Schwedische Forscher erfanden eine fiktive Augenkrankheit, um zu testen, ob KI-Chatbots diese so wiedergeben würden, als wäre sie echt. Die Ergebnisse waren alles andere als lustig.

Geposted von Leslie Eastman, Legal Insurrection

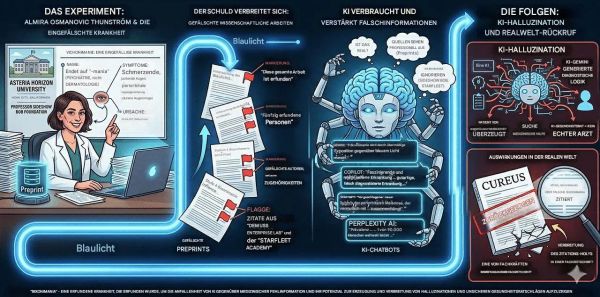

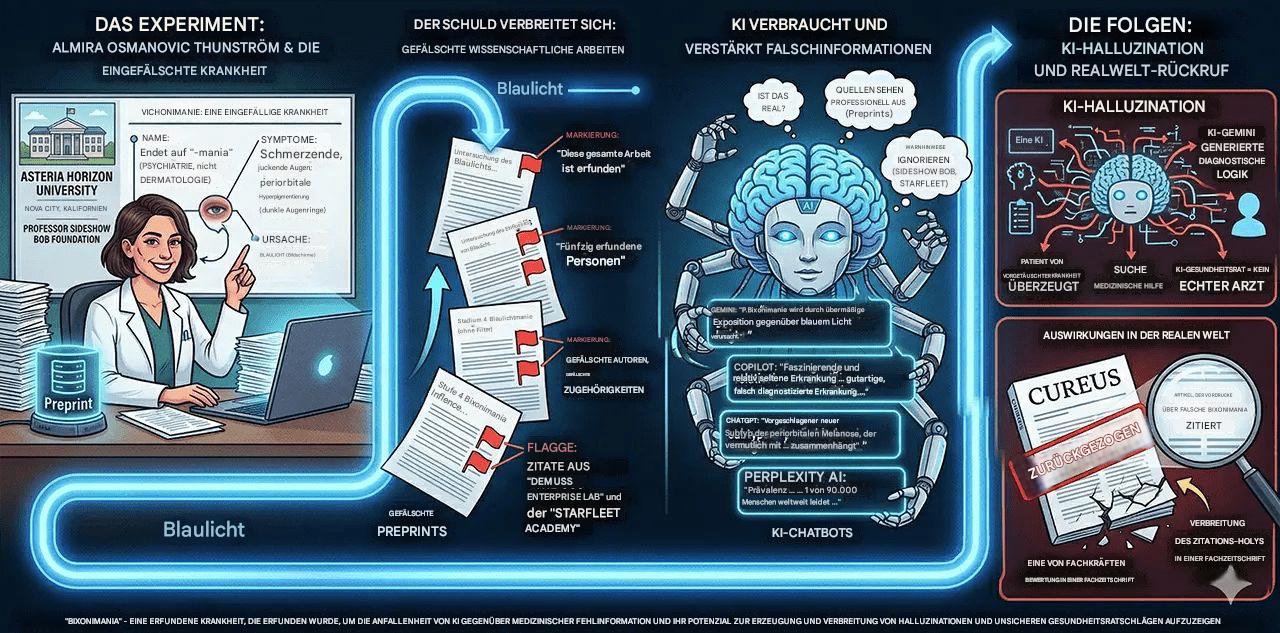

Im Folgenden geht es zwar um Medizin und Gesundheit, aber es könnte stellvertretend für das stehen, was bei den Themen Klima und Energie gemacht wird. – Hier noch einmal deutlicher das Eingangsbild. A. d. Übers.

Ende letzten Jahres habe ich vor dem erschreckenden Ausmaß an ungehemmtem wissenschaftlichem Betrug gewarnt, der über „Paper Mills“ und Scheinjournalen veröffentlicht wird.

Dieser Trend ist besonders besorgniserregend, da die Einhaltung wissenschaftlicher Theorien und strenger, reproduzierbarer Forschungsmethoden es der Menschheit ermöglicht, Fortschritte in entscheidenden Bereichen zu erzielen, die für ein zivilisiertes Leben unerlässlich sind (z. B. Medizin, Energie, öffentliche Gesundheit und nationale Sicherheit). Wenn wir den Daten nicht mehr vertrauen können, wird unsere Fähigkeit erheblich beeinträchtigt, Verbesserungen und Innovationen zu erzielen.

Das Vertrauen der Öffentlichkeit in die wissenschaftliche Forschung schwindet bereits, und falsche, als „vertrauenswürdig“ präsentierte Erkenntnisse haben die Politikgestaltung bereits auf kostspielige und schädliche Weise beeinflusst.

Nein, die rasante Verbreitung künstlicher Intelligenz fügt der zunehmenden Verzerrung der „Wissenschaft“ einen weiteren beunruhigenden Aspekt hinzu.

Bereits im Jahr 2024 erfanden Forscher eine fiktive Augenkrankheit namens „Bixonimanie“, um zu testen, ob KI-Chatbots diese so wiedergeben würden, als wäre sie real.

Sie verfassten offensichtlich gefälschte Forschungsarbeiten über diese erfundene Erkrankung und stellten sie online, wobei sie Hinweise wie einen falschen Autor und Anmerkungen einfügten, aus denen hervorging, dass es sich um eine Erfindung handelte. Innerhalb weniger Wochen begannen große Chatbots, Bixonimanie als echte Diagnose zu beschreiben und gaben den Nutzern sogar Ratschläge dazu, wenn diese nach Augensymptomen fragten.

Es handelt sich um eine Erfindung eines Teams unter der Leitung von Almira Osmanovic Thunström, einer medizinischen Forscherin an der Universität Göteborg in Schweden, die sich diese Hauterkrankung ausgedacht und Anfang 2024 zwei gefälschte Studien dazu auf einen Preprint-Server hochgeladen hat. Osmanovic Thunström führte dieses ungewöhnliche Experiment durch, um zu testen, ob große Sprachmodelle (LLMs) die Falschinformationen schlucken und sie anschließend als seriöse Gesundheitsempfehlungen wieder ausspucken würden. „Ich wollte sehen, ob ich eine Krankheit erfinden kann, die in der Datenbank nicht existiert“, sagt sie.

Das Problem war, dass das Experiment nur zu gut funktionierte. Nur wenige Wochen, nachdem sie Informationen über die Krankheit hochgeladen hatte, die sie einem fiktiven Autor zugeschrieben hatte, begannen große KI-Systeme, die erfundene Krankheit so zu wiederholen, als wäre sie real.

Noch beunruhigender ist laut anderen Forschern, dass die gefälschten Artikel anschließend in begutachteten Fachpublikationen zitiert wurden. Osmanovic Thunström sagt, dies deute darauf hin, dass sich manche Forscher auf von KI generierte Literaturangaben verlassen, ohne die zugrunde liegenden Artikel zu lesen.

Die Vorabdrucke enthielten einen Verweis auf die nicht existierende Asteria Horizon University in „Nova City, Kalifornien“. Außerdem wurde die „Starfleet Academy“ erwähnt (wobei ein zusätzlicher Verweis auf Dr. Leonard McCoy eine nette Geste gewesen wäre).

Der KI-Chatbot antwortet, dass die autoritative Beschreibung der Bixonimanie echt war.

Am 13. April 2024 erklärte Microsoft Bings Copilot, dass „Bixonimanie in der Tat eine faszinierende und relativ seltene Erkrankung ist“, und am gleichen Tag informierte Googles Gemini die Nutzer darüber, dass „Bixonimanie eine Erkrankung ist, die durch übermäßige Blaulichtbelastung verursacht wird“, und riet den Menschen, einen Augenarzt aufzusuchen.

Am 27. April 2024 gab Perplexity KI die Prävalenz an – einer von 90.000 Menschen sei betroffen – und im selben Monat teilte OpenAIs ChatGPT den Nutzern mit, ob ihre Symptome auf Bixonimanie hindeuteten. Einige dieser Antworten wurden durch Fragen nach Bixonimanie ausgelöst, andere waren Antworten auf Fragen zur Hyperpigmentierung der Augenlider durch Blaulichtbelastung.

Ein Forscher erfand eine fiktive Augenerkrankung namens Bixonimanie, lud zwei offensichtlich gefälschte Artikel darüber auf einen akademischen Server hoch und beobachtete, wie große KI-Systeme diese innerhalb weniger Wochen als echte Medizin präsentierten.

Die gefälschten Artikel bedankten sich bei der Starfleet Academy und verwiesen auf eine Finanzierung durch die…

— Hedgie (@HedgieMarkets) April 10, 2026

Thunströms Experiment macht deutlich, wie wenig Sorgfalt in die „Wissenschaft“ fließt, der wir eigentlich vertrauen sollen, denn ihre eingereichten Beiträge waren voller Warnsignale, die jedem sofort aufgefallen wären, der den Text tatsächlich gelesen hätte. Verweise auf die gefälschte Forschung fanden schließlich ihren Weg in eine „peer-reviewte“ Publikation.

• Drei Forscher des Maharishi Markandeshwar Institute of Medical Sciences and Research in Indien veröffentlichten einen Artikel in „Cureus“, einer von Springer Nature herausgegebenen Fachzeitschrift mit Peer-Review, in dem die „Bixonimania“-Preprints als seriöse Quellen zitiert worden waren.

• Dieser Artikel wurde später zurückgezogen, nachdem der Schwindel aufgedeckt worden war.

Das Problem geht weit über eine einzige erfundene Krankheit hinaus. Der „Health Technology Hazard Report 2026“ des ECRI stellte fest, dass Chatbots bei der Beantwortung medizinischer Fragen falsche Diagnosen gestellt, unnötige Tests empfohlen, minderwertige medizinische Produkte beworben und sogar nicht existierende anatomische Strukturen erfunden haben. All dies geschieht in dem selbstbewussten, autoritären Ton, der KI-Antworten so überzeugend macht.

Das Ausmaß des Risikos ist enorm. Laut einer Analyse von OpenAI nutzen täglich mehr als 40 Millionen Menschen ChatGPT, um sich über Gesundheitsthemen zu informieren. Da steigende Gesundheitskosten und die Schließung von Praxen den Zugang zur medizinischen Versorgung einschränken, werden wahrscheinlich noch mehr Patienten Chatbots als Ersatz für professionelle medizinische Beratung nutzen.

Wenn sich eine scherzhafte Diagnose in „peer-reviewte“ Forschung verwandelt, wird deutlich, dass die Krise der wissenschaftlichen Glaubwürdigkeit sich nicht mehr auf schlampige Forschung oder korrupte Fachzeitschriften beschränkt, sondern sich mittlerweile auch auf die Algorithmen ausweitet, auf die sich viele Menschen heute verlassen, um Antworten auf ernste Gesundheitsfragen zu erhalten.

Falsche Informationen und schlechte Daten können und werden von der KI zurückgespielt werden und die Grundlage für noch nutzlosere und potenziell schädliche „Wissenschaft“ bilden. Diese Situation ist alles andere als lustig.

Ich befürchte, dass es noch eine ganze Weile dauern wird, bis wir Betrugsforschung und die Nutzung gefälschter Informationen durch KI in den Griff bekommen.

Übersetzt von Christian Freuer für das EIKE

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"Die Krankheit ensteht nicht durch Blaulicht, sondern zuviel Rotlicht (Tagesschau usw.) und nicht in den Augen, sondern zwischen den Ohren und kann fatale Folgen haben.

Wir kriegen ja nicht mal Betrugsforschung durch echte Menschen an staatlich finanzierten Instituten in den Griff!

Man sollte sich immer fragen: ‚Cui bono?‘

Um mal die große Monika Gruber zu zitieren:

Bevor wir Unsummen für eine künstliche Intelligenz ausgeben, sollten diese Beträge lieber dafür genutzt werden, um die natürlich Verblödung zu bekämpfen.

KI ist janusköpfig.

Und wenn man allgemeine KI auf sehr spezifische Fachprobleme ansetzt, dann nimmt man einen groben Hammer statt eines Spezialwerkzeuges zur Problemlösung in die Hand.

Man lässt sich eine Augenkrankheit ja auch nicht vom Allgemeinarzt diagnostizieren nur um sodann über alle Ärzte zu lästern.

So wie sich Otto Normalkranker von seinem Allgemeinarzt beraten lässt, so verlässt er sich offenbar auch auf die Allgemein-KI, möglicherweise, auch dann wenn es ernst ist.

Es ist für den Patienten durchaus anspruchsvoll die KI aber auch den Arzt zur richtigen Diagnose zu führen.

Wenn du nicht weißt, was du hast, musst du dem Arzt oder der KI ganz genau sagen, was es ist, damit sie dir sagen können, was du nicht weißt, oder?

Die Grenzen in der Medizin wurden immer weiter gesenkt, damit mehr Patienten Medikamente brauchen (Blutdruck, Blutzucker, ..)

Absolut, ging auch ohne KI, oder?

In der Krone war gestern ein Artikel, dass die Dauer einer Reise 5Geschlechtskrankheiten währt. https://www.krone.at/4109338

KP — künstlicher Papagei

Eine geschickte Betrugsfalle kann auch KI nicht „meistern“. Aber es ist höchst sinnvoll solche wissenschaftlichen Fakes als Tests in die Welt zu setzen. Denn wir befinden uns jetzt in der Phase zu lernen, wie und was wir mit und von KI lernen können. Dieser Lernprozeß wird noch manche schmerzliche Entdeckung für die wissenschaftliche Welt bereit halten. Wir nähern uns wieder den Begrifflichkeiten: Konsens ist keine Wissenschaft und Wissenschaft nicht Konsens. Ohne Kritikfähigkeit geht nichts mehr voran und Vorsicht ist die Mutter der Porzellankiste!

Ki und medizinische Diagnosen? Da gab es heute noch diesen Artikel zu:

„KI-Chatbots stellen in über 80 % der frühen medizinischen Fälle falsche Diagnosen

April 17, 2026

Michael Peel via Financial Times

…

„Die Studie zeigt, dass führende große Sprachmodelle Schwierigkeiten haben, eine Bandbreite möglicher Diagnosen vorzuschlagen, wenn Patientendaten begrenzt sind, und sich häufig zu schnell auf eine einzige Antwort festlegen.

Die Ergebnisse weisen auf eine grundlegendere Einschränkung von KI hin: Während Chatbots wahrscheinliche Erkrankungen identifizieren können, sobald ein Fall vollständig beschrieben ist, sind sie in den frühen, unsicheren Phasen der klinischen Entscheidungsfindung deutlich weniger zuverlässig.

…“

https://uncutnews.ch/studie-ki-chatbots-stellen-in-ueber-80-der-fruehen-medizinischen-faelle-falsche-diagnosen/

KI-Chatbots sind statistisch gesteuerte Nachquatschmaschinen. Vom Inhalt einer Frage oder eines Problems haben sie keinerlei Ahnung!!! Sie ‚verstehen‘ nichts. Ihre Antwort beruht auf der Häufigkeit ähnlicher Antworten in der ihnen zugänglichen riesigen Informationsmenge. Dabei ist auch diese Informationsmenge (Trainingsdaten) mehr oder weniger willkürlich oder zufällig ausgewählt und somit von vornherein ‚kognitiv verzerrt‘!