https://x.com/cohler/status/2045615260443279694

Zusammenfassung meines Vortrags auf der ICCC16 am 8. April 2026.

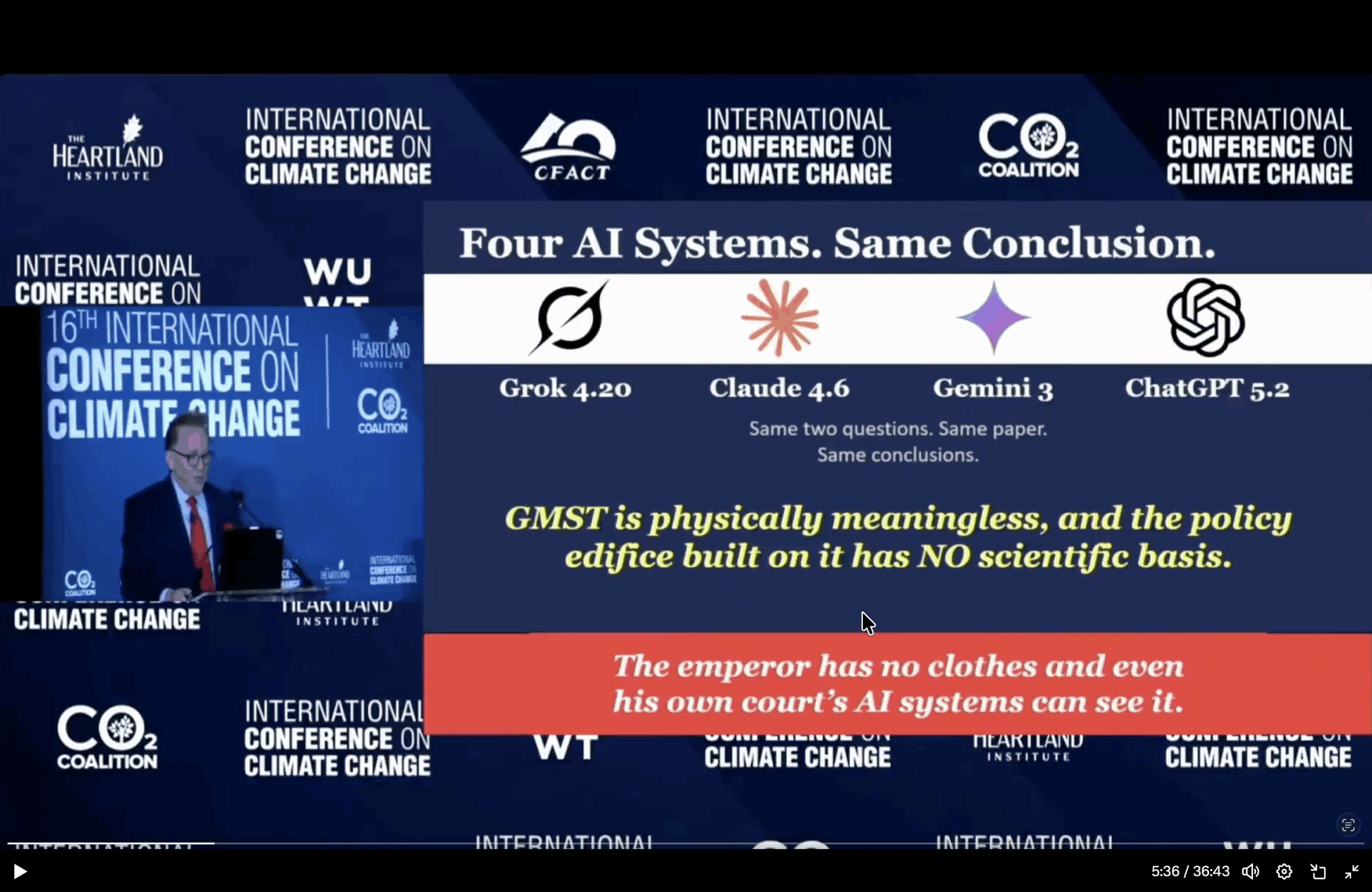

John Cohler bei seinem Vortrag Heartland Climate Conference April 2026

Die dieser Analyse zugrunde liegenden Dokumente sind unter

http://papers.jcohler.com verfügbar.

Seit fast vier Jahrzehnten wird der Welt eine Geschichte erzählt: Die Erde erwärmt sich in alarmierendem Tempo, der Mensch ist dafür verantwortlich, indem er fossile Brennstoffe verbrennt, und wenn wir nicht Billionen von Dollar investieren, um dies zu verhindern, droht eine Katastrophe. Regierungen haben ihre Wirtschaften auf diese Geschichte ausgerichtet. Kinder wachsen mit Angst davor auf. Wissenschaftler, die sie hinterfragen, werden ausgegrenzt.

Es gibt da nur ein Problem. Die wissenschaftliche Grundlage dieser Argumentation – jede einzelne Zahl, die der IPCC verwendet – ist physikalisch bedeutungslos. Nicht unsicher. Nicht diskutabel. Physikalisch bedeutungslos, genauso wie der Durchschnitt aller Telefonnummern in Washington, D.C., bedeutungslos ist. Man kann ihn berechnen. Die Rechnung stimmt. Aber das Ergebnis sagt absolut nichts über die Realität aus.

Das ist keine abwegige Behauptung. Es handelt sich um einen mathematischen und physikalischen Beweis, der auf wissenschaftlichen Artikeln und den Grundprinzipien der Thermodynamik basiert. Und wenn man es einmal erkannt hat, kann man es nicht mehr ignorieren.

Die erste Lüge: Eine Temperatur, die nicht existiert

Alles beginnt mit der globalen mittleren Oberflächentemperatur (GMST). Diese eine Zahl – üblicherweise als Abweichung vom vorindustriellen Niveau angegeben – bildet die Grundlage der gesamten IPCC-Studie. Wenn Sie hören, dass sich die Erde seit der industriellen Revolution um 1,2 Grad erwärmt hat, sprechen Sie von der GMST. Wenn Klimamodelle eine Erwärmung von 2, 3 oder 4 Grad bis zum Jahr 2100 prognostizieren, beziehen sie sich auf Veränderungen der GMST. Wenn das Pariser Abkommen eine Obergrenze von 1,5 Grad festlegt, ist dies eine Obergrenze für die GMST.

Was genau ist GMST? Hier beginnt die Geschichte sich zu entwirren.

Temperatur ist in der Physik eine sogenannte intensive Größe. Das bedeutet, sie beschreibt den Zustand eines spezifischen physikalischen Systems – eines Systems mit Grenzen, das sich im oder nahe am thermischen Gleichgewicht befindet und dessen Zustandsgleichung eindeutig definiert ist. Man kann sinnvoll über die Temperatur einer Tasse Kaffee, eines Zimmers oder des Ozeans in einer bestimmten Tiefe sprechen, da es sich dabei jeweils um ein definiertes physikalisches System handelt. Was man jedoch nicht tun kann, ohne die Gesetze der Thermodynamik zu verletzen, ist, Temperaturen von Systemen zu addieren, die nicht in thermischem Kontakt miteinander stehen, und das Ergebnis als „Temperatur“ zu bezeichnen.

Die Erdoberfläche ist kein thermodynamisches System. Sie ist ein Flickenteppich aus Tausenden von lokalen Systemen – Wüsten und Regenwäldern, polaren Eisschilden und tropischen Ozeanen, Berggipfeln und Talsohlen –, von denen keines mit den anderen im thermischen Gleichgewicht steht. Die Mittelung ihrer Temperaturen ergibt zwar einen Wert. Dieser Wert ist aber keine Temperatur im physikalisch sinnvollen Sinne. Er unterliegt keiner Zustandsgleichung. Es gibt kein physikalisches Gesetz, das ihn mit irgendetwas verknüpft. Wie der Physiker Christopher Essex und seine Kollegen in einer Veröffentlichung aus dem Jahr 2007 überzeugend darlegten, ist er schlichtweg keine Temperatur.

The Emperor Has No Clothes: How the IPCC Built a 38-Year Climate Empire on a Circle of Lies

Summary of my talk at ICCC16 on April 8, 2026.

The papers underlying this analysis are available at https://t.co/ym4Iv7EjWR.For nearly four decades, the world has been told a story. The… https://t.co/EwuAzclQxL

— Jonathan Cohler (@cohler) April 18, 2026

Das ist keine bloße Formalität. Es handelt sich um einen Kategorienfehler, der in jedem anderen Wissenschaftsbereich ein Forschungsprogramm sofort beenden würde. Intensive Eigenschaften über Nichtgleichgewichtssysteme hinweg zu mitteln, ist so, als würde man die Postleitzahlen aller Einwohner New Yorks mitteln und das Ergebnis dann als Wegbeschreibung verwenden. Die Rechnung liefert eine Zahl. Diese Zahl ist bedeutungslos.

Die Internationale Organisation für Normung (ISO) erkannte dies bereits vor Jahrzehnten implizit an. 2002 wurde die ISO beauftragt, alle wichtigen Begriffe im Zusammenhang mit dem Klimawandel zu definieren – und bis heute fehlt der Begriff „globale Durchschnittstemperatur“ in den finalen Definitionen. Diese Auslassung ist kein Versehen. Der Auftrag der ISO erfordert messtechnische Genauigkeit, und der Begriff „globale Durchschnittstemperatur“ kann diesen Anforderungen nicht gerecht werden.

Weder der IPCC noch irgendeine andere Klimabehörde hat jemals eine präzise physikalische Definition der globalen mittleren Oberflächentemperatur (GMST) vorgelegt. Sie verwenden den Begriff ständig – er taucht in praktisch jedem Kapitel des Sechsten Sachstandsberichts des IPCC auf –, aber sie haben nie definiert, welche physikalische Größe er repräsentiert, weil eine solche Definition nicht möglich ist.

Die zweite Lüge: Modelle, die auf nichts basieren

Wenn GMST physikalisch bedeutungslos ist, was leisten dann die Klimamodelle des IPCC eigentlich?

Die Antwort ist unbequem. Jedes der vom IPCC verwendeten wichtigen Klimamodelle – das Ensemble CMIP (Coupled Model Intercomparison Project) – ist darauf ausgelegt, historische Trends der mittleren globalen Oberflächentemperatur (GMST) zu reproduzieren. Diese Modelle verfügen über Hunderte von anpassbaren Parametern, die so eingestellt werden, dass die Modellausgabe mit den beobachteten GMST-Daten übereinstimmt. Diesen Vorgang nennt man Validierung: Man passt das Modell so lange an, bis es zu den Daten passt, und erklärt es dann anhand der Beobachtungen für validiert.

Wenn die globale mittlere Oberflächentemperatur (GMST) jedoch keine physikalisch sinnvolle Größe darstellt, ist die Anpassung eines Modells an ihre Reproduktion keine Validierung. Es handelt sich vielmehr um eine Kurvenanpassung an eine Zahl ohne physikalischen Gehalt. Das Modell lernt, ein mathematisches Artefakt abzubilden, nicht die physikalische Realität. Und da es sich um gekoppelte globale Zirkulationsmodelle handelt – in denen die Temperatur mit Niederschlag, Wind, Meeresströmungen, Meereis und Dutzenden weiterer Variablen interagiert –, breitet sich diese Verfälschung überall aus. Jede vom Modell erzeugte Projektion erbt für jede Variable die ursprüngliche Bedeutungslosigkeit.

Die Auswirkungen sind erschreckend. Jede Temperaturprognose. Jede Meeresspiegelprognose. Jede Prognose extremer Wetterereignisse. Jede CO₂-Bilanz. Jede Berechnung der verbleibenden Emissionen. All das basiert auf Modellen, die anhand einer physikalisch nicht existierenden Größe validiert wurden.

Die dritte Lüge: Ein Ozean, der nie vermessen wurde

Da die Aufzeichnungen der Oberflächentemperatur umstritten und unzuverlässig waren, entwickelte der IPCC eine zweite Beweiskette: den Wärmeinhalt der Ozeane (OHC). Die Argumentation war einfach: Wenn die Erde durch den Treibhauseffekt Energie speichert, muss diese Energie irgendwohin fließen, und der größte Teil davon sollte in die Ozeane gelangen. Misst man den Wärmeinhalt der Ozeane über einen längeren Zeitraum, erhält man ein direktes Maß für das Energieungleichgewicht der Erde.

Dieses Argument klingt überzeugend. Es basiert auf dem Programm Argo – einem Netzwerk von rund 4.400 Roboterbojen, die in den Weltmeeren verteilt sind. Jede Boje taucht bis zu 2.000 Meter tief und steigt alle zehn Tage wieder an die Oberfläche, wobei sie Temperatur- und Salzgehaltsprofile übermittelt. Argo ist eine echte wissenschaftliche Leistung, ein technisches Meisterwerk, das eine enorme Menge wertvoller ozeanografischer Daten geliefert hat.

Laut den Gründungsdokumenten von 1998 war Argo ursprünglich für Folgendes konzipiert: die Beobachtung des sich verändernden physikalischen Zustands der oberen Ozeanschichten, die Erfassung regionaler Wärme- und Salzgehaltsmuster, die Unterstützung der Wettervorhersage und die Ergänzung von Satellitenaltimetern. Der globale Wärmegehalt der Ozeane und das Energieungleichgewicht der Erde werden nirgends erwähnt. Das Programm war nicht für diesen Zweck gedacht und ist dafür grundlegend ungeeignet.

Das Problem beginnt mit grundlegenden physikalischen Prinzipien. Wenn eine Argo-Boje innerhalb von sechs bis zehn Stunden von 2.000 Metern Tiefe zur Oberfläche aufsteigt, sammelt sie dabei etwa 1.000 Temperaturmessungen. Die Boje driftet jedoch die ganze Zeit. Bis sie auftaucht und per Satellit Daten sendet, kann sie sich bis zu 50 Kilometer von der Stelle entfernt befinden, an der die tiefsten Messungen durchgeführt wurden. Diese Messungen werden alle der GPS-Position an der Oberfläche zugeordnet – dem einzigen tatsächlich bekannten Standort. Die tatsächliche Unterwasserbahn ist völlig unbekannt. Jeder einzelne Datenpunkt unter Wasser wird dem falschen Standort zugeordnet.

Dann beginnt die Interpolation. Die 12.000 monatlichen Messwerte – die bereits räumlich falsch zugeordnet sind – werden verwendet, um 45.000 dreidimensionale Gitterzellen zu füllen, die den globalen Ozean abdecken. Der größte Teil des Ozeans wird gar nicht gemessen, sondern berechnet. Polargebiete, Küstenzonen und Randmeere werden weitgehend ausgeschlossen. Etwa die Hälfte des gesamten Ozeanvolumens, einschließlich aller Wassermassen unterhalb von 2.000 Metern, wird schlichtweg ignoriert. Die Berechnungen verwenden Korrelationsfunktionen, die Messwerte von Wassermassen vermischen, die Hunderte oder sogar Tausende von Kilometern voneinander entfernt liegen, und so jegliche lokale Information zerstören, die die Messbojen tatsächlich erfasst haben.

Die aus diesem Prozess berechneten Anomalien – die Abweichungen von einem historischen Referenzwert – stoßen dann auf dasselbe grundlegende physikalische Problem wie GMST. Temperatur ist eine intensive Größe. Man kann Temperaturanomalien nicht sinnvoll über Nichtgleichgewichtsvolumina des Ozeans mitteln, genauso wenig wie über die Erdoberfläche. Der resultierende Wert hat zwar eine Einheit und die Berechnung ist korrekt, aber er repräsentiert keine physikalische Realität.

Wenn alle relevanten Unsicherheitsquellen – nicht erfasste Trajektorien, Interpolationsfehler, unzureichende Kenntnisse über die Tiefsee, Lücken in den Polargebieten und uneinheitliche Messrahmen – korrekt quantifiziert werden, beträgt die tatsächliche Unsicherheit des abgeleiteten Wertes für das Energieungleichgewicht der Erde mehr als ± 1 Watt pro Quadratmeter bei einer Wahrscheinlichkeit von 95 %. Der sechste Sachstandsbericht des IPCC gibt sie mit 0,7 ± 0,2 Watt pro Quadratmeter an. Die tatsächliche Unsicherheit ist etwa fünfmal größer als das gemessene Signal. Das Ergebnis ist statistisch nicht von null zu unterscheiden.

Die vierte Lüge: Satelliten wurden an die Fiktion angepasst

Der IPCC präsentiert seine Daten zum Wärmegehalt der Ozeane und seine satellitengestützten Daten zum Energieungleichgewicht als zwei unabhängige, übereinstimmende Beweisketten. Diese Übereinstimmung wird als starke Bestätigung dafür angeführt, dass die Erde Energie in dem behaupteten Ausmaß speichert.

Was der IPCC nicht prominent in den Vordergrund rückt, ist, wie diese Einigung zustande kam.

Die CERES-Instrumente der NASA – Satelliten zur Messung der Strahlungsbilanz am oberen Rand der Atmosphäre – liefern Rohmesswerte mit einer absoluten Unsicherheit von etwa drei bis fünf Watt pro Quadratmeter. Das vom IPCC angegebene Messsignal beträgt 0,7 Watt pro Quadratmeter. Die Satelliten allein können diese Größe nicht bestimmen.

Was wurde also getan? Die CERES-Daten wurden – mittels einer Methode der kleinsten Quadrate – angepasst, um eine Übereinstimmung mit der aus Argo-Daten abgeleiteten Schätzung des Wärmegehalts der Ozeane zu erzielen. Die Dokumentation des IPCC-Berichts AR6 bestätigt dies ausdrücklich: Die CERES-Flüsse „wurden innerhalb der geschätzten Unsicherheiten angepasst, um sicherzustellen, dass der Nettofluss an der Obergrenze der Atmosphäre mit der auf Basis von Messungen des Wärmegehalts der Ozeane geschätzten Energiebilanz der Erde übereinstimmt.“

Anders ausgedrückt: Sie haben die Satelliten so ausgerichtet, dass sie mit den Driftbojen übereinstimmten, und diese Übereinstimmung dann als unabhängige Bestätigung angeführt. Das ist keine Wissenschaft. Das ist ein Zirkelschluss mit unnötigen Umwegen.

Dieses Verhalten ist im IPCC-Ökosystem nicht beispiellos. Kevin Trenberth, einer der Architekten des Modells zur Berechnung des Wärmegehalts der Ozeane, schrieb in einer mittlerweile berüchtigten E-Mail aus dem Jahr 2009, die durch die ClimateGate-Enthüllungen ans Licht kam: „Tatsache ist, dass wir die derzeit ausbleibende Erwärmung nicht erklären können, und es ist eine Farce, dass wir es nicht können. Die im August veröffentlichten CERES-Daten zeigen, dass es eigentlich noch stärkere Erwärmung geben müsste: aber die Daten sind mit Sicherheit falsch.“ Wenn die Satellitendaten nicht mit den Modellen übereinstimmen, gelten die Satelliten als falsch. Wenn die Satellitendaten so angepasst werden, dass sie übereinstimmen, wird diese Übereinstimmung als Bestätigung angeführt. Das System ist von vornherein manipuliert.

Die fünfte Lüge: Der CO-Fingerabdruck ₂ , der nie existierte

Die letzte Säule der IPCC-Argumentation ist die Zuordnung des Kohlendioxids. Zwar ist der CO₂-Gehalt ₂ in der Atmosphäre gestiegen, und menschliche Industrieaktivitäten emittieren CO₂ ₂ . Doch der IPCC geht noch weiter und behauptet, der Anstieg des atmosphärischen CO₂ ₂ sei fast ausschließlich anthropogen bedingt – natürliche Prozesse könnten ihn nicht erklären, und die Isotopenzusammensetzung des atmosphärischen CO₂ ₂ liefere einen eindeutigen menschlichen Fingerabdruck.

Diese Behauptung stützt sich auf das Berner Modell, ein mathematisches Modell, das die CO₂-Verteilung ₂ zwischen Atmosphäre und natürlichen Speichern beschreibt. Das Berner Modell weist eine besonders alarmierende Eigenschaft auf: Es prognostiziert, dass ein erheblicher Anteil des heute emittierten CO₂ ₂ Jahrhunderte oder Jahrtausende in der Atmosphäre verbleiben wird. Der fünfte Sachstandsbericht des IPCC (AR5) besagt, dass 15 bis 40 Prozent des emittierten CO₂ ₂ über tausend Jahre in der Atmosphäre verbleiben werden. Dies ist die Grundlage für CO₂-Budgets und Klimaneutralitätsziele.

Das Berner Modell wurde durch Beweise widerlegt, die seit sechzig Jahren offenkundig waren.

Als die atmosphärischen Atomtests Anfang der 1960er Jahre ihren Höhepunkt erreichten, wurde ein massiver Impuls radioaktiven Kohlenstoffs – Atom-14-Kohlenstoff (CO₂) – in die Atmosphäre freigesetzt. Dieser Impuls wird seither kontinuierlich verfolgt. Wäre das Berner Modell korrekt, müsste dieser Impuls langsam abklingen, wobei ein substanzieller permanenter Anteil zurückbliebe. Stattdessen klingt er exponentiell mit einer e-Faltungszeit von etwa siebzehn Jahren ab. Der Atom-14-Kohlenstoff ist verschwunden. Er durchlief das System und wurde innerhalb von etwa einem halben Jahrhundert vollständig absorbiert. Das multi-exponentielle Berner Modell mit seinem permanenten Anteil in der Atmosphäre ist schlichtweg falsch. CO₂ ₂ verbleibt nicht über Jahrtausende in der Atmosphäre. Es durchläuft das System innerhalb von Jahren bis Jahrzehnten.

Die Isotopenanalyse bestätigt dies. Das Kohlenstoffisotopenverhältnis im atmosphärischen CO₂ ₂ – die sogenannte Delta-13C-Größe – nimmt ab, da sich das isotopisch leichtere CO₂ aus fossilen Brennstoffen ₂ mit der Atmosphäre vermischt. Der IPCC wertet diesen Rückgang als eindeutigen Beweis für die menschliche Verursachung.

Eine 2024 von Fachkollegen begutachtete Studie von Prof. Demetris Koutsoyiannis untersuchte die tatsächlichen Isotopendaten eingehend und fand etwas, das mit der gängigen Lehrmeinung nicht vereinbar ist: Die Netto-Isotopensignatur des atmosphärischen Eintrags ist seit der Kleinen Eiszeit im Wesentlichen unverändert geblieben. Der Wert ist stabil geblieben – weltweit, an allen wichtigen Messstationen und während der gesamten Industrialisierungsphase. Ein sich verändernder menschlicher Einfluss müsste sich in einer veränderten Nettosignatur widerspiegeln. Das ist jedoch nicht der Fall. Die Isotopenzusammensetzung ist mit der Dominanz der natürlichen Biosphäre und einem nicht nachweisbaren menschlichen Beitrag vereinbar.

Der Grund dafür ist nicht mysteriös. Die Biosphäre – Pflanzen, Böden, Ozeane – zirkuliert jährlich etwa 25-mal mehr Kohlenstoff als die menschlichen Industrieemissionen. Natürliche Prozesse sind dabei mit Abstand dominant. Menschliche Emissionen stellen lediglich ein Rauschen dar, das einem gewaltigen natürlichen Signal überlagert ist. Und die Temperatur, nicht menschliche Aktivitäten, ist für den größten Teil dieses Signals verantwortlich: Die Erwärmung führt dazu, dass die Biosphäre mehr CO₂ ausstößt ₂ , was die atmosphärischen Konzentrationen erhöht. Die Kausalität verläuft von der Temperatur zum CO₂ ₂ , nicht umgekehrt.

5 x 0 = 0

Treten Sie einen Schritt zurück und betrachten Sie das Gesamtbild.

Die Argumentation des IPCC für eine vom Menschen verursachte Klimakatastrophe stützt sich auf fünf miteinander verknüpfte Indikatoren: die globale mittlere Oberflächentemperatur (GMST), die darauf abgestimmten Klimamodelle, den Wärmeinhalt der Ozeane, das aus der Wärme der Ozeane resultierende Energieungleichgewicht der Erde und die CO₂-Zuordnung ₂ . Jeder dieser Indikatoren wird als unabhängiger Beweis präsentiert. Zusammen bilden sie laut IPCC einen überwältigenden Beweis.

Sie sind jedoch nicht unabhängig. Sie bilden einen Kreis. Die globale mittlere Oberflächentemperatur (GMST) ist physikalisch bedeutungslos. Die Modelle sind auf die GMST abgestimmt und erben deren Bedeutungslosigkeit. Der Wärmegehalt der Ozeane wird durch ein Verfahren berechnet, das gegen die Gesetze der Messphysik verstößt und statistisch nicht von null zu unterscheiden ist. Die Energiebilanz der Erde wird aus dem Wärmegehalt der Ozeane abgeleitet und durch Satelliten bestätigt, die entsprechend justiert wurden. Die Zuordnung von CO ₂ basiert auf einem Modell, das durch Daten aus Atombombenversuchen widerlegt wurde, und einem Isotopen-Fingerabdruck, der in den Beobachtungen nicht existiert.

Jedes Glied der Kette ist von den anderen abhängig. Keines steht für sich allein. Der IPCC nennt dies „mehrere Beweisketten“. Doch fünf mal null ist immer noch null.

Was das bedeutet

Nichts davon beweist, dass sich das Klima nicht verändert oder das menschliche Aktivitäten keinen Einfluss auf die Atmosphäre haben. Das Klima verändert sich kontinuierlich, und das seit Milliarden von Jahren. Es zeigt lediglich, dass die spezifischen Kennzahlen, mit denen der IPCC die Krise quantifiziert – jede Zahl, die die Politik bestimmt, jede Zahl, die die Ausgaben rechtfertigt, jede Prognose, die die Öffentlichkeit verängstigt – auf einem Fundament beruhen, das den Gesetzen der Physik nicht standhält.

Die Internationale Organisation für Normung konnte keine globale Durchschnittstemperatur definieren, da diese den metrologischen Anforderungen nicht genügt. Vier verschiedene KI-Systeme, denen die mathematischen Argumente vorgelegt wurden, kamen unabhängig voneinander zum selben Ergebnis. Der Kaiser ist nackt – und selbst die Werkzeuge, die sein Hof zu seinem Schutz geschaffen hat, erkennen es.

Seit 38 Jahren wurde auf diesen Kennzahlen eine gewaltige wissenschaftliche und politische Infrastruktur aufgebaut. Billionen von Dollar an Ausgaben wurden damit gerechtfertigt. Karrieren, Institutionen und internationale Abkommen hängen von ihnen ab. Sie in Frage zu stellen, wurde als Ketzerei behandelt.

Doch die Physik verhandelt nicht. Eine Zahl ohne physikalische Bedeutung erhält diese nicht, nur weil einflussreiche Personen sie für nützlich halten. Eine Messung, die sich nicht von Null unterscheidet, wird nicht zum Beweis einer Krise, nur weil ein Satellit entsprechend justiert wurde. Ein Modell, das durch sechzig Jahre Atombomben-Kohlenstoffdaten widerlegt wurde, wird nicht gültig, nur weil es zehntausendmal zitiert wurde.

Die Arbeit ist getan. Die Artikel sind veröffentlicht. Die mathematischen Grundlagen stehen jedem zur Verfügung, der sie untersuchen möchte. Die Frage ist nun nicht wissenschaftlicher Natur. Es geht vielmehr darum, ob die Institutionen, die ihre Macht auf diesen Zahlen aufgebaut haben, endlich anerkennen werden, was die Physik ihnen seit jeher zu sagen versucht.

Der Kaiser ist nackt. Das war schon immer so. Und es ist längst überfällig, das auszusprechen.

Der Vortrag „Des Kaisers neue Kleider“ wurde auf der 16. Internationalen Klimakonferenz in Washington DC am 8. und 9. April 2026 gehalten

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"Ordentliche Quellenangaben wären hilfreich.

Bitte hier nur unter vollem Klarnamen posten, siehe Regeln.

Dann halten Sie sich auch dran, und geben Sie keinen geschlechtslosen Fantasienamen an.

Richtig, wie ist ihr tatsächlicher Name oder sind Sie ein geschlechtsloses KI-Wesen?

Bitte hier nur unter vollem Klarnamen posten, siehe Regeln.

Dann halten Sie sich auch dran, und geben Sie keinen geschlechtslosen Fantasienamen an.

Richtig, wie ist ihr tatsächlicher Name oder sind Sie ein geschlechtsloses KI-Wesen?

Wie der IPCC ein 38-jähriges Klimaimperium auf einem Lügengebäude errichtete

aber wie bringen wir es wieder zu Fall. Zumal in Mitteleuropa zufälligerweise auch 1987 auf 88 ein Klimawandel einsetzte. Er begann mit einem Temperatursprung und der anschließenden angenehmen Weitererwärmung bis heute.

Aber: Die Erwärmung geht nicht mehr weiter. Allein der April stagniert seit 20 Jahren, bei wärmeinselarmen Wettersationen seit 1998!!

Ich fürchte der Zug ist abgefahren. Mehr als 40 Jahre Gehirnwäsche lassen sich nicht in wenigen Jahren korrigieren. Erst müssen noch viel mehr Menschen ihren Wohlstand, ihre Arbeit und vielleicht auch noch ihre Wohnung verlieren um sich davon zu befreien.

Wie der IPCC ein 38-jähriges Klimaimperium auf einem Lügengebäude errichtete.

Schön, aber wie bringen wir es wieder zu Fall?

Es gibt stattdessen viel bessere, korrekte und elegantere Evidenz, die die Klimawissenschaft falsifiziert. Um da drauf zu kommen muss sich aber halt mit der Materie tiefergehend beschäftigen.

Lustiger Weise liefert die „Konsenswissenschaft“ selbst die Daten die sie falsifiziert, und das auch noch auf höchstnotpeinliche Weise. Hier Daten aus dem Anhang von Chung et al 2010. Die Proxydaten sollen ein stark positives Wasserdampf-Feedback beweisen, wobei ein „Planck Feedback“ = 3,6 unterstellt wird. Für das WD-Feedback ergibt sich dann zB. 3,6 – 2,1 = 1,5W/m2.

Der Witz: die Regression ist einfach falsch. Bei stark verrauschten x-Werten ist eine lineare Einfachregression (OLS) nicht zulässig. Das weiß jeder Statistiker, aber kein Klimawissenschafter. Besonders falsch wird das Ergebnis, wenn die numerische Verteilung vertikal ist.

Eine Re-Analyse der Daten zeigt das wunderbar auf. Invertiert man die OLS Regression erhält man Werte ~5W/m2. Sinnvoller hier ist allerdings eine orthogenale Regression (TLS), die dann jedenfalls eine Steigung von weit über 3,6 liefert. Das heißt diese Daten zeigen tatsächlich, dass WD ein stark negatives Feedback ist! Und ja, da fährt der Zug drüber.

Wozu all diese Unwahrheiten?

„Der Atom-14-Kohlenstoff ist verschwunden. Er durchlief das System und wurde innerhalb von etwa einem halben Jahrhundert vollständig absorbiert.“

Nein, wurde es nicht. Zwar ist die C14 Konzentration wieder auf den „natürlichen“ Ausgangswert abgesunken, aber zugleich fiel and fält der C14 Wert eben wegen der anthropogenen Emissionen. Ich habe schon gezeigt, dass man die C14 Kurve (leider) sehr gut mit verschienden Modellannahmen rekonstruieren kann.

Was man sicher sagen kann ist, dass die extrem restrikten Modellannahmen in der RCP Szenarios wo die Atmosphäre mit einem sekundären Reservoir nur doppelter Größe kommunizieren würde, welches dann ebenfalls „voll läuft“, falsch ist. Das zeigen alleine schon die vorindustriellen anthropogenen Emissionen. Viel mehr lässt sich aus diesen Daten vorerst noch nicht ableiten.

https://greenhousedefect.com/basic-greenhouse-defects/co2-sinks-and-the-ocean

Es gibt keine physikalisch plausible Begründung für eine Klimaerwärmung durch ir-anregbare Spurengase. Von daher ist völlig egal wieviel, und wie lange, das „anthropogene“ CO2 in der Atmosphäre verbleibt. Eine Geisterdiskussion mit einer durchgeknallten Klimasekte….

Es ist zweifellos wichtig, die Schwachstellen des Klimakonzeptes immer wieder aufzuzeigen, und hier hat der Artikel von Jonathan Cohler zweifellos seine Verdienste. Umso ärgerlicher, wenn dabei unsinnige Aussagen sich mit sinnvollen mischen.

Cohler ist sich nicht zu schade für die Behauptung, das Mitteln von Temperaturen sei: „Physikalisch bedeutungslos, genauso wie der Durchschnitt aller Telefonnummern in Washington, D.C.“ Dieser Vergleich hinkt nicht nur, er ist geradezu beinamputiert!

Ein Temperaturwert ist eine Maßzahl. Das heißt v.a., man kann sie nach kleiner, gleich oder größer ordnen, und grundsätzlich ist auch das Rechnen damit erlaubt.

Eine Telefonnummer ist etwas vollkommen anderes: es handelt sich um eine reine Codierung. Sie hat kein Maß und ist keine Zahl im eigentlichen Sinne, auch wenn zur Codierung Ziffern verwendet werden. Man könnte statt der Ziffern genau so gut Buchstaben nehmen oder irgendwelche chinesischen Zeichen oder meinetwegen Farbtöne.

Wenn Cohler also meint, mit Telefonnummern rechnen zu können, macht er nicht weniger als einen Kategorienfehler – also genau das, was er dem IPCC vorwirft (Zitat: „Es handelt sich um einen Kategorienfehler, der in jedem anderen Wissenschaftsbereich ein Forschungsprogramm sofort beenden würde.“)!

Diejenigen, die vehement behaupten, die ermittelte Globaltemperatur ist bedeutungslos und lässt keine Aussagen über den energetischen Zustand der Erde zu, können sicher ganz einfach folgende Fragen beantworten:

1. Warum stimmen die Jahreswerte so gut überein? Das klingt trivial, ist aber bei einer

bedeutungslosen Zahl ohne Bindung zur Realität nicht zu erwarten.

2. Wieso wird der Jahresgang der globalen Temperatur (spezifisch für die Wasser- und

Lufttemperaturen) immer wieder korrekt abgebildet, wenn dieser Wert keinen Bezug

zum Energiegehalt des Erdsystems hat? Bei den Meerestemperaturen sind das

Änderungen im Zehntelgrad-Bereich!

3. Warum lassen sich in den globalen Temperaturreihen gut untersuchte Oszillationen

(z.B. ENSO) oder Störungen (Vulkanausbrüche) klar erkennen?

4. Weshalb korreliert der gemessene Temperaturanstieg erstaunlich gut mit dem

Meeresspiegelanstieg?

Ich bin auf die Antworten gespannt. Beste Grüße, Ole

„4. Weshalb korreliert der gemessene Temperaturanstieg erstaunlich gut mit dem

Meeresspiegelanstieg?“

Welchen gemessenen Temperaturanstieg meinen Sie?

Und welchen korrelierenden Meeresspiegelanstieg haben Sie dabei im Blick?

Da die Temperaturzeitreihen gerade in der modernen Ära (seit 1980) kaum voneinander zu unterscheiden sind, dürfen Sie sich eine aussuchen. Egal ob Landmessstellen, Satellitendaten oder Reanalyse-Produkte: Darin sehen Sie immer einen Temperaturanstieg der zum Meerespiegelanstieg (Pegelmessungen oder Satellit) passt. Mittlerweile hat man die jeweiligen Teilursachen für den Anstieg so gut aufgeschlüsselt, dass das Gesamtbudget sehr gut hinkommt. Aber so kompliziert meinten Sie es wahrscheinlich nicht, oder?

Das klingt nach einer sauberen Korrelation, aber bei genauerem Hinsehen vermischen Sie hier ein statistisches „Oberflächentemperatur“-Konstrukt mit einer volumetrischen Energiebilanz.

Dass die Kurven optisch ähnlich verlaufen, heilt nicht die thermodynamischen Mängel des GMST-Konstruktes, der Nicht-Temperatur.

Der Meeresspiegel steigt z.B. unter anderem durch thermische Ausdehnung (sterischer Anstieg). Aber das Wasser dehnt sich nicht wegen der GMST-Statistik aus, sondern wegen der Energieaufnahme in der Tiefe (Ocean Heat Content).

Die GMST ist ein geometrisch flächenmäßiges statistisches Konstrukt aus Oberflächentemperaturen, dem man °C unthermodynamisch anhängt.

Der Meeresspiegel reagiert auf die totale Enthalpie des Ozeans über die gesamte Tiefe.

Dass beide steigen/sinken, zeigt nur, dass Energie ins/aus dem System fließt. Es legitimiert aber nicht die GMST als physikalisch korrekte Messgröße. Eine Korrelation ist keine Kausalität – das eine hängt von der Energiebilanz ab, das andere ist geometrische Statistik.

Wenn Sie von Pegelmessungen sprechen: Wie rechnen Sie die lokale Tektonik und Landabsenkungen (z. B. durch Grundwasserentnahme oder postglaziale Landhebung) heraus?

Viele Pegel zeigen einen Anstieg, der primär auf das Absinken des Landes zurückzuführen ist.

Diese lokalen Effekte mit einem globalen statistischen Temperaturmittelwert-Konstrukt zu korrelieren, ist methodisch gewagt, da man hier geologische Prozesse mit atmosphärischem Rauschen vermengt.

Sie erwähnen Satellitendaten beim Meeresspiegel. Wissen Sie, in welcher Größenordnung wir hier messen?

Wir sprechen von einem Anstieg von ca. 3 mm pro Jahr.

Die Messgenauigkeit der Satelliten (z. B. Jason-Missionen) liegt nach allen Korrekturen (Atmosphäre, Wellengang, Gezeiten) in einem ähnlichen Bereich.

Zwei extrem fehleranfällige, hochgradig prozessierte statistische Konstrukte (GMST und globale Altimetrie) miteinander zu korrelieren und daraus eine physikalische Gewissheit abzuleiten, ist eher ein mathematischer Zirkelschluss als eine thermodynamische Beweisführung.

Dass das „Gesamtbudget“ angeblich so toll hinkommt, liegt oft daran, dass die Parameter so lange angepasst werden (Homogenisierung, Fitting), bis die Modelle die Korrelation widerspiegeln. Modelle passen Modelle an passen Modell an.

Wenn die GMST thermodynamisch keine Bedeutung hat – was sie als statistisches Flächenmittel nicht haben kann – dann ist ihre Korrelation mit dem Meeresspiegel lediglich das gewünschte/beauftragte Indiz damit die Klimatistik weiterhin politisch gepampert wird, oder?

„2. Wieso wird der Jahresgang der globalen Temperatur (spezifisch für die Wasser- und Lufttemperaturen) immer wieder korrekt abgebildet, wenn dieser Wert keinen Bezug zum Energiegehalt des Erdsystems hat? Bei den Meerestemperaturen sind das Änderungen im Zehntelgrad-Bereich!“

Woraus schließen Sie, dass der Jahresgang der sogenannten globalen Temperatur korrekt abgebildet wird? Was meinen Sie mit korrekt abgebildet?

Es gibt einen typischen Verlauf für die Globaltemperaturen übers Jahr. Ich vermute, das haben Sie sich schon mal angesehen. Dieser Verlauf wird jedes Jahr ähnlich durchlaufen und hängt vom Sonnenstand ab. Hätte die gemittelte Globaltemperatur keinen Bezug zur physikalischen Wirklichkeit, wäre dieses Verhalten nicht zu erwarten, sondern eher ausgeschlossen. Verständlich?

Der Jahresgang des statistischen GMST-Konstruktes ist eher eine „geografische Kuriosität“, ein geometrischer Index geprägt durch die zufällige Verteilung der Kontinente.

Er beschreibt lediglich, dass die Nordhalbkugel „kontinentaler“ geprägt ist.

Er ist ein Maß für die saisonalen höheren Temperaturen von Landflächen gegenüber den Ozeanen, nicht für eine globale Erwärmung des Planeten im Halbjahrstakt.

Für die energetische Bilanz des Planeten ist er tatsächlich eher statistisches Rauschen – Unfug.

Man kann sehr viel mit einem statistischen Konstrukt zusammenbauen, der Jahresgang der GMST was soll der beschreiben, wenn schon die GMST keine Temperatur beschreibt, thermodynamisch hat das alles keine Bedeutung, oder?

Hallo Herr Lange, Sie haben mein Argument nicht wirklich verstanden. Wahrscheinlich habe ich es auch nicht gut dargebracht. Ein nächster Versuch: Wodurch der Jahresgang entsteht, ist mir durchaus klar. Erstaunlich dabei ist, oder besser sollte für Kritiker der Globaltemperatur sein, dass die statistische GMST-Größe diesen Jahresgang zuverlässig abbildet. Und das zeigt eindeutig, dass die gewählte statistische Methode einen Wert ergibt, der mit der physikalischen Realität gekoppelt ist. Wäre er das nicht, würde er den Jahresgang, aber auch ENSO-Schwankungen nicht wiedergeben können. Und es widerspricht Ihrer Aussage, dass die Jahreswerte ein Artefakt der Mittelung sind, das kurzfristige Schwankungen wegdämpft. Was Sie beschreiben, ist das Wegmitteln von Wetter. Und das ist korrekt. Aber den globalen Energiegehalt der Luft (wahrscheinlich zu 95% durch die Meerestemperaturen getriggert) scheint die GMST sehr genau zu repräsentieren. El Nino ist da ein gutes Beispiel, das Phänomen kann man aktuell quasi live mitverfolgen. Ja, da wird warmes Wasser an die Oberfläche befördert. Das erwärmt, neben der Sonne, die Luft über einen großen Bereich des Pazifiks. Global gesehen, ist das gar nicht so viel, bei einem moderraten El Nino vielleicht 0.1 Grad. Und dennoch sieht die GMST diese Veränderung. Und das jedes Mal. Wie erklären Sie das, wenn die GMST für Sie nur ein statistisches Artefakt, ohne Aussagekraft ist?

siehe unten

„Diejenigen, die vehement behaupten, die ermittelte Globaltemperatur ist bedeutungslos und lässt keine Aussagen über den energetischen Zustand der Erde zu,…“

„El Nino ist da ein gutes Beispiel, das Phänomen kann man aktuell quasi live mitverfolgen. Ja, da wird warmes Wasser an die Oberfläche befördert. Das erwärmt, neben der Sonne, die Luft über einen großen Bereich des Pazifiks. Global gesehen, ist das gar nicht so viel, bei einem moderraten El Nino vielleicht 0.1 Grad. Und dennoch sieht die GMST diese Veränderung.“

Zunächst wird die Lufttemperatur über dem Pazifik für die GMST Ermittlung nicht verwendet. Dies „sieht“ GMST nicht!

Das ist das energetische Blindflug-Problem:

Eine Änderung der GMST um +0,1 (angeblich „Grad“) ist energetisch völlig unbestimmt. Physikalisch gesehen gibt es beliebig viele mögliche Szenarien, was diese +0,1 im Index bedeuten könnten, ich nenne wenige.

Szenario A (Interne Umverteilung):

Warmes Wasser steigt nach oben (El Niño). Die Oberfläche wird wärmer (Index steigt), aber das Gesamtsystem hat kein einziges Joule dazugewonnen. Im Gegenteil: Die Erde strahlt jetzt mehr Wärme ins All ab. Resultat: GMST steigt, aber das System kühlt energetisch ab.

Szenario B (Albedo-Änderung):

Weniger Wolken lassen mehr Sonnenstrahlung rein. Das System gewinnt Energie. Resultat: GMST steigt, System erwärmt sich.

Weitere:

Enthalpie-Falle (Feuchtigkeit): Die Lufttemperatur kann sinken, während der Energiegehalt (Enthalpie) steigt;

Phasenübergänge (Eisschmelze/Eiszunahme): Das System wir energetisch geladen/entladen, GMST suggeriert Stillstand;

Anthropologische Oberflächenveränderung (UHI): Indexanstieg ohne korrespondierende globale Strahlungsbilanzänderung;

Die GMST ist ein „Helligkeitswert“ einer Oberfläche, keine Bilanzsumme eines Systems.

In der Physik würde man eine Maschine niemals nach der Temperatur ihres Gehäuses beurteilen, ohne Druck, Masse und Energiedurchsatz zu kennen.

In der Klimatistik ist genau das jedoch die Standardvorgehensweise, zudem bei einer nicht-trivialen, offenen thermodynamischen Maschine, oder?

Herr Lange Sie machen die Diskussion zu kompliziert. Ihre Anmerkungen wären nur dann relevant, wenn wir sonst nichts über den Zustand der ENSO-Oszillation wüssten. Und nochmal, darum geht es primär nicht. Es ging doch jetzt, und so war auch mein ursprünglicher Post gedacht, nur um die Frage, warum eine GMST-Zeitreihe tatsächliche globale Temperaturabweichungen der Erdoberfläche (und der Jahresgang und ENSO sind global messbare aus anderen Quellen bekannte Änderungen) recht genau (natürlich mit Unsicherheiten) aufzeichnet. Um das zu können, muss sich auch im globalem Mittelwert das Signal der Abweichung manifestieren. Wenn Sie mir eine GMST-Zeitreihe geben, kann ich Ihnen daraus mit hoher Sicherheit den ENSO-Zyklus über den gesamten Zeitraum ablesen. Und geben sie mir die Tageswerte der Meerestemperaturen über mehrere Jahre, zeige ich Ihnen die Jahreszeiten. Damit ist eindeutig klar, auch die gemittelten globalen Temperaturreihen enthalten sinnvolle Informationen über die reale Welt. Und das steht im Widerspruch zu Aussagen des Artikels oben. Können wir uns darauf einigen?

Sie mischen bzw. unterscheiden in Ihren Aussagen häufig undifferenziert GMST-Zeitreihen und Meerestemperaturen-Zeitreihen ohne mitzuteilen welche statistischen Konstrukte aus Temperaturen Sie eigentlich meinen.

Wenn ich über GMST schreibe, dann meine ich, dass aus den globalen Luftoberflächen- und Meeresoberflächentemperaturen flächenmäßig gemitteltes rein statistisches Konstrukt, ohne Maßeinheit gebaut wurde. .

Was meinen Sie?

Was für Meerestemperaturen haben Sie im Blick, z.B. bei der Korallendiskussion oder hier oben bei den Tageswerten der Meerestemperaturen?

Wenn ich Ihnen beispielsweise die nur GMST-Zeitreihen der Jahre 1800 – 1820 gäbe – und weiter nichts, könnten Sie mir dann eindeutig mittels dieser GMST-Zeitkurve aufzeigen, wann ein starker/schwacher/kein El Nino/La Nina/Vulkanausbruch für die Ausschläge in der Kurve ursächlich verantwortlich war?

Sicher nicht!

Könnten Sie in einer reinen GMST-Kurve einen „Modoki“-El-Niño (zentraler Pazifik) von einem klassischen El Niño (Ostpazifik) unterscheiden unterscheiden? Die GMST schlägt bei beiden aus, aber die physikalischen Auswirkungen und Ursachen sind grundverschieden.

Gäbe ich Ihnen aber die „anderen eigentlich relevanten Daten“, welche vorliegen, zu diesen Jahren, dann könnten Sie diese Ereignisse genau und präzise determinieren!

Die GMST ist lediglich das globale Echo regionaler physikalischer Ereignisse. Ein Peak in der GMST-Kurve von 1810 veranlasst uns nur zunächst zu sagen, dass es global „wärmer“ war – er verrät uns nicht, ob die Ursache ein El Niño, eine solare Anomalie oder das Abklingen eines vulkanischen Winters war.

Noch gravierender: Ein Peak in der GMST-Kurve beweist nicht einmal eine globale Erwärmung im energetischen Sinne. ENSO ist primär eine Umverteilung von Energie zwischen Ozean und Atmosphäre. Wenn bei El Niño Wärme aus der Tiefe an die Oberfläche steigt, schlägt Ihr GMST-Fieberthermometer zwar aus, aber das System Erde hat dadurch kein Joule an Energie gewonnen. Ohne die räumliche und vertikale Auflösung bleibt die GMST blind für den Unterschied zwischen einer echten Energieaufnahme des Planeten und einem bloßen „Umrühren“ des Ozeans. Sie feiern das Signal eines Prozesses, dessen physikalische Bilanz die GMST gar nicht erfassen kann.

GMST verwechselt Wärmtransport mit Wärmeerzeugung.

Klimarettung sollte sich doch im Kern mit Wärmeerzeugung befassen.

Wozu brauchen wir also GMST?

Wir brauchen GMST aus rein wissenschaftlicher Sicht absolut nicht!

Darauf könnte am sich einigen, oder?

(GMST ist perfekt für rein politisch-ideologische Zwecke nutzbar!)

Also ich schreibe schon, ob ich Meerestemperaturen meine, oder die GMST-Zeitreihe. Welches Produkt genau, ist eher nebensächlich, weil sie sich in der modernen Ära nicht wirklich unterscheiden. Mein Favorit ist das Reanalyseprodukt von ECMWF, weil es sehr gut visualisiert ist und wohl aktuell (neben dem japanischen Produkt) zum qualitativ besten gehört. Ich wäre überrascht wenn GMST ohne Maßeinheit ausgeliefert wird. Sind Sie sich da sicher?

Sie neigen wieder dazu, die Diskussion zu verschieben. Natürlich kann man aus der globalen Temperaturreihe nicht den El Nino-Typ bestimmen. Aber überregionale Temperaturinformationen braucht es dafür schon. Und letztendlich sind alle Temperaturangaben, die über reine Punktmessungen hinausgehen, Mittelwerte und dennoch nützlich. Und ja, die ENSO-Oszillation verringert den Energiegehalt der Erde, wenn die GMST ansteigt. Ich plädiere auch nicht dafür, nur die globalen Temperaturreihen als Informationsgrundlage zu nutzen.

Dennoch bleibt bestehen, dass ich aus der GMST der letzten 80 Jahre die ENSO-Ereignisse mit einer hohen Wahrscheinlichkeit herauslesen kann. Und das geht nur, ich wiederhole mich, wenn dieses Signal in der Zeitreihe repräsentiert wird. Und wenn ich die El Nino induzierte Erwärmung, oder die La Nina induzierte Abkühlung der Luft im globalen Mittelwert reproduzierbar nachweisen kann, eignet sich die GMST natürlich auch dafür, den generellen Verlauf der Oberflächentemperatur über die letzten Jahrzehnte zu bestimmen, da es vergleichbare Größenordnungen sind. Das ist zwar zunächst reine Empirie und sagt nichts darüber aus, warum die GMST das vermag, obwohl Lufttemperaturen mit unterschiedlicher Wärmeenergie (Stichwort Feuchtigkeit) zusammengefasst werden, aber es funktioniert offensichtlich. Und dass die Richtung des Verlaufs (die globale Lufttemperatur wird seit 50 Jahren ca. 02 Grad pro Jahrzehnt wärmer) sehr wahrscheinlich richtig ist, wird durch zahlreiche unabhängige Indikatoren zusätzlich gestützt.

Wenn Sie begründete Argumente gegen diese „Logik“ haben, nehme ich diese gern auf. Aber bitte keine neuen Nebenschauplätze aufmachen. Es ist vollkommen klar, dass damit nicht alle Fragen beantwortet werden (Energiegehalt, Ursachen,…), aber zumindest ist es eine Grundlage, von der man starten kann.

„Das ist zwar zunächst reine Empirie und sagt nichts darüber aus, warum die GMST das vermag, obwohl Lufttemperaturen mit unterschiedlicher Wärmeenergie (Stichwort Feuchtigkeit) zusammengefasst werden, aber es funktioniert offensichtlich. Und dass die Richtung des Verlaufs (die globale Lufttemperatur wird seit 50 Jahren ca. 02 Grad pro Jahrzehnt wärmer) sehr wahrscheinlich richtig ist, wird durch zahlreiche unabhängige Indikatoren zusätzlich gestützt.“

Noch einmal:

Die GMST setzt sich im Wesentlichen aus zwei gemessenen Komponenten zusammen:

Im GMST-Konstrukt stecken also auch Meerestemperaturen, daher meine Nachfrage, welche Meerestempersturen Sie meinen, was Sie aber nicht beantworten.

(Reanalyseprodukten wie das von Ihnen genannte ERA5 (ECMWF) berechnen oft die Lufttemperatur in 2 Metern Höhe auch über dem Wasser.)

Temperaturen werden nicht kälter oder wärmer. Sie steigen oder fallen.

Temperaturen haben selbst keine Energie, auch keine Wärmeenergie.

Trendanalysenergebnisse leben von der Wahl der Stichprobenanzahl, hier von der der Periodenlänge.

Nicht ohne Grund hat die noch gute wissenschaftliche Metrologie eine Klimaperiode auf eine Zeitdauer 30 Jahre gesetzt.

Mit Beobachtungsergebnissen aus 2 Klima-Perioden lässt sich kein signifikanter statistischer Trend ermitteln.

Verkürzt man die Periodendauer, auf stündlich, wöchentlich, monatlich, jährlich, 10jährlich, erhält man genügend viele Perioden (Stichproben) um gute Statistik zu betreiben, aber man erhält für jede Periodendauer eine anderes Ergebnis.

Man hat nun einerseits die große Auswahl Passendes zu greifen, zerschlägt aber andererseits (für den Laien unbemerkt) die Klimadefinition, d.h. man beschreibt gar keinen Klimatrend mehr, man macht Statistik von Wetterabweichungen mit Ergebnis-Shopping und verkauft es als möglichst angstmachenden Klimatrend, oder?

Sorry, ich war etwas ungenau in der Formulierung. Letztendlich wissen sie schon, was ich meine: Die Temperatur von Luft mit unterschiedlicher Gehalt an Wärmeenergie. Und ja, Temperaturen steigen oder fallen, das sind semantische Feinheiten, auf die ich hätte achten sollen, da haben Sie einen Punkt.

Aber ansonsten machen Sie genau das, was ich befürchtet hatte, Sie bringen eine neuen Aspekt in die Diskussion, der erstmal nichts mit unserer Frage aus dem Ausgangpost zu tun hat.

Die 30 jährige Klimaperiode ist ein menschliches Konstrukt und kein naturgesetzliche Notwendigkeit. Ich denke, dass diese mit guten Argumenten von den Meteorologen so gewählt wurde, wobei ich persönlich glaube, dass durch die neuen Messverfahren und verbesserten Statistiken auch eine kürzere Periode sinnvoll sein kann.

Doch egal, die Klimaperiode hat eh nichts damit zu tun, ob sich der GMST-Trend statistisch signifikant von der Nullhypothese (flacher Trend) unterscheidet. Sie spielt vielleicht für die nachfolgende Diskussion, ob man schon von einer Klimaveränderung reden kann, eine Rolle. Für die direkt gemessenen Meerestemperaturen ist das Signal-Rausch-Verhältnis übrigens wesentlich günstiger, so dass man dort nach deutlich weniger Jahren von Signifikanz bei Trendänderungen (falls es diese gibt) ausgehen kann.

Ob Sie mit Tages-, Monats- oder Jahresdaten rechnen wollen, hängt davon ab, ob Sie für die jeweilige Wahl genug Daten zur Verfügung haben. An den Trends sollte das eigentlich keinen Unterschied machen, solange sich die Gesamtdauer nicht verändert. Das kommt aber auch auf die statistische Methode an, wie diese Anfangs- und Endwerte einbezieht.

Bei Jahresdaten haben Sie den Vorteil, dass Sie die Autokorrelation (zeitlich, räumlich) verringern oder sogar ganz verhindern. Bei kürzeren Perioden müssen sie in jedem Fall dagegen prüfen.

Halten wir fest: Die GMST-Datenreihe (Reanalyse) zeigt seit ca.1970 einen Trend von über 0,02 Grad/Jahr. Dieser Trend ist hoch signifikant. Neuste Berechnungen (Foster und Rahmstorf) zeigen sogar eine signifikante Beschleunigung. Ist das schon Klima oder noch Wetter? Ich denke, nach über 50 Jahren deutet vieles auf eine Veränderung der klimatischen Randbedingung auf unserer Erde hin. Meiner Meinung nach gibt es diesen Trend sogar schon deutlich länger, unterbrochen von der rasanten Zunahme der Luftverschmutzung nach dem 2. Weltkrieg. Was aus diesen Daten jeder persönlich mitnimmt, und ob er sie überhaupt anerkennt, oder schlicht verdrängt (leugnet), darauf hat auch die beste Statistik keinen Einfluss, wie man auf diesen Seiten immer wieder feststellen kann.

Wir sollten also, um den Trend der GMST-Datenreihe von 1970 bis heute richtiger einordnen zu können eine andere Klimadefinition vornehmen, insbesondere die Zyklusdauer stark reduzieren, die Definition modernisieren, oder?

Das brauchen wir nicht, aber für die Beurteilung globaler Änderungen könnten wir das (meiner persönlichen Meinung nach):

Die Definition von Klima ist ja eigentlich eine lokale. Und lokal ist das zufällige Rauschen (Wetter) groß. Um ein brauchbares Klimasignal aus diesem Rauschen zu isolieren, haben sich wohl 30 Jahre bewährt. Ich vermute, man könnte für unterschiedliche Klimazonen auch unterschiedliche Zeiträume definieren (z.B. Mitteleuropa versus Südeuropa), aber das macht es nur kompliziert.

Global reduziert sich das Rauschen sehr stark, da sich die Wetterkomponente weitestgehend herausmittelt. Wenn Sie sich die globalen Jahreswerte ansehen, so sind diese seit den modernen Messverfahren (Satellit, Bojen, Reanalyse) erstaunlich eng zusammen gerückt. Das bedeutet, die globale Energiebilanz ist sehr stabil. Wenn man mathematisch die ENSO-Varianz herausrechnet, wird es noch einheitlicher. Und deshalb bin ich der Meinung, dass es keine 30 Jahre braucht, bis man bemerkt, wenn sich etwas an diesem gut eingespielten System ändert. Auch aus diesem Grund ist die allmähliche Steigerung (immerhin ja nur 0.02°/Jahr) in der GMST-Reihe schon nach wenigen Jahren hochsignifikant und konnte die Beschleunigung (auf 0.03°/Jahr) seit den 2010er Jahren überhaupt statistisch sauber ermittelt werden.

Für die Daten in Deutschland sind möglicherweise (ich habe es nicht nachgerechnet) 30 Jahre sogar zu wenig. In Mitteleuropa haben wir mit die höchste Wettervariabilität auf diesem Planeten. Deshalb fahren wir ja auch so gern im Sommer in den Süden. Nicht weil wir die Hitze dort so toll finden (jedenfalls nicht jeder), aber man weiß zumindest, was man bekommt. An der Ostsee ist die Küste super schön, aber es kann eben auch ein Brettspiel-Urlaub werden…

Wenn ich mich richtig erinnere wurde die Klimaperiodendauer von der Wissenschaft auf 30 gesetzt um innere physikalisch-thermodynamische Prozesse zu glätten, also bekannte lang andauernde natürliche Zyklen zu glätten, nicht um statistische Glättungsmaßnahmen zu ergreifen, oder?

Aus diesem Kontext heraus teile ich Ihre Ansichten nicht.

Wählt man einen Zeitraum von nur 10 oder 15 Jahren (wie Sie es für die 2010er Jahre andeutet), könnte man lediglich die Warmphase eines solchen natürlichen Zyklus messen und diese fälschlicherweise z.B. als beschleunigten anthropogenen Trend interpretieren.

Die 30 Jahre dienen dazu, das thermodynamische Ungleichgewicht so weit zu mitteln, dass der eigentliche Antrieb (das Forcing) sichtbar wird, ohne von der kurz- und mittelfristigen Umverteilung von Energie zwischen Ozean und Atmosphäre überlagert zu werden, auch örtlich. Es werden wesentliche physikalische Zeitkonstanten berücksichtigt.

Der entscheidende Unterschied in unseren Meinungen zeigt sich offenbar in der Ausdeutung der Problematik statistische versus physikalische Signifikanz (wie schon bei der GMST-Interpretations-Diskussion):

Sie argumentieren statistisch, aus der Sicht eines rein mathematischen Datenproblems: Sie sagen, wenn die Datenpunkte (Jahreswerte) eng beieinander liegen und eine klare Richtung zeigen, ist der Trend mathematisch „bewiesen“. Sie nutzen die Statistik, um die physikalische Trägheit und die internen Zyklen des Systems „abzukürzen“. Das kann in Zeiten eines sehr starken Signals (wie derzeit) gut gehen, ist aber methodisch angreifbar – wir können es nicht wissen.

Die Physik sagt uns: Ein statistisch signifikanter Trend kann physikalisch trotzdem eine bloße Fluktuation sein (z.B. eine Häufung von El-Niño-Ereignissen). Statistisches Vertrauen ist nicht gleichbedeutend mit physikalischer Ursächlichkeit. Der physikalische Prozess muss im Mittelpunkt stehen.

Sie begehen potenziell einen Kategorienfehler: Sie verwechseln die Präzision der Messung (Satelliten, Bojen) mit der Natur des Systems.

Nur weil wir heute genauer messen können, wie sich die „Temperatur“ von Jahr zu Jahr ändert (Nichttemperaturen wie das GMST-Konstrukt und die Meeres“Temperaturen“-Konstrukte), bedeutet das physikalisch nicht, dass das Klima schneller reagiert oder dass interne Zyklen plötzlich verschwunden sind oder dass sich anthropogen etwas tut. Die 30 Jahre wurden gerade deshalb gewählt, um sicherzustellen, dass man nicht „mitten in der Messung“ des 2. Klimazyklus ab 1970 eine vorübergehende Schwankung als dauerhafte Klimaänderung missversteht, was dies aber auch nicht ausschließt, oder?

Herr Lange,

darf ich mal sagen, ihre bestimmte, freundliche, wissensbasierte Argumentation ist eine Bereicherung?

Tschuldigung das ?. Gewohnheit!

Sie ist!

Nein, meine Erklärung, dass die GMST-Zeitreihe sinnvolle Aussagen über die Temperatur der Atmosphäre an der Erdoberfläche zulässt, folgt der Logik, nicht der Statistik. Wenn die GMST-Zeitreihe reproduzierbar den Jahresgang wiedergibt, wird sie auch Änderungen durch andere Ursachen in ähnlicher Größenordnung registrieren können. Punkt. Die ENSO-Oszillation stärkt diese Aussage, auch sie wird in der GMST-Zeitreihe zuverlässig abgebildet. Punkt. Und das war es eigentlich schon. Alle anderen Themen (Statistik, Klima) haben Sie in die Diskussion gebracht.

Das wir heute genauer messen können, ändert natürlich an der Klimaphysik nichts, sondern verbessert unser Verständnis von ihr. Wenn die modernen, genaueren Messungen zeigen, dass die Globaltemperatur sehr stabil zu sein scheint, verschwinden dadurch per se keine Klimazyklen. Aber es darf mit den neuen Erkenntnissen hinterfragt werden, ob die Zyklen überhaupt global existieren, oder ob diese Messartefakte sind. Es ist durchaus denkbar, dass durch eine vorher ungenaue Verteilung der Messstandorte eigentlich lokale Ereignisse überproportional repräsentiert wurden. Denn, und jetzt kommt die Physik ins Spiel, seit wir die Energieflüsse z.B. von der Sonne direkt messen können, ist klar, dass deren Änderungen gar nicht ausreichen, um die vorher postulierten Zyklen zu erklären. Zumindest nicht ohne einer größere Menge an Zusatzannahmen und indirekter Wirkmechanismen.

Die Physik ist die große Stärke der Klimawissenschaft. Denn sie war die Grundlage für die Voraussage, dass eine CO2 Anreicherung in unserer Atmosphäre die globale Temperatur ändern wird. Und das zu einer Zeit, als an an einer Erwärmung noch nicht zu denken war.

Und zum Schluss noch eine Bemerkung zu Ihrem Satz „Die Physik sagt uns: Ein statistisch signifikanter Trend kann physikalisch trotzdem eine bloße Fluktuation sein (z.B. eine Häufung von El-Niño-Ereignissen).“ Nein, das sagt uns die Physik nicht, das kann sie gar nicht. Genau für solche Aussagen ist die Statistik zuständig. Mit ihrer Hilfe können wir eine Reihe von Datenpunkten daraufhin untersuchen, wie hoch die Wahrscheinlichkeit ist, ob es sich um eine zufällige Verteilung an Werten handelt, oder ob es signifikante Abweichungen (z.B. ein Trend) vom Rauschen gibt. Welche statistische Methode ich anwende, wie viele Datenpunkte ich habe, welche Verteilung diese haben, all das hat großen Einfluss darauf, wie robust das Ergebnis ist.

Zu den Ursachen für das Rauschen und für die Abweichungen dazu kann dann die Physik etwas sagen.

Es gibt keine Klimaphysik, sondern eine Klimakirche, die Millionen Propheten ausbildet und „Klimaphysiker“ nennt, die die Aufgabe haben, den Glauben zu verbreiten.

Im der Erdgeschichte ist CO2 von ca 15%-17% auf 0,1…0,03% gesunken, zwangsläufig gegenläufig zum Anstieg von O2 0 auf 20% gemäß Massenerhaltungssatz. Dabei haben diese große Verschiebungen nicht im Heringsten die Temperatur beeinflusst, bei jeder Konzentration war es sowohl 10 Grad wärmer als auch 10 Grad kälter.

Nun sucht die Klimakirche kaum messbare Verschiebungen von CO2 und Temperatur, um ihr Glauben zu untermauern. Hat mit Wissenschaft und Physik nichts zu tun.

Physik vs. Statistik – Eine Frage der Erkenntnishierarchie

Könnte es sein, dass Ihre Antwort ein grundlegendes Missverständnis über das Verhältnis von Messpräzision und physikalischer Erkenntnisfähigkeit offenbart? Sie nutzen Physik, Statistik und eine vermeintliche „Logik“ als wechselseitige Schutzschilde, um methodische Schwächen Ihrer Position zu maskieren.

Sie wechseln die Beweislast je nach Argumentationsnot: Mal ist die Mathematik der Richter und die Physik nur geduldeter Erklärer, mal umgedreht. In der Wissenschaftstheorie gibt es jedoch eindeutige Hierarchien.

1. Das ENSO-Dilemma: Präzision ohne Erkenntnis

Sie behaupten, die GMST sei valide, weil sie das ENSO-Signal „zuverlässig abbildet“.

Das ist ein Zirkelschluss.

Die GMST zeigt lediglich, dass das (Fieber-)Thermometer-Konstrukt ausschlägt, wenn Energie vom Ozean in die Atmosphäre abgegeben wird. Da ENSO jedoch ein interner Umverteilungsprozess ist – ein energetisches Nullsummenspiel im Gesamtsystem –, ist dieser Ausschlag physikalisch kein Indikator für einen geänderten energetischen Antrieb (Forcing).

Hier begehen Sie einen Kategorienfehler:

Eine Häufung von El-Niño-Ereignissen erzeugt in der GMST einen statistisch „hochsignifikanten“ Trend.

Die Statistik ruft hier „Erwärmung“, während die Physik weiß, dass lediglich Energie vom „Sparbuch“ (Ozean) auf das „Girokonto“ (Atmosphäre) umgebucht wurde.

Ohne die physikalische Prüfung der Tiefsee-Thermodynamik bleibt Ihre statistische Signifikanz blind. GMST kann aus sich selbst heraus nicht einmal identifizieren, warum sie steigt. Uns schon gar nicht was „normal“ wäre bezüglich Häufigkeit und Abständigkeit des ENSOs.

2. Die 30-Jahre-Regel: Physikalische Konstante statt statistischer Krücke

Ihre Ansicht, moderne Präzision erlaube es, die 30-jährige Klimaperiode zu verkürzen, ist physikalisch naiv. Diese Zeitspanne wurde nicht wegen „schlechter Daten“ gewählt, sondern aufgrund der thermischen Trägheit des Ozeans und bekannter Oszillationen (PDO, AMO etc.).

Präzision ersetzt keine Zeit:

Sie können ein Pendel, das eine Stunde für einen Schwung braucht, im Millisekundentakt filmen. Nach einer Minute haben Sie Millionen Datenpunkte (Präzision), wissen aber physikalisch immer noch nicht, ob das Pendel jemals zurückschwingt. Wer Trends auf Basis von 10 oder 15 Jahren behauptet, misst lediglich das „Rauschen“ interner Zyklen, nicht das klimatische Signal.

Es ist eher zu befürchten, dass selbst 30 Jahre physikalisch zu kurz gegriffen sind. Die Mannigfaltigkeit von das Klima beeinflussenden Prozessen ist doch eher erstaunlich hoch und erschreckend unerforscht.

3. Die experimentelle Blindheit (N<2)

Wir müssen uns der methodischen Bescheidenheit stellen: Da wir wirklich präzise, globale Daten (Satelliten, Argo-Bojen) erst seit etwa 1970 besitzen, haben wir bisher gerade einmal 1,8 Klimaperioden vermessen.

In der Experimentalphysik ist eine Stichprobe von N<2 fast wertlos, um zwischen einem anthropogenen Trend, kosmischen Einflüssen, etc. und der ansteigenden Flanke eines natürlichen 60- bis 80-jährigen Zyklus sicher zu unterscheiden.

Uns fehlt die experimentelle Basis für einen echten Vergleich mit der Zeit vor 1970 (1930). Wir sehen eine Kurve, aber wir kennen das System noch nicht lange genug, um das Rauschen sicher vom Signal zu trennen. Rekonstruktionen der Vergangenheit versuchen dies zu heilen, doch erreichen sie nie die physikalische Belastbarkeit einer direkten Messung. Zumal historische Sichten auch politisch geprägt sein können.

Fazit: Physik ist der Herr, Statistik der Knecht

Ihr Ansatz wirkt methodisch opportunistisch: Sie erklären die Statistik zum Richter, wenn ein Trend Ihre Sicht stützt, erklären sie aber für zweitrangig („folgt der Logik“), wenn es um die fundamentale Validierung Ihrer Datenbasis geht.

ENSO beweist die Sensitivität der Messung, aber nicht die Kausalität der Erwärmung.

30 Jahre sind eine physikalische Notwendigkeit, keine statistische Empfehlung.

Das GMST-Konstrukt ist eine statistische Hilfsgröße – eine „Nicht-Temperatur“ –, die als politisches Kommunikationsmittel fungiert, aber die tatsächliche physikalische Komplexität (latente Wärme, Schichtung) eher verschleiert.

Statistik sichert Erkenntnisse ab, aber sie generiert sie nicht. In der Klimawissenschaft muss die Physik der Herr im Haus bleiben und die Statistik der Knecht. Und Politik muss vor die Tür gesetzt werden.

Das bedeutet letztlich, dass wir Prozesse verstehen müssen, statt nur Kurven zu verlängern.

Finden Sie nicht auch?

Sehr guter Beitrag und wohl sortierte Antwort.

Sehr offensichtlich im Beitrag von Herrn „Bienkopp“.

Mal sehen ob er das physikalische Model benennen kann.

Herr Lange, wie kommen Sie auf derart merkwürdige Texte? Lesen Sie meine Beiträge und noch wichtiger, verstehen Sie überhaupt, was ich schreibe?

Physik und Mathematik sind doch nicht hierarchisch einander untergeordnet, sondern haben ganz unterschiedliche Aufgaben in der wissenschaftlichen Praxis. Die Physik untersucht und beschreibt die die Wirkmechanismen der realen, unbelebten Welt. Die Statistik als Teil der Stochastik interpretiert Datenmengen, die wir aus Messungen gewinnen. Das erste ist Naturwissenschaft, das zweite gehört zur Strukturwissenschaft. Da habe ich ganz bestimmt nichts verwechselt, bei ihnen bin ich mir da nicht so sicher.

1)

Wie können Sie meinen Text zur GMST zu einem Zirkelschluss umdeuten? Darin steckt eine kurze lineare „wenn, dann“ – Logik. Zirkulär wäre es nur, wenn ich versucht hätte mit dem Ende den Anfang zu beweisen. Ich habe immer wieder betont, dass es hierbei um die prinzipielle Fähigkeit der Messmethode geht, Temperaturänderungen der oberflächennahen Atmosphäre aufzuzeichnen. Die Referenz dafür ist der Jahresgang, die ENSO-Oszillation ist lediglich ein guter Test und damit eine Bestätigung dieser Fähigkeit. Welche physikalische Ursache die jeweilige Temperaturveränderung hervorgerufen hat, ist in diesem Zusammenhang total irrelevant. Die logische Implikation erfordert nämlich keine inhaltliche Ursache-Wirkungs-Beziehung, um dennoch wahr zu sein. Ist das wirklich so schwer zu verstehen?

2)

Die 30 Jahre als kleinste Periode zur Bestimmung von Klimadaten sind keine physikalische Konstante, sondern eine menschliches Konstrukt. Auch hier habe ich klar gemacht, dass ich damit gar kein Problem habe; es hat sich ja regional total bewährt. Ich habe nur angeregt, das man auf Grund deutlich besserer Daten heute anders über z.B. zyklische Muster urteilen kann. Denn als man diese ursprünglich bestimmt hat, war die Datenlage deutlich schlechter.

Die thermische Trägheit der Ozeane hat mit den 30 Jahren aber nichts zu tun, das wäre als Wärmepuffer schon verdammt lang 🙂

3)

Der kritische Umgang mit Erkenntnissen und Daten gehört zur Wissenschaft intrinsisch dazu. Aber überall, wo Menschen involviert sind, machen diese Fehler oder haben einen Bias. Deswegen gibt es die wissenschaftliche Community als korrigierende Instanz (über Tagungen, Vorträge oder Veröffentlichungen). Ist nicht perfekt, funktioniert aber dennoch ganz gut.

Ansonsten verwechseln Sie hier wieder zwei voneinander getrennte Kategorien. Zum einen haben wir eine Temperaturmessreihe. Diese können wir auf ihre statistischen Eigenschaften prüfen. Diese Prüfung ergibt, dass die Temperaturen seit ca. 50 Jahren steigen. Der Anstieg hat sich in den letzten 20 Jahren beschleunigt. Worin die physikalischen Ursachen liegen und ob wir bereits Klimaänderungen messen, sind andere, nachgelagerte Fragen, wenn auch die deutlich spannenderen.

Fazit:

Ihren Satz: „ENSO beweist die Sensitivität der Messung, aber nicht die Kausalität der Erwärmung.“ habe ich bisher vermisst und unterschreibe ich sofort. Genau das habe ich die letzten Tage aussagen wollen.

Ansonsten ist Ihr Opportunismus-Vorwurf unsinnig. Ich habe die Statistik nie als zweitrangig eingestuft. Da haben sie etwas falsch interpretiert.

Dennoch danke für einen interessanten Austausch,

Ole

Ist das Problem nicht, das die von Ihnen beschworene Physik, so nicht existiert?

Mit welchem physikalisch abgeleitetden Model können wir denn die gemittelte Oberflächentemperatur eines Planeten voraussagen?

Wie hoch wäre zum Beispiel diese Temperatur, wenn die Erde anstatt nur 1 bar 3 bar Luftdruck hätte und warum?

„1. Warum stimmen die Jahreswerte so gut überein? Das klingt trivial, ist aber bei einer bedeutungslosen Zahl ohne Bindung zur Realität nicht zu erwarten.“

Womit stimmen die Jahreswerte so gut überein?

Die global gemittelten Werte übers Jahr sind immer sehr ähnlich und unterscheiden sich nur um wenige Zehntelgrad. Und das auch nur, wenn El Nino und La Nina ihren Einfluss ausüben. Auch hier das Gleiche: Anscheinend wird der Globalwert vom Energiezustand der Erde begrenzt und konstant gehalten. Ansonsten wären viel stärkere Fluktuationen zu erwarten.

Dass die Jahreswerte so stabil sind, liegt nicht an einer energetischen Begrenzung, sondern an der statistischen Glättung. Wenn man tausende Würfel gleichzeitig wirft, kommt fast immer ein Mittelwert von 3,5 heraus. Das liegt nicht daran, dass eine Kraft die Würfel ‚begrenzt‘, sondern dass sich die extremen Ausreißer (Eiszeit in Sibirien vs. Hitzewelle in Australien) mathematisch gegenseitig aufheben.

El Niño beweist, dass die GMST eben nicht direkt vom globalen Energiezustand gesteuert wird. Bei El Niño wird kein einziges Joule Energie zusätzlich von der Sonne aufgenommen (aber mehr abgestrahlt!); es wird lediglich warmes Wasser aus der Tiefe an die Oberfläche des Pazifiks geschoben. Die GMST schießt hoch, obwohl die Gesamtenergie der Erde gleich bleibt. Das zeigt: Die GMST ist eine reine Oberflächenstatistik, die bestenfalls auf interne Umverteilungen reagiert, nicht auf den energetischen Gesamtzustand, den sie nie repräsentiert.

Ergo: Die Konstanz der GMST-Jahreswerte beschreibt keine thermodynamische Stabilität, es ist eine künstliche statistische sehr flache Fläche, ein statistisches unphysikalisches Nebenprodukt einer riesigen homogenisierten Stichprobe. Dass die Werte so eng beieinander liegen, ist ein Artefakt der Mittelung über ein extrem träges System (die Ozeane), das kurzfristige Schwankungen wegdämpft.

„3. Warum lassen sich in den globalen Temperaturreihen gut untersuchte Oszillationen

(z.B. ENSO) oder Störungen (Vulkanausbrüche) klar erkennen?“

Die „Nichtdurchgängigkeit“ in korrekten Anzeigen – also die Tatsache, dass diese Signale manchmal verschwimmen – verdeutlicht, dass die sogenannte globale Oberflächentemperatur (GMST) allein kein vollständiges (geeignetes) Maß für den energetischen Zustand unseres Planeten ist. GMST hat zudem große historische Datenschwäche.

Man kann es so ausdrücken: Die Oberflächentemperatur ist eher das „Fieberthermometer“, während der Energiegehalt der Ozeane (Ocean Heat Content) das eigentliche „Bankkonto“ der Erderwärmung darstellt.

Wobei sodann die gemittelte GMST und deren Anomalie bezüglich willkürlichem Normal-Referenzpunkt als ein reines ideologisch-politisches Konstrukt benutzt wird, zur Ausgabe des politischen 1,5 °C-Ziels.

Und weil das statistische Konstrukt GMST so „zappelig“ und ungenau ist (wegen ENSO etc.), ist sie als wissenschaftliches Langzeit-Maß eigentlich schlechter geeignet als z.B. der Wärmegehalt der Ozeane. Aber gerade weil sie so zappelig ist, bietet sie der Politik ständig neue Schlagzeilen (z.B. „Heißester Monat seit Aufzeichnungsbeginn“).

Die GMST-Nutzung zeigt das geschmeidige Zusammenwirken von politisch bezahlter Klimatistik, Medien und Politik sehr gut, oder?

Die eigentliche Frage dahinter: Warum ist die GMST nie genormt worden, warum sind diesbezügliche Versuche der Klimatistik an der Wissenschaft gescheiter?

Sorry, aber da verstehe ich Ihre Bemerkungen nicht. Mir ging es darum, dass die gemittelte Globaltemperatur sensitiv genug ist, um typische klimatische Ereignisse (wie ENSO) wiederzugeben. Und das sehr zuverlässig in Stärke und temporärer Auflösung. Wie soll das ohne Kausation funktionieren?

Genau das macht GMST eben nicht stringent und falsch sensitiv.

Beispiel Energieumverteilung:

Bei einem El Niño gelangt Wärme aus dem Ozean in die Atmosphäre. Die GMST steigt sprunghaft, obwohl die Gesamtenergie der Erde (Ozean + Luft) sich nicht im selben Maße ändert.

Was zeigt sie also an? Eine globale Erwärmung, wie behauptet?

Nein eine Energieumverteilung vom Ozean zur Atmosphäre, damit ist GMST nicht sensitiv bezüglich des globalen Gesamtsystems, nicht sensitiv bezüglich des globalen Energieinhaltes, für das sie aber angeblich stehen soll, oder?

Warum ist die GMST falsch sensitiv? Sie zeigt doch genau das, wofür sie steht, die globale Lufttemperatur. Und diese wiederum spiegelt den Wärmegehalt der Meeresoberfläche wider, während ENSO-Oszillationen gut zu beobachten. Und ja, sie zeigt damit auch die globale Erwärmung an, denn (nahezu) jeder El Nino Peak ist wärmer als der vorherige.

Aber es ging bei meiner Argumentation vor allem darum, darauf hinzuweisen, dass die GMST auf bekannte natürliche Veränderungen im System Erde (Jahresgang, ENSO) in der erwartbaren Größenordnung und in der richtigen zeitlichen Auflösung reagiert und damit auch einen sinnvollen Index für anthropogene Einflüsse darstellt. Nicht mehr, aber auch nicht weniger.

Dann sagen Sie uns doch bitte wo, wann, und in welcher Höhe sie gemessen wird? Wenn Sie das nicht können, dann sollten Sie akzeptieren das dies eine künstlich geschaffner Wert ist. Ohne Sinn und Verstand für den Zweck für den sie erfunden wurde.

„Warum ist die GMST falsch sensitiv? Sie zeigt doch genau das, wofür sie steht, die globale Lufttemperatur.“

GMST (Global Mean Surface Temperature) ist keine gemittelte globale Luft-Temperatur.

GMST zeigt nicht die globale Mittellufttemperatur an. Es ist also ein statistischer Flächenmittelwert aus Lufttemperaturen (+2mH) und Wasseroberflächentemperaturen (+0,0mH), ohne Eingang weiterer thermodynamischer Größen wie Wärmekapazitäten, Massen, Dichten, Feuchtigkeit, etc..

Sie ist weder „Lufttemperatur“ noch „Temperatur„, sie ist ein statistischer Index, dem eine °C-Maßeinheit thermodynamisch und energetisch falsch verpasst wurde. Sodann hat man aus Global Mean Surface – Index eine GMS-Temperatur gemacht, also einen physikalisch falschen Namen gegeben.

Jetzt kann man da viel Klimatistisches hineindeuten oder eben korrelieren wenn Sie es lieber so ausdrücken möchten – das mag gute Statistik(Mathematik) sein, aber es ist Hokus-Pokus-Physik.

Und genau das zeigt sich bei El Niño, der das GMST-Konstrukt ansteigen lässt, obwohl nur eine Energieumverteilung im System stattgefunden hat, die physikalische nicht zu einer Erwärmung des Gesamtsystems (oder durch Abstrahlung sogar zu einer Abkühlung) führen kann.

Was zeigt also das statistische Konstrukt GMST an? Anthropogenes? Nein!, der Index selbst sagt nichts über die Ursache aus. Er ist stumm gegenüber der Frage, ob die Wärme von der Sonne, aus dem Ozean oder durch veränderte Albedo kommt, oder ob gar gerade eine globale Abkühlung dahinter steckt.

Und was behauptet die Klimatistik, was es anzeigt? Menschengemachtes, leider falsch, führt zu absichtlich unsachlich gesteuerter Klimadebatte, oder?

Nichts für Ungut, aber Ihre Antwort geht erneut ziemlich weit an meinem Argument vorbei. Ich kenne die Kritikpunkte an einer gemittelten Temperatur. Ist ja häufig Thema bei Eike. Aber darum geht es hier nur sekundär. Wir nehmen mal an, die Kritiker hätten in allen Punkten Recht (haben sie nicht, wie auch andere Kommentatoren herausgearbeitet haben). Dann entsteht ja trotzdem der Widerspruch, warum die GMST immer wieder bekannte zeitliche Veränderungen mit geringer Amplitude (Jahresgang, ENSO) korrekt abbilden kann. Zufall? Nach 8 Jahrzehnten (hier beziehe ich mich auf die Reanalyse) wohl kaum. Und wenn die GMST sich für die kurzfristige natürlichen Oszillationen eignet, kann sie auch den langfristigen Anstieg der Temperatur prinzipiell messen, zunächst unabhängig von deren Ursache, oder?

Stellen Sie sich vor, Sie haben eine Sportuhr mit Pulsmessung und sagen Ihrem Arzt nach vier Jahren Nutzung, dass Ihr Ruhepuls über die Zeit messbar angestiegen ist. Der sagt, Quatsch, die Pulsmessung der Uhr ist dafür nicht genau genug. Dann kontern Sie, dass die Uhr aber den Tagesgang immer wieder sehr gut abbildet. Und das sich schon leichte sportliche Bewegung sofort am gemessenen Puls bemerkbar macht. Und dass die Größenordnungen der Änderungen (Tagesgang, Bewegung und erhöhter Ruhepuls) ähnlich sind. Wenn der Arzt dann immer noch sagt, das überzeugt ihn nicht, sollten Sie sich eine neue Praxis suchen.

In diesem Sinne, Ole

Ihr Vergleich GMST mit der Pulsmessung hinkt!

Der Puls, als autonomes Signal, der eine physische Realität zusammenfasst, die den ganzen Körper repräsentiert, ob Messung am Handgelenk, am Finger, am Hals per Pulsuhr oder Hand es bleibt repräsentative Messung mit korrekter Nulllinie.

Die GMST ist demgegenüber eine rechnerische Übereinkunft, die nichts Physikalisches repräsentiert, sie wird ja erst statistisch z,B. flächenmäßig mittels vieler Schätzungen und Homogenisierungen konstruiert. Ändern Sie die statistischen Konstruktionsregeln, z.B. andere Gewichtungen oder gar echte thermodynamisch korrekte Konstruktion, erhalten Sie eine ganz andere „Fieberkurve“ der Erde.

Ändern Sie den Normal-Referenzpunkt erhalten Sie eine steigende, konstante oder fallende Anomalie, je nach gewähltem Bezugspunkt.

Und natürlich mit angeklebte Maßeinheit.

Sie schreiben die GMST bildet den Jahresgang der Temperaturen exakt ab.

Ja welcher Temperaturen?

Nicht der Temperaturen der Nordhalbkugel, nicht die Temperaturen der Südhalbkugel, nicht die Temperaturen des Äquators, nicht der Antarktika?

Es ist ein sich zufällig ergebender Jahresgang, einer zufällig oder besser bewusst ausgewählten GMST-Berechnungs-Konstruktion, es gäbe ja viele Möglichkeiten – aber es muss ja korrelieren.

Die statistischen Regeln bestimmen die Aussage, es ist im Grunde ein Zirkelschluss, Sie bestätigen die gewählten Konstruktionsregeln, die mathematische Konsistenz – sonst nichts.

Mit GMST entdecken wir nichts, keine globale Temperatur, nichts das Sie nicht selbst vorab unter die nächtliche Straßenlaterne gelegt haben, bevor Sie den Betrunkenen zur Haustürschlüsselsuche losschickten, oder?

Hallo Herr ?,

an dieser Stelle mal ganz allgemein gefragt. Warum postet jemand unter Pseudonym (Ole Bienkopp = Romanfigur) und nicht mit seinem Klarnamen? Stehen sie (und Sie) nicht zu ihren Aussagen?

Zu Ihren Fragen will ich mich gar nicht weiter äußern (das kann Herr Lange weitaus besser als ich), aber ich möchte Ihnen gerne eine mehrteilige Gegenfrage stellen.

Wenn die GMST eine sinnvolle Größe wäre, welche Erkenntnisse würden Sie daraus ableiten? Was wäre schlimmer, steigend oder fallend und warum?

Für mich ist die GMST eine sinnvolle Größe, oder besser ein nützlicher Index. Noch wertvoller sind die Meerestemperaturen, weil diese deutlich weniger fluktuieren und mehr über die Gesamtenergie aussagen. Aber mit beiden Zeitreihen kann man feststellen, ob sich der Energiehaushalt der Erde ändert. Und die Änderungen haben Konsequenzen. Es ist wahrscheinlich egal, ob es kälter oder wärmer wird, beide Richtungen haben unangenehme Folgen. Eiszeiten (ja, wir leben in einer Zwischeneiszeit) und Heißzeiten sind für uns großen Säugetiere mit aktiver Temperaturhomöostase problematisch. Aber bevor diese Gefahr relevant wird, sind mit hoher Wahrscheinlichkeit unsere zivilisatorischen Errungenschaften an ihre Grenzen geraten. Jedenfalls finde ich die Prognosen der Wissenschaftler dazu plausibel. Ob man das katastrophal nennt, muss jeder für sich entscheiden. Für mich persönlich ist das sehr wahrscheinliche Ende der Warmwasserkorallen bereits eine extrem traurige Aussicht. Für andere ist das leichter zu verschmerzen.

Ole

Das Ende der Warmwasserkorallen?

Wo kommt das her?

Mal rein logisch, die heißen Warmwasserkorallen warum?

Kommt eine Eiszeit? Wo kommen dann Warmwasserkorallen her? Gabs schon mal ne Warmzeit? Wo kommen Warmwasserkorallen her?

Sie heißen Warmwasserkorallen, da sie im warmen Wasser leben. Aber ab 30°C stoßen sie ihre symbiontischen Algen ab und verhungern. Ich vermute, das haben sie selbst schon gelesen oder gehört. Häufen sich Korallenbleichen haben die Nesseltiere keine Chance auf Regenration. Davon abgesehen, dass empfindliche Arten eh bereits weg sind. Die Geschwindigkeit, mit der das Meerwasser wärmer wird, verhindert eine evolutionäre Anpassung. Die rezenten Arten haben de facto nichts mit den Korallen der Warmzeit zu tun. Vielleicht kann der Mensch durch Gentechnik nachhelfen, aber der ungeheure Artenreichtum in den Riffen wird so nicht zu retten sein. Ein extrem tragischer Verlust, der nach Aussagen von Meeresbiologen schon jetzt nicht mehr zu verhindern ist. Zumindest für einen Großteil der bekannten Vorkommen.

Wie warm ist das Wasser?

Bei Whatsupwiththat gabs mal ne gute Serie über die Limitierung der Ozeantemperatur durch Wasserverdunstung und Wolkenbildung. Kann ich empfehlen.

Wie regenerieren sich die Korallen?

Häufen sich Korallenbleichen?

Empfindliche Arten sind schon weg? Haben wir schon alle Arten bestimmt?

Mit welcher Geschwindigkeit wird das Wasser wärmer? Schneller als der saisonale Wechsel oder langsamer? Wie sieht es im täglichen Wechsel aus?

Verstehe ich das richtig, die Ozeane werden wärmer und die Korallen entwickeln sich zu Kaltwasser Korallen, und gehen dann bei Wärme ein?

Und bedingt, aber was meinen sie, wenn wir Gehirnzellen wachsen lassen könnten, würden mehr oder weniger Menschen so sein wie sie?

Bitte Quelle und Namen der Wissenschaftler angeben. Haben sie schon mal so ein Riff besucht?

Ja, Korallenbleichen häufen sich. Und da sie passieren (immer häufiger), scheint das Abkühlen durch Verdunsten nicht zu reichen. Ihre anderen Fragen ergeben wenig Sinn. Bei der Bedrohung der Korallen spielt nicht die Variabilität der Temperatur eine Rolle (ideal sind 24 bis 28°C), sondern die Grenztemperatur (>= 30°C), die nicht überschritten werden sollte. Und da die Meere immer wärmer werden, wird diese Grenze wenig überraschend immer schneller, immer öfter und vor allem in allen großen Meeresbecken gleichzeitig gerissen. Das ist jetzt keine Raketenwissenschaft und auch ohne Gentechnik mit normaler humaner Hirnleistung zu verstehen… 🙂

Empfehle diese Serie hier angefangen mit Artikel 1 zu studieren.

Was sie so im Straßenslang als „Reissen“ bezeichnen, hat das wissenschaftliche Grundlagen oder ist das ihre Interpretation?

Seit wann beobachtet die Wissenschaft Korallen, wie sieht die Häufigkeitsverteilung der Bleichen aus? Von welchen Riffen sprechen wir?

Hier noch Etwas wissenschaftliches.

Und hier noch was logisches, wenn die Ozeane ueberall waermer werden, dann werden mehr Lebensraeume fuer Warmwasserkorrallen geschaffen. Also wird es sicher kein Ende dieser sein.

Das mit den Korallen erschließt sich mir nicht. Ich denke die werden sich in anderen Regionen ausbreiten die dann plötzlich warm genug sind.