Wie auch Andere hier schon angemerkt haben, liegt das Problem darin, dass das, was für individuelle Wissenschaftler gut ist, nicht notwendigerweise auch für die Wissenschaft als Ganzes gut ist. Gegenwärtig ist die Karriere eines Wissenschaftlers abhängig von der Veröffentlichung so vieler Studien wie möglich in den prestigeträchtigsten Journalen. Mehr als alles andere verschafft ihnen dies Prestige, [finanzielle] Zuwendungen und Jobs.

Jetzt stelle man sich vor, man sei ein Forscher, der mit diesem System spielen will. Folgendes wird man tun: man fertige viele kleine und statistisch auf schwachen Füßen stehende Studien an. Man optimiere dann seine Verfahren, um positive Ergebnisse sicherzustellen. Falls man negative Ergebnisse erhält, kehre man sie unter den Teppich. Man versuche niemals, frühere Ergebnisse zu checken; man verfolge nur neue und begeisternde Ergebnisse. Dies ist kein Larifari. Wir wissen, dass es solche Praktiken im Überfluss gibt. Sie sind großartig, um Veröffentlichungen zu lancieren, aber sie verunreinigen auch die wissenschaftliche Aufzeichnung mit Ergebnissen, die tatsächlich nicht wahr sind. Richard Horton, Herausgeber von The Lancet, schrieb einmal: „Niemand wird Anreize bekommen, um Recht zu haben. Stattdessen bekommen Wissenschaftler Anreize, produktiv zu sein“.

Dies ist kein neuer Gedanke. In den siebziger Jahren schrieb der Sozialwissenschaftler Donald Campbell, dass jedwede Qualitäts-Metrik korrumpiert werden kann, falls die Leute anfangen, die Metrik selbst zu priorisieren über die Wesenszüge, die sie vermeintlich reflektiert. „Wir fanden, dass dieses Argument selbst dann funktioniert, falls Individuen nicht versuchen, ihre Metrik zu maximieren“, sagt Smaldino.

Er und McElreath zeigten dies hier, indem sie ein mathematisches Modell erzeugten, in dem simulierte Labore miteinander im Wettbewerb standen und sich entwickelten – man denke an SimAcademia. Die Labore wählten Dinge, die sie studieren wollten, ließen Experimente laufen, um ihre Hypothesen zu testen und versuchten, ihre Ergebnisse zu veröffentlichen. Sie variieren hinsichtlich der Stärke der Bemühungen zum Austesten ihrer Gedanken, was darauf einwirkt, wie viele Ergebnisse sie bekommen und wie zuverlässig diese Ergebnisse sind. Da gibt es einen Zielkonflikt: Mehr Mühe bedeutet richtigere, aber weniger Veröffentlichungen.

Im Modell wie in der Akademia sind positive Ergebnisse leichter zu veröffentlichen als negative, und Labore, die mehr veröffentlichen, bekommen mehr Prestige, Förderung und Studenten. Auch sie geben ihre Verfahren weiter. Mit jeder Generation stirbt eines der ältesten Labore, während sich eines der produktivsten reproduziert und Nachwuchs hervorbringt, der den Forschungsstil seines Doktorvaters nachmacht. Das ist das Äquivalent eines Studenten aus einem erfolgreichen Team, der ein eigenes Labor eröffnet.

Mit der Zeit und über viele Simulationen gleiten die virtuellen Labore unaufhaltsam in Richtung weniger Mühe, schlechtere Verfahren und fast vollständig unzuverlässiger Ergebnisse. Das Wichtige dabei ist: Anders als der hypothetische Forscher, den ich zuvor heraufbeschworen habe, versucht keiner dieser simulierten Wissenschaftler aktiv zu schummeln. Sie wandten keine Strategie an und verhielten sich integer. Und doch glitt die Gemeinschaft in Richtung schlechterer Verfahren. Das Modell zeigt: eine Welt, die Wissenschaftler für Publikationen über allem anderen belohnt – also eine dieser Welt nicht ganz unähnliche – führt auf natürliche Weise zu schwächerer Wissenschaft.

„Das Modell kann sogar optimistisch sein“, sagt Brian Nosek vom Center of Open Science, weil es nicht unsere unglückliche Tendenz in Betracht zieht, den Status Quo zu rechtfertigen und zu verteidigen. Er merkt zum Beispiel an, dass Studien im Bereich der sozialen und biologischen Wissenschaften im Mittel beklagenswert schwach ausgestattet sind – sie sind zu klein, um zuverlässige Ergebnisse zu erbringen.

Geringe statistische Belastbarkeit ist ein offensichtliches Symptom schwacher Forschung. Sie ist leicht zu berechnen, und die Menschen haben darüber seit den sechziger Jahren geredet. Und doch, über 50 Jahre später, hat sich daran überhaupt nichts verbessert. Tatsächlich „gibt es nach wie vor aktiven Widerstand gegen Bemühungen, die statistische Belastbarkeit zu erhöhen, und zwar seitens der Wissenschaftler selbst“, sagt Nosek. „Wenn der Wunsch nach Veröffentlichung höher ist als der Wunsch nach Richtigkeit, werden Forscher geringe statistische Belastbarkeit verteidigen, obwohl dies Null Qualität für die Wissenschaft bedeutet“.

Wichtig: „Solange es die Anreize gibt, wird es Belohnungen für jene geben, die das System täuschen können, ob sie das nun absichtlich machen oder nicht“.

Wissenschaftler haben jetzt mit den Konsequenzen dieser Stagnation zu kämpfen. In vielen Bereichen, darunter Neurowissenschaft, Genetik, Psychologie, Ökologie und Biomedizin, gibt es Gerede über eine Reproduzierbarkeits-Krise, in der schwache und schlechte Studien die Welt mit zweifelhaften Ergebnissen überschwemmt haben. „Wir bringen viel Zeit damit zu, uns über die Kultur der Wissenschaft zu beklagen, aber verbale Diskussionen erlauben es den Leuten, darüber zu reden“, sagt Smaldino. „Ein formelles Modell erlaubt es deutlicher zumachen, worüber man spricht“.

Zum Beispiel haben sich viele Wissenschaftler auf Replikation konzentriert – also der Wiederholung von Studien, um zu sehen, ob deren Ergebnisse stehen – als eine Art, die Zuverlässigkeit der Wissenschaft zu verbessern. Aber das würde dem Modell von Smaldino und McElreath zufolge nichts besser machen. Ihre Labore könnten Zeit damit verbringen, Arbeiten der Vergangenheit zu reproduzieren, und falls diese Versuche scheitern, würden die ursprünglichen Autoren einen erheblichen Rufschaden erleiden. Aber das spielte keine Rolle, „weil es viel mehr Ergebnisse gibt als überhaupt reproduziert werden können“, sagt Smaldino. Langfristig sind Labore damit durchgekommen, wenn sie schlechte Verfahren angewendet hatten, sogar falls andere sie mit ihren dubiosen Ergebnissen konfrontierten.

„Solange es die Anreize gibt, wird es Belohnungen für all jene geben, die das System beschummeln können, ob sie das nun absichtlich tun oder nicht“, sagt Smaldino. Um die Wissenschaft zu verbessern, müssen sich die Anreize ändern.

Und diese Änderungen müssen für alle Bereiche gelten, aber es müssen keine großen Veränderungen sein, sagt Nosek. Beispiel: Wenn Wissenschaftler nach Promotionen streben, werden sie oftmals aufgefordert, eine vollständige Liste ihrer Studien vorzuweisen. Niemand hat die Zeit, alle diese Studien zu lesen, und darum greifen die Mitglieder des Komitees zu an sich unpassenden Dingen wie etwa der Anzahl der Studien oder dem Prestige der Journale. „Eine einfache Änderung wäre es, den Kandidaten aufzufordern drei Artikel einzusenden, welche das Komitee lesen und detailliert bewerten kann“, sagt Nosek. „Das wären Anreize für die Kandidaten, drei herausragende Arbeiten zu erstellen“.

Aber in UK hat man ein solches System bereits aufgelegt, um Wissenschaftler zu beurteilen, und Andrew Higginson sowie Marcus Munafo, zwei Psychologen der Universities of Exeter bzw. Bristol würden verneinen, dass dies besser ist. Sie haben ein anderes mathematisches Modell angewendet, um vorherzusagen, wie sich Wissenschaftler verhalten sollen, um den Wert ihrer Veröffentlichungen für ihre Karriere zu maximieren. Und sie kamen zu dem Ergebnis, dass falls die Leute auf der Grundlage einer kleinen Anzahl von hoch einflussreichen Veröffentlichungen beurteilt werden, es für sie die beste Strategie ist, all ihre Bemühungen auf geringerwertige Studien zu konzentrieren, die sich nur an neuesten Ergebnissen ausrichten ohne die Ergebnisse älterer Studien zu checken. Als Folge davon wird die Hälfte dessen, was sie veröffentlichen, falsch sein.

Es gibt andere Lösungen. Einige Wissenschaftler haben sich für ein System der „Vor-Registrierung“ [pre-registration] stark gemacht, wobei die Arbeit vor dem Hintergrund ihrer Gedanken und Pläne bewertet wird, bevor irgendeine Arbeit tatsächlich angefertigt wird. Sie verpflichten sich, den Plan buchstabengetreu auszuführen, und die Journale verpflichten sich, die Ergebnisse zu veröffentlichen, egal welcher Art diese sind. Das reduziert die Kapazität und den Anreiz, mit Studien Schindluder zu treiben, um die eigenen Chancen auf die Durchführung einer Studie zu erhöhen. Außerdem verschiebt sich der Schwerpunkt weg von augenfälligen Ergebnissen hin zu soliden, zuverlässigen Verfahren. Fast 40 Journale veröffentlichen diese Art von Registered Reports, und es gibt Bemühungen, diese enger an Zuwendungen zu binden (hier), so dass eine einzelne Begutachtung der Verfahren in einer Studie Zuwendungen und Veröffentlichung garantiert.

Das Hauptgewicht auf Transparenz zu legen, kann ebenfalls helfen, sagt Simine Vazire, eine Psychologin an der University of California. „Falls die Autoren verpflichtet werden, mehr Details über ihre Forschungen bekannt zu geben, werden die Journale und die Begutachter besser in der Lage sein, die Qualität dieser Studien zu evaluieren, und es wird viel schwieriger für die Autoren sein, das System vorzuführen“.

Spitzenjournale wie Nature und Science ermutigen Autoren tatsächlich, transparenter zu sein hinsichtlich Daten und Verfahren, während sie Checklisten ausgeben, um es einfacher für die Herausgeber zu machen, die statistischen Qualitäten neuer Studien zu inspizieren. Und das Center for Open Science von Nosek hat Standards für Transparenz, Offenheit und Reproduzierbarkeit erstellt (hier), welche Journale und Geldgeber übernehmen können, sowie Auszeichnungen für gutes Verhalten (hier).

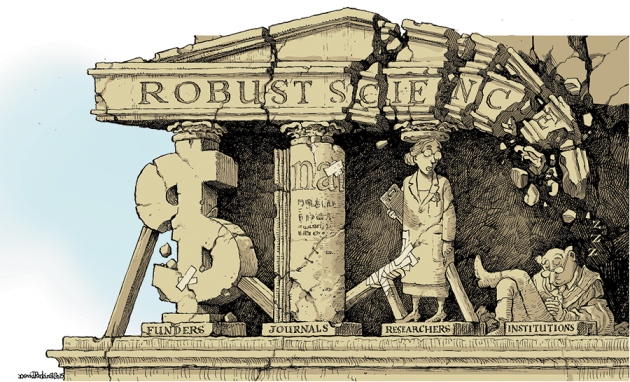

Ultimativ „ist die Änderung von Anreizen über das gesamte Wissenschafts-Ökosystem ein Problem der Koordination“, sagte Nosek. „Institutionen, Geldgeber, Herausgeber, Gesellschaften und die Forscher selbst müssen ihre Erwartungen allesamt etwas ändern. Ohne dies wird keine Änderung effektiv sein“.

Munafo ist voller Hoffnung. „Wir haben Fortschritte gemacht, von der Beschreibung des Problems hin zum Verständnis von dessen Natur“, sagt er. „Das ist ein gutes Zeichen. Hoffen wir, dass es uns Hinweise gibt, wo wir Anreiz-Strukturen am effizientesten ändern können. Wir stecken mitten in einem faszinierenden natürlichen Experiment, wobei viele Innovationen eingeführt oder angestoßen werden. Was funktioniert und was nicht, und was populär ist und was nicht, bleibt abzuwarten“.

„Ich möchte nicht übermäßig pessimistisch sein“, sagt Smaldino. „Es gibt viele wirklich gute Wissenschaftler, die nach Arbeiten mit hoher Qualität streben. Es gibt immer mehr Individuen, die erkennen, dass Qualität tatsächlich bedeutsam ist. Ich hoffe einfach, dass Sentiment vorherrscht“.

Link: http://www.theatlantic.com/science/archive/2016/09/the-inevitable-evolution-of-bad-science/500609/

Übersetzt von Chris Frey EIKE

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"#3: Guido Scholzen zu Lesch

ich will den Quatsch von ihm gar nicht mehr lesen,

er ist ein Lügner,

gerade als Astrophysiker müsste er den Erwärmungseffekt durch die Wirkung der Schwerkraft BESTENS kennen. BESTENS!

Sie fehlt in der CO2-Erwärmungshypothese.

Wärme ist an Masse gebunden.

Und da es auch Wärmestrahlung der Planeten gibt, kühlen die alle langsam aber sicher ab. Alle, auch die Erde.

Der Mars mit reiner CO2-Atmosphäre (96%) hat das schon hinter sich, ist wesentlich kälter als die Erde mit den lächerlichen 0,04% CO2.

Wärme ist an Masse gebunden.

Lesch sollte einen Feuerwehrmann und einen Gärtner fragen, wofür CO2 nützlich ist.

Sauerstoff ist schon deutlich gefährlicher,

aber ein BELEG, dass früher bei mehr CO2 in der Luft, das Pflanzenwachstum WESENTLICH INTENSIVER war als heute.

MfG

Der Artikel findet meine vollste Zustimmung. Einzelwohl (des Wissenschaftlers) vor Gemeinwohl (der Wissenschaft). Je mehr Artikel ein „Wissenschaftler“ in „renommierten“ Fachpublikationen veröffentlicht, umso karrierefördernder ist es. Kommen dann noch einige Bücher hinzu, die in der Regel nur ein „Aufbacken“ dieser Artikel darstellen, wird er auch der Öffentlichkeit bekannt und durch die Medien gereicht.

Das gilt nicht nur für die Naturwissenschaften, sondern auch für die, oft als „weiche Wissenschaft“ bezeichnete Wirtschaftswissenschaft. Ob die Entscheidungen des Nobelpreiskommitess in den letzten 20 Jahren Alfred Nobel gefallen hätten? Ich melde Zweifel an.

Wäre es sinnvoll, wenn Wissenschaftler einen Eid ähnlich dem hippokratischen Eid der Mediziner ablegen würden?

Harald Lesch hat wieder einen vom Stapel gelassen.

http://tinyurl.com/hp9p942

– diesmal geht es um Sauerstoff und Kohlenstoffisotope, die vor millionen von Jahren proportional angestiegen sind

– es geht um mehr CO2 in der Luft, die dann dazu führt, dass Pflanzen schlechter wachsen – und zum Schluss wird das wieder in Computersimulationen miteingerechnet.

– Noch nie war es mit dem Klima so schlimm wie heute – der Mensch ist daran schuld – und… an Naturgesetzen kommt man nicht drumrum.

Volksverblödung vom feinsten.

Das ist die Evolution schlechter Wissenschaft:

Diese Wissenschaftler erzählen dreimal so nen Quatsch, und dann glauben die es noch selber.

Wahre Wissenschaft hat nur ein Ziel: Erkenntniserweiterung. Insofern ist „Karriere“ eines Wissenschaftlers ein fataler Begriff, oftmals abhängig von der Nutzbarkeit für „Anonymus“, die mit „Wissensmanagement“ und PR-Methoden Wissenschaftler als Marionette aufbauen, um selber mit ihren Zielen im Hintergrund zu bleiben.

Insofern sind diese letzten 40 Jahre der Klimawissenschaft eine Neuauflage des „Kalten Krieges“ als Rollen-Maskerade zwischen Geld und Wissen, ein Kalter Krieg, ausgetragen auf dem Felde der Wissenschaft.

Ausgangspunkt war das Manhattan-Projekt, was den russischen Wissenschaftlern und der auch Sowjet-Führung vor Augen hielt, daß sie mangels Geld nicht mithalten konnten. Der russische Physiker Pjotr Kapitza gab Stalin den Rat, das Wissen der Physiker mit der Autorität von Unternehmensführern zu paaren, damit das ZK die Ideen der Wissenschaftler (Sacharows und seine eigenen) leichter schluckte. Stalin folgte diesem Rat nicht, den Kapitza in vielen Briefen an Stalin ausgebreitet hatte. Dafür haben die Physiker-Kollegen Kapitzas im Westen diesen Gedanken der Rollen-Maskerade aufgenommen, Kapitza hatte einige Zeit in Cambridge geforscht, man kannte sich.

Als dann nach Kriegsende die Physiker des Uran-Vereins nach Ost und West verstreut wurden, haben sie aus dem Gedanken Kapitzas ein Friedenskonzept geschmiedet, haben mit der Pugwash-Bewegung über die Wissenschaftsebene Verbindungen zwischen Ost und West geknüpft, die über das Laxenburger „International Institut for Applied Systems Analysis“ IIASA zu einem Konzept einer globalen Regierungsform ausgearbeitet wurden, in der „unabhängige und selbständige Forschungsorganisationen“ über den nationalen Regierungen rangieren sollten. Flankiert wurde das Ganze von Carl Friedrich von Weizsäcker und seinem Starnberger MPI, das der Machtverschiebung zwischen Politik und Wissenschaft einen philosophischen Überbau verpaßte, genannt „Weltinnenpolitik“

Wie „unabhängig“ diese Art Wissenschaftler sind, kann man an der Verfolgung Andersdenkender ablesen

In Open Science und Transparenz die Lösung zu sehen, ist ein schlechter Scherz, wird die Materialschlacht nur ausweiten, zu Wissensklau einladen, zu Locken auf Abwege, Zunahme von Relevanzübertreibungen und noch raffiniertere Fallenstellerei, getarnt als Wissenschaft.

Die Trennung von Wissenschaft und Politik ist das einzige, was helfen würde, zu einer freien Wissenschaft zurückzukommen.

Nicht minder wichtig ist die Trennung von Staat und Kirche, denn es war der Sacharow-Anhänger Crutzen mitsamt der DPG, die die Kirche ins Boot des Wissenschaftskrieges holten. Und Crutzen war es, der Schellnhuber in die Päpstliche Akademie der Wissenschaften bugsiert hat, an deren Präsidenten und Mitgliedern vorbei.

Vor einiger Zeit erschien ein Bericht auf WUWT. Darin wurde u.a. über eine Studie von Bayer zur Krebsforschung berichtet. Danach sind 75% aller Studien zur Krebsforschung salopp gesagt, das Papier nicht wert auf dem sie gedruckt sind. Abgesehen davon, daß die Autoren schlecht Wissenschaft betreiben, ist es sehr schlimm das solche falschen Ergebnisse dann zu fehlerhaften Behandlungen von Menschen führen können.

MfG