[*Vorbemerkung der Redaktion: In Deutschland wird dieses Verfahren schon sehr lange nicht mehr angewendet. Hier wird die Tagesmitteltemperatur seit Jahr und Tag folgendermaßen ermittelt: T(7.00h) + T(14.00h) + 2 x T(21.00h)/4 (Angaben in MEZ). Als Grundlage dienten die sog. „Mannheimer Stunden“ (mehr dazu hier), definiert bereits im 18 Jahrhundert. Die Verdoppelung des Messwertes von 21 Uhr sollte einmal eine Nachtmessung ersparen, zweitens liegt er ziemlich genau zwischen den Tagesextremen und wird auch morgens durchlaufen.

In anderen europäischen Ländern, wie auch Russlands wurden andere Algorithmen verwendet. Allen ist gemeinsam, dass sie für denselben Tagestemperaturverlauf unterschiedliche Mitteltemperaturen ergeben. Details dazu z.B. hier. Fakt ist jedoch auch, dass bedingt durch die englische US- amerikanische Dominanz besonders im 19.Jahrhundert die Max Min Methode die weltweit bestimmende war.

Nach Erfindung der Digitalthermometer hat man die stündlichen Werte durch 24 dividiert, um die Tagesmittelwerte zu berechnen. Ein am Institut für Meteorologie viele Jahre lang durchgeführter Vergleich beider Verfahren zeigt zwar ähnliche Werte mit nur wenigen Ausnahmen aufgrund der Advektion unterschiedlich temperierter Luftmassen.

Da in jedem Fall die Anomalien der absoluten Mittelwerte gebildet werden, dürfte sich deren Verhalten, besonders in einer Zeitreihe, von der im Text beschriebenen unterscheiden. Für das Folgende spielen dieser Umstand auch nur eine untergeordnete Rolle. Man muss ihn aber bei der Lektüre im Hinterkopf behalten.

Trotzdem ist die Beachtung der in der Signaltheorie entwickelten Gesetze auch bei der Auswertung von meteorologischen Verläufen empfehlenswert. Autor Werner Kohl hat auf Die Kalte Sonne dazu schon einiges geschrieben. (hier)

Ende Einschub]

Allerdings ist die Lufttemperatur ein Signal, und Messungen von Signalen müssen den mathematischen Gesetzen der Aufbereitung von Signalen folgen. Das Nyquist-Shannon Sampling Theorem sagt uns, dass wir ein Signal mit einer Rate messen müssen, die mindestens doppelt so hoch ist wie die höchste Häufigkeits-Komponente des Signals. Das nennt man die Nyquist Rate. Sammelt man Proben mit einer geringeren Rate, kommt ein Alias-Fehler [? hier steht etwas dazu. Anm. d. Übers.] in die Messungen. Je geringer die Mess-Häufigkeit im Vergleich zu Nyquist, umso größer wird der Fehler bei Berechnungen der Mitteltemperatur und von Trends. Das Nyquist Sampling Theorem ist heutzutage grundlegende Wissenschaft in jedem technologischen Bereich. Digitales Hören und Sehen, industrielle Prozess-Steuerung, medizinische Instrumente, Flugkontroll-Systeme, digitale Kommunikation usw. – alles beruht auf der grundlegenden Mathematik und Physik von Nyquist.

Die NOAA hat in ihrem USCRN (US Climate Reference Network) bestimmt, dass es notwendig ist, eine Anzahl von 4320 Messungen pro Tag zu haben, um Nyquist anwenden zu können. 4320 Messungen pro Tag bedeuten eine Messung alle 20 Sekunden. Das ist die anwendungsorientierte Nyquist-Anzahl von Messungen. Die NOAA mittelt diese 20-Sekunden-Messwerte zu einer Messung alle 5 Minuten oder 288 Messungen pro Tag. Die NOAA veröffentlicht auch nur diese 288 Messungen pro Tag (nicht die 4320 Messungen pro Tag). Eine Rate wird dann nur aus diesen 288 Messungen pro Tag berechnet (oder „5-Minuten-Messungen). Diese Rate kann allerdings nur erhalten werden mittels automatisierten Messungen mit elektronischen Instrumenten. Die meisten instrumentellen Aufzeichnungen enthalten Ablesungen von Quecksilber-Max/Min-Thermometern, welche lange vor der Automatisierung eine Option waren. Heutzutage nutzt man für instrumentelle Aufzeichnungen trotz der Verfügbarkeit von Automatisierung immer noch Tmax und Tmin (im Endeffekt 2 Messungen pro Tag) anstatt einer Messdaten-Gewinnung nach Nyquist. Grund hierfür ist, die Vergleichbarkeit mit älteren historischen Aufzeichnungen zu wahren. Mit lediglich 2 Messungen pro Tag ist die instrumentelle Aufzeichnung jedoch stark aliased. In dieser Studie wird gezeigt, dass das historische Verfahren signifikante Fehler bei den Mitteltemperaturen und den langzeitlichen Temperaturtrends ergibt.

Das UACRN der NOAA ist ein kleines Netzwerk, welches im Jahre 2008 komplett war, und es trägt nur sehr wenig zu den instrumentellen Aufzeichnungen insgesamt bei. Allerdings bieten die USCRN-Daten eine besondere Gelegenheit, eine hochwertige Version des historischen Verfahrens mit dem Nyquist-Verfahren zu vergleichen. Die Max- und Min-Werte werden ermittelt mit den höchsten und niedrigsten Werten unter den 288 Messungen über den interessierenden 24-Stunden-Zeitraum.

Beispiele aus dem USCRN der NOAA zur Illustrierung des Effektes eines Verstoßes gegen das Nyquist-Theorem bzgl. der Mitteltemperatur

Das folgende Beispiel soll zeigen, wie der Fehler bei der Berechnung der Mitteltemperatur zunimmt, wenn die Anzahl der Messungen abnimmt. Abbildung 1 zeigt die Temperatur, wie sie am Messpunkt Cordova AK [= Alaska] am 11. November 2017 gemessen worden ist, und zwar mittels der 5-Minuten-Messungen nach USCRN:

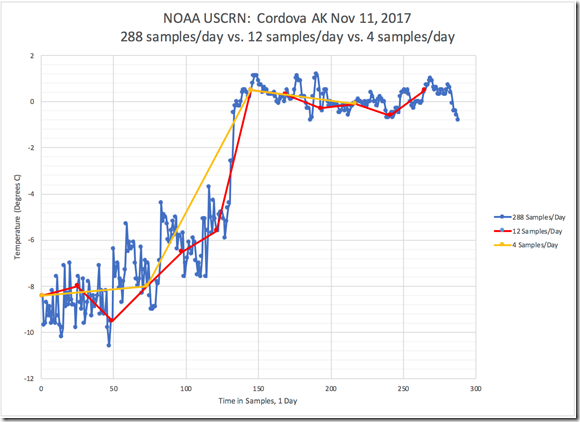

Die blaue Linie repräsentiert die 288 Temperaturmessungen jenes Tages. Sie zeigt 24 Stunden mit Temperaturdaten. Die grüne Linie zeigt die korrekte und genaue tägliche Mitteltemperatur, berechnet aus der Summe aller Messwerte dividiert durch die Anzahl der Messungen. Temperatur ist nicht Wärmeenergie, aber sie wird verwendet als eine Annäherung an dieselbe. In dieser Hinsicht zeigen die grüne Linie (Mitteltemperatur) und die Tageslinie (blaue Linie) genau die gleiche Menge von Wärmeenergie über den Zeitraum von 24 Stunden jenes Tages. Das korrekte Mittel beträgt -3,3°C. Tmax wird repräsentiert durch die orange, Tmin durch die graue Linie. Sie ergeben sich aus dem höchsten bzw. niedrigsten Wert der 288 Messungen über den 24-Stunden-Zeitraum. Das aus (Tmax + Tmin)/2 berechnete Mittel zeigt die rote Linie. (Tmax + Tmin)/2 ergibt einen Mittelwert von -4,7°C, weist also einen Fehler von 1,4°C im Vergleich zum korrekten Mittel auf.

[Dazu noch einmal zum Einschub oben: Bei dem zumindest in Deutschland gebräuchlichen Verfahren ist der Fehler geringer, was den Ausführungen des Autors zufolge aber auch daran liegen kann, dass es vier Messungen zu ganz bestimmten Zeiten sind und nicht nur zwei zu verschiedenen Zeiten am Tag. Daher zeigt sich in der folgenden Tabelle (Abbildung 2) bei 2 bzw. 4 Messwerten bei der Berechnung des Mittels der gleiche Fehler. Anm. d. Übers.]

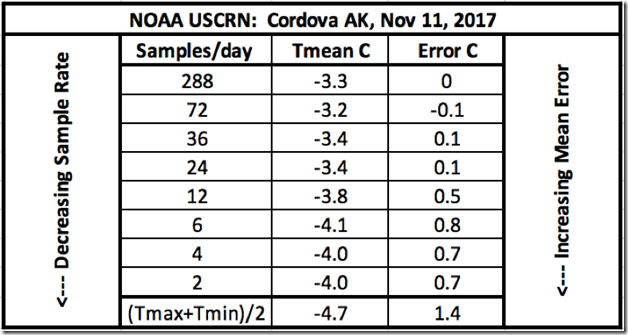

Mit den gleichen Signalen und Daten aus Abbildung 1 zeigt die Tabelle in Abbildung 2 die berechneten Temperaturmittel in Abhängigkeit von einer immer weiter abnehmenden Zahl von Messwerten. Diese reduzierten Raten kann man mittels Division der 288 Messwerte pro Tag durch 4, 8, 12, 24, 48, 72 und 144 errechnen. Bei einer angemessenen Aussortierung der Messwerte nach diesem Verfahren ist der Gesamteffekt der gleiche, als ob man im Original mit reduzierter Rate gerechnet hätte. Das sich aus dieser reduzierten Anzahl von Messwerten ergebende korrespondierende Aliasing zeigt sich auch in der Tabelle:

Aus der Tabelle geht klar hervor, dass bei Reduktion der Anzahl der Messwerte unter Nyquist der daraus erwachsende korrespondierende Fehler infolge des Aliasing zunimmt. Auch zeigt sich eindeutig, dass 2, 4, 6 oder 12 Messwerte pro Tag ein sehr ungenaues Ergebnis zeitigen. Eine Anzahl von 24 Messungen pro Tag (also stündlich) bis zu 72 Messwerten pro Tag (3 Messwerte innerhalb von 1 Stunde) kann genaue Ergebnisse erzielen – oder auch nicht. Die NOAA hat sich für 288 Messwerte pro Tag entschieden (4320 Messwerte pro Tag vor der Mittelbildung). Also wird das jetzt als der gegenwärtige Grund-Standard angesehen. Eine Anzahl von Messwerten unter 288 pro Tag wird (und sollte auch) als eine Verletzung des Nyquist-Theorems angesehen werden.

Es ist interessant darauf hinzuweisen, dass das in der Tabelle Gelistete einen Fehler von 0,7°C zeigt. Aber (Tmax + Tmin )/2 sind technisch 2 Werte pro Tag mit einem Fehler von 1,4°C, wie aus der Tabelle folgt. Wie kann das sein? Es kann sein, weil (Tmax + Tmin )/2 ein Sonderfall von 2 Messungen pro Tag ist, sind doch diese beiden Messungen nicht gleichmäßig über den Tag verteilt. Sie treten jeweils zu unterschiedlichen Zeiten auf. Bei geeigneten Messungen messen wir nach der Uhr – mit Messungen zu jeweils genau der gleichen Zeit an jedem Tag. Die Tatsache, dass Tmax und Tmin zu unregelmäßigen Zeiten am Tag auftreten, verursacht eine eigene Art von Messfehler. Es liegt jenseits dieser Studie, diesen in vollem Umfang zu erklären. Im Bereich der Signalanalyse und der Datengewinnung ist das ein bekanntes Problem. 2 Messungen pro Tag zu regelmäßigen Zeiten wird wahrscheinlich bessere Ergebnisse zeigen als das Auffinden der Höchst- und Tiefsttemperatur irgendeines gegebenen Tages. Die instrumentelle Temperaturaufzeichnung wendet das absolut schlechtestmögliche Verfahren an – was zu einem maximalen Fehler führt.

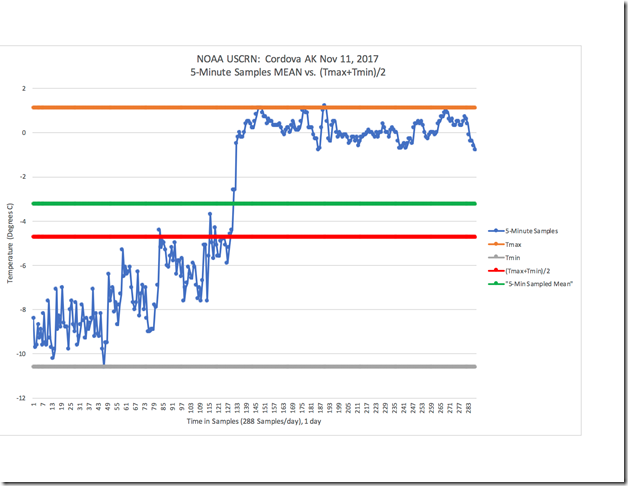

Abbildung 3 zeigt das gleiche tägliche Temperatursignal wie Abbildung 1, repräsentiert durch die 288 Messwerte pro Tag (blaue Linie). Ebenfalls gezeigt ist das gleiche tägliche Temperatursignal, errechnet aus 12 Messwerten pro Tag (rote Linie) und 4 Messwerten pro Tag (gelbe Linie). Aus dieser Abbildung geht schon für das bloße Auge hervor, dass viele Informationen des Original-Signals bei der Verwendung von nur 12 Werten pro Tag verloren gehen, und sogar noch mehr bei nur 4 Werten pro Tag. Es sind diese verloren gegangenen Informationen, welche das resultierende Mittel verfälschen. Diese Abbildung illustriert graphisch, was man in der korrespondierenden Tabelle von Abbildung 2 erkennt.

Abbildung 3: NOAA USCRN-Daten für Cordova, AK vom 11. November 2017: Abnehmende Detail-Genauigkeit des Mittelwertes bei 12 bzw. 4 Werten pro Tag.

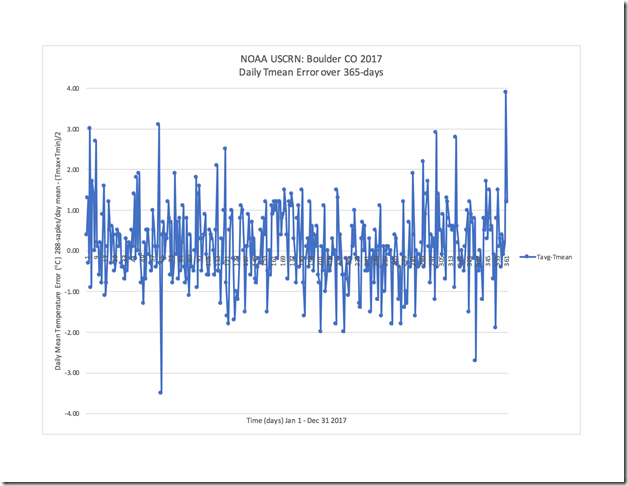

Abbildung 4 zeigt den täglichen mittleren Fehler zwischen dem Verfahren mit 288 Werten pro Tag nach USCRN und dem historischen Verfahren, wie er über 365 Tage an der Station Boulder in Colorado im Jahre 2017 gemessen worden war. Jeder Datenpunkt ist der Fehler jedes einzelnen Tages in der Aufzeichnung. Man erkennt aus Abbildung 4, dass (Tmax + Tmin )/2 tägliche Fehler bis zu ± 4 °C erzeugt. Die Berechnung eines Mittelwertes mit nur zwei Werten pro Tag ergibt kaum jemals den korrekten Mittelwert.

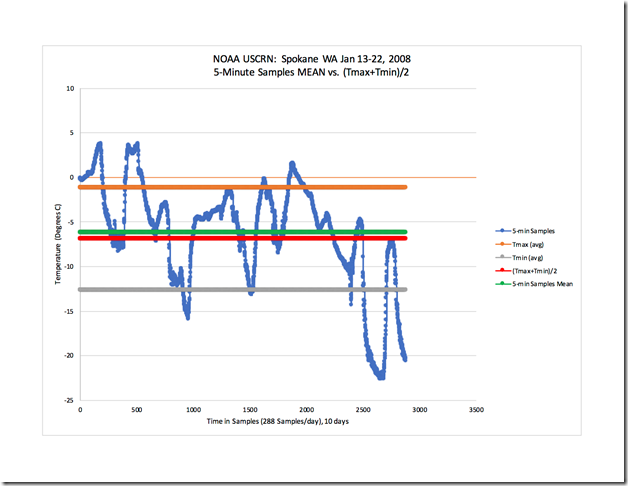

Betrachten wir noch ein weiteres Beispiel ähnlich dem in Abbildung 1 gezeigten, aber über einen längeren Zeitraum. Abbildung 5 zeigt (in blau) das 288 Werte pro Tag-Signal aus Spokane, WA [= Washington State, am Pazifik] vom 13. bis zum 22. Januar 2008. Tmax (mittel) und Tmin (mittel) sind jeweils in orange bzw. grau gezeigt. Das Mittel aus (Tmax + Tmin )/2 ist in rot dargestellt (-6,9°C) und das korrekte Mittel aus den alle 5 Minuten gemessenen Werten ist in grün dargestellt (-6,2°C). Das Mittel aus (Tmax + Tmin )/2 weist einen Fehler von 0,7°C über die 10-Tage-Periode auf.

Die Auswirkung einer Verletzung des Nyquist-Theorems auf Temperaturtrends

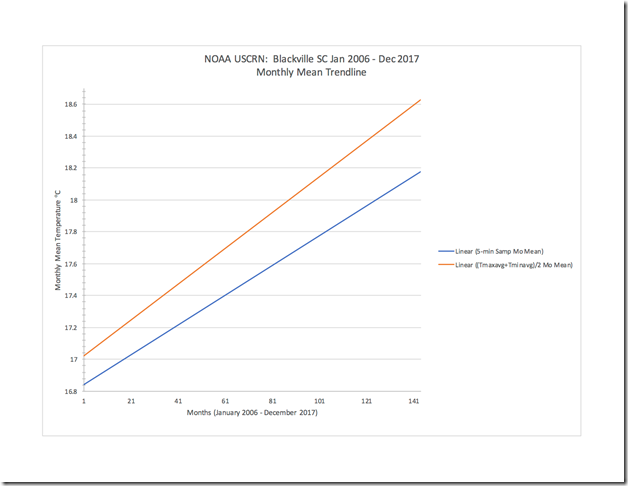

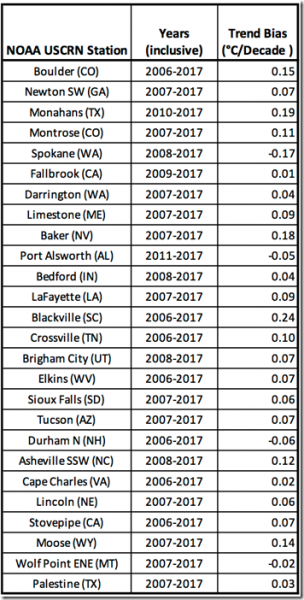

Schließlich müssen wir die Auswirkungen der Verletzung des Nyquist-Theorems bei der Anwendung auf Temperaturtrends betrachten. Abbildung 6 zeigt einen Vergleich zwischen linearen Temperaturtrends, wie sie sich aus dem historischen Verfahren ergeben, und Verfahren gemäß Nyquist unter Verwendung der Daten von Blackville, SC [= South Carolina], und zwar von Januar 2006 bis Dezember 2017. Man erkennt, dass der aus dem historischen Verfahren abgeleitete Trend (orange Linie) etwa 0,2°C wärmer anfängt und einen Erwärmungs-Bias von 0,24°C pro Dekade aufweist, jeweils im Vergleich zu dem Verfahren nach Nyquist (blaue Linie). Abbildung 7 zeigt den Trend-Bias oder Fehler (°C pro Dekade) für 26 Stationen im USCRN über einen Zeitraum von 7 bis 12 Jahren. Die 5-Minuten-Werte ergeben den Referenz-Trend. Fast jede Station zeigt einen Erwärmungs-Bias und nur wenige einen Abkühlungs-Bias. Der größte Erwärmungs-Bias beträgt 0,24°C pro Dekade und der größte Abkühlungs-Bias -0,17°C pro Dekade. Über alle 26 Stationen gemittelt ergibt sich ein Erwärmungs-Bias von 0,06°C. Wikipedia zufolge beträgt der berechnete globale Erwärmungstrend im Zeitraum 1880 bis 2012 0.064 ± 0.015°C pro Dekade. Schauen wir auf einen jüngeren Zeitraum, welcher den kontroversen „Stillstand der globalen Erwärmung“ enthält, und verwenden dann Daten von Wikipedia, erhält man die folgenden Erwärmungstrends – abhängig davon, welches Jahr man wählt als Beginn des „Stillstands“:

1996: 0.14°C pro Dekade

1997: 0.07°C pro Dekade

1998: 0.05°C pro Dekade

Obwohl man keine Schlussfolgerungen ziehen kann, wenn man die Trends über 7 bis 12 Jahre an 26 Stationen im USCRN vergleicht mit den gegenwärtig anerkannten lang- oder kurzzeitigen globalen Mitteltemperatur-Trends, kann dieser Vergleich instruktiv sein. Klar ist, dass die Anwendung des historischen Verfahrens zur Berechnung von Trends einen Trend-Fehler ergibt und dass dieser Fehler von ähnlicher Größenordnung sein kann wie die geltend gemachten Trends. Daher ist es vernünftig, die Validität der Trends zu hinterfragen. Es gibt keine Möglichkeit, diese Validität sicher herauszufinden, weil es bzgl. des Großteils der instrumentellen Aufzeichnung keine ordentlich errechnete Aufzeichnung zum Vergleich gibt. Aber mathematisch sicher ist, dass jede Mitteltemperatur und jeder Trend in den Aufzeichnungen signifikante Fehler enthält, falls das Verfahren der 2 Werte pro Tag angewendet worden ist.

Abbildung 6: NOAA USCRN-Daten für Blackville, SC von Januar 2006 bis Dezember 2017 – monatliche Mittel-Trendlinien

Schlussfolgerungen

1. Die Lufttemperatur ist ein Signal und muss daher gemessen werden nach den mathematischen Gesetzen, welche die Signalverarbeitung bestimmen. Die Wertesammlung muss gemäß dem Nyquist Shannon-Sampling Theorem durchgeführt werden.

2. Das Nyquist Shannon-Sampling Theorem ist seit über 80 Jahren bekannt und von grundlegender Bedeutung in jedem Technologiebereich, bei dem es um Signalverarbeitung geht. Eine Verletzung von Nyquist garantiert, dass die Werte korrumpiert sind mit einem Aliasing-Fehler, und die Werte werden nicht das sich ergebende Signal repräsentieren. Aliasing kann nach der Werte-Gewinnung nicht korrigiert werden.

3. Das Nyquist Shannon-Sampling Theorem erfordert, dass die Rate der Anzahl der Werte größer sein muss als 2 mal die höchste Häufigkeits-Komponente des Signals. Unter Verwendung automatisierter elektronischer Ausrüstung und Computer erstellt das NOAA USCRN Wertemengen mit einer Rate von 4320 Werten pro Tag (gemittelt zu 288 Werten pro Tag), um Nyquist praktikabel anwenden zu können und einen Aliasing-Fehler zu vermeiden.

4. Die instrumentelle Temperaturaufzeichnung beruht auf dem historischen Verfahren der Berechnung aus den Werten der täglichen Höchst- und Tiefsttemperatur. Daher verletzt die instrumentelle Aufzeichnung das Nyquist Shannon-Sampling Theorem.

5. Das USCRN der NOAA ist ein hochwertiges Datengewinnungs-Netzwerk, welches in der Lage ist, ein Temperatursignal ordentlich zu messen. Das USCRN ist ein kleines, im Jahre 2008 vervollständigtes Netzwerk und trägt nur wenig zu der gesamten instrumentellen Aufzeichnung bei. Allerdings bieten die USCRN-Daten eine besondere Gelegenheit, Analyse-Verfahren miteinander zu vergleichen. Ein Vergleich kann erfolgen zwischen Temperatur-Mittelwerten und Trends, errechnet aus Tmax und Tmin und einem ordentlich ermittelten Signal gemäß Nyquist.

6.Mittels der Verwendung einer begrenzten Anzahl von Beispielen aus dem USCRN wurde gezeigt, dass die Verwendung von Tmax und Tmin als Datenquelle die folgenden Fehler ergeben kann im Vergleich zu einem gemäß Nyquist ermittelten Signal:

a) Einen mittleren Fehler, der von Station zu Station sowie von Tag zu Tag an einer Station variieren kann.

b) einen mittleren Fehler, der mit der Zeit variiert mit einem mathematischen Anzeichen, welches sich ändern kann (positiv/negativ)

c) Tägliche mittlere Fehler bis zu ±4°C

d) Langzeitliche Trendfehler mit einem Erwärmungs-Bias bis zu 0,24°C pro Dekade und einem Abkühlungs-Bias bis zu -0,17°C pro Dekade.

7. Die volle instrumentelle Aufzeichnung weist keine angemessen ermittelte Wertemenge auf für einen Vergleich. Es bedarf weiterer Arbeiten, um zu bestimmen, ob eine theoretische Obergrenze berechnet werden kann für den Mittelungs- und den Trendfehler, der sich ergibt bei der Anwendung des historischen Verfahrens.

8. Das Ausmaß des beobachteten Fehlers mit der damit verbundenen Größenordnung der Unsicherheit stellen den wissenschaftlichen Wert der instrumentellen Aufzeichnung in Frage sowie auch die Praxis, Mittelwerte und langzeitliche Trends aus Tmax und Tmin zu berechnen.

Referenzen:

This USCRN data can be found at the following site: https://www.ncdc.noaa.gov/crn/qcdatasets.html

NOAA USCRN data for Figure 1 is obtained here:

NOAA USCRN data for Figure 4 is obtained here:

https://www1.ncdc.noaa.gov/pub/data/uscrn/products/daily01/2017/CRND0103-2017-AK_Cordova_14_ESE.txt

NOAA USCRN data for Figure 5 is obtained here:

NOAA USCRN data for Figure 6 is obtained here:

https://www1.ncdc.noaa.gov/pub/data/uscrn/products/monthly01/CRNM0102-SC_Blackville_3_W.txt

————————–

Die gesamte 21 Seiten starke Studie kann hier heruntergeladen werden (PDF).

Übersetzt von Chris Frey EIKE

![Zusammenfassende Version einer Studie mit dem Titel [übersetzt] „Missachtung von Nyquist: Eine weitere Quelle signifikanter Fehler bei Thermometer-Temperaturmessungen“](https://eike-klima-energie.eu/wp-content/uploads/2019/01/condensed_teaser.jpg)

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"Die meisten Klimadatenmessungen werden von Laien gemacht. In den USA wird einmal am Tag die Wetterhütte abgelesen. Daß viele von denen nicht korrekt stehen, also bei Polizeistationen in der Nähe des Kühlagregats, auf asphaltierten Parkplätzen, auf Dächern, neben Straßen, Flüssen und so fort ist inzwischen auch bekannt. Aber das ändert nur wenig, denn der US-Wetterdienst findet meist keine Interessenten, die die Wetterhütten betreuen wollen und überhaupt können.

Die DWD-Wetterstation in Lübeck befindet sich am Westende des Flughafens ca. 50 m entfernt vom asphaltierten Vorfeld und 20 Meter von der Hauptstraße von Lübeck Stadt zur Autobahn.

Also nix Neues über die Defizite der Aufstellung von Wetterhütten. Desweiteren muß man, wenn die USA betrachtet, berücksichtigen, daß die in Fahrenheit ganzzahlig messen, also nicht mit Zehntelgrad Celsius. Wenn man allerdings klimatische Trends ermitteln wil, spielt der absolute Fehler keine Rolle, denn der ist ja übers Jahr gesehen ziemlich konstant. Man kann also nur Trends betrachten aber eben keine absoluten Werte. Und wenns Thermometer geändert wird, der Meßort etc. muß korrigiert werden, wenn es geht.

„Vorbemerkung der Redaktion: In Deutschland wird dieses Verfahren schon sehr lange nicht mehr angewendet. Hier wird die Tagesmitteltemperatur seit Jahr und Tag folgendermaßen ermittelt: T(7.00h) + T(14.00h) + 2 x T(21.00h)/4 (Angaben in MEZ). Als Grundlage dienten die sog. „Mannheimer Stunden“ (mehr dazu hier), definiert bereits im 18 Jahrhundert.“

Der DWD zieht seit 31.3.2001 die Stundenwerte zur Berechnung der Tagesmittelwerte heran. Die Stundenwerte einzelner Stationen kann man herunterladen. Somit lassen sich die verschiedenen Näherungen <Tmin,Tmax> und <7,14,21,21> mit <0,1..23> vergleichen. Für die Station München Stadt finde ich für 2018:

<0,1..23>; 11,38 °C

<7,14,21,21>; 11,48°C

<Tmin,Tmax>; 11,56°C

Minimale Abweichung <7,14,21,21>-<0,1..23>; -2,1°C

Minimale Abweichung <Tmin,Tmax>-<0,1..23>; -1,4°C

Maximale Abweichung <7,14,21,21>-<0,1..23>; 2,4°C

Maximale Abweichung <Tmin,Tmax>-<0,1..23>; 3,3°C

Insgesamt betrachtet ist das Verfahren der Mannheimer Stunden nicht viel besser als <Tmin,Tmax>.

So ganz stimmt das mit dem Niquist nicht. Das Theorem ist nur einzuhalten, wenn der Verlauf reproduziert werden muss. Benötigt man aber nur Mittelwerte, ist eine Unterabtastung sehr wohl zulässig (und üblich). Diese ist dann aber über mehrere Perioden durchzuführen und bekommt abhängig von den abgetasteten Perioden ein sich immer mehr einengendes Fehlerband, wird also mit zunehmender Anzahl abgetasteter Perioden immer genauer.

Die Anzahl erforderlicher Abtastpunkte ist also abhängig davon, in welcher Auflösung man Mittelwerte und mit welchem Fehler man sie haben will.

Metereologischen Temperaturmessungen im Stile des USCRN (US Climate Reference Network) müssten aber auch genaue Normen enthalten, mit welcher Apparatur und in welcher Umgebung gemessen werden muss. D.h. festzulegen, w a s man überhaupt mißt. Diese Bedingungen haben sich bei allen Meßstationen im Laufe der Jahrzehnte mehrmals geändert. Nicht nur die Anzahl der Messungen, sondern auch die genannten Bedingungen sind entscheidend für brauchbare und vergleichbare Werte.

Es empfiehlt sich, die recht kontrovers geführte Diskussion zum Original-Artikel bei Wattsupwiththat aufmerksam zu lesen.

Das Abtsattheorem besagt, daß man einen beliebigen Signalverlauf dann vollständig reproduzieren kann, wenn man das Signal mindestens mit der doppelten höchsten vorkommenden Signalfrequenz abtastet. Aus diesem Grund ist z. B. die Abtastrate bei Audio-CDs 44,1 kHz. Damit kann man den Hörbereich 20Hz – 20.000 Hz inkl. Reserve verlusfrei reproduzieren.

Wenn man einen Temperaturverlauf, also die genaue Tagesverlaufskurve, reproduzieren will, muß man zuerst über einige Zeit kontinuierlich messen und diesen analogen Verlauf dann einer Fourieranalyse unerziehen, um festzustellen, was die höchste vorkommende Signalfrequenz ist. Und dann muß man mit der doppelten Frequenz abtasten und diese Werte speichern.

Die Frage ist allerdings, ist es ein Ziel einer Mittelwertbildung, diese aus dem ganz genauen Kurvenverlauf zu ermitteln? Kein einziges klassische Verfahren tut das, weil man früher immer nur wenige Werte pro Tag erfaßte. Daher sind alte Ablesemessungen mit modernen automatisierten Messungen nicht direkt vergleichbar, speziell dann, wenn die tatsächliche Kurve stark von der 24Stunden Grundsinusform abweicht.

Letzten Endes ist es eine Frage der Definition, was ein Tagesmittelwert ist und wie er gebildet wird.

Mir erscheint der Vorgang der Fertigwertbildung zu einem einzigen Welt-Wert jedenfalls wesentlich dubioser als einzelne Tageswertbildungen.

Stichwort – „Thermometer“ —- Stichwort: „Treibhauseffekt“

————————————————————————-

Ja, so ein Thermometer misst die Lufttemperatur.

Wie? – Durch Konvektion!

Es kann aber auch jede Strahlung absorbieren u. die dann entsprechende Temperatur anzeigen! Man lege es nur in die Sonne u. die Temperatur steigt gewaltig!

Es kann genauso auch die langwellige IR Strahlung absorbieren, ein Versuch mit einer IR Lampe zeigt es deutlich, auch hier steigt die Temperatur sofort!

So, nun die Frage an alle „THE“ Gläubigen Theoretiker, warum wird die angebliche Strahlung der Atmosphäre (ca 324 W/m²) und die der Erdstrahlung (ca 390 W/m²), nicht absorbiert u. in Erhöhung der Temperatur angezeigt???

Ja, wieder ganz einfach, weil keine Strahlung existiert!

Es gibt keinen „natürlichen“ und schon gar keinen „menschgemachten THE“ – auch über diesen Voodoo Glauben werden unsere Kinder u. Enkel einmal sehr lachen, wie wir über so manchen Glauben unserer Ahnen lachen!

Bitte die Klammern in den Formeln richtig setzen, sonst wirkt das ziemlich stümperhaft.

Es ist beachtenswert, dass vor den gewaltigen statistischen Betrachtungen mit Großrechnern nun auch endlich einmal Gedanken zur Messtechnik in die Klimaaufbereitung einziehen. Wenn bei üblichen Musik-CD’s nicht das Shannon Theorem Einzug gefunden hätte, kein Mensch würde sich diese Enstellungen bei der Wiedergabe antun und anhören. Da die Klima-Parameter-Aufbereitungen lautlos sind, kann man offenbar mit allen möglichen Verfälschungen aufwarten, es tut ja nicht direkt in den Ohren weh.

Jedenfalls sollten weitere Missachtungen messtechnischer Erfordernisse nicht mit der Vergleichbarkeit mit Werten aus falscher Messtechnik früherer Zeiten begründet werden, falls das Überleben der Menschheit damit im Zusammenhang stehen soll.

Erhebliche Zweifel sind angebracht, wenn Temperaturen ohne Bezug auf die Masse des erfassten Volumens untereinander gemittelt werden. Erst im Zusammenwirken mit einer Masse und deren thermischer Konstante kann über Temperaturen auf beinhaltete Energie geschlossen werden. Eine Mittelung korrekt erfasster Energien macht keinen Sinn, nur die Summation ist aufschlussreich, ein Prinzip, das bei jedem sog. Stromzähler erfolgreich angewandt wird.

Höhere oder niedrigere gemittelte Temperaturen sagen zunächst einmal gar nichts über die gesamte (globale) Energie und deren Trend zu höheren oder niedrigeren Werten aus. Mit etwas mehr messtechnischen Kenntnissen und mehr Bescheidenheit bei daraus abgeleiteten Schlüssen auf Erderwärmung oder -abkühlung wäre der Welt auf jeden Fall mehr geholfen als mit publizistischem Alarmimus.

Die Zeitkonstanten für die Aufnahme oder Abgabe von Energie unseres gesamten Globus einschließlich der großen Wassermassen der Weltmeere sind so groß, dass ein übereiliges Handeln aufgrund schnell erfundener, aber unbekannter Triggerpunkte nicht in wenigen Jahren erfolgen muss, falls es dem Menschen denn überhaupt obliegt, hier steuernd eingreifen zu können.

Mein berufliches Metier ist seit 40 Jahren die Temperaturmessung (Herstellung, Kalibrierung). Die Vergleichbarkeit der Meßreihen von früher und heute habe ich schon immer angezweifelt und damit das ganze Klimagedöns. Ich will an dieser Stelle nicht auf die vielen messtechnischen Fehlermöglichkeiten (z.B. „Englische Hütte gegenüber heutigen Messanordnungen, Standorte usw.) eingehen. @F. Blücher hat oben ja schon erwähnt, dass man erst einmal definieren müsste WAS und WIE gemessen werden müsste. Ich habe in meiner messtechnischen Praxis manche Überraschung erlebt, denn jedes berührend messende Thermometer mist immer nur die eigene Temperatur. Dazu gibt es Wechselwirkungen und Einflüsse, auch durch Bauart der Fühler bedingt, deren Grad man qualitativ manchmal nur schwer erkennen, respektive quantitativ reproduzierbar erfassen kann. Die von Ihnen hier eingebrachten Aspekte thermischer Konstanten haben wohl auch bisher nicht die erforderliche Beachtung gefunden und sind ganz sicher einer Betrachtung wert. Allerdings ignorieren die Klimaalarmisten „standhaft“ schon von Anfang an jegliche Kritik an ihrem unwissenschaftlichen Schwachsinn und jeden Fehlerhinweis. So wird wohl auch der von Ihnen angeführte Aspekt bei diesen Leuten wirkungslos verhallen, denn mehr als Alarmismus können die nicht.

Vielen Dank für den sachverständigen Hinweis. Es zeigt sich jedesmal wieder, sobald sich Fachleute zu Wort melden, bricht das Kartenhaus der Klimahysteriker zusammen. Es ist wirklich nur, wie Hartmut Bachmann schon lange sagt, ein Mittel einiger Finanzverbrecher auf dieser Welt, sich eine goldene Nase zu verdienen, und für die unzähligen Trittbrettfahrer, ein auskömmliches Einkommen zu erzielen.

Wen interessiert das schon. Obwohl die Atmosphäre ein Gasgemisch ist, wird von den Klimatologen der energetische Zustand NUR mit der Temperatur beschrieben. Und weil die ursprüngliche Basistemperatur noch nicht einmal erreicht wurde, schafft PIK die ab und definiert ein „relative Temperaturdifferenz“?

Für Klima braucht man die Erdoberflächentemperatur. Da wäre eine Messung im Erdreich sinnvoll. Da bekommt man Integration und Fehlerkorrektur gratis.

Carsten

—

Terroristen schaffen Arbeitsplätze

„Für Klima braucht man die Erdoberflächentemperatur. Da wäre eine Messung im Erdreich sinnvoll. Da bekommt man Integration und Fehlerkorrektur gratis.“

Richtig!

Als bei uns noch keine automatische Station im Ort war, waren zu Füßen der Englische Hütte einige Bodenthermometer mit verschiedenen Eintauchtiefen (ab einige wenige cm) vorhanden. Da ich beim Hersteller dieser Glasthermometer arbeitete, habe ich da seinerzeit ab und an unbürokratisch für Nachschub gesorgt. Ich denke, die gingen bis in 1 m Tiefe. Der Stationsableser hat diese Thermometer regelmäßig mit abgelesen und erfasst. Ob die damals aber auch zum Wetterdienst gemeldet worden sind oder irgendwie „landwirtschaftliche“ Verwendung fanden, kann ich nicht sagen. Standardmäßig scheint diese Erfassung heute nicht zu sein, aber spezielle elektrische Fühler gibt es. Aber: Oberflächentemperaturen haben ganz bestimmt auch so ihre Probleme in der Interpretation. @Peter Puschner hat oben einige Aspekte angerissen. Der Lufttemperatur ist der 0°C-Punkt relativ ergal, aber mit Bodenfeuchte und Aggregatzustandsänderungen der Bodenfeuchte wird es interessant. Dazu kommen die Tücken der Wärmeleitfähigkeiten aus Bodenzustand und Bodenzusammensetzung. Die Englische Hütte hat man seinerzeit wohl nicht ganz ohne Grund entwickelt.

In dieser Doku.

Aralkum – Die jüngste Wüste der Welt (2/5)

https://www.servus.com/de/p/Aralkum—Die-j%C3%BCngste-W%C3%BCste-der-Welt-%282-5%29/AA-1NUC5Y8812112/

wurde gesagt das die Temperatur um 6 Grad Celsius gestiegen ist seitdem der See ausgetrocknet ist(wegen Landwirtschaft).

Wie viele Messstellen gibt es in dieser Gegend?Diese dürfte man ja nicht verwerten wenn man den Klimwandel aufgrund des Co2 Anstiegs messen will.

Vielen Dank für diesen ausführlichen und guten Artikel. Jeder Student einer Naturwissenschaft lernt bereits im Anfangssemester, dass er während einer längeren Versuchsreihe weder den Standort noch sonst irgendwas am Versuchsaufbau verändern darf, schon gar nicht das Thermometer auswechseln, denn sonst sind die Langszeitswerte nicht aussagekräftig. Es ist auch nicht erlaubt während der Versuchsreihe einen Bunsenbrenner oder sonst eine Wärmequelle neben den Versuch zu stellen, was einem Wärmeinseleffekt entsprechen würde.

In Falle der Wetterstationen könnte man lediglich folgendes Ergebnis feststellen: Bei den Standorten der heutigen Wetterstationen und mit den heutigen Ausrüstungen und Messmethoden mißt man höhere Temperaturen als vor 100 Jahren. Ob es klimabedingt überhaupt wärmer würde, kann man daraus nicht ableiten. Und natürlich schon gar nicht, dass diese behauptete globale Erwärmung auch noch auf CO2 zurückzuführen wäre.

Weltwoche Seite 38…………

….da findet sich gerade ein Artikel von Emanuel Höhener und Silvio Borner.

Titel : Kernkraft gegen Sonne.

Er ist nicht streng Wissenschaftlich geschrieben, aber er fasst doch viele Fakten so zusammen das es sehr gut verständlich ist.

Der Artikel legt dar, dass die Energiewende in der Schweiz, also die „Energiestrategie 2050“ nicht 40 Franken pro Haushalt und Jahr kosten wird, sondern wohl 2000 Franken und mehr.

Mein persönlichen Eindruck als langjähriger Beobachter der Politik ist denn auch, dass Bundesrätin Leuthardt in den letzten 2 Jahren nur noch dem richtigen Zeitpunkt suchte um abtzutreten ….ohne ihr Ansehen all zu stark zu mindern …..und vor allem auch ohne zugeben zu müssen, das sie mit der Energiestrategie 2050 etwas angeschoben hat von den sie selber insgeheim weiss das es niemals funktionieren wird.

Also 40 – 50 mal höhere Kosten wie uns unsere Regierung im „Abstimmungsbüchlein“ versprach…. und obendrein eine verspargelte Landschaft mit allen dazugehörigen Umweltsünden die Links sonst Mantrahaft anprangert.

Im „Abstimmungsbüchlein“ legt der Bundesrat ….und oder, auch die Initianten einer Initiative seine Argumente pro oder kontra zum anstehenden Urnengang dar.

Aber ja, jeder Schweizer weiss an sich das dort nur noch gelogen wird.

Es wird dort nahezu immer nur noch die „Schönst-Wetterprognose“ eingestellt.