Erkunden wir also, wie die globalen Ozean-Temperaturen gemessen worden sind. Zunächst dazu eine Referenz für die weitere Diskussion:

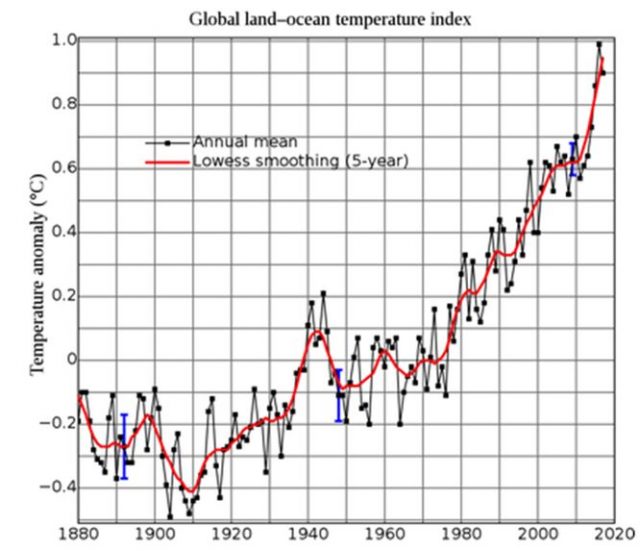

Bei Wikipedia findet sich unter der Quellenangabe NASA Goddard eine illustrative Graphik der globalen Temperatur mit einer darüber gelegten Glättung über fünf Jahre. Konzentrieren wir uns auf die Abkühlungsperiode von Mitte der vierziger bis Mitte der siebziger Jahre. Man kann das rapide Einsetzen der Abkühlung erkennen mit etwa 0,3°C im Jahre 1945 sowie die Umkehrung danach.

Abbildung 1: Temperaturindex Land ↔ Ozean von 1880 bis heute mit der Referenzperiode 1951 bis 1980. Die durchgezogene schwarze Linie stellt das globale jährliche Mittel dar, und die rote Linie ist eine Fünf-Jahre-Glättung, d. h. eine nicht parametrische Regressions-Analyse auf der Grundlage eines k-nearest-neighbor-Modells [?]. Die Funktion ist evaluiert mittels eines Bruchteils der Daten, die mit einem Zehn-Jahre-Fenster der Daten korrespondieren. Das ergibt eine effektive Glättung über etwa fünf Jahre. Die blauen Unsicherheits-Balken (95% Vertrauenslimit) berücksichtigen nur die unvollständige räumliche Datensammlung. Grundlagen sind die Abbildung 1A in Hansen et al. (2006) und Abbildung 9a in Hansen et al. (2010). Quelle

Die Studie von Thompson et al. (2008) in Nature erregte meine Aufmerksamkeit. Gavin Schmidt von RealClimate und auch New Scientist gaben Kommentare dazu ab. Thompson behauptet, den Grund dafür gefunden zu haben, warum die Abkühlung während der vierziger Jahre mit einer so drastischen Umkehrung des Erwärmungstrends zuvor begann. Dieser Umstand machte den Wissenschaftlern schon lange Kopfzerbrechen. Der Grund für diese Umkehr wurde angegeben als ein Wechsel bei den Verfahren der Messung von Ozean-Temperaturen. Das heißt, als man das Verfahren der Messung der Wassertemperatur aus mit Eimern geschöpften Wasser änderte und die Temperaturen einströmenden Kühlwassers maß.

Diese Abkühlungsperiode wollen wir einmal näher unter die Lupe nehmen.

Vor und nach dem 2. Weltkrieg wandte die britische Flotte das ,Eimer-Verfahren‘ an, um Ozeanwasser für dessen Temperaturmessung abzuschöpfen. Das heißt, ein Eimer Wasser wurde mit einem Flüssigkeits-Thermometer gemessen. Das andere oft angewendete Verfahren war die Messung der Temperatur von in Motoren einströmendem Kühlwasser.

Diese beiden Messverfahren werden im Jahre 2008 in einem Brief an Nature erklärt, wobei Thompson et al. sich der folgenden Wortwahl bedienten (SST = Wassertemperatur):

Die bemerkenswerteste Änderung im SST-Archiv nach Dezember 1941 erfolgte im August 1945. Zwischen Januar 1942 und August 1945 stammen etwa 80% der Messungen von US-Schiffen und ~5% von UK-Schiffen. Zwischen Ende 1945 und 1949 stammen dagegen nur ~30% der Messungen von US-Schiffen und ~50% von UK-Schiffen. Diese Änderung im August 1945 ist aus zwei Gründen bedeutsam: Erstens, im August 1945 erfolgten die Messungen auf US-Schiffen in Kühlwasser, während die UK-Messungen mittels des Eimer-Verfahrens durchgeführt wurden. Zweitens, das in Motoren einströmende Kühlwasser war allgemein zum Wärmeren hin verzerrt im Vergleich zu den nicht isolierten Eimermessungen.

Klimabeobachter hatten eine Delle bemerkt im Delta zwischen der Wassertemperatur und der nächtlichen Lufttemperatur (NMAT). Daher glaubte man die Ursache für den unerwarteten Wechsel der Temperatur um 0,3°C um das Jahr 1945 gefunden zu haben. Darauf verzerrte und modifizierte man die Aufzeichnungen. Die angebrachten Bias-Korrekturen könnten Thompson zufolge „die Jahrhunderte langen Trends der Wassertemperaturen aus jüngster Zeit um bis zu ~0,1°C zunehmen lassen“.

Vermutlich wurde diese Bias-Korrektur an prominenter Stelle in der Sumary for Policymakers des IPCC-Berichtes 2007 hervorgehoben. Dabei erhoben sich jedoch folgende Fragen: Wie ist die Korrektur von 0,1°C von Thompson angebracht worden – einheitlich? Über welchen Zeitraum? Ist die Zahl 0,1°C geraten oder willkürlich herausgepickt? Werden dabei irgendwelche Messfehler berücksichtigt, wie sie weiter unten in diesem Beitrag besprochen werden?

Ein fundamentale Frage erhebt sich: wie authentisch ist unsere Temperaturaufzeichnung? Mit wie viel Vertrauen können wir Trendlinien und zukünftige Szenarien abschätzen? Es ist offensichtlich, dass wir die Zahlen kennen müssen innerhalb der 0,1°C-Genauigkeit, um eine vernünftige Interpretation der Aufzeichnungen vornehmen und um glaubwürdig zukünftige globale Temperaturen projizieren zu können.

Wir werden die Messverfahren der Ozean-Wassertemperaturen detailliert untersuchen und dabei erkennen, dass die Datenaufzeichnung sehr grob ist, oftmals um mehr als eine Größenordnung!

Zunächst ist es erforderlich, die Grundlagen zu beschreiben, um allgemeines Verständnis zu erlangen.

2. Die Grundlagen

Ich denke, man kann allgemein zustimmen, dass für die Ableitung definitiver Trends aus globalen Temperaturdaten diese eine Auflösung mindestens innerhalb ± 0,1°C aufweisen müssen. Eine alte Daumenregel für jedwedes Instrument besagt, dass die Messung dreimal so genau sein muss wie die avisierte Auflösung. In unserem Falle sind das 0,03°C.

Thermische Instrumenten-Charakteristika definieren Fehler in Prozent über die gesamte Bandbreite. Read-out resolution is another error, as is read-out error. Beispiel: Nehmen wir an, ein Thermometer hat eine Bandbreite von 200 Grad. 2% Genauigkeit sind dann 4 Grad, Auflösung ist 2 Grad. Die Ablese-Genauigkeit möge 0,5 Grad betragen, das ist die Abstufung, die man noch unterscheiden kann, falls man ,angemessen blinzeln‘ kann.

Wenden wir uns jetzt den Instrumenten selbst zu.

Die Temperatur wird direkt gemessen mittels normaler Thermometer mit Flüssigkeits-Kapillare. Es gibt aber auch Bimetall-Thermometer und mit Hilfe von Elektronik auch Thermistoren sowie noch ein paar andere Verfahren. Via Satellit gemessene Temperaturen auf der Erde werden indirekt aus der Reflektion infraroter Strahlung gemessen.

Wir alle kennen das normale Flüssigkeits-Thermometer, mit dem wir es täglich zu tun haben. Diese sowie die Bimetall-Thermometer haben eine typische Genauigkeit von ± 1 bis 2 Prozent und sind nicht genauer als bis zu 0,5°C. Die Thermistoren können bei präziser Kalibrierung höchst genau messen.

Die Temperaturmessungen in der Natur konzentrieren sich nicht nur auf das Messinstrument selbst. Es handelt sich immer um ein System, welches bis zu verschiedenen Ausmaßen das Datengewinnungs-Verfahren umfasst, die die kurzzeitige Datenspeicherung, Daten-Konversion und Übertragung, Manipulation usw. Man füge noch die zeitlichen Variationen hinzu, das Umfeld des Messpunktes, der Aufzeichnung, des Sensor-Abtriebs und -Verschleiß, Variationen des zu messenden Mediums, verschiedene Beobachter und Interpreten usw. All dies leistet einen Beitrag zum Systemfehler. Die individuellen Fehlerkomponenten werden unterteilt in die festen bekannten Fehler – Fehler und Streuung – und variable Fehler. Außerdem müssen wir auf die ,signifikanten Zahlen‘ achten, da sich eine falsche Genauigkeit einschleichen kann, wenn man den Gesamtfehler berechnet.

Zusammenstellung der Fehler:

Alle als Zufallsfehler erkannten Fehler werden kombiniert mittels der Quadratwurzel der Summe der Quadratzahlen (RSS). Systematischen Fehlern wird durch algebraische Summierung Rechnung getragen. Die Gesamt-Ungenauigkeit ist die algebraische Summe des Gesamt-Zufallsfehlers und des Gesamt-Systemfehlers.

3. Vorherrschende Messverfahren der Ozean-Wassertemperatur

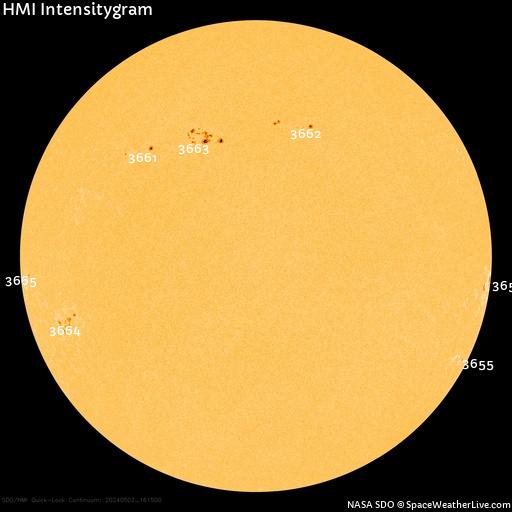

a. Satellitenbeobachtungen

Die Datenerfassung der Wassertemperatur mittels Infrarot-Sensoren an Bord von NOAA-Satelliten erfolgte mit hoch auflösenden Radiometern [high-resolution radiometers].

Die Messungen sind indirekter Natur und müssen die mit anderen Parametern assoziierten Unsicherheiten berücksichtigen, die nur grob geschätzt werden können. Nur die oberste Wasserschicht kann gemessen werden, welche einen starken Tagesgang-Fehler aufweisen kann. Satellitenmessungen begannen in den siebziger Jahren, so dass es keine Korrelation mit früheren Messungen gibt. Da es sich allerdings um indirekte Verfahren der Wassertemperatur-Messung handelt und es viele Schichten von Korrekturen und Interpretationen mit einheitlichen Fehleraspekten gibt, werden diese hier nicht weiter behandelt. Ein derartiges Unterfangen würde eine gesamte neue detaillierte Abschätzung erfordern.

b. Direkte Messungen der Wassertemperatur – historisch

Bevor man verstanden hatte, dass die thermischen Gradienten in tieferen Wasserschichten der Ozeane von Bedeutung waren, war es üblich, die Wassertemperatur in mit Eimern geschöpftem Ozeanwasser zu messen. Ersteres wurde überlebenswichtig für den U-Boot-Krieg vor und während des 2. Weltkrieges. Zuvor brauchte man die Wassertemperatur lediglich für die Wettervorhersage.

Das ,Eimer-Verfahren‘:

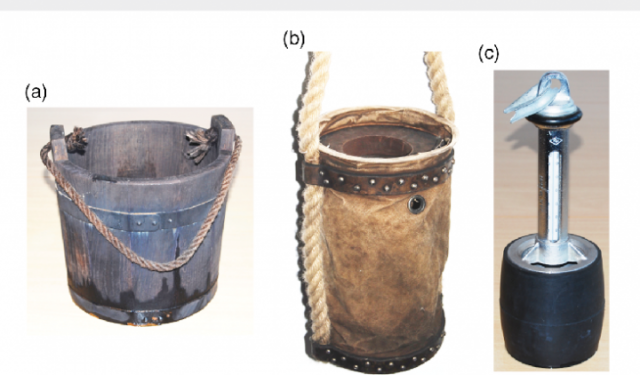

Üblicherweise wurde ein Holzeimer von einem fahrenden Schiff über Bord geworfen und danach ein Thermometer in die so gewonnene Wasserprobe gehalten. Nach den Holzeimern kamen Eimer aus Segeltuch in Gebrauch.

Abbildung 2: (a) Holzeimer, (b) Eimer aus Segeltuch, (c) German scoop (moderne Version). Mehr

Mit der steigenden Berücksichtigung der Genauigkeit von Messungen kamen Eimer aus Segeltuch in Gebrauch. Zusätzlich zu der typischen Thermometer-Genauigkeit von 0,5 bis 1,0°C gab es viele Quellen von Zufallsfehlern, als da wären:

● Tiefe des Eintauchens des Eimers

● Durchmischung der Wasseroberfläche durch variable Wellenhöhen und Wolkenbedeckung

● Aufwühlen der Wasseroberfläche durch die Schiffsschrauben

● variable Unterschiede zwischen Luft- und Wassertemperatur

● Relativbewegung der Schiffsroute zur Windrichtung

● Größenordnung von Wind- und Schiffsgeschwindigkeit kombiniert

● Zeitspanne zwischen Schöpfen des Wassers und der tatsächlichen Thermometermessung

● Zeitspanne, bis sich das Thermometer auf die Wassertemperatur eingestellt hat

● Ausmaß der Thermometer-Bewegung (falls vorhanden)

● Ablesung am Rand oder in der Mitte des Eimers

● Abkühlung des Thermometer-Messfühlers während der Ablesung

● Sehschärfe und Verhalten des Ablesenden

● Effektivität der Eimer-Isolation und Verdunstungs-Abkühlungseffekte durch leckende Eimer

● thermische Wechselwirkungen zwischen Eimer und Schiffsdeck

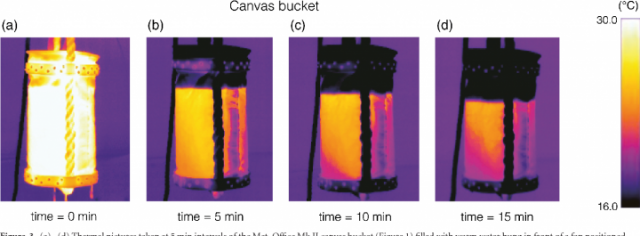

Hier folgt eine Infrarot-Sequenz, die zeigt, wie sich Wasser in einem Stoffeimer abkühlt:

Diese Bilder stammen aus folgender Studie:

Grazielle Carella und Alexis R.Morris

Man nimmt an, dass Unsicherheiten bei der Berücksichtigung von Bias-Adjustierungen historischer Messungen der Wassertemperatur mittels Eimern den größten Beitrag zu Unsicherheiten bei globalen Temperaturtrends leisten. Die Ergebnisse zeigen, dass die Modelle nur sehr grob imstande sind, die Abhängigkeit der Temperaturänderung des Wassers mit der Zeit über thermischen Antrieb und Eimer-Charakteristika zu erfassen: Volumen und Form, Struktur und Material. Sowohl die Modelle als auch die Beobachtungen zeigen, dass der bedeutendste Umweltparameter, der Temperatur-Verzerrungen in historischen Eimer-Messungen beeinflusst, der Unterschied ist zwischen dem Wasser und Flüssigkeits-Thermometern. Vermutungen, die inhärent in der Interpretation der Modelle vorhanden sind, beeinträchtigen wahrscheinlich deren Anwendbarkeit. Wir beobachteten, dass die Wasserprobe kräftig umgerührt werden musste, um mit den Modellergebnissen überein zu stimmen. Dies lässt gute Durchmischung annehmen. Es gab Inkonsistenzen zwischen den Modellergebnisse und früheren Messungen in einem Windkanal im Jahre 1951. Das Modell nimmt ein nicht turbulentes Anströmen an und prophezeit konsequent eine in etwa quadratische Abhängigkeit von der Windgeschwindigkeit. Bei Turbulenz wird der Wärmetransport mit der Intensität der Turbulenz zunehmen. Für Schiffsmessungen gilt, dass die Strömung wahrscheinlich turbulent ist und die Intensität der Turbulenz immer unbekannt ist. Fasst man alles zusammen, wird erwartet, dass Unsicherheiten aufgrund der Auswirkungen von Turbulenz und der Annahme gut durchmischter Wasserproben substantiell sind und einen limitierenden Faktor darstellen können für die direkte Anwendung dieser Modelle, um historische Wassertemperatur-Messungen zu adjustieren.

Temperaturmessung in einströmendem Kühlwasser:

Der Dieselmotor eines Schiffes enthält einen separaten Kühl-Kreislauf, um das Metall von der korrosiven Wirkung von Meerwasser zu isolieren. Die Rohmessung der Temperatur des einströmenden Wassers erfolgt fast immer mit Messzylindern (typischerweise mit einer Genauigkeit von 1°C und niemals kalibriert). Dieser ist installiert zwischen der Einströmungs-Pumpe und dem Wärmetauscher. Es gibt keinen Grund, Thermometer direkt am Schiffskörper zu installieren, ohne dass Daten durch die Aufheizung durch die Maschinen verzerrt werden. Anderenfalls wäre diese Aufstellung geeigneter für Forschungszwecke.

Folgende Zufalls-Einflüsse müssen bei der Messung berücksichtigt werden:

● Tiefe des einströmenden Wassers

● Ausmaß der Durchmischung der Oberflächenschicht durch Wind und Sonne

● Aufwühlen des Wassers durch das Schiff, auch abhängig von dessen Geschwindigkeit

● Differenz zwischen der Temperatur des Wassers und im Maschinenraum

● variable Temperatur im Maschinenraum

Außerdem gibt es langzeitliche, zeitvariable Systemfehler, die berücksichtigt werden müssen:

● zusätzliche thermische Energie durch die Ansaugpumpe

● Abnahme der Röhren-Isolierung und durch innere Ablagerungen

c. Einsatz von XBT-Sonden (Expendable Bathythermograph)

Die Sonar-Messungen und die Notwendigkeit, U-Boote vor der Entdeckung in thermischen Inversionsschichten zu bewahren, befeuerten die Entwicklung und den Einsatz von XBT-Stichproben. Die Sonden werden von Schiffen an der Wasseroberfläche und von U-Booten ausgesetzt. Temperaturdaten werden an das Schiff übermittelt mittels eines dünnen Kupferdrahtes von der Sonde, während sie langsam in die Tiefe sinkt. Die Temperaturmessung erfolgt mit einem Thermistor, Nachbehandlung und Aufzeichnung der Daten erfolgt auf dem Schiff. Die Tiefe wird errechnet aus der vergangenen Zeit und auf der Grundlage einer speziellen, vom Hersteller entwickelten Formel. Thermistoren-Messungen werden aufgezeichnet via Änderungen der Stromspannung des Signals.

Mögliche Randwert-Fehler:

● Thermische Verzögerungs-Effekte gegenüber der initialen Eintauch-Temperatur durch Lagerung der Stichprobe an Bord des Schiffes

● Eine von der Lagerzeit induzierte Kalibrierungs-Verschiebung

● Dynamischer Stress plus Effekte der sich ändernden Temperatur mit der Tiefe in Gestalt der Änderung der el. Widerstandsfähigkeit des Drahtes mit zunehmender Tiefe

● Variable thermische Verzögerungs-Effekte des Thermistors während des Versinkens

● Variabilität der Oberflächentemperatur vs. Stabilität tieferer Wasserschichten

● Durch Instrumente und Messverfahren induzierte Variabilität

d. Schwimmende ARGO-Bojen

Das Konzept dieser Tauchbojen ist ein cleveres Verfahren, um fast 4000 derartige Instrumente weltweit zu haben, die automatisch Wasserdaten aufzeichnen, während sie in verschiedenen Tiefen des Ozeans treiben. Periodisch tauchen sie auf und übermitteln die gespeicherten Daten, Tiefe, Salzgehalt und Temperatur-Historie via Satelliten an Bodenstationen zur Auswertung. Das oberste Ziel des ARGO-Programms ist es, fast simultane Temperaturmessungen der Flotte vorzunehmen bis zu einer Tiefe von 2500 Metern. Damit will man ein umfassendes Bild des Wärmegehaltes der Ozeane zeichnen.

Überraschenderweise sind die einzigen von den Herstellern der Bojen gelieferten Daten die hohe Präzision von 0,001°C ihres kalibrierten Thermistors. Rückfragen bei den Verantwortlichen des ARGO-Programms enthüllten, dass sie nichts von einem Systemfehler wussten, obwohl man ein Bewusstsein gegenüber einem solchen von einem so weit entwickelten wissenschaftlichen Experiment erwarten sollte. Fragen hinsichtlich verschiedener Fehlerquellen an den vorherrschenden Hersteller der ARGO-Bojen blieben unbeantwortet.

Dabei müssen folgende Randwert-Fehler evaluiert werden:

● Valide zeitliche Simultanität hinsichtlich der Tiefe der Temperaturmessungen, treiben doch die Bojen mit unterschiedlicher Geschwindigkeit. Außerdem können sie zwischen unterschiedlichen Zirkulationsmustern wechseln, sowohl vertikal als auch horizontal.

● Thermische Verzögerungs-Effekte

● Ungültige Messungen nahe der Oberfläche werden eliminiert, unbekanntes Ausmaß der Stärke des Fehlers

● Fehler bei der Übertragung von Datenpaketen an den Satelliten infolge der Bewegung der Sendeantenne durch den Wellengang

● Wellen- und Gischt-Interferenz mit der hohen Frequenz 20/30 GHz IRIDIUM der Transmission von Satellitendaten

● Schwächen bei der Aufzeichnung und Fehlinterpretationen der Daten

Außerdem gibt es unbekannte Fehler bzgl. Auflösung, Bearbeitung und der Aufzeichnungs-Instrumente wie etwa Rauigkeit bei der Konversion analog/digital, Auswirkungen alternder Batterien in den Bojen usw. Außerdem gibt es subtile Charakteristika zwischen verschiedenen Formen der Bojen, die vermutlich ohne detaillierte Forschungen niemals erkannt werden.

e. Fest installierte Bojen

Langfristig fest installierte Bojen weisen Schwächen auf bzgl. ihrer vertikalen Reichweite. Diese ist limitiert durch die Notwendigkeit der Verankerung und der Zeitlosigkeit von Ablesung und Aufzeichnung. Außerdem sind sie Gegenstand von Ablagerungen und Unterbrechungen der Sensor-Funktionsfähigkeit durch treibende maritime Flora. Deren Verteilung hängt von der küstennahen Verankerung ab. Dies verleiht ihnen nur begrenzten Wert für eine allgemeine Überwachung der Ozean-Temperatur.

f. Leitfähigkeit, Temperatur, Tiefen-Sonden (CTD)

Diese Sonden ermöglichen das genaueste Verfahren zur Messung der Wassertemperatur in verschiedenen Tiefen. Sie messen typischerweise Leitfähigkeit, Temperatur (meist auch Salzgehalt) und Tiefe zusammen. Sie werden von stationären Forschungsschiffen ausgesetzt, welche mit einem Bordkran ausgerüstet sind, um die Sonden zu versenken und zu bergen. Präzise thermische Thermistoren-Messungen in bekannten Tiefen werden in Echtzeit via Kabel an die Schiffe übertragen. Diese Sondenmessungen werden oftmals herangezogen, um andere Instrumente zu kalibrieren, wie etwa XBT und ARGO. Aber die hohen operationellen Kosten und die Feinheit [sophistication] als Forschungsinstrument verhindern deren Gebrauch auf breiter Front.

4. Signifikante Auswirkungen von Fehlern bei den verschiedenen Verfahren zu Temperaturmessungen in den Ozeanen

Hier versuchen wir, typische operationelle Fehler instrumenteller Verzerrungen in historischen Aufzeichnungen der Ozean-Wassertemperatur abzuschätzen.

a. Das Eimer-Verfahren

In der Studie Corrections of instrumental biases in historical sea surface temperature data’ Q.J.R. Metereol. Soc. 121 (1995) haben Folland et al. versucht, den Bias bei dem Eimer-Verfahren zu quantifizieren. In der Studie geht es um historische Temperatur-Aufzeichnungen und Variationen der verschiedenen Eimertypen. Außerdem ist es von Bedeutung, dass kein maritimes Unterfangen jemals irgendeiner Art von Protokoll gefolgt ist bei der Ermittlung derartiger Daten. Die Autoren dieses Reports führen eine sehr detaillierte Wärmetransfer-Analyse durch und vergleichen die Ergebnisse mit denen einiger Tests in Windkanälen (nicht isolierte Eimer kühlen sich um 0,41°C bis 0,46°C ab). Bei der Datenverarbeitung waren viele globale Variablen im Spiel ebenso wie einige Messungen in einströmendem Kühlwasser. Die Korrekturen von Folland betragen + 0,58°C bis 0,67°C bei nicht isolierten Eimern sowie + 0,1°C bis 0,15°C bei Holzeimern.

Des Weiteren stellen Folland et al. (1995) fest: „Die resultierenden Temperatur-Korrekturen der global und jahreszeitlich gemittelten Wassertemperatur nehmen zu von 0,11°C im Jahre 1856 auf 0,42°C im Jahre 1940“.

Es ist unklar, warum die Korrekturen im 19.Jahrhundert substantiell geringer sein sollen als im 20. Jahrhundert. Jedoch könnte dies eine Folge davon sein, dass früher vorherrschend Holzeimer zur Messung verwendet wurden (die viel besser isoliert sind). Es ist auch verwirrend, wie diese Zahlen korrelieren mit der allgemeinen Feststellung von Thompson, dass jüngste SSTs korrigiert werden sollten mit „bis zu ~0,1°C“. Was ist mit der Hinzunahme der Zahl 0,42 Grad?

Bei Berücksichtigung eines Systemfehlers – siehe Abschnitt 3b – sind die variablen Faktoren der vorherrschenden Größenordnung täglicher und jahreszeitlicher Natur sowie abhängig von Sonnenschein, Luftkühlung, dem Verhältnis der Temperatur von Sprühwasser und der Luft sowie einem festen Fehler der Thermometer-Genauigkeit von ±0,5°C, im besten Falle. Bedeutsam ist auch, dass die Eimerfüllung aus Wasser besteht, das nicht tiefer als einen halben Meter unter der Wasseroberfläche geschöpft worden ist, so dass folglich diese Wasserschicht erheblich mit dem Tagesgang der Temperatur variiert.

Tabatha (1978) sagt über Messungen auf einem kanadischen Forschungsschiff: „Temperaturen im mit Eimern geschöpften Wasser stellten sich um 0,1°C zum Warmen hin verzerrt heraus. Die Wassertemperatur in einströmendem Kühlwasser war um eine Größenordnung mehr gestreut als bei anderen Verfahren und um 0,3°C zum Warmen hin verzerrt“. Folglich ergibt sich aus beiden Verfahren ein gemessener Warm-Bias, d. h. Korrekturfaktoren müssten negativ sein, sogar beim Eimer-Verfahren, was das Gegenteil der Folland-Zahlen ist.

Wo beginnt man mit der Abschätzung der Randwert-Fehler? Es scheint fast unmöglich, ein valides Mittelungs-Szenario zu simulieren. Zur Illustration wollen wir eine Fehlerberechnung durchführen, und zwar bzgl. einer spezifischen Temperatur der Wasseroberfläche mit einem nicht isolierten Eimer.

Luftkühlung 0,5 Grad (zufällig)

Transfer an Bord 0,05 Grad (zufällig)

Thermometer-Genauigkeit 1,0 Grad (fest)

Ablesen und Parallaxe 0,2 Grad (zufällig)

Fehler e = 1,0 + (0,52 + 0,052 + 0,22)½ = 1,54 Grad oder 51 mal die gewünschte Genauigkeit von 0,03 Grad (siehe auch Abschnitt 2.0)

b. Messungen in einströmendem Kühlwasser

Saur 1963 kommt zu dem Ergebnis: „Der mittlere Bias der gemessenen Meerwasser-Temperaturen im Vergleich zu Meeresoberflächen-Temperaturen wird mit einem Vertrauensintervall von 95% geschätzt mit 0,67°C ±0,3°C auf der Grundlage einer Stichprobe von 12 Schiffen. Die Standardabweichung wird geschätzt zu 0,9°C … Der Schiffs-Bias (der mittlere Bias der Injektions-Temperatur eines bestimmten Schiffes) bewegt sich zwischen -0,3°C und 1,7°C unter 12 Schiffen“.

Fehler der SST einströmenden Kühlwassers hängen stark ab von den Betriebsbedingungen im Maschinenraum (Tauber 1969).

James and Fox (1972) weisen nach, dass Einströmen in einer Tiefe von 7 Metern oder weniger einen Bias von 0,2°C zeigte. Einströmen in größeren Tiefen zeitigte einen Bias von 0,6°C.

Walden (1966) fasst Aufzeichnungen von vielen Schiffen als um 0,3°C zu warm zusammen. Allerdings ist zweifelhaft, dass eine akkurate Instrumentierung verwendet wurde, um die Ablesungen zu kalibrieren. Daher ist seine Zahl von 0,3°C möglicherweise grob abgeleitet mit einem shipboard standard ½ oder mit auf 1 Grad genauen Thermometern.

Hier folgt eine Fehlerberechnung einer spezifischen Wassertemperatur am Einströmpunkt des Schiffsrumpfes:

Thermometer-Genauigkeit 1,0 Grad (fest)

Umgebender Maschinenraum Delta 0,5 Grad (zufällig)

Input der Pump-Energie 0,1 Grad (fest)

Gesamtfehler 1,6°C oder 53 mal die gewünschte Genauigkeit von 0,03 Grad.

Es gibt einen wesentlichen Unterschied zwischen der Messung in einströmendem Kühlwasser und Eimermessungen, der auch zu einer großen Differenz führt, nämlich die Messung viel tiefer im Wasser, in der Regel mehrere Meter unter der Oberfläche. Dieses Verfahren sorgt für kühlere und viel stabilere Temperaturverhältnisse als die Eimermessungen mit dem Oberflächenwasser. Allerdings übt auch die Temperatur des Maschinenraums einen starken Einfluss aus. Viele Messungen werden nur in ganzen Grad angegeben, der üblichen Thermometer-Auflösung.

Aber noch einmal: der einzige fest gegebene Fehler ist die Thermometer-Genauigkeit von einem Grad, ebenso wie der Wärmeunterschied um die Pumpe. Die variablen Fehler können auf größeren Schiffen von höherer Größenordnung sein und sind schwierig zu verallgemeinern.

Diese große Bandbreite von Variationen macht die Messung in einströmendem Kühlwasser fast unmöglich zu validieren. Außerdem erfolgte die Messung zu einer Zeit, als die auf Forschungen beruhende Kalibrierung noch kaum praktisch durchgeführt worden war.

c. XBT-Sonden

Lockheed-Martin (Sippican) stellt verschiedene Versionen her, und man wirbt mit einer Temperatur-Genauigkeit von ±0,1°C und einer System-Genauigkeit von ±0,2°C. Aiken (1998) berechnete einen Fehler von +0,5°C, und im Jahre 2007 stellte Gouretski einen mittleren Bias von +0,2°C bis +0,4°C fest. Die Forschungsgemeinschaft impliziert auch Variationen der Genauigkeit mit unterschiedlicher Daten-Herkunft und Aufzeichnungs-Instrumenten, und sie fordert Kalibrierungen mittels paralleler CTD-Sonden. Es gibt eine signifikante Varianz bei der Korrelation Tiefe ↔ Temperatur, über welche die Forscher immer noch Workshops abhalten, um diese Korrelation näher zu erfassen.

Wir können hinsichtlich des Gesamtfehlers nur grobe Abschätzungen vornehmen. Angesichts des vom Hersteller angegebenen Systemfehlers von 0,2 Grad und der oben beschriebenen Bandbreite von Fehlerquellen können wir einen Fehler von, sagen wir mal, 0,4°C ermitteln, was das Dreizehnfache der gewünschten Fehlerquote von 0,03 Grad ist.

d.ARGO-Treibbojen

Der hauptsächliche, in den USA ansässige Hersteller von APEX Teledyne reklamiert eine Genauigkeit von ±0,001°C, welche im Labor kalibriert worden ist (auf 0,002°C herabgestuft mit der Drift). Sie haben diese Zahl bestätigt, nachdem sie einige Stichproben nach vielen Betriebsjahren gezogen haben. Allerdings wird keine System-Genauigkeit angegeben, und der Hersteller gibt auf diesbezügliche Nachfragen keine Antwort. Die Kommunikation des Autors mit dem Büro des ARGO-Programms enthüllte, dass sie die System-Genauigkeit gar nicht kennen. Dies bedeutet, dass sie um die Genauigkeit der Thermistoren wissen, aber sonst nichts weiter. Der Seabird Scientific SBE Temperatur/Salzgehalt-Sensor kam in fast allen Stichproben zur Anwendung, aber das Unternehmen gibt den Fehlerbeitrag auch auf schriftliche Nachfragen via E-Mail nicht an. Nichts ist bekannt hinsichtlich der Fehler bei der Übertragung zu Satelliten oder der Genauigkeit bei der Aufbereitung der Daten an Land.

Hadfield (2007) berichtet von der Querung eines Forschungsschiffes auf dem 36. Breitengrad mit CTD-Messungen. Diese Daten hat man verglichen mit Temperaturdaten der ARGO-Bojen beiderseits der Schiffsroute, und sie sind innerhalb von 30 Tagen und manchmal auch mehr registriert worden. Allgemein stimmen die Daten überein auf 0,6°C RMS und einem Differential von 0,4°C östlich und 2,0°C westlich. Diese Messungen beziehen sich nicht auf die Genauigkeit der Bojen selbst, sondern auf die begrenzte Brauchbarkeit der ARGO-Daten, d. h. der Zeitgleichheit und geographischen Stelle der Temperaturmessungen im gesamten Ozean. Diese Unsicherheit deutet auf signifikante Grenzen bei der Berechnung des ozeanischen Wärmegehaltes, was doch der eigentliche Grund für das ARGO-Programm war.

Das ARGO-Qualitäts-Manual für die CTD-Daten und diejenigen auf der Schiffsroute ebnen den Weg für möglicherweise schlechte Daten. Die Temperatur-Verschiebung zwischen zwei mittleren Werten beträgt maximal 0,3 Grad als Kriterium, das Mittel 0,02 Grad und das Minimum 0,001 Grad.

Nimmt man einen Fehlergehalt der ARGO-Messungen an, bedeutet das mit Sicherheit einen viel höheren Wert als den vom Hersteller reklamierte Wert von 0,002 Grad.

Versuchen wir es also einmal:

Zugeordneter Systemfehler 0,01 Grad (vermutlich fest)

Fehler des Datenloggers und granularity [?] 0,01 (fest)

Datenübertragung 0,05 (zufällig)

Ground based data granularity 0,05 (fest)

Gesamtfehler 0,12 Grad, also das Vierfache der gewünschten Genauigkeit von 0,03 Grad.

Allerdings variiert die Hadfield-Korrelation zu CTD-Messungen entlang einer Schiffsroute bis zu 2 Grad, was der zeitlichen und geographischen Ausdehnung geschuldet ist. Aber auch Meeresströme und jahreszeitliche thermale Änderungen zusätzlich zu den inhärenten Bojen-Fehlern spielen eine Rolle.

Die NASA Willis 2003/05-Abkühlungsperiode

Dieses Thema wird im Abschnitt 5 ,Zusammenfassung‘ näher beleuchtet.

Im Jahre 2006 veröffentlichte Willis eine Studie, welche eine kurze Abkühlungsperiode zeigte, und zwar auf der Grundlage von Profilen der ARGO-Bojen:

Forscher fanden heraus, dass die mittlere Temperatur der oberen Ozeanschichten von 1993 bis 2003 um 0,09°C gestiegen und dann von 2003 bis 2005 wieder um 0,03°C gesunken ist. Der jüngste Rückgang ist in etwa gleich einem Fünftel der Wärmezunahme durch den Ozean im Zeitraum 1955 bis 2003.

Die Korrektur der Studie von 2007 stellt diesen offensichtlichen globalen Abkühlungstrend der Jahre 2003/2004 in Frage, indem die spezifisch falsch programmierten (vom Druck abhängigen) ARGO-Bojen ausgesondert und mit früheren, zum Warmen verzerrten XBT-Daten korreliert wurden. Damit, so hieß es, war die Größenordnung dieses Abkühlungs-Ereignisses substantiell verringert.

Im Mittelpunkt von Willis‘ Arbeit standen die Messung des ozeanischen Wärmegehaltes und die Einflüsse auf den Meeresspiegel. Hier folgen einige Auszüge aus dieser Studie, zunächst ohne und dann mit den angebrachten Korrekturen.

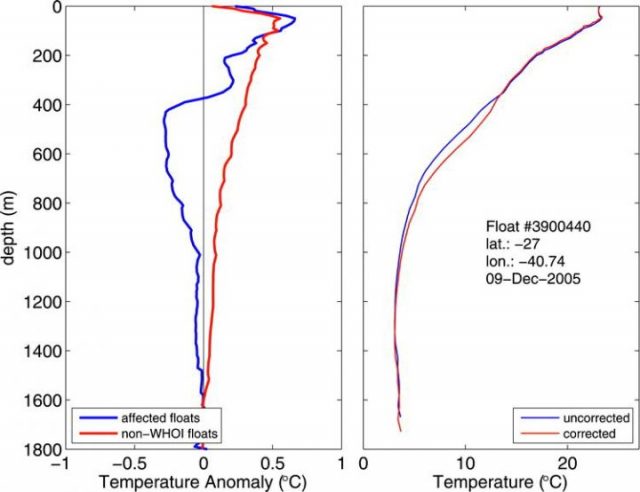

Vor der Korrektur:

Die mittlere Unsicherheit wird angegeben mit etwa 0,01°C in einer gegebenen Tiefe. Das Abkühlungs-Signal verteilt sich über die gesamte Wassersäule, wobei in den meisten Tiefen Abkühlung festgestellt wurde. Eine geringe Abkühlung wurde an der Oberfläche beobachtet, viel weniger als die Abkühlung in größerer Tiefe. Diese Abkühlung der Oberfläche von 2003 bis 2005 ist konsistent mit den globalen SST-Messungen (z. B. hier). Die stärkste Abkühlung ereignete sich in einer Tiefe von 400 m, aber auch in einer Tiefe von 750 m wurde noch substantielle Abkühlung beobachtet. Diese Verteilung reflektiert die komplizierte Überlagerung regionaler Erwärmungs- und Abkühlungs-Verteilungen mit unterschiedlicher Tiefen-Abhängigkeit ebenso wie den Einfluss von Änderungen der ozeanischen Zirkulation und den damit verbundenen Änderungen der Thermokline.

Das Abkühlungssignal ist in 750 m immer noch ausgeprägt und scheint sich in noch größere Tiefen zu erstrecken (Abbildung 4). Tatsächlich ergeben sich aus vorläufigen Schätzungen auf der Grundlage der ARGO-Daten eine zusätzliche Abkühlung in Tiefen zwischen 750 und 1400 m.

Nach der Korrektur:

… eine Schwäche, welche dazu führte, dass Temperatur- und Salzgehalts-Werte in Verbindung standen mit unrichtigen Werten des Drucks. Die Größe der Druckabweichung war abhängig vom Bojen-Typ und variierte von Profil zu Profil über eine Bandbreite von 2 bis 5 db nahe der Oberfläche bis zu 10 bis 50 db in Tiefen unterhalb etwa 400 m. Fast alle der WHOI FSI-Bojen (287 Instrumente) waren von Fehlern dieser Art betroffen. Die Hauptmasse dieser Bojen wurde im Atlantik platziert, wo die unechte Abkühlung entdeckt worden war. Der Kalt-Bias ist im Mittel über das betroffene Gebiet größer als -0,5°C in Tiefen zwischen 400 und 700 m.

Der hier präsentierte 2%-Fehler bzgl. der Tiefe steht in guter Übereinstimmung mit ihren Ergebnisse für den Zeitraum. Der Grund für die offensichtliche Abkühlung in der Schätzung, welche XBT- und ARGO-Daten kombiniert (Abbildung 4, dicke gestrichelte Linie) ist das zunehmende Verhältnis zwischen ARGO- und XBT-Messungen zwischen 2003 und 2006. Das sich ändernde Verhältnis verursacht die Abkühlung in der Schätzung, sowie sie sich von den warm-verzerrten XBT-Daten entfernt und sich den neutralere ARGO-Werten nähert.

Systematische Druck-Fehler wurden hinsichtlich der Echtzeit-Temperatur und des Salzgehaltes entdeckt bei einer geringen Anzahl von ARGO-Bojen. Diese Fehler hatten ihre Ursache in Problemen bei der Bearbeitung der ARGO-Daten, und korrigierte Versionen vieler der betroffenen Profile wurden vom Hersteller der Bojen geliefert.

Hier werden Fehler in den fall-rate-Gleichungen als primäre Ursache für den Warm-Bias der XBT-Daten angesehen. Im untersuchten Zeitraum stellte sich heraus, dass die XBT-Stichproben und die Zuordnung der Temperatur zu den jeweiligen Tiefen um etwa 2% zum zu Tiefen verschoben waren.

Man beachte, dass Willis und seine Mitautoren den Wärmegehalt der oberen 750 Meter abschätzten. In dieser Zone befinden sich etwa 20% des globalen Ozeanwassers.

Des Weiteren zeigt die Abbildung 2 in Willis‘ Studie, dass eine der eliminierten ARGO-Bojen das thermische Tiefen-Profil den Vergleich zeigt zwischen korrekt und fehlerhaft.

Abbildung 4: Links: Temperatur-Anomalie im Vergleich zur Tiefe relativ zu den WGHC für WHOI-Bojen mit unrichtigen Druckwerten (blaue Linie) und Nicht-WHOI-Bojen aus dem gleichen Gebiet (rote Linie). Die Daten beschränken sich auf den Atlantik zwischen 50°N und 50°S bzw. den Zeitraum vom 1. Januar 2003 bis zum 30. Juni 2007. Rechts: Auswirkung der Korrektur einer einzelnen WHOI FSI-Boje im Südatlantik. Aus Willis 2007.

Mittelt man den Fehler in spezifischen Tiefen, erhält man ein Differential von 0,15 Grad in einer Tiefe zwischen etwa 350 und 1100 m. Diese Zahl differiert von dem Kalt-Bias um -0,5°C, wie oben festgestellt, obwohl dieser nur zwischen 400 und 700 m Tiefe definiert war.

All diese Erklärungen von Willis sind sehr verworren und lassen kaum Vertrauen aufkommen hinsichtlich der Genauigkeit aller thermischen ARGO-Messungen.

5. Beobachtungen und Zusammenfassung

5.1 Ozean-Temperaturaufzeichnungen vor 1960/70

Versucht man, die Aufzeichnung der Ozean-Erwärmung und die Trendlinien während der Zeiten mit Eimermessungen und früheren Messungen in einströmendem Kühlwasser zu extrahieren, scheint das ein aussichtsloses Unterfangen zu sein wegen der großen systematischen und zufälligen Datenfehler.

Die Eimermessungen wurden für meteorologische Zwecke durchgeführt, und:

a. ohne Qualitäts-Protokolle und mit möglicherweise nur marginaler persönlicher Qualifikation,

b. durch viele Nationen mit vielen Kriegs- und Zivilschiffen,

c. auf separaten Ozeanen und oftmals in geschlossenen Handelsrouten

d. aufgenommenem Wasser nur von einer dünnen Oberflächenschicht

e. mit einer Instrumentierung, die viel gröber war als die gewünschte Qualität

f. Gegenstand erheblicher physikalischer Stichproben-Variationen und umweltlicher Störungen.

Die Temperaturdaten in einströmendem Kühlwasser waren genauso grob, und zwar weil

a. sie aus einer anderen Tiefe stammen,

b. sie stabiler waren als die vom Tagesgang beeinflussten Messungen in der obersten Wasserschicht.

Beobachtung Nr. 1:

Während des Wechsels der primären Verfahren zur Messung der Ozean-Temperaturen scheint es logisch, eine Überraschung in den Temperaturaufzeichnungen während des 2. Weltkrieges zu finden infolge von Änderungen der Temperatur-Datengewinnung. Allerdings sieht das Auffinden eines spezifischen Korrekturfaktors der Daten mehr wie Spekulation aus, weil die beiden historischen Messverfahren zu unterschiedlich sind hinsichtlich ihrer Charakteristika und hinsichtlich dessen, was sie messen. Allerdings muss die Tatsache des Einsetzens einer rapiden Abkühlung 1945/46 nach wie vor eingeräumt werden, weil es während der Folgejahre kühl blieb. Dann begann Mitte der siebziger Jahre wieder eine abrupte Erwärmung, wie die Graphik in Abschnitt 1 so ausgeprägt zeigt.

5.2 Weitere XBT- und ARGO-Messungen in jüngerer Zeit:

Obwohl die XBT-Aufzeichnung nur von begrenzter Genauigkeit ist, wie es die vom Hersteller genannte Systemgenauigkeit von ±0,2 Grad spiegelt, müssen deren Vor- und Nachteile berücksichtigt werden, vor allem hinsichtlich der ARGO-Aufzeichnungen.

XBT-Daten:

a. Sie reichen zurück bis in die sechziger Jahre mit umfangreichen Aufzeichnungen

b. Eine fortgesetzte Kalibrierung mit CBT-Messungen ist erforderlich, weil die Tiefenformeln zur Berechnung nicht konsistent genau sind.

c. XBT-Daten stehen fest hinsichtlich Gleichzeitigkeit und geographischem Ursprung, was statistische Vergleiche ermöglicht

d. Erkannter Bias der Tiefen-Messungen, welcher der Temperaturmessung zugeordnet werden kann

ARGO-Daten:

a. brauchbare Quantität und Verteilung von Bojen gibt es erst seit etwa seit dem Jahr 2003

b. Die Datengenauigkeit wird als extrem hoch angegeben, jedoch ohne bekannte System-Genauigkeit

c. Die Datensammlung kann nur zu Zeitpunkten der Transmission via Satellit erfolgen. Die dazwischen liegende Richtung der Meeresströme und die thermische Durchmischung während der Bojen-Messzyklen vergrößern die Unsicherheiten.

d. Die Kalibrierung mittels CTD-Messungen wird behindert durch die geographische und zeitliche Trennung. Das hat zu Temperatur-Diskrepanzen von drei Größenordnungen geführt, also 2,0 Grad (Hadfield 2007) bzw. 0,002 Grad (Hersteller-Angaben).

e. Programmierfehler haben historisch zu falschen Tiefen-Korrelationen geführt.

f. Unbekannte Datenfehler bei der Transmission zu Satelliten, möglicherweise mit dem 20/30 GHz-Häufigkeitssignal durch Wellengang, Gischt und starkem Regen.

Beobachtung Nr. 2:

Die ARGO-Daten müssen innerhalb ihrer Limitierungen betrachtet werden, trotz der ursprünglichen Absicht, eine präzise Karte des ozeanischen Wärmegehaltes zu erstellen. Die ARGO-Gemeinschaft weiß nichts über den Systemfehler bei der Messung der Temperatur durch die Bojen.

Die Forschungen von Willis (NASA) 2003/04 bzgl. der Ozean-Abkühlung lassen viele Fragen offen:

a. Ist es zulässig, die Validität der von ARGO gemessenen Abkühlung zu erweitern allein durch einen Teil des Atlantiks als Datenbasis der gesamten globalen Ozeane?

b. Ist der Schluss zulässig, dass die Korrektur eines kleinen Anteils irriger Tiefen-Temperaturprofile über eine geringe vertikale Erstreckung einen ausreichenden thermischen Einfluss auf die Masse aller Ozeane ausübt, um etwa eine globale Abkühlung zu propagieren oder nicht?

c. Willis argumentiert, dass das Aufkommen präziser ARGO-Messungen um das Jahr 2003 in Bezug auf die frühere Aufzeichnung der warm-verzerrten XBT-Daten das offensichtliche Einsetzen der Abkühlung ausgelöst hat. Allerdings war dieser XBT-Warm-Bias zu jener Zeit gut bekannt. Hätte er diesen Bias nicht berücksichtigen können, wenn er Vergleiche zwischen der Vor-ARGO-Zeit und der Nach-ARGO-Zeit durchführte?

d. Warum unterscheidet sich der von Willis gegebene Bias von -0,5°C so signifikant von dem 0,15 Grad-Differential, den man in seiner Graphik erkennt?

Beobachtung Nr. 3:

Das Forschungsobjekt von Willis et al. scheint ein Beispiel zu sein für eine unangemessene Verquickung von zwei unterschiedlichen generischen Arten von Daten (XBT und ARGO). Er kommt zu überraschenden Schlussfolgerungen:

a. Die Aufzeichnung vor 2003 sollte bzgl. des offensichtlichen Einsetzens von Abkühlung vorsichtig bewertet werden, und

b. diese Aufzeichnung vor 2003 sollte immer noch eine valide Aufzeichnung sein zur Berechnung von Trendlinien des ozeanischen Wärmegehaltes.

Willis: „… die Abkühlung von 2003 bis 2005 ist konsistent mit den globalen SST-Produkten“. Diese Feststellung widerspricht der späteren Schlussfolgerung, dass die Abkühlung durch die Ergebnisse der Korrekturen 2007 hinfällig war.

Außerdem ist Willis‘ Manipulation der Bojen-Metadaten zusammen mit den XBT-Daten verwirrend genug, um seine Schlussfolgerung in der Korrektur-Studie 2007 als fraglich erscheinen zu lassen.

Zusammenfassung der Beobachtungen:

● Es scheint, als ob die historischen Aufzeichnungen der Messungen mit ,Eimern‘ und in ,einströmendem Kühlwasser‘ als anekdotisch betrachtet werden müssen, als historisch und insgesamt grob, anstatt als wissenschaftliche Grundlage zu dienen für Trends der Erwärmung der Ozeane. Mit dem Aufkommen von XBT- und ARGO-Stichproben erscheinen die Trendlinien genauer, aber sie sind oftmals versteckt hinter Systemfehlern der Instrumente.

● Ein Versuch, den Ozean-Temperaturtrend zu ermitteln, muss die Größenordnung von Zufallsfehlern berücksichtigen im Verhältnis zu bekannten Systemfehlern. Falls man versucht, eine Trendlinie in einem Umfeld mit vielen Zufallsfehlern zu finden, kann sich der Mittelwert selbst am Rande der Fehlerbandbreite befinden und nicht in der Mitte.

● Die Ozeantemperatur sollte bis auf 0,03°C genau ermittelt werden. Allerdings gehen die Systemfehler oft über diese Präzision hinaus, und zwar bis zu drei Größenordnungen!

● Falls die Forschung von Willis symptomatisch ist für die Gemeinschaft der Meeresforscher insgesamt, kann der vermeintlichen wissenschaftlichen erforderlichen Sorgfalt nicht vertraut werden

● Mit der intensiven Konzentration auf statistische Manipulation der Metadaten und dem, was auch nur auf den Computer-Bildschirmen erscheint, scheinen es viele Wissenschaftler zu vermeiden, gebührende Umsicht walten zu lassen hinsichtlich der Datenquellen bzgl. Genauigkeit und Relevanz. Oftmals gibt es einfach nicht genügend Hintergrundwissen hinsichtlich der Genauigkeit der Rohdaten, um realistische Fehlerabschätzungen vornehmen zu können, und auch nicht, um irgendwelche Schlüsse zu ziehen, ob die Daten für das, was man machen will, überhaupt geeignet sind.

● Und außerdem: Die Grundlage statistischer Mittelbildung bedeutet die Mittelung ein und derselben Sache. Die Mittelung von Ozean-Temperaturdaten über die Zeit kann nicht mit Mittelwerten durchgeführt werden, welche aus breit gestreuten Datenquellen, Instrumenten und Verfahren hervorgehen. Deren individuelle Herkunft muss bekannt sein und berücksichtigt werden!

Zum Schluss noch ein Vorschlag:

Als er den Temperatursprung während des 2. Weltkrieges zwischen Eimermessungen und solchen in einströmendem Kühlwasser identifizierte, hat Thompson diese korreliert mit den NMAT-Daten, d. h. mit nächtlichen Temperaturen bei jedem der beiden Messverfahren. NMAT kann eine Möglichkeit sein – vielleicht bis zu einem bestimmten Grad – die verschiedenen Aufzeichnungen seit dem 19. Jahrhundert zu validieren und in einen Zusammenhang zu bringen mit zukünftiger Satelliten-Überwachung.

Dies kann erreicht werden, indem man Forschungsschiffe in kalte, gemäßigte und warme Ozeangebiete entsendet, wo sie gleichzeitig repräsentative Eimermessungen und in einströmendem Kühlwasser durchführen sowie eine Handvoll XBT- und ARGO-Sonden einsetzen, während CBT-Tests gleichzeitig erfolgen. Und alle diese Prozesse müssen korreliert werden unter ähnlichen nächtlichen Bedingungen und mit lokalisierten Satellitenmessungen. Mit dieser Kreuz-Kalibrierung könnte man die historischen Aufzeichnungen zurück verfolgen und die Temperaturdifferenzen berechnen zu ihren nächtlichen Verhältnissen, wo ein solches Zusammenpassen gefunden werden kann. Auf diese Weise können NMATs dazu führen, alte, derzeitige und zukünftige Ozean-Aufzeichnungen zu validieren. Damit können Trends der Vergangenheit und der Zukunft genauer abgeschätzt werden. Die Finanzierung eines solchen Projektes sollte leicht möglich sein, weil es die Validität vieler Ozean-Aufzeichnungen korrelieren und zementieren würde, in Vergangenheit und Zukunft.

Link: https://wattsupwiththat.com/2018/07/11/bucket-list-historic-global-ocean-temperature-data-the-missing-pedigree-is-a-comedy-of-errors/

Übersetzt von Chris Frey EIKE

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"Erst mal sind die Eimer für grobe Messungen ein Vehikel, dass besser als nichts ist/war. Der Autor hat die „Unwägbarkeiten“ auch ganz gut beschrieben.

Ich halte die Forderung nach 0,03 K Messunsicherheit zwar sinnvoll aus Sicht der zu bewertenden Umstände, aber technisch nicht mal mit den heutigen Möglichkeiten reproduzierbar realisierbar. Ich habe mein Berufsleben mit Temperatursensoren verbracht, hauptsächlich „elektrisch“, aber von Flüssigkeitsglasthermometern habe ich auch ein wenig Ahnung, zumal ich oft mit Kalibrierungen beschäftigt war.

Neben der „Eimermethode“ gab es bis zur technsichen Reife elektrischer Verfahren die Tiefseekippthermometer, um in der Tiefe der Meere Anhaltswerte bezüglich der Temperatur zu bekommen. Deren Kalibrierungbeim Hersteller habe ich oft erlebt und verfolgt, ich war aber mehr für die „elektrischen“ zuständig. Es gab damals beim ASMW die VM 237, die die Kalibrierung dieser sehr speziellen Glasthermometer regelte. Es gab die Typen A und B, die einen druckfest, die anderen offen, um über Umwege die Messtiefe bestimmen zu können. Insgesamt war die Kalibrierung prinzipbedingt mit langen Zeiten verbunden, die auch bei den realen Messungen zu Buche schlugen. Da die Schiffe während der Messungen meist in Fahrt waren, gingen die Messungen zwangsläufig über viele Kilometer bei Zeitkonstanten (t90) fast im Stundenbereich.

Die Grundunsicherheit dieser komlizierten Thermometer wird „über Alles“ im Bereich von einigen Zehnteln K gelegen haben, die Forderungen des Autors konnten aber auch die nicht erfüllen. Die unkritische Verwendung auch dieser Messdaten für irgendwelche klimatischen „Hochrechnungen“ verbietet sich also für die ehrliche Forschung.

Ich schliesse mich Ihrem Lob an, der Autor hat Planken unter den Füssen („alter“ Bootsmann hier), am Schanzkleid mit der Pütz und bei Kühlaggregaten im Maschinenraum.

Was grundsätzlich fehlt und womit das Projekt „globale“ Meerwasser-Temperaturen unabstreitbar belastet wird, ist der Zufluss durch Flüsse und Niederschläge. IIRC ist die Faustregel, dass sich Zuflüsse erst in ~10 Jahren unauffindbar vermischt haben. Wo wird das, mit welchem Anteil, wie berücksichtigt, ausser garnicht?

Das Wasserproben falsch sein können wegen „falscher Eimer“, dies kam auch schon im Jahr 2015 zum Thema bei der ARTE-Doku „Klimawandel – Woher kommen die Zahlen? (1/2)“, ab Minute 8:50 bis 12:45. Ab Minute 12:00 wird auch „orakelt“, warum Messungen während des 2. Weltkriegs ungenau waren.

https://vimeo.com/147425557

Ob vieles den Tatsachen entspricht oder nicht, lasse ich Experten entscheiden. Da auch hier bei EIKE darüber berichtet wird, sind sich Klimaalarmisten und Klimaskeptiker (=Klimarealisten) einig, dass es Messfehler bei dieser Methodik gab.

Interessant ist aber, dass bei dieser politisch korrekten Doku auch gezeigt wird, wie eine Grafik der Meerestemperaturen „korrekt“ verlaufen müsste, seit 1880, mit Hilfe von ‚Homogenisierung‘. also eine ‚Bereinigung‘ von Messfehlern.

Im Video ab Minute 18:05 bis 21:10

Ist diese Homogenisierung grundsätzlich erlaubt oder verboten bei wissenschaftlichen Statistiken? Oder ist dies eine Verfälschung zu Gunsten eines vorher festgelegten Ergebnisses? Dies würde mich als Laie mal interessieren.

Die Homogenisierung wäre notwendig, ist aber unmöglich weil die damaligen Randbedingungen völlig unbekannt sind. Also muss man das ganze resultierende Unsicherheitsband um den Mittelwert legen, worauf der völlig im Rauschen verschwindet. Details dazu hier

„Ohne Absorption von Solarstrahlung, ihre Wandlung in Wärme und ihres mit Hilfe des sog. atmosphärischen Treibhauseffektes verzögerten „Durchflusses“ würde die Temperatur des H2O der Ozeane global etwa 30 K ± ? betragen.“

Quatsch – wie immer!

Lieber Herr Keks,

„Quatsch“?, und welche Temperatur würde sich denn (ohne Sonne, aber mit Mond und ganz einsam im Weltraum nach Ihrem immer wieder beeindruckendem Wissenstand) mit der Erdwärme allein an der Erdoberfläche einstellen? Vielleicht 35 K ±?

MfG

Die Temperaturen werden so berechnet:

https://www.eike-klima-energie.eu/2018/02/09/schock-studie-formel-berechnet-praezise-planetarische-temperaturen-ohne-treibhauseffekt-und-co2/#comment-196621

Der Titel stimmt! Soviel Unsinn schockiert!

Joo, blöd nur, daß bei diesem „Unsinn“ die richtigen Werte raus kommen.

Als emprisch arbeitender Ökonom mit einer soliden Ausbildung in Statistik und Ökonometrie fand ich den Beitrag sehr informativ. Beschäftigt man sich mit der zweiten strategischen Variable des >menschengemachten Klimawandels<, so sind dort ja noch viel problematischere Erkenntnisprobleme. Aus der Chemie und Biologie kennt man ja die vielfältigen Quellen und Senken des >Klimagases<. Ich bin schon seit langer Zeit auf der Suche nach vertrauenswürdigen statistischen Befunden. Kann mir da jemand helfen ? Sollten diese Daten jemals gefunden werden, dann müsste man die hier dokumentierte Erkenntnismethodik anwenden.

„Sollten diese Daten jemals gefunden werden, d……..“

Leider, leider kann es solche Daten nicht geben, denn jede Änderung der Wirkung der mehr als zweiatomigen Gase auf die energetische Rückkopplung des atmosphärischen Treibhauseffektes wird von den Wasser und Eis Partikeln des lebenswichtigen Wasserkreislauf „unverzüglich“ kompensiert!

Woher haben die IPCC-Ideologen denn die CO2-Daten?

Die Daten entstehen nur dann, wenn man eine Wirkung addiert, die tatsächlich nicht entstehen kann, weil andere inhärent Beteiligte mit ihrer Gegenreaktionen (von den Unbedarften nicht erkannt) die Show stehlen!

Ich weiß, manchmal bin ich ein wenig nostalgisch:

Was soll der Quatsch der „Klimaexperten“, gerechnete Temperaturerhöhungen von Zehntel- bis einem Grad als katastrophal darzustellen. Auch über die Messungenauigkeiten lohnt eigentlich keine Diskussion, denn der historische Trend zeigt, dass so etwas locker im Rauschen untergeht.

– Aber, natürlich höre / lese ich auch Nachrichten. Prof. Latif hat auch schon wieder vor der kommenden Katastrophe warnen dürfen

http://www.fr.de/wissen/klimawandel/klimawandel/extremsommer-vom-klimaschutz-verabschiedet-a-1550325

http://www.fr.de/wissen/klimawandel/klimawandel/klimawandel-weltmeere-erhitzen-sich-auf-rekordhoch-a-1440911

und von 2015

http://www.fr.de/politik/klimaforscher-latif-sieht-zeitnot-und-hoffnungssignale-a-478573

Was wissen wir sicher? – Ohne Absorption von Solarstrahlung, ihre Wandlung in Wärme und ihres mit Hilfe des sog. atmosphärischen Treibhauseffektes verzögerten „Durchflusses“ würde die Temperatur des H2O der Ozeane global etwa 30 K ± ? betragen. Jetzt messen wir lokal eine Minimaltemperatur von 271 K ± ? (eine Naturkonstante!) und eine Maximaltemperatur von etwa 303 K ± ? (einen Klimaindikator?). Ein Besucher aus dem Weltraum würde den Mittelwert mit 287 K ± ? abschätzen und daher keineswegs erstaunt sein, wenn Schlaumeier sogar am Festland einen Mittelwert von „14 Grad C ± ?“ errechnen!

Peinlich bleibt für IPCC und BMU lediglich, dass alle Änderungen der energetischen Rückkopplung des CO2 klammheimlich von den Wasser und Eispartikeln darüber kompensiert werden. Doch merke: Glaube macht stark!!!!!!