Bahnbrechende Vorhersagemethode durch überraschende Sonneneruptionen auf der Rückseite der Sonne bestätigt

Mexiko-Stadt, Mexiko – 14. Februar 2026 Ein Team von Wissenschaftlern aus aller Welt hat das erste System entwickelt, das vorhersagen kann, wann und wo extrem starke Sonnenstürme, sogenannte Superflares, am wahrscheinlichsten auftreten. Diese Stürme können Stromnetze, Kommunikationssysteme und Satelliten stören und sogar eine Gefahr für Astronauten im Weltraum darstellen.

Anstatt zu versuchen, den genauen Zeitpunkt eines Sonnensturms vorherzusagen (was nahezu unmöglich ist), ermittelt dieser neue Ansatz längere Zeitfenster – von mehreren Monaten bis zu einem Jahr –, in denen die Wahrscheinlichkeit höher ist, dass die Sonne solche Extremereignisse auslöst. Das Verfahren zeigt zudem auf, welche Regionen der Sonne am stärksten gefährdet sind. Die Forschungsergebnisse wurden im „Journal of Geophysical Research: Space Physics“ veröffentlicht.

So funktioniert das Vorhersagesystem

Die Wissenschaftler analysierten Daten aus fast 50 Jahren (1975–2025) von Satelliten, welche die Röntgenstrahlung der Sonne überwachen. Dabei entdeckten sie zwei wesentliche Muster:

1. Sie identifizierten bestimmte Zonen auf der Sonne, in denen sich im Laufe der Zeit magnetische Energie aufbaut, wodurch in diesen Bereichen mit größerer Wahrscheinlichkeit starke Eruptionen auftreten.

2. Sie fanden ein rhythmisches Muster in der Sonnenaktivität, das auf zwei natürlichen Zyklen basiert: einem 1,7-Jahres-Zyklus und einem 7-Jahres-Zyklus. Wenn diese Zyklen auf bestimmte Weise zusammenfallen, steigt das Risiko von Superflares erheblich.

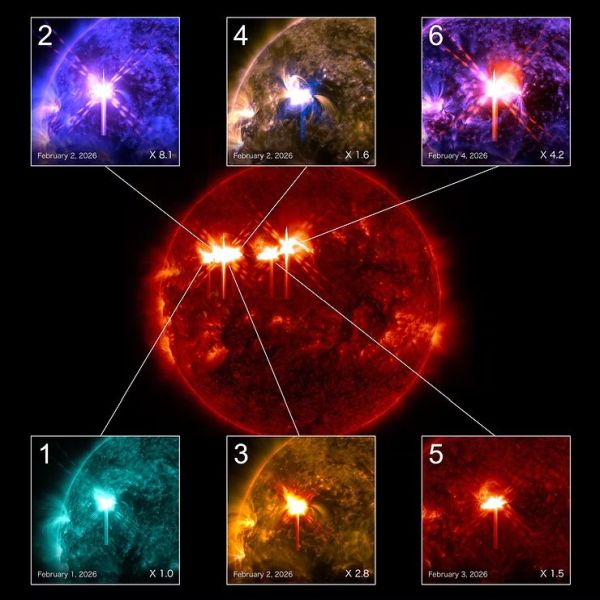

Mithilfe fortschrittlicher mathematischer Verfahren und maschinellen Lernens kombinierte das Team diese Muster, um risikoreiche Zeiträume und Orte auf der Sonne vorherzusagen. Für den aktuellen Sonnenzyklus (Sonnenzyklus 25) sagt ihr Modell zwei Hauptgefahrenfenster voraus:

• Mitte 2025 bis Mitte 2026 (mit Schwerpunkt auf der südlichen Hemisphäre der Sonne, zwischen 5°S und 25°S Breite)

• Anfang bis Mitte 2027 (mit Schwerpunkt auf der Nordhalbkugel der Sonne, zwischen 10° N und 30° N Breite)

Implikationen für die reale Welt

Der leitende Forscher Dr. Victor M. Velasco Herrera von der Nationalen Autonomen Universität von Mexiko erklärte:

„Herkömmliche Sonnenvorhersagen haben Schwierigkeiten mit diesen Extremereignissen, weil sie so schnell und unvorhersehbar auftreten. Unser Verfahren gibt Weltraumwetterdienstleistern und Satellitenbetreibern ein bis zwei Jahre im Voraus eine Warnung, wann die Bedingungen am gefährlichsten sind. Diese entscheidende Vorlaufzeit ermöglicht es ihnen, Kommunikationssysteme und Stromnetze vorzubereiten und zu schützen sowie die Sicherheit der Astronauten zu gewährleisten.“

Dr. Velasco Herrera wies auch auf die Bedeutung für Weltraummissionen hin:

„Die NASA tut gut daran, die Artemis-II-Mission zum Mond auf März zu verschieben, doch angesichts der derzeitigen hohen Sonnenaktivität deuten unsere Prognosen darauf hin, dass eine Verschiebung des Starts auf Ende 2026 eine wesentlich sicherere Entscheidung sein könnte.“

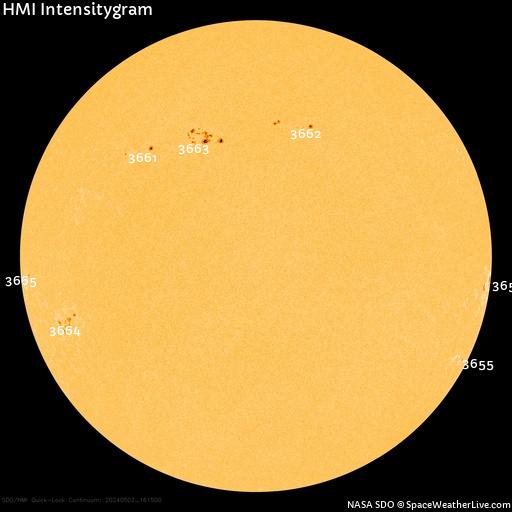

Überraschende Validierung von der anderen Seite der Sonne

Das Team erhielt bereits während des Forschungsprozesses selbst eine unerwartete Bestätigung für die Genauigkeit seines Modells. Nachdem sie ihre Arbeit zur Veröffentlichung eingereicht hatten (zwischen Oktober und Dezember 2025), entdeckten andere Wissenschaftler mithilfe des Raumfahrzeugs „Solar Orbiter“ eine Reihe gewaltiger Superflares, die auf der Rückseite der Sonne ausgebrochen waren – der Seite, die wir von der Erde aus nicht sehen können. Zu diesen Eruptionen gehörten eine der Klasse X11.1 am 14. Mai 2024, eine der Klassen X9.5 und X9.7 am 15. Mai 2024 sowie eine der Klasse X16.5 am 20. Mai 2024, wie zufällig am gleichen Tag in einer NASA-Studie berichtet worden war.

Bemerkenswerterweise stimmten diese neu entdeckten Ereignisse auf der Rückseite der Sonne mit den Mustern überein, die das Team vorhergesagt hatte, obwohl es bei der Entwicklung seines Vorhersagesystems keine Kenntnis von diesen Stürmen hatte.

„Das war reiner Zufall, aber auch sehr aufschlussreich“, sagte Dr. Velasco Herrera. „Wir haben unsere Vorhersage erstellt, ohne von diesen Superflares auf der Rückseite der Sonne zu wissen. Als sie während des Begutachtungsprozesses unserer Arbeit entdeckt worden sind, passten sie perfekt zu unseren vorhergesagten Mustern. Dies zeigt, dass unser physikalisch fundierter Ansatz auf der gesamten Sonne funktioniert, nicht nur auf der der Erde zugewandten Seite.“

Mitautor Dr. Willie Soon vom Center for Environmental Research and Earth Sciences (CERES) fügte hinzu:

„Die Natur hat uns den perfekten Test geliefert. Diese Entdeckungen auf der Rückseite haben unser Verfahren im Wesentlichen in Echtzeit validiert und bewiesen, dass die von uns identifizierten zugrunde liegenden Muster zuverlässig sind und überall auf der Sonnenoberfläche funktionieren.“

Warum das wichtig ist

Solarsuperflares sind die stärksten Eruptionen, die die Sonne hervorbringen kann. Ein direkter Treffer durch einen solchen Sturm könnte zu großflächigen Stromausfällen führen, Satelliten beschädigen, die GPS-Navigation stören, den Funkverkehr beeinträchtigen und Strahlungsgefahren für Astronauten und Fluggäste in großen Höhen verursachen.

Durch die frühzeitige Vorwarnung, wann und wo diese Ereignisse am wahrscheinlichsten auftreten, verschafft dieses neue Vorhersagesystem Energieversorgern, Satellitenbetreibern und Weltraumagenturen wertvolle Zeit, um Schutzmaßnahmen zu ergreifen – wie zum Beispiel die Anpassung von Satellitenbahnen, die Vorbereitung von Backup-Systemen oder die Umplanung von Weltraummissionen.

Da der Sonnenzyklus 25 weiterhin hohe Aktivität aufweist, bietet dieser Durchbruch eine erhebliche Verbesserung unserer Möglichkeiten, uns auf die Auswirkungen extremer Weltraumwetterereignisse vorzubereiten und diese abzumildern.

Die Forschungsarbeit mit dem Titel „A New Method for Probabilistic Spatiotemporal Forecasts of Solar Soft X-ray S-Class (> X10) Superflares“ wurde nun im Journal of Geophysical Research: Space Physics (American Geophysical Union) veröffentlicht: https://doi.org/10.1029/2025JA034977.

Zum Autorenteam gehören Wissenschaftler aus Mexiko, den USA, Ungarn, der Türkei, Russland, der Tschechischen Republik und China.

Publication Details

V. M. Velasco Herrera, G. Velasco Herrera, W. Soon, A. Özgüç, N. Babynets, A. Tlatov, M. Švanda, S. Qiu, S. Baliunas, B. Kotan, G. González González, L. A. Bautista Flores, M. Pazos (2026). “A New Method for Probabilistic Spatiotemporal Forecasts of Solar Soft X-Ray “S-Class” (>X10) Superflares“. Journal of Geophysical Research: Space Physics. 131 (2), e2025JA034977. https://doi.org/10.1029/2025JA034977

Studie: https://agupubs.onlinelibrary.wiley.com/doi/10.1029/2025JA034977

Übersetzt von Christian Freuer für das EIKE

Wir freuen uns über Ihren Kommentar, bitten aber folgende Regeln zu beachten:

- Bitte geben Sie Ihren Namen an (Benutzerprofil) - Kommentare "von anonym" werden gelöscht.

- Vermeiden Sie Allgemeinplätze, Beleidigungen oder Fäkal- Sprache, es sei denn, dass sie in einem notwendigen Zitat enthalten oder für die Anmerkung wichtig sind. Vermeiden Sie Schmähreden, andauernde Wiederholungen und jede Form von Mißachtung von Gegnern. Auch lange Präsentationen von Amateur-Theorien bitten wir zu vermeiden.

- Bleiben Sie beim Thema des zu kommentierenden Beitrags. Gehen Sie in Diskussionen mit Bloggern anderer Meinung auf deren Argumente ein und weichen Sie nicht durch Eröffnen laufend neuer Themen aus. Beschränken Sie sich auf eine zumutbare Anzahl von Kommentaren pro Zeit. Versuchte Majorisierung unseres Kommentarblogs, wie z.B. durch extrem häufiges Posten, permanente Wiederholungen etc. (Forentrolle) wird von uns mit Sperren beantwortet.

- Sie können anderer Meinung sein, aber vermeiden Sie persönliche Angriffe.

- Drohungen werden ernst genommen und ggf. an die Strafverfolgungsbehörden weitergegeben.

- Spam und Werbung sind im Kommentarbereich nicht erlaubt.

Diese Richtlinien sind sehr allgemein und können nicht jede mögliche Situation abdecken. Nehmen Sie deshalb bitte nicht an, dass das EIKE Management mit Ihnen übereinstimmt oder sonst Ihre Anmerkungen gutheißt. Wir behalten uns jederzeit das Recht vor, Anmerkungen zu filtern oder zu löschen oder zu bestreiten und dies ganz allein nach unserem Gutdünken. Wenn Sie finden, dass Ihre Anmerkung unpassend gefiltert wurde, schicken Sie uns bitte eine Mail über "Über Uns->Kontakt"Zum Thema des Beitrags!

Zitat: Bahnbrechende Vorhersagemethode durch überraschende Sonneneruptionen auf der Rückseite der Sonne bestätigt.

Na ja, so bahnbrechend ist das nun nicht. Es gab für solche Phänomene bzw. Erscheinungen schon eine Veröffentlichung/Beschreibung, nur hat niemand diese Theorie bis heute so recht gewürdigt und beachtet.

Siehe: H. Poincaré, Sur l’équilibre d’une masse fluid d’une mouvement de rotation, Acta math., 1885, p. 259

Die Beschreibung der Schwingungen bzw. Bewegungen einer freien Kugeloberfläche unter Erhalt der Rotationssymmetrie mit Hilfe von zonalen Kugelfunktionen ist in der Gesamterscheinung nicht möglich und unbestimmbar, weil dazu die zeitlichen Variationen der zonalen Oberflächen-Kugelfunktion dKi/dt erforderlich sind. Deshalb gibt es bis heute auch keine einheitliche Theorie sogenannte „Monsterwellen“ oder „Freak Waves“ zu erkennen bzw. das Auftreten näherungsweise physikalisch zu beschreiben. Die Deformation einer Kugeloberfläche nach zonalen Kugelfunktionen führen stets zur Instabilität.

Das Unbestimmtheitsverhältnis über eine Zeit- und Längenskala ergibt den Wert 1/√(2). Aufgrund der quadratischen Konvergenz (Gauß) von periodischen oder zyklischen oder oszillierenden Vorgängen erhält man in den theoretischen Betrachtungen den Faktor (1/√(2))² = ½ oder [(1/√(2))²]² = ¼ oder Kombinationswerte durch Überlagerung.

Das sieht man zum Beispiel an – Zitat: Sie fanden ein rhythmisches Muster in der Sonnenaktivität, das auf zwei natürlichen Zyklen basiert: einem 1,7-Jahres-Zyklus und einem 7-Jahres-Zyklus. Wenn diese Zyklen auf bestimmte Weise zusammenfallen, steigt das Risiko von Superflares erheblich.

Nimmt man die 1,7a und die 7a als zonale bestimmbare zeitliche Variationen der beobachteten Längenskala an, dann ergibt sich 1,7a^3,67 = 7a.

Die maximale Wahrscheinlichkeit der Prognose, dass die Sonneneruption der beobachteten Längenskala auftritt liegt also bei P = (1 – 1/3,67)*100% = 73%.

Statistische Extrapolation ist kein wirkliches Modell, sondern Hoffen, dass es wieder passiert. Ein Modell das auf einem bekannten Wirkzusammenhang basiert darf sich als solches bezeichnen. Für die Sonnenflecken gibt es auch Messreihen, aber das ist noch kein Beweis, dass es wieder passiert. Für die Sonnenflecken gibt es allerdings Modelle die die Schwingungen in dieser Gasblase modellieren und damit einen Wirkzusammenhang unterlegen. Dass jemand in den Daten ein 7 Jahreszyklus entdeckt hat, reicht nicht aus um ein Modell zu rechtfertigen. „Maschinelles Lernen“ ist Raten und Kaffeesatzleserei. Ich kenne solche Beispiele die furchtbar schief gegangen sind. p.s. Die CO2 Modelle des IPCC gehören auch dazu. Danach müssten wir schon alle verbrannt sein.

„Beispiele die furchtbar schief gegangen sind. p.s. Die CO2 Modelle des IPCC gehören auch dazu. Danach müssten wir schon alle verbrannt sein.“

Das ist so nicht richtig. Der erste IPCC von 1990 sagte etwa +0,3 K Erwärmung pro Jahrzehnt vorher für das „Weiter wie bisher“-Modell (Seite 63, Executive Summary) . Nun sind wir 35 Jahre später bei etwa +1,0 K mehr als 1990. Ich finde „furchtbar schief gegangen“ trifft es hier nicht, oder sehen Sie das anders?

Lesen Sie gerne selbst nach, der Bericht ist noch online.

Woher haben Sie die Info, dass das Modell versagt hat? Das stimmt offensichtlich nicht.

https://www.ipcc.ch/report/ar6/syr/figures/figure-spm-5 Die status quo Kurve überlappt sich schon fast mit der net zero Kurve am rechten Rand mit einer Streuung die haarsträubend ist. Wenn der IPCC ein Modell bastelt das gerade mal den natürlichen Trend ohne Beweis für mensch gemachten Wandel liefert, dann ist das Humbug. 0,3K ist für mich im Rauschen der natürlichen Vorgänge. https://de.wikipedia.org/wiki/Kleine_Eiszeit Wenn mir der IPCC die kleine Eiszeit genau „nachher voraussagt“ sehen wir weiter. Das wäre mal ein MODELL!

Aber vielleicht irre ich mich ja und die natürlichen Schwankungen in der Vergangenheit wurden von den Atlantern und ihren Abgasen verursacht:

Und dann halt noch die Schlagzeilen dazwischen: https://exxpress.at/news/klimaforscher-kalt-erwischt-arktis-eis-schmilzt-nicht-dahin-ostpazifik-kuehlt-ab/

Ich mache ihnen jedes „Modell“ aus einer kurzfristigen Aufnahme einer Rauschkurve, überhaupt kein Problem. Mit beliebig komplizierten Formeln und Parametersätzen.

Fakt ist: Der IPCC hat nicht vorhergesagt, das wir „verbrennen“, sondern, dass wir ca +1 K in 30 Jahren bekommen und das ist genau so eingetreten.

Drehen Sie es also wie Sie wollen, Ihre erste Aussage war schlicht falsch.

Mit Quellen Belegen konnten Sie sie auch nicht.

0,3 K/ 10a sind Rauschen? Rauschen bewegt sich um einen Referenzwert und wird mit +/- angegeben. Hier haben wir eine prognostizierte Steigung nmit Ungenauigkeiten. Die Betrachtung des CO2 ergab damals die Prognose einer Steigung und nicht eines Rauschens. Das „Rauschen“ von 0,3 K/10a traf jetzt dreimal korrekt ein.

„Ich mache ihnen jedes „Modell“ aus einer kurzfristigen Aufnahme einer Rauschkurve, überhaupt kein Problem.“

So funktionieren Modelle nicht…

Zu Ihrem Exxpress-.Artikel: Der gibt als „Quelle“ das Portal „Agrarheute“ an, ohne echte Verweise. Wissen Sie, weshalb? Weil sonst auffallen könnte, das die hier genannte Prognose nie wissenschaftlich anerkannt war. Der Artikel ist pure Stimmungsmache, nicht wissenschaftlich und kein Beleg für ein Versagen der Modelle.

„Aber vielleicht irre ich mich ja und die natürlichen Schwankungen in der Vergangenheit wurden von den Atlantern und ihren Abgasen verursacht:“

Ja, Sie Irren sich. Um das zu sehen braucht man keine Atlanter. Dass es natürliche Schwankungen gibt und gab heißt nicht, dass es keine anthropogenen geben kann. Das ist ein Fehlschluss.

Wir können gerne weiterdiskutieren, aber Ihre erste Behauptung ist nicht haltbar und ich würde Sie bitten, dies erstmal richtig zu stellen.

Sagte ich doch. Der IPCC soll die vergangenen kleinen Eiszeiten vorrechnen. Ach kann er nicht? Die nächste kleine Eiszeit von mir aus auch, allerdings kann ich das dann wohl selber nicht mehr überprüfen. …

p.s.: Nur um Missverständnisse auszuräumen. Wenn ein korrektes physikalisches Modell ohne menschlichen Einfluss eine Erhöhung von 0,3K/Dekade gesichert voraussagen würde, dann wären die Prognosen als unseriös zu bewerten. Und wenn das gleiche Modell die Kurven von oben nicht reproduzieren kann und ebenfalls solche Abweichungen entstehen, dann ist das sehr wohl furchtbar schief gegangen.

Es gibt ja Versuche den Fuß hier vorsichtig in die Türe zu bekommen, ohne gleich mit der Tür ins Haus zu fallen. Die website von EIKE hat gerade wieder einen Artikel zu dem Thema.

https://eike-klima-energie.eu/2026/03/19/neubewertung-des-klimawandels/#comments

Und selbstverständlich hat der IPCC nicht behauptet, dass wie verbrennen. Wenn ich theatralisch übertreibe, ist Kritik daran auch übertrieben.

Herr Beinwein, Computermodelle berechnen exakt das, was der Programmierer will bzw. wofür der Bezahler bezahlt. War lange genug für den Erfolg von Modellen zuständig um es genau zu wissen. Mit genügend Geld und Zeit kann ich Modelle organisieren, die eine beliebige Abkühlung bei CO2 Anstieg vorhersagen.

Wäre die IT schon vor 50 Jahren auf heutigen Niveau würden wir tausende überflüssige Waldsterbler und Ozonlochler ernähren, die mit ihren Simulationen den Weltuntergang berechnen. Nun sind es halt Millionen überflüssige Klimatologen.

Im Übrigen ist die Erde bei hunderfach höheren CO2 bis zum Äquator zugefroren, CO2 erwärmt erst, seit dem es die Computerspielereien gibt.

„Sagte ich doch. Der IPCC soll die vergangenen kleinen Eiszeiten vorrechnen. Ach kann er nicht?“

Doch, kann er. Die Kleine Eiszeit zeigt global eine Temperatursenkung von etwa 0,1 K nach Proxydaten.

Die Grafiken 2.11 im AR6, Working Group 1, Kap. 2 S.316 und 5.7 im AR5 Working Group 1, Kap. 5. S. 131 zeigen beide einen aus Modellen errechneten Rückgang der Temperatur um etwa 0,3 K zwischen 1400 und 1800. Ist zwar keine Punktlandung, jetzt für mich aber auch nicht „furchtbar schief gegangen“

(ich gebe zu, die KI hat mir geholfen, die Stellen zu finden aber ich habe es überprüft und die Grafiken sind wie beschrieben)

Tatsächlich ist es ein Standardverfahren, Modelle auf Ihre Qualität zu prüfen, indem man sie in der Vergangenheit losrechnen lässt und schaut, ob die Ergebnisse zu Proxies und Messdaten passen.

„Nur um Missverständnisse auszuräumen. Wenn ein korrektes physikalisches Modell ohne menschlichen Einfluss eine Erhöhung von 0,3K/Dekade gesichert voraussagen würde, dann wären die Prognosen als unseriös zu bewerten. „

Solche Modelle gibt es aber eben nicht.

Alle Modelle liefern falsche Ergebnisse, außer man berücksichtigt anthropogenes CO2 oder denkt sich eine bisher komplett unbekannte Energiequelle aus. Das könnte man dann allerdings zu Recht als unseriös bezeichnen.

„Und selbstverständlich hat der IPCC nicht behauptet, dass wie

verbrennen. Wenn ich theatralisch übertreibe, ist Kritik daran auch übertrieben.“

Die Aussage, „der Nordpol ist 2016 eisfrei“ war ja vielleicht auch nur eine theatralische Übertreibung? Eine entsprechende Studie konnte ich zumindest nicht finden.

Aber okay, das mit dem „verbrennen“ – geschenkt.

Ihre Kernaussage ist aber, dass die Modelle „furchtbar schief gegangen“ sind. Das ist keine theatralische Übertreibung, sondern schlicht falsch.

Ich kann nirgends ein physikalisch basiertes IPCC Modell finden, welches Wirkzusammenhänge autonom verrechnet. Und schon gar nicht auf 0,1K genau, was unabdingbar wäre um z.B. 0,3K/Dekade eindeutig menschgemacht zu deklarieren. Wenn schon in beobachtbaren Zeiträumen Simulationen mit +/- 0,3K/Dekade weglaufen ist das unannehmbar. (https://de.wikipedia.org/wiki/Klimamodell#/media/Datei:GCM_temp_anomalies_3_2000_German.svg) Bei Rekonstruktionen Rückwärts wird das dann total illusorisch. Der IPCC gibt dann auch zu, dass er Modelle mit Proxidaten „justiert“ (welche selber schon weit mehr als 0,3k streuen) bzw. „kalibriert“. Das ist nichts anderes als eine Interpolationsfunktion welche mit Modellen getarnt wurde. (https://archive.ipcc.ch/publications_and_data/ar4/wg1/en/figure-6-10.html). War es das was sie meinten, dass der IPCC sehr wohl die kleine Eiszeit „berechnete“? Das ist keine Berechnung, das ist höflich ausgedrückt eine „Justage“. Das lernt man schon in der Schule, dass man mit so etwas auf keinen, keinen Fall eine Extrapolation machen darf. Die Rekonstruktion müsste selbstverständlich auc durchgängig korrekt sein, und nicht nur irgendwo eine „Punktlandung“ produzieren.

„Ich kann nirgends ein physikalisch basiertes IPCC Modell finden, welches Wirkzusammenhänge autonom verrechnet.“

???

Das ist genau das, was Klimamodelle tun!

Es gibt Input von Außeneinflüssen auf die Temperatur und es wird berechnet, wie sich diese Parameter nach physikalischen Gesetzen auf die Temperatur auswirken.

Was glauben Sie denn, was Modelle tun?

Diese Modelle sind keine „Interpolation“ der Temperatur! Temp. ist der Output, kein Input.

„Der IPCC gibt dann auch zu, dass er Modelle mit Proxidaten „justiert““

Ich glaube, da haben etwas missverstanden. T-Proxies werden nicht als „Zieleingaben‘ zur Justierung in Modellen verwendet.

Der IPCC beschreibt tatsächlich Modell-Tuning, aber nicht im Sinne eines „Fitten“ an T- oder Proxydaten.

Angepasst werden die physikalischen Eingangsparameter (z. B. Strahlungsbilanz), nicht Temperaturverläufe.

Im AR6 steht ausdrücklich, dass die Mehrheit der Modelle nicht auf den beobachteten Erwärmungstrend getunt ist, abgesehen von einigen wenigen Experimentellen.

Die Aussage, der IPCC „gebe zu“, Modelle an Proxydaten zu justieren, ist aber eine Fehlinterpretation.

Mit den angepassten Daten konnte sowohl die kleine Eiszeit nachgebildet werden, als auch die Erwärmung seit 1990 vorhergesagt werden.

Und die Prognose von 1990 war sicher nicht mit Daten aus 2020 „gefittet“, oder?

Die Modelle „streuen“ nicht um 0.3 K, sondern zeigen eine Variabilität von etwa 0,3 K ab. Das ist ein Unterschied! Sie beziehen sich wohl in der Grafik auf kurzfristige Differenzieren oder Unterschiede an den Jahrzehnt-Grenzen. Wenn Sie aber Trendkurven betrachten, ist der Unterschied schon deutlich kleiner. Vor allem die Steigung der Trendkurven ist sehr gut vergleichbar und das ist, was ein Modell zeigen kann und soll.

Nimmt man das anthr. CO2 weg, stimmen diese Steigungen nicht mehr mit der Beobachtung seit 1900 überein.

Sie wollen offenbar ein Modell, das Ihnen exakt die Lottozahlen vorhersagen kann. Zugegeben, das gibt es nicht. Modelle haben statistische Streuung und Variabilität, aber das macht ein Modell weder nutzlos, noch „furchtbar schief gegangen“.

Ein Modell muss nicht auf 0.1 K genau eine gemessene Temperatur treffen. Es ist ein Indikator, wie sich T verändert, wenn sich Parameter ändern z.B. das CO2 erhöht. Das zeigen Modelle und Beobachtungen offenbar unabhängig voneinander.

Das Ganze hin und her kann man im kurzen Satz zusammenfassen: „Computerspielereien und Natur haben nichts miteinander zu tun!“ Kurz, verständlich und zutreffend.

Kurz und verständlich stimmt…

Zumindest verbal.

Die Modelle sind NICHT getunt?

Warum nicht? Geht nicht? Ist das Model falsch?

Macht man nicht? Was will man mit dem Ergebnis?

Ich glaube sie verifizieren gerade, was man von den Modellen halten muss.

Ungenau, nicht getunt, keine wirkliche Aussage möglich.

Schon beeindruckend, zu was Hochleistungs-Modellrechnungen heutzutage imstande sind und wie nützlich sie sind, um Vorhersagen und Warnungen für sich verändernde komplexe physikalische Systeme zu erhalten.

Stimmts?

Man konnte das Modell mit Messdaten prüfen, man hat (unabsichtlich) eine Experiment gemacht, oder?

Kann die Politik damit Geld verdienen? Nein. Wird sie zügig beginnen Sonnensturmschutz zu betreiben? Nein. Wann vielleicht doch, nach dem nächsten Sonnenstormtreffer, oder?

Ja, möglich!

Mensch, wo hab ich all das schonmal gehört?

Ich komm einfach nicht drauf…