Warum „billigere“ Wind- und Solaranlagen die Kosten erhöhen. Teil I: Das „Dickes Ende“-Problem

Planning Engineer (Russ Schussler)

Wind- und Sonnenenergie werden in vielen Regionen als die billigsten Stromquellen angepriesen, welche die meiste Zeit über preisgünstige Energie liefern können. Auf den ersten Blick könnte dies den Eindruck erwecken, dass ein stark auf erneuerbare Energien ausgerichteter Energiemix die wirtschaftlichste Wahl wäre. Diese Annahme übersieht jedoch einen kritischen Punkt: das Problem des „Dicken Endes“. Nur weil eine Ressource die meiste Zeit über billiger ist, bedeutet das nicht, dass sie die Gesamtsystemkosten senkt. In diesem Beitrag, dem ersten einer Reihe, wird untersucht, warum die Bevorzugung von Wind- und Solarenergie zu höheren Kosten führen dürfte, wobei eine Analogie aus der Finanzwelt verwendet wird.

Das dicke Ende im Finanzwesen: Ein abschreckendes Beispiel

Um das Problem des dicken Endes zu verstehen, betrachten wir einen Finanzbetrug, der einst in Werbespots zu später Stunde verbreitet wurde: „Machen Sie bei über 90 % Ihrer Trades Geld – garantiert!“ Diese Anzeigen versprachen, dass Sie mit ihrer Handelsstrategie bei 90 % Ihrer Geschäfte gewinnen und bei weniger als 10 % verlieren würden. Klingt nach einem todsicheren Weg zum Reichtum, oder?

Nicht so schnell, das ist zu einfach. Der Fehler liegt in der Größenordnung der Gewinne und Verluste. Investitionen steigen oft allmählich, können aber auch dramatisch abstürzen. Wenn Sie in 90 % der Fälle kleine Gewinne erzielen, aber in den restlichen 10 % massive Verluste erleiden, kann das Gesamtergebnis katastrophal sein. Der Prozentsatz der Gewinngeschäfte ist ein schlechter Maßstab für die Rentabilität, wenn die Verluste unverhältnismäßig hoch sind. Das ist das Dicke-Ende-Problem: Seltene, aber extreme Ereignisse bestimmen die Wirtschaftlichkeit.

Das dicke Ende im Stromnetz

Genauso wie seltene, aber massive Verluste im Handel die Gewinne zunichte machen können, verursachen Nachfragespitzen in den Stromsystemen Kosten, welche die Einsparungen durch erneuerbare Energien in einfachen Zeiten überschatten. Die Stromnachfrage schwankt, und die Stromversorgung ist zu bestimmten Zeiten weitaus schwieriger – und teurer – zu bewerkstelligen. Am Ende dieses Beitrags habe ich eine detailliertere und quantitativere Diskussion darüber geführt, wie und warum das dicke Ende zu einem wichtigen Faktor für die Energiekosten wird. Um nicht zu viele Leser zu verlieren, werde ich hier mit einer allgemeineren Beschreibung fortfahren.

Die schwierigsten Zeiten sind in der Regel die Nachfragespitzen im Winter und Sommer, die weniger als 5 % des Jahres ausmachen. In einer einzigen Stunde der Nachfragespitze können die Stromkosten um Größenordnungen höher ausfallen als die typischen Durchschnittskosten, so dass die Versorgungsunternehmen gezwungen sind, auf teure Reservekraftwerke zurückzugreifen, welche die meiste Zeit des Jahres ungenutzt bleiben. Im Januar 2014 beispielsweise wurde der Osten der USA von einem massiven Kälteeinbruch heimgesucht, der die Stromnachfrage für Heizzwecke im gesamten PJM-Verbund auf Rekordniveau steigen ließ. Da keine überschüssige Energie zwischen den Bundesstaaten geteilt werden konnte, stiegen die Großhandelspreise auf 2.000 US-Dollar pro Megawattstunde, mehr als das 60-fache des üblichen Durchschnitts von 30 US-Dollar/MWH. Kleinere, lokal begrenzte Ereignisse mit weniger drastischen Preisschwankungen kommen häufiger vor, tragen aber ebenfalls zum Problem des dicken Endes bei.

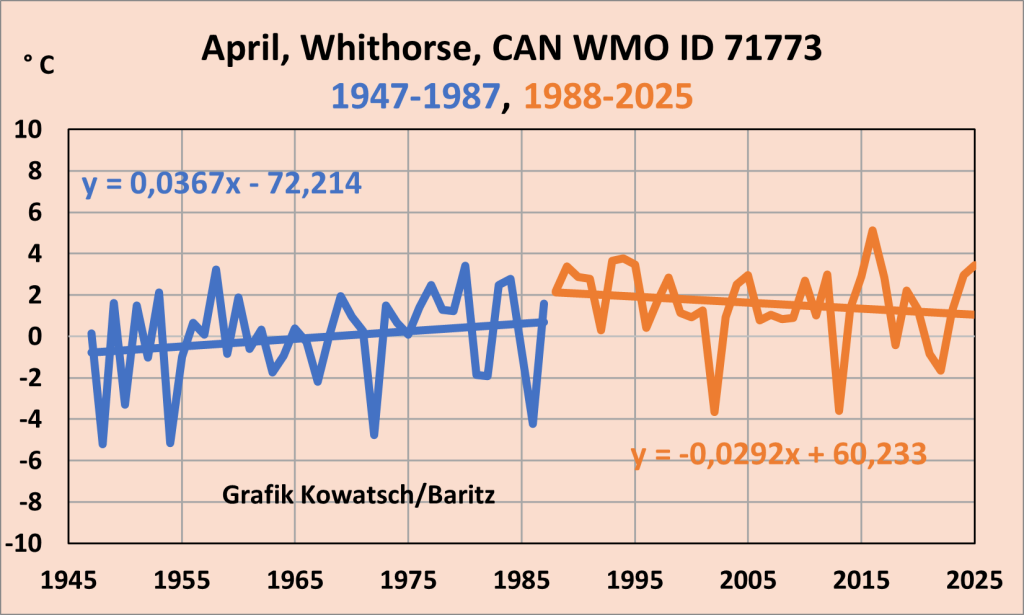

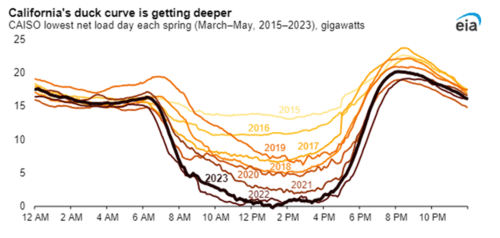

Diese Arten von Szenarien können durch die Entenkurve, wie sie im Folgenden dargestellt und beschrieben wird, erheblich verschlimmert werden:

Abbildung 1: Die Entenkurve, die zeigt, wie die Solarenergie in der Abenddämmerung starke Nachfragespitzen verursacht und die Kosten in die Höhe treibt.

Stellen Sie sich im schlimmsten Fall das Szenario der Entenkurve an einem Spitzentag im Sommer vor. Da die Verbraucher immer mehr Strom benötigen, fällt die gewerbliche und private Solarenergie deutlich ab und erfordert ein massives, schnelles Hochfahren einer Reihe von zuverlässigen Erzeugungsressourcen. Bei Jahresspitzen müssen unter Umständen große, kostspielige und möglicherweise das ganze Jahr über nicht benötigte Ressourcen zu hohen Kosten in Betrieb genommen werden. Bei einer Winterspitze tritt eine ähnliche Situation kurz vor Tagesanbruch ein. Ein hohes Maß an Strom wird benötigt, wenn Privatpersonen, Unternehmen und Fabriken mit der enormen Kälte fertig werden und sich auf den kommenden Tag vorbereiten.

Im Gegensatz dazu machen die „günstigen“ Zeiten, in denen die Nachfrage gering und das Angebot reichlich ist, 90 % oder mehr des Jahres aus, und hier werden die durchschnittlichen Energie- und variablen Kosten festgelegt. Ganz anders verhält es sich in schwierigen Zeiten mit der Nachfrage und den Festpreisen. In der Vergangenheit konnte eine einzige Stunde Nachfragespitze die jährlichen Spitzenlastgebühren eines Versorgungsunternehmens bestimmen, was die übergroßen Auswirkungen dieser extremen Bedingungen verdeutlicht.

Wind- und Solarenergie glänzen oft in guten Zeiten, da sie Strom zu niedrigeren Grenzkosten produzieren als traditionelle Energiequellen wie Erdgas oder Kernkraft. Allerdings ist ihre Leistung in Spitzenzeiten, wenn die Wetterbedingungen nicht mit der Nachfrage übereinstimmen, unregelmäßig und weniger zuverlässig. Wenn man sich in hohem Maße auf erneuerbare Energien verlässt, braucht man Reservesysteme – oft teure fossile oder nukleare Kraftwerke – um die Zuverlässigkeit während dieser kritischen Spitzenzeiten zu gewährleisten. Die Kosten für die Aufrechterhaltung dieser Reservesysteme in Verbindung mit der Infrastruktur, die für die Integration intermittierender erneuerbarer Energien erforderlich ist, können die Einsparungen durch billige erneuerbare Energien in guten Zeiten bei weitem übersteigen.

Wie ich schon früher angemerkt habe, sind „Energie-‚Pläne‘, die zwar Veränderungen auf breiter Front fordern, aber nicht berücksichtigen, wie das Gesamtsystem letztendlich funktionieren könnte, keine Pläne, sondern nur naive Wunschlisten.“ Politische Entscheidungsträger fördern Wind- und Solarenergie oft aufgrund ihrer niedrigen Kosten unter günstigen Bedingungen und ignorieren dabei das Dicke-Ende-Problem und die daraus resultierenden höheren Kosten für das gesamte System.

Eine Auto-Analogie: Effizienz/Marginalkosten sind nicht alles

Betrachten Sie ein praktisches Beispiel. Stellen Sie sich vor, Sie haben die Wahl zwischen zwei Autos. Auto A ist sparsam und erfüllt in 90 % der Fälle Ihre Bedürfnisse, aber in 10 % der Fälle brauchen Sie Auto B, das mehr Leistung und zusätzliche Sitzplätze hat. Auto B ist weniger sparsam, aber in den entscheidenden Momenten ist es unverzichtbar. Würden Sie auch Auto A kaufen, nur weil es in 90 % der Fälle billiger ist? Wahrscheinlich nicht – der Besitz von zwei Autos würde wahrscheinlich mehr kosten als die zusätzlichen Kraftstoffkosten für Auto B allein.

Auch der Bau von Wind- und Solarparks, die in ruhigen Zeiten billige Energie liefern, macht den Bedarf an zuverlässigen Ressourcen wie Erdgas oder Kernkraft in Spitzenzeiten nicht überflüssig. Die zusätzlichen Kosten für den Bau, die Instandhaltung und die Integration erneuerbarer Energien – bei gleichzeitiger Finanzierung von Backup-Systemen – machen das Gesamtsystem oft teurer. Detaillierte Modellrechnungen für das Energiesystem und Erfahrungen aus der Praxis bestätigen dies. Dennoch hält sich hartnäckig der Irrglaube, dass die niedrigen Grenzkosten der erneuerbaren Energien wirtschaftliche Vorteile garantieren.

Aneinander vorbei reden

Das „Fat Tail“-Problem kann erklären, warum Energiedebatten oft wie ein vorbeifahrendes Schiff in der Nacht wirken. Die Befürworter der erneuerbaren Energien betonen ihre niedrigen Durchschnittskosten, während sich die Planer auf die systemweiten Kosten konzentrieren, die mit der gesamten Palette der benötigten Erzeugungsressourcen verbunden sind. Diese Diskrepanz rührt von einer Art Unzähligkeit her – es wird versäumt, über die Durchschnittskosten hinauszugehen und die unverhältnismäßigen Auswirkungen der Versorgung von Spitzenzeiten und seltenen kostspieligen Ereignissen zu berücksichtigen.

In einem traurigen Fall von falsch verstandenem gesunden Menschenverstand wurden Renewable Portfolio Standards (RPS) und ähnliche Vorschriften in der Annahme erlassen, dass erneuerbare Energien von Natur aus wirtschaftlich sind. Die Modelle der Experten zeigten das Gegenteil, wurden aber oft als voreingenommen abgetan, da sie den Wert der „billigen“ erneuerbaren Energien nicht reflektierten. In Wirklichkeit reflektierten sie die harte Arithmetik des fetten Schwanzes. Diese entscheidende Erkenntnis wurde von zu vielen politischen Entscheidungsträgern, die sich auf kurzfristige Ziele konzentrierten, sowie von enthusiastischen Befürwortern und Akademikern, die sich der realen Welt nicht bewusst waren, übersehen.

Warum täuschen Finanzbetrügereien, bei denen ebenfalls Fat-Tail-Missverständnisse ausgenutzt werden, weniger Menschen als Versprechungen zu erneuerbaren Energien? Vielleicht verschleiert die Komplexität der Energiesysteme das Fat-Tail-Problem, während emotionale Appelle und vertrauenswürdige Institutionen den erneuerbaren Energien eine unangemessene Glaubwürdigkeit verleihen. Außerdem ist die Energiepolitik im Gegensatz zu persönlichen Investitionen mit kollektiven Kosten verbunden, so dass der Einzelne vielleicht weniger genau hinschaut.

Die moderne Zivilisation braucht die meiste Zeit über Strom. Andernfalls wären Wind- und Solarenergie ein besseres Geschäft. Aber es reicht nicht aus, 80 oder 90 % der Zeit über Energie zu verfügen. Es gibt zwar viele Programme und Ansätze zur Begrenzung des Stromverbrauchs in Spitzenzeiten, aber große Strommengen können nicht aus den Spitzenzeiten herausgenommen werden. Die Verbraucher müssen kühlen, wenn es heiß ist, und heizen, wenn es kalt ist. Diese Bedürfnisse sorgen dafür, dass das dicke Ende nicht wesentlich abgespeckt werden kann.

Um das klarzustellen: Ich glaube nicht, dass die Probleme im Allgemeinen in Form von „Fat Tails“ diskutiert wurden. Viele Ingenieure und Finanzanalysten haben sich zu den Systemkosten geäußert, was an den betroffenen Zuhörern vorbei und über sie hinweg ging. Die Gegenargumente von Akademikern und Befürwortern zur Wirtschaftlichkeit von Wind- und Solarenergie haben die Ingenieure und Finanzexperten verblüfft, die im Allgemeinen nicht den Einfluss hatten, um sie zu hinterfragen und eine Klärung herbeizuführen. In den meisten Fällen hatten die politischen Entscheidungsträger, ob mit oder ohne das nötige Verständnis, die Macht und trafen die Entscheidungen auf der Grundlage übermäßig optimistischer Erwartungen für Wind- und Solarenergie. Ein weiser Ratschlag: Wer nur von Durchschnittskosten spricht, sollte sich bei der Entscheidungsfindung für komplexe Systeme nicht darauf verlassen. Hüten Sie sich vor irreführenden Maßstäben.

Vorausschau

Das dicke Ende ist nur ein Teil des Puzzles. Es ist zwar ein entscheidender und oft missverstandener Faktor, aber auch andere Faktoren treiben die Kosten von Wind- und Solaranlagen in die Höhe. In künftigen Beiträgen dieser Serie werden diese Faktoren im Detail untersucht, um eine umfassende Erklärung dafür zu liefern, warum „billigere“ Wind- und Solarenergie in der Regel zu erheblich höheren Stromkosten führen kann. In den nächsten Beiträgen werden wir uns mit der Solarenergie für Privathaushalte, mit den wirtschaftlichen Aspekten von Energieversorgern befassen, Probleme mit den Energiemärkten erörtern sowie auf viele der oft ignorierten, nicht berücksichtigten Kosten im Zusammenhang mit Wind- und Solarenergie eingehen.

Das Wichtigste vorweg: In der Energiewirtschaft, wie auch im Finanzwesen, kann die Konzentration auf das, was am häufigsten passiert, den Blick auf die katastrophalen Kosten dessen verstellen, was seltener passiert. Das „Fat Tail“-Problem erfordert einen ganzheitlichen Ansatz bei der Energieplanung, bei dem Zuverlässigkeit und Erschwinglichkeit Vorrang vor simplen Kostenvergleichen haben.

Bonusabschnitt: Warum gibt es ein dickes Ende in Stromsystemen?

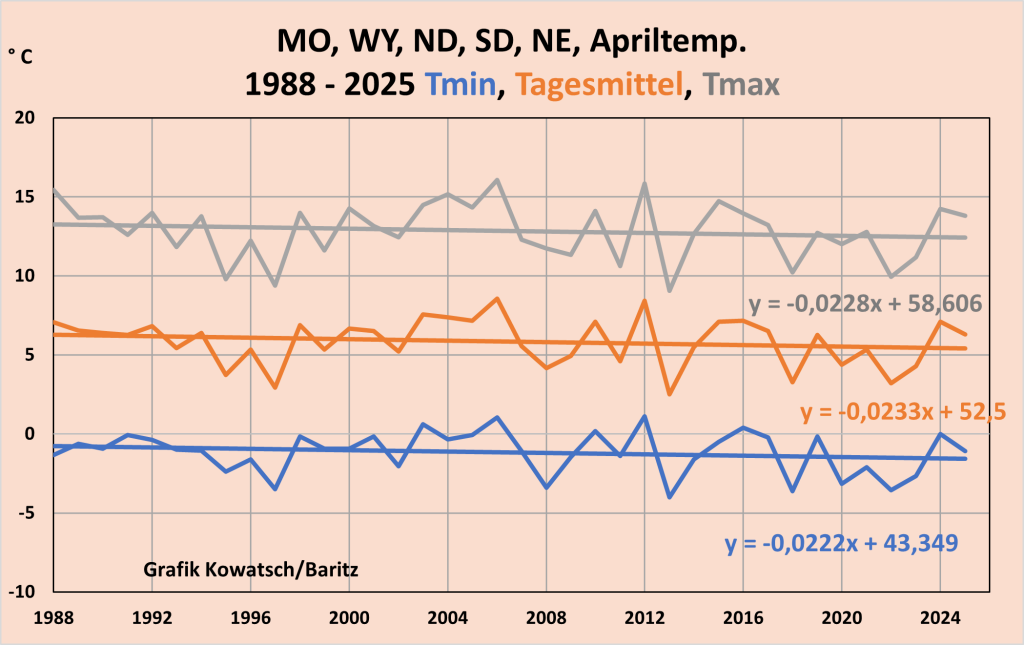

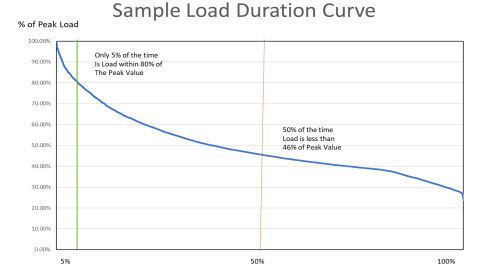

Schauen wir uns einige der Gründe an, warum elektrische Systeme dazu neigen, ein dickes Ende zu haben. Die Stromnachfrage schwankt je nach Tageszeit, Wochentag, Jahreszeit und natürlich je nach Wetterbedingungen, vor allem der Temperatur. Die durch diese Faktoren verursachten Schwankungen lassen sich in einer Lastdauer-Kurve ablesen. Lastdauerkurven werden gebildet, indem der jährliche stündliche Bedarf vom Höchstwert, der während des Jahres beobachtet wird, zum Mindestwert geordnet wird. Hier eine typische Lastdauer-Kurve:

Abbildung 2: Lastdauer-Kurve, die veranschaulicht, wie die Spitzennachfrage (rechts) kurz auftritt, aber die Systemkosten treibt

Wenn wir uns von rechts nach links bewegen, sehen wir, dass die Werte in der Nähe des Spitzenwerts nicht lange anhalten, und wenn wir uns nach links bewegen, sehen wir, dass die Last in fast einem Drittel der Zeit deutlich unter 40 % des Spitzenwerts fällt. Bei diesem typischen System liegt die Last nur 1,5 % der Zeit innerhalb von 90 % des Spitzenwerts. Wie oben gezeigt, liegt die Last nur 5 % der Zeit bei 80 % des Spitzenwerts. Niedrigere Lastniveaus überwiegen, da die Last in 50 % der Zeit weniger als 46 % des Spitzenwertes beträgt.

Noch ausgeprägter als die mit einem elektrischen System verbundenen Änderungen der Nachfrage sind die Unterschiede bei den Energiekosten von Stunde zu Stunde. Die inkrementellen Kosten für das nächste Quantum Energie werden als System-Lambda bezeichnet. Dies ist ein guter Indikator für die variablen Kosten für die Bereitstellung zusätzlicher Energie pro Stunde. Für ERCOT (Texas) lag das durchschnittliche System-Lambda im letzten Jahr bei 25 bis 30 $/MWh. Die meisten Werte lagen zwischen 10 $ und 100 $/MWh. Die gesamte Spanne reichte jedoch von -$10/MWh bis zu etwa $5.000/MWh. Die kalifornische ISO gibt die System-Marginal-Energiekosten ähnlich wie das System-Lambda an, das im vergangenen Jahr durchschnittlich 20 bis 30 $/MWh betrug, wobei die meisten Werte zwischen 0 und 100 $/MWh lagen, die gesamte Spanne jedoch von -100 $/MWh bis 2.000 $/MWh reichte.

Die Spanne der Grenzkosten (inkrementellen Kosten) ist sehr groß. Durch den Ausbau von Wind- und Solarenergie werden die Spannen noch deutlicher, als sie es sonst wären. Einige von Ihnen werden sich vielleicht den Kopf zerbrechen, wenn sie die negativen Werte oben sehen. Lassen Sie mich das erklären: Die Kernkraft läuft heute so gut wie immer auf Hochtouren. Für andere Anlagen wie Kohle- und Erdgasverbrennungsturbinen gelten Mindestbetriebswerte. Die Abschaltung von Kernkraft-, Kohle- und Kombikraftwerken ist mit Kosten verbunden, und wenn sie einmal abgeschaltet sind, gibt es verschiedene Mindestabschaltzeiten, die verhindern könnten, dass sie später bei Bedarf wieder zur Verfügung stehen. Für viele Blöcke bedeutet die Bereitstellung der benötigten Energie in Zeiten hoher Nachfrage, dass sie 24 Stunden am Tag Strom erzeugen müssen. Manchmal werden Wind- und Solarkraftwerke vorrangig betrieben, unabhängig davon, ob die Energie benötigt wird oder nicht. Diese Faktoren führen dazu, dass mehr Energie zur Verfügung steht, als vom System genutzt werden kann. Ein negatives Lambda wird verwendet, um von der Erzeugung abzuschrecken, und die Anlagen werden für die Einspeisung von Strom in diesen Zeiten bezahlt. (Hinweis: Aufgrund vertraglicher Vereinbarungen und Vorschriften kann es vorkommen, dass Wind- und Solarkraftwerke in Zeiten von Energieüberschüssen bezahlt werden, auch wenn andere für die Einspeisung von Energie in Rechnung gestellt werden).

Wir haben hier keine Festpreise berücksichtigt, aber allein die oben genannten Faktoren zeigen, dass Fat Tails eine große Rolle spielen können. System-Lambdas mit hohen Kosten können ein paar Größenordnungen über dem durchschnittlichen System-Lambda liegen, und noch schlimmer ist es, wenn der Energiewert negativ ist.

Bevor es einen signifikanten Anteil an intermittierenden Ressourcen gab, wurde die Stromerzeugung im Allgemeinen in Spitzenlast-, Zwischenlast- und Grundlaststrom eingeteilt. Die inkrementellen Kosten für jede dieser Kategorien waren begrenzt, oft bekannt und nur in den extremsten Fällen gegeben. Es war relativ einfach, die Last vorherzusagen und zu bestimmen, welche Erzeugungsmuster sich ergeben würden und welche Kosten damit verbunden wären. Die intermittierende Erzeugung hat diese Situation drastisch verändert. Die Last kann steigen, während die intermittierende Erzeugung sinkt, oder umgekehrt. Die sich daraus ergebenden Änderungen der Grenzkosten können manchmal atemberaubend sein. Wenn die intermittierende Erzeugung zunimmt, sind die Kosten für das Stromsystem ein Problem mit einem dicken Ende auf Steroiden.

Übersetzt von Christian Freuer für das EIKE

Anmerkung des Übersetzers: Ich bin nicht sicher, ob der Terminus „Fat Tail“ im Original mit „dickes Ende“ korrekt übersetzt ist, wenn derselbe nicht im Original stehen gelassen worden ist. Gerne nehme ich bessere Vorschläge entgegen.