Der Irrweg der Dekarbonisierung: Warum der Kohleausstieg und die CO₂-Abgabe samt „Klimaschutzpolitik“ politisch wirkungslos und wirtschaftlich schädlich sind – und warum Kernenergie die Antwort ist

von Frank-Christian Hansel (AfD MdA Berlin) und Michael Limburg (Vizepräsident von EIKE)

Die deutsche Energie- und Klimapolitik wird seit Jahren von einem Dogma beherrscht: der vollständigen Dekarbonisierung der Wirtschaft, koste es, was es wolle. Der Kohleausstieg, der als Herzstück dieser Strategie gilt, wird dabei als moralisches Gebot und alternativloses Mittel im Kampf gegen den Klimawandel dargestellt. Doch ein genauerer Blick auf die Fakten entlarvt diese Politik als ineffektiv, teuer und in weiten Teilen von einer klima-apokalyptischen Ideologie getrieben, deren Nutzen für das globale Klima nicht nachweisbar ist. Statt wirksamen Klimaschutz zu erreichen, wird Deutschlands Energieversorgung geschwächt, die industrielle Wettbewerbsfähigkeit aufs Spiel gesetzt und der Wohlstand der Bürger gefährdet.

Das passiert bei dogmatischer, ideologischer Politik – Wohlstandsverluste und Niedergang.

Danke für Nichts! https://t.co/XZ2L281vv2 pic.twitter.com/PBCcZGp26u

— marc friedrich (@marcfriedrich7) February 20, 2025

Gleichzeitig verkennt Deutschland eine entscheidende Technik, die weltweit eine Renaissance erlebt: die Kernenergie. Modernste Reaktortechnologien, darunter Small Modular Reactors (SMRs), bieten die Möglichkeit einer sauberen, sicheren und zuverlässigen Energieversorgung, die sowohl wirtschaftlich sinnvoll als auch klimafreundlich ist.

Ein teures Nullsummenspiel: Der Kohleausstieg ohne jeden Klimaeffekt

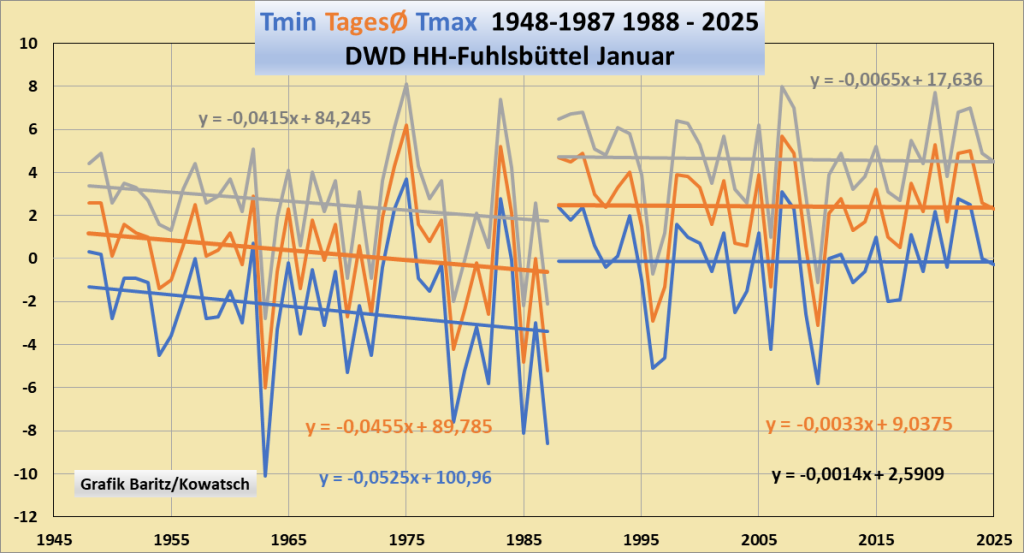

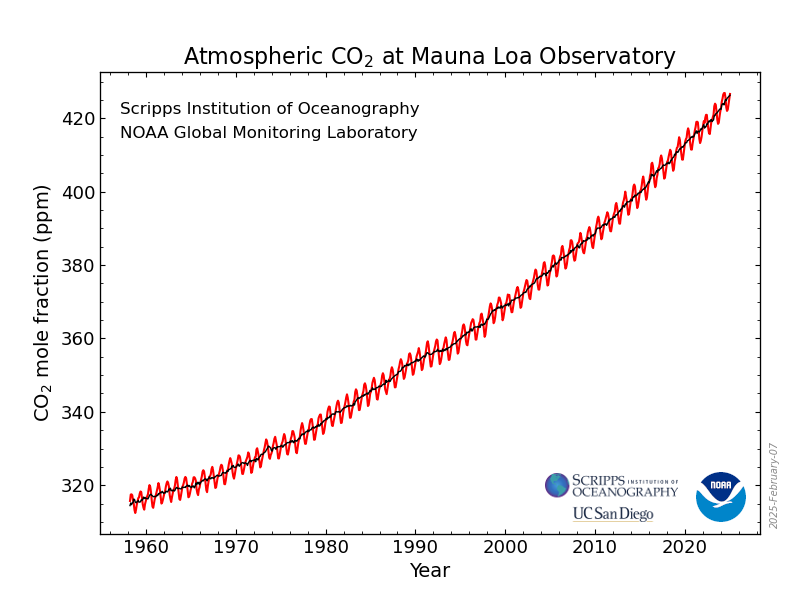

Aktuelle Daten und Antworten aus dem Bundeswirtschaftsministerium zeigen deutlich: Der Kohleausstieg in Deutschland verpufft in klimapolitischer Hinsicht komplett wirkungslos. Grund dafür ist nicht, dass die Bundesregierung es versäumt hat, die freiwerdenden Emissionszertifikate im EU-Emissionshandelssystem zu löschen. Sondern der Grund dafür ist, dass die Emissionen der EU, incl. Deutschlands keine Spur in der CO2 Konzentration hinterlassen, also nicht mal eine Delle in der Anstiegskurve, die ua. In Mauna Loa abrufbar ist, hinterlassen hat. Doch allein die Konzentration soll, folgt man dem IPCC, die sog. Gegenstrahlung erhöhen, die wiederum – wieder IPCC – für unser Klima, spontan verantwortlich sein soll. Das zeigte sich mehr als deutlich – bei dem Großexperiment während des Lockdown 2020- als 2,4 Gigatonnen weniger CO2 emittiert wurden als im Jahre davor und auch danach. Diese gewaltige Menge – welche der ökonomischen Stilllegung fast der gesamten EU entspricht, war komplett wirkungslos.

Doch trotzdem verbleiben diese Zertifikate, so wirkungslos und eminent schädlich sie sind, die eigentlich durch die Abschaltung von Kohlekraftwerken vom Markt genommen werden sollten, weiterhin verfügbar und können nun einfach von anderen Unternehmen in Europa genutzt werden. Eine weiterere wahnwitzige Folge ist: Während Deutschland Milliarden für die Stilllegung von Kohlekraftwerken ausgibt, werden an anderer Stelle in Europa Emissionen in gleicher Höhe ausgestoßen. Dieser gesamte Prozess gleicht einem Nullsummenspiel, bei dem sich auch die globale CO₂-Bilanz nicht verbessert, selbst wenn die, wie oben beschrieben, keinerlei Wirkung hat.

Besonders drastisch fällt die Kritik von FDP-Fraktionsvize Lukas Köhler aus: Er bezeichnet den Kohleausstieg als „energiepolitischen Irrweg“ und wirft der Bundesregierung vor, Milliarden an Steuergeldern für Entschädigungen verbrannt zu haben, ohne eine einzige zusätzliche Tonne CO₂ einzusparen. Eine solche Symbolpolitik mag moralisch inszeniert sein, doch sie bleibt nachweislich, auf das Klima bezogen, wirkungslos. Nun kann man unterstellen, dass der FDP Abgeordnete Köhler – ein studierter Philosoph – nicht so gut in der Klimawissenschaft zuhause ist, aber in seinem Kokon hat er recht. CO2 Einsparung, selbst unter Auflösung aller wirtschaftlichen Tätigkeiten – wie oben beschrieben- sind so oder so – völlig sinnlos. Sie katapultieren dieses Land nur zurück in die Armut des Mittelalters. Mehr nicht.

Milliardenschwere Symbolpolitik auf Kosten der Bürger

Die Zahlen sprechen für sich: Für den Kohleausstieg wurden allein 4,35 Milliarden Euro aus dem Klima- und Transformationsfonds für Entschädigungszahlungen an Kraftwerksbetreiber bereitgestellt. Zusätzlich werden bis 2038 Strukturhilfen in Höhe von 40 Milliarden Euro an betroffene Braunkohle-Regionen gezahlt. Diese gigantischen Summen fließen in ein Vorhaben, das – mangels wirksamer Löschung der Emissionszertifikate – keine realen Emissionsreduktionen auf EU-Ebene nach sich zieht.

Stattdessen steigen die Strompreise in Deutschland weiter, da die Versorgungslücke, die durch abgeschaltete Kohlekraftwerke entsteht, teuer durch Gasimporte oder volatilen erneuerbaren Strom gefüllt werden muss. Diese Preissteigerungen treffen nicht nur Privathaushalte, sondern schwächen auch die Wettbewerbsfähigkeit der deutschen Industrie. Stromintensive Unternehmen drohen ins Ausland abzuwandern, während die Bevölkerung mit höheren Energiekosten belastet wird.

Ein rationaler Ansatz hätte stattdessen darin bestehen können, diesen Weg endlich aufzugeben und wieder auf den Pfad von günstiger Energie mit Kern- oder Kohle, Öl und Gas zurückzukehren, wie es derzeit die USA unter Donald Trump vormachen und wie es alle anderen Länder, unabhängig von ihren Lippenbekenntnissen, auch machen. Doch ideologische Verbohrtheit steht einem pragmatischen Kurs im Weg.

Dekarbonisierung als Ausdruck einer klima-apokalyptischen Ideologie

Die deutsche Klimapolitik wird von einer Erzählung dominiert, die den Klimawandel als unmittelbar bevorstehende Apokalypse inszeniert. Diese Rhetorik erzeugt politischen und gesellschaftlichen Druck, radikale Maßnahmen wie die vollständige Dekarbonisierung der Wirtschaft um jeden Preis umzusetzen. Die Realität ist jedoch viel einfacher.

Deutschland trägt weniger als 2 % zu den globalen CO₂-Emissionen bei. Selbst eine vollständige Dekarbonisierung der deutschen Wirtschaft hätte – wie oben beschrieben – überhaupt keinen Einfluss auf den weltweiten Klimaverlauf. Weder so, noch so. Länder wie China, Indien und die USA bestimmen mit ihren merkwürdigen (Nicht-)Emissionsstrategien den globalen Trend. Dennoch verfolgt Deutschland einen Sonderweg, der mehr an eine moralische Selbstinszenierung erinnert als an eine rationale Politik.

Diese Ideologie blendet zudem aus, dass der Klimawandel zwar vielleicht eine Herausforderung darstellt, die nicht durch Anpassung behoben werden könnte aber erst dann wenn der Fall eintritt. Er ist nicht das existenzielle Weltuntergangsszenario, als das er von Klimaaktivisten dargestellt wird. Technischer Fortschritt, Anpassungsstrategien und eine globale Perspektive sind zielführender als blinder Aktionismus.

CO₂-Abgabe abschaffen – als Vorstufe zur Beendigung einer irrwitzigen „Klimaschutzpolitik“

Ein weiteres zentrales Instrument der aktuellen Klimapolitik, das ebenso wie gesamte „Klimarettungsspolitik“ – dringend abgeschafft gehört, ist die CO₂-Abgabe. Diese Abgabe verteuert Energie künstlich, belastet Haushalte mit steigenden Kosten für Strom, Wärme und Mobilität und stellt eine zusätzliche Belastung für Unternehmen dar. Auch hier bleibt die klimapolitische Wirkung fragwürdig: Wenn Emissionen im Rahmen des europäischen Emissionshandelssystems ohnehin gedeckelt sind, führt eine nationale CO₂-Abgabe lediglich zu einer Umverteilung der Kosten, und das nicht mal zu zusätzlichen Emissionsreduktionen.

Die Abschaffung der CO₂-Abgabe wäre daher ein erster sinnvoller Schritt, um den wirtschaftlichen Schaden der deutschen Klimapolitik erstmal zu begrenzen, bevor man sie Schritt für Schritt komplett abschafft. Statt auf zusätzliche Steuern und Abgaben zu setzen, sollte sich Deutschland auf marktwirtschaftliche Mechanismen konzentrieren.

Fazit: Zeit für einen Kurswechsel – Mit Kernenergie in die Zukunft

Der Kohleausstieg, wie er derzeit in Deutschland praktiziert wird, ist ein Beispiel für kostspielige Symbolpolitik, die keinen globalen Klimaeffekt hat. Milliarden Euro an Steuergeldern werden für Maßnahmen ausgegeben, deren Wirksamkeit nicht nachweisbar ist. Der Verzicht auf Kohle wird mit einer instabilen Energieversorgung, steigenden Strompreisen und sinkender industrieller Wettbewerbsfähigkeit bezahlt.

Die zugrunde liegende Dekarbonisierungsstrategie entpuppt sich als von klima-apokalyptischer Ideologie getrieben, die rationalen, marktwirtschaftlichen Lösungen im Weg steht. Es ist Zeit für einen fundamentalen Kurswechsel:

- Abschaffung der CO₂-Abgabe, um Wirtschaft und Bürger zu entlasten, als erster Schritt, die gesamte „Klimaschutzpolitk“ zu verwerfen.

- Stärkung marktwirtschaftlicher Mechanismen wie des EU-Emissionshandels.

- Abkehr von ideologisch motivierten Maßnahmen, die nur hohe Kosten verursachen, aber nichts am „Weltklima“ ändern können.

Revitalisierung der Kernenergie: Der entscheidende Hebel für Versorgungssicherheit und Klimaschutz

Ein echter Kurswechsel muss jedoch mehr umfassen: Deutschland muss die Kernenergie revitalisieren. Während hierzulande ideologische Vorbehalte weiterhin den Einsatz dieser sauberen, sicheren und zuverlässigen Energiequelle blockieren, zeichnet sich international längst ein neuer Trend ab.

Internationale Beispiele für die Renaissance der Kernenergie

- USA: Die USA investieren massiv in die Entwicklung von Small Modular Reactors (SMRs). Unternehmen wie NuScale Power und TerraPower (mit Unterstützung von Bill Gates) arbeiten an Reaktoren, die kleiner, günstiger und schneller einsetzbar sind. Die US-Regierung sieht SMRs als Schlüsseltechnologie für die Dekarbonisierung des Energiesektors.

- Kanada: Kanada verfolgt eine SMR-Roadmap, um bis 2030 die ersten SMRs in Betrieb zu nehmen. Diese sollen nicht nur Strom liefern, sondern auch abgelegene Regionen und Industriebetriebe zuverlässig versorgen.

- Großbritannien: Das Vereinigte Königreich setzt mit dem Rolls-Royce SMR-Projekt auf den Bau von modularen Reaktoren, um bis 2050 klimaneutral zu werden und gleichzeitig die Abhängigkeit von Energieimporten zu verringern.

- China: China baut derzeit sowohl konventionelle Kernkraftwerke als auch neue SMR-Modelle und sieht in der Kernenergie einen wesentlichen Bestandteil seiner Strategie zur Reduzierung der Kohlenutzung.

- Osteuropa: Länder wie Polen, Rumänien und Tschechien planen ebenfalls SMR-Projekte, um ihre Energieversorgung zu dekarbonisieren, ohne dabei auf Kohle oder Gas angewiesen zu sein.

Small Modular Reactors (SMRs): Die Zukunft der Kernenergie

SMRs stehen für eine neue Generation von Kernreaktoren, die dezentral, modular und mobil-stationär einsetzbar sind. Sie unterscheiden sich in mehreren wesentlichen Punkten von traditionellen Großreaktoren:

- Höchste Sicherheitsstandards: Viele SMR-Designs besitzen inhärente Sicherheitsmechanismen, die eine Kernschmelze physikalisch unmöglich machen.

- Dezentrale Energieversorgung: SMRs können direkt an Industrieanlagen, entlegenen Regionen oder urbanen Zentren installiert werden, ohne große Stromübertragungsnetze zu benötigen.

- Flexible Einsatzmöglichkeiten: Durch ihre kompakte Größe eignen sich SMRs für industrielle Wärmeversorgung, Wasserstoffproduktion und Entsalzung, was sie vielseitig einsetzbar macht.

- Schnelle Bauzeiten und Skalierbarkeit: Im Vergleich zu Großkraftwerken können SMRs serienmäßig hergestellt und in kürzerer Zeit in Betrieb genommen werden.

Schlussfolgerung: Pragmatismus statt Ideologie – Mit Kernenergie zu Wohlstand und ohne „Klimaschutz“

Deutschland braucht keine teuren Alleingänge, sondern eine pragmatische, wirtschaftsfreundliche Klimapolitik, die Wohlstand, Versorgungssicherheit und technologischen Fortschritt miteinander in Einklang bringt. Dazu gehört:

- Abschaffung der CO₂-Abgabe, um Verbraucher und Unternehmen zu entlasten als erster Schritt, die gesamte „Klimaschutzpolitk“ zu verwerfen.

- Marktwirtschaftliche Mechanismen wie der EU-Emissionshandel statt planwirtschaftlicher Eingriffe.

- Revitalisierung der Kernenergie – insbesondere durch den Einsatz von Small Modular Reactors (SMRs), die weltweit als Schlüsselelement einer nachhaltigen Energiezukunft anerkannt sind.

Deutschland darf den internationalen Anschluss nicht verlieren. Während andere Nationen auf Kernenergie der neuesten Generation setzen, um die Herausforderungen von Klimaschutz, Versorgungssicherheit und Wettbewerbsfähigkeit gleichzeitig zu lösen, hält Deutschland an einer ideologisch motivierten Dekarbonisierungspolitik fest, die nutzlos und teuer und aber komplett wirkungslos bleibt.

Die Zeit ist reif für einen Kurswechsel, der nicht auf klima-apokalyptische Narrative, sondern auf Technik, Innovation und wirtschaftliche Vernunft setzt. Mit der Kernenergie – insbesondere durch den Einsatz moderner SMRs – kann Deutschland eine klimafreundliche, sichere und wettbewerbsfähige Energiezukunft gestalten. Je nach Preis und Kosten bleiben Öl, Gas und Kohle sinnvolle andere Energieträger.

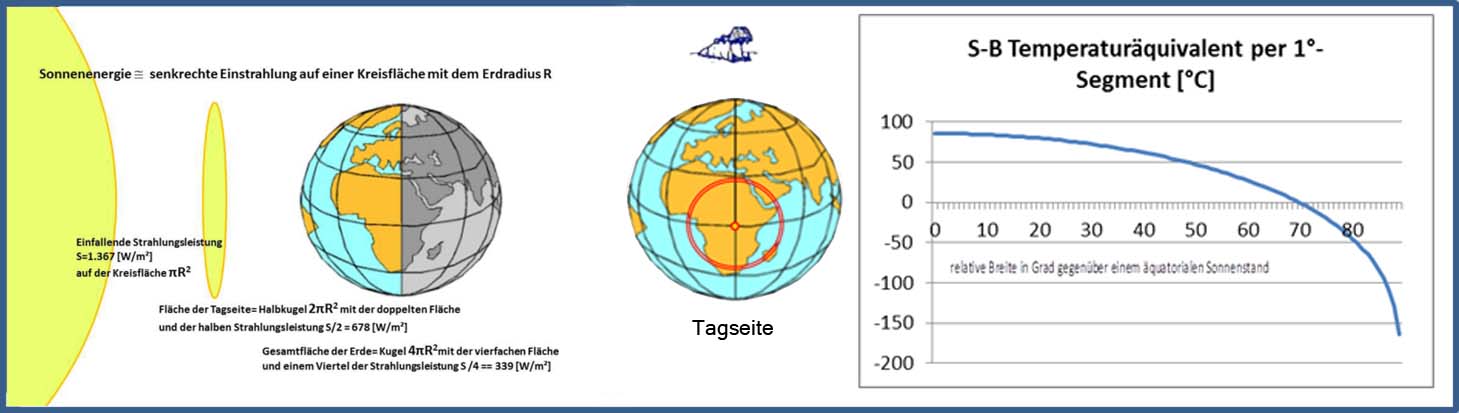

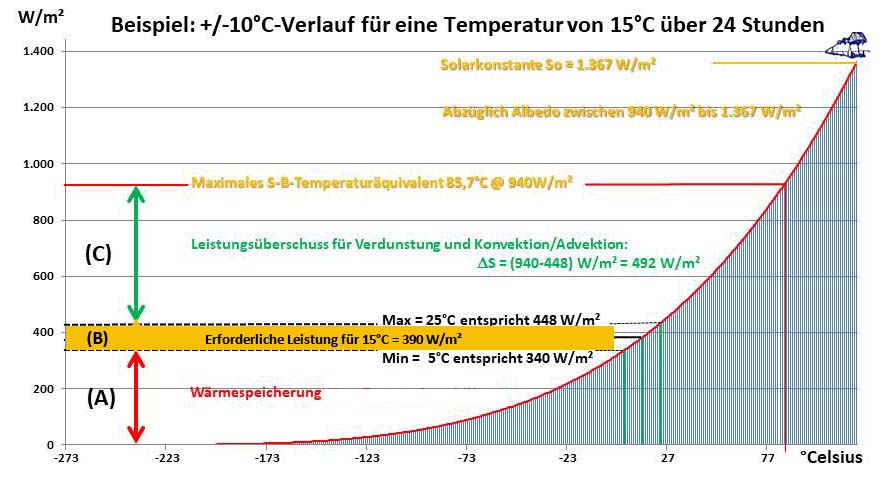

BEWEIS: Die Berechnungen für die Tagseite unserer Erde beruhen auf dem S-B-Temperaturäquivalent aus einer ortsgetreuen S-B-Inversion der hemisphärisch eingestrahlten spezifischen Strahlungsleistung der Sonne für die jeweiligen individuellen Ortslagen.

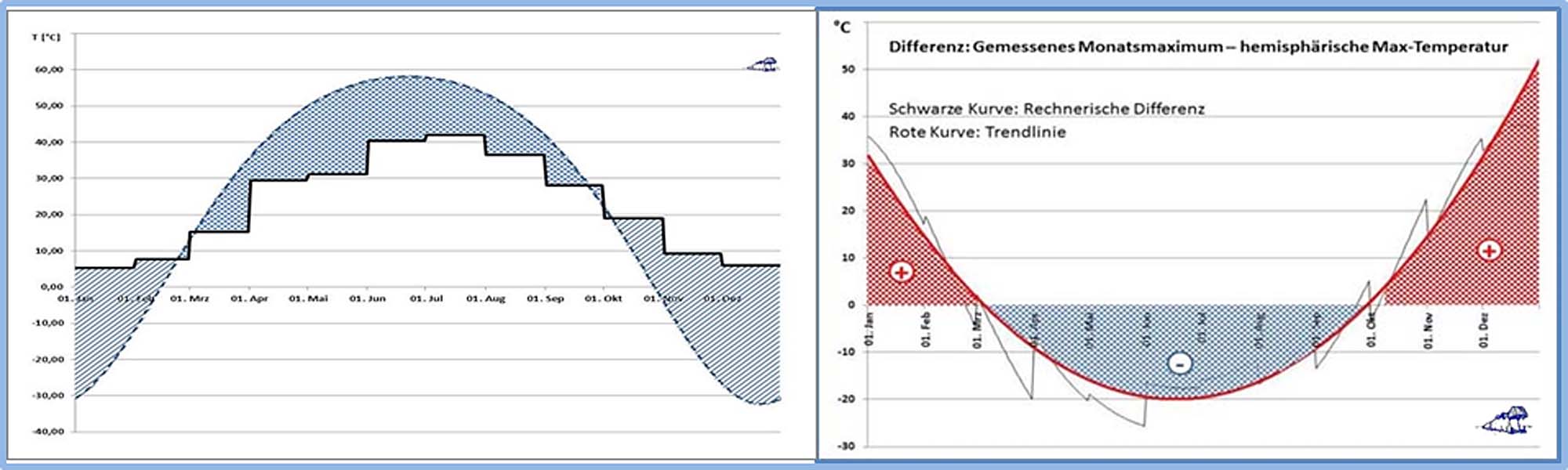

BEWEIS: Die Berechnungen für die Tagseite unserer Erde beruhen auf dem S-B-Temperaturäquivalent aus einer ortsgetreuen S-B-Inversion der hemisphärisch eingestrahlten spezifischen Strahlungsleistung der Sonne für die jeweiligen individuellen Ortslagen. Wie weiter oben bereits ausgeführt wurde, wird das maximale S-B-Temperaturäquivalent auf unserer Erde aufgrund von Konvektion und Verdunstung in der Realität niemals erreicht; umgekehrt wird aber der nächtliche Temperaturabfall durch Kondensation und Advektion abgemildert. Letzteres gilt übrigens auch für das Strahlungsdefizit in mittleren und höheren Breiten der jeweiligen Winterhemisphäre, dazu nachfolgend das Beispiel für Potsdam:

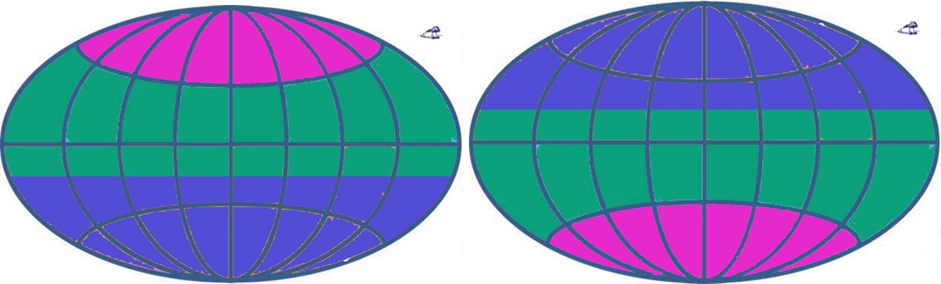

Wie weiter oben bereits ausgeführt wurde, wird das maximale S-B-Temperaturäquivalent auf unserer Erde aufgrund von Konvektion und Verdunstung in der Realität niemals erreicht; umgekehrt wird aber der nächtliche Temperaturabfall durch Kondensation und Advektion abgemildert. Letzteres gilt übrigens auch für das Strahlungsdefizit in mittleren und höheren Breiten der jeweiligen Winterhemisphäre, dazu nachfolgend das Beispiel für Potsdam: BEWEIS: Hier bei uns in Deutschland schwankt die solare LEISTUNG zwischen etwa 90% der Solarkonstanten am Sommerpunkt (21.06.) und etwa 30% am Winterpunkt (21.12.). An den Polen unserer Erde geht es noch extremer zu, dort schwankt die Sonnenscheindauer als Indikator für die solare ARBEIT (=Leistung x Zeit) zwischen 0 Stunden (Wintersonnenwende am Pol der Winterhemisphäre) und 24 Stunden (Sommersonnenwende am Pol der Sommerhemisphäre), was das hemisphärische Konvektionsmodell tatsächlich abzubilden vermag:

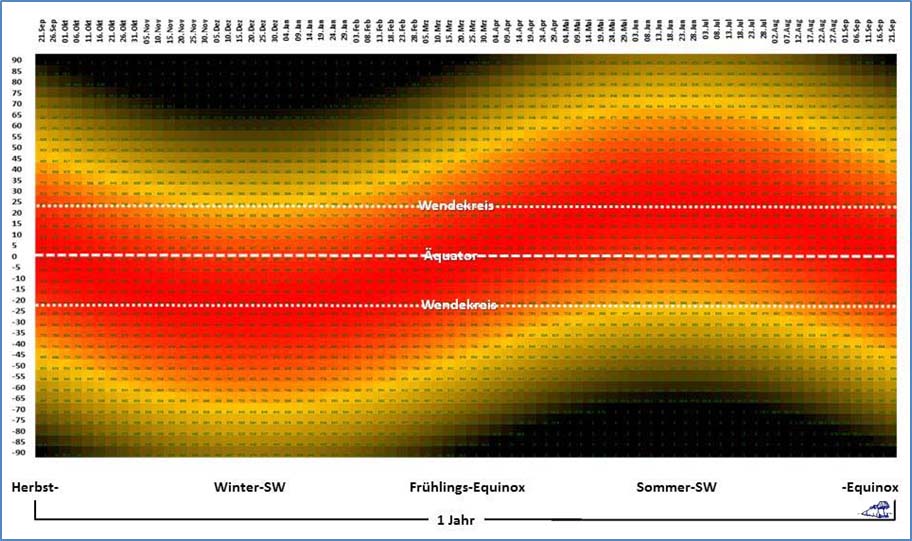

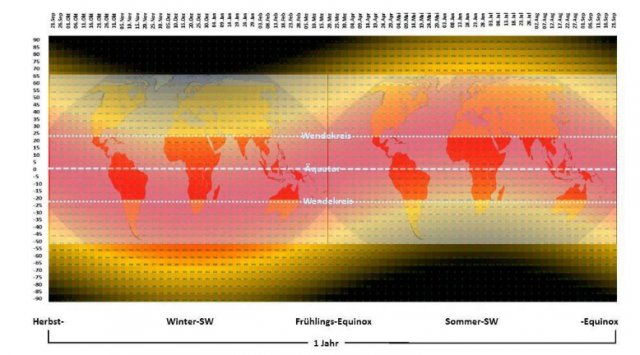

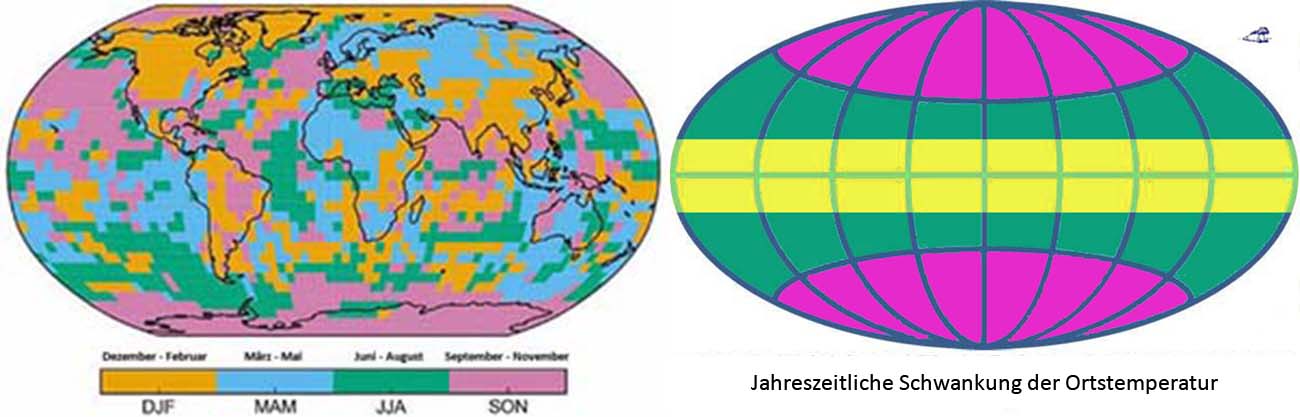

BEWEIS: Hier bei uns in Deutschland schwankt die solare LEISTUNG zwischen etwa 90% der Solarkonstanten am Sommerpunkt (21.06.) und etwa 30% am Winterpunkt (21.12.). An den Polen unserer Erde geht es noch extremer zu, dort schwankt die Sonnenscheindauer als Indikator für die solare ARBEIT (=Leistung x Zeit) zwischen 0 Stunden (Wintersonnenwende am Pol der Winterhemisphäre) und 24 Stunden (Sommersonnenwende am Pol der Sommerhemisphäre), was das hemisphärische Konvektionsmodell tatsächlich abzubilden vermag: Das konventionelle Faktor4-THE-Modell vermag diese Schwankungen nicht abzubilden, im Gegenteil, es wirft grundsätzlich dieselbe „natürliche theoretische Globaltemperatur“ für alle Ortslagen auf unserer Erde aus, selbst für die Polkappen und die Wüstengebiete in niederen geografischen Breiten. Da aber das hemisphärische Konvektionsmodell den jahreszeitlichen solaren Zenitwinkel berücksichtigt, kann es sogar die Beleuchtungsklimazonen unserer Erde abbilden:

Das konventionelle Faktor4-THE-Modell vermag diese Schwankungen nicht abzubilden, im Gegenteil, es wirft grundsätzlich dieselbe „natürliche theoretische Globaltemperatur“ für alle Ortslagen auf unserer Erde aus, selbst für die Polkappen und die Wüstengebiete in niederen geografischen Breiten. Da aber das hemisphärische Konvektionsmodell den jahreszeitlichen solaren Zenitwinkel berücksichtigt, kann es sogar die Beleuchtungsklimazonen unserer Erde abbilden:

Abbildung 6: Vergleich zwischen der IPCC-Darstellung einer maximalen anthropogenen Klimaeinwirkung und der maximalen jahreszeitlichen Veränderung der Ortstemperatur

Abbildung 6: Vergleich zwischen der IPCC-Darstellung einer maximalen anthropogenen Klimaeinwirkung und der maximalen jahreszeitlichen Veränderung der Ortstemperatur Sowohl die Temperatur auf der Tagseite der Erde als auch die Temperatur auf deren Nachseite setzen nun auf der Temperatur der globalen Wärmespeicher auf, die im Wesentlichen von der Durchschnittstemperatur der Ozeane (ca. 20°C) bestimmt wird. Wasser ist der hauptsächliche Träger dieser Energie, sei es in flüssiger Form in den Ozeanen oder gasförmig in der Atmosphäre. Die örtliche Nachttemperatur der kontinentalen Landflächen wird also letztendlich über die Umgebungstemperatur ziehender Tiefdruckgebiete oder lokaler Land- Seewind Systeme bestimmt und gehorcht damit der Umgebungsgleichung des Stefan-Boltzmann-Gesetzes. Je weiter nun eine Örtlichkeit vom Meer entfernt liegt und umso weniger Wasserdampf die örtliche Atmosphäre enthält, umso größer sind dort die Temperaturschwankungen zwischen Tag und Nacht. Die kontinentalen Wüstengebiete unserer Erde sind dafür ein ganz hervorragendes Beispiel. Seit jeher haben die Ozeane mit einem Zeitverzug von Jahrhunderten jede globale Klimaänderung „mitgemacht“ und gleichzeitig die jeweiligen individuellen Ortstemperaturen (oder meinetwegen auch eine sogenannte „globale Durchschnittstemperatur“) auf der Nachthemisphäre nach unten abgesichert:

Sowohl die Temperatur auf der Tagseite der Erde als auch die Temperatur auf deren Nachseite setzen nun auf der Temperatur der globalen Wärmespeicher auf, die im Wesentlichen von der Durchschnittstemperatur der Ozeane (ca. 20°C) bestimmt wird. Wasser ist der hauptsächliche Träger dieser Energie, sei es in flüssiger Form in den Ozeanen oder gasförmig in der Atmosphäre. Die örtliche Nachttemperatur der kontinentalen Landflächen wird also letztendlich über die Umgebungstemperatur ziehender Tiefdruckgebiete oder lokaler Land- Seewind Systeme bestimmt und gehorcht damit der Umgebungsgleichung des Stefan-Boltzmann-Gesetzes. Je weiter nun eine Örtlichkeit vom Meer entfernt liegt und umso weniger Wasserdampf die örtliche Atmosphäre enthält, umso größer sind dort die Temperaturschwankungen zwischen Tag und Nacht. Die kontinentalen Wüstengebiete unserer Erde sind dafür ein ganz hervorragendes Beispiel. Seit jeher haben die Ozeane mit einem Zeitverzug von Jahrhunderten jede globale Klimaänderung „mitgemacht“ und gleichzeitig die jeweiligen individuellen Ortstemperaturen (oder meinetwegen auch eine sogenannte „globale Durchschnittstemperatur“) auf der Nachthemisphäre nach unten abgesichert: