Milankovitch-Zyklen und Baumring-Proxys: Der Hockeyschläger im IPCC AR 6

Stephen McIntyre

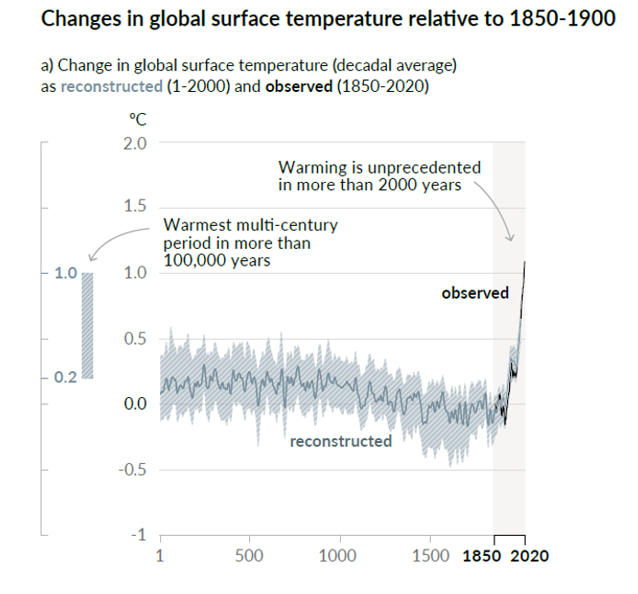

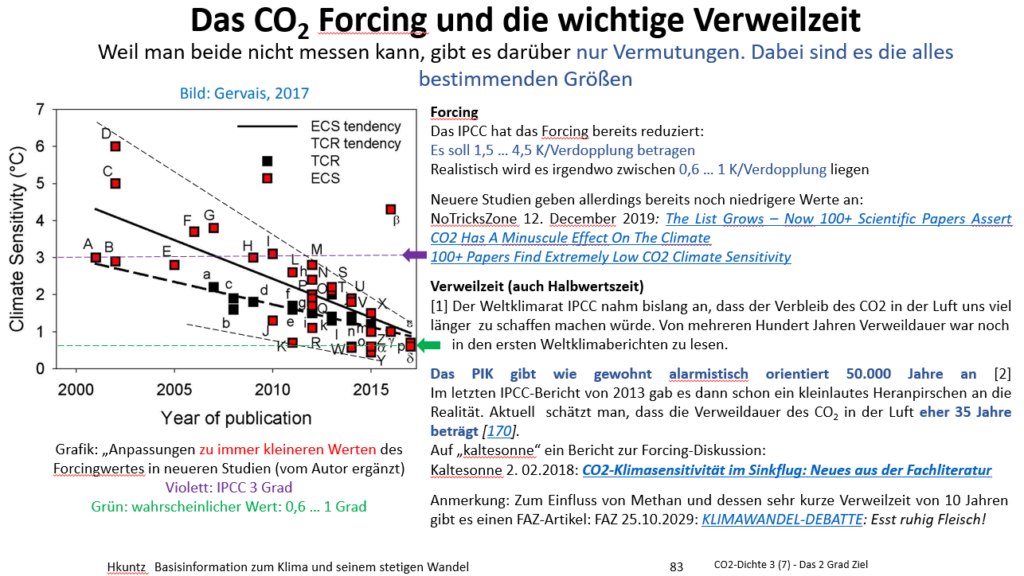

Obwohl Klimawissenschaftler immer wieder behaupten, dass Fehler in ihren „Hockeyschläger“-Proxy-Rekonstruktionen keine Rolle spielen – dass es keine Rolle spielt, ob sie Daten auf dem Kopf stehend verwenden; dass es keine Rolle spielt, ob sie einzelne Reihen auswählen, je nachdem, ob sie im 20, Jahrhundert ansteigen; dass es keine Rolle spielt, wenn sie Reihen verwerfen, die nicht in die „richtige“ Richtung gehen („hide the decline“); dass es keine Rolle spielt, ob sie kontaminierte Daten oder beschädigte Kiefernzapfen verwendet haben; dass solche Fehler keine Rolle spielen, weil der Hockeystick selbst keine Rolle spielt – der IPCC bleibt süchtig nach Hockeyschlägern: Und siehe da, Abbildung 1a der neu aufgelegten Summary for Policymakers enthält – was sonst – ein Hockeystick-Diagramm. Wenn Sie Michael Manns Hockeystick schon für schlecht hielten, dann stellen Sie sich einen neu aufgelegten Hockeystick von neu aufgelegten Klimawissenschaftlern vor. Wie die Klimawissenschaftler sagen, ist es noch schlimmer, als wir dachten.

Seltsamerweise erscheint dieses führende Diagramm der Zusammenfassung der politischen Entscheidungsträger nicht im Bericht selbst. (Zumindest konnte ich es in Kapitel 2 nicht finden.) Es ist jedoch eindeutig das Ergebnis von PAGES2K Consortium (Nature 2019) und Kaufman et al (2020), die ich beide kurz auf Twitter kommentiert habe (siehe hier).

Es ist schwer zu sagen, wo man anfangen soll.

Der Gedanke/dieDefinition eines Temperatur-„Proxy“ ist, dass er eine Art lineare oder nahezu lineare Beziehung zur Temperatur hat, wobei die Fehler weißes Rauschen oder rotes Rauschen niedriger Ordnung sind. Mit anderen Worten: Wenn man sich eine Reihe von tatsächlichen Temperatur-„Proxies“ ansieht, würde man erwarten, dass die Reihen ziemlich ähnlich und konsistent aussehen.

Aber das ist nicht das, was man bei den vom IPCC verwendeten Daten sieht. Im IPCC-Bericht oder sogar in den zitierten Artikeln würde man das nie erfahren, denn die Autoren dieser Temperatur-Rekonstruktionen der letzten ein oder zwei Jahrtausende vermeiden es peinlich genau, die zugrunde liegenden Daten darzustellen. Für mit der Materie nicht vertraute Leser ist es schwer, die extreme Widersprüchlichkeit der zugrundeliegenden „Proxy“-Daten angesichts der vorgetäuschten Präzision des IPCC-Diagramms vollständig zu erfassen.

Viele der in diesem Beitrag besprochenen Reihen, einschließlich fast aller HS-förmigen Reihen, wurden bereits in Blogbeiträgen von Climate Audit (tag/pages2k) von vor 2, 5, 10 oder sogar 15 Jahren oder in Tweets von 2019 und 2020 (siehe hier) besprochen.

Die PAGES2019 ist keine „zufällige“ Auswahl von Proxies, sondern wurde anhand von Ex-post-Kriterien ausgewählt. Wie Rosanne d’Arrigo vor vielen Jahren vor dem NAS-Gremium erklärte: Wenn man Kirschkuchen machen will, muss man zuerst Kirschen pflücken.

Der PAGES2019-Datensatz besteht aus 257 Proxys, die aus dem vorherigen PAGES2017-Datensatz mit 692 Proxys ausgewählt wurden, der zuvor aus Tausenden von Proxyserien ausgewählt worden war, die von vielen Autoren im Laufe der Jahre gesammelt worden waren.

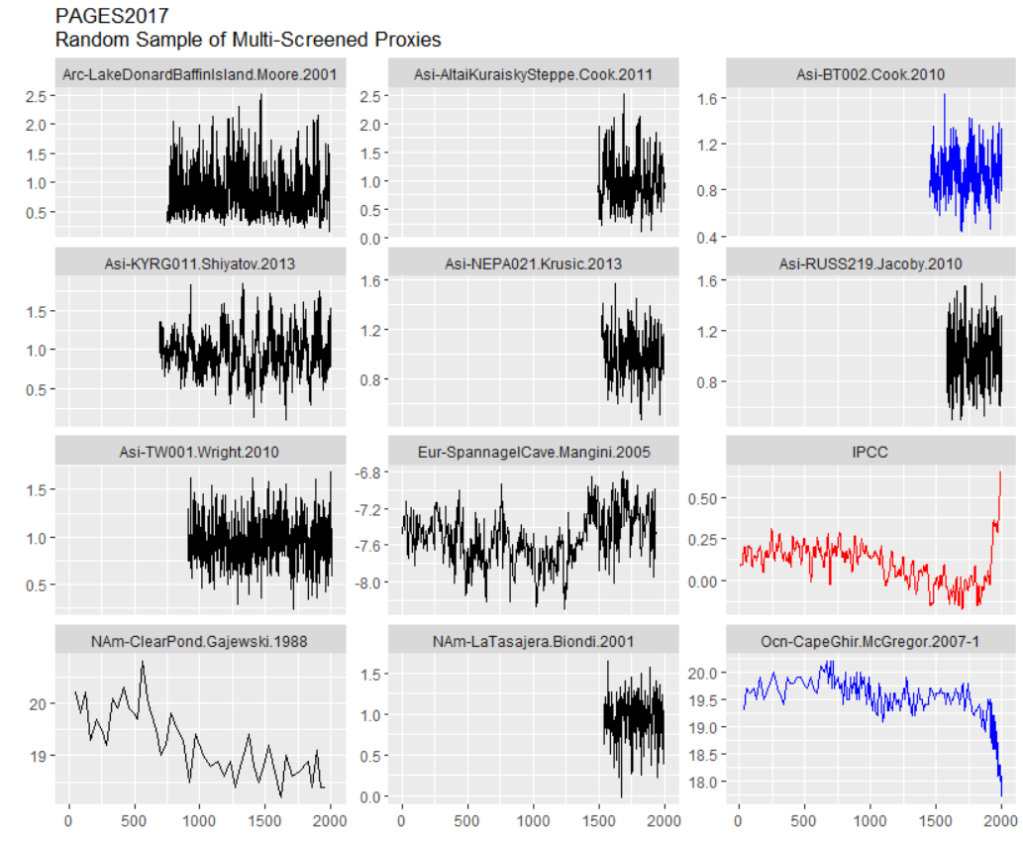

Um den Lesern einen Überblick über die zugrundeliegenden Daten – und nicht über das massierte Endprodukt – zu geben, habe ich drei Chargen von jeweils 11 zufällig ausgewählten Reihen aus PAGES2017, PAGES2019 und dann PAGES2019 nordamerikanischen Baumringen aufgezeichnet und dann jede Charge kommentiert. (Die Stichproben wurden mit der R-Formel sample(1:K, 11) ausgewählt, wobei K die Größe des Datensatzes ist, aus dem eine Stichprobe gezogen wird.) In jedem Fall gab es in der Regel Serien, die ich bereits untersucht hatte, sowie zahlreiche nicht beschreibbare Serien, die bemerkenswert und wichtig sind, weil die meisten Proxies nicht beschreibbar sind und man dies sehen muss, um sie zu verstehen.

Dieser Beitrag wird noch einige Tage in Arbeit sein, da ich einige Abschnitte zu speziellen Themen habe, die ich versuchen werde, nach und nach hinzuzufügen, wenn ich Zeit habe.

Eine erste Reihe: PAGES2017 Proxies

Zur ersten Veranschaulichung sehen Sie unten eine Stichprobe von 11 PAGES2017-Reihen. Die auf PAGES2019 übertragenen Reihen sind in blau dargestellt. Als Referenz ist die IPCC-Kurve in rot dargestellt. Wie Sie unschwer erkennen können, sind die meisten der Reihen unscheinbar und kurz. Nur eine Reihe in dieser Stichprobe (Cape Ghir temperature alkenones) hat die Form eines Hockeyschlägers, aber sie geht nach unten:

Die oben gezeigte Kap-Ghir-Reihe ist in Grad Celsius angegeben, hat aber ein offensichtliches Problem: Sie geht nach unten. (Siehe frühere Climate Audit-Diskussion der Cape Ghir-Alkenonreihe hier). Und dies ist kein Fall, in dem die rohe Proxy-Messung eine umgekehrte Beziehung zur Temperatur hat (z. B. Korallen-Sr oder Korallen-d18O), sondern ein Fall, in dem die Temperaturschätzung aus dem Proxy nach unten geht. Alkenone sind ein sehr einzigartiger Näherungswert, da es allgemein anerkannte Formeln für die direkte Umrechnung von Alkenon-Messungen in Grad Celsius gibt. Alkenone werden häufig zur Schätzung der Ozeantemperatur in der Tiefsee verwendet und liefern konsistente Schätzungen für Millionen von Jahren. Dies ist etwas völlig anderes als bei Baumringmessungen, bei denen die Ringbreiten zunächst an das Alter und den Standort angepasst werden müssen, bevor versucht wird, eine lokale Ad-hoc-Formel zu entwickeln, um die lokale Temperatur anhand einer Art Durchschnitt der Ringbreiten zu schätzen.

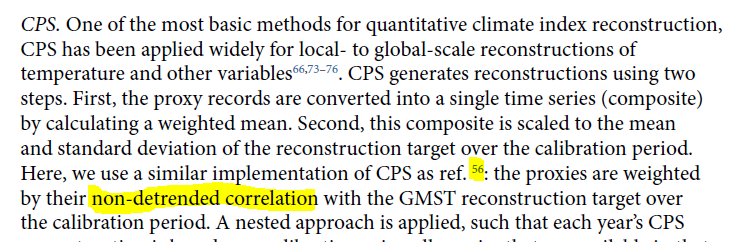

Warum genau die lokalen Temperaturen am Kap Ghir (vor der Küste Marokkos) gesunken sind, ist ein Rätsel. Anstatt dieses Rätsel zu lösen, stellen Neukom und Co. die Reihen einfach auf den Kopf und folgen damit dem Beispiel von Upside Down* Mann, indem sie die Reihen nach ihrer Korrelation mit der instrumentellen Zieltemperatur ausrichten, sogar in ihrer „CPS“-Rekonstruktion – eine Technik, die normalerweise resistent gegen opportunistisches Umdrehen von Proxies ist, um die HS-Nähe einer endgültigen Rekonstruktion zu verbessern.

[*upside down = verkehrt herum, auf dem Kopf stehend]

Beachten Sie, was Neukom et al. mit ihrer „CPS“-Methode gemacht haben:

CPS ist (meines Wissens nach) in allen früheren Rekonstruktionen ein Mittelwert aus skalierten Daten, der ex ante an bekannten Eigenschaften des Proxys orientiert wurde. Das heißt, es wird nicht einfach eine Alkenon-Temperaturschätzung umkippen lassen, weil sie in die falsche Richtung geht. Aber diese heilsame Eigenschaft wird in Neukoms verfälschter Implementierung von CPS nicht beibehalten – eine Verfälschung, der die Gutachter eigentlich hätten widerstehen müssen. PAGES2K erstellte Temperaturrekonstruktionen mit sieben verschiedenen Methoden, die alle zu ähnlichen Ergebnissen wie CPS führten – was stark darauf hindeutet, dass diese anderen Methoden auch Serien wie Cape Ghir verfälschen.

Eine zweite Reihe: PAGES2019-Proxies

Hier ist eine zweite Zufallsstichprobe von Proxies, dieses Mal alle aus der zusätzlich überprüften PAGES2019-Untergruppe. Werfen Sie einen Blick darauf, Kommentare unten.

Es ist nicht so, dass PAGES2K ein Kompositum aus 257 Serien erstellt hat, die zwei Jahrtausende lang sind und alle oder die Mehrheit eine HS-Form haben. Eine Reihe in dieser Stichprobe sieht dem IPCC-Stick sehr ähnlich und wird weiter unten ausführlich diskutiert, aber die anderen sehen ganz anders aus.

Vier der Reihen in der Stichprobe sind sehr kurz – drei von ihnen sind sogar kürzer als die instrumentelle Aufzeichnung. Dabei handelt es sich um Korallen-Sr- oder Korallen-d18O-Reihen, die 25 % des PAGES2019-Datensatzes ausmachen. Die oben dargestellten extrem kurzen Aufzeichnungen sind typisch, ja fast universell für diese Klasse von Proxy-Daten. Sie weisen einen ausgeprägten Trend in der instrumentellen Periode auf. Dies steht im Gegensatz zu dem fehlenden Trend, den man bei den beiden langen Proxies in der mittleren Spalte oben sieht – einer Baumringreihe von Mt Read, Tasmanien (auch in MBH98 verwendet) und einer Eiskernreihe von Fisher aus dem Jahr 1983 von der Devon Ice Cap auf der Baffininsel (auch verfügbar für Multiproxy-Studien der 1990er Jahre).

Die kurzen Korallenserien liefern keine Informationen zu den mittelalterlichen und früheren Perioden, die man mit der modernen Periode zu vergleichen versucht. Was ist also ihre Funktion? Tragen sie etwas anderes bei, als den unscheinbaren längeren Serien einen Schnurrbart aufzusetzen?

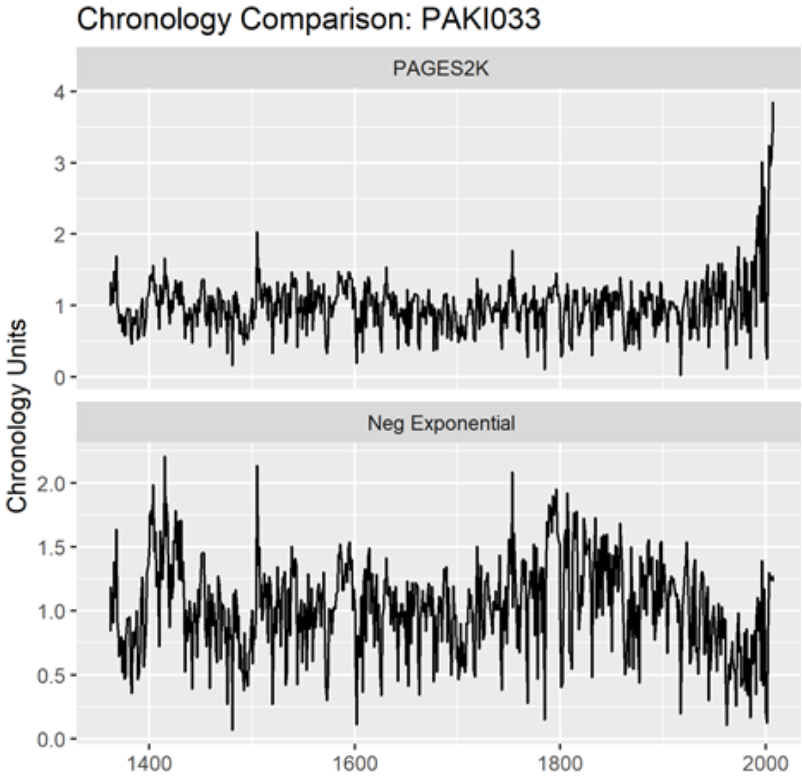

Die Baumringreihen in dieser Stichprobe sind eher kurz; die Screening-Verfahren haben eher konzentrierte Reihen mit leichten Anstiegen. (Die Streifenrinden-Borstenzapfen-Chronologien, die im Hockeystick von Mann et al. so prominent waren, werden in PAGES2019 weiterhin verwendet – wie unten besprochen). Ich habe die Serie in der linken Spalte mit dem großen Anstieg (Asi_MUSPIG aka paki033) in einem Tweet-Thread 2019 hier diskutiert. Ich habe die zugrundeliegenden Ringbreitenmessungen bei der NOAA ausfindig gemacht und die Baumring-„Chronologie“ mit der Standardmethodik neu berechnet – siehe unten. Die hochfrequenten Details stimmen überein, was zeigt, dass die zugrunde liegenden Messdaten äquivalent sind. Die Chronologie der Originalautoren ist bei der NOAA nicht archiviert: Wie ist es PAGES2K also gelungen, einen solchen Hockeyschläger zu erhalten? Ich habe keine Ahnung.

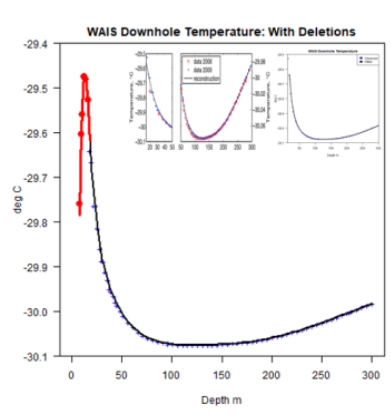

Die „interessanteste“ Reihe in dieser Stichprobe ist die Bohrlochtemperatur-Rekonstruktion, die der späteren IPCC-Rekonstruktion so unheimlich ähnlich ist. Zufälligerweise (oder auch nicht) habe ich über diese Bohrlochtemperatur-Rekonstruktion (von WAIS Divide, Antarktis) im Februar 2019 geschrieben, ein paar Monate vor der Veröffentlichung von PAGES 2019 – siehe hier; scrollen Sie nach unten – für eine ausführlichere Analyse.

Ich habe in mehreren Beiträgen über die Mathematik der Bohrloch-Inversions-Berechnungen geschrieben, die vorgeben, die Temperaturen für Tausende von Jahren in der Vergangenheit anhand der heute im Bohrloch gemessenen Temperaturen zu schätzen. Diese Berechnungen erfordern die Inversion einer multi-kollinearen Matrix (mit einer Determinante nahe 0). Meiner Meinung nach sind fast alle Details, über die Fachleute schwadronieren, eine Art Chladni-Muster-Artefakt.

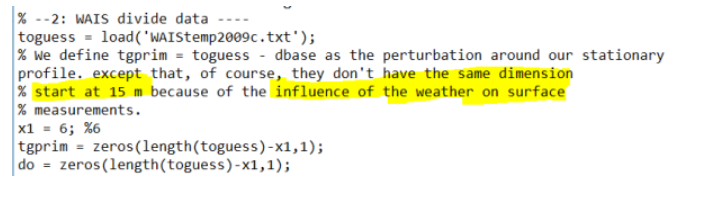

Aber das ist eine andere Geschichte. Hier war das Problem viel seltsamer. Einige Jahre zuvor war es mir (auf Umwegen) gelungen, eine Kopie des Codes zu erhalten, der zur Berechnung dieser Bohrlochinversion verwendet wurde (die nirgendwo archiviert ist). Der Code zeigte, dass die obersten 15 Meter des Bohrkerns aus der Berechnung gestrichen worden waren.

[Hervorhebung im Original]

Ich hatte ERHEBLICHE Schwierigkeiten, die zugrundeliegenden Bohrlochtemperaturen für einige berühmte Reihen zu bekommen. (Das NAS-Panel von 2006 zitierte ein solches Ergebnis, aber der ursprüngliche Autor {ein Mitarbeiter der US-Regierung} weigerte sich, die Daten zur Verfügung zu stellen, und meines Wissens sind sie nach wie vor nicht verfügbar). In diesem Fall waren die zugrunde liegenden und archivierten Bohrlochtemperaturen nebst deren Werten gelöscht worden. Unnötig zu erwähnen, dass sie verloren gegangen sind. Eine Inversion unter Verwendung aller Daten hätte nicht zu dem beeindruckenden Hockeystick im PAGES2019-Datensatz geführt, sondern zu einem erheblichen Rückgang in jüngster Zeit.

Na super, ein weiteres Beispiel für „hide the decline“.

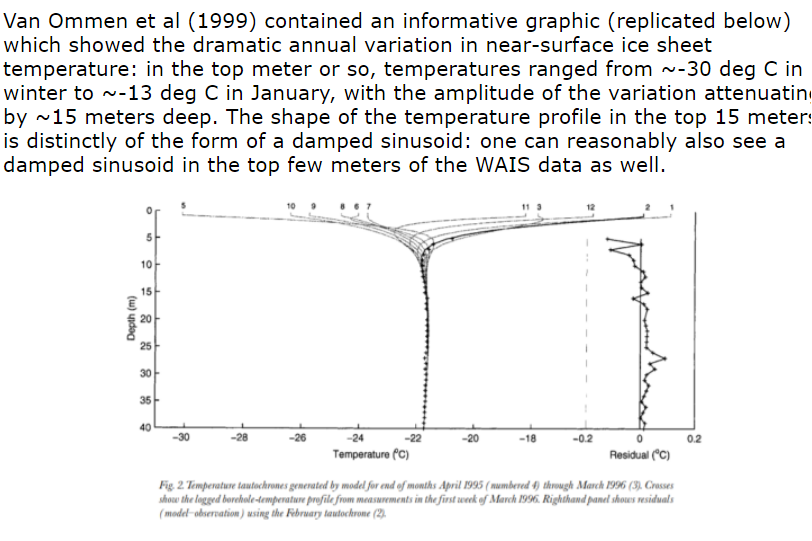

Fairerweise muss man sagen, dass es, wie ich in einem früheren Beitrag feststellte, im oberen Teil des antarktischen Eisschildes dramatische jahreszeitliche Temperaturschwankungen gibt, die das ohnehin schon schwierige (und wahrscheinlich unlösbare) Problem der Inversion noch unlösbarer machen. In meinem Beitrag vom Februar 2019 habe ich ein Diagramm von van Ommen et al. (1999) gezeigt, das die dramatischen Veränderungen der Temperatur im Bohrloch im Laufe der Jahreszeiten darstellt: Es lässt sich eine Art gedämpftes Sinusmuster erkennen. In den obersten 15 Metern des Bohrkerns dominieren die saisonalen Veränderungen.

Beachten Sie, dass die Klinge auf dem Hockeyschläger in dieser IPCC-Reihe vollständig von der Wahl von 15 Metern als Grenzwert für die Bohrlochinversion abhängt. Bei einer Wahl von 20 Metern wäre die Klinge wahrscheinlich gänzlich verschwunden.

Die Tatsache, dass der oberste Teil des Bohrkerns wegen saisonaler Effekte ausgeschlossen werden muss, führt zu einer seltsamen Ironie: Die Schichten in 15 Metern Tiefe bei WAIS stammen aus den 1960er Jahren. Das IPCC hat sich also auf eine Reihe von Daten gestützt, die vorgeben, die Temperatur bis 2007 zu rekonstruieren, ohne jedoch die Eiskerne aus der Zeit zwischen 1965 und 2007 zu verwenden. Die Berechnung erfolgt ausschließlich anhand von Eiskernschichten aus der Zeit vor den 1960er Jahren. Hält das jemand für zuverlässig? Ich nicht.

Darüber hinaus ergibt die Rekonstruktion der WAIS-Divide-Bohrlochtemperatur ein völlig anderes Ergebnis als die weithin replizierten und gut verstandenen d18O-Isotopenreihen.

In Anbetracht der Fragen und Mängel im Zusammenhang mit der WAIS-Bohrlochinversionsreihe ist es absurd, dass diese Reihe (noch dazu eine Singleton-Reihe) in einem politikrelevanten Dokument verwendet werden soll. Die Tatsache, dass das endgültige IPCC-Diagramm dieser Müllreihe so ähnlich ist, wirft die Frage auf, was unter der Haube der multivariaten Berechnungen vor sich geht.

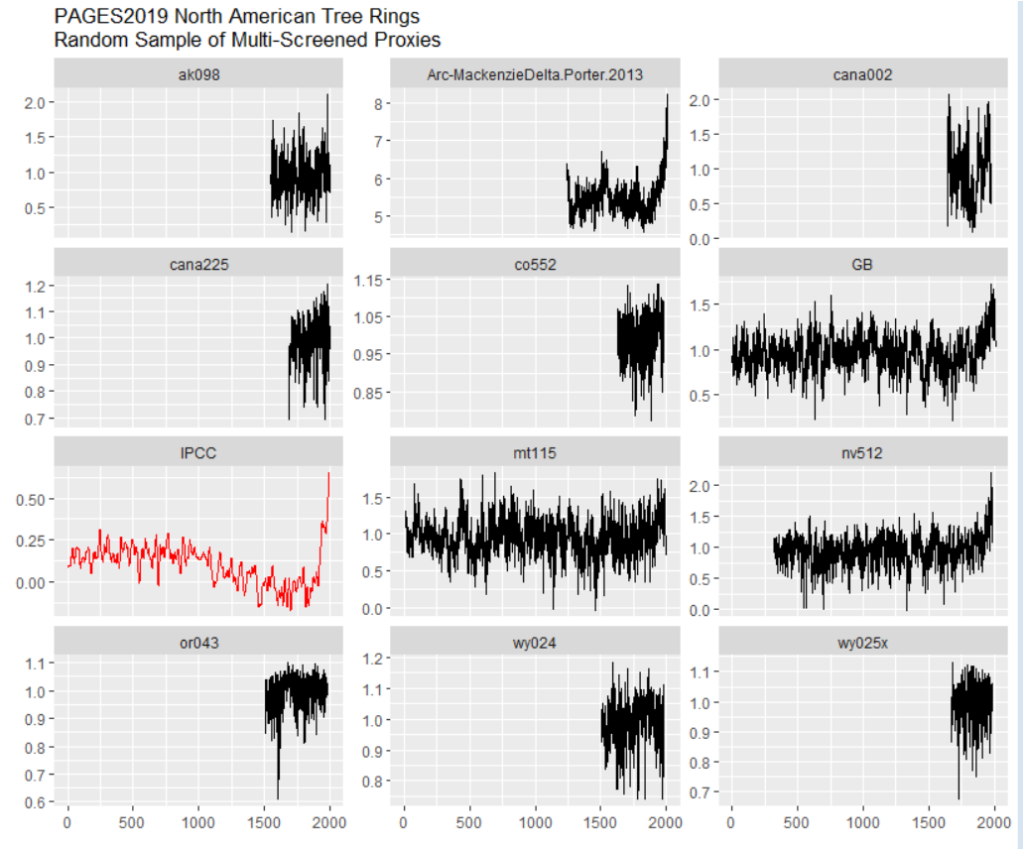

Eine dritte Reihe: PAGES2019 Nordamerikanische Baumringe

Nordamerikanische Baumringe (einschließlich einiger arktischer Serien) machen ~25% der PAGES2019 Proxies aus. Hier eine zufällige Auswahl:

Die meisten sind kurz und eher unscheinbar – nicht wie das endgültige IPCC-Diagramm.

Es gibt eine Reihe mit einem riesigen Hockeyschläger: Mackenzie Delta (Porter 2013); und zwei Reihen („GB [Great Basin]“ und nv512) mit auffälligen Schlussanstiegen. Aufmerksame Leser haben vielleicht schon etwas von dieser Geschichte mitbekommen.

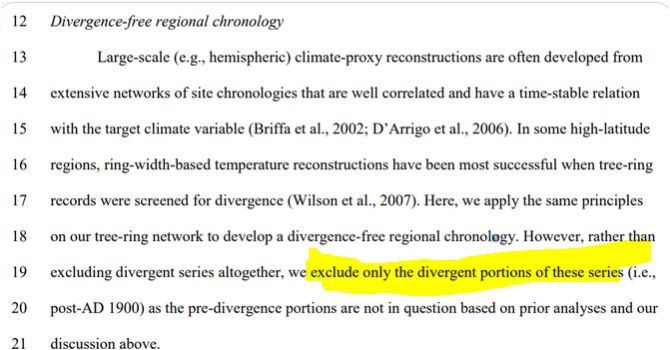

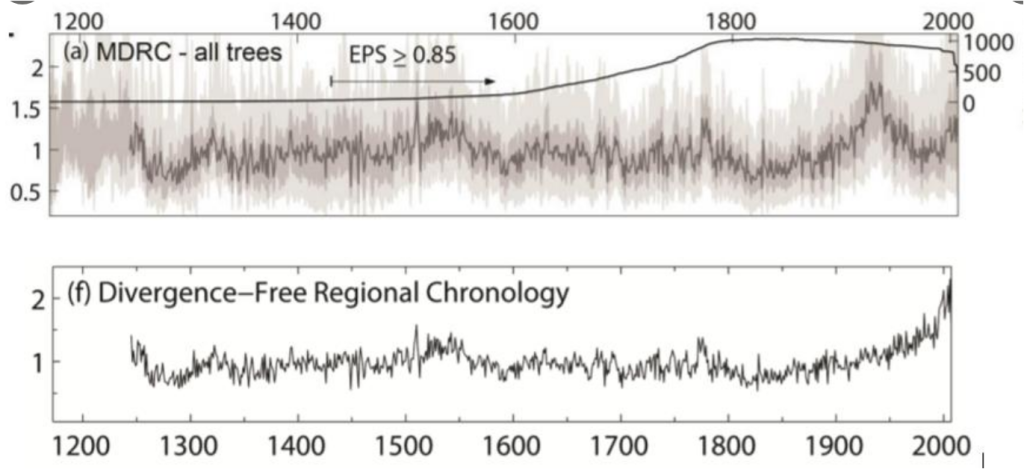

Ich habe den Mackenzie Delta Super-Stick von Porter et al. (2013), einen Neuzugang in der Hockeystick-Fertigungstechnik, im Juli 2019 hier auf Twitter besprochen. Er stammt aus dem kanadischen Yukon, einem Gebiet, das in einer Studie von d’Arrigo et al. aus dem Jahr 2004 als typischer Ort für das klassische „Divergenzproblem“ galt – die Ringbreiten nehmen ab, während die Temperaturen steigen. Wie ist es Porter et al. also gelungen, einen Super-Stick zu finden, der Jacoby und d’Arrigo entgangen war, die seit langem nach Hockeyschlägern in Baumringdaten suchen und sich nicht scheuen, Kirschen zu pflücken, um Kirschkuchen zu backen?

Sie trieben „hide the decline“ auf eine Weise auf die Spitze, die von früheren Praktikern dieser dunklen Kunst nie in Erwägung gezogen worden war. Anstatt den Rückgang im Endprodukt zu verbergen, taten sie dies für einzelne Bäume: Wie in dem zugrundeliegenden Artikel erläutert, schlossen sie die „abweichenden Sequenzen“ einzelner Bäume aus, die die Frechheit besaßen, in den letzten Jahren ein rückläufiges Wachstum aufzuweisen. Selbst Briffa hätte niemals solch radikale Maßnahmen in Erwägung gezogen.

Fairerweise muss man sagen, dass der ursprüngliche Artikel von Porter et al. sowohl die tatsächliche (nicht beschreibende) Chronologie aller Bäume als auch den Superstick zeigte, der sich aus „hide the decline“ bei einzelnen Bäumen ergab: Die Entscheidung, den falschen Superstick zu verwenden, liegt bei Neukom und PAGES2019.

Stripbark Bristlecone Chronologien

Wie oben erwähnt, werden sich aufmerksame Leser an die Kennung nv512 erinnern. Es handelt sich dabei um eine der klassischen Graybill Stripbark Bristlecone–Chronologien (Pearl Peak), von der wir beobachtet hatten, dass sie sowohl die MBH98 PC1 als auch die endgültige MBH98 Rekonstruktion dominiert. Sie (und andere wichtige Stripbark-Standorte) wurden in McIntyre und McKitrick (2005 GRL) Tabelle 1 aufgeführt:

Die Leser werden sich auch daran erinnern, dass das NAS-Gremium 2006 empfohlen hat, „Stripbark“-Chronologien bei Temperaturrekonstruktionen zu „vermeiden“. Obwohl die Klimagemeinschaft erklärt hat, die Empfehlungen des NAS-Gremiums umzusetzen, sind sie süchtig nach Stripbark-Chronologien, deren Eigenschaften gut bekannt sind. Fünf verschiedene PAGES2019-Serien verwenden Stripbark-Bristlecones (drei davon aus den ursprünglichen Graybill-Versionen): nv512 (Pearl Peak); nv513 (Mount Washington); ca529 (Timber Gap Upper); SFP (eine Aktualisierung der San Francisco Peaks, die az510 einbezieht) und GB (ein Verbund aus Pearl Peak, Mount Washington und Sheep Mountain, der sowohl Graybill- als auch aktualisierte Informationen verwendet).

2018 habe ich untersucht, wie sich die nordamerikanischen Baumringnetzwerke seit MBH98 verändert haben. Die einzige Konstante war die Abhängigkeit der Paläoklimatologen von Stripbark-Chronologien – ein Phänomen, das ich schon lange vor Climategate kommentiert hatte (unter Berufung auf Clapton et al. und Paeffgen et al.), sehr zum Ärger von Dendros, aber der Kommentar bleibt heute genauso wahr wie damals.

…

Conclusion

Viele dieser Probleme habe ich bereits im Juli 2019 erörtert, nur wenige Tage nach der Veröffentlichung des zugrunde liegenden Artikels (siehe hier). Ich erwarte zwar nicht unbedingt, dass die Rezensenten des IPCC meinen Twitter-Feed aufmerksam verfolgen, aber man kann sicherlich davon ausgehen, dass die Klimawissenschaftler des IPCC, die sich hauptberuflich mit diesen Themen befassen, kompetent genug sind, um Dinge zu bemerken, die ich an meinem ersten Tag, an dem ich mir PAGES2019 ansah, beobachten konnte. Aber ihre Blindheit ist immer wieder erstaunlich.

Link: https://climateaudit.org/2021/08/11/the-ipcc-ar6-hockeystick/

Übersetzt von Christian Freuer für das EIKE