Die Falschmesser vom Deutschen WetterDienst oder, wie der DWD die Deutschlandtemperatur um +1,4°C zu hoch angibt – Teil 1

„We own the science and we think that the world should know it.„ UN Under-Secretary General for Global Communications Melissa Fleming beim WEF im Oktober 2023

Teil 1: Das heutige Messnetz des DWD ist für Vergleiche zu Temperaturen vor der Jahrtausendwende unbrauchbar, da dieses nichts mehr mit dem von vor 2000 zu tun hat. Weder in der Messdatenerfassung, noch in der Struktur (Messstandorte).

Von Raimund Leistenschneider, Matthias Baritz, Josef Kowatsch

¹ Zum Bild oben: Die Autoren weisen ausdrücklich daraufhin, wenn sie vom DWD schreiben, dann meinen sie nicht die vielen dortigen Meteorologen und Wissenschaftler, die jeden Tag akribisch ihrer Tätigkeit nachgehen, um verwertbare Ergebnisse zu liefern, sondern die dortige Führungsmannschaft, die nicht müde wird, sich und damit ihre Behörde und natürlich den Bundesverkehrsminister – der DWD ist eine Behörde im Bundesverkehrsministerium – mit unsoliden und unwissenschaftlichen Aussagen lächerlich zu machen, siehe hier oder hier.

Kurzer Rückblick:

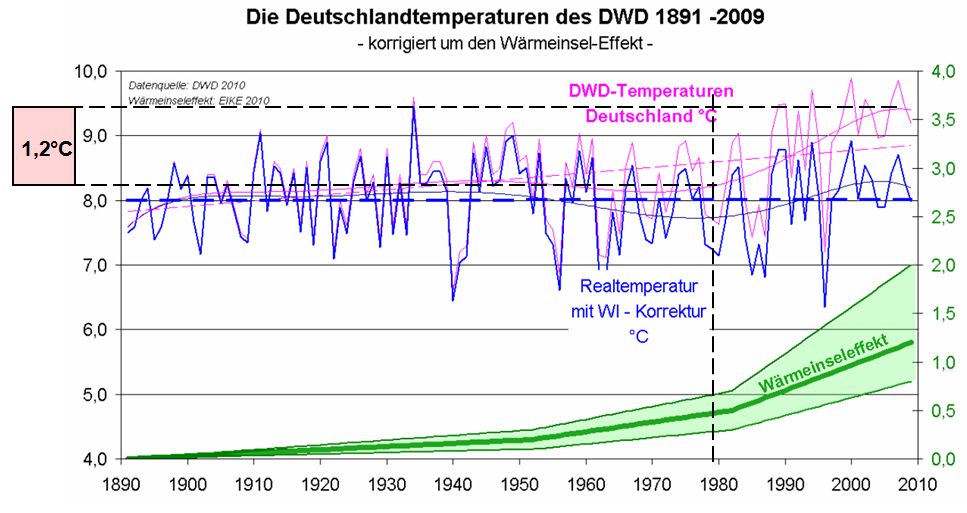

Werte Leser, in 2010 hatte Leistenschneider herausgefunden, dass die vom DWD herausgegebenen mittleren Jahrestemperaturen für Deutschland (um die geht es in diesem Bericht) um +0,9°C bis +1,2°C zu hoch sind (Abb.2).

Abb.2 zeigt den Fehler bei den Deutschlandtemperaturen, die Leistenschneider in 2010 ermittelt hatte: „Klimaerwärmung in Deutschland nicht nachweisbar: Der DWD hantiert mit falschen Daten – Eine Bestandsaufnahme der Deutschlandtemperaturen“

Abb.2 zeigt den unmittelbaren Vergleich der Deutschlandtemperaturen DWD und der WI-bereinigten von 1891 – 2009. Die blau gestrichelte Linie zeigt den Temperaturmittelwert im Betrachtungszeitraum. Die Temperaturen in Deutschland durchbrechen die Mittellinie nach unten, was bedeutet, dass 2010 kälter als im 120-Jahresvergleich ist. Zum berechneten WI wurde, wie dies beim IPCC üblich ist, der Fehlertoleranzbereich angegeben (grüner Bereich). Soviel zum damaligen Text.

Die obigen Untersuchungen basieren im Wesentlichen auf den Strahlungsgesetzen nach Planck – ob die anschließende mathematische Betrachtung richtig ist² – und den Steigungsvergleichen der DWD-Deutschlandjahrestemperaturen zu der DWD-Referenzstation Hohenpeißenberg.

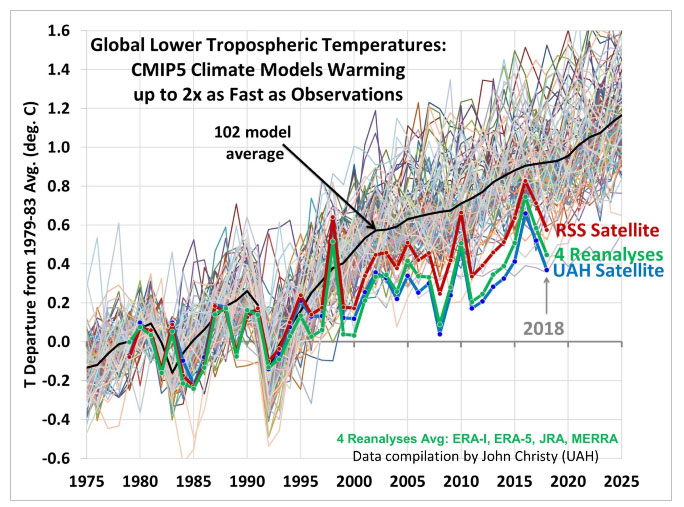

² Mathematisch lässt sich vieles berechnen (siehe z.B. Klimaprojektionen des IPCC). Jedoch allein die Physik entscheidet, ob eine Berechnung sinnvoll ist oder ob nicht (Abb.3).

Abb.3, Quelle: Roy W. Spencer, Ph. D. zeigt hier die tatsächlich gemessene Globaltemperatur im Vergleich zum Mittel der Klimaprojektionen (schwarz) und den einzelnen (berechneten) Klimavorhersagen von 1979 bis 2018. Die Realität hat mit den berechneten Szenarien nichts zu tun. Solche Berechnungen sind nicht das Papier wert, auf denen sie gedruckt sind!

Ein schönes Beispiel, dass alles berechnet werden kann, ganz gleich, welcher Unsinn dabei heraus kommt. Zurück zu unserem Thema:

Die Theorie besagt, dass sich in einer Erwärmungsphase, in der sich die Erde seit etwa 1980 befindet, kalte Gebiete schneller erwärmen als warme. Eine Aussage, die übrigens auch das IPCC sagt. Indes hat dies rein gar nichts mit einem angeblichen menschengemachten Klimawandel zu tun, sondern basiert auf einem physikalischen Basisgesetz.

Um einen gleichen Körper von 10°C auf 20°C zu erwärmen und von 100°C auf 110°C, ist stets dieselbe Energiemenge nötig. „Aber“, um einen Körper zu erwärmen, muss man diesen zuerst auf seiner Temperatur halten. Nennen wir diese „Halteenergie“. Denn das System Erde befindet sich in einer kalten Umgebung (Weltall) und gibt ständig Energie an diese Umgebung ab.

Nun verliert nach Planck ein identischer wärmerer Körper, in gleichen Zeiteinheiten, mehr Energie, als ein kälterer Körper. Seine Halteenergie ist also höher. Da die Erde nur eine Energie erhält, erwärmen sich kältere Gebiete (z.B. Polregionen) schneller als wärmere. Es erfolgt somit ein Angleich der Temperaturen – Temperaturunterschied wird geringer.

Werden nun die Temperaturen der zu untersuchenden Objekte in Relation gesetzt, so muss in einer Erwärmungsphase ein (leichter) und stetiger Angleich der Temperaturen erfolgen. Sind Sprünge zu verzeichnen, ist dies auf Unregelmäßigkeiten der Temperaturerfassung/Messnetzes zurück zu führen. Anhand anschließender Steigungsvergleiche lässt sich der Fehler berechnen, der in Abb.2 zu sehen ist.

Zu „Sprünge“ der Fachmann, Prof. Malberg, FU, Met Inst.:

„Die Verlagerung von Klimastationen an neue Standorte führt in der Regel zu sprunghaften Änderungen der Klimawerte. Wird die neue Station nicht auf bisherige Messreihe (oder umgekehrt) mittels vieljähriger Parallelbeobachtungen reduziert, so kann der Bruch so groß sein, dass die Klimareihe für die Analyse des langfristigen Klimawandels unbrauchbar wird.“

Doch wie kommt es zu den Sprüngen in den Vergleichen der Deutschlandtemperaturen zu denen der Referenzstation Hohenpeißenberg?

Das Messnetz des DWD ist heute ein gänzlich anderes als noch vor 100 Jahren oder mehr ist. Nur 5% seines heutigen Messnetzes stimmen mit dem vor 120 Jahren dem Namen nach überein. Betrachtet man dazu die Stationsverlagerungen in diesen verbliebenen 5%, geht die Vergleichbarkeit gegen 0%, denn diese wurden in den Orten an wärmere Stellen verlegt, siehe hier.

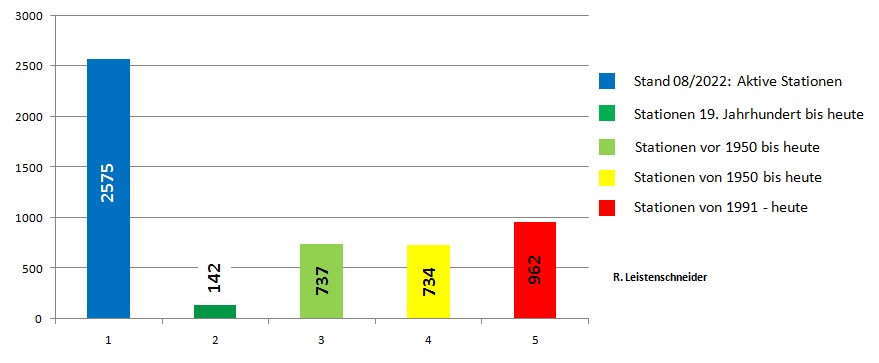

Bereits Abb.4 zeigt, dass so gut wie nichts mehr beim DWD-Messnetz mit dem von früher identisch ist, was Abb.5 verdeutlicht.

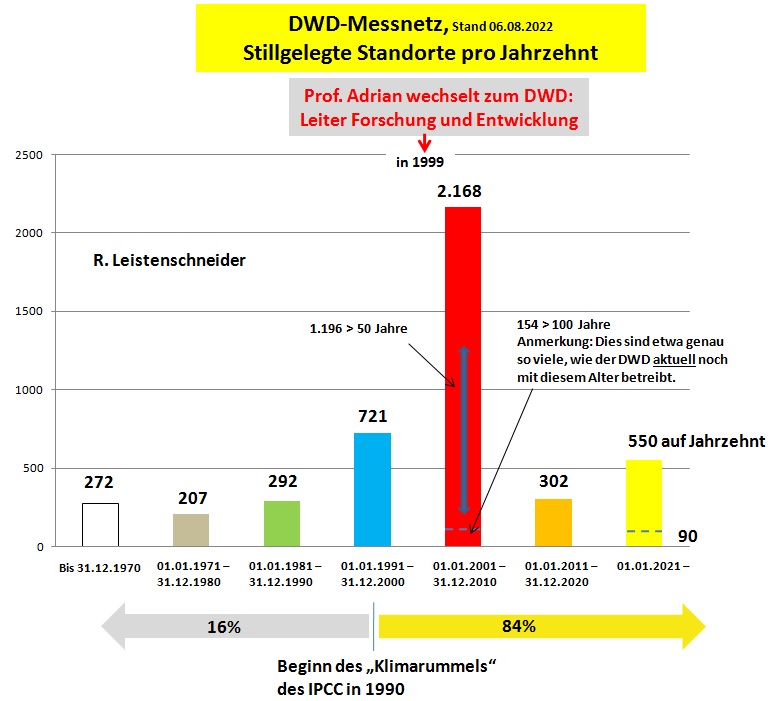

Abb.5, Quelle R. Leistenschneider, nach Daten des DWD, zeigt alle vom DWD, nach dessen eigenen Angaben, bis 2022 (Stand 08/2022) stillgelegten Messstandorte, aufgeschlüsselt nach Dekaden. Die aktuelle Dekade zeigt bis 08/2022 bereits 90 Stilllegungen. Hochgerechnet auf das Jahrzehnt, sind dies, bei gleichbleibender Stilllegungsfreude des DWD = 550 Messstandorte.

Ist schon sehr auffällig, dass der DWD mit Beginn der Klimaaktivtäten weltweit in dem IPCC (1990 = First Assessment Report) damit beginnt, sein bisheriges Messnetz stillzulegen und durch neue Standorte zu ersetzen.

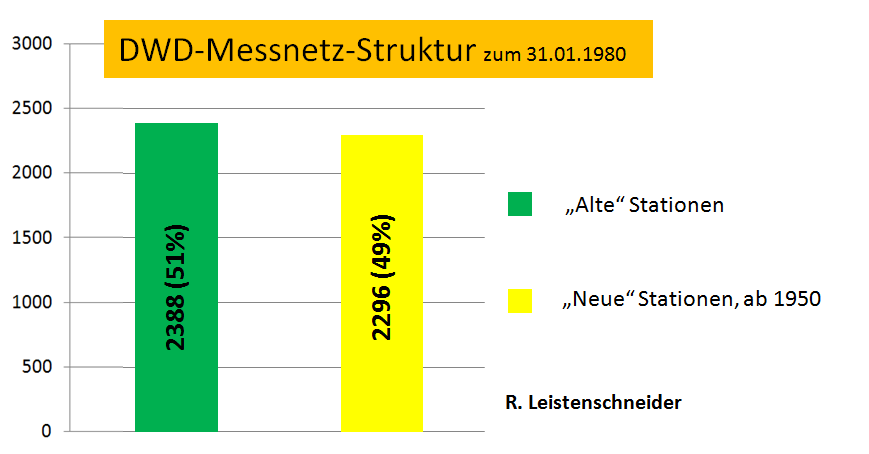

Dass sämtliche Vergleiche des DWD zu den Deutschlandtemperaturen unbrauchbar sind, zeigt weiter dessen Struktur (Abb.6 und Abb.7), die stimmen müsste, sollen Vergleiche korrekt sein.

Abb.6, Quelle R. Leistenschneider, nach Daten des DWD, zeigt die weitgehend ausgeglichene Struktur des DWD-Messnetzes vor der Klimahype. In seinem Messnetz hat er etwa die gleiche Anzahl von „alten“, wie von „neuen“ Messstandorten.

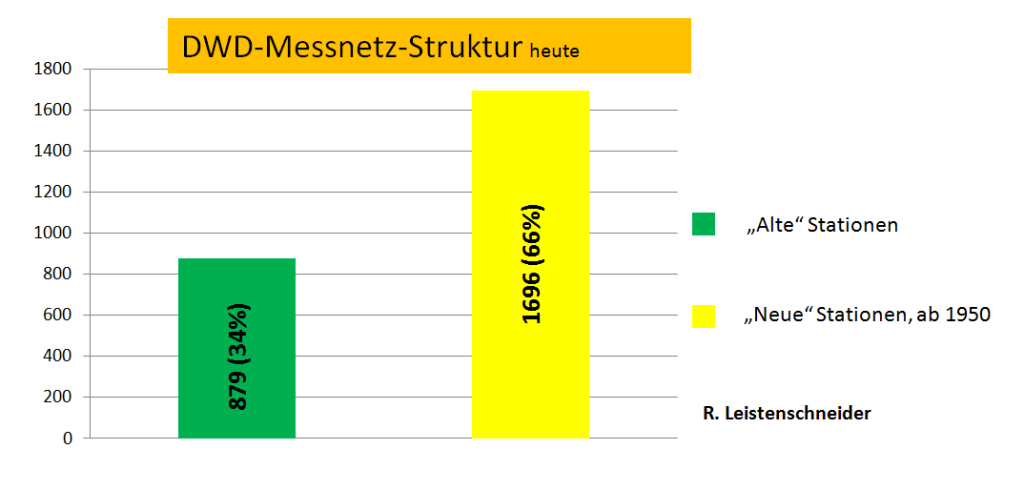

Die heutige Struktur des DWD-Messnetzes ist dagegen sichtlich unausgewogen und schieflastig, Abb.7.

Abb.7, Quelle R. Leistenschneider, nach Daten des DWD, offenbart die Unausgewogenheit (Schieflastigkeit) des heutigen DWD-Messnetzes zugunsten von „neuen“ Messstandorten, die ab dem Klimarummel des IPCC im Jahr 1990 begann. Vergleiche mit Abb.4.

Halten wir fest:

Bis 1990 wurden in 100 Jahren (!) etwa soviele Standorte stillgelegt, wie in den 1990-Jahren. Also in lediglich 10 Jahren. Dass Ganze „schreit“ förmlich nach „Lug und Betrug“.

In der Tat, sind alle Vergleichsdaten des DWD zu den mittleren Jahrestemperaturen in Deutschland unbrauchbar, wie noch bewiesen wird.

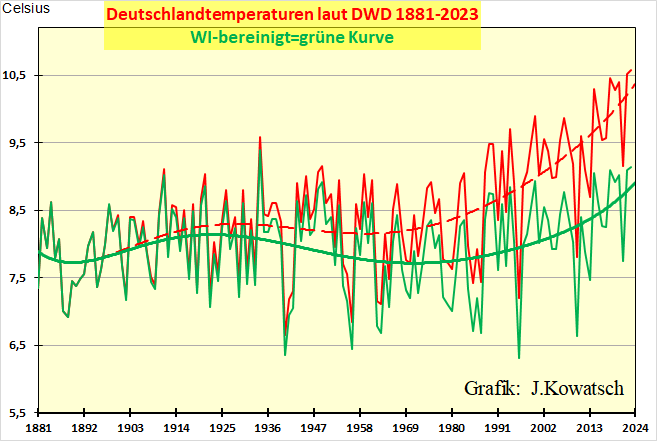

Kowatsch hatte die Datenreihe in Abb.2 bis in das Jahr 2023 erweitert, nachdem Leistenschneider die Berechnung bis 2023 weiter geführt hatte (Abb.8).

Abb.8 zeigt in rot, die vom DWD veröffentlichten Jahrestemperaturen für Deutschland von 1881 bis 2023 und in grün, die nach dem obigen Verfahren bereinigten und richtigen (!!) (Vergleichs)temperaturen für Deutschland im selben Zeitraum.

Man beachte: Zu Beginn der 1930-Jahre war es in Deutschland vergleichbar so warm wie heute, was etwa ein Jahrzehnt anhielt!

Nach diesem Verfahren, liegt der Fehler in 2023 bei +1,42°C. Diesen Wert sollten wir uns merken.

Beweisführung

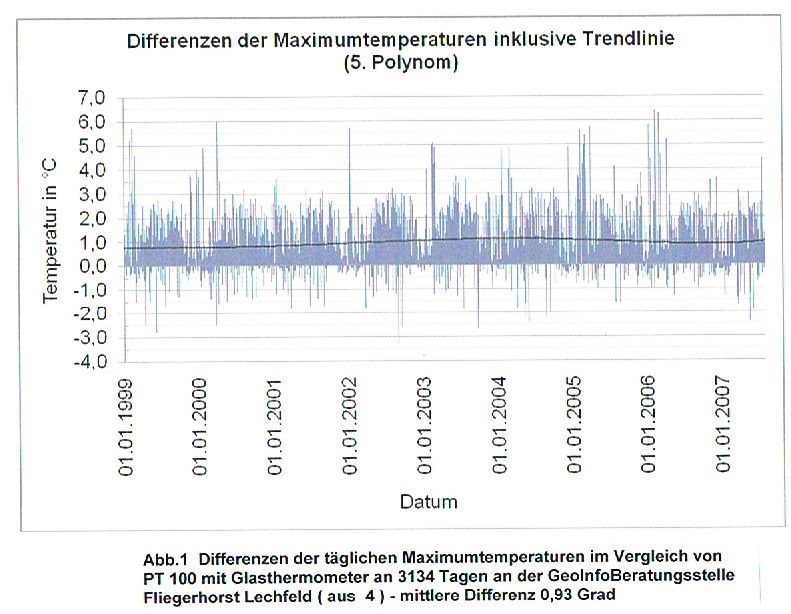

Unsere Beweisführung für die Manipulation des DWD bei den mittleren Jahres(vergleichs)temperaturen für Deutschland, beruht auf der Diplomarbeit beim DWD „Vergleich und Auswertung von täglichen Extremtemperaturmessungen mit Quecksilber-/Alkohol- und Pt100-Thermometern beim Fliegerhorst Lechfeld“.

Erstprüfer: Leitender MA des DWD (jetzt in Rente), Herr RDir a. D. Klaus Hager

Herr Hager hatte in der Berliner Wetterkarte auszugsweise daraus berichtet:

Abb.9, Quelle: Beilage zur Berliner Wetterkarte 44/13, „Vor- und Nachteile durch die Automatisierung der Wetterbeobachtungen und deren Einfluss auf vieljährige Klimareihen“, Klaus Hager. Abb.5 zeigt den Unterschied der Messungen mit einem Quecksilberthermometer und der heutigen elektronischen Messungen über einen Zeitraum von 8 1/2 Jahren. Sehr gut zu sehen, dass die elektronische Messung deutlich höhere Werte ergibt und zwar um +0,93°C höher! Dazu der Text des Verfassers, Herr Klaus Hager:

„An den 3144 Tagen ergab sich eine mittlere Differenz von + 0,93 Grad – Pt 100 höher als Quecksilber. Die maximal erfasste Tagesdifferenz betrug gar 6,4 Grad! An 41% der Tage war die Differenz 0 bis 1 Grad, an 26% der Tage 1 bis 3 Grad und an 18% der Tage größer als 2 Grad, an 15% der Tage waren die Quecksilberwerte höher als die mit Pt 100 gewonnenen Höchstwerte.“

„Ursachen hierfür können der Grad der Wolkenbedeckung und die Sonnenscheindauer, aber auch Windgeschwindigkeit und Luftmassenwechsel sowie die Bodenbedeckung mit einer Schneedecke sein. Somit kann man nicht mit generellen Korrekturwerten arbeiten, sondern muss lapidar feststellen, dass die früher gewonnenen Messwerte nicht mit den heutig erfassten für eine lange Temperaturreihe verwendet werden dürfen, ohne dass Brüche in den langen Reihen entstehen, die nicht real sind.“

Ein weiterer Fachmann, Prof. Malberg, FU Met Inst. dazu:

„Mit den Auswirkungen auf die Klimatemperatur durch die Umstellung von Quecksilberthermometermessungen auf elektronische Messverfahren Ende der 1980er/Anfang der 1990er Jahre hat sich W. Wehry (Beiträge zur BWK SO 22/09) befasst. Auch dieser (Fort-)Schritt hatte offensichtlich eine gewisse scheinbare Erhöhung der Mitteltemperatur zur Folge, da die elektronischen Messungen in der Regel höhere Maxima als die trägen Quecksilbermessungen ergeben. Der Effekt wirkt sich vor allem dort aus, wo die Mitteltemperatur aus Maximum und Minimum gebildet wird, u. a. in den USA.“

Die Autoren hatten mehrfach dazu berichtet.

Wie von Prof. Malberg genannt, handelt es sich bei den Daten nicht um (Tages)mittelwerte, sondern um Tageshöchstwerte. Sind also für eine Projektion auf die Temperaturmittelwertveröffentlichungen des DWD nur bedingt brauchbar, da sie eine andere Größe abbilden.

Nun ist die Physik etwas wunderbares. Sie gilt sowohl in Deutschland gleichermaßen, wie Frankreich den USA, etc. Eine Offenbacher-Physik existiert nicht. Auch wenn die Verlautbarungen zum angeblichen menschengemachten Klimawandel einen anderen Anschein erwecken. Doch dies soll jetzt nicht unser Thema sein.

Sowohl beim neuen Messverfahren mit Pt 100 (Platinsensor, dessen el. Widerstand sich mit der Temperatur ändert), als auch beim früheren Messverfahren mit Quecksilberthermometer (dessen Funktionsweise auf der Volumenänderung zur Temperatur beruht), handelt es sich um lineare Größen. Deshalb werden/wurden beide auch zur Temperaturerfassung eingesetzt. Linear bedeutet, dass deren Änderung pro °C stets die gleiche ist. Zumindest in dem Temperaturbereich, indem diese messen.

In der o.g. Diplomarbeit ist festgehalten:

„Aufgrund eines breiten Temperaturspektrums von -200,00 °C bis +500,00 °C deckt das Pt 100 beinahe alle üblichen Temperaturmessungen in Bodennähe und auch in der Atmosphäre ab. (Deutscher Wetterdienst, 1973)“

Dem Pt 100 ist es dabei egal, ob er Temperaturhöchstwerte oder niedrigere Temperaturwerte misst. Er kennt keine „Höchstwerte“, sondern einzig Messwerte. Will heißen, wenn der Pt 100, im Vergleich zum Quecksilberthermometer, falsche (zu hohe) Vergleichswerte liefert, dann ist dies auch bei den darunter liegenden Temperaturmesswerten der Fall. Die Frage ist „nur“: Wie hoch sind diese im Bezug des Tagesmittelwertes und damit zu den Jahresmittelwerten?

Nicht nur die Physik ist etwas Wunderbares, sondern auch deren Hilfsmittel, die Mathematik. Denn mit ihr lassen sich aus den Höchstwerten (deren Abweichung um +0,93°C), die Tages- und damit Jahresmittelwerte errechnen. Also wie hoch der Fehler bei den Temperaturmittelwerten ist. Konkret, um wie viel °C mit dem Pt 100 bei den Jahresmittelwerten im Vergleich zu früher (vor der Jahrtausendwende) zu hoch gemessen wird.

Dazu im Teil 2 mehr.

Raimund Leistenschneider – EIKE

Matthias Baritz, Naturwissenschaftler und Naturschützer

Josef Kowatsch, Naturbeobachter, aktiver Naturschützer, unabhängiger Klimaforscher