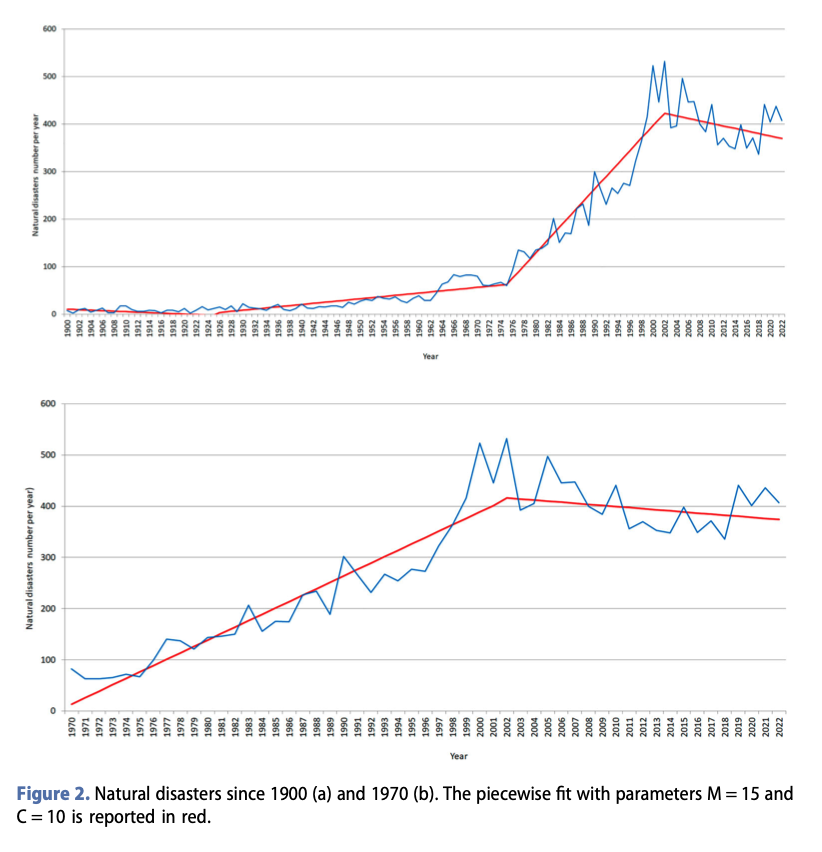

von Dr. Lars Schernikau, Autor von „Unbequeme Wahrheiten… über Strom und die Energie der Zukunft“ (hier bestellbar)

Viele Ingenieure oder Menschen mit einer Ausbildung oder Tätigkeit im Energiebereich argumentieren immer wieder, dass die Elektrifizierung von Heizung, Verkehr und Industrie die Energieeffizienz erhöhen und damit den Primärenergieverbrauch senken wird. So prognostiziert die IEA in ihrem „Netto-Null-Pfad“ eine Verringerung des Primärenergieverbrauchs um 10 % bis 2030 und sogar noch mehr bis 2050, und das trotz Bevölkerungswachstum und steigendem Lebensstandard, wobei der Energieverbrauch pro Kopf im schnell wachsenden „globalen Süden“ logischerweise zunimmt.

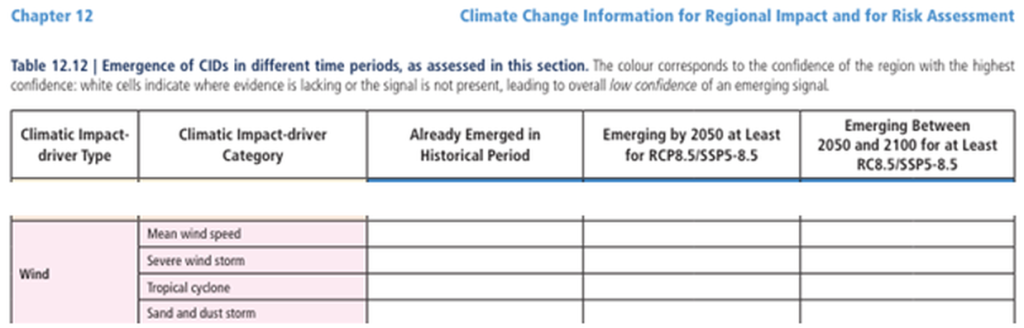

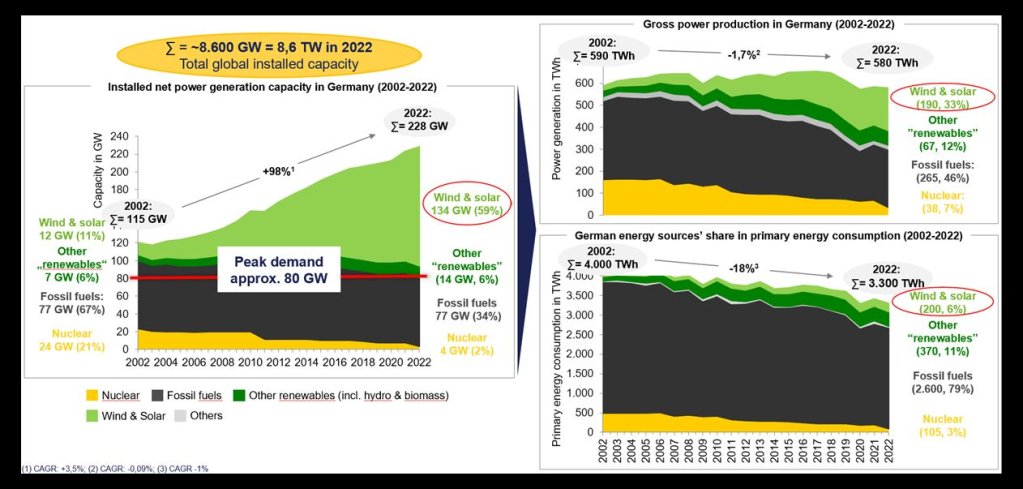

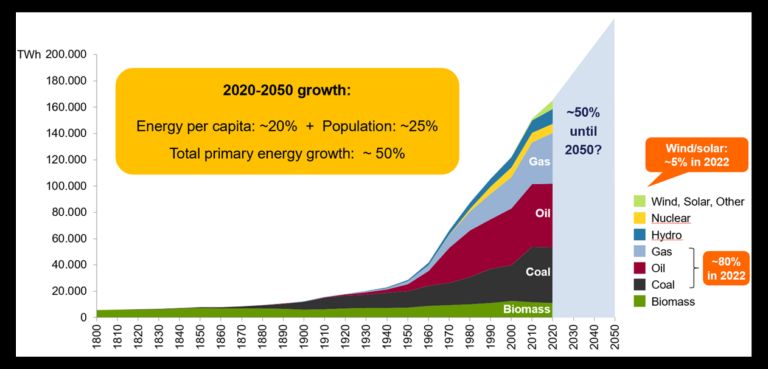

Geht man von einem Bevölkerungswachstum von 25% und einem Pro-Kopf-Energiezuwachs von 20% aus, so wäre ein Anstieg der Primärenergie um etwa 50% bis zum Jahr 2050 realistischer (Abbildung 1). Damit läge die Welt im Jahr 2050 im Durchschnitt etwa auf dem Niveau des heutigen Chinas, weit hinter Europa oder den USA, und es würde dabei davon ausgegangen, dass die Netto-Energieeffizienz bei der „Produktion“ und dem „Konsum“ von Energie von heute bis 2050 in etwa unverändert bliebe. Warum die Annahme einer konstanten Primärenergieeffizienz von einigen und auch mir infrage gestellt wird, versuche ich hier zu erklären.

Abbildung 1: Primärenergie bis heute und Projektion bis 2050. Quellen: Schernikau basierend auf Our World in Data nach Vaclav Smil 2017 und Energy Institute Statistical Review of World Energy 2023, (link)

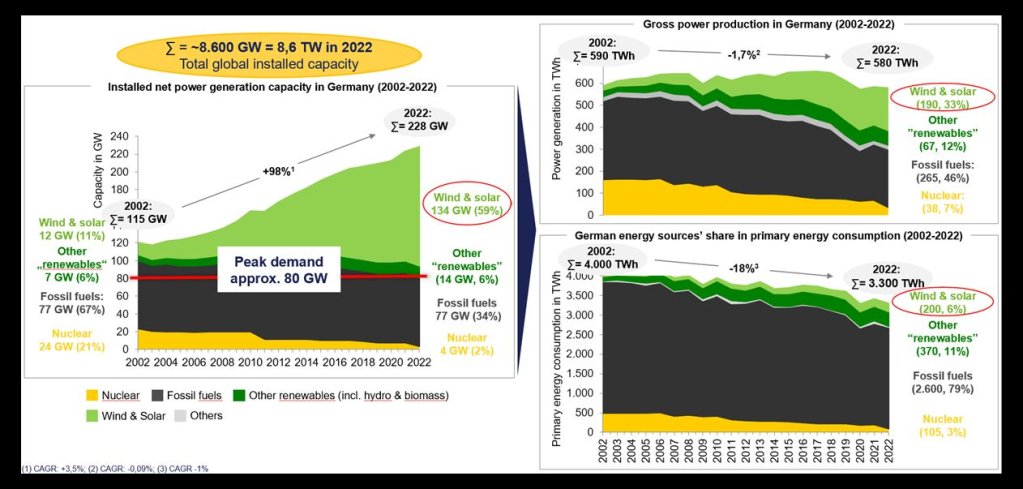

Elektromotoren sind effizienter als Verbrennungsmotoren, Wärmepumpen sind effizienter als Öl- oder Gasbrenner. Die Nutzung von Strom zur Erzeugung von Industriewärme ist effizienter als die Verbrennung fossiler Brennstoffe. Dies sind nur einige der Argumente, die wir regelmäßig hören, auch für Wasserstoff. Und hier scheint der Beweis erbracht: Der Primärenergieverbrauch in Deutschland ist in den 20 Jahren der „Energiewende“ um etwa 20% gesunken, während sich der Lebensstandard, die Bevölkerung und der Stromverbrauch weniger verändert haben (Abbildung 2).

Es ist richtig, dass ein Elektromotor effizienter ist als ein Verbrennungsmotor, warum sonst würden unsere modernen Züge elektrisch und nicht mehr mit Dieselmotoren fahren? Es ist auch richtig, dass der „Transport“ von Energie von einem Ort zum anderen, um die Temperatur um 1 °C zu erhöhen (z. B. vom Boden zu Ihrer elektrischen Heizung mithilfe eines Wärmetauschers), im Durchschnitt nur etwa ein Drittel der benötigten Energie im Vergleich zur Verbrennung von Öl oder Gas verbraucht.

Ich weiß nicht genug über Industriewärme, um mich dazu zu äußern, also lasse ich das für heute aus.Für meine Argumentation hier macht es allerdings auch keinen Unterschied. Die Herstellung und Verwendung von Wasserstoff als Energieträger ist sicherlich NICHT energieeffizient, das steht hoffentlich außer Frage.

Warum führen die oben genannten energiewirtschaftlichen Fakten über Elektromotoren und Wärmepumpen nicht zu einem geringeren Primärenergieverbrauch, sondern ganz im Gegenteil? Warum gibt es ein grundlegendes Missverständnis darüber, wie viel Primärenergie benötigt wird, um unser Leben zu führen, ob elektrisch oder nicht? Gehen wir der Sache auf den Grund.

Abbildung 2: Installierte Kraftwerksleistung in Deutschland, Stromerzeugung, Primärenergie. Quellen: Schernikau auf Basis von Fraunhofer, Agora, AG Energiebilanzen. Siehe auch www.unpopular-truth.com/graphs.

1. Was ist Primärenergie?

Primärenergie ist die in der Natur vorkommende „rohe, unverarbeitete Energie“, die wir ihr entnehmen

(Lars Schernikau)

Diskussionen über die Verwendung des Primärenergiemaßstabs sind aufgekommen, da „erneuerbare Energien“ wie Wind und Sonne einen größeren Anteil an der Elektrizität, jedoch einen geringeren Anteil an der Primärenergie ausmachen, wie Sie in Abbildung 2 und 3 sehen können. Einige Ökonomen halten die Primärenergie für veraltet und irreführend, weil sie der Ansicht sind, dass „Primärenergie“ aus Sonne und Wind mit geringen Energieverlusten in nutzbaren Strom umgewandelt werden kann.

Für diese wichtige Diskussion stellen wir klar, dass weltweit ca. 70.000 TWh Primärenergie für die Stromerzeugung verwendet werden (etwa 40 % der Primärenergie), was ca. 30.000 TWh nutzbarem Strom entspricht (Abbildung 3). Die Differenz ergibt sich größtenteils aus der thermischen Umwandlung bzw. dem (Un-)Wirkungsgrad von konventionellen Brennstoffen in Elektrizität in Wärmekraftwerken. Der Rest geht somit in Form von Wärme an die Umwelt „verloren“.

In Wikipedia heißt es meines Erachtens richtig: „Primärenergie (PE) ist die in der Natur vorkommende Energie, die noch keinem von Menschen durchgeführten Umwandlungsprozess unterzogen wurde. Sie umfasst die in Rohstoffen enthaltene Energie und andere Energieformen, einschließlich Abfälle, die einem System zugeführt werden. Primärenergie kann nicht-erneuerbar oder erneuerbar sein.“

Um die Sache noch weiter zu verwirren, gibt es verschiedene Methoden zur Berechnung der Primärenergie: die Methode der teilweisen Substitution und die Methode des physikalischen Energiegehalts (siehe Our World In Data oder IEA FAQ), aber auch dieser Aspekt ist für diese Diskussion hier nicht relevant.

Warum also mache ich so ein Aufheben darum und bezweifle, dass eine „elektrische Welt“, die auf Wind und Sonne (Formen von Primärenergie) basiert, weniger Gesamtprimärenergie benötigen würde, als die IEA und viele andere behaupten?

Erstens behaupte ich, dass die Art und Weise, wie die Primärenergie für jedes einzelne Land berechnet wird, zumindest irreführend ist, weil sie die außerhalb des Landes verbrauchte Primärenergie außer Acht lässt! Deshalb sieht man in Deutschland einen – unzutreffenden – Rückgang des Primärenergieverbrauchs.

Zweitens behaupte ich, dass die Art und Weise, wie Wind- und Solarenergie in den Energiestatistiken auftauchen, nämlich mit geringen Energieverlusten oder mit geringen Auswirkungen auf die Primärenergie, irreführend, wenn nicht gar falsch ist. Die Standardinterpretation der veröffentlichten Elektrizitäts- und Primärenergiedaten, d.h. Wind und Sonne seien primärenergieeffizienter, ist einfach nicht mit der Physik und der Energiewirtschaft vereinbar.

Abbildung 3: Die „Nutzung“ der globalen Primärenergie und ihr Vergleich mit der Elektrizität. Quellen: Schernikau auf der Grundlage von IEA, Energy Institute (ex BP), Our World in Data. Siehe auch www.unpopular-truth.com/graphs.

2. Primärenergie aus „abgebauten Bodenschätzen“ vs. Primärenergie aus Sonne und Wind

Für diese Diskussion lasse ich Wasserkraft und Biomasse außen vor. Wasserkraft ist natürlich begrenzt, Biomasse hat ganz andere ökonomische und Umweltauswirkungen, auf die ich hier aufgrund der Zeit und Artikellänge nicht eingehen kann. Ich konzentriere mich auf:

a) die so genannte „nicht erneuerbare“ Energie aus den „abgebauten Brennstoffen“ Öl, Kohle, Gas und Uran, die fast 90 % der Primärenergie und etwa 70 % der Elektrizität ausmacht, und

b) die so genannte „erneuerbare“ Energie aus Sonne und Wind, die angeblich etwa 5 % der Primärenergie und 12 % der Elektrizität ausmacht (Abbildung 3).

Um es gleich vorwegzunehmen: Öl, Kohle, Gas und Uran sind „abgebaute Energierohstoffe“, die wir aus dem Boden gewinnen, und logischerweise gibt es eine Grenze für das, was Mutter Erde zur Verfügung hat. Bitte akzeptieren Sie, dass wir über diesen Punkt jetzt nicht streiten müssen. Auf der Grundlage unseres heutigen Wissens und der Tatsache, dass wir ständig neue Ressourcen finden, sehe ich für die nächsten paar hundert Jahre kein Problem. Wenn Sie über 50 Jahre alt sind, erinnern Sie sich noch daran, was man Ihnen in der Grundschule darüber erzählt hat, wie lange das Öl noch reicht? Vergleichen Sie diese Zahl mit heute.

Damit will ich keineswegs sagen, dass wir uns keine Sorgen über die Erschöpfung von Rohstoffen machen sollten. Eine solche Erschöpfung führt zu höheren Kosten und logischerweise zu größeren Auswirkungen auf die Umwelt, da es schwieriger wird, die Ressourcen zu „finden“ und „abzubauen“. Dies lässt sich im Alltag der Kraftstoffgewinnung beobachten. Außerdem sind und bleiben die geförderten Energierohstoffe begrenzt. Wie relevant dies für unser Leben ist, hängt von der gesamten (ich behaupte, weitgehend noch unbekannten) Ressourcenbasis und unserer jährlichen Entnahme ab.

Der derzeitige Energiegehalt der gesamten (heute bekannten) Ressourcen an konventionellen Energierohstoffen beläuft sich auf etwa 150 Mio. TWh gegenüber etwa 160.000 TWh jährlicher Förderung (BGR 2023). Wenn sich diese Zahlen nicht ändern und wirklich nur 150 Mio. TWh konventionelle Brennstoffe im Boden vorhanden sind, und wenn wir sie ökonomisch abbauen könnten, bleiben uns bei den derzeitigen Förderraten noch etwa 900 Jahre „geförderte Energierohstoffe“, bevor die Lichter ausgehen. Ich verstehe, dass das sehr viel zu sein scheint, mehr als Sie vielleicht dachten, aber ich lade Sie ein, die Zahlen zu prüfen. Ich spreche von Ressourcen, nicht Reserven.

Die Primärenergie von Energierohstoffen wie Öl, Kohle oder Gas wird durch ihre „inhärente“ Energie oder ihren Heizwert oder Verbrennungswert gemessen, normalerweise in kcal/kg oder btu oder etwas Ähnlichem. Diese in den „geförderten Energierohstoffen“ enthaltene Primärenergie ist in der Natur „frei“ verfügbar, erfordert aber einen beträchtlichen Aufwand

a) dem Boden entnommen, aufbereitet und transportiert zu werden, und

b) durch Verbrennung in nutzbaren, wertvollen Strom „umgewandelt“ zu werden. Alles führt zu einem „Energieverlust“, da die Entropie jedes Mal zunimmt, wenn wir Energie nutzen oder speichern.

Was die so genannte „erneuerbare“ Energie aus Sonne und Wind betrifft, würde ich in der Tat zustimmen, dass wir „fast“ unbegrenzte Energie aus der Sonne und vielleicht etwas begrenztere Energie aus dem Wind haben. Die Windkraft als globale Energiequelle wird auf 45 bis 100 TW geschätzt (Adams und Keith 2013). Dem stehen weniger als 9 TW der derzeit weltweit installierten Kapazität aller Arten von Strom gegenüber, also ist alles gut? Vielleicht nicht!

Wir wissen, dass auch hier der 1. Hauptsatz der Thermodynamik gilt: Energie geht nie verloren, sie wird nur von einer Form in eine andere „verschoben“ oder „übertragen“. Wenn wir also Wind aus der Luft „nehmen“, um ihn in Strom umzuwandeln, verlangsamen wir natürlich die Windgeschwindigkeit. Diese Windgeschwindigkeiten werden mit der Zeit wieder „aufgefüllt“, und die Energierückgewinnungsrate ERR für Wind besagt, dass etwa 1 bis maximal 2 MW/km² für die „erneuerbare“ Nutzung durch den Menschen zur Verfügung stehen, andernfalls hört der Wind auf zu wehen (Smith und Schernikau 2023 für weitere Einzelheiten und Quellen von Dritten). Heute wird vielfach viel „dichter“ gebaut, auch hier mit Konsequenzen. Diese geringe „Leistungsdichte“ des Windes hat, wie Sie sehen werden, eine primärenergetische Konsequenz. Wenn wir von „Energieverlusten“ sprechen, „verlieren“ wir natürlich keine Energie, sondern wandeln lediglich die ursprünglich „nützliche“ Energie in „nutzlose“ Energie aufgrund stetig steigender Entropie um. Diese Wärmenergie erwärmtie schließlich die Welt um uns herum.

Die Leistungsdichte der Sonne pro m² ist ebenfalls von Natur aus begrenzt, nicht nur durch a) die Länge der Nächte oder die Bewölkung, sondern auch b) durch die Sonneneinstrahlung oder die „Kraft der Sonne, die auf Ihren Kopf scheint“. Es macht einen Unterschied, ob Sie mittags in Arizona oder in Nordkanada in der hellen Hochsommersonne stehen. Auch diese geringe Leistungsdichte von etwa 5.000 bis 10.000 kWh pro installiertem kW pro Jahr in Deutschland im Vergleich zu Arizona (Global Solar Atlas) hat eine direkte Auswirkung auf die Primärenergie.

Sie werden nun hoffentlich zustimmen, dass es Energie, Rohstoffe, Land und Geld bedarf, um a) die „freie“ Energie aus der Natur zu gewinnen, ob sie nun „erneuerbar“ ist oder nicht, und b) die „gewonnene Energie“ für den Endverbraucher in Form einer verbrauchbaren kWh oder Wärme nutzbar zu machen.

Dies ist für die Energiediskussion von grundlegender Bedeutung:

Während die Primärenergie für uns kostenlos ist (abgebaut oder „erneuerbar“), müssen wir immer Energie, Rohstoffe, Land und Geld aufwenden, um (a) diese Energie zu gewinnen und (b) sie für die Endnutzung zu verarbeiten.

3. Benötigte Primärenergie, um Wind und Sonne nutzbar zu machen

Es mag Sie überraschen, dass bei der Berechnung der Primärenergie in Deutschland davon ausgegangen wird, dass nahezu 100% des aus Sonne oder Wind „geernteten“ oder gewonnenen Stroms in nutzbaren Strom für den Verbraucher umgewandelt wird. So tauchen in Deutschland im Jahr 2022 fast 200 TWh Primärenergie aus Wind und Sonne als etwa 190 TWh verbrauchbarer Strom in der Statistik auf (AGEB Jahresbericht, S. 43). Bei der Kernenergie entsprechen 105 TWh Primärenergie aus Kernenergie etwa 35 TWh verbrauchtem Strom.

Erkennen Sie den Trugschluss? Hatten wir uns nicht gerade im vorherigen Abschnitt darauf „geeinigt“, dass wir die Energie einbeziehen müssen, um a) die Energie aus der Natur zu gewinnen und b) die „gewonnene Energie“ für die Endnutzung durch den Verbraucher nutzbar zu machen? Eigenartigerweise haben wir b) im Gasbeispiel mit einbezogen, aber weder a) noch b) im Sonnen- oder Windbeispiel. Was ist hier falsch gelaufen?

a) Energie zur Gewinnung der Energie aus der Natur: Bleiben wir bei Solar und Gas in Deutschland, um den Punkt zu illustrieren. Die benötigte Primärenergie, um Solarenergie aus der Natur zu gewinnen, finden Sie größtenteils in den Statistiken Chinas wieder. 80-90% der Wertschöpfungskette für Solarmodule ist in oder um China angesiedelt. Die Wärme und der Strom, die für die Herstellung von Polysilizium, Glas, Aluminium, Kupfer, Chemikalien und Stahl für die Montagekonstruktion benötigt werden, basieren größtenteils auf Kohle und werden ebenfalls größtenteils, aber nicht nur, in den Statistiken Chinas ausgewiesen. Ich habe einen ganzen Blogeintrag zu diesem Thema verfasst (Coal’s importance for Solar panel manufacturing; in deutscher Übersetzung hier) und eine neue, noch unveröffentlichte wissenschaftliche Arbeit ist in Arbeit (Mariutti und Schernikau 2024).

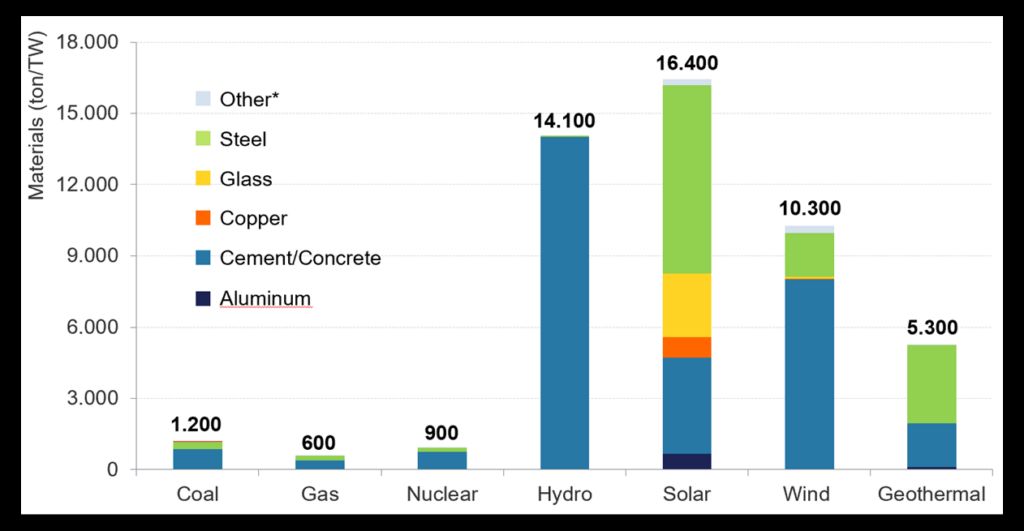

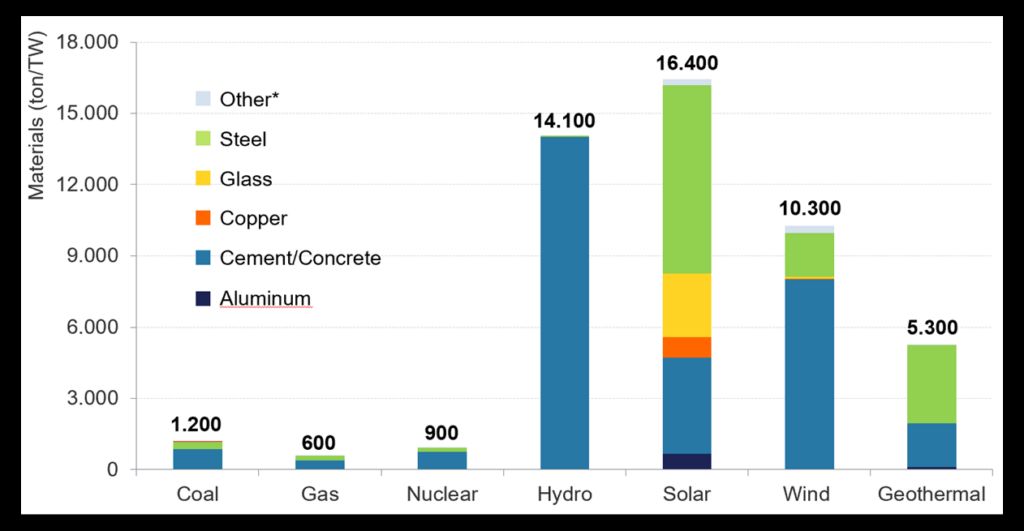

Das Gleiche gilt natürlich für den Bau eines Gaskraftwerks, auch dieser Aufwand muss berücksichtigt werden (was in Deutschland derzeit nicht der Fall ist). Das Gas selbst ist in der deutschen Statistik aber einkalkuliert. Sie werden es vielleicht ahnen, dass die geringe Energiedichte von Solarenergie (und Windkraft) bedeutet, dass viel mehr Land für Solarenergie benötigt wird, aber auch, dass viel mehr Tonnen an Rohstoffen und damit Energie benötigt werden, um die installierte Kapazität von Solar- oder Windenergie im Vergleich zu Gas, Kohle oder Kernkraft bereitzustellen (Abbildung 4).

Abbildung 4: Ausgewählte Materialien, die je nach Stromerzeugungstechnologie benötigt werden. Quelle: Schernikau auf der Grundlage von Daten des Department of Energy DOE, USA. Siehe auch www.unpopular-truth.com/graphs.

b) Energie, um die „gewonnene Energie“ für die Nutzung durch den Verbraucher nutzbar zu machen: Die Energie, um die Solarenergie für den Endverbrauch wirklich „nutzbar“ zu machen, ist eine weitere, komplexere Frage, die sich von der des Gases unterscheidet, da man bei Gas den Wirkungsgrad des Kraftwerks „einfach“ schätzen könnte, um eine grobe Zahl zu erhalten.

Man darf jedoch nicht vergessen, dass Strom aus Sonnenkollektoren für den „normalen“ Gebrauch im Stromnetz einen geringeren Wert hat, da er unstetig, unzuverlässig und somit unvorhersehbar ist, zumindest auf Versorgungsebene. Um eine kWh aus Sonnenenergie im Stromnetz wirklich nutzbar zu machen, sind zusätzliche Anlagen erforderlich (alle im Vergleich zu einem einzigen Gaskraftwerk):

-

Ein großer Überbau von Solarmodulen, um niedrige natürliche Kapazitätsfaktoren auszugleichen (10 bis 11% in Deutschland, 25 % in Kalifornien) + Überbauung, um Speicher zu „laden“ + Überbauung, um Energie-„Verluste“ zu berücksichtigen, die nicht nur für die Speicherung, sondern auch für die Aufbereitung, den Ausgleich und die Übertragung erforderlich sind.

-

Kurzzeit-Energiespeicherung (z.B. Batterien?) zum Ausgleich kurzfristiger Tagesschwankungen.

-

Langfristige Energiespeicherung (z.B. Wasserstoff?) zur Überbrückung von Tagen oder sogar Wochen ohne „nutzbare“ Sonneneinstrahlung, auch saisonale Speicherung genannt.

-

Ein thermisches Kraftwerk in Bereitschaft für schlechte Zeiten, zumindest derzeit in den Plänen Deutschlands enthalten.

-

Eine viel komplexere und größere Netzintegration und Übertragungsinfrastruktur, um den Solarstrom in das Netz zu integrieren.

Mir ist zwar klar, dass nicht immer alle 5 Punkte erforderlich sind, aber im Versorgungsbereich oder im Netzbereich sind sie oft erforderlich und werden eingeplant. Diese 5 Punkte werden umso wichtiger, je mehr Wind- und Sonnenenergie im System vorhanden ist.

Müsste man also nicht die Primärenergie mit einbeziehen, die für alle oben genannten 5 Punkte benötigt wird, um die gewonnene Sonnenenergie für den Endverbraucher „nutzbar“ zu machen? Wären die Zahlen dann nicht vergleichbar mit denen eines Gas- oder Kohlekraftwerks? Wir nennen solche „nutzbare“ Energie „abschaltbare“ Energie oder „feste“ Energie, d.h. Energie, die bei Bedarf zur Verfügung steht, und nicht nur dann, wenn die Natur sie bereitstellen kann.

Gas-, Kohle- und größtenteils auch Kernkraftwerke benötigen diese 5 Systeme nicht, da sie von Natur aus weitgehend regelbar sind (weniger bei der Standard-Kernkraft, aber die Grundlast der Kernkraft hat eine ganz andere Qualität und einen anderen Wert als intermittierender Wind- und Solarstrom). Es gibt genügend energiewirtschaftliche Literatur, die auch beweist, dass jede zusätzliche kWh Solar- oder Windenergie ab einem bestimmten, relativ geringen Durchdringungsgrad weniger Wert hat als die vorherige (z.B. Hirth 2013). Somit steigen die Gesamtkosten für Strom mit jedem zusätzlichen Solarpanel oder Windrad im System.

Die benötigte Primärenergie, um die gewonnene Solarenergie wirklich nutzbar zu machen, wird sicherlich in keiner Statistik eines einzelnen Landes erfasst, wohl aber in dem Land, in dem all diese Anlagen hergestellt oder produziert werden. Auch die graue Energie (embodied energy) für alle benötigten Rohstoffe und Materialien müsste mit einbezogen werden und wird irgendwo auf der Welt erfasst, aber nicht in Deutschland. (man denke an Eisenerz, Kalkstein für Zement, Kupfererz, Lithiumerz, Nickelerz, Bauxit, Rohöl und vieles mehr).

Das bedeutet, dass die Primärenergie, die Wind und Solarstrom zugerechnet wird zu gering ausgewiesen ist und logischerweise damit die Primärenergie, die nutzbarer Kohle-, Gas-, oder Ölenergie zugerechnet wird zu hoch ist.

4. Und nun?

Fassen wir zusammen. Wir wissen, dass der Anteil der Sonnen- und Windenergie an der Primärenergie derzeit stark unterschätzt wird, da davon ausgegangen wird, dass fast 100 % der primären Sonnen- und Windenergie in nutzbaren Strom umgewandelt werden. Die wahren Energie- und Rohstoffauswirkungen von Wind und Sonne sind in der Kohle-, Öl- und Gas-Primärenergie „versteckt“, die benötigt wird, um a) die Sonnen- und Windenergie zu gewinnen und b) den erzeugten Strom für den Verbraucher wirklich nutzbar zu machen. Die gleiche „Falschaussage“ gilt auch für genutzte Energie aus Kohle, Gas oder Öl. Jedoch sinddie Auswirkungen wesentlich geringer, da der Brennstoffverbrauch bedeutender ist als die Investitionsgüter und der zusätzliche Bedarf für Überbauung, Speicherung und Übertragung entweder nicht vorhanden oder viel geringer ist (man erinnere sich an die Liste der 5 Systeme). Außerdem ist die Leistungs- oder Energiedichte pro m² bei konventionellen Brennstoffen viel höher, so dass weitaus weniger Ausrüstung erforderlich ist, um der Anforderung gerecht zu werden.

Jede Windturbine und jedes Solarmodul bringen also eine Menge Ballast mit sich, der in den Statistiken nicht ausgewiesen wird. Auf globaler Ebene werden Sie sehen, wie die Primärenergie mit mehr Wind- und Solarenergie wächst. Tatsächlich ist die Netto-Energieeffizienz (eROI) von Wind- und Solarenergie unter Berücksichtigung des gesamten Systems, um den Strom wirklich nutzbar zu machen, viel niedriger als die von Kohle, Gas oder Kernkraft. Daher kann man davon ausgehen, dass die Primärenergie mit zunehmender Wind- und Solardurchdringung schneller steigt. Dies wird durch den „wahren EROI des Gesamtsystems“ diktiert, der bei Wind- und Solarenergie niedriger ist als bei konventionellen Energiesystemen. Auch hier arbeiten wir an einer akademischen Grundlagenstudie, die dies zeigt. Einen Top-Down-Blick gibt es hier bei Schernikau, Smith und Falcon 2022 „Full Cost of Electricity ‚FCOE‘ and Energy Returns ‚eROI‘“.

Zum Argument des Elektrofahrzeugs. Ja, ein Elektromotor ist effizienter als ein Verbrennungsmotor, wenn man ihn direkt ohne den ehrlichen Lebenszyklus vergleicht. Aber die Versorgung des Elektroautos mit Wind- und Sonnenenergie bedeutet, dass das Elektroauto all die oben genannten Nachteile mit sich bringt und der Vorteil des Elektromotors selbst „verloren“ geht (was bei einem mit Kohle, Gas oder Kernkraft betriebenen Elektrozug nicht der Fall ist). Hinzu kommt das Batterieproblem, die gesamte Primärenergie für die Herstellung der Batterie (die ein elektrischer Zug nicht benötigt), die – einmal hergestellt – immer noch aus dem Netz geladen werden muss. Daher werden Elektrofahrzeuge im großen Maßstab die Primärenergie nicht reduzieren. Elektrofahrzeuge können für bestimmte Anwendungen, wie z.B. den gewerblichen Kurzstreckenverkehr in oder um Städte, durchaus sinnvoll sein, aber ich habe diese Berechnungen nicht durchgeführt, daher ist dies nur eine Vermutung. Hier lassen wir aber die praktische Unverkäuflichkeit von E-Fahrzeugen aufgrund der geringen Lebensdauer der Batterie außer Acht.

Das Gleiche gilt nun auch für die Wärmepumpe. Jede Wärmepumpe benötigt Strom, was bei einer Gas- oder Ölheizung nicht der Fall ist, oder nur in sehr geringem Maße. Logischerweise, so wird uns gesagt, sollte der Strom „erneuerbar“ sein, also größtenteils aus Wind- oder Solaranlagen stammen. Die durch die Technologie der Wärmepumpe gewonnene Effizienz geht durch die Ineffizienz der Wind- und Solar- oder konventionellen Systeme verloren. Hinzu kommt das Problem, dass eine Wärmepumpe an Effizienz verliert, je kälter es wird (ihre Leistungszahl, COP, sinkt).

Im Winter, wenn wirklich geheizt werden muss, benötigen Sie also mehr Strom. Nicht nur, weil es kälter ist, sondern auch weil der Wirkungsgrad der Wärmepumpe sinkt. Denken Sie daran, dass der Winter die Zeit ist, in der die Sonnenenergie knapp ist. In dicht besiedelten Städten sind Wärmepumpen ohnehin ein Mythos. Wie dem auch sei, Wärmepumpen sind großartig. Unsere Familie nutzt sie seit Jahrzehnten wegen des Kostenvorteils und da Strom sicher verfügbar war, auch im Winter. Aber glauben Sie nicht, dass ein wind- und solarbetriebenes Wärmepumpensystem die Primärenergie reduziert, das tut es nicht!

Dass ein „wasserstoffbasiertes“ industrielles System NICHT primärenergieeffizient ist, sondern das genaue Gegenteil, liegt auf der Hand, sodass ich nicht dafür plädieren werde. Lassen Sie mich stattdessen einfach Osburg,, den Vorsitzenden von Thyssen Krupp Steel zitieren: Deutschland: „Die Umstellung auf Klimaneutralität [mit H2] wird den Strombedarf allein in unserem Duisburger Werk von 4,5 TWh auf 45 TWh verzehnfachen“.

Ein erheblicher Teil der Kohle-, Gas- und Öl-Primärenergie in der globalen Statistik muss dem Wind- und Solarstrom zugerechnet werden.

Diese Brennstoffe werden benötigt, um a) die Wind- und Solarenergie zu gewinnen und b) die Wind- und Solarenergie durch Hilfssysteme wie z. B. Speicherung/Backup und Netzintegration oder -übertragung wirklich nutzbar zu machen.

5. Zusammenfassung

Wir haben nun festgestellt, was die Primärenergieprobleme sind und warum es ein Fehler ist, anzunehmen, dass eine elektrische Welt, die weitgehend, aber nicht nur auf Wind- und Solarenergie basiert, global gesehen zu weniger Primärenergie führen wird. Parallel dazu haben wir logischerweise auch einen Teil der Gründe erläutert, warum Wind- und Solarenergie die teuerste und am wenigsten energie- und rohstoffeffiziente Art der „nützlichen“ Stromerzeugung ist.

Denken Sie daran, dass diese Aussage nicht politisch ist und uns nicht daran hindert, alles in unserer Macht Stehende zu tun, um die Umweltauswirkungen unserer Energiesysteme zu minimieren. Die Aussage beruht einfach auf physikalischen und tatsächlichen Gegebenheiten und lässt sich leicht am Beispiel Deutschlands veranschaulichen.

Die wahren finanziellen Kosten der sogenannten „Energiewende“ übersteigen – wegen all der erforderlichen Hilfssysteme – bei weitem alle bisherigen Schätzungen. Würden Wind- und Solarenergie Energie sparen, eine kostengünstige Lösung darstellen und wirklich zu 100 % effizient sein, dann hätten wir natürlich keinen Streit und Deutschland hätte nicht die höchsten Strompreise aller Industrienationen. Die deutsche Wirtschaft würde mit kostengünstiger und zuverlässiger Energie florieren, aber nichts davon ist der Fall (Bloomberg Feb 2024: Germany’s Days as an Industrial Superpower Are Coming to an End).

Das wichtigste Ergebnis für heute ist somit, dass die globale Primärenergie aus drei Gründen zunehmen und nicht abnehmen wird:

-

Zunahme der Bevölkerung,

-

Anstieg des Pro-Kopf-Energieverbrauchs, da der „globale Süden“ aufholt, und

-

Rückgang der „Primärenergieeffizienz“ zur Stromerzeugung, solange der Anteil von Wind- und Sonnenenergie im Netzsystem steigt

Ich stimme zu und verstehe voll und ganz, dass es auch Verbesserungen bei der „Primärenergieeffizienz“ durch Technologie und Innovation geben wird. Die großen Verbesserungen konzentrieren sich jedoch auf den „Energieverbrauch“. Das Jevons-Paradoxon besagt, dass neue Energienutzungen Effizienzverbesserungen ausgleichen. Man denke nur an die aufkommende künstliche Intelligenz, Rechenzentren, Raumfahrt, terrestrische Reisen und vieles mehr. Der springende Punkt ist hier die Verringerung der Primärenergieeffizienz bei der „Energieerzeugung“.

Mein Vorschlag lautet nach wie vor: INVESTIEREN wir in konventionelle Energiesysteme statt aus diesen AUSZUSTEIGEN, um die wirtschaftliche und ökologische Produktivität weiter zu verbessern und einen wirklich positiven Unterschied für die wachsende Bevölkerung zu machen, indem Sie erschwingliche und zuverlässige Energie mit den geringsten Umweltauswirkungen bereitstellen. Parallel dazu müssen wir mehr in Forschung und Entwicklung investieren, um langfristig die Abhängigkeit von unzureichender „fossiler“ Energie zu reduzieren und diese mit energieeffizienteren Formen ersetzen zu können.

Logischerweise bleibt „Net Zero anything“ bestenfalls Wunschdenken.

Mehr Details zu den o.g. Themen können sie im Buch des Autors „Unbequeme Wahrheiten… über Strom und die Energie der Zukunft“ nachlesen und hier bestellen.

Link: https://unpopular-truth.com/2024/05/24/why-primary-energy-is-still-king/

Übersetzt von Christian Freuer für das EIKE

Hinweis: Diese Übersetzung ist vom Autor begutachtet worden.