Grüne Produzenten halten „grüne“ Energie für zu teuer, um „grünen“ Wasserstoff herzustellen

Stopthesethings

Der Mythos, „grünen“ Wasserstoff ausschließlich mit Wind und Sonne zu produzieren, ist ein weiterer Versuch der Vetternwirtschaft, die Steuerzahler von ihrem Geld zu trennen. Wenn „grüner“ Wasserstoff wirtschaftlich machbar wäre, würden Unternehmer jeden Cent, den sie aufbringen könnten, für etwas (scheinbar) vielversprechend einsetzen.

Die Tatsache, dass ihre erste Anlaufstelle staatliche Subventionsfonds sind, sagt jedoch alles.

Abgesehen von den (bedauerlichen) wirtschaftlichen Aspekten bedeutet die Physik der Produktion, Lagerung und Verteilung eines äußerst flüchtigen und korrosiven Gases, dass nichts davon eine Hoffnung auf Verwirklichung hat. Aus diesem Grund gibt es weltweit keinen einzigen kommerziellen Hersteller von grünem Wasserstoff [in größeren Mengen].

Andrew Twiggy Forrest, der treue Kapitalist des Königs von Australien – das führende Sprachrohr dieses Landes für grünen Wasserstoff – hat viel Rhetorik, aber kaum rationale Argumente und noch weniger den Wunsch, mit seinem eigenen Geld Taten folgen zu lassen.

Wie das Team von Jo Nova unten erklärt, haben Forrests große Pläne für grünen Wasserstoff im Hades keine Chance, jemals in die Tat umgesetzt zu werden.

Erneuerbare Energie ist zu teuer, um „grünen Wasserstoff“ herzustellen – Twiggy geht stattdessen nach Arizona

Jo Nova Blog, 30. April 2024

Erst vor 18 Monaten gab die australische Regierung 14 Millionen Dollar an Andrew „Twiggy“ Forrest, um herauszufinden, ob sein Team auf einer Insel in der Nähe von Brisbane eine 500-MW-Elektrolyse-Anlage zur Herstellung von Wasserstoffgas bauen könnte. Es sollte eine glorreiche grüne Zukunft in Australien werden, die größte Wasserstoffanlage der Welt. Jedoch verstrichen in den letzten Monaten drei Fristen für die Genehmigung des Projekts. Stattdessen geht das australische Unternehmen ins Ausland.

Wie Nick Cater betont, wird dieser Teil der ursprünglich in Australien herzustellenden erneuerbaren Superenergie nun [eventuell] in Arizona hergestellt, weil dort immer noch billiger Strom vorhanden ist – für wundersame 7,5 cent / Kilowattstunde!

Australiens Produktionsrückgang ist eine Geschichte gebrochener Versprechen und gescheiterter Wohlfahrtsprogramme der Industrie.

Nick Cater, The Australian

Bowen beschrieb den Erfolg des Projekts als „entscheidend“ für Australiens Ambitionen, eine Supermacht für grüne Energie zu werden.

Es stellte sich heraus, dass reichlich Sonne bei der Herstellung von grünem Wasserstoff kein so großer Wettbewerbsvorteil war. Niedrige Steuern, eine verantwortungsbewusste Regierung und günstige und zuverlässige CO2-freie Energie sind weitaus attraktivere Anziehungspunkte für Investoren.

Die Zukunft wird bereits in Buckeye, Arizona, gebaut, wo Fortescue 500 Millionen US-Dollar (765 Millionen US-Dollar) in eine Anlage für grünen Wasserstoff investiert, die angeblich bis 2026 in Betrieb sein wird.

Im Jahr 2023 wuchsen die Investitionen für Produktion in Arizona schneller als in jedem anderen Bundesstaat. Es umfasst energie- und wasserintensive Industrien wie die Herstellung von Siliziumchips, wobei Arizona aus dem Nichts auf den vierten Platz unter den US-Bundesstaaten kam.

..Es ist nicht schwer herauszufinden, warum. Der höchste staatliche Einkommenssteuersatz in Arizona beträgt 2,98 Prozent. … Für energiehungrige Branchen wie die Wasserstoff- und IT-Branche ist der größte Reiz jedoch der Industriestrompreis: 7,47 Cent pro kWh in Arizona im Vergleich zu 18 Cent in Kalifornien.

Unsere Strompreise sind doppelt so hoch, wie es jede Wasserstoffindustrie ertragen könnte.

Damit sind weit abgeschlagen. Letzten Monat sagte der Chef von Fortescue Energy, er hoffe, dass unsere Preise fallen würden (um die Hälfte!), und nannte Norwegen als Beispiel für „billige erneuerbare Energie“, als ob wir das nachahmen könnten. Das ist ein wenig aussagekräftig, wenn man bedenkt, dass die einzige erneuerbare Energie, die Norwegen nutzt, Wasserkraft ist (96 %). Norwegen verfügt über 31 GW Wasserkraft, während wir über 4 GW verfügen und nicht einmal ein 2 GW-Pumpwasserkraftwerk in Betrieb nehmen können. Um es ganz klar auszudrücken: Norwegen hat tausend Fjorde und eine halbe Million Seen und Australien hat keine Fjorde und etwa fünfzig Salzseen“.

Laut Fortescue beruhen die Hoffnungen auf Wasserstoff auf einer Halbierung der Strompreise.

Peter Kerr, Australian Financial Review, 11. März 2024

Herr Hutchinson [Fortescue Energy-Chef] sagte gegenüber dem Australian Financial Review Business Summit, dass die hohen Strompreise das Haupthindernis auf Gibson Island seien. „Wir haben sehr, sehr hart daran gearbeitet“, sagte er. „Aber angesichts der aktuellen Strompreise ist es schwierig, im globalen Wettbewerb zu bestehen. Es ist eine schwere Entscheidung.

Das Unternehmen geht davon aus, in diesem Jahr ein grünes Wasserstoffprojekt in Norwegen genehmigt zu bekommen, das mit kohlenstofffreier Wasserkraft betrieben werden soll. „Wenn man sich auf der ganzen Welt umschaut, wo man billigen erneuerbaren Strom bekommen kann, liegt der Preis für wettbewerbsfähigen erneuerbaren Strom bei weniger als 30 US-Dollar pro Megawattstunde“.

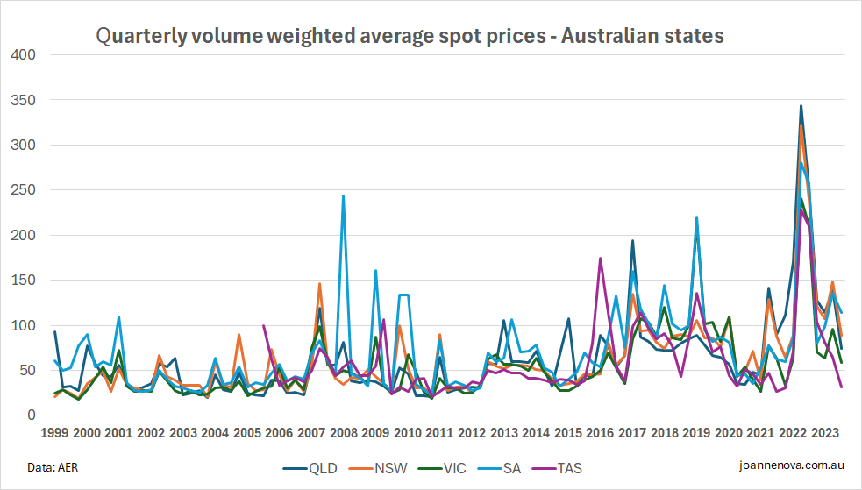

Unmögliches Dreiecksrätsel. Die Ironie besteht darin, dass er zur Herstellung von Wasserstoff den billigen Strom benötigt, den wir früher im australischen Stromnetz hatten, bevor wir mit der Einbindung erneuerbarer Energien begannen (nach 2008, als Kevin Rudd gewählt wurde). Zwanzig Jahre lang betrug der gesamte australische Netzpreis etwa 30 US-Dollar pro Megawattstunde. Zu einem Zeitpunkt nach 2012, als die CO2-Steuer eingeführt wurde, stiegen die Strompreise über die Preisgrenze von 50 US-Dollar pro Megawattstunde, die die Wasserstoffindustrie unrealistisch macht, und sanken nie wieder.

Es war einmal, dass es in Australien so billigen Strom gab, dass niemand Wasserstoff gekauft hätte. Jetzt, wo Strom so teuer ist, könnte Wasserstoff konkurrenzfähig sein, aber niemand kann es sich leisten, ihn herzustellen.

Wie beim unmöglichen Penrose-Dreieck: [Dieses in sich verschlungene Dreieck] … es ergibt nie einen Sinn.

Reference: AER quarterly wholesale electricity prices 1999- 2023

Referenz: Vierteljährliche Großhandelspreise der AER für Strom 1999–2023

Übersetzt durch Andreas Demmig