The Gestalt of Heat Waves

Einführung

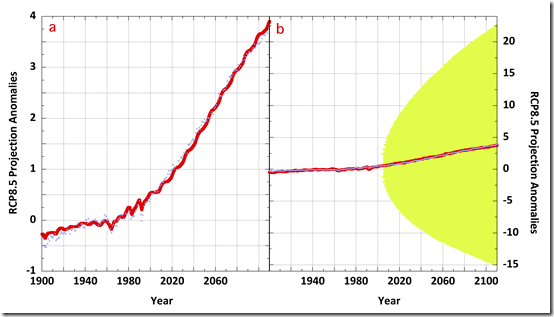

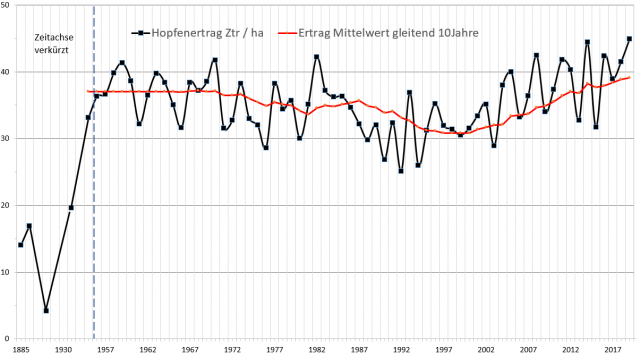

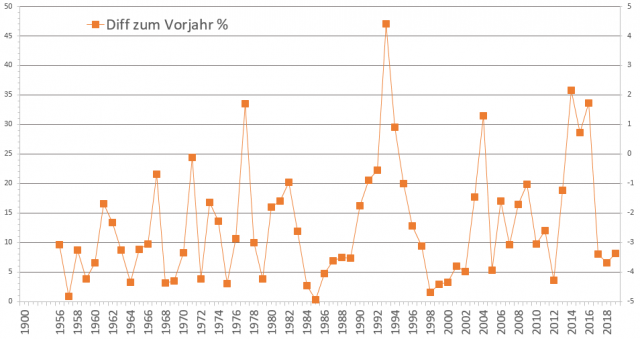

In der Presse war während des Sommers in diesem Jahr viel zu lesen über ,globale‘ Hitzewellen, besonders in Frankreich und Grönland. Beispiele für derartige Fanfarenstöße finden sich hier. Den Prophezeiungen zufolge sollten wir erwarten, dass Hitzewellen häufiger und intensiver werden infolge der anthropogenen globalen Erwärmung AGW, jetzt allgemein ,Klimawandel‘ genannt. Die Grundlage dieser Behauptung sind ausschließlich nicht validierte Globale Klima-Modelle, von denen allgemein eingeräumt wird, dass sie viel zu warme Ergebnisse zeigen. Die vereinfachende Begründung lautet, dass es nachts weniger abkühlt und es daher weniger Aufheizen bedarf, um ungewöhnlich hohe Temperaturen zu erreichen. Unglücklicherweise jedoch – wenn das stimmen würde, dürften Hitzewellen niemals mehr aufhören.

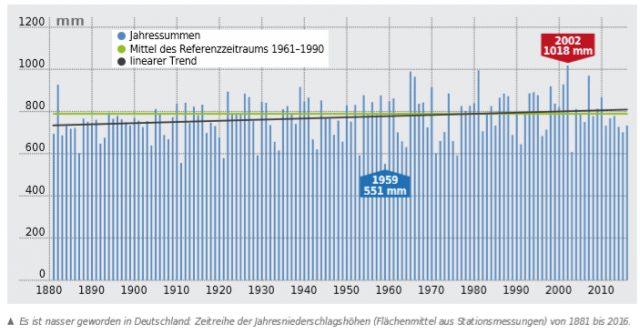

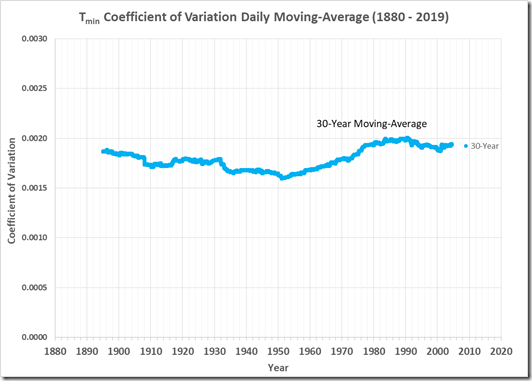

Eine Agentur, welche die Hitzewellen der 1930er Jahre [in den USA] nicht eliminiert hat, ist die US Environmental Protection Agency EPA. In den Daten zeigt sich eindeutig, dass während dieser Zeit die höchsten Werte des Hitzewellen-Index‘ aufgetreten waren.

Abbildung 1: Jährlicher Hitzewellen-Index in den USA. (Quelle)

Falls die Prophezeiungen einer schlimmeren Zukunft valide wären, müsste man erwarten, in der Lage zu sein, schon jetzt eine Änderung festzustellen, wird doch davon ausgegangen, dass sich die Erde mindestens seit Beginn der industriellen Revolution erwärmt hat. Das heißt, falls sommerliche Hitzewellen häufiger auftreten und heißer werden, müsste man erwarten, dass die täglichen Maximum-Temperaturen eine größere statistische Varianz zeigen.

Weil die Menschen auf dem Land leben und wir uns um die Auswirkungen auf die Menschen Sorgen machen wie etwa Komfort und Hitzetote bis zum Exzess scheint es am besten zu sein, sich einfach die Lufttemperaturen auf dem Land vorzunehmen. Es gibt in der Klimatologen-Gemeinschaft eine unglückliche Tendenz, Wassertemperaturen mit Lufttemperaturen auf dem Land zu verschmelzen. Dies neigt dazu, Änderungen abzuschwächen, weil man viel mehr Energie braucht, um die Wassertemperatur zu ändern als für eine Änderung der Landtemperatur. Da nun über 70% der Erdoberfläche mit Wasser bedeckt sind, werden kleine Änderungen oder Trends bzgl. Energie in den gewichteten Mittelwerten der Wasser- und Landtemperatur schwieriger auszumachen sein.

Analyse

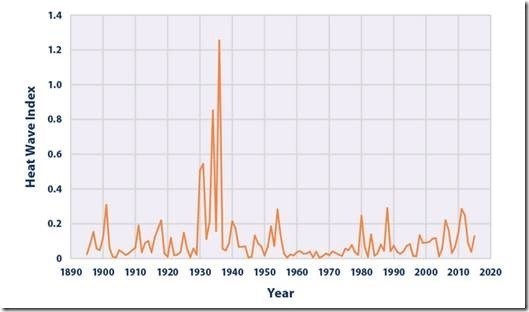

Um die Lage zu klären, zog ich die Daten des Berkeley Earth Surface Temperature (BEST)-Projektes heran. Ich wollte so dicht wie nur irgend möglich an die Rohdaten herankommen und die Mittelbildung minimieren, welche normalerweise bei solchen Daten durchgeführt wird, und was Bedenken weckt hinsichtlich nachfolgender statistischer Analysen. Zu diesem Zweck lud ich einen experimentellen Datensatz herunter, welcher die täglichen Maximum– und Mnimum-Temperaturen nur über Landflächen enthielt. Abbildung 2 zeigt den Koeffizienten der Variation (CoV) der täglichen Höchsttemperatur (Tmax) als Zeitreihe von 1880 bis Mitte 2019. Es werden zwei Verläufe gezeigt: 1) ein 30-jähriges gleitendes Mittel der Standardabweichung (SD) dividiert durch das 30-jährige arithmetische Mittel in täglichen Stufen, und 2) ein einjähriges gleitendes Mittel der SD dividiert durch das jährliche arithmetische Mittel in täglichen Schritten. Die Division durch das Mittel normalisiert die SD und erzeugt den CoV.

Ich übertrug die BEST-Temperaturanomalien in geschätzte Grad Celsius, indem ich die mittlere berechnete Tmax von 1951 bis 1980 addierte. Um dann eine Division durch Null zu vermeiden, konvertierte ich die Temperaturen zu Grad Kelvin, damit die CoVs von Tmax und Tmin vergleichbar sind. Die die Tmax-Temperaturen begleitenden Metadaten [?] zeigen die geschätzte Unsicherheit des zugrunde liegenden Mittels (14,41°C) mit ±0.11° C. Die Präzision der berechneten Anomalien sollten dann nicht größer als jener Wert sein und möglicherweise darunter liegen, wobei die Unsicherheit der individuellen Messungen berücksichtigt werden, aus welchen die Anomalien errechnet worden sind. Nichtsdestotrotz gibt BEST die Anomalien bis zu drei Stellen nach dem Komma an anstatt des einen gerechtfertigten Wertes. Ignorieren wir das erst einmal und fahren fort…

Das jährliche gleitende Mittel des CoV von Tmax ist nicht besonders informativ, zeigt es doch lediglich große jährliche Änderungen in dem, was im Wesentlichen die Standardabweichung ist. Allerdings glätten die über 30 Jahre gleitenden Mittelwerte die Daten deutlich, wenngleich die ersten und letzten 15 Jahre der Daten dabei abgeschnitten werden. Von 1895 bis 1950 gibt es keinen erkennbaren Trend. Danach jedoch zeigt der CoV einen eindeutigen Aufwärtstrend, was man auch erwarten kann, falls sommerliche Hitzewellen an Häufigkeit, Dauer und bzgl. der Temperatur zunehmen. Allerdings zeigt sich dann ab etwa dem Jahr 1996 etwas Unerwartetes – der CoV beginnt zu sinken! Die jährlichen CoV-Werte zeigen außerdem, dass es auch um das Jahr 2000 eine Abnahme gibt. Überraschenderweise kommt die US-Hitzewelle während der 1930er Jahre nur schwach beim CoV der jährlichen Tmax zum Ausdruck.

Abbildung 2: Tmax-Variations-Koeffizient der Zeitreihe (Quelle)

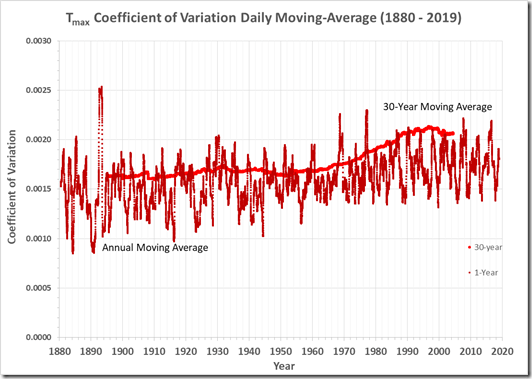

Abbildung 3: Tmin-Variations-Koeffizient der Zeitreihe (Quelle)

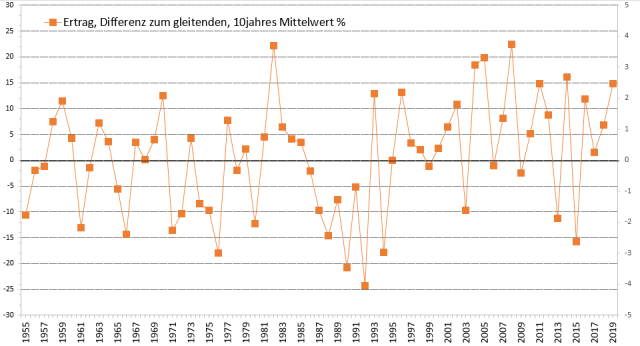

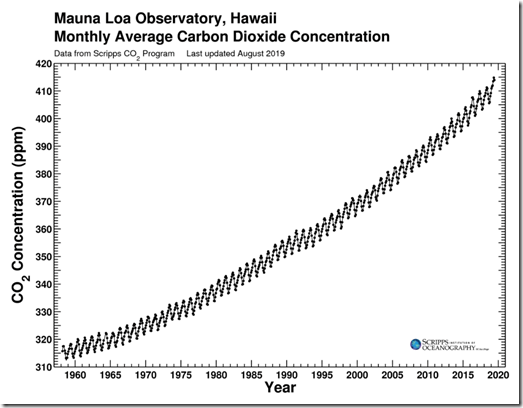

Interessanterweise sieht der CoV der gleitend gemittelten Zeitreihe von Tmin ganz anders aus, wie aus Abbildung 3 hervorgeht. Wie bei der Tmax-Zeitreihe handelt es sich um ein über 30 Jahre gleitendes Mittel mit täglichen Schritten. Im Wesentlichen zeigt sich eine Abnahme der Varianz von mindestens Mitte der 1890er-Jahre bis etwa zum Jahr 1952, gefolgt von einer Zunahme bis etwa 1990 und dann wieder eine Abnahme mit der ursprünglichen Rate. Die Abnahme kann jeweils erklärt werden im Zusammenhang mit der Strahlungs-Abkühlung der Erde [radiative cooling], erschwert durch zunehmende ,Treibhausgase‘. Das heißt, es wird nachts nicht mehr so kalt, was den täglichen Temperaturgang verringert und damit auch die Varianz von Tmin. Die fast 40-jährige Unterbrechung der Abnahme ist etwas schwerer zu erklären, weil es keine gleichlaufende Änderung von CO2 in der Atmosphäre gegeben hatte! (Siehe Abbildung 6 unten). Das ist ein Hinweis darauf, dass irgendwelche Auswirkungen von langlebigem CO2 leicht zu kompensieren sind – vielleicht durch Aerosole, kurzlebige Bewölkung und Wasserdampf, selbst wenn diese tatsächlich nicht die entscheidenden Treiber sein sollten.

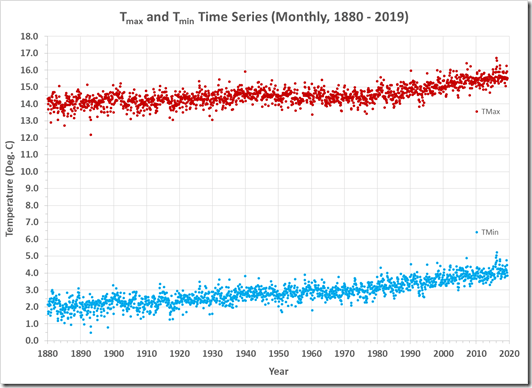

Was geht hier vor? Um das noch tiefer zu erkunden, studierte ich die jüngsten Tmax– und Tmin-Daten aus BEST. Weil die täglichen Daten so viel Rauschen aufweisen, verwendete ich die monatlichen Zeitreihen, um das Verhalten der Temperaturen zu ergründen.

Abbildung 4: Monatliche Mittelwerte der Zeitreihen der Höchst- und Tiefsttemperatur (Quelle)

(Das Thema Temperaturänderungen habe ich zuvor schon einmal behandelt, und zwar hier)

Auch Abbildung 4 ist nicht sehr informativ. Es sieht so aus, als wäre eine leichte Zunahme der Steigung von Tmax nach etwa dem Jahr 1975 aufgetreten, was nur schwer den Auswirkungen von CO2 zuzuordnen ist. Der Anstieg der Tmin könnte nach 1998 leicht gesunken sein mit Ausnahme des El Nino 2016. Zeichnet man die Anomalien anstatt die tatsächlichen Temperaturen (hier nicht gezeigt), wird die Zunahme der Steigung von Tmax nach 1975 betont; jedoch erscheint Tmin gleichförmiger. Man beachte, dass der Theorie der ,Treibhausgas‘-Erwärmung zufolge die Auswirkungen bei Tmin am stärksten sind. Allerdings gibt nichts davon Aufschluss darüber, was mit den CoVs um das Jahr 1990 geschehen war.

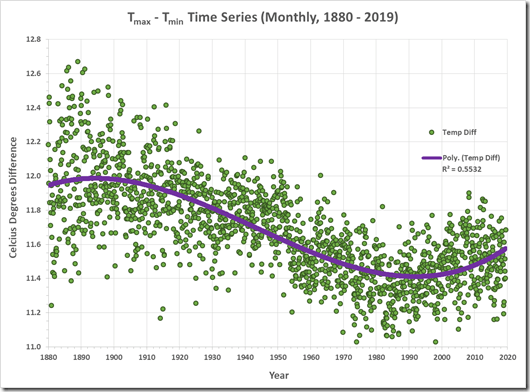

Allerdings ist ein Plot der Zeitreihe der monatlichen Daten der Differenzen zwischen Tmax und Tmin wesentlich interessanter! Wie früher schon einmal beschrieben sind diese Differenzen etwa seit Beginn des 20. Jahrhunderts kleiner geworden. Allerdings zeigt sich auch hier genau wie bei den CoVs eine ausgeprägte Änderung um das Jahr 1900! Nach einer Abnahme der Differenzen über ein Jahrhundert begannen diese wieder zuzunehmen. Die polynome Regression 3. Ordnung – dargestellt in violett – ist von keiner besonderen Bedeutung außer der Betonung der Änderungen der Differenz zwischen Höchst- und Tiefsttemperaturen. Jedoch deutet sich darin ein möglicher 200-Jahre-Zyklus an.

Es sieht so aus, als sei vor etwa 30 Jahren irgendetwas Subtiles passiert, was sich nicht in Temperatur- (oder Temperaturanomalie-)Daten allein zeigt. Abbildung 4 zeigt, dass Tmax und Tmin beide steigen. Da Tmax viel größer ist als Tmin, wird jene dazu neigen, die daraus resultierende Änderung zu dominieren, mit gleicher Prozentzahl für beide. Es scheint, als ob sowohl Tmax als auch Tmin gleichlaufend durch den El Nino 2016 beeinflusst worden wären. Die Steigung von Tmax ist zwischen 1985 und 2005 größer als von Tmin. Falls Tmax stärker steigt als Tmin, wäre dies ein Argument gegen CO2 als primärer Treiber der globalen Erwärmung.

Die Frage lautet: „Was war die Ursache der Änderungen um das Jahr 1990, und hat es irgendeine klimatologische Bedeutung?“ Eine mögliche Erklärung ist, dass die offensichtliche Änderung der Temperatur-Relationen irgendwie ein Artefakt der Aufbereitung [processing] ist; allerdings sind mir die Details des Aufbereitungs-Verfahrens von BEST nicht bekannt genug, um darüber zu spekulieren, wie diese Änderung zustande kommt. Unwillkürlich kommt einem aber der Gedanke, dass hier die Regeln von Präzision und Fehlerfortpflanzung ignoriert worden sind.

Abbildung 6: CO2-Konzentration von 1958 bis 2019 (Quelle)

Abbildung 6 ist eine Graphik der CO2-Messungen am Mauna Loa seitens des Scripps Oceanographic Institute. Betrachtet man die Graphik, scheint es leicht zu sein, das oben beschriebene Verhalten mit einem geringen Rückgang der Zunahme-Rate von CO2 nach dem Jahr 1990 zu erklären, für etwa zwei oder drei Jahre. Das heißt, falls CO2 der Haupttreiber von Temperaturänderungen wäre, scheint es nichts im Verhalten der CO2-Konzentrationen zu geben, was augenscheinlich die jüngste langzeitliche Abnahme der CoVs oder der Differenzen von Tmax und Tmin erklären würde.

Summary

Extrapolationen sind immer mit Risiken behaftet. Auf der Grundlage des Verhaltens von CoV von Tmax jedoch, welcher abzunehmen scheint, scheint es keine starke empirische Stützung für die Prophezeiung zu geben, dass zukünftige Hitzewellen schlimmer und häufiger auftreten als während der jüngeren Vergangenheit.

Eindeutig ist Tmax während der letzten 40 Jahre oder so gestiegen. Allerdings erreichte der CoV vor 30 Jahren seinen Spitzenwert und scheint derzeit immer noch abzunehmen, jedenfalls auf der Grundlage der jährlichen CoV-Werte. Weil Tmax typischerweise die Folge direkter solarer Erwärmung ist, könnte eine Abnahme der Varianz der so genannten ,Solarkonstante‘ zu einer Abnahme des CoV von Tmax führen.

Während Tmin eindeutig steigt, fast monoton, zeigt der CoV, dass die Zunahme zustande kommt, indem man das Grundniveau der Minimum-Temperaturen anhebt [?].

Man könnte versucht sein, die Effekte beiseite zu schieben, die ich als so gering beschrieben habe, dass sie keine Konsequenzen nach sich ziehen. Allerdings sind die Temperaturdifferenzen und die Standardabweichungen des über 30 Jahre geglätteten Mittels, auf welchem die CoVs basieren, hinsichtlich Dauer und Größenordnung vergleichbar mit vielen Jahrzehnten der Änderung der mittleren globalen Temperatur. Hierfür bedarf es dringend einer Erklärung. Tragen die globalen Klimamodelle diesen Sekundäreffekten in irgendeiner Weise Rechnung?

Ich möchte über das Verhalten der CoV und der Differenzen der Höchst- und Tiefsttemperaturen mit Bezug zu globalen Temperaturänderungen nachzudenken anregen.

References

C. D. Keeling, S. C. Piper, R. B. Bacastow, M. Wahlen, T. P. Whorf, M. Heimann, and H. A. Meijer, Exchanges of atmospheric CO2 and 13CO2 with the terrestrial biosphere and oceans from 1978 to 2000. I. Global aspects, SIO Reference Series, No. 01-06, Scripps Institution of Oceanography, San Diego, 88 pages, 2001.

*It is more accurate to refer to the CoVs as a “sliding sample” because only the denominator is actually a moving average.

Link: https://wattsupwiththat.com/2019/09/06/the-gestalt-of-heat-waves/

Übersetzt von Chris Frey EIKE