SZ: Bauernaufstand (Teil 1)

Damit dieser Anspruch an die Lenkung des Weltklimas und Wette „eingehalten“ wird, klagen diese drei (auf Anregung und) mit Unterstützung durch Greenpeace. Die erste Verhandlung darüber steht in Kürze bevor. Und aus diesem Anlass brachte die Süddeutsche Zeitung darüber eine ganze (Jubel-)Seite. Grund, sich die darin gelisteten Argumente anzusehen.

Biolandbau

Wohl nicht zufällig kamen in dem SZ-Artikel nur die Biobauern zu Wort. Es ist allgemein bekannt, dass Biobauern in unseren Breiten (und nicht nur dort) weiterhin das erleiden, was eine vernünftige, konventionelle Agrarwirtschaft in vielen Fällen zumindest teilweise überwunden hat: Einen desaströsen Ertrag von teils nur der Hälfte (gegenüber dem konventionellen Anbau) und schlimme, in der Regel negative Abhängigkeit vom Wetter, zuzüglich dem völligen ausgeliefert sein gegenüber Schädlingen und Pilzerkrankungen.

Eine umfassende Darstellung darüber findet sich in

Achgut: Frau Künasts Landwirtschaft im Faktencheck

Und bei EIKE 19.09.2016: Biobauern sind die größten Lebensmittel-Vernichter Ohne Klimawandel überlebt die Biolandwirtschaft ihre Ernteverluste nicht

Neue Zürcher Zeitung 4.8.2016: [6] Miserable Weizenernte im Kanton Zürich Wer ist schuld an der Missernte?

In einem Jahr wie diesem zeige sich schonungslos, dass diese ökologisch geprägte Politik nicht aufgehe. An Zürcher Sammelstellen zeige sich bezüglich der Getreideernte «der blanke Horror»: Vor 150 Jahren hätte eine solche Missernte ein Hungerjahr bedeutet, sagt Haab, jetzt müsse halt stärker auf das Ausland gesetzt werden. Dies sei die Quittung dafür, dass Bauern mit Beiträgen vom Bund im Rahmen des Extenso-Programms und mit IP-Suisse-Geldern davon abgehalten würden, ihre Weizen wirksam vor Pilzbefall zu schützen.

Bauern, die extensiv produzierten, also ohne Einsatz von Fungiziden, hätten einen Ernteausfall von rund 40 Prozent zu verkraften, konventionelle Produzenten einen solchen von 20 bis 25 Prozent, sagt er.

DIE WELT 11.08.16: [5] Ernteausfälle bei Bio-Gurken im Spreewald

Ein Betrieb aus Steinreich (Dahme-Spreewald) etwa beklagt bei Bio-Schälgurken Ernteausfälle von 70 Prozent. Grund sei eine Pilzkrankheit. Die EU stufte vor Jahren ein Mittel dagegen, das im Ökolandbau angewendet durfte, als Pflanzenschutzmittel ein. Damit darf es nicht mehr auf die Felder.

Frankfurter Rundschau 21. Juli 2016: Kleine Körner, faule Kartoffeln

Auch Kartoffeln dürfte es dieses Jahr weniger geben. Die Kraut- und Knollenfäule wütet, eine Pilzkrankheit, die ebenfalls durch Nässe ausgelöst wird. „Auf manchen Äckern gibt es Einbußen bis zu 100 Prozent“, sagt Weber.

[3] Insbesondere für die Erzeuger von Biokartoffeln war die Ausbreitung des Krautfäuleerregers Phytophthora infestans ein großes Problem; im Ökoanbau wurde auch ein vermehrtes Auftreten von Kartoffelkäfern beobachtet.

topagrarONLINE, 09.08.2016: Bio-Kartoffelbauern in der Pfalz drohen 100 Prozent Ernteausfall

Feucht-warme Witterung begünstigt die Krankheit und kann zu Ertragsverlusten von 20 bis 40 % oder sogar zu Totalschaden führen. Die Behandlung mit Kupfer, die im Bio-Anbau bis zu einer bestimmten Grenze pro Hektar erlaubt ist, greift bei häufigen Niederschlägen nicht, weil das Kupfer sofort wieder von der Pflanze abgewaschen wird und damit wirkungslos bleibt. Andere Pflanzenschutzmittel, wie zum Beispiel das systemisch wirkende und komplett abbaubare Kaliumphosphonat, sind beim Bio-Anbau nicht erlaubt.

Die Ökobauern befinden sich aufgrund des dauerhaft feuchten Wetters im Frühjahr und Frühsommer 2016 in einer Zwickmühle. Entweder sie verlieren ihr Biosiegel oder die komplette Ernte.

Rückblick auf die „erstrebte“, vorindustrielle Agrarzeit

Wie das früher aussah, liest sich wie folgt:

[3] Erntemengen

… Im frühen Mittelalter um 1000 n. Chr. lag das Verhältnis von Aussaatmenge zu Erntemenge bei etwa 1:3. Das bedeutet, dass aus 1 kg ausgesätem Weizen 3 kg neu heranwuchsen. Davon musste 1 kg für die nächste Aussaat zurückgelegt werden. Von den verbliebenen 2 kg musste der Bauer Abgaben leisten (Steuern zahlen). Das Erntegut war zudem ständig von Ungeziefer und Schimmel bedroht. Da blieb nur wenig für die eigene Ernährung. Ein Grund für das schlechte Verhältnis war die ständige Bedrohung durch Schädlinge und Pflanzenkrankheiten. In einigen Jahren wurden bis zu 50% der Ernte vom Wild zerstört. Dazu kamen Heuschrecken, Käfer, Mäuse, Pilzkrankheiten, Sturm, Hagel und Dürre. Außerdem war der Ertrag durch den Mangel an Pflanzennährstoffen ohnehin sehr gering …

WIKIPEDIA: Hunger war im Mittelalter so weit verbreitet, dass er neben Krieg, Pestilenz und Tod als einer der „vier Apokalyptischen Reiter“ galt. Bei der Hungersnot von 1315–1317 starben in Europa mehrere Millionen Menschen. Die schwerste Hungersnot im 15. Jahrhundert in Europa fand 1437 bis 1439/40 statt. In Industrieländern kommen Hungersnöte heute praktisch nicht mehr vor, aber weiterhin in Entwicklungsländern.

WDR 09.08.2010: Fast alle Menschen verzweifeln. Sie verzehren die Kadaver verendeter Tiere. Viele Arme sterben vor Hunger.“ Das schreibt der Mönch Reiner 1196 in den Annalen des Klosters St. Jakob in Lüttich. Weiter heißt es: „Die Armen lagen auf den Straßen umher und starben; auch vor der Tür unserer Kirche lagen sie zur Zeit der Matutin seufzend und sterbend.“ Reiner von Lüttich beschreibt in kurzen lateinischen Sätzen eine der größten Hungersnöte des Mittelalters. Ein Jahr zuvor, 1195, zerstörten Dauerregen und Unwetter die Ernte. „In diesem Jahr regnete es beständig vom Johannisfest (im Juni) bis Weihnachten … außerdem richtete ein schweres Unwetter nach dem Jakobusfest (im Juli) alle Feldfrüchte zugrunde“ erzählt Reiner von Lüttich in den Klosterannalen, eine der wichtigsten Quellen für die Naturkatastrophe. Ein Jahr später, 1196, breitet sich die Hungersnot über das heutige Belgien, Lothringen, West- und Süddeutschland bis nach Österreich aus … Die Hungersnot, die auf den verregneten Sommer 1195 folgt, endet erst nach drei Jahren. Wie viele Menschen daran gestorben sind, ist nicht überliefert.

Keine Belege, aber enorm viel „Wissen“

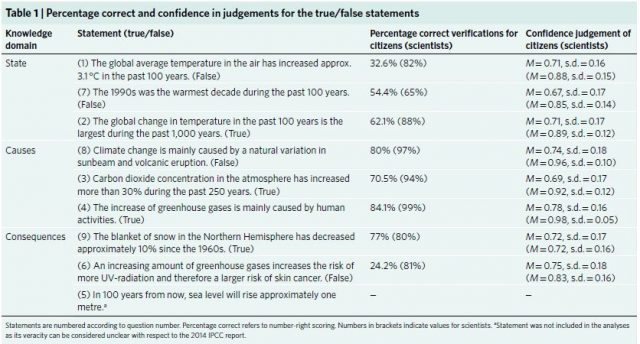

Es wurde schon oft thematisiert, wie das, was man oft genug in den Medien liest, als „selbst erlebt“ empfunden und auch so wiedergegeben wird:

EIKE 03.07.2019: [Link] Wozu (gegenteilige) Messwerte betrachten? Den Klimawandel fühlt doch jeder

In praktisch allen Klima-Alarmpublizierungen wird dieser psychologische Effekt ausgenutzt, um „Belege“ zu produzieren und keine Fakten zeigen zu müssen. Die SZ – nicht ohne Grund „Alpenprawda“ genannt -, beherrscht und pflegt dieses Vorgehen virtuos. Im nun rezensierten Artikel ist nicht eine Spur konkreter Belegführung zu finden, aber eine Aneinanderreihung schlimmer „Betroffenheitsaussagen“, die ersatzweise als Belege herhalten sollen. Selbstverständlich findet sich darin auch der „erforderliche“ Professor, der alles bestätigen kann, indem er ebenfalls Gemeinplätze wiederholt.

Bauern spüren schon heute die drastischen Folgen des Klimawandels

SZ: [1] „Vertrocknete Felder, Schädlinge und Obst, das verdirbt – Bauern spüren schon heute die drastischen Folgen des Klimawandels. Drei von ihnen verklagen nun die Bundesregierung, weil die ihre Ziele nicht einhält … “

Eine wirklich schlimme Ansage, die in der SZ sozusagen als feststehende Tatsache beschrieben steht. Nun hat der Autor gerade erst Ernteergebnisse zusammengetragen und in Relation zu historischen Werten, als alles angeblich viel besser war, gestellt:

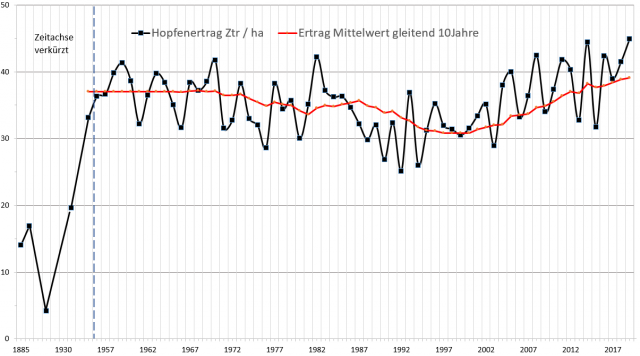

EIKE 08.09.2019: [4] Hopfenertrag 2019

EIKE 03. September: [7] GRÜNE, Bauern und Klimawandel: Im Jammern bilden sie eine Symbiose

Das Ergebnis daraus: So gut wie seit ca. 20 Jahren sind die wichtigen Erträge in der Landwirtschaft in der gesamten Historie noch nie gewesen! Wo die „ drastischen Folgen … “ zu finden sein sollen, ist dem Autor mehr als ein Rätsel.

Zum Beleg anbei die wichtigen Grafiken aus den zwei Artikeln:

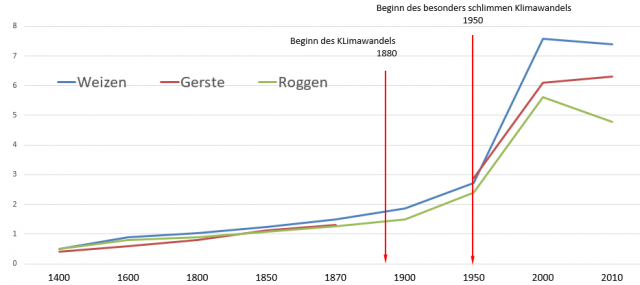

Bild 1 Ernteerträge (als Relativzahl) von 1400 – 2010. Grafik vom Autor erstellt. Datenquelle: Blog Heimbiotope, Tabelle mit historischen Getreideerträgen

SZ: [1] „ ... die Folgen sind schon jetzt deutlich zu spüren: Die deutsche Getreideernte 2018 war die niedrigste seit 1994 …“.

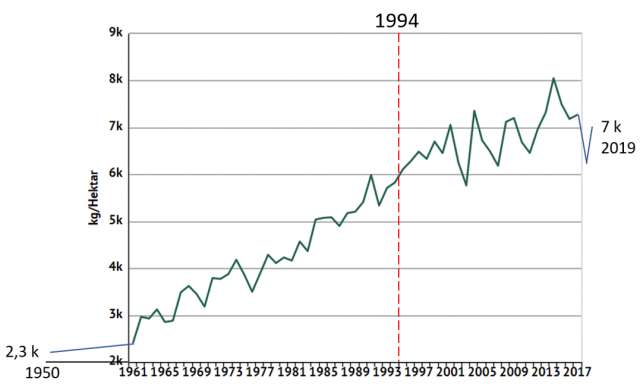

Wer das folgende Bild 2 betrachtet, erkennt die sorgfältig getextete und bewusst irreführende Aussage dieses Satzes. Ein ausgewähltes Einzelereignis wird als negativer Trend suggeriert, wissend, dass mangels Verlaufsgrafik – die seit 1994 einen deutlichen Ertragsgewinn ausweist – kein Leser den Wahrheitsgehalt überprüfen kann und so niemand die Perfidität und bewusste Tatsachenverdrehung hinter dem Satz bemerkt. So etwas bezeichnet sich trotzdem und ungestraft als „Qualitätsjournalismus“ (der Beitrag von Greenpeace dazu, sei hier nicht kommentiert).

Bild 2 Getreide gesamt, Ertrag Deutschland 1950 bis 2019. Bildquelle: Deutschland – Getreideertrag, Grafik vom Autor um die Randdaten und Zusatzangaben ergänzt

Bild 3 Hopfenernte Deutschland, Ertragsverlauf 1955 – 2019 und 10jähriger, gleitender Mittelwert. Zeitachse vor 1955 verkürzt. Daten bis 1946 Quelle: Blog Heimbiotope, Tabelle mit historischen Ernteerträgen. Grafik vom Autor erstellt

Geht der Klimawandel gezielt auf Obstbauern los?

Nun könnte es vielleicht sein, dass dieser grandiose Ernte-Erfolg des sich seit der schlimmen Kaltzeit zum Glück wieder erwärmendem Klima, genannt: „Schlimmer, vom (vorwiegend westlichen) Menschen verursachter Klimawandel“, nur für Korn und Hopfen gilt. Klagen tun aber Obstbauern. Vielleicht hat der Klimawandel nur auf diese sein spezielles Augenmerk geworfen?

Dazu Berichte und Daten über jüngste Ernteergebnisse:

SZ 21. August 2018: Umwelt: Der Rekord bei der Apfelernte ist auch ein Problem

Die Hitze sorgt für ein Rekordjahr bei der Apfelernte. Allerdings bedeutet das, dass sich die Bäume schlechter für kommendes Jahr vorbereiten können …

topagraronline: Überdurchschnittliche Apfel- und Birnenernte im Jahr 2018

Die deutschen Obstbaubetriebe erwarten im Jahr 2018 eine Apfelernte von 1,1 Mio. t und eine Birnenernte von 46 800 t. Wie das Statistische Bundesamt nach vorläufigen Schätzungen zum August 2018 weiter mitteilt, wird die Apfelernte damit um knapp 17 % über dem Durchschnitt der letzten zehn Jahre von 934 600 t liegen.

Und so war es 2019:

NDR 2019: Mit 265.000 Tonnen Ernteertrag rechnet die Obstbauversuchsanstalt in Jork, das sind etwa 13 Prozent weniger als 2018. Dafür sei die Qualität besonders gut, sagt Ulrich Buchterkirch von der Fachgruppe Obstbau im Landvolk Niedersachsen.

Stern.de 28. Juni 2019: Obstbauern erwarten sehr gute Kirschenernte

Wiesbaden – Die deutschen Obstbauern können sich in diesem Sommer erneut über eine üppige Kirschenernte freuen. Trotz vereinzelter Einbußen durch Spätfröste und Trockenheit stehe ein sehr gutes Erntejahr bevor, teilte das Statistische Bundesamt mit. Nach einer ersten Schätzung rechnet die Wiesbadener Behörde 2019 mit einer Kirschenmenge von 62 200 Tonnen – deutlich über dem Schnitt der vergangenen zehn Jahre mit 48 700 Tonnen. Schon 2018 hatten die Obstbauern mit gut 60 000 Tonnen eine sehr gute Ernte eingefahren

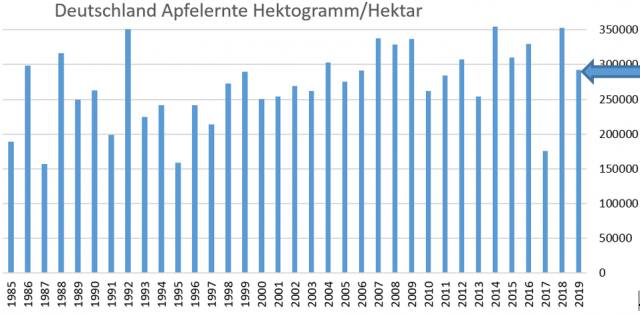

Und nun die im SZ-Artikel wohl „zufällig“ fehlenden Grafiken: 2014 und 2018 gab es die höchsten Erträge in der aufgezeichneten, deutschen Apfelgeschichte:

Bild 4 Deutschland Apfelernten Erträge 1985 – 2019. Quelle: factfish.com. Erträge für 2018, 2019 vom Autor ergänzt. Grafik vom Autor erstellt

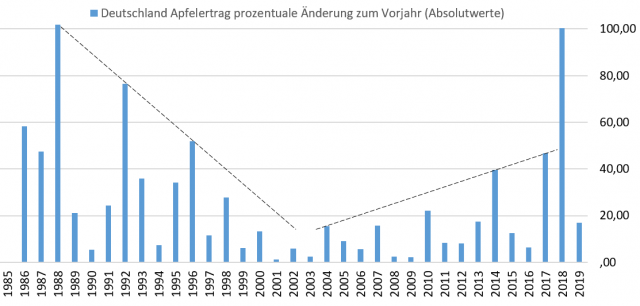

Bild 5 Deutschland Apfelernten Erträge. Prozentuale Änderung zum Vorjahr (Absolutwert) 1985 – 2019. Quelle: factfish.com. Erträge für 2018, 2019 vom Autor ergänzt. Grafik vom Autor erstellt

Wie man sieht, gibt es unglaublich hohe Ertragsschwankungen. Früher ganz schlimm, dann eine längere Zeit geringer und in letzter Zeit plötzlich einmal ein Wert fast so hoch wie früher. Wer würde bei dem Bild aber nicht auch an einen Ausschnitt einer Zyklik denken; doch an einen zunehmenden, schlimmen, früher noch nie dagewesenen, negativen Ertragseinfluss des Klimawandels wohl kaum.

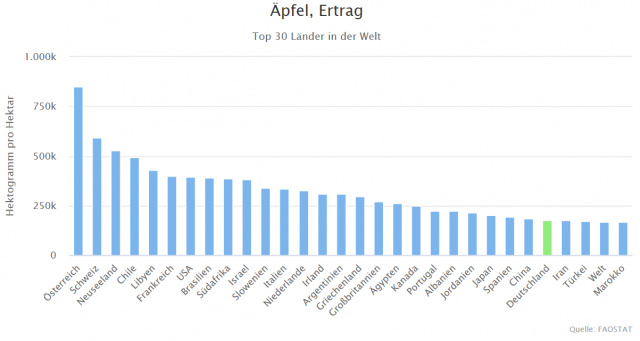

Wo man vielleicht weinen kann, ist beim Ertrag im internationalen Vergleich. Deutschland, sonst oft Vorreiter, liegt damit ziemlich am hintersten, leider auch untersten Ende. Wenn man dann noch wie die Biobauern mit einem reduzierten Ertrag von bis zu 50 % von diesem Bisschen „herumkrabbelt …. “. Vielleicht stimmt diese Statistik aber auch nicht so ganz.

Bild 6 Apfelernte. Erträge im internationalen Vergleich. Quelle: factfish.com

Ergänzend noch eine Darstellung zu diesem Thema von kaltesonne:

[10] kaltesonne 24. Januar 2019: Obstbauer klagt gegen Klimawandel – trotz Rekordapfelernte 2018

(Auszug) EV: Sie bauen auf 23 Hektar vor allem Äpfel an. Haben Sie wenigstens vom Hitzesommer profitiert? Die Ernte fiel in diesem Jahr doch gut aus?

Blohm: Wir haben gerade erst abgeerntet, den Ertrag müssen wir noch schätzen. Doch wir wissen schon, dass es Einbußen gibt. Viele Äpfel haben Sonnenbrand, also dunkle Flecken und ledrige Haut. So kauft uns die keiner ab. Auch die Trockenheit war ein Problem. Im Frühjahr 2017 hatten wir dafür Starkregen, Hagel und Sturm. Da bildete sich Staunässe, die Erde ist aufgeweicht und die Bäume sind regelrecht abgesoffen und dann umgekippt. Wir beobachten seit zehn Jahren immer mehr solcher Wetterextreme.

kaltesonne: Im Meckern ist Johannes Blohm ziemlich gut. In Wirklichkeit war 2018 ein absolutes Rekordjahr für die Apfelernte. So ein wenig erinnert Blohm an ein verhätscheltes Millionärskind, das alles hat, aber dann wegen eines Flecks auf dem Ferrari ungehalten wird. Die Rückfragen der Zeit sind jedoch zum Glück ausgezeichnet:

EV: Könnten das nicht Launen der Natur sein?

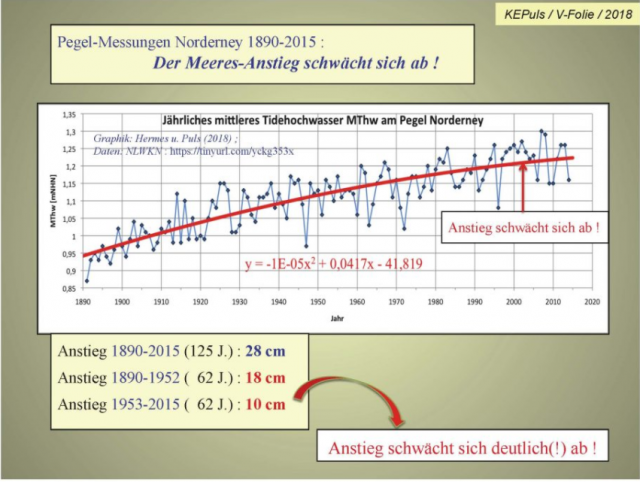

Blohm: Mein Vater betreibt den Hof seit 30 Jahren, seit 1560 steht unsere Familie in den Kirchenbüchern, aber solche Extreme haben wir noch nie erlebt. Früher hagelte es vielleicht ein Mal in fünf Jahren, das war schon schlimm genug. Jetzt hagelte es drei Jahre in Folge. Und dass der Meeresspiegel steigt, merken wir auch längst.

EV: Inwiefern?

Blohm: Weil die Pole schmelzen und mehr Wasser in die Elbe fließt, gelangt durch den Druck auch mehr Salz ins Elbwasser. Begießen wir damit die Äpfel, legt sich eine Salzschicht auf die Früchte. Wenn der Pegel weiter steigt, wird auch das Hochwasserrisiko bei Sturmfluten zunehmen. Wir liegen hier einen halben bis einen Meter unterm Meeresspiegel, die Deiche könnten bald nicht mehr ausreichen.

kaltesonne: Genau das ist das Problem. Aus subjektivem Empfinden wird einfach in unwissenschaftlicher Weise verallgemeinert. Beispiel Hagel: Als Hagel wird fester Niederschlag bezeichnet, der aus Eis besteht und einen Durchmesser von mindestens 5 mm hat. Die meisten Hageltage in Deutschland gibt es zwischen Mai und August. Aufgrund der relativ geringen räumlichen Ausdehnung von Hagelstreifen und der kurzen Dauer der Hagelschauer von wenigen Minuten ist Hagel ein nur äußerst schwierig quantitativ zu erfassendes meteorologisches Phänomen. Eine offizielle deutsche Zeitreihe der Hagelentwicklung der letzten Jahrzehnte gibt es daher noch nicht, wobei der DWD derzeit noch nach Lösungen sucht.

In einer Diplomarbeit der Universität Münster (pdf hier) dokumentiert Jan Deepen eine hohe jährliche Variabilität von Hagelereignissen in Deutschland, wobei der Hagel-Trend in den letzten 80 Jahren rückläufig ist. Ähnlich sieht es das Climate Service Center Germany. Mittlerweile fanden internationale Studien, dass die Häufigkeit von Hagel offenbar weitgehend unabhängig von der Entwicklung der Durchschnittstemperatur ist und Hagel in China trotz Erwärmung in den letzten 50 Jahren seltener geworden ist (Xie et al. 2008, 2010). Auch in der Tschechischen Republik hat die Hagelhäufigkeit während der letzten 100 Jahre offenbar abgenommen (Brazdil et al. 2016). Aufgrund der schlechten Beobachtungsdatenbasis entwickelten Mohr et al. 2015 ein Modell für Europa, das für die vergangenen 60 Jahre jedoch keinen Trend fand.

Blohms Geschichte zum Meeresspiegel und seinen Auswirkungen auf seine Äpfel sind so kurios, dass wir sie einfach mal so stehen lassen und darüber schmunzeln.

Warme Sommer

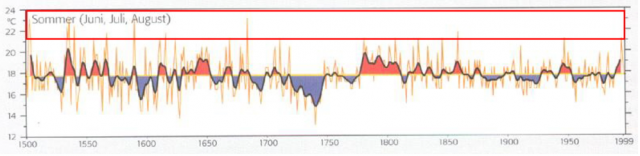

Es ist wohl ein Gerücht, dass so schöne, warme Sommer wie sie derzeit bei uns „lamentiert“ werden früher nie auftraten. Dass solche in den üblichen Verlaufsgrafiken nicht erkennbar sind, liegt oft alleine an der mangelnden Auflösung der Proxis, oder Mittelungen. Liegt eine ausreichende Auflösung vor, kann man die wirkliche Vergangenheit sehen:

Selbst während der vergangenen Kaltzeit heiße Sommer:

Bild 7 Temperaturverlauf Sommer 1500 – 1999. Quelle Quelle: Glaser, Rüdiger, Klimageschichte Mitteleuropas, 1000 Jahre Wetter, Klima, Katastrophen, ISBN 353414687-5 (Anm.: Bild von einer Ausarbeitung von „klimakontroverse.de“ übernommen)

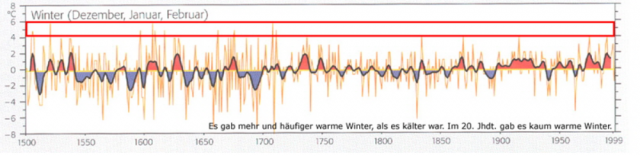

Und „warme“ Winter:

Bild 8 Temperaturverlauf Winter 1500 – 1999. Quelle Quelle: Glaser, Rüdiger, Klimageschichte Mitteleuropas, 1000 Jahre Wetter, Klima, Katastrophen, ISBN 353414687-5 (Anm.: Bild von einer Ausarbeitung von „klimakontroverse.de“ übernommen)

Salzwasser in der Elbe

[10] kaltesonne : (Einer der klagenden Bauern) Blohm: Weil die Pole schmelzen und mehr Wasser in die Elbe fließt, gelangt durch den Druck auch mehr Salz ins Elbwasser. Begießen wir damit die Äpfel, legt sich eine Salzschicht auf die Früchte. Wenn der Pegel weiter steigt, wird auch das Hochwasserrisiko bei Sturmfluten zunehmen. Wir liegen hier einen halben bis einen Meter unterm Meeresspiegel, die Deiche könnten bald nicht mehr ausreichen.

Eine ergänzende Beschreibung: MSN Nachrichten 10.09.2019 : Folgen des Klimawandels: Apfel-Krise im Alten Land

Problematisch ist außerdem der gestiegene Salzgehalt der Elbe, mit deren Wasser viele Bauern ihre Plantagen bewässern. Das Salz schädigt die Blätter und sie können die Früchte nicht mehr so gut von der Sonne abschirmen. Den Äpfeln droht „Sonnenbrand“.

Nun ist der Klimawandel also auch schuld, dass aufgrund der Flußvertiefung und weiterer, baulicher Elbmaßnahmen mehr Salzwasser in die Elbe dringt. Für Folgen solcher Baumaßnahmen erhalten betroffenen Bauern wohl wenig, oder kein Geld, wenn es aber der Klimawandel wäre …

Heute klagen gegen eine Gefahr, die in 2 … 5tausend Jahren eintreten könnte

SZ: [1]: Doch das friedliche Bild täuscht, die kleine Insel ist in Gefahr, auch wegen des steigenden Meeresspiegels. „Irgendwann saufen wir hier vielleicht ab. Diese Angst schwebt über allem“ … sagt Backsen. Das eigentliche Problem für Bauern an der Nordseeküste liegt weit im Norden. Schmilzt das komplette Landeis Grönlands werden die Ozeane um fast sieben Meter ansteigen …. damit sie den Hof auch in Zukunft noch bewirtschaften können, muss die Regierung nach Ansicht Becksens …

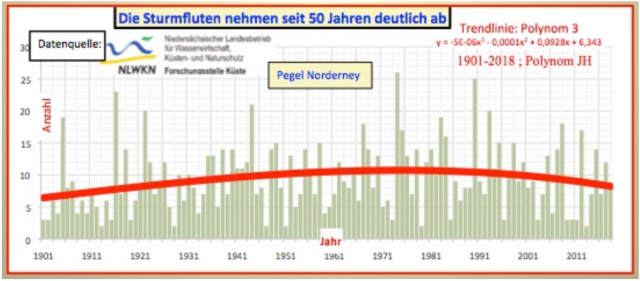

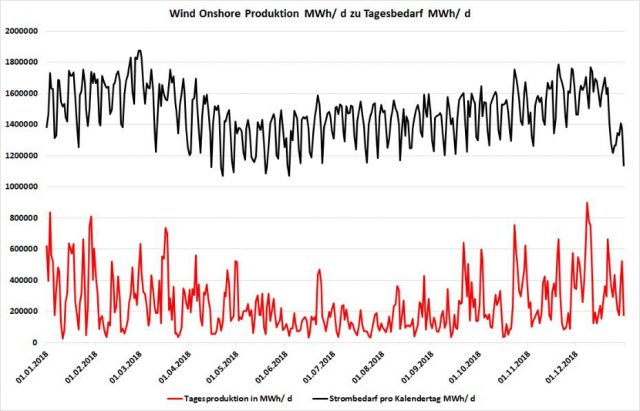

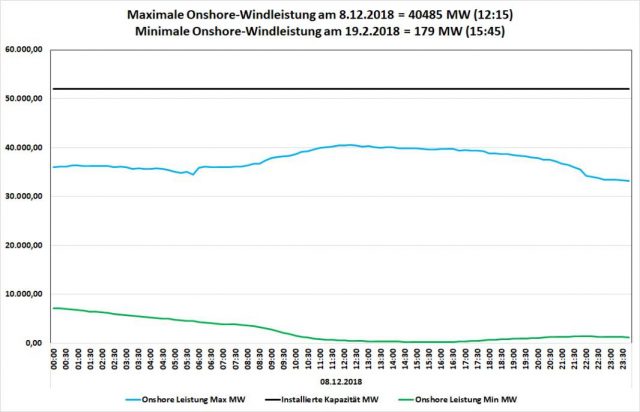

Vor Kurzem hat Herr Puls gezeigt, dass die Nordsee zwar eine „Mordsee“ sein kann, der Klimawandel aber für etwas Beruhigung sorgt:

EIKE 25. August 2019: [11] Klima-Ruhe an der Nordsee

[12] kaltesonne 6. März 2018: Extremwetter in den letzten tausend Jahren

… Wenn das 13. Jahrhundert als eins für die Menschen in Deutschland und Europa angenehmes Jahrhundert bezeichnet werden kann, trifft für das nächste Jahrhundert das Gegenteil zu. Natürlich hat es in allen Jahrhunderten, auch im 13. örtliche Unwetter mit Gewitter, Sturm und Überschwemmung gegeben, die sind hier aber nicht gemeint. Wie auch in den vorausgegangenen Zeiten finden die Sturmfluten an der Nordseeküste das Hauptaugenmerk der Chronisten. Fünfzehn schwere Sturmfluten werden erwähnt weil sie viele Menschenleben forderten und es große Landverluste gab. Am schlimmsten war wohl die vom 16 Januar 1362. die als die große Mannstränke in die Geschichte eingegangen ist. Der heutige Küstenverlauf ist zum großen Teil durch diese Flut entstanden. Neben den Schaden bringenden Sturmfluten ist dieses Jahrhundert aber vor allem durch Nässe, Überschwemmungen und Kälte im Inland gekennzeichnet ….

Extremwetter Fazit

Selbst wenn man den Chronisten einige Übertreibungen unterstellt, dürfte feststehen, dass Extremwetter in der Vergangenheit nicht seltener, sondern öfter eintraten und diese Ereignisse nicht harmloser, sondern schlimmer waren, als das was wir heute erleben.

Verglichen mit den vergangenen 1000 Jahren, leben wir heute in einer ruhigen Zeit. Am ähnlichsten scheint mir noch das 13. Jahrhundert mit dem 20. Jahrhundert zu sein. Zwar scheinen Hunger in einer globalisierten Wirtschaft nicht mehr vorstellbar, zumindest in den s. g. entwickelten Ländern. Auf die Marktpreise hat das Wetter auch heute noch Einfluss, wie man selbst bei kleinen Wetterabweichungen wie ein Spätfrost im April in 2017 beobachten konnte. Da erfroren mal eben die Blüten an den Obstbäumen und schon waren Kirschen und Äpfel knapp und teuer.

Was würde heute geschehen, wenn wie in all den Jahrhunderten der kleinen Eiszeit, die Flüsse in Europa zufrieren würden, oder der Winter von Oktober bis Juni anhält? Wie würden wir reagieren, wenn Niederschläge und Überschwemmungen, oder Hitze und Dürre Ausmaße annehmen wie sie die Chronisten beschrieben haben? Und wer garantiert uns, dass es nicht doch wieder mal so kommt, denn Extremwetter hat es zu allen Zeiten gegeben, egal ob das Klima kälter oder Wärmer war. Es hat den Anschein, dass es in den wärmeren Perioden etwas weniger WetterAbweichungen vom „Normalen“ gab. Das mag aber auch daran liegen, dass die Extreme zum Kalten hin für uns Menschen schädlicher sind als die zum Warmen hin. Klar dürfte auch sein, dass wir Menschen Extremwetter nicht verhindern und auch nicht herbei zaubern können, selbst nicht mit Kohlendioxyd.

Aber der Bauer verweist ja auf Grönland. Die 7 m Pegelanstieg, welche von dort her drohen, haben wirklich gewaltige Ausmaße. Da muss man schon zustimmen. Wenn dem so ist, hat man allen Grund zu sagen: „Diese Angst schwebt über allem“ und täglich schlecht zu schlafen, mindestens so lange, bis wenigstens unsere Berliner Politik mit viel Aufwand und vor allem vielen Kosten als weltweites Vorbild CO2 reduziert.

Wie lange muss man allerdings schlecht schlafen?

scinexx: …. Selbst bei einer Erwärmung von zwei Grad würde es mindestens 50.000 Jahre dauern, bis das Grönlandeis komplett verschwunden sei. „Je stärker wir die Temperaturgrenze überschreiten, desto schneller schmilzt das Eis“, sagt Erstautor Alexander Robinson vom Potsdam-Institut für Klimafolgenforschung (PIK)

Das ist aber das Ergebnis „moderner“ PIK-Simulationen, die besonders alarmierend parametriert sind. Mit ziemlicher Sicherheit funkt bis dahin die längst überfällige Eiszeit gehörig dazwischen. Nur „wissen“ das die Simulationen nicht, weil sie – beziehungsweise deren Programmierer – die Klimazyklen nicht und schon gar nicht die Eiszeiten verstehen.

Wie rasend schnell die angeblich „sicheren“ Erkenntnisse und damit auch die Klima-Simulationsprogramme, wie auch deren Ergebnisse veralten, zeigt exemplarisch das „kaltesonne“-Publizierverzeichnis

Darin lassen sich mehrmals im Jahr immer neue Erkenntnisse lesen (kleiner Auszug):

Vor 8000 Jahren war es in Grönland 5°C wärmer als heute: Grönlandeis robuster als gedacht (3.7.2018)

Zentrum des grönländisches Inlandeises gewinnt an Masse und bewegt sich langsamer als im Durchschnitt der letzten 9000 Jahre (9.2.2017)

Bewegung des grönländischen Inlandeises verlangsamt sich: Presse sprachlos und vergisst vor lauter Überraschung, darüber zu berichten (14.1.2016)

Stanford University: Polare Eisschilde stabiler als gedacht, Meeresspiegelanstieg weniger dramatisch als befürchtet (13.1.2016)

Wo ist der ominöse Kipppunkt? Vor 120.000 Jahren war es 4 Grad wärmer und das grönländische Eis hielt stand (17.10.2013)

Ende von Teil1, Teil 2 folgt demnächst.

Quellen

[1] SZ 7./8. September 2019: Bauernaufstand

[2] aepfelundkonsorten.org, PV-Jahresheft-2011: Verkehrte Kirschenwelt Über die Sortenentwicklung und die fatale „Außerwertsetzung“ alter Süßkirschsorten

[3] Prof. Dr. Peter Weingarten: Landnutzungswandel vor dem Hintergrund der Perspektiven in der Agrar- und Energiepolitik

[4] EIKE 08.09.2019: Hopfenertrag 2019

[5] EIKE 03. September: GRÜNE, Bauern und Klimawandel: Im Jammern bilden sie eine Symbiose

[6] Zeitschrift für Pflanzenkrankheiten und Pflanzenschutz 1976, S. 53-58: H. Engel; Untersuchung über die Besatzdichte der Kirschfruchtfliege

[7] Landesamt für Natur, Umwelt und Verbraucherschutz Nordrhein-Westfalen: Klimawandel und Klimafolgen in Nordrhein-Westfalen Ergebnisse aus den Monitoringprogrammen 2016 LANUV-Fachbericht 74

[8] EIKE: Klima-Ruhe an der Nordsee

[9] kaltesonne 4. Juli 2019: Futurezone.de am 20. Juni 2019

[10] kaltesonne 24. Januar 2019: Obstbauer klagt gegen Klimawandel – trotz Rekordapfelernte 2018

[11] EIKE 25. August 2019: Klima-Ruhe an der Nordsee

[12] kaltesonne 6. März 2018: Extremwetter in den letzten tausend Jahren

[13] Kottfoff et al. 2017: Marine core M0059, Little Belt, western Baltic Sea, TIME: Last 8000 years

[14] ScienceScepticalBlog 9. September 2019: Mojib Latif, Präsident des Club of Rome: Der Norden im Klimawandel!

[15] topagrarONLINE 30.07.2019: Bauernfamilien und Greenpeace verklagen Bundesregierung wegen Klimapolitik

[16] EIKE: 12.Sept. 2019: … Umweltpakt … UNO auf dem Weg ins Mittelalter

[17] EIKE 22.07.2016 : Wurde ein Klimawandel-Einfluss bisher übersehen? Was ist, wenn Gott anstelle von CO2 das Klima lenkt?

[18] EIKE 27. November 2017: Die Rede unseres Bundespräsidenten, F. W. Steinmeier auf COP23 über den Klimawandel war (k)eine investigative Sternstunde – Teil 2 (2)

[19] Achgut: Klima: Deutschlands Ruf first!