Im ersten Teil ging es vorwiegend um allgemeine Probleme des Biolandbaus, sowie um die enormen, positiven Auswirkungen des Klimawandels auf die Ernteerträge, vor allem auch in Deutschland.

Wenn es die Erträge nicht sind, was ist es dann?

Wenn das Wetter Ernten nicht oder wenig schädigt, dann machen es andere Begleiterscheinungen der „ach so gütigen“ Natur:

Wie war es früher: [3] … in Grund für das schlechte Verhältnis war die ständige Bedrohung durch Schädlinge und Pflanzenkrankheiten. In einigen Jahren wurden bis zu 50% der Ernte vom Wild zerstört. Dazu kamen Heuschrecken, Käfer, Mäuse, Pilzkrankheiten …

WIKIPEDIA: Die als Große Hungersnot in die Geschichte eingegangene Hungersnot zwischen 1845 und 1849 war die Folge mehrerer durch die damals neuartige Kartoffelfäule ausgelöster Missernten, durch die das damalige Hauptnahrungsmittel der Bevölkerung Irlands, die Kartoffel, vernichtet wurde … Infolge der Hungersnot starben eine Million Menschen, etwa zwölf Prozent der irischen Bevölkerung …

WIKIPEDIA: Die aus Nordamerika stammende Blattlaus-Verwandte wurde in den 1860er Jahren durch Rebstöcke von der Ostküste Amerikas über London ins südliche Frankreich eingeschleppt (ab 1863 nachgewiesen) und breitete sich in der Reblausinvasion rasant von dort über sämtliche europäische Weinbaugebiete aus. In der Folge kam es im europäischen Weinbau zu dramatischen Verwüstungen, der sogenannten „Reblauskrise“ oder „Reblauskatastrophe“.

Wer als Bauer einem Redakteur sagt, das dürfe heutzutage ja wohl nicht mehr so sein, – vielleicht, weil eine abgebrochene Theologiestudentin der GRÜNEN die Natur „besprochen“ hat (Bild) -, sollte diesem Beruf fern bleiben. Macht man aber nicht, sondern prozessiert, damit alle Bürger für die vollkommen unsinnige und nutzlose CO2-Vermeidung immense Summen bezahlen sollen, zusätzliche Begründung:

SZ: [1] „... doch die Kirschfruchtfliege hat für die Bäume vor drei Jahren das Aus bedeutet. Mit global steigenden Temperaturen … Biologischen Schutz gegen die Fliege gibt es nicht und Pestizide sind im Ökolandbau nicht erlaubt … früher waren unsere Kirschen garantiert madenfrei …

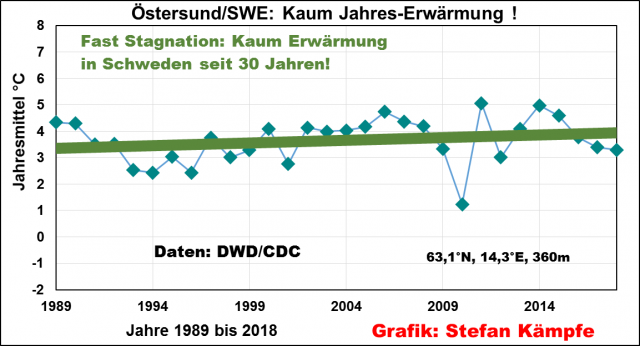

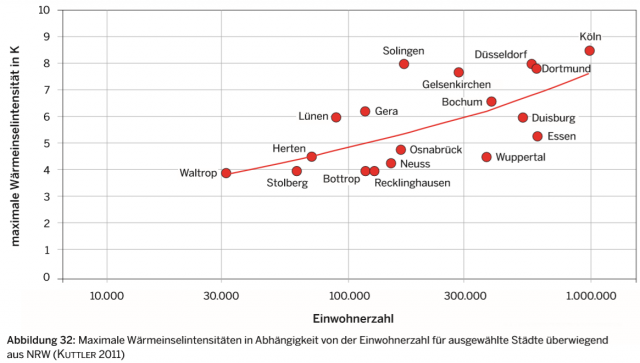

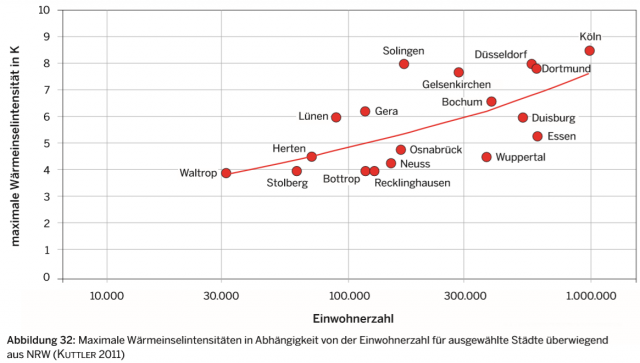

Nun ist die Kirschfliege wirklich ein großes Problem. Nur hat es mit einem Klimawandel wohl weniger zu tun. Die im SZ-Artikel angesprochenen, plus 1 Grad Erwärmung in den letzten 30 Jahren ist auch für diese Fliege nicht wirklich viel und kann nur wenig Ursache der dortigen Verbreitung sein. Aber die Städte und selbst Randgebiete bekommen durch die Urbanisierung wesentlich höhere Inseltemperaturen [7]. Die dort (auch privat) gepflanzten Obstbäume sind damit ein ideales Brut- und Ausbreitungsgebiet solcher mehr Wärme liebender, teils eingeschleppter Arten.

Bild 11 Wärmeinseleffekt in Städten [7]

Wer behauptet, durch eine Billiarden über Billiarden kostende, weltweite CO2-Reduzierung mit vielleicht (selbst das ist nicht im Ansatz gesichert) wenigen Zehntel Grad Schadfliegenprobleme lösen zu können, hat einfach eine Klatsche im Kopf. Bei einer urbanen Wärmeinsel-Erwärmung latenter Brutgebiete, beginnend bei 3 … 4 Grad und bis 8 … 9 Grad reichend ist diese – hypothetische – Temperaturverringerung vollkommen bedeutungslos.

Einem SZ-Redakteur würde eine solche Betrachtung aber nie einfallen und Greenpeace schon gar nicht, denn dieser NGO lebt schließlich davon.

Aber auch aus einem anderen Grund würde es überhaupt nichts nützen. Es gibt inzwischen eine neue, eingeschleppte Kirschfliegenart, die „Kirschessigfliege“, welche sich auch bei niedrigeren Temperaturen noch „wohlfühlt“ und viel schlimmer als die bisher in Europa verbreitete wirkt, und gegen die eine Erwärmung fast hilfreich wäre:

… Die Kirschessigfliege richtet aber den weitaus größeren Schaden an, da sie sich unglaublich schnell vermehrt: Bei einer Entwicklungszeit von gerade einmal acht bis vierzehn Tagen sind zehn bis dreizehn Generationen pro Saison möglich …

WIKIPEDIA: Die Kirschessigfliege bevorzugt gemäßigtes Klima. Temperaturen von 30 °C schränken die Aktivitäten und über 32 °C auch die Vermehrung ein. Damit sind große Teile Europas für eine Ansiedlung geeignet. Eine Einschränkung der Entwicklung dürfte es lediglich in sehr heißen Gebieten Südeuropas und in Teilen Nordeuropas geben …

Der betroffene Bauer spricht im SZ-Artikel dazu jedoch ein Thema an: „Pestizide sind im Ökolandbau nicht erlaubt“.

Wer sich der Möglichkeit einer Schädlingsbekämpfung selbst beraubt, bekommt eben auch wieder die Probleme der Altvorderen; da kann die Natur gnadenlos sein.

Ob diese Kirschen früher „garantiert madenfrei“ waren, mag sein, da die (alte) Kirschfliege im Norden wenig auftrat:

Ökolandbau: Ökologischer Anbau von Süßkirschen

… In Norddeutschland, nördlich von Hannover, taucht die Kirschfruchtfliege selten auf …

Spätestens seit 2007 gibt es sie aber auch dort, wie es ein alter Zeitungsartikel ausweist:

Hamburger Abendblatt 21.05.07: Altes Land: Bauern in Angst vor der Kirschfruchtfliege

Die europäische Kirschfruchtfliege ( Rhagoletis cerasi ) war bisher eher im Süden verbreitet. Doch im vergangenen Jahr ist sie auch an verschiedenen Stellen in Hamburg und im Umland aufgetaucht. Klopp: „Die Ursache für ihr Auftreten ist uns noch unbekannt. Vielleicht sind die Tiere mit Früchten eingeschleppt worden. Denn eigentlich können sie in unseren nassen, marschigen Böden nicht überleben.“ Die erwachsenen, vier Millimeter großen, schwarzen Fliegen mit der charakteristischen gelben Zeichnung legen jeweils ein Ei in die reifenden Früchte der Kirschen. Die entwickelnden Larven fressen das Fruchtfleisch, wodurch es oft auch zum Verfaulen der Früchte kommt. Die Maden verlassen die Frucht, um sich im Boden zu verpuppen. Und genau hier machten ihnen bisher die Bodenverhältnisse und das Klima im Alten Land einen Strich durch die Rechnung. Zu kalt, zu nass.

… Durch wärmeres, trockeneres Wetter könnte sich dieses aber ändern. „Im Hamburger Stadtgebiet, wo es deutlich wärmer und trockener ist, hatte ich im vergangenen Jahr einen extremen Anstieg von Anfragen zu Kirschfruchtfliegen“

Im Alten Land hofft man darauf, dass die Fliege auch weiterhin ihren Entwicklungszyklus nicht vollenden kann. Klopp: „Doch wir wollen vorbereitet sein und notfalls rechtzeitig Mittel zur Bekämpfung einsetzen.

In der Oberrheinebene (laut dem Bericht bis zur Höhe von Hannover) war sie schon „immer“ eine Plage und wird zum Beispiel in der Oberrheinebene nachweislich seit 1952 intensiv bekämpft [6].

Leider steht im SZ-Artikel nicht, ob es sich nicht etwa um die neu eingewanderte Fliegenart handelt, welche sich ja in ganz Deutschland verbreitet (in den USA bis zur Grenze mit Kanada).

Nun zeigen die Kirschfliegen typische Probleme im Obstbau auf, weshalb es sich lohnt, ein wenig mehr darüber zu lesen.

Kirschfliegen …

… eine teils selbst gemachte Tragödie: Einmal durch die Wünsche der Verbraucher und des Handels und dazu auch durch die sich selbst auferlegten Verbote der Biobauern:

[2] Es ist eine Tragik. Ausgerechnet die robustesten, wohlschmeckendsten, bekömmlichsten, platzfestesten und am wenigsten von Maden befallenen alten Süßkirschsorten früherer Zeiten sind heute nicht nur aus dem Erwerbsobstbau komplett verschwunden, sondern sind auch in den Baumschulen nicht mehr zu kaufen und spielen in der Züchtung kaum eine Rolle.

Eine Entwicklung mit gravierenden Folgen für Konsumenten und Umwelt: Denn während die Frühkirschen kaum von den Maden der Kirschfruchtfliege befallen werden, sind gerade die späten Knorpelkirschen am stärksten heimgesucht (in Norddeutschland ab der 4.-5. KW, in Süddeutschland teils schon ab der 3. KW). Die Folge „Kirschen aus deutschen Landen“ werden im konventionellen Anbau regelmäßig mit Insektiziden gegen die Kirschfruchtfliege behandelt – die letzte Spritzung oft noch bis vor der Ernte (Perfektion aktuell bis drei Wochen, Mospilan bis eine Woche vor der Ernte!). Und die Kirschen, die aus südlichen Ländern in unserer „Frühkirschenzeit“ bei uns auf den Markt kommen, sind als – dort spät reifende – Sorten selbstverständlich ebenfalls mit Insektiziden behandelt. Sollten diese Mittel ihre Zulassung verlieren (was zwischenzeitlich der Fall schien), bekommt auch der konventionelle Erwerbs-Kirschenanbau Probleme mit der Beherrschung dieses lästigsten Schädlings im Kirschanbau.

Der Biologische Anbau, der chemisch-synthetische Spritzmittel nicht verwenden darf, krankt daran, dass er bis heute noch keine „hundertprozentig“ wirksame Methode gegen die Kirschfruchtfliege entwickelt hat. Daher wären frühreifende Kirschsorten für den Bio-Anbau (zumindest für die Direktvermarktung) ein Ausweg – umso mehr, als einige der früh reifenden „weichen“ Sorten ganz nebenbei auch weniger platzanfällig sind als die späteren Knorpelkirschen.

Die Altvorderen litten darunter, denn sie hatten keine Lösung. Der altvordere moderne Biolandbau verbietet sich selbst Lösungen

Das grüne Lexikon HORTIPENDIUM: Kirschfruchtfliegen

Ein ökonomisch wichtiges Problem ist Rhagoletis cerasi insbesondere im biologischen Landbau. Zur Zeit gibt es keine wirksame Lösungsstrategie und kein wirksames Verfahren.

Zeit Online 26. Juli 2012: Die Rettung der Ochsenherzkirsche

Der langjährige Fokus der Züchter auf Größe und sattes Rot mache insbesondere den Ökobauern große Probleme …

Die neuen Züchtungen seien extrem krankheits- und schädlingsanfällig, dürften im Biolandbau aber nicht mit Chemikalien behandelt werden. Er möchte nun spezielle Sorten für Biobauern auf den Markt bringen.

… Gegen die Kirschfruchtfliege wiederum, die das Dorf seit einigen Jahren heimsucht, hilft es, besonders auf frühreife Sorten zu setzen. Die Made des Schädlings kriecht von Ende Juni an in die Früchte und macht sie unverkäuflich. Sorten aber, die früher reifen, werden von ihr nicht befallen.

Zu beachten ist dabei, dass es inzwischen zwei Sorten Kirschfliegen gibt, die weit schlimmere ist erst vor Kurzem nach Europa gekommen:

StMELF, LfL Bayern: Sicherstellung des Kirschanbaus in Bayern

Die aus dem asiatischen Raum eingewanderte Kirschessigfliege Drosophila Suzukii stellt eine starke Bedrohung für den gesamten heimischen Obstbau dar. Sie befällt neben Süß- und Sauerkirschen alle weichfleischigen Obstarten und wird als äußerst gefährlicher Schädling eingestuft.

Aufgrund ihrer kurzen Entwicklungszeit und mehrerer Generationen in Folge kann sie sich in der Obstanlage explosionsartig vermehren und einen nahezu vollständigen Ertragsausfall verursachen. Das zeigte sich bereits ab dem Jahr 2009 in Obstanlagen in Spanien, Südfrankreich und Italien. Im Jahr 2014 verursachte die Kirschessigfliege unerwartet hohe Schäden in bayerischen Obstkulturen. Besonders betroffen waren Süß- und Sauerkirschen, Zwetschgen, remontierende Erdbeeren, Himbeeren, Brombeeren und Heidelbeeren sowie Holunder.

Interessant ist, dass die hochgefährliche, neue Kirschfliege, bei höheren Temperaturen und Trockenheit dezimiert wird. Das Klimawandel-Argument damit vollkommen daneben liegt:

Julius Kühn Institut: Die Kirschessigfliege Drosophila Suzukii Matsumura 1931

Die Kirschessigfliege Drosophila suzukii ist ein invasiver Schädling, der seit 2008 in Europa auftritt. Die Art gehört zu den Obst-, Essig- oder Taufliegen (Diptera: Drosophilidae) und stammt ursprünglich aus Asien. Im Jahr 2011 wurde sie erstmals in Deutschland nachgewiesen und ist seit 2014 im gesamten Bundesgebiet verbreitet. Sie belegt im Gegensatz zu unseren heimischen Arten gesunde, kurz vor der Ernte stehende Früchte mit Eiern, bevorzugt Steinobst und Beerenfrüchte. Die Vielzahl der Wirtspflanzen, der kurze Generationenzyklus und die hohe Vermehrungsrate machen D. suzukii zu einem sehr gefährlichen Schädling, der zu enormen Ernteausfällen führen kann.

… Der optimale Temperaturbereich liegt zwischen 20 und 25 °C. Außerdem ist eine hohe Luftfeuchtigkeit (> 60 %) förderlich. Bei über 30 °C sowie geringer Luftfeuchte nimmt die Aktivität stark ab …

Der Apfelwickler …

Es gibt sicher nichts mehr auf dieser Welt, an dem nicht der Klimawandel mindestens eine gehörige Teilschuld hätte. Wenn die Kirschfliegen nicht reichen, kommt der Apfelwickler dazu:

SZ: [1]: … Das Werk des Apfelwicklers. „Diesen Schädling gibt es hier schon lange, Früher gab es aber pro Saison nur eine Generation … dieses Jahr vermehre sich der wärmeliebende Schädling schon zum dritten Mal. Kein Wunder, die Durchschnittstemperatur im Alten Land ist in den vergangenen 30 Jahren um ein Grad gestiegen“

Hortipendium: Generationen

… In Regionen mit warmen Klimaten, wie z.B. die Pfalz und Rheinhessen, tritt der Apfelwickler in zwei vollständig ausgeprägten Generationen auf (bivoltine Generation). In Regionen mit weniger günstigen Klimaten wie z.B. das Alte Land, macht er mindestens eine vollständige Generation, kann dort aber auch in Jahren mit warmen Frühsommern mit einer zweiten zumindest partiellen Generation auftreten, die zu erheblichen Ertragsausfällen führen kann.

… Die Larven sind unempfindlich gegenüber strengen Frösten.

NDR Ratgeber 01.09.2019: Der Norden im Klimawandel Wie der Klimawandel den Obstanbau verändert

Das betrifft auch die Strategien gegen Schädlinge, die am Esteburg Obstbauzentrum entwickelt werden. Die veränderten klimatischen Bedingungen kommen zum Beispiel dem Apfelwickler entgegen, ein Nachtfalter, dessen Larve sich als Made ins Innere der Äpfel bohrt – sie gilt als einer der größten Obstschädlinge Europas. Produziert der Apfelwickler in normalen norddeutschen Sommern nur eine Larvengeneration, gelang ihm zuletzt in warmen Sommern noch eine zweite. „Eine zweite Larvengeneration kann bereits unter den jetzigen Klimabedingungen den Fruchtbefall vor der Ernte verdoppeln“, heißt es in einer Studie zur Anpassung des Obstbaus der Niederelbe an den Klimawandel …

Über die berichteten, drei Generationen des Apfelwicklers fand google keine Fundstelle. Über die aktuelle Apfelernte, welche laut dem Klagelied der Biobauern im „Alten Land“ so desaströs ausfiel, berichtete der NDR kürzlich:

Gute Ernte für 2019 erwartet

… Im Alten Land stehen die Zeichen auf Ernte: Die Frühäpfel sind bereits reif, Anfang September beginnt die Saison der Hauptapfelsorten wie Holsteiner Cox und Elstar. Die Obstbauern erwarten Erträge von rund 265.000 Tonnen, das sei etwas weniger als der Durchschnitt von rund 290.000 Tonnen, sagt Dr. Matthias Görges vom Esteburg Obstbauzentrum Jork. Die Fruchtqualität sei allerdings sehr gut. Da es genug Sonnenstunden gegeben habe, hätten die Früchte genügend Zucker bilden können: „Die Äpfel schmecken!“

Eigentlich müsste das Wetter der letzten zwei Jahre den Apfelwickler im Norden eher eingedämmt haben: Denn angeblich gibt es immer mehr Wind und weniger Feuchte, genau das, was diese Fliege nicht leiden kann:

WIKIPEDIA: Apfelwickler Lebensweise: Apfelwickler bildet zwei Generationen im Jahr, die erste fliegt hauptsächlich im Mai und Juni, die zweite im August und September. Optimale Bedingungen für den Flug findet der Apfelwickler während der Abenddämmerung. Vor allem an warmen, windstillen Abenden um 20 °C und bei feuchtem Wetter sind die Apfelwickler besonders aktiv.

Wie ideologisch Hirnverbrannt muss man dazu sein

Unabhängig davon, wie viel Anteil das sich stetig verändernde und zum Glück etwas wärmer gewordene Klima an den Problemen der sich beschwerenden Biobauern hat, zu verlangen, dass sich nun alle Bürger Deutschlands für die extrem teuer werdende CO2-Minderung zwangsverpflichtet werden sollen und zu behaupten, dass es (noch) nicht gemacht wird, wäre Schuld an den aktuellen Problemen von Ökobauern im Obstanbau, ist (rein private Ansicht des Autors die niemand teilen muss) eine reine Zumutung, mindestens an den Verstand.

SZ: [1] „... Schuld an der Misere ist nach Ansicht Blohms der Klimawandel – und die Bundesregierung, weil die nicht genug für den Schutz des Klimas tut. Deshalb hat die Bauernfamilie zusammen mit zwei anderen Familien und Greenpeace die Bundesregierung verklagt ... “

Leider finden solche Pseudoargumentationen neben der Süddeutschen Zeitung unsere Regierung und alle Altparteien toll und legen großen Wert darauf, es auch konsequent umzusetzen.

CSU: Weichstellung für die Zukunft

Sogar die CSU, lange Zeit noch ein kleiner Hort von Restvernunft im deutschen Politikchaos prescht dabei vor. Herr Söder hat beschlossen, nicht wie sein Vorgänger als schnöder und allseits verlachter Bettvorleger von Frau Merkel zu enden und auch nicht als Frau Merkels „Darmwurm“, wie Herr Altmaier, der in Talkshows sitzt, sich von GRÜNEN beschimpfen lässt, dass dass seine WirtinChefin nicht genug gegen das Klima tut, sich windet und damit entschuldigt, das liege nur an den Zwängen der leidigen Regierungsarbeit, die noch nicht ganz überwunden wären: aber er arbeite fleißig und unermüdlich, damit sich das GRÜN wie gewünscht schneller bessert.

Deshalb ist er gleich ganz in ihr Bett gehupft und setzt ihre Politik, „grüner zu sein als die GRÜNEN“ konsequent um. Deren Devise „meine Politik beruht nicht auf Sachverstand … “, übernahm er mit der gleichen Konsequenz.

Im ganz aktuellen, auf der CSU-Homepage hinterlegtem Klimaschutz-Infodokument steht als Begründung für die mit 100 % Zustimmung beschlossenen Klimamaßnahmen lediglich:

Topaktuell CSU 7. September 2019 Weichstellung für die Zukunft

„Wir reden nicht nur, wir handeln!; „Mit unserer Klimastrategie antworten wir auf die Herausforderungen des Klimawandels; „Wir setzen auf Klimastrategie …

Selbstverständlich sollen auch GRÜNE Maximalforderungen mindestens erfüllt werden:

„ Klimaschutz als Staatsziel in das Grundgesetz und die Bayerische Verfassung aufnehmen …“

Wer käme auch darauf, für die vielen, teuren Maßnahmen tiefer gehende Begründungen zu erwarten? Benötigt niemand, denn die Vorteile sind doch für jeden einleuchtend: „Wir setzen auf eine Klimastrategie, die umfassend angelegt ist und verbindet“. Selbstverständlich ist das, was Frau Merkel unisono vorbetet, auch nun auch in Bayern Gesetz: „Wir sind Vorreiter … „

Im gesamten CSU-„Richtungspapier“ beschränken sich alle „Klimamaßnahmen“ alleine und ausschließlich auf CO2-Minderung:

„Klimaschutzmechanismus: CO2-Begrenzung … “

Ein Beleg, dass man sich unisono auf das Fachniveau der GRÜNEN herunter-reduziert hat.

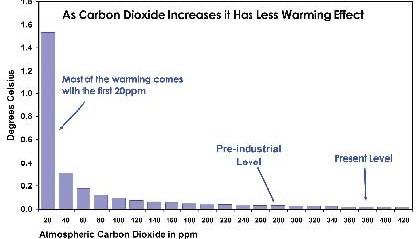

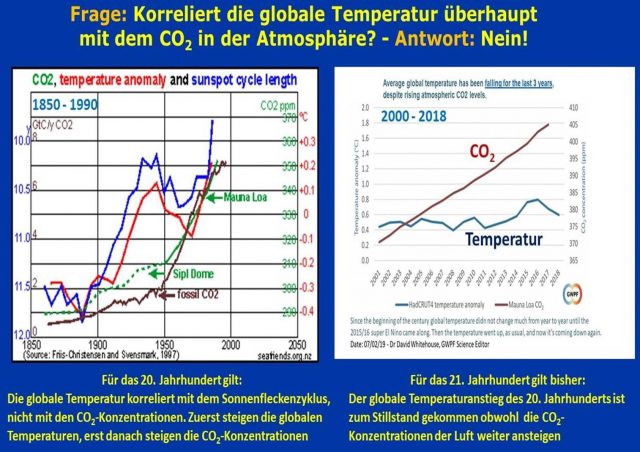

Dass sowohl der Forcingwert, wie auch die Senkenmengen regelmäßig weit günstiger kalkuliert werden:

kaltesonne: Die Sonne im Juli 2019: Die Erde wird grüner – die ausbleibende Katastrophe

EIKE 22. Februar 2019: Weltklimarat IPCC zum CO2 : „Alles halb so schlimm!“

ist (nicht nur) bei der CSU nicht angekommen. Macht nichts, bei allen anderen, etablierten Parteien ja ebenfalls nicht.

Die Bürger sollen damit aber so richtig happy gemacht werden, denn es nützt ihnen ja auf jeden Fall:

„Unser Klimaschutzkonzept ist ein wichtiger Motor für die Konjunktur“

Bedeutet nichts anderes, als dass alle Bürger viel, viel Geld für unsinnigste Maßnahmen auszugeben haben, damit die Ökoprofiteure sich weiterhin risikolos goldene Nasen verdienen können.

Auch der „notwendige“ Professor äußert sich

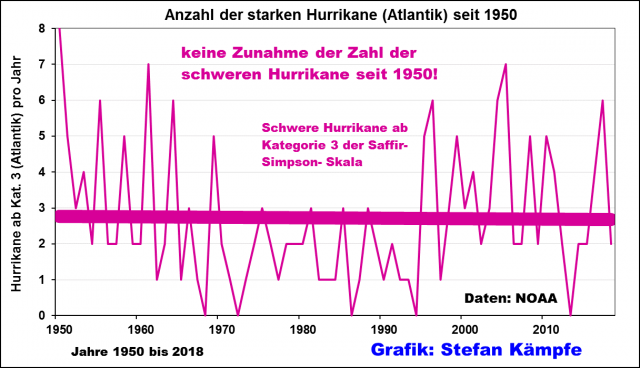

SZ: [1]: Christoph Müller, Leiter Institut für Pflanzenökologie der Uni Gießen: „ Die Folgen des Klimawandels spüren wir alle schon heute … Das Wetter werde immer extremer, Hitzewellen, Dürren und Stürme kämen häufiger vor. „Normale Schwankungen sind das keine “

Wieder Jemand, der entweder bewusst nicht Belegtes sagt, oder von dem was er hier sagt, keine Ahnung hat.

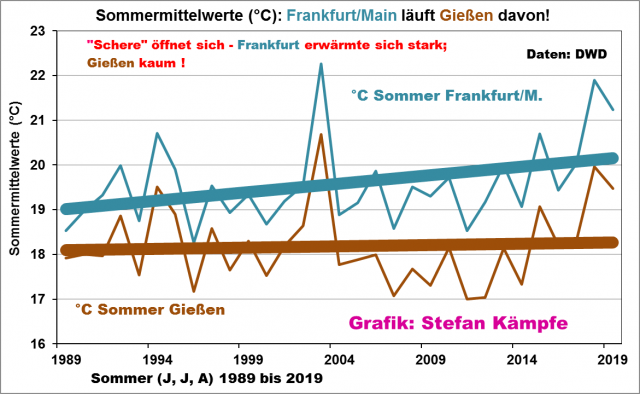

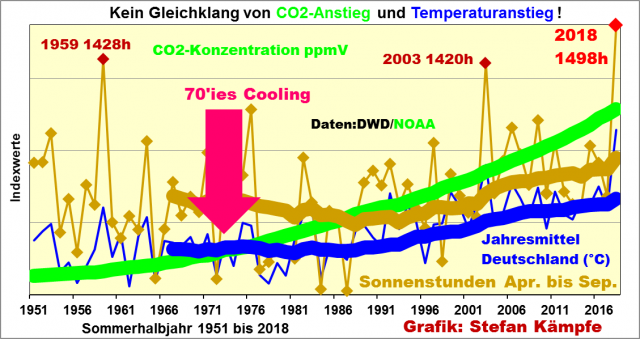

Es ist inzwischen vollkommen vergebliche Liebesmühe, immer neu darauf hinzuweisen, dass das Wetter keinesfalls „immer extremer“ wird. Das Einzige was im Ansatz stimmt ist, dass es nach der vergangenen Kaltzeit wärmer wurde. Selbst dabei hat aber die umfangreiche Urbanisierung mit Sicherheit einen erheblichen Anteil (wie es Herr K. Puls auf EIKE immer wieder aufzeigt und es Bild 7 auch belegt), neben dem, dass man die früheren „Globaltemperaturen“ nicht entfernt mit ausreichender Genauigkeit kennt.

Selbst nach jahrelangen Recherchen hat der Autor (und andere) bisher keine messtechnischen Belege für diese regelmäßig zu hören und zu lesende Behauptung gefunden, sondern das Gegenteil.

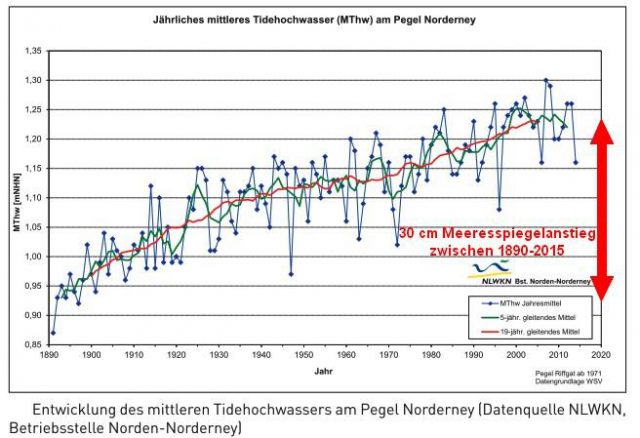

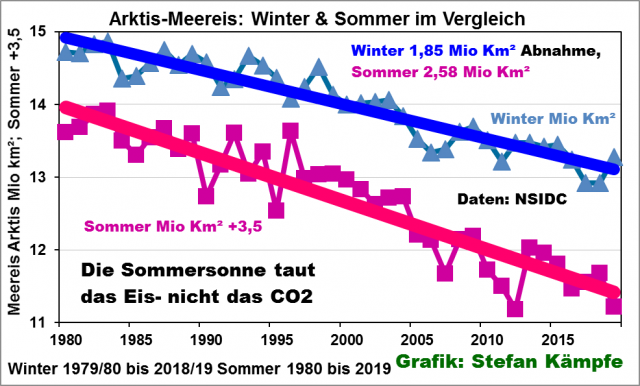

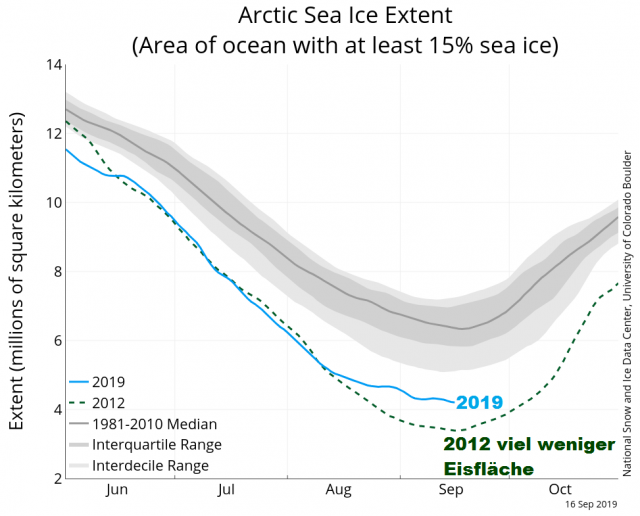

[8] EIKE: Klima-Ruhe an der Nordsee

EIKE 01. Juni 2019: Extreme Wetterlagen verstärken sich. Bayern gehört zu den besonders gefährdeten Regionen

EIKE 08. Juni 2018: Die Suche nach dem Klimawandel geht weiter. Denn in Deutschland ist er nicht zu finden

EIKE 18.04.2018: Beeinflussungen durch Starkregen nehmen in Deutschland nicht zu. Mit schlecht angewandter Statistik lässt sich aber das Gegenteil „zeigen“ (Teil 2)

Dass es der IPCC im letzten Sachstandsbericht ebenfalls sagt (eine Zunahme von Extremereignissen ist weltweit nicht nachzuweisen), kann man im folgenden Artikel anhand der übersetzten Zitate aus dem IPCC-AR5 nachlesen:

EIKE 31.01.2018: Endlosschleife Klimaangst

Kaltesonne hat vor Kurzem wiederholt dargestellt, wie unverfroren mit den Extremwetterthesen umgegangen wird, um Alarm zu publizieren:

[9] kaltesonne 4. Juli 2019: Tornados, Hitzewellen, Dauerregen: Deshalb ist das Wetter in Deutschland so extrem

In Deutschland wird das Wetter regelrecht zum Unwetter: Die Hitze heißer, der Regen länger, die Stürme stärker. Spüren wir die Auswirkungen der Klimakrise bereits?

Au weia. 50 Cent in die Fake News-Kasse. Hätte der Autor doch mal auf www.klimawandel-in-deutschland.de vorher nachgelesen:

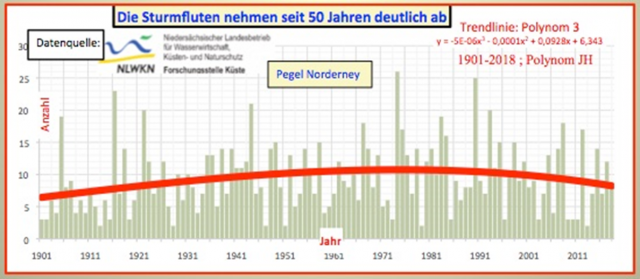

Stürme: Das PIK Potsdam wertete Satellitendaten aus und stellte für die vergangenen 35 Jahre eine signifikante Abnahme der Sturmaktivität während des Sommers in den mittleren Breiten der nördlichen Hemisphäre fest, darunter auch in Deutschland. Winterstürme über dem Nordatlantik und Nordwesteuropa zeigen jedoch starke, jahrzehntelange Schwankungen, wobei derzeit kein Langzeittrend sichtbar ist, wie ein Team um Frauke Feser vom Helmholtz-Zentrum Geesthacht dokumentierte. Erkennbar sind eine Verringerung der Sturmaktivität seit den 1880ern bis Mitte der 1960er Jahre und ein darauf folgender Anstieg bis Mitte der 1990er Jahre. Ab Mitte der 1990er Jahre verringert sich dann wiederum die Sturmaktivität. Ähnliches fand ein Wissenschaftlerteam um Sönke Dangendorf von der Universität Siegen. Die Forscher untersuchten die Sturmgeschichte der Nordsee für die vergangenen 170 Jahre und konnten ebenfalls keinen Langzeittrend bei Stürmen und Sturmfluten feststellen. Noch weiter zurückreichende Sturmrekonstruktionen aus dem mitteleuropäischen Raum zeigen zudem, dass die Kleine Eiszeit generell sogar stürmischer als heute war.

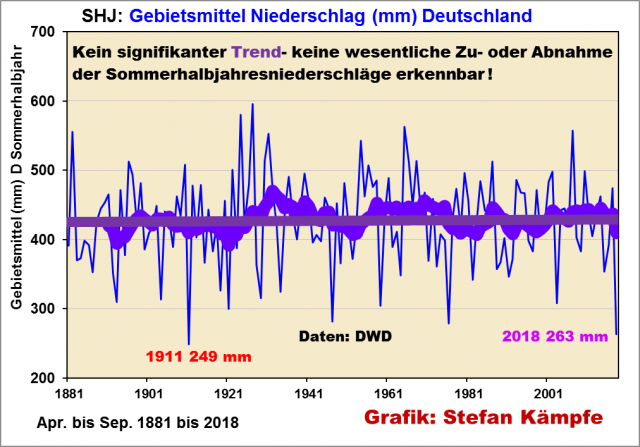

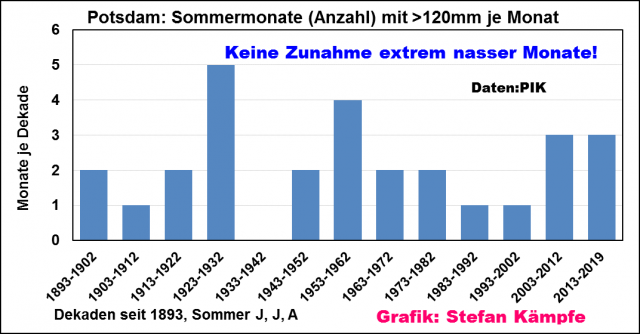

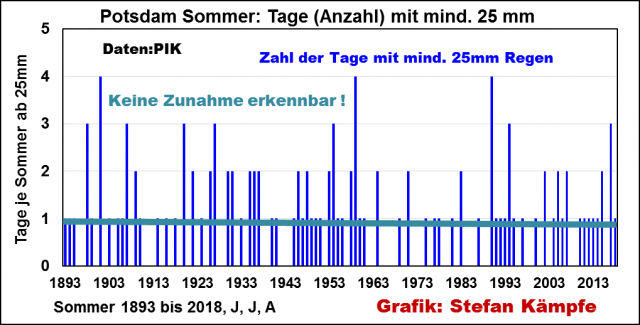

Dauerregen: Seit 1951 hat sich die Häufigkeit von Starkniederschlag von mehr als 30 mm nur geringfügig erhöht (Abb. 3). Die Veränderung ist aus statistischer Sicht jedoch insignifikant, so dass kein belastbarer Langzeittrend ausgemacht werden kann. Die Zeitreihe moderner Radardaten zum Starkregen ist leider noch zu kurz, um aussagekräftige Trends interpretieren zu können.

Was Gemüsebauern im Gewächshaus seit Jahrzehnten mit CO2 machen, verstehen die Pflanzen nicht …

SZ: [1]: Christoph Müller, Leiter Institut für Pflanzenökologie der Uni Gießen: „ Unsere Theorie war, dass die Pflanzen schneller wachsen würden, dafür brauchen die CO2, … Doch das Mehr an Kohlenstoff bringt sie (die Pflanzen) offenbar durcheinander … Wir müssen das alles noch besser verstehen … sicher ist aber: Pflanzen brauchen ein ausgeglichenes Klima, um gut zu wachsen“.

Ein herrliches Beispiel eines Institutsleiters, der um weitere Fördermittel ringt. Man könnte meinen, noch niemand hätte zur Auswirkung von CO2 auf Pflanzen geforscht und die Gewächshausbauern, die damit ihre Pflanzen seit langem erfolgreich zu mehr Wachstum anregen, wissen eigentlich gar nicht, was sie tun?

EIKE 09.05.2016: Die Europäische Kommission hat festgestellt, dass CO2 ein Pflanzengift ist – allerdings erst ab 5.000 ppm Konzentration

Oder anders herum: Wenn es wirklich noch gar nicht erforscht ist und man es „erst noch besser verstehen“ muss, wie können dann die vielen Simulationen bereits heute genau die Auswirkungen von CO2 auf die Pflanzen dieser Erde berechnen und vorhersagen, wie viel % Ernteminderung so und so viel mehr CO2 im Jahr 2100 verursachen soll? Vermutet hat es der Autor schon lange:

EIKE 26.11.2016: Forscher des Weltklimarates IPCC rechnen, dass die globale Erwärmung 10 bis 50 % der jährlichen Ernte bedroht – Was steckt dahinter?

Diese Forschung scheint inzwischen epidemisch zu werden und ist ein neues Abschöpfungsgebiet für Fördermittel.

„Meine“ Tageszeitung am 12.9.2019: „Forscher der TU München düngen am Amazonas Bäume künstlich mit CO2, um die Auswirkungen einer veränderten Atmosphäre zu ergründen“

Man hat wenige Jahre Zeit, „düngt“ einzelne Bäume mit zusätzlich 200 ppm CO2 und erwartet dann, bahnbrechendes, bisher nicht bekanntes Wissen zu erhalten. Benötigt man, denn: „die zukünftige Rolle des Amazonas-Regenwaldes … ist unklar … weil unsicher ist, wie die Bäume auf zunehmendes CO2 reagieren werden“. Das wissen bisher eben nur die Klimasimulationen, aber scheinbar nicht die beteiligten Forscher.

Aber eines weiß die berichtende Forscherin schon jetzt: „Ich glaube nicht, dass der Regenwald noch wesentlich mehr Kohlenstoff speichern kann als bisher … Falls die CO2-Konzentration in der Atmosphäre weiter steigt, könnte das sogar einen besonders negativen Effekt haben … “

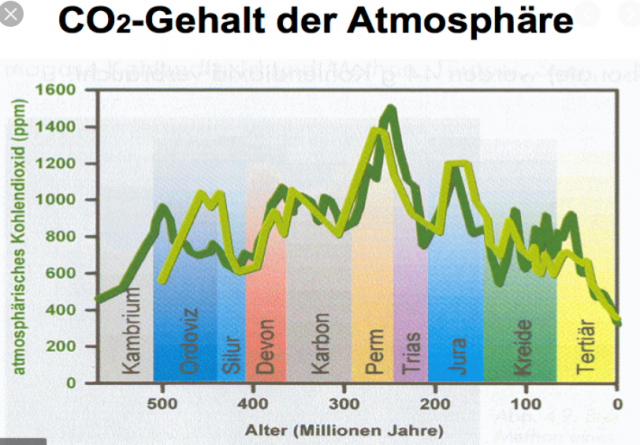

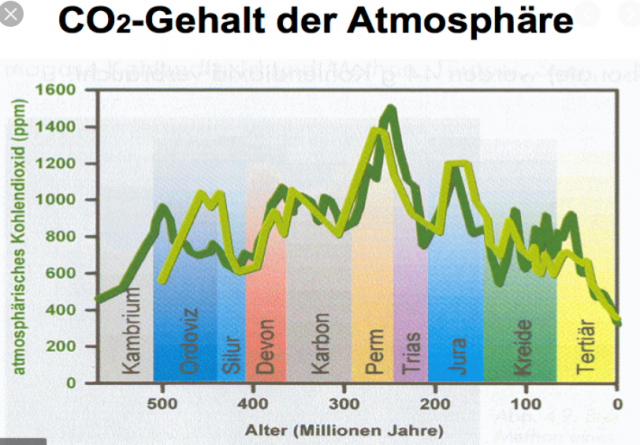

Wenn sich die junge, engagierte Forscherin da nicht vielleicht irrt, oder es nicht zu sagen wagt. Es gab eine Zeit, da hatte mehr CO2 einen wahnsinnigen Effekt und es entstanden die riesigen Kohleflöze, das war das danach benannte Karbon und das Perm:

WIKIPEDIA: … vor etwa 250 bis 350 Millionen Jahren. Im Karbon und Perm gediehene Urfarne, Kalamiten sowie Siegel- und Schuppenbäume bildeten große Sumpfwälder. Die optimalen Wachstumsbedingungen für die Pflanzen führten zu einer starken Überproduktion von Biomasse …

Und was hat damals (mit) dazu geführt: Ein um ein Vielfaches höherer CO2-Gehalt in der Atmosphäre

Bild 12 CO2-Gehalt der Atmosphäre zu den Zeiten der Kohleentstehung (Perm und Trias). Quelle: unbekannt

Wenigstens ein positives Ergebnis dürfte aber mit Sicherheit herauskommen: Für ein paar Promotionen sollten die Effekte reichen.

Ideologie schafft argumentative Sicherheit

SZ: [1] Die Anwältin will vor Gericht auch damit argumentieren, dass der Klimawandel schon heute die Grundlage der Bauern auf Eigentum, Berufsfreiheit und Gesundheit einschränke. Sie ist sich sicher: „Wir haben die besseren Argumente“

Greenpeace ist auch überzeugt, dass der Weltklimavertrag rechtlich bindend ist:

[15] … Die Bundesregierung verstößt gegen Grundrechte, wenn sie nicht weitere Maßnahmen ergreift, um das deutsche Klimaziel für das Jahr 2020 noch zu erreichen. Denn das Klimaziel ist keine rein politische Zielsetzung, sondern justiziabel und bindend …

Im Welt-Klimavertrag steht zur Verbindlichkeit:

… zum Erreichen des in Artikel 2 genannten langfristigen Temperaturziels sind die Vertragsparteien bestrebt, so bald wie möglich den weltweiten Scheitelpunkt der Emissionen von Treibhausgasen zu erreichen …

Genau so interpretieren es allerdings auch Frau Merkel und selbstverständlich die Frau Merkels Äußerungen (eine Meinung hat sie ja fast nie) immer mittragenden Altparteien im Bundestag, die in Deutschland inzwischen fast schon mitregierenden NGOs sowieso.

Wenn Frau Merkel (vor-)spricht, ist unser Bundespräsident als verbreitende Sprechblase nie weit [18]. Auch er weiß genau über das Klima Bescheid [19]. (Zitierung aus einer Zeitung vom 14.09.2019): „Die alarmierende Dynamik des Klimawandels lässt uns keine Wahl. Wir müssen schneller und entschiedener handeln“. Nach Auffassung Steinmeiers sollte Deutschland wieder eine internationale Führungsrolle beim Klimaschutz anstreben“.

Womit man sich eigentlich wundert, warum er nicht die Wenigen, die mit Greta vor dem Weißen Haus protestierten [20], um seine Person erhöht hat. Im Beschimpfen gerade dieses Präsidenten hat auch er ja ziemliche Übung [21].

Man wird Steinmeiers Reden wohl positiv verstehen müssen: Deutschland hat inzwischen auf so vielen Gebieten die Führungsrolle verloren, dass man sich nun auf kleine reduzieren sollte [19]. Und vor allem eine, wozu man wirklich kein Wissen, sondern nur den festen Glauben benötigt: „CO2 = Klimagift und muss mit allen Mitteln, Geld und Einsatz verhindert werden“. Dazu: „Armut erlöst“, ein Wunsch ausreichend gut pensionsgesicherter, allerchristlichster „Vordenker“ [17] für das einfachere Volk, damit dieses nicht auf die Idee kommt, das einfachere Leben wegen drastischer Wohlstandsreduzierung wäre etwas Negatives.

Einfach genial, wie eine autistische, sich nur in Schwurbelsätzen ausdrückende, unfehlbare Vorsitzende, es immer neu schafft, jegliche intellektuelle Konkurrenz von ihrem Umfeld fernzuhalten.

Es bleibt abzuwarten, wie die Gerichte durch ihre Instanzen entscheiden. Juristen entscheiden nicht anhand von Messwerten, sondern nach Gesetzen. Wenn bis dahin der Klimaschutz wie geplant im Grundgesetz steht, ist das Ergebnis vorherbestimmt.

Die UN als fast überall versagender „Weltretter“ hat sich ebenfalls umorientiert und wird auf dem „Ersatz-Rettungssektor“ Sektor Klimakampf immer aktiver. Soeben wurde ein Entwurf eines Umweltpaktes ausgegeben, der neue Forderungen enthält:

[16] … Staaten, die den Vertrag unterzeichnen, sind gehalten, den «Klimawandel» durch «staatliche Beihilfen» zu bekämpfen. Sie sollen alle staatlichen und wirtschaftlichen Unternehmungen auf ihre «Umweltverträglichkeit» hin prüfen lassen. Kontrollbürokratien sind aufzubauen, Berichte zu schreiben, und ausserdem verpflichten sich die Regierungen darauf, «Massen-Informationsmittel» bereitzustellen «mit erzieherischem Charakter über Ökosysteme und über die Notwendigkeit von Umweltschutz» …

Wie inzwischen üblich, ist der Bürger und die gesamte Welt vorbeugend auch vor allen Gefahren zu schützen, auch denen, welche noch nicht richtig bekannt sind, aber von irgendjemandem schon einmal vorsichtshalber „angemahnt“ oder simuliert werden:

[16] Artikel 6, «Vorsorge»:

Im Falle eines Risikos von «schweren oder unumkehrbaren Umweltschäden», wie zum Beispiel durch Klimawandel, dürfe das «Fehlen von wissenschaftlicher Gewissheit kein Grund sein, wirksame und angemessene Maßnahmen zur Verhinderung von Umweltschäden auf einen späteren Zeitpunkt zu verschieben».

Wenn Deutschland dann unter der Last des Klimaschutzes zusammengebrochen sein wird und bemerkt, dass der Rest der Welt die „Verbindlichkeit“ im Klimavertrag „sind die Vertragsparteien bestrebt“, spätestens wenn die Einzahlungen in den Weltklimafond nicht mehr spritzig sprudeln etwas auslegungsfähiger interpretiert, kann man das selbst gemachte Gesetz ja wieder ändern. Dann fällt auch das Urteil anders aus. Juristen kennen keine falschen oder gar dunklen Zeiten in der Geschichte. Es ist nicht ihre Aufgabe, Gesetze zu beurteilen, sondern ausschließlich die aktuellen richtig – bedeutet staatvorgabengetreu – umzusetzen.

Zur Abrundung noch die Kenntnis und Argumentation des Vorsitzenden des Bund Naturschutz, Richard Mergner (Diplom Geograph, Studium Regionalplanung und Wirtschaftsgeographie), zitiert aus einem Zeitungsinterview der Lokalzeitung des Autors am 12.09.2019 über das CSU-Klimaschutz-Strategiepapier: „Söder muss Verantwortung übernehmen“

Neben dem, dass als einziges Argument für die Notwendigkeit und Maßnahmen zum Klimaschutz, CO2-Minderung und sture Einhaltung des Klimaschutzvertrages gebracht werden „Wir haben die Atmosphäre als Müllhalde genutzt“, ist ihm keine Restriktions- und Verbotsmaßnahme zu wenig, um es umzusetzen. Technische Probleme wischt er dabei mit einem Wimpernschlag beiseite.

Die Stromautobahnen, welche den im Norden zeitweise in absolutem Überfluss erzeugten Windstrom in den Süden transportieren sollen, sind selbstverständlich überflüssig, ja schädlich. Denn wie es die „Freien Wähler“ auch fordern, ist wie beim Essen regionales, auch Strom nur guter Strom, wenn er regional erzeugt wurde.

Geht doch auch ganz einfach: „Der BN hält sie (die Trassen) in der derzeitigen Ausgestaltung nicht für nötig. Mit diesen Stromautobahnen schaffen wir letztlich eine Konkurrenz zu dezentralem, naturverträglich erzeugtem Strom. Was wir brauchen, ist der Ausbau des regionalen Verteilernetzes und von Stromspeichern. Ein Argument für Trassen fällt bald weg: dass nach dem Wegfall der Atomkraftwerke 2025 die Trassen gebracht werden. Es gibt sie dann aber noch nicht und es geht trotzdem. Das muss einem mal jemand erklären ... „

Klar, dass dazu der Naturschutz hintenanzustehen hat. Die bayerische 10H Abstandsregelung für Windräder – mit der Bayern bisher von der unglaublichen Naturzerstörung durch Ökoindustrie wie man sie im Norden Deutschlands sehen kann -, verschont blieb, muss natürlich fallen.

Kein Wort findet sich über die in diesem Artikel gelisteten Verbesserungen an Lebensqualität (nicht nur) durch das sich bisher erwärmte Klima mit den aktuellen, unglaublich vorteilhaften Zuständen. Zu solchem Wissen, oder dessen Berücksichtigung muss eine gesellschaftliche Gehirnamputation stattgefunden haben, die von solchen Ökostrategen weiter auch an sich selbst skalpiert wird.

Allerdings, das mit den Stromspeichern hat die CSU und FW Koalition zumindest schon begonnen: Die Uni Bayreuth bekam ein „BayBatt“ Batterie-Forschungszentrum:

WELT 04.09.2018: … Dort sollen künftig in Zusammenarbeit etwa mit Forschungsabteilungen der Automobilindustrie intelligente, vernetzte und nachhaltige Energiespeicher erforscht und entwickelt werden – «nicht nur für Elektrofahrzeuge, sondern auch für Gebäude und Netzstrukturen …

Wie immer, ist damit auch für wenige sicher ein direkter, konjunktureller Nutzen verbunden:

WELT: Wir werden im Rahmen eines Fünf-Jahres-Plans 25 Millionen Euro in den Aufbau des BayBatt investieren und im Endausbau 114 neue Stellen schaffen, davon allein zwölf Professuren

Quellen

[1] SZ 7./8. September 2019: Bauernaufstand

[2] aepfelundkonsorten.org, PV-Jahresheft-2011: Verkehrte Kirschenwelt Über die Sortenentwicklung und die fatale „Außerwertsetzung“ alter Süßkirschsorten

[3] Prof. Dr. Peter Weingarten: Landnutzungswandel vor dem Hintergrund der Perspektiven in der Agrar- und Energiepolitik

[4] EIKE 08.09.2019: Hopfenertrag 2019

[5] EIKE 03. September: GRÜNE, Bauern und Klimawandel: Im Jammern bilden sie eine Symbiose

[6] Zeitschrift für Pflanzenkrankheiten und Pflanzenschutz 1976, S. 53-58: H. Engel; Untersuchung über die Besatzdichte der Kirschfruchtfliege

[7] Landesamt für Natur, Umwelt und Verbraucherschutz Nordrhein-Westfalen: Klimawandel und Klimafolgen in Nordrhein-Westfalen Ergebnisse aus den Monitoringprogrammen 2016 LANUV-Fachbericht 74

[8] EIKE: Klima-Ruhe an der Nordsee

[9] kaltesonne 4. Juli 2019: Futurezone.de am 20. Juni 2019

[10] kaltesonne 24. Januar 2019: Obstbauer klagt gegen Klimawandel – trotz Rekordapfelernte 2018

[11] EIKE 25. August 2019: Klima-Ruhe an der Nordsee

[12] kaltesonne 6. März 2018: Extremwetter in den letzten tausend Jahren

[13] Kottfoff et al. 2017: Marine core M0059, Little Belt, western Baltic Sea, TIME: Last 8000 years

[14] ScienceScepticalBlog 9. September 2019: Mojib Latif, Präsident des Club of Rome: Der Norden im Klimawandel!

[15] topagrarONLINE 30.07.2019: Bauernfamilien und Greenpeace verklagen Bundesregierung wegen Klimapolitik

[16] EIKE: 12.Sept. 2019: … Umweltpakt … UNO auf dem Weg ins Mittelalter

[17] EIKE 22.07.2016 : Wurde ein Klimawandel-Einfluss bisher übersehen? Was ist, wenn Gott anstelle von CO2 das Klima lenkt?

[18] EIKE 27. November 2017: Die Rede unseres Bundespräsidenten, F. W. Steinmeier auf COP23 über den Klimawandel war (k)eine investigative Sternstunde – Teil 2 (2)

[19] Achgut: Klima: Deutschlands Ruf first!

[20] WELT Samstag, 14. September 2019: Greta Thunberg: „Trump ist ein Lügner“

[21] Spiegel online Donnerstag, 04.08.2016: Steinmeier nennt Donald Trump „Hassprediger“