Der sogenannte „natürliche atmosphärische Treibhauseffekt“ ist die Basis aller Befürchtungen über eine menschengemachte Klimakatastrophe, weil dieser sich durch den technischen CO<sub>2</sub>-Ausstoß der Menschheit angeblich noch weiter verstärken und zu einer globalen Selbstverbrennung führen soll. Für einen solchen „natürlichen atmosphärischen Treibhauseffekt“ gibt es unterschiedliche Modelle, einen experimentellen Ansatz und zwei Widerlegungen. In Teil 1 wurden die unterschiedlichen Thesen/Antithesen vorgestellt, die nachfolgend einzeln diskutiert werden.

MEINE ARGUMENTATION zu THESE (1):

Der Ansatz (1) ist grundlegend FALSCH, weil er über eine Gleichsetzung von Tag und Nacht die STRENGE PHYSIKALISCHE GLEICHZEITIGKEIT im Stefan-Boltzmann-Gesetz verletzt. Mit der Solarkonstanten (S0=1367 W/m²), der Erdalbedo (ALPHA=0,3) und der temperaturwirksamen Strahlungsleistung (Seff = S0*(1-ALPHA) = 940 W/m²) ergibt sich für die Netto-Strahlungsbilanz der Erde:

(IN = 940 W/m² * π R2) = (OUT = 235 W/m² * 4 π R2) @ NST (= 14,8 °C)

Das bedeutet, die Temperaturgenese der Erde erfolgt ausschließlich auf ihrer Tagseite mit (940 W/m² * cos Phi), und die Abstrahlung erfolgt mit durchschnittlich 235 W/m² über ihre gesamte Oberfläche. Und das alles geschieht im Strahlungsgleichgewicht der Klimadefinition (>30 Jahre) bei einer vorgeblich „gemessenen“ konstanten Globaltemperatur NST, in deren Berechnung bereits die tatsächlich gemessene Nachttemperatur eingegangen ist.

Ansatz (1) ignoriert den Unterschied zwischen Tag und Nacht und setzt einfach den Wert für die durchschnittliche globale Abstrahlung in das Stefan-Boltzmann-Gesetz ein. Durch diese globale Mittelung wird aber die temperaturwirksame spezifische Flächenleistung der solaren Einstrahlung verfälscht. Und die daraus abgeleitete „natürliche“ Temperatur der Erde von minus 18°C erfordert wiederum einen „natürlichen atmosphärischen Treibhauseffekt“ von 33°C, um die Differenz zur vorgeblich gemessenen Globaltemperatur NST zu erklären.

Selbst in der Ableitung einer Strahlungstransfergleichung wird unter impliziter Einbeziehung einer Nachttemperatur von minus 273°C die vorgebliche „S-B Gleichgewichtstemperatur“ (Teq = -18°C) als globale Mittelung der temperaturwirksamen solaren Einstrahlung über die gesamte Erdoberfläche benutzt. Und damit führt dieser Ansatz rekursiv auf seine eigene Randbedingung einer globalen „Faktor4-Mittelung“ zurück.

Vielmehr kann man sich physikalischen Randbedingungen des Stefan-Boltzmann-Gesetzes auch so vorstellen, dass die die Temperaturgenese auf unserer Erde ausschließlich dort erfolgt, wo Strahlung GLEICHZEITIG Temperatur erzeugen kann. Bei einer Betrachtung der Temperaturgenese muss man sich also auf die tatsächlich beleuchtete Tagseite unserer Erde beschränken.

BEWEISFÜHRUNG zu (1.1) – Die Erde wird als ein selbstleuchtender Stern betrachtet (Dietze):

Für einen selbst leuchtenden Stern kann man tatsächlich eine S-B-Inversion durchführen, beispielsweise für die Sonne, indem man die spezifische Strahlungsdichte (Solarkonstante) vom Erdbahnradius auf die Oberfläche der Sonne zurückrechnet und darauf das S-B-Gesetz anwendet; dabei bleibt die spezifische Strahlungsleistung auf den jeweils betrachteten Flächen zeitgleich konstant.

Die Erde ist aber kein selbst leuchtender Stern, bei dem man die einfallende Strahlungsleistung der Sonne über die gesamte Oberfläche mitteln könnte; dazu bräuchte es nach These (1.1) vielmehr zwei Sonnen mit halber Strahlkraft, jeweils eine auf der Tagseite und eine auf der Nachtseite der Erde. Denn die Temperaturgenese findet ausschließlich auf der solar bestrahlten Seite der Erde statt, und zwar tageszeit-, breiten- und jahreszeitabhängig. Die Einbeziehung der Nachtseite der Erde in eine Berechnung mit dem Stefan-Boltzmann-Gesetz ist damit physikalisch naiv und hat dieselbe Relevanz wie eine Einbeziehung der Fläche des Experimentiertischs in die Ergebnisrechnung des Stefan-Boltzmann-Experiments – solche unbeleuchteten Flächen haben mit dem S-B-Gesetz nämlich überhaupt nichts zu tun.

BEWEISFÜHRUNG zu (1.2.1) – Die Klimawirksamkeit von Treibhausgasen (Krüger):

TREIBHAUSGASE: Den sogenannten „Treibhausgasen“ (THG), hauptsächlich Wasserdampf, Kohlenstoffdioxid und Methan, wird vom IPCC eine aktive Temperaturwirksamkeit in [W/m²] zugemessen. Diese Zuordnung ist aber grundsätzlich falsch, weil solche Gase keine aktive Strahlungsquelle darstellen. IR-aktive Gase absorbieren zwar passiv Infrarotstrahlung, können eine solche Strahlung aber ohne externe Quelle gar nicht aus eigener Kraft erzeugen. Es handelt sich vielmehr um eine Art „energetischen Staffellauf“ – und damit entfällt auch ein zusätzlicher energetischer Beitrag dieser THG zum sogenannten Treibhauseffekt.

SATELLITENMESSUNGEN: Der Beweis eines atmosphärischen Treibhauseffektes durch Satellitendaten besteht lediglich aus einem VERGLEICH zwischen der theoretischen IR-Abstrahlung der Erde und den vorgeblich von Satelliten „gemessenen“ Spektren, denen ganz erhebliche Rechenprozesse hinterlegt zu sein scheinen: Die veröffentlichten NIMBUS-IR-Spektren überdecken einen deutlich größeren Wellenlängenbereich, als es die dort gemessenen IR-Intervalle hergeben (Fußnote *1). Und beim AERI-Spektrometer werden offenbar lediglich Interferenzsignale für konkrete IR-Intervalle gemessen und über eine Fourier-Transformation spektral analysiert. Daraus wird dann anscheinend im Abgleich mit Vergleichs-Schwarzkörpern ein IR-Gesamtspektrum berechnet (Fußnote *2).

Das abschließende KO-Kriterium für die These (1.2.1): Das vorgelegte IR- Beweisspektrum für diese These zeigt eindeutig globale rechnerische Mittelwerte aus dem konventionellen S-B-Ansatz und stellt daher keine beweiskräftigen Messerwerte dar. Vielmehr bedeutet die exakte Einhaltung der durchschnittlichen THE-Eckwerte (240+150=390) W/m² in dem vorliegenden IR-Spektrum ein eindeutiges KO-Kriterium für die These (1.2.1).

Bei dem IR-Spektrum@70km handelt es sich nicht etwa um echte IR-Messwerte, sondern um ein wohlmeinendes handwerkliches Zirkelkonstrukt. Dieses konstruierte F-Wort-Spektrum kann keinerlei eigene Beweiskraft für einen „natürlichen atmosphärischen Treibhauseffekt“ entwickeln, weil es nämlich umgekehrt rein rechnerisch aus dieser THE-Hypothese abgeleitet worden ist.

Fußnoten zu den „gemessenen“ IR-Spektren (bei tieferem Interesse sei der Google-Übersetzer empfohlen):

*1) Das Nimbus 3 Satellite Infrared Spectrometer (SIRS) misst laut NASA 8 Intervalle, Zitat: „… in seven spectral intervals in the carbon dioxide band (11 to 15 micrometers) and one interval in the atmospheric window centered at 11.1 micrometers“.

*2) Nach dem AERI Handbook scheint es bei solchen Messungen eine Art vergleichendes Dataprocessing zu geben, Zitat mit Hervorhebungen (7.3.1 Theory): „Two blackbody sources, one at ambient temperature and the other at 330K are used to calibrate the instrument. The two sources are used to determine the slope and offset, which define the linear instrument response at each wavenumber. (see reference 1) The AERI views these two blackbodies every two minutes. Magnitude of the difference between these blackbody spectra is then formed to compute the responsivity and offset for the instrument.“

BEWEISFÜHRUNG zu (1.2.2) – Experimenteller Nachweis des „natürlichen atmosphärischen Treibhauseffektes“ (Schnell):

Kernaussage (1.2.2-1): Mit Bezug auf eine abgewandelte Umgebungsgleichung des Stefan-Boltzmann-Gesetzes wird hier der Umgebungstemperatur T0 eine „Gegenstrahlung“ zugeschrieben. Aber anders als beim Stefan-Boltzmann-Gesetz, das eine Umgebung von 0 Kelvin voraussetzt, strahlt ein Schwarzer Körper (T) in einer erwärmten Umgebung (T0) lediglich mit einer verminderten Leistung nach der S-B Umgebungsgleichung DELTA S (=P/A) = SIGMA (T4 – T04). Es handelt sich hierbei physikalisch also eindeutig um eine verminderte Abstrahlung des Schwarzen Körpers und nicht um eine „Gegenstrahlung“ seiner Umgebung.

Die Verminderung der Strahlungsleistung eines Schwarzen Körpers mit (T) in einer Umgebung von (T0>0K) stellt also keinerlei physikalischen Beweis für eine „Gegenstrahlung“ dar, sondern folgt lediglich den bekannten physikalischen Gesetzen.

Kernaussage (1.2.2-2): Um welchen Effekt es sich bei der von Dr. Schnell experimentell festgestellten Temperaturwirkung von CO2 handeln könnte, vermag der Autor nicht zu beurteilen.

Nach den HS der Thermodynamik muss die erforderliche Energie jedenfalls irgendwo herkommen, denn das CO2-Molekül ist nicht in der Lage, aus sich selbst heraus Energie zu erzeugen.

BEWEISFÜHRUNG zu (1.3) – Variable Abstrahlungshöhe der Erde (Heller):

Die „atmosphärische Rückstrahlung“ soll angeblich die Erdoberfläche mit zusätzlich 150 [W/m²] erwärmen, ein kälterer Körper (240 W/m²) erwärmt also fortlaufend einen wärmeren (390 W/m²). Für These (1.3) liegen verschiedene Konformitätsbehauptungen mit den HS der Thermodynamik vor.

Diese Gegenstrahlung bedient sich exakt der konventionellen Stefan-Boltzmann Herleitung von (240 W/m² entspricht -18°C) und (390 W/m² entspricht 15°C) mit einer Temperaturdifferenz von 33 Grad. Aber die Hauptsätze der Thermodynamik schließen ein Perpetuum Mobile jeglicher Art grundsätzlich aus, da hilft auch die Hilfskonstruktion einer „variablen Emissionshöhe“ nicht weiter.

Weiterhin entkoppelt sich das Modell einer „variablen Emissionshöhe“ ausgerechnet von der globalen Durchschnittstemperatur, der es eine grundsätzliche globale Abstrahlung bei minus 18°C entgegensetzt, ohne deren zwingende Relevanz nachgewiesen zu haben. Die „variable Emissionshöhe“ bei minus 18°C stellt damit lediglich eine Rekursion auf den konventionellen S-B-Ansatz selbst dar. Und durch eine „vollautomatische“ Anpassung der Emissionshöhe „deckelt“ dieses Modell alle inneren Widersprüche des konventionellen S-B-Ansatzes (1).

Insbesondere sperrt dieses Modell die tatsächliche Temperaturgenese auf der Tagseite unserer Erde und die nachgewiesenen paläoklimatischen Temperaturschwankungen aus seiner Betrachtung aus.

Umgekehrt wird allerdings ein Schuh daraus: Wenn der gesamte „Körper ERDE“ in der hohen Atmosphäre bei minus 18°C mit 235 W/m² in den Weltraum abstrahlt, dann entspricht die vorgeblich durchschnittlich 14,8°C warme Erdoberfläche zunächst einem S-B-Strahlungsäquivalent von 390 W/m². Gegenüber der hohen Atmosphäre mit minus 18°C ergibt sich damit nach der Umgebungsgleichung des S-B-Gesetzes [Delta S = Sigma * (T4-T04)] aber ein Delta-Wärmefluss vom Wärmeren (Erdoberfläche) zum Kälteren (hohe Atmosphäre) von lediglich 155 W/m²:

(@NST = 14,8°C&390W/m²) 155 W/m² => (@T@70 = -18°C&235W/m²) 235 W/m² => Weltraum

Damit folgt die bekannte Differenz von [Delta S = 155 W/m²] exakt den HS der Thermodynamik und hat gar nichts mit einem „Treibhauseffekt“ oder einer „Gegenstrahlung“ zu tun, sondern ist allein den jeweils behaupteten Ortstemperaturen (T=14,8 °C) und (T0 = -18°C) geschuldet.

MEINE ARGUMENTATION zu THESE (2) – Breitenabhängige Mittelung der solaren Einstrahlung über Tag und Nacht (Kramm et al.):

Dieser Ansatz ist zwar „etwas anders“ als (1), aber auch NICHT richtig. Denn er verletzt durch eine breitenabhängige globale Mittelung ebenfalls die die STRENGE PHYSIKALISCHE GLEICHZEITIGKEIT im Stefan-Boltzmann-Gesetz.

BEWEISFÜHRUNG (2.1): Eigenartig ist, dass Kramm et al (2017) hier mit einem dünnen „Multilayer“ als Modell für unseren „Wasserplaneten“ Erde arbeiten. Diese (begrenzte) Slab-Speicherung bewirkt nämlich lediglich eine leicht verzögerte Abstrahlung, die sich vordergründig allerdings erheblich auf die Ortstemperatur auswirkt, weil die ersten 2 W/m² im S-B-Gesetz bereits ein Temperaturäquivalent von ca. 70 Kelvin liefern.

Aber allein die in den OZEANEN gespeicherte Energie (=Arbeit=Leistung*Zeit) entspricht einer Abstrahlungsleistung unserer Erde von etwa 120 JAHREN bei (IN=OUT@NST). Ein konservativer Vergleich des Wärmeinhalts der Ozeane mit der täglichen und jährlich global eingestrahlten Sonnenenergie zeigt, dass deren Einfluss auf die globale Temperaturgenese nicht vernachlässigt werden darf:

(Tag = 1,05*10^22 Joule) << (Jahr = 3,85*10^24 Joule) << (Ozeane > 4,59*10^26 Joule)

Die Ozeane enthalten also ein Energieäquivalent von etwa 50.000 Tagen Sonneneinstrahlung oder 100.000-mal die notwendige Energie, um auf der Erde eine vergleichbare Nachtabkühlung wie auf dem Mond zu verhindern. Die Interaktion der Ortstemperatur mit den globalen Wärmespeichern Atmosphäre und Ozeanen ist ein wesentlicher Mechanismus in der Temperaturgenese auf unserer Erde, der bei Kramm et al. (2017) lediglich durch eine (begrenzte) Slab-Speicherung in Analogie zum Mond berücksichtigt wird.

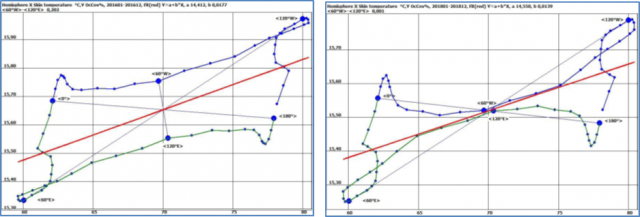

Zur Darstellung des Jahresverlaufs eines breitenabhängigen S-B-Temperaturäquivalentes: Kramm et al. (2017) stellen in Abbildung 22 den breitenabhängigen 24-Stunden-Durchschnitt der solaren Einstrahlung und dessen S-B-Temperaturäquivalent dar. Die Problematik einer solchen 24-stundendurchschnittlichen solaren Strahlungsleistung hatte ich in meinem EIKE-Artikel „Noch ein paar Fragen zum ‚natürlichen‘ atmosphärischen Treibhauseffekt“ vom 23. Juni 2017 anhand einer vergleichbaren Abbildung von Dennis L. Hartmann ausführlich erläutert; insbesondere lässt ein solcher Strahlungsdurchschnitt keinesfalls die Berechnung eines S-B-Temperaturäquivalentes zu. Der korrekte breitenabhängige Jahresverlauf des maximalen S-B-Temperaturäquivalentes ist weiter oben unter THESE (4) abgebildet und bestätigt die globale Klimaküche zwischen den Wendekreisen.

Es ist daher äußerst befremdlich, wenn Kramm et al. (2017) in Abbildung 22a aus einem solchen rechnerischen 24-Stunden-Strahlungsdurchschnitt ein S-B-Temperaturäquivalent ableiten, bei dem sich die globalen Temperatur- und Strahlungsmaxima wegen der Tageslängen im Polarsommer zwangsläufig auf der Polkalotte der jeweiligen Sommerhemisphäre konzentrieren. Die dermaßen fehlerhaft ermittelten Temperaturen liegen folglich im Jahresverlauf um den Äquator zwischen 220K und 240 K und steigen zum jeweiligen Pol der Sommerhemisphäre stark an. Grund dafür ist, dass die temperaturwirksame solare Einstrahlung zwischen den Wendekreisen im 24-Stunden-Durchschnitt praktisch halbiert wird, und sich in diesem Modell von Kramm et al. (2017) die globale „Klimaküche“ dadurch fälschlicherweise von der Äquatorzone zwischen den Wendekreisen auf den geographischen Pol der Sommerhemisphäre verschiebt.

BEWEISFÜHRUNG (2.2): Kramm et al. (2017) umschiffen die Problematik der terrestrischen Temperaturgenese, indem sie in ihrer Kernaussage (2.2) einfach die primäre Wirkungskette (Strahlungsflüsse = Ursache) und (lokale Temperaturen = Wirkung) umkehren. So kommen Kramm et al. (2017) schließlich zu dem Ergebnis, Zitat: „Based on our findings, we may conclude that the effective radiation temperature yields flawed results when used for quantifying the so-called atmospheric greenhouse effect.“ (S. 283 Ende vorletzter Absatz)

Der unparteiische Google-Übersetzer sagt: „Aufgrund unserer Ergebnisse können wir den Schluss ziehen, dass die effektive Strahlungstemperatur bei der Quantifizierung des sogenannten atmosphärischen Treibhauseffekts zu fehlerhaften Ergebnissen führt.“

Das Problem dieser Aussage ist wiederum, dass Kramm et al. gar nicht versucht hatten, den atmosphärischen Treibhauseffekt an einem realistischen Modell der Erde zu quantifizieren, sondern an ihrem nachweislich der BEWEISFÜHRUNG zu (2.1) unzureichenden „Multilayer“-Mond-Modell.

MEINE ARGUMENTATION zu THESE (3) – Globale Stefan-Boltzmann-Integration (Gerlich&Tscheuschner):

Der von Gerlich und Tscheuschner aufgezeigte Widerspruch (33°C # 144°C) ist analog zu dem gängigen „Faktor4“-Ansatz für einen „natürlichen atmosphärischen Treibhauseffekt“ innerhalb dieses Modells (1) korrekt abgeleitet worden.

Damit haben Gerlich&Tscheuschner den „natürlichen atmosphärischen Treibhauseffekt“ widerlegt.

Allerdings ist diese Widerlegung aus dem global gemittelten Modell (1) heraus erfolgt und daher kann dieses Ergebnis nicht auf die reale Erde angewendet werden. Denn lediglich die Tagseite der Erde (2PIR2) darf im Strahlungsgleichgewicht zwischen Sonne und Erde mit dem Stefan-Boltzmann-Gesetz betrachtet werden. Von daher hätte diese Lösung von Gerlich and Tscheuschner (2009) auf die Tagseite der Erde (2PIR2) beschränkt bleiben müssen.

BEWEISFÜHRUNG (3): Die physikalische Globaltemperatur Tphys von Gerlich and Tscheuschner (2009) beträgt -129 °C, respektive 144,15 K für die gesamte Erdoberfläche (4PIR2). Mit dem Stefan-Boltzmann-Gesetz darf aber lediglich die Tagseite der Erde (2PIR2) im Strahlungsgleichgewicht zwischen Sonne und Erde betrachtet werden. Von daher muss diese Lösung von Gerlich and Tscheuschner (2009) auf die Tagseite der Erde (2PIR2) reduziert werden.

Korrektur Weber für die Integrallösung von G&T: Lösung G&T * 4πR2 / 2πR2 = 2 * Lösung G&T

Folglich verdoppelt sich die Lösung von Gerlich and Tscheuschner für die physikalische Temperatur auf Tagseite der Erde zu

Tphys-korr = 288,3 °K oder 15,15 °C (Korrektur Weber für Lösung G&T)

und bestätigt damit wiederum meinen hemisphärischen Stefan-Boltzmann-Ansatz.

MEINE ARGUMENTATION zu THESE (4) – Hemisphärischer Stefan-Boltzmann-Ansatz (Weber):

Hier muss sich der interessierte Leser ein eigenes Urteil bilden, weil es sich um meinen eigenen hemisphärischen Stefan-Boltzmann-Ansatz handelt. Zwecks Arbeitsentlastung der EIKE-Redaktion finden Sie nachfolgend einige Kommentarvorschläge zum Ankreuzen:

O U. Weber, Fachrichtung Science Fictíon – unklar bleibt, warum EIKE einen derartigen Quark veröffentlicht!

O Alles was Sie hier schreiben ist völlig falsch, das hatte ich Ihnen schon vor 2 Jahren in meiner E-Mail nachgewiesen.

O Der „Geophysiker“ Weber verbreitet nun schon zum 14. Mal seinen Quatsch hier auf EIKE und hat den Faktor 4 immer noch nicht verstanden.

O Sie vergessen völlig, dass sich die Erde dreht. Und das so schnell, dass sich der größte Anteil der Erdoberfläche mit Überschallgeschwindigkeit nach Osten bewegt.

O Sie haben da einen Rechtschreibfehler in Ihrem Text. Wenn Sie einen so simplen Fehler machen, muss alles andere auch falsch sein.

O Zum fremdschämen, Herr Weber ist einfach nur peinlich.

O Die Anwendung des Stefan-Boltzmann-Gesetzes auf die Erde ist absurd.

O Was der Autor schreibt ist völliger Unsinn, ich habe das deshalb HIER mal einfach verständlich erklärt…

O Man kann doch nicht eine spezielle Situation der Anwendung des Stefan-Boltzmann Gesetzes herzuziehen, um die Physik der Erde umzukrempeln.

O Sie behaupten also, die Erde sei eine Scheibe und die Sonne scheint auch nachts.

Diese Liste bitte ausdrucken, einen passenden Kommentar ankreuzen, den Zettel zusammenknüllen und dann wegwerfen – Sie werden Sich danach sofort erleichtert fühlen. Die in diesem Beitrag zitierten Protagonisten dürfen selbstverständlich gleich mehrere Kommentare ankreuzen…

BEWEISFÜHRUNG (4): Ich darf an dieser Stelle zunächst nochmals darauf hinweisen, dass das mathematische Gleichheitszeichen im Stefan-Boltzmann-Gesetz die physikalische Randbedingung der GLEICHZEITIGKEIT impliziert.

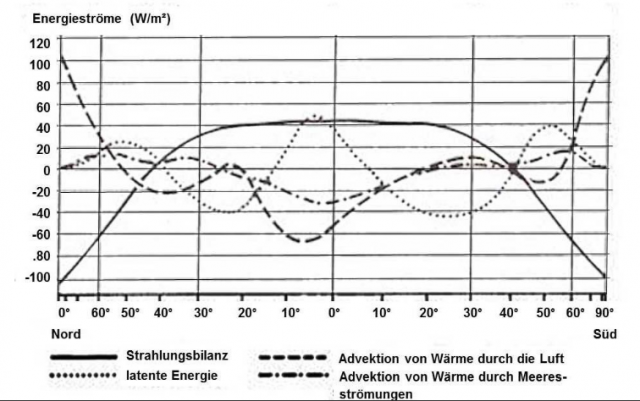

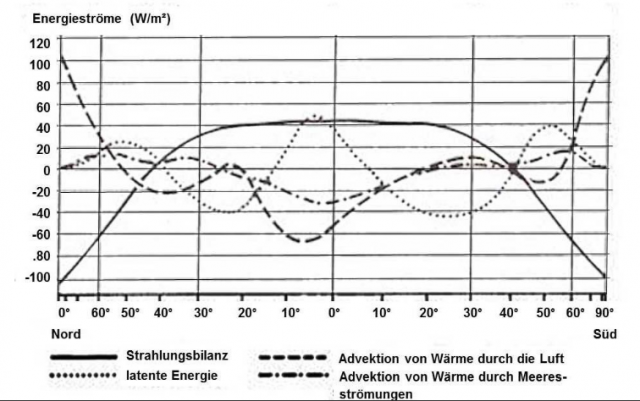

Ein weiteres Argument für meinen hemisphärischen S-B-Ansastz ist die nachfolgende Abbildung „Jahresmittel des Energiehaushaltes der Atmosphäre und seiner Komponenten in Abhängigkeit von der geographischen Breite“ nach Häckel, die das Jahresmittel der advektiven Energieströme auf unserer Erde zeigt:

Abbildung: „Jahresmittel des Energiehaushaltes der Atmosphäre und seiner Komponenten in Abhängigkeit von der geographischen Breite“ nach HÄCKEL, H. (1990): Meteorologie. – 8. Aufl. 2016; Stuttgart (Verlag Eugen Ulmer), ISBN 978-3-8252-4603-7)

Diese Abbildung zeigt auf Basis einer globalen Energieabstrahlung von 235 W/m² den im Jahresdurchschnitt von den globalen Zirkulationen aus den äquatorialen Regionen in mittlere und höhere geographische Breiten hinein verfrachteten Wärmestrom. Tatsächlich dürften diese Beträge im jeweiligen Winterhalbjahr der mittleren und höheren Breiten noch deutlich höher ausfallen als der Jahresdurchschnitt selbst. Da die Betrachtung der globalen Abstrahlung über die Umgebungsgleichung des Stefan-Boltzmann-Gesetzes in meinem hemisphärischen S-B-Ansatz ebenfalls auf einer durchschnittlichen globalen Abstrahlung von 235 W/m² beruht, reiht sich diese Abbildung von Häckel widerspruchslos in diese Argumentation ein.

Denn damit ist der Nachweis erbracht, dass die hemisphärisch ermittelten Einstrahlungsdefizite im jeweiligen Winterhalbjahr der mittleren und höheren Breiten aus dem horizontalen Wärmetransport der globalen Zirkulationen abgemildert werden.

In Teil 3 werden die Erkenntnisse zu den einzelnen Thesen/Antithesen und das Ergebnis dieser Analyse vorgestellt.