Die unglaubliche Geschichte, wie Klimawandel apokalyptisch wurde

Es stimmt zwar, dass apokalyptische Dissonanzen immer einen Platz in Diskussionen über Klima hatten. Im Jahre 1989 warnten die UN, dass der Welt „nur noch ein Zeitfenster von 10 Jahren verbleibt, um dem Treibhauseffekt entgegen zu treten, bevor dieser sich der menschlichen Kontrolle entzieht“ (hier). Aber die Eskalation der apokalyptischen Klima-Rhetorik während der letzten Jahre ist beispiellos. Die Untergangs-Trommelei hat einige prominente Gestalten dazu verleitet, der Mainstream-Klima-Gemeinschaft beizutreten mit dem Lamento, dass „Klimawissenschaftler die Rate des Klimawandels sowie die Schwere von dessen Auswirkungen bisher unterschätzt haben“ (hier). In Wirklichkeit hat die Klimawissenschaft es nicht einmal vermocht, den Klimawandel genau zu bestimmen – und das permanent auch nicht über die letzten 50 Jahre (hier).

Folglich gibt es hier eine Inkonsistenz. Die Diskussionen über Klimawandel sind apokalyptischer geworden, nicht aber die Klimawissenschaft (hier). Es war schwierig, diese Inkonsistenz zu verstehen, und obwohl ich noch nicht alle Antworten gefunden habe, so habe ich doch einen großen Teil dieses Puzzles ausgemacht, über welches ich hier zum ersten Mal berichten möchte.

Diskussionen über Klimawandel sind direkt oder indirekt beeinflusst von Experten, die unter dem Schirm des IPCC arbeiten. Das IPCC wurde während der 1980er Jahre ins Leben gerufen, um die Klimawissenschaft zusammenzufassen und Schätzungen vorzunehmen, um dann die Politiker zu informieren. Das IPCC hat seitdem fünf große Zustandsberichte veröffentlicht sowie periodisch Abschätzungen zu Teilbereichen.

Ich habe bei vielen Gelegenheiten dem Kongress Rede und Antwort gestanden hinsichtlich der kritischen Bedeutung des IPCC. Das IPCC spielt bei allem eine so zentrale Rolle, dass man es hätte erfinden müssen, wenn es das nicht schon gäbe. Forschungen bzgl. Klimawandel resultieren in umfang- und variantenreicher Literatur, welche zusammenzustellen ohne die Experten-Zustandsbeschreibungen wie jene des IPCC unmöglich wäre. Das IPCC spielt also eine eine entscheidende Rolle am Schnittpunkt zwischen Wissenschaft und Politik.

Ein vom Menschen verursachter Klimawandel ist natürlich ein reales und bedeutendes Problem [?]. Ich habe seit Jahrzehnten immer wieder die Wichtigkeit der Reduktion von Kohlendioxid-Emissionen betont sowie die Notwendigkeit, sich an Klima-Variabilität und -Änderung anzupassen. Aber eine effektive Politik ist jetzt bedroht durch die apokalyptische Wendung in der Klimadebatte.

Entscheidungen innerhalb des IPCC haben zu dieser apokalyptischen Wende in den Diskussionen beigetragen. Das brachte uns von konstruktiven Diskussionen ab, ängstigt Kinder und trägt zu überhitzter Rhetorik bei. Um die Rolle des IPCC im jüngsten Aufstieg des Klima-Untergangs zu verstehen, muss man verstehen, auf welche Art und Weise diese Institution ihre Zustandsberichte erstellt.

Allem, was dem IPCC bei deren Erstellung zugrunde liegt, sind Zukunfts-Szenarien. Derartige Szenarien werden herangezogen, um den zukünftigen Klimawandel zu projizieren, ebenso wie die Auswirkungen eines solchen Wandels auf Gesellschaft und Umwelt sowie Kosten und Nutzen von Maßnahmen zur Abschwächung dieser Auswirkungen.

Um derartige Projektionen zu erzeugen, hat das IPCC in seinen Szenarien lange differenziert zwischen „Grundlegenden Szenarien“ [baseline scenarios] der Zukunft, welche beschreiben, wohin die Welt steuert beim Fehlen jedweder Klimapolitik einerseits und „Abschwächungs-Szenarien“ [mitigation scenarios], welche eine Welt mit Klimapolitik beschreiben, andererseits. Grundlegende Szenarien werden oftmals als „Business as Usual“ gewertet.

Der Aufstieg des neuen Klima-Kataklysmus‘ kann direkt bis zu einer folgenreichen, aber kaum beachteten Änderung zurückverfolgt werden, mit welcher das IPCC seine Szenarien präsentiert. Die Konsequenzen dieser Änderung haben in der gesamten wissenschaftlichen Gemeinde nachgehallt, ebenso wie in der Berichterstattung der Medien und in Diskussionen von Politik und Gesellschaft.

Vor fast zwei Jahrzehnten hat das IPCC einen Satz von Szenarien entwickelt (hier) als Grundlage für die Integration der Arbeiten seiner drei Arbeitsgruppen zu Wissenschaft, Auswirkungen und Abschwächung. Die Szenarien waren entwickelt worden, um als die Grundlage zukünftiger Klima-Entwicklungen und den Folgen von Maßnahmen zu dessen Abschwächung zu dienen. Eine solche Koordinierung bzgl. der gesamten Abschätzungen des IPCC ist offensichtlich sinnvoll.

Zu jener Zeit erkannte das IPCC, dass „die Zukunft inhärent unvorhersagbar ist und dass infolgedessen die Ansichten in dieser Hinsicht darüber auseinandergehen, welches der repräsentativen Szenarien mehr oder weniger wahrscheinlich ist. Daher ist die Entwicklung eines einzelnen ,Best Guess‘– oder ,Business as Usual‘-Szenarios weder wünschenswert noch möglich“. Auf der Grundlage dieser Perspektive entwickelte das IPCC zwar einen Satz von Szenarien für unsere kollektive Zukunft, legte sich aber nicht fest, welches davon wahrscheinlicher ist als ein anderes. Es erklärte: „der Terminus ,Business as usual‘ kann irreführen sein“ und „die meisten in diesem Bericht betrachteten Szenarien können als theoretisch [exploratory] betrachtet werden“.

Das Ergebnis dieser Prozedur war, dass die projizierte Zukunft beim Fehlen von Klimapolitik eine sehr breite Palette möglicher Entwicklungen umfasste. Der vierte Zustandsbericht des IPCC aus dem Jahr 2007 räumte diese breite Palette zukünftiger möglicher Entwicklungen ein. „Es gibt immer noch eine riesige Spannbreite von (Kohledioxid-)Emissionen in allen Grundlagen-Szenarien in der Literatur, wobei die Emissionen im Jahre 2100 eine Bandbreite von 10 Gt bis zu rund 250 Gt CO2 aufweisen“.

Mit anderen Worten, wenn es um Kohlendioxid-Emissionen aus der Verbrennung fossiler Treibstoffe und die damit verbundenen Klima-Konsequenzen geht, enthält die langfristige Zukunft Möglichkeiten, die von höchst optimistischen (das 10 Milliarden-Tonnen-Szenario) bis zu höchst pessimistischen (die 250 Milliarden Tonnen) Szenarien reichen – und alles dazwischen auch.

Eine enorm folgenschwere Änderung der Prozedur vollzog das IPCC dann von seinem 4. Zustandsbericht 2007 zum 5. Zustandsbericht 2013. Das IPCC verwarf sein früheres Eingeständnis der fundamentalen Unsicherheiten und Ignoranz bzgl. der Zukunft. Stattdessen wurde in vollem Umfang das Szenario „Business as Usual“ für die Zukunft auf den Schild gehoben. Dieses vom 5. Zustandsbericht übernommene Szenario war assoziiert mit einem der extremsten Szenarien der Zukunft.

Im 5. Zustandsbericht stellt das IPCC fest: „Die zukünftigen Treibhausgas-Emissionen sind unsicher. Zwischen 1970 und 2010 nahmen die Emissionen um 79% zu (von 27 Gt auf über 49 Gt). Business as Usual würde zu einer Fortsetzung dieser Rate führen“. Eine Zunehme mit dieser Rate würde bewirken, dass zum Ende dieses Jahrhunderts 189 Milliarden Treibhausgase emittiert werden würden. Dies liegt innerhalb des 99. Perzentils aller Szenarien in der Datengrundlage von Referenz-Szenarien im 5. Zustandsbericht (hier).

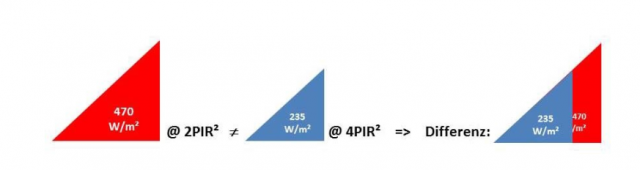

Der 5. Zustandsbericht ging noch weiter und identifizierte explizit eine Untermenge von Referenz-Szenarien, welche charakterisierten, wo das IPCC dem Glauben anhängt, wohin sich die Welt ohne jede Klimapolitik entwickeln würde. Die Bandbreite der in dem Report für das Jahr 2100 angenommenen Emissionen allein für „Business as Usual“ reicht von 50 Gt bis 106 Gt Kohlendioxid (was als die 10% bis 90%-Perzentile der Szenarien-Datengrundlage beschrieben wird). Der Report ging noch weiter und identifizierte ein einzelnes Szenario als „Business as Usual“ mit Kohlendioxid-Emissionen von über 80 Milliarden Tonnen im Jahre 2100 (dieses Szenario wird als RCP 8.5 bezeichnet).

Vom 4. zum 5. Zustandsbericht änderte sich die Zukunft, wie sie vom IPCC gesehen wird, dramatisch. Die Welt ging nicht mehr einer großen Bandbreite möglicher Entwicklungen entgegen mit enormen Unsicherheiten, sondern stattdessen mit einiger Sicherheit einer Zukunft, welche charakterisiert ist durch ein extremes Niveau von Kohlendioxid-Emissionen (hier). Quantitativ sind 50 Milliarden Tonnen Emissionen im Jahre 2100 aus den IPCC-Szenarien einfach verschwunden, und der Schwerpunkt legte sich auf ein „Business as Usual“-Szenario von über 80 Milliarden Tonnen Emissionen im Jahre 2100 (hier).

Die Apokalypse ist auf den Weg gebracht.

Die Entscheidung des IPCC, seinen 5. Zustandsbericht auf das extremste Szenario überhaupt zu konzentrieren, war unglaublich folgenreich. Tausende akademischer Studien bzgl. der zukünftigen Auswirkungen des Klimawandels folgten der Anleitung seitens des IPCC und haben das extremste Szenario als „Business as Usual“ hervorgehoben. Dies wird jetzt oftmals als das Einzige interpretiert und als die Zukunft, der die Welt entgegen geht. Im Jahre 2019 beispielsweise sind zwei neue akademische Studien pro Tag veröffentlicht worden (hier), welche dieses extremste aller Szenarien als „Business as Usual“ darstellen und extremste zukünftige Auswirkungen prophezeien. Journalisten schlachten diese ,sensationalistischen‘ Ergebnisse aus, die von Aktivisten und Politikern noch weiter übertrieben werden (hier), und als Konsequenz davon wird der Klimawandel als immer apokalyptischer betrachtet.

Das Problem mit dem extremen „Business-as-Usual“-Szenario im 5. IPCC-Zustandsbericht besteht darin, dass es schon jetzt überholt ist. Schon für das Jahr 2020 werden die Emissionen auf das Wildeste übertrieben, was in der akademischen Literatur schon als höchst unwahrscheinlich wenn nicht unmöglich beschrieben wird. Die International Energy Agency IEA hat Szenarien für die nächsten Jahrzehnte entwickelt (hier), welche erheblich vom favorisierten Szenario des IPCC abweichen. Natürlich ist es möglich, dass die Welt massive Mengen Kohlendioxid emittiert, was jedoch eine massive Zunahme der Verbrennung von Kohle zur Voraussetzung hat. Aber dieses Szenario ist mit Sicherheit nicht vorherbestimmt, und andere zukünftige Entwicklungen sind mit Sicherheit auch möglich.

Bemerkenswerterweise ist das IPCC drauf und dran, sich weiterhin auf Extrem-Szenarien wie „Business as Usual“ in seinem bevorstehenden 6. Zustandsbericht zu stützen, obwohl diese Szenarien längst überholt sind.

Zu all dem werde ich künftig sicher noch mehr schreiben, ist es doch derzeit der Schwerpunkt meiner Forschungen. Für heute steht unter dem Strich zu verstehen, dass eine verhängnisvolle Entscheidung des IPCC, selektiv ein Extrem-Szenario aus einer gewaltigen Palette möglicher zukünftiger Szenarien herauszupicken, wesentlich dazu beigetragen hat, die Klima-Apokalypse zu erzeugen – eine ängstigende, aber durchweg imaginäre Zukunft.

Übersetzt von Chris Frey EIKE