Sie beginnt so:

Der steigende Säuregehalt des Pazifiks führt dazu, dass sich die Schalen des Pazifischen Taschenkrebses [Dungeness crab] auflösen.

Die Versauerung macht die Schalen der Larven dieser Krebse verwundbarer gegenüber Raubtieren und limitiert die Effektivität zum Wachstum der Muskeln.

Der Pazifische Ozean wird so sauer, dass sich die Schalen einer Schlüsselspezies von Krebsen aufzulösen beginnen. Dies geht aus einer neuen US-Studie hervor.

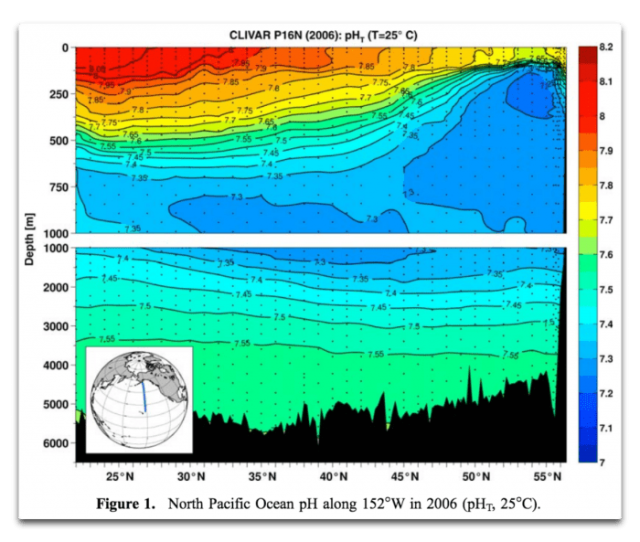

Sieht aus, als wäre das Ende der Zeiten gekommen, oder? Also möchte ich gleich zu Beginn ein simples Faktum nennen: Der Ozean ist NICHT sauer! Und das wird er auch nie werden, außer vielleicht an ein paar isolierten Stellen. Er ist alkalisch. Das Niveau von sauer/alkalisch wird mit der pH-Skala ausgedrückt. Auf dieser ist 7.0 neutral, 7 bis 14 alkalisch und 0 bis 7 sauer. [Siehe Abbildung 1 ganz oben! Hier noch einmal, weil sie oben nicht vollständig gezeigt wird:]

Aus der Graphik geht ein pH-Wert um 8 der Ozeane hervor (allerdings, wie wir sehen werden, verdeckt das erhebliche Variationen).

Und dem zufolge, was ich in der High School in Chemie über chemische Analyseverfahren gelernt habe weiß ich, dass wenn man einer basischen Lösung etwas Säure hinzufügt – oder auch umgekehrt – das aus einem einfachen Grund „Neutralisierung“ genannt wird, bewegt sich doch die Lösung in Richtung neutral.

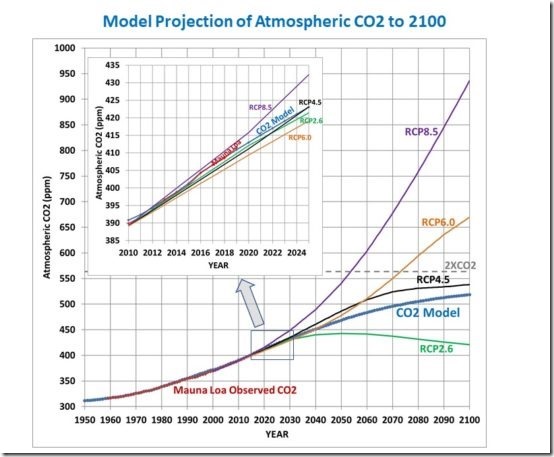

Wenn sich Kohlendioxid im Regen- oder Ozeanwasser löst, entsteht eine schwache Säure. Fügt man diese schwache Säure dem Ozean hinzu, wird dieser leicht etwas neutralisiert. Um wie viel? Nun, falls man den Modellen Glauben schenken will, bewegt sich der pH-Wert der Ozeane bis zum Jahr 2100 von derzeit 8 auf etwa 7,92. Mit anderen Worten, eine schwache Neutralisierung.

Warum aber ist dann andauernd von „Ozean-Versauerung“ die Rede und nicht von „Ozean-Neutralisierung“? Traurige Antwort: weil „Versauerung“ viel beängstigender klingt. Das kann man in obigen Ausführungen erkennen, wo es heißt:

Der Pazifische Ozean wird so sauer, dass sich die Schalen einer Schlüsselspezies von Krebsen aufzulösen beginnen. Dies geht aus einer neuen US-Studie hervor.

Nun, nein! Das kann falscher nicht sein. Der Ozean ist nicht im Geringsten sauer. Er ist lediglich etwas weniger alkalisch. Die Verwendung des Terminus‘ „Versauerung“ anstatt „Neutralisierung“ soll uns davon überzeugen, dass das Unmögliche passiert. Man stelle sich einmal vor, die Aussage oben würde lauten

Der Pazifische Ozean wird so neutralisiert, dass sich die Schalen einer Schlüsselspezies von Krebsen aufzulösen beginnen. Dies geht aus einer neuen US-Studie hervor.

Nanu? Der Pazifische Ozean wird so neutral, dass sich Dinge aufzulösen beginnen? Wie bitte?

Der Alarmismus dreht durch.

Und noch etwas ist wichtig hinsichtlich des pH-Wertes. Lebewesen kommen mit sauren Substanzen wesentlich besser zurecht als es bei uns mit alkalischen Substanzen der Fall ist. Man betrachte noch einmal Abbildung 1 oben. Wir konsumieren regelmäßig ziemlich saure Sachen. Weintrauben und Orangensaft hat einen pH-Wert von etwa 3. Zitronensaft hat einen pH-Wert von zwei, sehr sauer, fünf pH-Einheiten unter neutral. Und bei sechs Einheiten unter neutral mit einem pH-Wert von nur eins – ist unsere eigene Magensäure.

Aber wir essen nicht viel, das alkalischer ist als ein pH-Wert von etwa 10, wie Kohl, Brokkoli und Artischocken. Und während unsere Mägen einen pH-Wert von 1 mühelos tolerieren, werden wir übel verätzt durch Bleiche am entgegen gesetzten Ende der pH-Skala.

Und jetzt zum erforderlichen Vorbehalt (Disclaimer). Für dieses Thema habe ich ein persönliches Interesse und eine persönliche Leidenschaft. Ich lebe an der Westküste der USA in genau dem Gebiet, um das es hier geht, und ich habe in diesen Gewässern seit Jahren kommerziell geangelt. Daher weiß ich Einiges über lokale ozeanische Ökosysteme.

Damit als Prolog nun zurück zu der Panikmache im Guardian-Artikel. Dieser basiert auf einer wissenschaftlichen Studie mit dem Titel [von Google übersetzt] „Exoskelett-Auflösung mit Mechanorezeptor-Schäden bei der Larve der Dungeness-Krabbe im Zusammenhang mit dem Schweregrad der heutigen vertikalen Gradienten der Ozeanversauerung“ [Link zum Original hier] … die „Ozean-Versauerung“ (OA) schlägt wieder zu. Auszug aus dem Abstract:

Die Ozean-Versauerung (OA) entlang der US-Ostküste intensiviert sich schneller als im globalen Ozean beobachtet. Dies gilt vor allem in küstennahen Regionen (<200 m), die eine geringere Puffer-Kapazität aufweisen und gleichzeitig wichtige Lebensräume für ökologisch und wirtschaftlich bedeutende Arten bieten.

Nun kann ich nirgendwo in der Studie irgendeine Referenz für den Gedanken entdecken, dass die US-Westküste irgendwie schneller versauert als der globale Ozean. Tatsächlich haben wir kaum pH-Daten aus dem globalen Ozean.

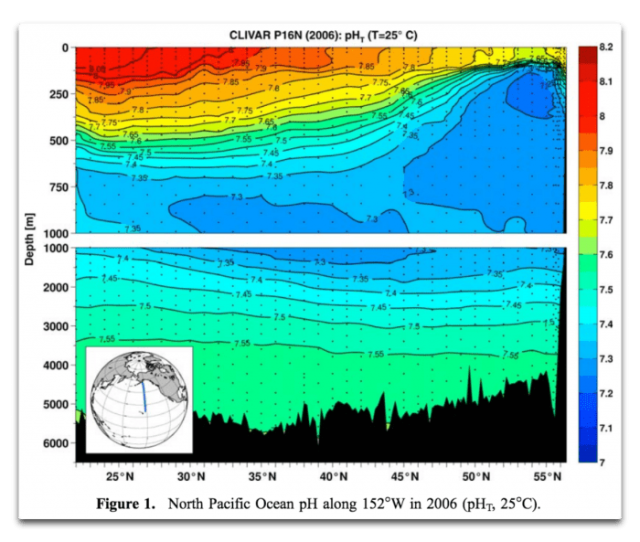

Aber ein paar Daten haben wir doch. Eine höchst informative Graphik zeigt einen Ausschnitt des Ozeans von der Oberfläche bis zum Grund und von Hawaii bis nach Alaska. Im Verlauf von 15 Jahren sind Wissenschaftler immer wieder diese Route entlang gefahren, wobei sie periodisch den pH-Wert von der Oberfläche bis zum Grund maßen. Dazu habe ich in meinem Beitrag mit dem Titel „The Electric Oceanic Acid Test“ schon etwas geschrieben. Hier folgt dieser Ozean-Querschnitt mit dessen Original-Bildinschrift:

Abbildung 2. Der Einschub links unten zeigt das Untersuchungsgebiet. Quelle

Nun gibt es hinsichtlich dieser Graphik mehrere faszinierende Phänomene. Das erste ist die große Bandbreite der pH-Werte im Ozean. Wir neigen zu der Annahme, dass der pH-Wert überall in etwa gleich ist, aber nichts könnte weiter von der Wahrheit entfernt sein. Um Hawaii (in der Graphik oben links) beträgt der pH-Wert 8,5. Aber ein paar hundert Meter unter der Oberfläche vor der Küste Alaskas (oben rechts) beträgt dieser Wert 7,25. Dieser pH ist das, was hysterische Wissenschaftler und der Guardian als „SEHR VIEL SAURER“ bezeichnen, aber die richtige Beschreibung wäre „neutraler“.

Und weiter – wo befinden sich die meisten Lebewesen in dieser Graphik? Nun, genau vor der Küste Alaskas, in meinen alten Fischgründen, die angefüllt sind mit Plankton, Heringen, Lachsen, Flundern, Walen und allen Arten maritimer Lebensformen überhaupt. Sie alle florieren in jenen „SEHR VIEL SAUREREN“, d.h. „neutraleren“ Ozeanwassern.

Und schließlich gedeiht Meeresleben unter allen pH-Werten in der Graphik. Es gibt Fische und andere Meereslebewesen bei jedem pH-Niveau und in jedem von der Graphik abgedeckten Gebiet, von oben bis unten und von Hawaii bis nach Alaska. Sie sind nicht gefesselt an einen schmalen Bereich, wo sie sterben werden, wenn sich der pH-Wert auch nur um eine Zehnteleinheit im Verlauf von einhundert Jahren ändert.

Also bitte – können wir uns jetzt nicht einmal von diesem Gedanken verabschieden, wonach eine geringe, allmähliche Neutralisierung jede arme Kreatur im Ozean töten würde? Alkalinität ist ein Problem für Lebewesen im Meer, nicht Versauerung. Darum sind so viele dieser Lebewesen überzogen von einer Schleimschicht – um sich nämlich vor dem alkalischen Seewasser zu schützen.

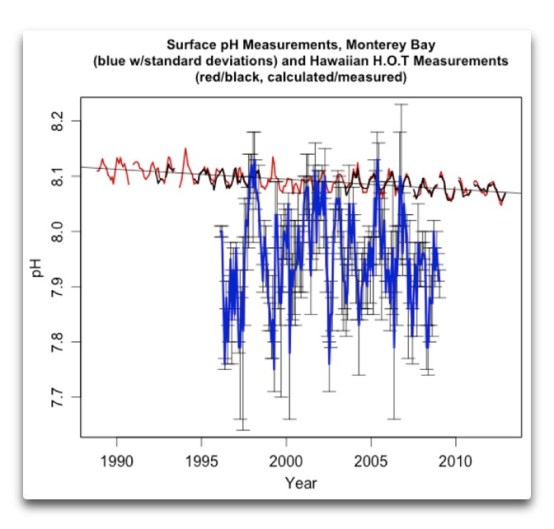

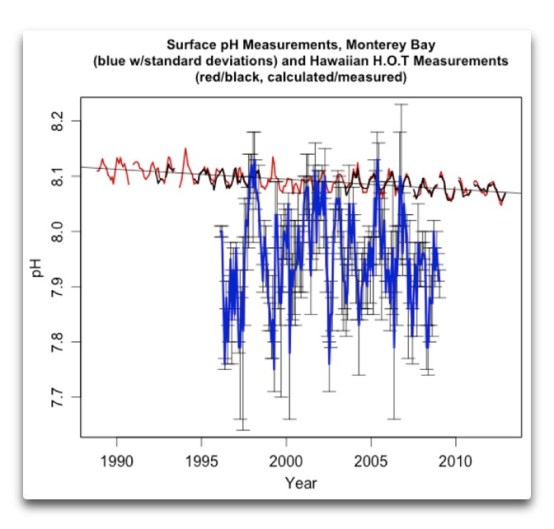

Aber weiter. Ich habe schon zuvor etwas über pH-Messungen geschrieben, und zwar am Einsaugloch des Rohres zum Monterey Bay Aquarium in einem Beitrag mit dem Titel „A Neutral View of Oceanic pH“. In jenem Beitrag wurde offensichtlich, dass der langfristige pH-Trend an jener Stelle geringer war als an der Tiefwasserstelle vor Hawaii. Hier die Graphik aus jenem Beitrag, welche die Differenz zeigt:

Abbildung 3: Oberfächen-pH-Messungen im offenen Ozean (HOT) und an der Küste der Monterey Bay. Die Hawaii-Daten zeigen sowohl gemessene pH-Werte (schwarz) als auch aus anderen Messungen berechnete pH-Werte, z. B. gelöst in anorganischem Kohlenstoff (DIC), totaler Alkalinität und Salinität. Man erkennt die höheren pH-Werte um Hawaii, die schon in der vorigen Abbildung hervortraten.

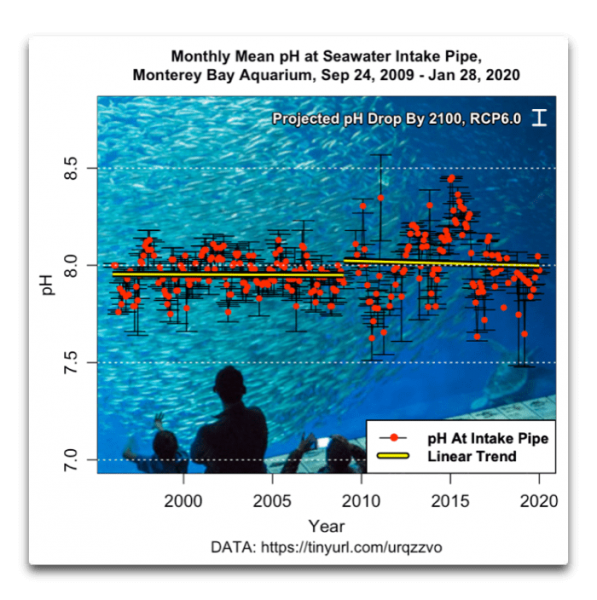

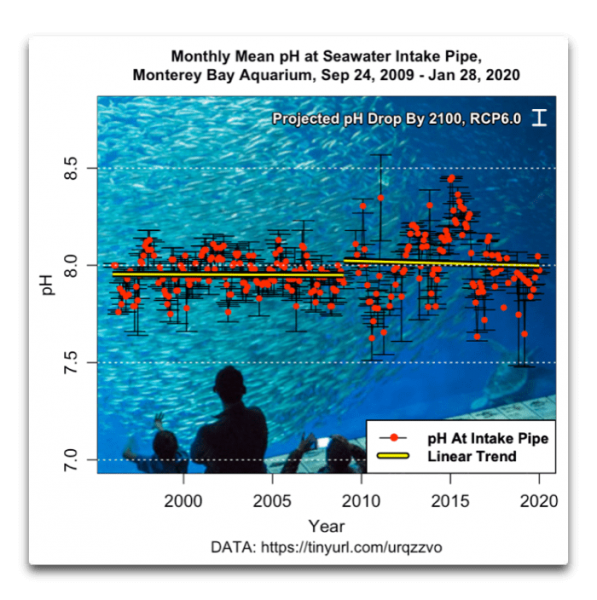

Traurigerweise ist die Website mit dem pH-Datensatz aus der Monterey Bay zu irgendeiner unbekannten japanischen Website geworden. Glücklicherweise habe ich die Daten aber gespeichert. Und ich vermochte sogar weitere pH-Daten aufzufinden in eine Zeitreihe direkt nach dem Ende meiner alten Daten. Allerdings scheint die Kalibrierung der pH-Messfühler in dem neuen Datensatz etwas verändert. Ich habe beide Datensätze in einer Graphik erfasst mit separaten linearen Trendverläufen in beiden Datensätzen:

Abbildung 4: 25 Jahre monatlicher mittlerer pH-Messungen an der Einsaugpumpe, wo 9,5 Millionen Liter Meerwasser pro Tag in das Monterey Bay Aquarium strömen. Zwei separate Datensätze wurden betrachtet. Der Einsaugstutzen befindet sich 15 Meter unter der Wasseroberfläche. Die Größenordnung des projizierten pH-Rückgangs bis zum Jahr 2100 unter dem RCP6.0-Szenario ist dargestellt durch die senkrechten Striche in weiß oben rechts.

Der neutrale pH-Wert von 7,0 findet sich unten, unter den Daten. Man beachte, dass der langzeitliche Trend des mittleren pH-Wertes des Wassers in beiden Datensätzen in etwa gleich ist und dass der Trend ziemlich gering ist im Vergleich zu der projizierten leichten Neutralisierung bis zum Jahr 2100.

Und noch wesentlicher: jene projizierte pH-Abnahme von 0,08 pH-Einheiten bis zum Jahr 2100 wird marginalisiert durch den Tagesgang der pH-Werte. Die Standardabweichung der täglichen pH-Änderung beträgt 0,6 Einheiten, diejenige der monatlichen Änderung 0,1 Einheiten.

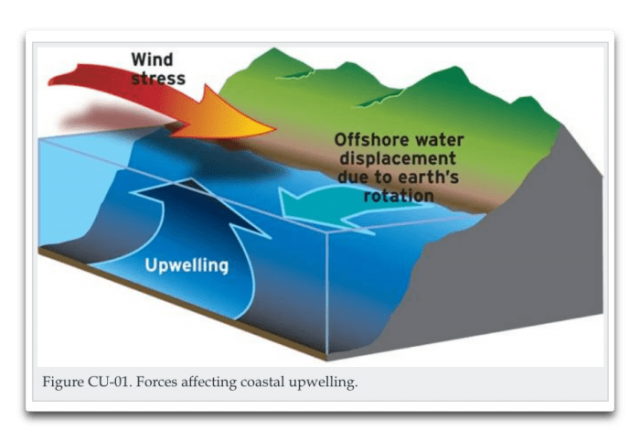

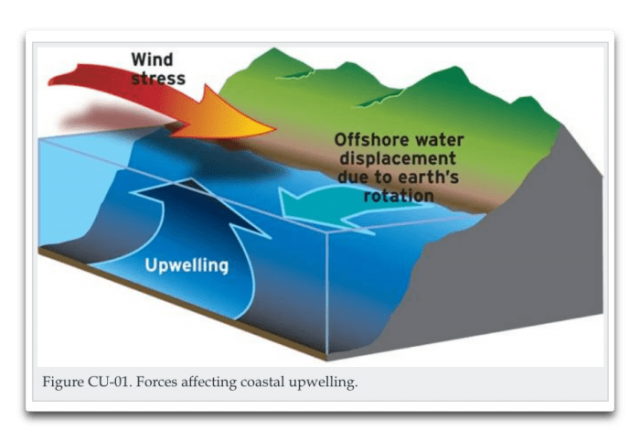

Warum ändert sich der pH-Wert an der US-Westküste so rasch? Das hat alles zu tun mit aufwallendem Wasser vor der Küste. Wechselnde Winde entlang der Küste sorgen dafür, dass kaltes, CO2-reiches und neutraleres Tiefenwasser in unterschiedlicher Menge an die Oberfläche gelangt, was den pH-Wert buchstäblich sich über Nacht ändern lässt.

Abbildung 5: Die mechanische Auswirkung der Nordwinde entlang der US-Westküste sorgt für aufwallendes Tiefenwasser, reich an CO2-Gehalt und neutraler. Quelle: NOAA

Und dieser sich fortwährend ändernde pH-Wert ist es, der diese Behauptungen über ozeanische Lebewesen, die so furchtbar unter trivial geringen Änderungen des pH-Wertes leiden, total unglaubwürdig erscheinen lässt. Jedes Lebewesen im Ozean entlang dieser Küste erlebt Tag für Tag viel stärkere pH-Änderungen als sie im Verlauf des Jahrhunderts erleben werden.

Es gibt noch einen weiteren Datensatz, den ich hierzu noch hinzufügen muss, bevor ich auf die Studie selbst eingehe. Die Studie selbst befasst sich mit einem Gebiet nahe Seattle. Wie also verhält sich der ozeanische pH-Wert ebendort?

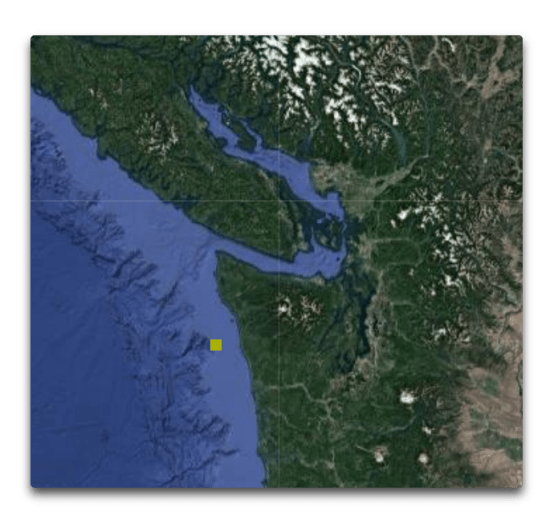

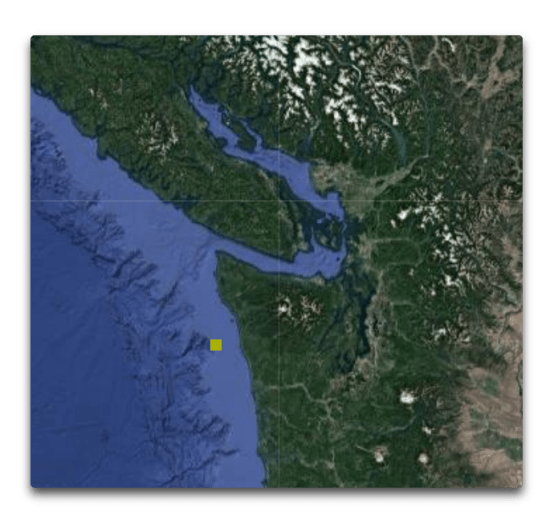

Es stellt sich heraus, dass es sehr schwierig ist, langzeitliche pH-Messungen aus jenem Gebiet zu finden. Die besten, die ich finden konnte, war eine unterbrochene Reihe von Messungen einer Boje vor der Küste von Washington State nahe einer Meerenge – ein wunderschönes Fleckchen unseres Planeten, das ich vor einiger Zeit besucht hatte. Die La Push buoy befindet sich hier:

Abbildung 6: Das gelbe Quadrat kennzeichnet die Stelle der „La Push-Boje. Die Meerenge ist der blaue, landeinwärts gerichtete Kanal. Die Städte Seattle und Tacoma befinden sich am inneren Ende der Meerenge. Vancouver Island in Kanada liegt nördlich derselben.

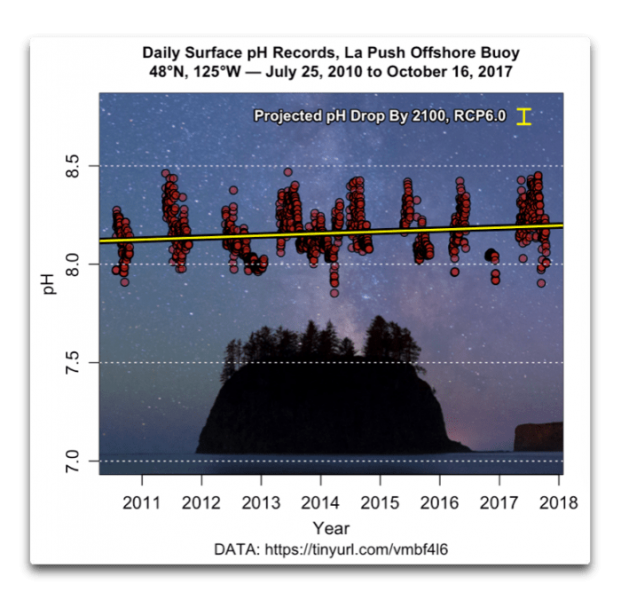

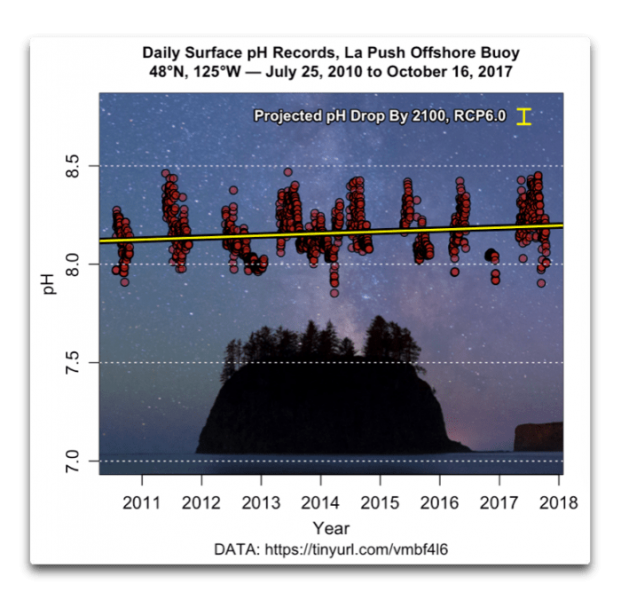

Es sieht so aus, dass die Boje geborgen wird, wenn das Wetter sehr rauh ist, weil weil es in jedem Winter eine Datenlücke gibt. Hier sind die Daten dieser Boje dargestellt, und zwar mit der gleichen Skala wie die Monterey-Daten oben:

Abbildung 7: Tägliche Aufzeichnungen von der Wasseroberfläche der La Push-Boje vor der Küste von Washington State. Im Hintergrund sieht man eine Insel nahe der Boje.

Und wieder erkennt man die gleiche Situation. Die pH-Änderungen sind viel größer als die projizierte Änderung von heute bis zum Jahr 2100. Und während ich die Trendlinie wegen der vielen Datenlücken nicht überbewerten möchte, ist es gut möglich, dass der Trend tatsächlich etwas alkalischer wird.

Wie kann das sein? Man erinnere sich, die pH-Schwingungen entlang dieser Küste und der mittlere pH-Wert selbst sind keine direkten Funktionen des CO2-Niveaus. Stattdessen werden sie gesteuert durch die unbeständige und mittlere Windstärke. Ist es windiger, wallt mehr neutraleres Tiefenwasser auf und erniedrigen den Oberflächen-pH – und umgekehrt.

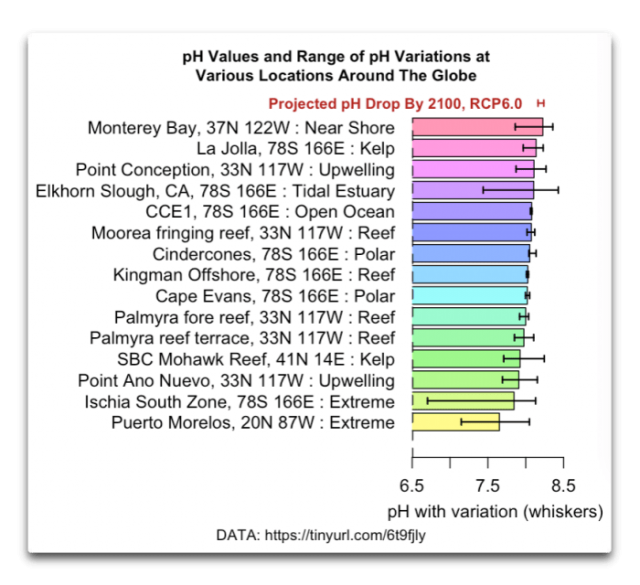

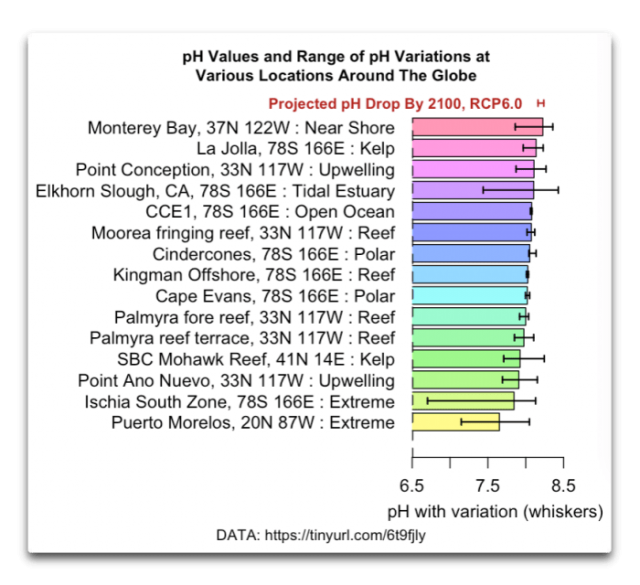

Und falls jemand denkt, dass derartige pH-Schwingungen auf diese Küste beschränkt sind, der betrachte einige Daten aus der ganzen Welt:

Abbildung 8: pH-Werte nebst deren Variationen in verschiedenen ozeanische Ökosystemen. Horizontale Strecken (schwarz) zeigen die Bandbreite der pH-Werte. Das Ausmaß der erwarteten leichten Neutralisierung bis zum Jahr 2100 nach dem RCP6.0-Szenario repräsentieren die roten Strecken oben. Die Ischia South Zone, wo die niedrigsten pH-Werte auftreten, liegt neben einem Vulkan, in dessen Umfeld ständig CO2 aus dem Ozeanboden ausgast. Datenquelle

Schließen möchte ich mit einem Blick auf die Studie selbst, zumindest solange ich es ertragen kann. Ich möchte einige Zitate hervorheben. In der ersten Zeile ihrer „Höhepunkte“ liest man:

Küstennahe Habitate mit den steilsten vertikalen Gradienten der Ozean-Versauerung sind dem Zustand der Krebslarven absolut abträglich.

Nun gibt es so etwas wie einen „vertikalen Gradienten der Ozean-Versauerung“ nicht. Es gibt einen vertikalen pH-Gradienten, wie man es auch erwarten kann mit dem Aufwallen von CO2-reichem Tiefenwasser, welches das alkalischere Oberflächenwasser mit weniger CO2 erreicht. Aber dies ist ein natürlicher Umstand, wie er schon immer vorhanden war und nichts mit Ozean-Versauerung OA zu tun hat. Und es werden auch keinerlei Beweise geliefert, welche zeigen, dass sich der Gradient in Zukunft markant ändern wird.

In ihren Conclusions schreiben sie:

Wie die Auflösung bei Pteropoden ist das bei der Dungeness-Krabbe beobachtete Larvensterben ein klarer Beweis dafür, dass wirbellose Meerestiere in ihrer natürlichen Umgebung durch eine längere Exposition gegenüber starken, heutigen OA-bezogenen vertikalen Gradienten geschädigt werden.

[Ausnahmsweise übersetzt mit Linguee-Translator. Anm. d. Übers.]

Allerdings bringen sie auch hier keine Beweise dafür, dass eine „OA“ oder eine milde ozeanische Neutralisierung in der Vergangenheit irgendwelche Auswirkungen auf die „vertikalen Gradienten in der natürlichen Umgebung“ hatten. Die vertikalen pH-Gradienten vor der Küste sind eine Funktion des Aufwallens, was wiederum eine Funktion des Windes ist, der sich permanent ändert. Sie haben keine langzeitlichen Daten für den vertikalen pH-Gradienten. Stattdessen begaben sie sich auf eine zweimonatige Reise, nahmen einige Wasserproben und extrapolierten bis zum Anschlag. Wir wissen nicht einmal, ob sie die genau gleiche „Auflösung“ [dissolution] vor 100, 50 oder 25 Jahren gefunden haben. Oder vielleicht war die Auflösung besonders schlecht während dieses speziellen Zeitraumes von zwei Monaten in diesem speziellen kleinen Gebiet. Das sollte uns nicht überraschen. Ein Grund, warum so viele maritime Lebewesen Hunderttausende Larven hervorbringen ist, dass viele, vielleicht die meisten davon, in feindliche Umgebungen treiben und aus irgendwelchen Gründen sterben – die Liste dieser Gründe ist lang: Probleme mit dem Salzgehalt, Trübung, pH-Wert, Raubtiere, Wassertemperatur und andere.

Und schließlich belegt diese Studie eines – dass nämlich Neptun, der einen Dreizack schwingende Meergott, definitiv einen Sinn für Humor hat. Die ultimative Ironie ist Folgende:

Sie konnten die Teile der Krebslarve gar nicht sehen, welche sie untersuchen wollten, weil jene Teile der Larven von einer Schale umgeben sind. Also mussten sie zunächst diese Schale auflösen, um Zugang zu ihrem Studienobjekt zu erlangen. Sie beschreiben dieses Problem und dessen Lösung so:

Die Schuppen der Schale, welche normalerweise über der kristallinen Schicht liegen und Beobachtungen der Auflösung unmöglich machen, wurden vor der Analyse von jeder Larve entfernt, und zwar mittels Chlorbleichlauge [sodium hypochlorite], welches die Schalen effektiv beseitige, nicht aber die kristallinen Schichten darunter, auch nicht bei hohen Konzentrationen.

Dreimal darf geraten werden, welche Auswirkung die 6%-Lösung der Chlorbleichlauge auf den pH-Wert hat, die sie angewendet haben.

Es hat einen pH-Wert von 11 oder mehr und liegt damit fast ganz oben der Skala in Abbildung 1, ist also sehr stark alkalisch.

Kein Wunder also, dass Neptun in Gelächter ausbricht – sie sind in höchster Alarmbereitschaft hinsichtlich „Versauerung“ und Auswirkungen derselben auf die Auflösung der Larvenschalen … aber sie gebrauchen eine alkalische Lösung, um die Larvenschalen tatsächlich aufzulösen.

Ist Wissenschaft nicht etwas Wunderbares?

Link: https://wattsupwiththat.com/2020/01/31/the-solution-to-dissolution/

Übersetzt von Chris Frey EIKE