Mit dem weitgehenden Umbruch der Medienbranche als Folge des Internetzeitalters haben sich auch die bisherigen Strukturen grundlegend geändert. Journalisten sind immer seltener nur einer Zeitschrift, einem Verlag bzw. einem Sender zugeordnet, sondern teilen ihre Zeit oft auf verschiedene Auftraggeber auf. Zudem verwischen sich die bisherigen Grenzen zwischen Text, Bild und Bewegtbild immer mehr. Die geringere Bindung an einen festen Auftraggeber hat zur Folge, dass die Beschäftigungssituation immer prekärer wird. Von geschätzt etwa 85.000 Journalisten in Deutschland sind nur ca. 45.000 fest angestellt, der Rest muss seine Haut als freier Mitarbeiter zu Markte tragen. Das Durchschnittseinkommen ist mit nur 36.000 €/Jahr sehr niedrig. Auf der anderen Seite bilden sich dadurch innerhalb des Journalismus eigenständige Strukturen – meist in Form von Netzwerken – heraus, die sich dann eigenständig Finanzmittel suchen und sichern und dadurch auch eigene Meinungsmacht gewinnen. Geldquellen sind oft Stiftungen, NGO´s oder staatliche Fördertöpfe, wobei insbesondere bei den Stiftungen die Transparenz über die Mittelverwendung meist gering ist. In den Stiftungen, bei den durch sie geförderten NGO´s sowie bei staatlichen Akteuren wie z.B. dem Umweltbundesamt (UBA) haben sich häufig Vertreter linksradikal-grüner Gruppierungen wie Greenpeace festgesetzt und nutzen diese für die finanzielle Absicherung ihrer Genoss*Innen, zur Diffamierung von „Klimaleugnern“ und zur Verbreitung ihrer Ideologie. In den letzten Jahren haben sich immer mehr Pressure-Groups linker bis linksextremer Journalisten gebildet, die über ihre Vernetzung mit den etablierten Medien und mit dem Staatsapparat einen unverhältnismäßig großen und oft sehr bedenklichen Einfluss auf die öffentliche Meinung ausüben.

Ein kaum übersehbarer Filz eng verflochtener Journalisten-Netzwerke

Diese Gruppierungen sind inzwischen so zahlreich und so kaum entwirrbar untereinander vernetzt, dass es nicht möglich ist, sie im Rahmen dieser kurzen Artikelserie auch nur ansatzweise umfassend zu behandeln. Deshalb können nur die wichtigeren kurz vorgestellt werden, bei anderen sind aus Platzgründen nur einige wenige Angaben möglich, und viele weitere konnten hier gar nicht berücksichtigt werden. Eines haben jedoch so gut wie alle dieser Gruppierungen gemeinsam: Sie sehen sich als Vorkämpfer gegen den Klimawandel und „gegen Rechts“ – und ihnen stehen über Stiftungen sowie aus öffentlichen Fördertöpfen Geldmittel in Größenordnungen zur Verfügung, von denen die verhassten „Klimawandelleugner“ – viele davon Privatleute oder Rentner ohne nennenswertes Vermögen – nur träumen können.

Bild 2. Jean Pütz – die sympathische Galionsfigur einer inzwischen sehr unsympathischen Ansammlung von Klimaaktivisten namens WPK (Bild: Creative Commons Michael Schilling)

Die Wissenschafts-Pressekonferenz – ein radikaler Wolf im wissenschaftlichen Schafspelz

Zu den Wegbereitern dieser Entwicklung gehört ausgerechnet ein fast schon idealer Sympathieträger, nämlich der längst pensionierte Jean Pütz vom WDR, der sich dort als Pionier moderner Formate von Wissenschaftssendungen wie Quarks oder nano betätigte. Die von ihm mit begründete Wissenschafts-Pressekonferenz (WPK) bezeichnete sich auch als „Mafia der Vernunft“. Ihre Mitglieder sind hauptberufliche Wissenschaftsjournalisten, die für Fernsehen, Hörfunk, Printmedien und/oder Internet arbeiten. Im Prinzip ist hier die Creme so gut wie aller deutschen Fernsehanstalten und ihrer populären Wissenschaftssendungen vertreten. Die Neigung dieser Elite des Fernseh-Wissenschaftsjournalismus, sogenannte „Leugner des Klimawandels“ nicht zu Wort kommen zu lassen, ist hinlänglich bekannt.

Wie kam es überhaupt zur Bildung der WPK? Den Anstoß gab nach den Worten von Jean Pütz die Unzufriedenheit mit der damaligen Industrieabhängigkeit des Wissenschaftsjournalismus im Fernsehen. Dadurch sei die Glaubwürdigkeit auf der Strecke geblieben. Die Gründer der WPK wussten als Fachleute „am besten, dass, damals wie heute, wichtige Weichenstellungen für die Wissenschaft und Forschung der Zukunft anstanden und dass davon nicht nur Politiker überzeugt werden mussten, sondern…auch unmittelbar der Bürger“. Was aus den hehren Absichten geworden ist, kann man mit dürren Worten zusammenfassen: Agitprop für die Weltrettung durch Vernichtung unserer modernen Industriegesellschaft.

Ob Jean Pütz in seinem Alter überhaupt noch mitbekommen hat, was seine Kollegen aus diesen Initiativen gemacht haben oder nicht, sei dahingestellt. Fakt ist jedoch: Statt der Ansichten der Industrie wird heute auf Kosten der Gebührenzahler Industriefeindlichkeit verbreitet. Die angeblich angestrebte „verantwortungsvolle, sachgerechte und unabhängige Berichterstattung aus dem gesamten Bereich der Wissenschaft, der Medizin und der Technik in allen publizistischen Medien“ ist weitgehend zur Propaganda für die Klimahysterie und gegen die Kernkraft sowie gegen moderne Methoden der Landwirtschaft verkommen. Stars sind Leute wie die aggressive Weltrettungs-Prophetin Mai Thi Nguyen Kim, Prof. Lesch mit seinen farbenfroh blubbernden Glasballons oder der Arzt Dr. von Hirschhausen, der den Eindruck erweckt, menschliches Fieber und Weltklima nicht so recht auseinanderhalten zu können. Zu den Kuratoriumsmitgliedern der WPK zählen neben einigen großen Konzernen die Creme der Großforschungseinrichtungen und Wissenschaftsverbände, diverse staatliche Stellen sowie die SAP-nahe Klaus Tschira Stiftung. Geld haben sie jedenfalls überreichlich…

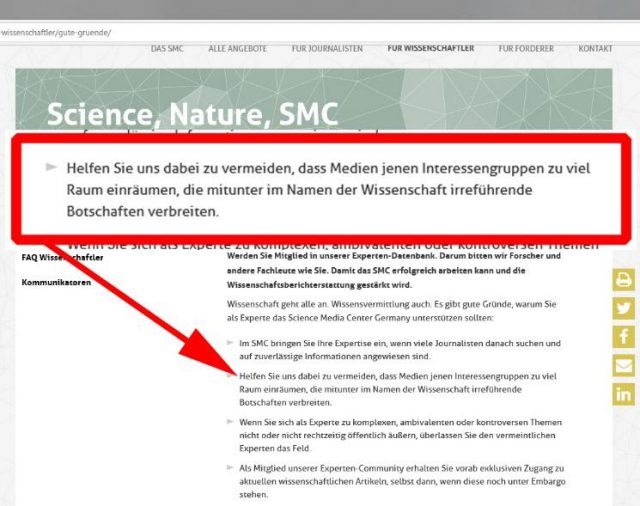

Die Klaus Tschira Stiftung und das Science Media Center

Die von dem SAP-Mitgründer Klaus Tschira 1995 ins Leben gerufene Klaus Tschira Stiftung (KTS) gehört zu den großen gemeinnützigen Stiftungen und hat bisher mehr als 600 Millionen Euro an Fördermitteln und Sachspenden vergeben. Sie behauptet von sich, sie wolle Naturwissenschaften, Mathematik und Informatik fördern und die Wertschätzung für diese Fächer in der Gesellschaft steigern. Was dabei in Wirklichkeit herauskommt, zeigt sich am Beispiel der von ihr überwiegend finanzierten Stiftung Science Media Center Germany (SMC). Vordergründig soll SMC anerkannte Fachleute aus der Wissenschaft sowie Wissenschaftsjournalisten in Kontakt bringen, um letzteren schnell und fundiert zuverlässige Fakten und Einschätzungen zu technischen bzw. wissenschaftlichen Themen zu liefern. Dazu habe man gezielt Koryphäen für eine „Experten-Datenbank“ erkoren, welche den Medien kostenfrei zeitnah Experten-Statements und fundiertes Wissen vermitteln sollen. So wolle man „wissenschaftliche Argumente für Journalisten leicht zugänglich machen, um unabhängige Berichterstattung über Wissenschaft und wissensbasierte Themen in Politik und Gesellschaft zu stärken“. Soweit die Theorie.

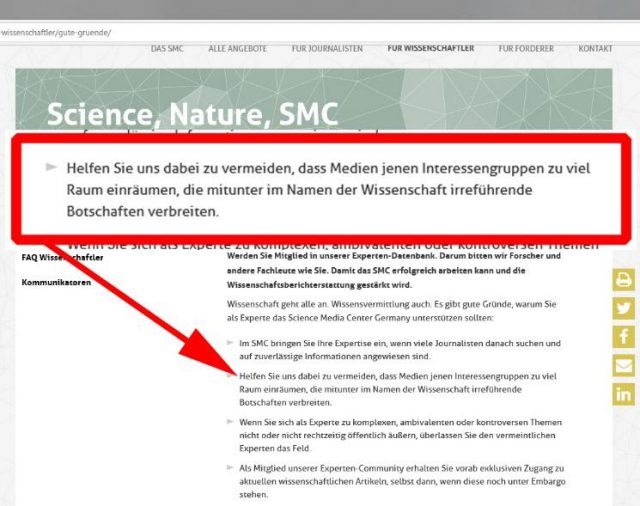

Bild 3. Bei SMC dürfen „Koryphäen“ wie Prof. C. Kemfert und Prof. V. Quaschning für die Energiewende trommeln (Bild: Autor, Eigenes Werk auf der Grundlage eines Screenshots)

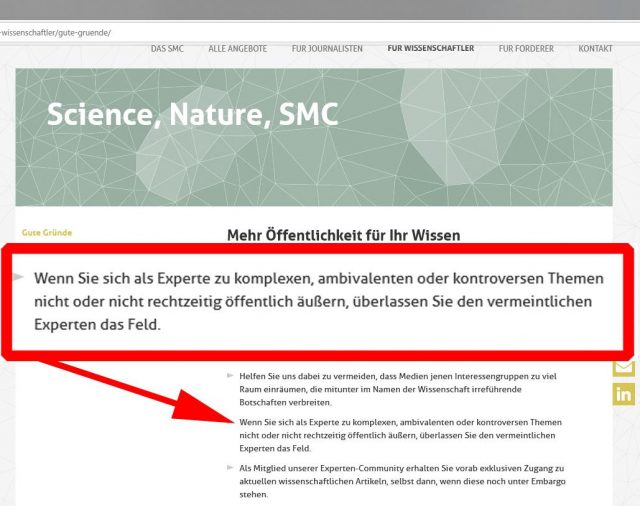

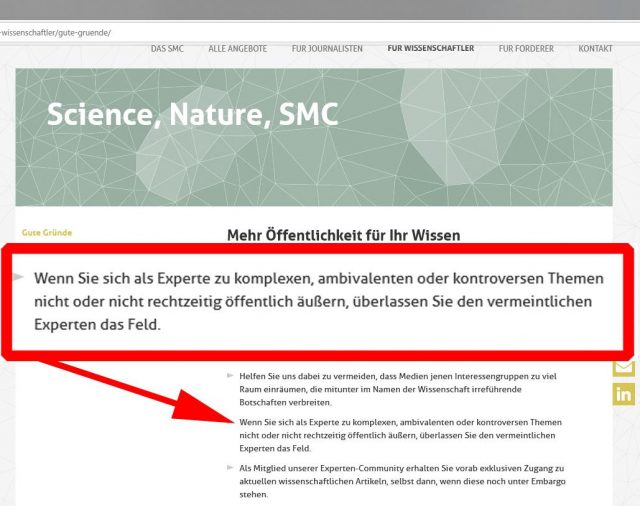

In der Praxis wird allerdings bei der Auswahl dieser „Wissenschaftler“ gänzlich parteilich vorgegangen. Dies wird sogar offen zugegeben, indem man den – nach SMC-eigenen Kriterien „auserwählten“ – Experten die Botschaft verkündet: „Helfen Sie uns dabei zu vermeiden, dass Medien jenen Interessengruppen zu viel Raum einräumen, die mitunter im Namen der Wissenschaft irreführende Botschaften verbreiten….Wenn Sie sich als Experte zu komplexen, ambivalenten oder kontroversen Themen nicht oder nicht rechtzeitig öffentlich äußern, überlassen Sie den vermeintlichen Experten das Feld….Über das SMC erreichen Sie gleichzeitig zahlreiche handverlesene registrierte Journalisten in relevanten Medien, vor allem in Deutschland, Österreich und der Schweiz“. Und diese Parteilichkeit begünstigt, wie die Namen der auserwählten Experten z.B. im Energiesektor belegen, gezielt Personen mit stramm grünlinker ideologischer Ausrichtung.

In einem funktionierenden Rechtsstaat müssten die zitierten Sätze im Prinzip zur Folge haben, dass dem Verein die Gemeinnützigkeit entzogen würde. Das ist den SMC-Verantwortlichen inzwischen wohl auch klar geworden, weshalb diese Texte inzwischen von der aktuellen Fassung der Webseite entfernt bzw. entschärft wurden. Es gibt jedoch immer noch Suchmaschinentreffer für die zitierten Aussagen – und archivierte Screenshots. Das Internet vergisst halt nicht so schnell.

Auch ein Blick auf die Themenliste der SMC-Veröffentlichungen offenbart schnell, dass SMC sich nach wie vor stark auf die grünlinks-typischen Umwelt- und Klimathemen wie Energiewende, CO2, Dürren, Glyphosat, Autoabgase, Feinstaub, Elektromobilität oder Gülledüngung konzentriert. Zu Wort kommen bekannte Eiferer der Klima- und Energiewende wie die Professoren Kemfert und Quaschning oder – beim Automobil – Fr. Prof. Hoffmann. Diese gehört zu den fanatischen Verfechtern der Vernichtung der Autoindustrie durch übertrieben scharfe Grenzwerte für Autoabgase. Echte Koryphäen wie Hans-Werner Sinn scheint man dagegen nicht zu

berücksichtigen.

Bild 4. Eine kaum verschleierte Aufforderung an Klimahysteriker, anderen Meinungen nicht das Feld zu überlassen (Bild: Autor, Eigenes Werk auf der Grundlage eines Screenshots)

Der größte Treppenwitz an SMC ist, dass ausgerechnet eine Stiftung aus dem direkten Umfeld des in Deutschland beheimateten SAP-Konzerns seit Jahren mit viel Energie darauf hinarbeitet, unter dem Deckmantel der „Förderung der Wissenschaft“ genau diese Wissenschaft und zugleich die deutsche Industrie zu zerstören.

Das Netzwerk Recherche

Nach dem Beispiel der WPK sind im Laufe der Jahre auch bei anderen Medienvertretern zahlreiche weitere Netzwerke entstanden. Eines der älteren ist das Netzwerk Recherche e.V. (NR), ein eingetragener gemeinnütziger Verein mit (2018) 840 Mitgliedern. Zwar behauptet man, man wolle „die journalistische Recherche und den Qualitätsjournalismus in Deutschland“ stärken und sei laut Satzung der „Förderung der Bildung“ verpflichtet. Doch lässt schon allein die 2001 erfolgte Gründung auf einer Tagung der Friedrich-Ebert-Stiftung erahnen, wessen Geist bei der angestrebten „Volkserziehung“ den gewünschten linksgrünen Ton angibt.

Offiziell gibt man sich beim Netzwerk Recherche auf der Homepage betont neutral, investigativ und dem Allgemeinwohl verpflichtet. Zu den Zielen gehört auch „gemeinnütziger Journalismus“, d.h. Redaktionen, denen endlich kein „Verlagsmanager im Nacken“ sitzt. Dank finanzieller Unabhängigkeit könne man endlich investigativ Themen angehen, die sonst untergehen würden. Dann, so die Hoffnung, könne der Journalist endlich die Welt so verbessern, wie er sich das vorstellt.

Bild 5. Die Stiftung Olin GmbH, die auch das Netzwerk Recherche fördert, unterstützt eine ganze Reihe klimaaktivistischer bzw. klimaradikaler Bewegungen mit teils hohen Summen (Bild: Autor)

Was jedoch wirklich dahintersteckt, zeigt sich beim Blick auf die Geldgeber. Daran herrscht kein Mangel: Zu den Partnern und Förderern zählen u.a. die Rudolf Augstein Stiftung, der NDR, die Bundeszentrale für politische Bildung, die GLS Treuhand, die Olin gemeinnützige GmbH, nextMedia.Hamburg und die Schöpflin Stiftung. Auch bei diesen Förderern liest man zunächst honigsüße Phrasen über Freiheit, Gleichheit, Gerechtigkeit etc. pp. Man muss schon in die Tiefe bohren, um festzustellen, welche Erwartungen diese großzügigen Spender denn wohl haben. Zum Beispiel die Olin Stiftung von Alexander Szlovák, der nach einer Meldung im Hamburger Abendblatt mit einem Vermögen von 100 Mio. zu den 80 reichsten Hamburger Familien gehört. Die Stiftung unterstützt knapp 30 zum Teil aktivistische NGO´s und erklärt den Kampf gegen den Klimawandel zu ihrem Hauptziel. Zu ihren Empfängern gehört auch die „Plant for the planet“-Bewegung, die ein sehr umtriebiger Unternehmer Frithjof Finkbeiner (u.a. Desertec, Club of Rome) und sein Sohn managen. Weiterer Förderer ist die Schöpflin-Stiftung, die sich ebenfalls dem Kampf gegen den Klimawandel verpflichtet hat. Und die an bestimmten Projekten des Netzwerk Recherche beteiligte Stiftung Mercator gehört als Finanzier der Agora Energiewende zu den größten und finanzstärksten Förderern der deutschen „Energiewende“. Die punktuell ebenfalls kooperierende Friedrich-Ebert-Stiftung ist eine Finanzierungsquelle für linksradikale Kräfte im Umfeld der SPD.

Angesichts solcher Hintermänner ist offensichtlich, dass der „Neutralitäts“-Anspruch des Netzwerks Recherche nur ein Feigenblatt darstellt, hinter dem sich das branchenübliche linksradikal-grüne Gedankengut verbirgt.

Correctiv – Kläger, Richter und Büttel zugleich

Sich selbst stuft Correctiv natürlich als edel, hilfreich und gut ein. Man bezeichnet sich als gemeinnütziges Recherchezentrum im deutschsprachigen Raum und nimmt für sich in Anspruch, investigativen Journalismus zu pflegen und sich für eine lebenswerte Zukunft einzusetzen. Nach eigenem Verständnis schütze man das Volk vor gezielten Falschmeldungen und setze ein klares Zeichen gegen Extremismus. So kehre der Journalismus zu seinen Wurzeln zurück und werde wieder zur Vierten Gewalt in der Gesellschaft. Man sage Nein zu Populismus, Nein zu Hass und Hetze und Nein zu Lügen im Netz. Soweit der hehre Anspruch.

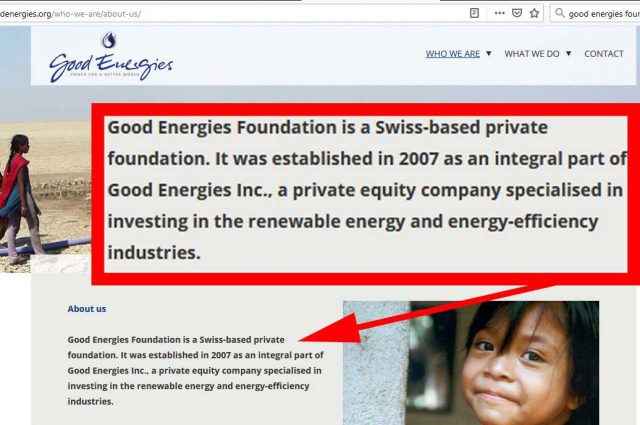

Bild 6. Für Klimahysterie-Profiteure ist es besonders praktisch, wenn ihre Stiftung gleich integraler Bestandteil des Unternehmens ist (Bild: Autor, Eigenes Werk auf der Grundlage eines Screenshots)

In Wirklichkeit stimmt all dies nicht. Diese mit Millionenspenden von deutschen und internationalen Stiftungen finanzierte Gruppe mit knapp 30 bezahlten Mitarbeitern hat sich sowohl politisch als auch klimapolitisch eindeutig positioniert: Für die Klimahysterie, gegen sogenannte „Rechte“ und „Populisten“. Im Quartalsbericht XXI kann man sich über die aktuellen Projekte informieren. Doch irgendwie scheinen wichtige Themen zu fehlen:

- Linker Extremismus und linke Gewalt, wie in Hamburg, wo ganze Straßenzüge verwüstet wurden? Scheinen für Correctiv kein Thema zu sein.

- Finanzierung der Klimahysterie mit Milliardensummen aus dem In- und Ausland, mit Schwerpunkt USA? Da schreibt man lieber über das „böse“ Geld der „Klimaleugner“ vom Heartland-Institut.

- Probleme mit kriminellen Clanstrukturen in unseren Großstädten? Uninteressant.

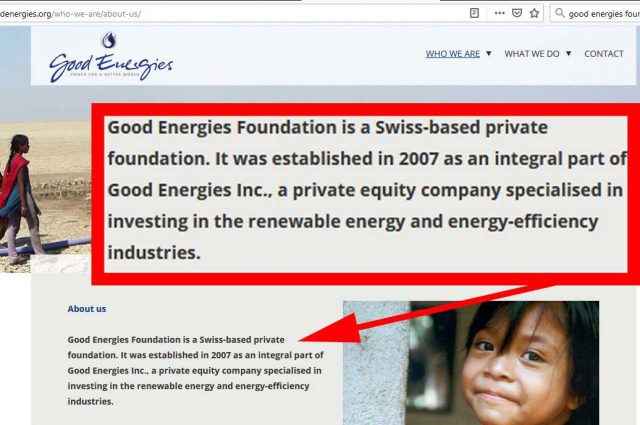

Diese Haltung erklärt sich, wenn man einen Blick auf die Geldquellen von Correctiv wirft. Ihre Rechtsform ist die einer gemeinnützigen GmbH. Auf der Webseite wird um milde Gaben zur Unterstützung von „mutigem und unabhängigem“ Journalismus geworben, mit 10,- € kann man dabei sein. Doch das schicke, für die eigenen Zwecke komplett maßgeschneiderte und mit technischen Raffinessen wie Video- und Audio-Studios, einem Experience-Lab, Co-Working Spaces und einem Cafe ausgestattete neue Zentrum, das derzeit in Berlin entsteht, sowie die auf fast 30 Mitarbeiter angewachsene Crew lassen sich mit solchen Mini-Beträgen nicht einmal ansatzweise bezahlen. Offenbar großzügig finanziert wird das Zentrum von der bereits weiter oben als Förderer der Klimahysterie erwähnte Schöpflin-Stiftung. Hinter Correctiv stehen aber noch weitere eindeutig klimahysterische Finanziers wie die Stiftung Mercator, die neben dem Energiesektor jetzt auch noch den Verkehrssektor vollständig dekarbonisieren will. Mit im Bunde ist hierbei die European Climate Foundation, hinter der sich wiederum sechs andere Stiftungen verbergen, darunter die US-Stiftung McCall McBain Foundation. Den Vogel schießt offenkundig die Schweizer Good Energy Foundation ab, die auf ihrer Webseite offen zugibt, dass sie integraler Bestandteil eines Unternehmens ist, das sein Geld mit Investitionen in Erneuerbare Energie verdient. Abgerundet wird das Ganze noch durch die Open Society Foundation des schillernden Multimilliardärs und Börsenspekulanten Soros, zu dessen Geschäften auch die Förderung von Umstürzen gehört.

Wie bei den meisten dieser Netzwerke findet man auch beim Correctiv-Personal schon bei oberflächlichem Durchchecken schnell Journalisten, die offensichtlich weder objektiv noch unabhängig sind. Neben Benjamin Schubert, der beim linksgrünen Netzwerk Attac mitmacht, gibt es da die engagierte Klima-„Aktivistin“ Annika Joeres, die auch in der Süddeutschen ihr Unwesen treibt, und Skandaljournalisten wie David Schraven, der versuchte, einer missliebigen Politikerin einen Sex-Skandal anzuhängen, oder Jonathan Sachse, der sich mit Familienverbänden anlegte.

Bild 7. Artikel 5 Grundgesetz verbietet eigentlich die Zensur missliebiger Meinungen (Bild: Autor)

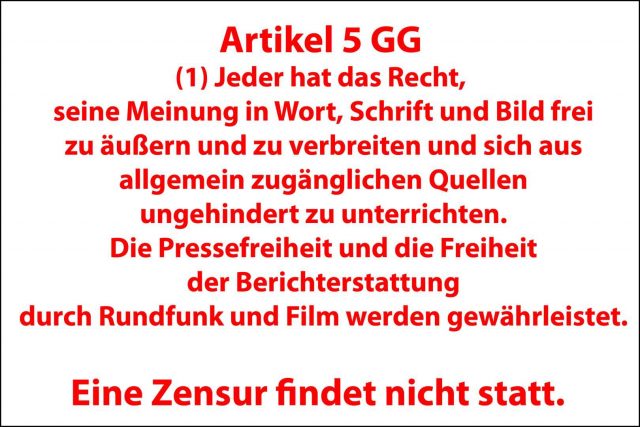

Trotz dieser klar dokumentierbaren Einseitigkeit hat man Correctiv zum Zensor und Richter über andere Autoren im Netz befördert. Bei ihrer Tätigkeit sorgen sie u.a. dafür, dass die Verbreitung missliebiger Ansichten durch sofortiges Anhängen von Gegenmeinungen behindert wird. Dabei sind die Zensoren selbst gar keine Fachleute, sondern fachfremde Journalisten ohne eigene Kompetenz in Fragen der Klimawissenschaften. Was da gemacht wird, ist im Prinzip eine Verletzung des grundgesetzlich garantierten Rechts auf freie Meinungsäußerung. Es kommt hierbei zu einem schmutzigen Zusammenspiel von Staat und Social-Media-Konzernen wie Facebook: Der Staat zwingt die IT-Firmen, missliebige Meinungen zu zensieren, und unterläuft dabei den eigentlich unumgänglichen Rechtsweg, indem er das Recht, Zensur auszuüben, direkt den Konzernen zuschiebt. Das widerspricht dem Grundrecht auf freie Meinungsäußerung, denn letztere darf zwar durch andere Gesetze eingeschränkt werden, doch sind solche Einschränkungen eigentlich an die Einhaltung des Rechtswegs – also mit der Möglichkeit des Widerspruchs unter Einschaltung ordentlicher Gerichte – gebunden. Dennoch wurden staatlicherseits die Überwachung und auch gleich der Vollzug von Zensurmaßnahmen privaten Konzernen zugeschoben. Diese wiederum haben sich mit Correctiv einen Büttel besorgt, der für sie die dreckige Arbeit gegen Bezahlung erledigt. Was durchaus der Tradition eines der US-amerikanischen Ziehväter von Correctiv, dem Poynter Institute, entspricht. Auch dieses widmet sich unter dem Deckmantel des „Faktencheckens“ dem Krieg gegen missliebige Meinungen. Wobei Poynter allerdings in den USA mehr Gegenwind bekam und sogar eine schmachvolle Niederlage kassierte. In den USA steht es aktuell um die Pressefreiheit augenscheinlich besser als in Deutschland.

Die Medienmacht der (Linken in der) SPD

Das Redaktions Netzwerk Deutschland (RND) der Madsack Mediengruppe ist ein Instrument der Macht der Linken – vordergründig der SPD – in den deutschen Medien. Das RND ist eine Art Zentralredaktion, in der überregionale Nachrichten für ein Imperium aus 15 Regionalzeitungen und 28 Anzeigenblättern erstellt werden. Hinzu kommen noch weitere, nicht zur Gruppe gehörende Zeitschriften. Die angeschlossenen Blätter übernehmen diese Nachrichten in ihren Mantelteil und ergänzen dies um Örtliches und Regionales. Damit hat die SPD über ihre Deutsche Druck- und Verlagsanstalt, die größte Kommanditistin bei Madsack ist, die Deutungshoheit über das, was „täglich etwa 7 Millionen Lesern“ serviert wird. Und diversen Blogmeldungen zufolge gibt es in der RND-Redaktion auch Verbindungen zum Linksextremismus, siehe auch hier.

Bild 8. Die taz behauptet, sie engagiere sich für Meinungsvielfalt (Bild: Autor, Eigenes Werk auf der Grundlage eines Screenshots)

Das größte Netzwerk – die taz und ihre Ex-Journalisten

Sowohl von der Radikalität als auch von der Bedeutung her sticht in Deutschland ein Netzwerk ganz besonders hervor, und zwar die Gemeinschaft der heute und der ehemals bei der taz tätigen Journalisten. Die taz behauptet zwar munter, „für Meinungsvielfalt und gegen Meinungsmache“ zu sein, doch kann man auf der gleichen Homepage auch das Glaubensbekenntnis Linksradikale, unabhängige Presse in Deutschland: 40 Jahre taz finden. Bei der Überprüfung vieler Lebensläufe in Mainstreammedien und Journalisten-Netzwerken fällt auf, dass man immer wieder auf Journalisten stößt, die früher einmal für die taz geschrieben haben. Deren Redaktion fungiert augenscheinlich als eine Art Virusschleuder des Linksradikalismus in den deutschen Medien.

Bild 9. In Wirklichkeit ist sie nichts weiter als ein Sturmgeschütz des Linksradikalismus (Bild: Autor, Eigenes Werk auf der Grundlage eines Screenshots)

Etliche der dort geschulten und ideologisch gestählten Journalisten sind inzwischen in andere Redaktionen weitergewandert, teils bis in höchste Kreise z.B. der Deutschen Welle oder in die Leitung des lukrativen Finanztip. Obwohl sie nicht formell als Organisation agieren, ist ihre Genossenschaft mit bald 20.000 Mitgliedern als vernetzte Community eines der größten und am besten in den Medien verankerten linksradikalen Medien-Netzwerke Deutschlands.

Weitere Netzwerke

Darüber hinaus gibt es zahlreiche weitere – teils auch international geknüpfte – Netzwerke, die nur zum Teil noch so tun, als ob sie „neutralen, unabhängigen Journalismus“ betreiben würden. Meist genügt es, sich die Sponsoren etwas näher anzusehen oder in die beruflichen Hintergründe der maßgeblichen Mitarbeiter hineinzuleuchten, um schnell festzustellen, dass dieser Anspruch nicht der Wahrheit entspricht und sich dahinter eine meist sehr einseitige Agenda verbirgt.

Clean Energy Wire (CLEW) besteht aus hochkarätigen Journalisten, ist jedoch eine reine Lobbyorganisation für „erneuerbare“ Energien, die von der Stiftung Mercator und der European Climate Foundation finanziert wird.

Die in Österreich tätige cooppa bezeichnet sich als Genossenschaft von JournalistInnen und Organisationen und hat zum Ziel, die „große Transformation“ der Umstellung auf eine klimaneutrale Gesellschaft voranzubringen. Dahinter stehen auch diverse Unternehmen sowie Verbände wie das Green Brands Gütesiegel, die mit den geförderten Maßnahmen Geschäfte machen.

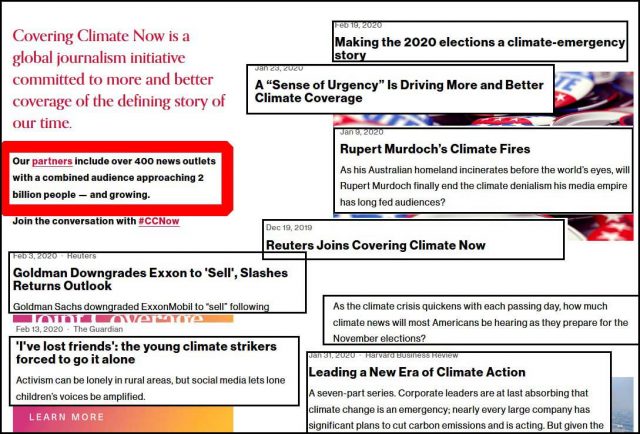

Bild 10. Das Netzwerk Covering climate now, das 2 Milliarden Leser erreicht, „optimiert” weltweit die Verbreitung klimahysterischer Botschaften (Bild: Autor, Eigenes Werk auf der Grundlage von Screenshots)

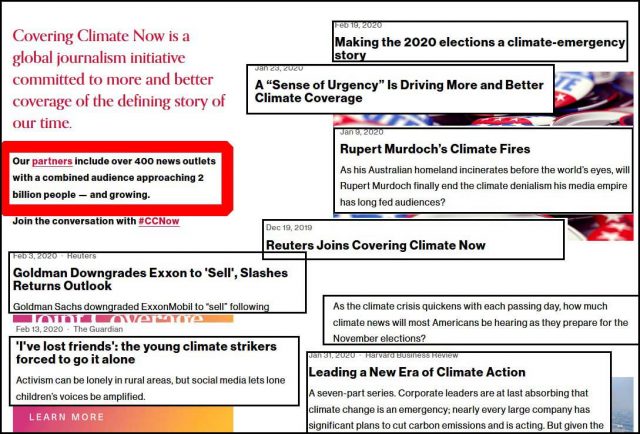

Covering climate now ist faktisch der Kronzeuge dafür, dass es sich bei der aktuellen Berichterstattung über den angeblich menschengemachten Klimawandel um eine global gesteuerte und synchronisierte Medienkampagne handelt. In den am Netzwerk beteiligten Publikationen – darunter auch wissenschaftliche Zeitschriften wie Nature oder Scientific American – wird das Erzeugen von Klimahysterie optimiert, während „klimaskeptischen“ Ansichten faktisch kein Raum mehr gegeben wird. Deutsche Teilnehmer dieses internationalen Netzwerks aus mehreren hundert Publikationen sind u.a. taz, correctiv und stern sowie klimareporter, globalmagazin, Edison, Spektrum der Wissenschaft und KlimaSocial. International sind auch große Nachrichtenagenturen wie AFP, Reuters, Bloomberg und Getty Images dabei.

Das European Data Journalism Network (EDJNet) behauptet von sich, seinen Mitgliedern keine Beschränkungen aufzuerlegen. Es wird allerdings von den EU-Behörden äußerst großzügig gefördert, bis hin zu kostenlosen Übersetzungen. Allerdings sollte die Berichterstattung der EDJNet-Söldner „europäische Perspektiven“ (von der Leyens EU-Version eines „Green New Deal“ und europäische Postkolonialtruppen in Afrika inklusive?) berücksichtigen. Noch Fragen?

Project Syndicate agiert als eine Art internationaler Presseagentur in 13 Sprachen und in 157 Ländern. Gebracht werden vor allem Meinungsbeiträge maßgeblicher Politiker, Abgeordneter, Wissenschaftler, Manager und Aktivisten, darunter solche „Größen“ wie Joschka Fischer. Finanziers sind, neben Herrn Soros mit seiner Open Society Foundation, die Bill & Melinda Gates Foundation, die European Climate Foundation, die grün-linksradikale Heinrich Böll Stiftung und die linksradikal-grüne Friedrich Ebert Stiftung.

Einen hohen Bekanntheitsgrad (Panama Papers, Paradise Papers etc.) hat schließlich auch noch das International Consortium of Investigative Journalists, zu dem in Deutschland auch die Redaktion der Süddeutschen Zeitung gehört. Zu den zahlreichen Förderern gehören eine Auswahl kirchlicher wie privater Stiftungen, Promis wie Barbara Streisand und Meryl Streep sowie der anscheinend unvermeidliche Herr Soros.

Die Gewinner des Prinzips Einäugigkeit

Angesichts dieser Fülle aggressiv-linksgrüner Ideologen-Netzwerke, die im Hintergrund mit enormen Geldmitteln gefördert werden, nimmt es nicht wunder, dass unsere Medienlandschaft politisch und sozial weitgehend einseitig aufgestellt ist. So schafft man es, die gesellschaftlichen Trends in die den Hintergrund-Finanziers genehme Richtung zu beeinflussen. In den Medien gibt es im Prinzip kaum noch eine bürgerliche Mitte. Das erklärt die Intensität der Dauerberieselung in Richtung Klimahysterie in den Medien. Im Fernsehen wird heute selbst in Natursendungen und sogar bei Tipps für den Kräutergarten vor dem „menschengemachten Klimawandel“ gewarnt. Bei all dieser Berichterstattung über Klima- und Wetterfragen ist schon seit Jahren eine geradezu phänomenale Einseitigkeit zu beobachten. Während Klima-Angstmacher wie Mojib Latif, Prof. Schellnhuber oder Stefan Rahmstorf ständig auftreten und teils sogar selbst schreiben dürfen, wurden die sogenannten Skeptiker systematisch ausgebremst und kommen heute kaum noch zu Wort. Darüber hinaus werden sie – je nach Präferenz des Journalisten – in der Regel als dumm, naiv oder „Rechts“ porträtiert und teils ehrenabschneidend angegangen. Solcher „Haltungsjournalismus“ lohnt sich offenkundig, die entsprechenden Stiftungen und die profitierenden Firmen haben für willfährige Unterstützer unglaubliche Geldmengen z.B. für Honorare oder für Anzeigen zur Hand. Allein ein Herr Bezos von Amazon hat gerade erst großzügig 10 Mrd. US-$ für seinen Bezos Earth Fund versprochen. Damit lassen sich ungezählte weitere „Wissenschaftler“ und Mietjournalisten bezahlen, welche die Botschaft vom kurz bevorstehenden Klima-Weltuntergang propagieren und den Schlaubergern unter den Kapitalisten nahezu risikolose, weil staatlich über lange Zeiträume garantierte Einnahmen bescheren.

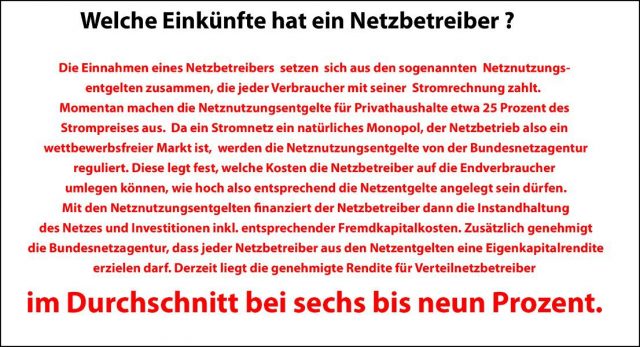

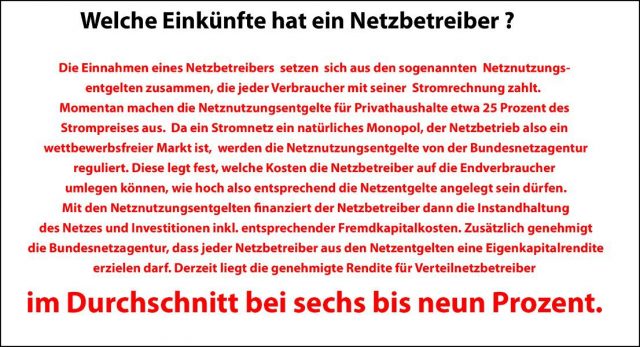

Bild 11. Eine staatlich langfristig gesicherte Monopolstellung mit ebenfalls staatlich gesicherter Rendite ist für das internationale Großkapital ausgesprochen attraktiv (Grafik: Autor, entnommen aus Zitat)

Worum es den Herrschaften dabei geht, kann man am Beispiel der Netzbetreibergesellschaften erkennen: Egal welchen Unsinn der Staat im Bereich des Baus im Prinzip unnützer Leitungen wie Südlink oder Nordlink von ihnen verlangt – sie können alle Kosten auf die Netzdurchleitungsgebühren aufschlagen und damit eine von der Bundesnetzagentur zugesicherte Rendite erwirtschaften, die zurzeit bei 6-9 % liegt. Für Kapitalanleger sind solche Modelle sehr attraktiv, müssen sie sich doch nicht mehr mit den Unwägbarkeiten und Risiken von Märkten und Konkurrenzverhältnissen herumschlagen. Gerade die Groß- und Hochfinanz setzt deshalb gerne und zunehmend auf solche Renditebringer mit langfristig gesicherten Margen. Wichtig ist hierbei vor allem Dingen, dass man diese Projekte als „grün“ ausgeben kann – und dass die Medien mit ihrer Klimageddon-Angstmache genügend Wähler dazu bringen, den Befürwortern dieses größten Betrugs aller Zeiten ihre Stimme zu geben.