Die wirkliche Klimakrise ist nicht die globale Erwärmung, sondern globale Abkühlung – und vermutlich hat sie bereits begonnen

Einführung: Katastrophale anthropogene globale Erwärmung CADW – eine gescheiterte Hypothese

Die Panikmache um CAGW („globale Erwärmung“, „Klimawandel“, „Klimakrise“, „Klima-Notstand“) ist eine gescheiterte Hypothese und der größte wissenschaftliche Betrug aller Zeiten (hier). Der Globale-Erwärmung-Alarmismus wurde von politischen Extremisten vorangetrieben, und ihre leichtgläubigen Jünger glaubten Jahrzehnte lang daran – und das, obwohl es keinerlei stichhaltige Beweise dafür gibt, dass eine katastrophale Erwärmung in der Realität überhaupt existiert und trotz vielfältiger Belege, welche die CAGW-Hypothese falsifizieren.

Der gescheiterten CAGW-Hypothese zufolge soll ein gestiegener atmosphärischer CO2-Anteil aufgrund der Verbrennung fossiler Treibstoffe eine gefährliche Runaway-globale Erwärmung auslösen. Die einzigen vermeintlichen Beweise für diesen Betrug sind Computer-Klimamodelle, welche die gegenwärtig beobachtete leichte Erwärmung drastisch übertreiben, typischerweise um 300 bis 500 Prozent. In diese Klimamodelle gehen absichtlich exzessiv hohe geschätzte Werte der Klimasensitivität bzgl. CO2 ein, und sie sind darauf ausgelegt, falschen Alarm zu schlagen.

Die globale Erwärmung hat sich seit Mitte der 1990er Jahre verlangsamt. Also ließen die Alarmisten verlauten, dass ein gestiegener CO2-Gehalt heftigeres, chaotischeres Wetter auslösen wird. Es gibt vielfache Belege, dass auch das falsch ist (hier). Tatsächlich ist das Wetter weniger chaotisch geworden (hier).

Weitere Belege für groß angelegten Betrug sind: Der Mann’sche Hockeyschläger (MBH98 etc.), die Klimagate-E-Mails, die Verfälschung historischer Temperaturdaten und die aggressive Taktik der Klima-Extremisten.

Eindeutige Belege, dass der durch CO2 getriebene Alarmismus von globaler Erwärmung/Klimawandel eine erfundene Krise ist

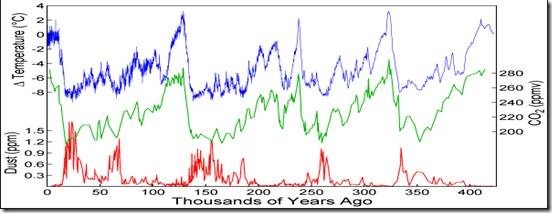

Atmosphärische CO2-Konzentrationen waren in der geologischen Historie schon viel höher als heute, aber eine Runaway-globale Erwärmung ist über die Milliarden Jahre der Erdgeschichte niemals eingetreten. In geologischen Zeiten war es schon viel wärmer, und auch viel kälter als heute. Die Erde befindet sich derzeit in einer glazialen Epoche, in welcher Kilometer dicke Eisschilde große Teile des Planeten etwa 100.000 Jahre lang überzogen, jeweils unterbrochen von Interglazialen mit einer Dauer von etwa 10.000 Jahren. Die Erde befindet sich derzeit in einem solchen warmen Interglazial, aber die letzte Vereisung endete schon vor etwa 10.000 Jahren, so dass eine erneute Vereisung auf der Erde statistisch demnächst fällig ist.

Während der Mittelalterlichen Warmzeit von 900 bis 1300 lag die Temperatur viel höher als heute. Danach geriet die Menschheit in die Kleine Eiszeit von etwa 1300 bis 1850. Diese hatte viel Leiden und den Tod von Millionen zur Folge.

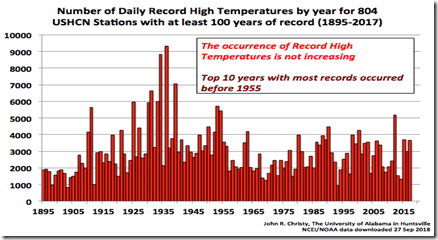

Die USA verfügen über einige der weltweit besten Temperaturdaten. Die höchsten Temperaturen wurden während der 1930er Jahre registriert, also deutlich bevor sich die Verbrennung fossiler Treibstoffe um das Jahr 1940 erheblich verstärkte.

Die Verbrennung fossiler Treibstoffe verstärkte sich zu Beginn des 2. Weltkriegs erheblich. Aber die globale Temperatur SANK signifikant von 1940 bis 1977. Diese eine Beobachtung ist bereits ausreichend, um die CAGW-Hypothese zu widerlegen – die globale Temperatur stieg NICHT katastrophal aufgrund eines steigenden CO2-Gehaltes.

Selbst unter der Annahme, dass die GESAMTE beobachtete globale Erwärmung dem gestiegenen atmosphärischen CO2-Gehalt zugeordnet werden kann, rechneten die folgenden beiden Studien vor, dass die MAXIMALE Klimasensitivität einer hypothetischen Verdoppelung des CO2-Gehaltes nur etwa 1°C beträgt, was viel zu gering ist, um eine gefährliche globale Erwärmung auszulösen: hier und hier.

Jene 1°C pro Verdoppelung ist nicht die mittlere, sondern die MAXIMALE Klimasensitivität, kann doch der größte Teil der beobachteten Erwärmung natürlichen Ursachen zugeordnet werden. Noch einmal: Computer-Klimamodelle des IPCC und Globale-Erwärmung-Alarmisten ziehen Werte der Klimasensitivität heran, die 3 bis 5 mal größer sind als bei 1°C pro Verdoppelung, nur um falsche Ängste bzgl. einer gefährlichen globalen Erwärmung zu wecken.

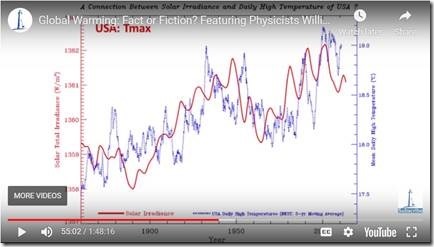

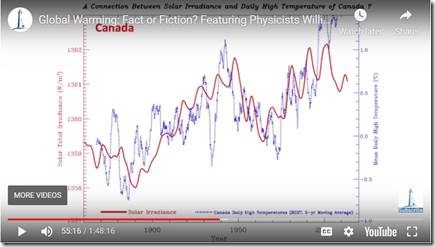

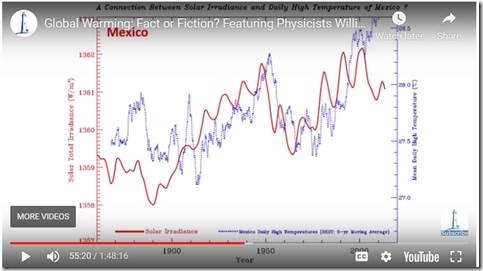

Die Beweislage ist ziemlich eindeutig: Sonnenaktivität und nicht das atmosphärische CO2 ist der primäre Treiber der Temperatur auf der Erde (hier). Im neuesten Video des Astrophysikers Willie Soon belegt er die Relation zwischen Sonne und Klima und erläutert seine Schlussfolgerungen. Es gibt eine starke Korrelation zwischen den täglichen Höchsttemperaturen und der gesamt-solaren Einstrahlung (54:51 im Video):

… in den USA (55:02):

Kanada (55:16):

und Mexiko (55:20):

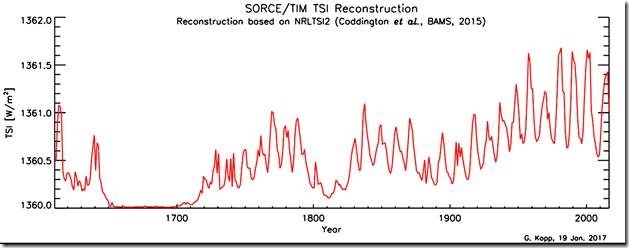

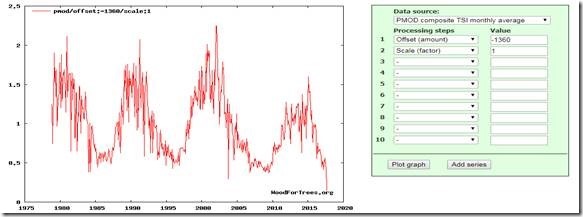

Die gesamt-solare Einstrahlung liegt derzeit nahe 1360 W/m² und ist damit von ähnlicher Größenordnung wie während der sehr kalten Perioden um die Jahre 1700 und 1800. Die atmosphärischen Temperaturen dürften also in naher Zukunft sinken – wenn dies nicht bereits im Gange ist.

Quelle. Zu beachten: 1360 ist gleich Null gesetzt.

Wir wissen, dass sich die Sonne am Ende des Zyklus‘ 24 (SC24) befindet, dem schwächsten Zyklus seit dem Dalton-Minimum (um das Jahr 1800), und auch vom SC25 wird erwartet, dass er sehr schwach ausfällt. Wir wissen außerdem, dass sowohl das Dalton-Minimum als auch das Maunder Minimum (~1650 bis ~1700) sehr kalte Perioden waren mit erheblichen Leiden für die Bevölkerung.

Die globale Temperatur wird mit Sicherheit NICHT primär getrieben durch einen steigenden atmosphärischen CO2-Gehalt, weil Änderungen des CO2-Gehaltes Temperaturänderungen zeitlich HINTERHER laufen, was sowohl in Proxy-Aufzeichnungen in Eisbohrkernen als auch in den modernen Daten zum Ausdruck kommt. Dem Eisbohrkern aus Wostok zufolge beträgt die zeitliche Verzögerung einer CO2-Änderung aufgrund einer voran gegangenen Temperaturänderung etwa 800 Jahre (hier).

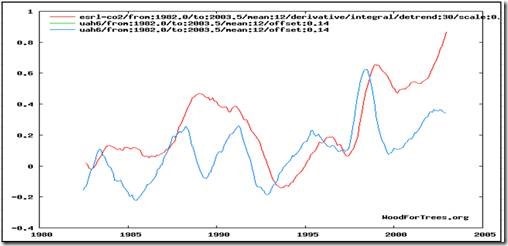

Im Januar 2008 beschrieb Allan MacRae in seiner Studie mit dem Titel „Carbon Dioxide Is Not The Primary Cause Of Global Warming“ die folgenden grundlegenden Beobachtungen (hier):

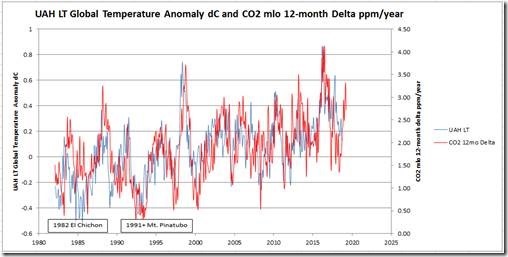

a) Die Geschwindigkeit der Änderungen des atmosphärischen CO2-Gehaltes variiert in etwa synchron mit Änderungen der globalen Temperatur.

b) Daher ergibt sich aus dem Integral der zeitlichen CO2-Änderungen eine Verzögerung um etwa 9 Monate nach einer Temperaturänderung.

Die sehr enge Korrelation zwischen der zeitlichen CO2-Änderung (rot) und derjenigen der globalen Temperatur (blau) ist eindeutig erkennbar. Große Vulkanausbrüche (einige VE15 und die meisten VE16-Ereignisse) stören die Relation:

Die Integration der Daten der CO2-Änderungen mit der Zeit ergeben ein zeitliches Hinterherlaufen hinter Temperaturänderungen um etwa 9 Monate.

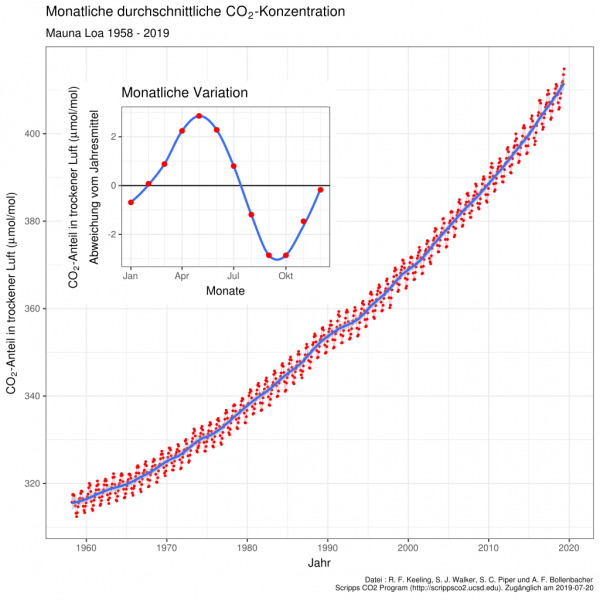

Obige Graphiken zeigen CO2-Daten des Mauna Loa. Ähnliche Ergebnisse zeigten sich bei der Auswertung globaler CO2-Daten wie bei MacRea im Jahre 2008. Die Auswirkungen großer Vulkanausbrüche sind offensichtlich.

Das 12-monatige Delta des CO2 wird herangezogen, um die „Jahreszeiten-Sägezahnkurve“ darzustellen.

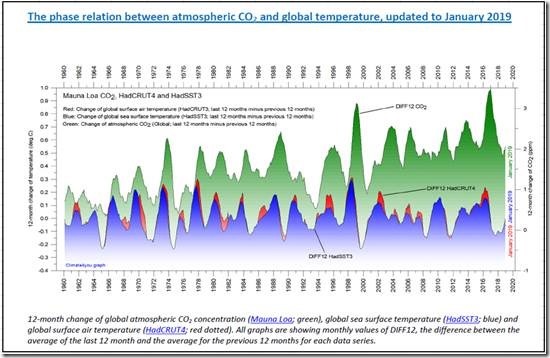

Die ~9-monatige Verzögerung der atmosphärischen CO2-Änderungen (rot) nach Temperaturänderungen (blau) ist offensichtlich (hier).

Im Januar 2013 machten Humlum, Stordahl und Solheim eine ähnliche Etdeckung – dass nämlich atmosphärische CO2-Änderungen den globalen Luft- und Wassertemperatur-Änderungen um 9 bis 12 Monate nachlaufen. Die Studie: „The phase relation between atmospheric carbon dioxide and global temperature“

a) Änderungen des atmosphärischen CO2-Gehaltes laufen Änderungen der globalen Wassertemperatur um 11 bis 12 Monate nach

b) Änderungen des atmosphärischen CO2-Gehaltes laufen Änderungen der globalen Lufttemperatur um 9,5 bis 10 Monate nach.

c) Änderungen des atmosphärischen CO2-Gehaltes laufen Änderungen der globalen Temperatur der unteren Troposphäre um etwa 9 Monate nach.

Unsere Prognosen-Auswertung ist exzellent; das IPCC und seine Erfüllungsgehilfen lagen fortwährend falsch.

Die Fähigkeit zur Prognose ist vermutlich die beste objektive Eigenschaft zur Feststellung wissenschaftlicher Kompetenz. Das IPCC nebst seinen Globale-Erwärmung-Alarmisten lagen grundsätzlich falsch – jede einzelne ihrer Panik-Prophezeiungen bzgl. globale Erwärmung/Klimawandel ist nicht eingetreten (hier).

Schon im Jahre 2002 schrieben die Mitautoren Dr. Sallie Baliunas, Astrophysiker, Dr. Tim Patterson, Paläoklimatologe, und Allan Mac Rae hier:

„Die Klimawissenschaft stützt nicht die Theorie einer katastrophalen, vom Menschen ausgelösten globalen Erwärmung – die vermeintliche Erwärmungskrise existiert nicht“.

„Auf der ultimativen Agenda der Befürworter des Kyoto-Protokolls steht die Eliminierung fossiler Treibstoffe, aber dies würde zu einer katastrophalen Verknappung der globalen Energieversorgung führen – die von den Befürwortern vorgeschlagenen verschwenderischen und ineffizienten Energie-Lösungen können fossile Treibstoffe einfach nicht ersetzen“.

Beide Aussagen sind nachweislich bis heute korrekt. Trotz der zunehmenden Verbrennung fossiler Treibstoffe – vor allem seit dem Jahr 1940 – und der Zunahme des atmosphärischen CO2-Gehaltes seit 1958 ist der Welt nichts Anderes widerfahren als eine erhebliche vorteilhafte Zunahme der Ernteerträge und eine milde, wohltuenden globale Erwärmung.

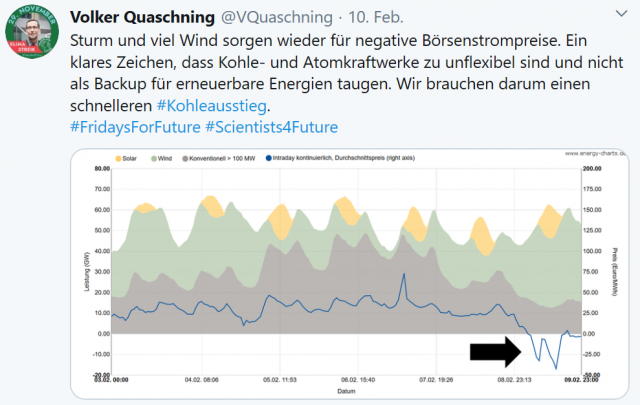

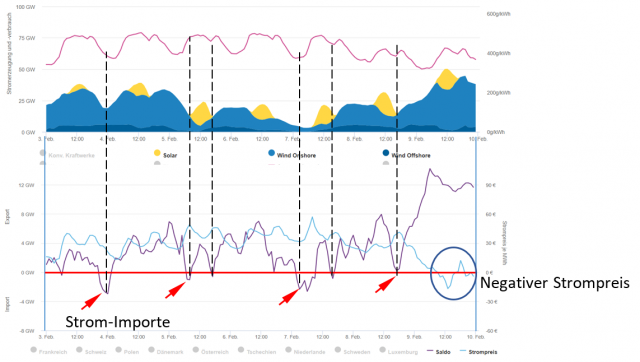

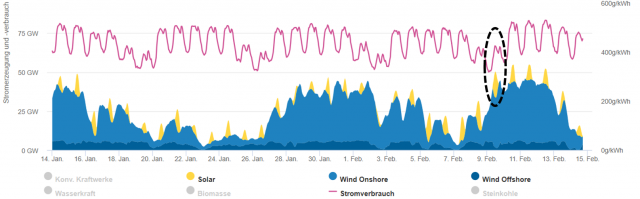

Trotz der Jahrzehnte langen Kampagnen bzgl. deren Eliminierung haben fossile Treibstoffe immer noch ihren Anteil von 85% an der globalen Primärenergie, der Rest stammt überwiegend aus Kern- und Wasserkraft. Trotz der verschwendeten Zehner-Billionen Dollar an Subventionen macht grüne Energie immer noch lediglich 4% der globalen Primärenergie aus. Wegen deren Intermittenz werden durch grüne Energie-Programme nicht einmal CO2-Emissionen nennenswert reduziert, müssen diese doch zu fast 100% durch zumeist fossile Energie ersetzt werden, wenn der Wind nicht weht und die Sonne nicht scheint.

CO2-Konzentration ist viel zu niedrig; auf der Erde ist es kälter als es optimal für die Menschheit und die Umwelt wäre

Die radikalen Grünen könnten falscher nicht liegen. Im Gegensatz zur grünen Propaganda ist der atmosphärische CO2-Gehalt viel zu niedrig – viel zu niedrig füroptimales Pflanzenwachstum und Ernteerträge, und viel zu niedrig für das weitere Überleben aller irdischen Lebensformen (hier). Programme zur CO2-Reduktion oder zu dessen Abscheidung sind nicht nur falsch, sondern auch kostspielig, destruktiv und idiotisch.

Durch Kälte sterben etwa 20 mal mehr Menschen als durch Wärme oder Hitze (hier). Winterbedingte Todesfälle (ermittelt aus dem Vergleich zwischen Anzahl der Todesfälle in den vier Wintermonaten einerseits (Dezember bis März auf der Nordhemisphäre) sowie der Hälfte der Anzahl von Todesfällen in den übrigen acht Monaten andererseits) treten weltweit auf, sogar in warmen Ländern wie Thailand und Brasilien.

…

Prognosen einer unmittelbar bevorstehenden globalen Abkühlung, die jetzt jederzeit beginnen kann.

Allan McRae hat am 1. September 2002 auf der Grundlage von Diskussionen mit Dr. Tim Patterson die Prognose veröffentlicht, wonach eine globale Abkühlung, wie sie bereits von ~1940 bis 1977 zu verzeichnen war, erneut zwischen 2020 und 2030 auftreten dürfte (hier):

„Während der letzten 1000 Jahre zeigte die globale Temperatur eine starke Korrelation mit Variationen der Sonnenaktivität. Diese Erwärmungs- und Abkühlungsphasen waren mit Sicherheit nicht durch vom Menschen verursachte Variationen des CO2-Gehaltes ausgelöst worden, weil die Verbrennung fossiler Treibstoffe bis zum 20. Jahrhundert keine Rolle spielte.

Aber auch der Temperaturverlauf über das 20. Jahrhundert zeigt kaum eine Korrelation mit dem atmosphärischen CO2-Niveau, welches über das Jahrhundert gestiegen ist. Allerdings erfolgte ein großer Teil der Erwärmung im 20. Jahrhundert vor dem Jahr 1940. Danach wurde es von 1940 bis 1977 kühler, gefolgt von erneuter Erwärmung ab dem Jahr 1977. Da 80% des vom Menschen erzeugten CO2 erst nach dem Jahr 1940 freigesetzt worden ist, stellt sich die Frage, warum der Großteil der Erwärmung schon davor eingetreten ist. Und außerdem, warum war es von 1940 bis 1977 zu einer Abkühlung gekommen trotz des steigenden CO2-Niveaus? Auch diese Erwärmungs- und Abkühlungstrend korrelieren viel besser mit Variationen der Sonnenenergie.

Erst seit 1977 korreliert die Erwärmung mit dem gestiegenen CO2-Gehalt, aber die Sonnenaktivität hat während dieses Zeitraumes ebenfalls zugenommen. Diese Erwärmung wurde nur an der Erdoberfläche gemessen, wohingegen Satelliten kaum oder überhaupt keine Erwärmung registriert haben in Höhen zwischen 1,5 bis 8 km. Dies steht in völligem Widerspruch zur Theorie des CO2 als dem Haupttreiber der Erwärmung. Falls wirklich die Sonnenaktivität der Haupttreiber der Temperatur in den bodennahen Luftschichten ist und nicht CO2, dann sollten wir den Beginn der nächsten Abkühlungsperiode 2020 bis 2030 erwarten“.

Während der letzten fünf Jahre schrieb MacRae genauer, dass die globale Abkühlung eher 2020 beginnen würde und dass sie sporadisch beginnt – an verschiedenen Stellen der Welt unterschiedlich. Ähnliche Prognosen globaler Abkühlung finden sich im Anhang.

Erwähnt werden muss in diesem Zusammenhang, dass das Ausbringen von Saatgut in Nordamerika sowohl 2018 als auch 2019 erst einen Monat später als gewöhnlich erfolgen konnte. Im Jahre 2019 waren außerdem viel mehr Allzeit-Kälterekorde in den USA registriert worden als Wärmerekorde (hier). Diese Ereignisse mögen Wetter und nicht Klima gewesen sein, aber sie könnten auch erste Anzeichen einer globalen Abkühlung sein.

…

[Hier folgt eine längere Beschreibung mit Einzelheiten zu den Ernteausfällen von Sojabohnen und anderem Getreide.]

Anhang – andere Prognosen einer globalen Abkühlung in chronologischer Reihenfolge ab dem Jahr 2003 [diese Prognosen stimmen bzgl. Abkühlung alle überein, lediglich Beginn und Dauer werden unterschiedlich beurteilt. Anm. d. Übers.]

Im Jahre 2003 verfasste Dr. Theodor Landscheidt eine Studie mit der Prognose einer ernsthaften globalen Abkühlung (hier):

Eine Analyse der variierenden Sonnenaktivität während der letzte beiden Jahrtausende zeigt, dass es im Gegensatz zu den Behauptungen des IPCC bzgl. einer vom Menschen verursachten Erwärmung um 5,8°C im Verlauf der nächsten 100 Jahre eine lange Periode kühleren Klimas zu erwarten ist mit der kältesten Phase um das Jahr 2030“.

Im Jahre 2005 prognostizierte Piers Corbyn eine Abkühlung bis 2040 (hier):

Am 2. Februar hielt Corbyn seinen Vortrag vor dem Institute of Physics Energy Management Group. Darin stellte er fest:

Während der nächsten 5 bis 10 Jahre wird die Wärme noch bestehen bleiben, wenn es zu einer transpolaren Verschiebung kommt. Dieser folgt eine Verlagerung des magnetischen Pols weg vom geographischen Pol, eine Abnahme der Sonnenaktivität eine Südwärts-Verlagerung des Golfstromes und eine merkliche Abkühlung bis zum Jahr 2040.

Im Jahre 2006 prognostizierte die NASA, dass der „Sonnenzyklus 25 um das Jahr 2022 einer der schwächsten seit Jahrhunderten sein kann“ (hier).

Khabibullo Abdusamatov et al. an der Russian Academy of Science schrieb im Jahre 2006 (hier):

50 Jahre lang kann es auf der Erde zu einer Abkühlung kommen mit ernsten Konsequenzen, bevor eine neue Periode mit Erwärmung Anfang des 22. Jahrhunderts einsetzt.

Auf der Grundlage unserer Forschungen bzgl. solarer Emissionen entwickelten wir ein Szenario einer globalen Abkühlung des Erdklimas bis Mitte dieses Jahrhunderts und dem Beginn eines regulären, 200 Jahre währenden Zyklus‘ mit globaler Erwärmung, welche Anfang des 22. Jahrhunderts einsetzen dürfte“.

Abdusamatov sagte, dass er und seine Kollegen zu dem Ergebnis gekommen seien, dass eine Periode globaler Abkühlung ähnlich der zum Ende des 17. Jahrhunderts – als die Grachten in den Niederlanden zufroren und Siedlungen in Grönland aufgegeben werden mussten – im Zeitraum 2012 bis 2015 beginnen und ihren Höhepunkt im Zeitraum 2055 bis 2060 erreichen kann. Weiter führte er aus, dass seiner Ansicht nach eine solche zukünftige Klimaänderung sehr ernste Konsequenzen zeitigen würde und dass man sich seitens der Behörden darauf vorbereiten sollte.

Nigel Weiss von der University of Cambridge schrieb im Jahre 2006 hier:

Betrachtet man die Vergangenheit der Sonne genauer, dann erkennt man, dass wir uns gegenwärtig in einer Phase anomal hoher Sonnenaktivität befinden. Derartige Perioden sind aber nicht von langer Dauer, dann erfolgt ein Einbruch. Diesen erwarte ich schon sehr bald“.

Leif Svalgaard von der Stanford University schrieb im Jahre 2006 hier:

Die Anzahl der Sonnenflecken wird im nächsten Jahrzehnt stark abnehmen. Sie wird extrem gering sein, und dieser Absturz wird drastisch ausfallen. Dieses bevor stehende Minimum der Sonnenflecken kann auf der Erde Abkühlung auslösen“.

[Schlussbemerkung des Übersetzers: Interessant bei diesen Prognosen aus den 2000er Jahren ist ja, dass man sie schon auf ihren Gehalt abklopfen kann, und zumindest was die Sonnenaktivität betrifft, waren die Prognosen durchweg weitgehend zutreffend!]

Übersetzt von Chris Frey EIKE