Tausendjährige Temperaturtrends zeigen globale Abkühlung

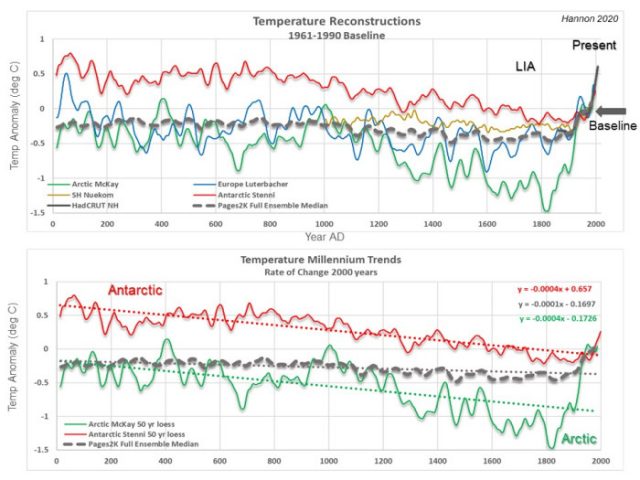

Anomalien der globalen mittleren Temperatur wurden kürzlich vom Pages 2K Consortium unter Führung von Nuekom berechnet (2019). Deren statistische Mittelwerte sind ein Konglomerat von sieben unterschiedlichen Verfahren für 7000 Proxy-Aufzeichnungen über die letzten 2000 Jahre. Das Mittel aller dieser Verfahren wird als gestrichelte Linie in Abbildung 1 gezeigt und mit den veröffentlichten regionalen Pages 2k-Rekonstruktionen verglichen. Alle Mittelwerte zeigen ähnliche Trends und werden fortan einfach als die globalen Mittel bezeichnet.

Es wurden solche regionalen Temperatur-Rekonstruktionen gewählt, die ähnliche Proxy-Datensätze heranziehen wie bei der Berechnung globaler Mittelwerte. Die Arktis-Rekonstruktion von McKay umfasst eine Palette von Proxy-Aufzeichnungen, bestehend aus Eisbohrkernen, Baumringen, Sedimenten in Seen und im Ozean nördlich von 60°N. Die Northern Hemisphere (NH) European Rekonstruktion von Luterbacher basiert auf Baumringen. Und die Antarktis-Rekonstruktion von Stenni beruht hauptsächlich auf Isotopen in Eisbohrkernen.

Das globale Mittel von Pages 2k scheint vernünftig zu sein im Vergleich zu regionalen Konstruktionen von der Gegenwart bis zurück zur Kleinen Eiszeit, genauer bis etwa zum Jahr 1250. Es ist schwierig zu erkennen, wie der Mittelwert im Vergleich zu regionalen Rekonstruktionen in der Gegenwart aussieht, wenn man einen Referenz-Zeitraum von 1961-1990 verwendet, da alle Rekonstruktionen konvergieren und den „Hockeyschläger“-Effekt erzeugen. Vor 1250 n. Chr. scheint der globale Mittelwert parallel zu den Temperaturen im NH Europa zu liegen, wovon die Antarktis weitgehend ausgespart ist.

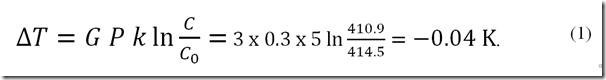

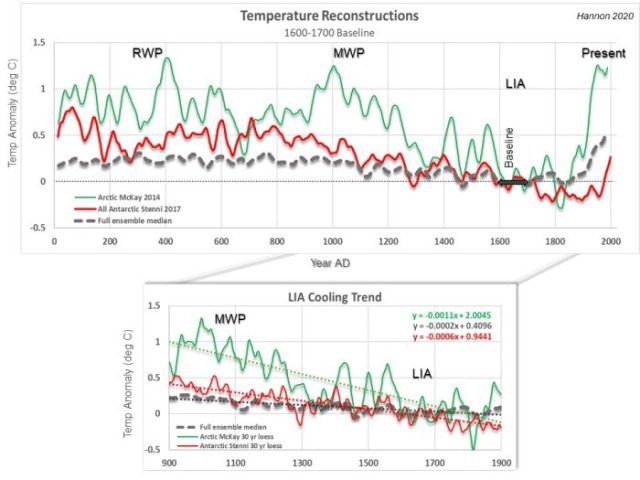

Abbildung 1: Die obere Grafik zeigt Temperatur-Rekonstruktionen mit einem 50-Jahre Loess-Filter [?] mit den globalen Mittelwerten des 7000 Member umfassenden Ensembles von Pages 2K mit allen Verfahren. Die untere Graphik zeigt lineare Trends der letzten 2000 Jahre.

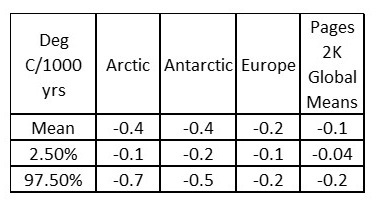

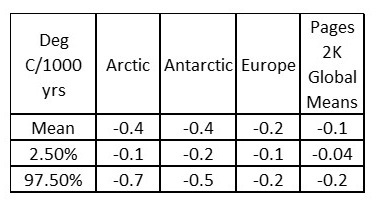

Eine lineare Regressionsanalyse der Temperatur-Rekonstruktionen in Abbildung 1 unten zeigt während der letzten 2000 Jahre Abkühlungstrends. Überraschenderweise zeigt sich sowohl in der Arktis als auch in der Antarktis ein ähnlicher langzeitlicher Abkühlungstrend von 0,4°C über 1000 Jahre. Tatsache ist, dass alle regionalen Konstruktionen eine negative Neigung – oder einen Abkühlungstrend – aufweisen während der letzten 2000 Jahre. Dies wird in Tabelle 1 dargestellt.

Interessanterweise verlaufen alle globalen Mittel fast flach oder zeigen einen dezenten Abkühlungstrend. Der globale mittlere Abkühlungstrend liegt mehr auf einer Linie mit der NH-Europa-Temperatur-Rekonstruktion. Man beachte, dass 97,5% der globalen mittleren Abkühlungstrends von 0,2°C pro 1000 Jahre immer noch flacher verlaufen als der mittlere Abkühlungstrend von 0,4°C pro 1000 Jahre in Arktis und Antarktis. Auch ist die mittlere globale geringe Bandbreite von 2,5% von 0,04°C pro 1000 Jahre viel flacher als die untere Bandbreite irgendwelcher regionalen Rekonstruktionen.

Tabelle 1: Jahrtausend-Trends räumlicher Temperatur-Rekonstruktionen während der letzten 2000 Jahre im Vergleich zu den globalen Mittelwerten von Pages 2K. Mittelwerte und Bandbreite für die Arktis stammen von McKay, für die Antarktis von Stenni, für Europa von Luterbacker und für globale Mittel von Neukom.

Von allen regionalen Temperatur-Rekonstruktionen zeigt der mittlere tausendjährige Trend von NH Europa die geringste Abkühlung während der letzten 2000 Jahre von lediglich 0,2°C pro 1000 Jahre. Diese Temperatur-Rekonstruktion beruht ausschließlich auf Baumring-Proxydaten. Es gibt eine merkliche Verschiebung hinsichtlich Datenmenge und -qualität in den Baumring-Datensätzen um das Jahr 1000. Die Anzahl der Baumring-Aufzeichnungen sind signifikant reduziert von 400 Aufzeichnungen nach dem Jahr 1600 auf weniger als 30 Aufzeichnungen vor dem Jahr 1000 (Luterbacher 2016).

McKay meldet einen Abkühlungstrend in der Arktis von 0,47°C pro 1000 Jahre im Zeitraum des Jahres 0 bis zum Jahr 1900. Der hier beschriebene Abkühlungstrend gilt für den Zeitraum von 0 bis zum Jahr 2000 und umfasst auch die Gegenwart. Bezieht man diese mit ein, reduziert sich der arktische tausendjährige Abkühlungstrend etwas, nämlich von 0,47°C auf 0,40°C pro 1000 Jahre. Wie erwartet zeigt sich in der Arktis-Rekonstruktion mit großen Temperaturschwankungen von Jahrhundert zu Jahrhundert die höchste Verteilung tausendjähriger Trends mit einer Bandbreite von -0,1°C bis -0,7°C pro 1000 Jahren.

Stenni (2017) zeigt Abkühlungstrends von 0,3°C pro 1000 Jahre für das Ostantarktische Plateau bis 0,52°C pro 1000 Jahre für die Antarktische Halbinsel, jeweils im Zeitraum 0 bis 1900. Die letzten 100 Jahre werden dabei separat betrachtet, was die größere Häufigkeit kürzerfristiger hundertjähriger Erwärmungen der Gegenwart zeigt. Bezieht man die Gegenwart mit ein, nimmt die Bandbreite des tausendjährigen Abkühlungstrends in der Antarktis etwas zu. Die Ostantarktis ist das letzte Gebiet auf der Erde, wo die gegenwärtige hundertjährige Erwärmung aufgetreten ist. Diese verzögerte Erwärmung wird von den Klimamodellen nicht erfasst, neigen diese doch dazu, die Erwärmung der Antarktis zu übertreiben (Stenni 2017).

Das globale Mittel liegt außerhalb der Arktis-Antarktis-Umhüllung

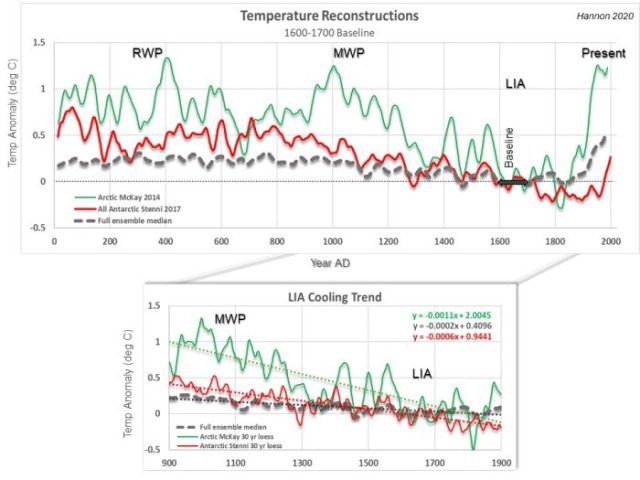

Wie schon in meinem vorigen Beitrag angesprochen ziehe ich es vor, für erweiterte Temperatur-Rekonstruktionen die Kleine Eiszeit (LIA) von 1600 bis 1700 als Referenzlinie heranzuziehen und nicht so sehr den Referenzzeitraum 1961 bis 1990. Beim Verwenden des LIA-Referenzzeitraumes bleibt die Temperaturkonvergenz während der kalten LIA erhalten, ebenso wie Temperaturdivergenzen zwischen Arktis und Antarktis in wärmeren Perioden. Damit werden die Mittelalterliche Warmzeit MWP, die Römische Warmzeit RWP und die LIA als Klima-Ereignisse in den Arktis-Daten der Abbildung 2 gut erkennbar. Zusätzlich sind diese Polargebiete dann in einen geeigneten Zusammenhang gestellt mit dem Umstand, dass es in der Antarktis stärkere negative Temperaturabweichungen gibt als in der Arktis.

Allgemeine Beobachtungen zeigen, dass die MWP und die RWP eine arktische Temperaturspitze wie das heutige Maximum von 1940 bis zur Gegenwart aufweisen. Alle drei Spitzen sind etwa 1,3°C wärmer als die LIA-Basislinie. Im Gegensatz dazu lagen die Temperaturen in der Antarktis während der MWP und der RWP um 0,25°C bis 0,50°C höher als heute.

Der globale Mittelwert wird grundsätzlich rückwärts in der Zeit abgeflacht, indem die zugrunde liegenden tausendjährigen Abkühlungstendenzen nicht berücksichtigt werden. Wenn Rekonstruktionen auf die LIA datiert werden, liegt der globale Mittelwert außerhalb der arktischen und antarktischen Bandbreite vor dem Jahr 1250. Vom Jahr 0 bis zum Jahr 1250 zeigt der Mittelwert niedrigere globale Temperatur-[Anomalien] als selbst die Antarktis. Ein einfacher Unterschied in der Durchschnittstemperatur zwischen der LIA und Rekonstruktionen von 0-1000 ist aufschlussreich. Sie zeigt den globalen Mittelwert mit einer leichten Erwärmung von nur 0,25°C vor der LIA, im Gegensatz zur Antarktis und Arktis, die eine Erwärmung von 0,5°C bzw. 0,8°C vor der LIA aufweisen. Das globale Mittel erscheint in der Gegenwart vernünftig.

Abbildung 2: Temperatur-Rekonstruktionen von Arktis und Antarktis der globalen Mittelwerte nach Pages 2K im Vergleich zum Referenzzeitraum 1600 bis 1700. Die Rekonstruktionen sind mit einem 50-Jahre-Loess-Filter versehen. Die untere Graphik ist eine Vergrößerung, welche lineare Trends von der MWP zur LIA zeigt. Diese Rekonstruktionen sind mit einem 30-Jahre-Loess-Filter versehen.

Wie erwartet ist der Jahrtausend-Trend im Hintergrund mit der Zeit vorübergehend. Beispiel: Die Abkühlung von der MWP zur LIA verlief schneller als die Abkühlung der letzten 2000 Jahre (untere Graphik in Abbildung 2). Die Arktis weist eine Abkühlung um 1,1°C pro 1000 Jahre auf, und die Antarktis kühlt sich mit einer Rate von 0,6°C ab. Unglaublicherweise zeigt das globale Mittel nach Pages 2K eine LIA-Abkühlungsrate von lediglich 0,2°C pro 1000 Jahre, das ist sogar noch geringer als in der Antarktis. Der Abflachungs-Effekt reduziert die Temperatur-Anomalie der Warmzeiten vor der LIA und zeigt nicht angemessen den LIA-Abkühlungstrend.

Der globale Mittelwert wird von Baumring-Proxys verzerrt

Die von Pages 2K zur Berechnung globaler Mittelwerte herangezogenen Daten beruhen auf 7000 Proxy-Aufzeichnungen. Die Mehrzahl der Aufzeichnungen jedoch (59%) besteht aus Baumringdaten hauptsächlich der Nordhemisphäre (Pages 2k, 2017). Nuekon (2019) räumt ein, dass Baumring-Aufzeichnungen trendbereinigt sind und daher nicht Trends im Zeitmaßstab von einem oder mehreren Jahrhunderten erfassen können. Auch erhalten sie nicht längerzeitliche tausendjährige Trends. Außerdem bestätigt er, dass sich dieses Problem verstärkt, je weiter man zeitlich zurückgeht. Das führt zu einer Unterschätzung der niederfrequenten Variabilität besonders während des ersten Jahrtausends der modernen Zeitrechnung. Das wäre analog zu Warmzeiten wie der MWP und der RWP. Die Mittelwert-Berechnungen von Pages 2K sind beherrscht von Proxydaten der Nordhemisphäre mit einer Überbetonung von Baumring-Proxys, und das ist der Hauptgrund für die Abflachung während der Vergangenheit.

Christiansen et al. (2017) haben eine exzellente Analyse und Diskussion über das Fehlen der Erhaltung niederfrequenter oder langzeitlicher Variabilität in Proxy-Aufzeichnungen sowie Temperatur-Rekonstruktionen im großräumigen Maßstab. Die Autoren stellen fest, dass Baumring-Aufzeichnungen eine absolute jährliche Datierungs-Kontrolle aufweisen und mit anderen Chronologien verglichen werden können. Allerdings räumt er ebenfalls die Probleme von Baumring-Daten bzgl. der Variabilität ein. Außerdem stellt er fest, dass die Mittelung von Proxys als ein Low-Pass-Filter wirken, was das Signal sich abflachen lässt. Damit wird die wahre Amplitude von Kalt- und Warmzeiten in Temperatur-Rekonstruktionen nicht erfasst. Beides gilt für das globale Mittel während RWP und MWP, weshalb man bzgl. der absoluten Temperaturwerte diese nicht mit der hundertjährigen Erwärmung der Gegenwart vergleichen kann.

Zusätzlich sind Baumring-Aufzeichungen vor dem Jahr 1000 hinsichtlich Datenquantität und -qualität reduziert. Für eine objektive Begutachtung der Pages 2K-Baumring-Proxys empfehle ich die Lektüre der Beiträge von Steve McIntyre hierzu. Er diskutiert die Genauigkeit von Baumringdaten, das Divergenz-Problem und die Rosinenpickerei hinsichtlich der Daten.

Conclusions

Die im Jahr 2019 veröffentlichte globale Mitteltemperatur von Pages 2K erfasst nicht den tausendjährigen Abkühlungstrend, wie er in Temperatur-Rekonstruktionen in Arktis und Antarktis aufgetreten war. Deren globales Mittel stützt sich auf eine Datengrundlage, welche verzerrt ist durch Baumring-Proxys der Nordhemisphäre, welche keine langzeitlichen Temperaturtrends der Polargebiete erfassen.

Die Auswirkung insgesamt des Pages 2K-Datensatzes und der daraus gebildeten Mittelwerte besteht darin, dass Temperaturtrends der Vergangenheit abgeflacht werden, besonders während RWP und MWP, welche Schlüssel-Analogien der heutigen Zeit sind. Die Abkühlung bis zur LIA ist weitgehend verschwunden. Höhere Temperaturen in Arktis und Antarktis während RWP und MWP sind minimiert und werden durch die globale Mitteltemperatur nicht repräsentiert.

Ergo: das Pages 2K-Consortium hat das Profil der globalen mittleren Temperatur in der Vergangenheit abgeflacht.

Acknowledgements: Special thanks to Donald Ince and Andy May for reviewing and editing this article.

References Cited:

Christiansen, B. & Ljungqvist, F. C. Challenges and perspectives for large-scale temperature reconstructions of the past two millennia. Rev. Geophys. 55, 40–96 (2017). https://agupubs.onlinelibrary.wiley.com/doi/full/10.1002/2016RG000521

Luterbacher J et al. European summer temperatures since Roman times. Environmental Research Letters 11, 024001, DOI: 10.1088/1748-9326/11/2/024001, 2016.

McKay, N. P. and Kaufman, D. S.: An extended Arctic proxy temperature database for the past 2,000 years, Scientific Data 1:140026, doi:10.1038/sdata.2014.26, 2014 Dataset: https://www1.ncdc.noaa.gov/pub/data/paleo/pages2k/arctic2014temperature-v1.1.txt

McIntyre, S. Climate Audit blog. https://climateaudit.org/?s=Pages

PAGES 2k Consortium: Continental-scale temperature variability during the past two millennia, Nat. Geosci., 6, 339–346, Published online 21 April 2013, https://doi.org/10.1038/NGEO1797, 2013.1c PAYWALLED. Dataset available see above.

PAGES 2k Consortium- Neukom, R., Barboza, L.A., Erb, M.P. et al. Consistent multidecadal variability in global temperature reconstructions and simulations over the Common Era. Nat. Geosci. 12, 643–649 (2019). https://doi.org/10.1038/s41561-019-0400-0. Paywalled, but shared by the author at the following link. http://pastglobalchanges.org/science/wg/2k-network/nature-geosc-2k-july-19

Stenni, B., Curran, M. A. J., Abram, N. J., Orsi, A., Goursaud, S., Masson-Delmotte, V., Neukom, R., Goosse, H., Divine, D., van Ommen, T., Steig, E. J., Dixon, D. A., Thomas, E. R., Bertler, N. A. N., Isaksson, E., Ekaykin, A., Werner, M., and Frezzotti, M.: Antarctic climate variability on regional and continental scales over the last 2000 years, Clim. Past, 13, 1609–1634, https://doi.org/10.5194/cp-13-1609-2017, 2017.

Temperature Reconstruction Datasets

Arctic McKay, 2014. https://www1.ncdc.noaa.gov/pub/data/paleo/pages2k/arctic2014temperature-v1.1.txt

Antarctic Stenni, 2017. https://www1.ncdc.noaa.gov/pub/data/paleo/pages2k/stenni2017antarctica/CPSrecons/All_regions_recons_CPS.csv

Europe Luterbacher, 2016. https://www1.ncdc.noaa.gov/pub/data/paleo/pages2k/EuroMed2k/eujja_2krecon_nested_cps.txt

SH Nuekom, 2014. https://www1.ncdc.noaa.gov/pub/data/paleo/contributions_by_author/neukom2014/SH_Fig2_recons_Ens-means_wrt1000-2000.txt

Pages 2K 2013 dataset. www.ncdc.noaa.gov/paleo/pages2k/pages-2k-network.html

Pages 2K-Nuekom Ensemble Means 2019. https://www.ncdc.noaa.gov/paleo-search/study/26872 .

Link: https://wattsupwiththat.com/2020/05/03/global-mean-temperature-flattens-the-past/

Übersetzt von Chris Frey EIKE