Das Ende der Menschheit ist in 30 Jahren

Wissenschaftler prognostizieren Ende der Menschheit

Dank den msn-Nachrichten kann man auf dem PC nun täglich so niveauvolle Information lesen, wie man sie früher ganz selten notgedrungen, bei schlimmster Langeweile wegen langer Wartezeit, verschämt im Wartezimmer durch „Bunte“, „Bild der Frau“, „Frau mit Herz“ erfuhr.

Und so erschien am 14. Mai die erschreckende Meldung, dass das Ende der Menschheit nun im Jahr 2050 erscheint. Um die Überlassung einer veredelten und gereinigten Erde an seine Enkel braucht man sich damit endgültig keine Sorgen mehr zu machen, da sie zu dem Datum völlig unbewohnbar geworden ist, die Enkel dann also eher die Sorge nach einem geeigneten Platz unter, als über der Erde haben.

Und diesmal weiß die Meldung, dass es ganz, ganz sicher geworden ist, denn „die Entwicklung lässt sich nicht mehr aufhalten“, wie es zwei besonders kompetente Wissenschaftler am anderen Ende der Welt ermittelt und publiziert haben.

msn-Nachrichten: [1] Wissenschaftler prognostizieren Ende der Menschheit

… Schlechte Nachrichten ist die Menschheit ja schon gewohnt, besonders, wenn es um das Klima geht. Aber jetzt wird es heftig die Einschläge kommen so gesehen nicht nur näher, sie sind da!

Das Ende der Menschheit zu unseren Lebzeiten

Was da australische Forscher an Daten gesammelt, ausgewertet und daraus dann resümiert haben, ist absolut erschreckend. Es geht um nicht weniger als den Zusammenbruch der Zivilisation und das Ende der Menschheit in 30 Jahren.

Das „Breakthrough National Centre for Climate Restoration“ hatte bei australischen Universitäten einen Bericht zum Klimawandel angefordert und die Forscher haben jeden diesbezüglich denkbaren Ablauf durchgespielt

Worst-Case-Szenario löscht die Menschheit aus

… Denn die Entwicklung lässt sich nicht mehr aufhalten, selbst wenn der Mensch noch panisch versuchen sollte, all das umzusetzen, was vor Jahrzehnten hätte spätestens begonnen werden müssen

Lange hat man auf diese Präzisierung des künftigen Klimas warten müssen. Nachdem sich die Weltuntergänge zwar bisher schon häuften, dabei aber auch immer neu verschoben wurden; vom Ende des letzten Jahrtausend bis etwa zum Jahr 2100 (eine Listung findet sich bei [6]) ist es trotz des schlimmen Inhalts also fast eine Wohltat, dass die Wissenschaft nun herausfand, es wird mit Sicherheit in der Mitte dieser Zeitspanne geschehen.

Mancher mag Zweifel an dieser Aussage hegen. Leider hat ein bedeutender Klimaforscher diese zunichte gemacht. Mit seinen fachmännischen Augen hat er diesen Bericht gelesen, durchdacht und musste es leider bestätigen:

msn-Nachrichten: [1]Wie hoch ist die Wahrscheinlichkeit?

… Und wie wahrscheinlich ist es, dass sich die Dinge exakt so entwickeln werden? Klimaforscher Prof. Dr. Mojib Latif vom Geomar Helmholtz-Zentrum für Ozeanforschung in Kiel sagt dazu:

„Die Studie behandelt sogenannte ‚Low ProbabilityHigh Impact‘-Events, also Ereignisse, die mit einer geringen Wahrscheinlichkeit eintreten werden, aber ein enormes Schadenspotenzial haben.“

Mit anderen Worten: Es muss nicht so kommen, aber man kann es auch nicht ausschließen.

Damit gab M. Latif diesem Bericht sein wissenschaftliches „Gewicht“. Allerdings schloss er seine Bewertung (laut Artikel) mit den kryptischen, wissenschaftlichen Worten, welche inzwischen wohl jeden Politiker zur Verzweiflung treiben:

msn-Nachrichten: [1] Ob dieser Befund möglicherweise ein Weckruf an die Verantwortlichen ist, bleibt abzuwarten.

Der Klima-Untergangs-Report

Auf der folgenden Homepage findet sich eine Beschreibung und man kann den Report laden:

[2] Climate Code RED: Can we think in new ways about the existential human security risks driven by the climate crisis?

Die Vorlage für die msn-Nachrichten findet sich unter:

[4] abc Action News Jun 11, 2019: Climate change could pose ‚existential threat‘ by 2050, report says

Der Report selbst heißt: [3] Report: Existential climate-related security risk: A scenario approach, May 2019

und beschreibt auf sieben inhaltsschweren Seiten, warum die Welt im Jahr 2050 untergeht.

Schon daran lässt sich die hohe, wissenschaftliche Kunst der Autoren erkennen. Während das IPCC für seinen AR5-Langbericht 1552 Seiten benötigt, weshalb immer ein politisches Gremium notgedrungen einen eigenen, vom Inhalt des Langberichtes streckenweise losgelösten Kurzbericht fabuliert, schaffen es diese Fachpersonen mit sieben Inhaltsseiten, das Wichtige und Notwendige darzustellen und zu belegen.

Als Autoren werden genannt:

Deshalb wurde er verfasst

Gleich als Einleitung findet sich ein prominenter Ausspruch des berühmten Klimawissenschaftlers, Dr. Gavin Schmidt (Leiter des Goddard Institute for Space Studies der NASA und ausgewiesener Klimaaktivist), der in dieser Wissenschaft auch konsequent angewandt wird:

Praxisnäher übersetzt: Auch das Unwahrscheinliche kann wahr werden und ist deshalb als Möglichkeit zu erforschen (beim Klimawandel bedeutet dies: zu simulieren). Die (schrecklichen) Ergebnisse sind – so unwahrscheinlich sie auch eintreten –, als ob sie doch kommen würden und damit eine große Gefahr bedeuten, zu publizieren ...

Weiterführung des Autors: … Es gibt nämlich immer Bevölkerungskreise, welche jede noch so unwahrscheinliche Apokalypse für bare Münze nehmen und bedingungslosen Schutz davor fordern. (Nicht nur) die Freitagshüpfer sind ein beredtes Beispiel.

Fachinhalte

Das erste Kapitel lautet: SCIENTIFIC RETICENCE und erläutert zum Beispiel Szenarien des Meeresspiegels und der Temperatur:[3] … In one example, the IPCC’s Fifth Assessment Report in 2014 projected a sea-level rise of 0.55-0.82 metre by2100, but said “levels above the likely range cannot bereliably evaluated”. By way of comparison, the higher of two US Department of Defence scenarios is a two-metre rise by 2100, and the “extreme” scenariodeveloped by a number of US government agencies is 2.5 metres by 2100

„SCIENTIFIC RETICENCE“ lässt sich in diesem Zusammenhang gut wie folgt beschreiben:

[5] Wissenschaftliche Zurückhaltung ist eine ernsthafte Bedrohung für den Klimawandel

Profis müssen sich über drohende Gefahren äußern, auch wenn sie etwas falsch machen …

… Wenn es um den Klimawandel geht, manifestiert sich das Bedürfnis nach übermäßiger Vorsicht und absoluter Sicherheit der Ergebnisse leider als Schweigen der Mainstream-Wissenschaft über die schlimmsten, aber wahrscheinlichen Folgen und die schlimmsten Szenarien, die immer wahrscheinlicher werden …

Die große Gefahr

Im Report geht es (nur) darum, auch unwahrscheinlich(st)e Szenarien als eine große Gefahr dazustellen.

Beispielhaft an Gefahren sind gelistet (Auszug):

Report [3]: Scientists warn that warming of 4°C is incompatible with an organised global community, is devastating to the majority of ecosystems, and has a high probability of not being stable. The World Bank says it may be “beyond adaptation”.

But an existential threat may also exist for many peoples and regions at a significantly lower level of warming. In 2017, 3°C of warming was categorised as “catastrophic” with a warning that, on a path of unchecked emissions, low-probability, high-impact warming could be catastrophic by 2050

Grob verbesserte Deepl-Übersetzung: Wissenschaftler warnen davor, dass eine Erwärmung um 4°C unsere globale Staatenorganisation ins Wanken bringt, sich auf die Mehrheit der Ökosysteme verheerend auswirkt und mit hoher Wahrscheinlichkeit nicht stabil sein wird (Anm.: Ob damit das Klima, oder die Staatsordnungen gemeint sind, erschließ sich aus dem Text nicht eindeutig, es werden aber wohl die 4 Grad gemeint sein). Die Weltbank sagt, es könnte dann „jenseits der Anpassungsmöglichkeit“ (der Ökosysteme) liegen.

Aber eine existenzielle Bedrohung könnte für viele Völker und Regionen auch (schon) bei einer deutlich geringeren Erwärmung bestehen. Im Jahr 2017 wurden 3°C Erwärmung als „katastrophal“ eingestuft, mit der Warnung, dass auf einem Pfad (wenig wahrscheinlicher) unkontrollierter Emissionen bereits diese Temperaturerhöhung im Jahr 2050 katastrophal sein könnte.

Bestätigung finden die Autoren zum Beispiel in Aussagen von Herrn Schellnhuber (ehemaliger PIK-Leiter):

Report [3]: The Emeritus Director of the Potsdam Institute, Prof. Hans Joachim Schellnhuber, warns that “climate change is now reaching the end-game, where very soon humanity must choose between taking unprecedented action, or accepting that it has been left too late and bear the consequences.” He says that if we continue down the present path “there is a very big risk that we will just end our civilisation. The human species will survive somehow but we will destroy almost everything we have built up over the last two thousand years.”

Grob verbesserte Deepl-Übersetzung: (Schellnhuber) warnt davor, dass „der Klimawandel nun den Zeitpunkt erreicht, wo sich die Menschheit sehr bald entscheiden muss, entweder beispiellose Maßnahmen zu ergreifen oder zu akzeptieren, dass sie den Lösungszeitpunkt verpasst hat und die Folgen tragen muss“. Er sagt, wenn wir den gegenwärtigen Weg (der CO2-Emission) weitergehen, „besteht die sehr große Gefahr, dass wir unsere Zivilisation (damit) einfach beenden. Die menschliche Spezies wird irgendwie überleben, aber wir werden fast alles zerstören, was wir in den letzten zweitausend Jahren aufgebaut haben“.

Man erkennt den „Beleghintergrund“ der später kommenden, extremen, aber auch sehr unwahrscheinlichen Klima-Schreckensszenarien: Es geht um die Klima-Kipppunkte, welche als Folge überproportionale Steigerungen erzeugen und (nur) so unwahrscheinliche Extremwerte „wahrscheinlich“ werden lassen.

Report [3]: This is a particular concern with potential climate tipping-points — passing critical thresholds which result in step changes in the climate system that will be irreversible on human timescales — such as the polar ice sheets (and hence sea levels), permafrost and other carbon stores, where the impacts of global warming are non-linear and difficult to model with current scientific knowledge.

… Recently, attention has been given to a “hothouse Earth” scenario, in which system feedbacks and their mutual interaction could drive the Earth System climate to a point of no return, whereby further warming would become self-sustaining. This “hothouse Earth” planetary threshold could exist at a temperature rise as low as 2°C, possibly even lower ….

Grobe Deepl-Übersetzung: Dies ist besonders besorgniserregend im Hinblick auf potenzielle Klimakipp-Punkte – das Überschreiten kritischer Schwellenwerte, die zu schrittweisen Veränderungen des Klimasystems führen, die auf menschlichen Zeitskalen irreversibel sind – wie die polaren Eisschilde (und damit der Meeresspiegel), Permafrostböden und andere Kohlenstoffspeicher, wo die Auswirkungen der globalen Erwärmung nichtlinear und mit den derzeitigen wissenschaftlichen Erkenntnissen schwer zu modellieren sind.

… Kürzlich wurde die Aufmerksamkeit auf ein „Treibhaus Erde“-Szenario gelenkt, in dem Systemrückkopplungen und ihre gegenseitige Wechselwirkung das Klima im Erdsystem bis zu einem Punkt ohne Wiederkehr treiben könnten, an dem sich eine weitere Erwärmung selbst trägt. Dieser „Treibhaus Erde“-Schwellenwert könnte bei einem Temperaturanstieg von nur 2°C, möglicherweise sogar bei niedrigeren liegen ….

Im Kern ist damit die „Belegführung“ des Reports abgehandelt. Nicht ein eigener – gar neuer – Gedanke ist im Report zu finden. Es reicht den Autoren, was vor allem Herr Schellnhuber „gesagt“ hat. Zwar sind noch (für Klimapublizierungen geradezu extrem wenige) Fundstellen gelistet. Deren „Belegqualität“ teilweise aber auf dem folgenden Niveau:

Fundstelle: 11 Breeze, N. 2018. “It’s non-linearity, stupid”, The Ecologist, 3 January 2019, accessed 18 March 2019

Hinter dieser Fundstelle steckt dann nichts anderes, als ein Interview mit Herrn Schellnhuber:

ECOLOGIST 3rd January 2019: ‚It’s nonlinearity – stupid!‘

Nick Breeze interviews professor John Schellnhuber, who set up the Potsdam Institute for Climate Impact Research in 1991 to study climate.

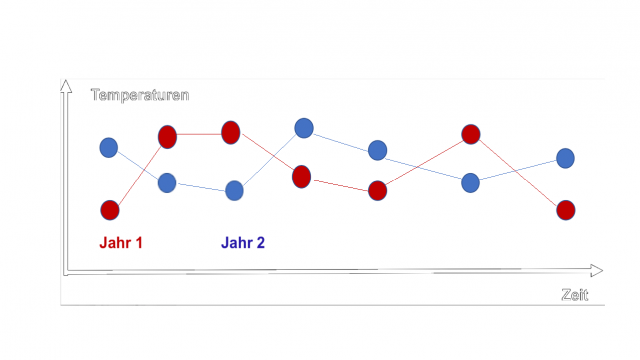

Sehr seltene Ereignisse sind viel wahrscheinlicher als bisher angenommen …

Alle IPCC-Reports „handeln“ und bewerten mit Wahrscheinlichkeiten. Bleibt man bei den Wahrscheinlichen, kommen allerdings keine wirklichen Schreckensszenarien zustande (bleibt man bei den Messwerten, dann nicht einmal mehr das).

Um ihn trotzdem zu „erzeugen“, bleibt also nur die Wahl, den statistischen „Vertrauensbereich“ extrem auszuweiten, im Klartext: auch unwahrscheinlich(st)e Simulationsergebnisse in den Überdeckungsbereich des „Vertrauens“ mit einzubeziehen. Mit Statistik nicht so „Bewanderte“ meinen dazu, solche Ergebnisse hätten dann besonders viel „Vertrauen“.

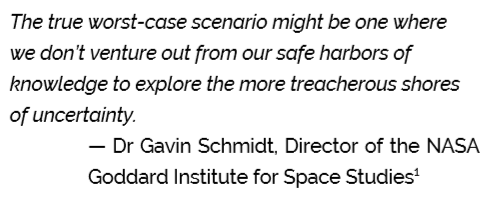

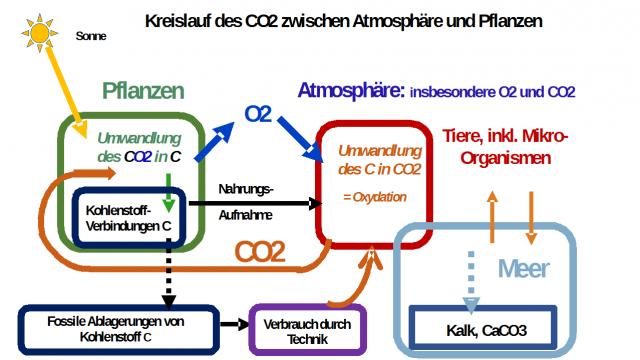

Ein paar Grafiken zu Erläuterung:

Das folgende Bild zeigt die Simulations-Pegelverläufe aus dem IPCC AR5 Sachstandsbericht. Mit dem als wahrscheinlichst geltendem Scenario RCP 2.6, beträgt die Pegelerhöhung zum Jahr 2100 zwischen 18 … 59 cm. Die lineare Fortschreibung des Tidenpegelverlaufs ergibt +15 … 20 cm (Anm.: Der Pegelforscher Prof. Mörner geht von -+10 cm aus).

Dies sind zum Jahr 2100 die wahrscheinlichsten Werte. Entsprechen (mit einem zusätzlichen Risikopuffer) werden Küsten-Schutzmaßnahmen in Ländern, deren Politiker auf den Schutz ihrer Bevölkerung (und nicht nur des eigenen) Wert legen (und es bezahlen können) ausgeführt.

Die Autoren des Berichtes behaupten nun, dass dies falsch ist. Es könnte ja sein, dass auch ein extrem selten wahrscheinlicher Fall doch eintritt und wenn er kommt, ist man nicht gewappnet.

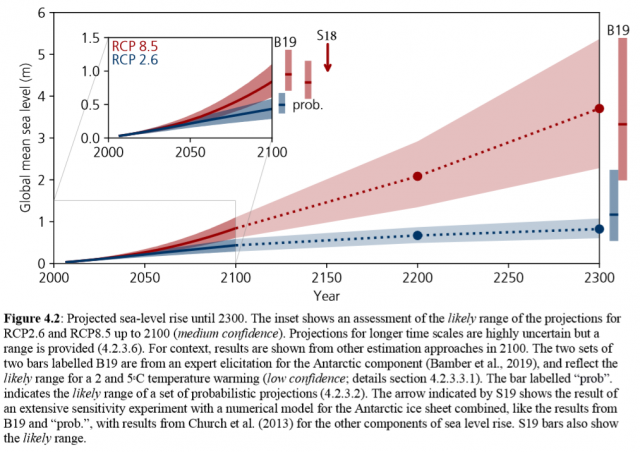

Das folgende Pegel-Simulationsbild zeigt eine solche Simulation eines mit sehr hoher Wahrscheinlichkeit (da auch physikalisch unmöglich) nicht eintreffenden Pegel-Szenarios:

Mit diesem Vorgehen ist natürlich wirklich jeder Alarm erzeugbar. Auch der, dass die Erde im Jahr 2050 wegen des Klimas fast nicht mehr bewohnbar ist. Auch, die „Unrettbarkeit“, da die Kosten einer „Rettung“ von keiner Ökonomie der Welt bezahlt werden könnte.

Report [3]: Analysis of climate-related security threats in an era of existential risk must have a clear focus on the extremely serious outcomes that fall outside the human experience of the last thousand years. These “fat-tail” outcomes have probabilities that are far higher than is generally understood.

Grobe Deepl-Übersetzung: Die Analyse der klimabedingten Sicherheitsbedrohungen in einer Ära existentieller Risiken muss einen klaren Fokus auf die äußerst schwerwiegenden Folgen haben, die außerhalb der menschlichen Erfahrung der letzten tausend Jahre liegen. Diese „Fat Tail“-Ergebnisse haben Wahrscheinlichkeiten, die weit höher sind, als allgemein verstanden wird.

Um dieses Vorgehen zu rechtfertigen, wird wiederholend Herr Schellnhuber bemüht:

Report [3]: In Prof. Schellnhuber’s words: “We must never forget that we are in a unique situation with no precise historic analogue. The level of greenhouse gases in the atmosphere is now greater, and the Earth warmer, than human beings have ever experienced …

Grobe Deepl-Übersetzung: (Schellnhuber) „Wir dürfen nie vergessen, dass wir uns in einer einzigartigen Situation befinden, in der es keine genaue historische Entsprechung gibt. Das Niveau der Treibhausgase in der Atmosphäre ist heute höher und die Erde wärmer, als es die Menschen je erlebt haben …

Dass alleine die Aussage: (Schellnhuber) „ … die Erde wärmer, als es die Menschen je erlebt haben … „ mit Sicherheit nicht stimmt, tut der „Belegführung“ in den Augen der Berichtsautoren keinen Abbruch.

Und so wird auch nach Schellnhubers „Anleitung“ vorgegangen:

Report [3]: In this spirit, we sketch a 2050 scenario

Welche Erde trifft man im Jahr 2050 an?

Report [3]: By 2050, there is broad scientific acceptance that system tipping-points for the West Antarctic Ice Sheet and a sea-ice-free Arctic summer were passed well before 1.5°C of warming, for the Greenland Ice Sheet well before 2°C, and for widespread permafrost loss and large-scale Amazon drought and dieback by 2.5°C. The “hothouse Earth” scenario has been realised, and Earth is headed for another degree or more of warming, especially since human greenhouse emissions are still significant.

… While sea levels have risen 0.5 metres by 2050, the increase may be 2–3 metres by 2100, and it is understood from historical analogues that seas may eventually rise by more than 25 metres

Grob verbesserte Deepl-Übersetzung: Zum Jahr 2050 gibt es eine breite wissenschaftliche Akzeptanz, dass die System-Kipp-Punkte für den westantarktischen Eisschild und einen meereisfreien arktischen Sommer bereits weit unterhalb einer Erwärmung um 1,5°C überschritten sind, für den grönländischen Eisschild weit unterhalb 2°C und für einen großflächigen Permafrostverlust und großflächige Dürre und Absterben im Amazonasgebiet mit 2,5°C.

Das „Gewächshaus Erde“-Szenario ist dann eingetroffen, und die Erde steuert auf eine weitere oder noch stärkere Erwärmung zu, zumal die Treibhausgasemissionen des Menschen immer noch beträchtlich sind.

… Während der Meeresspiegel bis 2050 um 0,5 Meter angestiegen ist, könnte der Anstieg bis 2100 2-3 Meter betragen, und aus historischen Analogien geht hervor, dass die Meere schließlich um mehr als 25 Meter ansteigen könnten …

Was dazu im Bericht fehlt, ist die physikalische Tatsache, dass dazu ein ganz großes Schmelzen der Antarktis erforderlich ist und dieses dazu mehrere Tausend Jahre benötigen würde.

Nach diesen nicht nur vollkommen kritiklos, sondern bedingungslos zustimmend, vorwiegend vom PIK übernommen Listungen extremster Simulations-Szenarien sollte man annehmen, es würden nun etwas konkreter Details und neue Gesichtspunkte dazu erscheinen. Doch davon kommt: nichts. Stattdessen warnende Beschreibungen und mit Sicherheit der einzige, wichtige Absatz des Reports für dessen Auftraggeber:

Report [3]: To reduce such risks and to sustain human civilisation, it is essential to build a zeroemissions industrial system very quickly. This requires the global mobilisation of resources on an emergency basis, akin to a wartime level of response.

Grobe Deepl-Übersetzung: Um solche Risiken zu verringern und die menschliche Zivilisation aufrechtzuerhalten, ist es unerlässlich, sehr schnell ein Null-Emissions-Ökosystem aufzubauen. Dies erfordert die globale Mobilisierung von Ressourcen auf Notfallbasis, ähnlich der Reaktion in Kriegszeiten …

Warum hat sich M. Latif das angetan?

Dieser „Bericht“ fällt (rein persönliche Meinung des Autors als Klimalaien) ohne zu zögern in die Kategorie „Auftragsleistung, die nicht einmal im Ansatz Wert darauf legt, einen Anflug von Seriosität zu verbreiten und ihren Fachinhalt weder neutral-, noch im Ansatz wissenschaftlich prüft“.

Immer wieder erschreckend zu sehen, welch unterirdisches Niveau zum Klimawandel veröffentlicht und von Medien gepriesen wird.

Dass allerdings einer wie M. Latif dazu noch einen (im Ansatz positiven) Kommentar beisteuert, muss man wohl als einen Akt eigener Verzweiflung betrachten. In solchen Seelenzuständen hat man sich einfach nicht mehr ausreichend im Griff:

Badische Neueste Nachrichten, 25. September 2019: Klimaforscher Mojib Latif in Karlsruhe: „Ich bin gescheitert“

Wenn man nun noch weiß, dass dieser Bericht bereits letztes Jahr um fast die gleiche Zeit erschien und schon damals mit der gleichen Reaktion „besprochen“ wurde:

Bild 6 [9] Bild-Zeitung, 6.6.2019

… laut einem Bericht aus Australien könnte diese Erfolgsgeschichte schon bald zu einem katastrophalen Finale kommen.

und dann wieder am 10.09.2019 im FOCUS, erkennt man die perfide Beeinflussungsstrategie unserer Medien, durch regelmäßiges Wiederholen der gleichen Information, so als ob sie gestern neu verfasst worden wäre.

Doch nun eine Entschuldigung für M. Latif. Auch andere „Klimaforscher“ sind sich für nichts zu schade:

[9] Bild-Zeitung: Zu Einordnung der Studie erklärte Klimaforscher Dr. Martin Stendel vom dänischen Meteorologischen Institut (DMI) gegenüber BILD: „Die australischen Forscher folgen dem Ansatz: Können wir sicher ausschließen, dass es wesentlich extremere Entwicklungen gibt? Nein, das können wir nicht. Solchen extremen Entwicklungen können wir zwar keine Wahrscheinlichkeiten zuordnen, aber sie sind möglich.“

Aber die Bild-Zeitung achtet immer auch auf (etwas) Ausgewogenheit:

[9] … Es gibt jedoch auch Kritik an dem Bericht. Der Klimaforscher Prof. Dr. Hans von Storch gegenüber BILD: „Das ist ein schönes Stück interessengeleitetes Verschrecken von Menschen. Medial sicher zur erschreckender Unterhaltung geeignet, aber in der Sache ein weiterer Versuch, den Versuch lächerlich zu machen, den Klimawandel ernst zu nehmen.“ ...

Quellen

[1] msn Nachrichten 14.05.2020: Das Ende der Menschheit in 30 Jahren

[2] Climate Code RED: Can we think in new ways about the existential human security risks driven by the climate crisis?

[3] Report: Existential climate-related security risk:A scenario approach May 2019

[4] abc Action News Jun 11, 2019: Climate change could pose ‚existential threat‘ by 2050, report says

[5] DownToEarth: Wissenschaftliche Zurückhaltung ist eine ernsthafte Bedrohung für den Klimawandel

[6] Salonkolumnisten, 15. Juli 2019: Wir sind noch einmal davongekommen

[7] EIKE 22.02.2020: Greta weiß genau Bescheid … Der Meeresspiegel könnte um 0,04 … 10 m steigen… ist die etwas umformulierte Botschaft, welche ein Video mittels Aussagen des PIK vermittelt

[8] Climate Central, November 2015: MAPPING CHOICES CARBON, CLIMATE, AND RISING SEAS OUR GLOBAL LEGACY

[9] Bild-Zeitung, 06.06.2019: Australische Forscher warnen vor Nichts-Tun Schock-Prognose zur Klimakatastrophe