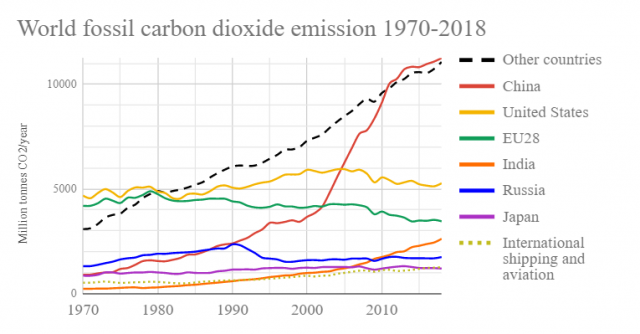

Die Verfechter des natürlichen Treibhauseffektes benötigen diesen, um zu erklären, warum die Abstrahlung der Erde um soviel geringer ist als die mittlere Temperatur an der Erdoberfläche an Strahlungsleistung nach dem S-B-Gesetz erzeugen würde. Um trotzdem ein Gleichgewicht mit der Einstrahlung zu erreichen, benötigt sie jedoch ein kompliziertes rückgekoppeltes und vor allem lückenhaftes Gegenstrahlungsmodell. Das alles hat seine Ursache in der Mittelung der einfallenden solaren Strahlung durch den Teiler 4 für die gesamte Kugel. Es ist aber unbestreitbare Tatsache, dass nachts die Sonne nirgendwo scheint. Physikalisch ausgedrückt bedeutet dies, dass jeweils nur eine Halbkugel die solare Strahlung aufnimmt, während zeitgleich die gesamte Kugel Strahlungsleistung wieder abgibt, um auf diese Weise zu einem Gleichgewicht zwischen Ein- und Ausstrahlung zu gelangen. Unser Autor A. Agerius (Pseudonym, der wirkliche Name ist der Redaktion bekannt) hat nun in seinem Modell auf andere Weise als U. Weber nachgewiesen, dass sich sämtliche Messwerte der ERBS-Satellitenreihe auf einfache Weise abbilden und vor allem reproduzieren lassen, wenn man die Halbkugel-Ein- und Ganzkugel-Abstrahlung konsequent und Schicht für Schicht anwendet. Eine Gegenstrahlung wird dafür nicht mehr benötigt. Um dem Prinzip von Occam´s Razor zu genügen, nachdem die einfachste Erklärung für Naturerscheinungen fast immer die Richtige ist, stellen wir diese, für viele überraschende Herleitung, hier zur Diskussion.

A. Agerius26.07.2020

In 4 Themenblöcken werden die Stichworte im Titel betrachtet. Sie sind inhaltlich verbunden:

A. Umgebungsgleichung (Stefan-Boltzmann-Gesetz)

„Anmerkungen zur hemisphärischen Mittelwertbildung mit dem Stefan-Boltzmann-Gesetz“ (von Ulrich O. Weber,veröffentlicht am 11. September 2019 durch EIKE, Europäisches Institut für Klima & Energie)

Der Ansatz von Herrn Weber ist in Beiträgen auf EIKE und in seinen Büchern ausführlich dargestellt. Diese Modellierung berücksichtigt keine atmosphärischen, horizontalen und vertikalen Umschichtungen. Ihr perspektivischer Bezugspunkt ist die Kugeloberfläche. Zwei unabhängige Vergleichsrechnungen durch einen Bekannten, Diplomingenieur der Elektrotechnik, und mir wurden mit diesem Modell über Mantelringe mit 1 Grad Schritten bei solarer Einstrahlung von 1367 W/m², auch als Total Solar Irradiance TSI bezeichnet, und mit einer Albedo a = 0,30 berechnet. Wir erhielten als Global Mean Temperature für die Erde T = 15,3°Celsius. Dieser Ansatz ist ein in sich komplett unabhängiger Beweis, dass es für die Herleitung dieser Mitteltemperatur keines Treibhauseffektes von 33 K bedarf.

Herr Weber schrieb in diesem Artikel: „In der üblicherweise dargestellten Form lautet das Stefan-Boltzmann-Gesetz: P/A = σ T4. Diese Form stellt den astronomischen Spezialfall für eine Umgebungstemperatur T0 von 0 Kelvin dar.“ Und „Die allgemeine Form des Stefan Boltzmann-Gesetzes wird auch als Umgebungsgleichung bezeichnet: P/A = σ (T4 – T04).“ Einer der Kommentatoren auf der EIKE-Blogseite beanstandete, dass die Formulierung als Umgebungsgleichung so nicht in der originalen Veröffentlichung von Boltzmann steht. Auch im nächsten Artikel, „Safety First“, spricht Herr Weber die Umgebungsgleichung an.

„Safety First: Zum besseren Verständnis meiner hemisphärischen Energiebilanz“ (von Ulrich O. Weber, veröffentlicht am 29. Juli 2019 durch EIKE)

Herr Weber entgegnet: „Offenbar konnten die geschätzten Kommentatoren mit der Umgebungsgleichung des Stefan-Boltzmann-Gesetzes in der Form ´P/A = * (T4-T04)´, die dieser Betrachtung zugrunde liegt, aber recht wenig anfangen,…“ Dem Leser des EIKE-Blogs, stellt sich die Frage: Ist die Kritik der Kommentatoren gerechtfertigt?

B. Ungerechtfertigte Kritik an Ulrich O. Weber

Hierzu verweise ich auf „Physik für Ingenieure“, ein seit 50 Jahren gültiges Standardwerk abertausender deutscher Maschinenbauer und Bauingenieure, Zitatanfang: „So ist die effektiv abgestrahlte Leistung eines „schwarzen“ Körpers ΔPs = σ A (T14 – T24) für einen „grauen“ Körper gilt ΔPs = ε σ A (T14 – T24)

Beispiel 7. Ein schwarzer Körper hat die Oberfläche A = 1 cm² und die Temperatur T1 = 373 K. Bei der Umgebungstemperatur ϑ = 20 °C strahlt er 6,76 10-2 W ab. Ist er jedoch nicht „schwarz“, sondern reflektiert er 20%, so kann er nur 80% absorbieren. Da sich das Absorptionsvermögen wie das Emissionsvermögen verhält, emittiert er – wenn er strahlt – auch nur 80% der Leistung, das ist 5,41 10-2 W.“ Zitatende, [Hervorhebungen verändert]

ΔPs = 5,41 10-2 W = σ A (T14 – T24) = 5,6704 10-8 Wm -2 K-4 1.0 10-4 m² 0.80 (3734 K4 – 293,154 K4)

Hieraus folgt: Das Emissionsvermögen kann nicht größer als das Absorptionsvermögen sein. Dies gilt explizit für Strahlung, sonst würde der 1. Hauptsatz der Thermodynamik verletzt werden. Die obige Darstellung gehorcht auch dem 2. HS, Wärme fließt immer (ohne äußere Einwirkung) von warm nach kalt. Diese Hauptsätze der Physik gelten selbstverständlich auch für ihre Unterdisziplinen wie Klimawissenschaft, Atmosphärenphysik, Meteorologie und Ozeanografie.

Um die Bedeutung „Umgebungsgleichung“ für den EIKE-Blogleser besser zu veranschaulichen, folgt ein Beispiel aus dem Alltag:

Ein ca. 2.5 m² großer Flur eines denkmalgeschützten Altbaus benötigt einen neuen Heizkörper. Für den Flur seien +18°C Raumtemperatur ausreichend, bei -10°C Außentemperatur. Dies führt zu einem dem Alter des Gebäudes angepassten Dimensionswert von 100 W/m² Raumfläche. Die notwendige Heizleistung für den Flur erfordert somit zu 250 W. Die Vorlauftemperatur der Gaszentralheizung beträgt am Einlassventil 70°C, die Rücklauftemperatur 55°C. Die mittlere Oberflächentemperatur der Heizfläche weist damit 62.5°C auf. Der hierzu gehörige Anpassungsfaktor von mittlerer Heizflächentemperatur und Raumlufttemperatur beträgt in dieser Kombination f >= 1,37. Die Mindestauslegung wird somit zu 1,37 x 250 W = 343 W bestimmt. Gewählt wird ein Plattenheizkörper Typ 22 der Länge 1 m, Bauhöhe 400 mm mit einer Norm- Wärmeleistung von 970 W/m. 388 W = 970 W/m x 0,4 m. Mit T1 = 62,5 °C = 335,65 K und T2 = 18°C = 291,15 folgt:

Ein 1. Thermometer misst auf der Mitte des Plattenheizkörpers T = 62,5 °C, das 2. Thermometer misst im Raum T = 18°C.

ΔPs / A = 312 W/m² = σ (T14 – T24) = 5.6704 10-8 Wm -2 K-4 (335.654 K4 – 291.154 K4)

Ludwig Eduard Boltzmann (1844 – 1906) hatte bei seiner wissenschaftlichen Veröffentlichung noch nicht die praktischen Anwendungen ΔPs = σ A (T14 – T24), siehe Physik für Ingenieure im Blick. Die Kritik an Herrn Ulrich O. Weber ist somit nicht gerechtfertigt.

Übertragen der Umgebungsgleichung auf die Erde:

a Ein erstes Thermometer sei in 2m Höhe ein zweites Thermometer befände sich in ca. 70km Höhe.

T1 = 15,2 °C = 288,35 K und T2 = -18,89 °C= 254,26 K

ΔPs / A = σ (T14 – T24) = 5,6704 10-8 Wm -2 K-4 (288.354 K4 – 254,264 K4) = 155,02 W/m²

b Ein erstes Thermometer sei in 70km Höhe ein zweites befände sich in ca. 200km Höhe

T1 = -18,89 °C= 254,26 K und T2 = -273,15 °C= 0 K

ΔPs / A = σ (T14 – T24) = 5.6704 10-8 Wm -2 K-4 (254.264 K4 – 0 K4) = 236.99 W/m² ~ -18.88 °C

c Ein erstes Thermometer sei in 2m Höhe ein zweites befände sich nun in ca. 200km Höhe

T1 = 15,2 °C = 288,35 K und T2 = -273,15 °C= 0 K

ΔPs / A = σ (T14 – T24) oder 5,6704 10-8 Wm -2 K-4 (288,354 K4 – 04 K4) = 392,01 W/m² ~ 15,20 °C

Oder 155,02 W/m² + 236,99 W/m² = 392,01 W/m²

Die Darstellung als Umgebungstemperatur – ich verwende jetzt bewusst die Formulierung von Herrn Ulrich O. Weber – zeigt die Wärmeleistung pro m² der Erde, hier 392,00 W/m² ~ 15,20°C fließt mit (288,354 K4 – 04 K4) von warm nach kalt und nicht umgekehrt. Lässt dies noch hypothetischen Raum für eine Gegenstrahlung in der Unterwissenschaft Atmosphärenphysik zu? Hotspots in der Atmosphäre als eigenständige Wärmequellen werden nicht gemessen, auch nicht mit Wetterballonen.

C. Strahlungsgleichgewicht

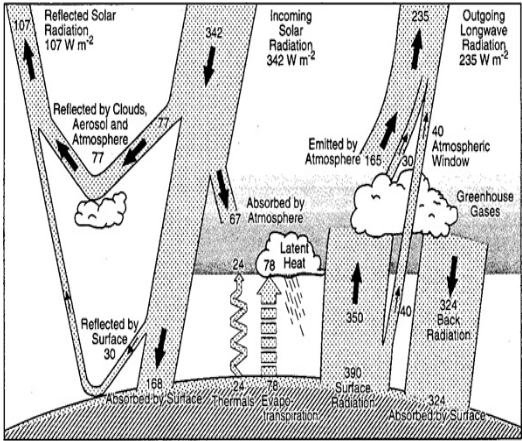

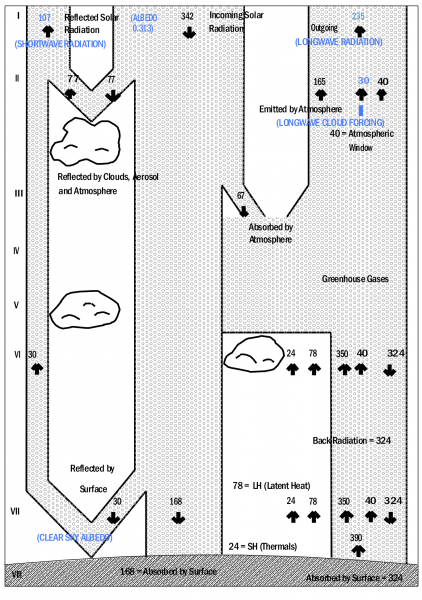

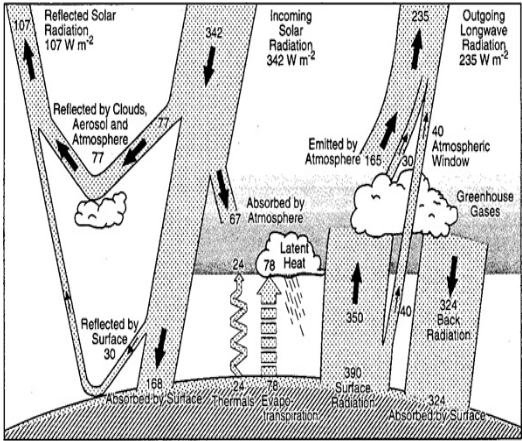

Die Hypothese der Gegenstrahlung (Back Radiation mit 324 W/m²) in der Strahlungsbilanz als Strahlungsgleichgewicht der Erde modellierten Kiehl und Trenberth 1997 in Earth´s Annual Global Mean Energy Budget. Die unten dargestellte FIG.7. wurde dreimal in IPCC Berichten, zuletzt 2007, an prominenter Stelle dargestellt. Ihr Gegenstrahlungsansatz ist die theoretische Basis der IPCC Klimamodelle. Im Modell mit Gegenstrahlung absorbieren IR-aktive Gase wie z. B. CO2. Diese würden im Anschluss bei ihrer Re-Emission eine Gegenstrahlung von 324 W/m² verursachen.

Bildnachweis: J. T. Kiehl and Kevin E. Trenberth, 1997, Earth´s Annual Global Mean Energy Budget, FIG.7. S.206 IPCC, Climate Change 2007, Cambridge University Press 2007 abgebildet auch in den IPCC Reporten 2007, 2001 und 1995

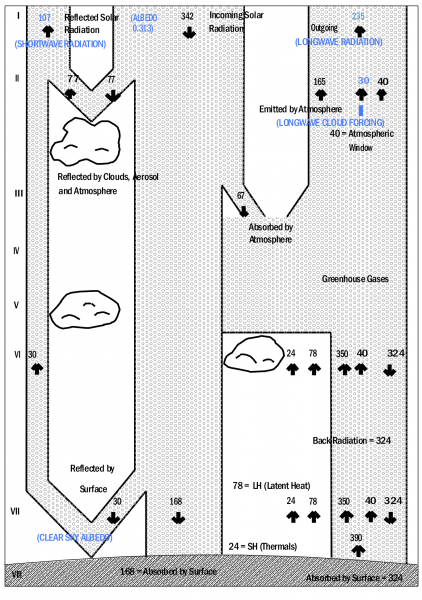

Bildnachweis:erstellt von A. Agerius, 2020

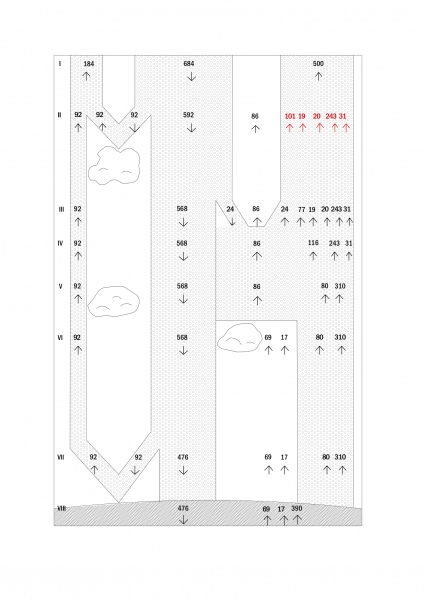

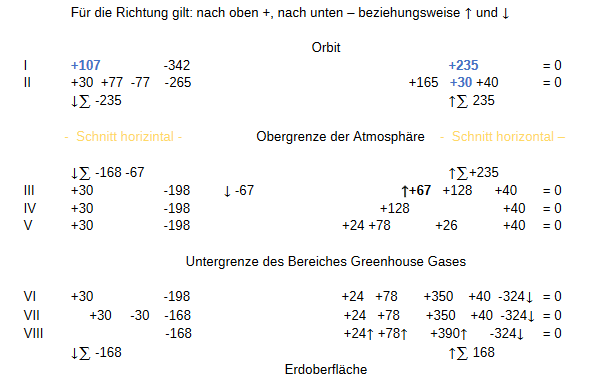

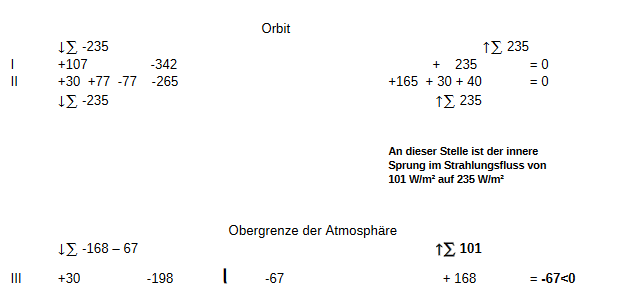

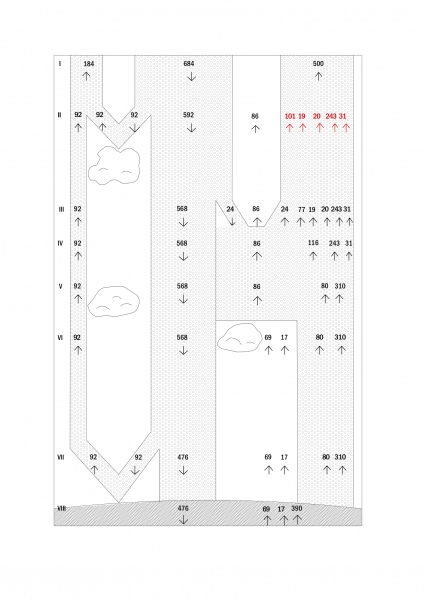

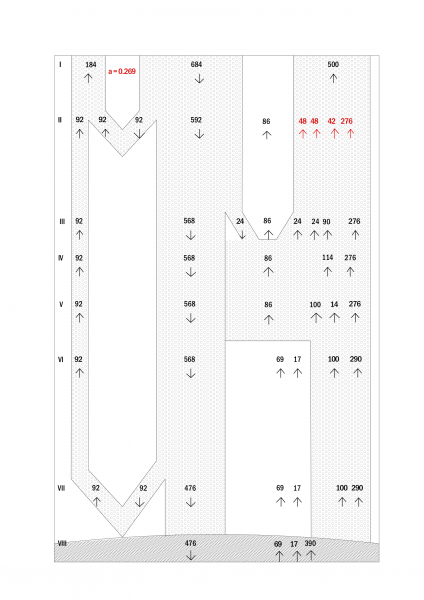

In der Darstellung oben sind römischen Zahlen eingetragen.Sie markieren horizontale Schnittebenen durch die Atmos-phäre. Ihre Strahlungsflüsse entsprechen dem Bild 1.

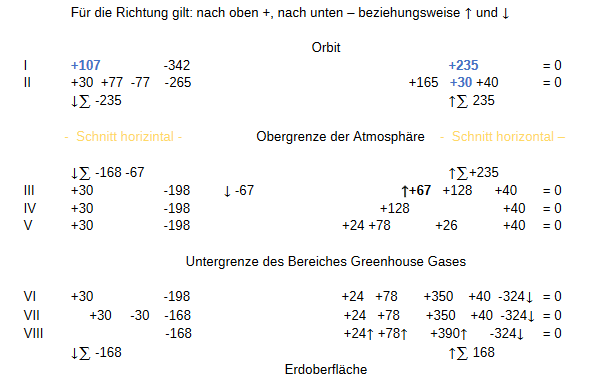

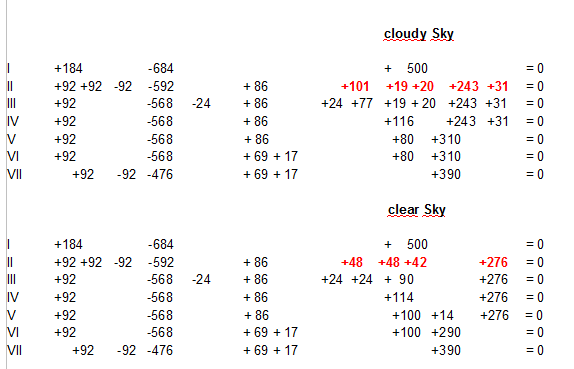

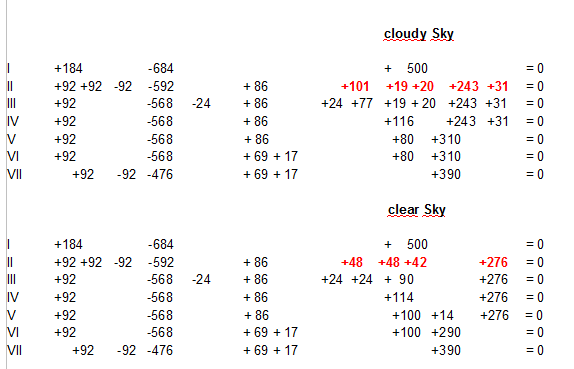

Kiehl und Trenberth verwenden Pfeile zur Darstellung von Strahlungsflüssen (W/m²). Diese Art der Darstellung erinnert an Kraftvektoren der technischen Mechanik. Wenn man diesen Gedanken zu Grunde legt, drängt es sich auf, das Schnittkraftprinzip anzuwenden. Ein unter Spannung – Kraft geteilt durch Fläche – stehendes Bauteil wird hierbei virtuell, wie mit einem Messer, durchtrennt. Alle an der Schnittfläche auftretenden Größen werden sichtbar und müssen Gleichgewichtsbedingungen gehorchen. Bei einem Bauteil wären dies Schub- Druck-, Zugkräfte, bzw. Biegespannungen, Momente, Torsion etc. In der diesem Textblock folgenden Anordnung von Zahlen in 8 Zahlenzeilen ist dies in Analogie zur Mechanik für den Strahlungsfluss aufbereitet. Auch hier muss sich ebenfalls ein horizontales und vertikales Gleichgewicht als Strahlungsgleichgewicht ausbilden.

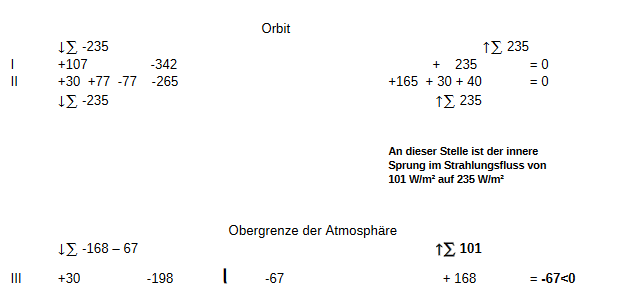

Zur besseren Veranschaulichung für FIG.7. werden 8 Ebenen (I bis VIII) eingeführt und die horizontale Betrachtung mit „= 0“ am Zeilenende berücksichtigt. Mit dem Minus Zeichen (-) zeigt der Strahlungspfeil (in der Analogie dem Kraftvektor vergleichbar) in Richtung Erde, mit Plus Zeichen (+) in Richtung Orbit, vertikales Gleichgewicht. Die Zahlenwerte in W/m² sind aus FIG.7. KT97 entnommen: Zwischen Ebene II und III wurde virtuell nach dem Schnittkraftprinzip (gelb markiert) durchgeschnitten und die Strahlungsflüsse anschließend angetragen. Hierbei wird sichtbar, dass bei Kiehl und Trenberth in FIG.7. ↑+67 in der zeichnerischen Darstellung fehlen. Ohne ↑+67 gibt es einen Sprung im Strahlungsfluss.

Blau, Vergleich mit Satellitenmesswerten, zuzüglich 2 Albedos a = 0,3129 bzw. 0.088

Erläuterung: Zeile I bis III ohne „gleichzeitig“ ↑+67 bildet sich vertikal ein Sprung im Strahlungsfluss aus. Die Energiebilanz von Kiehl und Trenberth kann somit das Gleichgewichtskriterium „∑ H = 0“ in Zeile III nicht erfüllen. Dies verlangt aber eine Bilanz. Bsp. Geschäftsbilanz: Einer Ausbuchung -67.000 Euro in Unterkonto A „Verkauf“ ist „gleichzeitig“ eine Einbuchung von +67.000 Euro in Unterkonto B „Umsatz“ zugeordnet.

Zeile IV bis VIII wie zuvor.

Kiehl und Trenberth berufen sich auf Satellitenmessungen: „The ERBE [Earth Radiation Budget Experiment] (see Ramanathan et al. 1989) provided nearly 5 yr of continuous data from the mid.1980s.

The global annual mean of these data (Kiehl et al. 1994) indicate that the outgoing longwave radiation is 235 Wm-2 ,…” [Ergänzungen vom Autor hinzugefügt] Hinter „see Ramanathan et al. 1989” steht u.a. Bruce Barkstorm. Er war der Chefingenieur beim Bau der ERBS Satelliten (Teil des ERBE Programms der NASA). Um ein Modell zu entwickeln, das seine eigenen Satelliten Messwerte erklärte, zeichnete Barkstorm die Strahlungsflüsse in seiner eigenen Darstellung als Pfeile. Er formulierte damit als Erster die Hypothese der Gegenstrahlung in Verbindung mit Satellitendaten. Kiehl und Trenberth übernahmen sein Prinzip -Strahlungen wie Kraftvektoren darzustellen – und verfeinerten nur sein Modell.

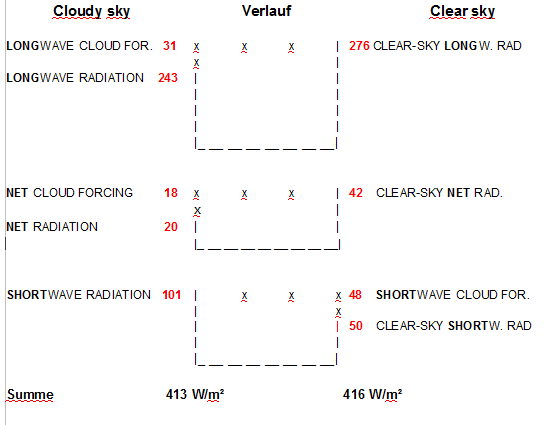

In FIG.7. KT97 weisen die obigen 5 Werte einen direkten Bezug zu den ERBS Messwerten auf und haben folgende Bedeutung:

Reflected Solar Radiation, ins Orbit zurück geworfene Strahlung, kurzwellige Strahlung 107 W/m²

Outgoing Longwave Radiation, von der Atmosphäre abgestrahlte langwellige Strahlung 235 W/m²

Longwave cloud forcing, langwellige Strahlung beim Vorhandensein von Bewölkung 30 W/m²

Albedo, Anteil der ins Orbit reflektierten Strahlung, 107 W/m² / (107 W/m² + 235 W/m²) 0.3129

Clear Sky Albedo, der Bodenanteil der Albedo 30 W/m² / 342 W/m² 0.0877

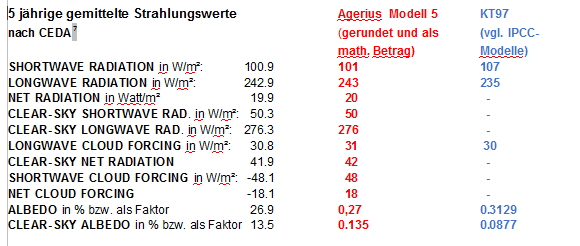

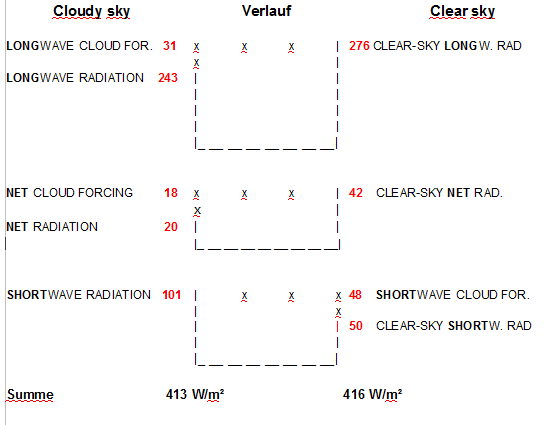

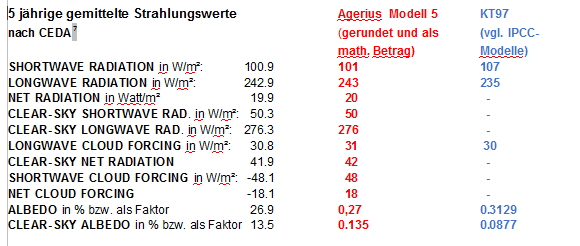

Satellitenmesswerte des ERBS Satelliten in einem Modellvergleich:

KT97 schafft es 5 von 11 Messreihen im Modell KT97 abzubilden. Bezüglich longwave radiation tritt eine Differenz von rund 8 W/m² (242.9 – 235) auf. Das cloud forcing von 30.8 W/m² ist zwar mit 31 W/m² gut modelliert, aber in den 235 W/m² nach FIG.7. enthalten. „The longwave cloud forcing, clear minus cloudy sky flux, is 30 W/m-2, which agrees closley with the annual mean ERBE value, as it should because both clear and cloudy sky top-of atmosphere fluxes are tuned to the ERBE data.” Die von Satelliten gemessene CLEAR-SKY LONGWAVE RADIATION von 276.3 W/m² kann in FIG.7. nicht dargestellt werden. Im Modell fehlen so 41.3 W/m² (276.3-235). Lange Zeit waren die oben aufgelisteten Messwerte einer breiten Öffentlichkeit nicht zugänglich. Bei 15°C als globale Durchschnitts Temperatur macht eine Strahlungsdifferenz von 5 W/m² zwischen Messwert und Modellwert fast 1C° aus (Pariser Klimaakkord?). Beim Betrachten von roter und blauer Spalte drängen sich damit zwei Fragen auf:

- Kann man ein Modell entwickeln, das alle Messwerte abbildet?

- Kann ein solches Modell eine möglichst geringe Abweichung zwischen Messwert und Modellwert aufweisen und welche Aussagen lässt ein solches Modell dann zu?

An dieser Stelle möchte ich überleiten zu D. Mittelwertbildung, denn man kann ein anderes Modell entwickeln und dazu spielt der Faktor 2 eine entscheidende Rolle.

D. Mittelwertbildung

„Nachdem sich der Rauch verzogen hat: Stefan-Boltzmann auf den Punkt gebracht“ (von Ulrich O. Weber, veröffentlicht am 16. Februar 2017 durch EIKE)

Herr Weber formuliert hierin: „Die alternative Herleitung berechnet sich mit dem Strahlungsgleichgewicht des S-B Gesetzes für eine Halbkugelbetrachtung in einem Zweischichtfall für Atmosphäre und Erdoberfläche: (Solarkonstante/2) => netto 390 W/m² => +14,8°Celsius.“ Mit der Solarkonstante von 1368 W/m² /2 = 684 W/m² schreibt Herr Weber in einer anderen Schrift:

684 [W/m²] – 214 [W/m²] – 80 [W/m²] = 390 [W/m²]

Hierin sind 80 W/m² 2 mal 40 W/m² des atmosphärischen Fensters von KT97 und 214 W/m² 2 mal 107 W/m² reflektierter Strahlungsanteil durch eine Albedo von 0.3129 verglichen mit KT97.

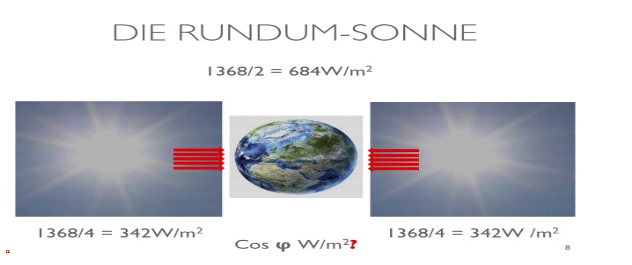

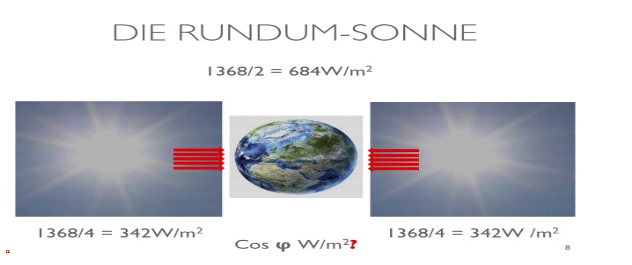

Herr Limburg, der Vizepräsident von EIKE, 2019 auf der 13. EIKE im Vortrag „Was Sie schon immer über den Treibhauseffekt wissen wollten…“ Zum Modell mit 1368 W/m²/ 2 Einstrahlung: „Ohne jetzt den Breitengrad […] mit zu berücksichtigen, kann man ganz grob annehmen, dass auf die Halbkugel rund 684 W/m², also die Hälfte, pro m² fällt. Das würde die ganz erste Näherung sein, für jeden, der sich mit der Frage beschäftigt, stellt sich die Frage: wo kommt denn die Energie her? Die Treibhausforscher, die dem IPCC zuarbeiten, sehen das aber ganz anders. Die erfinden plötzlich eine Rundumsonne. Plötzlich ist die Sonne von beiden Seiten da und bestrahlt beide Seiten gleichmäßig. Zwar nicht mit der vollen Leistung, sie wird gedimmt. Die 684 W/m² werden nochmal halbiert. Das geht dann auf die Kugeloberfläche. Wir haben statt 684 W/m² plötzlich von beiden Seiten, jeweils auf die Halbkugel bezogen, gleich große 342 W/m². Das ist zumindest eine Überlegung, die man an anstellen kann.“

Bildnachweis: EIKE

Die Satellitenmesswerte des ERBS Satelliten könnte man mit einem Halbkugelmodell in Beziehung setzen. Der Satellit ERBS hatte 15-Umläufe um die Erde am Tag. Die ERBS-Messwerte der Scanner, die auf die Erde gerichtet sind, sind aus einer Mittelwertbildung entstanden, einer Mittelung aus Tag- und Nachtmessung.

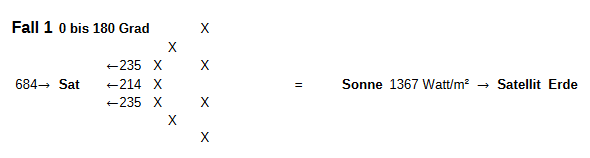

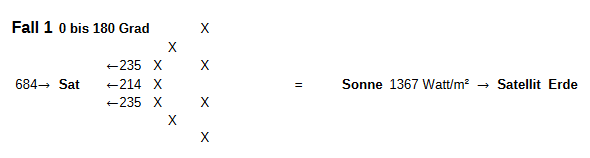

Die Erdkugel als beleuchtete Halbkugel grafisch im Augenblick der Einstrahlung 0 bis 180 Grad und 180 bis 360 Grad so dargestellt:

X

X X

X

Der Standort des Satelliten ist von der solaren Einstrahlung auf die Erde unabhängig.

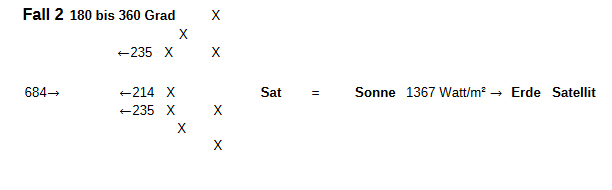

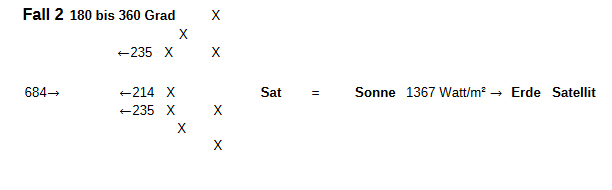

Fall 1: 0 bis 180 Grad:

15 Mal in 24 h für ERBS ist die halbe Erdkugel beleuchtet

+

Fall 2: 180 bis 360 Grad:

15 Mal in 24 h für ERBE ist eine halbe Erdkugel unbeleuchtet, aber in dieser Zeit strahlt die Sonne auf die beleuchtete Seite. Um auf die Satellitenwerte verweisen zu können, muss der Standpunkt der Messung berücksichtigt werden, die Perspektive des Satelliten während des Messvorganges. Steht der Satellit im Erdschatten, ist die TSI = 0 W/m². ISRModel = Incoming Solar Radiation auf Modellebene:

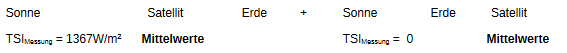

In der Messung:

Daraus folgt:

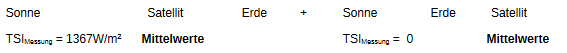

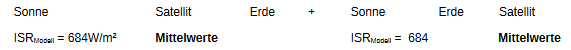

In der Perspektive des Satelliten: TSI im Mittel = (1368 W/m² + 0) / 2 = 684 W/m²

Übertragen auf ein Modell, das auf Mittelwerten beruht:

Der Faktor 2 lässt sich deshalb auch aus der Mittelwertbildung ableiten.

Werden Satellitenmesswerte als Strahlungsbeträge wie folgt umgruppiert, weisen sie eine horizontale und vertikale Gleichgewichtsbeziehung bzw. einzelne Symmetrieachsen auf. Dies gilt bis in den einzelnen ermittelten Datensatz und ist dem 1. HS der Thermodynamik, der Energieerhaltung, geschuldet.

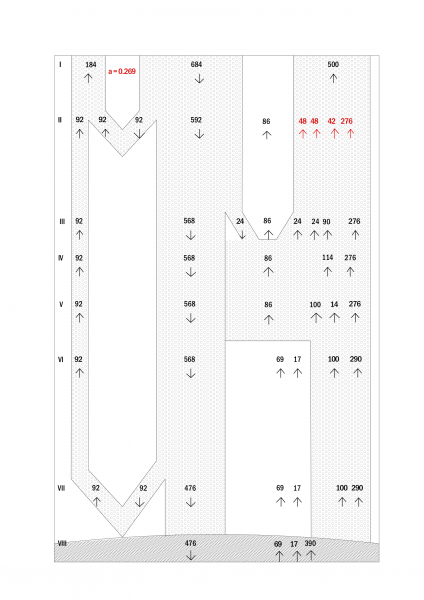

(Mit clear sky albedo = 0.1345 = 92 W/m² /684 W/m² und a = 0.269 = 184 W/m² / 684 W/m²)

Modell 5: rot Abgleich mit Satellitenmesswerten, albedo a = 0.2690, bzw. 0.1345

Bildnachweis, A. Agerius FIG8 b Modell 5 clear sky11

Wenn die Strahlungsbilanz als Modell aus der Perspektive des Satelliten gerechnet wird, dann erscheinen alle vom ERBS Satelliten gemessenen 11 Datenreihen als Mittelwerte der 5- jährigen Messung gleichzeitig.

Grafische Darstellung der Strahlungsbilanz mit Satellitenmesswerten des Satelliten ERBS im 5- jährigen Mittel nach CEDA als Gegenmodell zu KT97, getrennt nach cloudy sky FIG8a und clear sky FIG8b:

Bezüglich shortwave cloud forcing gelingt die Trennung nicht ganz. Der Abweichung beträgt 11.5% (11.5% = 48/416 x100). Dies wird in Kauf genommen. Die gesamte Modellabweichung macht nur weniger als fünf Tausendstel der „top of“ gemessenen Gesamtstrahlung aus (4.8 = 2.0 W/m² /414.5 x 1000) oder ist damit < = 2 Watt/m² zum Messwert. Ich nenne es Modell 5. In KT97 werden die Messwerte, auf die sich Kiehl und Trenberth berufen, unzureichend abgebildet. Darüber hinaus gibt es zusätzliche Kritikpunkte an KT97, die in diesem kleinen Artikel nicht angesprochen werden können. Die exakte Ableitung von Modell 5, Werte für Konvektion, Wärmeleitung, atmosphärisches Fenster, weitere 14 Kritikpunkte an KT97, ein Vergleich mit Messwerten der Satelliten TERRA und AQUA des NASA CERES Programms siehe Quellenangabe.

Zusammenfassung:

Der Strahlungs- und der Temperaturverlauf von der Erdoberfläche in Richtung Orbit entsprechen der Umgebungsgleichung siehe Abschnitt B. Die Formulierung einer Umgebungsgleichung P/A = σ (T4 – T04) aus dem Boltzmann Gesetz von Herrn Weber ist daher richtig. Die Umgebungsgleichung bildet ab, dass Wärme von warm nach kalt fließt, gemäß den Regeln der Thermodynamik. Das Modell von Kiehl und Trenberth, Abschnitt C, zeigt die Erde in der treffenden Beschreibung von Herrn Limburg als „eine Rundum-Sonne [allseitige Einstrahlung] bei gedimmter Einstrahlleistung“. KT97 beruft sich einerseits auf Satellitenmesswerte, kann aber andererseits nur sehr wenige davon abbilden und diese zeigen dann eine große Abweichung zwischen Modell und Messwertmittel.

Die durchschnittliche Oberflächentemperatur der Erde von ca. 15°C kann in KT97 nur mit der Modellhypothese von hoher Gegenstrahlung (324 W/m²) erklärt werden. Aber auch langwellige Strahlungsaussendung gemäß Stefan-Boltzmann benötigt eine Ursprungs-Temperatur als Ursache. In KT97 würde aber Wärme von kalt nach warm fließen. Weber`s Ansatz, Abschnitt A, betrachtet die Einstrahlung auf eine Halbkugel, aber die Abstrahlung von der Gesamtkugel aus der Perspektive der Kugeloberfläche. Dies führt ebenfalls zu einer Durchschnittstemperatur von 15°C, aber die Einführung der Idee einer Gegenstrahlung ist hierzu nicht erforderlich.

Der Ansatz Agerius (Modell 5), Abschnitt D, wurde aus der Perspektive des Satelliten entwickelt. Die Sonneneinstrahlung auf der Halbkugel reicht aus, um die Erde mit einer Durchschnittstemperatur von ca.15°C zu erwärmen. Die Abstrahlung erfolgt auch hier über die Oberfläche der Gesamtkugel. Alle Satellitenmesswerte lassen sich im Modell Agerius dann ebenfalls darstellen und dies mit einer Abweichung von <= 2 W/m² zwischen Modell und Messwertmittel. Beide Strahlungsverläufe clear und cloudy sky, Abschnitt D, benötigen keine Gegenstrahlung von 324 W/m² und schließen sie damit aus. Mit 714 W/m² (390 + 324) würde die Erde zu heiß werden. Mit den voneinander unabhängigen Modellen, Weber und Agerius, aus unterschiedlichen Perspektiven bzw. Bezugspunkten entwickelt, ist eine Gegenstrahlungshypothese und damit auch ein natürlicher Treibhauseffekt von 33 K für die Erklärung und Herleitung der realen Temperaturwerte nicht erforderlich.