Einsetzendes Grand Solar Minimum

Die Sonnenaktivität ist die treibende Kraft des Erdklimas. Diese Definition des Offensichtlichen wird nur von denjenigen bestritten, die falsch informiert sind, und von denen, die ein finanzielles oder politisches Motiv haben.

Eine hohe Sonnenaktivität – wie wir sie seit etwa 100 Jahren genießen – hat unserem Planeten ein stabiles, berechenbares Klima beschert, unter dem wir modernen Menschen die Möglichkeit hatten, zu gedeihen und unsere technologische Gesellschaft erfolgreich voranzubringen.

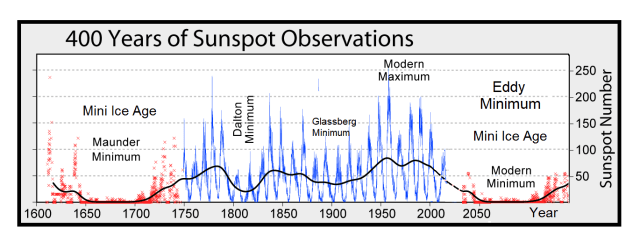

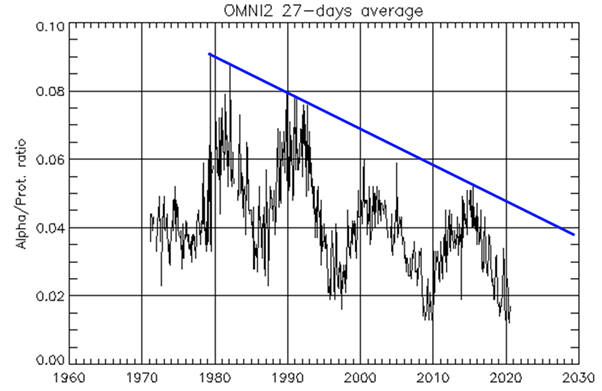

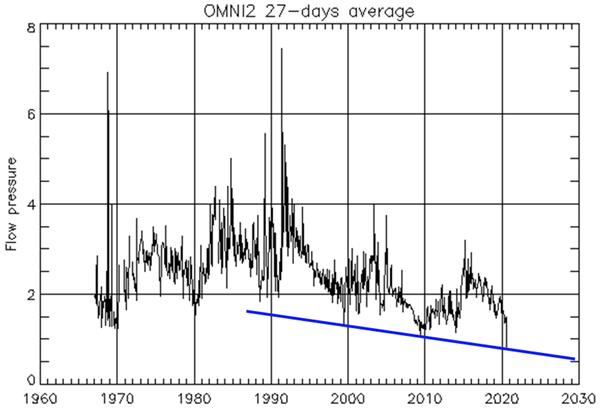

Doch wie bei allen guten Dingen gehen auch diese vorhersehbaren Tage zu Ende: Die Leistung der Sonne geht auf ein Niveau zurück, das seit 200 Jahren nicht mehr beobachtet wurde, auf einen Rückgang der Aktivität, wie es sie seit dem Dalton-Minimum (1790-1830) nicht mehr gegeben hat. Und wie bei jeder großen und fortschreitenden Zivilisation der Vergangenheit kommt eine Zeit, in der die Folgen eines Sonnenminimums bekämpft werden müssen. Wir müssen uns auf die wilden Ausschläge zwischen den Extremen vorbereiten, die durch einen zunehmend schwachen und welligen (meridionalen) Strahlstrom verursacht werden, wir müssen uns eines starken vulkanischen Aufschwungs bewusst sein, der in Zeiten geringer Sonnenaktivität zu beobachten ist, sowie der Wolken verursachenden kosmischen Strahlung und, vielleicht am wichtigsten, einer allgemeinen Abkühlung des Planeten.

Ernteerträge sind immer das Erste, was einbricht. Und unsere modernen, zart ausbalancierten, chemisch abhängigen Monokulturen sind auf eine gewaltsame Klimaveränderung einfach nicht vorbereitet – wie Robert Felix schon lange warnt: „Ich fürchte, dass wir auf den Straßen um Nahrung kämpfen werden, lange bevor wir von Eis bedeckt sind“.

Heute kommt die Nachricht, dass Großbritannien soeben die schlechteste Weizenernte der letzten 40 Jahre erlitten hat, was Befürchtungen über höhere Preise für Mehl und in der Folge für Brot und andere Produkte auf Mehlbasis hervorruft.

Die Wachstumsbedingungen dieser Saison waren typisch für die Schwankungen zwischen den Extremwerten, die wir bei einem Grand Solar Minimum erwarten würden. Großbritanniens Landwirte haben sich gerade durch den nassesten Herbst seit dem Jahr 2000 gekämpft, in dem nur 60 % dessen, was gepflanzt werden konnte, tatsächlich in den Boden gelangten, dann kam der nasseste Februar seit Aufzeichnung, gefolgt vom sonnigsten Frühling und trockensten Mai seit Aufzeichnung und dann, zur Sicherheit, der kälteste Juli seit 1988.

„Gott hat meine Ernte gebraten, gefroren, ertränkt und dann wieder ertränkt“, klagte Jeremy Clarkson über die schlechten Wetterbedingungen auf seiner Farm im Westen von Oxfordshire.

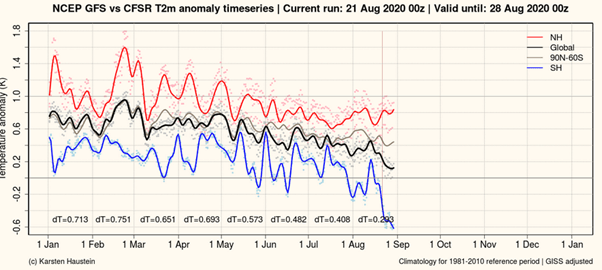

Und während die Tagesordnung des Tages die Schuld für diese Schwankungen fest auf den Menschen und seine folgenlosen CO2-Ausstöße schiebt, kann nur ein Dummkopf diese Theorie nach ein klein wenig Nachforschungen aufrechterhalten. Und obwohl ich akzeptiere, dass nicht alle davon überzeugt sind, dass der Zeitraum, auf den wir zusteuern, dem Maunder-Minimum entsprechen wird, sind die Wetterextreme und die allgemeine Abkühlung des Planeten höchstwahrscheinlich mit dem reduzierten Ausstoß der Sonne verbunden.

Der Sommer 2020 war in ganz Europa ein kurzer Sommer.

Wie bereits erwähnt, war der Juli dieses Jahres der kälteste Juli in Großbritannien seit 1988, und während die Wetteruhr Anfang August auf Hitzeausbrüche umschaltete, war diese Wärme nur allzu kurz, und jetzt kommt nach den neuesten Prognosen der Herbst in Westeuropa, noch bevor der August vorüber ist: ein heftiger Knick im Jetstream ist dabei, die Luft arktischen Ursprungs anomal weit nach Süden abzulenken:

Temperatur-Anomalien in 2 m Höhe vom 30 August (nach GFS; tropicaltidbits.com)

Nach Angaben des Met Office kann diese Luftmasse das Potential, seltene Sommerfröste zu liefern. Und während in der zweiten Hälfte der nächsten Woche mit einer Wiedererwärmung (zurück zu den Durchschnittstemperaturen) gerechnet wird, dürfte im weiteren Verlauf des Septembers (der zwar immer noch in dem unzuverlässigen Zeitrahmen liegt, aber es lohnt sich, ihn im Auge zu behalten) eine weitere polare Kältewelle die Führung übernehmen:

Temperatur-Anomalien in 2 m Höhe vom 11. September (nach GFS; tropicaltidbits.com).

Schaut man sich anderswo in der Welt um, dürfte es auch in Nordamerika verbreitet zu Temperaturwerten deutlich unter den Mittelwerten kommen, sogar mit Schneefall auf einigen Bergen:

Temperatur-Anomalien in 2 m Höhe vom 31. August (nach GFS; tropicaltidbits.com).

Es scheint sich ab dem 6. September etwas Historisches abzuzeichnen:

Temperatur-Anomalien in 2 m Höhe vom 6. bis zum 11. September (nach GFS; tropicaltidbits.com)

[Es handelt sich um eine animierte Graphik. Falls die Darstellung derselben hier nicht läuft, bitte im Original schauen. Anm. d. Übers.]

Fallen Sie nicht auf gefälschte, Wärmeangst erzeugende politische Agenden herein.

Die KALTEN ZEITEN kehren zurück, die mittleren Breiten frieren wieder ein; im Einklang mit der historisch niedrigen Sonnenaktivität, Kondensationskerne bildenden kosmischen Strahlen und einem meridionalen Strahlstrom.

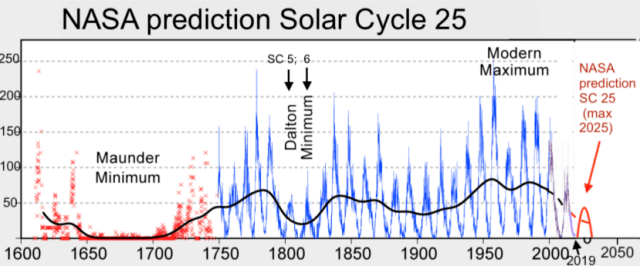

Sogar die NASA scheint zuzustmmen, wenn man zwischen den Zeilen liest, dass ihre Prognose für diesen bevorstehenden Sonnenzyklus (25) ihn als „den schwächsten der letzten 200 Jahre“ ansieht, wobei die Agentur hier frühere Sonnenabschaltungen mit längeren Perioden globaler Abkühlung in Beziehung setzt.

Bereiten Sie sich auf die KÄLTE vor – lernen Sie die Fakten kennen, denken Sie um, wenn nötig, und bilden Sie sich eine eigene Meinung.

Social Media-Kanäle schränken die Reichweite von Electroverse ein – Twitter sortiert Follower aus, und Facebook kennzeichnet Beiträge als „falsch“. Melden Sie sich unbedingt an, um Benachrichtigungen über neue Beiträge per E-Mail zu erhalten (das Feld befindet sich in der Seitenleiste >>> oder scrollen Sie nach unten, wenn Sie ein Mobiltelefon benutzen).

Und/oder werden Sie Patron, indem Sie hier klicken: www.patreon.com/join/electroverse, und/oder ziehen Sie in Betracht, „Werbung zu erlauben“ für www.electroverse.net, wenn Sie einen Blocker benutzen.

Die Website erhält eine NULL-Finanzierung und hat noch nie eine erhalten. Helfen Sie uns also auf jede erdenkliche Weise, die Botschaft zu verbreiten, damit andere überleben und in der kommenden Zeit gedeihen können.

[An was erinnert einen das? Anm. d. Übers.]

Grand Solar Minimum + Pole Shift

Link: https://electroverse.net/grand-solar-minimum-incoming/

Übersetzt von Chris Frey EIKE