Windenergie-Skandal in UK

Großbritannien von einem Windpark-Skandal erschüttert, der die Verbraucher mit 1,4 Milliarden Pfund zu stehen kommen wird

Sam Greenhill

Eine Windparkfarce, die 1,4 Milliarden Pfund IHRES Geldes vernichtete! Während Boris Johnson seine Vision propagiert, jedes Haus mit Turbinen zu versorgen, enthüllen wir den verpfuschten Plan, der die Rechnungen für 20 JAHRE aufblähen wird.

● Boris Johnson hat erklärt, dass die Windkraft die Zukunft der britischen Energie ist

● Aber eine Untersuchung hat ergeben, dass die Turbinenbesitzer über die Maßen bezahlt werden

● Beamte setzen Subventionssatz so hoch an, dass er als „Lizenz zum Gelddrucken“ gebrandmarkt wurde

Ein verpfuschtes grünes Programm zahlt den Besitzern von Windturbinen das Siebenfache des Wertes des von ihnen erzeugten Stroms – und es wird die britischen Verbraucher schätzungsweise 1,4 Milliarden Pfund kosten.

Ein Subventionssatz für Windturbinenbesitzer könnte dazu führen, dass sie bis zu sieben Mal mehr als die von ihnen produzierte Strommenge einstecken, was als „Lizenz zum Gelddrucken“ bezeichnet wird.

Die Daily Mail kann das Augenfälligkeitsfiasko der Woche enthüllen. Boris Johnson erklärte, dass die Windkraft die Zukunft für die Energieerzeugung der Nation sei. Das Programm wurde ins Leben gerufen, um Hausbesitzer zu ermutigen, eine kleine Windmühle zu installieren, um ihren Bedarf zu decken und in das Stromnetz einzuspeisen.

Den Eigentümern wird für 20 Jahre eine Goldgrube an Bargeld garantiert, und das System ist so lukrativ, dass es einen Goldrausch unter den Investoren, darunter führende Pensionsfonds, ausgelöst hat.

Die Farce dieser grünen Initiative wurde in Nordirland ins Leben gerufen, aber die atemberaubenden Kosten werden dank höherer „grüner Abgaben“ auf die Rechnungen von privaten und geschäftlichen Versorgungsunternehmen in jeder Ecke des Vereinigten Königreichs zu spüren sein. Sie stellt die 500 Millionen Pfund in den Schatten, die durch einen früheren verpfuschten Skandal um grüne Energie in der Provinz verschwendet wurden, der als „Cash for Ash“ [etwa: Geld für Asche] bezeichnet wird und vor drei Jahren zum Sturz der Regierung Stormont führte.

Eine Untersuchung der Mail hat ergeben:

* Eine Turbine erntet etwa 375.000 Pfund pro Jahr, produziert jedoch Strom im Wert von nur 51.000 Pfund;

* Die Subvention ist nur in Ulster verfügbar, erhöht aber die Energierechnungen in ganz Großbritannien um 71 Millionen Pfund pro Jahr;

* Da die Subvention für 20 Jahre garantiert ist, werden sich die Gesamtkosten für die britischen Verbraucher auf schätzungsweise 1,4 Milliarden Pfund belaufen;

* Unfähige Beamte versuchten, das Programm 2016 zu schließen – aber Schlupflöcher ließen es bis März 2019 laufen;

* In einem Ansturm auf die Errichtung von Turbinen vor der Frist wurden Hunderte errichtet, viele davon im Besitz von Risikokapitalgebern und sogar des Pensionsfonds der Royal Bank of Scotland.

Am Dienstag gab der Premierminister das dramatische Versprechen ab, bis 2030 jedes Haus mit Windstrom zu versorgen. Mr. Johnson sagte der Konferenz der Konservativen, er werde mit „Sturmangriffsgeschwindigkeit“ arbeiten, um seine „grüne industrielle Revolution“ einzuleiten.

Aber die Untersuchung der Mail deckt auf, wie ein bestehendes Windprogramm den Verbrauchern enorme Kosten aufbürdet. Es sollte Landbesitzern Anreize für die Errichtung kleiner Windturbinen bieten. Sie würden Gebühren für „sauberen“ Strom erhalten, der in das Stromnetz eingespeist würde. Sogar David Cameron errichtete eine in seinem Garten.

Die Minister nannten es eine „Belohnung für saubere Energie“. Um sie zu finanzieren, führten sie eine „grüne Abgabe“ ein. Diese so genannte „Erneuerbare-Energien-Pflichtabgabe“ erhöht die Stromrechnung eines typischen Haushalts um etwa 73 Pfund pro Jahr. Nach 2009 wurden diese Anreize als zu großzügig eingestuft und in England, Wales und Schottland drastisch gekürzt.

Doch nordirische Beamte hielten den Zinssatz unerklärlicherweise in dieser Höhe stabil – was bei wohlhabenden Investoren einen Ansturm auf die Installation klappriger Turbinen auslöste und ihnen praktisch risikofreie Einkommen bescherte. Gestern Abend sagte der Ökoenergie-Experte Dr. John Constable: „Jemand hat einen Fehler gemacht: so einfach ist das. Kluge Geschäftsleute sehen diese Fehler. Es gab einen totalen Ansturm. Einige Leute müssen sagenhaft reich geworden sein. Ich sah mir die Rede des Premierministers an und dachte: Geht das schon wieder los“.

Die Daten, auf denen die Berechnungen basieren, sind auf der Website der Energiebehörde Ofcom verfügbar. Auf einer trostlosen Bergkuppe südlich von Londonderry fand unsere Zeitung, dass die Windkraftanlage wahrscheinlich die größte ihrer Art in Großbritannien ist. Unter dem Namen „SP2045“ drehten sich ihre Flügel in der lebhaften Brise von Ulster im vergangenen Jahr genug, um Strom für etwa 51.000 Pfund zu erzeugen.

Aber diese spezielle Maschine ist weitere 324.000 Pfund mehr an grünen Subventionen wert. Insgesamt brachte SP2045 im Jahr 2019 £375.000 ein – mehr als das Siebenfache des Marktwertes des tatsächlich erzeugten Stroms.

Öffentliche Unterlagen zeigen, dass SP2045 einer Firma namens Simple Power No1 Ltd. gehört. Anhand von Akten des Unternehmens konnten wir es bis zum Pensionsfonds der Royal Bank of Scotland zurückverfolgen. Tatsächlich gibt es in den sanften Hügeln Nordirlands Hunderte von gebrauchten Turbinen, die sich im Besitz von Blue-Chip-Firmen befinden.

Die städtischen Finanzies, so scheint es, haben das Potenzial für üppige Renditen erkannt – und das vor allem, nachdem die Beamten den Subventionssatz für kleine Windparks auf einen verblüffend großzügigen Satz festgelegt hatten. Aus fadenscheinigen Gründen haben die Besitzer kleiner Windturbinen – definiert als solche mit einer Spitzenleistung von 250 Kilowatt – in Nordirland Anspruch auf eine Zahlung im Wert von etwa 220 Pfund für jedes Megawatt Strom, das sie pro Stunde erzeugen.

In anderen Teilen Großbritanniens ändert sich die Zahl jedes Jahr, im letzten Jahr betrug sie jedoch 16 Pfund. Und das zusätzlich zum Verkauf des tatsächlichen Stroms zum Marktpreis. Der Großhandelspreis für Strom schwankt, lag aber im vergangenen Jahr im Durchschnitt bei etwa 35 Pfund pro Megawattstunde. Der Eigentümer erhält also £35 für den Strom plus £220 an Subventionen, insgesamt £255 – mehr als das Siebenfache des Marktwertes des Stroms selbst.

Gleiches gilt nicht für Windmühlenbesitzer an anderen Orten im Vereinigten Königreich. Es gilt auch nicht für größere Turbinen.

Da die Subvention für 20 Jahre garantiert ist, werden sich die Gesamtkosten für die britischen Verbraucher auf schätzungsweise 1,4 Milliarden Pfund belaufen.

Dr. Constable, Direktor der Stiftung für Erneuerbare Energien dazu:

„Der Fehler im öffentlichen Dienst führte zu einer Lizenz zum Gelddrucken. Diese kleinen 250kW-Turbinen sind seit Jahren veraltet, und niemand hätte sie damals gebaut, es sei denn als loophole Cash Cow [?] Sie rufe schrecklich hohe Subventionen ab, sind aber eine absolute Goldgrube für Investoren.

Der ganze Beitrag steht hier.

——————————

Neuer Windpark-Skandal dreimal schlimmer als „ Cash for Ash“

Daily Mail

Die Enthüllungen der Mail werfen beunruhigende Fragen für Premierministerin Arlene Foster auf, die zu der Zeit, als 2009 der Goldgruben-Subventionssatz festgelegt wurde, Energieministerin der nordirischen Regierung war.

Mrs. Foster hatte auch den Vorsitz im ähnlichen „Cash for Ash“-Skandal, der ihre Regierung 2017 zu Fall brachte.

2017: Ein Grüne-Energie-Skandal bringt die Regierung von Nordirland zu Fall (hier)

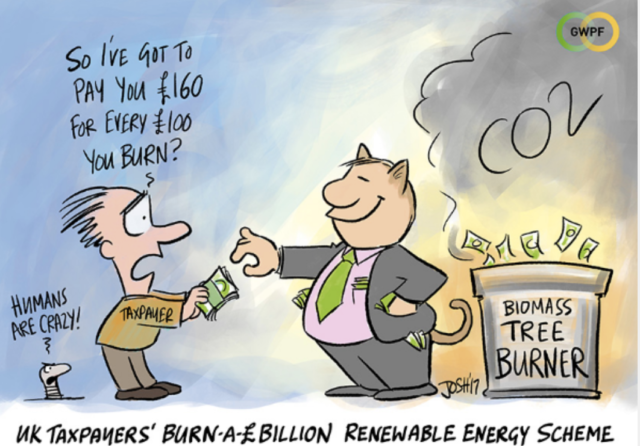

Dieses fehlerhafte grüne System, bezeichnet als Renewable Heat Incentive [etwa: Erneuerbare-Wärme-Anreiz], zahlte den Kunden mehr für die Nutzung erneuerbarer Energie als die tatsächlichen Kosten des Brennstoffs. Einige Familien ließen ihre Heizkessel rund um die Uhr laufen, und unverantwortliche Bauern heizten leere Scheunen. Für jedes Pfund, den sie für die Heizung ausgaben, erhielten sie 1,60 Pfund an Subventionen zurück.

Eine vernichtende öffentliche Untersuchung kam Anfang des Jahres zu dem Ergebnis, dass das Schema niemals hätte angenommen werden dürfen. Der Vorsitzende Sir Patrick Coghlin äußerte sich kritisch über die Erste Ministerin, führte aber zu ihrer Entlastung an, dass sie von ihren Beamten falsche Informationen erhalten habe. Er warnte auch davor, dass sich eine solch katastrophale Situation wiederholen könnte, indem er sagte: „Es gibt keine Garantie dafür, dass die bei der Untersuchung aufgedeckten Schwächen in der Regierungsführung, der Personalausstattung und der Führung nicht noch einmal miteinander kombiniert werden können“. Die Kosten von „Cash for Ash“ für die Steuerzahler belaufen sich auf bis zu 500 Millionen Pfund.

Das neue Fiasko – das durchaus als „Son of Cash for Ash“ bezeichnet werden kann – ist möglicherweise dreimal so teuer.

Der ganze Beitrag steht hier.

——————————

Boris Johnson kündigt einen Anstieg der Strompreise um 200% an

GWPF

Der Premierminister ignoriert klare Beweise dafür, dass die den erneuerbaren Energien zugrunde liegende Wirtschaftlichkeit katastrophal ist, und hat Großbritannien heute zu einem weiteren Ausbau der Offshore-Windenergie bis 2030 verpflichtet, mit beängstigenden Auswirkungen auf die Strompreise, die sich verdreifachen müssten, um die tatsächlichen Kosten zu decken.

Dies ist nicht nur ökonomisch töricht, sondern auch inkohärente Klimapolitik, da die heutige Entscheidung dafür sorgen wird, dass andere Ziele für niedrige Emissionen, wie die Elektrifizierung von Fahrzeugen und die Heizung von Haushalten, für die meisten Briten unerschwinglich werden.

Die Offshore-Windenergie bleibt trotz Schall und Rauch der Windindustrie eine extrem teure Art der Stromerzeugung. Sollte der Premierminister sein Ziel erreichen, werden die laufenden Kosten sogar noch weiter steigen, da die Turbinen in tieferem Wasser gebaut werden müssen und die Betriebskosten viel höher sind.

Darüber hinaus erhöhen die versteckten Kosten für die Integration eines hohen Maßes an intermittierender Windenergieerzeugung in das Elektrizitätssystem die direkten Kosten der Windflotte um mindestens 50%.

Dieses übereilte und falsch konzipierte Versprechen gefährdet jede Aussicht auf eine Erholung nach Covid und nach Brexit in höchstem Maße. Angesichts der Gefahr wesentlich höherer Strompreise wird kein vernünftiger Investor Geld in britische Fertigungsbetriebe oder damit verbundene Unternehmen mit überdurchschnittlichem Stromverbrauch investieren.

Die Auswirkungen auf die Nettobeschäftigung sind ebenfalls verheerend. Subventionen können einige wacklige britische Arbeitsplätze in der Windindustrie und viele weitere in China und im Nahen Osten schaffen, wo Windturbinen hergestellt werden, aber sie werden den Verlust realer britischer Arbeitsplätze in anderen Unternehmen, die wegen hoher Energiekosten nicht mehr lebensfähig sind, nicht ausgleichen. Der Nettoeffekt für das Vereinigte Königreich wird stark negativ sein.

Dr. Benny Peiser, der Direktor der GWPF, sagte:

„Die Zusage des Premierministers ist ein Geschenk an die grüne Lobby und ein Schlag ins Gesicht für gewöhnliche Familien und Unternehmen, die einen hohen Preis zu zahlen haben werden“.

Link: https://www.thegwpf.com/boris-johnson-announces-200-rise-in-electricity-prices/

Übersetzt von Chris Frey EIKE