CMIP6-Aktualisierung

Ich habe bereits früher über die Vorhersage-Zuverlässigkeit von Klimamodellen auf WUWT Stellung geommen, und zwar hier, hier, hier und hier. Wer eine Videopräsentation der Arbeit bevorzugt, findet sie hier. Volle Transparenz erfordert, dass man Dr. Patrick Browns (jetzt Prof. Brown an der San Jose State University) Videokritik zur Kenntnis nimmt, die hier gepostet wurde und die in den Kommentaren unter diesem Video, beginnend hier, widerlegt wurde.

Diejenigen, die sich diese Kommentare durchlesen, werden sehen, dass Dr. Brown keine offensichtliche Ausbildung in der Analyse physischer Fehler aufweist. Er machte die gleichen Anfängerfehler, wie sie bei Klimamodellen üblich sind und die hier und hier ausführlich diskutiert werden.

In unserer Debatte benahm sich Dr. Brown sehr zivilisiert und höflich. Er wirkte wie ein netter Kerl und wohlmeinend. Aber als man ihm keine Möglichkeit ließ, die Genauigkeit und Qualität der Daten zu beurteilen, verrieten ihn seine Lehrer und Mentoren.

Mangelnde Ausbildung in der Bewertung der Datenqualität ist offenbar eine Lücke in der Ausbildung der meisten, wenn nicht aller AGW-Konsens-Klimaforscher. Sie finden keinen Sinn im entscheidend zentralen Unterschied zwischen Präzision und Genauigkeit. Es kann überhaupt keinen möglichen Fortschritt in der Wissenschaft geben, wenn die Mitarbeiter nicht geschult sind, die Qualität ihrer eigenen Daten kritisch zu bewerten.

Die beste Gesamtbeschreibung von Klimamodellfehlern ist immer noch Willie Soon, et al., 2001 vorbehalten in seinem Beitrag „Modeling climate effects of anthropogenic carbon dioxide emissions: unknowns and uncertainties“. So ziemlich alle beschriebenen Simulationsfehler und Schwächen sind auch heute noch zutreffend.

Jerry Browning hat kürzlich eine rigorose mathematische Physik veröffentlicht, die an ihrer Quelle die von Willie et al. beschriebenen Simulationsfehler aufdeckt. Er zeigte, dass die falsch formulierte physikalische Theorie in Klimamodellen diskontinuierliche Heiz-/Kühlterme erzeugt, die eine „Größenordnung“ der Verringerung der Simulationsgenauigkeit bewirken.

Diese Diskontinuitäten würden dazu führen, dass die Klimasimulationen rasch voneinander abweichen, es sei denn, die Klimamodellierer unterdrücken sie mit einer hyperviskosen (Melasse-)Atmosphäre. Jerrys Papier bietet einen Ausweg. Dennoch bleiben Diskontinuitäten und Melasseatmosphären auch in den neuen verbesserten CMIP6-Modellen erhalten.

Im Fünften Zustandsbericht 2013 (5AR) verwendete der IPCC CMIP5-Modelle, um die Zukunft der globalen Lufttemperaturen vorherzusagen. Der kommende 6AR wird die aktualisierten CMIP6-Modelle verwenden, um die thermische Zukunft vorherzusagen, die uns erwartet, falls wir weiterhin fossile Brennstoffe verwenden.

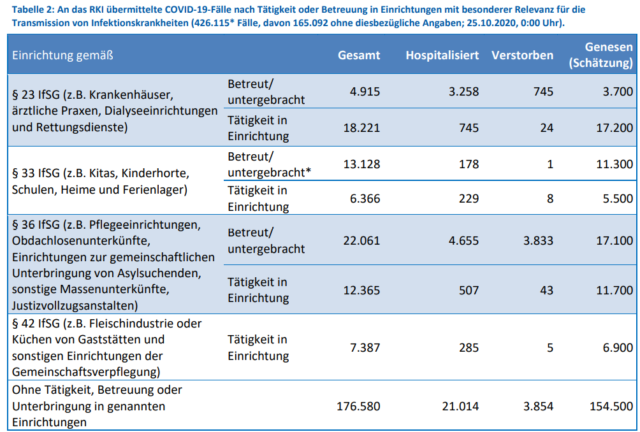

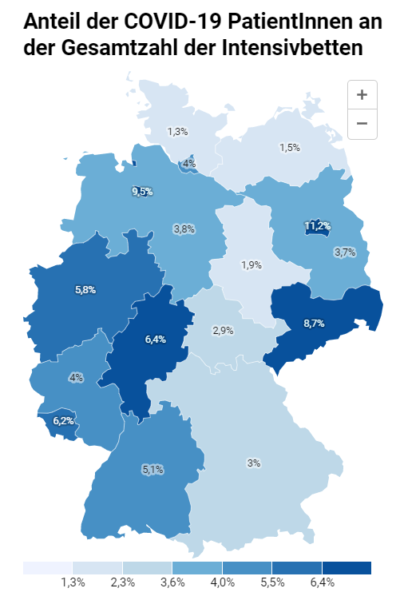

CMIP6-Wolkenfehler und Nachweisgrenzen: Abbildung 1 vergleicht den vom CMIP6 simulierten globalen durchschnittlichen jährlichen Wolkenanteil mit dem gemessenen Wolkenanteil und zeigt deren Differenz zwischen 65 Grad nördlicher und südlicher Breite. Der durchschnittliche jährliche Fehler (rms root mean square) des Wolkenanteils beträgt ±7,0%.

Dieser Fehler kalibriert die durchschnittliche Genauigkeit von CMIP6-Modellen gegenüber einem bekannten, beobachtbaren Wolkenanteil. Der durchschnittliche jährliche rms-Fehler des CMIP5-Wolkenanteils über den gleichen Breitenbereich beträgt ±9,6%, was auf eine Verbesserung des CMIP6 um 27% hinweist. Nichtsdestotrotz weisen CMIP6-Modelle immer noch signifikante Simulationsfehler des globalen Wolkenanteils auf.

Abbildung 1 Linien: rot, MODIS + ISCCP2 gemessener jährlicher durchschnittlicher Wolkenanteil; blau, CMIP6-Simulation (9 Modellmittelwerte); grün, (gemessen minus CMIP6) jährlicher durchschnittlicher Kalibrierungsfehler (rms-Fehler in Längsrichtung = ±7,0%).

Die folgende Analyse ist eine einfache Erweiterung der bisherigen, auf die CMIP5-Projektionen der Lufttemperatur angewendeten Fehlerfortpflanzung auf die CMIP6-Modelle.

Fehler bei der Simulation des globalen Wolkenanteils führen zu Folgefehlern im langwelligen Wolkenantrieb (LWCF) des simulierten Klimas. LWCF ist eine Quelle des thermischen Energieflusses in der Troposphäre.

Der troposphärische thermische Energiefluss ist die Determinante der Lufttemperatur in der Troposphäre. Simulationsfehler in LWCF führen zu Unsicherheiten im Wärmefluss der simulierten Troposphäre. Diese wiederum führen zu Unsicherheiten bei den projizierten Lufttemperaturen.

Für weitere Diskussionen siehe hier – Abbildung 2 und den umgebenden Text. Das oben verlinkte Fehlerfortpflanzungspapier bietet ebenfalls eine ausführliche Diskussion dieses Punktes.

Der globale jährliche Mittelwert des langwelligen LWCF rms-Kalibrierfehlers der CMIP6-Modelle beträgt ±2,7 W/m² (28 Modellmittelwerte aus Abbildung 18 hier).

Ich konnte die Gültigkeit dieser Zahl überprüfen, denn dieselbe Quelle lieferte auch den durchschnittlichen jährlichen LWCF-Fehler für die 27 von Lauer und Hamilton bewerteten CMIP5-Modelle. Der von Lauer und Hamilton ausgewertete CMIP5 rms-Jahresdurchschnitts-LWCF-Fehler beträgt ±4 W/m². Eine unabhängige Neubestimmung ergab ±3,9 W/m²; dasselbe gilt für den Rundungsfehler.

Die kleine Frage der Auflösung: Im Vergleich mit dem CMIP6 LWCF-Kalibrierungsfehler (±2,7 W/m²) beträgt die durchschnittliche jährliche Zunahme des CO2-Antriebs zwischen 1979 und 2015 0,025 W/m² (Daten von der EPA). Die durchschnittliche jährliche Zunahme der Summe aller Antriebe für alle wichtigen Treibhausgase im Zeitraum 1979-2015 beträgt 0,035 W/m².

Der durchschnittliche jährliche CMIP6 LWCF-Kalibrierungsfehler (±2,7 W/m²) ist also ±108-mal größer als die durchschnittliche jährliche Zunahme des Antriebs durch CO2-Emissionen allein und ±77-mal größer als die durchschnittliche jährliche Zunahme des Antriebs durch alle THG-Emissionen.

Das heißt, eine untere Grenze der CMIP6-Auflösung ist ±77 Mal größer als die zu erkennende Störung. Dies ist eine kleine Verbesserung gegenüber CMIP5-Modellen, die eine ±114-mal zu große Auflösung der unteren Grenze aufwiesen.

Die analytische Strenge erfordert in der Regel, dass die instrumentelle Nachweisgrenze (Auflösung) 10-mal kleiner als die erwartete Messgröße ist. Um also ein Signal von CO2– oder THG-Emissionen vollständig zu erkennen, müssen die aktuellen Klimamodelle ihre Auflösung um fast das 1000-Fache verbessern.

Eine andere Möglichkeit ist, dass die CMIP6-Klimamodelle die Auswirkungen von CO2– oder THG-Emissionen auf das Erdklima oder die globale Lufttemperatur, so überhaupt existent, nicht erfassen können.

Diese Tatsache dürfte von der Konsensus-Klimatologie-Gemeinschaft ignoriert werden.

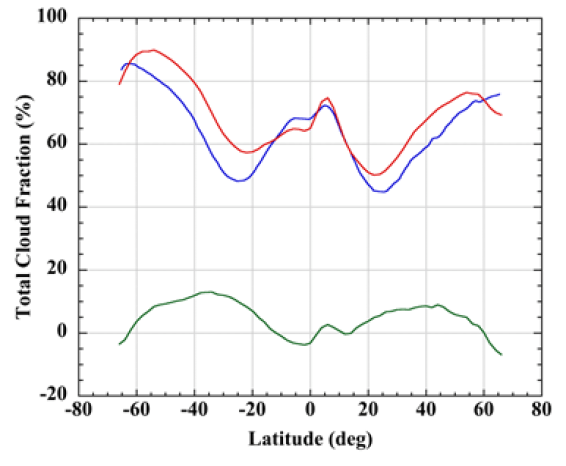

Gültigkeit der Simulation: Papalexiou et al., 2020 stellten fest, dass „die Glaubwürdigkeit von Klimaprojektionen typischerweise dadurch definiert wird, wie genau Klimamodelle die historische Variabilität und Trends abbilden“. Abbildung 2 zeigt, wie gut die lineare Gleichung, die zuvor zur Emulation der CMIP5-Lufttemperaturprojektionen verwendet wurde, die GISS-Temp-Anomalien reproduziert.

Abbildung 2 Linien: blau, GISS Temp 1880-2019 Land plus SST-Lufttemperaturanomalien; rot, Simulation unter ausschließlicher Verwendung der Meinshausener RCP-Antriebe für CO2+N2O+CH4+ Vulkanausbrüche

Die Nachahmung geht durch die Mitte des Trends und ist besonders gut in der Zeit nach 1950, wo die Lufttemperaturen angeblich durch Treibhausgasemissionen (THG) angetrieben werden. Die durch vulkanische Aerosole verursachten nichtlinearen Temperaturabfälle werden erfolgreich in den Jahren 1902 (Pelée), 1963 (Agung), 1982 (El Chichón) und 1991 (Pinatubo) reproduziert. Nachdem wir die Glaubwürdigkeit der veröffentlichten Norm nachgewiesen haben, können wir fortfahren.

CMIP6 Welt: Die neuen CMIP6-Projektionen haben neue Szenarien, die Shared Socioeconomic Pathways (SSPs).

Diese Szenarien kombinieren die repräsentativen Konzentrationspfade (Representative Concentration Pathways – RCPs) des AR 5 mit „quantitativen und qualitativen Elementen, die auf Welten mit verschiedenen Ebenen von Herausforderungen für die Abschwächung und Anpassung basieren [mit] neuen Szenario-Handlungssträngen [die] Quantifizierungen der damit verbundenen Bevölkerungs- und Einkommensentwicklung umfassen … zur Verwendung durch die Klimawandel-Forschungsgemeinschaft“.

Zunehmend entwickelte Beschreibungen dieser Handlungsstränge sind hier, hier und hier verfügbar.

Die Simulation der CMIP6-Lufttemperatur-Projektionen unten folgt der identischen Methode, die in dem oben verlinkten Fehlerfortpflanzungspapier beschrieben ist.

Die Analyse konzentriert sich hier auf Projektionen, die mit Hilfe des Erdsystemmodells CMIP6 IMAGE 3.0 erstellt wurden. IMAGE 3.0 wurde so konstruiert, dass alle erweiterten Informationen, die in den neuen SSPs zur Verfügung gestellt werden, berücksichtigt wurden. Die IMAGE 3.0-Simulationen wurden lediglich der Bequemlichkeit halber ausgewählt. Die von van Vuulen et al. im Jahr 2020 veröffentlichte Studie enthielt in seiner Abbildung 11 praktischerweise sowohl die SSP-Vorgaben als auch die daraus resultierenden Lufttemperaturprojektionen. Die veröffentlichten Daten wurden mit DigitalizeIt, einem Werkzeug, das mir gute Dienste geleistet hat, in Punkte umgerechnet.

Hier ist ein kurzes Zitat aus der Beschreibung für IMAGE 3.0: „IMAGE ist ein integrierter Bewertungsmodellrahmen, der globale und regionale Umweltfolgen von Veränderungen menschlicher Aktivitäten simuliert. Das Modell ist ein Simulationsmodell, d.h. Änderungen der Modellvariablen werden auf der Grundlage der Informationen aus dem vorhergehenden Zeitschritt berechnet.

Simulationen werden von] zwei Hauptsystemen angetrieben: 1) das menschliche oder sozio-ökonomische System, das die langfristige Entwicklung menschlicher Aktivitäten beschreibt, die für eine nachhaltige Entwicklung relevant sind; und 2) das Erdsystem, das Veränderungen in natürlichen Systemen wie dem Kohlenstoff- und Wasserkreislauf und dem Klima beschreibt. Die beiden Systeme sind durch Emissionen, Landnutzung, Klima-Rückkopplungen und mögliche politische Reaktionen des Menschen miteinander verbunden“.

[Hervorhebung vom Autor]

Über fehlerbehaftete Iterationen: Der oben fettgedruckte Satz beschreibt die schrittweise Simulation eines Klimas, bei der jeder zuvor simulierte Klimazustand in der iterativen Berechnung die Anfangsbedingungen für die nachfolgende Klimazustandssimulation bis hin zum endgültigen simulierten Zustand liefert. Die Simulation als schrittweise Iteration ist Standard.

Wenn die in der Simulation verwendete physikalische Theorie falsch oder unvollständig ist, überträgt jeder neue iterative Anfangszustand seinen Fehler in den nachfolgenden Zustand. Jeder nachfolgende Zustand ist dann zusätzlich einem weiteren Fehler unterworfen, der sich aus der Anwendung der falschen physikalischen Theorie auf den fehlerhaften Anfangszustand ergibt.

Entscheidend: Als Folge der schrittweisen Iteration werden systematische Fehler in jedem Klimazwischenzustand in jeden nachfolgenden Klimazustand fortgeschrieben. Die Unsicherheiten aus den systematischen Fehlern pflanzen sich dann als Wurzel-Summen-Quadrat (rss) durch die Simulation fort.

In diesem Zusammenhang zeigte Jerry Browning in seinem Beitrag analytisch und gründlich auf, dass Klimamodelle eine falsche physikalische Theorie verwenden. Abbildung 1 oben zeigt, dass eine der Folgen ein Fehler im simulierten Wolkenanteil ist.

Bei einer Projektion zukünftiger Klimazustände sind die physikalischen Fehler der Simulation unbekannt, da zukünftige Beobachtungen nicht zum Vergleich zur Verfügung stehen.

Die rss-Fortpflanzung eines bekannten Modell-Kalibrierungsfehlers durch die iterierten Schritte erzeugt jedoch eine Zuverlässigkeits-Statistik, anhand derer die Simulation bewertet werden kann.

Obiges fasst das Verfahren zusammen, welches zur Bewertung der Projektionszuverlässigkeit in der Ausbreitungspapier und hier verwendet wird: Zuerst wird das Modell gegen bekannte Ziele kalibriert, dann wird der Kalibrierungsfehler durch die iterativen Schritte einer Projektion als Wurzel-Summen-Quadrat-Ungenauigkeit fortführt. Man wiederholt diesen Prozess bis zum letzten Schritt, der den vorhergesagten zukünftigen Endzustand beschreibt.

Die abschließende Wurzel-Summen-Quadrat-(rss)-Unsicherheit gibt die physikalische Zuverlässigkeit des Endergebnisses an, da der physikalisch wahre Fehler in einer Zukunftsprognose nicht bekannt ist.

Diese Verfahren ist Standard in den physikalischen Wissenschaften, wenn es darum geht, die Zuverlässigkeit eines berechneten oder vorhersagbaren Ergebnisses zu ermitteln.

Emulation und Ungewissheit: Eine der wichtigsten Demonstrationen in der Fehler-Fortpflanzungstudie war, dass fortgeschrittene Klimamodelle die Lufttemperatur lediglich als eine lineare Extrapolation des THG-Antriebs projizieren.

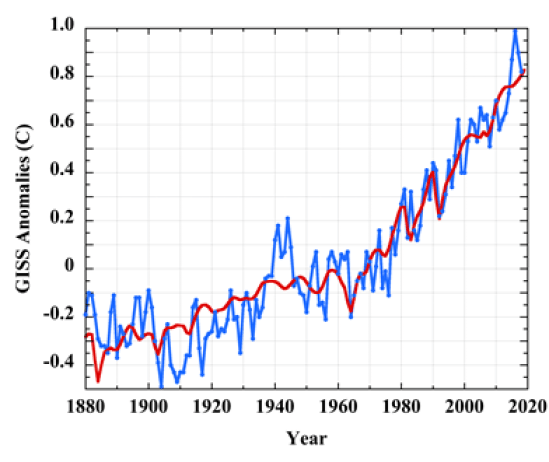

Abbildung 3, Tafel a: Punkte sind die IMAGE 3.0-Lufttemperaturprojektion von Szenario SSP1 (blau) und Szenario SSP3 (rot). Vollständige Linien sind die Emulationen der IMAGE 3.0-Projektionen: blau, SSP1-Projektion, und rot, SSP3-Projektion, die unter Verwendung der in der veröffentlichten Analyse der CMIP5-Modelle beschriebenen linearen Emulationsgleichung erstellt wurden. Tafel b ist wie Tafel a, zeigt aber auch die expandierenden 1 s rss-Ungenauigkeits-Kurven, die entstehen, wenn ±2,7 W/m² des jährlichen durchschnittlichen LWCF-Kalibrierungsfehlers durch die SSP-Projektionen vermehrt und fortgeführt werden.

In Abbildung 3a oben zeigen die Punkte die Lufttemperaturprojektionen der Handlungsstränge SSP1 und SSP3, die mit dem Klimamodell IMAGE 3.0 erstellt wurden. Die Linien in Abbildung 3a zeigen die Emulationen der IMAGE 3.0-Projektionen, die unter Verwendung der linearen Emulationsgleichung erstellt wurden, die in der Fehlerfortpflanzungs-Studie (ebenfalls in einem Artikel aus dem Jahr 2008 im Skeptic Magazine) ausführlich beschrieben wird. Die Emulationen sind 0,997 (SSP1) oder 0,999 (SSP3) mit den IMAGE 3.0-Projektionen korreliert.

Abbildung 3b zeigt, was passiert, wenn ±2,7 W/m² des jährlichen mittleren LWCF-Kalibrierungsfehlers durch die globalen Lufttemperaturprojektionen IMAGE 3.0 SSP1 und SSP3 vermehr und fortgeführt wird.

Die Unsicherheitsbereiche sind so groß, dass die beiden SSP-Szenarien statistisch nicht unterscheidbar sind. Es wäre unmöglich, entweder eine Projektion oder, in Erweiterung, irgendeine SSP-Lufttemperaturprojektion als repräsentativer für die sich entwickelnde Lufttemperatur zu wählen, da jede mögliche Änderung der physisch realen Lufttemperatur in allen Projektionsunsicherheits-Bereichen untergegangen ist.

Ein Intermezzo – Es gibt Drachen: Ich werde hier einen Nebenschauplatz einbauen, um einem früheren heftigen, hartnäckigen und wiederholt behaupteten Missverständnis zuvorzukommen. Bei den Unsicherheitseinhüllenden in Abbildung 3b handelt es sich nicht um physikalisch reale Lufttemperaturen. Das muss eindeutig klar sein.

Diese Unsicherheitsbalken bedeuten nicht, dass das Klima in Zukunft 15°C wärmer oder 10°C kälter sein wird. Unsicherheitsbalken beschreiben eine Bandbreite, in der Unwissenheit herrscht. Ihre Botschaft lautet, dass die projizierten zukünftigen Lufttemperaturen irgendwo innerhalb der Unsicherheitsbandbreite liegen. Aber niemand kennt den Ort. CMIP6-Modelle können nichts Definitiveres sagen als das.

Innerhalb dieser Unsicherheitsbalken befindet sich Terra Incognita. Es gibt Drachen.

Wer darauf besteht, dass die Unsicherheitsbalken tatsächliche reale physikalische Lufttemperaturen implizieren, sollte sich überlegen, wie sich dieser Gedanke gegen die Notwendigkeit durchsetzt, dass eine physikalisch reale ±C-Unsicherheit eine Gleichzeitigkeit von heißen und kalten Zuständen erfordert.

Unbestimmtheits-Balken sind streng axial. Sie stehen im Plus und im Minus auf jeder Seite eines einzelnen Datenpunktes. Die Annahme zweier gleichzeitiger, gleich großer, aber entgegengesetzt polarisierter physikalischer Temperaturen, die auf einem einzigen Punkt des simulierten Klimas stehen, ist eine physikalische Unmöglichkeit.

Die Idee verlangt Unmögliches, nämlich dass die Erde gleichzeitig Treibhaus und Eiskeller des globalen Klimas einnimmt. Bitte also diesen Gedanken endgültig verwerfen.

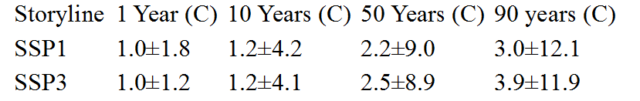

Und nun zurück zu unserer Feature-Präsentation: Die folgende Tabelle enthält ausgewählte Anomalien der Projektion der Szenarien IMAGE 3.0 SSP1 und SSP3 nebst ihren entsprechenden Unsicherheiten.

Keine dieser prognostizierten Temperaturen ist anders als physikalisch bedeutungslos. Keine einzige von ihnen sagt uns etwas physikalisch Reales über mögliche zukünftige Lufttemperaturen.

Es folgen mehrere Schlussfolgerungen.

Erstens projizieren die CMIP6-Modelle, wie ihre Vorläufer, die Lufttemperaturen als lineare Extrapolation des Antriebs.

Zweitens machen CMIP6-Klimamodelle, wie ihre Vorgängermodelle, großräumige Simulationsfehler im Wolkenanteil.

Drittens erzeugen CMIP6-Klimamodelle wie ihre Vorläufer LWCF-Fehler, die enorm größer sind als die winzige jährliche Zunahme des troposphärischen Antriebs durch Treibhausgasemissionen.

Viertens erzeugen die CMIP6-Klimamodelle, wie ihre Vorläufer, so große und unmittelbare Unsicherheiten, dass die Lufttemperaturen selbst für ein Jahr nicht zuverlässig prognostiziert werden können.

Fünftens müssen CMIP6-Klimamodelle, wie ihre Vorläufer, eine etwa 1000-fach verbesserte Auflösung aufweisen, um ein CO2-Signal zuverlässig zu erkennen.

Sechstens erzeugen CMIP6-Klimamodelle, wie ihre Vorläufer, physikalisch bedeutungslose Lufttemperatur-Projektionen.

Siebtens haben die CMIP6-Klimamodelle, wie ihre Vorläufer, keinerlei Vorhersagewert.

Die unvermeidliche Schlussfolgerung ist nach wie vor, dass ein anthropogenes Lufttemperatursignal in Klimabeobachtungen nicht nachgewiesen werden konnte und auch gegenwärtig nicht nachgewiesen werden kann.

Ich schließe mit einer Bemerkung, die schon einmal gemacht wurde: Wir wissen jetzt mit Sicherheit, dass all die Hektik um CO2 und das Klima umsonst war.

All die verängstigten Erwachsenen; all die verzweifelten jungen Menschen; all die Gymnasiasten, die zu Tränen und Schuldzuweisungen durch Lektionen über bevorstehendes Unheil, Tod und Zerstörung verängstigt sind; all die sozialen Unruhen und Verwerfungen. All das war umsonst.

All die Schuldzuweisungen, all die Rufmordanschläge, all die zerstörten Karrieren, all die überschüssigen Todesfälle im Winter durch Brennstoffarmut, all die Männer, Frauen und Kinder, die weiterhin mit Rauch in geschlossenen Räumen leben, all die enormen Summen, die umgeleitet wurden, all die zerstörten Landschaften, all die zerhackten und verbrannten Vögel und Fledermäuse, all die gewaltigen Geldsummen, die von der Mittelschicht an reiche Subventionsbauern überwiesen wurden:

Alles umsonst.

Link: https://wattsupwiththat.com/2020/10/27/cmip6-update/

Übersetzt von Chris Frey EIKE