Das Geschäft mit der Angst, die unendliche Geschichte….oder, lernen wir Deutsche gar nichts aus der Geschichte? Teil 1: anthropogener Klimawandel

Abb.1, links Quelle: Bild vom Gemälde von Peter Paul Rubens: Papst Leo X. Rechts: UN-Generalsekretär Guterres, einer der Haupttreiber beim sog. anthropogenen Klimawandel, Quelle: Deutscher Bundestag.

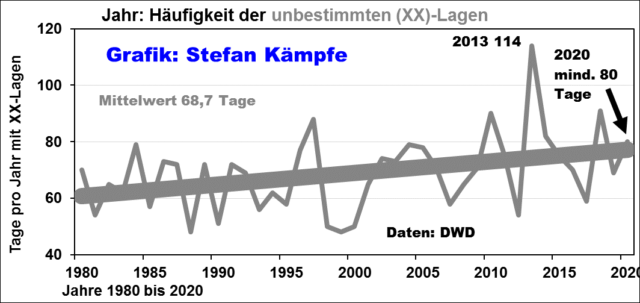

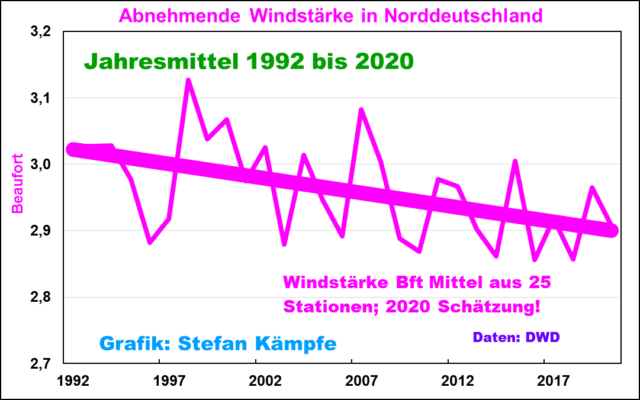

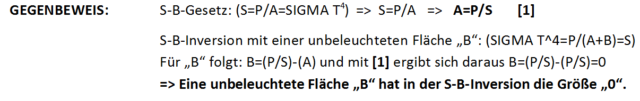

Der Artikel soll zeigen, dass wir in der Tat einen menschengemachten Klimawandel (Erderwärmung) haben, aber nicht auf der Basis sog. Treibhausgase wie CO2, sondern auf der Basis manipulierter Maßsysteme/Messungen. Die Dreistigkeit, mit der dabei vorgegangen wird, wird mit zunehmender Abnahme der solaren Tätigkeit, immer dreister. EIKE berichtete darüber hier , hier oder hier. Zuerst will der Autor einen Blick darauf werfen, inwieweit die Aussage vom Rückgang der solaren Tätigkeit, z.B. einer „kalten“ Sonne berechtigt ist.

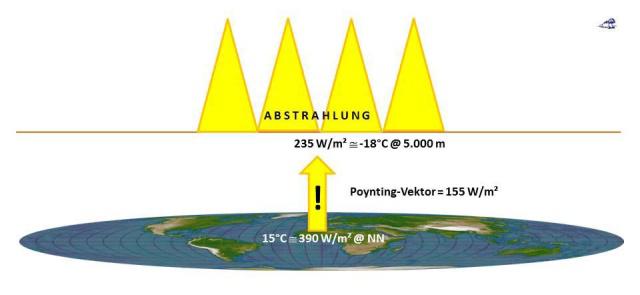

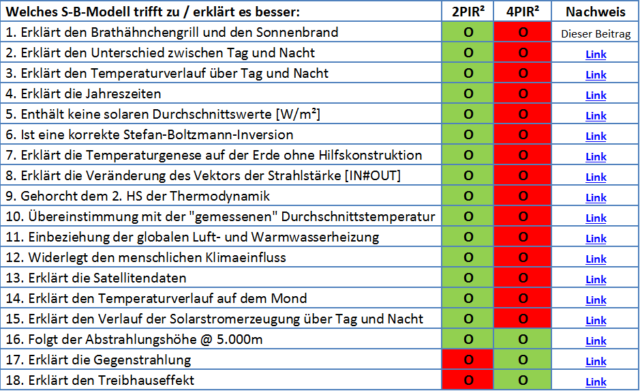

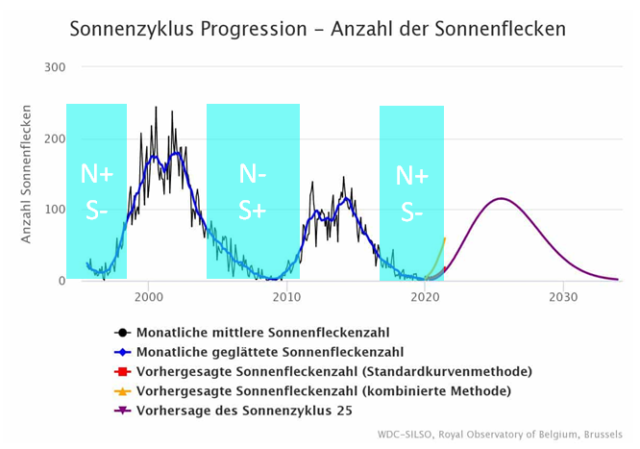

Abb.2 (Quelle) zeigt den 11-jährigen Schwabe-Zyklus (Zyklus 23 und 24) der Sonne bis 2020, sowie den projizierten 25 Sonnenzyklus bis 2030. Deutlich zu erkennen, dass die solare Aktivität, gemessen an der Sonnenfleckenzahl – diese betrachtet der Schwabe-Zyklus – deutlich zurück gegangen ist.

Nun lässt sich die Aktivität der Sonne nicht an einem einzigen Parameter festmachen, wie z.B. die (unsinnige) Behauptung, die Erderwärmung hinge einzig am CO2, sondern die solare Aktivität ist weitaus komplexer. In seinem 8-teiligen Eike-Bericht, „Dynamisches Sonnensystem – die tatsächlichen Hintergründe des Klimawandels“ hatte der Autor dies 2011 dezidiert aufgezeigt.

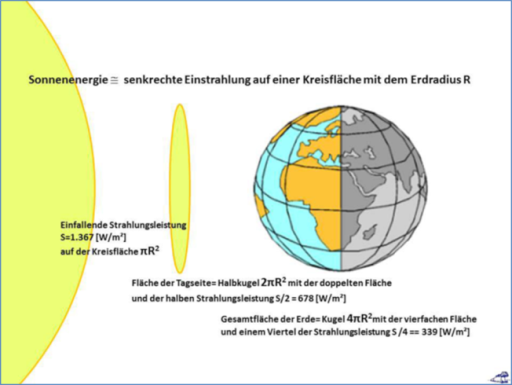

Wichtig für die Erdtemperatur ist neben der solaren Einstrahlung, der Grad der Wolkenbedeckung, die die Sonnenscheindauer bestimmt. Niemand wird bestreiten wollen, dass ein wolkenloser Himmel für höhere Tagestemperaturen sorgt, als ein wolkenverhangener Himmel zur gleichen Jahreszeit und geographischer Breite. Dem interessierten Leser fällt hier sicherlich zuerst der Svensmark-Effekt ein, der darlegt, dass die Wolkenbedeckung mit dem Maß der solaren Aktivität (über die Modulation der kosmischen Strahlung durch den Sonnenwind) zusammenhängt. Der Sonnenwind wiederum wird (zumindest tlw.) durch die Sonnenflecken und die solaren Flares (Sonneneruptionen) beeinflusst.

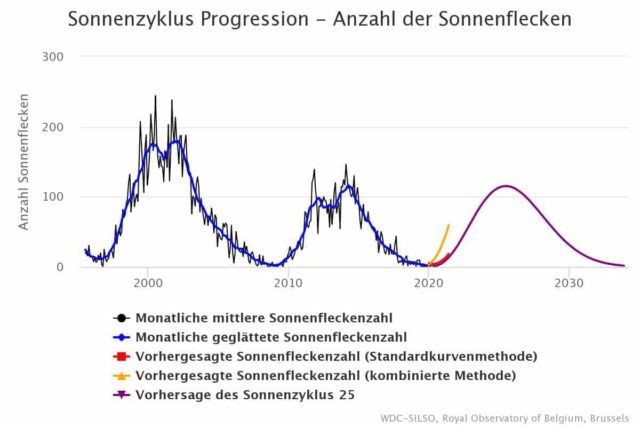

Wie gesehen, ist die Fleckenaktivität seit Jahren vglw. gering und auch die magn. Aktivität der Sonne, die für die Flares mitverantwortlich ist, ist fallend (Abb.3).

Abb.3 (Quelle) zeigt die jährliche Anzahl magnetischer Stürme (blau) und die geglättete Sonnenfleckentätigkeit. Im 20. Jahrhundert ist eine deutliche Zunahme der magnetischen Aktivität der Sonne zu verzeichnen, die etwa um das Jahr 1900 begann. Seit Beginn des Jahrtausends fällt die magn. Aktivität der Sonne wieder.

Abb.3 zeigt einen etwa 100 jährigen Anstieg der solaren Aktivität. Diese fällt zusammen mit dem Anstieg im Hauptsonnenzyklus, dem im Mittel 208-jährigen de Vries-Suess-Zyklus.

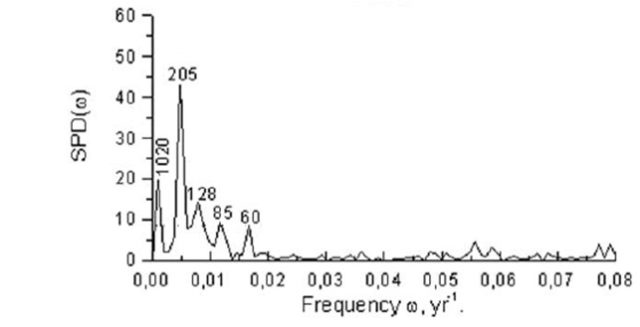

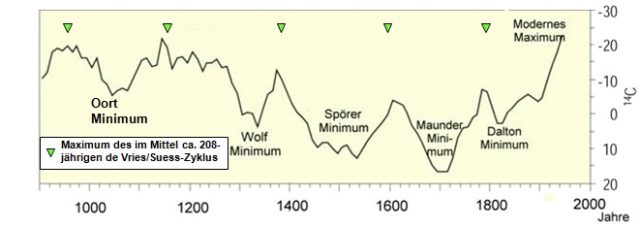

Warum Hauptsonnenzyklus? Den Grund zeigt Abb.4.

Abb.4, Quelle: Orgutschov et al. Aanhand der Fourier-Analyse werden in der Sonnenfleckenzahl verschieden Perioden sichtbar. Die dominanteste ist die 205-Jahres-Periode, was dem Hauptsonnenzyklus, dem im Mittel 208-jährigen de Vries/Suess-Zyklus entspricht. Darüber hinaus ist eine 85-Jahres-Periode, der Gleissberg-Zyklus, eine 60-Jahres-Periode (Landscheidt-Zyklus) und die 1.020-Jahres-Periode erkennbar.

In ihrer Arbeit „Multi-periodic climate dynamics: spectral analysis of long-terminstrumental and proxy temperature records“ untersuchten die Wissenschaftler Lüdecke, Hempelmann und Weiss den Einfluss des de Vries-Suess-Zyklus auf die Erdtemperaturen und fanden den in Abb. 5 dargestellten Verlauf der Temperaturanomalien.

Abb.5, Quelle: Lüdecke, Hempelmann und Weiss zeigt die Temperaturanomalie der letzten 250 Jahre. Der Verlauf folgt dem de Vries-Suess-Zyklus der Sonne, der in 2002/2003 sein Aktivitätsmaximum erreichte.

Bezogen auf seine mittlere (statistische) Länge von 208 Jahren, lag sein (statistisches) Minimum um das Jahr 1899. Das Jahr 2020 liegt 17 Jahre nach seinem letzten Maximum. Normiert auf die Zeit (Jahre) sind dies 16% entfernt vom Maximum. Das Jahr 2020 liegt somit noch 84% vom nächsten Minimum entfernt. In diesem Zusammenhang von einer schwachen Sonne oder gar „kalten“ Sonne zu reden, ist denn auch fehl am Platz und weitaus verfrüht. Dies zeigt Abb.6.

Abb.6 (Quelle) zeigt die heliosphärische Stromschicht (current sheet = HCS), den die Sonne in den Orbit schickt. Neben dem Sonnenwind ist sie der entscheidende Parameter, der Aufschluss über die magnetische Aktivität der Sonne gibt. Die Abb. zeigt, dass die Sonne (obwohl schwach im Schwabe-Zyklus, siehe Abb. 2, Zyklus 24) im 24. Schwabezyklus ihren zweitstärksten Aktivitätszyklus ausgebildet hat. Beim HCS ist nicht das Maximum ausschlaggebend, sondern das Flächenintegral. Im Zeitraum, als der Hauptsonnenzyklus sein Maximum erreichte (um 2003) hatte die Sonne ihre stärkste Aktivität, wie Abb.6 transparent zeigt.

Eine kurze Erklärung.

Heliospheric Current Sheet (HCS)

Das Interplanetarische Magnetfeld ist auf der Erdbahn mit einer Stärke von 1 – 10 nT 100 bis 1000-fach stärker, als das Dipolfeld der Sonne dies erwarten lässt (magnetische Dipolfelder klingen mit der dritten Potenz des Abstandes ab). Deshalb muss es einen Effekt geben, der es verstärkt. Dies ist die Heliosphärische Stromschicht, die bis an die Grenzen des Sonnenwindes reicht. Dabei hat sie eine Breite von ca. 60.000 km. Der elektrische Strom in der HCS ist radial einwärts gerichtet und liegt bei ca. 104 A/km².

Die Heliosphärische Stromschicht dreht sich mit der Sonne und braucht für einen Umlauf knapp 4 Wochen. In diesem Zeitfenster befindet sich die Erde einmal über und einmal unterhalb der HCS. Da sich die Erde in 365 Tagen einmal um die Sonne bewegt, gerät sie mehrfach abwechselnd in den Bereich von südlich, bzw. nördlich gerichteten Magnetfeldern der Sonne, wobei sie jedes Mal die Heliosphärische Stromschicht durchquert. Die Lage der HCS im Orbit ist dabei abhängig von der solaren Aktivität (in Abb.6 ist daher als Maß der Aktivität der Winkel – Inclination = Neigung – angegeben).

In seiner Abhandlung „Dynamisches Sonnensystem – die tatsächlichen Hintergründe des Klimawandels“ ist der Autor im Teil 4b (hier) näher auf die HCS eingegangen.

Was hat das nun mit dem Klima und der Erdtemperaturen zu tun? Nun, eine ganze Menge. Hat die HCS doch direkten Einfluss auf die irdische Wolkenbedeckung und niemand wird ernsthaft bestreiten wollen, dass eine strahlende Sonne am Himmel (mit wenig Wolken), die Temperaturen höher steigen lässt, als ein wolkenverhangener Himmel. Mit ihrem Einfluss auf die Gewitteraktivität hat sie einen weiteren unmittelbaren Einfluss auf trockene oder nasse Sommer. Siehe hierzu z.B.:

„Lightning as a space‐weather hazard: UK thunderstorm activity modulated by the passage of the heliospheric current sheet“, Owens et al. 2015, Geophysical Reseach Letters (https://agupubs.onlinelibrary.wiley.com/doi/10.1002/2015GL066802)

„Daily changes in global cloud cover and Earth transits of the heliospheric current sheet“, D.R. Kniveton und B.A. Tinsley., Journal of Geophysical Research Atmospheres. (https://www.researchgate.net/publication/238494062_Daily_Changes_in_Global_Cloud_Cover_and_Earth_Transits_of_the_Heliospheric_Current_Sheet)

Zum Einfluss der solaren Aktivität auf den irdischen Niederschlag siehe auch Stanford University (hier).

Im Teil 7 seiner Arbeit „Dynamisches Sonnensystem – die tatsächlichen Hintergründe des Klimawandels“ hat der Autor mögliche Zusammenhänge der HCS mit der nordatlantischen Hurrikanaktivität dargelegt (hier, darin Abbildung 179)

Wie gezeigt, haben warme und trockene Jahre nichts mit sog. Treibhausgasen zu tun, sondern sind allein auf die solare Aktivität zurückzuführen, wie Abb. 7 und 8 weiter zeigen.

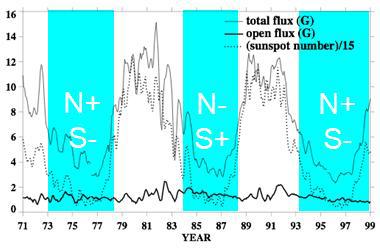

Abb. 7a stammt aus der Arbeit von Wang et al 2000 (hier) und zeigt die Polarität des Sonnenmagnetfeldes*.

* Der magnetische Zyklus wird Hale-Zyklus (der Astronom George Hale maß Anfang des 20. Jahrhunderts erstmals Magnetfelder in den Sonnenflecken) genannt und beträgt 22,1 Jahre. Dies ist der eigentliche Zyklus der Sonnenfleckenaktivität. Fleckengruppen setzen sich aus nordmagnetischen und südmagnetischen Flecken zusammen, die bipolar angeordnet sind. Während eines 11-jährigen Zyklus (Schwabe-Zyklus: 8 – 15 Jahre) laufen bei der Rotation der Sonne entweder die Nordpole oder die Südpole ständig voraus (Hale´s Polaritätsgesetz). Nach 11 Jahren kehrt sich diese Polarität um. Es vergehen also zwei 11-jährige Zyklen, bis die gleiche Anordnung wieder erscheint.

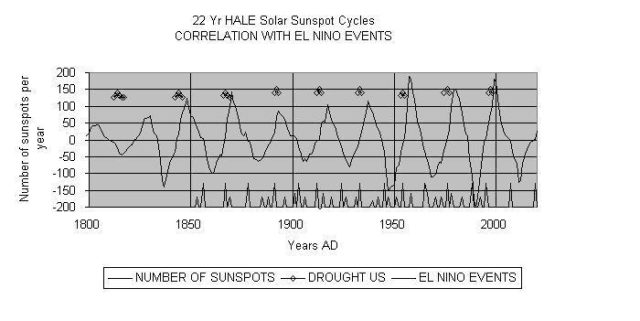

Abb.8 (Quelle) zeigt den Hale-Zyklus von 1800 – 2009 (obere Datenreihe). Die Rauten geben US-Trockenjahre an und die untere Datenreihe zeigt El-Niño-Ereignisse. Während El-Niño-Ereignisse keinen direkten Zusammenhang mit dem Hale-Zyklus erkennen lassen, zeigen die US-Trockenjahre, also bewölkungsschwache Jahre, eine deutlich Häufung zum Hale-Zyklus und zwar immer dann, wenn die Polarität des Sonnenmagnetfeldes N+ und S- beträgt.

Abb.7b, in Abb.2 hat der Autor die Informationen aus Abb.7a bis in unsere Zeit (Jahr 2020) erweitert. Aufgrund der solaren Aktivität sind die Jahre 2017 bis 2020 als „Trockenjahre“ zu bezeichnen, was wohl in 2021 anhalten wird. Mit irgendwelchen sog. Treibhausgasen oder einem angeblichen menschengemachten Klimawandel hat das rein gar nichts zu tun, sondern sind wiederkehrende Ereignisse, wie sie im 22-jährigen Hale-Zyklus und/oder im 208-jährigen de Vries-Suess-Zyklus „üblich*“ sind.

* So verlor z.B. der bekannte Pilgervater und spätere Gouverneur von Plymouth, William Bradford, aufgrund mehrerer nachfolgender Trockenjahre in der Mitte der 1590-Jahre in England, die die Ernten vernichteten, sein (bescheidenes) Vermögen. Quelle: ARTE-Sendung „Aufbruch in die neue Welt“, Doku USA 2015 „Die Pilgerväter“.

Abb.9 zeigt die Kälteperioden der letzten 1.100 Jahre (Dreiecke ergänzt nach Quelle: United States Geological Survey). Die Maxima der Warmperioden korrelieren jeweils mit dem Maximum des de Vries/Suess-Zyklus (grüne Dreiecke). In der Zeit der 1590-Jahre hatte der Hauptsonnenzyklus sein Maximum.

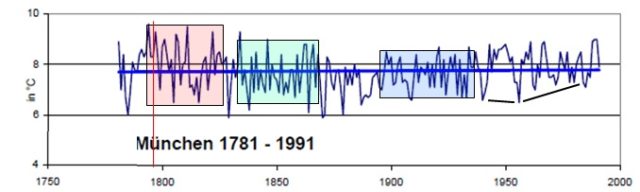

Auch das Temperaturverhalten nach einem Hauptsonnenzyklus ähnelt dem des anderen, wie ein Blick auf historische Temperaturaufzeichnungen zeigt (Abb.10).

Abb. 10, Quelle: Prof. Ewert, zeigt die Temperaturen in München im Zeitraum von 1781 – 1991. Die rote Linie gibt den Zeitpunkt des Maximums im Hauptsonnenzyklus an. Bis zu einem Zeitraum von 20 – 30 Jahren nach dem Hauptsonnenzyklus schwanken die Temperaturen noch stark zwischen warm und kalt (rote Fläche). Im Vergleich zu heute bis zum Jahr 2025 – 2035.

Bis zum erreichen seines Minimums, sind immer noch relativ hohe Temperaturausschläge zu verzeichnen, jedoch auf insgesamt niedrigerem Niveau (grüne Fläche). Unmittelbar vor und nach dessen Minimum ist das Klimasystem sozusagen in seinem eingeschwungenen, kalten Zustand und die Ausschläge sind am geringsten (blaue Fläche). Vor einem erneuten Temperaturanstieg (steigender Sonnenzyklus), fallen die Temperaturen auf ein Minimum und steigen dann kontinuierlich an (schwarze Linien).

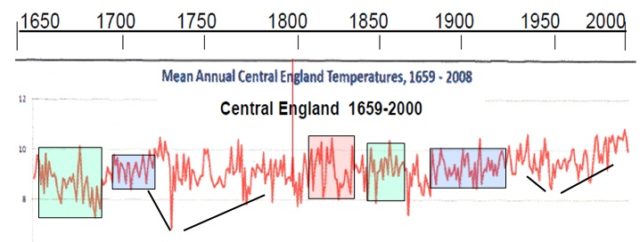

Dies gilt auch für die übrigen europäischen Städte, deren Temperaturaufzeichnungen bis in diese Zeit zurückreichen. Für Mittelengland liegen noch weiter in die Vergangenheit zurückreichende Temperaturaufzeichnungen vor. Diese zeigen, dass der Temperaturgang bei dem davorliegenden Maximum im Hauptsonnenzyklus nach dem gleichen Muster verlaufen, Abb.11.

Abb. 11: Temperaturgangreihe Zentralenglands von 1659 – 2000 (Quelle: Prof. Ewert). Mit seinem ausgeglichenen Seeklima zwischen Atlantik und Nordsee nimmt England sicherlich eine Sonderstellung ein. Dies zeigt sich, dass hier die „grüne“ Phase von der „roten“ Phase nicht so stark differiert wie in Mitteleuropa. Aber auch hier ist das Muster, trotz der Moderation durch den Ozean, vorhanden. Auch beim davor liegenden Hauptsonnenzyklus, fallen zuerst die Temperaturen stark, bevor sie dann wieder ansteigen (schwarze Linien).

Fazit

1. Sowohl die heutigen Temperaturen, als auch deren Wechselverhalten, wie die Trockenperioden sind natürlich wiederkehrende Ereignisse nach dem Maximum im Hauptsonnenzyklus. Mit sog. Treibhausgasen hat dies nichts zu tun.

2. In Anbetracht, dass die Sonne noch 86% (normiert auf die Zeit) von ihrem Aktivitätsminimum in ihrem Hauptzyklus entfernt ist, sind Aussagen von einer schwachen oder gar „kalten“ Sonne unangebracht und fehl am Platz. Wir Menschen neigen lediglich dazu, Dinge, die wir sehen (hier deren Fleckenaktivität in Abb.2), höheres Gewicht zukommen zu lassen. Bei der Sonne, die neben ihrer Fusionsenergie die Erde mit ihrer magn. Energie direkt und vor allem indirekt beeinflusst, eine falsche Gewichtung.

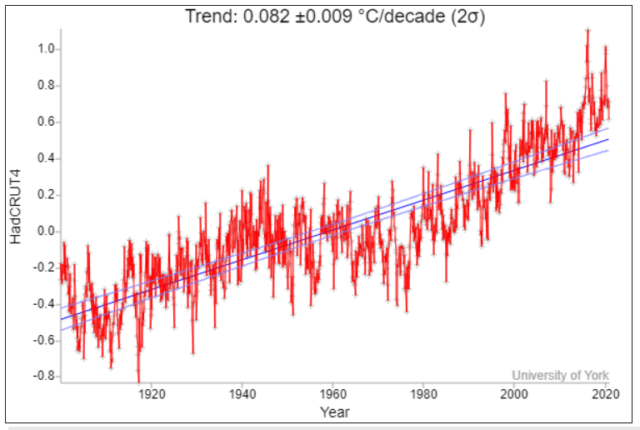

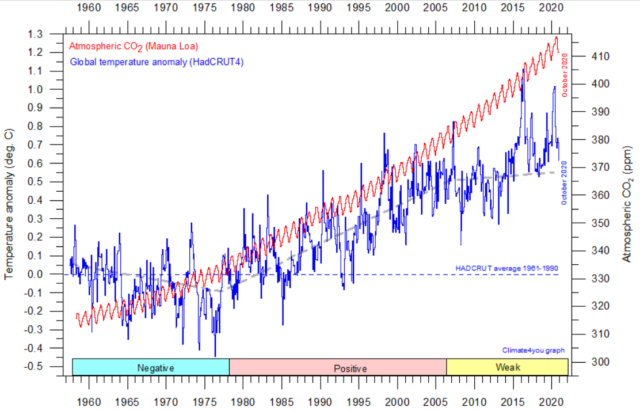

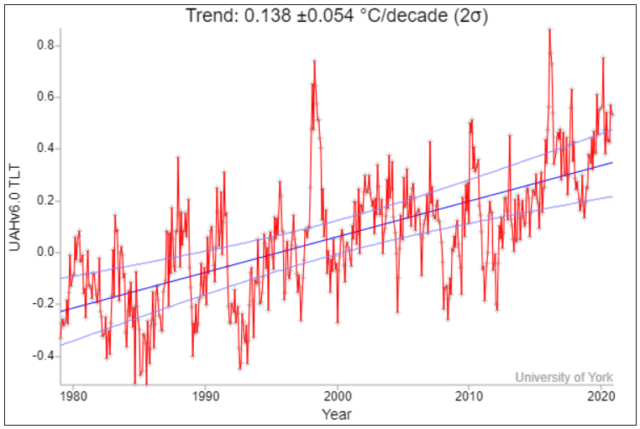

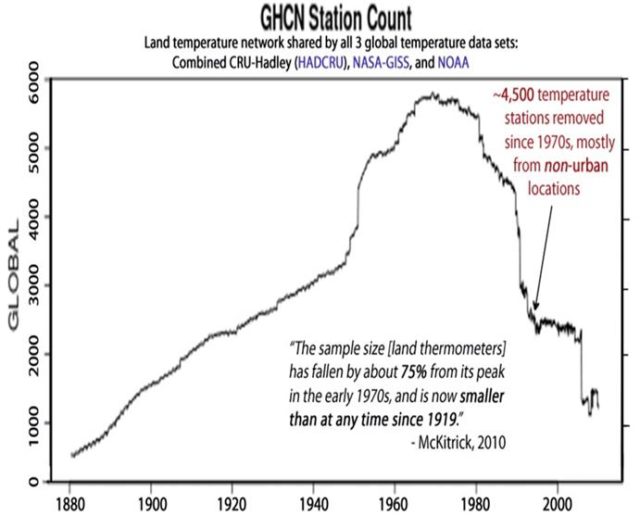

3. Meldungen von „höchsten“ Temperaturen, etc. sind auf dreiste Temperaturfälschungen, sowohl bei den Daten (bitte erinnern Sie sich an „Climategate“), wie bei der Messerfassung (vor 50 oder 100 Jahren wurde mit Quecksilber gemessen, heute durchweg elektronisch), aber vor allem bei der Auswahl der Messstationen zurück zuführen. Siehe Abb.12.

4. Aus 3 folgt, dass bei Temperaturvergleichen von heute zu früher durchweg „Äpfel mit Birnen“ verglichen werden und damit sämtliche Temperaturvergleich von DWD (Deutschem Wetterdienst, etc.) wertlos sind.

Abb.12 (Quelle) zeigt, dass mittlerweile fast ausschließlich Messstationen, die für die Mittelwertvergleiche herangezogen werden, aus städtischen Regionen stammen. Die der ländlichen hat drastisch abgenommen. Jeder braucht nur auf die Anzeige der Fahrzeugaußentemperatur zu schauen, um zu wissen, dass die Temperatur in Städten um bis zu 3°C höher ist, als in ländlichen Gebieten.

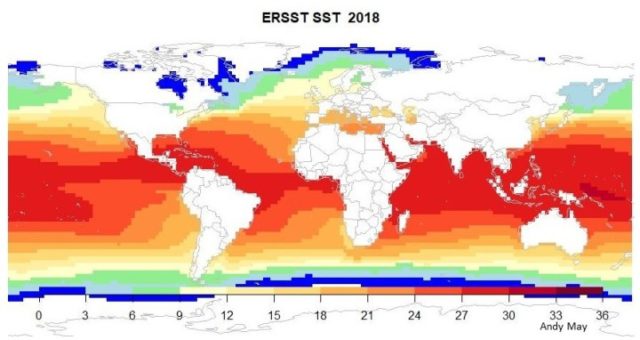

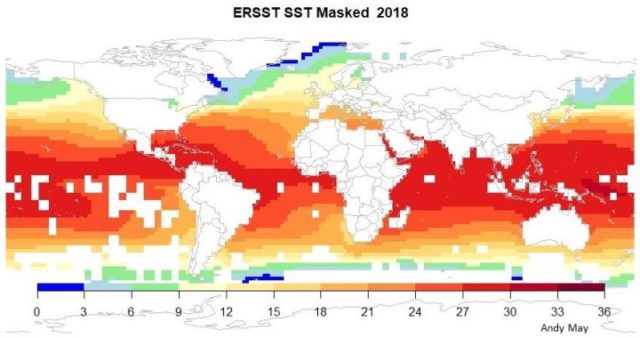

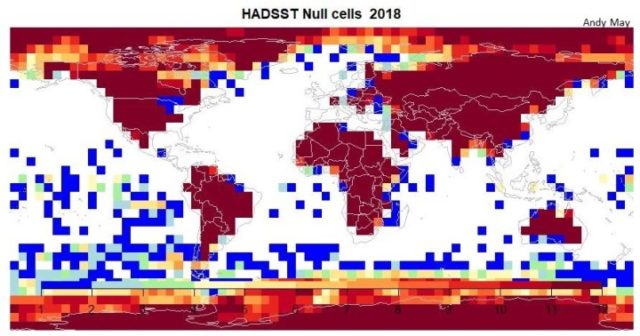

Weiter wird in vielen Gebieten der Erde überhaupt nicht gemessen und doch dreist von einer Globaltemperatur gesprochen. Vgl. Bericht im o.g. Link und die Vorgehensweise des Met Office.

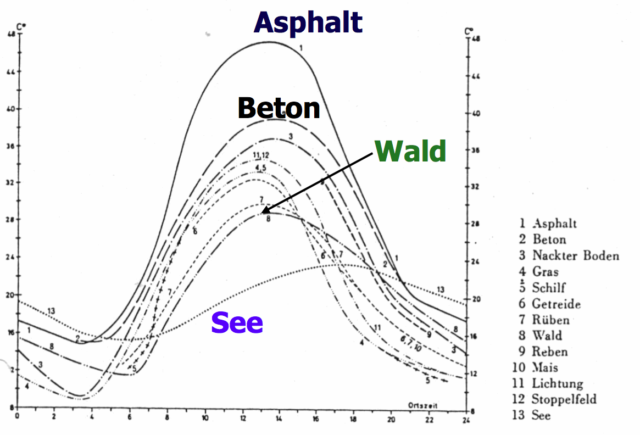

Wie sehr sich die Temperatur allein durch die Bodenbeschaffenheit ändert, zeigt Abb.13.

Abb.13 zeigt den Tagesgang der Temperatur an einem sonnigen Sommertag in Bodenhöhe für verschiedene Böden, nach Fezer 1975.

Zu Abb. 13: Nicht nur, dass über Beton und insbesondere Asphalt die Temperaturen z.B. sehr stark über denen des Waldbodens liegen, sondern auch, dass ein deutlicher Temperaturunterschied von mehreren °C zwischen Gras, Wald oder landwirtschaftlichen Flächen vorliegt. Messstationen, die ursprünglich auf freiem Feld standen und zwischenzeitlich in einer Gras, Hecken oder offenen Waldlandschaft stehen, weil sich das Landschaftsbild über die Jahrzehnte änderte oder städtische Messstationen, die fast 90% der Datenquelle ausmachen, geben somit deutlich höhere Temperaturwerte wieder und verzerren jeglichen Temperaturvergleich.

Mittlerweile räumt sogar der DWD ein, dass mit solchen Aussagen wie „heißester“… etwas nicht stimmt und diese falsch sind, Abb.14.

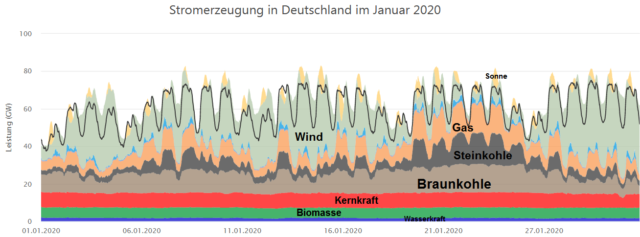

Es ist eine geradezu unverantwortlich, das auf solch einer falschen, auf Lügen und Betrug aufgebauten Metapher, gemeint ist der sog. anthropogene Klimawandel, hunderte von Milliarden Euro von unten nach oben verteilt werden, unsere Wirtschaft und Industrie ruiniert wird und letztendlich unsere Arbeitsplätze vernichtet werden.

Von Politik und Staatsmedien hochgepriesene neue Wirtschaftszweige, die stattdessen für vernichtete Branchen (als eine der letzten ist die Automobilindustrie dran) entstehen würden, entpuppen sich denn auch als nicht überlebensfähig (z.B.: Solarindustrie) oder als schlichte Betrugsfirmen, wie wirecard, die parasitengleich das Volksvermögen abzweigen, dass über Jahre der „Karle vom Band“ oder die „Jutta vom Einzelhandel“ erwirtschaftet haben.

Für solche Firmen macht dann die Kanzlerin auch noch Werbung. Aber Intelligenz ist offenbar nicht jedermanns (oder jederfraus) Sache.

(Teil 2 folgt demnächst)