Der Verfasser stellt dort eine einfache Energiebilanz an der Erdoberfläche auf und umgeht damit die komplizierten und großenteils unverstandenen Vorgänge in der Atmosphäre und in den Ozeanen. Dabei ist hervorzuheben, dass sich das irdische Leben in einer extrem dünnen Grenzschicht an der Erdoberfläche abspielt, während die Atmosphäre mit der Höhe rasch lebensfeindlicher, dünner und kälter wird. Gleichzeitig hat die Erdoberfläche eine deutlich größere Wärmespeicherkapazität als die umgebende Atmosphäre. Wobei sich die Atmosphäre in der Grenzschicht im ständigen Wärmeaustausch und Temperaturausgleich mit der Erdoberfläche befindet. Ein Ansatz, dem hier in etwas geänderter und verallgemeinerter Form gefolgt wird.

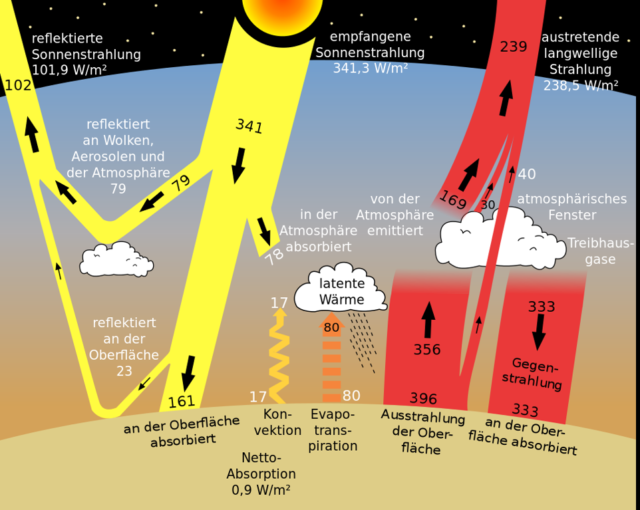

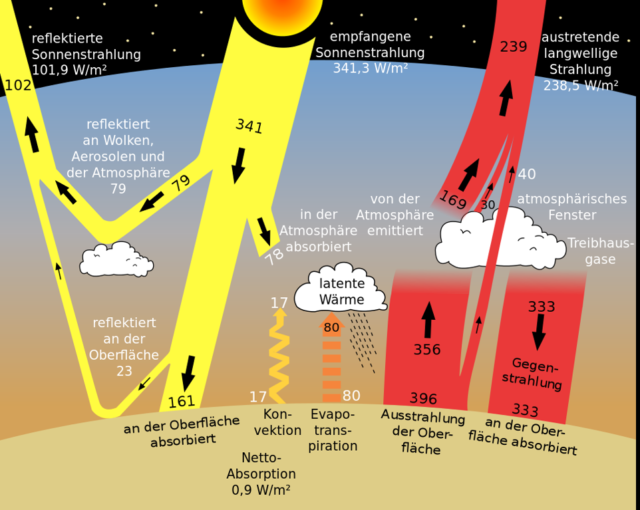

Das nachfolgende Strahlungsdiagramm nach Trenberth-Kiehl beinhaltet zwar ein physikalisch merkwürdiges Phänomen, nämlich die Generierung einer starken Gegenstrahlung in der Atmosphäre, die ausschließlich nach unten strahlt. Doch findet man in der Grafik recht detaillierte Zahlenangaben:

Gemäß obiger Grafik besteht an der Erdoberfläche ein Gleichgewicht aus eingestrahlter Sonnenenergie (So) und wieder abgegebener Energie in Form von Verdunstung (Evap), Infrarotstrahlung (Erad) und Konvektion (Kon).

Dieses Gleichgewicht wird um einen zunächst unbekannten Antrieb („forcing“) X erweitert:

So + Evap + Erad + Konv + X = 0

Der Antrieb X kann dabei unterschiedliche Ursachen haben – am geläufigsten ist der zusätzliche Strahlenantrieb durch vermehrtes CO2. Der Sonnenanteil So bleibt in dieser Bilanz konstant – Änderungen bei der Einstrahlung, z.B. durch veränderte globale Bewölkung, sind im Antrieb X enthalten. Ist der Antrieb X von Null verschieden und die Kühlterme Erad, Evap und Konv ändern sich monoton mit der Temperatur, dann stellen sich Gleichgewicht und Temperatur neu ein. Aus der neuen Gleichgewichtsbilanz erhält man dann die Temperaturänderung ΔT = T – T0, abhängig vom Antrieb X. To ist dabei die global gemittelte Ausgangstemperatur mit 15 ºC bzw. 288 K. Für den Startwert T = T0 gilt X = 0.

Zu der Erwärmung der Erdoberfläche tragen bei:

Sonne:

Gemäß obiger Grafik beträgt die an der Erdoberfläche im Mittel absorbierte Sonneneinstrahlung (So), abzüglich 0,9 Watt/m2 Nettoabsorption:

So = 160 Watt/m2

Zusätzlicher Antrieb X:

Wenn man den Antrieb X ausschließlich einem CO2-Anstieg zuschreibt, dann gilt:

X = 5,35 ⋅ ln (C/Co) [Watt/m²] mit der atmosphärischen CO2-Dichte C

Dieser „Strahlungsantrieb“ entsteht der Theorie zufolge durch spektroskopische Absorption und Emission bei den Resonanzlinien des Spurengases CO2, was in diesem Wellenlängenbereich den Energietransport verlangsamt und was vorwiegend in der dichteren, unteren Atmosphäre geschieht. Die logarithmische Abhängigkeit in der Formelbeziehung für X ist Folge der spektroskopischen Sättigung des CO2 in der Atmosphäre. Der Strahlungsantrieb wächst dabei mit zunehmendem CO2 immer langsamer. Wobei die Verdoppelung der CO2-Dichte C einen zusätzlichen Strahlungsantrieb von X= 3,7 Watt/m2 generiert. Was einer Temperaturerhöhung von 1,1 Grad (einige Autoren nennen etwas höhere Werte) entspricht und als CO2-Klimasensitivität definiert ist.

Zusätzlich gibt es positive Rückkopplung oder Verstärkung, z.B. durch vermehrten Wasserdampf, das bedeutendste Klimagas. Aber auch negative Rückkopplung oder Abschwächung des Strahlungsantriebs, z.B. durch Überdeckung der Absorptionsfenster von CO2 und Wasserdampf, Abkühlung durch vermehrte Wolkenbildung und Aerosole sowie weitere Wechselwirkungseffekte in einer komplizierten, großenteils unverstandenen Atmosphäre spielen eine Rolle.

Man kann sich den Temperaturanstieg der letzten 150 Jahre auch mit natürlicher (Rück-)Erwärmung seit der Kleinen Eiszeit erklären, wie es schon bei früheren Kalt- und Warmzeiten der Fall war – ganz ohne anthropogenes CO2. Wobei allerdings die Ursachen für die damaligen Temperaturänderungen nicht bekannt sind. Auch urbane Wärmeinseleffekte, Landnutzungsänderungen, Energiefreisetzung durch die Menschen, wahrscheinlich auch der Flugverkehr und natürliche periodische Einflüsse (z.B. ozeanische Oszillationen und variierende Sonneneinstrahlung, verstärkt durch den Svensmark-Effekt) tragen bei.

Die Behauptung von Alarmforschern ist falsch, man könne sich den neuzeitlichen Temperaturanstieg nur mit anthropogenem CO2 erklären.

Die Bezeichnung „X“ wird deshalb gewählt, weil der Antrieb X einer black box ähnelt, deren Inhalte man nicht genau kennt.

Wasserdampf-Rückkopplung:

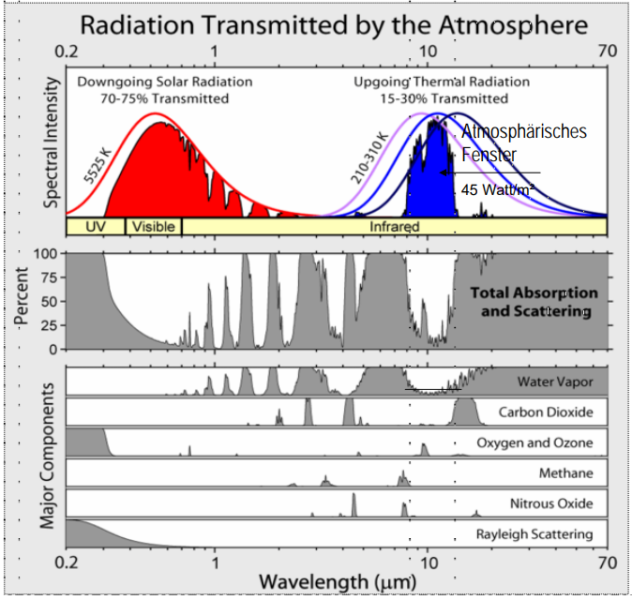

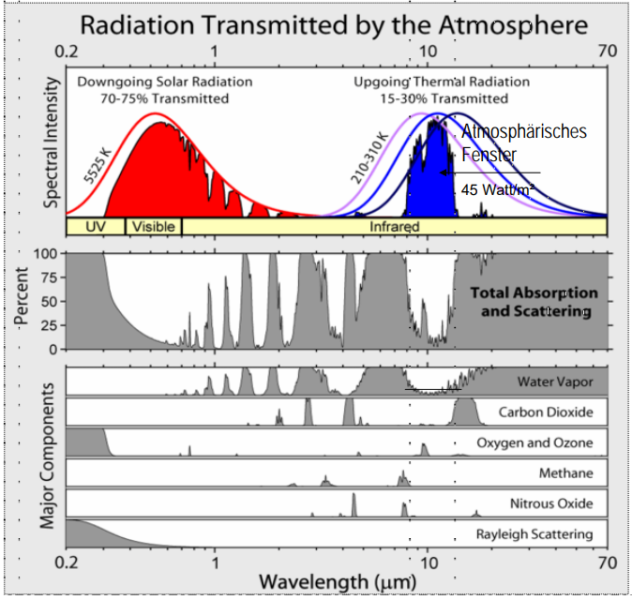

Die Rückkopplung durch zusätzlichen Wasserdampf wird in der Bezugsveröffentlichung aus nachfolgender Grafik für die spektroskopische Transmission in der Atmosphäre ermittelt:

Folgt man der zitierten Arbeit, trägt der Wasserdampf etwa 8 Watt/m2 zum Strahlungsantrieb bei – offensichtlich geschätzt anhand des atmosphärischen Fensters und der Reduktion der durchgehenden Strahlung (nach Trenberth-Kiel 40, in der Bezugsarbeit 45 Watt/m²) durch Wasserdampfabsorption und -streuung. Aufgrund von 7,5 Prozent mehr Wasserdampf pro 1 Grad Temperaturerhöhung wird demnach das Infrarot-Fenster um jeweils 0,6 Watt/m² weiter verkleinert. Was in diesem Modell der (positiven) Wasserdampf-Rückkopplung ΔR entspricht:

ΔR = 8 . (1,075 ΔT – 1) Watt/m2 mit ΔT = T – T0

Die Genauigkeit des Ansatzes soll hier nicht weiter hinterfragt werden. Von der Größenordnung her gehört ΔR zu den kleineren Beiträgen der Oberflächenbilanz. Außerdem ist die positive Wasserdampfrückkopplung ΔR ein Antrieb und in der eingangs aufgestellten Bilanz im Antrieb X mit enthalten. In den üblichen Klimamodellen verstärkt ΔR den Infrarot-Strahlungsantrieb der Klimagase und trägt dort zur Erhöhung der Klimasensitivität bei.

Kühlung der Erdoberfläche:

Verdampfung/Verdunstung:

Die in dem Strahlungsdiagramm (ganz oben) aufgeführte, relativ große Verdunstungswärme von 80 Watt/m2 lässt sich aus Niederschlagsmenge und spezifischer Verdunstungswärme offenbar recht gut ermitteln – weil sämtlicher Wasserdampf als Niederschlag und Tau zur Erde zurückkehrt.

Die Verdunstung von Wasser entzieht der Erdoberfläche Energie und transportiert diese in die höheren Atmosphärenschichten. Dort wird die Energie durch Kondensation (Wolkenbildung) wieder abgegeben und ins Weltall abgestrahlt. Durch das Abregnen der Wolken wird der Wasserkreislauf geschlossen. Für die Stabilität des Klimas ist von großer Bedeutung, dass die Verdunstungswärme stark abhängig von der Oberflächen-Temperatur der Erde ist. Diese Tatsache lässt sich an den Niederschlägen ablesen. Wir wissen, dass die Niederschläge dort am höchsten sind, wo die meiste Wärme von der Erdoberfläche abgeführt werden muss – am Äquator. Wir wissen auch, dass die Niederschläge auf der Erde mit der Erwärmung der letzten 100 Jahre zugenommen haben. Mit durchschnittlich 80 Watt/m² liefert die Verdunstung etwa 50 Prozent des Wärmetransports von der Erdoberfläche Richtung äußere Atmosphäre. Eine höhere Oberflächentemperatur führt zwangsläufig zu einer stärkeren Verdunstung weil Dampfdruck und Aufnahmefähigkeit der Luft für Wasserdampf ansteigen. Bereits ein Grad Erwärmung erhöht die Verdunstung und damit den Wärmetransport um 7,5 %. Bezogen auf den gesamten Wärmetransport von 80 Watt/m² sind das immerhin 6,0 Watt/m² zusätzlicher Kühleffekt an der Erdoberfläche. Die Verdunstung stellt also ein starkes Dämpfungsglied gegen Änderungen des Klimas dar.

Der Wärmetransport durch Verdunstung und dessen Zunahme mit der Temperatur bestimmen das Ergebnis maßgeblich. Für den Dampfdruck von Wasser lässt sich die Zunahme von etwa 7,5 % bei einem Grad Erwärmung verifizieren – z.B. hier. Bei der engl. Wikipedia heißt es: „The rate of evaporation in an open system is related to the vapor pressure found in a closed system.“ Aber was bedeutet „related to“? Lassen sich die Angaben in der Bezugsveröffentlichung bestätigen?

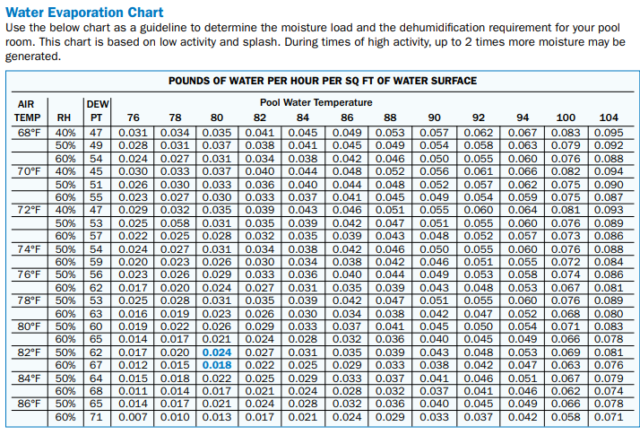

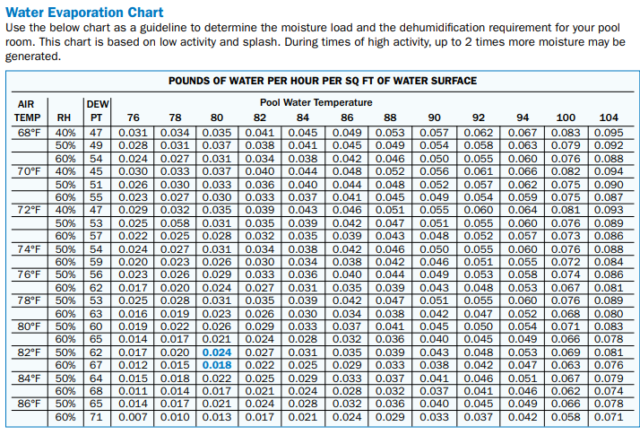

Hilfreiche Zahlen bietet nachfolgende Pool-Tabelle, vermutlich durch Messungen ermittelt. Man sieht dort gut, wie die verdunsteten Wassermengen mit der Temperatur zunehmen, in der Regel sogar um etwas mehr als 7,5%. Dabei ist RH die Relative Luftfeuchtigkeit und DEW PT der Taupunkt, Temperaturen in Fahrenheit.

Die Temperaturschritte von 2 ºF entsprechen jeweils 1,112 ºC. 68 ºF entsprechen 20 ºC und 86 ºF 30 ºC.

Dabei ist zu beachten, dass in den Tropen und in den Regenwäldern das meiste Wasser verdunstet. Auch steigt durch Wellengang und Wind die Verdunstung deutlich an – nach folgender Tabelle bis zu einem Faktor zwei.

Hingegen dürfte über den 29% Landfläche die Verdunstung niedriger sein, regional abhängig von Bodenfeuchte und Bewaldung. Eine mittlere Zunahme von Verdunstung und Wärmetransport um 7,5% je 1 ºC Temperaturerhöhung, wie in der Bezugsarbeit angenommenen, scheinen realistisch.

Hingegen dürfte über den 29% Landfläche die Verdunstung niedriger sein, regional abhängig von Bodenfeuchte und Bewaldung. Eine mittlere Zunahme von Verdunstung und Wärmetransport um 7,5% je 1 ºC Temperaturerhöhung, wie in der Bezugsarbeit angenommenen, scheinen realistisch.

Als Formelbeziehung erhält man damit:

Evap = 80 ⋅ 1,075 ΔT Watt/m2

Evap ist dabei die Verdunstungswärme, ΔT = T – T0.

In der Bezugsveröffentlichung wird der Spezialfall ΔT = 1ºC behandelt.

Strahlung:

Folgt man der Strahlungsbilanz in der ersten Grafik oben, dann werden netto 63 Watt/m2 vom Boden abgestrahlt und davon etwa 40 Watt/m2 direkt in den Weltraum (in der Bezugsarbeit 45 Watt/m2). Die restlichen 23 Watt/m2 nehmen den „Umweg“ über die Atmosphäre. Entscheidend ist aber für die Betrachtung hier, wie viel Strahlung die Erdoberfläche verlässt.

Durch einen veränderten Antrieb X ändert sich die Temperatur T = T0 + ΔT und somit auch die Wärmeabstrahlung Erad mit der 4. Potenz von T:

Erad = 63 · (T/T0)4 Watt/m²

Konvektion:

Konvektion ist der Transport thermischer Energie durch fühlbare Wärme der Luftmassen. Der Antrieb sind Dichteunterschiede. Wird die Erdoberfläche wärmer, verstärkt sich die Thermik und transportiert mehr Energie in Richtung höhere Atmosphäre. Der Anteil der Konvektion am Wärmetransport ist mit knapp 11 Prozent (gemäß TK-Grafik) gering und dürfte gemäß folgender Beziehung mit der Temperatur zunehmen:

Konv = 17 · (1 + ΔT/T0) Watt/m2 mit ΔT = T – T0 und T0 = 288 K

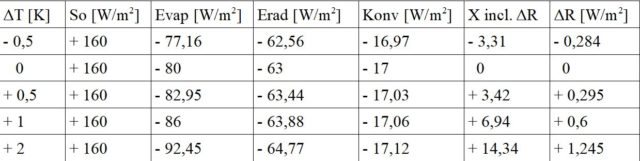

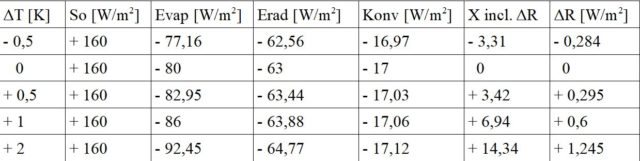

Naheliegend wäre jetzt, in die Oberflächenbilanz die oben aufgeführten Formelbeziehungen einzusetzen, um so die Beziehung zwischen X und ΔT auszurechnen. Einfacher und anschaulicher geht es, wenn man in nachfolgender Tabelle zeilenweise die Änderungen von X und ΔT vergleicht.

Bilanz

Eine Änderung des Antriebs X führt zu einer Temperaturänderung ΔT = T – T0 in der ersten Spalte. Mit der sich ändernden Temperatur T ändern sich auch die Kühleffekte. Es stellt sich ein neues Gleichgewicht ein, die Bilanz ist wieder ausgeglichen. Dabei kommen für den Antrieb X neben Klimagasen auch andere, z.T. natürliche Erwärmungsursachen in Betracht. Berechnet wird X aus der (negativen) Summe von So, Evap, Erad und Konv in der jeweiligen Tabellenzeile. Grundsätzlich sind auch negative Antriebe X möglich mit Temperaturrückgängen wie in der ersten Tabellenzeile, wie sie z.B. infolge bevorstehender solarer Minima eintreten könnten.

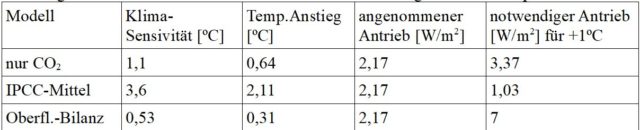

In der Bezugsarbeit wurde eine niedrige Klimasensitivität von 0,58 ºC ermittelt.

Was folgt daraus?

1) Man sieht in der Tabelle, dass der Antrieb X um ca. 7 Watt/m2 wächst für jeweils 1 Grad Temperaturerhöhung. Dabei erkennt man: Mit steigender Temperatur T = T0 + ΔT wachsen die verursachenden Antriebe X schneller als die zugehörigen Temperaturanstiege. Ein runaway-Effekt bei den Temperaturen ist deshalb nicht zu befürchten.

Bei spektroskopischer Erwärmung nur durch CO2 beträgt bei CO2-Verdoppelung der CO2-Antrieb 3,7 Watt/m2. Was in den bisherigen Klimamodellen einer Temperaturerhöhung bzw. CO2-Klimasensitivität von 1,1 Grad entspricht. Im Oberflächenmodell steigen bei einem gleichgroßen Antrieb die Temperaturen nur um 0,53 Grad – hauptsächlich als Folge der Verdunstungskühlung.

Was recht gut mit der Bezugsarbeit übereinstimmt. Berücksichtigt man ferner, dass X alle natürlichen und anthropogenen Antriebe mit enthält, dann ist eine Klimasensitivität von 0,53ºC sehr niedrig und zu vernachlässigen. Umgekehrt gilt genauso: Eine (utopische) Dekarbonisierung wird die Temperaturen kaum beeinflussen. In der Bezugsarbeit wird auf weitere Arbeiten verwiesen, die ähnlich niedrige Ergebnisse für die Klimasensitivität ermitteln.

Zur Erinnerung: Der IPCC gibt für die CO2-Klimasensitivität eine Spanne von 1,6 bis 5,6 Grad C an, aber nur mit einer Wahrscheinlichkeit von 66%. Was um eine Größenordnung höher ist.

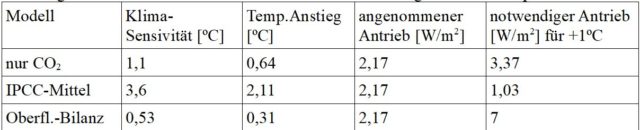

In den letzten 150 Jahren sind die globalen Temperaturen offenbar um 1 Grad gestiegen. Das CO2 in der Atmosphäre dabei um knapp 50%, was einem CO2-Antrieb von 2,17 Watt/m2 entspräche. Dazu eine Vergleichstabelle für diesen Antrieb und den Auswirkungen auf die Temperaturen:

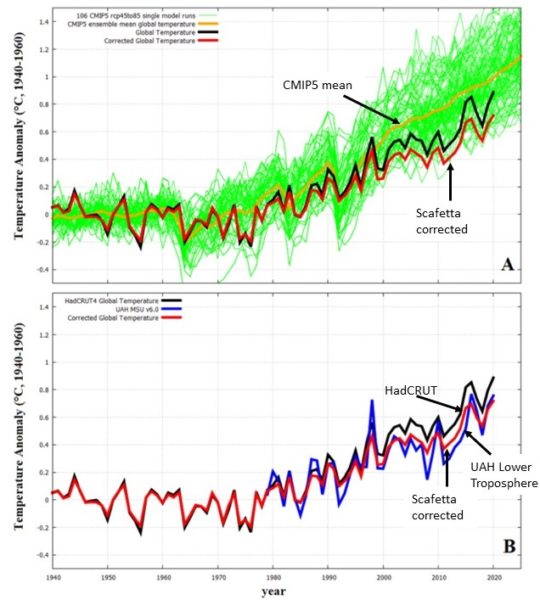

Bei der Rechnung gemäß Oberflächenbilanz ist noch viel Raum für weitere Antriebe wie z.B. Wasserdampf-Rückkopplung oder andere, nicht-anthropogene Antriebe. Das anthropogene CO2 alleine reicht für 1 Grad Temperaturerhöhung hier bei weitem nicht. Während der IPCC mit positiver Wasserdampf-Rückkopplung rechnet und diesen Wasserdampf-Zusatzantrieb der CO2-Klimasensitivität zuschlägt – nur das anthropogene CO2 ist alleiniger Übeltäter! Und mit seinen Computer-Klimamodellen viel zu hohe Temperaturen errechnet. Halbwegs passend wird es nur, wenn der IPCC die niedrigeren Klima-Sensitivitäten am unteren Rand seines Unsicherheitsbereichs verwendet. Auch gibt es kaum Platz für natürliche Antriebe, deren Existenz der IPCC im Wesentlichen bestreitet.

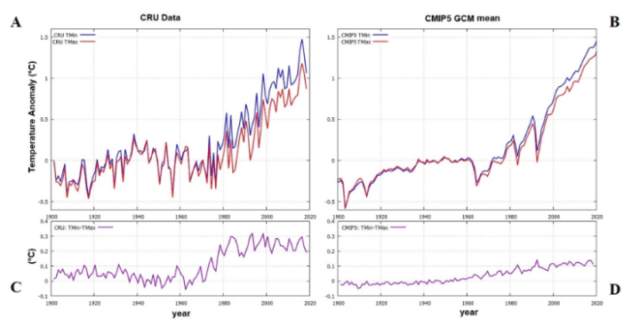

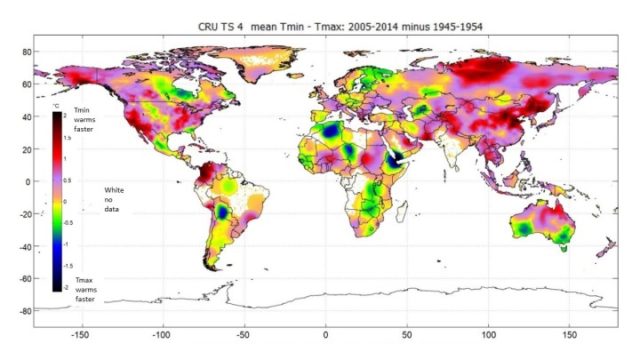

So spricht für das Oberflächenmodell unter anderem, dass die Temperaturprognosen des IPCC meist zu hoch liegen. Auch die höheren Landtemperaturen stimmen mit dem Oberflächenmodell überein, weil es an Land meist weniger Verdunstung gibt. Allerdings tragen dazu auch Wärmeinseleffekte, Landnutzungsänderungen und die Temperaturträgheit der Ozeane bei. Für das Oberflächenmodell spricht ferner, dass alle beteiligten Größen gut verstanden sind – im Gegensatz zu den Klimamodellen des IPCC.

2) Die Wasserdampf-Rückkopplung ΔR wurde in der Bezugsarbeit näherungsweise aus der Grafik oben für die spektrale Transmission in der Atmosphäre abgeleitet. Interessant ist die Größenordnung: Als Effekt zweiter Ordnung ist die (zusätzliche) Wasserdampf-Rückkopplung deutlich kleiner als der auslösende Antrieb – was plausibel ist.

3) Ein weiterer Aspekt ist bemerkenswert: Es wird der große Einfluss der Verdunstungswärme auf das Temperaturgeschehen deutlich. Mehr Verdunstung, wie es bei höherer Bodenfeuchte der Fall ist, wirkt kühlend, senkt dadurch die Temperaturen und umgekehrt.

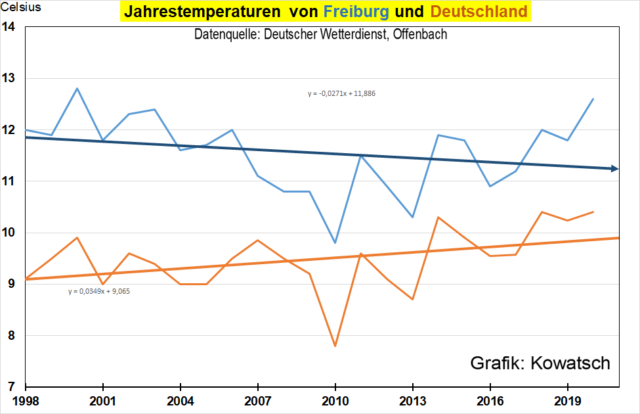

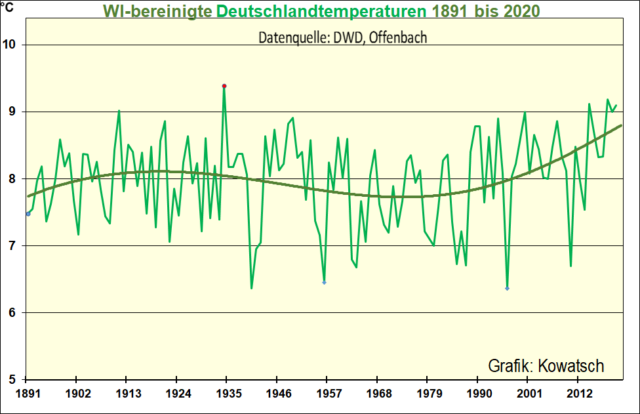

Wenn die Herren Kowatsch und Kämpfe in Deutschland eine zunehmende Trockenheit aufgrund menschlicher Eingriffe in den Wasserhaushalt aufzeigen, dann führt die verringerte Verdunstungskühlung zu zusätzlicher Erwärmung.

Autor: Dr. Roland Ullrich ist Physiker und promovierte an der TU München über Plasmaphysik.Sein Berufsweg führte ihn von der Plasmaphysik, einem kurzen Ausflug in die Welt der Metallhydridspeicher zu einer überwiegend gutachterlichen Tätigkeit in der technisch-wissenschaftlichen Analyseabteilung einer Bundesbehörde.