Manipulation der Daten zum Meeresspiegel

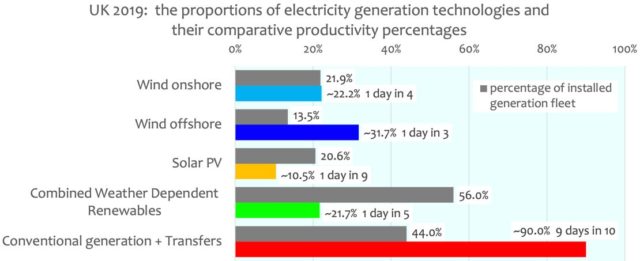

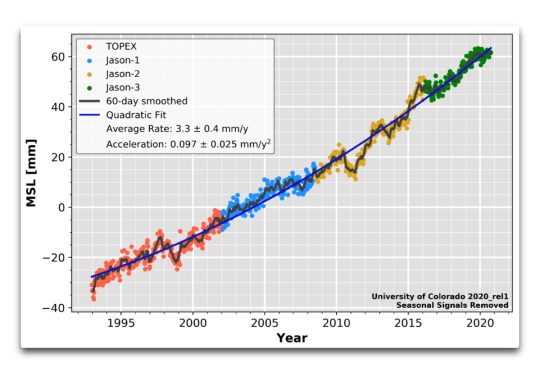

Erstens: Warum zeigen die satellitengestützten Meeresspiegeldaten, dass der Meeresspiegel so viel schneller steigt als der Anstieg, der an Gezeitenstationen an den Küsten der Welt gemessen wird? Die Aufzeichnungen der Gezeitenstationen zeigen einen Anstieg in der Größenordnung von ein paar Millimetern pro Jahr, eine Rate, die sich über die etwa hundert Jahre, für die wir ausreichende Aufzeichnungen haben, kaum verändert hat. Die Satellitenaufzeichnungen (Abbildung 1) zeigen jedoch einen Anstieg von 3,3 mm/Jahr. Warum der große Unterschied?

Zweitens: Warum zeigt der satellitengestützte Meeresspiegel eine so deutliche Beschleunigung? Wie oben erwähnt, zeigen die Aufzeichnungen des Meeresspiegels von Gezeitenstationen, die viel länger sind, wenig oder keine Beschleunigung. Aber die Satellitenaufzeichnungen behaupten, dass die Rate des Meeresspiegelanstiegs um etwa einen Zehntel Millimeter pro Jahr zunimmt. Eine solche Beschleunigung würde den Anstieg des Meeresspiegels in etwa dreißig Jahren verdoppeln. Noch einmal: Warum der große Unterschied?

Zunächst einmal: Hier ist, was die Satellitendaten laut der University of Colorado Sea Level Research Group zeigen:

Abbildung 1. Meeresspiegeldaten der University of Colorado, die den Trend und die Beschleunigung zeigen. Beachten Sie, dass die Grafik keine Überschneidungen zwischen den einzelnen Satellitenaufzeichnungen zeigt. QUELLE: UCSLR-Gruppe

Ich habe diese Woche wieder über diese Fragen nachgedacht, also ging ich zu NOAA und holte mir deren Excel-Tabelle, die den kompletten Datensatz für jeden der vier Satelliten zeigt.

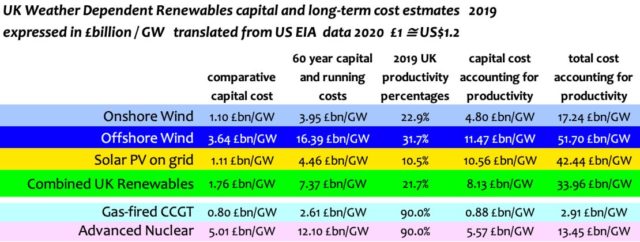

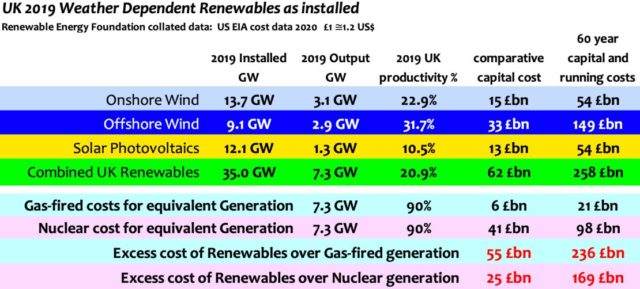

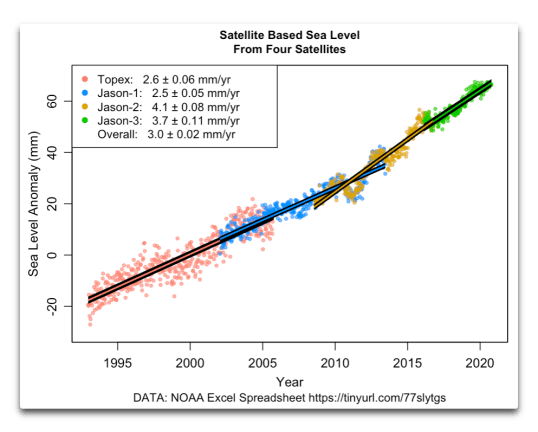

Ich habe die NOAA-Daten aufgezeichnet. Aber im Gegensatz zu den Colorado-Daten oben, habe ich die volle Überlappung zwischen den einzelnen Satelliten mit einbezogen. Dann habe ich die Rate des Meeresspiegelanstiegs, die von jedem der vier Satelliten angezeigt wird, separat betrachtet. Abbildung 2 zeigt das Ergebnis.

Abbildung 2. NOAA-Meeresspiegeldaten, die den Trend der einzelnen, vollständigen Satellitenaufzeichnungen und den Gesamttrend zeigen. QUELLE: NOAA-Excel-Tabelle

Es scheint, als hätte ich nach all den vielen Jahren der Verwunderung endlich eine Antwort auf meine beiden Fragen. Der Trend ist so groß und die Beschleunigung ist aus einem einfachen Grund so groß. Die beiden jüngsten Satelliten zeigen Trends, die deutlich größer sind als die der beiden früheren Satelliten. Die ersten beiden Satelliten stimmen recht gut überein, aber sie zeigen beide einen viel kleineren Trend als die beiden letzten Satelliten. Und keine der beiden Hälften der Satellitenaufzeichnungen zeigt eine Beschleunigung.

Was man oben sieht sind die Fakten, wie sie von der NOAA angegeben werden, und ich habe oben die Quelle dieser Fakten verlinkt. Und es scheint mir, dass diese Fakten mehr als ausreichend sind, um die Satellitenaufzeichnung des Meeresspiegels vollständig zu diskreditieren.

Und um zum eigentlichen Thema zurückzukehren, warum zeigen die NOAA-Daten einen Gesamttrend, der um 0,3 mm pro Jahr geringer ist als die Colorado-Daten? Das liegt daran, dass die Colorado-Daten das enthalten, was „GIA“ genannt wird, und die NOAA-Daten nicht.

„GIA“ steht für die „glaziale isostatische Anpassung“. Es gibt eine Beschreibung davon auf der Colorado-Seite hier. Sie bezieht sich auf die Veränderungen der Gesamtform der Erde aufgrund des Abschmelzens der riesigen und immens schweren Eisschilde der letzten Eiszeit.

Laut dieser Seite wird die GIA „unabhängig aus Modellen auf -0,3 mm/Jahr geschätzt (Peltier, 2001, 2002, 2009; Peltier & Luthcke, 2009)“.

Nun ist ein Computermodell nichts anderes ist als eine physikalische Umsetzung der Überzeugungen, Erkenntnisse und insbesondere der Missverständnisse der Person, die den Computer programmiert. Da Mr- Peltier an der Programmierung aller vier auf der Colorado-Seite aufgeführten Modellrealisierungen beteiligt war, ist ihre Behauptung, die vier Modelle seien „unabhängig“, lächerlich. Was wir haben, ist die Behauptung eines Mannes, dass er den GIA berechnen kann.

Welchen Effekt hat die GIA? Die Colorado-Seite sagt (Hervorhebung von mir):

Vor der Veröffentlichung 2011_rel1 haben wir die GIA bei den Schätzungen des globalen mittleren Meeresspiegels nicht berücksichtigt, aber diese Korrektur ist jetzt wissenschaftlich gut verstanden und wird von fast allen Forschungsgruppen auf der ganzen Welt auf die GMSL-Schätzungen angewendet. Die Einbeziehung der GIA-Korrektur hat den Effekt, dass frühere Schätzungen der globalen mittleren Meeresspiegelrate um 0,3 mm/Jahr erhöht werden.

Da sind also die fehlenden 0,3 mm/Jahr, angewandt von „fast allen Forschungsgruppen“ … Ich schätze, die NOAA hat das nicht mitbekommen.

Für mich ist die Behauptung, dass ein Computermodell die Veränderung des Gesamtvolumens aller verschiedenen Ozeanbecken der Welt auf die nächsten 0,3 mm pro Jahr des Meeresspiegels berechnen kann, unglaubwürdig, und zwar aus folgendem Grund.

Für den Landteil der Berechnung müssen diese „unabhängigen“ Computermodelle GPS-Höhen verwenden. Durch die Verwendung von Split-Phase-GPS und wiederholten Messungen können diese bis zu ± 10 mm oder besser genau sein, eine erstaunliche wissenschaftliche Leistung … aber das ist weit entfernt von einem Zehntel Millimeter, und das nur an Land. Nicht nur das, wir haben auch keine GPS-Messungen im ganzen Land. Sie konzentrieren sich auf die USA und Europa, während sie anderswo nur sporadisch genutzt werden.

Auf dem Meer müssen die „unabhängigen“ Modelle Satellitenmessungen verwenden, so dass sich die Frage nach der Genauigkeit und Präzision der Satellitenmessungen des Meeresspiegels selbst stellt. Diese Messungen werden durchgeführt, indem Radarwellen von der Meeresoberfläche zurückgeworfen werden und gemessen wird, wie lange es dauert, bis sie zum Satelliten zurückkehren. Hier sind wiederholte Messungen nicht möglich, da sich der Meeresspiegel an jedem Punkt ständig ändert und der Satellit selten zweimal an der gleichen Position ist. In einer aktuellen NASA-Pressemitteilung zum Sentinel-6-Satelliten, dem Nachfolger des Jason-3-Satelliten, wird der Ozeanograph Josh Willis zitiert:

Sentinel-6 wird in einer Umlaufbahn in etwa 1300 km Höhe kreisen und mit Hilfe von Radar die Oberfläche des Ozeans messen. Ein Instrument auf dem Satelliten sendet eine Radarwelle hinunter zur Erde. Die Radarwelle wird von der Meeresoberfläche reflektiert und kehrt zum Satelliten zurück. Durch die Messung der Zeit, die das Radar für den Hin- und Rückweg benötigt – und unter Berücksichtigung der Feuchtigkeit in der Atmosphäre, die das Radar verlangsamt – können die Wissenschaftler messen, wie weit die Meeresoberfläche vom Satelliten entfernt ist.

Mit anderen Worten: Der Satellit kann den Wissenschaftlern auf der Erde mitteilen, wie hoch die Ozeane sind und wie sich diese Höhe im Laufe der Zeit verändert.

„Es ist wirklich eine unglaubliche technische Leistung“, sagt Josh Willis. „Wir können den Wasserstand mit einer Genauigkeit von 25 mm aus 1300 km Höhe messen.“

Eine Genauigkeit von 25 mm … und sie behaupten, sie kennen die jährliche Veränderung des Volumens der Ozeane aus dem GIA auf das nächste Zehntel eines mm der Meeresspiegelhöhe? Ich weiß, dass Genauigkeit etwas anderes ist als Präzision, und dass die Messung von Längenänderungen im Laufe der Zeit (Präzision) um eine Größenordnung besser sein kann als die Messung der Länge selbst (Genauigkeit), aber trotzdem … sorry, aber ich kaufe dem GIA die Behauptung nicht ab.

Schauen wir mal, ob ich Ihnen ein Gefühl für die Schwierigkeit der Satellitenmessungen des Meeresspiegels geben kann. Die Satelliten kreisen in einer Höhe von etwa 830 Meilen, das sind etwa 1,34 Milliarden Millimeter. Um also die Veränderung des Meeresspiegels auf ein Zehntel Millimeter genau zu messen, müssten wir in der Lage sein, den Abstand zwischen dem Satelliten und der Meeresoberfläche mit einer Genauigkeit von mehr als einem Teil in dreizehn Milliarden zu messen … und das ist selbst in einer kontrollierten Laborumgebung eine große Herausforderung.

Hier sind einige der Schwierigkeiten bei dieser Messung. Die erste ist die Messung der Höhe des Satelliten selbst. Wenn wir das nicht auf den Millimeter genau für jede Sekunde eines jeden Tages wissen, werden wir ungenaue Antworten erhalten. Der nächste Punkt ist die unterschiedliche Zusammensetzung, Temperatur, Bewölkung und Feuchtigkeit der Atmosphäre. All diese Faktoren verändern die Zeit, die das Radarsignal braucht, um zum Satelliten zurückzukehren. Dann gibt es die Meereswellen, die offensichtlich die Höhe des Ozeans um Tausende von mm verändern. Schließlich gibt es noch die „Instrumentendrift“, die unvermeidlichen Veränderungen, die bei elektronischen Messinstrumenten mit der Zeit auftreten.

Nettoergebnis? Nun, das Nettoergebnis ist in Abbildung 2 oben zu sehen, wo laut der Universität von Colorado ein Satellit sagt, dass der Meeresspiegel mit 2,5 mm/Jahr ansteigt, und nur 8 Tage nach dem Ende der Daten dieses Satelliten (das Intervall zwischen einem Satelliten und dem nächsten in der Colorado-Meeresspiegelaufzeichnung) sagt der Nachfolgesatellit, dass er mit 4,1 mm/Jahr ansteigt … no bueno. Sie behaupten, dass in 8 Tagen die Anstiegsrate um 1,6 mm pro Jahr gestiegen ist. Beachten Sie auch, dass es in beiden Hälften der Satellitenaufzeichnung absolut keine Beschleunigung gibt, sondern nur eine schrittweise Veränderung zwischen den Satelliten. Offensichtlich sind sie nicht in der Lage, jährliche Änderungen des Meeresspiegels auf den nächsten Millimeter genau zu messen, geschweige denn auf den nächsten Zehntelmillimeter.

Die Leute, die an dem Projekt arbeiten, sind jedoch alle wahre Gläubige. Im selben Artikel wird Josh Willis mit den Worten zitiert: „Wir wissen, dass die Ozeane wegen der vom Menschen verursachten Eingriffe in das Klima steigen.“

Verdammte Menschen, die sich immer in das Klima einmischen … zum Beispiel hat unser neuer „Klima-Zar“ John Kerry 5 Häuser, eine Reihe von Autos, eine Yacht und einen Privatjet, und er sagt uns, dass wir den Bus nehmen sollen, um die gefürchtete, „vom Menschen verursachte Störung des Klimas“ zu vermeiden … aber ich schweife ab.

Das Problem ist, dass der Start mit einer festen „wissenschaftlichen“ Überzeugung wie dieser dazu führt, dass die Leute, die an den Satelliten-Meeresspiegel-Datensätzen arbeiten, „befangen“ sind. Sie kleben die offensichtlich inkompatiblen Satellitenergebnisse zusammen, streichen Erdnussbutter über die Risse, damit sie nicht gesehen werden können, und verkünden der Welt, dass die Satelliten eine gefährliche Beschleunigung des Meeresspiegelanstiegs zeigen, so dass wir alle sehr besorgt sein sollten …

Ich habe schon seit einiger Zeit gesagt, dass wir den Satellitenergebnissen kein Gewicht beimessen sollten. Ich habe dies jedoch ausschließlich auf die sehr großen Unterschiede sowohl im Trend als auch in der Beschleunigung zwischen den Satelliten- und den Gezeitenstationsaufzeichnungen gestützt, sowie auf die bekannten Schwierigkeiten bei Satellitenmessungen, die oben diskutiert wurden. Ich habe diese Frage in mehreren Beiträgen untersucht, darunter „Inside The Acceleration Factory“ und „Accelerating The Acceleration“.

Aber jetzt, endlich, habe ich die Fakten, die meine Behauptung untermauern. Es gibt keine Beweise für eine Beschleunigung des Meeresspiegelanstiegs, weder in den Tidenmessungen noch in den schäbig zusammengeschusterten Satellitenaufzeichnungen. Er steigt seit geraumer Zeit in der Größenordnung von 200 mm pro Jahrhundert, und es gibt keine Anzeichen für eine Veränderung dieser Anstiegsrate.

Es steht einem also frei, das zu tun, was Obama und Bill Gates getan haben – Grundstücke am Meer kaufen. Sie verkünden lautstark, dass der Meeresspiegel gefährlich ansteigt, aber wie die Mehrheit der Klimaalarmisten überführen ihre Taten deren Worte als Scheinheiligkeit.

Link: https://wattsupwiththat.com/2021/02/21/munging-the-sea-level-data/

Übersetzt von Chris Frey EIKE

Anmerkung des Übersetzers: Einige ausschweifende Passagen Eschenbachs wurden bei der Übersetzung nicht berücksichtigt.