Vanuatu geht unter, Gebete könn(t)en jedoch helfen …

Das Land, welches am meisten vom Klimawandel bedroht ist

Nordbayerische Nachrichten, Lokalausgabe vom 01. März 2021

Artikel „Vanuatu steht im Mittelpunkt“ Der WELTGEBETSTAG lenkt den Blick auf den Inselstaat, den der Klimawandel hart trifft

… In diesem Jahr steht der pazifische Inselstaat Vanuatu im Mittelpunkt … denn die insgesamt 83 Inseln im pazifischen Ozean sind vom Klimawandel betroffen, wie kaum ein anders Land … Die steigenden Wassertemperaturen gefährden Fische und Korallen, nach deren Absterben treffen die Wellen mit voller Wucht auf die Inseln und tragen sie Stück für Stück ab. Steigende Temperaturen und veränderte Regenmuster lassen Früchte nicht mehr so wachsen wie früher … Doch es steigt nicht nur der Meeresspiegel, auch die tropischen Wirbelstürme werden stärker. So zerstörte zum Beispiel 2015 der Zyklon Pam einen Großteil der Inseln, 24 Menschen starben …

Dazu der Verweis auf ein „Belegvideo“ über Vanuatu: www.kirche-langenzenn.de/wgt_vanuatu.

Wer „gewöhnungsbedürftige“ Stimmen von Laiensprechern und kirchlichen Duktus mag, mag es sich antun. Information bietet das Video allerdings keine, nur zusätzliche Horrormeldungen.

Bild 1 Kirchliches „Belegvideo“ über das besonders vom Klimawandel betroffene Vanuatu. Link

Kirchliches Video zu Vanuatu: … auf dem Pazifischen Feuerring, viele Erdbeben, durch Tsunamis beeinflusst … leben (noch) im Einklang mit der Natur und ernähren sich von dem, was der Regenwald ihnen an Früchten schenkt und was sie im Meer fangen … für tropische Gefilde recht moderate Temperaturen … Vanuatu gilt weltweit als das Land, das am meisten vom Klimawandel bedroht ist … Durch die Erwärmung der Meere sterben die Korallen ab … tropische Wirbelstürme sind in Vanuatu nichts ungewöhnliches, durch den Klimawandel werden sie allerdings immer heftiger … Pam mit Windgeschwindigkeiten von bis zu 280 km/h … als besonders schwerwiegende Folge des Klimawandels gelten die veränderten Regenmuster. Die Durchschnittstemperaturen steigen und insgesamt fällt weniger Regen. Das führt bereits jetzt zu Ernteausfällen … Pam gilt als die schwerste Naturkatastrophe Vanuatus in der jüngeren Vergangenheit …

Eine Nachfrage bei den Initiatoren der Kirche ergab, dass die Information zu Vanuatu von einer Frau K. D. Buck (Journalistin Religionswissenschaftlerin, Politologin und Autorin) stammt, welche dazu extra (auf Spesen) nach Vanuatu reisen durfte um vor Ort zu recherchieren. Darüber gibt es auch einen Podcast:

Bild 2 Podcast, Link

Leider ist in dem Podcast-Interview weniger über Klimawandel die Rede. Frau Buck ist erkennbar eine felsenfest überzeugte Klimaaktivistin und reiste (erstmals in ihrem Leben) in den Pazifik, um ihre Überzeugung bestätigt zu finden. Über die Bestätigungen kann sie allerdings außer anderswo abgelesenen Allgemeinplätzen – die Menschen auf Vanuatu sind die die das ausbaden was wir verursachen, man kann da schon von einer Opferbeziehung sprechen, sowie „alles wird schlimmer“ – scheinbar nichts sagen.

Und so behandelt der wesentliche Teil des Podcast religiöse Themen und Gewalt gegen Frauen, die bei den dortigen Christen wohl sehr stark verbreitet ist.

Wer sich die Recherche des Autors zu Vanuatu [1] aufgrund des SZ-Berichtes vom letzten Jahr durchliest, findet bereits darin zu fast allen Themen welche Frau D. Buck anspricht ausreichend Information – durch die ebenfalls dazu extra hingereiste Redakteurin Ann Esswein und als Erwiderung durch den Autor. Frau Buck hätte dem Klima also viel mehr nützen können, wenn sie einfach die „Recherche“ von Ann Esswein übernommen hätte, denn dieser hat sie (nach dem, was der Autor bisher von ihr darüber erfahren hat) wirklich nichts Ergänzendes beigetragen.

Ganz stark erinnert es den Autor an die Reise einer Bundestagsdelegation, die eine ähnliche Intention hatte, ebenfalls auf Spesen abrechnete und verblüffen ähnliche Aussagen lieferte – die nur ebenfalls nicht mit der Wirklichkeit übereinstimmten:

[Link] EIKE 30. April 2019: Claudia Roth auf Forschungsreise zum Klimawandel

Und zielorientiert etwas dagegen tut

Höchst interessant, was Vanuatu sich als Maßnahme gegen den schlimmen Klimawandel ausgedacht hat. Es erinnert direkt an die EU und unsere eigene Umweltministerin. Doch auf jeden Fall hat es immer einen Nutzen, denn es spült Geld in die Kassen:

… um dem Klimawandel entgegenzuwirken, gilt seit zwei Jahren in Vanuatu ein rigoroses Verbot von Einwegplastiktüten, Trinkhalmen und Styropor. Wer dagegen verstößt, muss mit einer Strafe von bis zu 900 Dollar rechnen …

Alleine diese „Information“ in einer „Klimawandelrecherche“ stolz herauszustellen, ist für den Autor ein Beleg, dass keinerlei Kenntnis noch Mühe aufgewandt wurde, die „Recherche“ mit Fakten begründen zu wollen.

Vor einem Jahr ging Vanuatu noch nicht unter

Im Mai letzten Jahres hat der Autor aus ähnlichem Anlass bereits über Vanuatu berichtet: [1] Die SZ im Agitationsmodus. Und die Wahrheit bleibt wieder auf der Strecke

Man erkennt daran – Geschichte(n) wiederholt sich (wenn alleine Agitation das Thema bestimmt).

Die damalige Einleitung: [1] … Um dies zu belegen, durfte dank Unterstützung von diversen Organisationen … eine als Redakteurin „getarnte“ Aktivistin … vor Ort reisen und dort (angeblich) besonders Klima-sachkundige Personen interviewen…. Aufgrund deren herzzerreißender Schilderungen setzte sie sich hin und schrieb für die SZ-Leser eine drei volle Seiten lange Geschichte um die edlen, im Einklang mit der Natur lebenden Einwohner vor Ort und die bösen Mächte im reichen Westen, welche diesen mit ihrer CO2-Emission buchstäblich das Leben zur Hölle und die Zukunft kaputt machen.

Doch, das ist der Kern dieser Wochenendgeschichte: Die Inselregierung ist aktiv und weiß sich zu wehren, indem sie diese bösen (reichen) Mächte verklagen will. Natürlich nicht, damit diese nur Buße tun, sondern damit ihnen gutes (und viel) Geld als Wiedergutmachung überwiesen werde.

Die SZ-Leser, welche – sofern solche Prozesse gewonnen werden -, indirekt mit zu den Zahlenden gehören, sollen dies als einen gerechten – und vor allem selbstverständlichen – Ausgleich für die Schäden der durch ihre Emission losgetretenen Naturgewalten begreifen. Und unterstützen, dass NGOs und Anwaltskanzleien im eigenen Land die Prozesse für solche Staaten vorantreiben.

Ausgerechnet von einem Untergang kann bei Vanuatu immer noch keine Rede sein. Denn diese Inselgruppe besteht aus bergigen Vulkangipfeln und nicht aus flachen Atollen. Ein Drittel des Landes liegt über 300 m hoch. „Gefährdet“ sind die Bewohner nur, weil sie ihre Dörfer aus Bequemlichkeit direkt am Strand errichten, um möglichst wenig Fußweg zu ihren Fischerbooten zu haben.

Allerdings versinkt Vanuatu wirklich (ganz langsam) im Pazifik. Jedoch nicht wegen dem Klimawandel, sondern weil es die Plattentektonik so „will“:

[1] ntv Dienstag, 26. Juli 2011: Umsiedlung im Pazifik Klimawandel nicht allein schuld

… Das Wasser rückte immer näher. Deswegen verließen die Einwohner den Hauptort der pazifischen Insel Tegua. Lange Zeit wurde für den Anstieg des Meeresspiegels der Klimawandel alleine verantwortlich gemacht. Forscher stellen jetzt aber auch noch eine andere Ursache fest.

Das zum Inselstaat Vanuatu gehörende Eiland sinkt aufgrund der Plattentektonik nach unten. Damit erscheint der beobachtete Wasseranstieg dramatischer, als er ist …

Sie kommen zu dem Schluss, dass die kleine Inselgruppe Torres Island, zu der auch Tegua gehört, durch die geologischen Prozesse etwa einen Zentimeter im Jahr tiefer rutscht (-0,94 Zentimeter +/- 0,25 Zentimeter). Hinzu kommt ein Meeresspiegel-Anstieg von etwa 1,2 Zentimetern (+/- 0,15 Zentimeter). Beides zusammengenommen ergibt den beobachteten schnellen Anstieg. Die Resultate seien auch für die Analyse des steigenden Meeresspiegels in anderen Regionen der Welt von Bedeutung.

Anmerkung: In der Darstellung von ntv hat sich ein gravierender Fehler eingeschlichen. Wahrscheinlich aufgrund der mangelnden Kenntnis der Redaktion fiel nicht auf, dass wohl eine Kommastelle verschoben wurde:

Der Tidenpegel-Anstieg beträgt nicht „etwa 1,2 Zentimeter“, sondern je nach Lage 1 … 2,5 mm pro Jahr. Wenn die Plattentektonik dann wirklich „-0,94 Zentimeter“ Senkung pro Jahr verursacht, übersteigt diese Wirkung die des Pegelanstiegs um das 5 … 10-Fache. Nur gibt es dafür keine Reparationszahlungen des reichen Westens.

… aber viele Probleme waren schon da

Wenn ein Land/Region „ganz besonders“ vom Klimawandel betroffen ist, kann man davon ausgehen, dass es große Probleme hat die allerdings nicht vom Klimawandel rühren und hoher Geldbedarf besteht, der sich am Einfachsten aus dem Klimaschutzfond „decken“ ließe.

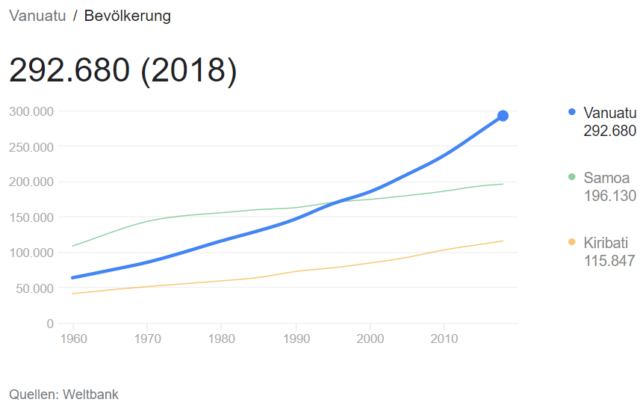

Immer lohnt es sich, die Bevölkerungsrate anzusehen um gängige Probleme zu ahnen. Seit 1960 ist diese von ca. 70.000 auf aktuell wohl 300.000 gestiegen.

Man kann ahnen, dass diese Bevölkerungsdichte auf kleinen Inselgruppen, welche von der Natur nur für geringste Besiedlungsdichten „vorgesehen“ sind, massive Probleme bereitet und eine Aussage: und ernähren sich von dem, was der Regenwald ihnen an Früchten schenkt und was sie im Meer fangen … stark historisierend ist: WIKIPEDIA: 2010 wurden Agrargüter im Wert von 24 Mio. US-$ exportiert; jedoch mussten Nahrungsmittel im Wert von 56,3 Mio. US-$ importiert werden

Auch sonst ist das Land für die meisten Einwohner keineswegs das berichtete Paradies:

Riskantes Leben auf Vanuatu | Wissen & Umwelt | DW | 19.03.2015:

... Schon in stabilen Zeiten haben gerade einmal 57 Prozent der Bevölkerung Vanuatus Zugang zu sanitären Anlagen und Abwasserbeseitigung … Einer von zehn Bewohnern der Inselgruppe lebt in extremer Armut, acht Prozent der Bevölkerung sind unterernährt … Meist vermieden Politiker im Anschluss an die Katastrophe, die Schuld für schlechte Prävention und unzureichende Rettungsmaßnahmen auf sich und die Regierung zu nehmen.

Zudem ist das Archipel Malariagebiet, was alleine 20 % Kindersterblichkeit unter 5 Jahren bedingt [Link]. Auch Dengue-Fieber ist verbreitet.

Da das Archipel direkt auf dem hoch aktiven Pazifischen Feuerring liegt (dem alleine es seine Entstehung verdankt) sind Vulkanausbrüche und schwerste Erdbeben, auch mit folgenden Tsunamis, regelmäßige Erscheinungen.

Welchen Anteil hat nun (vielleicht) der Klimawandel?

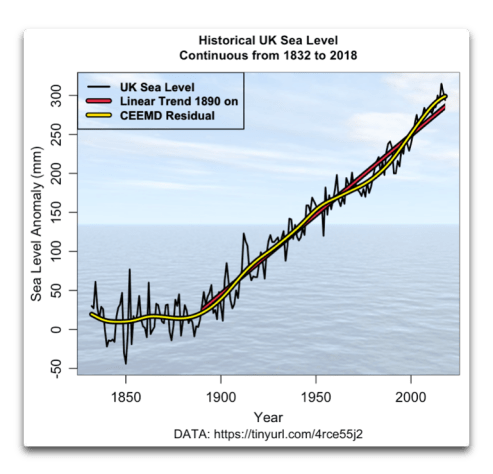

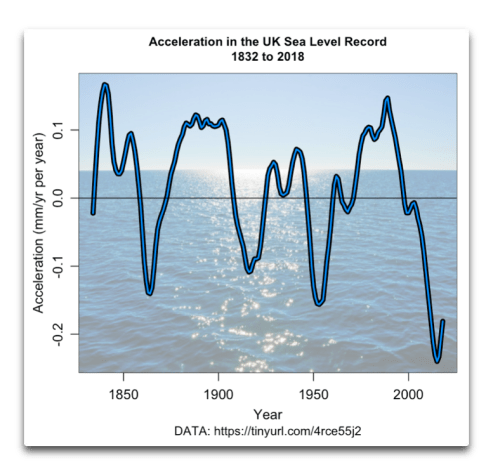

Steigende Pegel

Die Kirche sagt zwar nicht direkt etwas über steigenden Meerespegel. Auf die Anfrage des Autors kam allerdings auch eine Linkliste mit „Information“ zum Thema. Und in dieser Listung ist auch der Link zu einem Video der Ann Esswein (SZ-Bericht über Vanuatu [1]) Spiegel, 13.04.2020: „Zu weit entfernt für die Klimapolitik“

Erosion, Zyklone, Überschwemmungen – an keinem anderen Ort der Welt wird das Ausmaß des Klimawandels sichtbarer als im Inselstaat Vanuatu. Hilfe gibt es kaum, die Bewohner fühlen sich im Stich gelassen.

Und darin geht es handfest um aufgrund des Klimawandels steigenden Meerespegel, zumindest dürfen es Einheimische kommentarlos in die Kamera anhand schlimmer Geschichten erzählen.

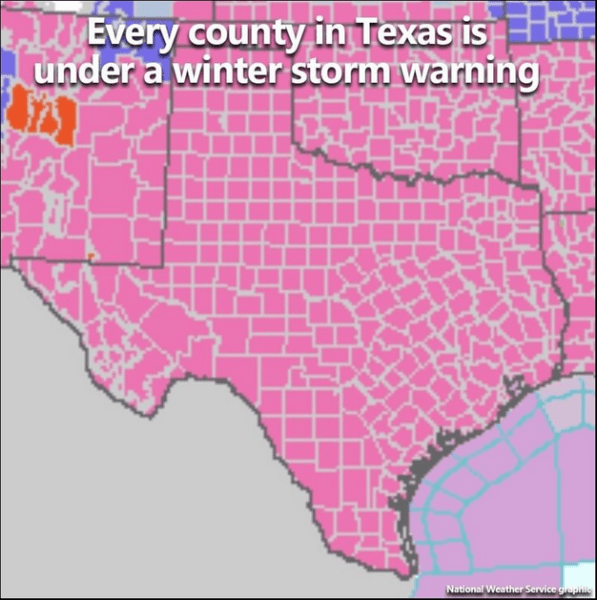

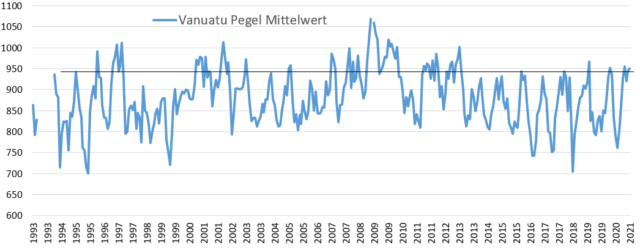

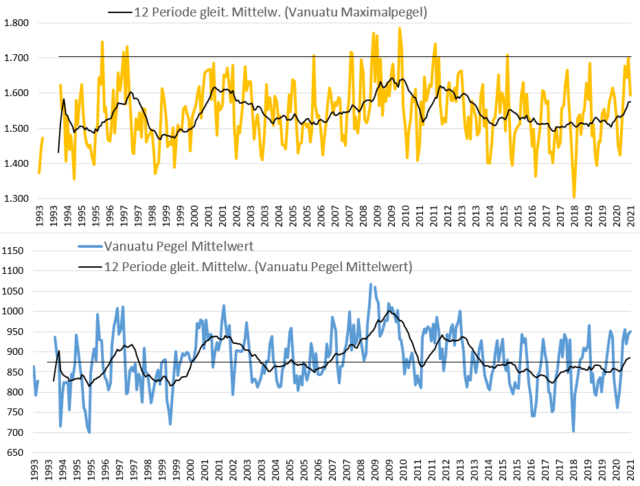

Eine Nachschau beim Australischen Pacific-Monitoring Programm zeigt den folgenden Pegelverlauf. Ein „klimawandel-“bedingter, schlimmer Pegelanstieg ist nicht zu finden:

Bild 4 Vanuatu, Pegelverlauf Mittelwert 1993 – 2.2021. Grafik vom Autor erstellt. Datenquelle: Australien Government Bureau of Meteoorologie, Monthly sea levels for VANUATU

Das Gleiche gilt für den Maximalpegel:

Bild 5 Vanuatu, Pegelverlauf Maximalpegel 1993 – 2.2021. Grafik vom Autor erstellt. Datenquelle: Australien Government Bureau of Meteoorologie, Monthly sea levels for VANUATU

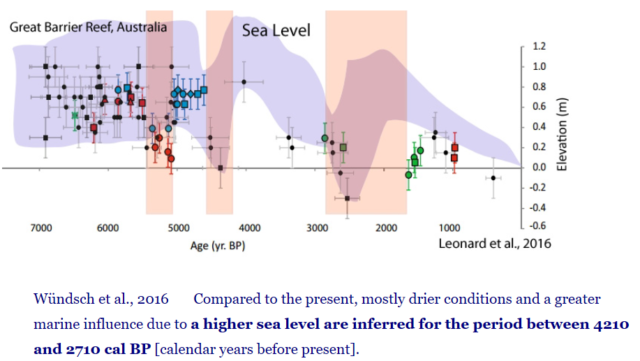

Zudem hat der Pazifik in dieser Region einen der niedrigsten Pegel seit vielen Tausend Jahren:

Nochmals die Gefährdung durch Tsunamis im Pazifik.

Wenn man überlegt, dass beim Meerespegelanstieg um Zentimeter in vielen Jahren gerungen wird welche begründen sollen, dass die Welt Billiarden um Billiarden Dollar zur CO2-Reduktion ausgibt – auf die sich Vanuatu problemlos einstellen kann -, dann zeigen die viele Meter hohen Flutwellen der regelmäßigen Tsunamis eine wirkliche Bedrohung.

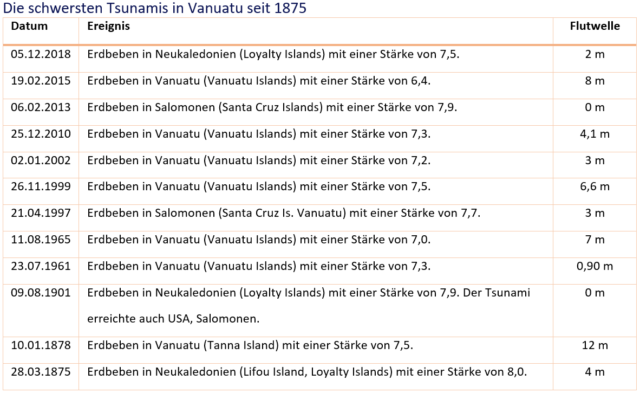

Bild 9 Vanuatu, die schwersten Tsunamis seit 1875 mit Höhe der Flutwelle. Quelle: Laenderdaten.info Tsunamis in Vanuatu

Wer meint, die Tsunami-Flutwellen in dieser Region wären „hoch“, sollte sich die um Japan ansehen (die Flutwelle beim Tsunami von Fukushima mit ca. 15.000 direkten Todesopfern war zwischen 15 … 20 m hoch).

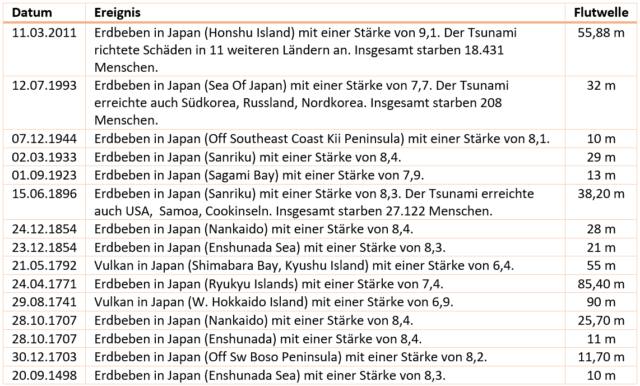

Bild 11 Japan, die schwersten Tsumamis Japan seit 1498 mit Höhe der Flutwelle. Quelle: Laenderdaten.info Tsunamis in Japan

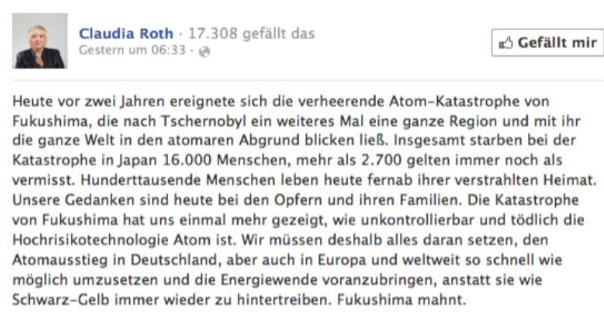

Ist bekannt, dass unsere Kirchen deshalb für Japan beten oder westliche Regierungen Geld bereitstellen? Eher das Gegenteil: Man war nicht einmal bereit, die Tsunamiopfer von Fukushima als solche zu bezeichnen, weil man wegen der Ideologie unbedingt „andere“ Opfer wollte:

Achgut, 16.02.2021: Fukushima: Wie t-online die Fakten verstrahlt

… Nach einem Erdbeben und einem Tsunami war es am 11. März 2011 in drei der sechs Reaktoren zur Kernschmelze gekommen. Mehr als 18.000 Menschen starben. Es war das schlimmste Atomunglück seit der Tschernobyl-Katastrophe von 1986.“

C. Roth kann nicht anders, als Tatsachen entsprechend ihrer Ideologie zu drehen. Wirkliche Empathie für die ertrunkenen Menschen? Vollkommene Fehlanzeige:

Doch Frau Künast übertrifft ideologisch alles:

Zeit Online 20. August 2019: „Wir hätten uns nicht so ins Bockshorn jagen lassen dürfen“

Künast: … Der Atomunfall in Fukushima oder die Dürresommer haben gezeigt, dass man den Klimawandel nicht mehr leugnen kann.

Doch seit wann interessieren Aktivisten Fakten.

Germanwatch, HINTERGRUNDPAPIER Globale Klimakrise: Aufbruch in eine neue Zukunft, 2017: … Zahlreiche Aktionen und Appelle für den Klimaschutz kommen von den kleinen Inselstaaten. In einer dieser Aktionen haben sich unter dem Motto „Wir ertrinken nicht. Wir kämpfen“ junge Aktivist*innen aus mehreren kleinen Inselstaaten, unter anderem aus Fidschi, Samoa, Tonga, Tuvalu und Vanuatu, zu den „Pacific Climate Warriors“ zusammengeschlossen, um die Pazifischen Inseln vor dem Klimawandel zu schützen und sich mit friedlichen Mitteln gegen die fossile Energieindustrie zu stellen …

Taifune/Zyklone

Die Kirche behauptet: auch die tropischen Wirbelstürme werden stärker …

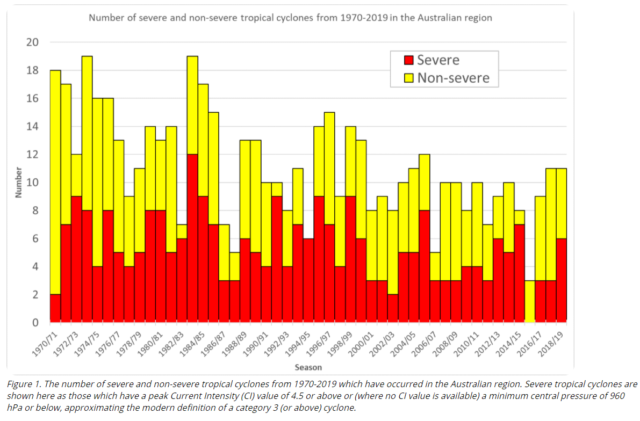

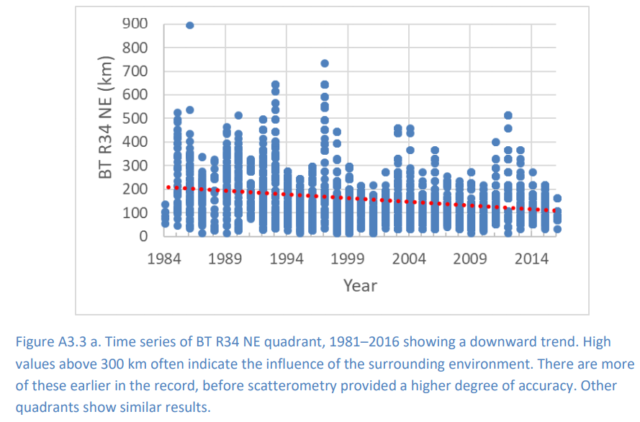

Die Homepage der Regierung von Australien bietet dazu etwas Info. Schon die Erste zeigt, dass das mit immer stärker werdenden Zyklonen nicht ganz stimmen kann.

Bild 12 Region Australien. Anzahl Cyclone nach Klassifizierung 1970 – 2019. Quelle: Australia Bureau of Meteorology, Tropical cyclone climatology

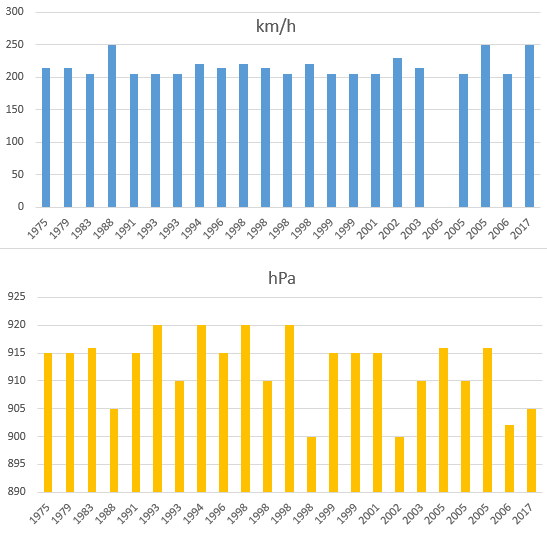

Und die nächsten Grafiken zeigen es auch:

Bild 13 Cyclone der Kategorie 5, Region Australien 1975 – 2017. Grafik vom Autor erstellt. Datenquelle: WIKIPEDIA, List of the most intense tropical cyclones

Bild 14 Zyklone im Pazifik, Windgeschwindigkeiten. Quelle: Australia Bureau of Meteorology. Objective Tropical Cyclone Reanalysis JIP Printed: 19/12/2018, Joint Industry Project for Objective Tropical Cyclone Reanalysis: Final Report

Dabei hat die Datenbank erst seit etwa 1985 verlässliche Daten. Was vorher geschah fehlt oft oder ist nicht richtig hinterlegt.

Der IPCC bestätigt es im letzten Sachstandbericht AR5:

Tropische Stürme und Hurrikane

IPCC 2013, AR5, WGI, Kapitel 2, Seite 216: “No robust trends in annual numbers of tropical storms, hurricanes and major hurricanes counts have been identified over the past 100 years in the North Atlantic basin.”

Übersetzung: Keine robusten Trends bei den jährlichen Zahlen von tropischen Stürmen, Hurrikans und Stark-Hurrikans konnten in den letzten 100 Jahren im Nordatlantischen Becken ausgemacht werden.

Tropische Zyklone

IPCC 2013, AR5, WGI, Kapitel 2, Seite 216: “Current datasets indicate no significant observed trends in global tropical cyclone frequency over the past century and it remains uncertain whether any reported long-term increases in tropical cyclone frequency are robust, after accounting for past changes in observing capabilities.”

Übersetzung: “Aktuelle Datensätze zeigen keine signifikanten beobachteten Trends bei der weltweiten tropischen Wirbelsturmfrequenz während des letzten Jahrhunderts und es ist ungewiss, ob ein berichteter langfristiger Anstieg der tropischen Wirbelsturm-Frequenz robust ist, nach Berücksichtigung der letzten Änderungen in den Beobachtungs-Möglichkeiten.“

Berichte der Australischen Regierung ebenso:

Australien Government Bureau of Meteoorologie, TECHNICAL REPORT Climate Change in Australia PROJECTIONS FOR AUSTRALIA´S NRM REGIONS: TROPICAL CYCLONES

The relatively short time span of consistent records, combined with high year to year variability, makes it difficult to discern any clear trends in tropical cyclone frequency or intensity for the Australian region. For the period 1981 to 2007, no statistically significant trends in the total numbers of cyclones, or in the proportion of the most intense cyclones, have been found in the Australian region, South Indian Ocean or South Pacific Ocean (Kuleshov et al. 2010). However, observations of tropical cyclone numbers from 1981–82 to 2012–13 in the Australian region show a decreasing trend that is significant at the 93-98 % confidence level when variability associated with ENSO is accounted for (Dowdy, 2014). Only limited conclusions can be drawn regarding tropical cyclone frequency and intensity in the Australian region prior to 1981, due to a lack of data. However, a long-term decline in numbers on the Queensland coast has been suggested (Callaghan and Power, 2010).

Grobe deepl-Übersetzung: Die relativ kurze Zeitspanne konsistenter Aufzeichnungen, kombiniert mit einer hohen Variabilität von Jahr zu Jahr, macht es schwierig, klare Trends in der Häufigkeit oder Intensität tropischer Zyklone für die australische Region zu erkennen. Für den Zeitraum 1981 bis 2007 wurden keine statistisch signifikanten Trends in der Gesamtzahl der Wirbelstürme oder im Anteil der intensivsten Wirbelstürme in der australischen Region, im Südindischen Ozean oder im Südpazifik gefunden (Kuleshov et al. 2010). Allerdings zeigen Beobachtungen der Anzahl tropischer Wirbelstürme von 1981-82 bis 2012-13 in der australischen Region einen abnehmenden Trend, der auf dem Vertrauensniveau von 93-98 % signifikant ist, wenn die mit ENSO verbundene Variabilität berücksichtigt wird (Dowdy, 2014). In Bezug auf die Häufigkeit und Intensität tropischer Wirbelstürme in der australischen Region vor 1981 können aufgrund fehlender Daten nur begrenzte Schlussfolgerungen gezogen werden. Es wurde jedoch ein langfristiger Rückgang der Anzahl an der Küste von Queensland vermutet (Callaghan und Power, 2010).

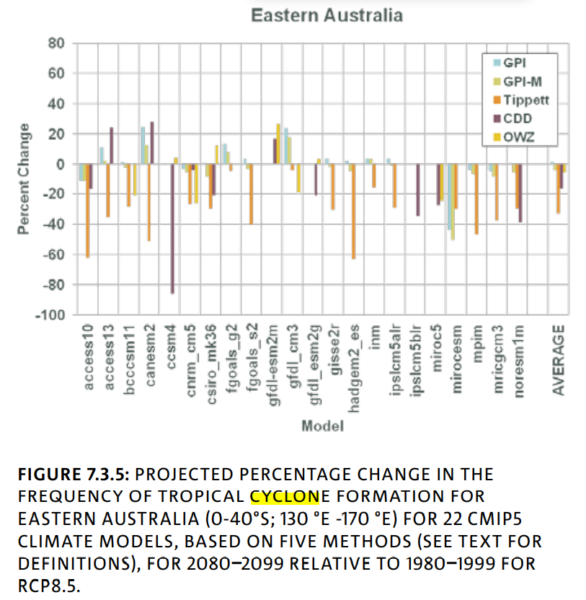

Nun noch, was Simulationen für diese Region projizieren – für die Zukunft eine deutliche Abnahme (trotz dem bewusst gewählten Extremszenario rcp8.5):

Bild 15 Projektionen der prozentualen Änderung am Auftreten tropischer Cyclone in Ost-Australien. Quelle: Australien Government Bureau of Meteorologie, TECHNICAL REPORT Climate Change in Australia PROJECTIONS FOR AUSTRALIA´S NRM REGIONS

Temperaturen

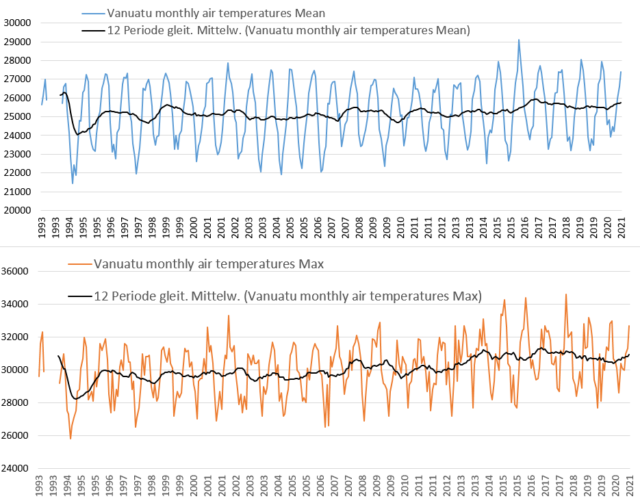

Die Kirche sagt: … Durch die Erwärmung der Meere sterben die Korallen ab …

Dann müsste man dies anhand der Wassertemperaturen ja erkennen können.

Auf den australischen Pazifik-Infoseiten sind nicht nur die Tidenpegel hinterlegt, sondern auch die Temperaturen der Pazifikinseln.

Damit lässt sich die Darstellung: Die steigenden Wassertemperaturen gefährden Fische und Korallen,

zumindest orientierend sichten. Und die Wassertemperaturen ändern sich wie zu erwarten in Zyklen, aber sie verlaufen unspektakulär und vor allem ohne einen stetigen Anstieg:

Bild 15a Vanuatu, Lufttemperaturen Mittelwert und Maximalwert 2001 – 2020. Grafik vom Autor erstellt. Datenquelle: Australien Government Bureau of Meteorologie, VANUATU

Allerdings, die maximale Lufttemperatur hat seit 2013 zugenommen, könnte derzeit aber wieder zurückgehen:

Bild 16 Vanuatu, Wassertemperaturen Mittelwert und Maximalwert 2001 – 2.2021. Grafik vom Autor erstellt. Datenquelle: Australien Government Bureau of Meteorologie, VANUATU

Niederschlag

Die Kirche sagt: … und veränderte Regenmuster lassen Früchte nicht mehr so wachsen wie früher …

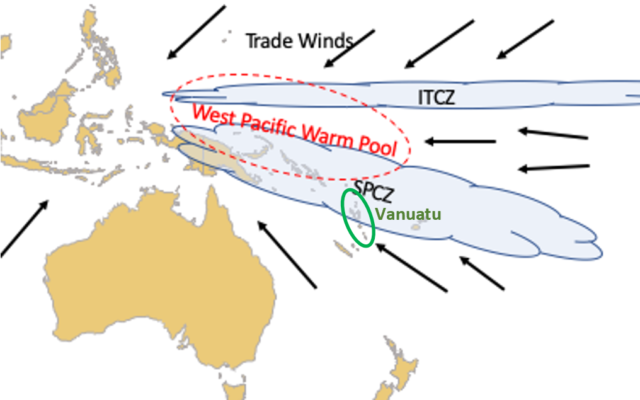

Man muss wissen, dass sich die Inselgruppe Vanuatu am Rande einer Konvergenzzone mit zwei völlig unterschiedlichen Klimaten (in denen jeweils eine Hälfte der Inselgruppe hineinragt) – und vor allem Niederschlagsverhalten – befindet. Wobei sich Vanuatu trotzdem glücklich schätzen sollte. Es liegt zumindest teilweise in der Zone SPCT und für diese gilt: Die SPCZ ist das ausgedehnteste und beständigste Regenband der südlichen Hemisphäre …

Bild 17 Konvergenzzonen im Pazifik. Grafik vom Autor ergänzt. Quelle: South Pacific Convergence Zone (SPCZ) – SKYbrary Aviation Safety

Bild 17 Konvergenzzonen im Pazifik. Grafik vom Autor ergänzt. Quelle: South Pacific Convergence Zone (SPCZ) – SKYbrary Aviation Safety

Es ist naheliegend, dass daraus starke Veränderungen und Extreme im Niederschlag resultieren.

South Pacific Convergence Zone (SPCZ) – SKYbrary Aviation Safety

The South Pacific Convergence Zone (SPCZ) is a persistent band of cloudiness and storms, a 200-400 km broad zone that originates in Southeast Asia and stretches southeast to French Polynesia and the Cook Islands. The SPCZ is the Southern Hemisphere’s most expansive and persistent rain band, and is the largest and most persistent spur of the Intertropical Convergence Zone (ITCZ). It is also the only spur that does not result from heating over land during the summer. The SPCZ is most active in the southern hemisphere summer, but it is present year-round.

Grobe deepl-Übersetzung: Die Südpazifische Konvergenzzone (SPCZ) ist ein anhaltendes Band von Bewölkung und Stürmen, eine 200-400 km breite Zone, die ihren Ursprung in Südostasien hat und sich südöstlich bis nach Französisch-Polynesien und zu den Cookinseln erstreckt. Die SPCZ ist das ausgedehnteste und beständigste Regenband der südlichen Hemisphäre und der größte und beständigste Ausläufer der Innertropischen Konvergenzzone (ITCZ). Es ist auch der einzige Ausläufer, der nicht aus der Erwärmung über Land im Sommer resultiert. Die SPCZ ist im Sommer der südlichen Hemisphäre am aktivsten, aber sie ist das ganze Jahr über vorhanden.

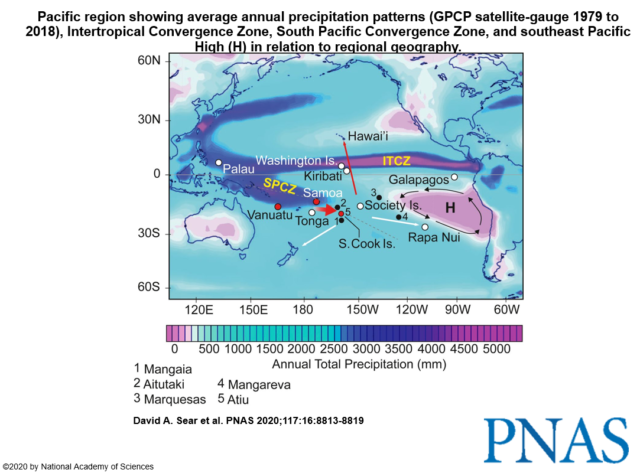

Bild 18 Pazifische Konvergenzzonen mit Niederschlagsverhalten. Quelle: David A. Sear at al.,April 2020: Human settlement of East Polynesia earlier, incremental, and coincident with prolonged South Pacific drought

Und so kommt es, dass die Niederschläge südpazifischer Inselgruppen seit Urzeiten gegenteilige Tendenzen aufweisen. Wer also „für oder gegen“ Regen betet, muss dem lieben Gott genau sagen, welches Atoll er gerade „errettet“ haben möchte. Mit CO2-Vermeidung trifft man allerdings pauschal (sofern es überhaupt funktionieren würde) und „rettet“ welche, während man andere dafür in die „Verdammnis“ schickt.

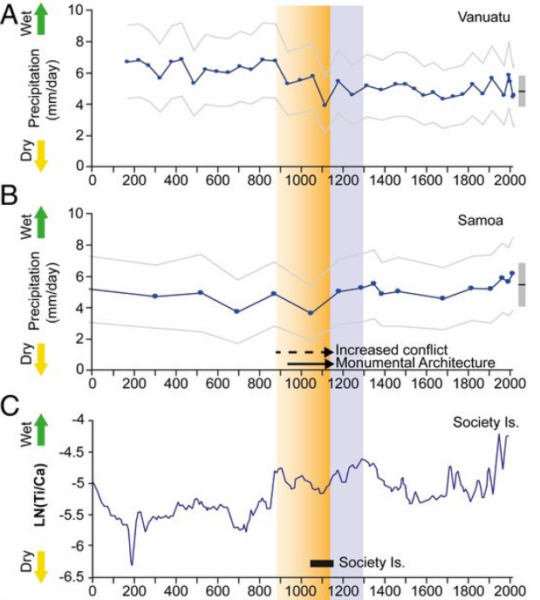

Bild 19 (Teilbild) Niederschlagsrekonstruktionen seit 2000 Jahren von Vanuatu, Samoa, Society Isl. Quelle: David A. Sear at al.,April 2020: Human settlement of East Polynesia earlier, incremental, and coincident with prolonged South Pacific drought

Niederschlag in der Region

Die „Kirche“ sagt: Die Durchschnittstemperaturen steigen und insgesamt fällt weniger Regen

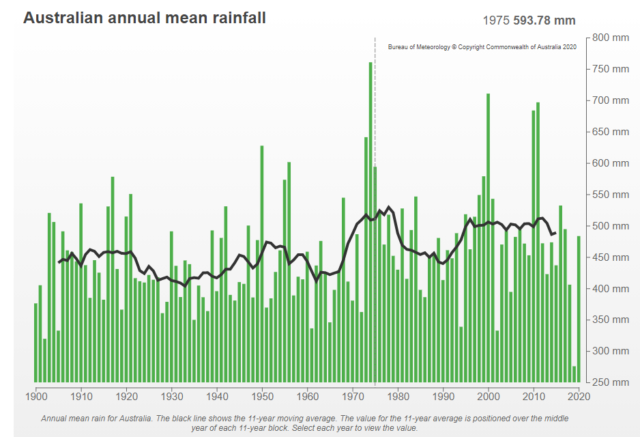

Für Australien finden sich Niederschlagskurven mit längeren Verläufen. Diese zeigen extreme Schwankungen und von Anfang 1900 an eine eher kontinuierliche Niederschlags-Zunahme.

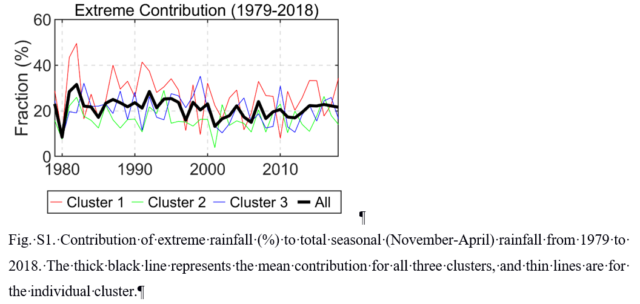

Es gibt auch eine grobe Darstellung zu Extremniederschlag im Süd-Pazifik. Der wird eher weniger.

Bild 21 Quelle: Sunil KumarPariyar et al., September 2020: Factors affecting extreme rainfall events in the South Pacific, Appendix A. Supplementary data

Niederschlag Vanuatu-Inselgruppe

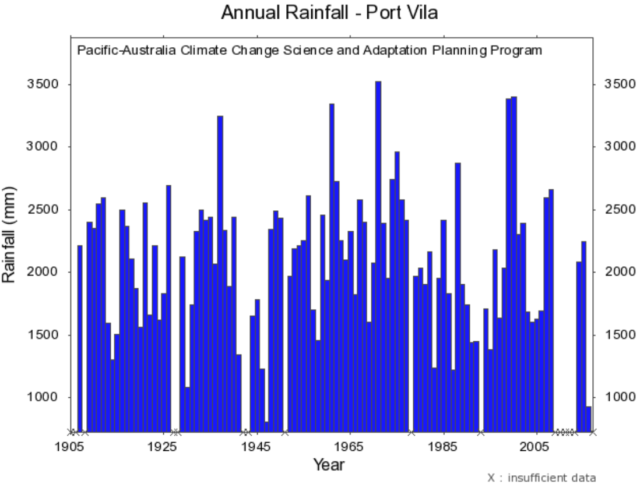

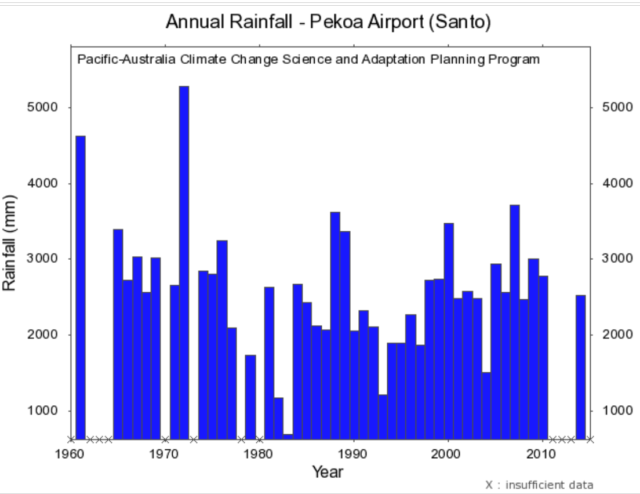

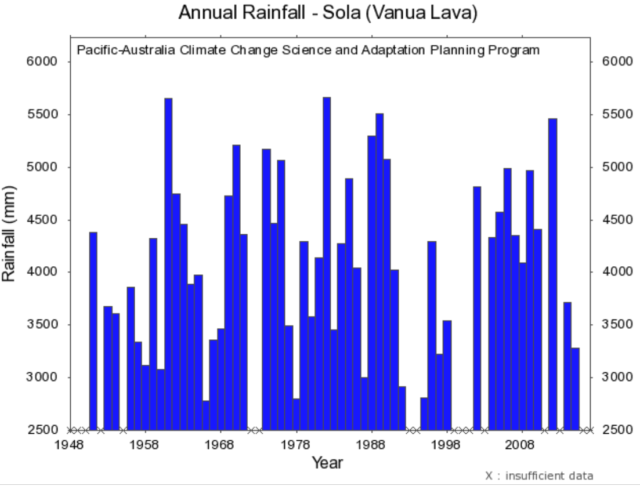

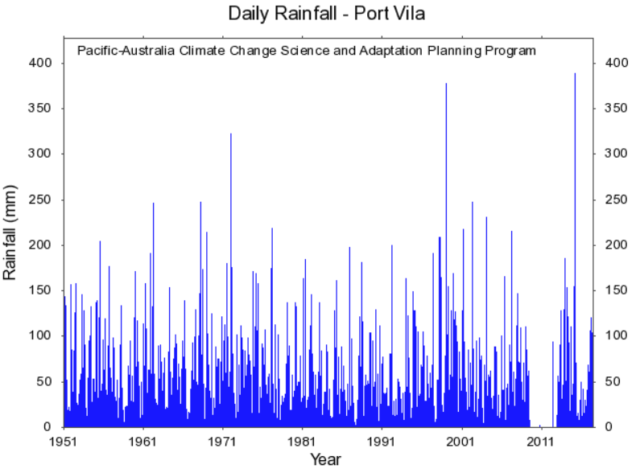

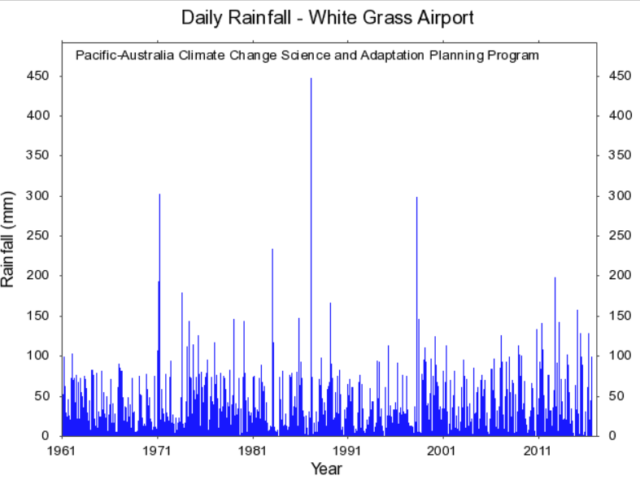

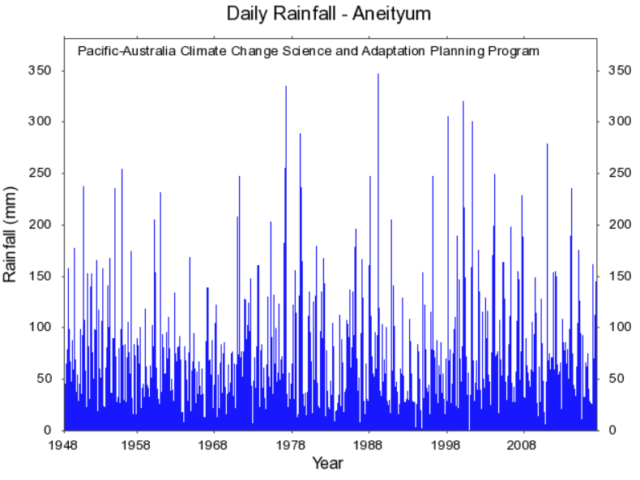

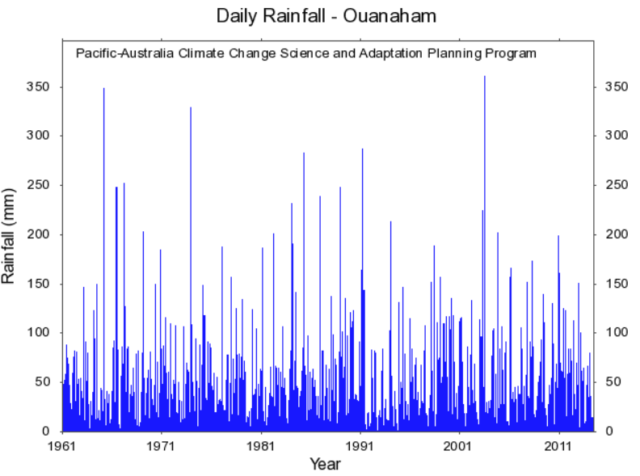

Jahresverläufe von verschiedenen Messstationen der Inselgruppe Vanuatu sehen extreme Schwankungen, aber keine Tendenz zu immer geringerem Niederschlag.

Bild 22 Vanuatu, Port Vila. Jährlicher Niederschlag seit 1905. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Bild 23 Vanuatu, Pekoa Airport. Jährlicher Niederschlag seit 1960. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Bild 24 Vanuatu, Sola. Jährlicher Niederschlag seit 1948. Quelle: Pacific Climate Change Site Data (bom.gov.au)

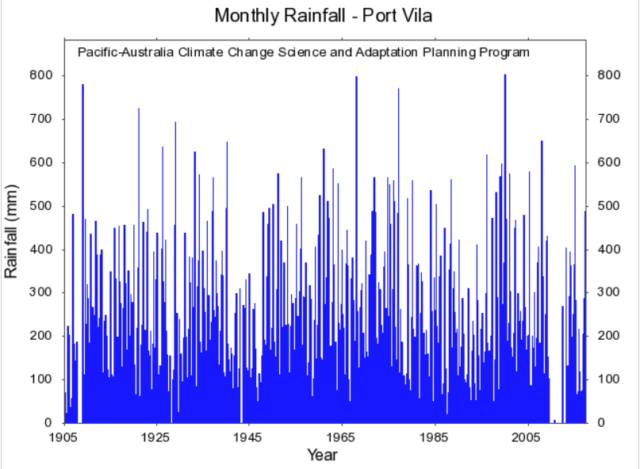

Dazu noch ein Verlauf des Niederschlags in Monatsauflösung von Port Vila.

Bild 25 Vanuatu, Port Vila. Monatlicher Niederschlag seit 1905. Quelle: Pacific Climate Change Site Data (bom.gov.au)

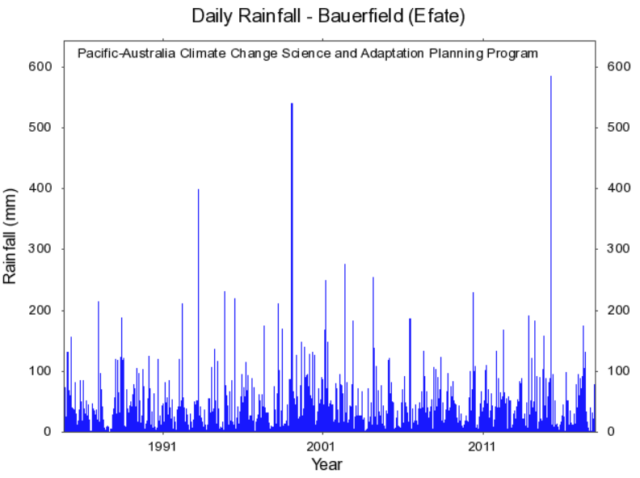

Ob der Niederschlag auf Vanuatu extremer wird, kann man anhand der Tagesauflösung sehen. Es gibt viele extreme Tage – aber keine Tendenz zu immer höheren Extremen:

Bild 26 Vanuatu, Port Vila. Niederschlag seit 1951 in Tagesauflösung. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Bild 27 Vanuatu, White Grass Airport. Niederschlag seit 1961 in Tagesauflösung. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Bild 28 Vanuatu, Aneityum. Niederschlag seit 1948 in Tagesauflösung. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Bild 29 Vanuatu, Quanaham. Niederschlag seit 1961 in Tagesauflösung. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Niederschlagsextreme ereignen sich meistens ohne Trend und Vorwarnung aus heiterem Himmel. Nicht oft, wenn, dann aber heftig. Ein Beispiel dafür:

Bild 27a Vanuatu, Bauerfield. Niederschlag seit 1985 in Tagesauflösung. Quelle: Pacific Climate Change Site Data (bom.gov.au)

Fazit

Vanuatu wird erkennbar von praktisch allen Unbilden heimgesucht, welche die Natur zu bieten hat. Das war aber schon immer so. Und viele, leider auch Schlimme – wie Vulkanausbrüche und die schlimmen Tsunamis, auch das Versinken mit der Erdplatte – haben mit dem Klima nichts zu tun.

Dazu kommt eine rasant wachsende Überbevölkerung mit all ihren Problemen.

Weiterhin kann der Autor jedoch keine Belege über Messdaten finden, welche die Aussagen der Kirche – dass Vanuatu konkret und verstärkt vom sich ständig verändernden Klima „gebeutelt“ wird – erhärten würde. Er spricht der kirchlichen Redakteurin – deshalb weiterhin ab, ernsthaft nach Belegen gesucht zu haben (wofür man auch nicht für viel Geld (hier Spesen) vor Ort zu reisen braucht).

Der Kirche ist vorzuwerfen, eine solche – rein auf Fabulierungen basierende „Recherche“ – unkontrolliert zu veröffentlichen. Man erkennt deutlich, dass die Kirche blind ist, wenn etwas geliefert wird was ihrem „Wunsch“ (und Narrativ) entspricht.

Quellen

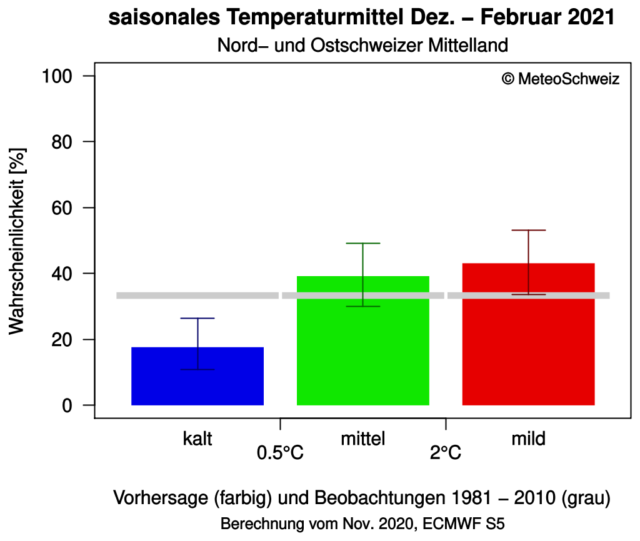

[1] EIKE 08.05.2020: Die SZ im Agitationsmodus. Und die Wahrheit bleibt wieder auf der Strecke