Ich erwähne das alles, um Sie wissen zu lassen, dass ich weit, weit davon entfernt bin, ein Anfänger oder gar ein Programmierer-Geselle zu sein. Ich habe z. B. mit „computerbasierter Evolution“ gearbeitet, um zu versuchen, den Aktienmarkt zu analysieren, bevor die meisten Leute überhaupt davon gehört haben. …

Nun, wer meine Arbeiten gelesen hat weiß, dass ich weit davon entfernt bin, Computer-Klimamodelle zu lieben. Ich wurde gefragt: „Was haben Sie gegen Computermodelle?“ und „Wie können Sie den Modellen nicht vertrauen, wir benutzen sie doch für alles?“

Nun, basierend auf einer lebenslangen Erfahrung auf diesem Gebiet kann ich Ihnen ein paar Dinge über Computerklimamodelle und Computermodelle im Allgemeinen versichern. Hier ist die Kurzfassung:

● Ein Computermodell ist nichts anderes als eine physikalische Umsetzung der Überzeugungen, Vorstellungen, falschen Ideen und Missverständnisse desjenigen, der das Modell geschrieben hat. Daher werden die Ergebnisse, die es produziert, die Überzeugungen, Auffassungen, falschen Ideen und Missverständnisse des Programmierers unterstützen, bestätigen und verkörpern. Alles, was der Computer tut, ist, diese Überzeugungen und Missverständnisse offiziell und vernünftig aussehen zu lassen. Oh, und er macht sehr, sehr schnell Fehler. Ich habe das schon erlebt.

● Computer-Klimamodelle gehören zu einer bestimmten Klasse von Modellen, die „iterative“ Computermodelle genannt werden. In dieser Klasse von Modellen wird die Ausgabe eines Zeitschrittes als Eingabe für den nächsten Zeitschritt in den Computer zurückgespeist. Mitglieder dieser Klasse von Modellen sind notorisch launisch, instabil und neigen zu internen Oszillationen und allgemein zum Herunterfallen. Normalerweise müssen sie in gewisser Weise künstlich „eingezäunt“ werden, damit sie nicht außer Kontrolle geraten.

● Wie jeder bestätigen kann, der schon einmal versucht hat, z. B. den Aktienmarkt zu modellieren, kann ein Modell, das die Vergangenheit absolut fehlerfrei reproduzieren kann, in der Tat sehr wahrscheinlich völlig falsche Vorhersagen für die Zukunft liefern wird. Ich habe das auch schon erlebt. Wie es in der Brokerwerbung in den USA heißen muss: „Vergangene Performance ist keine Garantie für zukünftigen Erfolg“.

● Das bedeutet, dass die Tatsache, dass ein Klimamodell das vergangene Klima perfekt nachzeichnen kann, NICHT bedeutet, dass es eine genaue Darstellung der Realität ist. Und vor allem bedeutet es NICHT, dass es die Zukunft genau vorhersagen kann.

● Chaotische Systeme wie Wetter und Klima sind notorisch schwer zu modellieren, selbst auf kurze Sicht. Das ist der Grund, warum Vorhersagen über den zukünftigen Weg eines Wirbelsturms in den nächsten 48 Stunden die Form eines Kegels und nicht einer geraden Linie haben.

● Es gibt einen ganzen Zweig der Informatik namens „V&V“, was für Validierung und Verifizierung steht. So können Sie sicher sein, dass Ihre Software der Aufgabe gewachsen ist, für die sie entwickelt wurde. Hier ist eine Beschreibung aus dem Internet:

Was ist Software-Verifizierung und -Validierung (V&V)?

Verifizierung

820.3(a) Verifikation ist die Bestätigung durch Prüfung und Erbringung eines objektiven Nachweises, dass festgelegte Anforderungen erfüllt wurden.

„Dokumentierte Verfahren, die in der Benutzerumgebung durchgeführt werden, um die Ergebnisse zu erhalten, aufzuzeichnen und zu interpretieren, die erforderlich sind, um festzustellen, dass die vorgegebenen Spezifikationen erfüllt wurden“ (AAMI).

Validierung

820.3(z) Validierung bedeutet die Bestätigung durch Untersuchung und Erbringung eines objektiven Nachweises, dass die besonderen Anforderungen für einen bestimmten Verwendungszweck konsistent erfüllt werden können.

Prozessvalidierung bedeutet die Feststellung durch objektive Beweise, dass ein Prozess konsistent ein Ergebnis oder ein Produkt erzeugt, das seinen vorgegebenen Spezifikationen entspricht.

Designvalidierung ist der objektive Nachweis, dass die Produktspezifikationen mit den Bedürfnissen des Anwenders und der vorgesehenen Verwendung(en) übereinstimmen.

„Dokumentiertes Verfahren zur Erlangung, Aufzeichnung und Interpretation der Ergebnisse, die erforderlich sind, um festzustellen, dass ein Prozess konsistent ein Produkt hervorbringt, das den vorgegebenen Spezifikationen entspricht“ (AAMI).

Weitere Informationen zu V&V hier.

● Ihre durchschnittliche Fahrstuhl-Steuerungssoftware wurde mehr V&V unterzogen als die Computerklimamodelle. Und wenn die Software eines Computermodells nicht einer umfangreichen und strengen V&V unterzogen wurde, ist die Tatsache, dass das Modell sagt, dass etwas in der Modellwelt passiert, KEIN Beweis dafür, dass es in der realen Welt tatsächlich passiert … und selbst dann, wie man sagt, „Mist auftritt“. Wir haben eine Marssonde verloren, weil jemand eine einzige Zahl nicht von imperialen Maßen in metrische umgerechnet hat … und Sie können darauf wetten, dass die NASA ihre Programme einer umfangreichen und strengen V&V unterzieht.

● Computermodellierer, mich manchmal eingeschlossen, unterliegen alle dem fast unwiderstehlichen Wunsch, die Modellwelt mit der realen Welt zu verwechseln. Sie sagen Dinge wie „Wir haben festgestellt, dass das Klimaphänomen X durch den Antrieb Y verursacht wird“. Richtig wäre aber: „Wir haben festgestellt, dass in unserem Modell das modellierte Klimaphänomen X durch unseren modellierten Antrieb Y verursacht wird“. Leider sind die Modellierer nicht die einzigen, die bei diesem Prozess getäuscht werden.

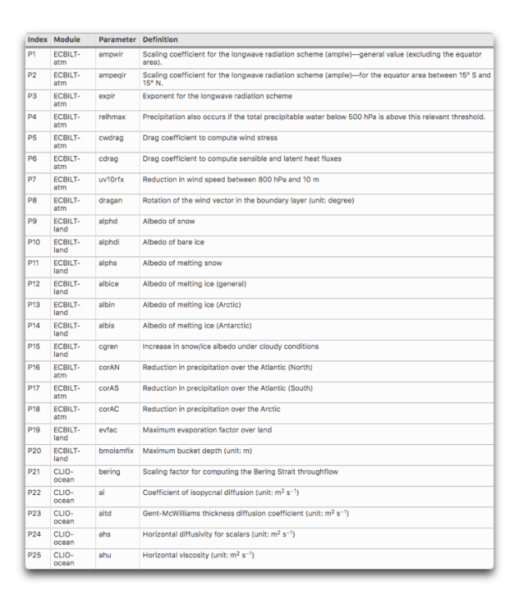

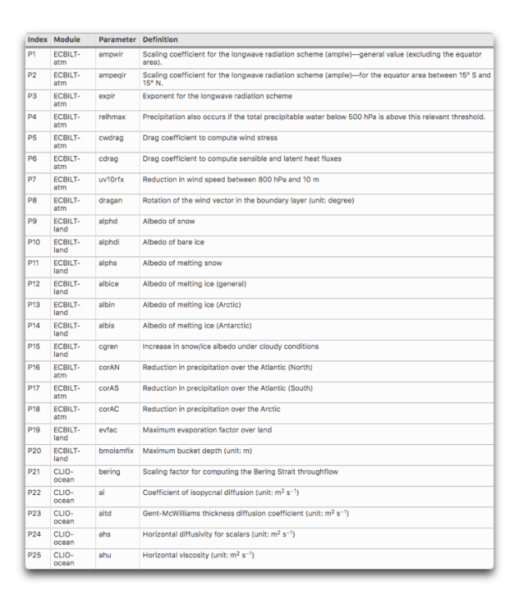

● Je mehr einstellbare Parameter ein Modell hat, desto unwahrscheinlicher ist es, dass es die Realität genau abbildet. Klimamodelle haben Dutzende von abstimmbaren Parametern. Hier sind 25 von ihnen, es gibt aber noch viele mehr:

Was ist falsch mit Parametern in einem Modell? Hier ist eine oft wiederholte Geschichte über den berühmten Physiker Freeman Dyson, der von dem noch berühmteren Enrico Fermi zu diesem Thema belehrt wurde …

Im Frühjahr 1953 hatten wir nach heroischen Anstrengungen theoretische Graphen der Meson-Proton-Streuung gezeichnet. Wir beobachteten freudig, dass unsere berechneten Zahlen ziemlich gut mit den gemessenen Zahlen von Fermi übereinstimmten. Also machte ich einen Termin aus, um mich mit Fermi zu treffen und ihm unsere Ergebnisse zu zeigen. Stolz fuhr ich mit dem Greyhound-Bus von Ithaca nach Chicago, um Fermi ein Paket mit unseren theoretischen Graphen zu zeigen.

Als ich in Fermis Büro ankam, überreichte ich Fermi die Graphen, aber er warf kaum einen Blick auf sie. Er lud mich ein, Platz zu nehmen, und fragte mich freundlich nach der Gesundheit meiner Frau und unseres neugeborenen kleinen Sohnes, der jetzt fünfzig Jahre alt geworden war. Dann verkündete er sein Urteil mit ruhiger, gleichmäßiger Stimme. „Es gibt zwei Wege, Berechnungen in der theoretischen Physik durchzuführen“, sagte er. „Der eine Weg, und das ist der Weg, den ich bevorzuge, besteht darin, ein klares physikalisches Bild von dem Prozess zu haben, den man berechnet. Der andere Weg ist, einen präzisen und in sich konsistenten mathematischen Formalismus zu haben. Beides hat man nicht.“

Ich war etwas verblüfft, wagte es aber ihn zu fragen, warum er die pseudoskalare Mesontheorie nicht als einen in sich konsistenten mathematischen Formalismus ansah. Er antwortete: „Die Quanten-Elektrodynamik ist eine gute Theorie, weil die Kräfte schwach sind, und wenn der Formalismus mehrdeutig ist, haben wir ein klares physikalisches Bild, das uns leitet. Bei der pseudoskalaren Mesonentheorie gibt es kein physikalisches Bild, und die Kräfte sind so stark, dass nichts konvergiert. Um Ihre berechneten Ergebnisse zu erreichen, mussten Sie willkürliche Abschneideverfahren einführen, die weder auf solider Physik noch auf solider Mathematik beruhen.“

In meiner Verzweiflung fragte ich Fermi, ob er nicht beeindruckt sei von der Übereinstimmung zwischen unseren berechneten Zahlen und seinen gemessenen Zahlen. Er antwortete: „Wie viele willkürliche Parameter haben Sie für Ihre Berechnungen verwendet?“ Ich dachte einen Moment über unsere Abschneideverfahren nach und sagte: „Vier.“ Er sagte: „Ich erinnere mich, dass mein Freund John von Neumann zu sagen pflegte: Mit vier Parametern kann ich einen Elefanten einpassen, und mit fünf kann ich ihn mit dem Rüssel wackeln lassen.“ Damit war das Gespräch beendet. Ich bedankte mich bei Fermi für seine Zeit und Mühe, und nahm traurig den nächsten Bus zurück nach Ithaca, um den Studenten die schlechte Nachricht zu überbringen.

● Das Klima ist wohl das komplexeste System, das der Mensch zu modellieren versucht hat. Es hat nicht weniger als sechs große Subsysteme – den Ozean, die Atmosphäre, die Lithosphäre, die Cryosphäre, die Biosphäre und die Elektrosphäre. Keines dieser Subsysteme ist für sich genommen gut verstanden, und wir haben nur punktuelle, lückenhafte, grobe Messungen von jedem einzelnen. Jedes von ihnen hat seine eigenen internen Zyklen, Mechanismen, Phänomene, Resonanzen und Rückkopplungen. Jedes der Subsysteme interagiert mit jedem der anderen. Es gibt wichtige Phänomene, die auf allen Zeitskalen von Nanosekunden bis zu Millionen von Jahren und auf allen räumlichen Skalen von Nanometern bis zum gesamten Planeten auftreten. Schließlich gibt es sowohl interne als auch externe Einflüsse von unbekanntem Ausmaß und Wirkung. Wie wirkt sich zum Beispiel der Sonnenwind auf die Biosphäre aus? Nicht nur das, wir sind erst seit ein paar Jahrzehnten an dem Projekt dran. Unsere Modelle sind … nun ja … um großzügig zu sein, würde ich sie als Bastelvorlagen für die Komplexität der realen Welt bezeichnen.

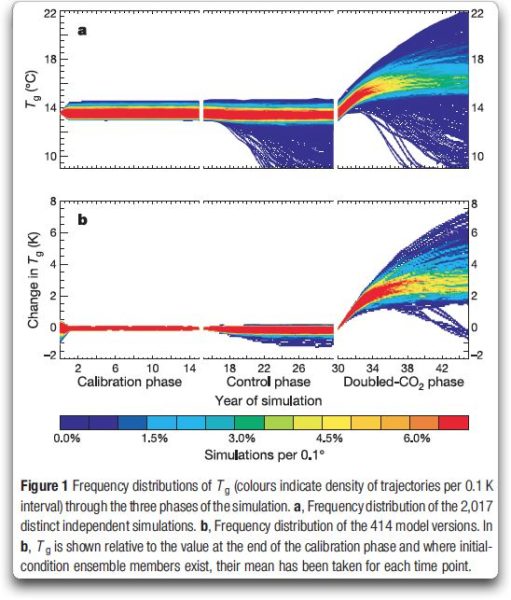

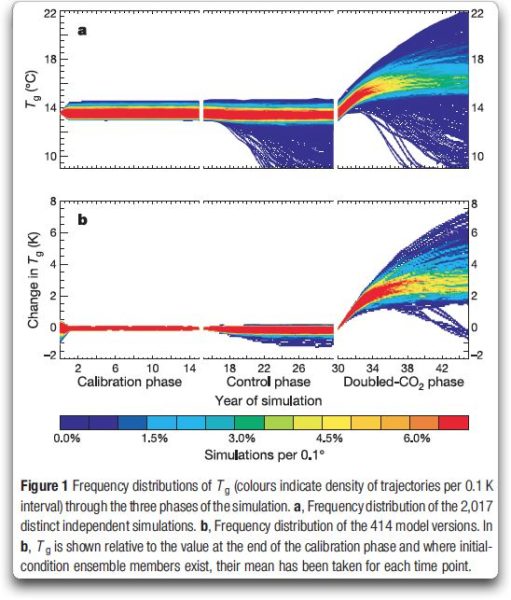

● Viele Läufe von Klimamodellen enden auf dem Fußboden des Schneideraums, weil sie nicht mit den Überzeugungen, Auffassungen, falschen Ideen und Missverständnissen des besagten Programmierers übereinstimmen. Sie zeigen uns nur die Ergebnisse der Modellläufe, mit denen sie einverstanden sind, nicht aber die Ergebnisse der Läufe, bei denen das Modell aus den Fugen geraten ist. Hier sind zweitausend Läufe von 414 Versionen eines Modells, das zuerst eine Kontroll- und dann eine Doppel-CO2-Simulation durchführt. Man erkennt, dass viele der Ergebnisse weit aus dem Rahmen fallen:

Aus all diesen Überlegungen folgt, dass jeder, der glaubt, dass die Klimamodelle etwas „beweisen“ oder „feststellen“ oder „verifizieren“ können, was vor fünfhundert Jahren passiert ist oder in hundert Jahren passieren wird, in einem Narrenparadies lebt. Diese Modelle sind dieser Aufgabe in keiner Weise gewachsen. Sie mögen uns Einsichten bieten oder uns dazu bringen, neue Ideen in Betracht zu ziehen, aber sie können nur Dinge in der Modellwelt „beweisen“, nicht aber in der realen Welt.

Ich möchte klarstellen, dass ich selbst Dutzende von Modellen geschrieben habe und nicht gegen Modelle bin. Ich habe sie mein ganzes Leben lang geschrieben und benutzt. Allerdings gibt es diese Modelle, und dann gibt es jene Modelle. Einige Modelle wurden getestet und einer umfangreichen V&V unterzogen, und ihre Ergebnisse wurden mit der realen Welt verglichen und als sehr genau befunden. Also benutzen wir sie, um interplanetare Sonden zu navigieren und neue Flugzeug-Tragflächen und ähnliches zu entwerfen.

Klimamodelle gehören leider nicht zu dieser Klasse von Modellen. Verdammt, wenn sie es wären, bräuchten wir nur eines von ihnen, anstatt der Dutzenden, die heute existieren und die uns alle unterschiedliche Antworten geben … was zu der ultimativen Hybris der Modellierer führt, der Idee, dass die Mittelung dieser Dutzenden von Modellen das „Rauschen“ beseitigt und nur solide Ergebnisse zurücklässt.

Schließlich könnte ich als lebenslanger Computerprogrammierer der Behauptung „Alle Modelle sind falsch, aber einige sind nützlich“ nicht mehr widersprechen. Nehmen wir beispielsweise die CFD-Modelle, die die Boeing-Ingenieure verwenden, um die Tragflächen von Jumbo-Jets zu entwerfen oder die Modelle, die unsere Aufzüge steuern. Will mir jemand ernsthaft weismachen, dass diese Modelle falsch sind? Wer das wirklich glaubt, würde nie wieder fliegen oder in einen Aufzug steigen. Sicher, sie sind keine exakten Reproduktionen der Realität, das ist es, was „Modell“ bedeutet … aber sie sind richtig genug, um sich in Situationen, in denen es um Leben und Tod geht, auf sie verlassen zu können.

Lassen Sie mich diese Frage klar formulieren. Während Modelle, die richtig sind, absolut nützlich sind, ist es sicherlich auch möglich, dass ein Modell, das falsch ist, nützlich ist.

Aber damit ein Modell, das falsch ist, nützlich ist, müssen wir unbedingt verstehen, WARUM es falsch ist. Sobald wir wissen, wo es falsch gelaufen ist, können wir den Fehler beheben. Aber bei den komplexen iterativen Klimamodellen, die Dutzende von Parametern benötigen, bei denen die Ausgabe eines Zyklus‘ als Eingabe für den nächsten Zyklus verwendet wird und bei denen ein hundertjähriger Lauf mit einem halbstündigen Zeitschritt 1,75 Millionen Schritte umfasst, ist es fast unmöglich zu bestimmen, wo ein Klimamodell vom Weg abgekommen ist. War es ein Fehler in dem Parameter, der die Eistemperatur in 10.000 Fuß Höhe angibt? War es ein Fehler in dem Parameter, der die Bildung von Schmelztümpeln auf dem Meereis nur auf bestimmte Monate beschränkt? Es gibt keine Möglichkeit, das festzustellen, also gibt es auch keine Möglichkeit, aus unseren Fehlern zu lernen.

Als nächstes werden alle diese Modelle „getrimmt“, um den vergangenen langsamen Erwärmungstrend darzustellen. Und im Allgemeinen machen sie das gut … weil die verschiedenen Parameter angepasst und das Modell im Laufe der Zeit verändert wurde, bis sie das taten. Es ist also keine Überraschung, dass sie diesen Job gut machen können … zumindest in den Teilen der Vergangenheit, auf die sie getrimmt worden waren, um sie zu reproduzieren.

Aber dann ziehen die Modellierer die modellierten „anthropogenen Antriebe“ wie CO2 heraus und verkünden stolz, dass – da das Modell die vergangene allmähliche Erwärmung nicht mehr reproduzieren kann – dies beweist, dass die anthropogenen Antriebe die Ursache der Erwärmung sind … Ich nehme an, dass das Problem mit dieser Behauptung klar wird.

Hinzu kommt, dass die Gittergröße der Computermodelle weit größer ist als wichtige Klimaphänomene wie Gewitter, Staubteufel und Tornados. Wenn das Klimamodell falsch ist, liegt das daran, dass es diese Phänomene nicht enthält? Ich sage: ja … die Klima-Computermodellierer sagen nichts.

Wir wissen ja nicht einmal, ob die Navier-Stokes-Gleichungen der Strömungsdynamik, wie sie in den Klimamodellen verwendet werden, zur richtigen Antwort konvergieren, und soweit ich das beurteilen kann, gibt es keine Möglichkeit, das zu bestimmen.

Um den Kreis zu schließen, lassen Sie mich zu meinem Ausgangspunkt zurückkehren – ein Computermodell ist nichts anderes als meine Ideen, die verfestigt wurden. Das war’s. Das ist alles.

Wenn ich also denke, dass CO2 der geheime Steuerknopf für die globale Temperatur ist, dann wird die Ausgabe eines jeden von mir erstellten Modells diese Annahme widerspiegeln und verifizieren.

Wenn ich aber denke (wie ich es tue), dass die Temperatur durch sich entwickelnde Phänomene in engen Grenzen gehalten wird, dann wird die Ausgabe meines neuen Modells diese Annahme widerspiegeln und verifizieren.

Nun, würden die Ausgaben eines dieser sehr unterschiedlichen Modelle „Beweise“ für die reale Welt sein?

Nicht auf diesem Planeten.

Und das ist die kurze Liste der Dinge, die mit Computermodellen falsch sind … es gibt viel mehr, aber wie Pierre sagte, „die Ränder dieser Seite sind zu klein, um sie zu enthalten“ …

Link: https://wattsupwiththat.com/2021/03/12/there-are-climate-models-and-there-are-climate-models/

Übersetzt von Chris Frey EIKE