Globale Daten zum Energieverbrauch 2020 zeigen: dieser wird vollständig dominiert durch den Verbrauch fossiler Treibstoffe

Larry Hamlin

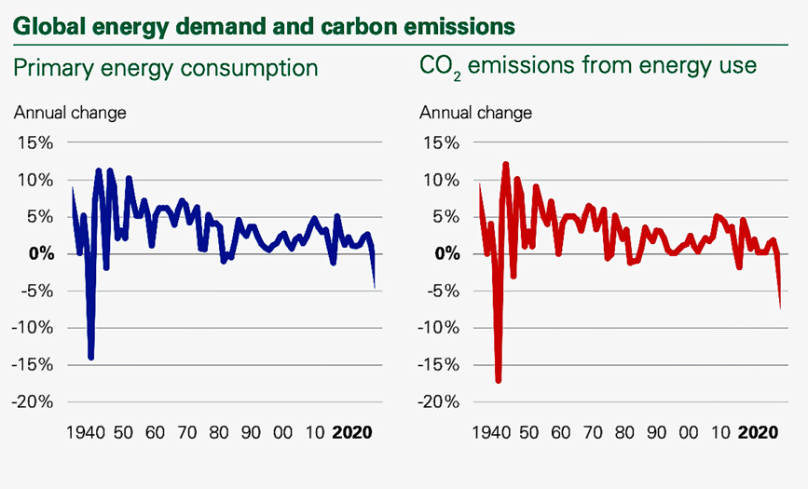

British Petroleum hat seinen Global Energy Statistical Review für das Jahr 2021 veröffentlicht, der dramatische Pandemie-bedingte Rückgänge beim globalen Energieverbrauch und den Emissionen zeigt. Der globale Energieverbrauch sank während des außergewöhnlichen Pandemie-Jahres 2020 um 4,5 % im Vergleich zum Jahr 2019, während die globalen CO2-Emissionen im Jahr 2020 ebenfalls um 6,3 % zurückgingen. Diese Rückgänge sind die größten, die in diesen Größenordnungen seit 1945 aufgetreten sind, wie unten dargestellt:

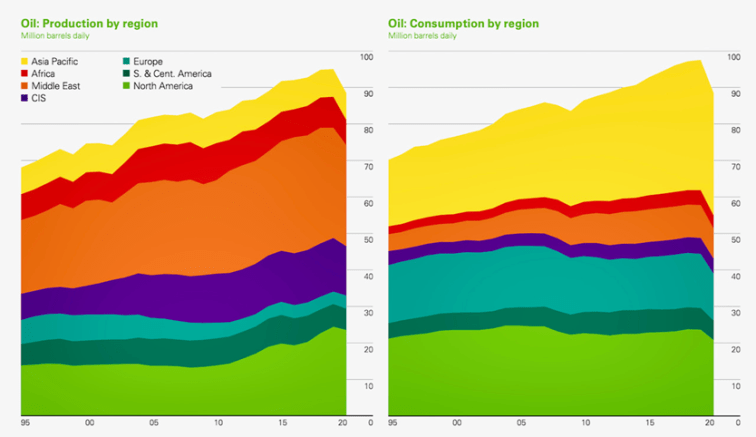

Der Rückgang des weltweiten Ölverbrauchs war für fast drei Viertel des Rückgangs des Energieverbrauchs im Jahr 2020 verantwortlich.

Von den 195 Nationen der Welt hatte nur eine Nation eine steigende Nutzung aller fossilen Energiekategorien und erhöhte CO2-Emissionen im Vergleich zum Jahr 2019, und diese Nation war China, das einen Anstieg des Gesamtenergieverbrauchs um 2,1 % verzeichnete, wobei die Energienutzung von Öl, Erdgas und Kohle trotz der verheerenden Auswirkungen der weltweiten Covid-Pandemie zunahm.

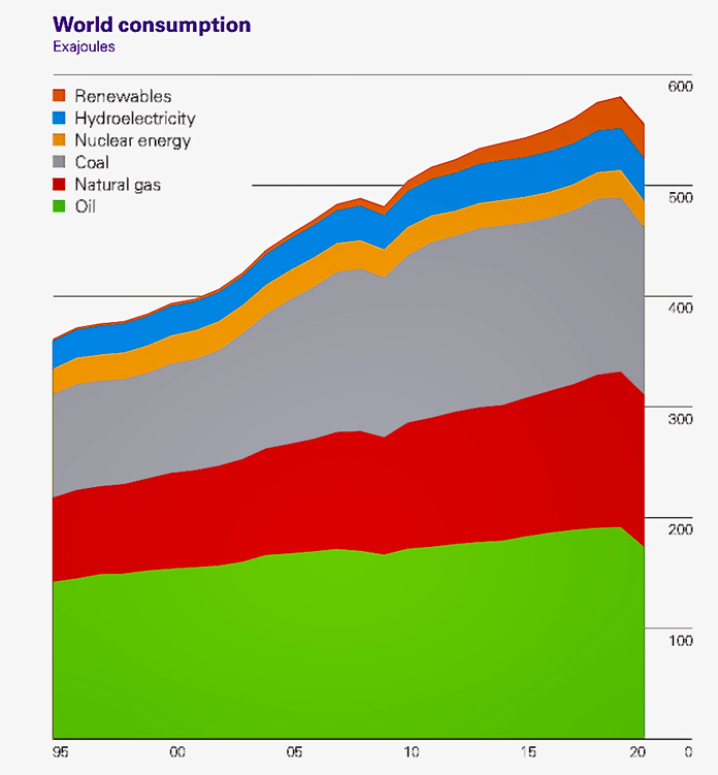

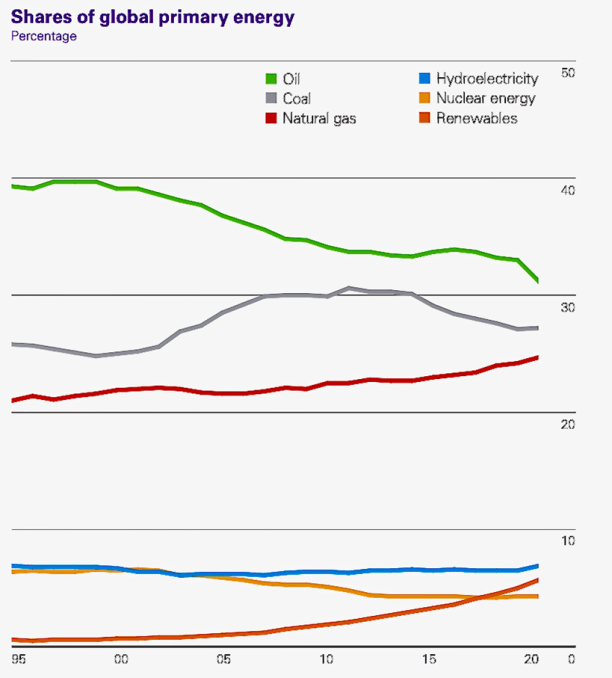

Wie im BP-Bericht vermerkt, werden die Änderungen des globalen Energieverbrauchs im Jahr 2020 wie folgt hervorgehoben, wobei die unten stehende Grafik diese Informationen anzeigt.

„Der Primärenergieverbrauch sank im vergangenen Jahr um 4,5 %, der erste Rückgang des Energieverbrauchs seit 2009. Der Rückgang wurde größtenteils von Öl (-9,7 %) getragen, auf das fast drei Viertel des Rückgangs entfielen. Der Verbrauch aller Energieträger ging zurück, mit Ausnahme der erneuerbaren Energien (+9,7 %) und der Wasserkraft (+1,0 %). Der Verbrauch ging in allen Regionen zurück, wobei die größten Rückgänge in Nordamerika (-8,0 %) und Europa (-7,8 %) zu verzeichnen waren. Den geringsten Rückgang gab es im asiatisch-pazifischen Raum (-1,6 %) aufgrund des Wachstums in China (+2,1 %), dem einzigen großen Land, in dem der Energieverbrauch im Jahr 2020 stieg. In den anderen Regionen reichte der Verbrauchsrückgang von -7,8 % in Süd- und Mittelamerika bis -3,1 % im Nahen Osten.“

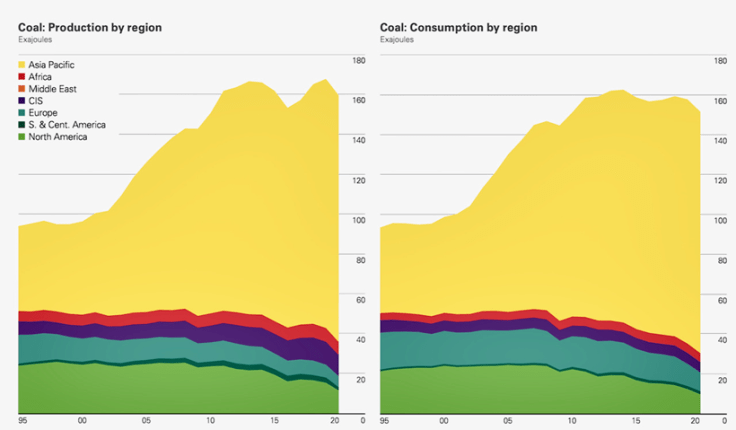

Die Entwicklungsländer der Welt, angeführt von China und Indien, sind heute für 61 % des gesamten weltweiten Energieverbrauchs verantwortlich (eine Zahl, die jedes Jahr weiter steigt), wobei der Energieverbrauch Chinas heute größer ist als der Gesamtenergieverbrauch der USA und der EU zusammen. Darüber hinaus sind die Entwicklungsländer jetzt für 82 % des weltweiten Verbrauchs von Kohlebrennstoffen verantwortlich, wobei diese Zahl bis zum Jahr 2020 noch steigen wird. Allein auf China entfallen 57 % des gesamten globalen Kohleverbrauchs. Erneuerbare Energien machen nur 5,4 % des Gesamtenergieverbrauchs in China und nur 4 % des Gesamtenergieverbrauchs in den Entwicklungsländern im Jahr 2020 aus.

[Hervorhebung im Original]

Die massive globale Dominanz der Entwicklungsländer, die die ständig steigende Produktion und den Verbrauch von Kohlekraftstoff vorantreiben, wird in dem folgenden Diagramm aus dem BP-Bericht dargestellt:

Im Jahr 2020 machten fossile Brennstoffe 86,4 % des Gesamtenergieverbrauchs der Entwicklungsländer und 84,9 % des Gesamtenergieverbrauchs Chinas aus. Fossile Brennstoffe lieferten 83,1 % des gesamten globalen Energieverbrauchs im Jahr 2020, während erneuerbare Energien nach Billionen von Dollar an Subventionen und jahrzehntelangen globalen Regierungsvorgaben nur 5,7 % des gesamten Energieverbrauchs der Welt im Jahr 2020 ausmachten.

[Alle Hervorhebungen im Original]

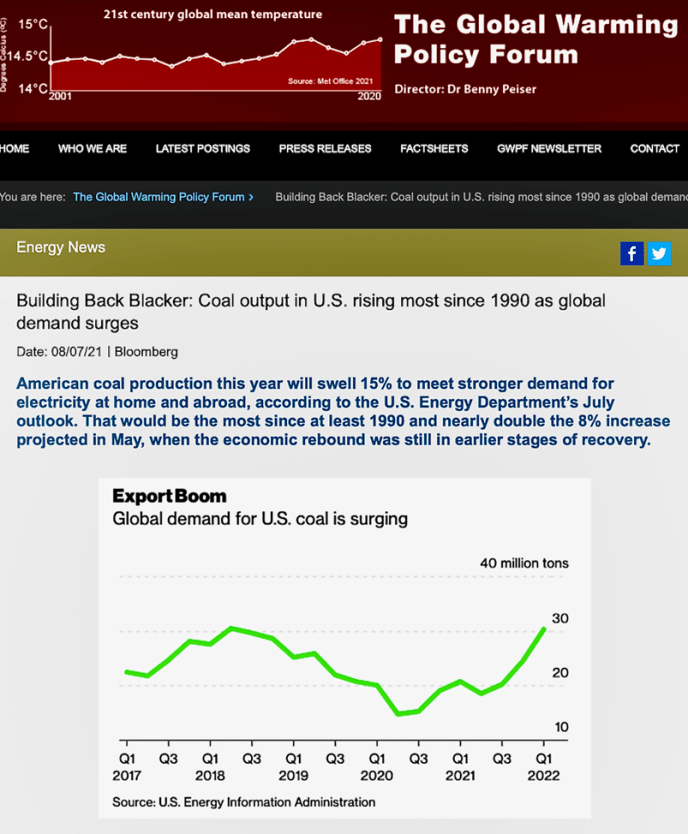

Die globale Nachfrage nach einem verstärkten Einsatz von Kohlebrennstoffen in der Zeit nach der Pandemie ist den Daten der EIA zufolge bereits im Gange, die einen steigenden Exportboom für US-Kohle zeigen, wie unten erwähnt, angetrieben durch die globale Nachfrage aus den Entwicklungsländern, die den gesamten globalen Energieverbrauch (insbesondere Kohle) und die Emissionen dominieren:

Der Gesamtenergieverbrauch der Industrienationen (einschließlich der USA, der EU und Großbritanniens) wird ebenfalls von fossilen Brennstoffen dominiert, die 78 % des Gesamtenergiebedarfs der Industrienationen im Jahr 2020 ausmachen. Erneuerbare Energien machen nur etwa 8,3 % des Gesamtenergiebedarfs der Industrienationen im Jahr 2020 aus, trotz des ganzen Klimaalarmisten-Hypes über die „Netto-Null“-Propaganda und all der Regierungsvorschriften und Billionen von Dollar an Subventionen, die unzuverlässige erneuerbare Energien fördern.

Der Gesamtenergieverbrauch der USA im Jahr 2020 wurde ebenfalls von fossilen Brennstoffen dominiert, die etwa 81,7 % des Gesamtenergiebedarfs der USA deckten, während erneuerbare Energien nur etwa 7 % des Gesamtenergiebedarfs der USA ausmachten. Die USA schreiben die Nutzung erneuerbarer Energien seit der Verabschiedung des Public Utilities Regulatory Policy Act (PURPA) im Jahr 1978 vor, doch nach 42 Jahren, in denen Regierungspolitiker die Nutzung dieser unzuverlässigen Energieressourcen forderten, lieferten sie im Jahr 2020 nur 7 % der gesamten US-Energie.

Sogar in Kalifornien zeigen die neuesten EIA-Energieverbrauchsdaten, dass fossile Brennstoffe 72,4 % des Gesamtenergieverbrauchs des Staates ausmachen (angeführt von Erdöl und Erdgas), während erneuerbare Energien nur etwa 12 % der Gesamtenergie des Staates ausmachen. Wind- und Solarenergie lieferten nur 6,8 % des kalifornischen Gesamtenergieverbrauchs.

Erdöl ist mit einem Anteil von 31,2 % am weltweiten Gesamtenergieverbrauch der am meisten genutzte fossile Energieträger. Die ständig steigende Produktion und der Verbrauch von Ölbrennstoff zur Deckung des weltweiten Energiebedarfs wird in dem folgenden Diagramm aus dem BP-Bericht dargestellt:

Wind- und Solarenergie machten im Jahr 2020 nur 3,9 % des weltweiten Gesamt-Energieverbrauchs und nur 2,7 % des Gesamtenergieverbrauchs der Entwicklungsländer aus, wobei diese Länder den weltweiten Energieverbrauch und das Wachstum vollständig dominieren. Diese Nationen haben kein Interesse und keine Verpflichtungen, den zukünftigen Energieverbrauch fossiler Brennstoffe und die daraus resultierenden Emissionen zu reduzieren, die das notwendige und anhaltende Wirtschaftswachstum dieser Nationen beeinträchtigen könnten.

Wind- und Solarenergie lieferten im Jahr 2020 nur 5,7% des Gesamtenergieverbrauchs der Industrienationen und nur 4,8% des Gesamtenergieverbrauchs der USA im Jahr 2020.

Erneuerbare Energien werden niemals den globalen Energieverbrauch dominieren, weil sie zu unzuverlässig sind und enorme Kosten für die Zuverlässigkeit der Energiesysteme verursachen, die erforderlich sind, um den zuverlässigen Energiefluss aufrechtzuerhalten, der zur Förderung des notwendigen und produktiven Wirtschaftswachstums erforderlich ist. Diejenigen, die etwas anderes glauben, haben keinen Bezug zur globalen Energiewirklichkeit und leugnen die enormen Zuverlässigkeitsprobleme, die bei erneuerbaren Energien unvermeidlich sind.

Diese Ergebnisse des globalen Energieverbrauchs zeigen, dass Biden und seine Demokraten, die Führer Großbritanniens und der EU völlig versagt haben, irgendeine sinnvolle politische Initiative zu schaffen, die zu ihren gehypten Reden über die weltweite „Netto-Null“-Propaganda passt. China und die Entwicklungsländer haben die vollständige Kontrolle über den globalen Energieverbrauch und die Emissionsergebnisse, wobei die Führer dieser Nationen keinerlei Absichten erkennen lassen, die ihre Ziele zur Ausweitung ihres Wirtschaftswachstums und ihrer globalen Macht gefährden könnten.

Der globale Energieverbrauch des Jahres 2020 nach Ressourcenart wird im BP-Bericht wie folgt angesprochen, wobei die Grafik, die diese Informationen darstellt, unten gezeigt wird.

„Öl hat weiterhin den größten Anteil am Energiemix (31,2%). Kohle ist der zweitgrößte Brennstoff im Jahr 2020 mit einem Anteil von 27,2 % am gesamten Primärenergieverbrauch, ein leichter Anstieg gegenüber 27,1 % im Vorjahr. Der Anteil von Erdgas und erneuerbaren Energien stieg auf Rekordhöhen von 24,7 % bzw. 5,7 %. Erneuerbare Energien haben nun die Kernenergie überholt, die nur 4,3 % des Energiemixes ausmacht. Der Anteil der Wasserkraft stieg im vergangenen Jahr um 0,4 Prozentpunkte auf 6,9 %, der erste Anstieg seit 2014.“

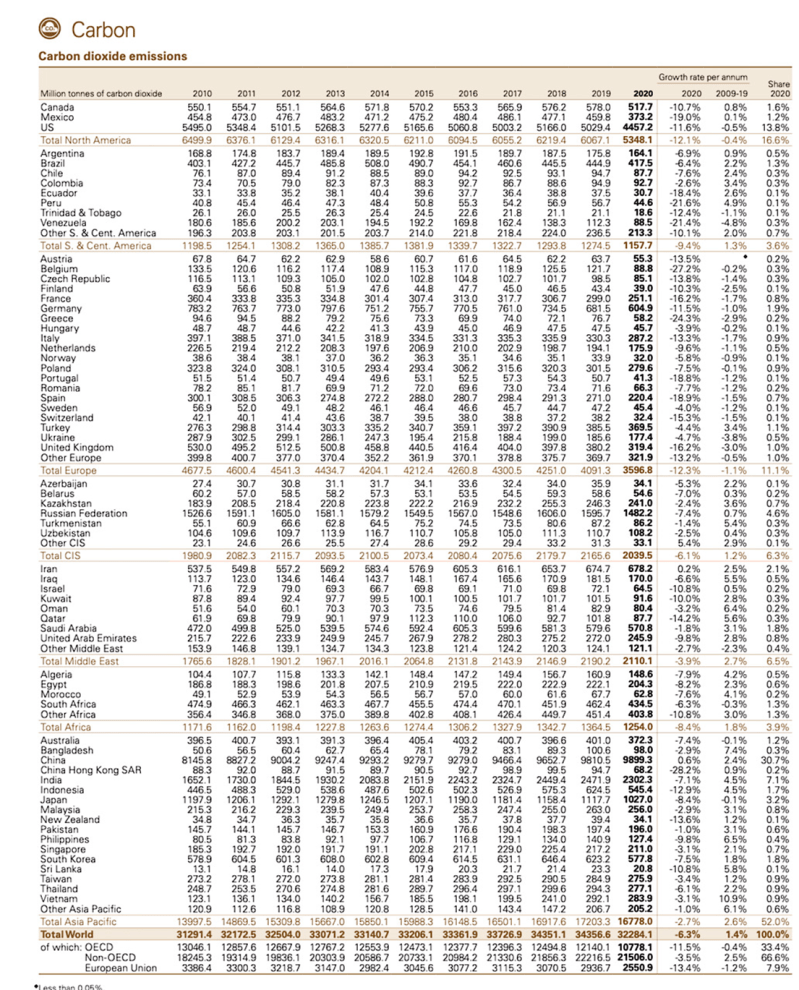

Chinas Dominanz bei den globalen CO2-Emissionen wuchs mit dem Anstieg dieser Emissionen im Jahr 2020 sogar noch weiter an, so dass China nun für 31 % aller globalen CO2-Emissionen mit 9.893,5 Millionen Tonnen verantwortlich ist, wobei die Gesamtemissionen nun etwa 2,25 Mal so hoch sind wie die CO2-Emissionen der USA, die auf 4.432,2 Millionen Tonnen zurückgingen.

Die Entwicklungsländer haben ihre Dominanz bei den globalen Emissionen weiter ausgebaut. Mit 21.253,3 Millionen Tonnen CO2-Emissionen im Jahr 2020 sind sie nun für zwei Drittel aller globalen CO2-Emissionen verantwortlich. Die Entwicklungsländer kontrollieren nun 61% des gesamten globalen Energieverbrauchs und 2/3 aller globalen CO2-Emissionen.

Die CO2-Emissionen der USA sind seit ihrem Höchststand im Jahr 2007 von 5.884,2 Millionen Tonnen um etwa 1,45 Milliarden Tonnen auf 4.432,2 Millionen Tonnen im Jahr 2020 gesunken. Die CO2-Emissionen der EU sind seit 2007 von 3.579,3 Mio. Tonnen um 1,03 Mrd. Tonnen auf 2.548,8 Mio. Tonnen im Jahr 2020 zurückgegangen.

Trotz dieser Rückgänge sind die globalen CO2-Emissionen zwischen 2007 und 2020 um über 1,9 Milliarden Tonnen gestiegen, da die Entwicklungsländer ihre CO2-Emissionen in diesem Zeitraum um über 4,89 Milliarden Tonnen erhöht haben, wobei allein China für über 2,65 Milliarden Tonnen dieses Gesamtanstiegs verantwortlich ist.

Die folgende Tabelle zeigt die globalen CO2-Emissionsdaten im BP-Bericht, aktualisiert auf die Ergebnisse für das Jahr 2020. Der Rückgang der globalen CO2-Emissionen im Jahr 2020 um etwas mehr als 2 Milliarden Tonnen CO2 resultiert aus den Auswirkungen der Pandemie und dem geringeren Energieverbrauch im Jahr 2020. Wie oben in Bezug auf den neuen globalen Kohleverbrauchsboom erwähnt, wird das Ende des Pandemie-bedingten globalen Wirtschaftsrückgangs im Jahr 2020 ein neues Wachstum des Energieverbrauchs durch den erhöhten Verbrauch fossiler Brennstoffe in den Entwicklungsländern, die den globalen Energieverbrauch und die Emissionen dominieren, bewirken.

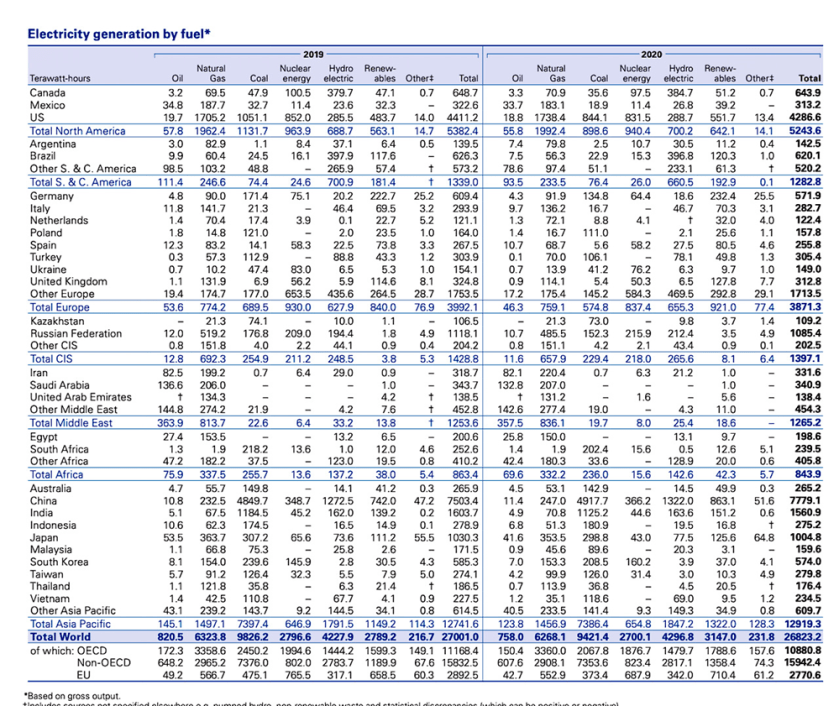

Der BP-Bericht enthält auch Daten zum globalen Stromverbrauch, der im Jahr 2020 gegenüber 2019 leicht gesunken ist (etwa 0,6 %). Der globale Stromverbrauch wird erneut von der Nutzung fossiler Brennstoffe dominiert, die 61,3 % des gesamten globalen Stromverbrauchs ausmachten. Erneuerbare Energien lieferten nur etwa 11,7 % des gesamten globalen Stromverbrauchs im Jahr 2020, wobei große Wasserkraftwerke 16 % und Kernkraftwerke 10 % ausmachten.

Die Entwicklungsländer dominieren den globalen Stromverbrauch und haben einen Anteil von ca. 60 % am gesamten globalen Stromverbrauch gegenüber ca. 40 % in den Industrieländern. Die Entwicklungsländer nutzen fossile Brennstoffe für etwa 68,2 % ihres Stroms, während erneuerbare Energien nur etwa 8,5 % des gesamten Stroms ausmachen. Auf große Wasserkraftwerke entfielen etwa 17,7 % des Stroms in den Entwicklungsländern und auf Kernkraftwerke etwa 5,1 %.

Die Industrienationen nutzten fossile Brennstoffe für etwa 51,3 % ihrer gesamten Elektrizität, wobei erneuerbare Energien etwa 16,4 % ihres Stromverbrauchs ausmachten. Auf Wasserkraft entfielen etwa 13,6 % und auf Kernenergie etwa 17,2 % des Stroms.

Ein Vergleich zwischen China und den USA zeigt, dass China etwa 81,5 % mehr Strom verbraucht als die USA, wobei fossile Brennstoffe etwa 66,5 % des chinesischen Stroms ausmachen, verglichen mit 60,7 % fossilen Brennstoffen für den Strom in den USA. Erneuerbare Energien haben einen Anteil von ca. 11 % an der chinesischen Elektrizität, während sie in den USA einen Anteil von ca. 12,9 % ausmachen.

Die BP-Stromdaten sind unten dargestellt:

Die Entwicklungsländer der Welt dominieren den globalen Energieverbrauch und die Emissionen vollständig und setzen sich unerschütterlich für eine zukünftige, wirtschaftlich getriebene verstärkte Nutzung fossiler Brennstoffe für das Energiewachstum ein, was zu einem zukünftigen Anstieg der globalen CO2-Emissionen führt.

Das wird nicht aufhören wegen der absurden „Netto-Null“-Propagandaschemata, die von Biden und seinen Demokraten, den „Führern“ Großbritanniens und der EU propagiert werden, die nichts anderes als eine völlig ineffektive und unrealistische Minderheitenposition bezüglich des globalen Energieverbrauchs und der Emissionen vertreten. Im Grunde sind diese an der Energiewirklichkeit vorbeigehenden „Führer“ nur der sprichwörtliche „Schwanz, der mit dem Hund wedelt“ und stellen nichts weiter als ein triviales Ärgernis für die Führung der Entwicklungsländer dar. Alles, was diese inkompetenten „Führer“ erreichen werden, ist die Zerstörung ihrer Volkswirtschaften und die Übergabe der globalen wirtschaftlichen Zukunft an die Entwicklungsländer, um die „Habenden und die nichts Habenden“ unserer zukünftigen Welt zu bestimmen.

Link: https://wattsupwiththat.com/2021/07/11/2020-global-energy-data-shows-fossil-fuels-completely-dominate-world-energy-use/

Übersetzt von Christian Freuer für das EIKE