Kenneth Haapala, President, The Science and Environmental Policy Project (SEPP)

„Es ist eine Sache, drastische Maßnahmen und harte wirtschaftliche Sanktionen zu verhängen, wenn ein Umweltproblem eindeutig und schwerwiegend ist. Eine ganz andere Sache ist es, dies zu tun, wenn das Umweltproblem weitgehend hypothetisch ist und nicht durch sorgfältige Beobachtungen belegt werden kann. Dies ist bei der globalen Erwärmung definitiv der Fall“. – Frederick Seitz, 17. Präsident der Nationalen Akademie der Wissenschaften der Vereinigten Staaten

Diese Abhandlung befasst sich mit der wissenschaftlichen Integrität, die mit der Befürchtung verbunden ist, dass die durch den Menschen verursachte Erhöhung des Kohlendioxidgehalts in der Atmosphäre zu einer erheblichen globalen Erwärmung führen wird. Um zu verstehen, wie Kohlendioxid die Temperaturen auf der Erde beeinflusst, muss man den Treibhauseffekt verstehen, wie verschiedene Treibhausgase den Wärmeverlust an den Weltraum beeinflussen, wie verschiedene Treibhausgase die Wirksamkeit anderer Treibhausgase in der Atmosphäre beeinflussen und wie die Zunahme des Treibhauseffekts das Klima beeinflusst. Um zu verstehen, wie sich die menschlichen Emissionen von Treibhausgasen auf das Klima auswirken, muss der Treibhauseffekt von anderen menschlichen Einflüssen auf das Klima, wie der Verstädterung, getrennt werden. Außerdem müssen die menschlichen Einflüsse von den natürlichen Klimaveränderungen getrennt werden, zu denen auch die veränderte Ozeanzirkulation und die veränderten Sonneneinflüsse gehören, die wir noch nicht vollständig verstehen.

Dieses kurze Papier ist in sechs grundlegende Abschnitte unterteilt: Erstens, die Bedeutung der wissenschaftlichen Methode für das Verständnis der physikalischen Welt; Zweitens, das sich verändernde Klima; Drittens, die Bedeutung des Treibhauseffekts, einschließlich Kohlendioxid, für das Leben auf diesem Planeten; Viertens, Probleme mit globalen Klimamodellen, die verwendet werden, um die katastrophalen Folgen zunehmender Treibhausgase, insbesondere Kohlendioxid, vorherzusagen; Fünftens, moderne physikalische Beweise, die eine alternative Analyse des Treibhauseffekts stützen; und Sechstens, ein Vorschlag für politische Maßnahmen, die die Nation ergreifen muss.

Abschnitt 1: Die wissenschaftliche Methode

Die wissenschaftliche Methode ist ein Prozess, bei dem Fehler im Denken und in den Konzepten beseitigt werden, indem die Konzepte ständig strengen Tests unterzogen werden, wobei alle verfügbaren und dafür geeigneten physikalischen Beweise verwendet werden. Wenn sich die physikalischen Beweise ändern, müssen auch die Konzepte entsprechend angepasst werden. Das 20. Jahrhundert begann ohne Relativitätstheorien oder Quantenmechanik, die die klassische Physik auf den Kopf stellten, und ohne den Glauben, dass sich Kontinente nicht bewegen. Heute nutzen wir diese Konzepte und erleben einen ständigen Wandel in der Kommunikation, Elektronik und ähnlichen Technologien. Wer weiß, was neue Entwicklungen bringen werden?

Mit dem dramatischen Wandel unseres Wissens über die physikalische Welt, einschließlich der Wissenschaft und der Wissenschafts-basierten Technologie, wie z. B. Atomwaffen, erlangten die Wissenschaftler politischen Einfluss und Verantwortung. Die strikte Anwendung der wissenschaftlichen Methode, insbesondere durch Wissenschaftler, die bei der US-Regierung angestellt sind oder von ihr gefördert werden und die der amerikanischen Öffentlichkeit gegenüber verantwortlich sind, sollte kein Thema sein. Politische Überzeugungen müssen beiseite gelassen werden. Steven Koonin (der leitende Wissenschaftler des Energieministeriums unter der Obama-Regierung), der mit komplexer mathematischer Physik, mathematischer Modellierung und dem IPCC-Prozess vertraut ist, schrieb:

„Philip Handler, ein ehemaliger Präsident der Nationalen Akademie der Wissenschaften, wies 1980 in einem Leitartikel auf das Problem hin, das auch vier Jahrzehnte später noch unheimlich nachhallt:

Die einzigartige Rolle der Wissenschaftler bringt eine besondere Verantwortung mit sich. Wir sind die Einzigen, die objektive Wissenschaft in die Diskussion einbringen können, und das ist unsere vorrangige ethische Verpflichtung. Wie Richter sind wir verpflichtet, persönliche Gefühle beiseite zu lassen, wenn wir unsere Arbeit tun. Wenn wir das nicht tun, nehmen wir der Öffentlichkeit das Recht, fundierte Entscheidungen zu treffen, und untergraben ihr Vertrauen in das gesamte wissenschaftliche Unternehmen. Gegen Wissenschaftler als Aktivisten ist überhaupt nichts einzuwenden, aber Aktivismus, der sich als Wissenschaft ausgibt, ist schädlich.“[1]

Seit den 1970er Jahren hat sich die Zahl der Beweise (Daten) für den Treibhauseffekt und den Einfluss zunehmender Treibhausgase auf die Erdatmosphäre und damit auf das Klima dramatisch erhöht. Es obliegt den Wissenschaftlern der Regierung und den von der Regierung geförderten Wissenschaftlern, die wissenschaftliche Methode anzuwenden und diese neuen Daten (Beweise) in ihre Berichte einzubeziehen, damit sie die amerikanische Öffentlichkeit nicht in die Irre führen.

Abschnitt 2: Das sich ändernde Klima

Der Atmosphärenphysiker Richard Lindzen ist bekannt für seine Arbeiten im Bereich der dynamischen Meteorologie, der atmosphärischen Gezeiten, der Ozonphotochemie, der quasi-biennialen Oszillation und der Iris-Hypothese. Lindzen beschrieb die allgemein akzeptierte Sichtweise des Klimasystems der Erde als Zirkulation zweier Flüssigkeiten (Atmosphäre und Ozeane), die miteinander und mit dem unebenen Land in Wechselwirkung stehen und durch die Rotation der Erdkugel in Turbulenzen versetzt werden, wodurch die Flüssigkeiten und das Land einer ungleichmäßigen Erwärmung durch die Sonne ausgesetzt werden. (Auch der Energiefluss von der Sonne zur Erde variiert.) Das gesamte System beinhaltet eine Flüssigkeitsdynamik, die nicht vollständig verstanden wird. Daher:

„Die Tatsache, dass diese Zirkulationen Wärme zur und von der Oberfläche transportieren, bedeutet, dass die Oberfläche selbst nie im Gleichgewicht mit dem Weltraum ist. Es gibt nie ein genaues Gleichgewicht zwischen der von der Sonne einfallenden Wärme und der von der Erde erzeugten Abstrahlung. Das liegt daran, dass in den Ozeanen immer Wärme gespeichert (und wieder abgegeben) wird. Daher schwankt die Oberflächentemperatur immer etwas.“ [Interpunktion leicht verändert][2]

Nach der Erörterung der beträchtlichen Energieübertragungen durch die Phasenwechsel des Wassers bringt Lindzen den Treibhauseffekt zur Sprache und stellt fest:

„… dass die beiden bei weitem wichtigsten Treibhaussubstanzen Wasserdampf und Wolken sind. Wolken sind auch wichtige Reflektoren für das Sonnenlicht.

Die Einheit zur Beschreibung der Energieflüsse ist Watt pro Quadratmeter. Der Energiehaushalt dieses Systems umfasst die Absorption und die Wiederabgabe von etwa 200 Watt pro Quadratmeter. Eine Verdoppelung des CO2 führt zu einer Störung dieses Budgets um 2 %. Das gilt auch für geringfügige Veränderungen der Wolken und anderer Merkmale, und solche Veränderungen sind üblich …“

Lindzen schließt den Abschnitt ab, indem er über „unerzwungene“ natürliche Schwankungen spricht, die erst nach 1.000 Jahren auftreten können. Der Klimawandel umfasst also zwei Bereiche der Physik, für die wir keine umfassenden, durch physikalische Beweise belegten Theorien haben: 1) die Strömungsdynamik und 2) der Treibhauseffekt.

Abschnitt 3: Der Treibhauseffekt

Der Treibhauseffekt macht die Erde bewohnbar. John Tyndall, der ab 1859 Laborexperimente entwickelte, erkannte, dass Treibhausgase die Atmosphäre erwärmen, indem sie den Wärmeverlust von der Oberfläche in den Weltraum verlangsamen. Diese Verlangsamung der Abstrahlung von Infrarotenergie in den Weltraum macht die Erde bewohnbar, wobei das wichtigste Treibhausgas der Wasserdampf ist. Tyndall stellte fest, dass der Einfluss einiger Treibhausgase nicht proportional zu ihren Konzentrationen ist.[3]

Jahrzehntelange Laborexperimente zeigen, dass Kohlendioxid nur bei extrem niedrigen Konzentrationen ein wirksames Treibhausgas ist. Seine Wirksamkeit ist bei weniger als der Hälfte der Konzentration erschöpft, die es hatte, als der Mensch begann, fossile Brennstoffe zu nutzen. Die Erhöhung der Kohlendioxidkonzentration durch den Menschen ist so, als würde man ein dünnes Laken auf eine dicke Bettdecke legen – es bewirkt wenig oder gar nichts.

In den 1970er Jahren, als Teile der Welt eine wirtschaftliche Entwicklung durchliefen und die Kohlendioxidkonzentration anstieg, zeigten die Oberflächentemperaturen der Erde eine Abkühlung statt einer Erwärmung. Der Nationale Forschungsrat bildete ein einflussreiches Gremium, das behauptete, dass, obwohl Laborexperimente zeigen, dass Kohlendioxid eine bescheidene Auswirkung auf die Temperatur hat, die leichte Erwärmung durch Kohlendioxid – weniger als 3 Prozent der gesamten atmosphärischen Erwärmung – durch den Anstieg des Wasserdampfs stark verstärkt würde. Dies war eine Vermutung, ohne physikalische Beweise. Die Vermutung führte dazu, dass aus einem bescheidenen maximalen Anstieg von 1 Grad Celsius (°C) aufgrund einer Verdoppelung des Kohlendioxids allein ein spekulativer Gesamtanstieg von 3°C wurde.[4]

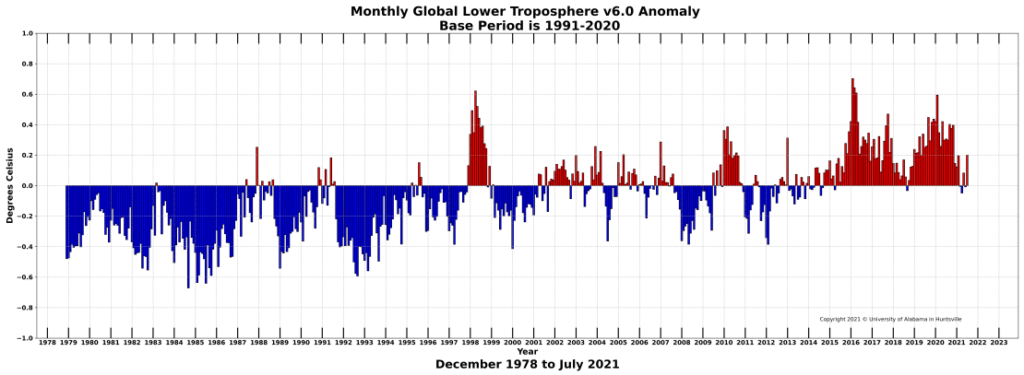

Das IPCC und viele wissenschaftliche Gremien in den USA haben diese Vermutung in ihre unbestätigten Annahmen aufgenommen. Seit 1979 haben die USA jedoch eine umfangreiche Sammlung von Beobachtungen der Atmosphäre mit Hilfe von Satelliten entwickelt. Vierzig Jahre gemessener atmosphärischer Temperaturtrends, der einzige umfassende globale Temperaturdatensatz, der existiert, bestätigen ein Jahrhundert von Laborexperimenten. Die Auswirkungen des zunehmenden Kohlendioxids sind gering, viel geringer als die natürlichen Schwankungen. An der Oberfläche ist es schwierig, die Zunahme des Treibhauseffekts von den natürlichen Schwankungen zu trennen.

[Hervorhebung vom Übersetzer]

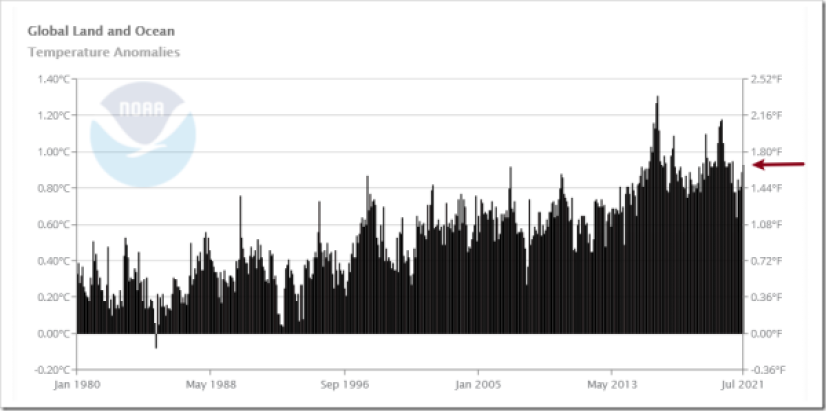

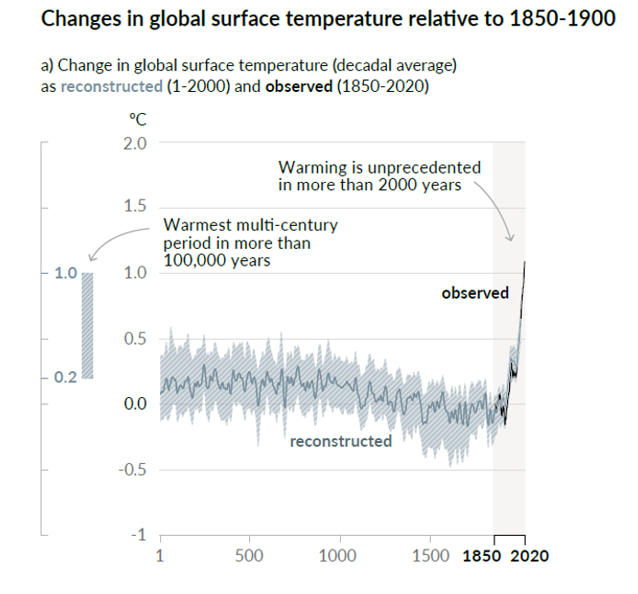

Auch die spekulierte Verstärkung durch erhöhten Wasserdampf ist nicht zu finden. Seit über 40 Jahren stellen die USA Daten über den Treibhauseffekt selbst zusammen, die die Temperaturtrends in der Atmosphäre bestätigen – eine Zunahme des Kohlendioxids führt zu einer mäßigen Erwärmung. Die derzeitige Erwärmung der Atmosphäre beträgt 0,1°C pro Jahrzehnt seit Januar 1979, oder etwa 0,6°C seit Januar 1979, oder etwa 1,4°C pro Jahrhundert. Dies liegt in der Mitte der niedrigsten Schätzungen der Erwärmung, die derzeit vom IPCC entwickelt werden, der von einem geringen Anstieg des Kohlendioxids ausgeht. Darin sind alle Treibhausgase und natürliche Schwankungen enthalten. Er liegt innerhalb der Bandbreite der natürlichen historischen Erwärmung[5].

Auf der Grundlage von NOAA-Beobachtungen auf dem Mauna Loa, Hawaii, tritt die maximale atmosphärische Kohlendioxidkonzentration jedes Jahr im Mai auf. Die Messungen im Mai stiegen von 339 ppm im Jahr 1979 auf 419 ppm im Jahr 2021. Dies ist ein Anstieg von 80 ppm oder 24%. Der Anstieg der atmosphärischen Temperaturen aus allen Quellen betrug jedoch nur 0,5°C. Die am besten geeigneten physikalischen Beweise stützen nicht die Befürchtung, dass die Zunahme des Kohlendioxids eine gefährliche Erwärmung verursacht[6].

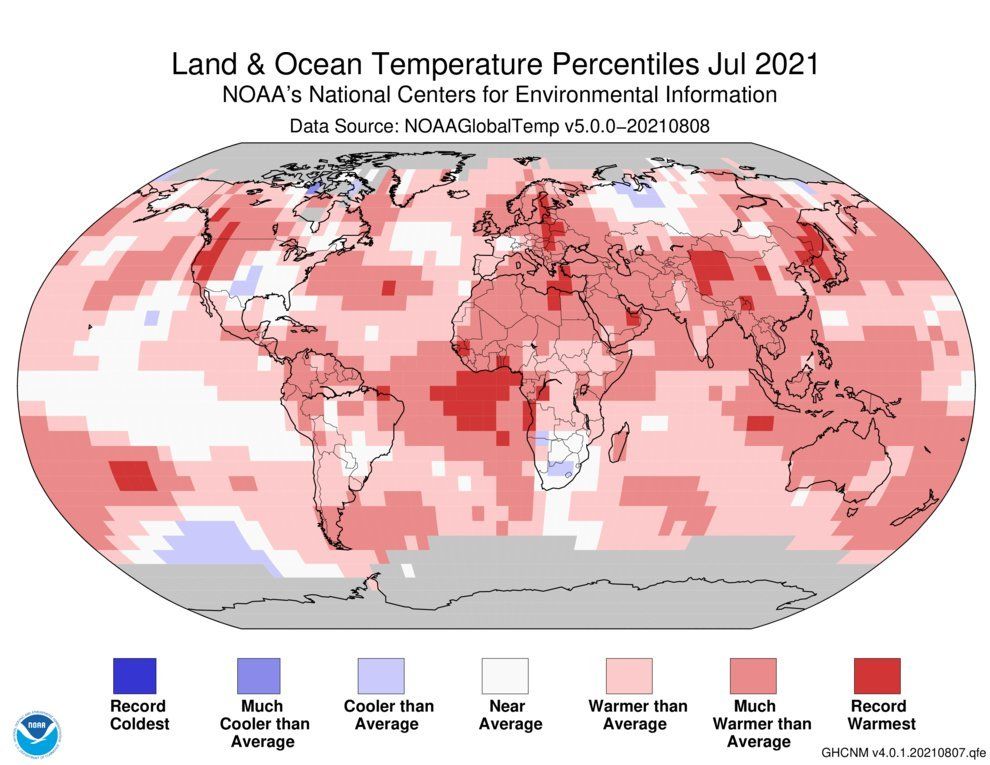

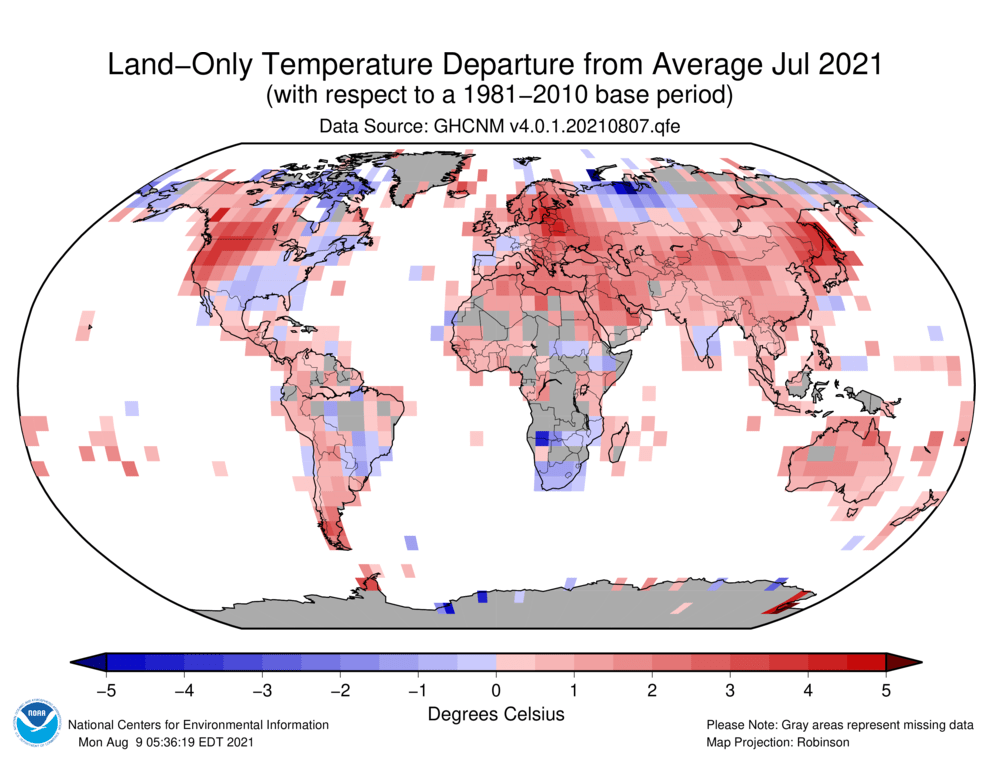

Damit eine Zunahme des Kohlendioxids zu einer Erwärmung der Erdoberfläche führen kann, muss sich die Atmosphäre schneller erwärmen als die Erdoberfläche, aber das Gegenteil ist der Fall. Die wahrscheinlichen Ursachen für die Oberflächenerwärmung sind die Verstädterung, Veränderungen der Ozeanzirkulationen und Sonnenschwankungen, die wir noch nicht vollständig verstehen, und nicht die Treibhausgase. Im Allgemeinen ignorieren diejenigen, die Oberflächendaten verwenden, um eine gefährliche Erwärmung zu behaupten, solche Veränderungen. Sie verwenden Modelle, die nie validiert wurden (anhand physikalischer Beweise aus der Atmosphäre), um 30 bis 80 Jahre in die Zukunft zu spekulieren.

Abschnitt 4: Probleme mit den globalen Klimamodellen

In seinem Buch „Unsettled“ zeigt Steven Koonin zahlreiche Mängel im IPCC-Prozess auf, die behoben werden müssen, wenn die Ergebnisse für die öffentliche Politik genutzt werden sollen. Zu den schwerwiegenderen Mängeln, die Koonin diskutiert, gehören:

A) eine Verwechslung der Skala zwischen Celsius und Kelvin bei der Schätzung des Einflusses einer Verdoppelung des Kohlendioxids, was zu erheblichen Fehlern führt, und

B) die IPCC-Modelle folgen nicht dem Erwärmungstrend in den Aufzeichnungen der Oberflächentemperatur zwischen 1910 und 1940.

Koonin weist auch auf die Komplexität der Klimamodelle hin, welche die Oberfläche und die Atmosphäre in verschiedene hypothetische Boxen, so genannte Zellen, unterteilen. Für alle Zellen werden genaue Messungen benötigt, die es aber nicht gibt. Außerdem sind die Zellen so groß, dass wichtige Wetterereignisse übersehen werden können. Am wichtigsten ist, dass die IPCC-Schlussfolgerungen politisch und nicht wissenschaftlich sind:

„Und – ein sehr wichtiger Punkt – die ‚Summaries for Policymakers‚ des IPCC werden stark von Regierungen beeinflusst, wenn nicht sogar geschrieben, die ein Interesse an der Förderung bestimmter politischer Maßnahmen haben. Kurz gesagt, es gibt viele Möglichkeiten, die Objektivität des Prozesses und des Produkts zu korrumpieren.“

Ein Buch des japanischen Klimatologen und ehemaligen NASA-Forschers Mototaka Nakamura zeigt die Unzulänglichkeiten der Erdoberflächentemperaturen auf und hält sie für unzuverlässig vor 1980.

Ein quasi-globales Beobachtungssystem gibt es erst seit etwa 40 Jahren, seit der Einführung der künstlichen Satellitenbeobachtung. Vor dieser Zeit wurden die Temperaturdaten über extrem kleine Gebiete (bezogen auf die gesamte Erdoberfläche) gesammelt und weisen daher eine starke räumliche Verzerrung auf. Wir verfügen über eine unzureichende Menge an Daten, um den Trend der globalen mittleren Oberflächentemperatur für die Zeit vor der Satellitenbeobachtung zu berechnen. Diese starke räumliche Verzerrung stellt die Aussagekraft des „Trends der globalen mittleren Oberflächentemperatur“ vor 1980 in Frage[7].

Nakamura geht auch auf Versuche ein, seine Ansichten zu diskreditieren, die jedoch fehlschlugen. Im Gegensatz zu Koonin, der die Entwicklung der globalen mittleren Oberflächentemperatur vor 1980 akzeptiert, stellt Nakamura fest, dass diese Entwicklung höchst fragwürdig ist. So ist beispielsweise seit über 2.000 Jahren bekannt, dass Veränderungen in der Landnutzung, wie die Trockenlegung von Feuchtgebieten, die Abholzung von Wäldern, die Bewässerung, die Verstädterung usw., zu einer Veränderung der lokalen Klimatemperaturen führen. Nakamura stellt fest, dass die globalen Oberflächentemperaturtrends auf einigen wenigen, stark lokalisierten Messungen beruhen und die gesamte Aufzeichnung, auf der die globalen Klimamodelle beruhen, stark verzerrt sein kann. Vergleicht man die Ergebnisse globaler Klimamodelle mit dem, was in der Atmosphäre geschieht, wo der Treibhauseffekt auftritt, so überschätzt das Modell die erwärmende Wirkung von Kohlendioxid und anderen Treibhausgasen erheblich. Beide Autoren beanstanden die Vorgehensweise des UN IPCC und der US-Regierung bei der Bewertung der Auswirkungen von Treibhausgasen als äußerst problematisch.

Die Auswirkungen der Treibhausgase auf die atmosphärische Temperatur sind weitaus geringer als in den Modellen dargestellt. Christy et al. verglichen vier verschiedene Satelliten-Datensätze, vier verschiedene Wetterballon-Datensätzr und vier Sätze von Wetter-Reanalysen mit dem Durchschnitt der Modellsimulationen, die im Fünften Sachstandsbericht des IPCC verwendet wurden. Die Forscher stellten fest, dass die Modelle die tatsächliche Entwicklung der atmosphärischen Temperatur stark überschätzen und dass die Diskrepanz immer größer wird. Globale Klimamodelle mögen nützliche Lehrmittel sein, aber sie sind für die Regierungspolitik in Bezug auf Treibhausgase nicht geeignet[8].

Abschnitt 5: Aktuelle physikalische Beweise, die eine alternative Analyse des Treibhauseffekts unterstützen

Im 20. Jahrhundert kam es zu großen Veränderungen in der Physik, wie der Relativitätstheorie und der Quantenmechanik, die die physikalischen Eigenschaften der Natur auf molekularer, atomarer und subatomarer Ebene beschreibt. Die Quantenmechanik führte zu einem Bereich der Physik, der als Atomare, Molekulare und Optische Physik (AMO) bezeichnet wird und die Entwicklung von Datenbanken ermöglichte, die zur direkten Berechnung des Treibhauseffekts in der Atmosphäre verwendet werden können [9].

Mit Hilfe der HITRAN-Datenbank haben die AMO-Verantwortlichen W. A. van Wijngaarden und W. Happer den Einfluss von Wasserdampf, Kohlendioxid, Ozon, Distickstoffoxid und Methan in einer wolkenfreien Atmosphäre auf die Erhöhung der globalen Temperaturen geschätzt. Unter den derzeitigen atmosphärischen Bedingungen haben ein Anstieg des Wasserdampfs und des Kohlendioxids nur minimale Auswirkungen auf die Temperaturen. Endlich haben wir Berechnungen, die mit den Messungen der Vorgänge in der Atmosphäre übereinstimmen. [10]

Abschnitt 6: Wie es weitergeht

Wissenschaftliche Integrität erfordert, dass die Regierung Biden die strengste Anwendung der wissenschaftlichen Methode anwendet.

Wie oben gezeigt, unterstützen Beobachtungen mit der Technologie des 21. Jahrhunderts bestimmte Konzepte des 20. Jahrhunderts und weisen andere als falsch aus. Wissenschaftliche Integrität erfordert, dass die Verwaltung keine langfristigen Modelle für die Politik verwenden sollte, solange die Modelle nicht die hohen Standards für die Verifizierung und Validierung erfüllen, die von den Sandia National Laboratories für die Modellierung der Zuverlässigkeit von Kernwaffen erfüllt werden, oder die Standards, die vom Apollo-Team von Wissenschaftlern und Ingenieuren für die bemannte Erforschung des Mondes gefordert werden[11], [12].

Da es derzeit keine physikalischen Beweise für eine gefährliche globale Erwärmung durch Treibhausgase oder deren Auswirkungen und auch keine physikalischen Beweise für eine Klimakrise gibt, sollte die Regierung die atmosphärischen Temperaturtrends und die MODTRAN- und HITRAN-Datenbanken nutzen, um die Auswirkungen zunehmender Treibhausgase in der Atmosphäre abzuschätzen. Außerdem sollte die Regierung weiterhin

● die Überwachung der atmosphärischen Temperaturen, wie sie seit 40 Jahren durchgeführt wird, und

● die ausgehende elektromagnetische Strahlung überwachen, wie dies im Rahmen des CERES-Projekts geschieht.

Vor allem aber sollte die Biden-Regierung die Öffentlichkeit darüber informieren, dass es keine aktuelle Bedrohung gibt und dass sie die bestmögliche Wissenschaft zur Überwachung der Situation einsetzt, um sicherzustellen, dass sich keine Bedrohung entwickelt.

This article is adapted from a version that first appeared on the website of the Science and Environmental Policy Project (SEPP) July 28, 2021, and is used by permission.

Endnotes

[1] Steven E. Koonin, Unsettled: What Climate Science Tells Us, What It Doesn’t, and Why It Matters, BenBella Books, Inc, 2021 Kindle Edition; p 10, Introduction.

[2] Richard Lindzen, Global Warming for the Two Cultures, Global Warming Policy Foundation, October 2018.

[3] John Tyndall, Heat, a Mode of Motion, 5th ed., 1875, p. 359; the book is available in PDF.

[4] Ad Hoc Study Group on Carbon Dioxide and Climate, Massachusetts Institute of Technology, Jule G. Charney, Chairman, et al., Carbon Dioxide and Climate: A Scientific Assessment, presented to the Climate Research Board, Assembly of Mathematical and Physical Sciences, National Research Council, National Academy of Science, 1979.

[5] Roy W. Spencer, UAH Global Temperature Update for June 2021: -0.01 deg. C, July 2, 2021. Data from Global Temperature Report, Earth System Science Center, The University of Alabama in Huntsville, June 2021, data from https://www.nsstc.uah.edu/climate/.

[6] Data from NOAA, Global Monitoring Laboratory, Mauna Loa, Hawaii, accessed July 26, 2021.

[7] Motokaka Nakamura, Confessions of a climate scientist: The global warming hypothesis is an unproven hypothesis, Kindle Edition, October 2019.

[8] John R. Christy, Roy W. Spencer, William D. Braswell & Robert Junod, “Examination of space-based bulk atmospheric temperatures used in climate research,” International Journal of Remote Sensing, March 8, 2018.

[9] Iouli E. Gordon, The HITRAN Database, Harvard-Smithsonian Center for Astrophysics, Atomic and Molecular Physics Division, accessed July 12, 2019.

[10] W. A. van Wijngaarden and W. Happer, “Dependence of Earth’s Thermal Radiation on Five Most Abundant Greenhouse Gases,” Atmospheric and Oceanic Physics, June 4, 2020. Link to prepublication version.

[11] William L. Oberkampf, Timothy G. Trucano, and Charles Hirsch, Verification, Validation, and Predictive Capability in Computational Engineering and Physics, Sandia National Laboratories, Sand Report, February 2003.

[12] One More Mission, The Right Climate Stuff Team.

Link: https://cornwallalliance.org/2021/08/comments-on-federal-scientific-integrity/

Übersetzt von Christian Freuer für das EIKE