NTV hatte am 12. Januar 2019 berichtet, Zitat:

„Bisher waren Forschungen zum SRM, auch solares Geoengineering genannt, auf das Labor und Computersimulationen beschränkt. Doch dieses Jahr wollen Wissenschaftler erstmals den Schritt nach draußen wagen: Forscher der Harvard-Universität planen ein Experiment, bei dem kleine Partikel in einer hohen Luftschicht ausgebracht werden, wie das Magazin „Nature“ berichtete. Untersucht werden soll so die „Stratospheric Aerosol Injection“ (SAI), eine Variante des solaren Geoengineerings, bei der ein Partikelmantel einen Teil der Sonnenstrahlen ablenkt und die Sonne so verdunkelt wird. Das Projekt mit dem Namen Stratospheric Controlled Perturbation Experiment (SCoPEx) hat mit Bill Gates einen berühmten Förderer und könnte schon in der ersten Jahreshälfte starten. Ein Ballon soll bis in die Stratosphäre aufsteigen, in rund 20 Kilometern Höhe soll er dann Wolken kleiner Partikel aus Kalziumkarbonat, also Kalk, ausstoßen. Anschließend messen Sensoren an dem Ballon, wie sich diese ausbreiten.“

Als Förderer des SCoPEx-Projekts werden angegeben:

“William and Flora Hewlett Foundation; The Open Philanthropy Project; Pritzker Innovation Fund; The Alfred P. Sloan Foundation; VoLo Foundation; The Weatherhead Center for International Affairs; G. Leonard Baker, Jr.; Alan Eustace; Ross Garon; Bill Gates; John Rapaport; Michael Smith; Bill Trenchard.”

Dem EIKE-Artikel „‚Klimaschutz‘: Riskantes Spiel mit dem Wetter“ vom 7. Februar 2021 war zu entnehmen, dass ein erster Praxistest im Rahmen des SCoPEx-Experiments offenbar bereits für Juni 2021 geplant gewesen sei. Aber aus diesem SCoPEx-Test wird nun offenbar vorerst nichts werden, wie die taz am 5. April 2021 unter dem Titel „Klimamanipulation abgeblasen“ gemeldet hatte, Zitat:

„Ende letzter Woche gaben Harvard und SSC [staatliche schwedische Raumfahrtgesellschaft] bekannt, dass die Pläne auf Eis gelegt würden: Es gebe in der internationalen Wissenschaft einen Bedarf nach weiterer Diskussion zu diesem Thema, denn bislang gebe es ‚keinen Konsens, inwieweit ein solcher Versuch angemessen ist‘. Die SSC-Mitteilung führt eine weitere Begründung an, die eine Beteiligung Schwedens am Test auf absehbare Zeit unmöglich machen dürfte: ‚Es fehlen heute internationale Abkommen bezüglich der Forschung im Geoengineering-Sektor.‘“

Bevor man mit dem solaren Klimaantrieb unserer Erde herumspielt kann uns ja vielleicht die Aga-Kröte mal erzählen, was bei nicht bis zu Ende gedachten menschlichen Eingriffen in natürliche Abläufe so alles passieren kann.

Schauen wir uns nachfolgend also einmal genauer an, ob ein solcher Eingriff in die terrestrische Temperaturgenese mit oder ohne ein internationales Abkommen tatsächlich angemessen wäre

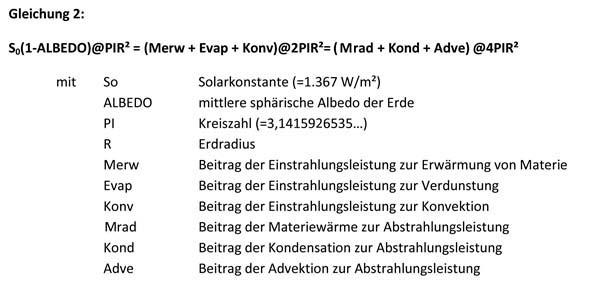

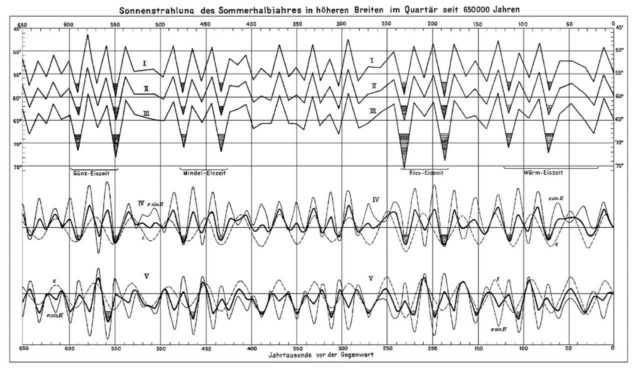

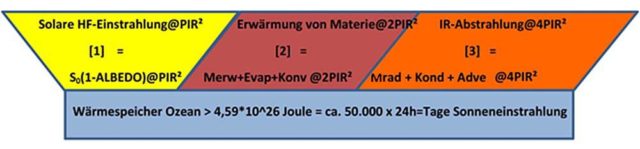

Kiehl & Trenberth lassen in ihrem konventionellen IPCC-Modell KT97 die Vektor-Richtung der solaren Einstrahlung [1] mit einem Skalar-Trick verschwinden und fokussieren ihren Tag=Nacht-Faktor4-Flacherdeansatz für die Solarkonstante „So/4“ auf die radiale Abstrahlung der Erde [3]. Die gesamte Ursachen-Wirkungs-Kette für die terrestrische Temperaturgenese lautet aber,

Aussage 1:

Solare HF-Einstrahlung@PIR² [1]=> Erwärmung von Materie@2PIR² [2]=> IR-Abstrahlung@4PIR² [3]

Der EIKE-Artikel „Anthropogener Treibhauseffekt: nach wie vor zu schwach für die Klimakatastrophe!“ von Dr. Roland Ullrich enthält die bekannte KT97-Darstellung mit einer atmosphärischen Gegenstrahlung von 333W/m². Dort wurde auch eine Gleichung für die globale Verteilung der Sonneneinstrahlung aufgestellt:

GLEICHUNG 1: So + Evap + Erad + Konv + X = 0 (Dr. Roland Ullrich)

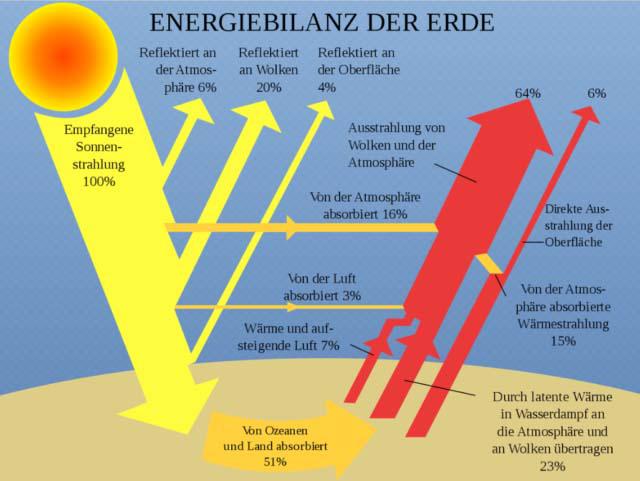

Die in einem späteren Artikel von Dr. Ullrich nachgereichte „realistische Darstellung der Energiebilanz der Erde“ verschleiert durch Prozentangaben wiederum die zugehörigen spezifischen Leistungen:

Durch die Prozentangaben in Abbildung 1 wird aber auch noch die Betrachtungsperspektive (PIR² oder 2PIR² oder 4PIR²) verschleiert. Allein der Term „Von Ozeanen und Land absorbiert 51%“ entspräche bezüglich der Solarkonstanten (So=1.367W/m²) einer spezifischen Strahlungsleistung von 697W/m² mit einem rechnerischen S-B-Temperaturäquivalent von 60°C. Und für die „atmosphärische Gegenstrahlung“ taucht dort lediglich der aufsteigende IR-Term „Von der Atmosphäre absorbierte Wärmestrahlung 15%“ (entsprechend 205W/m² von So) auf, der jedoch nicht auf die Erdoberfläche zurückgeführt wird. Von daher bleibt dort der fiktive atmosphärische Antrieb für den sogenannten „natürlichen atmosphärischen Treibhauseffekt“ rechnerisch völlig im Dunklen. Und damit fehlt wiederum jede Erklärung, wie die Lücke von 155W/m² in der konventionellen Faktor4-Klimatheorie zwischen einer fehlerhaft abgeleiteten „natürlichen Gleichgewichtstemperatur“ unserer Erde von (-18°C) und der sogenannten „gemessenen globalen Durchschnittstemperatur“ (NST) von ca. (15°C) geschlossen werden sollte.

Die Vektorrichtung der parallelen solaren HF-Einstrahlung kann nämlich nur über die Erwärmung von Materie in eine radiale terrestrische IR-Abstrahlungsrichtung transformiert werden. Denn Photonen wandeln sich nun mal nicht freiwillig von kurzwelliger HF-Strahlung (solar=niedrige Entropie) zu langwelliger IR-Strahlung (terrestrisch=hohe Entropie) um; dazu bedarf es vielmehr in einem Zwischenschritt der Erwärmung von Materie (Aussage1: [2]), und das ist nur auf der Tagseite der Erde möglich. Dazu passt auch die Aussage von Prof. Dr. Heinz Fortak aus seinem Buch Meteorologie von 1971, Sekundärzitat aus einer Email vom 21.05.2021 um 21:08 Uhr an einen reduzierten Skeptiker-Email-Verteiler mit Dank an Dr. Gerhard Kramm:

„Der Strahlungsanteil in Hoehe von 3.52 kWh/(m2 d) (42 %), welcher das System Erde – Atmosphaere effektiv erwaermt, besteht aus der kurzwelligen Strahlungsabsorption in der Atmosphaere und am Erdboden (17 % + 47 % = 64 %) abzueglich des Energiebetrages, der zur Verdunstung des Wassers benoetigt wurde. Der „Kreislauf“ der langwelligen Strahlung zwischen Erdoberflaeche und Atmosphaere traegt nicht zur Erwaermung des Systems bei. Die effektive langwellige Ausstrahlung nach oben von 64 % dient zur Aufrechterhaltung des Strahlungsgleichgewichts an der Obergrenze der Atmosphaere.“

Damit können wir für einen (IN=OUT)-Gleichgewichtszustand feststellen,

Aussage 2:

(Solare HF-Einstrahlung [1] @2PIR² [2] = terrestrische IR-Abstrahlung @4PIR² [3]) @ NST=CONST

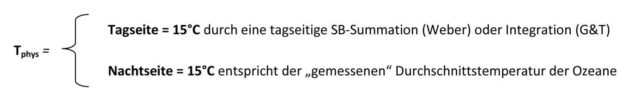

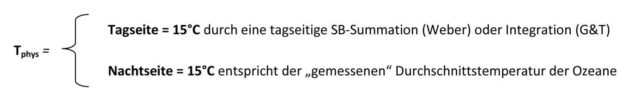

Und wenn wir in Ermangelung von Alternativen mit Durchschnittswerten argumentieren, führt die Gleichsetzung NST=Tphys zu

Aussage 3:

Hinweis zur Temperatur auf der Nachtseite: Die Umgebungsgleichung des S-B-Gesetzes stellt die Ausgangssituation für meine Betrachtung der Nachtseite unserer Erde dar. Dadurch werden die Temperaturverhältnisse und die daraus abzuleitenden Flussrichtungen der Energie von warm zu kalt eindeutig definiert, aber der physikalische Ausgleichsmechanismus kann und wird selbstverständlich alle Arten des Energietransportes umfassen, wie ich das in der Vergangenheit bereits mehrfach ausgeführt hatte (beispielsweise hier: Land-Seewind-System und hier: 6. ERKENNTNIS).

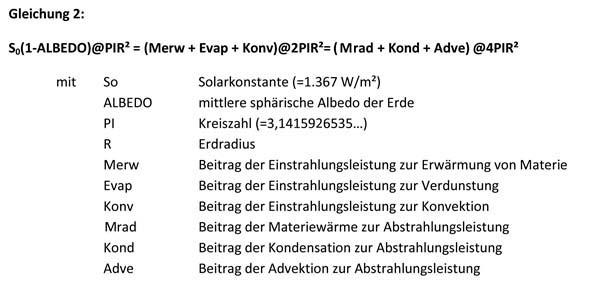

Kommen wir jetzt noch einmal zu dem Modell KT97 von Kiehl & Trenberth zurück. Es ist klar hervorzuheben, dass der Ausdruck „S0“ in der Wissenschaft eindeutig für die Solarkonstante von 1.367 W/m² steht; das Faktor-4-Derivat von Kiehl & Trenberth leitet sich dagegen aus (S0/4) her. Und schließlich wäre hier von den KT97-Anhängern noch zu klären, wie ein IR-Spektrum von bis zu 120°C (@ S0) auf der Tagseite unserer Erde (generell S0 (1-ALBEDO)*COS(Zenitwinkel)) mit dem ominösen „Faktor4“ gemittelt wird, um so 4x das IR-Spektrum von -18°C (@235W/m²) zu erzeugen; insbesondere, wo dabei die höheren, ausschließlich auf der Tagseite erzeugten IR-Frequenzen abbleiben sollen (hier in Abbildung 6 dargestellt). Auf der anderen Seite kann Energie nicht einfach so verschwinden. In der Gleichung 1 sind aber Kondensation („Kond“) und Advektion („Adve“) nicht enthalten, es sei denn implizit in „Evap“ und „Konv“, was diese Terme dann allerdings mit („Evap“=„Evap“-„Kond“) und („Konv“=„Konv“-„Adve“) selbst auf „0“ bringen würde. Klarer wird vielleicht eine hemisphärische Betrachtung:

Es ergibt sich daraus die nachfolgend in Tabelle 1 dargestellte Situation:

Der Bodenwärmefluss sowie der Term „X“ aus Gleichung 1 sind hier nicht aufgeführt. Setzen wir einmal anstelle von Term „X“ einen Albedo-Antrieb ein:

Tabelle 1: Die Temperaturgenese auf unserer Erde [1]=>[2]=>[3] wird durch die ozeanischen Wärmespeicher mit einer Mitteltemperatur von etwa 15°C gestützt.

Die orbitalen Milanković-Zyklen stellen die einzige bekannte unabhängige Zeitreihe dar, die mit ihrem Frequenzspektrum die Schwankungen der paläoklimatischen Temperaturproxys für die letzten 420.000 Jahre in etwa abbilden können. Die Albedo unserer Erde ist dagegen die einzige bekannte Variable, die über eine Beeinflussung des reflektierten Anteils der Sonnenstrahlung die dafür notwendigen Schwankungen des solaren Klimaantriebs verursachen kann. Der Antrieb „X“ kann daher als +/-DELTA ALBEDO durch ein Albedo-Forcing beschrieben werden:

Gleichung 3: (S0 – S0*ALBEDO +/- S0*DELTA ALBEDO)@PIR² = (Merw + Evap + Konv)@2PIR²

Die linke Seite der Gleichung 3 bestimmt also, welche spezifische solare Strahlungsleistung überhaupt für die terrestrische Temperaturgenese zur Verfügung steht, und zwar zwischen einer Albedo von „0“=Schwarzkörper und „1“=Diskokugel, respektive 1.367W/m² und 0W/m². Manchmal wird die Zeit (t) ebenfalls eingebunden, aber das würde insofern zu Komplikationen führen, weil die Verweildauer von Wärme in den globalen Strömungssystemen von Atmosphäre und Ozeanen sehr unterschiedlich ist. Verstehen wir die Gleichungen 2 und 3 also eher als Ergebnis einer langjährigen Durchschnittsbetrachtung. An einer Weltformel für die Temperatur hatte ich mich hier einmal versucht, und hier an einem natürlichen Klimamechanismus.

Und jetzt schauen wir einmal genauer auf unser Eiszeitalter:

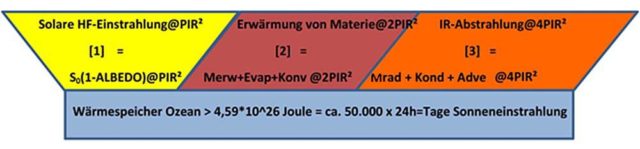

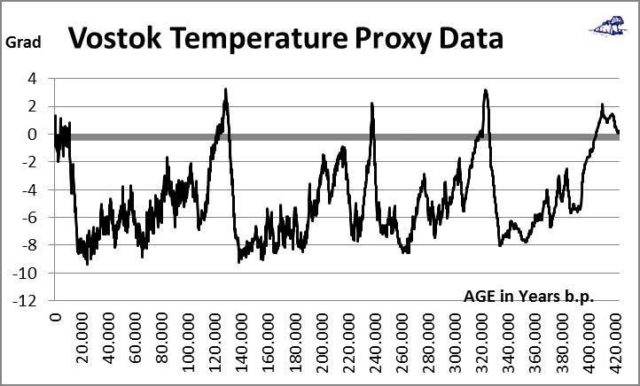

Wir leben gegenwärtig in einem Interglazial der gegenwärtigen Eiszeit, also irgendwo zwischen der letzten Kaltzeit und der nächsten, wie die nachfolgende Abbildung mit den Temperaturproxys der antarktischen Vostok-Bohrung zeigt:

Abbildung 2: Isochrone Interpolation der Temperaturproxys aus den Vostok-Daten [1]

In den vergangenen 420.000 Jahren beschränkten sich die sogenannten Warmzeiten oder Interglaziale auf Zeiträume von jeweils 10.000 bis 15.000 Jahren. Unser aktuelles Interglazial besteht nun bereits seit etwa 12.000 Jahren, hat also voraussichtlich noch zwischen 0 und 3.000 Jahre Bestand. Und dann wird es wieder für etwa 100.000 Jahre lang ziemlich kalt, mit Gletschern im norddeutschen Tiefland und allem was so dazu gehört. Damit sollte uns aber auch die Frage interessieren, was genau den Wechsel von einer Warmzeit zu einer Kaltzeit hervorruft.

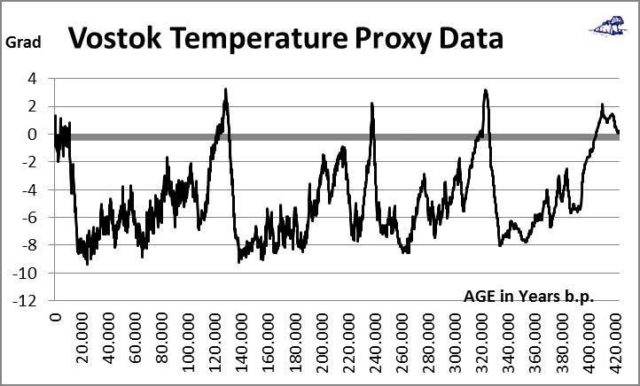

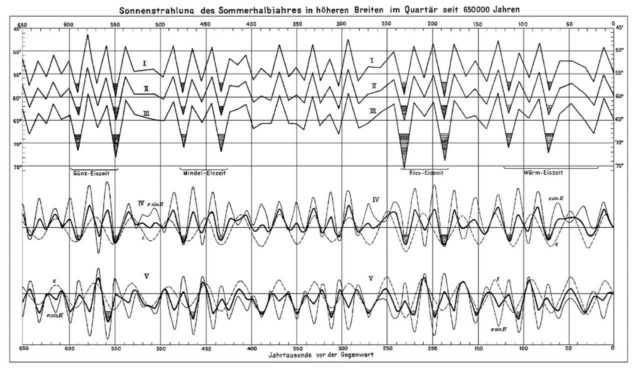

Köppen und Wegener machen in ihrem Werk „Die Klimate der geologischen Vorzeit“ (Bornträger 1924, Nachdruck bei Schweizerbart) die sommerliche Sonneneinstrahlung in höheren geographischen Breiten für den Wechsel von Warm- und Kaltzeiten verantwortlich.

Abbildung 3: Rekonstruktion der Sonnenstrahlung des Sommerhalbjahres in höheren Breiten im Quartär seit 650.000 Jahren, aus Köppen & Wegener (1924), Graphik von M. Milanković, gemeinfrei aus Wikipedia

Nach Köppen und Wegener kommt es bei einer Kaltzeit nämlich gar nicht darauf an, wie extrem kalt es im Winter wird, sondern wie viel Schnee und Eis über den Sommer liegen bleibt. Das gilt insbesondere für die polaren Regionen in den höheren geographischen Breiten, wo durch eine solche Erhöhung der sommerlichen Albedo dann weitere Sonneneinstrahlung reflektiert wird, sodass dadurch keine Materie mehr erwärmt werden kann und folglich die Temperaturen sinken.

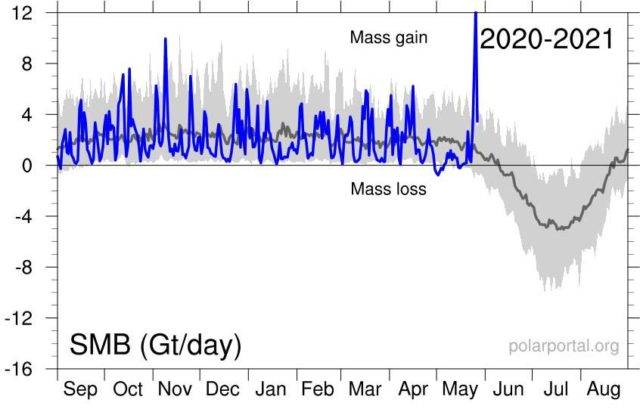

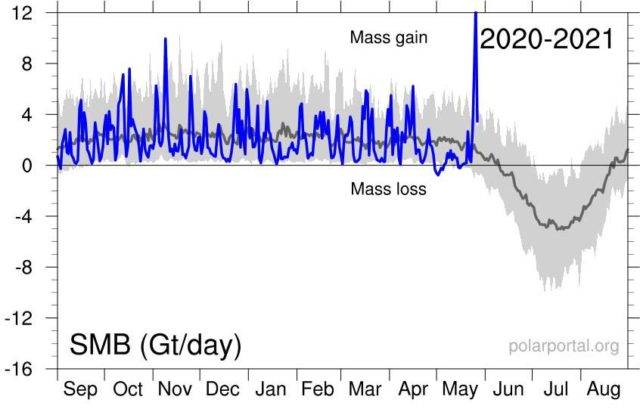

Die dänischen Forschungseinrichtungen für die Arktis präsentieren auf ihrem Polar Portal die Daten über den Zustand zweier Hauptkomponenten der Arktis, der grönländischen Eisdecke und des Meereises. Die nachfolgende Abbildung von diesem Portal zeigt, wie die Oberfläche des grönländischen Eisschildes täglich an Masse gewinnt und verliert, also die Oberflächenmassenbilanz. Die Massenverluste durch Abkalben von Gletschern sind dort nicht enthalten.

Abbildung 4: Oberflächenmassenbilanz der aktuellen Saison für das Grönländische Eisschild gemessen in Gigatonnen (1 Gt entspricht 1 Milliarde Tonnen und entspricht 1 Kubikkilometer Wasser). Die dunkelgraue Kurve zeichnet den Mittelwert aus dem Zeitraum 1981-2010. Quelle: Dänisches Polar Portal

Das hellgraue Band in Abbildung 4 zeigt die jährlichen Masseunterschiede von Jahr zu Jahr für den Zeitraum 1981-2010, wobei die niedrigsten und höchsten Werte für jeden Tag weggelassen worden sind. Wir können deutlich erkennen, dass der Masseverlust des Grönländischen Eisschildes erst Anfang Juni beginnt und bereits in der 2. Augusthälfte endet, also auf etwa drei Monate im Jahr beschränkt ist und im Maximum auf den Juli fällt. Wenn sich dieser kurze Zeitraum der Schmelze in den höheren geographischen Breiten noch weiter einschränken würde, bliebe dort dann von Jahr zu Jahr etwas mehr Schnee und Eis liegen und es würde immer mehr Sonnenstrahlung reflektiert und trüge nicht mehr zur terrestrischen Temperaturgenese bei. Wir erinnern uns an den Unterschied zwischen der spezifischen Strahlungsleistung und der übertragenen Wärmemenge:

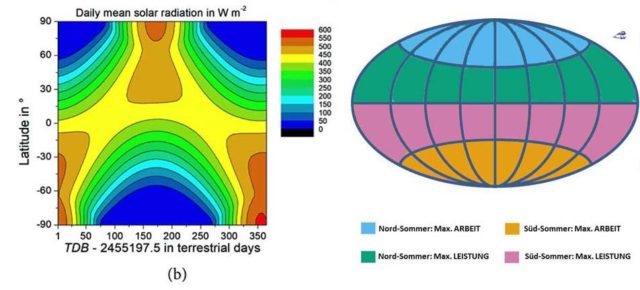

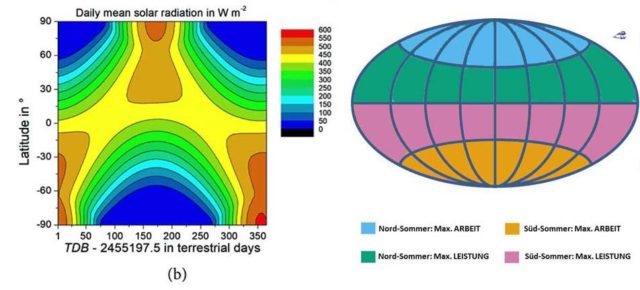

Abbildung 5: Zum Unterschied zwischen Leistung und Arbeit der solaren Einstrahlung. Links: Gemittelte 24h-tagesdurchschnittlich zurückgerechnete Strahlungsleistung der Sonne in Abhängigkeit von der Jahreszeit und der geographischen Breite über ein Jahr (Abbildung 22 b aus Kramm et al. (2017): … (b) solar radiation reaching the Earth’s surface; … as predicted for one year starting with TDB=2,455,197.5 (January 1, 2010, 00:00 UT1) – Creative Commons License CC BY 4.0)´. Rechts: Die maximale spezifische solare (Strahlungs-)LEISTUNG (~S-B-Temperaturäquivalent) und die maximale solare ARBEIT (Arbeit=Leistung x Zeit über die örtliche Tageslänge) im jeweiligen Sommerhalbjahr auf der Nord- und Südhalbkugel (nicht flächengetreu – weitere Erläuterungen sind hier zu finden)

In den höheren geographischen Breiten ist also die solare Arbeit im Sommerhalbjahr sogar noch größer als in den Tropen, die maximal mögliche S-B-Gleichgewichtstemperatur folgt allerdings immer dem höchsten Sonnenstand zwischen den beiden tropischen Wendekreisen des Krebses und des Steinbocks, wobei diese Temperatur aufgrund von Konvektion und Verdunstung nirgendwo erreicht wird. Einen möglichen Wirkmechanismus für ein natürliches Klimaforcing hatte ich hier auf KS beschrieben.

Es gibt auf unserer Erde keine Energiequelle, die den Wechsel zwischen Kalt- und Warmzeiten verursachen kann. Die orbitalen Milanković-Zyklen stellen die einzige bekannte unabhängige Zeitreihe dar, die mit ihrem Frequenzspektrum die Schwankungen der paläoklimatischen Temperaturproxys für die letzten 420.000 Jahre in etwa abbilden können. Aber selbst die Schwankung der solaren Einstrahlung innerhalb dieser Zyklen reicht vom Betrag her als Erklärung für den Wechsel von klimatischen Kalt- und Warmzeiten nicht aus. Die Albedo unserer Erde ist die einzige bekannte Variable, die über eine Beeinflussung des reflektierten Anteils der Sonnenstrahlung die dafür notwendigen Schwankungen des solaren Klimaantriebs verursachen kann, und zwar, ganz generell nach Gleichung (3) betrachtet, zwischen den Extrema einer Albedo von „0“=Schwarzkörper und „1“=Diskokugel, entsprechend einer temperaturwirksamen spezifischen solaren Strahlungsleistung von 1.367W/m² respektive 0W/m².

Die Klimasensitivität der Sonnenstrahlung

Den „Antrieb X“ aus Gleichung (1), Zitat: „Man sieht in der Tabelle, dass der Antrieb X um ca. 7 Watt/m2 wächst für jeweils 1 Grad Temperaturerhöhung“, hatte ich nicht übernommen. Stattdessen hatte ich in Gleichung (3) den variablen Term (+/- S0*DELTA ALBEDO) mit der Erd-Albedo eingeführt. Wie ich hier auf KS bereits einmal ausführlich dargestellt hatte, können die Schwankungen des natürlichen Paläo-Klimaantriebs als (+/-DELTA ALBEDO) durch ein Albedo-Forcing beschrieben werden, und zwar mit 13,67 [W/m²] pro Prozent Albedo und 9 [W/m²] pro Kelvin:

Douglas und Clader [2] geben die Klimasensitivität k der Sonneneinstrahlung aus eigenen Versuchen zu

Gleichung 4: Delta T/Delta F = k = 0,11 +/- 0,02 [°Celsius / Wm2] an.

Damit ergibt sich für die Vostok-Temperaturproxys von 5,44°C bis 18,06°C um die sogenannte globale Durchschnittstemperatur (NST) von 14,8°C eine Schwankungsbreite der spezifischen solaren Strahlungsleistung von:

Gleichung 5: DELTA FV@NST = +29,36 [W/m²] und -85,36 [W/m²]

Dieser Betrag stimmt in etwa mit den Berechnungen von Lascar et al. [3] überein, die für 65°N / 120°E eine Schwankung der Sonneneinstrahlung von bis zu +/- 50 [W/m²] über orbitale Zyklen angeben. Aus der Solarkonstanten von 1.367 [W/m²] und der Albedo von Douglas und Clader [1] mit a = 0,3016 ergibt sich eine reflektierte/refraktierte Energiemenge von 412,29 [W/m²], die nicht zur Klimaentwicklung beiträgt. Daraus wiederum lässt sich ein Beitrag von 13,67 [W/m²] pro Prozent Albedo ermitteln und, umgerechnet auf die Extremwerte der absoluten Vostok-Temperaturproxys, eine Schwankungsbreite für die Albedo der Erde von:

Gleichung 6: F@amin = 412,29 – 29,36 [W/m²] = 382,93 [W/m²] mit dem Albedo amin = 0,2801

Gleichung 7: F@amax = 412,29 + 85,36 [W/m²] = 497,65 [W/m²] mit dem Albedo amax = 0,3640

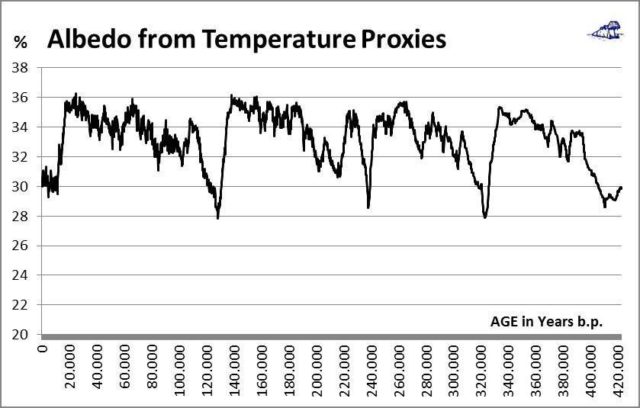

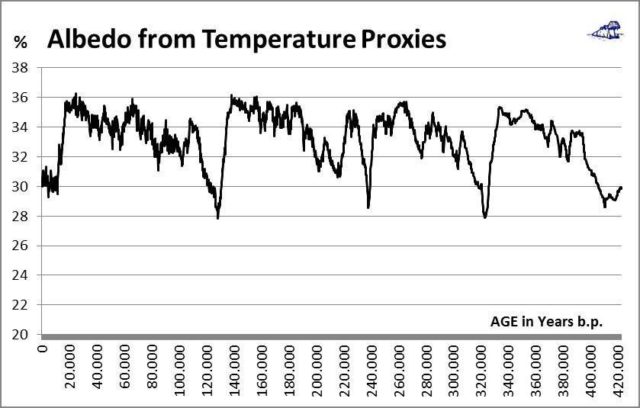

In der nachfolgenden Abbildung sind die Vostok-Temperaturproxys in Albedoschwankungen umgerechnet worden, und zwar beginnend mit einer Albedo von 0,3016 für die aktuelle „gemessene“ globale Durchschnittstemperatur (NST) von 14,8° Celsius:

Abbildung 6: Die Varianz der Erdalbedo über die Warm- und Kaltzeiten abgeleitet aus den Vostok Temperaturproxys [1]

Kaltzeiten dürften jeweils in einem Zeitabschnitt beginnen, in dem die Nordsommer auf das Abhel der

elliptischen Erdbahn fallen, weil dort die Sommersonne schwächer ist als im Perihel; und genau in diesem Abhel befinden wir uns gerade. Und wenn Sie jetzt die Abbildung 6 auf Sich wirken lassen, würden Sie da auf die Idee kommen, die Albedo unserer Erde künstlich zu erhöhen?

Die Menschheit hat mit der Albedo unserer Erde möglicherweise erstmals einen echten „Kipp-Punkt“ für unser globales Klima zu fassen bekommen. Und im heiligen Klimawahn sollten wir jetzt nicht wie unwissende Kinder an dieser Stellschraube herumpfuschen und das Klimaparadies unserer Warmzeit zerstören.

Aber eine Stimme aus dem Off sagte, „Beruhige Dich, denn es könnte schlimmer kommen…“

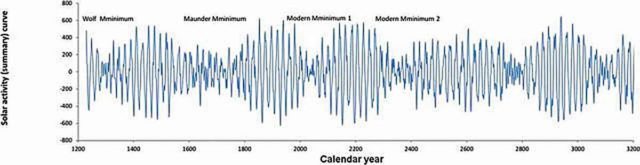

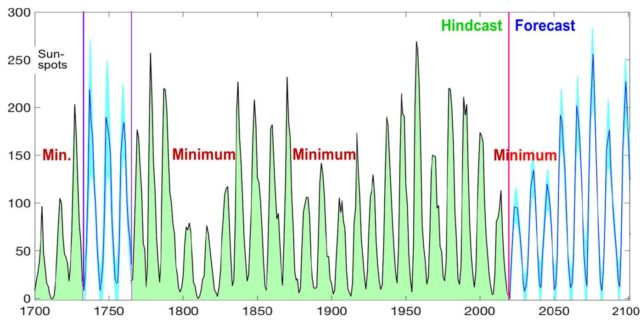

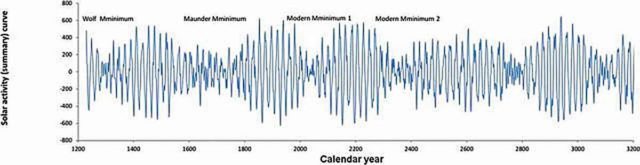

Und natürlich kommt es noch schlimmer. In einem EIKE-Artikel erklärt Professor Valentina Zharkova, wie sich aus dem zyklischen Wechsel des Solardynamos zwischen einem poloidalem und einem toroidalem Magnetfeld durch deren Interferenz eine Schwebungsfunktion ergibt. Diese Schwebung verursacht Schwankungen der Gesamtabstrahlung unserer Sonne (Total Solar Irradiance =TSI), die wiederum zu Großen Solarzyklen von 350-400 Jahren führen sollen, wie die nachstehende Abbildung zeigt:

Abbildung 7: Rekonstruierte Kurve der Sonnenaktivität für 1200-3300 n. Chr. (aus einer Zusammenfassung auf EIKE, Daten von Zharkova et al. (2020).

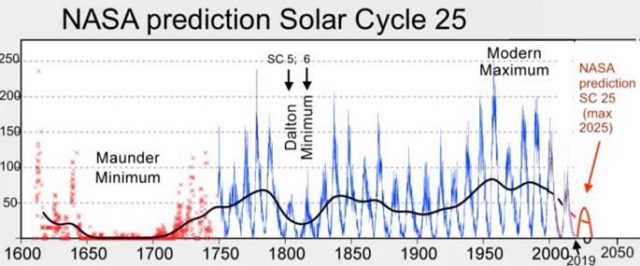

Und das ist immer noch nicht alles. V.M. Velasco Herrera, W. Soon und D.R. Legates haben gerade einen neuen Artikel mit dem Titel, “Does Machine Learning reconstruct missing sunspots and forecast a new solar minimum?” veröffentlicht. In der Presseerklärung heißt es dazu u.a., Google-übersetztes Zitat:

„Die drei Wissenschaftler haben einem Algorithmus für maschinelles Lernen beigebracht, wie man zugrunde liegende Muster und Zyklen in den Sonnenflecken der letzten 320 Jahre erkennt. Der Algorithmus entdeckte dann eine bisher unbemerkte Wechselwirkung zwischen den 5,5-jährigen Sonnenhalbzyklen (blau) und den 120-jährigen Gleissberg-Doppelzyklen […], die es ihm ermöglichte, die früheren Vorhersagen eines ruhigen halben Jahrhunderts zu bestätigen – Vorhersagen, die jetzt von Sonnenphysikern geteilt werden.“

Die nachfolgende Abbildung zeigt eines der Ergebnisse von Velasco Herrera et al.:

Auch nach diesen Ergebnissen einer KI-Signalanalyse der Sonnenflecken steht uns offenbar ein solares Minimum bevor. Und sogar die NASA rechnet für die kommenden Jahre mit einem neuen solaren Minimum, Zitat aus einem EIKE-Artikel:

„Die neue Untersuchung wurde von Irina Kitiashvili geleitet, einer Forscherin des Bay Area Environmental Research Institute am Ames Research Center der NASA im kalifornischen Silicon Valley. Sie kombinierte Beobachtungen von zwei NASA-Weltraummissionen – dem Solar and Heliospheric Observatory und dem Solar Dynamics Observatory – mit Daten, die seit 1976 vom bodengestützten National Solar Observatory gesammelt wurden.“

Man macht sich also grundsätzliche Gedanken über eine Verminderung der Globaltemperatur durch eine künstliche geotechnische Verringerung der solaren Einstrahlung, und zwar ausgerechnet zu einem Zeitpunkt, wo

- das gegenwärtige Interglazial in seinem letzten Drittel steht,

- die Nordsommer auf das Aphel der elliptischen Erdbahn mit den größten Sonnenabstand fallen

- und für die nächsten Jahrzehnte durch mehrere unabhängige Forschungsergebnisse ein solares Minimum vorausgesagt wird.

Das Orakel von Delphi würde uns an dieser Stelle vielleicht weissagen, dass wir den befürchteten menschengemachten Hitzekollaps unserer Erde sicher vermeiden werden, wenn wir es durch Klimaengineering schaffen sollten, dass im Sommer der höheren geographischen Breiten in aufeinander folgenden Jahren zunehmend mehr und mehr Schnee und Eis liegen bleiben. Allerdings war das Orakel von Delphi auch immer so höflich, sich über die Konsequenzen eines vermeintlichen Erfolges auszuschweigen…

Referenzen

[1] Vostok ice-core data [NOAA]: Petit, J.R., et al., 2001, Vostok Ice Core Data for 420,000 Years. IGBP PAGES/World Data Center for Paleoclimatology Data Contribution Series #2001-076. NOAA/NGDC Paleoclimatology Program, Boulder CO

[2] Douglas and Clader (2002): Climate sensitivity of the Earth to solar irradiance. GEOPHYSICAL RESEARCH LETTERS, VOL. 29, NO. 16, 10.1029/2002GL015345, 2002

[3] Laskar et al.: Orbital, precessional, and insolation from -20Myr to +10Myr. Astronomy & Astrophysics 270, 522-533 (1993) – Figure 5