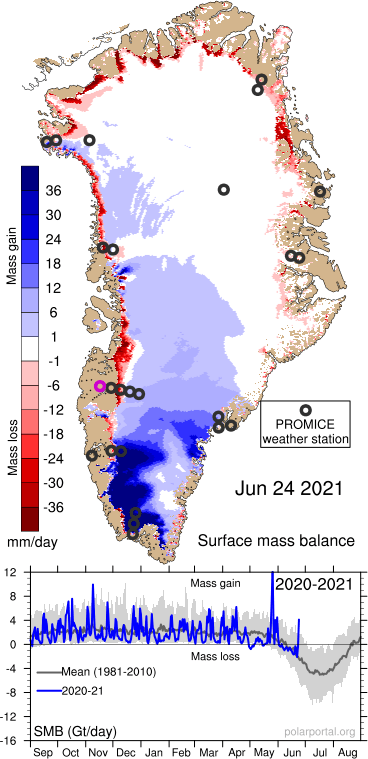

Bild: aus dem Beitrag

Cap Allon

Trotz des Verbots von Ozon abbauenden Gasen – wie FCKW und HFCKW-Kühlmittel – und trotz jüngster Berichte, dass sich das Ozonloch verkleinert, behauptet eine neue Studie eines internationalen Wissenschaftlerteams, dass die globale Erwärmung zu einem größeren Ozonverlust führt.

Die Forschung argumentiert, dass extrem niedrige Wintertemperaturen hoch in der Atmosphäre über der Arktis aufgrund von Klimamustern, die mit der globalen Erwärmung verbunden sind, häufiger und extremer werden.

In einem perfekten Beispiel für das, was George Orwell Doublethink nannte, behauptet die AGW-Partei, dass globale „Erwärmung“ auch globale „Abkühlung“ bedeuten kann – d. h. dass die CO2-Emissionen (d.h. Ihre Existenz) für ALLE Dinge des Klimas verantwortlich sind; sogar für die starke Abkühlung, die wir seit 2016 erlebt haben.

Die Studie geht aber noch weiter und besagt, dass diese extrem niedrigen Temperaturen angeblich Reaktionen mit den verbleibenden Ozon abbauenden Chemikalien verursachen und zu größeren Ozonverlusten führen.

Die neue Studie von UMD, dem Helmholtz-Zentrum für Polar- und Meeresforschung des Alfred-Wegener-Instituts und dem Finnischen Meteorologischen Institut wurde in der Zeitschrift Nature Communications veröffentlicht.

Ross Salawitch, Professor am UMD Department of Atmospheric and Oceanic Science, dem Department of Chemistry and Biochemistry und dem Earth System Science Interdisciplinary Center sagte: „Wir befinden uns in einer Art Wettlauf zwischen dem langsamen und stetigen Rückgang der FCKW, die erst in 50 bis 100 Jahren verschwinden, und dem Klimawandel, der die Temperaturextreme des Polarwirbels in rasantem Tempo sinken lässt.

Die zunehmend niedrigen Temperaturen“, so Salawitch weiter, „schaffen Bedingungen, die den Ozonabbau durch FCKWs fördern. Obwohl diese Verbindungen also langsam verschwinden, nimmt der Ozonabbau in der Arktis im Zuge des Klimawandels zu.“

Neue Daten aus der Studie zeigten die kältesten arktischen Polarwirbel-Temperaturen und die höchsten Ozonverluste im Jahr 2020, was die bisherigen Rekorde von vor neun Jahren im Jahr 2011 übertrifft (eine Art von Sonnenminimum-Korrelation ist hier sehr wahrscheinlich – nicht, dass die Forscher es wagen, die Möglichkeit zu erwähnen, dass ein natürliches Phänomen hinter ihren Ergebnissen stehen könnte).

Nach diesen Wissenschaftlern ist das Chlor normalerweise nicht reaktiv innerhalb des arktischen Polarwirbels, aber Wolken bieten die richtigen Bedingungen für das Chlor, um die Form zu ändern und mit Brom und Sonnenlicht zu reagieren, um Ozon zu zerstören.

Aus der Antarktis hört man Ähnliches.

Das Erdbeobachtungsprogramm der Europäischen Union gab Ende 2020 bekannt, dass das Ozonloch über der Antarktis auf die größte Größe und den tiefsten Stand seit mindestens 15 Jahren angeschwollen ist und damit zu den bemerkenswertesten jemals aufgezeichneten gehört.

Clare Nullis von der wärmesüchtigen WMO erklärt, dass sich das Ozonloch jedes Jahr im August – zu Beginn des antarktischen Frühlings – auszudehnen beginnt und um den Oktober herum einen Höhepunkt erreicht.

„Die Luft ist unter minus 78 Grad Celsius kalt, und das ist die Temperatur, die man braucht, um stratosphärische Wolken zu bilden – was ein ziemlich komplexer Prozess ist“, sagte Nullis bei einem U.N.-Briefing im Oktober 2020. „Das Eis in diesen Wolken löst eine Reaktion aus, die dann das Ozon zerstören kann. Das ist also der Grund, warum wir dieses Jahr das große Ozonloch sehen.“

Aber diese Ergebnisse widersprechen dem absurden Konsens, dass die globale Erwärmung die globale Abkühlung verursacht, und sie widersprechen wiederum der sogenannten „Wissenschaft“ hinter dem internationalen Abkommen (dem Montreal-Protokoll), das entwickelt wurde, um diese Ozon abbauenden Substanzen (OSDs) – wie FCKW- und HFCKW-Kühlmittel – auslaufen zu lassen.

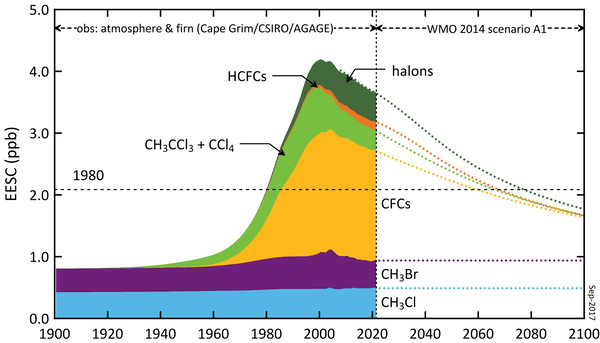

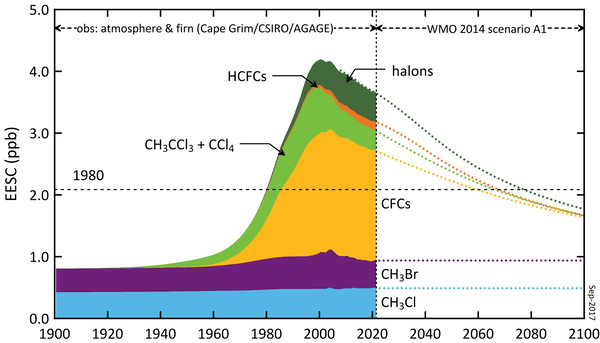

OSDs sind seit ihrem Höchststand im Jahr 2000 rückläufig (siehe unten), und die Löcher, die über den Polen wachsen, zeigen zwei Jahrzehnte später, dass die Korrelation zwischen OSDs und Ozon nicht mehr besteht. Es spielt einfach keine Rolle, dass reduzierte OSDs auf einmal einen noch nie dagewesenen Einfluss auf die Ozonschicht haben. Nein, der Mechanismus hier scheint ein Nnatürlicher zu sein und ist wahrscheinlich in irgendeiner Weise mit der historisch niedrigen Sonnenaktivität verbunden, die seit über einem Jahrzehnt beobachtet wurde.

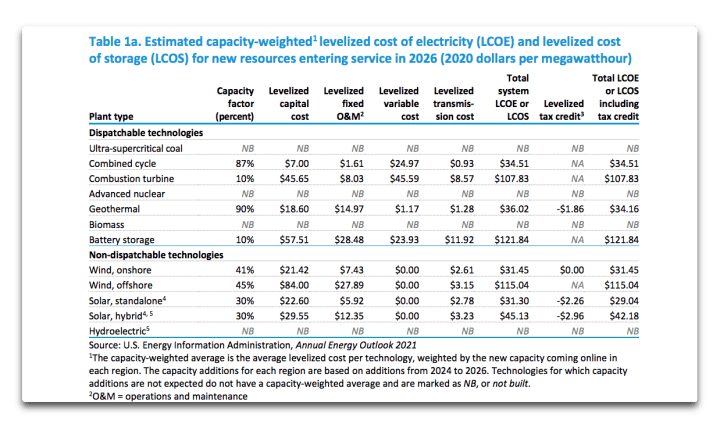

Abbildung: Vergangene und vorhergesagte Werte von kontrollierten Gasen in der antarktischen Atmosphäre, angegeben als äquivalente effektive stratosphärische Chlorwerte (EESC), ein Maß für ihren Beitrag zum stratosphärischen Ozonabbau.

Diese Ergebnisse bestätigen auch, was die NASA schon seit Jahren sagt – dass sich nämlich die obere Atmosphäre abkühlt.

Die Bildung von stratosphärischem Ozon wird durch die von der Sonne kommende ultraviolette (UV) Strahlung initiiert.

Folglich erhöht ein Anstieg der Strahlungsleistung der Sonne die Ozonmenge in der Erdatmosphäre.

Die Strahlungsleistung der Sonne und die Anzahl der Sonnenflecken variieren über den gut dokumentierten 11-jährigen Sonnenzyklus. Beobachtungen über mehrere Sonnenzyklen seit den 1960er Jahren zeigen, dass die globalen Gesamt-Ozonwerte zwischen dem Maximum und dem Minimum eines typischen Zyklus um 1 bis 2 % schwanken.

Allerdings sind die „globalen“ Gesamt-Ozonwerte nicht unbedingt das, was uns hier interessiert. Es gibt Hinweise darauf, dass der Ozonabbau in Zeiten geringer Sonnenaktivität über den Polen viel stärker ist als anderswo auf dem Planeten. Dies ist ein Phänomen, das wir heute sowohl in der Antarktis als auch in der Arktis beobachten.

Dies könnte durchaus die wahre Ursache für die Polar Amplification sein.

Klima-Alarmisten behaupten natürlich gerne, dass CO2 die Arktis überproportional erwärmt, aber sie haben keinen anerkannten Ansatz, wie dies geschehen könnte.

Es ist Phantasie.

Andererseits passt eine positive Korrelation zwischen abnehmender Sonnenaktivität und Ozonabbau über der Arktis sehr gut, ebenso wie die negative Korrelation zwischen Ozonabbau und steigenden Temperaturen.

Es gibt noch einen weiteren wichtigen Faktor, der bei all dem eine Rolle spielt, und das sind Vulkanausbrüche.

Explosive Vulkanausbrüche injizieren Schwefelgase direkt in die Stratosphäre, wodurch neue Sulfatpartikel gebildet werden. Die Partikel bilden sich zunächst in der Stratosphäre im Windschatten des Vulkans und verbreiten sich dann über die gesamte Hemisphäre oder global, da die Luft von stratosphärischen Winden transportiert wird.

Ein Verfahren, um das Vorhandensein vulkanischer Partikel in der Stratosphäre nachzuweisen, nutzt Beobachtungen der Durchlässigkeit der Sonnenstrahlung durch die Atmosphäre. Wenn große Mengen neuer Partikel in der Stratosphäre über einer ausgedehnten Region gebildet werden, wird die solare Durchlässigkeit messbar reduziert (wie auch die terrestrischen Temperaturen).

Die Ausbrüche von Mt. Agung (1963), El Chichón (1982) und Mt. Pinatubo (1991) sind die jüngsten größeren Beispiele für Schwefelinjektionen, die die Sonnendurchlässigkeit vorübergehend reduzierten. Der chilenische Vulkanausbruch des Calbuco (2015) ist ein weiteres Beispiel – diese stratosphärische Injektion spielte eine Rolle bei der Vergrößerung des Ozonlochs im Jahr 2015:

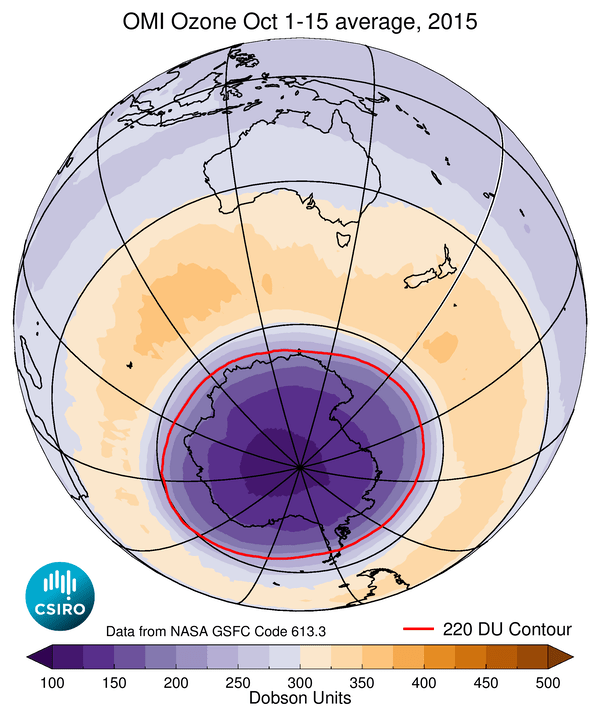

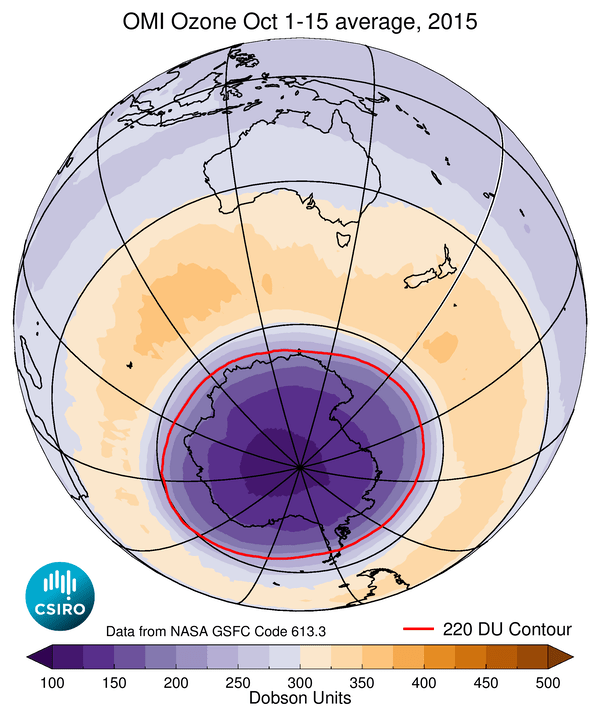

Abbildung: Durchschnittliche Ozonkonzentrationen über der südlichen Hemisphäre während des Zeitraums vom 1. bis 15. Oktober 2015, als das Ozonloch in der Antarktis für dieses Jahr fast seine maximale Ausdehnung hatte. Die rote Linie zeigt die Grenze des Ozonlochs.

Bei seiner maximalen Ausdehnung war das Ozonloch 2015 das viertgrößte, das jemals beobachtet wurde. Es gehörte zu den oberen 15 % in Bezug auf die Gesamtmenge des abgebauten Ozons. Nur in den Jahren 2006, 1998, 2001 und 1999 war es hzu einem noch stärkeren Ozonabbau gekommen, während andere spätere Jahre (2013, 2014 und 2016) in der Nähe der Mitte des beobachteten Bereichs lagen.

Das Loch von 2020 scheint sogar noch größer zu sein als das von 2015, ein klarer Hinweis darauf, dass andere Faktoren als ODS der Schlüssel zum Ozonabbau über den Polen sind – nämlich, Überraschung, Sonnen- und Vulkanaktivität.

Leider bleibt die UNO und ihr betrügerischer kleiner Ableger – die WMO – an das Montreal-Protokoll gekettet.

Clare Nullis kommt zu dem Schluss, dass sich die Ozonschicht trotz der immer größer werdenden Löcher nach Ansicht von Experten langsam erholt, nachdem das Abkommen 1987 verabschiedet wurde, und sie drängt die Nationen, sich an die Maßnahmen zu halten, indem sie Klimaprognosen zitiert, die besagen, dass die Ozonschicht im Jahr 2060 wieder das Niveau von 1980 erreichen wird.

Sie müssen denken, dass wir Idioten sind; aber ich befürchte, dass wir es als Kollektiv sind.

„Wenn Sie ein Bild von der Zukunft wollen, stellen Sie sich einen Stiefel vor, der auf einem menschlichen Gesicht herumtrampelt – für immer.“ – George Orwell, 1984

Link: https://electroverse.net/climate-report-blames-cooling-on-warming/

Übersetzt von Christian Freuer für das EIKE