Was wir früher Lügen nannten, nennt man nun Computersimulation Moral

… so ähnlich lautete ein Songtext der Sängerin Milva [10]. Damals war das Militär angesprochen. Heute lässt sich damit synonym ein Vorgehen von Kampftruppen gegen das sich ständig wandelnde Klima beschreiben.

Helmut Kuntz

Klimaforscher entsetzt: Venedig versinkt früher als erwartet im Meer

Nach den Fluten in Deutschland ließ die nächste Klima-Katastrophenmeldung nicht lange auf sich warten. Wie das romantische Ahrtal, wird auch Venedig in Fluten versinken …

MSN-Nachrichten: SAT.1, 07.09.2021

Im Video wird davon gesprochen, was die Klimaforscher erwarten: Der Meeresspiegel soll bei Venedig „ … um mehr als einen Meter in den nächsten Jahrzehnten steigen … sei sogar ein Anstieg um 170 cm bis zum Jahr 2100 möglich …

Dabei hatte eine noch unveröffentlichte Studie der Beratungsgruppe der Vereinten Nationen für den Klimawandel im Juni dieses Jahres noch festgestellt, dass es bis zum Jahr 2100 „voraussichtlich“ 50 cm Anstieg werden (könnten).

Bild 4 Meldung von euronews. Link: Venedig

Die Studie(n)

In den Videos ist kein Hinweis auf die Studien zu finden, welche Venedig „früher als erwartet“ im Meer versinken lassen. Doch hat „Der Standard“ ebenfalls darüber berichtet. Und was für die ökogläubigen, deutschen Bürger unwichtig ist, ist für seine (kritischeren?) österreichischen Leser vermerkt: Um welche Studien es sich dabei handelt.

[1] DerStandard, 7. September 2021: WELTERBE IN GEFAHR Steigender Meeresspiegel: Venedig droht schon bald unterzugehen

In wenigen Jahrzehnten könnte das Weltkulturgut um über einen Meter unter Wasser stehen.

Bereits eine 2018 veröffentlichte Studie im Fachjournal „Nature Communications“ kam zu dem Schluss, dass die Folgen des Klimawandels für Venedig und dutzende andere Weltkulturerbestätten eine große Bedrohung darstellen …

Zitiert wird dazu im Artikel des „Standard“ vom 7. September 2021 zuerst eine Studie [2], welche bereits im Oktober 2018 veröffentlicht wurde.

Dabei zeigt sich wieder der häufige und typische Fall, dass Medien durch Wiederholen (und so tun, als wäre es aktuell herausgegeben) den Klimaalarm neu schüren.

Genau diese Studie wurde damals vom Autor rezensiert:

[3] EIKE 31.10.2018: Zeugnisse vergangener Kulturen sind durch den Klimawandel in Gefahr. Die Bedrohung betrifft vor allem Weltkulturerbestätten im Mittelmeerraum Teil 2 (2)

[4] EIKE 30. Oktober 2018: Zeugnisse vergangener Kulturen sind durch den Klimawandel in Gefahr. Die Bedrohung betrifft vor allem Weltkulturerbestätten im Mittelmeerraum Teil 1(2)

Das Ergebnis war eindeutig:

[3] [4] … Die aktuell postulierte Gefährdung hat eine Wahrscheinlichkeit von 1 % und muss nicht vom Klimawandel kommen, da sie schon immer bestand … Alle Gefährdungsszenarien stammen ausschließlich aus Modellsimulationen … Der Anstieg von Flut- und Erosionsrisiko von bis zu 50 Prozent … basiert auf einem im Mittelmeerraum angenommenen Meeresspiegelanstieg von durchschnittlich 1,46 Meter bis zum Jahr 2100. Dieser Anstieg könnte mit einer fünfprozentigen Wahrscheinlichkeit (95. Perzentil) unter einem hohen Klimawandelszenario (RCP8.5) eintreten.

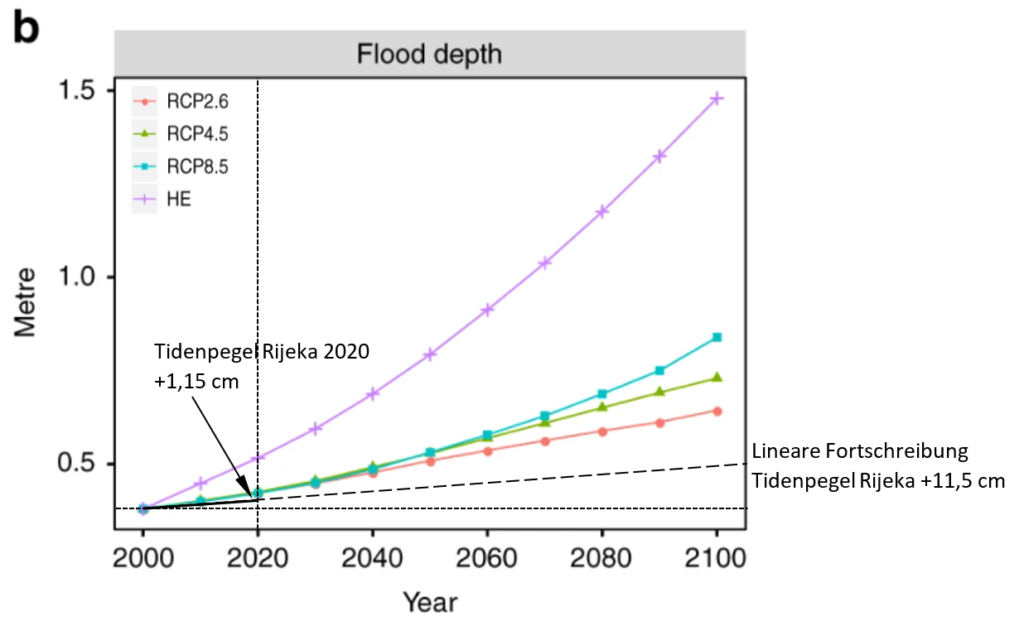

Grafisch sieht diese 5-prozentige Wahrscheinlichkeit unter rcp8.5 wie im Bild 5 aus. Dazu 5 % Wahrscheinlichkeit zu errechnen, schafft ein falsch geeignet parametrierter Computer mühelos. Sich zu trauen, so etwas zu publizieren, ist allerdings nur in den Klima-„Wissenschaften“ möglich.

Nun hat eine wirklich neue Studie die schlimmen Vorhersagen der vorhergehenden Studie allerdings bestätigt:[1] Der Standard: Im Extremfall bis zu 170 Zentimeter

… Eine aktuelle Studie lässt befürchten, dass die Uhr für Venedig schneller abgelaufen sein könnte, als man zunächst angenommen hatte. Ein Team von Klima- und Meeresforschern warnt nun im Fachmagazin „Natural Hazards and Earth System Sciences“ vor einem Anstieg des Meeresspiegels um mehr als einen Meter in den kommenden Jahrzehnten.

Sollte der Klimawandel nicht entscheidend gebremst werden, sei bis zum Jahr 2100 ein Anstieg um bis zu 120 Zentimeter möglich, hieß es. Als Extremszenario wurde sogar ein Anstieg um rund 170 Zentimeter berechnet.

Die Verlinkung im Artikel verweist dazu auf eine Seite der EGU (European Geosciences Union) „Venice flooding: understanding, prediction capabilities, and future projections“, welche auf eine Studie verweist: [5] Davide Zanchettin at al., 01 Sep 2021: Sea-level rise in Venice: historic and future trends

In dieser neuen Studie liest man dann (unter anderem):

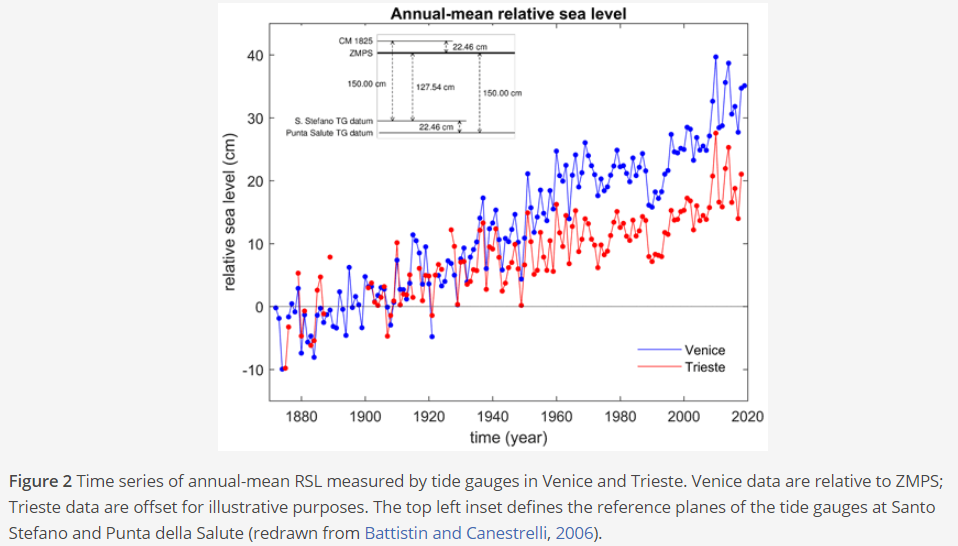

(Übersetzt mit Deepl) [5] ... Die derzeit beste Schätzung der durchschnittlichen Rate des Meeresspiegelanstiegs während des Beobachtungszeitraums von 1872 bis 2019 auf der Grundlage von Tide-Gauge-Daten nach Beseitigung von Absenkungseffekten beträgt 1,23 ± 0,13 mm / Jahr. Eine höhere – aber unsicherere – Rate des Meeresspiegelanstiegs ist für die letzten Jahre zu beobachten. Zwischen 1993 und 2019 wird eine durchschnittliche Veränderung von etwa +2,76 ± 1,75 mm/Jahr aus den Gezeitenpegeldaten nach Entfernung der Absenkung geschätzt …

… liegt die wahrscheinliche Bandbreite des atmosphärisch korrigierten relativen Meeresspiegelanstiegs in Venedig bis 2100 zwischen 32 und 62 cm für das RCP2.6-Szenario bzw. zwischen 58 und 110 cm für das RCP8.5-Szenario.

Ein plausibles, aber unwahrscheinliches High-End-Szenario, das mit dem starken Abschmelzen des Eisschildes verbunden ist, liefert bis 2100 etwa 180 cm relativen Meeresspiegelanstieg in Venedig. Projektionen von vom Menschen verursachten vertikalen Landbewegungen sind derzeit nicht verfügbar, aber historische Beweise zeigen, dass sie das Potenzial haben, einen signifikanten Beitrag zum relativen Meeresspiegelanstieg in Venedig zu leisten und die Gefahr durch klimatisch induzierte Meeresspiegeländerungen zu verschärfen.

Zu dieser Aussage folgt dann Bild 5. Der Unterschied zwischen dem Pegel „Venedig“ und dem Pegel „Triest“ hat als Ursache, dass Venedig versinkt (was in den angezogenen PSML-Pegeln nicht korrigiert ist, so dass sich der Tidenpegel-Anstieg und die Senkungen addieren), während Triest auf Felsgrund steht und somit kaum isostatische Veränderungen erfährt. Für den Anstieg alleine des Meerespegels dieser Region ist der Tidenpegelverlauf von Triest deshalb der richtige(re).

Als normaler Bürger wird man mit dem Bild 5a allerdings verärgert. Wenn er in den PSMSL-Pegelviewer schaut, findet er (nicht nur) gerade zu dieser Gegend (Venedig) Pegeldaten, welche um das Jahr 2000 enden und bei weitem nicht so früh beginnen, wie in Bild 5 gezeigt. Zwar wird in der Studie dazu ein Link zu PSMSL angegeben, der allerdings wieder nur auf die Pegeldateien mit den eingeschränkten Datenlängen zeigt.Anscheinend gibt es aber doch bis aktuell reichende Daten, sofern Figure 2 (Bild 5) aus der Studie stimmt, welche dem normalen Bürger aber vorenthalten werden.

Weiter geht es in der Studie (Übersetzt mit Deepl): [5] … Die RSL-Zeitreihen von Triest, Marseille und Genua zeigen hundertjährige Trends zwischen 1,2 und 1,3 mm/Jahr … Die Schätzungen stimmen mit dem Trend des Meeresspiegelanstiegs von 1,2 ± 0,1 mm / Jahr aus dem 20. Jahrhundert überein, der von Marcos et al. (2016) für die gleichen Stationen gemeldet wurde.

Trotz dieser Pegelangaben werden in dieser Studie dann beliebig hohe Pegelanstiege simuliert:

Bild 6 [5] (Teilbild) Figure 7Observed and projected trends of Mediterranean sea-level variations. (c) Projected northern Adriatic RSL anomalies and associated uncertainties related to socio-economic scenarios (shading: 5th–95th percentile range; line: median). See main text for details on the calculation of uncertainties. Adapted from Thiéblemont et al. (2019). Bild vom Autor ergänzt

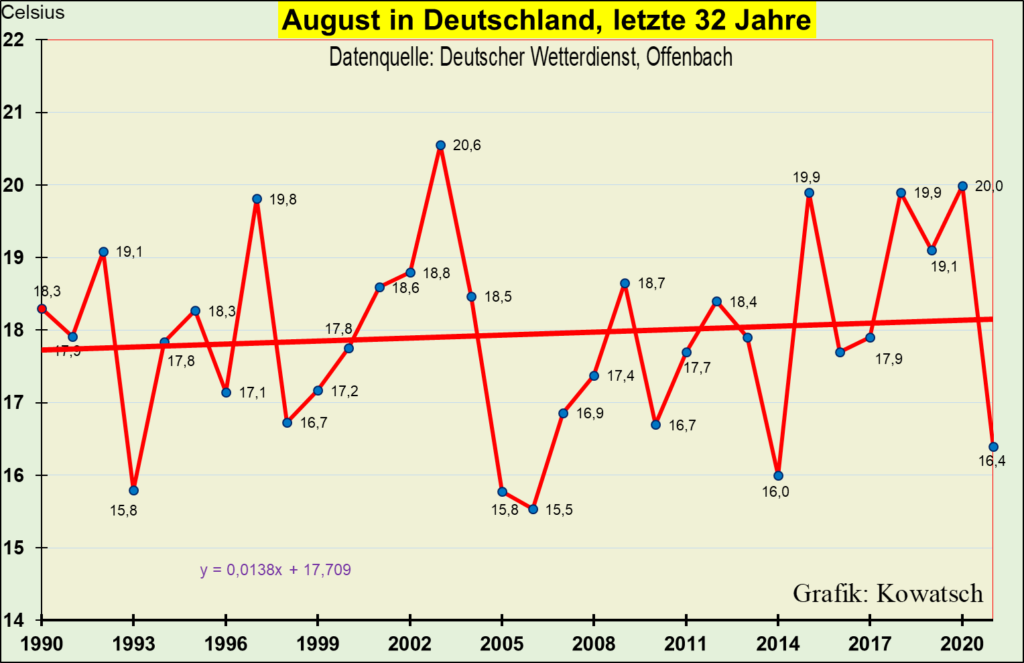

Pegeldaten

In [3] [4] wurden umfangreich Pegeldaten ausgewertet und dargestellt. Beim Klima kann sich in den vergangenen drei Jahren aber vielleicht Wichtiges ereignet haben, auch wenn es niemand – nicht einmal die alles permanent beobachtenden „Öffentlich-Rechtlichen“ mitbekommen haben. Deshalb eine aktualisierte Pegel-Nachschau.

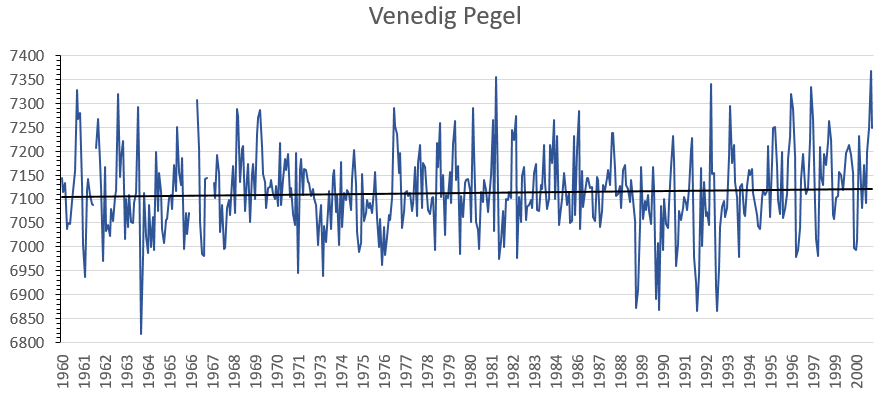

Bild 7 PSMSL-Pegelverlauf Venedig 1960 – 2000 (da endet der aktuelle PSML-Datensatz). Pegelanstieg 0,43 mm/pa. Grafik vom Autor erstellt

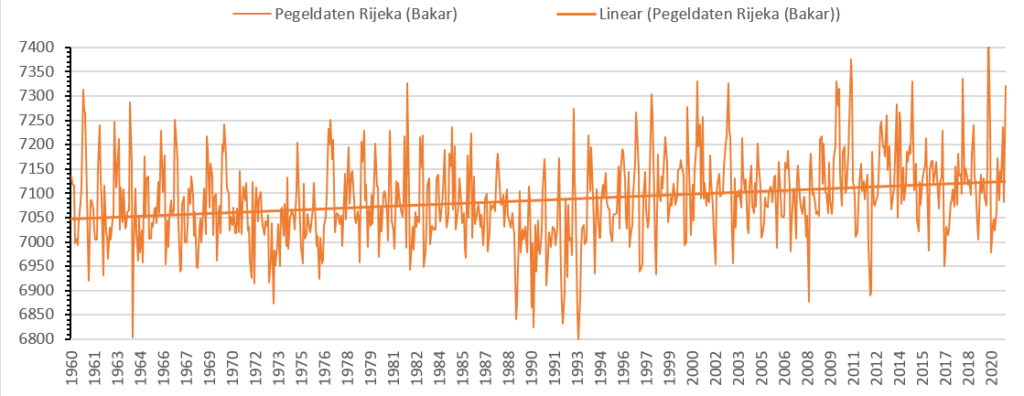

Bild 8 PSMSL-Pegelverlauf bei Rijeka 1960 – 2020 (da endet der aktuelle PSML-Datensatz). Pegelanstieg 1,3 mm/pa. Grafik vom Autor erstellt

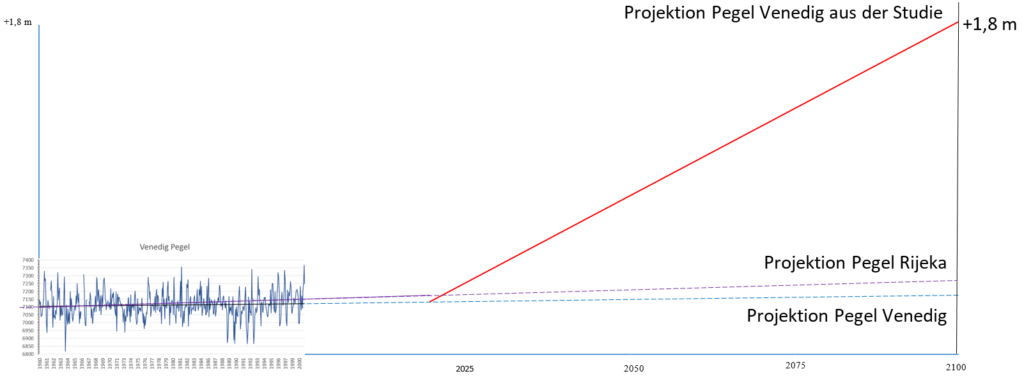

Um die Aussagen der Studie zu verdeutlichen, eine Grafik:

Bild 9 PSMSL-Pegelverlauf Venedig mit verschiedenen Projektionen bis zum Jahr 2100. Grafik vom Autor erstellt

Schon aktuell hat sich (nicht nur) das rcp8.5-Scenario als grottenfalsch erwiesen

Im folgenden Bild sieht man, wie stark die Szenarienprojektionen bereits aktuell vom wirklichen Tidenpegelverlauf abweichen. Beim Klimawandel stört es aber keinen „Wissenschaftler“, etwas zu publizieren, das bereits zum Publizierzeitpunkt als grottenfalsch erkennbar ist. Sie wissen, dass kein Freitagshüpfer, kein Klimacamper und auch kein Journalist es nachprüfen würde, alleine schon deshalb nicht, weil die „Wissenschaftlichkeit“ durch Angabe einer statistischen Wahrscheinlichkeit gesichert wurde …

Landsenkungen sind das viel größere Problem. Damit lässt sich aber kein Klimaalarm simulieren …

Ehrlicherweise geht diese Studie (ganz kurz) auf das ein, was in Venedig – wie in vielen „besonders schlimm“ vom Klimawandel „betroffenen“ Küstenstädten – das wirkliche Problem ist [6] [9]. Allerdings wird es auch gleich wieder ignoriert.

(Übersetzt mit Deepl) [5] Vertikale Landbewegungen

… es wird beobachtet, dass natürliche Prozesse, insbesondere Konsolidierung und anthropogene Aktivitäten weiterhin mit Raten von 10 bis −2 mm / Jahr beitragen. Daher können menschliche Aktivitäten erheblich zum Anstieg der RSL beitragen, aber detaillierte Szenarien sind derzeit nicht in der Literatur verfügbar, und dies ist ein allgemeines Problem.

All diese natürlichen und anthropogenen Beiträge haben das Potenzial, die RSL in Venedig zu erhöhen und die negativen Auswirkungen des lokalen Meeresspiegelanstiegs zu verschärfen, mit einem Beitrag in der Größenordnung von 10 cm pro Jahrzehnt auf subregionaler Ebene und möglicherweise viel größer lokal.

Man muss sich das immer wieder vor Augen führen: Der Tiden-Pegelanstieg in der nördlichen Adria liegt seit den 60er Jahren irgendwo zwischen 0,5 … 1,4 mm/pa (laut PSML bei Venedig nur ca. 0,5 mm/pa). Die Senkung der Lagune von Venedig soll jedoch zwischen 2 … 10 mm/pa betragen (wobei dieser Wert für Venedig aktuell etwas zu hoch gegriffen sein dürfte, wie es die PSMSL-Daten von Bild 7 zeigen).

Trotzdem wird alleine ein simulierter, zukünftig extrem zunehmender Pegelanstieg als Problemursache ausgemacht.

Ein Hintergrund könnte (wie bei den vielen anderen, von massiven Senkungen betroffenen Küstenstädten rund um die Welt) sein: Für eine selbst verursachte Senkung gibt es keine automatischen Hilfsgelder vom Ausland, für „Klimawandel-Folgen“ hat jedes Land bedingungslosen Anspruch darauf.

Unwahrscheinliche, aber plausible High-End-Veränderungen

Seit das PIK die These ausgegeben hat, dass auch unwahrscheinlichste Ereignisse, welche zwar physikalisch nicht möglich sind, von Computern aber als denkbar – wenn auch mit geringster Wahrscheinlichkeit – ausgegeben werden, publiziert werden sollen und das IPCC im neuen AR6 (inzwischen auch der DWD und unsere Behörden) deshalb vorwiegend mit dem real nicht möglichen rcp8.5-Szenario simulieren [7], weil sich nur damit ein „ausreichender“ Klimaalarm erzeugen lässt, wurden völlig neue „Klimawelten“ für die zunehmende Zahl gut bezahlter Simulationsforscher erschlossen.

Und seitdem ist kein Szenario mehr vor der Klima-Simulationswut sicher:

(Übersetzt mit Deepl) [5] … Bis zum Jahr 2100 wird erwartet, dass natürliche lokale Absenkungen zu einem RSL-Anstieg von etwa 10 cm im Vergleich zum späten 20. Jahrhundert führen werden. Der projizierte klimatisch induzierte Anstieg des venezianischen Meeresspiegels aus Schätzungen für die GMSL, korrigiert um die regionale Umverteilung von Massenbeitragskomponenten wie Gletschern, Eisschilden und Grundwasser, liegt im Bereich von 21 bis 52 cm (von 48 bis 100 cm) bis 2100 für das sozioökonomische Szenario RCP2.6 (RCP8.5). Das Schmelzen von Eisschilden liefert einen höchst unsicheren Beitrag. Ein RSL-Anstieg in Venedig von über 180 cm bis 2100 ist eine unwahrscheinliche, aber plausible High-End-Veränderung unter starker Schmelze Grönlands und der Antarktis.

Venedig sank auch früher schon schneller als erwartet

Die Zeiten, als noch einigermaßen ehrlich publiziert wurde, sind endgültig vorbei. Früher waren die Überschriften zwar fast wortgleich, doch kam danach wenigstens ohne Verschwurbelung die Erklärung:

[8] Die Presse, 22.03.2012: Venedig sinkt schneller als erwartet

Ein US-Forscher schlägt Alarm: Der Grund von Venedig soll um zwei Millimeter pro Jahr sinken.

Venedig versinkt immer schneller im Wasser. Der Forscher Yehuda Bock, Experte des Ozeanografischen Instituts der Universität von San Diego in Kalifornien, errechnete, dass der Grund von Venedig derzeit um zwei Millimeter pro Jahr sinkt. In den kommenden 20 Jahren soll der Meerespegel in Venedig um acht Zentimeter höher als jetzt sein, sollte die Lagunenstadt weiterhin mit diesem Tempo sinken.

Das Phänomen betreffe nicht nur die Stadt, sondern auch die Lagune mit ihren 120 Inseln, stellte Bock fest. Der nördliche Teil der Lagune sinke um rund zwei bis drei Millimeter im Jahr, der südliche Teil um etwa drei bis vier Millimeter …

Auch Studien wiesen darauf hin, nicht nur für Venedig, sondern weltweit:

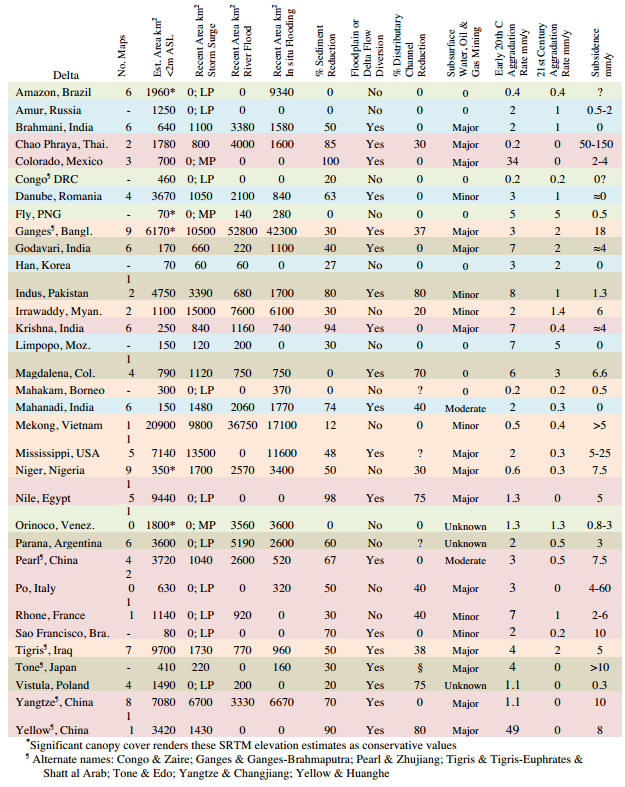

[9] Syvitski, J. P. M. et al., 2009: Sinking deltas due to human activities

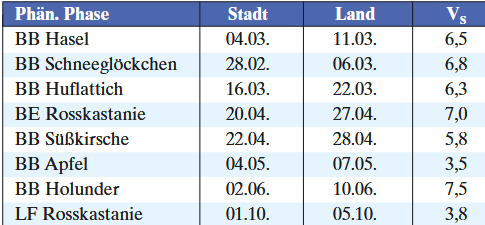

Bild 11 [9] Table 1. Representative deltas analyzed using MODIS imagery, SRTM data, and ancillary data (see Methodology section and 15 for details). Commentary in the storm surge column is as follows: LP= little potential; MP = moderate potential; SP = significant potential). Net Subsidence (or Relative Sea Level Rise) rates are time variable, and provided ranges cover different times and areas of a delta, where known; question marks are for unknown estimates.

[1] Der Standard, 7. September 2021: WELTERBE IN GEFAHR Steigender Meeresspiegel: Venedig droht schon bald unterzugehen

[2] Lena Reimann at al., 16. October 2018: Mediterranean UNESCO World Heritage at risk from coastal flooding and erosion due to sea-level rise

[3] EIKE 31.10.2018: Zeugnisse vergangener Kulturen sind durch den Klimawandel in Gefahr. Die Bedrohung betrifft vor allem Weltkulturerbestätten im Mittelmeerraum Teil 2 (2)

[4] EIKE 30. Oktober 2018: Zeugnisse vergangener Kulturen sind durch den Klimawandel in Gefahr. Die Bedrohung betrifft vor allem Weltkulturerbestätten im Mittelmeerraum Teil 1(2)

[5] Davide Zanchettin at al., 01 Sep 2021: Sea-level rise in Venice: historic and future trends

[6] EIKE 18.06.2019: Küstenstädte versinken, (auch) weil das Geld stattdessen zur CO2-Reduktion hinausgeworfen wird

[7] Tichys Einblick, F. Vahrenholt, 8. Sept. 2021: IPCC UND DEUTSCHE MEDIEN Die künstlich erzeugte Angst vor der Fünf-Grad-Erwärmung

[8] Die Presse, 22.03.2012: Venedig sinkt schneller als erwartet

[9] Syvitski, J. P. M. et al., 2009: Sinking deltas due to human activities

[10] Lied „Wenn der Wind sich dreht“, Textstelle „Was wir Kinder Lügen nannten. Nennt man nun Moral“