Unsicherheiten der Bewölkung

Ich habe ein interessantes Zitat im jüngsten Klimanifest des IPCC gelesen, dessen sechster Sachstandsbericht den Eingeweihten als „IPCC AR6“ bekannt ist:

Klima-Rückkopplungen und Sensitivität – Abschnitt 7.7 der AGI im AR6

Der Nettoeffekt von Veränderungen der Wolken als Reaktion auf die globale Erwärmung ist die Verstärkung der vom Menschen verursachten Erwärmung, d. h. die Netto-Wolkenrückkopplung ist positiv (hohes Vertrauen).

Im Vergleich zum AR5 haben große Fortschritte im Verständnis der Wolkenprozesse das Vertrauensniveau erhöht und den Unsicherheitsbereich bei der Wolkenrückkopplung um etwa 50 % verringert. Die Bewertung der Wolkenrückkopplung in niedriger Höhe über den subtropischen Ozeanen, die zuvor die Hauptquelle der Unsicherheit bei der Nettowolkenrückkopplung war, wurde durch die kombinierte Verwendung von Klimamodellsimulationen, Satellitenbeobachtungen und expliziten Wolkensimulationen verbessert, was insgesamt zu starken Beweisen führt, dass diese Art von Wolken die globale Erwärmung verstärkt.

Die Netto-Wolkenrückkopplung, die sich aus der Summierung der für die einzelnen Regime ermittelten Wolkenrückkopplungen ergibt, beträgt 0,42 [-0,10 bis 0,94] W/m² °C. Eine negative Nettowolkenrückkopplung ist sehr unwahrscheinlich. (hohes Vertrauen)

Die Vorstellung einer globalen positiven Netto-Wolkenrückkopplung erschien mir immer sehr unwahrscheinlich. Das liegt zum Teil daran, dass ich jahrelang in den Tropen gelebt und viel Zeit im Freien verbracht habe. Wenn es in den Tropen wärmer wird, bilden sich Kumuluswolken, die viel der starken tropischen Sonneneinstrahlung in den Weltraum reflektieren, die einfallende Energie verringern und so die Oberfläche abkühlen. Und wenn die Erwärmung weiter anhält, bilden sich Gewitter, die die Oberfläche auf vielfältige Weise abkühlen. Ich habe also Tag für Tag die Rückkopplung der Wolken beobachtet und gesehen, dass eine stärkere Erwärmung zu einer stärkeren Abkühlung aufgrund der Wolken führt, nicht zu einer verstärkten Wolkenerwärmung. Und die Tropen sind ein großer Teil des Planeten.

Nun haben Wolken zwei entgegengesetzte Strahlungseffekte auf die Oberfläche. Sie reflektieren die kurzwellige Sonnenstrahlung zurück in den Weltraum und kühlen die Oberfläche ab. Außerdem absorbieren und emittieren Wolken langwellige (thermische) Infrarotstrahlung, wodurch die Oberfläche wärmer wird als ohne Wolken.

Dies ist keine Theorie. Sie können den Kurzwelleneffekt an einem klaren Sommertag spüren, wenn eine Wolke vorbeizieht und die Oberfläche kühler hinterlässt als ohne Wolken. Man kann auch den Langwelleneffekt in einer klaren Winternacht spüren, wenn eine Wolke aufzieht und die Oberfläche wärmer als ohne Wolke zurücklässt.

[Für diejenigen, die einwenden, dass die abwärts gerichtete langwellige Strahlung von kalten Wolken die Oberfläche nicht wärmer zurücklassen kann als ohne Wolken, siehe meinen Beitrag „Kann ein kaltes Objekt ein heißes Objekt erwärmen“.]

Die Summe dieser beiden Strahlungseffekte, der kurzwelligen Abkühlung und der langwelligen Erwärmung, wird als „Netto-Wolken-Strahlungs-Effekt“ oder „Netto-CRE“ bezeichnet. Ist er positiv, so wird die Oberfläche durch die Wolken wärmer, ist er negativ, so wird die Oberfläche durch die Wolken kühler als ohne sie.

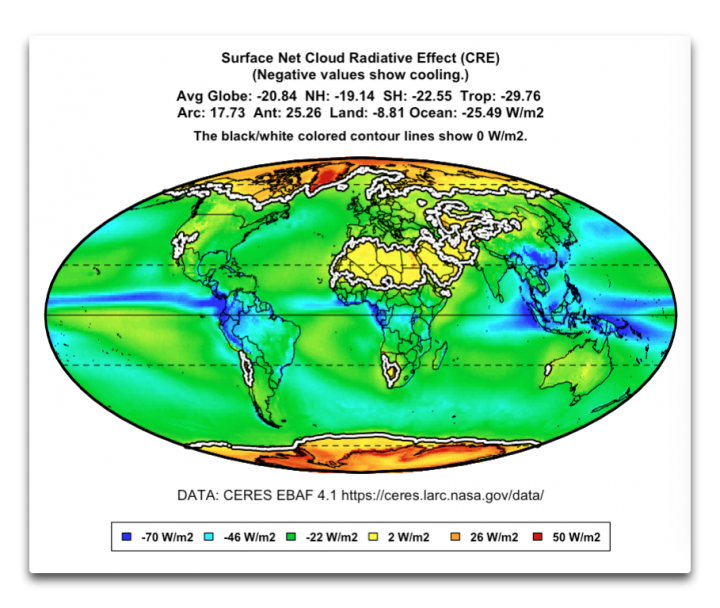

Also wandte ich mich erneut dem satellitengestützten CERES-Datensatz zu. Dieser enthält Daten über den Netto-Strahlungseffekt der Wolken auf der Oberfläche. Abbildung 1 zeigt die Nettostrahlungseffekte der Wolken („net CRE“) auf der ganzen Welt.

Es gibt mehrere interessante Dinge in Bezug auf die Auswirkungen der oben gezeigten Wolken. Erstens kühlen sie die Oberfläche im Durchschnitt um etwa zwanzig Watt pro Quadratmeter (W/m²) ab. Außerdem erwärmen die Wolken die Pole um etwa den gleichen Betrag, also etwa zwanzig W/m². Und Wolken kühlen den Ozean etwa dreimal so stark ab wie das Land.

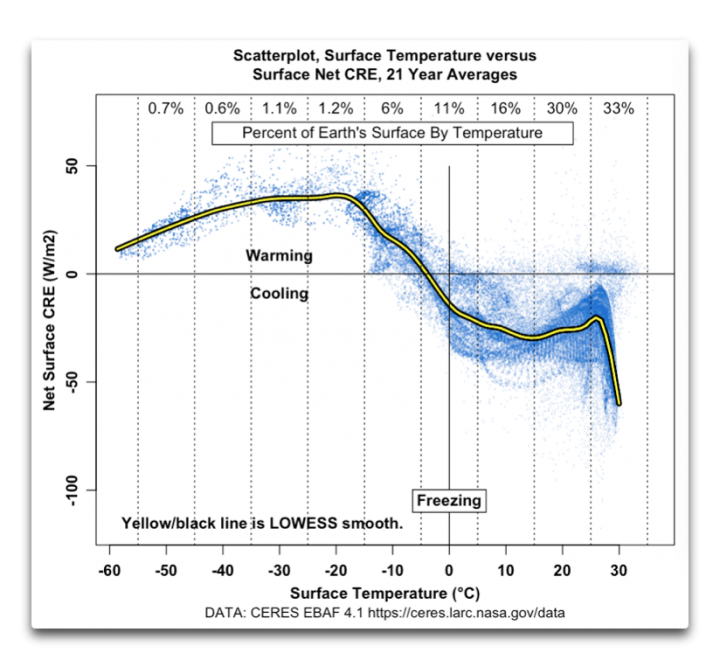

Wie hängt die Netto-CRE mit der Temperatur zusammen? Wir können das auf verschiedene Weise betrachten. Abbildung 2 unten zeigt ein Streudiagramm der durchschnittlichen Netto-CRE gegenüber der durchschnittlichen Oberflächentemperatur.

Da 21-Jahres-Durchschnittswerte verwendet werden, hat diese Art der Analyse den großen Vorteil, dass alle Rückkopplungen und langsam wirkenden Prozesse berücksichtigt werden. Dabei handelt es sich um die Gitterzellen-Temperaturen, auf die sich jede Gitterzelle über Jahrzehnte hinweg eingependelt hat, nachdem die Netto-Wasserdampf-Rückkopplung, die Wolken-Rückkopplung und alle anderen Rückkopplungen ihre Wirkung entfaltet haben. Auf diese Weise erhalten wir eine gute Vorstellung von der langfristigen Netto-Wolkenrückkopplung bei verschiedenen Temperaturen.

Abbildung 2. Streudiagramm der Durchschnittstemperaturen in Gitterzellen von 1° Breitengrad und 1° Längengrad und der Netto-Wolkenabstrahlungswirkung.

In Abbildung 2 ist der Trend bei jeder Temperatur durch die Steigung der gelb/schwarzen Linie gegeben. Sie zeigt an, wie stark sich die CRE im Durchschnitt bei einer bestimmten Temperaturänderung verändert. Daraus können wir mehrere Dinge erkennen. Erstens ist die Steigung bei den niedrigsten Temperaturen positiv – antarktische Wolken führen zu einer Erwärmung. Aber oberhalb von Temperaturen von etwa -20°C ist der allgemeine Trend der Netto-Wolkenrückkopplung negativ.

Oberhalb von etwa 26°C, was etwa 30 % des Planeten ausmacht, ist die Nettowolkenrückkopplung extrem negativ. Für jedes zusätzliche Grad Erwärmung nimmt die Nettostrahlungswirkung der Wolken um einige Dutzend Watt ab.

Schließlich gibt es zwei Gebiete, in denen die Nettowolkenrückkopplung positiv ist – dort, wo die Durchschnittstemperatur unter -20°C liegt (hauptsächlich das antarktische Plateau) und dort, wo sie zwischen 15°C und 25°C liegt (gemäßigte Zone).

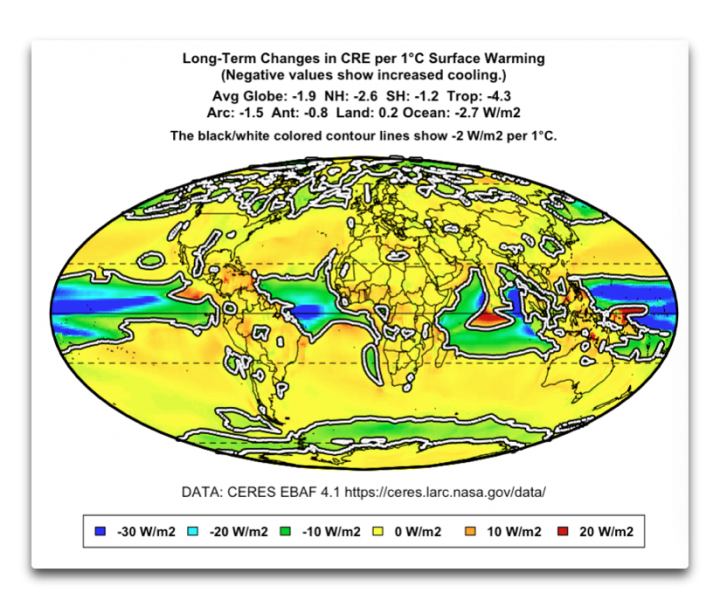

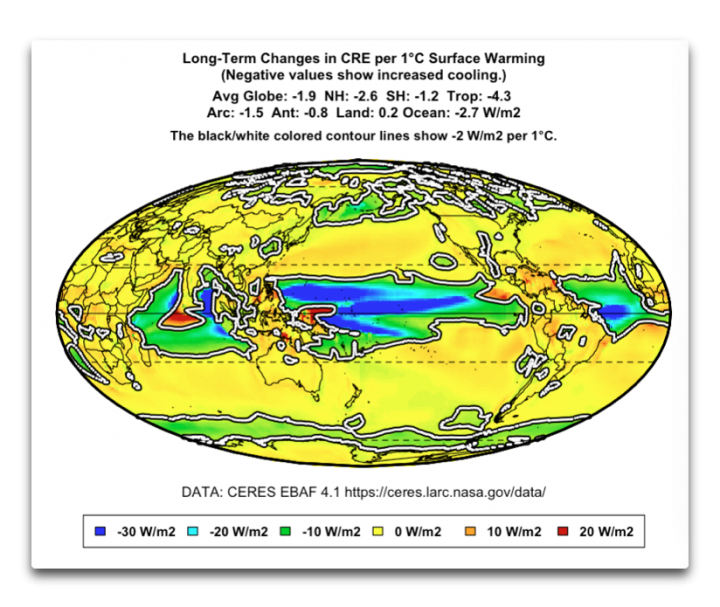

Es gibt noch eine andere Möglichkeit, die langfristige Nettowolkenrückkopplung zu betrachten. Dabei werden dieselben Mittelwerte der Temperatur und der Nettowolkenrückkopplung betrachtet, allerdings auf andere Art und Weise. Bei dieser Methode wird das Gebiet um jede Gitterzelle herum betrachtet, um zu sehen, wie der Trend in dieser Gitterzelle ist.

Die Logik hinter der Methode besteht darin, dass eine bestimmte Gitterzelle eine durchschnittliche Temperatur und eine durchschnittliche Wolkenstrahlungswirkung aufweist. Wenn wir sehen wollen, was passiert, wenn die Durchschnittstemperatur um 1 °C höher oder niedriger ist, können wir die umliegenden Gitterzellen betrachten, um zu sehen, was bei unterschiedlichen Temperaturen in diesem lokalen Bereich passiert.

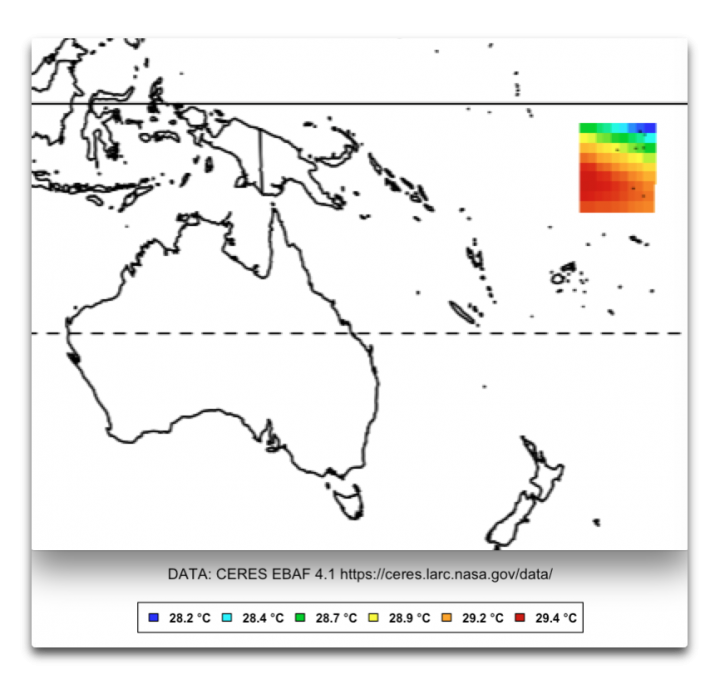

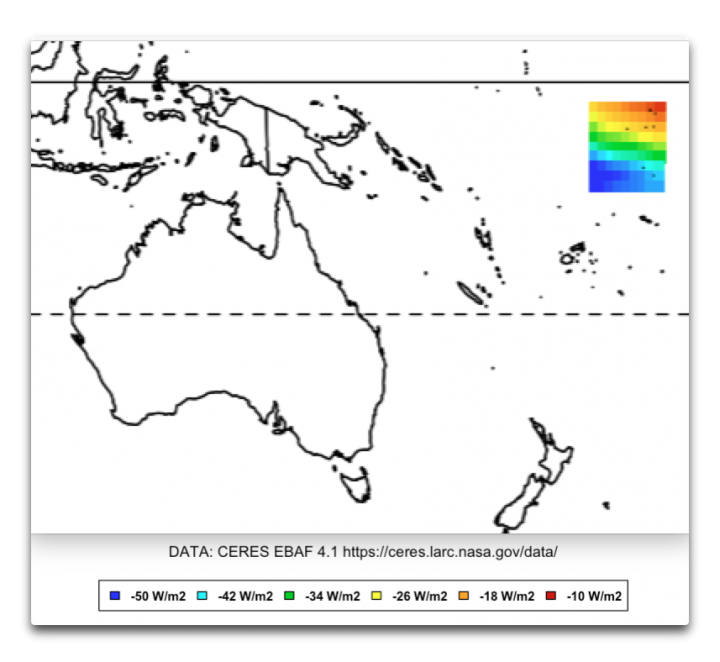

Hier sind zum Beispiel einige typische Gebiete im Pazifischen Ozean, die jeweils 9° Breitengrad x 9° Längengrad messen:

Wie Sie sehen können, ist in diesem Teil des Pazifiks die Übereinstimmung zwischen ~ stationären Durchschnittstemperaturen und ~ stationären durchschnittlichen Netto-CRE stark negativ. Ich berechne den Trend und ordne ihn der zentralen Gitterzelle des Blocks zu. Ich wiederhole den Vorgang für jede der 64.800 Gitterzellen der Welt und untersuche, was in der lokalen Region passiert. So erhalte ich die globale Karte, die in Abbildung 4 unten dargestellt ist:

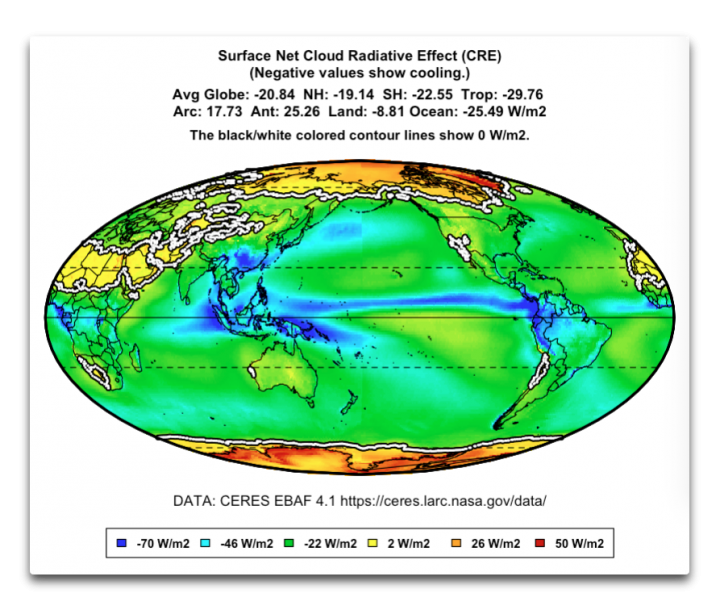

Abbildung 4a: Veränderung der CRE bei einem Anstieg der Oberflächentemperatur um 1°C, Ansicht des Atlantiks. Die weiß/schwarzen Linien zeigen den globalen Durchschnitt, etwa -2 W/m².

Abbildung 4b: Veränderung der CRE bei einem Anstieg der Oberflächentemperatur um 1°C, Ansicht des Pazifiks. Die weiß/schwarzen Linien zeigen den globalen Durchschnitt, etwa -2 W/m².

Dazu einige Anmerkungen. Die Nettowolkenrückkopplung ist über dem Land positiv und über dem Ozean negativ. In Übereinstimmung mit der Neigung der gelb-schwarzen Linie in Abbildung 2 sind das antarktische Plateau und die Temperaturzonen die positiven Gebiete, während die Tropen negativ sind. Und wie in Abbildung 2 dargestellt, sind einige Teile des wärmsten tropischen Ozeans stark negativ.

Als globaler flächengewichteter Durchschnitt ergibt diese Analyse schließlich eine globale negative CRE von -1,9 W/m² pro Grad Oberflächenerwärmung. Negativ.

Ja, ich verstehe, dass dies das genaue Gegenteil von dem ist, was die „Klimamodell-Simulationen, Satellitenbeobachtungen und explizite Simulationen von Wolken“, auf die sich der IPCC bezieht, aussagen… aber der IPCC ist ein politisches Gremium, kein wissenschaftliches Gremium.

Und was noch wichtiger ist: Diese Analyse basiert auf dem, was die Erde tatsächlich tut, und nicht auf „Klimamodell-Simulationen“, von denen selbst das IPCC zugibt, dass sie in Bezug auf Wolken sehr fehlerhaft und unsicher sind.

Und ja, sie widerspricht dem „wissenschaftlichen Konsens“ … aber so etwas ist sowieso Unsinn.

Schlussbemerkungen

Dies sind nur die Strahlungseffekte der Wolken. Zusätzlich zu den Strahlungseffekten der Wolken kühlen die Wolken die Oberfläche auf verschiedene andere Weise ab:

● Sie verstärken den Wind, der die Verdunstung erhöht, was die Abkühlung der Oberfläche verstärkt.

● Der Wind erhöht auch den fühlbaren Wärmeverlust von der Oberfläche.

● Wind über dem Ozean führt zu einer Erhöhung der Oberflächenalbedo durch die Auswirkungen von weiß brechenden Wellen, Gischt und Schaum.

● Sowohl durch die Gischt als auch durch die Wellen vergrößert der Wind die Oberfläche des Ozeans, was zu einem erhöhten Verlust an Verdunstungswärme und fühlbarer Wärme führt.

● Wolken führen zu Regen und Schnee, die beide eine stark kühlende Wirkung auf die Oberfläche haben.

● Thermisch angetriebene, kondensierende Wolken sind von langsam absinkender, trockener Luft umgeben, wodurch mehr Strahlung in den Weltraum entweichen kann.

● Der Wind verstärkt die Umwälzung der Meeresoberfläche, die kühleres Tiefenwasser an die Oberfläche bringt.

● Die in den obigen Grafiken gezeigte Strahlungskühlung unterschätzt also sowohl den gesamten Kühleffekt als auch die gesamte negative Rückkopplung der Wolken erheblich.

Link: https://wattsupwiththat.com/2021/09/17/uncertain-clouds/

Übersetzt von Christian Freuer für das EIKE