Von der Website science, climat et énergie (SCE)

[Alle Hervorhebungen in diesem Beitrag im Original. ]

Wir haben erfahren, dass der Nobelpreis für Physik 2021 am Dienstag, den 5. Oktober, an zwei Experten für die Modellierung des Klimawandels, den amerikanisch-japanischen Syukuro Manabe und den deutschen Klaus Hasselmann, sowie an den italienischen Theoretiker Giorgio Parisi verliehen wurde.

Die Hälfte des Preises geht an den 90-jährigen Syukuro Manabe und den 89-jährigen Klaus Hasselmann „für die physikalische Modellierung des Erdklimas und für die Quantifizierung seiner Variabilität und die zuverlässige Vorhersage der globalen Erwärmung“, so die Jury. Die andere Hälfte des Preises geht an Giorgio Parisi, 73, „für die Entdeckung des Zusammenspiels von Unordnung und Fluktuationen in physikalischen Systemen vom atomaren bis zum planetarischen Maßstab“.

SCE beglückwünscht die Preisträger und nutzt die Gelegenheit, um an einige offensichtliche Fakten zu erinnern, die von den meisten Medien nicht erwähnt werden.

1. Das Nobel-Komitee belohnt Modellierer

Mit dem Nobelpreis für Physik werden Modellphysiker ausgezeichnet, d. h. Wissenschaftler, die auf der Grundlage bekannter physikalischer Gesetze komplexe mathematische Modelle erstellen und damit versuchen, vergangene und zukünftige Veränderungen im Klimasystem zu reproduzieren.

Dabei ist zu bedenken, dass ein mathematisches Modell nicht die Realität ist und dass im Hinblick auf das Klima kein Modell jemals in der Lage sein wird, genau vorherzusagen, was in der Zukunft passieren wird.

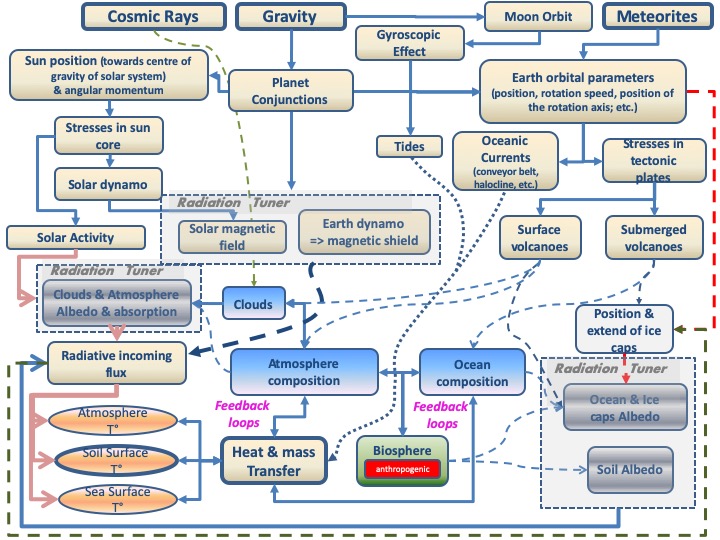

Das ist der Grund dafür. Erstens sind viele physikalisch-chemische Phänomene noch immer schlecht verstanden (z. B. die Bildung von Wolken [französisch]). Sollte sich herausstellen, dass dies nicht der Fall ist, könnte die wissenschaftliche Forschung heute eingestellt werden. Das Klima ist ein komplexes System, d. h. es setzt sich aus einer Vielzahl von Elementen zusammen (sowohl auf der Erde als auch außerhalb der Erde), und alle diese Elemente können untereinander eine Vielzahl von Wechselwirkungen haben (Abbildung 1). Es sind viele Arten von Wechselwirkungen möglich; das System enthält auch viele direkte oder indirekte Rückkopplungsschleifen (und daher mit einer gewissen Verzögerung). Es ist auch dynamisch, d. h. es entwickelt sich in Raum und Zeit.

Abbildung 1. Die vielen Parameter, die das Klima steuern: das „Klima-Metamodell“. Für weitere Informationen siehe hier [französisch].

Wenn die Wechselwirkungen zwischen den Objekten des Systems linear und kurzzeitig sind, kann die Entwicklung des dynamischen Systems als Funktion der Zeit durch Systeme gewöhnlicher Differentialgleichungen modelliert werden. Das System entwickelt sich dann mit der Zeit zu einer einzigen Lösung, bei der sich die Werte der Variablen nicht mehr ändern. In diesem Fall können Vorhersagen gemacht werden.

Leider sind natürliche Systeme, die die Eigenschaft der Linearität besitzen, äußerst selten, um nicht zu sagen nicht existent. Viele Systeme lassen sich jedoch einigermaßen linearisieren, um ihre Untersuchung zu erleichtern. Viele Theorien der Physik und der Mechanik werden daher unter Berücksichtigung linearer Systeme aufgestellt.

Wenn aber die Wechselwirkungen zwischen den Objekten des Systems nichtlinear sind (Anmerkung: nichtlinear = das „Überlagerungsprinzip“ wird nicht beachtet; die meisten physikalischen Systeme sind nichtlinear. Beispiel: Navier-Stokes-Gleichungen in der Flüssigkeitsmechanik), muss die Entwicklung des dynamischen Systems als Funktion der Zeit durch Systeme nichtlinearer Differentialgleichungen modelliert werden. Diese Gleichungen sind sehr schwer zu lösen… Lange Zeit mussten wir auf Vereinfachungen zurückgreifen, um diese Gleichungen unter den Bedingungen der Linearität zu untersuchen. Glücklicherweise können uns die Computer helfen. Und diese Computer zeigen uns dann, dass es mehrere mögliche Lösungen gibt! In einigen Fällen konvergiert das System nie direkt zu der einen oder anderen Lösung, sondern „dreht sich“ in asymptotisch konvergierenden Bahnen; in anderen Fällen entwickelt sich das System in variablen, aber nicht konvergierenden Bahnen um einen der „seltsamen Attraktoren“ und wechselt zu unvorhersehbaren Zeiten von einem „Attraktor“ zum anderen. Ein solches System wird als „chaotisch“ bezeichnet (im mathematischen Sinne des Begriffs; im Englischen ist es ein „dynamisches System“). Es kann durch ein System perfekt definierter nichtlinearer Gleichungen beschrieben werden, aber der Wert seiner abhängigen Variablen kann sich zu einem bestimmten Zeitpunkt enorm ändern, wenn wir die Ausgangsbedingungen oder den Wert eines der Parameter nur geringfügig ändern, was ein solches System in der Praxis vollkommen unvorhersehbar macht. Dies ist das, was man als deterministisches Chaos [französisch] bezeichnet hat. Das System schwingt unregelmäßig (aperiodisch) und wiederholt nie genau dieselbe Schwingung zweimal. Es ist also nicht möglich, das Verhalten des Systems auf lange Sicht vorherzusagen.

Im deterministischen Chaos bestimmt jede Anfangsbedingung vollständig die zukünftige Entwicklung, denn es handelt sich nicht um einen Zufall: Das System ist vollständig deterministisch. Zwei sehr ähnliche Ausgangsbedingungen können jedoch völlig unterschiedliche Entwicklungen haben. Die Entwicklung des Systems wird dann unvorhersehbar, weil ein kleiner Messfehler oder eine Rundung auf die 15. Nachkommastelle nach einer gewissen Zeit zu völlig anderen Ergebnissen führt.

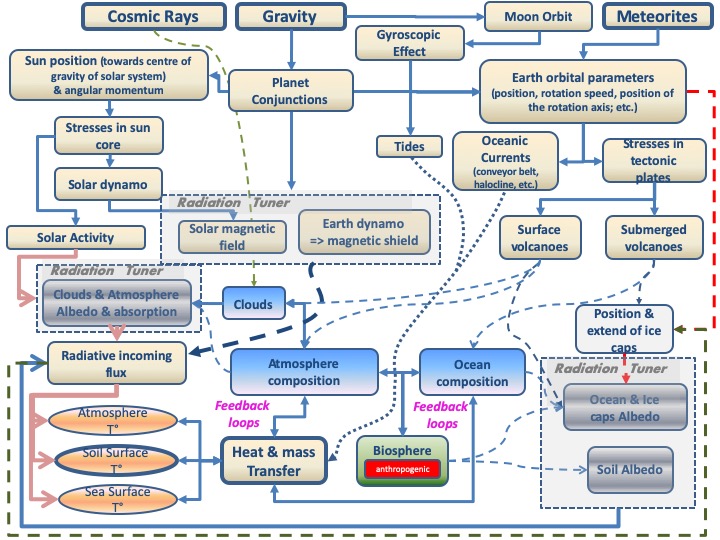

Mit anderen Worten, wenn eine mathematische Variable geringfügig geändert wird, wird das Klimamodell nicht dieselbe Vorhersage liefern. Hier ist ein konkretes Beispiel (Abbildung 2).

Abbildung 2. Ergebnisse von 30 Simulationen, die mit demselben Klimamodell durchgeführt wurden (Karten 1 bis 30), für Nordamerika im Winter. Die Karten zeigen die Trends zwischen 1963 und 2012 (50-Jahres-Zeitraum). Der einzige Unterschied zwischen den Simulationen ist die Starttemperatur, wobei die Unterschiede zwischen den Simulationen sehr gering sind (es wurde eine kleine [(10↑-14)°C] zufällige Rundungsdifferenz zum anfänglichen Lufttemperaturfeld verwendet). Die EM-Karte ist der Durchschnitt der 30 Simulationen, die OBS-Karte sind die Beobachtungen. Die Farben stellen die Variationen (in °C) über 50 Jahre dar. Quelle: Deser et al. 2016, Journal of Climate 29: 2237-2258.

Abbildung 2 (aus Deser et al. 2016, Journal of Climate 29: 2237-2258) zeigt uns, dass wir völlig unterschiedliche Vorhersagen erhalten können, wenn wir die Ausgangstemperatur um einen winzigen Wert (10↑-14°C) variieren.

Der Mittelwert der Simulationen (EM in Abbildung 2) stimmt nicht mit den beobachteten Messungen überein, und schlimmer noch, wir bringen die Modelle dazu, genau das zu sagen, was wir wollen, indem wir einen der Parameter auf infinitesimale Weise verändern. Man kann naiv hoffen, dass mathematische Modelle (und ihre Algorithmen zur Berechnung eines Mittelwerts) es ermöglichen, die chaotische Signatur eines komplexen Phänomens zu „löschen“, aber in Wirklichkeit verleihen die Modelle selbst, durch die Struktur der verwendeten Gleichungen, den Ergebnissen, die sie produzieren, einen chaotischen Charakter.

Für weitere Einzelheiten sei auf die Veröffentlichung [französisch] des SCE über chaotische Systeme verwiesen.

2. Klimamodelle sind ungenau

Nach dem eben Gesagten ist es offensichtlich, dass die Jury des Nobelkomitees falsch liegt, wenn sie schreibt, dass Klimamodelle „die globale Erwärmung zuverlässig vorhersagen können“. Hier sind zwei weitere Beobachtungen, die das Gegenteil zeigen:

– Kein Computermodell hatte die Pause (den „Hiatus“) in der Entwicklung der globalen Temperaturen, die zwischen 1998 und 2014 beobachtet wurde, vorhergesagt. Zu diesem Problem sind Dutzende von Artikeln veröffentlicht worden. Siehe zum Beispiel Hedemann et al. 2017 (Nature Climate Change).

– Computermodelle, die auf der CO2-Rate basieren, sagen einen atmosphärischen „Hot-Spot“ voraus (wir haben hier [französisch] darüber berichtet). Dieser „Hot-Spot“ entspricht jedoch nicht den Messungen, die in situ mit Wetterballonen durchgeführt wurden! Für weitere Details siehe Christy et al. 2018.

Glauben Sie immer noch, dass die Klimamodelle korrekt sind? Es ist seit langem bekannt, dass die Klimamodelle übermäßige Erwärmungsraten in der tropischen Troposphäre aufweisen. Und das ist kein Geheimnis für viele Modellierer, die versuchen, ihre Modelle zu verbessern… Nur das Nobelkomitee scheint es nicht zu wissen!

Was die neuen Versionen der Klimamodelle CMIP6 (Coupled Model Intercomparison Project Version 6) angeht, die im letzten Bericht des IPCC (AR6) verwendet wurden, so sind sie nicht besser. In einer Veröffentlichung aus dem Jahr 2020 untersuchten McKitrick und Christy beispielsweise 38 CMIP6-Modelle anhand historisch beobachteter Parameter. Sie konzentrierten sich dabei auf den Zeitraum 1979-2014. Die Autoren zeigen, dass die Modelle zu einer Erwärmung führen, die nicht mit den Beobachtungen übereinstimmt, weder für die untere noch für die mittlere Troposphäre, weder in den Tropen noch anderswo auf der Welt.

3. Die Philosophie des Nobelpreises dürfte nicht beachtet worden sein

Es ist unklar, ob Alfred Nobel den Physikpreis 2021 billigen würde, wenn er ihn sehen könnte. Der Erfinder des Dynamits war ein leidenschaftlicher Verfechter der konkreten Aspekte von Wissenschaft und Technik und wollte diejenigen belohnen, die einen konkreten Beitrag zu deren Fortschritt geleistet hatten. So wurde der Nobelpreis für Physik 1903 gemeinsam an das Ehepaar Curie (Pierre und Marie) und an Henri Becquerel für die Entdeckung der natürlichen Radioaktivität verliehen, einem bis dahin unbekannten physikalischen Phänomen. Der Nobelpreis von 1935 wurde James Chadwick für seine Entdeckung des Neutrons im Jahr 1932 verliehen, eines wesentlichen Elements, das die Materie ausmacht. Beispiele dieser Art gibt es viele.

Erst nach und nach wurde der Preis auch für Theorien esoterischer Natur verliehen. Eine der Bedingungen für die Verleihung war, dass diese Theorien zum Verständnis der Eigenschaften der physikalischen Welt beitragen konnten. Ein gutes Beispiel dafür ist der Nobelpreis für Physik von 1963, der Eugène Wigner (gemeinsam mit Maria Goeppert-Mayer und Hans Jensen) für seine grundlegenden Arbeiten zu Symmetriegruppen verliehen wurde, einer sehr abstrakten mathematischen Theorie zum Verständnis wichtiger Aspekte der Struktur des Universums.

Mit dem Nobelpreis für Physik 2013 wurden zwei Theoretiker (Brout und Englert) ausgezeichnet, die ein mathematisches Modell entwickelt haben, das die Eigenschaften eines fundamentalen Teilchens, des Higgs-Bosons, erklärt, das 2012 mit den Instrumenten am großen CERN-Collider nachgewiesen wurde. Diese Entdeckung erklärt die Verleihung des Preises an die drei Autoren, von denen nur zwei den Preis erhielten, da Brout 2011 verstarb.

Der diesjährige Preis wird dieser Perspektive bei weitem nicht gerecht. Bringen diese Autoren des Modellierens noch nie dagewesene Ergebnisse? Wir können das bezweifeln, mit der möglichen Ausnahme von Giorgio Parisi. In der Begründung ist lediglich von „zuverlässigen“ Ergebnissen die Rede. Das Mindeste, was wir sagen können, ist, dass diese Einschränkung nicht viel bedeutet. Außerdem bietet das Modell nichts grundlegend Neues in der Physik. Alles, was es ausmacht (Physik der Sonne, der Atmosphäre, der Ozeane und ihrer Wechselwirkungen), ist seit Jahrzehnten bekannt. Der Preis ist also eher eine „mathematische“ als eine „physikalische“ Aufgabe. Der Wille Alfred Nobels wird also in gewisser Weise verraten.

4. Conclusions

Indem das Nobelkomitee am Vorabend von COP26 Klimamodellierer belohnt, macht es eine politische und mediale Geste. Das gemeine Volk, das keine Ahnung von Modellierung hat, wird dazu neigen, den Vorhersagen des Heiligen Berichts des IPCC zu glauben.

Abschließend sei an dieser Stelle daran erinnert, was der Physiker Jacques Duran auf seiner Website „Pensée-unique“ geschrieben hat:

„Vorhersagen über die Zukunft unseres Planeten sind gelinde gesagt riskant, denn wir haben es mit einem riesigen System von Differentialgleichungen mit unbekannten Koeffizienten zu tun, die nichtlinear und miteinander gekoppelt sind. Diese Gleichungen sind daher sehr schwer zu entschlüsseln. Darüber hinaus verhalten sich einige dieser Gleichungen chaotisch, d. h. sie reagieren sehr empfindlich auf oft unbekannte Anfangsbedingungen. Es gibt nichts Schlimmeres! Doch Computerprogrammierer haben einen Heidenspaß mit Tausenden von unbekannten Parametern und der Form von Master-Gleichungen, die man versuchen muss zu erraten. Das Problem ist jedoch, dass wir die Ergebnisse beliebig verändern können, indem wir nur einen der Parameter oder nur eine der unbekannten Gleichungen ändern. Wie können wir dann glauben, dass Computer eine korrekte Vorhersage machen, wenn die wesentlichen Mechanismen des Austauschs und der positiven und negativen Rückkopplungen immer noch sehr schlecht verstanden sind und immer noch Gegenstand erbitterter Diskussionen zwischen Chemikern, Physikern, Klimatologen und anderen Geophysikern sind?“

Der Glaube an den Wahrheitsgehalt einer bestimmten Computervorhersage ist eher eine Glaubensfrage als eine wissenschaftliche Gewissheit. Angesichts der Vielzahl möglicher Auflösungsmethoden, der komplizierten Gleichungen und der Anzahl der einstellbaren Parameter sind die Ergebnisse von Computersimulationen für jemanden, der sie nicht selbst programmiert hat, nur schwer zu kontrollieren. Kurzum, wir tappen im Dunkeln, und die Vorurteile nehmen überhand. Politiker und Umweltschützer hingegen wählen die Ergebnisse aus, die für sie richtig sind, ignorieren aber die vielen Unsicherheiten, Annäherungen und Probleme, die die angewandten Methoden mit sich bringen. Politiker und Umweltschützer sind völlig unfähig, die Verlässlichkeit der ihnen mitgeteilten Ergebnisse einzuschätzen, und man kann es ihnen angesichts der Schwierigkeiten des Problems nicht verdenken. Das Einzige, was man ihnen vorwerfen kann, ist ihre zu große Leichtgläubigkeit und ihre zwingenden Behauptungen, um zu glauben, dass all dies sicher ist, während es das überhaupt nicht ist!“

5. References

John R. Christy, Roy W. Spencer, William D. Braswell & Robert Junod (2018) Examination of space-based bulk atmospheric temperatures used in climate research, International Journal of Remote Sensing, 39:11, 3580-3607, DOI: 10.1080 /01431161.2018.1444293

Link: https://www.science-climat-energie.be/sce-info-a-nobel-prize-for-mathematical-models/

Übersetzt von Christian Freuer für das EIKE