Sollten Regierungen wissenschaftliche Forschung kontrollieren?

Andy May

Bundesgelder ermöglichen es nicht gewählten Bürokraten, die wissenschaftliche Forschung zu kontrollieren. Sie diktieren die Projekte und oft auch die Ergebnisse. Sie nutzen gezielte Indiskretionen an die Presse, um jeden in Verlegenheit zu bringen, der versucht, sich ihrer Kontrolle zu widersetzen. Sie handeln mit der Angst und genießen sie. Jeder, der nicht mit ihnen übereinstimmt, unterdrückt die „Wissenschaft“.

Sie nutzen auch eine unwissende und willfährige Presse, um privat finanzierte wissenschaftliche Forschung als von „bösen“ Unternehmen „korrumpiert“ zu verteufeln [1]: Staatliche Forschung ist „Wissenschaft“ und privat finanzierte Forschung ist korrupt. Mit diesem Narrativ werden sie zur „Wahrheit“, und gegenteilige Ansichten sind nicht erlaubt.

[Hervorhebungen vom Übersetzer]

Präsident Eisenhower sagte, Zitat:

Präsident Eisenhower sagte, Zitat:

„Die Aussicht auf die Beherrschung der Gelehrten der Nation durch die Beschäftigung des Bundes, die Zuteilung von Projekten und die Macht des Geldes ist allgegenwärtig und muss ernsthaft in Betracht gezogen werden.“

Aus der Abschiedsrede von Präsident Eisenhower, 1961

H. L. Mencken schrieb, Zitat:

„Das ganze Ziel der praktischen Politik besteht darin, die Bevölkerung in Angst und Schrecken zu versetzen (und damit in Sicherheit zu bringen), indem man sie mit einer endlosen Reihe von Schrecknissen bedroht, die alle nur eingebildet sind.“

H. L. Mencken, 1918, Zur Verteidigung der Frauen

Wie kann man die Öffentlichkeit besser erschrecken als mit den Vorhersagen eines Wissenschaftlers?

In Abbildung 1 sehen wir ein Time-Titelbild vom 8. April 1977, das einen Artikel darüber ankündigt, wie man eine kommende Eiszeit überleben kann. Im Gegensatz dazu wird auf dem Titelblatt vom 3. April 2006 dazu geraten, sich wegen des vermuteten Kipppunkts der globalen Erwärmung große Sorgen zu machen.

Die von der Regierung finanzierte Forschung sagte uns 1977, dass wir alle in einer neuen Eiszeit erfrieren würden, dann hörte die Welt auf, sich abzukühlen, und begann sich zu erwärmen, und 2006 beschlossen die Herausgeber von Time, dass wir alle aufgrund der globalen Erwärmung kochen werden, wenn wir die fossile Brennstoffindustrie nicht zerstören.

Ich weiß nicht, wie viel Geld die Regierung für die Vorhersage einer neuen Eiszeit im Jahr 1977 ausgegeben hat, aber ein Bericht des Government Accountability Office aus dem Jahr 2018 behauptet, dass die USA seit 1993 über 154 Milliarden Dollar für Aktivitäten im Zusammenhang mit dem Klimawandel ausgegeben haben [2].

Abbildung 2 zeigt zwei Jahr-2000-Warnungen aus dem Jahr 1999. Wir würden alle sterben, weil die Computer den Unterschied zwischen 1900 und 2000 nicht erkennen könnten. Dieser Fehler würde zweifellos (sarkastisch gesprochen) Computerausfälle verursachen, die zu versehentlichen Atombombenexplosionen, gefährlichen Entlassungen von Gefangenen und Terroranschlägen führen würden. Aber nichts ist passiert. Wie Ross Perot bemerkte, ist er noch nicht von einem Auto angefahren worden, das er drei Blocks entfernt kommen sah. Angeblich drohten die Krankenhäuser überzulaufen, wenn wir das Land nicht wegen Covid-19 abriegeln würden; in der Zwischenzeit hat Schweden nichts getan und es ging ihm gut. Die Liste geht weiter und weiter.

Was hat die private Forschung für uns getan? Beispiele sind Halbleiter [3], PCs [4], Kameras [5], Telefone [6], Autos [7], Flugzeuge [8], Klebeband [9], Fernsehen und Filme [10], Teflon [11], Klettverschluss [12], Aspirin [13], und vieles mehr. Regierungen haben nicht so viele Erfindungen gemacht, aber zu den Beispielen gehören Atombomben [14], ballistische Raketen [15], AK-47 [16] und wahrscheinlich COVID-19 [17] und die COVID-19-Impfstoffe [18]! Private Erfindungen verbessern in der Regel unser Leben, staatliche Erfindungen zerstören eher Leben.

[Hervorhebung vom Übersetzer]

Aber dann fragen die Befürworter der staatlich kontrollierten Wissenschaft: „Was ist mit der Grundlagenforschung? Was ist mit der Forschung, die die Unternehmen nicht finanzieren wollen?“ Das ist Unsinn, Wissenschaft und Technologie werden sich unabhängig von staatlichen Eingriffen weiterentwickeln, Regierungen sind nicht so wichtig. So haben Newton und Leibniz etwa zur gleichen Zeit die Infinitesimalrechnung erfunden, und Elisha Gray und Alexander Graham Bell meldeten am gleichen Tag Telefonpatente an [19].

Viele staatliche Forschungsgelder werden für nutzlose oder gefährliche Forschung ausgegeben. Das COVID-SARs-Virus wurde wahrscheinlich teilweise mit Forschungsgeldern der US-Regierung entwickelt. Bestimmte NIH*-Forschungsgelder sind an das Wuhan Institute of Virology geflossen. Mit Forschungsgeldern wurden unlängst Versuche finanziert, Zebrafische nikotinabhängig zu machen, und vier Millionen Dollar wurden ausgegeben, um den Zusammenhang zwischen Alkoholkonsum und Notaufnahme zu untersuchen [20]. Wer hätte gedacht, dass es da einen Zusammenhang gibt?

[NIH = National Institutes of Health, Amerikanische Behörde für Gesundheit; Sitz in Bethesda, Maryland. A. d. Übers.]

Es ist ein Mythos, dass Wissenschaft und Technologie durch Geldausgeben hervorgezaubert werden können. Es ist auch ein Mythos, dass die wissenschaftliche Forschung die Entwicklung neuer Technologien vorantreibt; es ist genau umgekehrt: Wissenschaftliche Durchbrüche sind normalerweise das Ergebnis technologischer Veränderungen, nicht umgekehrt [21]. Die Thermodynamik wurde aufgrund der Dampfmaschine entwickelt, nicht umgekehrt. Einsteins Relativitätstheorie wäre ohne das Michelson-Interferometer und andere spektakuläre Erfindungen im 19. Jahrhundert vielleicht nicht entwickelt worden [22]. Wie jeder hier verstehen sollte, wird zuerst die Technik entwickelt, und dann findet die Wissenschaft heraus, wie es dazu kam.

Politiker und Bürokraten kontrollieren die wissenschaftliche Forschung und die Forschungsergebnisse, indem sie gezielt Projekte finanzieren, die nach potenziellen Katastrophen, idealerweise globalen Katastrophen, suchen. Viele Menschen lieben Katastrophengeschichten, Journalisten lieben Katastrophengeschichten, Wissenschaftler lieben es, in Zeitungen und im Fernsehen zitiert zu werden. Es ist eine Win-Win-Situation für alle, außer für die Allgemeinheit. Der Princeton-Physikprofessor William Happer schrieb einmal, Zitat:

„Als Direktor der Energieforschung des Energieministeriums in den frühen 1990er Jahren war ich erstaunt, dass der größte Teil der Bundesmittel für Umweltstudien des DOE, der NASA, der EPA und anderer Bundesbehörden in Forschungsprogramme floss, die eine Botschaft des drohenden Untergangs verstärkten: die Menschheit und der Planet Erde würden durch globale Erwärmung, Pestilenz, Hungersnot und Überschwemmungen verwüstet.“ [23]

Prof. William Happer, 2003

So ist es nicht verwunderlich, dass Wissenschaftler, seit die Regierung die Finanzierung der wissenschaftlichen Forschung übernommen hat, von der Forschung, die den Menschen hilft, zur Erforschung möglicher Katastrophen übergegangen sind, ganz gleich, wie unwahrscheinlich diese sind. Die Wissenschaft hat sich von der Verbesserung des menschlichen Lebens zur Entwicklung von Plots für Katastrophenfilme entwickelt. Und wenn die Menschen für die Katastrophe verantwortlich gemacht werden können, ist es noch besser, denn dann können die Politiker den Menschen vorschreiben, ihr Leben „zum Wohle der Allgemeinheit“ zu ändern. Die Macht des Politikers wächst dann, weil die Ausübung von Macht diese vergrößert, und die Menschen werden ihre Freiheiten im Austausch für Sicherheit aufgeben, ob die Gefahr nun real ist oder nicht.

Wenn ein Politiker die Phrase „für das Allgemeinwohl“ benutzt, verstecken Sie Ihre Kinder und halten Sie Ihre Brieftasche fest, dann hat er es auf etwas abgesehen und führt nichts Gutes im Schilde.

Als Al Gore 1992 für das Amt des Vizepräsidenten kandidierte, schrieb er ein Buch Earth in the Balance, in dem er auf Seite 5 sagte, Zitat:

„Professor Revelle erklärte, dass ein höherer CO2-Gehalt den so genannten Treibhauseffekt auslösen würde, der die Erde erwärmen würde. Die Implikationen seiner Worte waren verblüffend; wir hatten nur acht Jahre an Informationen, aber wenn sich dieser Trend fortsetzt, würde die menschliche Zivilisation eine tiefgreifende und zerstörerische Veränderung des gesamten globalen Klimas bewirken.“

Al Gore, Die Erde im Gleichgewicht

Revelle war ein berühmter Wissenschaftler, der eine Vorlesung gehalten hatte, die Gore in Harvard besuchte. Er schrieb das Folgende im Jahr 1991, ein Jahr bevor Gores Buch herauskam. Es stammt aus einem Cosmos-Artikel mit dem Titel: „What to do about Greenhouse Warming: Look before you Leap“ [etwa: Was tun gegen die Treibhaus-Erwärmung? Erst schauen, dann reagieren], geschrieben in Zusammenarbeit mit Fred Singer und Chauncey Starr, zwei anderen berühmten Wissenschaftlern.

Ich zitiere aus der Studie:

„Wir können unsere Schlussfolgerungen in einer einfachen Botschaft zusammenfassen: Die wissenschaftliche [Grundlage] für eine Erwärmung durch den Treibhauseffekt ist zu unsicher, um drastische Maßnahmen zu diesem [Zeitpunkt] zu rechtfertigen. Es besteht kaum ein Risiko, politische Antworten auf dieses jahrhundertealte Problem hinauszuzögern, denn es ist zu erwarten, dass sich das wissenschaftliche Verständnis innerhalb des nächsten Jahrzehnts wesentlich verbessern wird.“

(Singer, Revelle, & Starr, 1991)

Revelle hatte die Zunahme des Kohlendioxids in der Atmosphäre jahrzehntelang untersucht und war zu dem Schluss gekommen, dass es eine gewisse Erwärmung verursachen könnte, aber er war sich nicht sicher, ob dies ein Problem darstellen würde. Seine Erwähnung von „innerhalb des nächsten Jahrzehnts“ war unheimlich korrekt, denn die berühmte Pause in der Erwärmung begann im Jahr 2000, nur neun Jahre später. Sie dauerte mindestens bis 2014.

Al Gore, der kaum eine wissenschaftliche Ausbildung hatte, litt nicht unter solchen Zweifeln. Er war sich sicher, dass die Verbrennung fossiler Brennstoffe den Kohlendioxidgehalt in der Atmosphäre auf „gefährliche“ Werte ansteigen ließ, und er war überzeugt, dass dies durch den Anstieg des Meeresspiegels und extreme Wetterverhältnisse ein Problem für die Zivilisation darstellte. Er war sich sicher, dass wir den CO2-Ausstoß zum Wohle der Menschheit verringern müssen. Es gab keine Beweise für diese Annahmen, aber Al Gore brauchte keine Beweise, er konnte sich immer auf Klimamodelle verlassen, und das tat er auch. Revelle hegte ein tiefes Misstrauen gegenüber Klimamodellen.

Die Unvereinbarkeit zwischen Revelles wahren Ansichten und der Art und Weise, wie sie in Gores Buch dargestellt wurden, fiel Gregg Easterbrook, einem Redakteur von Newsweek, auf, der in der Ausgabe von The New Republic vom 6. Juli 1992 darüber schrieb [24].

Al Gore wurde durch Easterbrooks Artikel und die darauf folgenden Artikel von George Will und anderen gedemütigt. Justin Lancaster war von 1981 bis zu Revelles plötzlichem Tod im Juli 1991 Revelles Doktorand und Lehrassistent an der Scripps Institution of Oceanography. Er war auch ein Unterstützer von Al Gore. Lancaster behauptete, Revelle sei von Singer „hinters Licht geführt“ worden, damit er seinen Namen zu dem Cosmos-Artikel „Look before you Leap“ hinzufügte. Er behauptete auch, dass es Revelle „sehr peinlich war, dass sein Name damit in Verbindung gebracht wurde“. Lancaster behauptete ferner, dass Singers Handlungen „unethisch“ waren und speziell darauf abzielten, die Position von Senator Al Gore zur globalen Erwärmung zu untergraben. Lancaster bedrängte Singer 1992, beschuldigte ihn, Revelles Namen über seine Einwände hinweg in den Artikel gesetzt zu haben, und verlangte, dass Singer den Artikel entfernen ließ. Er verlangte sogar, dass der Herausgeber eines Bandes, der den Artikel enthalten sollte, diesen entfernen sollte [25].

Professor Singer, der Cosmos-Verlag und der Herausgeber des Buches widersprachen diesen Forderungen und Anschuldigungen. Daraufhin verklagte Singer Lancaster wegen Verleumdung mit Hilfe des Center for Individual Rights in Washington, D.C. Professor Singer und das Center gewannen den Prozess und zwangen Lancaster zu einer Entschuldigung.

Die Ermittlungen während des Prozesses ergaben, dass Lancaster eng mit Al Gore und seinen Mitarbeitern zusammenarbeitete. Tatsächlich rief Al Gore nach Erscheinen des Easterbrook-Artikels persönlich bei Lancaster an und fragte ihn nach Revelles geistiger Leistungsfähigkeit in den Monaten vor seinem Tod im Juli 1991. Freunde und Familie von Revelle erinnern sich, dass er bis zu dem Moment, als er an einem plötzlichen Herzinfarkt verstarb, geistig rege und aktiv war. Dies hielt Al Gore und Lancaster jedoch nicht davon ab, zu behaupten, Revelle habe an Senilität oder Demenz gelitten, und deshalb unterschied sich die Darstellung in Gores Buch so sehr von dem, was Revelle an anderer Stelle, auch in dem Cosmos-Artikel, schrieb. Lancaster selbst hatte in einem Briefentwurf an Al Gore geschrieben, dass Revelle „geistig scharf bis zum Ende“ war und „seine Integrität nicht auf die leichte Schulter nahm“ [26].

Während des Ermittlungsverfahrens stellten Singer und seine Anwälte fest, dass Lancaster wusste, dass alles in dem Cosmos-Artikel wahr war und dass Revelle mit allem darin übereinstimmte. Der Artikel enthielt sogar eine Menge Material, das Revelle bereits 1990 auf einer Tagung der American Academy for the Advancement of Science vorgestellt hatte.

Wenn Revelle gegen „drastische“ Maßnahmen plädierte, meinte er damit Maßnahmen, die Billionen von Dollar kosten und die fossile Brennstoffindustrie und die Entwicklungsländer lahmlegen würden. Bis zu seinem Tod hielt er extreme Maßnahmen für verfrüht. Er war eindeutig der Meinung, dass wir erst einmal abwägen sollten, bevor wir etwas unternehmen.

Al Gore versuchte, Ted Koppel dazu zu bringen, Singer in seiner wöchentlichen Fernsehsendung Nightline zu verunglimpfen, und scheiterte damit spektakulär. Er wollte, dass Koppel die „Anti-Umwelt-Bewegung“ untersuchte und insbesondere „die Tatsache aufdeckte“, dass Singer und andere skeptische Wissenschaftler finanzielle Unterstützung von der Kohleindustrie und der verrückten Lyndon LaRouche-Organisation erhielten. Anstatt Al Gores Vorgaben zu folgen, sagte Ted Koppel am 24. Februar 1994 im Fernsehen folgendes:

„Es entbehrt nicht einer gewissen Ironie, dass Vizepräsident Gore, einer der wissenschaftlich gebildetsten Männer, die in diesem Jahrhundert im Weißen Haus saßen, zu politischen Mitteln greift, um etwas zu erreichen, das letztlich auf rein wissenschaftlicher Grundlage gelöst werden sollte. Der Maßstab für gute Wissenschaft ist weder die Politik des Wissenschaftlers noch die Menschen, mit denen der Wissenschaftler zusammenarbeitet. Es ist das Eintauchen der Hypothesen in die Säure der Wahrheit. Das ist der harte Weg, aber es ist der einzige Weg, der funktioniert.“

Ted Koppel, Nightline, 24. Februar 1994

Al Gore als „wissenschaftlich gebildet“ zu bezeichnen, ist fragwürdig, aber Koppel hat mit dem Rest Recht. Er hat eine Integrität, die im heutigen Journalismus fehlt, und er versteht den wissenschaftlichen Prozess. Der Versuch, Koppel zu benutzen, um Singer zu teeren, hat Gore eine Menge wohlverdienter Kritik eingebracht.

In Anbetracht dessen ist es nicht verwunderlich, dass Lancaster sich nur zwei Monate später, am 29. April 1994, zu einer Entschuldigung bereit erklärte. Lancasters Rückzug war eindeutig:

„Ich ziehe alle mündlichen oder schriftlichen Äußerungen zurück, die ich gemacht habe und in denen ich behaupte oder andeute, dass Professor Revelle kein echter und freiwilliger Mitverfasser des Cosmos-Artikels war, oder die in irgendeiner anderen Weise das Verhalten oder die Motive von Professor Singer in Bezug auf den Cosmos-Artikel (einschließlich, aber nicht beschränkt auf dessen Abfassung, Redaktion, Veröffentlichung, Wiederveröffentlichung und Verbreitung) anzweifeln oder verleumden. Ich verpflichte mich, in Zukunft keine derartigen Aussagen mehr zu machen. … Ich entschuldige mich bei Professor Singer“.

Justin Lancaster, gerichtlich angeordnete Entschuldigung, 29. April 1994

In seiner eidesstattlichen Erklärung gab Lancaster also zu, dass er über Fred Singer gelogen hatte. Später zog Lancaster seinen gerichtlich angeordneten Widerruf zurück und wiederholte die gleichen Anschuldigungen. Er gibt zu, dass er unter Eid in einem Gerichtssaal und schriftlich gelogen hat, und sagt uns dann, dass er nicht gelogen hat. Er gibt zu, dass Professor Revelle ein echter Mitverfasser der Arbeit war, dann erklärt er: „Revelle hat sie nicht geschrieben“ und „Revelle kann kein Autor sein“ [27]. Es ist kaum zu glauben, was manche Menschen zu tun bereit sind, ihrem Ruf im Namen einer imaginären Klimakatastrophe zu schaden. Er zog seinen Widerruf zurück, obwohl es Beweise in Revelles eigener Handschrift und zahlreiche Aussagen von anderen gibt, die belegen, dass Revelle tatsächlich zu dem Artikel beigetragen hat. Eine Klimawandel-Katastrophe? Schauen wir weiter.

Abbildung 3 zeigt die Ankündigung des Nobelpreiskomitees für den 2018 erhaltenen Preis des Yale-Professors William Nordhaus. Er erhielt den Preis für seine jahrzehntelange Forschung zur Ökonomie des Klimawandels und für die Entwicklung des DICE-Wirtschaftsmodells für potenzielle wirtschaftliche Schäden durch den Klimawandel.

Abbildung 3. Die Ankündigung des Nobelpreiskomitees zur Verleihung des Nobelpreises für Wirtschaft an Prof. William Nordhaus.

Im Jahr 1990 schrieb Nordhaus, Zitat:

„…diejenigen, die für starke Maßnahmen zur Verlangsamung der Erwärmung des Treibhauseffekts plädieren, sind zu diesem Schluss gekommen, diese ohne eine erkennbare Analyse der Kosten und des Nutzens vorzunehmen…“

(Nordhaus, 1990)

Nordhaus erhielt den Nobelpreis 28 Jahre, nachdem er dies geschrieben hatte. Nordhaus nannte auch Al Gores Kyoto-Protokoll von 1997

„… ein konzeptionelles Desaster; es hat weder politisch noch wirtschaftlich oder ökologisch einen Zusammenhang.“ [28]

Yale-Konferenzprotokoll

Kyoto hatte wenig mit dem Klimawandel zu tun, es war hauptsächlich ein enormer Geldtransfer von den reichen Ländern zu den armen Ländern.

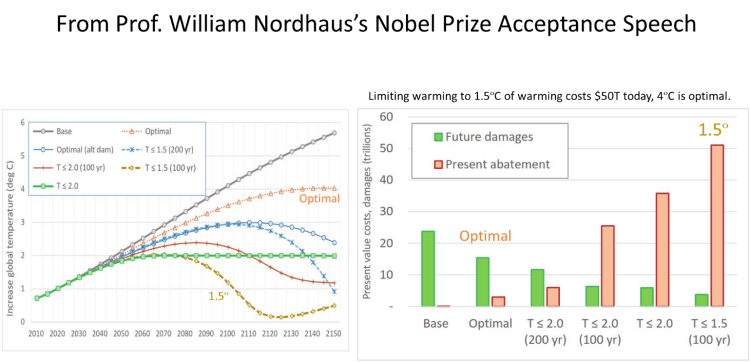

Abbildung 4. Zwei Diagramme, die Nordhaus‘ Analyse der vermiedenen künftigen Schäden (grün) und der gegenwärtigen Kosten der CO2-Minderung (rot) zusammenfassen. Das linke Diagramm zeigt die vom IPCC erwarteten Temperaturen für jedes Szenario und das rechte Diagramm die Kosten und Vorteile der Szenarien.

Abbildung 4 fasst das Ergebnis der Analyse von Nordhaus zusammen, wobei er Grafiken aus seiner Nobelpreisvorlesung von 2018 verwendet [29]. Die Folie hebt zwei wirtschaftliche Szenarien hervor: Das erste ist der vom IPCC empfohlene Weg zu einer durchschnittlichen Erwärmung im 21. Jahrhundert von 1,5 Grad Celsius, der von 2060 bis 2080 zwei Grad Erwärmung erreicht, dann aber abfällt. Dieses hypothetische Erwärmungsszenario ist in der linken Grafik in schmutzigem Gelb dargestellt. Die Ergebnisse des Nordhaus-DICE-Wirtschaftsmodells für dieses Szenario sind auf der rechten Seite des rechten Diagramms dargestellt. Der rote Balken zeigt die gegenwärtigen Vermeidungskosten, d. h. die Kosten, die entstehen, wenn die Treibhausgasemissionen so weit reduziert werden, dass die Erwärmung auf 1,5 Grad begrenzt wird. Wie man sieht, zahlen wir heute über 50 Billionen Dollar, um in der Zukunft Einsparungen von weniger als fünf Billionen Dollar zu erzielen. Wenn alles so abläuft, wie der IPCC sagt, ist das kein sehr gutes Geschäft.

Das zweite hervorgehobene Szenario ist das wirtschaftlich „optimale“ DICE-Modell. Im linken Diagramm ist es die orangefarbene, mit Dreiecken gepunktete Linie. Es erreicht eine Erwärmung von vier Grad, bevor es sich abflacht. Es ist das Szenario mit den geringsten Kosten für die Gesellschaft. Der Temperaturanstieg ist höher, als der IPCC empfiehlt, und wesentlich höher als die Beobachtungen vermuten lassen, die wir erreichen werden. Eine Erwärmung um vier Grad ist für Menschen, Tiere und Pflanzen sicherlich nicht gefährlich. Die Temperaturen steigen stärker in den hohen Breiten, nachts und im Winter. Die Veränderungen während des Tages, in den Tropen und im Sommer sind recht gering. Das Leben gedeiht in Gebieten mit sehr hohen Temperaturen, daher ist unsere Wirtschaft das Hauptanliegen, und Nordhaus sagt, dass vier Grad Erwärmung aus wirtschaftlicher Sicht optimal sind. Wie in der rechten Grafik zu sehen ist, sind die prognostizierten Vorteile dieses optimalen Szenarios (in grün) viel höher als die Kosten (in rot dargestellt).

Das rechte Diagramm zeigt die Analyse aller im linken Diagramm dargestellten Szenarien, mit Ausnahme des Szenarios „optimal (alter Damm)“, bei dem ein anderes zukünftiges Schadensszenario verwendet wird. Das „Basis“-Szenario ist das Emissionsszenario des IPCC RCP8.5, bei dem im Wesentlichen kein Versuch der Schadensbegrenzung unternommen wird.

Nordhaus kommt zu seinen Schlussfolgerungen, indem er die „sozialen Kosten der Kohlenstoffdioxid-Emissionen“ analysiert. Wenn eine Kohlenstoffsteuer auf fossile Brennstoffe erhoben wird, steigen die Kosten für diese Brennstoffe und schaden der Wirtschaft. Fossile Brennstoffe werden für die Herstellung oder den Vertrieb von fast allem verwendet, was wir in unserem täglichen Leben nutzen; folglich führt die Einführung der Steuererhöhung dazu, dass die Kosten für alles steigen, was den Verbrauch verringert und unseren Lebensstandard senkt. Wenn jedoch das Worst-Case-Szenario des IPCC zutrifft und seine Analyse der Kosten der Erwärmung zutreffend ist, bringt die Verteuerung fossiler Brennstoffe Vorteile mit sich, da wir weniger davon verbrauchen, weniger CO2 ausstoßen und Kosten aufgrund der globalen Erwärmung vermeiden werden. Die rechte Grafik vergleicht die vom IPCC berechneten Schäden mit den Kosten des Klimawandels für verschiedene CO2-Minderungssteuern zur Begrenzung der Erwärmung in unterschiedlichen Szenarien.

Der IPCC möchte, dass wir die Erwärmung auf 1,5 °C gegenüber der vorindustriellen Ära begrenzen, d. h. gegenüber der Zeit vor 1900 oder dem Ende der Kleinen Eiszeit, als der CO2-Gehalt etwa 280 bis 290 ppm betrug. Doch wie Nordhaus‘ Analyse zeigt, wäre dies eine wirtschaftliche Katastrophe und würde über 50 Billionen Dollar einer Weltwirtschaft von 88 Billionen Dollar kosten. Es würde wahrscheinlich fast jeden verarmen lassen. Selbst eine Begrenzung der Erwärmung auf weniger als zwei Grad in den nächsten 100 Jahren würde zu einer wirtschaftlichen Katastrophe führen. Vergleichen Sie dies mit der IPCC-Schätzung, wonach das weltweite BIP in 60 Jahren nur um 0,2-2 % sinken würde, wenn wir nichts unternehmen.

Nordhaus verwendete für seine Berechnungen das Emissionsszenario RCP 8.5 des IPCC, das sich als unwahrscheinliches Worst-Case-Szenario erwiesen hat und von zahlreichen Forschern diskreditiert wurde. Die anderen, gemäßigteren IPCC-Szenarien sehen wirtschaftlich und aus einer vermeintlich gefährlichen Klimaperspektive viel besser aus [30].

Bjørn Lomborg untersuchte in einem Artikel in der Zeitschrift Technological Forecasting & Social Change die potenziellen Kosten der globalen Erwärmung im Vergleich zu den Kosten einer radikalen Reduzierung der CO2-Emissionen im Jahr 2020 [31]. In einer detaillierten Analyse der Wirtschaftsprognosen von Nordhaus, dem IPCC und anderen kommt Lomborg ebenfalls zu dem Ergebnis, dass sich das globale BIP heute aufgrund des Klimawandels nicht merklich verändert. Bei einer Erwärmung von 1,5°C stellt er eine geringfügige Veränderung des BIP von -0,28% fest, und bei einer Erwärmung von 4°C wird das BIP im Jahr 2100 um 2,9% sinken, wenn wir nichts gegen den Klimawandel unternehmen.

Lomborg weist darauf hin, dass der IPCC bis zum Ende des 21. Jahrhunderts einen Anstieg des menschlichen Wohlstands um 450 % prognostiziert. Die prognostizierten Klimaschäden würden diesen Wohlstandszuwachs auf 434 % reduzieren, wenn wir nichts unternehmen. Somit wird der Klimawandel den Gewinn an globalem Wohlstand im Jahr 2100 voraussichtlich um 4 % verringern.

Lomborg weist weiter darauf hin, dass die Kosten des Nichtstuns gering sind, die Kosten der vorgeschlagenen klimapolitischen Maßnahmen jedoch sehr hoch. Das Pariser Abkommen wird, wenn es vollständig umgesetzt wird, im Jahr 2030 über 800 Milliarden Dollar pro Jahr kosten und die Emissionen nur um 1 % dessen reduzieren, was erforderlich ist, um den durchschnittlichen globalen Temperaturanstieg auf 1,5 °C zu begrenzen. Jeder Dollar, der für Paris ausgegeben wird, bringt nur 11 Cent an Nutzen. Auch das ist kein sehr gutes Geschäft.

Die Öffentlichkeit und die Medien, die eigentlich bohrende Fragen stellen sollten, sind davon überzeugt, dass sie die Wissenschaft nicht verstehen können. Sie haben die Wissenschaft zu einer Form der Magie erhoben, die nur von Hexen und Hexenmeistern verstanden wird. Sie sind darauf beschränkt, von Wissenschaftlern zu verlangen, dass sie sie mit bedeutungslosen Sätzen füttern. Mit ein wenig Mühe können die meisten Laien wissenschaftliche Arbeiten verstehen, und sie sollten es auch versuchen. Es ist nicht akzeptabel, sich darauf zu verlassen, dass Politiker, Wissenschaftler und die Medien uns sagen, was vor sich geht. Wissenschaftler sollten auch mehr für Laien verständliche Texte verfassen, wie es John Tyndall, Svante Arrhenius und viele andere frühe Wissenschaftler taten. Keine kleinen 600-800-Wörter-Op-eds, sondern echte wissenschaftliche Abhandlungen, die für den einfachen Mann geschrieben sind. Die Nachrichtenmedien sind schlecht darin, über Wissenschaft zu schreiben, weil sie oft kein Interesse an der Wahrheit haben, sondern nur Aufmerksamkeit und verblüffende Vorhersagen wollen. Ihr Ziel ist Aufmerksamkeit, nicht Bildung. Deshalb müssen wir es selbst herausfinden. Zu diesem Zweck sollten wir uns an die Worte des großen Physikers Richard Feynman erinnern:

„Wissenschaft ist der Glaube an die Unwissenheit der Experten“.

Prof. Richard Feynman

Die Wissenschaft ist eine Methode zur Aufdeckung der Wahrheit. Sie ist eine über Jahrtausende hinweg verfeinerte Methodik, die eingesetzt werden kann, um zu zerstören, was die Mehrheit für wahr hält, was aber nicht stimmt. Wenn ein Wissenschaftler aufhört, die gängige Meinung in Frage zu stellen, ist er kein Wissenschaftler mehr.

Abschließend möchten wir mit einer letzten Geschichte enden. Steven Koonin berichtet in seinem Buch Unsettled, dass „Senator [Charles] Schumer (zusammen mit den Senatoren Carper, Reed, Van Hollen, Whitehouse, Markey, Schatz, Smith, Blumenthal, Shaheen, Booker, Stabenow, Klobuchar, Hassan, Merkley und Feinstein) den Gesetzentwurf S.729 im Senat einbrachte“, in dem es unter anderem heißt, Zitat:

„… die Verwendung von Geldern für Bundesbehörden zu verbieten, um ein Gremium, eine Arbeitsgruppe, einen beratenden Ausschuss oder andere Bemühungen einzurichten, die den wissenschaftlichen Konsens zum Klimawandel in Frage stellen…“

Senatsvorlage S.729

Ja, diese Senatoren versuchten, mit Hilfe von Forschungsgeldern der Regierung Gesetze gegen die Infragestellung einer unbewiesenen wissenschaftlichen Hypothese, im Grunde einer wissenschaftlichen Meinung, zu erlassen. Viel schlimmer kann es nicht werden. Wissenschaft ist Debatte, und wenn nicht alle Seiten geprüft und argumentiert werden, ist es keine Wissenschaft. Zum Glück ist ihr Versuch gescheitert, denn das Letzte, was wir brauchen, ist, dass der US-Senat über die wissenschaftliche Wahrheit entscheidet!

„Wenn man Politik und Wissenschaft vermischt, kommt nur Politik heraus.“ [32]

Anthony Sadar, Washington Times.

In der Politik geht es darum, durch Überredung und Einschüchterung eine einheitliche Meinung zu schaffen; in der Wissenschaft geht es darum, diesen Konsens in Frage zu stellen. Bei Debatten geht es um Bildung, wir sollten alle Seiten anhören.

Download the footnotes and the bibliography here.

This talk is mostly drawn from my latest book, Politics & Climate Change: A History

- Politics and Climate Change: A History, by Andy May ↑

- (Government Accounting Office, 2018) ↑

- William Shockley, Bell Labs ↑

- John Blanknbaker, Kenbak Corp. ↑

- Joseph Nicephore Niepce, French inventor ↑

- Either Alexander Bell or Antonio Meucci ↑

- Karl Benz ↑

- Wright Brothers ↑

- Richard Gurley Drew, 3M ↑

- Charles Francis Jenkins, Charles Jenkins Laboratories ↑

- Roy Plunkett, DuPont ↑

- George de Mestral, Swiss engineer ↑

- Felix Hoffman, Bayer ↑

- Julius Oppenheimer, Manhatten project ↑

- Walter Dornberger and Wernher von Braun ↑

- Mikhail Timofeyevich Kalashnikov, Soviet and Russian army general ↑

- Shi, Wuhan Institute of virology, see Viral, by Aline Chan and Matt Ridley ↑

- Various manufacturers under contract to the U.S. Government. ↑

- (Ridley, 2015) ↑

- (Schow, 2019) ↑

- (Ridley, 2015) ↑

- (Gallucci, 2018) ↑

- (Happer, 2003) ↑

- (Easterbrook, 1992) ↑

- (Geyer, 1993) ↑

- (Singer, 2003), Chapter 11 in Politicizing Science by Michael Gough ↑

- (Lancaster, 2006), Lancaster “fully rescind and repudiate my 1994 retraction” ↑

- (Yale University, n.d.) ↑

- (The Nobel Prize, 2018) ↑

- Wang and colleagues (Wang, Feng, Tang, Bentley, & Höök, 2017), (Ritchie & Dowlatabadi, 2017) and (Burgess, Ritchie, Shapland, & Pielke Jr., 2020) ↑

- (Lomborg, 2020) ↑

- (Sadar, 2022) ↑

Link: https://andymaypetrophysicist.com/2022/01/21/should-government-control-scientific-research/

Übersetzt von Christian Freuer für das EIKE