Hinein in die Blackbox

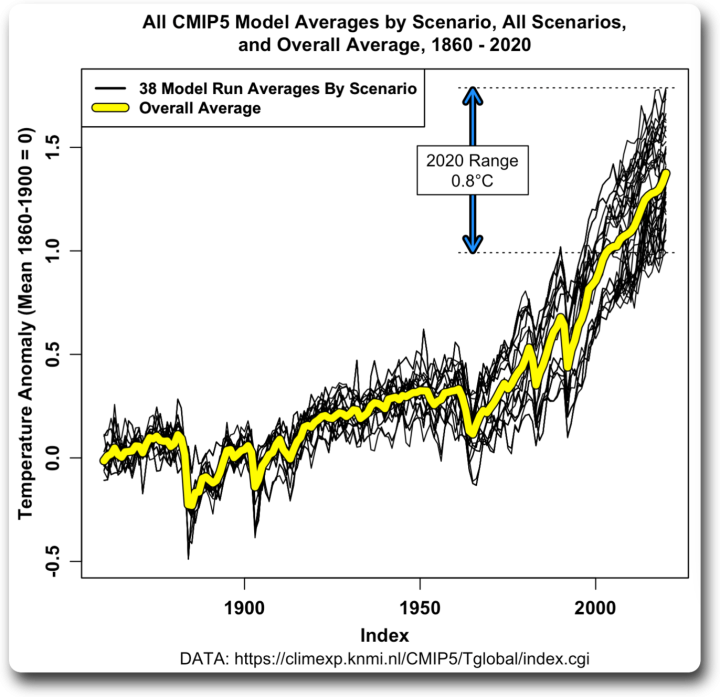

Durch eine für mich typische Reihe von Missverständnissen und Zufällen bin ich dazu gekommen, mir die durchschnittlichen Modellergebnisse des Climate Model Intercomparison Project 5 (CMIP5) anzusehen. Ich habe die Durchschnittswerte der einzelnen Modelle für jedes der vier Szenarien verwendet, insgesamt also 38 Ergebnisse. Der gemeinsame Zeitraum für diese Ergebnisse ist 1860 bis 2100 oder eine ähnliche Zahl. Ich habe die Ergebnisse von 1860 bis 2020 verwendet, damit ich sehen konnte, wie die Modelle abschneiden, ohne eine imaginäre Zukunft zu betrachten. Die CMIP5-Analyse wurde vor ein paar Jahren durchgeführt, so dass für alle Jahre bis 2012 aktuelle Daten vorlagen. Die 163 Jahre von 1860 bis 2012 waren also eine „Nachhersage“ unter Verwendung tatsächlicher Treibhausdaten, und die acht Jahre von 2013 bis 2020 waren Prognosen.

An Abbildung 1 waren für mich mehrere Dinge interessant. Erstens die große Spanne. Ausgehend von einer gemeinsamen Basislinie reichten die Modellergebnisse bis 2020 von einer Erwärmung von 1°C bis zu einer Erwärmung von 1,8°C…

In Anbetracht dieser schrecklichen Temperaturstreuung zwischen den Modellen in einem Hindcast bis 2012 plus acht Jahre Vorhersage, warum sollte jemand den Modellen für das Jahr 2100 vertrauen?

Die andere Sache, die mich interessierte, war die gelbe Linie, die mich an meinen Beitrag mit dem Titel [übersetzt] „Das Leben ist wie eine schwarze Schachtel Pralinen“ erinnerte. In diesem Beitrag habe ich die Idee einer „Black Box“-Analyse erörtert. Das Grundkonzept besteht darin, dass man eine Blackbox mit Eingängen und Ausgängen hat und die Aufgabe darin besteht, ein einfaches oder komplexes Verfahren zu finden, um den Eingang in den Ausgang zu verwandeln. Im vorliegenden Fall ist die „Black Box“ ein Klimamodell, die Eingaben sind die jährlichen „Strahlungsantriebe“ durch Aerosole, CO2, Vulkane und dergleichen, und die Ausgaben sind die jährlichen globalen Durchschnittstemperaturwerte.

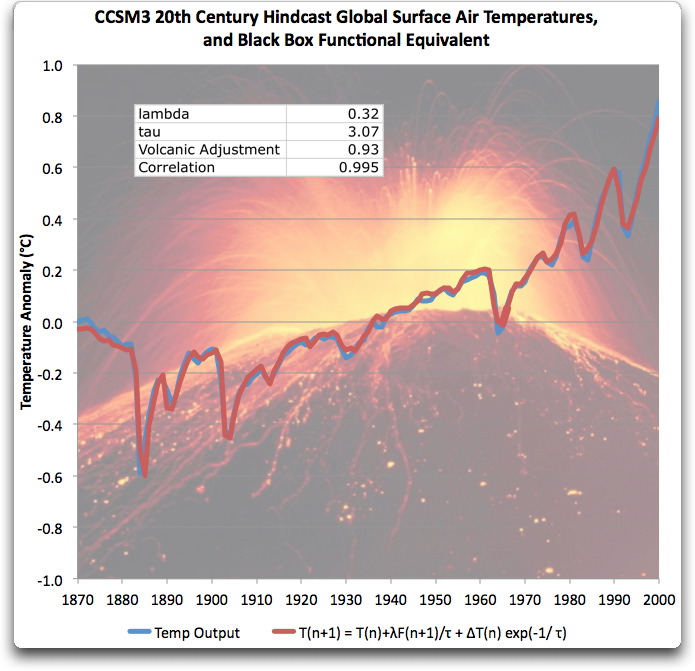

Im gleichen Beitrag wird auch gezeigt, dass die Ergebnisse des Modells extrem genau nachgebildet werden können, indem die Eingaben einfach verzögert und neu skaliert werden. Hier ein Beispiel aus dem Beitrag, wie gut das funktioniert:

Abbildung 2. Original Bildunterschrift: „Funktionale Äquivalenzgleichung des CCSM3-Modells, verglichen mit der tatsächlichen CCSM3-Ausgabe. Die beiden sind fast identisch.“

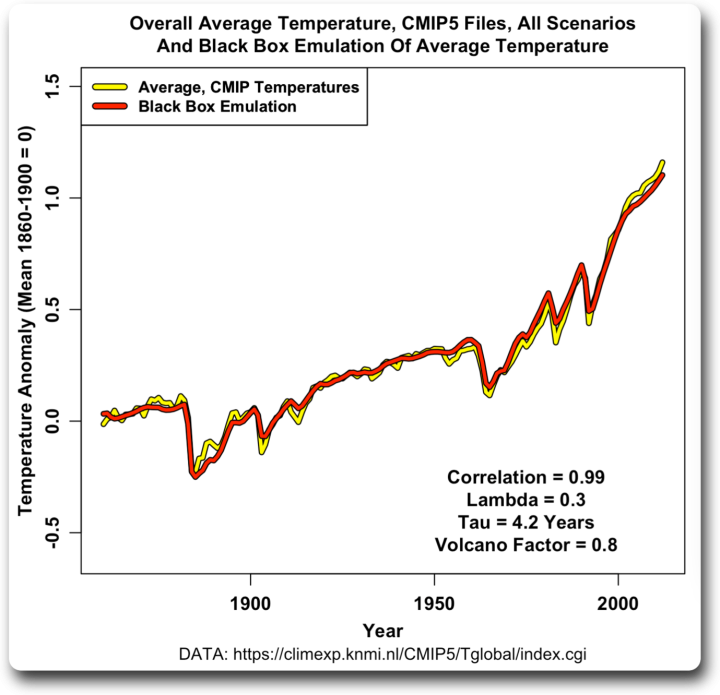

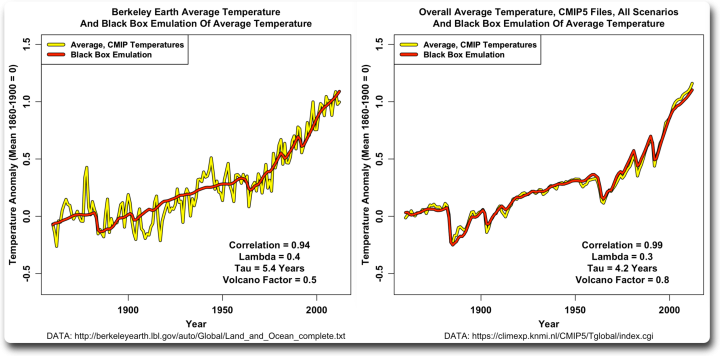

Ich besorgte mir also eine Reihe von CMIP5-Forcings und verwendete sie, um den Durchschnitt der CMIP5-Modelle zu emulieren (Links zu den Modellen und Forcings in den technischen Anmerkungen am Ende). Abbildung 3 zeigt das Ergebnis:

Abbildung 3. Durchschnitt der CMIP5-Dateien wie in Abbildung 1, zusammen mit der Black-Box-Emulation.

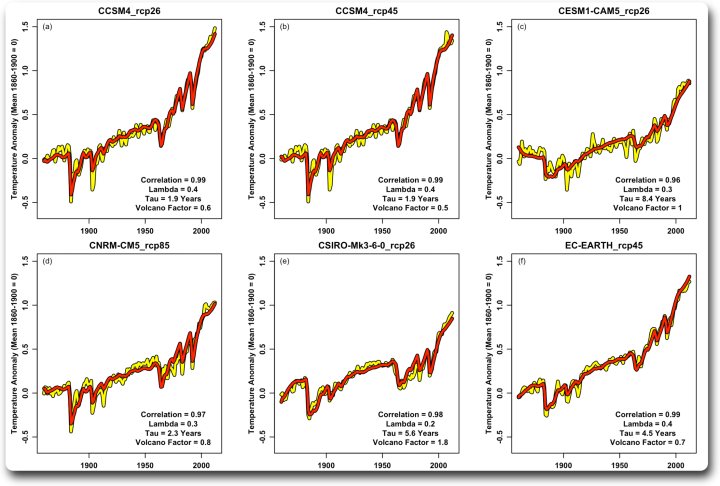

Auch hier ist die Übereinstimmung sehr gut. Nachdem ich das gesehen habe, wollte ich mir einige Einzelergebnisse ansehen. Hier ist der erste Satz:

Ein interessanter Aspekt dabei ist die Variation des Vulkanfaktors. Die Modelle scheinen mit dem Antrieb durch kurzfristige Ereignisse wie Vulkane anders umzugehen als mit dem allmählichen Anstieg des Gesamtantriebs. Und die einzelnen Modelle unterscheiden sich voneinander, wobei der Faktor in dieser Gruppe von 0,5 (halber vulkanischer Faktor) bis 1,8 (80 % zusätzlicher vulkanischer Faktor) reicht. Die Korrelationen sind alle recht hoch und reichen von 0,96 bis 0,99. Hier ist eine zweite Gruppe:

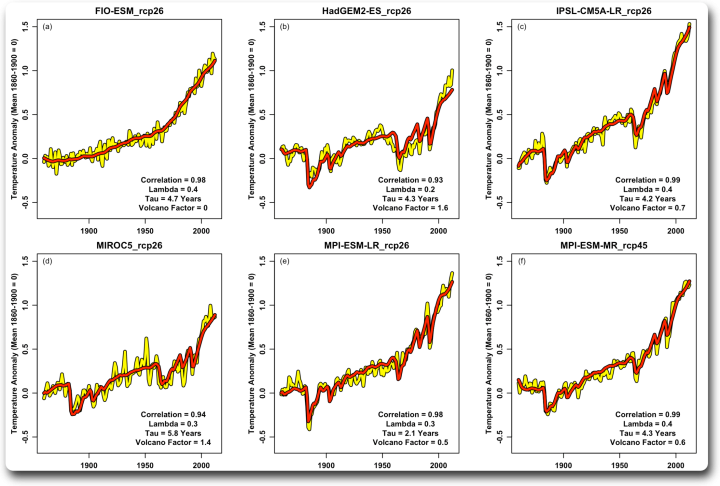

Panel (a) oben links ist insofern interessant, als dass die Vulkane offensichtlich nicht in den Antrieb für dieses Modell einbezogen wurden. Infolgedessen ist der Faktor für den vulkanischen Antrieb gleich Null … und die Korrelation beträgt immer noch 0,98.

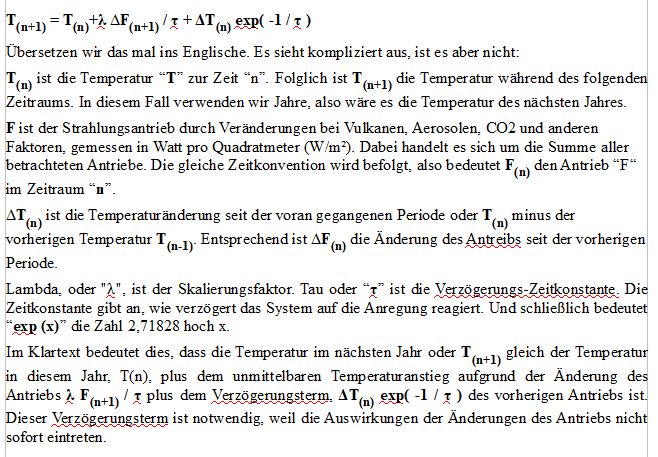

Dies zeigt, dass trotz der unglaublichen Komplexität und der Tausenden und Abertausenden von Codezeilen und der 20.000 2D-Gitterzellen mal 60 Schichten gleich 1,2 Millionen 3D-Gitterzellen … die Ergebnisse in einer einzigen Codezeile nachgebildet werden können, und zwar:

[Die Hoch- und Tiefstellungen in den folgenden Abschnitten lassen sich in den eingeschränkten Möglichkeiten des Editors nicht abbilden. Daher sind diese Absätze hier in einer Graphik-Darstellung zusammen gefasst. A. d. Übers.]

Seltsam, nicht wahr? Millionen von Gitterzellen, Hunderttausende von Codezeilen, ein Supercomputer, der sie verarbeitet … und es stellt sich heraus, dass die Ausgabe nichts anderes ist als eine verzögerte (tau) und neu skalierte (lambda) Version der Eingabe.

Nachdem ich das gesehen hatte, dachte ich, ich wende das gleiche Verfahren auf die aktuellen Temperaturdaten an. Ich habe den Berkeley Earth Datensatz für die globale durchschnittliche Temperatur verwendet, obwohl die Ergebnisse bei Verwendung anderer Temperaturdatensätze sehr ähnlich sind. Abbildung 6 zeigt das Ergebnis:

Abbildung 6. Die Temperaturaufzeichnung von Berkeley Earth und die Emulation unter Verwendung der gleichen Antriebsfaktoren wie in den vorherigen Abbildungen. Zum Vergleich habe ich Abbildung 3 auf der rechten Seite eingefügt.

Es zeigt sich, dass der Modelldurchschnitt viel empfindlicher auf den vulkanischen Antrieb reagiert und eine kürzere Zeitkonstante tau hat. Und da es sich bei der Erde um ein einzelnes Beispiel und nicht um einen Durchschnitt handelt, enthält sie natürlich viel mehr Schwankungen und hat daher eine etwas geringere Korrelation mit der Emulation (0,94 gegenüber 0,99).

Zeigt dies also, dass die Einflüsse tatsächlich die Temperatur bestimmen? Nun … nein, aus einem einfachen Grund. Die Treibhausgase wurden im Laufe der Jahre so ausgewählt und verfeinert, dass sie gut zur Temperatur passen … die Tatsache, dass sie passen, hat also keinerlei Aussagekraft.

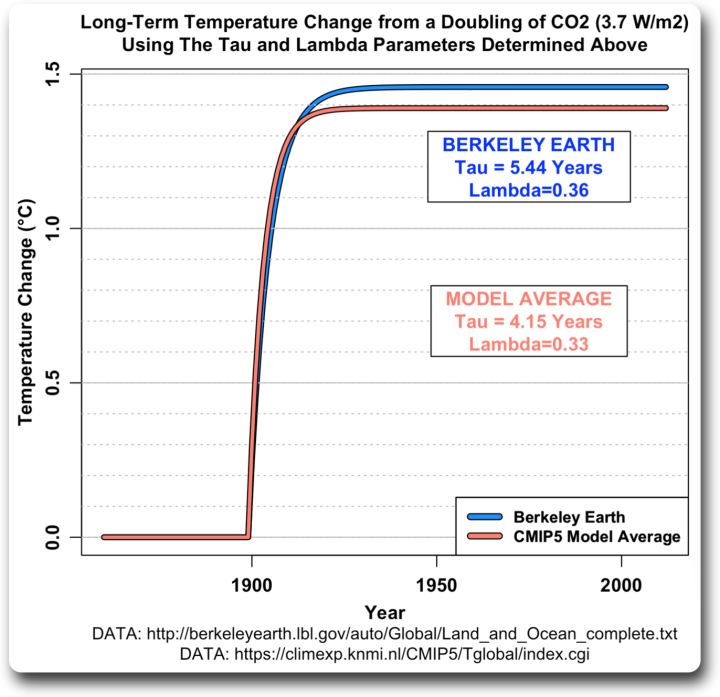

Eine letzte Sache, die wir tun können. FALLS die Temperatur tatsächlich ein Ergebnis der Treibhausgase ist, können wir die oben genannten Faktoren verwenden, um die langfristigen Auswirkungen einer plötzlichen Verdopplung des CO2 zu schätzen. Der IPCC sagt, dass dies den Treibhauseffekt um 3,7 Watt pro Quadratmeter (W/m²) erhöhen wird. Wir verwenden einfach eine Stufenfunktion für den Treibhauseffekt mit einem Sprung von 3,7 W/m² zu einem bestimmten Zeitpunkt. Hier ist das Ergebnis, mit einem Sprung von 3,7 W/m² im Modelljahr 1900:

Abbildung 7. Langfristige Temperaturveränderung bei einer Verdoppelung des CO2-Ausstoßes unter Verwendung von 3,7 W/m² als Anstieg des Antriebs und berechnet mit den Lambda- und Tau-Werten für die Berkeley Earth und den CMIP5-Modelldurchschnitt wie in Abbildung 6 gezeigt.

Man beachte, dass die reale Erde (blaue Linie) mit der größeren Zeitkonstante Tau länger braucht, um das Gleichgewicht zu erreichen, etwa 40 Jahre, als wenn man den Durchschnittswert des CMIP5-Modells verwendet. Und da die reale Erde einen größeren Skalenfaktor Lambda hat, ist das Endergebnis etwas größer.

Ist dies also die geheimnisvolle Gleichgewichts-Klimasensitivität (ECS), über die wir so viel gelesen haben? Kommt darauf an. FALLS die Werte für den Treibhauseffekt genau sind und FALLS der Treibhauseffekt die Temperatur beeinflusst … dann sind sie vielleicht richtig.

Oder auch nicht. Das Klima ist ungeheuer komplex. Was ich bescheiden „Willis‘ erstes Klimagesetz“ nenne, besagt:

Alles im Klima ist mit allem anderen verbunden … was wiederum mit allem anderen verbunden ist … außer wenn dem nicht so ist.

Im Original folgen jetzt noch diverse technische Angaben, die in dieser Übersetzung nicht genannt werden.

Link: https://wattsupwiththat.com/2022/02/03/into-the-black-box/

Übersetzt von Christian Freuer für das EIKE