Energiepolitik der Westlichen Welt: Geleitet von einem Ozean der Ignoranz

Vor ein paar Jahren diskutierte ich mit einem Bekannten über die Auswirkungen der Dürre auf einige kanadische Anbaugebiete. Der Mann hatte keinerlei landwirtschaftliche Erfahrung, was nicht sonderlich ungewöhnlich ist, ebenso wie die oft damit einhergehende unzusammenhängende Sicht auf die Dinge, wie sie wirklich funktionieren. Nachdem er eine Minute lang über die Verwüstung der Ernte nachgedacht hatte, fragte er: „Könnte man nicht einfach einen Bewässerungsschlauch benutzen?“

Der Mann war kein besonders großer Idiot; er war einfach nur isoliert und hatte keine Ahnung, wie unpraktisch und unplausibel diese Idee war. Wenn man ihn nicht gerade mit dem Hubschrauber in die Mitte eines 640 Hektar großen Feldes fliegt, ist es schwer, die Realität der Situation angemessen zu beschreiben.

Wir alle können uns in die Lage dieser Person versetzen, wenn wir eine Lösung für etwas wagen, von dem wir keine Ahnung haben. Wenn ein Chirurg auf ein verfahrenstechnisches Problem bei der Arbeit hinweist, bezweifle ich stark, dass meine Vorschläge für „Wissen-ohne-Kettensägen-sind-Wunder-Werkzeuge“ eine große Hilfe wären.

Das ist nur eine Kuriosität des menschlichen Diskurses und selten mehr als eine Belustigung. Aber nicht in der Energiewelt. Die Gartenschlauch-Denker haben sich ihren Weg an den Entscheidungstisch gebahnt.

Im Januar schickte eine Gruppe von 400 „Wissenschaftlern, Akademikern und Modellierern von Energiesystemen“ einen Brief an die Bundeskabinettsminister Freeland, Wilkinson und Guilbealt (klingt nach einer furchteinflößenden Anwaltskanzlei), in dem sie die [kanadische] Bundesregierung aufforderten, keine Steuergutschrift für die Kohlenstoffabscheidung und -speicherung zu gewähren, wenn dieses Verfahren zur Verbesserung der Erdölförderung (CCUS) eingesetzt wird.

Das ist eine merkwürdige Haltung, denn ein Grundprinzip der Technik (und des gesunden Menschenverstandes) besagt, dass Effizienzgewinne mit doppeltem Verwendungszweck die am niedrigsten hängenden Früchte sind, die es gibt. Da die Welt ohnehin das ganze Öl verbrennen wird, ist es absolut sinnvoll, dort anzusetzen und diese Infrastruktur zu nutzen, wo immer es möglich ist.

Nicht jedoch für die 400 Personen, die sich selbst für besser geeignet halten, das Problem zu lösen. (Unter den Unterzeichnern, von denen wir technische Ratschläge annehmen sollten, befinden sich Dutzende von Politikern; Dutzende von Soziologen; Professoren für Filmwissenschaft, Asienwissenschaft, Religionswissenschaft, Geschichte, Rechnungswesen, Englisch, Kunstgeschichte, Philosophie … so ziemlich jede sozialwissenschaftliche Disziplin, die man sich vorstellen kann). Sie alle haben sich als Experten für CCUS bezeichnet. Sie alle sagen der Regierung gemeinsam: „Hören Sie nicht auf den Lockvogel, ein Wasserschlauch wird schon reichen.“

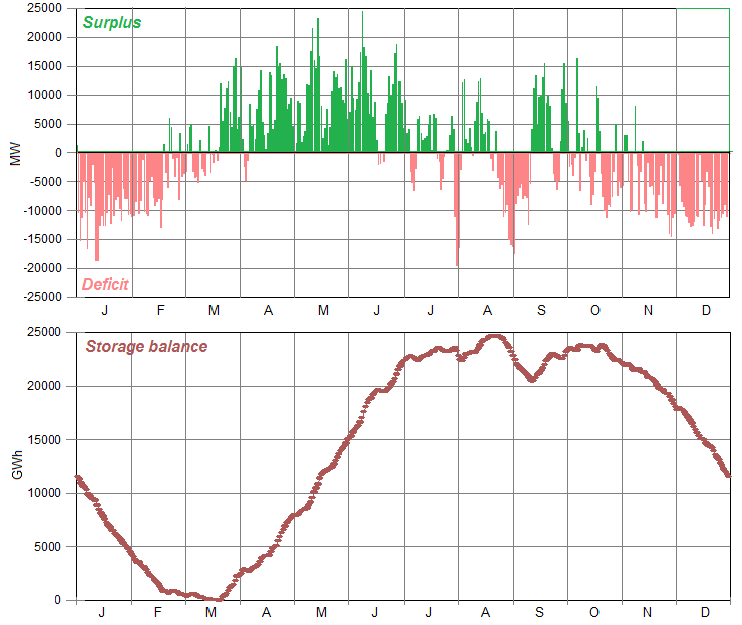

Nehmen wir eine ihrer Beschwerden: „Der Aufbau der CCUS-Infrastruktur würde ein riesiges System von Pipelines zum Transport des Kohlenstoffs erfordern.“ Dies ist einer der wenigen Punkte, die sie in ihrem Geflecht aus umständlichen und unsinnigen Peer-Reviews nicht anführen, weil diese Welt für sie nicht existiert. Kohlenwasserstoffe werden in Zukunft einfach aus der Gleichung gestrichen. Die Gruppe fordert die Bundesbehörden auf, stattdessen „eine verstärkte Elektrifizierung, eine weitreichende Nutzung erneuerbarer Energien und eine Steigerung der Energieeffizienz“ anzustreben.

Gegen eine Steigerung der Energieeffizienz ist nichts einzuwenden, aber wie sieht es mit dem Ersatz von Kohlenwasserstoffen durch den groß angelegten Einsatz erneuerbarer Energien aus (ihre Ersatzlogik, nicht meine)? Wie bei den Landwirten wird auch hier mit dem Gartenschlauch argumentiert, aber lassen Sie uns hören, was andere, die sich für Funktionalität interessieren, zu sagen haben.

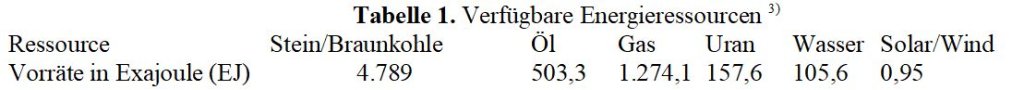

Die IEA, die unter bestimmten Umständen immer noch nicht in der Lage ist, bestimmte Wahrheiten zu vermeiden, wies letztes Jahr in einem Bericht darauf hin, dass die Beibehaltung eines globalen Temperaturanstiegs von unter 2 Grad bis 2040 eine Vervierfachung des Mineralienbedarfs bzw. der neuen Minen und das Erreichen des Netto-Null-Zustands bis 2050 eine Versechsfachung bedeuten würde.

Falls das lächerlich klingt, dann deshalb, weil es so ist und nicht passieren wird. Einem anderen Artikel von Ingenieuren zufolge würde eine vollständige Energiewende „nicht nur die bestehenden und geplanten Produktionskapazitäten [für Kupfer, Nickel, Graphit, Lithium und andere], sondern auch die bekannten weltweiten Reserven dieser Mineralien übersteigen“.

Und das ist der theoretische Teil. Hier ist der tatsächliche Blick aus der Praxis: Unabhängig von den Reserven wird es immer schwieriger, sie abzubauen.

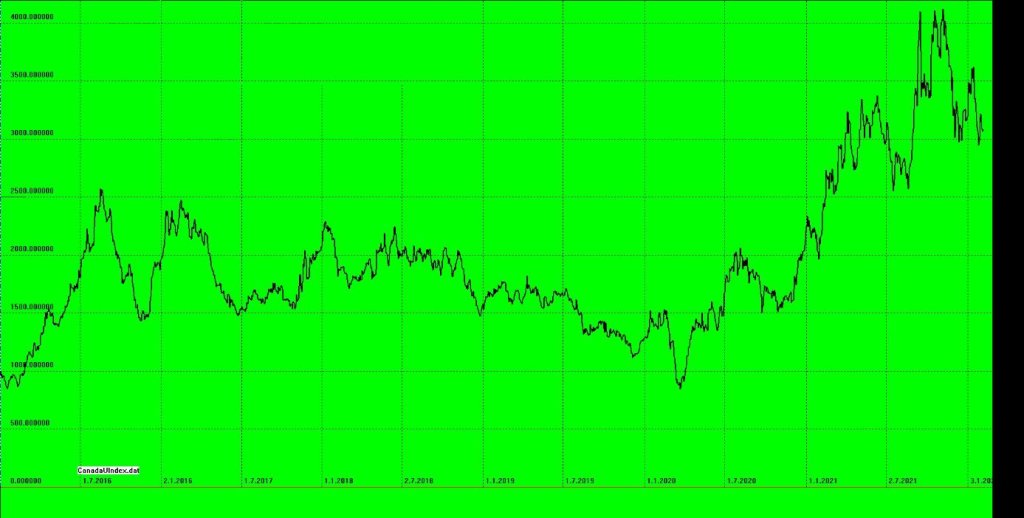

Vor ein paar Wochen sagte der Direktor des Bergbaugiganten Freeport-McMoRan in einer Telefonkonferenz zum Jahresende: „Wir stellen eine zunehmende Verknappung des Angebots fest, während die Nachfrage so stark steigt. Es gibt eine begrenzte Anzahl von Projekten, die seit einiger Zeit entwickelt werden… darüber hinaus ist es schwierig, umsetzbare Projekte zu finden, die innerhalb eines sehr kurzen Zeitraums entwickelt werden können… es gibt weltweit zunehmende politische Risiken, die sich auf die Entwicklung des Kupferangebots auswirken werden. Vor allem in Chile und Peru, wo 40 % des weltweiten Kupfers herkommen, gibt es neue Präsidenten, deren Agenda auf Sozialprogramme ausgerichtet ist… Sie sehen dies in Ländern wie den Vereinigten Staaten, Sie sehen andere Länder, die die Entwicklung neuer Angebote aus sozialen Gründen einschränken… von Asien über Mittelamerika bis nach Afrika. All diese Dinge führen zu Lieferengpässen.“

Als Referenz – und das war für mich als Bergbau-Laie hilfreich – hat die jüngste Mine von F-M in Indonesien, für die das Unternehmen vor 20 Jahren mit den Investitionen begonnen hat, mehr als 350 Meilen Tunnel, sieben Meilen unterirdische Gleise zur Beschickung riesiger Brecher und fünf Meilen Förderbänder. Deshalb dauert es 20 Jahre, bis die Minen in Betrieb genommen werden können, und diese Zeitspanne wird sich noch verlängern, da es aufgrund von Vorschriften immer schwieriger wird, sie überhaupt in Betrieb zu nehmen.

Es gibt natürlich keine Garantie dafür, dass Trudeau/Guilbealt/Wilkinson/Freeland auf die 400-köpfige Gruppe hören werden, aber es gibt keinen Grund zu der Annahme, dass sie es nicht tun werden. Die westlichen Staats- und Regierungschefs haben sich mit ideologischen Klonen umgeben, die für diese Aufgabe ungeeignet sind und denen es an jeglicher Erfahrung mit dem Betrieb eines Energiesystems fehlt.

Über das europäische Energiefiasko muss kaum noch diskutiert werden, und das Erstaunlichste daran ist, dass viele dieser gescheiterten Energiegeneräle auf die hohen Erdgaskosten als Grund für den beschleunigten Ausbau der erneuerbaren Energien verweisen. Das ist genau die gleiche Lösung wie der Typ, der vorschlug, Quadratkilometer große Felder mit einem oder zwei Gartenschläuchen zu bewässern.

Die Demenz reicht bis hierher. Biden sucht auf der ganzen Welt nach Erdgaslieferungen für Europa für den Fall, dass Russland in die Ukraine einmarschiert, während seine Günstlinge zu Hause alles tun, um die Kohlenwasserstoffindustrie zugunsten erneuerbarer Energien zu schwächen.

Es kursieren Gerüchte (auf der Grundlage von Diskussionspapieren der US-Regierung), wonach Bidens Regierung die Mineralölsteuersätze um 50 Prozent anheben will (ein Sprecher des Weißen Hauses spielte den Bericht herunter und bezeichnete die Erhöhung als „vorbereitende Entwurfssprache“).

Die USA sind heute einer der größten Erdgasexporteure der Welt (zumindest vorübergehend), eine Welt, die ohne Frage verzweifelt nach mehr Erdgas sucht, und Bidens neue Energieexperten scheinen zu glauben, dass die Erschwerung der Förderung eine logische Karte ist, die sie ausspielen können, während ihr Chef unter jedem Stein der Welt nach mehr Angebot sucht.

Die gefährliche, vom Kurs abweichende Denkweise, die vielen dieser Entscheidungen zugrunde liegt, besteht in dem auf grundlegender Unkenntnis beruhenden Glauben, dass sich die Energiewende schnell vollzieht. So gibt es Heerscharen von Menschen, die sich selbst zu „Energieexperten“ erklären, weil sie jeden Aspekt der erneuerbaren Energien in der Annahme studieren, dass dies die ganze Geschichte sein wird.

Es versteht sich von selbst, dass es Tausende von Start-up-Unternehmen gibt, die jede erdenkliche neue saubere Technologie ausprobieren, und einige werden funktionieren, aber die meisten bringen uns direkt zurück zum kritischen Problem des Mineralienmangels, wie ein Krater, der nicht umschifft werden kann.

Wie kann man einer Analyse vertrauen, die sich weigert, das derzeitige Kohlenwasserstoffsystem zu integrieren, das 80 Prozent des weltweiten Energiebedarfs deckt? Jeder vernünftige Plan würde damit als Grundlage beginnen und Dinge wie CCUS als relativ leicht zu erreichende Meilensteine einbeziehen (und ich habe auch keine Ahnung, ob CCUS in großem Maßstab wirtschaftlich ist; ich weiß nur, dass die „Dekarbonisierung“ sowohl in wirtschaftlicher Hinsicht als auch in Bezug auf den Lebensstandard unverschämt teuer sein wird; wenn sie also stattfinden soll, stimme ich für CCUS als so vernünftig wie möglich).

Darüber hinaus kann man trotz mehrerer Jahrzehnte und Billionen von Ausgaben leicht argumentieren, dass es bisher überhaupt keine Energiewende gibt – 80 Prozent des weltweiten Energiebedarfs wurden vor 30 Jahren durch Kohlenwasserstoffe gedeckt, und dieser Prozentsatz ist heute fast derselbe. Das ist nicht die Definition einer Energiewende – es ist das Bild eines immer größer werdenden Energieverbrauchskuchens, bei dem die Größe der einzelnen Stücke durch eine Zunahme des Durchmessers und nicht durch eine Zunahme der Proportionen zunimmt.

Es fühlt sich ein wenig seltsam an, auf solch offensichtliche Umstände hinzuweisen, wenn es jeden Tag offensichtlicher wird, dass die Welt nach mehr Kohlenwasserstoffen schreit und nicht nach weniger. Aber solange unsere Regierungen – und die Menschen, die sie wählen – weiterhin in ihrem La-La-Land leben, haben wir die Wahl, zu kapitulieren und sie das gesamte System in den Boden stampfen zu lassen, oder sie mit einem Gartenschlauch ins Weizenfeld zu führen und darauf zu warten, dass das Licht angeht.

Wie sind wir in einen solchen Energie-Sumpf geraten? Finden Sie heraus, wie es dazu kam und wie Sie da wieder herauskommen – holen Sie sich „The End of Fossil Fuel Insanity“[etwa: Das Ende des Wahnsinns der fossilen Brennstoffe] bei Amazon.ca, Indigo.ca, oder Amazon.com. Vielen Dank für die Unterstützung.

Link: https://wattsupwiththat.com/2022/02/12/an-ocean-of-ignorance-guides-western-energy-policy/

Übersetzt von Christian Freuer für das EIKE