…weil man darin die Mittelalterliche Warmzeit verschwinden lässt

Larry Hamlin

[Anmerkung des Übersetzers: Die Ausschnitte aus dem Original-CLINTEL-Report sind hier nur als Graphiken gezeigt. Die Ausschnitte qwerden teilweise kursiv gesetzt darunter übersetzt. – Ende Anmerkung]

Die Climate Intelligence Foundation (CLINTEL) hat bedeutende Fehler in der Zusammenfassung für politische Entscheidungsträger (SPM) des UN IPCC AR6 katalogisiert und diese Fehlerauflistung und Analyse an den IPCC-Vorsitzenden und andere führende Politiker der Welt verteilt, um sie über diese Fehler zu informieren.

Die festgestellten Fehler führen dazu, dass der SPM die Standards objektiver wissenschaftlicher Integrität nicht erfüllt und daher die führenden Politiker der Welt hinsichtlich einer angemessenen Klimapolitik in die Irre führt, indem er fälschlicherweise auf eine „Klimakrise“ hinweist, die in Wirklichkeit gar nicht existiert. Der mit schweren Mängeln behaftete SPM wird „in unangemessener Weise zur Rechtfertigung drastischer sozialer, wirtschaftlicher und menschlicher Veränderungen durch strenge Abmilderung verwendet, während eine umsichtige Anpassung viel angemessener wäre“.

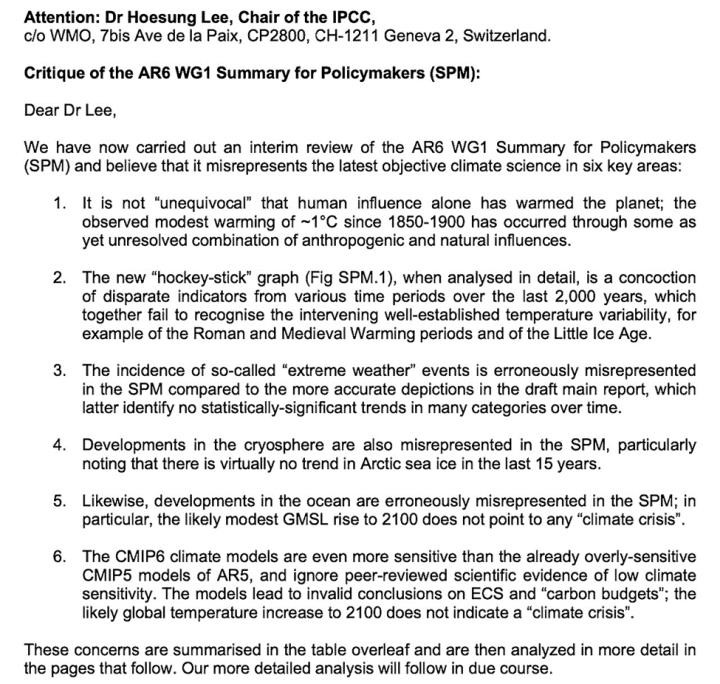

Die wesentlichen Fehler werden im CLINTEL-Bericht wie folgt in sechs Schlüsselbereiche eingeteilt:

1. Es ist nicht „eindeutig“, dass allein der menschliche Einfluss den Planeten erwärmt hat; die beobachtete bescheidene Erwärmung von ~1°C seit 1850-1900 ist durch eine noch Kombination von anthropogenen und natürlichen Einflüssen.

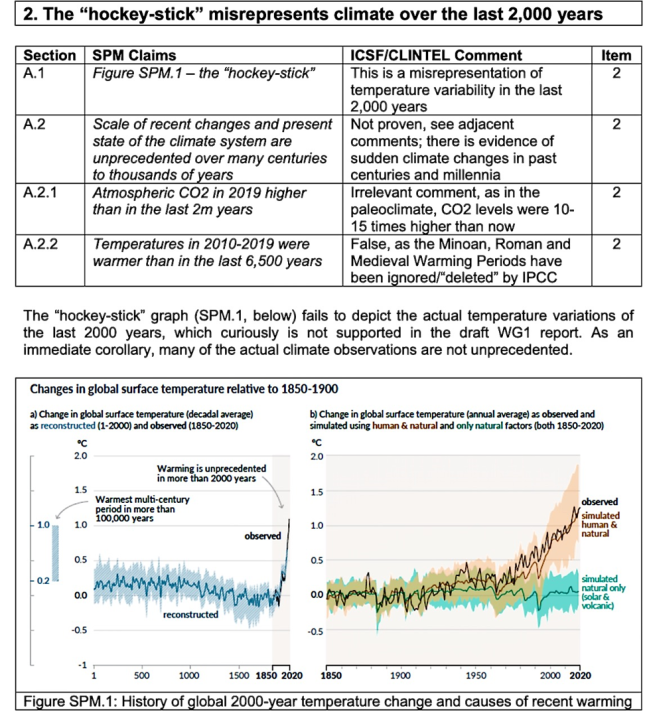

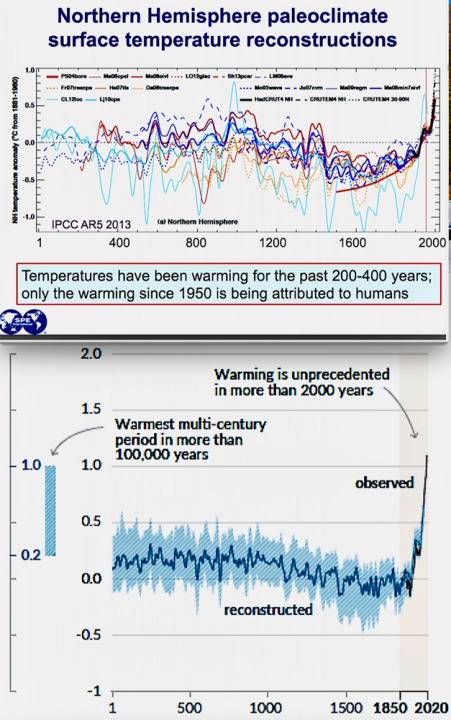

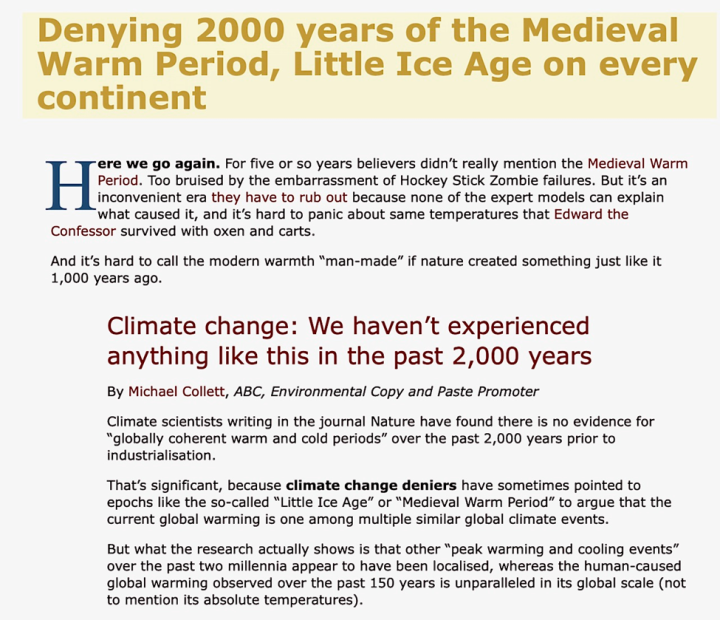

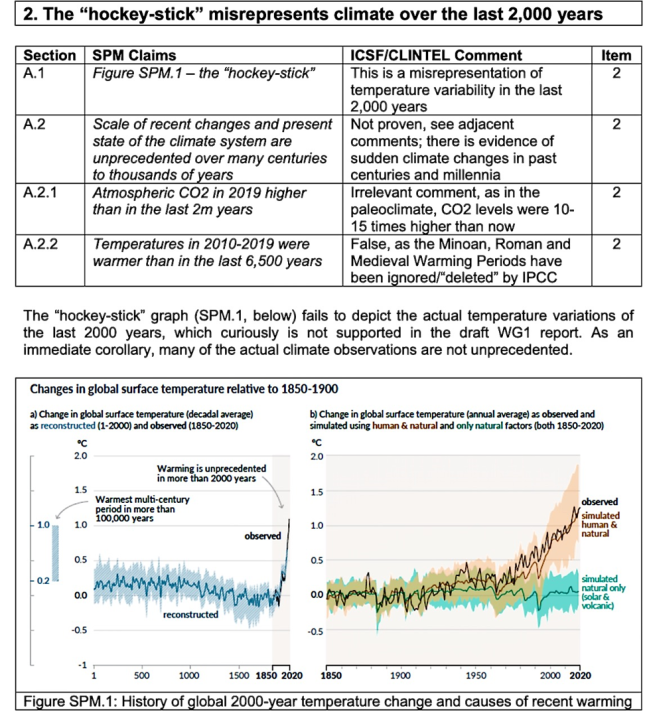

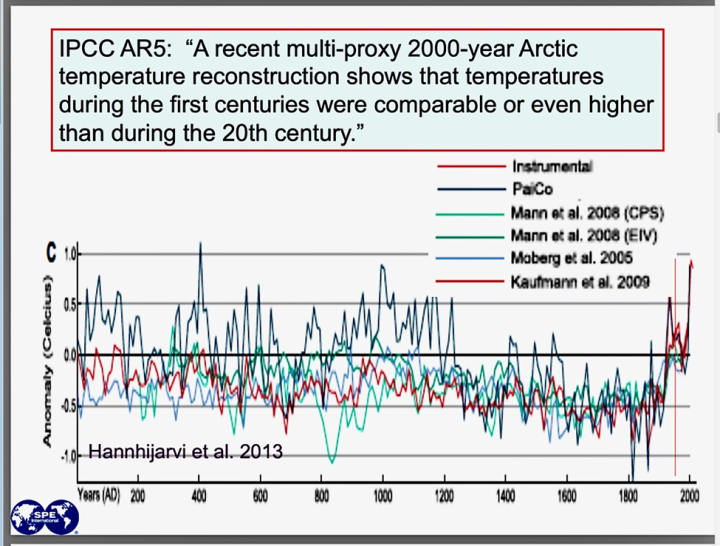

2. Die neue „Hockeyschläger“-Grafik (Abb. SPM.1) ist, wenn man sie im Detail analysiert, ein Sammelsurium von disparaten Indikatoren aus verschiedenen Zeiträumen der letzten 2.000 Jahre, die die zusammen die dazwischen liegende, gut etablierte Temperaturvariabilität nicht erkennen, zum Beispiel die römische und mittelalterliche Warmzeit und die kleine Eiszeit.

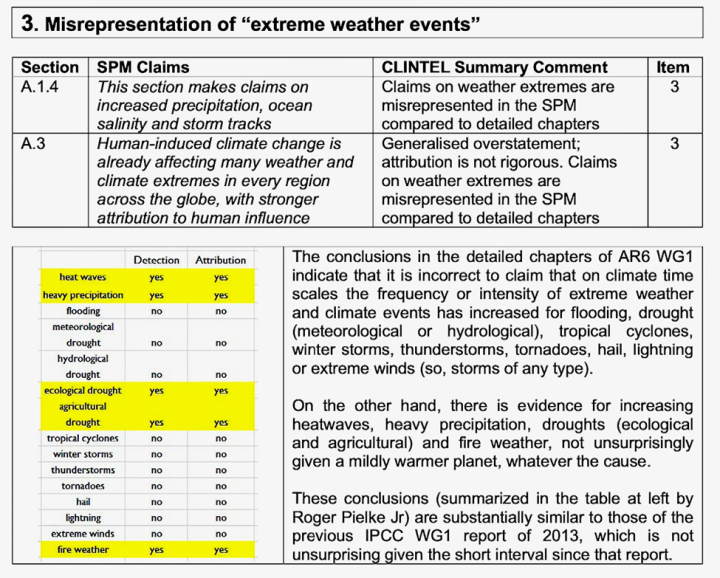

3. Die Häufigkeit sogenannter „extremer Wetterereignisse“ wird im SPM fälschlicherweise falsch dargestellt im Vergleich zu den genaueren Darstellungen im Entwurf des Hauptberichts. Letzterer zeigt in vielen Kategorien keine statistisch signifikanten Trends im Zeitverlauf.

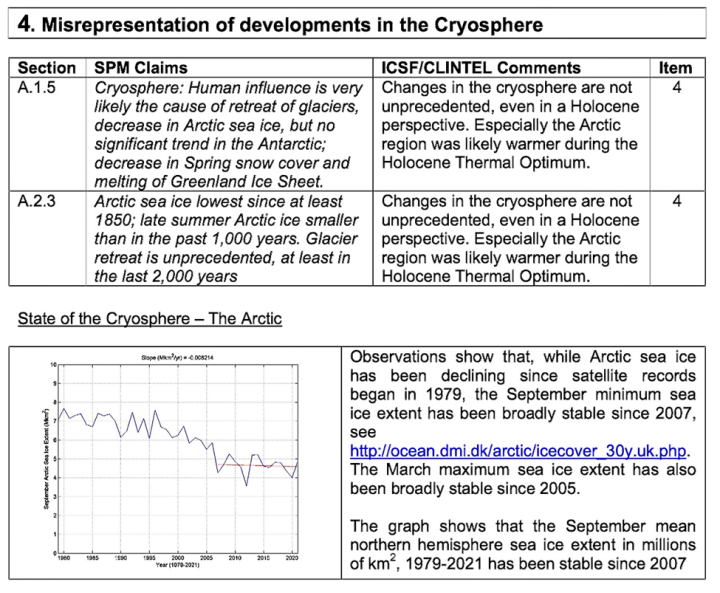

4. Die Entwicklungen in der Kryosphäre werden in der SPM ebenfalls falsch dargestellt, insbesondere dass es praktisch keinen Trend beim arktischen Meereis in den letzten 15 Jahren gibt.

5. Ebenso werden die Entwicklungen im Ozean im SPM fälschlicherweise falsch dargestellt; insbesondere der wahrscheinliche bescheidene Anstieg des GMSL bis 2100 deutet nicht auf eine „Klimakrise“ hin.

6. Die CMIP6-Klimamodelle sind noch empfindlicher als die ohnehin schon überempfindlichen CMIP5-Modelle des AR5 und ignorieren die von Fachleuten überprüften wissenschaftlichen Beweise für eine geringe Empfindlichkeit. Die Modelle führen zu ungültigen Schlussfolgerungen über ECS und „Kohlenstoffbudgets“; der wahrscheinliche globale Temperaturanstieg bis 2100 deutet nicht auf eine „Klimakrise“ hin.

Die Behauptung der SPM, dass allein der menschliche Einfluss den Planeten „eindeutig“ erwärmt hat, ist falsch, da diese Behauptung die natürlichen Klimaeinflüsse ignoriert, einschließlich der Auswirkungen der Sonnenvariabilität, natürlicher Ereignisse wie ENSO, El Niño, La Niña, AMO, PDO usw. sowie der Auswirkungen von geomagnetischen Stürmen, Erdbeben, Tsunamis und Vulkanausbrüchen, zusätzlich zu anderen Bereichen, die im CLINTEL-Bericht angesprochen werden und vom IPCC systematisch ignoriert wurden, wie die nachstehende Zusammenfassung zeigt.

Der IPCC hat sich zur Untermauerung der „eindeutigen“ Behauptung auf statistische Verfahren gestützt, die von den weltbekannten Statistikexperten Dr. Ross McKitrick und Steven McIntyre in Frage gestellt wurden. Diese Anfechtungen müssen von den Befürwortern der IPCC-SPM-Klimaalarmisten weiter geprüft werden.

Diese höchst fragwürdige „eindeutige“ Behauptung kontaminiert alle SPM-Behauptungen in den sechs Schlüsselbereichen der Überprüfung, was sich in der wiederholten Verwendung der fehlerhaften Begriffe „vom Menschen verursacht“, „vom Menschen induziert“ und „vom Menschen beeinflusst“ zeigt.

Ein Teil der CLINTEL-Zusammenfassung, in der die „eindeutige“ SPM-Behauptung zurückgewiesen wird, ist nachstehend wiedergegeben:

Die Tatsache, dass das Mandat der UNFCCC darin besteht, „gefährliche anthropogene Störungen des Klimasystems“ zu bekämpfen, hat die Klimaforschung bedauerlicherweise von [der Erforschung] natürlicher Ursachen abgehalten und jede objektive, umsichtige Analyse verhindert. Es ist bedauerlich, dass es keine detaillierte Analyse der Auswirkungen der Sonnenvariabilität und natürlicher Ereignisse wie ENSO, El Niño, La Niña, AMO, PDO usw., und sogar, wie diese mitkosmischer Strahlung, geomagnetischen geomagnetische Stürme, Erdbeben, Tsunamis, Vulkanausbrüche.

Vor kurzem wurde eine bahnbrechende Arbeit mit dem Titel „How much has the Sun influenced Northern Hemisphere temperature trends? An ongoing debate“ von Ronan Connolly, Willie Soon et al/ (https://doi.org/10.1088/1674-4527/21/6/131). Er kommt zu dem Schluss, dass es nicht eindeutig ist, dass der menschliche Einfluss allein die jüngste Erwärmung verursacht hat; es ist eindeutig, dass sie verursacht wird durch eine noch ungeklärte Kombination aus menschlichem Einfluss und natürlicher Variabilität.

Zusammenfassung: Um zu beurteilen, inwieweit die Gesamtsonneneinstrahlung (Total Solar Irradiance – TSI) die Lufttemperatur der nördlichen Hemisphäre beeinflusst hat, sind zuverlässige Schätzungen für beide Größen erforderlich. Sechzehn verschiedene Schätzungen der Veränderungen der TSI seit mindestens dem 19.Jahrhundert wurden in der Literatur zusammengestellt. Bei der Hälfte dieser Schätzungen handelt es sich um „geringe Variabilität“ und bei der anderen Hälfte um „hohe Variabilität“.

Im CLINTEL-Bericht werden die oben erwähnten Probleme im Zusammenhang mit dem „menschlichen Einfluss“ weiter untersucht und anschließend die statistischen Fehler, die bei der Behauptung der „eindeutigen“ Zuordnung verwendet wurden, wie folgt behandelt:

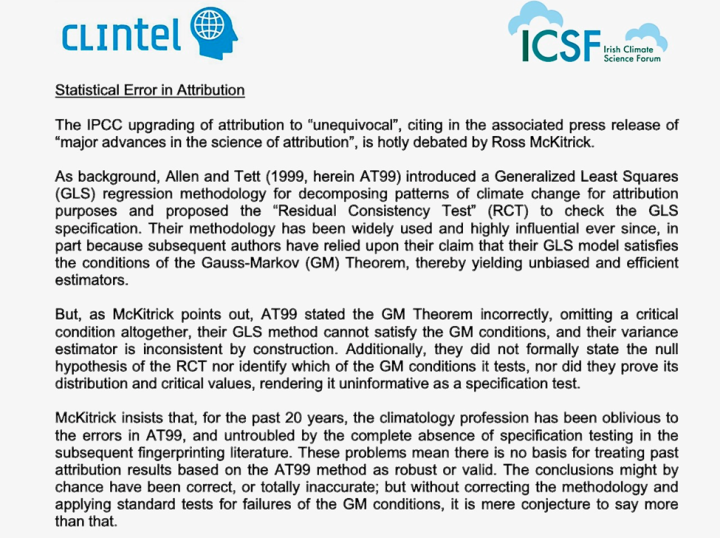

Statistischer Fehler bei der Zurechnung:

Die Höherstufung der IPCC-Attribution auf „eindeutig“, die in der zugehörigen Pressemitteilung mit dem Hinweis auf „wichtige Fortschritte in der Wissenschaft der Attribution“ einher geht, wird von Ross McKitrick heftig diskutiert.

Zum Hintergrund: Allen und Tett (1999, hier AT99) führten eine Generalized Least Squares (GLS)-Regressionsmethode zur Zerlegung von Mustern des Klimawandels für Zuordnungszwecke durch und schlugen den „Residual Consistency Test“ (RCT) zur Überprüfung der GLS Spezifikation vor. Ihre Methodik ist seither weit verbreitet und sehr einflussreich, unter anderem zum Teil, weil sich nachfolgende Autoren auf ihre Behauptung verlassen haben, dass ihr GLS-Modell die Bedingungen des Gauß-Markov-Theorems (GM-Theorem) erfüllt und damit eine unverzerrte und effiziente Schätz-Grundlage liefert.

Doch wie McKitrick betont, hat AT99 das GM-Theorem falsch formuliert und eine kritische Bedingung ganz weggelassen, welche ihre GLS-Methode nicht erfüllen kann, und ihre Schätz-Grundlage der Varianz ist inkonsistent. Außerdem haben sie weder die Nullhypothese der RCT formell dargelegt noch angegeben, welche der GM-Bedingungen sie testet, noch ihre Verteilung und kritische Werte, was ihn als Spezifikationstest uninformativ macht.

McKitrick besteht darauf, dass die Klimatologen in den letzten 20 Jahren die Fehler in AT99 und das völlige Fehlen von Spezifikationstests in der der nachfolgenden Fingerprinting-Literatur nicht bemerkt haben. Diese Probleme bedeuten, dass es keine Grundlage für die Behandlung vergangener Zuordnungsergebnisse, die auf der AT99-Methode basieren, als robust oder gültig zu betrachten. Die Schlussfolgerungen könnten zufällig zufällig richtig oder völlig ungenau gewesen sein; aber ohne Korrektur der Methodik und der Methodik und der Anwendung von Standardtests für das Scheitern der GVO-Bedingungen ist es reine Spekulation, mehr zu sagen als das.

Der CLINTEL-Bericht kommt zu dem Schluss:

„Daher ist die einleitende Aussage im SPM „Es ist eindeutig, dass der menschliche Einfluss die Atmosphäre, die Ozeane und das Land erwärmt hat“ wissenschaftlich nicht haltbar. Darüber hinaus zeugt das Fehlen jeglicher ernsthafter Versuche, andere Erklärungen für den Klimawandel zu untersuchen, von einem Mangel an offenem Denken und Objektivität des IPCC.“

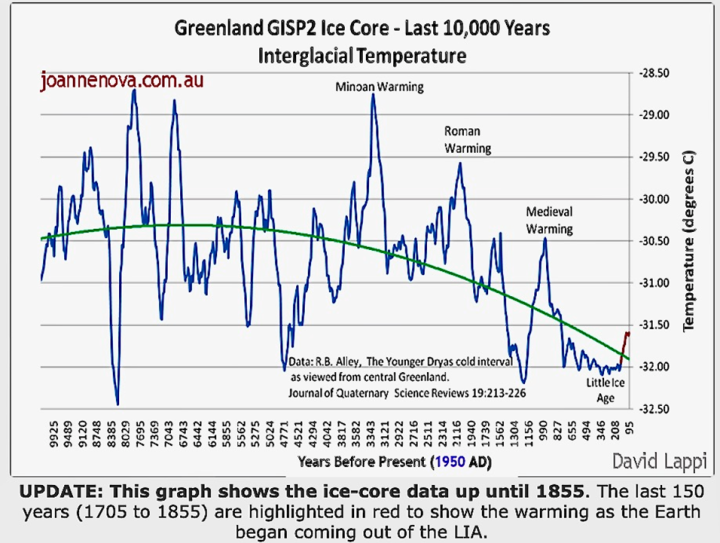

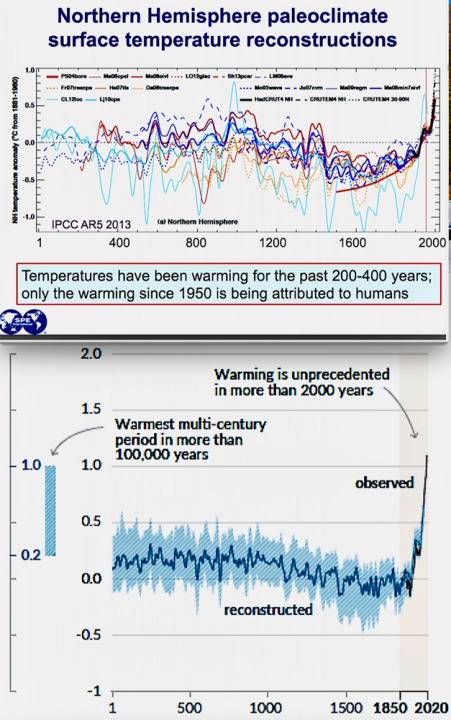

Der AR6 SPM verwendet fehlerhafte Statistiken, um den gefälschten „Hockeyschläger“ noch einmal neu zu erfinden, um die natürlichen Temperaturschwankungen der letzten 2.000 Jahre zu verbergen, wie im CLINTEL-Bericht festgestellt wurde, der den vollständigen Ausschluss der umfangreichen und gut etablierten, von Fachleuten geprüften, nachgewiesenen Daten und Studien der mittelalterlichen Warmzeit feststellt und auch die Daten und Studien der minoischen und römischen Warmzeit ignoriert.

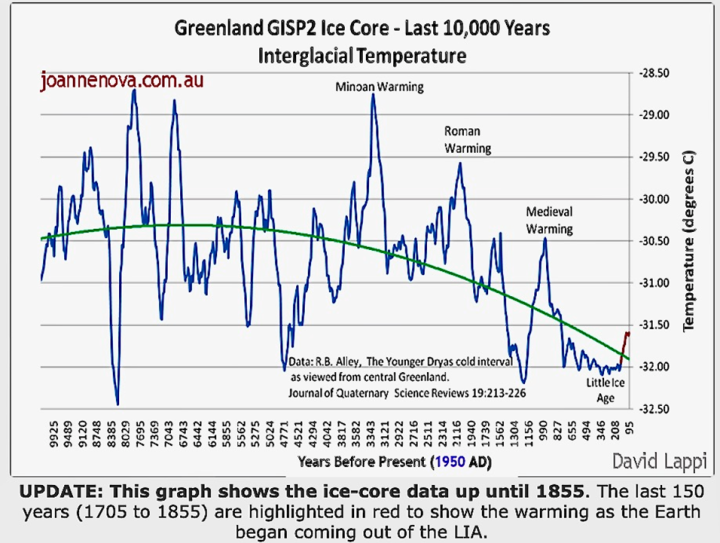

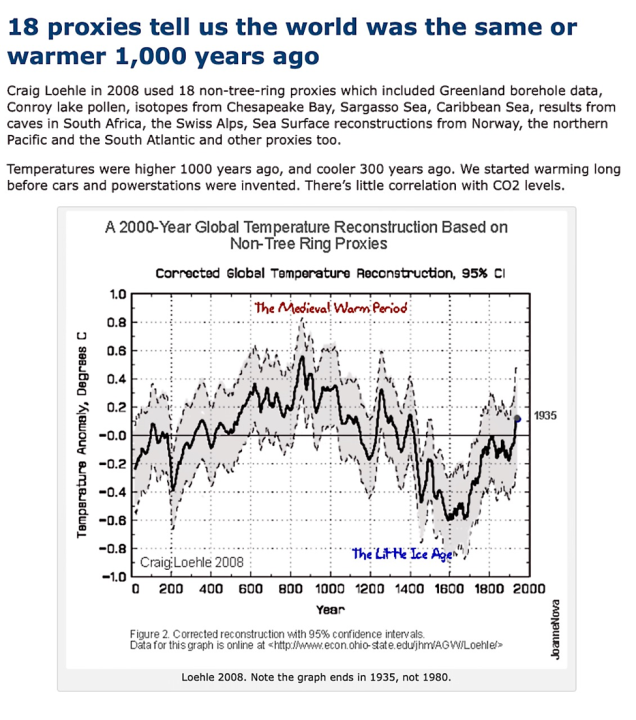

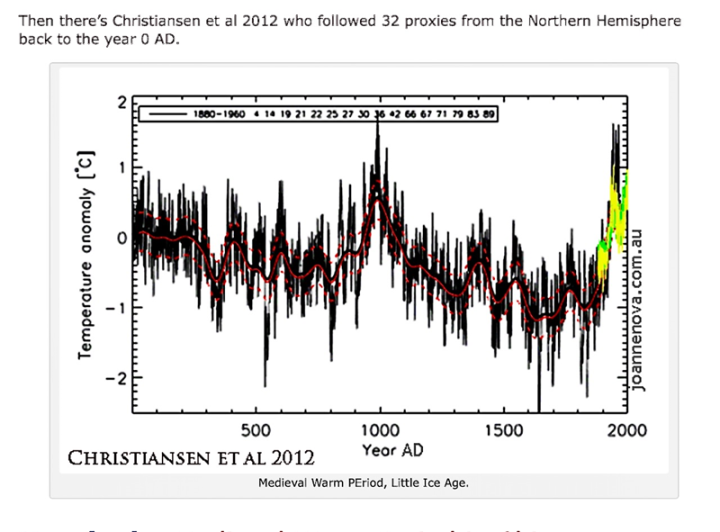

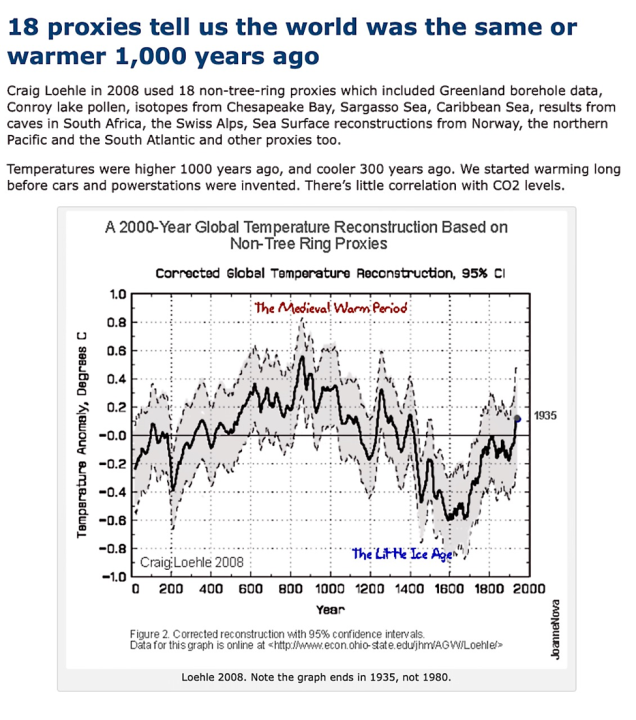

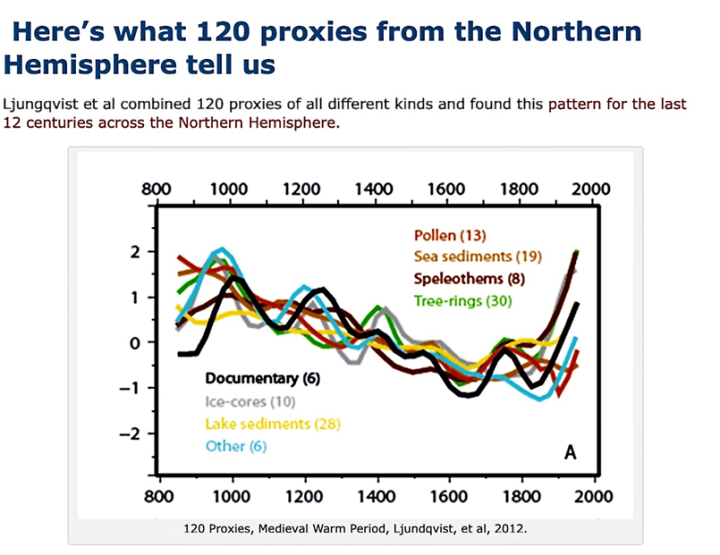

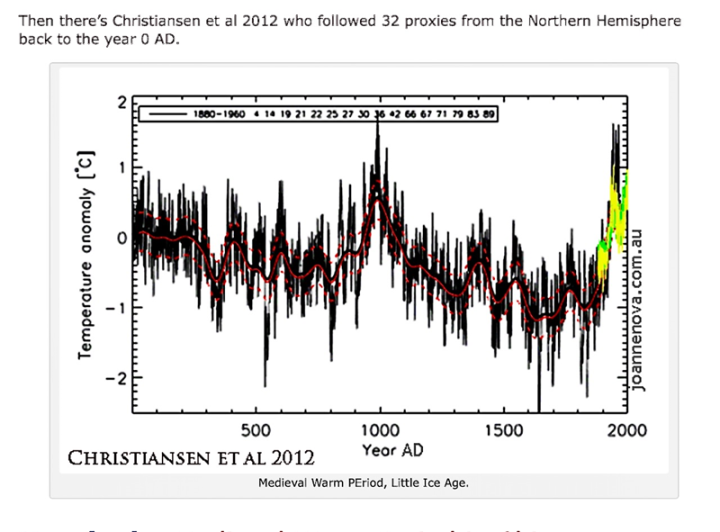

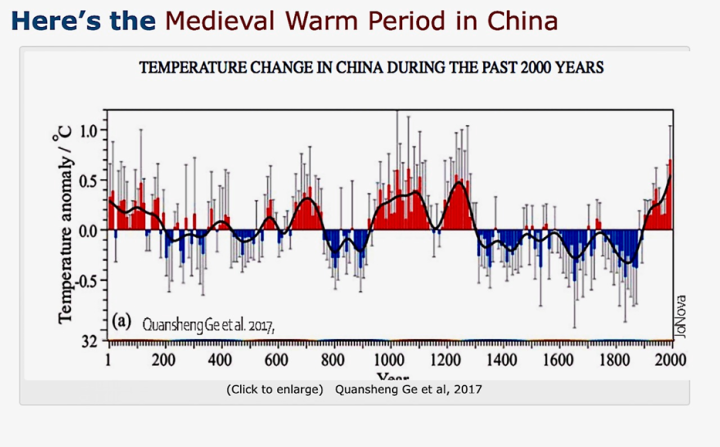

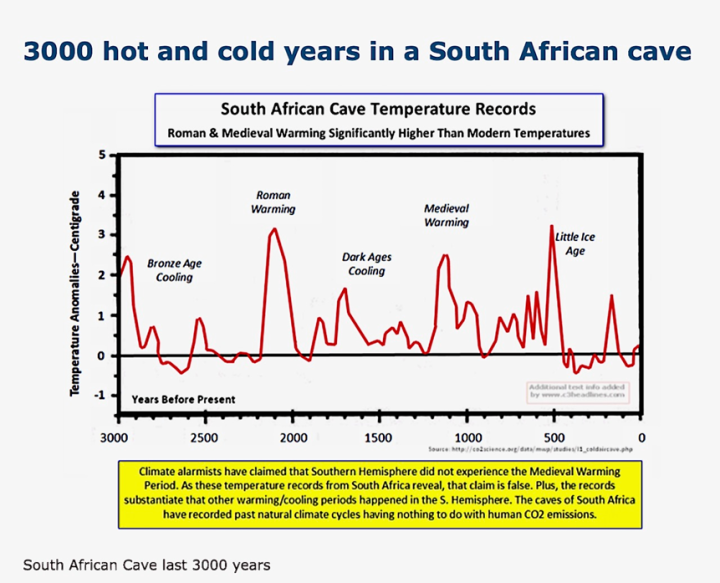

Nachfolgend ein Beispiel für eine der zahlreichen, von Fachleuten geprüften Temperatur-Rekonstruktionen, die diese nachgewiesenen Wärmeperioden dokumentieren:

Wenn man sich ansieht, was der IPCC mit dem AR6 SPM „Hockeyschläger“ gemacht hat, werden Erinnerungen an das „Hide the decline“-Trickdebakel des IPCC in der Watergate-Ära der Klimawissenschaft wach, das die Datenmanipulationen der Klimaalarmisten aufgedeckt hat (wobei die Art der „Tricks“, die in dem „Hide the decline“-Debakel verwendet worden waren, anders ist als die statistischen „Tricks“, die im AR6 SPM-Bericht verwendet wurden), wie unten gezeigt:

Der CLINTEL-Bericht befasst sich mit der Falschdarstellung der SPM-Daten zur Rekonstruktion der Klimaerwärmung über den Zeitraum der letzten 2.000 Jahre, wie in der nachstehenden Zusammenfassung gezeigt wird:

Der CLINTEL-Bericht kommt zu dem Schluss:

„Der im SPM vorgestellte „Hockeyschläger“ hat keine strenge wissenschaftliche Grundlage und stellt die Klimavariabilität der letzten zwei Jahrtausende falsch dar. Infolgedessen kann nicht behauptet werden, dass die jüngsten Klimaschwankungen „beispiellos“ sind.

Der UN IPCC AR6 SPM, der die mittelalterliche Warmzeit „verschwinden“ lässt, ist ein so ungeheuerlich fehlerhaftes Klimaalarm-Propagandaschema, dass es ein viel höheres Maß an wissenschaftlicher Prüfung und öffentlicher Aufmerksamkeit verdient.

Die mittelalterliche Warmzeit ist wissenschaftlich zweifelsfrei bewiesen, wie zahlreiche paläoklimatische Rekonstruktionen der Oberflächentemperaturen zeigen, darunter auch die von Dr. Judith Curry (Graphik oben), wie der nachstehende Vergleich zeigt, der die enorme manipulierte Verzerrung der Daten der Temperatur-Rekonstruktion im IPCC SPM über die letzten 2.000 Jahre deutlich macht (Graphik unten):

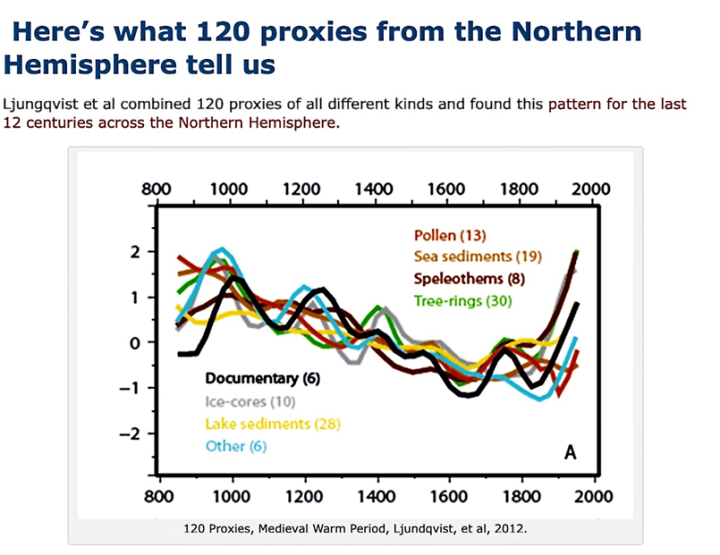

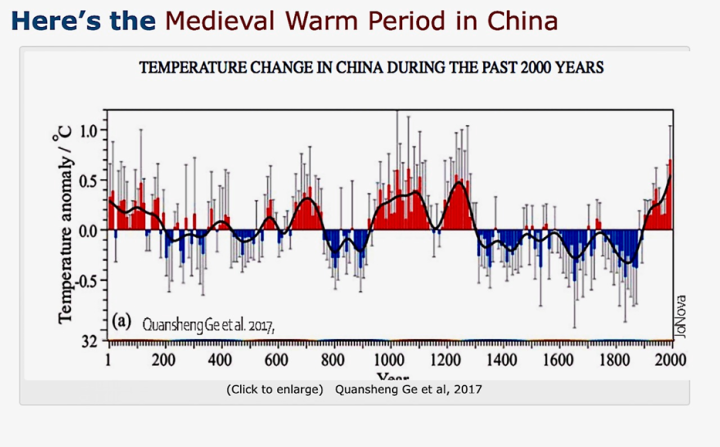

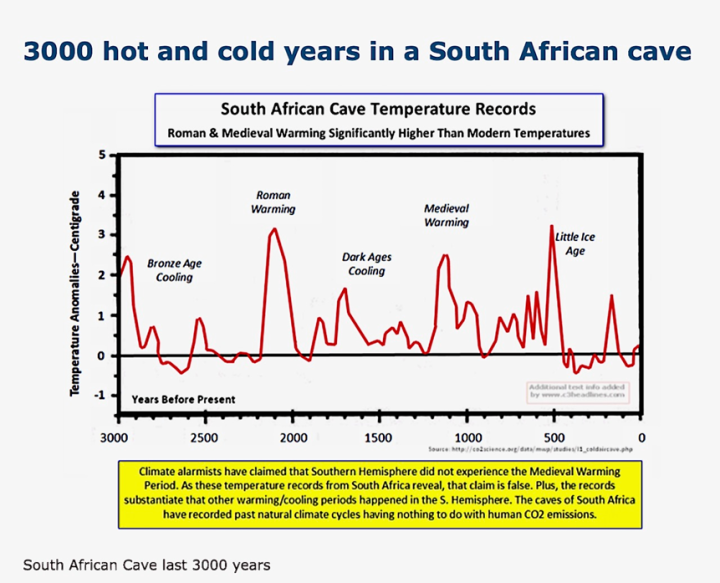

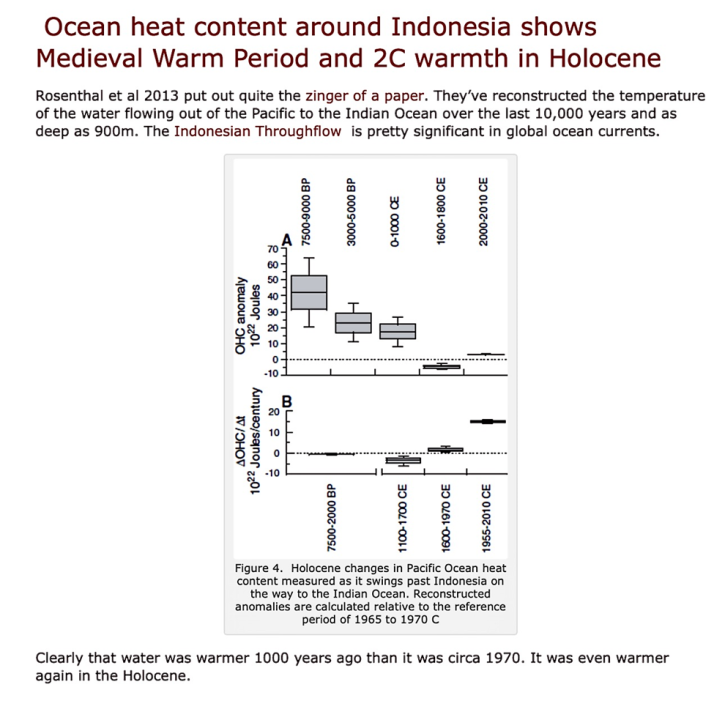

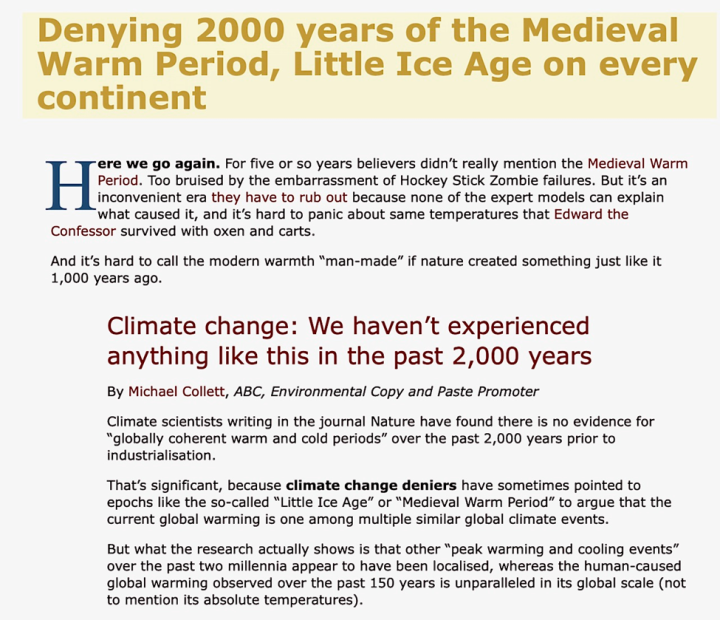

Darüber hinaus wird in einem Artikel auf der Website von JoNova eine Zusammenfassung einiger weniger der vielen weltweiten paläoklimatischen Oberflächentemperatur-Rekonstruktionen gegeben, die eindeutig die Idiotie des Versuchs belegen, die Existenz der mittelalterlichen Warmzeit zu leugnen, wie es im IPCC AR6 SPM geschieht.

Dass die Leugnung der mittelalterlichen Warmzeit durch den IPCC auf absurd konstruierten und fehlerhaften statistischen „Tricks“ von politisch getriebenen Klimaalarmisten beruht, die arrogant glauben, ihre „Tricks“ seien besser als jahrzehntelang gesammelte und analysierte globale Daten, die in Dutzenden von begutachteten und veröffentlichten Studien gesammelt wurden, und diese übertrumpfen, ist einfach verblüffend, wie die Daten und Studien zur mittelalterlichen Warmzeit aus dem unten aufgeführten JoNova-Artikel deutlich zeigen. Dieser Artikel wurde erstmals 2019 geschrieben, ist aber angesichts der AR6 SPM-Wärmeperioden-Täuschungen jetzt absolut relevant:

Der JoNova-Artikel bietet dann eine Zusammenfassung einiger weniger der zahlreichen begutachteten wissenschaftlichen Daten und Studien, die eindeutig die außergewöhnlichen Klimaschwankungen der letzten zwei Jahrtausende belegen, einschließlich der mittelalterlichen Warmzeit, die das UN IPCC mit Hilfe fehlerhafter statistischer „Tricks“, die von Dr. McKitrick und Steve McIntyre im CLINTEL-Bericht angesprochen wurden, „verschwinden“ lässt:

Die Tatsache, dass der UN IPCC ein solch kolossal hinterhältiges und fehlerhaftes Vorhaben wie die Leugnung der eindeutigen, wissenschaftlich nachgewiesenen Glaubwürdigkeit der mittelalterlichen Warmzeit, die die Klimaschwankungen in den letzten zwei Jahrtausenden bestimmt hat, in Angriff nehmen würde, offenbart ihren verzweifelten Versuch, erfundene und lächerliche Propaganda-Behauptungen über eine „Klimakrise“ zu rechtfertigen, wobei diese Aktion eindeutig belegt, dass das SPM die Standards der „objektiven wissenschaftlichen Integrität“ nicht erfüllt.

Darüber hinaus ist die enorme weltweite Überzahl an von Experten geprüften wissenschaftlichen Temperatur-Rekonstruktionsstudien, die eindeutig die Existenz der mittelalterlichen Warmzeit (sowie der minoischen und römischen Warmzeit) belegen, ein klarer Beweis dafür, dass die statistischen Schemata und „Tricks“, die vom IPCC angewandt werden, um diese Warmzeit „verschwinden“ zu lassen, als fehlerhaft und falsch beurteilt werden müssen.

Dieser eklatante Akt des „Verschwindenlassens“ der mittelalterlichen Warmzeit offenbart den politisch motivierten Mangel an klimawissenschaftlicher Kompetenz und Integrität des gesamten UN IPCC AR6-Berichts und -Prozesses und zeigt deutlich, dass das IPCC die Politisierung der Klima-Alarmisten-Propaganda als sein Ziel fördert, selbst wenn dies bedeutet, dass etablierte und bewährte, von Experten geprüfte wissenschaftliche Daten fälschlicherweise abgelehnt, verzerrt und manipuliert werden.

Der AR6 SPM wurde absichtlich manipuliert, um alarmistische politische Ziele zu erreichen, die die COP26-Bemühungen unterstützen würden, den Nationen der Welt fälschlicherweise vorzuschreiben, fossile Brennstoffe aufzugeben und die exzessive und kostspielige Nutzung unzuverlässiger, nicht anpassungsfähiger und auf Reservestrom angewiesener erneuerbarer Energien anzunehmen.

Glücklicherweise ist dieser Plan völlig gescheitert, und die Entwicklungsländer (angeführt von China und Indien) kontrollierten das Ergebnis der COP26, indem sie sich weigerten, diese wirtschaftlich zerstörerischen, wissenschaftlich fehlerhaften und rein auf Klima-Alarmismus ausgerichteten Forderungen zu erfüllen.

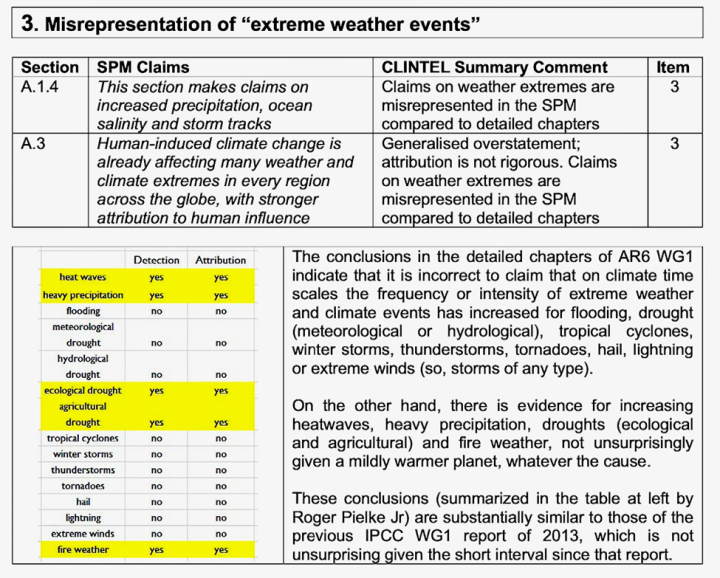

Der CLINTEL-Bericht befasst sich als Nächstes mit den falschen Darstellungen des SPM (man beachte erneut die Verwendung der Begriffe „vom Menschen verursacht“ und „menschlicher Einfluss“) in Bezug auf extreme Wetterereignisse, die im Folgenden zusammengefasst werden, wobei die in der Zusammenfassung enthaltene CLINTEL-Kritik in ihrem Bericht noch ausführlicher dargelegt wird.

Der CLINTEL-Bericht stellt fest, dass der Entwurf des AR6 WG1 nicht mit den SPM-Behauptungen in Bezug auf Überschwemmungen übereinstimmt, indem er feststellt, dass „es ein geringes Vertrauen in den menschlichen Einfluss auf die Veränderungen bei hohen Flussabflüssen auf globaler Ebene gibt“, dass „stärkere Regenfälle nicht immer zu mehr Überschwemmungen führen“ und „die Anzahl der signifikanten Trends bei größeren Überschwemmungen in Nordamerika und Europa ungefähr der Anzahl entsprach, die allein aufgrund des Zufalls zu erwarten war“ sowie „Veränderungen im Laufe der Zeit beim Auftreten größerer Überschwemmungen wurden eher durch multidekadische Schwankungen als durch langfristige Trends dominiert.“

In dem Bericht heißt es: „Den vielleicht besten Überblick über die Wetterereignisse seit der letzten Eiszeit bietet der Klassiker ‚Climate, History and the Modern World‚ von HH Lamb, der erstmals 1982 veröffentlicht und seitdem mehrfach nachgedruckt wurde. Darin werden auch extreme Wetterereignisse in der globalen Abkühlungsperiode der 1960er und 1970er Jahre dokumentiert. Allein dieses Buch lässt wenig Zweifel daran, dass die heutigen so genannten „extremen Wetterereignisse“ keineswegs beispiellos sind.

„Folglich stellt die SPM die detaillierten Erkenntnisse über Extremereignisse falsch dar.“

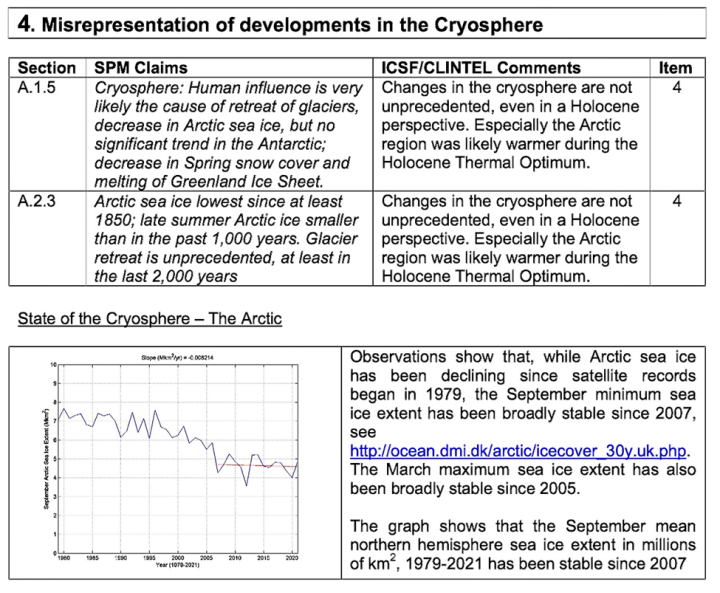

Der CLINTEL-Bericht befasst sich als Nächstes mit den falschen Darstellungen der SPM (man beachte erneut die Verwendung des Begriffs „menschlicher Einfluss“) zu den Entwicklungen in der Kryosphäre, die im Folgenden zusammengefasst werden:

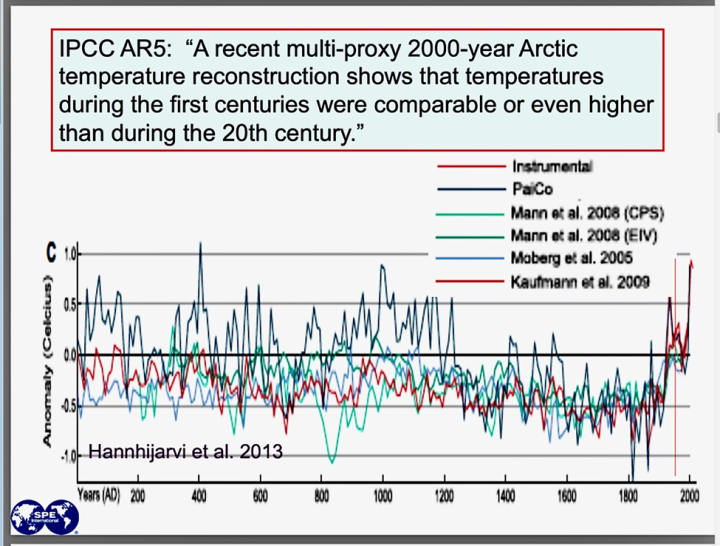

Dr. Curry stellte in ihrem Vortrag Daten zum langfristigen Verhalten der höheren Temperaturen in der Arktis in den letzten 2.000 Jahren vor, wie unten dargestellt, wobei die Temperaturen in der Arktis während des thermischen Optimums im Holozän vor 4.000 bis 8.000 Jahren noch höher waren:

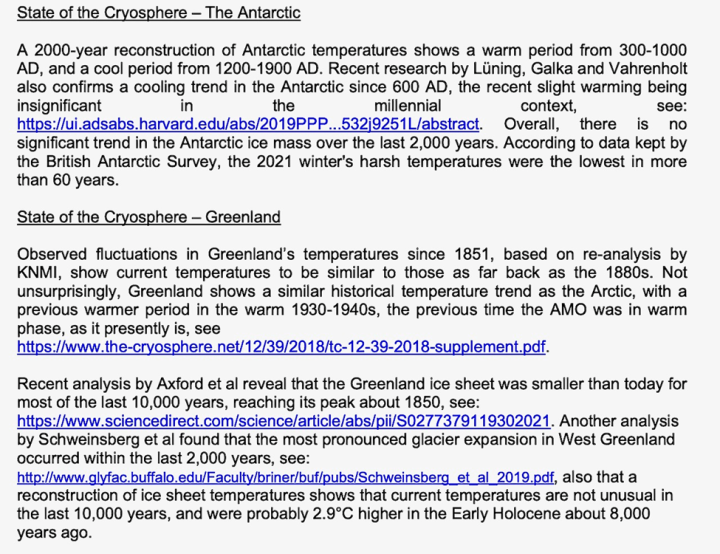

Die Entwicklungen in der Antarktis und in Grönland sowie der Gletscher sind in den folgenden Abschnitten des CLINTEL-Berichts zusammengefasst:

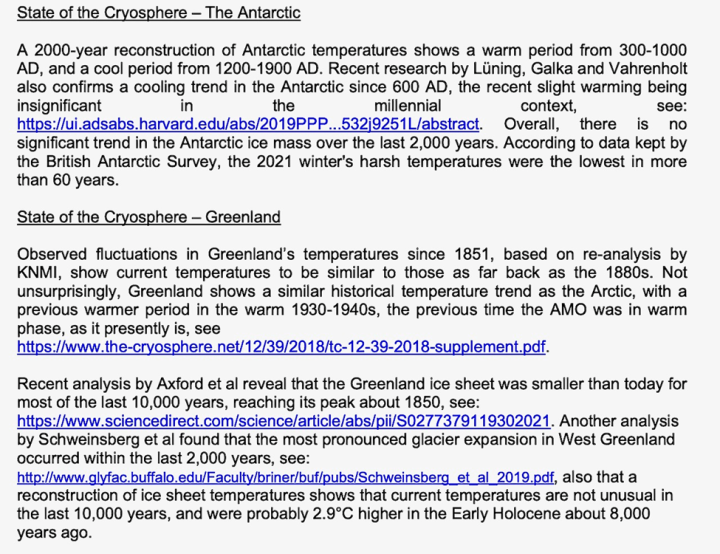

Zustand der Kryosphäre – Die Antarktis

Eine 2000-jährige Rekonstruktion der antarktischen Temperaturen zeigt eine Warmzeit von 300-1000 AD und eine kühle Periode von 1200-1900 AD. Neuere Forschungen von Lüning, Galka und Vahrenholt bestätigen ebenfalls einen Abkühlungstrend in der Antarktis seit 600 n. Chr., wobei die jüngste leichte Erwärmung im Jahrtausendkontext unbedeutend ist (hier). Insgesamt gibt es keinen signifikanten Trend in der antarktischen Eismasse während der letzten 2.000 Jahre. Nach den Daten des British Antarctic Survey waren die Temperaturen im Winter 2021 die niedrigsten seit mehr als 60 Jahren.

Zustand der Kryosphäre – Grönland

Die beobachteten Schwankungen der Temperaturen in Grönland seit 1851, die auf einer Neuanalyse des KNMI beruhen zeigen, dass die aktuellen Temperaturen denen der 1880er Jahre ähneln. Es überrascht nicht, dass Grönland einen ähnlichen historischen Temperaturtrend aufweist wie die Arktis, mit einer früheren Wärmeperiode in den warmen 1930-1940er Jahren, als sich die AMO in der warmen Phase wie derzeit befand, siehe hier.

Jüngste Analysen von Axford et al. zeigen, dass der grönländische Eisschild während des größten Teil der letzten 10.000 Jahre kleiner war als heute und seinen Höhepunkt um 1850 erreichte, siehe hier. Eine weitere Analyse von Schweinsberg et al. ergab, dass die stärkste Ausdehnung der Gletscher in Westgrönland in den letzten 2.000 Jahren stattgefunden hat, siehe hier, und auch eine Rekonstruktion der Temperatur auf dem Eisschild zeigt, dass die gegenwärtigen Temperaturen im Vergleich der letzten 10.000 Jahre nicht ungewöhnlich sind und im frühen Holozän vor etwa 8.000 Jahren wahrscheinlich 2,9°C höher waren.

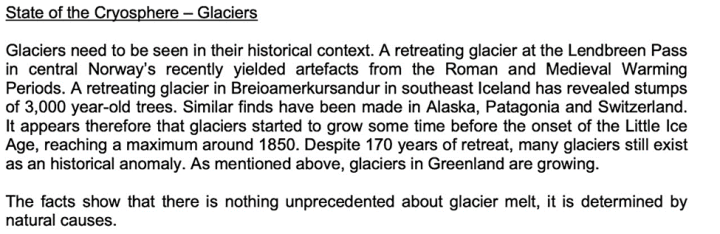

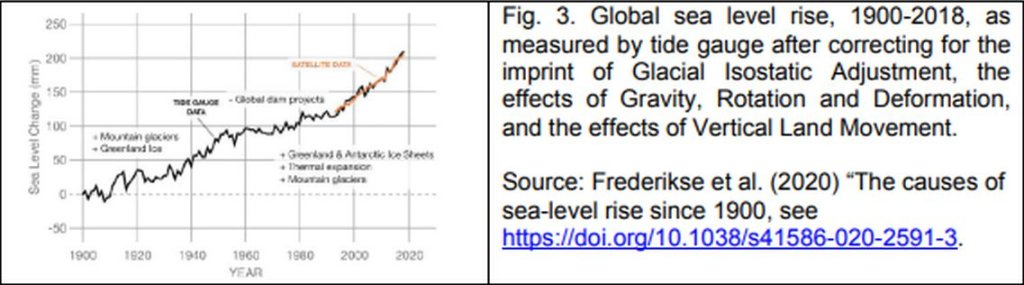

Zustand der Kryosphäre – Gletscher

Gletscher müssen in ihrem historischen Kontext gesehen werden. Ein sich zurückziehender Gletscher am Lendbreen-Pass in Mittelnorwegen hat kürzlich Artefakte aus der römischen und mittelalterlichen Warmzeit freigelegt. Ein sich ebenfalls zurückziehender Gletscher im Breioamerkursandur im Südosten Islands hat Stümpfe von 3.000 Jahre alten Bäumen freigelegt. Ähnliche Funde wurden auch in Alaska, Patagonien und der Schweiz gemacht. Es scheint also, dass die Gletscher schon einige Zeit vor dem Beginn der Kleinen Eiszeit zu wachsen begannen und um 1850 ein Maximum erreichten. Trotz 170 Jahren Rückzug sind viele Gletscher immer noch vorhanden als historische Anomalie. Wie bereits erwähnt, wachsen die Gletscher in Grönland weiter.

Die Fakten zeigen, dass das Schmelzen der Gletscher nichts Ungewöhnliches ist, sondern von natürlichen Ursachen bestimmt wird.

„Zusammenfassend lässt sich sagen, dass die behaupteten Veränderungen in der Cryosphäre durch Beobachtungen nicht bestätigt werden.“

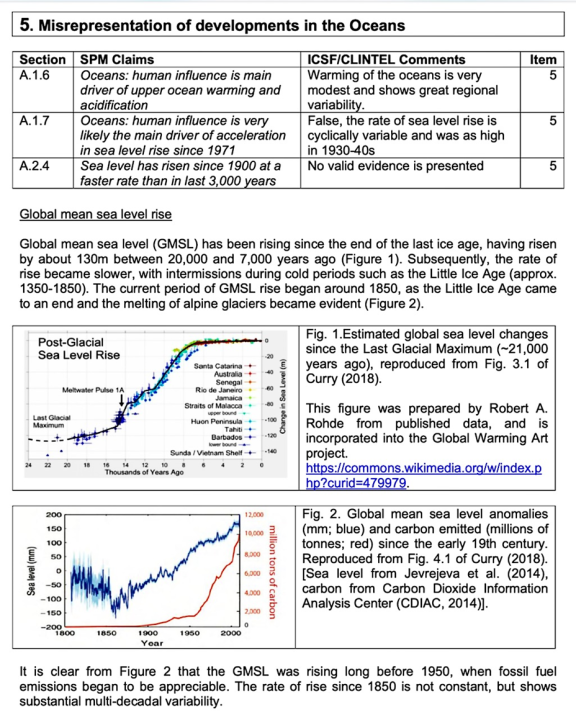

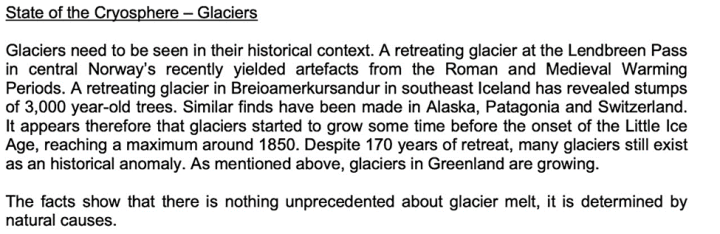

Der CLINTEL-Bericht befasst sich als Nächstes mit den falschen Darstellungen von SPM (auch hier ist die Verwendung der Begriffe „menschlicher Einfluss“ und „menschliche Einflüsse“ zu beachten) zu den Entwicklungen in den Ozeanen:

Dr. Curry geht in ihrem Vortrag speziell auf die falsche Behauptung ein, dass der „menschliche Einfluss“ die Hauptursache für die Beschleunigung des Meeresspiegelanstiegs seit 1971 ist, wie in der unten stehenden Grafik dargestellt:

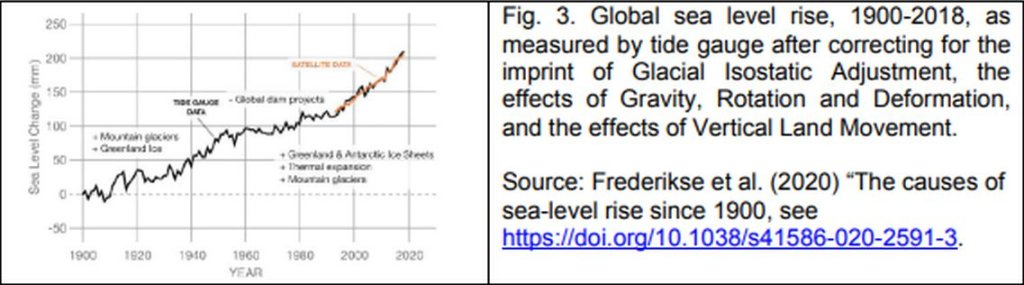

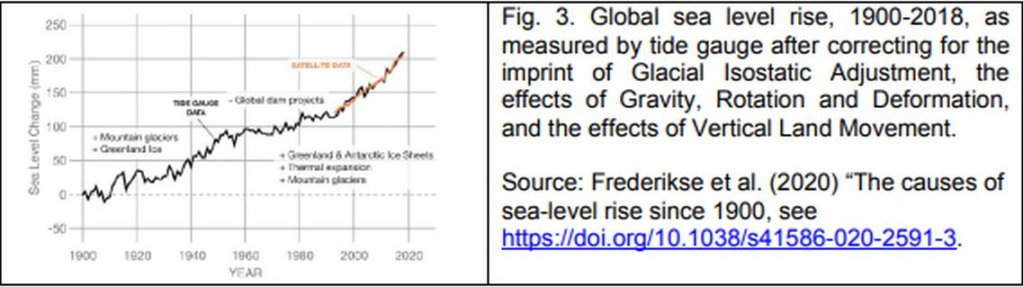

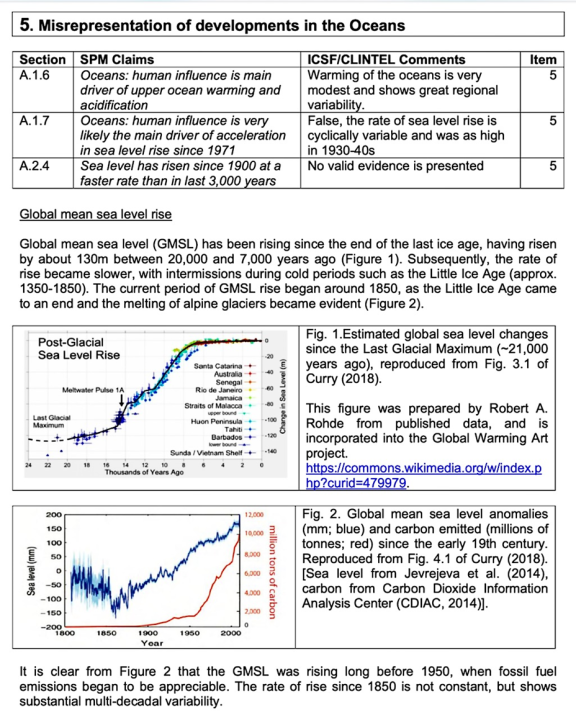

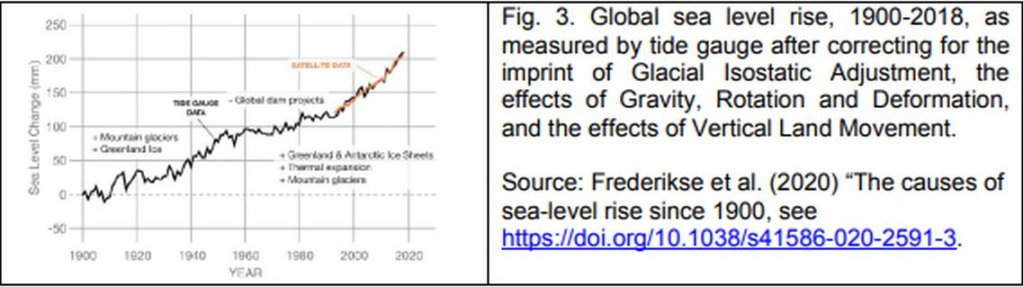

Kürzlich hat eine von der NASA geleitete Studie zu einem modernen Rahmenwerk geführt, das die Fortschritte bei Meeresspiegelmodellen und Satellitenbeobachtungen zusammenführt, um das Verständnis des Meeresspiegelanstiegs Anstiegs in den letzten 120 Jahren zu verbessern (Frederikse et al. 2020). Der in dieser Studie ermittelte GMSL-Anstieg im Zeitraum 1900-2018 ist in Abbildung 3 dargestellt.

Auch diese Abbildung zeigt eine mehrdekadische Variabilität. Eine Analyse der Daten zeigt, dass im Vergleich zu den oben genannten Werten die durchschnittliche Anstiegsrate des GMSL im 20. Jahrhundert auf 1,4 mm/Jahr nach unten korrigiert werden muss. Die Rate des GMSL-Anstiegs, die aus den rekonstruierten Pegeldaten für den Zeitraum 1993-2018 hervorgeht., stimmt gut mit den Satelliten-Altimetriedaten überein, die für denselben Zeitraum verfügbar sind; beide Anstiegsraten liegen bei etwa 3,3 mm/Jahr.

Die Daten von Frederikse et al. zeigen auch, dass die Geschwindigkeit des GMSL-Anstiegs im 20-Jahres-Zeitraum 1934-1953 3,3 mm/Jahr betrug, was in etwa der Rate im Zeitraum 1993-2018 entspricht. Laut Frederikse et al. ist die überdurchschnittliche Anstiegsrate des GMSL in diesem Zeitraum auf überdurchschnittliche Beiträge der Gletscher und des grönländischen Eisschilds zurückzuführen, wobei der grönländische Beitrag um 1935 etwas größer war als im Jahr 2018.

Beobachtungen an Land (seit 100 Jahren) bestätigen, dass der GMSL weiterhin um 1-2 mm/Jahr ohne jegliche Beschleunigung erfolgt. Satellitendaten, die nur bis 1993 zurückreichen, deuten auf einen einigermaßen linearen ~3mm/Jahr Trend hin. Es ist Rosinenpickerei des IPCC, den Wert von 3,7 mm/Jahr zu verwenden.

Selbst wenn der GMSL jetzt im oberen Durchschnitt um ~3,3 mm/Jahr ansteigt, bedeutet dies einen Anstieg des Meeresspiegels in der Größenordnung von 0,25 m bis 2100, was eine langfristige Anpassungsstrategie erfordert, aber nicht auf eine „Klimakrise“ in diesem Jahrhundert hindeutet.

Es gibt keine Grundlage für die Behauptung der SPM, dass der mittlere globale Meeresspiegel jetzt schneller ansteigt als in den letzten 3.000 Jahren. Es könnte vermutet werden, dass der Meeresspiegel während der römischen und der mittelalterlichen Warmzeit mit ähnlichen Raten wie heute anstieg, während der kleinen Eiszeit aber wahrscheinlich zurückging (wie in Abbildung Eiszeit zurückging (wie in Abbildung 2 dargestellt). Wie aus Abbildung 1 hervorgeht, betruen die Veränderungen des mittleren globalen Meeresspiegels in den letzten 3.000 Jahren sehr wahrscheinlich weniger als 1 m.

Die Gezeitenmessdaten der NOAA stützen weiterhin das Ergebnis, dass der „absolute globale Meeresspiegel-Anstieg vermutlich zwischen 1,7 und 1,8 mm/Jahr liegt“, wie in dem unten stehenden Dokument vermerkt. Dieses Niveau des globalen Meeresspiegelanstiegs stimmt mit dem CLINTEL GMSL-Anstieg überein, wie er oben in ihrem Bericht diskutiert wird, der Behauptungen über einen schnelleren Anstieg des Meeresspiegels als in den letzten 3.000 Jahren zurückweist.

Die in den Medien verbreiteten Behauptungen über einen katastrophalen Anstieg des Meeresspiegels auf den Malediven und den Inseln im Pazifischen Ozean entbehren jeglicher Grundlage, wie aus dem folgenden Bericht hervorgeht:

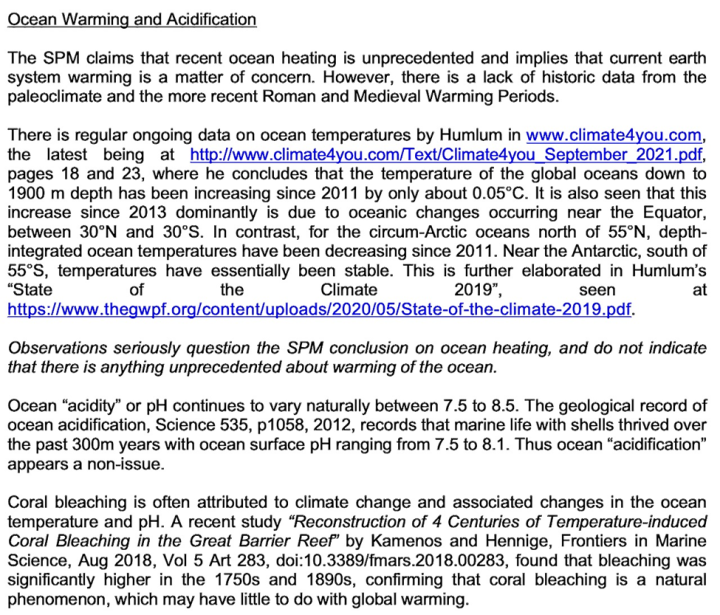

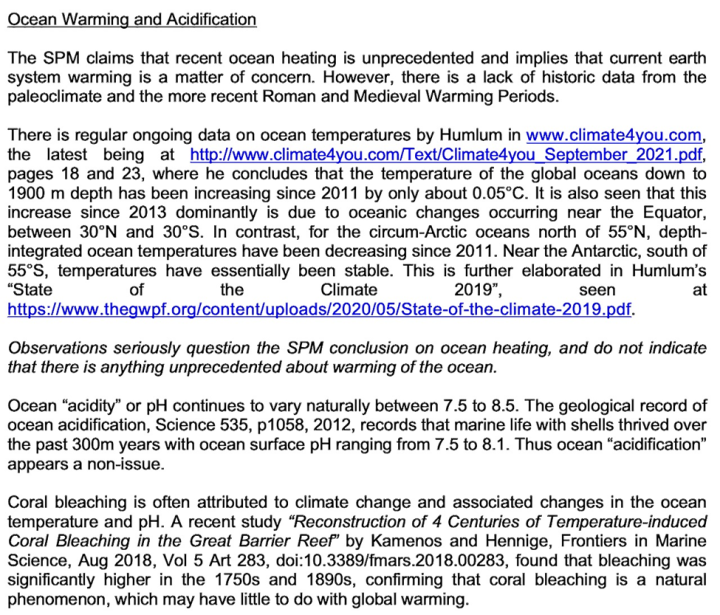

In Bezug auf die Erwärmung und Versauerung der Ozeane stellt der CLINTEL-Bericht fest:

Erwärmung und Versauerung der Ozeane

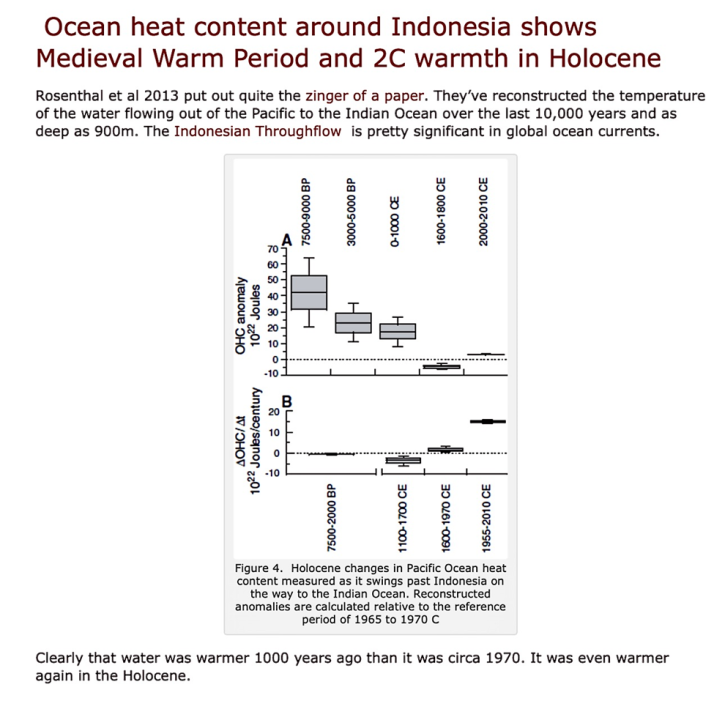

Die SPM behauptet, dass die jüngste Erwärmung der Ozeane beispiellos ist und dass die derzeitige Erwärmung des Erdsystems Anlass zur Sorge gibt. Es mangelt jedoch an historischen Daten aus dem Paläoklima und den jüngeren römischen und mittelalterlichen Wärmeperioden.

Humlum veröffentlicht regelmäßig Daten zu den Meerestemperaturen unter www.climate4you.com, die neuesten sind hier zu finden, und zwar auf den Seiten 18 und 23, wo er zu dem Schluss kommt, dass die Temperatur der Weltmeere bis in 1900 m Tiefe seit 2011 um nur etwa 0,05°C gestiegen ist. Es wird auch deutlich, dass dieser Anstieg seit 2013 vor allem auf ozeanische Veränderungen in Äquatornähe zurückzuführen ist, zwischen 30°N und 30°S. In den zirkumarktischen Ozeanen nördlich von 55°N sind die tiefenintegrierten Ozeantemperaturen dagegen seit 2011 rückläufig. In der Nähe der Antarktis, südlich von 55°S, sind die Temperaturen im Wesentlichen stabil geblieben. Dies wird weiter ausgeführt in Humlum’s „State of the Climate 2019“ hier.

Die Beobachtungen stellen die SPM-Schlussfolgerung zur Erwärmung der Ozeane ernsthaft in Frage und deuten nicht darauf hin, dass die Erwärmung des Ozeans etwas noch nie Dagewesenes ist.

Der „Säuregehalt“ oder pH-Wert des Ozeans schwankt weiterhin auf natürliche Weise zwischen 7,5 und 8,5. Die geologische Aufzeichnung der Ozeanversauerung, Science 535, S. 1058, 2012, zeigt, dass Meereslebewesen mit Schalen in den letzten 300 Millionen Jahren bei einem pH-Wert zwischen 7,5 und 8,1 gediehen sind. Somit scheint die „Versauerung“ der Ozeane kein Problem zu sein.

Die Korallenbleiche wird häufig auf den Klimawandel und die damit verbundenen Veränderungen der Meerestemperatur und des pH-Werts zurückgeführt. Eine kürzlich durchgeführte Studie mit dem Titel „Reconstruction of 4 Centuries of Temperature-induced Coral Bleaching in the Great Barrier Reef“ von Kamenos und Hennige, Frontiers in Marine Science, Aug 2018, Vol 5 Art 283, doi:10.3389/fmars.2018.00283 ergab, dass die Bleiche in den 1750er und 1890er Jahren signifikant höher war, was bestätigt, dass die Korallenbleiche ein natürliches Phänomen ist, das möglicherweise wenig mit der globalen Erwärmung zu tun hat.

„Zusammenfassend lässt sich sagen, dass die Behauptungen über den Anstieg des Meeresspiegels, die Erwärmung und den Säuregehalt falsch dargestellt werden.“

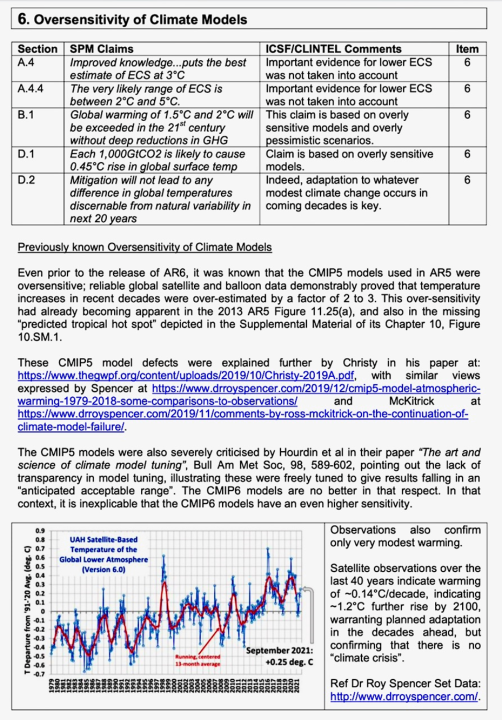

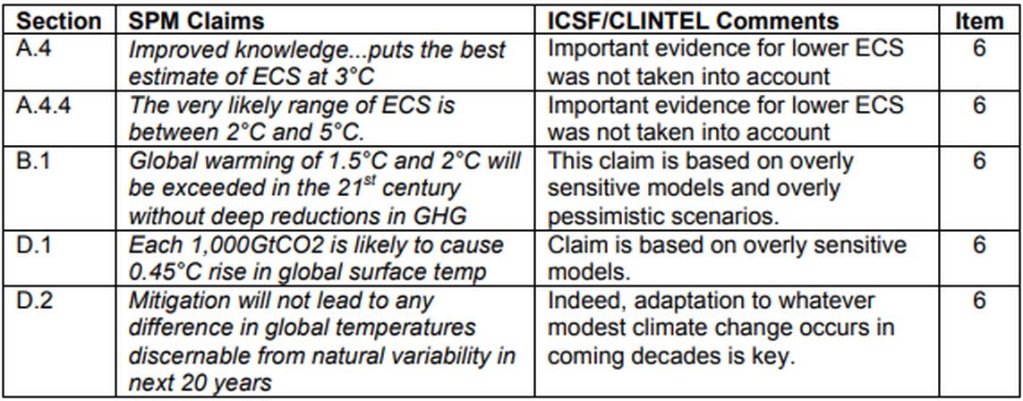

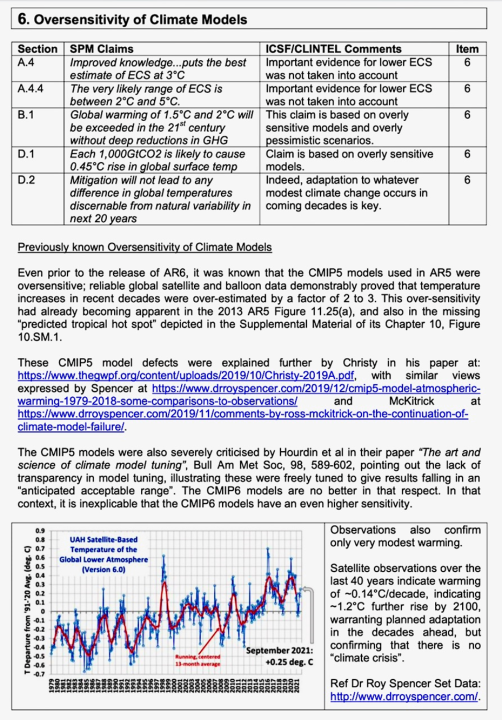

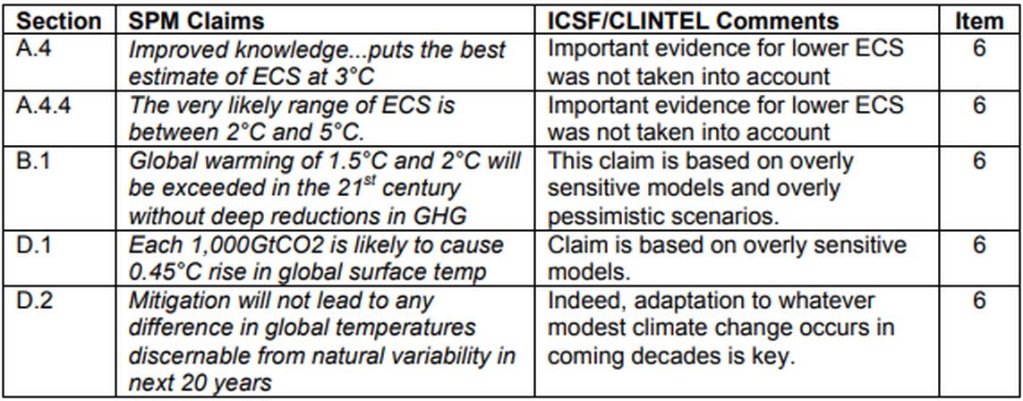

Der CLINTEL-Bericht befasst sich als nächstes mit den falschen Darstellungen der SPM über die Überempfindlichkeit von Klimamodellen:

Überempfindlichkeit der Klimamodelle

Zuvor bekannte Überempfindlichkeit der Klimamodelle

Schon vor der Veröffentlichung des AR6 war bekannt, dass die im AR5 verwendeten CMIP5-Modelle überempfindlich waren. Zuverlässige globale Satelliten- und Ballondaten bewiesen jedoch, dass der Temperaturanstieg der letzten Jahrzehnte um den Faktor 2 bis 3 überschätzt wurde. Diese Überempfindlichkeit hatte sich bereits in der AR5-Abbildung 11.25(a) von 2013 gezeigt, und auch in dem fehlenden „vorhergesagten tropischen Hot Spot“, der im ergänzenden Material des Kapitels 10, Abbildung 10.SM.1. dargestellt ist.

Diese CMIP5-Modelldefekte wurden von Christy in seiner Studie näher erläutert. Ähnliche Ansichten vertrat Spencer hier und McKitrick hier.

Die CMIP5-Modelle wurden auch von Hourdin et al. in ihrer Studie „The art and science of climate model tuning“, Bull Am Met Soc, 98, 589-602, heftig kritisiert, wobei sie auf die mangelnde Transparenz bei der Modellabstimmung hinweist und zeigt, dass die Modelle frei abgestimmt wurden, um Ergebnisse zu erzielen, die in einem „erwarteten akzeptablen Bereich“ liegen. Die CMIP6-Modelle sind in dieser Hinsicht nicht besser. In diesem Kontext ist es unerklärlich, dass die CMIP6-Modelle eine noch höhere Empfindlichkeit aufweisen.

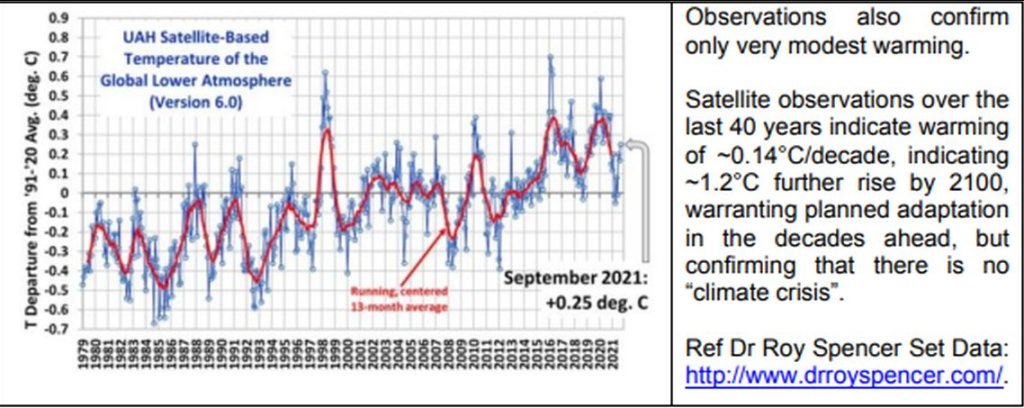

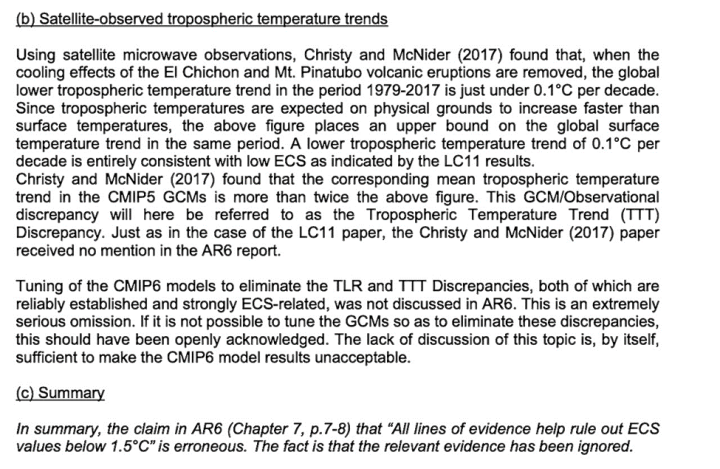

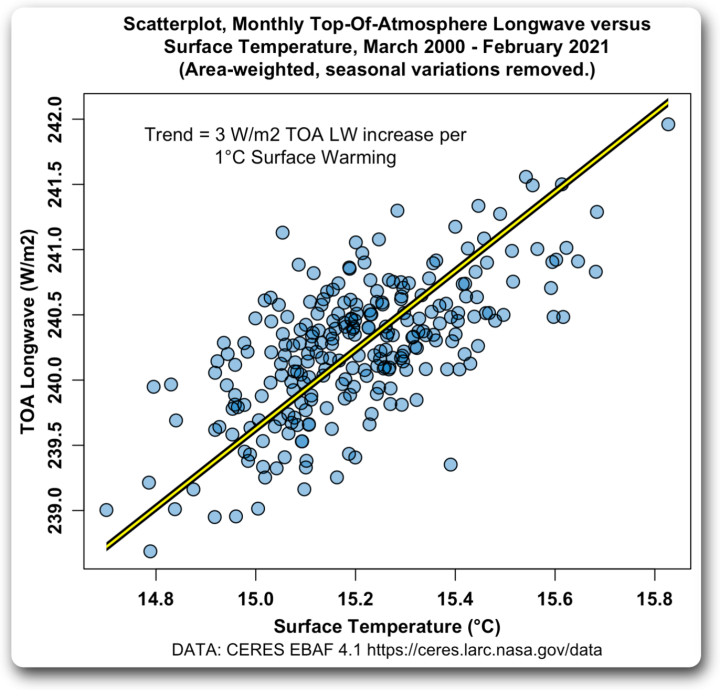

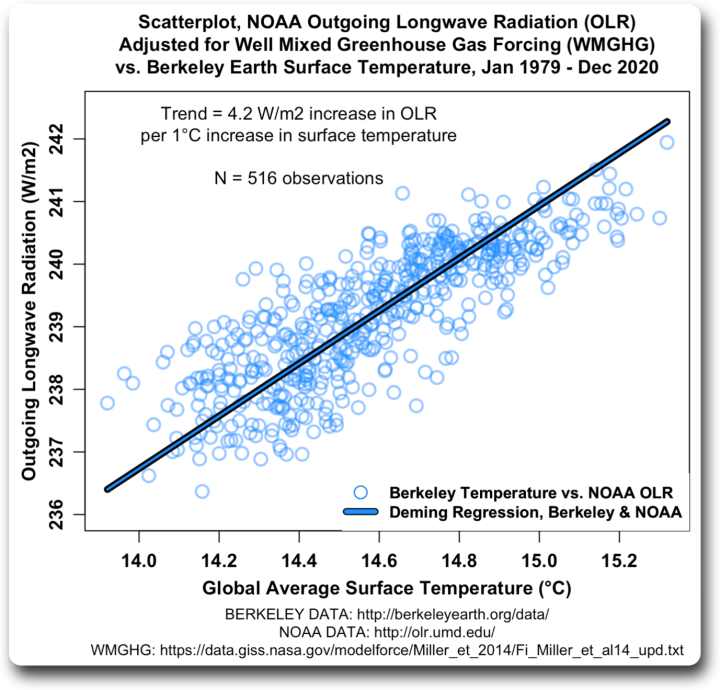

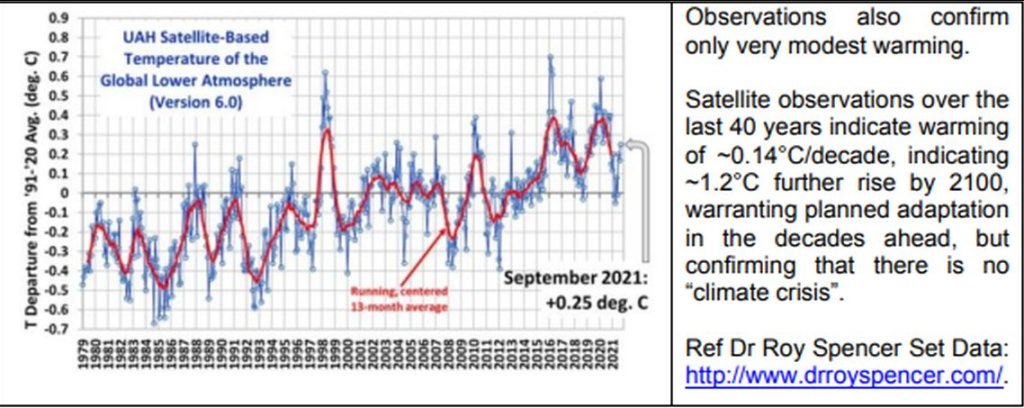

Zu den satellitengestützten Temperaturtrends in der Troposphäre stellt der CLINTEL-Bericht fest:

(b) Von Satelliten beobachtete Trends der troposphärischen Temperatur

Anhand von Satelliten-Mikrowellenbeobachtungen fanden Christy und McNider (2017) heraus, dass die globalen Temperaturtrends, wenn die Abkühlungseffekte der Vulkanausbrüche von El Chichon und Mt. Pinatubo entfernt werden, in der unteren Troposphäre im Zeitraum 1979-2017 knapp unter 0,1 °C pro Jahrzehnt liegen. Da die troposphärischen Temperaturen aus physikalischen Gründen schneller steigen sollten als die Oberflächentemperaturen, setzt die obige Abbildung eine Obergrenze für den globalen Oberflächentemperaturtrend im gleichen Zeitraum. Ein Temperaturtrend von 0,1°C pro Dekade in der unteren Troposphäre ist durchaus mit einem niedrigen ECS vereinbar, wie die Ergebnisse von LC11 zeigen.

Christy und McNider (2017) fanden heraus, dass der entsprechende mittlere troposphärische Temperaturtrend in den CMIP5-GCMs mehr als doppelt so hoch ist wie der obige Wert. Diese Diskrepanz zwischen GCM und Beobachtungen wird hier als Troposphärischer Temperaturtrend (TTT) bezeichnet. Genau wie im Fall des LC11-Papiers hatte das Papier von Christy und McNider (2017) im AR6-Bericht keine Erwähnung gefunden.

Die Abstimmung der CMIP6-Modelle zur Beseitigung der TLR- und TTT-Diskrepanzen, die beide zuverlässig nachgewiesen und stark ECS-bezogen sind, wurden im AR6 nicht diskutiert. Dies ist ein äußerst schwerwiegendes Versäumnis. Wenn es nicht möglich ist, die GCMs so abzustimmen, dass diese Diskrepanzen beseitigt werden, hätte dies offen zugegeben werden müssen. Das Fehlen einer Diskussion dieses Themas ist an sich schon ausreichend, um die CMIP6-Modellergebnisse inakzeptabel zu machen.

(c) Zusammenfassung

Zusammenfassend lässt sich sagen, dass die Behauptung im AR6 (Kapitel 7, S. 7-8), wonach „alle Belege gegen ECS-Werte unter 1,5°C ausschließen“ ist falsch. Tatsache ist, dass die relevanten Beweise ignoriert wurden.

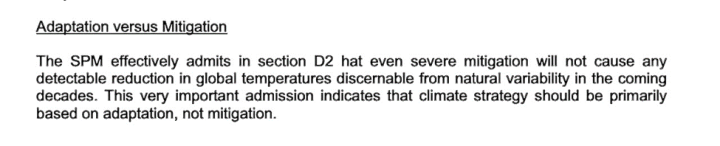

Der CLINTEL-Bericht enthält auch einen kurzen Kommentar zur Bedeutung der Anpassung gegenüber der Abschwächung:

Anpassung versus Abschwächung

Der SPM räumt in Abschnitt D2 effektiv ein, dass selbst starke Abmilderungsmaßnahmen in den kommenden Jahrzehnten nicht zu einer Reduktion der globalen Temperaturen führen, die sich von der natürlichen Variabilität unterscheidet. Dieses sehr wichtige Eingeständnis zeigt, dass die Klimastrategie in erster Linie auf Anpassung und nicht auf Milderung beruhen sollte.

Link: https://wattsupwiththat.com/2022/02/15/ipcc-ar6-spm-credibility-destroyed-by-disappearing-medieval-warming-period/

Übersetzt von Christian Freuer für das EIKE