Gibt es wirklich eine Klimakrise?

Ivor Williams

Summary

Es gibt zwei Gründe, daran zu zweifeln, dass unser sich veränderndes Klima eine „Krise“ ist:

1. Die Wissenschaft basiert weitgehend auf steigenden globalen Temperaturwerten. Doch diesen wird durch ihre unglaubliche Messung auf ein Hundertstel Grad Celsius eine falsche Aura der Genauigkeit verliehen.

2. Das Wetter und das Klima in England und Wales werden viel länger als anderswo auf der Welt genauer überwacht. Warum gibt es in den Temperatur-, Niederschlags-, Sturm- und Gezeitenmessungen keine Spur eines Klimanotstands?

Man macht uns weis, dass es einen Klimanotstand gibt

Die britische Regierung im Mai 2019: „Die Abgeordneten haben einem Antrag zugestimmt, einen Umwelt- und Klimanotstand auszurufen …. Dieser Vorschlag, der den Willen des Unterhauses demonstriert … wurde ohne Abstimmung angenommen.

Die Lehrer wurden durch ein 29-seitiges Handbuch ermutigt, Maßnahmen zu ergreifen: „Wie erklärt man einen Klimanotstand an Ihrer Schule oder Hochschule … Erklären Sie einfach einen Klimanotstand oder proklamieren Sie einen BEDEUTENDEN Klimanotstand? Eine sinnvolle Klimanotstandserklärung erfordert direktes Handeln und messbare systemische Veränderungen.“

Lokale Verwaltungen im Vereinigten Königreich schlossen sich schnell an: „300/404 (74 %) der District, County, Unitary & Metropolitan Councils haben bis heute den Klimanotstand ausgerufen. Auch 8 zusammen hängende Behörden/Stadtregionen.“ (Oktober 2021)

Die UN fügten weitere Details hinzu: ‚Der Klimawandel ist die entscheidende Krise unserer Zeit, und er vollzieht sich noch schneller als wir befürchtet haben … Steigende Temperaturen führen zu Umweltzerstörung, Naturkatastrophen, Wetterextremen, Nahrungsmittel- und Wasserversorgungsunsicherheit, wirtschaftlichen Störungen, Konflikten und Terrorismus. Der Meeresspiegel steigt, die Arktis schmilzt, Korallenriffe sterben ab, die Ozeane versauern und die Wälder brennen‘.

Das IPCC ist das Gremium der Vereinten Nationen, das die wissenschaftlichen Erkenntnisse über den Klimawandel bewertet: „Wissenschaftler beobachten in allen Regionen der Erde Veränderungen des Klimas“, heißt es in ihrem Bericht vom August 2021. Viele der beobachteten Veränderungen … sind seit Tausenden, wenn nicht Hunderttausenden von Jahren beispiellos, und einige der Veränderungen … sind über Hunderte bis Tausende von Jahren unumkehrbar“.

Diese Katastrophenwarnungen haben jede Überschwemmung, jeden Sturm, jede Dürre und jeden „Temperaturrekord“ zu einem eindeutigen Beweis für einen gefährlichen Klimawandel gemacht. Aber das Wetter auf der Welt wurde nur in den letzten zwei Jahrhunderten regelmäßig überwacht – das sind nur 2 % des Zeitraums seit dem Ende der letzten Eiszeit. In den nächsten ein oder zwei Jahrtausenden werden noch viele weitere Rekorde gebrochen werden.

Sind diese Daten real?

Treibhausgase

Kohlendioxid (CO2): Untersuchungen haben ergeben, dass der CO2-Gehalt der Atmosphäre vor der Industrialisierung (1750-1800) bei 278 ppm (parts per million) lag. Dies wird vom IPCC als Basiswert verwendet. Messungen am Mauna Loa Observatorium auf Hawaii seit 1958 zeigen einen stetigen Anstieg.

September 1961: 315 ppm

September 2021: 413 ppm, ein Anstieg um rund 30 % in 60 Jahren

413 Teile pro Million = 0,04 %.

Nach Ansicht von Wissenschaftlern ist der kontinuierliche Anstieg dieser und anderer Treibhausgase für die globale Erwärmung verantwortlich.

Die Atmosphäre enthält 1-4 % Wasserdampf, der bei weitem das größte Treibhausgas ist. Die anderen sind Methan (CH4), Distickstoffoxid (N20), Ozon (O3) und fluorierte Gase, alle in viel geringeren Mengen.

Diese Gase halten die Erde warm. [?] Ohne sie würde die Durchschnittstemperatur der Erde um mehr als 30 Grad Celsius sinken, von plus 14 auf minus 18 Grad. Aber es gibt auch ein Rückkopplungsproblem: Wenn sich die Atmosphäre erwärmt, kann sie mehr Wasserdampf aufnehmen, was ihre Auswirkungen auf Wetter und Klima noch verstärkt.

Globale Temperatur

Die globalen Temperaturen werden von der US National Aeronautics & Space Administration, Goddard Institute of Space Studies (NASA/GISS), der US National Oceanic & Atmospheric Administration (NOAA), der Japanese Meteorological Agency (JMA), dem European Centre for Medium Range Weather Forecasts (ECMWF) und dem britischen Met Office Hadley Centre überwacht. Die Berichte werden in Form einer Temperaturanomalie mit Bezug auf einen vereinbarten Durchschnittszeitraum, in der Regel 30 Jahre, erstellt.

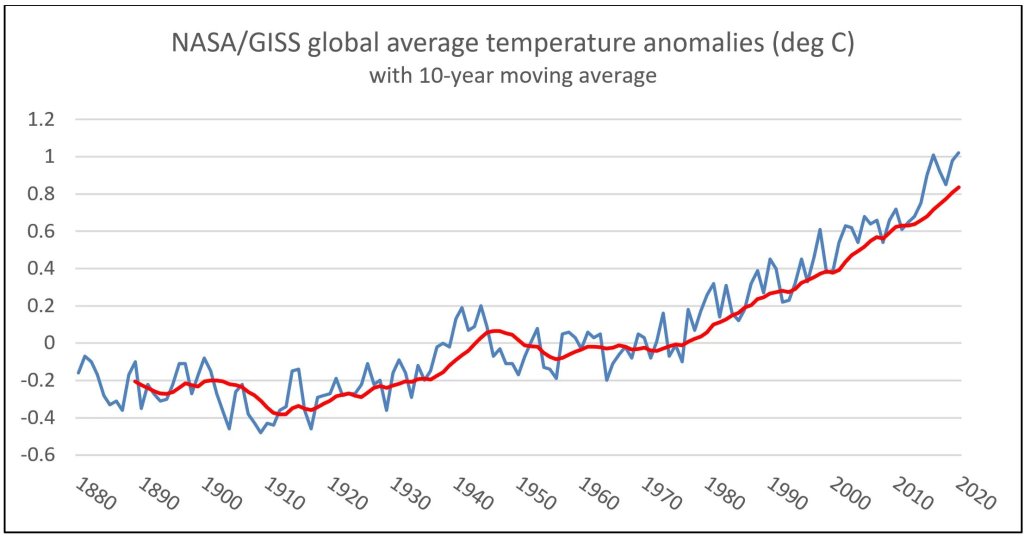

Das NASA/GISS-Diagramm der globalen Temperaturen von 1880 bis 2020 verwendet Anomalie-Daten mit Bezug auf den Durchschnitt von 1951-1980.

Dieses Diagramm ist so dargestellt, wie es auf der NASA/GISS-Website erscheint. Beachten Sie, dass die y-Achse (Temperaturskala) übertrieben dargestellt ist, um den Trend deutlicher zu machen. Diese Form, bei der die x-Achse (Jahr) manchmal gequetscht wird, um die Übertreibung noch zu verstärken, findet sich überall in den Medien.

Die NOAA verwendet ebenfalls Daten aus dem Jahr 1880. Ihr Diagramm stellt die globalen Temperaturen als Anomalie in Bezug auf den Durchschnitt von 1901-2000 dar und hat eine sehr ähnliche Form wie das obige.

Die JMA berechnet die globale Temperaturanomalie entweder mit Bezug auf den Durchschnitt von 1991-2020 oder auf 1901-2000.

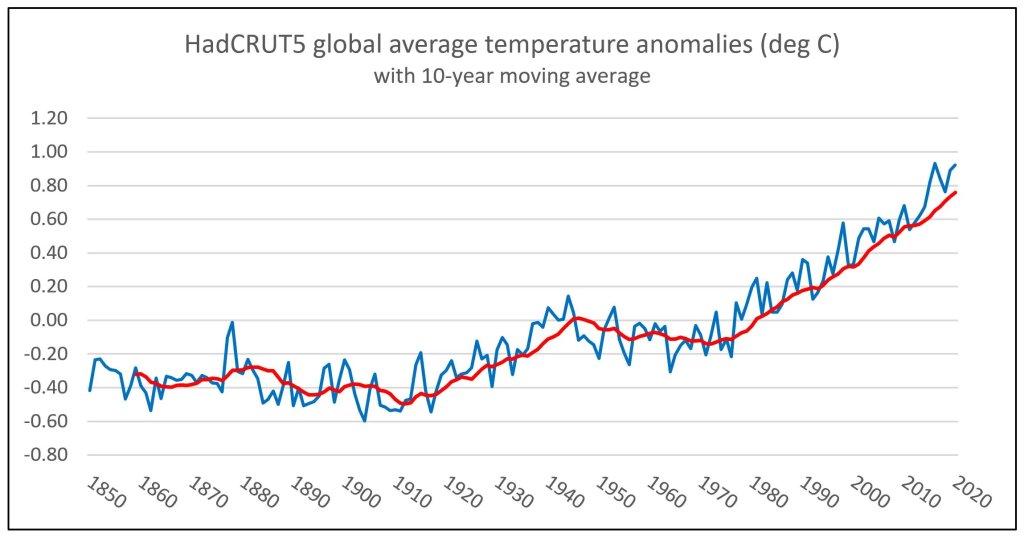

Das UKMO Hadley Centre verwendet Daten aus dem Jahr 1850. Ihre Anomalie für 2020 lag +0,92 Grad Celsius über dem Durchschnitt von 1961-1990, der tatsächlich 14,0 Grad Celsius betrug.

Temperaturwerte

Meteorologische Beobachtungsstationen geben die Temperatur auf eine Dezimalstelle genau an. In die Temperaturanalysen der NASA fließen Oberflächentemperaturmessungen von mehr als 20.000 Wetterstationen sowie schiffs- und bojengestützte Beobachtungen der Temperatur an der Meeresolberfläche ein … Diese In-situ-Messungen werden mit einem Algorithmus analysiert, der die unterschiedlichen Abstände der Temperaturstationen rund um den Globus und die Auswirkungen der städtischen Wärmeinsel berücksichtigt …. Aus diesen Berechnungen ergeben sich die globalen durchschnittlichen Temperaturabweichungen vom Basiszeitraum 1951 bis 1980.

Auf den Websites von NASA/GISS, NOAA und JMA werden die jährlichen globalen Anomalien für 2020 auf zwei Dezimalstellen genau angegeben: +1,02, +1,19 bzw. +0,34 Grad Celsius, erscheinen also wärmer als in den jeweiligen Durchschnittszeiträumen.

Die gesamte wissenschaftliche Grundlage für die globale Erwärmung beruht auf den Temperaturdaten dieser fünf Organisationen sowie auf den CO2-Aufzeichnungen.

Es ist sehr schwer zu glauben, dass Wissenschaftler die jährliche Gesamttemperatur unseres gesamten Globus, d.h. aller 510.000.000 km², mit einer Genauigkeit von einem Hundertstel Grad messen können. Die zwei Dezimalstellen spiegeln nur das Ausmaß des Mittelungsprozesses wider, nicht die Genauigkeit der Daten.

Die gesamte wissenschaftliche Grundlage für die globale Erwärmung beruht auf den von diesen fünf Organisationen erstellten Temperaturdaten und den CO2-Aufzeichnungen. Es gibt keinen Hinweis auf eine Fehlermarge, was zu erheblichen Zweifeln an der angegebenen Genauigkeit der Zahlen führt.

Die fünfte Temperaturreihe und andere Daten aus UK

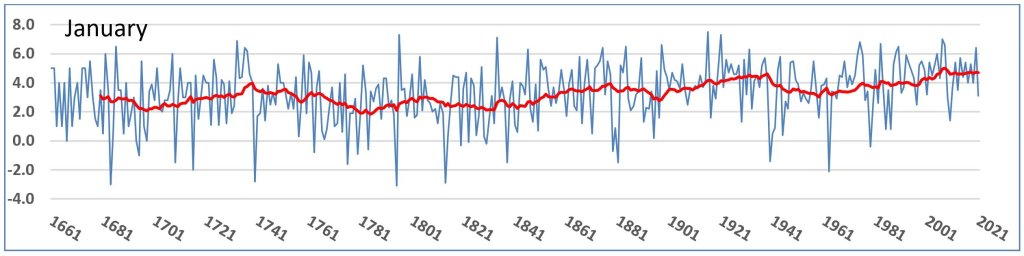

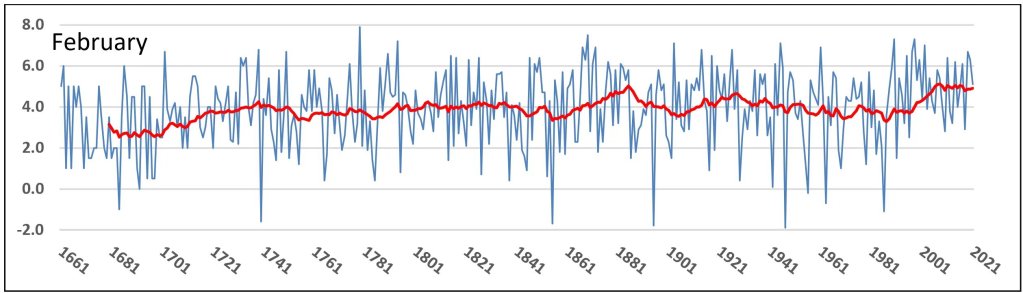

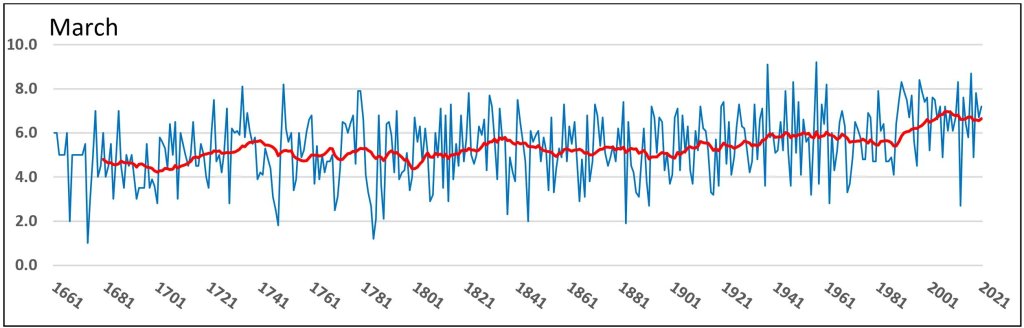

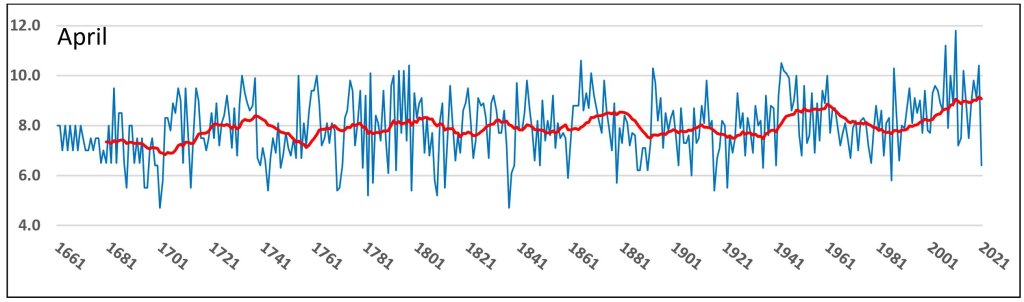

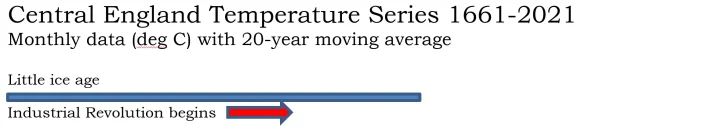

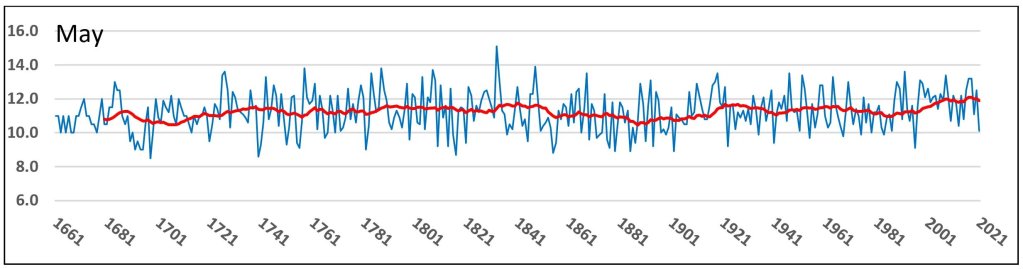

Es gibt noch eine weitere Temperaturaufzeichnung, die ein viel kleineres Gebiet betrifft, aber schon im Jahre 1659 beginnt. Es handelt sich um die Temperaturreihe des Hadley Centre des britischen Met Office, welche die bei weitem längste instrumentelle Temperaturaufzeichnung der Welt ist. Sie deckt das Gebiet Manchester-London-Bristol in einem Dreieck ab. Derzeit werden vier Messstationen verwendet.

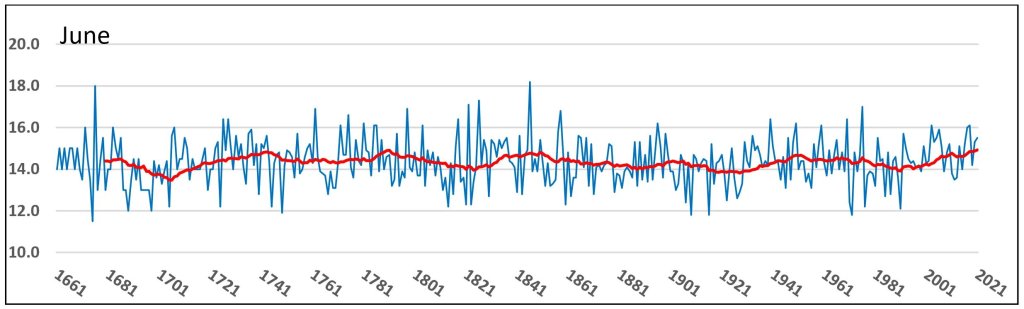

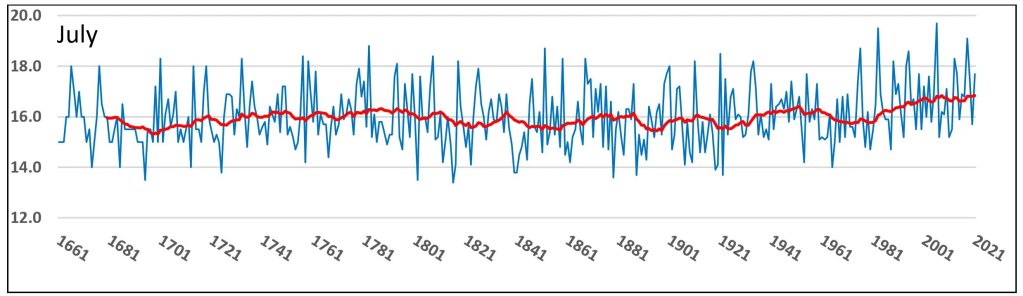

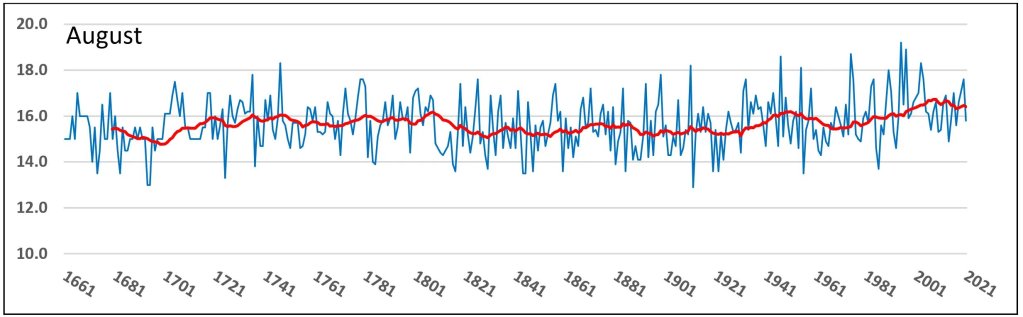

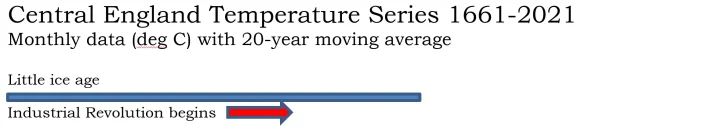

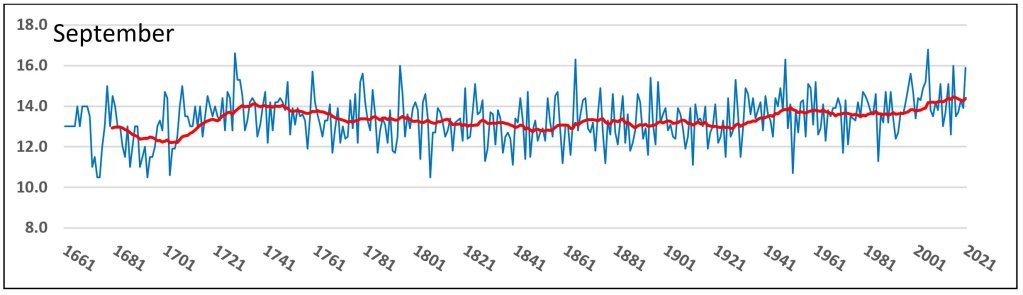

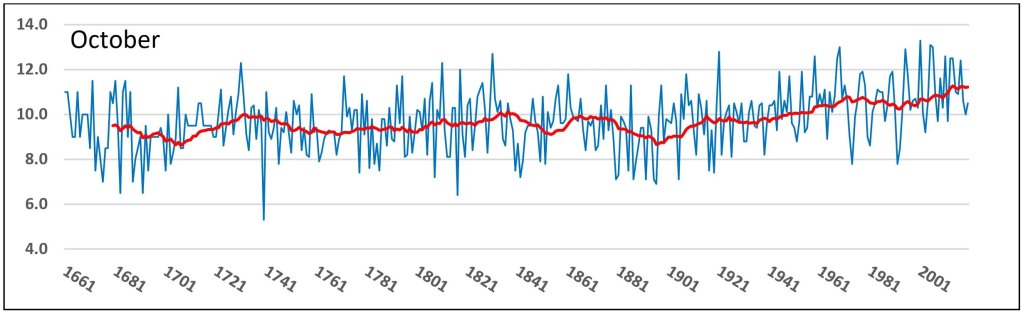

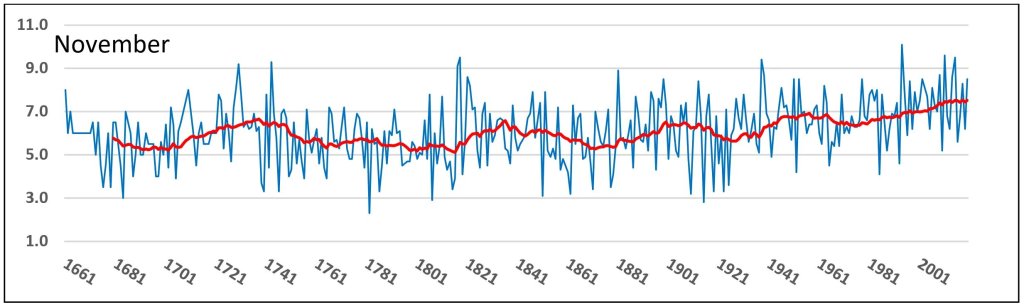

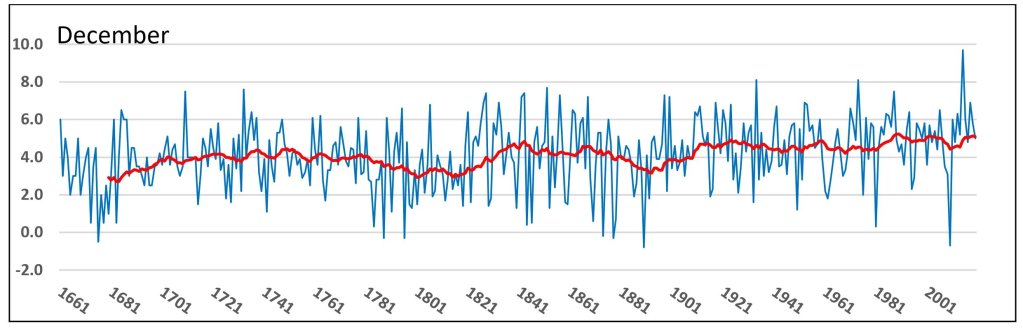

Die monatlichen Diagramme (unten) umfassen den letzten Teil der Kleinen Eiszeit (1300-1850) und den Beginn der industriellen Revolution (ab der zweiten Hälfte des 18. Jahrhunderts). Die y-Achse (Temperaturskala) ist kürzer als bei den NOAA- und HadCRUT-Diagrammen (oben).

Diese Diagramme zeigen die tatsächlichen Durchschnittstemperaturen (keine Anomalien) anhand von vier Messstationen in einem kleinen Gebiet. Diese viel längere Zeitspanne verwischt alle Spuren des Wetters und zeigt das Klima deutlicher. In einigen Monaten ist eine gewisse Erwärmung zu erkennen, aber nichts, was auf eine Krise hindeutet:

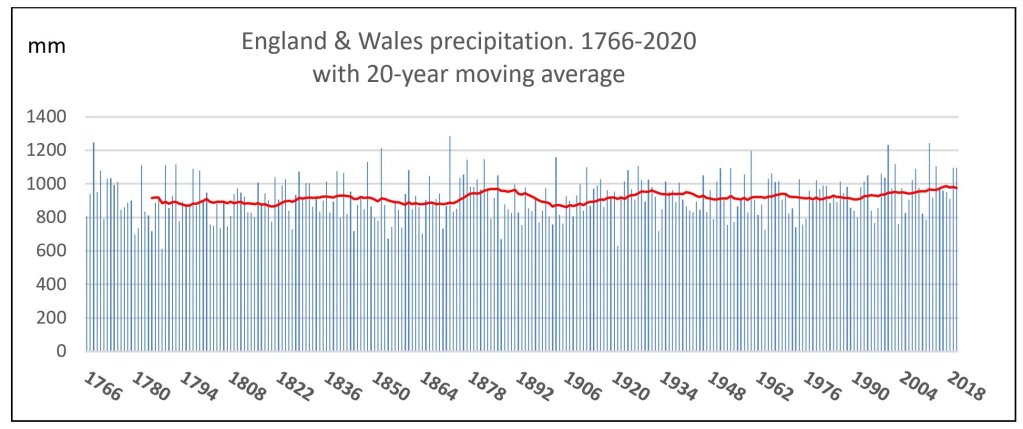

Niederschlag

Die Niederschlagssummen für England und Wales sind für einen Zeitraum von 254 Jahren ab 1766 verfügbar. Auch hier gibt es keine Anzeichen für einen Klimanotstand oder für eine merkliche Veränderung der aufgezeichneten Mengen:

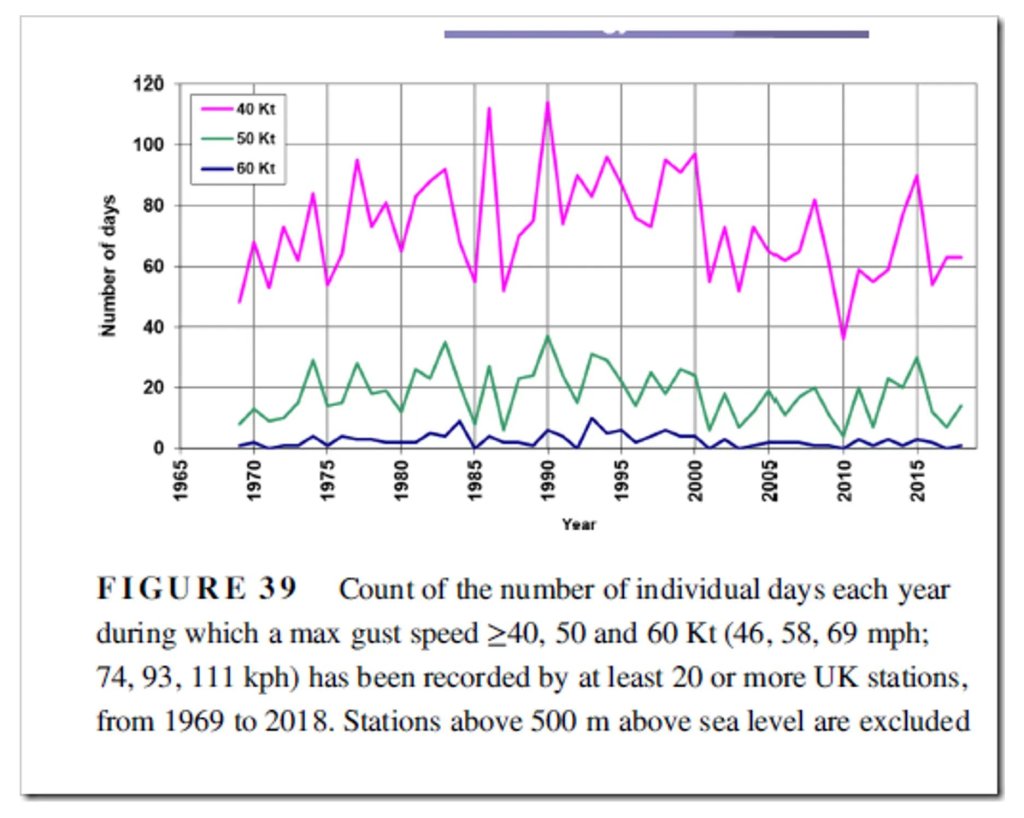

Stürme

Es zeigt sich auich keine Klimawandel-Auswirkung bzgl. Stürmen in UK:

Meeresspiegel

Langfristige britische Messungen in North Shields und Newlyn zeigen einen langsamen und stetigen Anstieg von 2 mm/Jahr über die letzten 100 Jahre.

Summary

Die globalen Temperaturanomalien sowie der Anstieg des Kohlendioxidgehalts und anderer Emissionen sind der Grund für die Besorgnis über den Klimawandel.

Die außerordentliche Aufmerksamkeit, die den Temperaturdaten zuteil wurde, hat dazu geführt, dass jeder Fall von ungewöhnlichem Wetter in der ganzen Welt als Beweis für ein bevorstehendes Unheil angesehen wird.

Das Wetter ist meist normal, mit Schwankungen und gelegentlichen Ausreißern nach oben. Das war schon immer so.

Obwohl sich das globale Klima verändert, gibt es zwei Gründe, die Situation nicht als „Notfall“ zu bezeichnen:

1. Die Wissenschaft stützt sich weitgehend auf die steigenden globalen Temperaturwerte. Diese erhalten jedoch durch ihre unglaublichen Messungen auf ein Hundertstel Grad Celsius einen falschen Nimbus der Genauigkeit.

2. Wetter und Klima in England und Wales werden schon viel länger als anderswo auf der Welt genau beobachtet. Von einem Klimanotstand zeigt sich bei den Temperatur-, Niederschlags-, Sturm- und Gezeitenmessungen keine Spur.

Übersetzt von Christian Freuer für das EIKE