Der Sonne-Klima-Effekt: Die Winter-Pförtner-Hypothese (I).

Die Suche nach einem solaren Signal

Javier Vinós & Andy May

„Wahrscheinlich wurde auf keinem Teilgebiet der Meteorologie so viel Aufwand betrieben wie bei den Auswirkungen der Sonnenvariabilität auf Wetter und Klima. Und kein anderes hat so wenig für die Forschungsarbeit vorzuweisen gehabt.“ Helmut E. Landsberg (1982)

1.1 Introduction

Die Sonne wird seit den Anfängen der menschlichen Intelligenz als die Quelle des Klimas angesehen, weshalb sie in vielen alten Kulturen verehrt wurde. Große Sonnenflecken sind mit bloßem Auge sichtbar, wenn die Sonne tief am Horizont steht und teilweise durch Staub oder Rauch verdeckt ist. Mehrere Mythen und ikonografische Darstellungen deuten darauf hin, dass Sonnenflecken den alten Kulturen in Amerika, Afrika und Asien bekannt waren. Die erste schriftliche Erwähnung eines Sonnenflecks stammt jedoch aus Theophrastus‘ De Signis Tespestatum um 325 v. Chr. Diese erste schriftliche Erwähnung der Sonnenvariabilität wurde bereits mit einem klimatischen Effekt in Verbindung gebracht, da Theophrastus erwähnt, dass sie mit dem Niederschlag zusammenhängt. Theophrastus gilt als Vater der Botanik und war ein Schüler von Aristoteles. Er trat die Nachfolge von Aristoteles als Leiter des Lyzeums an, als Aristoteles, der Lehrer Alexanders des Großen, wegen der anti-makedonischen Stimmung aus Athen fliehen musste. Theophrastus‘ beiläufige Erwähnung von Sonnenflecken muss sich auf allgemeines Wissen aus der Vergangenheit bezogen haben, da er während des großen griechischen Sonnenminimums von 390-310 v. Chr. lebte (Usoskin 2017) und es sehr unwahrscheinlich ist, dass irgendjemand zu dieser Zeit einen Sonnenfleck mit bloßem Auge hätte sehen können. Die meisten uns bekannten Sonnenfleckenbeobachtungen mit bloßem Auge stammen aus China, wo Aufzeichnungen ab 165 v. Chr. gefunden wurden. Die älteste bekannte Zeichnung tatsächlicher Sonnenflecken stammt aus dem Chronicon ex chronicis von John of Worcester, das im Manuskript auf Dezember 1128 datiert wird, also während des mittelalterlichen großen Maximums der Sonnenaktivität.

Polarlichter sind eine atmosphärische Lichterscheinung, die aus der Wechselwirkung von Sonnenwind und Erdmagnetfeld resultiert und in der Regel in einem Abstand von 10-20° zu den geomagnetischen Polen entsteht. Aurora ist die römische Göttin der Morgenröte, eine Schwester von Sol und Luna. Jeden Morgen öffnete sie die Tore des Himmels, damit die Sonne aufgehen konnte, und raste dann in ihrem Wagen über den frühen Morgenhimmel, um den neuen Tag anzukündigen. Der Name Aurora Borealis wurde dem atmosphärischen Phänomen 1619 von Galileo gegeben, was auf seine nördliche (boreale) Ausrichtung hindeutet. Polarlichter werden gelegentlich in mittleren Breiten und selten in niedrigen Breiten beobachtet, wenn ein geomagnetischer Sturm das Polarlichtoval vorübergehend vergrößert. Polarlichter werden seit dem Altertum beobachtet. Die ersten Aufzeichnungen über Polarlichter scheinen drei assyrische Tontafeln um 660 v. Chr. zu sein (Hayakawa et al. 2019). Auch der Prophet Hesekiel berichtete um 593 v. Chr. in der Bibel von einem Polarlicht, und Aristoteles schrieb 340 v. Chr. in seiner Abhandlung Meteorologica über Polarlichter. Bis zur Ankunft der modernen Wissenschaft wurden Polarlichter jedoch nicht mit der Sonnenaktivität in Verbindung gebracht. Anders Celsius war der erste, der 1733 vorschlug, dass Polarlichter mit dem Magnetfeld der Erde zusammenhängen, aber die Verbindung zur Sonne musste bis zum Carrington-Ereignis von 1859 warten, als auf die von Richard Carrington und Richard Hodgson entdeckte Sonneneruption, die eine große geomagnetische Störung verursachte, das intensivste und am tiefsten gelegene Polarlicht der Geschichte folgte. Historische Aufzeichnungen von Polarlichtern seit dem Altertum werden zusammen mit historischen Aufzeichnungen von Sonnenflecken mit bloßem Auge zur Untersuchung der vergangenen Sonnenaktivität verwendet.

Auf die Erfindung des Fernrohrs im Jahr 1608 folgten bald zahlreiche teleskopische Beobachtungen von Sonnenflecken. Die ersten Aufzeichnungen gehen auf Thomas Harriot im Jahr 1610 und die erste Veröffentlichung auf Johannes Fabricius im Jahr 1611 zurück (Vázquez & Vaquero 2009). Galileo Galilei und Christoph Scheiner führten 1612 systematische Sonnenfleckenbeobachtungen durch, wobei beide feststellten, dass sie nie weit vom Sonnenäquator entfernt waren und sich mit der Sonne drehten. Die teleskopischen Sonnenfleckenbeobachtungen kamen gerade rechtzeitig, um das große Maunder-Sonnenminimum (GSM) von etwa 1645 bis 1715 zu registrieren. Seitdem hat kein weiteres GSM stattgefunden, da das Dalton-Minimum kein GSM war (Usoskin 2017).

Zumindest ein veränderlicher Stern war den alten Ägyptern vor drei Jahrtausenden bekannt. Es gibt jetzt Belege dafür, dass der Kairoer Kalender aus den Jahren 1244-1163 v. Chr. die Periode des verfinsternden Doppelsterns Algol, der mit dem ägyptischen Gott Horus assoziiert wird, als Glücks- und Unglückstage aufzeichnet (Jetsu & Porceddu 2015). Algol war der zweite veränderliche Stern, der 1669 von modernen Astronomen beschrieben wurde. Vorausgegangen war die Entdeckung, dass Mira mit einer 11-monatigen Periode pulsiert, durch Johannes Holwarda im Jahr 1638. Die Zahl der bekannten veränderlichen Sterne wuchs langsam bis etwa 1850, als sie sich beschleunigte, und insbesondere seit der Einführung der Astrofotografie in den 1880er Jahren. Der Allgemeine Katalog der Veränderlichen Sterne 2017 (Version GCVS 5.1) enthält Daten für 52.011 Veränderliche Sterne. Die Sonne gilt derzeit als veränderlicher Stern mit einer sehr geringen Abweichung von einer Millimagnitude. Über 80 % der sonnenähnlichen Sterne zeigen eine Variabilität wie die Sonne (Connolly et al. 2021).

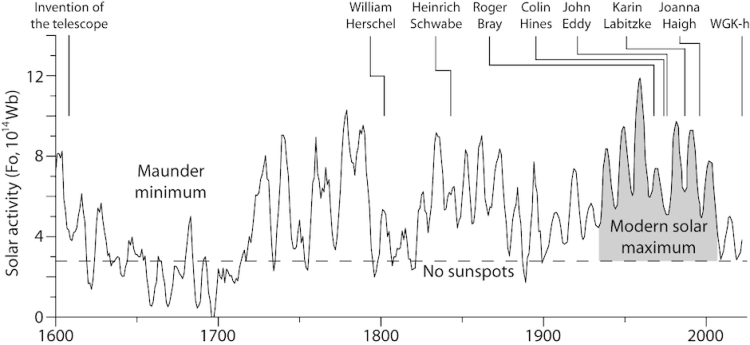

Abb. 1.1 zeigt die Sonnenaktivität seit 1600 nach Usoskin et al. 2021 (Abb. 8) und Wu et al. 2018 für das 20. Jahrhundert in offenen solaren Flux-Weber-Einheiten. Einige Meilensteine in der Erforschung des Sonnen-Klima-Effekts sind angegeben. Im Jahr 1608 wurde das Fernrohr erfunden. 1801 entwickelte Herschel die Hypothese vom Zusammenhang zwischen Sonnenflecken und Klima. Im Jahr 1843 entdeckte Heinrich Schwabe den Sonnenzyklus. 1968 entdeckte Roger Bray den 2500-jährigen Sonnenaktivitätszyklus in Verbindung mit einem 2500-jährigen Klimazyklus. 1974 schlägt Colin Hines einen Sonnen-Klima-Mechanismus vor, der durch planetarische Wellen vermittelt wird. 1976 schrieb John Eddy einen bahnbrechenden Artikel über das Maunder-Minimum. 1986 entdeckte Karin Labitzke den ersten soliden Sonnenklimaeffekt in der polaren Atmosphäre während des Winters. 1996 schlug Joanna Haigh den „Top-down“-Sonnenklimamechanismus vor. Im Jahr 2022 schlagen wir die Hypothese des „Winter Gatekeeper“-Sonnenklimamechanismus vor.

1.2 William Herschel, Heinrich Schwabe und die frühe Sonne-Klima-Begeisterung

Mit dem Aufkommen des Teleskops und dem Interesse an Sonnenflecken kamen Spekulationen auf, dass Veränderungen der Sonnenfleckenzahl und Veränderungen des Wetters zusammenhängen, wie Theophrastus schon 325 v. Chr. vermutete. Der italienische Jesuitenastronom Giambattista Riccioli und der mexikanische Astronom José Antonio Alzate stellten 1651 bzw. 1784 die gleiche Vermutung auf.

Der Musiker, Komponist, Mathematiker, Astronom und beste Teleskopbauer seiner Zeit, der Entdecker des Uranus und der Infrarotstrahlung, William Herschel, war der erste, der die These aufstellte, dass die Sonne ein veränderlicher Stern ist und Sonnenflecken Veränderungen der Sonnenaktivität widerspiegeln, die das Klima beeinflussen. In einem Artikel, den er 1801 in der Royal Society vorstellte, sagte er:

„Ich bin jetzt sehr geneigt zu glauben, dass … [reichlich Sonnenflecken], kann dazu führen, dass wir erwarten, eine reichliche Emission von Wärme, und daher milde Jahreszeiten. Und dass im Gegenteil … die Abwesenheit von … [Sonnenflecken] eine spärliche Wärmeabgabe bedeutet und uns veranlassen kann, strenge Jahreszeiten zu erwarten.“

(Herschel 1801)

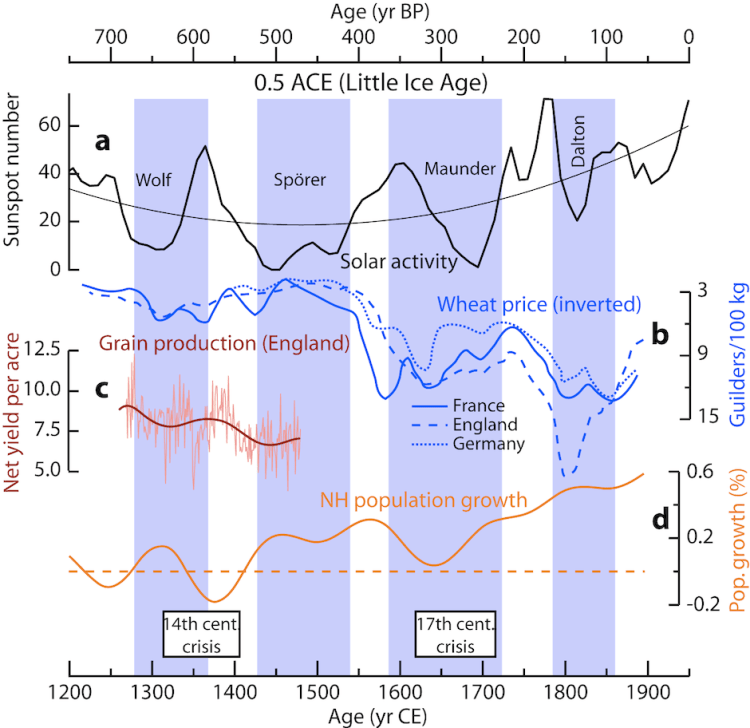

Interessanterweise war Herschel auch der erste, der mehr Sonnenflecken mit einer höheren Sonnenemission in Verbindung brachte, im Gegensatz zu allen früheren Beobachtern und fast allen, die ihm bis ins 20. Jahrhundert folgten. Er setzte dann den Weizenpreis seit 1650 aus Adam Smiths The Wealth of Nations mit den frühen Sonnenfleckenzahlen in Beziehung und fand eine Entsprechung. Die von Herschel vorgeschlagene Entsprechung ist wahrscheinlich falsch. Er selbst warnte davor, dass das Kriterium wahrscheinlich nicht real ist, da der Preis von Waren auch durch ihre Nachfrage reguliert wird, aber das Fehlen von Temperaturaufzeichnungen ließ ihm keine andere Methode. Abbildung 1.2 zeigt, dass die Getreideproduktion erwartungsgemäß die bessere Wahl ist. Die hohe Sterblichkeit durch die Hungersnot von 1317 und den Schwarzen Tod von 1346, dem ein Drittel der europäischen Bevölkerung zum Opfer fiel, führte zu einem Nachfragerückgang, der die Getreidepreise trotz des Produktionsrückgangs während des Spörer-Minimums von ca. 1400-1500 niedrig hielt.

Herschels Sonnen-Klima-Vorschlag wurde mit Spott bedacht. Lord Brougham spottete und nannte ihn „eine große Absurdität“ und fuhr fort zu sagen, dass „seit der Veröffentlichung von Gullivers Reise nach Laputa der Welt nichts so Lächerliches mehr geboten wurde“ (Edinburgh Review 1803).

Abb. 1.2. Die Auswirkungen der Klimaveränderungen der Kleinen Eiszeit auf die menschlichen Gesellschaften in Europa.

In Abb. 1.2 sind eingezeichnet: a) Rekonstruktion der Sonnenaktivität, die die Wolf-, Spörer-, Maunder- und Dalton-Sonnenminima zeigt. (Nach Wu et al. 2018). Die quadratische Regression (dünne Linie) folgt der langfristigen Veränderung der Sonnenaktivität. Plot b) zeigt den Weizenpreis in niederländischen Gulden pro 100 kg (invertiert), für Frankreich (durchgezogene Linie), England (gestrichelte Linie) und Deutschland (gepunktete Linie). (Nach Lamm 1995). Diagramm c) zeigt drei Hauptkulturen von Getreide-Nettoerträgen pro Acre in England, mit jährlichen Daten (dünne Linie) und einem langfristigen Trend (dicke Linie). (Nach Campbell & Ó Gráda 2011). Diagramm d) zeigt das Bevölkerungswachstum der nördlichen Hemisphäre in Prozent. (Nach Zhang et al. 2011). Die Kästchen am unteren Rand kennzeichnen die Zeiträume, die von Historikern als Krise des 14. und 17. Jahrhunderts angesehen werden. Vertikale Balken (ACE, abruptes Klimaereignis) sind Perioden der Klimaverschlechterung. Abb. 1.2 ist nach Vinós (2022).

Herschels detaillierte Sonnenbeobachtungen hätten den 11-jährigen Sonnenzyklus aufdecken können, aber sie fanden während des Dalton-Minimums statt. Diese Entdeckung musste auf Heinrich Schwabe warten, der nach einem hypothetischen Planeten innerhalb der Merkurbahn suchte, der von vielen Astronomen zu jener Zeit als Vulkan bezeichnet wurde. 17 Jahre lang (nur anderthalb Perioden!) machte er detaillierte Sonnenbeobachtungen, um einen Transit von Vulkan unter den Sonnenflecken zu erkennen. Er veröffentlichte seine Sonnenbeobachtungen jedes Jahr, und 1843 berichtete er:

„Aus meinen früheren Beobachtungen, über die ich jedes Jahr in dieser Zeitschrift berichtet habe, geht hervor, dass es eine gewisse Periodizität im Erscheinen der Sonnenflecken gibt, und diese Theorie scheint nach den Ergebnissen dieses Jahres immer wahrscheinlicher zu werden. … Vergleicht man die Zahl der Gruppen mit der Zahl der Tage, an denen keine Flecken zu sehen sind, so wird man feststellen, dass die Sonnenflecken eine Periode von etwa 10 Jahren haben, und dass sie während fünf Jahren dieser Periode so häufig auftreten, dass es während dieser Zeit nur sehr wenige oder gar keine Tage gibt, an denen überhaupt keine Flecken zu sehen sind.“

(Schwabe 1843)

Schwabes Konzept fand wenig Beachtung, bis Alexander von Humboldt 1851 seine Sonnenfleckendaten in sein monumentales Werk Kosmos aufnahm. Vier Astronomen, darunter Rudolf Wolf, Direktor der Berner Sternwarte, bemerkten daraufhin, dass die periodischen Veränderungen der kleinen täglichen Schwankungen des Erdmagnetfeldes in Periode und Epoche mit dem von Schwabe beschriebenen Sonnenfleckenzyklus übereinstimmten. Rudolf Wolf begann daraufhin mit einer systematischen Untersuchung der Sonnenschwankungen, aus der die Sonnenfleckenaufzeichnung hervorging. Heinrich Schwabe wurde 1857 mit der Goldmedaille der Royal Astronomical Society ausgezeichnet, obwohl er Vulkan nicht gefunden hatte (laut Star Trek befindet er sich im Dreifachsternsystem 40 Eridani).

Die Entdeckung des Sonnenzyklus löste eine fieberhafte Suche nach 11-jährigen Perioden in allen Wetteraufzeichnungen aus. In den 1860er Jahren wurden nur drei Artikel über den Zusammenhang zwischen Sonne und Klima veröffentlicht. Im nächsten Jahrzehnt waren es mehr als hundert (Hoyt & Schatten 1997), und in den folgenden Jahrzehnten vervielfachten sie sich weiter. Im Jahr 1958 listete die American Meteorological Society in ihrer Bibliographie 1278 Artikel über die Beziehungen zwischen Sonne und Wetter auf. Die meisten der zwischen 1870 und 1920 durchgeführten Studien zum Thema Sonne und Klima stimmten darin überein, dass es an den meisten Orten, an denen eine gute Korrelation gefunden werden konnte, eine negative Korrelation zwischen Sonnenflecken und Temperaturen gab.

Aus dieser Zeit ragen die Studien von Wladimir Köppen heraus. Köppen schuf ein Klimaklassifizierungssystem, das noch heute verwendet wird, und leistete wesentliche Beiträge zu mehreren Wissenschaftszweigen. Er war einer der bedeutendsten Klimaforscher seiner Zeit und leistete zusammen mit seinem Schwiegersohn Alfred Wegener einen entscheidenden Beitrag zur Milankovitch-Theorie. Köppens Sonnen-Klima-Studien waren rigoros. Sein Artikel von 1873 über die elfjährige Temperaturperiode war der umfassendste seiner Zeit. Im Jahr 1914 aktualisierte er den Artikel. Er kam zu dem Schluss, dass die Sonne tatsächlich eine Periodizität in der Oberflächentemperatur der Erde verursacht, und zwar nicht nur an vielen Orten, sondern auch auf hemisphärischer und globaler Ebene. Zu dieser Zeit konnten die geringen Veränderungen des CO2-Gehalts nicht die Ursache für die von Köppen festgestellten Klimaveränderungen sein.

Um die Jahrhundertwende bestand kein Zweifel daran, dass die 11- und 22-jährigen Sonnenzyklen an den meisten Orten und sogar hemisphärisch und global negativ mit der Oberflächentemperatur korrelierten, während sie in niedrigen und hohen Breiten eine positive und in mittleren Breiten eine negative Korrelation mit dem Niederschlag aufwiesen. Im Jahr 1903 stellte Nordmann fest:

„Die mittlere Erdtemperatur weist eine Periode auf, die im Wesentlichen derjenigen der Sonnenflecken entspricht; die Wirkung der Flecken besteht darin, die mittlere Erdtemperatur zu verringern, d.h. die Kurve, die die Schwankungen dieser Temperatur darstellt, verläuft parallel zur umgekehrten Kurve der Häufigkeit der Sonnenflecken.“

(Hoyt & Schatten 1997).

1.3 Die Solarkonstante und die Diskreditierung des Teilbereichs

Mit der Erfindung des Pyrheliometers durch Claude Poillet im Jahr 1837 begann man, die Menge der auf die Erde einfallenden Sonnenenergie oder die gesamte solare Bestrahlungsstärke (TSI) zu messen. Die Genauigkeit der Daten war im 19. Jahrhundert aufgrund der Unzuverlässigkeit der frühen Instrumente und der mangelnden Standardisierung der frühen Messungen gering. Trotz dieser Unzulänglichkeiten stellten die Astrophysiker jener Zeit fest, dass die Schwankungen der TSI sehr gering sind, woraufhin das Konzept der Solarkonstante entstand. 1878 erfand Samuel Langley das Bolometer und 1890 wurde er Direktor des Smithsonian Astrophysical Observatory. Mit Hilfe von Charles Abbot, der 1906 seine Nachfolge antrat, erstellten sie ein Programm zur Bestimmung der Schwankungen der Solarkonstanten mit Stationen auf Berggipfeln in den USA und Chile. Die Daten aus den Jahren 1923 bis 1954 zeigten geringe Schwankungen im Zusammenhang mit dem Sonnenzyklus von 0,02-0,25 % und einen umstrittenen Anstieg von 0,2 % während des 31-jährigen Zeitraums. Charles Abbot war von der Verbindung zwischen Sonne und Klima überzeugt und schrieb nach dem Ende des Programms in der ersten Ausgabe des nun nach ihm benannten Solar Energy Journal: „Da die Sonnenstrahlung und das Wetter durch identische Schwankungsperioden beeinflusst zu werden scheinen, ist es daher wahrscheinlich, dass Wetterveränderungen durch Sonnenschwankungen hervorgerufen werden.“ Als Beweis für seine These verglich er Sonnenvorhersagen für Niederschlag und Temperatur in St. Louis und Peoria mit den tatsächlichen Wetterdaten von 1854 bis 1939 (Abbot 1957). Dennoch räumte er ein, dass es schwierig sei, signifikante Wetterveränderungen auf so geringe Schwankungen der Solarkonstante zurückzuführen, da er wusste, dass die allgemeine Meinung gegen seine Hypothese war.

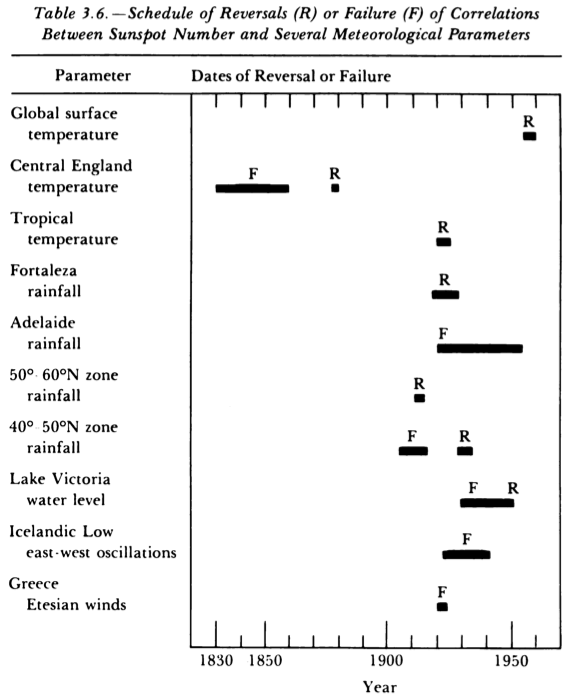

Der damalige Konsens hatte sich von einer Befürwortung des Zusammenhangs zwischen Sonne und Klima zu Beginn des 20. Jahrhunderts zu einer Ablehnung um die Jahrhundertmitte gewandelt. Der Grund für diesen Wandel war eine bessere Bestimmung der Solarkonstante, die zu dieser Zeit noch erhebliche Schwankungen zuließ, aber auch etwas, das um 1920 geschah. All die statistisch signifikanten Korrelationen, die die besten Wissenschaftler der damaligen Zeit, wie Wladimir Köppen, in etwa sieben Jahrzehnten Wetterdaten (ca. 1840-1910) gefunden hatten, begannen um 1920 zu versagen, oder schlimmer noch, sie kehrten sich um, was niemand erklären konnte. Die Situation wurde sehr verwirrend, einige Autoren behaupteten eine positive Korrelation, andere eine negative Korrelation und wieder andere gar keine Korrelation. Es wurden ausgeklügelte Hypothesen vorgeschlagen, die auf ein gestörtes Paradigma hindeuteten, und das gesamte Teilgebiet geriet in Verruf. Um 1950 wurde die Untersuchung der Beziehungen zwischen Sonne und Wetter von vielen als unwürdige Beschäftigung für einen Meteorologen angesehen (Hoyt & Schatten 1997), und dieser Zustand wurde von Abbot in seinem Artikel von 1957 anerkannt.

Abb. 1.3. Grafik einiger Korrelationsumkehrungen (R) und -ausfälle (F) für ausgewählte meteorologische Variablen und Sonnenflecken. Aus Herman & Goldberg 1978.

Abb. 1.3 zeigt den Zeitpunkt der Vorzeichenumkehr bei mehreren Sonnen-Klima-Korrelationen, die sich zwischen 1920-30 häuften (Abb. 1.3). Die Temperaturkorrelation kehrte sich um, ebenso wie viele andere meteorologische Variablen, wie Niederschlag, Winde, die bevorzugte Lage des Islandtiefs und die Stärke des indischen Monsuns. Auch wenn die Vorzeichenumkehr nicht erklärt werden konnte, deutete dies auf eine Beziehung zwischen Sonne und Klima hin, nur nicht auf eine Beziehung, die auf TSI-Änderungen beruht, da die Beziehung zwischen Sonnenemissionen und Sonnenfleckenaktivität nicht umgekehrt ist. Diese wichtige Schlussfolgerung entging den meisten Klimaforschern damals, und sie entgeht auch heute noch vielen von ihnen. Im frühen 20. Jahrhundert waren Klimaverschiebungen unbekannt, aber heute weiß man, dass um 1924 im Pazifik ein Regimewechsel von einer kühlen zu einer warmen Pazifischen Dekadischen Oszillation stattfand (Mantua & Hare 2002). Dieser Wechsel fand unmittelbar nach dem Sonnenminimum von 1923 statt und führte zu einer globalen Erwärmung (der Erwärmung des frühen 20. Jahrhunderts), obwohl die Sonnenaktivität bis 1934 unter dem Durchschnitt lag.

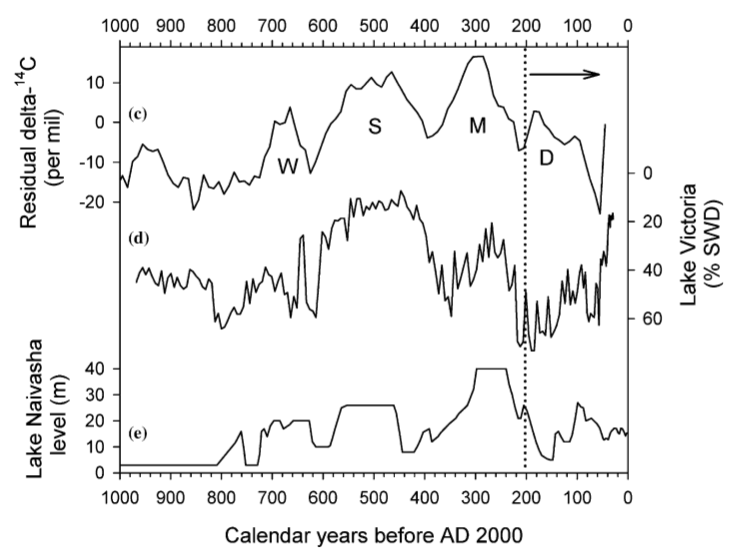

Abb. 1.4. Eine 2005 gemeldete Umkehrung der Korrelation zwischen Sonne und Niederschlag um 1800. Dargestellt sind: c) Veränderung des atmosphärischen 14C als inverser Indikator für die Sonnenaktivität. W, S, M, D entsprechen den Wolf-, Spörer-, Maunder- und Dalton-Minima. d) Pegel des Victoria-Sees, abgeleitet aus Flachwasserdiatomeen (SWD) in einem Bohrkern. e) Pegel des Naivasha-Sees (Kenia) in Metern. Die gestrichelte vertikale Linie und der Pfeil markieren eine Umkehrung des Sonnenklimas während des Dalton-Sonnenfleckenminimums. Aus Stager et al. 2005.

Nach Hoyt und Schatten (1997) haben die Korrelationen zwischen Sonne und Temperatur in den letzten 400 Jahren mehrmals das Vorzeichen gewechselt und waren zwischen etwa 1600-1720 und 1800-1920 negativ und zwischen etwa 1720-1800 und 1920 bis heute positiv. Die Umkehrung um 1800 ist in Abbildung 1.4 dargestellt.

1.4 Roger Bray, John Eddy und die Wiederbelebung in den 1970er Jahren

Während das Teilgebiet Sonne-Klima in Verruf geriet, wurde die Saat für seine Wiedergeburt gelegt. Andrew Douglass war ein Astronom, der 1901 von Percival Lowell wegen seiner Skepsis gegenüber der künstlichen Natur der Marskanäle entlassen worden war. Während seiner gesamten Laufbahn war Douglass von der Wirkung der Sonne auf das Klima überzeugt, und 1904 stellte er eine Korrelation zwischen der Breite der Jahresringe in Arizona, die mit den Niederschlagsverhältnissen zusammenhängt, und den Sonnenflecken fest. Indem er diese Beziehung verfolgte, entwickelte er in den folgenden 40 Jahren das neue Teilgebiet der Dendrochronologie, die bis zur Einführung der Radiokohlenstoffdatierung die einzige präzise Methode zur Datierung alter Strukturen war. Douglass untersuchte die Jahresringe von Bäumen im Zusammenhang mit dem Klima und der Sonnenaktivität und war der Entdecker des hundertjährigen Sonnenzyklus (den er Triple-Triple-Sonnenzyklus nannte). Er fand ihn nicht in den Aufzeichnungen über Sonnenflecken, sondern in den klimatischen Auswirkungen auf das Wachstum der Mammutbaumringe (Douglass 2019). Es ist der einzige Fall eines Sonnenzyklus, der erstmals in den Aufzeichnungen zum Paläoklima identifiziert wurde.

Willard Libby entwickelte die Radiokohlenstoffdatierung in den späten 1940er Jahren. Damit die Verfahren genau waren, musste man wissen, wie sich das atmosphärische 14C/12C-Verhältnis im Laufe der Zeit verändert hatte. Die Wissenschaftler mussten eine Kalibrierungskurve (IntCal) aus präzise datierten Baumringen nach der dendrochronologischen Methode von Douglass erstellen, um die Radiokohlenstoffverhältnisse in Kalenderalter umzuwandeln. Hans Suess in Kalifornien und Minze Stuiver in Arizona gehörten zu den Vorreitern dieser Bemühungen. 1961 war Stuiver der erste, der vorschlug, dass die atmosphärischen 14C-Schwankungen, die einige Jahrhunderte oder weniger andauern, auf die solare Modulation der 14C-Produktion durch kosmische Strahlung in der oberen Atmosphäre zurückzuführen sind (Stuiver & Quay 1980). Plötzlich schien die Sonne über lange Zeiträume hinweg variabler zu sein, als die jüngsten Messungen der Solarkonstanten vermuten ließen.

Diese Erkenntnis eröffnete die Möglichkeit, die kürzlich rekonstruierten 14C-Veränderungen zur Untersuchung der Sonnenvariabilität und ihrer Beziehung zu klimatischen Veränderungen in der fernen Vergangenheit zu nutzen. Ab 1963 schlug Roger Bray auf der Grundlage seiner glaziologischen und botanischen Studien vor, dass es eine enge Beziehung zwischen der Sonnenaktivität und dem Klima in den vergangenen Jahrhunderten und Jahrtausenden gibt. Im Jahr 1968 identifizierte er den 2500-jährigen Sonnen- und Klimazyklus, der kürzlich nach ihm benannt wurde (Vinós 2016). Dieser lange Sonnenzyklus ist in Bezug auf die klimatischen Auswirkungen während des Holozäns der wichtigste. Der jüngste Tiefpunkt des Bray’schen Sonnenzyklus, 1388-1834 (Bray 1968), fällt mit der von François Matthes 1939 entdeckten Kleinen Eiszeit (LIA) zusammen. Roger Bray war der erste, der vorschlug, dass die LIA eine solare Ursache hatte. In den 1960er und 1970er Jahren veröffentlichte Roger Bray 14 Artikel in Nature und Science, in denen er die Sonnenvariabilität und die vulkanische Aktivität mit dem Klimawandel in Verbindung brachte. Da er jedoch ein Botaniker war, der das Klima unabhängig von Neuseeland erforschte und von anderen Sonnen-Klima-Wissenschaftlern getrennt war, wurden seine Erkenntnisse zu Unrecht nicht anerkannt. Sein Zyklus erhielt von Paul Damon und Charles Sonnet (Damon & Sonnet 1991) den absurden Namen „Hallstatt“, obwohl sie von Brays Arbeit wussten.

1974 veröffentlichte Robert Currie eine Studie über 226 Wetterstationen in der ganzen Welt, die 1993 anhand von 1200 US-Stationen aktualisiert wurde. Unter Verwendung neuer statistischer Methoden, die er gerade entwickelt hatte, stellte er bei vielen Stationen sowohl ein 10,5-Sonnen- als auch ein 18,9-Mond-Signal fest, entschied aber, dass lokale Effekte das regionale Signal bei einigen Stationen überdecken könnten. Interessanterweise stellte er fest, dass Stationen östlich der Rocky Mountains eine positive Korrelation zwischen Sonnenaktivität und Temperatur aufwiesen, während Stationen westlich der Rocky Mountains eine negative Korrelation zeigten (Currie 1993), ein Effekt, der der in den 1920er Jahren beobachteten Signalumkehr in der Korrelation nicht unähnlich ist. 1980 entdeckte Currie ein 11-jähriges Signal des Sonnenfleckenzyklus in der Erdrotation. Er war nicht der erste, der dies nach der Erfindung der Atomuhr tat, aber da die Auswirkungen der Sonne auf die Erde so umstritten sind (wahrscheinlich wegen des Fehlens eines anerkannten Mechanismus), wurde der Effekt der Sonne auf die Erdrotation mehrfach unabhängig voneinander „entdeckt“, zuletzt im Jahr 2010, und er wird weiterhin ignoriert.

Der erste brauchbare Mechanismus für den Sonnenklimaeffekt wurde jedoch 1974 von Colin Hines vorgeschlagen. Ein Jahr zuvor hatten Wilcox et al. (1973) entdeckt, dass die Struktur des Magnetfeldsektors der Sonne die durchschnittliche Fläche der Tiefdruckgebiete während des Winters auf der Nordhalbkugel in einer Höhe von 300 mb (etwa 9.100 Meter) beeinflusst. Hines (1974) war skeptisch in Bezug auf einen Sonnen-Klima-Effekt, schlug aber vor, dass planetarische Wellen, die in der oberen Atmosphäre einer variablen Reflexion ausgesetzt sind, in der unteren Atmosphäre variable Interferenzmuster hervorrufen können. Diese könnten ein möglicher Kandidat für den Effekt sein, wenn er denn real wäre.

Ein weit verbreiteter Artikel von Joe King (1975) trug viel dazu bei, das erneute Interesse an den Beziehungen zwischen Sonne und Klima zu fördern, indem er eine Vielzahl von Beweisen präsentierte und zu dem Schluss kam, dass:

„Die angehäuften Beweise sind so zwingend, dass es nicht mehr möglich ist, die Existenz starker Verbindungen zwischen dem Wetter und den Strahlungsveränderungen zu leugnen.“

King, 1975

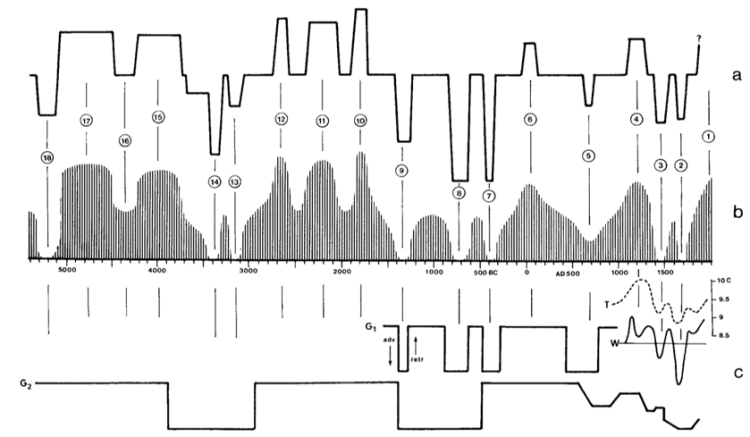

Dies bereitete den Boden für John Eddys bahnbrechenden Artikel in Science ein Jahr später. Eddy brachte die vergessene Entdeckung von Gustav Spörer und Edward Maunder ans Licht, dass sich die Sonne in der Zeit von 1645 bis 1715 sehr ungewöhnlich verhielt und nur sehr wenige Sonnenflecken aufwies. Eddy, der sich sehr für die Geschichte der Astronomie interessierte, untermauerte diese Feststellung mit Sonnenfleckenbeobachtungen mit bloßem Auge, Polarlichtbeobachtungen, Finsternisbeobachtungen und 14C-Daten (Eddy 1976). Der Science-Artikel über das Maunder-Minimum erlangte enorme Popularität. Eddy veröffentlichte daraufhin mehrere Artikel über die Beziehung zwischen Sonne und Klima in den letzten 7500 Jahren (Abb. 1.5).

Abb. 1.5. Interpretation der Sonne-Klima-Beziehung für die letzten 7500 Jahre von John Eddy. Eingezeichnet sind: a) Schematische 14C-Variabilität mit 18 Abweichungen vom Normalwert. Die Zahlen 2 und 3 entsprechen den Maunder- und Spörer-Minima. b) Langfristige Hüllkurven-Interpretation des Sonnenzyklus‘ auf der Grundlage der 14C-Daten. c) Klimaschätzungen. G1, Alpengletscher; G2, weltweite Gletscher; T, Temperatur in England; W, Winterhärte für den Raum Paris-London. Aus Eddy 1977.

George Siscoe zog eine optimistische Bilanz des goldenen Jahrzehnts der Sonnen-Klima-Forschung der 1970er Jahre (Siscoe 1978) und nannte drei wichtige Fortschritte. Die von Wilcox und Eddy sowie die Studien, die die Dürre im nordamerikanischen Südwesten mit dem 22-jährigen Hale-Zyklus des magnetischen Sonnenlichts in Verbindung bringen. Doch obwohl das Teilgebiet Sonne-Klima wieder vor Aktivität strotzte und gut besuchte Tagungen stattfanden, wurde es angesichts seiner interdisziplinären und kontroversen Natur immer noch kritisiert. Barrie Pittock veröffentlichte einen kritischen Blick auf 140 Sonnenklima-Artikel (Pittock 1978) und kam zu dem Schluss, „dass es trotz einer umfangreichen Literatur zu diesem Thema derzeit wenig oder keine überzeugenden Beweise für statistisch signifikante oder praktisch nützliche Korrelationen zwischen Sonnenfleckenzyklen und dem Wetter oder dem Klima gibt.“

1.5 Die globale Erwärmung der 1980er Jahre und das zweite Ende der Sonne-Klima-Verbindung

In den 1980er Jahren wurde die Sonne-Klima-Renaissance der 1960er und 1970er Jahre durch Verbesserungen bei der Messung der Solarkonstanten ausgebremst. Hohlraumradiometer wurden erstmals im November 1978 im Earth Radiation Budget Experiment an Bord des Satelliten Nimbus 7 eingesetzt. Das ACRIM-Experiment (Active Cavity Radiometer Irradiance Monitor) begann mit der Mission zum Sonnenmaximum im Februar 1980. Zum ersten Mal erreichten die Werte der Solarkonstanten die Präzision von zwei Dezimalstellen eines Prozents. Die Abnahme der Solarkonstante vom Maximum des Sonnenzyklus 1980 bis zum Minimum 1986 wurde mit 0,15% oder 2 W/m2 bestimmt. Die jährliche Änderung wurde jedoch bereits 1982 mit nur 0,02 % angegeben. Die große Mehrheit der Forscher glaubte, dass nur Änderungen der Gesamtenergie das Klima beeinflussen könnten, und dass eine Änderung von ± 0,07 % keine signifikanten Auswirkungen haben könne. Diejenigen, die die Idee vertraten, dass kleine solare Veränderungen auf atmosphärische Instabilitäten einwirken könnten, die ihre klimatische Wirkung verstärkten, konnten nicht erklären, wie sie dies in einer von Natur aus instabilen Atmosphäre tun konnten.

Im Jahr 1980 schienen Nastrom und Belmont herausgefunden zu haben, wie der Sonne-Klima-Effekt funktioniert. Anhand der Radiosondendaten von 174 Stationen in der nördlichen Hemisphäre für den Zeitraum 1949-1973 stellten sie fest, dass die Winde in der Troposphäre ein eindeutiges Sonnensignal aufweisen. Sie stellten fest, dass Windgeschwindigkeit und Temperatur auf den Sonnenzyklus reagierten und der Effekt im Winter in der Nähe der Tropopause maximal war (Nastrom & Belmont 1980). Im Jahr 1983 erklärten dieselben Autoren ihr Ergebnis nach weiteren Tests für statistisch unbedeutend (Venne et al. 1983). Ebenfalls 1980 veröffentlichte Minze Stuiver, die Autorität auf dem Gebiet der Radiokohlenstoffdatierung, die 1961 die Rekonstruktion der vergangenen Sonnenaktivität initiiert hatte, einen einflussreichen Artikel in Nature, in dem er die neue detaillierte 14C-Variabilitätsrekonstruktion mit mehreren langen Klimaaufzeichnungen verglich (Stuiver 1980). Er kam zu dem Schluss, dass Perioden geringer Sonnenaktivität wie das Maunder-Minimum in den letzten 6.000 Jahren mehrmals aufgetreten waren und dass eine Beziehung zwischen Klimareihen und der aus 14C abgeleiteten Aufzeichnung der Sonnenaktivität für das letzte Jahrtausend nicht hergestellt werden konnte.

Minzes Artikel demontierte die Arbeit von John Eddy. Zwei Jahre später bestätigte Eddy den Tod der Sonnen-Klima-Studien als Mainstream-Wissenschaft:

„Messungen von Raumsonden haben ergeben, dass die gesamte Strahlungsleistung der Sonne um 0,1-0,3% schwankt. … Es ist zu erwarten, dass solche Veränderungen die Temperatur der Erdoberfläche um einen Bruchteil eines Grades Celsius verändern, und es wurden wahrscheinliche Beweise für dieses von der Sonne verursachte Signal gefunden. Obwohl der Effekt für das Verständnis des Klimasystems wichtig ist, ist er zu gering, um für praktische Wetter- oder Klimavorhersagen von Bedeutung zu sein.“

(Eddy et al. 1982)

Wie ein altes Sprichwort sagt: „Leg mich einmal rein, schäm dich, leg mich zweimal rein, schäme ich mich“. Die Sonnen-Klima-Forscher wurden in den 1920er und 1980er Jahren zweimal zum Narren gehalten; das sollte sich nicht wiederholen. Das Teilgebiet geriet in absoluten Verruf. Nichts, was die Worte „Sonne“ und „Klima“ im selben Satz enthielt, sollte mehr ernst genommen werden. Das Timing war perfekt für die CO2-Hypothese des Klimawandels, denn die globale Erwärmung begann zum zweiten Mal im 20. Jahrhundert, und dieses Mal konnte es nicht die Sonne sein. Jeder, der dies vorschlug, musste mit Spott und einer unbedeutenden Karriere rechnen. Es ist ein Punkt erreicht, an dem selbst eindeutige Sonneneffekte auf die Erdrotation oder die El Niño/Southern Oscillation peinlich genau ignoriert werden.

Beim Vergleich der Sonnenaktivität muss die Länge der einzelnen Sonnenzyklen berücksichtigt werden. Oben in Abb. 1.6 wird die Summe der Sonnenflecken für jedes Jahr im Zyklus durch die Anzahl der Jahre im Zyklus geteilt, und vom Ergebnis wird der Sonnenfleckendurchschnitt von 1700-2020 abgezogen. Das Ergebnis wird als Balkendiagramm dargestellt, wobei die Breite der Balken proportional zur Dauer des Zyklus‘ ist. Die Linie ist die lineare Regressionstrendlinie. Der untere Teil von Abb. 1.6 zeigt die jährliche internationale Sonnenfleckenzahl aus WDC-SILSO. Der Zeitraum 1934-2008 ist der 75-jährige Zeitraum mit der höchsten Sonnenaktivität seit mindestens 700 Jahren, da die Sonnenaktivität während der LIA nach ca. 1270 bekanntlich sehr niedrig war. Dieser Zeitraum wird als das moderne Sonnenmaximum bezeichnet. Die enge zeitliche Übereinstimmung zwischen der 75-jährigen Periode mit der höchsten Sonnenaktivität und der 75-jährigen Periode mit der höchsten globalen Erwärmung (1925-2000) seit 700 Jahren ist wahrscheinlich kein Zufall und verdient eine gründliche Untersuchung, die derzeit nicht stattfindet (von Vinós 2022).

Für diejenigen, die ihre Karriere fortsetzen wollten, war der Umschwung vollzogen. Wilcox, Svalgaard und Scherrer veröffentlichten 1976 „On the reality of a sun-weather effect“ (Wilcox et al. 1976). Sie waren kurz davor, das Problem zu lösen. Sie befanden sich im richtigen Teil des Planeten (den Extratropen der nördlichen Hemisphäre), am richtigen Ort (der oberen Troposphäre und der unteren Stratosphäre), zur richtigen Jahreszeit (im Winter), betrachteten die richtige Variable (den Luftdruck) und konnten einen eindeutigen Effekt feststellen. Dass der Sonne-Klima-Effekt in arktischen Breiten im Winter stärker ist, ist eine weitere Bestätigung dessen, was aus der Umkehrung der Sonne-Wetter-Korrelation abgeleitet werden konnte: Die Sonne kann das arktische Winterklima nicht durch Änderungen des TSI beeinflussen, weil es während der Polarnacht keine Sonneneinstrahlung gibt, und in der Arktis spielt es keine Rolle, wie klein oder groß die TSI-Änderungen bei einer nicht scheinenden Sonne sind. Es muss also ein anderer Mechanismus vorhanden sein.

Colin Hines (1974) hatte den Sonnen-Klima-Mechanismus bereits auf der Grundlage der Ergebnisse von Wilcox et al. identifiziert; es handelte sich um die unterschiedliche Ausbreitung und Reflexion planetarischer Wellen aufgrund von Änderungen der zonalen Windgeschwindigkeit. Die gleichen Veränderungen wurden von Nastrom und Belmont festgestellt und später verworfen. Doch Wilcox et al. zogen sich zurück. Sie büßten ihre Chance ein, in dieser 200 Jahre alten klimatologischen Untersuchung den Beweis für einen Sonnenklimaeffekt zu finden. Diese Ehre sollte einer Frau zuteil werden, die sich mehr für die Wissenschaft als für ihre Karriere oder ihren Ruf interessierte. Der Mitautor von Wilcox et al., Leif Svalgaard, hat in den letzten Jahren jede Andeutung, dass die Sonnenvariabilität zur modernen globalen Erwärmung beigetragen haben könnte, energisch zurückgewiesen und unermüdlich für eine umstrittene Änderung der Sonnenfleckenaufzeichnung geworben, die seine Ansichten besser unterstützt.

1.6 Karin Labitzke und der unbestätigte erste solide Nachweis eines Sonnensignals

1982 veröffentlichte der National Research Council eine Monographie über „Solar Variability, Weather, and Climate“. Sie liest sich wie ein Totenschein für das Teilgebiet. Sie enthält u. a. Artikel von James Holton und Barrie Pittock und stand unter dem Vorsitz von John Eddy. James Holton, einer der führenden Experten auf dem Gebiet der Atmosphäre, analysierte die möglichen physikalischen Mechanismen für einen Sonne-Klima-Effekt durch eine dynamische Kopplung zwischen der Stratosphäre und der Troposphäre in einem negativen Licht (Holton 1982). Bei der Betrachtung des Mechanismus von Hines (1974) räumte Holton ein, dass Veränderungen in der stratosphärischen Strömung, die mit der Sonnenvariabilität zusammenhängen, die Reflexion/Absorption planetarischer Wellen verändern und durch Welleninterferenz Effekte in der Troposphäre erzeugen könnten. Für ihn stellte dieser Mechanismus eine mögliche Verbindung zwischen der Sonnenvariabilität und dem Wetter und Klima in der Troposphäre dar, die trotz des enormen Energieunterschieds zwischen dem solaren Input und der Klimareaktion von Bedeutung sein könnte. Er kam jedoch zu dem Schluss, dass dieser Mechanismus spekulativ sei.

Zwei Jahre zuvor hatten Holton und Tan (1980) einen bahnbrechenden Artikel veröffentlicht, in dem sie zeigten, dass äquatoriale Stratosphärenwinde, obwohl sie die Erde in großer Höhe über dem Äquator umkreisen, die globale Zirkulation modulieren. Diese Winde sind als Quasi-Biennial Oscillation (QBO) bekannt, weil sie mit einer Quasiperiodizität von etwas mehr als zwei Jahren zwischen östlicher und westlicher Richtung wechseln. Die von Holton und Tan entdeckte Auswirkung der QBO auf die Zirkulation in der nördlichen Hemisphäre bestand darin, dass sie das mittlere Geopotential (Druck) am Pol während des Winters über planetarische Wellen veränderte. Dieser Befund hätte alle möglichen Fragen über eine mögliche Beteiligung der Sonnenaktivität aufwerfen müssen, da er eindeutig mit den Ergebnissen von Wilcox et al. zusammenhing und den Mechanismus der planetarischen Wellen von Colin Hines einbezog, aber zu der Zeit war (und ist) eine solare Erklärung für die meisten Wissenschaftler inakzeptabel. Im Winter umkreisen starke Westwinde die Polarregion und umkreisen einen Kaltluftkörper, den man Polarwirbel nennt. Die Modulation des Nordpolarwirbels durch die QBO ist so wichtig, dass er den Namen „Holton-Tan-Effekt“ erhielt. Interessanterweise war die Modulation des nordpolaren Geopotenzials durch die QBO nur während der Wintersaison von Bedeutung, wenn der mittlere zonale Wind westlich ist und sich vertikal ausbreitende planetarische Wellen vorhanden sind. Holton und Tan mussten die Bedingung der planetarischen Wellen einführen, weil die Korrelation zu bestimmten Zeiten zusammenbrach.

Karin Labitzke (1987) stellte fest, dass die Korrelation zwischen Polarwirbel und QBO manchmal während der westlichen Phase des QBO zusammenbrach, aber nur, wenn die Sonnenaktivität nahe ihrem zyklischen Maximum war. Sie beschloss, die Daten über die stratosphärischen Polartemperaturen nach QBO-Phasen zu trennen. Die sehr geringe Korrelation zwischen der Sonnenaktivität und den polaren Temperaturen, wenn alle Daten berücksichtigt werden, wird mit den getrennten Daten sehr hoch (Abb. 1.7). Nach 186 Jahren hatte Labitzke die von William Herschel 1801 begonnene Aufgabe gelöst. In einem Folgeartikel mit Harry van Loon (Labitzke & van Loon 1988) dehnten sie die Studie über den Einfluss der Sonne auf den winterlichen atmosphärischen Druck und die Temperatur auf die Troposphäre der nördlichen Hemisphäre aus. Die wichtigste Schlussfolgerung aus dieser Arbeit ist, dass das Signal des QBO in der außertropischen Stratosphäre in solaren Minima verstärkt und in solaren Maxima abgeschwächt wird. Die Tatsache, dass die QBO-Orientierung den solaren Effekt von einem Vorzeichen in sein Gegenteil verkehrt, ist nicht unähnlich anderen Korrelationsvorzeichen-Umkehrungen beim Sonne-Klima-Effekt und ein dritter Hinweis darauf, dass der Effekt nicht nur durch Änderungen des TSI verursacht werden kann.

In dem unentbehrlichen Handbuch Physics of Climate von Peixoto und Oort (1992) wurden die Ergebnisse von Labitzke und van Loon angemessen gewürdigt. Nachdem sie erklärt hatten, dass dies der überzeugendste statistische Beweis für eine Beziehung zwischen Sonne und Wetter ist, den man gefunden hat, fahren sie fort:

„Selbst an der Erdoberfläche sind die Korrelationen zwischen der Sonnenaktivität und dem Druck auf dem Meeresspiegel oder der Temperatur … ungewöhnlich hoch und scheinen einen bedeutenden Teil der gesamten interannualen Variabilität der Winterzirkulation zu erklären“

(Peixoto & Oort 1992)

Labitzkes Beendigung der 186-jährigen Suche nach einem Sonnen-Klima-Effekt, die 1801 von William Herschel eingeleitet wurde, hätte jedoch zu keinem ungünstigeren Zeitpunkt kommen können. Die globale Erwärmung wurde bereits dem CO2 angelastet, und das wissenschaftliche Dogma war völlig gegen ihre Erkenntnisse, da alle Sonnen-Klima-Studien diskreditiert worden waren. James Holton sagte:

„Oberflächlich betrachtet kann ich nichts Falsches daran finden, aber es gibt absolut keine physikalische Grundlage, und das stört mich. Diese Leute haben die höchste Korrelation, die ich je gesehen habe, aber wenn ich ein Wettender wäre, würde ich dagegen wetten.“

(Kerr, 1987)

Sie hatte eine klare und unbestreitbare Auswirkung der Sonnenaktivität auf das Klima gefunden. Sie konnte nicht bestritten werden, aber sie konnte ignoriert werden. Und man würde sie ignorieren als eine Kuriosität mit wenig praktischer Wirkung, die keinen Platz im modernen Klimaverständnis hat.

In Abb. 1.7 ist Folgendes dargestellt: A) Fehlender Zusammenhang zwischen der Stratosphären-Wintertemperatur am Nordpol und der Sonnenaktivität (10,7 cm Sonnenfluss), wenn die Daten aller Jahre berücksichtigt werden. B) zeigt eine deutlich positive Korrelation, wenn nur die Jahre der westlichen QBO-Phase berücksichtigt werden. Nicht gezeigt ist die deutlich negative Korrelation, wenn nur Jahre mit QBO-Ostphase berücksichtigt werden (Abb. 1.7 stammt von Kerr 1987).

1.7 Auswirkungen

Der wissenschaftliche Konsens über einen bedeutenden Sonnen-Klima-Effekt hat sich von der Ablehnung vor 1850 über die Befürwortung in den 1860er bis 1920er Jahren, die Ablehnung in den 1920er bis 1960er Jahren, die Befürwortung in den 1960er bis 1970er Jahren und die Ablehnung seit den 1980er Jahren verändert. Das zeigt nur, dass der wissenschaftliche Konsens in der Wissenschaft keinen Platz hat. Die Meinung eines Wissenschaftlers ist keine Wissenschaft. Nur Beweise machen Wissenschaft aus. Auch wenn Beweise verworfen oder ignoriert werden können, bleiben sie bestehen und warten auf den Zeitpunkt, an dem sie richtig bewertet werden.

Der Niedergang des Teilgebiets Sonne-Klima in den frühen 1980er Jahren entmutigte weitere Forschungen darüber, wie die Sonnenvariabilität das Klima beeinflusst. Das Erstarken der politisch unterstützten CO2-Hypothese des Klimawandels machte das Teilgebiet zu einer wissenschaftlichen Sackgasse. Nur eine Handvoll Forscher entschied sich, den hohen Preis für Ansehen und Karriere zu zahlen, der mit der Verfolgung dieses Forschungsinteresses verbunden war. Der schwierige Forschungsgegenstand der Sonne-Klima-Beziehung hat zwischen 1870 und 1980 kaum Fortschritte gemacht, wenn man die Menge der investierten Forschungsarbeit bedenkt. Die Umwandlung in ein anrüchiges Forschungsgebiet nach 1980 hat trotz der rasanten Fortschritte in der Klimatologie in den folgenden Jahrzehnten zu einer Verlangsamung des Fortschritts geführt.

Sonnenklimaforscher müssen sich damit abfinden, dass ihre Erkenntnisse nicht anerkannt werden, dass es schwieriger ist, ihre Ergebnisse in guten Fachzeitschriften zu veröffentlichen, dass sie keine guten Studenten bekommen und dass sie von ihren Fachkollegen gering geschätzt werden. Aus diesem Grund haben sie Schwierigkeiten, in ihrer Karriere voranzukommen, und die Quote des beruflichen Scheiterns unter jungen Wissenschaftlern, die in dieses Teilgebiet einsteigen, ist hoch. Eine Ausnahme bilden die Sonnen-Klimaforscher, die davon ausgehen, dass die Sonnenvariabilität nicht wesentlich zur modernen Erwärmung beigetragen hat. Diese sind gut angesehen, werden viel zitiert, tragen zu den IPCC-Berichten bei und produzieren manchmal geringe solare Variabilität für Klimamodelle.

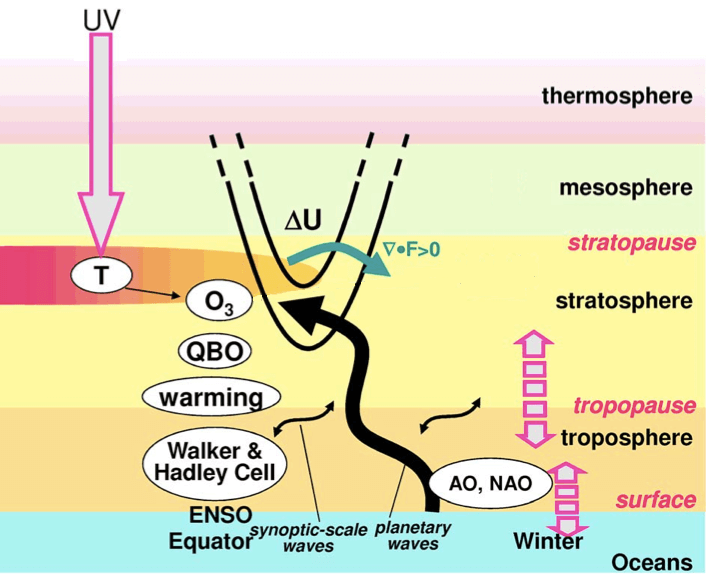

Trotz dieser Schwierigkeiten taucht der Sonne-Klima-Effekt immer wieder auf, wenn Modelle versuchen, reale Phänomene zu reproduzieren, und wenn Reanalysen mit realen Klimadaten gefüttert werden, und trotzt so manchem Versuch, ihn zu verbergen. 1996 zeigte Joanna Haigh in einem bahnbrechenden Artikel in Science, dass Veränderungen in der atmosphärischen Zirkulation, die in Modellen nur schwach wiedergegeben werden, eindeutig einen solaren Ursprung haben (Haigh 1996). Tropische Ozonveränderungen schienen entscheidend für den Effekt im Modell zu sein. Es wurde bald klar, dass die Änderungen des TSI während des Sonnenzyklus nicht genug Energie enthielten, um die beobachteten Klimaeffekte zu erklären. Daher wurde angenommen, dass eine Art Verstärkungsmechanismus dafür verantwortlich war. Obwohl die Klimamodelle bis vor kurzem die Stratosphäre nicht berücksichtigten, entwickelte Haigh den so genannten „Top-down-Mechanismus“ zur Verstärkung des solaren Effekts auf das Klima (Abb. 1.8).

In Abb. 1.8 wirkt die solare UV-Strahlung auf die Ozonschicht in der Stratosphäre und erhöht deren Temperatur (T) und die Ozonmenge (O3). Die Temperaturänderung verändert den latitudinalen Temperaturgradienten und wirkt sich über die thermische Windbilanz auf die zonal-gemittelten zonalen Winde (ΔU) aus. Die Änderung der zonalen Winde verändert die Eigenschaften der Atmosphäre für die Ausbreitung planetarer Wellen. Der Effekt führt zu einer anomalen Divergenz (>0) des Eliassen-Palm-Flusses (F), der proportional zur potentiellen Vorticity* ist, und verändert die Ablagerung von Impuls und kinetischer Energie. Die Stärke des Polarwirbels (nicht gezeigt) hängt von diesen Veränderungen ab und treibt Veränderungen der Arktischen Oszillation (AO), der Nordatlantischen Oszillation (NAO) und der Hadley- und Walker-Zirkulationen an. Die dicken unterbrochenen Pfeile zeigen die Kopplung an. Die Abbildung ist nach Gray et al. 2010.

[*Für den Begriff „Vorticity“ oder „Wirbelgröße“ gibt es keine bessere deutsche Entsprechung. Man könnte ihn als Wirbel-Intensität betrachten. Eine ausführlichere Erklärung dieses Begriffs würden den Rahmen dieses Beitrags sprengen. In der Wettervorhersage ist die Vorticity ein zentrales Element. Ein Googeln nach diesem Begriff gibt mehrere Treffer, z. B. hier. A. d. Übers.]

Die derzeitige orthodoxe Sichtweise des Sonne-Klima-Effekts lässt sich in Judith Leans Bericht von 2017 zusammenfassen. Der Anstieg der Gesamtbestrahlungsstärke um 0,1 % zwischen Sonnenminimum und -maximum ist mit einem Anstieg der globalen Oberflächentemperatur der Erde um 0,1 °C verbunden. Es gibt dynamische Prozesse, die die regionale Reaktion sowohl an der Oberfläche als auch in der Atmosphäre verändern. Die Auswirkung eines großen solaren Minimums wie des Maunder-Minimums ist wahrscheinlich geringer als ein paar Zehntel °C globale Abkühlung (Lean 2017). In den folgenden fünf Teilen dieser Artikelserie werden wir die kürzlich vorgeschlagene Winter-Gatekeeper-Hypothese zum Einfluss der Sonne auf das Klima erläutern (Vinós 2022). Sie beinhaltet einige sehr komplexe Klimaphänomene, was erklärt, warum sie 220 Jahre lang unentdeckt blieb. Im nächsten Teil werden wir sehen, dass die orthodoxe, vom IPCC sanktionierte Sicht des Klimawandels die Auswirkungen der Sonnenvariabilität auf mindestens fünf sehr wichtige klimabezogene Phänomene ignoriert, die sie im Wesentlichen widerlegen. Es ist zu hoffen, dass die Zeit für eine weitere Umkehrung des Sonne-Klima-Konsens‘ gekommen ist.

Anmerkung: Dies ist der erste Teil einer sechsteiligen Serie über die Auswirkungen der Sonnenvariabilität auf den Klimawandel. Javiers vorherige 13-teilige Serie zum Klimawandel wurde zwischen 2016 und 2018 veröffentlicht und kann auf judithcurry.com gelesen werden, indem man „Nature Unbound“ in das Suchfeld eingibt. Sie erzeugte über 4.000 Kommentare und war die Grundlage für sein im September 2022 erschienenes Buch „Climate of the Past, Present and Future. A Scientific Debate, 2. Aufl., in dem ein Teil des Materials dieser Serie enthalten ist.

Die Bibliographie kann hier heruntergeladen werden.

Eine Liste der verwendeten Abkürzungen kann hier heruntergeladen werden.

Dieser Beitrag wurde in leicht veränderter Form zuerst auf Climate Etc. veröffentlicht.

Übersetzt von Christian Freuer für das EIKE