Zahlen – verzwickte, verzwickte Zahlen: Teil 2: Man darf (kann) Temperaturwerte nicht mitteln

[Alle Hervorhebungen in diesem Beitrag im Original! A. d. Übers.]

Beginnen wir mit dieser einfachen Aussage – sie ist wahr, aber mit einigen Vorbehalten gegenüber dem gesunden Menschenverstand verbunden.

In diesem Aufsatz geht es um einen wissenschaftlichen Punkt: Man kann keine durchschnittliche Temperatur messen! Diese Tatsache kann sich auf Ihr Verständnis einiger unterstützender Punkte der Klimawissenschaft auswirken.

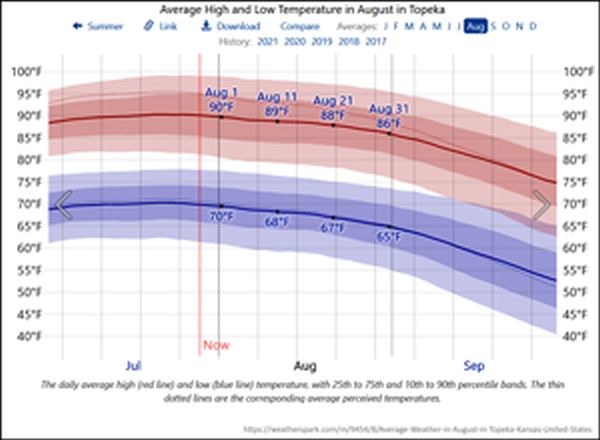

Nehmen wir an, Sie betreiben eine Website für Unternehmen, die im August eine Tagung in Topeka, Kansas, abhalten wollen, und Sie möchten die Teilnehmer darüber informieren, welches Wetter sie in Bezug auf die Temperatur erwarten können, damit sie geeignete Kleidung für die Reise einpacken können. Ein Diagramm wie unten ist sehr gut geeignet. Sie zeigt den Durchschnitt der historischen Höchst- und Tiefsttemperaturen für jeden Tag des Monats und stellt diese als Spanne und nicht nur als Zahl dar. Sie gibt eine vernünftige Antwort auf die Unternehmensfrage: „Wie ist das Wetter im August in Topeka?“ Die Antwort: Heiße Tage und angenehm warme Nächte. Also, tagsüber Reden und Präsentationen im klimatisierten Auditorium und abends das Tiki-Bar-Luau am Hotelpool, das ist definitiv angesagt!

In diesem Fall haben sie nicht wirklich versucht, die „Durchschnittstemperaturen“ zu ermitteln – sie haben einfach die Zahlen über die Temperaturen gemittelt, um einen erwarteten Bereich historischer Höchst- und Tiefstwerte zu finden – sie glauben nicht, dass es sich dabei um eine reale Temperatur handelt, die gemessen werden könnte – sie räumen ein, dass es sich um einen eher vagen, aber nützlichen Bereich erwartbarer täglicher Höchst- und Tiefstwerte handelt.

Dieser akzeptable und vernünftige Ansatz ist etwas ganz anderes, als die Höchsttemperaturen von San Diego, Los Angeles, Mohave und Palm Springs zu nehmen, sie zu addieren, durch vier zu teilen und zu verkünden, dass man den Temperaturdurchschnitt der südwestlichen kalifornischen Wüste ermittelt hat. Sie mögen ein absolut korrektes – auf viele Dezimalstellen genaues – mathematisches Mittel der verwendeten Zahlen haben, aber Sie werden nichts wie eine numerische Temperatur oder ein physikalisch sinnvolles Ergebnis erhalten haben. Welchen numerischen Mittelwert Sie auch immer gefunden haben, er wird die physikalische Realität der „Temperatur“ nirgendwo repräsentieren, schon gar nicht in der Region, die Sie interessiert.

„Aber, aber, aber, aber“ ….. kein Aber!

Man kann die Temperatur nicht mitteln!

Warum nicht? Die Temperatur ist doch nur eine weitere Zahl, oder nicht?

Die Temperatur ist nicht nur eine Zahl – die Temperatur ist die Zahl der – die Zählung oder Messung einer der verschiedenen Temperatureinheiten.

Temperatur, Maß für Hitze oder Kälte, ausgedrückt in einer beliebigen Skala, die die Richtung angibt, in die die Wärme–Energie spontan fließt, d. h. von einem heißeren Körper (mit einer höheren Temperatur) zu einem kälteren Körper (mit einer niedrigeren Temperatur). Die Temperatur ist nicht das Äquivalent der Energie eines thermodynamischen Systems. [Quelle]

Wir können also sagen, dass Objekte mit höheren Temperaturen, unabhängig davon, welche Skala man verwendet (°F, °C, K), „heißer“ sind und Objekte mit niedrigeren Temperaturen (unter Verwendung derselben Skala) „weniger heiß“ oder „kälter“ sind (…), und wir können davon ausgehen, dass die Wärmeenergie vom „Heißeren“ zum „Kälteren“ fließt.

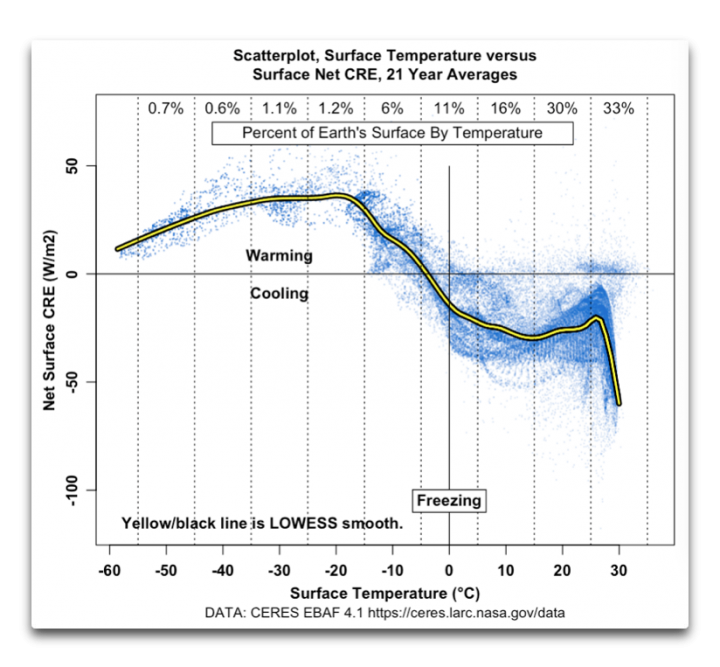

Die Multiplikation von Temperaturen als Zahlen ist möglich, führt aber zu unsinnigen Ergebnissen, zum Teil, weil die Temperaturen in willkürlichen Einheiten unterschiedlicher Größe angegeben werden, vor allem aber, weil die Temperaturen nicht die Wärmeenergie des gemessenen Objekts, sondern die relative „Hitze“ und „Kälte“ darstellen. „Doppelt so heiß“ in Fahrenheit, sagen wir doppelt so heiß wie 32°F (Gefriertemperatur von Wasser) ist 64°F – offensichtlich wärmer/heißer, aber nur unsinnigerweise „doppelt so heiß“. In Celsius-Graden müssten wir 1°C sagen (wir können die Null nicht verdoppeln), und wir hätten 2°C oder 35,6°F (ganz anders als die obigen 64°F). Ja, das liegt daran, dass die Größen der Einheiten selbst unterschiedlich sind. Wenn wir jedoch wissen wollen, um wie viel „Wärme“ es sich handelt, sagen uns weder Grad Fahrenheit noch Grad Celsius etwas … Temperatur ist kein Maß für den Wärmeinhalt oder die Wärmeenergie.

Ein Kubikmeter Luft bei normalisiertem Luftdruck auf Meereshöhe (etwa 1.013,25 hPa) und 60 % Luftfeuchtigkeit bei einer gemessenen Temperatur von 21°C enthält weit weniger Wärmeenergie als ein Kubikmeter Meerwasser bei gleicher Temperatur und Höhe. Ein ein Kubikmeter großer Block aus rostfreiem Stahl mit einer Temperatur von 21°C enthält sogar noch mehr Wärmeenergie. Die relative Hitze oder Kälte eines Körpers kann durch seine Temperatur ausgedrückt werden, aber die Menge an Wärmeenergie in diesem Körper wird nicht durch die Angabe seiner Temperatur ausgedrückt.

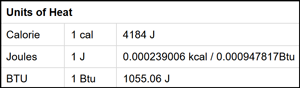

Wie wird Wärme in der Wissenschaft ausgedrückt – quantifiziert – ?: Die Einheiten der Wärmeenergie sind Kalorien, Joule und BTU (Quelle). Wir sehen, dass keine der Wärmeeinheiten eine Temperatureinheit (°F, °C, K) ist.) (Anmerkung: Wenn Thermodynamik einfach wäre, hätte ich diesen Aufsatz nicht schreiben müssen).

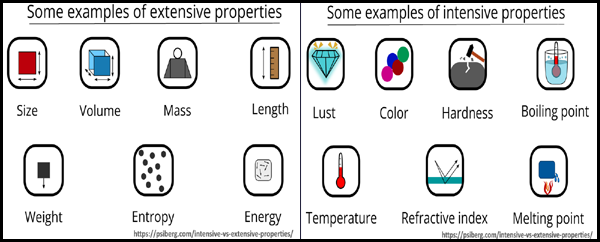

Die Temperatur ist eine Eigenschaft der Materie – und die Temperatur ist insbesondere eine Intensive Eigenschaft.

Umfangreiche Eigenschaften können addiert werden – Volumen: Die Addition von 1 Kubikmeter Mutterboden zu einem neuen Kubikmeter Mutterboden ergibt zwei Kubikmeter Mutterboden und füllt das doppelte Volumen des Hochbeetgartens in Ihrem Garten. Länge: Wenn man eine Meile Fahrbahn zu einer Meile bestehender Fahrbahn hinzufügt, erhält man zwei Meilen Fahrbahn.

Bei intensiven Eigenschaften funktioniert dies jedoch nicht. Die Härte ist eine Intensive Eigenschaft. Man kann die numerische Mohs-Härte von Apatit, die einen Wert von 5 hat, nicht mit der numerischen Mohs-Härte von Diamant, die einen Wert von 10 hat, addieren und erhält überhaupt keine sinnvolle Antwort – sicherlich nicht 15 und auch nicht „5 plus 10 geteilt durch 2 gleich 7,5“.

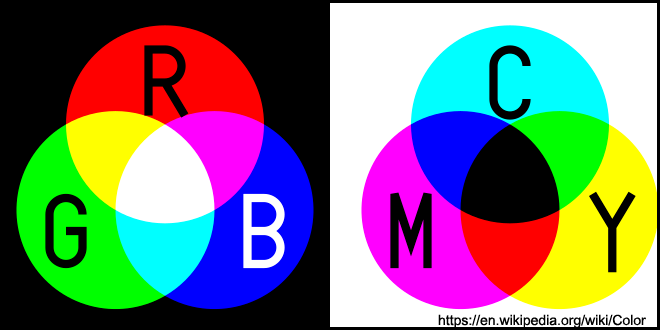

Farbe ist eine intensive Eigenschaft. Farbe hat zwei Maße: Wellenlänge/Frequenz und Intensität. Die meisten von uns können die Farbe einer Materie leicht erkennen – unsere Augen teilen unserem Gehirn die allgemeine Wellenlänge des Lichts mit, das von einem Objekt reflektiert oder ausgestrahlt wird, was wir in einen Farbnamen übersetzen. Wissenschaftlich gesehen kann die Wellenlänge (oder gemischte Wellenlängen) des reflektierten oder ausgestrahlten Lichts als Frequenzen (in Terahertz – Terahertz, 10↑12 Hz ) und Wellenlängen (in Nanometern) gemessen werden. Farben lassen sich nicht als Zahlen addieren. Bei farbigem Licht ergibt die gleichmäßige Addition der drei Grundfarben „weißes“ Licht. Bei Pigmenten ergibt die Addition der drei Grundfarben „Schwarz“, und andere Kombinationen, wie Magenta und Gelb, führen zu überraschenden Ergebnissen.

Auch die Temperatur, eine intensive Eigenschaft, kann nicht hinzugefügt werden.

„Intensive Variablen hingegen sind unabhängig von der Systemgröße und stellen eine Eigenschaft des Systems dar: Temperatur, Druck, chemisches Potenzial usw. In diesem Fall führt die Kombination zweier Systeme nicht zu einer intensiven Gesamtgröße, die der Summe ihrer Komponenten entspricht. Zwei identische Teilsysteme haben zum Beispiel nicht die doppelte Gesamttemperatur oder den doppelten Druck ihrer Komponenten. Eine Summe über intensive Größen hat keine physikalische Bedeutung. Die Division sinnloser Summen durch die Anzahl der Komponenten kann dieses Ergebnis nicht umkehren. Unter besonderen Umständen kann die Mittelwertbildung eine Annäherung an die Gleichgewichtstemperatur nach der Vermischung bewirken, doch ist dies für die Analyse eines nicht im Gleichgewicht befindlichen Falles wie des Erdklimas irrelevant.“ [ Quelle: Does a Global Temperature Exist? von Christopher Essex, Ross McKitrick und Bjarne Andresen (.pdf ) ]

Das ist eine wunderbare, aber dichte Erklärung. Schauen wir uns die wichtigsten Punkte einzeln an:

1. Die Temperatur, eine intensive Eigenschaft, ist unabhängig von der Systemgröße und stellt eine Qualität des Systems dar.

2. Die Kombination von zwei Systemen (z. B. die Temperaturen von zwei verschiedenen Kubikmetern Atmosphäre, die zwei Stevenson Screens oder zwei MMTS-Einheiten umgeben) ergibt keine intensive Gesamtgröße, die der Summe ihrer Komponenten entspricht.

3. Eine Summe über intensive Variablen hat keine physikalische Bedeutung – die Addition der Zahlenwerte zweier intensiver Variablen, wie der Temperatur, hat keine physikalische Bedeutung, sie ist unsinnig.

4. Das Dividieren von bedeutungslosen Summen durch die Anzahl der Komponenten – mit anderen Worten, die Mittelwertbildung oder die Ermittlung des Mittelwerts – kann dieses Ergebnis nicht umkehren, der Durchschnitt oder Mittelwert ist immer noch bedeutungslos.

5. Lufttemperaturen (2 Meter über der Oberfläche) sind alle punktuellen Temperaturmessungen innerhalb einer Luftmasse, die sich nicht in allen Maßstäben hinsichtlich Temperatur, Druck, Feuchtigkeit oder Wärmeinhalt mit ihrer Umgebung im Gleichgewicht befindet.

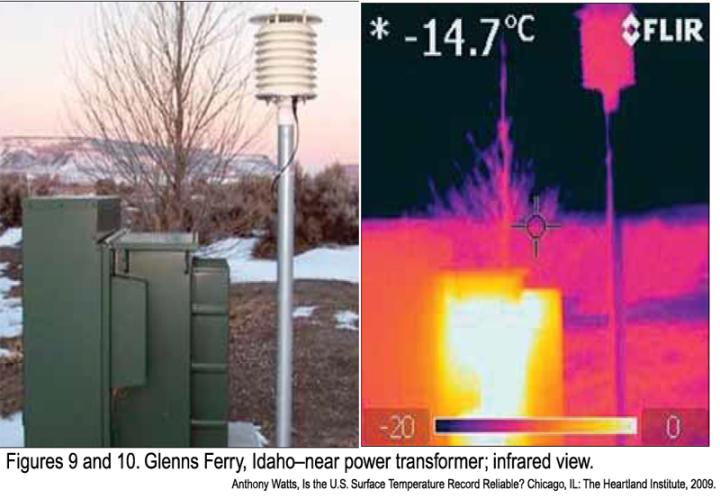

Wir können sehen, dass selbst auf sehr kleinem Maßstab, d. h. auf den wenigen Metern, die den MMTS-Sensor an der Wetterstation in Glenns Ferry, Idaho, umgeben, das Lufttemperatursystem weit davon entfernt ist, sich im Gleichgewicht zu befinden – Luft über einem heißen Transformator, gefrorenes kahles Gras, Schneeflecken und Gestrüpp, die alle Wärmeenergie von der Sonne absorbieren und einen unterschiedlichen Wärmeinhalt aufweisen. Alle diese kleineren Teilsysteme geben aktiv Wärme ab oder nehmen Wärmeenergie aus den ungleichen Systemen um sie herum auf. Praktisch gesehen würde man, wenn man neben dem Sensor stünde, wissen, dass es dort „kalt“ ist, da die Luft am Sensor weit unter dem Gefrierpunkt liegt – aber im Notfall könnte man sich an den Transformator kuscheln und sich durch seine Wärme wärmer fühlen. Es ist jedoch wissenschaftlich nicht möglich, die Lufttemperaturen selbst innerhalb des zwei Meter großen Luftwürfels um den Sensor herum zu „mitteln“.

Man kann die Temperatur nicht mitteln.

Kommentar des Autors:

Ich mache mir keine Illusionen darüber, dass dieser Aufsatz von allen, die hier lesen, akzeptiert werden wird. Er ist jedoch wissenschaftlich und physikalisch korrekt und könnte viele fest verankerte Überzeugungen erschüttern.

Ich werde einen Folgeartikel, Teil 3, schreiben, in dem es um die Ausreden geht, mit denen CliSci behauptet, sie könnten gültige Durchschnittstemperaturen ermitteln – einschließlich der lahmen Ausreden: „Wir bilden keine Mittelwerte, sondern Anomalien“; „Wir finden nicht nur Mittelwerte, sondern gewichtete Mittelwerte“; „Wir bilden keine Mittelwerte, sondern Krig“; „Wir erfinden keine Daten, sondern verwenden die Zahlen der nächstgelegenen verfügbaren Stationen, solange sie innerhalb von 1.200 Kilometern liegen“ [750 Meilen]. (Anmerkung: Das ist die ungefähre Entfernung von Philadelphia nach Chicago oder von London nach Marseille, die, wie wir alle wissen, kein gemeinsames Klima haben, geschweige denn Lufttemperaturen); und viele mehr. In allen Fällen werden die Temperaturen in unangemessener Weise gemittelt, was zu sinnlosen Zahlen führt.

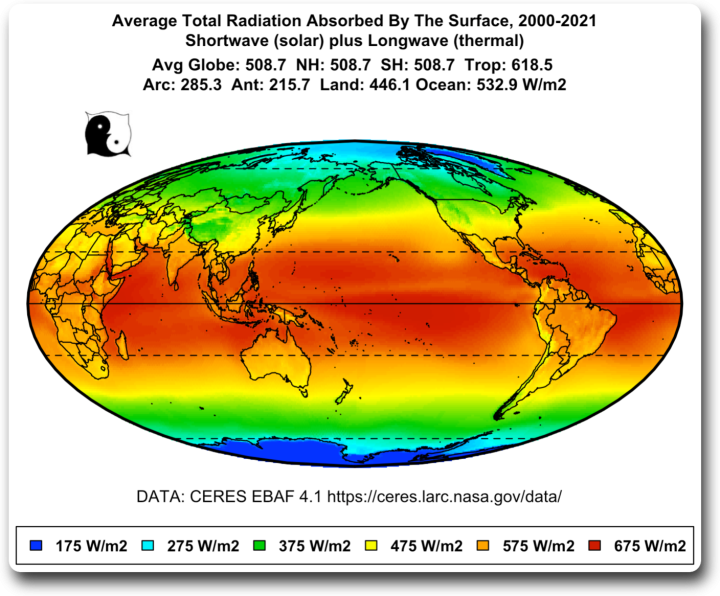

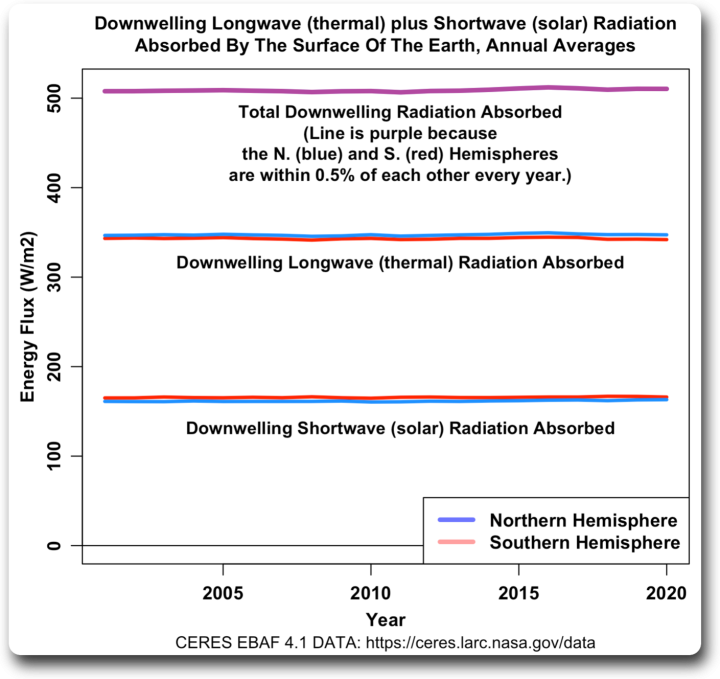

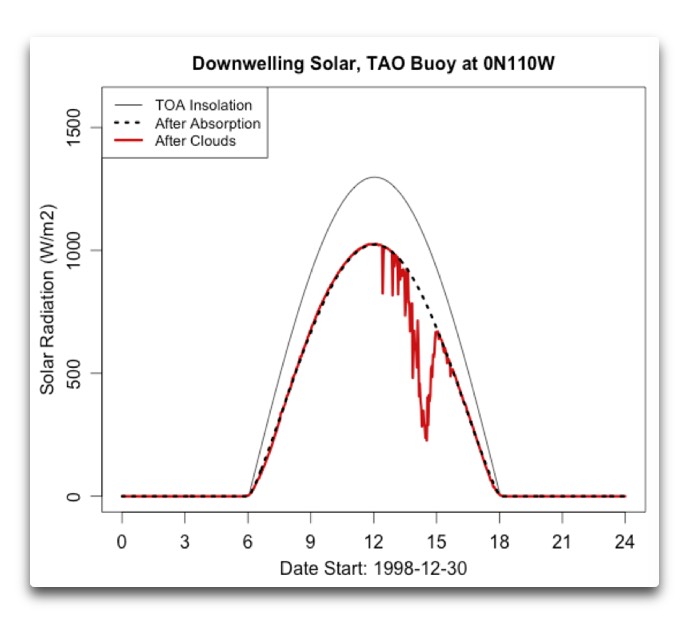

Man kann jedoch einen Mittelwert bilden und mit dem Wärmeinhalt arbeiten, der eine umfassende Eigenschaft der Materie ist. Es ist der Wärmeinhalt des „gekoppelten nichtlinearen chaotischen Systems“, das das Erdklima darstellt, mit dem sich die Klimawissenschaft beschäftigt, wenn sie darauf besteht, dass steigende atmosphärische CO2-Konzentrationen mehr Wärme im Erdsystem einschließen. Aber CliSci misst den Wärmeinhalt des Systems nicht, sondern besteht darauf, die bedeutungslosen Zahlen zu ersetzen, die verschiedene Gruppen als globale durchschnittliche Oberflächentemperatur bezeichnen.

Sie können Ihre Meinung gerne in den Kommentaren kundtun – ich werde den Punkt nicht bestreiten – er ist einfach zu grundlegend und wahr, um sich darüber zu streiten. Wenn Sie spezifische Fragen stellen, werde ich versuchen, diese zu klären. Wenn Sie sich an mich wenden, beginnen Sie Ihren Kommentar mit etwas wie „Kip, ich frage mich …“.

Link: https://wattsupwiththat.com/2022/08/09/numbers-tricky-tricky-numbers-part-2/

Übersetzt von Christian Freuer für das EIKE