Es ist an der Zeit über „Nutzungsgrade“ zu reden

Dr. Lars Schernikau, energy economist and commodity trader, Switzerland/Singapore

[Alle Hervorhebungen im Original. A. d. Übers.]

In der Stromerzeugung sind Nutzungsgrad, Auslastung und Lastfaktor nicht dasselbe.

In der Presse,der Politik und sogar unter „Energie-Experten“ herrscht oft Verwirrung über die Verwendung des Begriffs „Nutzungsgrad„ (in Eng. Capacity Factor). Dies ist entschuldbar, da die in diesem Artikel getroffene Unterscheidung erst mit dem Vordringen der variablen „erneuerbaren“ Energien wie Wind und Sonne in unsere Energiesysteme relevant wurde.

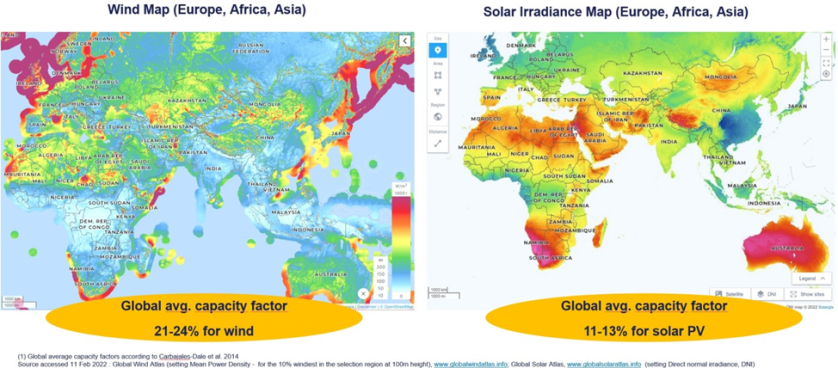

● Der durchschnittliche natürliche Nutzungsgrad der Solarenergie liegt weltweit bei etwa 11-13 %. An den besten Standorten in Kalifornien, Australien, Südafrika und der Sahara kann er über 25 % liegen, ist aber selten. (siehe www.globalsolaratlas.info, Einstellung der direkten normalen Sonneneinstrahlung)

● Die natürlichen Nutzungsgrad der Windkraft erreichen im weltweiten Durchschnitt etwa 21-24%. Die besten Offshore-Standorte in Nordeuropa können über 40 % erreichen. In den meisten Teilen Asiens und Afrikas gibt es kaum nutzbaren Wind, und der natürliche Nutzungsgrad liegt unter 15 %, mit Ausnahme von kleinen Gebieten an Teilen der Küsten Südafrikas und Vietnams. (siehe www.globalwindatlas.info, Einstellung der mittleren Leistungsdichte)

Die natürlichen Nutzungsgrade in Europa sind bei der Windkraft tendenziell höher als bei der Solarenergie. Windkraftanlagen in Nordeuropa können im Durchschnitt über 30 % erreichen (höher bei teureren Offshore-Anlagen, niedriger bei Onshore-Anlagen), aber weniger als 15 % in Indien und weniger als 8 % in Indonesien. Die durchschnittlichen, und die Betonung liegt auf durchschnittlich, jährlichen PV-Nutzungsgrade erreichen etwa ~10-11% in Deutschland, ~17% in Spanien, ~25% in Kalifornien und können 14-19% in Indien erreichen, aber sie erreichen weniger als 15% in den besiedelten Gebieten Indonesiens (für Details siehe auch Carbajales-Dale et al. 2014.

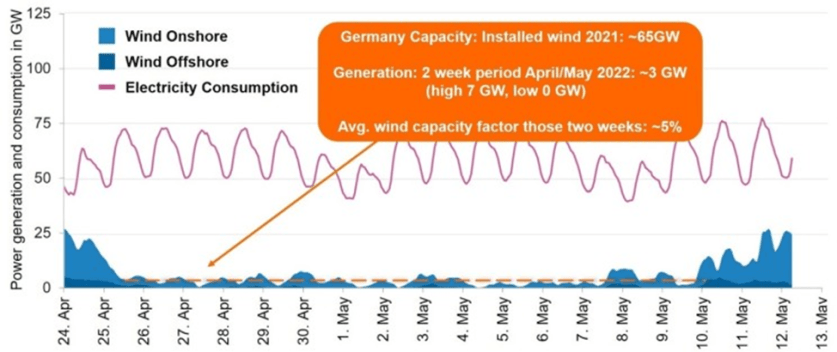

Die Abbildung weiter unten zeigt einen zweiwöchigen Zeitraum im Mai 2022 (als ich dieses Kapitel unseres Buches über Nutzungsgrade schrieb), in dem der durchschnittliche Windnutzungsgrad für ALLE deutschen Windkraftanlagen (On- und Offshore) nur ~5% erreichte.

Um Verwirrung zu vermeiden, versuche ich in meinen Texten, wo immer möglich, den Begriff „natürlicher Nutzungsgrad“ zu verwenden.

● Der „natürliche Nutzungsgrad“ ist der Prozentsatz der maximal möglichen Leistung des „Kraftwerks“ (Kohle, Gas, Kernkraft, Sonne, Wind, Wasser usw.), die unter den natürlichen Bedingungen des Standorts erreicht wird, wobei keine betrieblichen oder technischen Störungen oder Ausfälle angenommen werden.

● Ich definiere „Auslastung“ als den prozentualen Anteil der im Jahresdurchschnitt genutzten Kraftwerksleistung, der nur durch technische, betriebliche oder wirtschaftliche Ausfälle oder Kürzungen verringert wird… völlig unabhängig vom Nutzungsgrad.

● Der „Netto-Lastfaktor“ ist dann – nach meiner Definition – das Produkt aus natürlichem Nutzungsgrad x Auslastung

Wenn wir also vom Nutzungsgrad sprechen, beziehen wir uns nur auf den natürlichen Nutzungsgrad, nicht auf die technologisch oder betrieblich bedingte „Auslastung“ (oft als Betriebszeit, Anlagenauslastungsfaktor oder PLF für „plant load factor“ bezeichnet). Mit anderen Worten: Wenn die Technik versagt oder ein Kraftwerk absichtlich abgeschaltet wird, verringert sich zwar die Auslastung, nicht aber der natürliche Nutzungsgrad.

Wie bereits erwähnt ist der natürliche Nutzungsgrad auf den Standort und nicht auf die PV-Anlage zurückzuführen. Daher muss selbst ein perfektes PV-Material immer noch mit natürlichen Nutzungsgraden von durchschnittlich 10-25 % pro Jahr zurechtkommen, wobei andere Verluste aus der Aufbereitung, der Übertragung, dem Ausgleich oder der Speicherung stark intermittierender Stromquellen nicht berücksichtigt sind (Schernikau und Smith 2021).

In der Presse wurde mehrfach erwähnt, dass Kohle oder Gas im Durchschnitt Nutzungsgraden von 60 % oder weniger haben. Dies ist bestenfalls irreführend, wahrscheinlicher ist, dass dies aus politischen Gründen bewusst falsch ist. Bei dieser Zahl handelt es sich jedoch nicht um den aus der Natur abgeleiteten Nutzungsgrad, sondern um die Auslastung, die mit einer höheren Durchdringung von Wind- und Solarenergie sinkt und zum Anstieg der Stromsystemkosten beiträgt.

Die Auslastung sollte und kann nicht mit den natürlichen Nutzungsgraden verglichen werden, da sie sehr unterschiedlich sind. Konventionelle Kraftwerke haben einen natürlichen Nutzungsgrad von nahezu 100 %, aber ihre betriebliche und technische Auslastung liegt oft deutlich unter 90 %, auch, aber nicht nur, wegen des Vorrangs von Wind und Sonne im System. Aufgrund des hohen CF ist der Nettolastfaktor nur geringfügig niedriger als die Auslastung eines konventionellen Kraftwerks.

Da die Auslastung von Wind- und Solarkraftwerken oft nahe 100 % liegt, ist ihr Nettolastfaktor oft nur geringfügig niedriger als ihr natürlicher Nutzungsgrad.

Abbildung: Deutsche Winderzeugung 25. April bis 10. Mai 2022 während einer 2-wöchigen Windflaute. Quelle: Agora 2022, Abbildung 10 im Buch „Unbequeme Warheiten… über Strom und die Energie der Zukunft“, www.unpopular-truth.com und auf Amazon https://amzn.eu/d/48cXQQE (changed link auf DE amazon)

Leider kann der natürliche Nutzungsgrad von Wind- und Solarkraftwerken (auch von Wasserkraftwerken aufgrund der natürlichen Flussläufe) nicht vorhergesagt oder für einen bestimmten Zeitraum garantiert werden. Der natürliche Nutzungsgrad kann zwar auf Jahresbasis geschätzt werden, schwankt aber selbst im Jahresverlauf stark (siehe Europa 2021) und ist sehr unbeständig, wobei er manchmal für Wind- und Solarenergie tage- und wochenlang nahe 0 % liegt, selbst in Spitzenlagen.

Somit sind die natürlichen Nutzungsgraden weltweit ein direktes Ergebnis des Standorts der Wind- oder Solaranlage; sie hängen in keiner Weise von der eingesetzten Technologie ab und können auch nicht von ihr beeinflusst werden. Der letzte Punkt ist wichtig… keine technologischen Fortschritte können die natürliche Verfügbarkeit von Wind, Sonne oder Flussläufen verändern und somit den natürlichen Nutzungsgraden für eine bestimmte Anlage beeinflussen. Technologie KANN und WIRD verbessern, wie viel nutzbare Elektrizität man aus dem natürlichen Eingangsprodukt (Wind, Sonne, Fluss, Gas, Kohle, Uran usw.) herausholen kann… dies wird Umwandlungseffizienz oder Wirkungsgrad genannt, und ihre Grenzen werden weiter unten diskutiert.

Da gut geeignete Standorte bereits „verbraucht“ sind, kann man davon ausgehen, dass die durchschnittlichen natürlichen Nutzungsgraden im Laufe der Zeit sinken werden… im Gegensatz zu dem, was Net-Zero-Pläne annehmen (siehe Internationale Energieagentur (IEA), McKinsey & Company oder Internationale Agentur für Erneuerbare Energien (IRENA)).

1. Bei einem Photovoltaik-Park hängt der natürliche Nutzungsgrad vollständig von der Intensität und Dauer der Sonneneinstrahlung ab, die von der Jahreszeit und der Bewölkung, von Tag und Nacht und von der Fähigkeit, die Transparenz der Oberfläche des PV-Paneels aufrechtzuerhalten, beeinflusst wird, z. B. von Staub in der Sahara oder Schnee im Winter.

2. Die natürlichen Nutzungsgraden von Windparks hängen von der Verteilung der Windgeschwindigkeit am Standort und der Sättigungsgeschwindigkeit der Windturbine ab. Der Nutzungsgrad einer Windturbine wird durch die Anzahl der Stunden pro Jahr bestimmt, in denen der Windpark bei oder oberhalb der Sättigungs-Windgeschwindigkeit arbeitet (Smith und Schernikau 2022 für weitere Quellen). Wenn die Sättigungs-Windgeschwindigkeit niedrig angesetzt wird, z. B. 4-5 m/s, produziert der Windpark selbst bei hohen Nutzungsgraden wenig Energie. Üblicherweise liegen die Windsättigungs-Geschwindigkeiten bei 12-15 m/s.

Jetzt wird klar, warum die installierte Kapazität für Wind- und Solarenergie viel größer sein muss als für disponierbare Energie wie Kernkraft, Kohle, Gas oder Wasser. Dieser beträchtliche relative Anstieg der Energieerzeugungskapazität, um die gleiche verfügbare, aber unvorhersehbare Energieleistung zu erzeugen, ist mit einem wesentlich höheren Rohstoffeinsatz und Energieeinsatzfaktor für variable „erneuerbare“ Energie gekoppelt, der durch jegliche Brennstoffeinsparungen ausgeglichen werden muss.

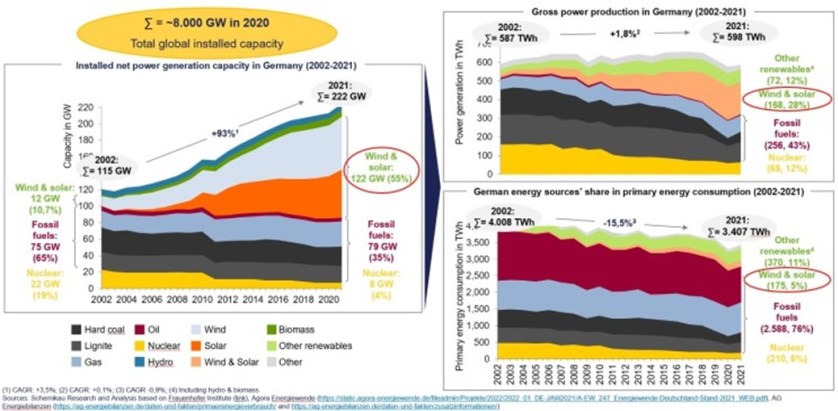

Deutschland ist ein gutes Beispiel: Die gesamte installierte Stromerzeugungskapazität hat sich in den letzten 20 Jahren mehr als verdoppelt, im Wesentlichen aufgrund des Ausbaus von Wind- und Sonnenenergie (siehe Abbildung unten).

● Die installierte Wind- und Solarkapazität liegt jetzt bei über 125 GW und damit mehr als 150 % über dem Spitzenstrombedarf in Deutschland von etwa 80 GW.

● Die in Deutschland installierte konventionelle Stromerzeugungskapazität, bestehend aus Kohle, Gas und Kernkraft, deckt den Spitzenstrombedarf nun nur noch kaum ab.

● Trotz dieses Kapazitätszuwachses in Deutschland werden Wind- und Solarenergie im Jahr 2021 weniger als 30% der gesamten Stromerzeugung und etwa 5% des gesamten Energieverbrauchs ausmachen.

Abbildung: Installierte Kraftwerksleistung, Stromerzeugung und Primärenergie in Deutschland. Quelle: Schernikau Research and Analysis basierend auf Fraunhofer 2022, AGE 2021, Agora 2022. Abbildung 7 im Buch „Unbequeme Warheiten… über Strom und die Energie der Zukunft“, www.unpopular-truth.com und auf Amazon https://amzn.eu/d/48cXQQE (changed link auf DE amazon

Der geringe natürliche Nutzungsgrad von Wind- und Solaranlagen ist zweifelsohne einer der Hauptgründe für ihre niedrige Netto-Energieeffizienz (https://dx.doi.org/10.2139/ssrn.4000800) und damit hohen Kosten.

Umwandlungseffizienz oder Wirkungsgrad

Die folgende Abbildung fasst die Umwandlungs-Wirkungsgrade für Wind- und Solarenergie und die Gesetze, denen sie folgen, zusammen. Der Umwandlungs-Wirkungsgrad misst das Verhältnis zwischen der nutzbaren Leistung einer Energieumwandlungsmaschine und der zugeführten Energie, also nach Berücksichtigung des natürlichen Nutzungsgrades.

Abbildung: Physikalische Gesetze begrenzen technologische Verbesserungen bei Wind- und Solarenergie. Quelle: Schernikau und Smith Research and Analysis, Abbildung 11 im Buch „Unbequeme Warheiten… über Strom und die Energie der Zukunft“, www.unpopular-truth.com und auf Amazon https://amzn.eu/d/48cXQQE (changed link auf DE amazon

Dieser Artikel kann auch abgerufen werden unter https://www.linkedin.com/pulse/time-talk-capacity-factors-lars-schernikau.

Link: https://wattsupwiththat.com/2022/12/27/it-is-time-to-talk-about-capacity-factors/

Übersetzt von Christian Freuer für das EIKE