Wenn ein einzelner Regenmesser für den ganzen Planeten spricht: Wie ein kleiner Datensatz zu einer globalen Klima-Schlagzeile wird

[Alle Hervorhebungen im Original. A. d. Übers.]

Wissenschaftliche Erkenntnisse gewinnen nicht nur durch Daten an Autorität, sondern auch durch die Art und Weise, wie diese Daten präsentiert werden. Die Veröffentlichung von Kong und Kollegen aus dem Jahr 2025 mit dem Titel „Intensifying precipitation over the Southern Ocean challenges reanalysis-based climate estimates – Insights from Macquarie Island’s 45-year record” (Etwa: Zunehmende Niederschläge über dem Südlichen Ozean stellen reanalysebasierte Klimaprognosen infrage – Erkenntnisse aus den 45-jährigen Aufzeichnungen von Macquarie Island) ist ein hervorragendes Beispiel dafür, wie ein kleines, unsicheres Ergebnis durch die Pressemitteilung zu einer weitreichenden globalen Aussage werden kann.

In dem von Fachkollegen begutachteten Artikel sind die Autoren vorsichtig, sogar zurückhaltend: Sie diskutieren mögliche Verzerrungen, die begrenzte räumliche Abdeckung und die Annahme-lastige Natur ihrer Extrapolationen. In der Phys.org / The Conversation-Version der Geschichte – verfasst von zwei der gleichen Forscher – wird der Ton jedoch zu Gewissheit. Was eine lokale Analyse war, wird zu einer globalen Offenbarung: „Stürme im Südlichen Ozean bringen mehr Regen – und die Folgen könnten global sein.“

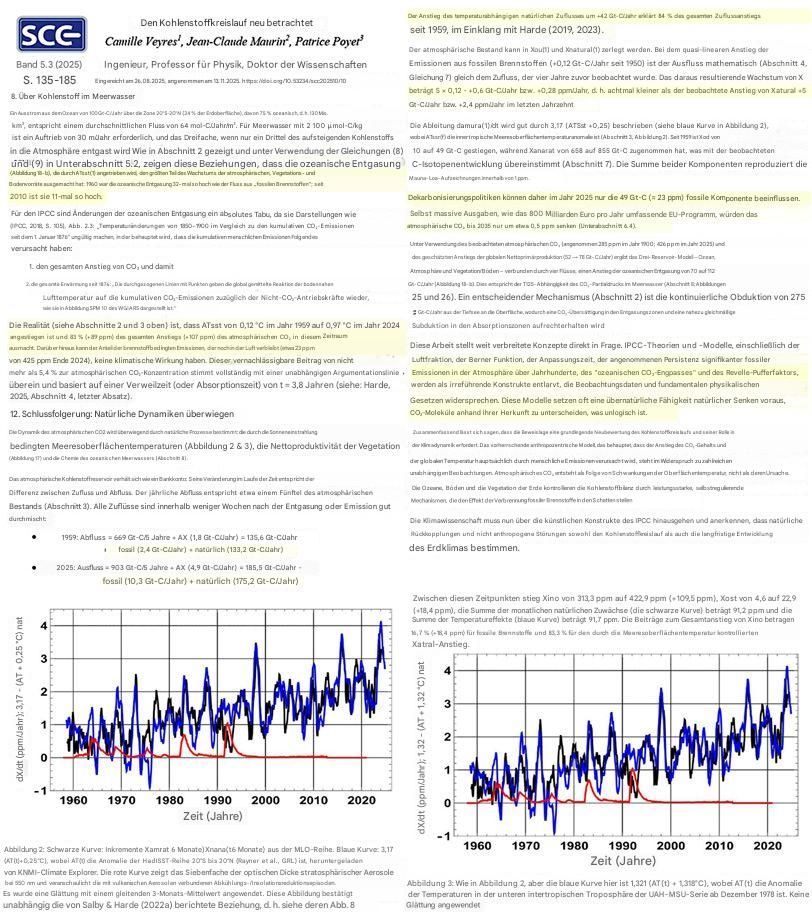

Die Graphik in deutscher Übersetzung (Google Translate):

Der Unterschied zwischen diesen beiden Versionen ist keine Frage der Semantik. Es handelt sich um den Unterschied zwischen einer statistischen Kuriosität in einem kleinen Datensatz und einer behaupteten hydrologischen Transformation im planetarischen Maßstab.

Die winzige Grundlage

Macquarie Island, ein windgepeitschter Bergrücken auf halbem Weg zwischen Tasmanien und der Antarktis, liefert eine der wenigen langfristigen meteorologischen Aufzeichnungen im Südlichen Ozean. Die Autoren analysieren 45 Jahre täglicher Niederschlagsdaten (1979–2023). Es fehlen weniger als zehn Tage, was eine beeindruckende Kontinuität darstellt. Doch während die zeitliche Abdeckung lang ist, beschränkt sich die räumliche Abdeckung auf einen Punkt – 8 Meter über dem Meeresspiegel, in einer der wettermäßig variabelsten Regionen der Erde.

Jeder, der in Zeitreihenanalyse geschult ist, weiß, was ein solcher Datensatz offenbaren kann und was nicht. Fünfundvierzig Jahreswerte bieten bestenfalls ein paar Dutzend Freiheitsgrade für die Trendschätzung. In Klimakontexten mit großen interannuellen Schwankungen können einige wenige anomale Jahre die Regressionsgerade so stark verzerren, dass sie „statistisch signifikant” erscheint.

Wenn die gleichen Jahre in fünf Cluster von „synoptischen Regimen” unterteilt werden, sinkt die effektive Stichprobengröße für jeden Trend noch weiter – oft auf weniger als zehn wirklich unabhängige Punkte, wenn man die serielle Korrelation berücksichtigt. Unter diesen Bedingungen können kleine zufällige Schwankungen als aussagekräftige Muster erscheinen.

Die Clusterbildung, welche die Muster erzeugt

Um meteorologische „Regimes“ zu untersuchen, wandten Kong et al. K-Means-Clustering auf 15 atmosphärische Variablen aus der ERA5-Reanalyse an. Sie testeten zwischen drei und acht Clustern und entschieden, dass fünf „optimal“ seien, da die Ergebnisse „weitgehend mit früheren Studien übereinstimmten“.

Dies ist keine objektive Optimierung, sondern eine Ermessensentscheidung. K-Means erzwingt sphärische Cluster von ungefähr gleicher Größe, eine Geometrie, der atmosphärische Daten selten entsprechen. Eine Änderung der Anzahl der Cluster oder sogar der zufälligen Initialisierung kann sowohl die Zusammensetzung der Cluster als auch die abgeleiteten Trends verändern. Bei 45 Jahren täglicher Daten – über 16.000 Punkten – ist es fast garantiert, dass eine bestimmte Aufteilung Cluster mit offensichtlichen Unterschieden in der Niederschlagsintensität ergibt, die auf dem Niveau von 0,05 „signifikant“ erscheinen.

Mit anderen Worten: Das Verfahren ist anfällig für statistische Trugbilder. Die offensichtliche Präzision von Zahlen wie „ein Anstieg der Niederschlagsintensität um 28 % bei Warmluftadvektion” kann darauf zurückzuführen sein, wie der Algorithmus die Daten aufteilt, und nicht auf eine zugrunde liegende physikalische Veränderung.

Signifikanz durch Multiplikation

Nach der Definition von fünf Regimen passten die Autoren separate lineare Trends für jedes Regime sowohl in den Beobachtungs- als auch in den ERA5-Datensätzen an – insgesamt über 50 Regressionen. Dennoch verwendet die Arbeit den herkömmlichen Schwellenwert p < 0,05 ohne Korrektur für multiple Tests. Bei diesem Schwellenwert wird etwa jede zwanzigste Regression zufällig als „signifikant” erscheinen. Bei Dutzenden von Tests sind eine Handvoll p-Werte unter 0,05 statistisch unvermeidlich, selbst wenn keine wirklichen Trends vorliegen.

Die Tabellen bestätigen dies: Die meisten Regime weisen p-Werte um 0,05 auf; einige wenige liegen darunter und werden als „signifikant” bezeichnet. Es wird keine Anpassung (Bonferroni, Benjamini-Hochberg oder anderweitig) vorgenommen. Das Ergebnis ist eine statistische Landschaft, die mit Zufallsbefunden gespickt ist, denen ein erklärender Status zugewiesen wird.

Da sich die fünf Regime-Zeitreihen gegenseitig ausschließen und zusammen vollständig sind – jeder Tag gehört genau zu einem Cluster –, sind ihre jährlichen Häufigkeiten zudem von Natur aus voneinander abhängig. Ein Anstieg in einem Regime muss mit einem Rückgang in anderen einhergehen. Werden sie als unabhängige Stichproben behandelt, wird die scheinbare Gewissheit jedes Trends übertrieben.

Datenmenge vs. Datenqualität

Selbst wenn jede Regression perfekt durchgeführt werden würde, bliebe die physikalische Bedeutung mehrdeutig. Die Niederschlagsmenge auf einer Insel in den „Roaring Forties“* hängt von der lokalen Topografie, der Meerestemperatur und der Windrichtung ab, die alle unabhängig von allgemeinen Klimatrends variieren können. ERA5 hingegen stellt einen gerasterten Durchschnitt über etwa 25 × 25 km dar. Die Diskrepanz zwischen einem Punktmessgerät und einem Modellraster ist erheblich. Der beobachtete Anstieg von 260 mm pro Jahr könnte eher lokale Stationseffekte, Messgeräteänderungen oder zufällige dekadische Schwankungen widerspiegeln als einen tatsächlichen regionalen Trend.

[*„Roaring Forties“ = „Brüllende Vierziger“. Der Terminus wurde von frühen Seefahrern geprägt, die damit auf der Südhemisphäre die Orkanwirbel zwischen 40°S und 50°S meinten, die sie naturgemäß sehr gefürchtet haben. A. d. Übers.]

Die Autoren räumen diese Vorbehalte tief in der Diskussion ein:

„Während MAC wertvolle Langzeitbeobachtungen liefert, führt seine Einzelpunktnatur zu einer potenziellen Skalenabweichung vom nächsten ERA5-Gitterzellenmittelwert, was zu den beobachteten Verzerrungen beitragen kann.“ (S. 1655)

Das ist ein wichtiges Eingeständnis. Leider verschwindet das vollständig aus den Medienberichten.

Vom statistischen Artefakt zum globalen Zusammenhang

Die Medienversion beginnt mit einer anschaulichen Beschreibung – Pinguine, See-Elefanten, moosbewachsene Hänge – und erklärt dann:

„Unsere neue Forschung bestätigt [den Anstieg der Niederschläge] – und zeigt, dass die Geschichte weit über ein abgelegenes UNESCO-Weltnaturerbe hinausgeht.“

Von da an entfaltet sich die Logik eher durch Implikation als durch Beweise. Da der Südliche Ozean „eine enorme Rolle im globalen Klimasystem spielt“, muss jede Veränderung auf Macquarie Island eine größere Transformation reflektieren. Die Autoren, die nun zu Kommunikatoren geworden sind, erklären dann:

„Falls die Zunahme der Niederschläge, die wir auf Macquarie Island beobachten, die Bedingungen im gesamten Sturmgürtel des Südlichen Ozeans reflektiert – worauf mehrere Indizien hindeuten –, sind die Folgen gravierend.“

Dieser Satz enthält zwar ein bedingendes „falls“, aber was folgt, macht es zunichte:

„Unsere Schätzungen deuten darauf hin, dass diese zusätzlichen Niederschläge im Jahr 2023 etwa 2.300 Gigatonnen zusätzlichem Süßwasser pro Jahr im gesamten südlichen Ozean in hohen Breitengraden entsprechen – eine Größenordnung, die über den jüngsten Schmelzwasserbeiträgen der Antarktis liegt.“

Nun ist diese Annahme zu einer quantitativen globalen Aussage geworden, die mit scheinbarer Präzision und einem Vergleich zum Massenverlust der Antarktis einhergeht. Für den allgemeinen Leser liest sich dies wie eine Tatsache. In der wissenschaftlichen Abhandlung wird die gleiche Zahl mit den Worten „unter der Annahme, dass dieser Anstieg repräsentativ ist …” eingeleitet – ein Gedankenexperiment, keine Beobachtung.

Die Illusion der Größenordnung

Die Skalierung eines Einzelpunkt-Trends auf ein Ozeanbecken ist mehr als eine Extrapolation; es ist ein dimensionaler Sprung. Die Fehlerbalken einer solchen Berechnung sind praktisch unbegrenzt. Dennoch verschwinden diese Balken in der gängigen Darstellung.

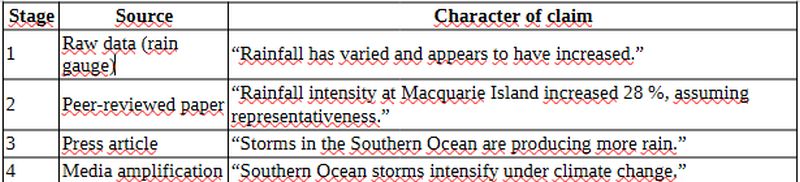

Die Argumentationskette würde, falls sie transparent dargestellt werden würde, wie folgt lauten:

1. Beobachtung: Die Messungen auf Macquarie Island zeigen einen Anstieg der jährlichen Niederschlagsmenge um 28 % seit 1979.

2. Annahme: Die Veränderung auf der Insel repräsentiert den gesamten Breitengrad zwischen 50° und 60° südlicher Breite.

3. Berechnung: Multiplikation des mittleren Anstiegs mit der Fläche dieses Gürtels.

4. Ergebnis: ~3.400 Gigatonnen zusätzlicher Süßwasserfluss.

Jeder Schritt erhöht die Unsicherheit um eine Größenordnung. Am Ende ist die numerische Genauigkeit (z. B. „2.300 Gigatonnen“) bedeutungslos. Dennoch erhalten solche Zahlen gerade deshalb rhetorische Kraft, weil sie präzise wirken. Die Spezifität signalisiert Zuversicht, auch wenn die Berechnung kaum mehr als eine arithmetische Übung auf der Grundlage einer Annahme ist.

Ein System der Aufblähung

Dies ist kein Einzelfall, sondern verdeutlicht eine systemische Tendenz in der modernen Klimakommunikation. Forscher, die unter Druck stehen, die Relevanz ihrer Arbeit zu beweisen, erweitern ihre Schlussfolgerungen über den Bereich hinaus, den ihre Daten stützen können. Redakteure und Öffentlichkeitsabteilungen bevorzugen aussagekräftige Schlagzeilen gegenüber probabilistischen Formulierungen. Das Ergebnis ist eine Zunahme des Vertrauens:

Mit jedem Schritt wächst das Vertrauen, während die Evidenzbasis gleich bleibt.

Statistische Sorgfalt ging unter

Die Einschränkungen des Fachartikels sind umfangreich und klar aufgeführt. Es wird darauf hingewiesen, dass nur ein Regime-Frequenztrend statistisch signifikant ist, dass ERA5 lokale Beobachtungen assimiliert, was die Unabhängigkeit erschwert, und dass die weiter gefassten Extrapolationen spekulativ sind. Die 95-prozentigen Konfidenzintervalle vieler Regressionen überschneiden sich mit Null. Die Autoren weisen sogar darauf hin, dass „weitere Belege erforderlich sind“.

Nichts davon findet sich in der öffentlichen Version. Stattdessen erfahren die Leser, dass „sich der Südliche Ozean möglicherweise um 10–15 % stärker abkühlt als 1979 – einfach durch den Energieverbrauch für die Verdunstung, der die zusätzlichen Niederschläge antreibt”. Diese Aussage impliziert eine quantifizierte, bassinhafte Änderung des Energiehaushalts, die nicht aus Messungen abgeleitet wurde, sondern aus dem gleichen Einpunkt-Niederschlagsanstieg multipliziert mit theoretischen Latentwärmefaktoren. Die Grenze zwischen Beobachtung und Vermutung wird ausgelöscht.

Warum kleine Datensätze große Trugbilder erzeugen

Kurze oder lokalisierte Datensätze sind aufgrund der Klimazeitreihen innewohnenden Autokorrelation besonders anfällig für falsche Trends. Selbst bei rein zufälligen jährlichen Schwankungen kann das Verfahren der kleinsten Quadrate scheinbar signifikante Steigungen ergeben, wenn aufeinanderfolgende Werte nicht unabhängig sind. Standard-p-Werte gehen von Unabhängigkeit aus; wenn diese Annahme nicht zutrifft, ist die tatsächliche Signifikanz weitaus geringer.

Hinzu kommt die Möglichkeit der Nichtstationarität – Perioden mit höherer und niedrigerer Varianz – wodurch sich die Konfidenzintervalle weiter vergrößern. Ohne explizite Tests auf Autokorrelation und Empfindlichkeit gegenüber Start- und Enddaten sollte jeder lineare Trend über 45 Jahre als vorläufig betrachtet werden. In der Veröffentlichung werden keine dieser Tests erwähnt. Somit könnte der viel gepriesene „Anstieg um 28 %” leicht ein statistisches Artefakt der natürlichen multidekadischen Variabilität sein.

Solche Artefakte sind nicht trivial, sie prägen das Narrativ. Nach ihrer Veröffentlichung wird jeder einzelne zu einem weiteren „Datenpunkt” in Metaanalysen und Klimamodellvalidierungen, was möglicherweise die Verzerrungen in genau den Reanalysen verstärkt, welche die Autoren kritisieren.

Warum dieses Kommunikationsmuster fortbesteht

Forscher stehen oft zwischen zwei Erwartungen: der akademischen Forderung nach Vorsicht und der öffentlichen Erwartung von Klarheit und Wirkung. Förderinstitutionen und Medien bevorzugen Meldungen, die lokale Erkenntnisse mit globalen Herausforderungen in Verbindung bringen. Der sicherste Weg, um Sichtbarkeit zu erlangen, besteht darin, auf weitreichende Konsequenzen hinzuweisen und gleichzeitig in der technischen Version formelle Vorbehalte zu formulieren. Diese Vorbehalte überleben jedoch selten die Pressemitteilung.

In diesem Fall verfassten die gleichen Autoren sowohl die wissenschaftliche als auch die populäre Version und entfernten damit den üblichen Filter, der Nuancen hätte bewahren können. Der selbstbewusste Ton des Outreach-Artikels trägt somit die Handschrift der ursprünglichen Autoren und vermittelt den Lesern den Eindruck, dass die erweiterten Behauptungen auf Daten und nicht auf Schlussfolgerungen beruhen.

Die Folgen übertriebener Gewissheit

Wenn kleinere Studien als globale Durchbrüche veröffentlicht werden, hat dies zwei Nachteile. Erstens erwartet die Öffentlichkeit dann ständig neue „Klima-Kipppunkte“, wodurch die Aufmerksamkeit von soliden, langfristigen Beweisen abgelenkt wird. Zweitens schwindet das Vertrauen in die Klimawissenschaft insgesamt, wenn nachfolgende Analysen die Schlagzeilen-Ergebnisse nicht reproduzieren können. Der Verlust an Glaubwürdigkeit ist kollektiv und beschränkt sich nicht auf eine einzige Veröffentlichung.

Übermäßiges Vertrauen wirkt sich auch intern auf die Wissenschaft aus. Sobald sich eine Erzählung verfestigt – „Stürme im Südlichen Ozean bringen mehr Regen“ –, stehen zukünftige Studien unter einem subtilen Druck, sich anzupassen. Nullergebnisse laufen Gefahr, als konträr zu erscheinen, selbst wenn sie genauer sind.

Eine vernünftige Alternative

Nichts davon bedeutet, dass Kong et al. unangemessen gehandelt haben; ihre zugrunde liegende Analyse ist eine standardmäßige explorative Untersuchung. Das Problem liegt darin, dass Exploration mit Bestätigung verwechselt wird. Ein vernünftiger Ansatz würde die Unterscheidung klar halten:

• Über den beobachteten lokalen Trend und seine Unsicherheit berichten

• Die Sensitivität gegenüber dem Startjahr, der Clusteranzahl und der Autokorrelation ausdrücklich testen

• Extrapolationen auf Beckenebene als hypothetische Szenarien und nicht als Schätzungen darstellen

• Diese bedingte Formulierung in jeder öffentlichen Kommunikation beibehalten

Wären diese Vorgehensweisen durchgehend befolgt worden, wäre die Studie nach wie vor wertvoll – als Fallstudie zur regionalen Niederschlagsanalyse –, ohne ihre globale Bedeutung zu überbewerten.

Die wahre Lektion

Die Aufzeichnungen von Macquarie Island sind gerade deshalb wissenschaftlich interessant, weil sie selten sind. Ihr Wert liegt in der Überprüfung von Fernerkundungs- und Modellprodukten, nicht in der Diagnose planetarischer Veränderungen. Die Versuchung, sie zu globalen Beweisen zu erheben, ist verständlich; Daten aus dem Südlichen Ozean sind rar, und jeder Datensatz erscheint wertvoll. Aber Seltenheit ist kein Ersatz für statistische Aussagekraft.

Die eigentliche Botschaft des Artikels – wie wenig wir tatsächlich über Niederschlagstrends im Südlichen Ozean wissen – wurde in der Berichterstattung der Medien umgekehrt. Anstatt die Unsicherheit hervorzuheben, verwandelte der Artikel sie in Gewissheit: Der Ozean „verändert sich schneller und dramatischer als wir dachten“. Die Realität könnte genau das Gegenteil sein: Da es so wenige direkte Beobachtungen gibt, wissen wir noch nicht einmal, ob er sich überhaupt verändert.

Schlussfolgerung

Der Weg dieser Studie – von der Zeitreihe eines Messgeräts bis zur Schlagzeile über das globale Klima – zeigt, wie moderne Wissenschaftskommunikation vorläufige statistische Muster zu Darstellungen einer planetarischen Veränderung aufbauschen kann. Jeder Schritt auf diesem Weg beseitigt eine Ebene der Unsicherheit, bis am Ende keine vorsichtige Schlussfolgerung mehr übrig bleibt, sondern eine deklarative Behauptung.

Die Wiedereinführung dieser Unsicherheit ist kein Akt der Skepsis um ihrer selbst willen, sondern eine Wiederherstellung der Verhältnismäßigkeit. Die Daten von Macquarie Island mögen auf interessante Schwankungen hindeuten, aber die Konfidenzintervalle sind groß, die Stichprobe klein und die physikalischen Prozesse ungeklärt. Ein solches Fragment als Beweis für globale hydrologische Veränderungen zu behandeln, birgt die Gefahr, Wissenschaft zu reiner Erzählkunst zu machen.

Wenn es hier einen eindeutigen Trend gibt, dann nicht bei den Niederschlägen, sondern in der Rhetorik: die anhaltende Eskalation von bescheidenen Anzeichen zu großartigen Schlussfolgerungen. Solange sich dieser Trend nicht umkehrt, wird die Kluft zwischen Klimadaten und Klimadiskurs weiter wachsen – und damit auch die Verwirrung in der Öffentlichkeit darüber, was die Zahlen wirklich bedeuten.

Übersetzt von Christian Freuer für das EIKE