Anhörung des Haushaltsausschusses des Senats: Judith Curry spricht

Judith Curry, Climate Etc.

[Dieser Beitrag wird bei WUWT unter der Rubrik „Government Idiocy“ gelistet. A. d. Übers.]

Die Anhörung in der vergangenen Woche war ein trauriges Beispiel für das, was im US-Senat als Debatte und Überlegungen durchgeht. Auf jeden Fall ist sie ein interessantes Beispiel dafür, warum die USA nicht in der Lage sind, die Kluft zwischen den Parteien zu überbrücken und herauszufinden, wie man vernünftig mit dem Thema Klimawandel umgehen kann.

Falls Sie es verpasst haben, der Vorsitzende des Haushaltsausschusses des Senats, Sheldon Whitehouse, hat seine Befragung von mir am Ende der Anhörung auf YouTube verewigt: Chairman Whitehouse Presses GOP Witness in Budget Hearing on Climate Change and Insurance Markets [etwa: Vorsitzender Whitehouse bedrängt GOP-Zeugen in Haushaltsanhörung zu Klimawandel und Versicherungsmärkten].

Ich hatte erwartet, dass SW auf mich losgehen würde, wie er es schon oft bei republikanischen Zeugen getan hat. In meiner schriftlichen Aussage fügte ich am Ende meines Lebenslaufs einen Absatz hinzu, um den Vorwurf zu entkräften, dass ich in der Tasche des „Big Oil“ stecke. Als SW die Zeugen vorstellte, dankte er jedem von ihnen und sagte, er freue sich auf ihre Aussagen – auch auf die des anderen republikanischen Zeugen. Als er mich vorstellte, nannte er einfach meinen Namen und meine Positionen. Das war von Beginn der Anhörung an klar. Allerdings hatte ich nicht mit dem Irrsinn gerechnet, der dann folgte.

Es scheint, dass Senator Whitehouse dachte, dass sein Verhör mit mir eine Art großartiges „Takedown“ war: falsche Charakterisierung von Dingen, die ich vor über einem Jahrzehnt geschrieben hatte, aus dem Zusammenhang gerissene Verweise auf meine Verwendung der alarmistischen Auslösewörter „Schwindel“ und „korrupt“ in Interviews und obskuren Blogbeiträgen, unveröffentlichte Grafiken, die ich noch nie gesehen habe, Worte der „Weisheit“ von Exxon in den 1960er Jahren usw.

Abgesehen davon, dass fast nichts davon etwas mit meiner Aussage zu tun hatte und ich die meiste Zeit keine Ahnung hatte, wovon er sprach, gab er mir etwa 30 Sekunden Zeit, um auf jede dieser Fragen zu antworten, und sagte, dass ich später schriftlich antworten könne. Am Tag nach der Anhörung schickte mir sein Mitarbeiter eine E-Mail mit Folgefragen von Senator Grassley (siehe meine Antworten: Judith Currys Antwort auf die Fragen von Senator Grassley) und dem Hinweis, dass „ich Ihnen in den nächsten Tagen auch eine Abschrift Ihrer Ausführungen von der Anhörung schicken werde, damit Sie kleinere Änderungen vornehmen können“ – diese Abschrift habe ich noch nicht erhalten.

Auf jeden Fall klingt das nicht so, als hätte ich wirklich eine Chance, im Kongressprotokoll sinnvoll zu antworten, wie es Senator Whitehouse mehrfach versprochen hat. Deshalb antworte ich hier in meinem Blog, um zu zeigen, wie sinnlos ein solches Verhalten in den Hallen des Kongresses ist, wo ernsthafte Themen ernsthaft debattiert werden sollten.

Meine Anhörung vor dem Kongress im Jahre 2014

SW brachte meine Aussage aus dem Jahr 2014 vor dem Senatsausschuss für Umwelt und öffentliche Arbeiten zur Sprache, in der ich die Aussagen des IPCC AR4 (2007) mit denen des IPCC AR5 (2013) verglich, was mich zu dem Schluss brachte, dass der AR5 eine schwächere Argumentation für die anthropogene Erwärmung enthielt als der AR4.

SW las meine zusammenfassenden Aufzählungspunkte ab, ohne die umfangreiche Dokumentation zu erwähnen, die ich in Form von direkten Zitaten aus dem AR5 zur Verfügung gestellt hatte, und versuchte dann, meine Aussage von 2014 zu widerlegen, indem er meine Aussagen falsch darstellte und aktuelle Beobachtungen anführte, z. B. dass das antarktische Meereis derzeit auf einem Rekordtief sei.

Hier ist der Text aus meiner Aussage von 2014, die direkte Zitate aus dem IPCC AR5 sind:

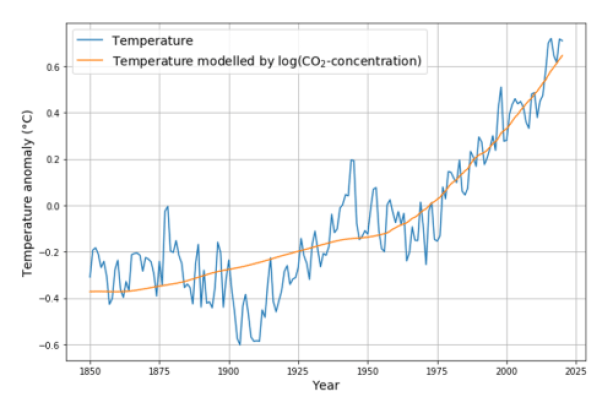

„Die Erwärmungsrate der letzten 15 Jahre (1998-2012) beträgt 0,05 [-0,05 bis +0,15] °C pro Jahrzehnt, was geringer ist als die seit 1951 (1951-2012) berechnete Rate von 0,12 [0,08 bis 0,14] °C pro Jahrzehnt.

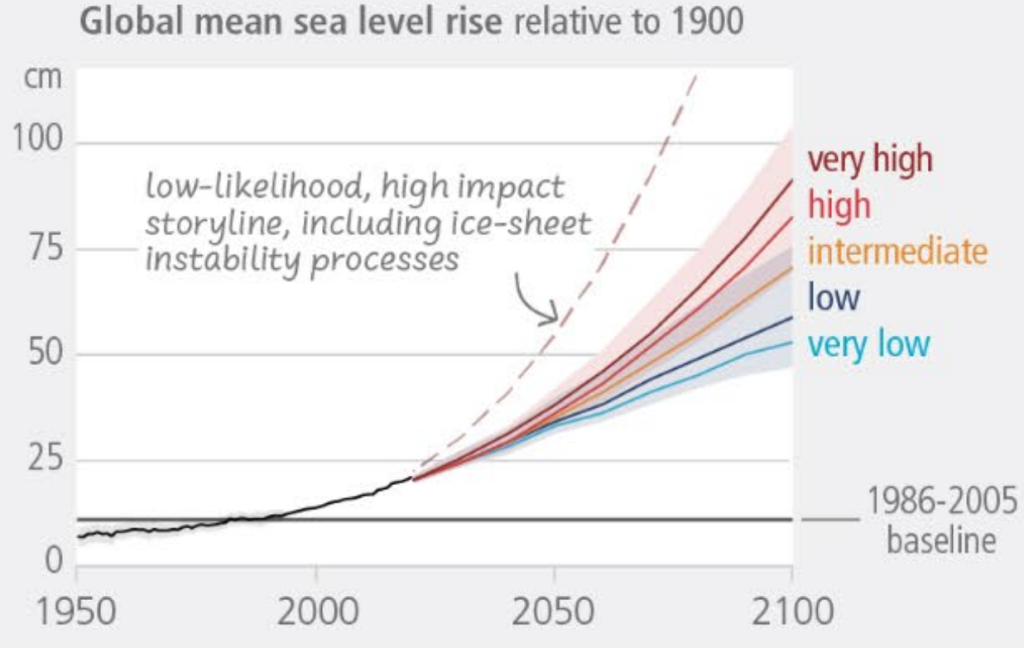

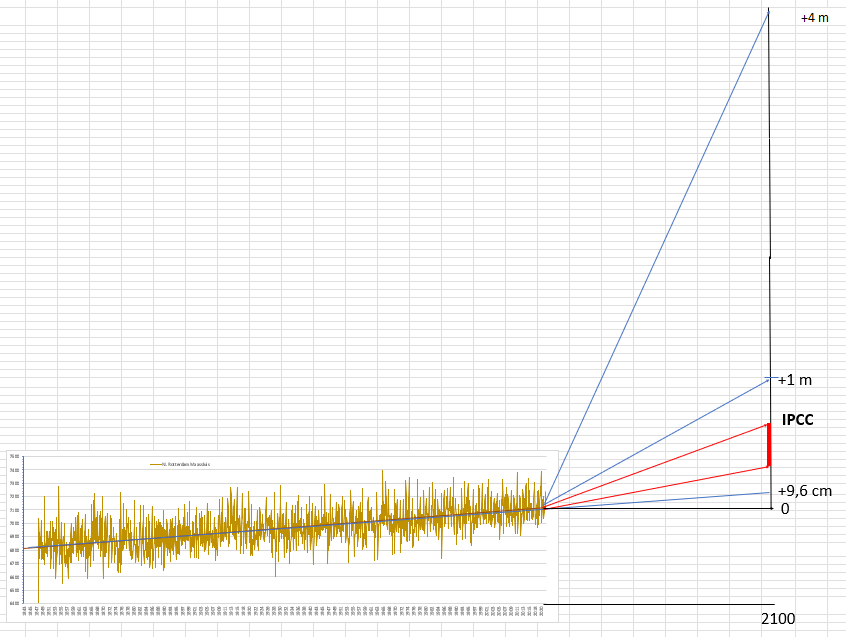

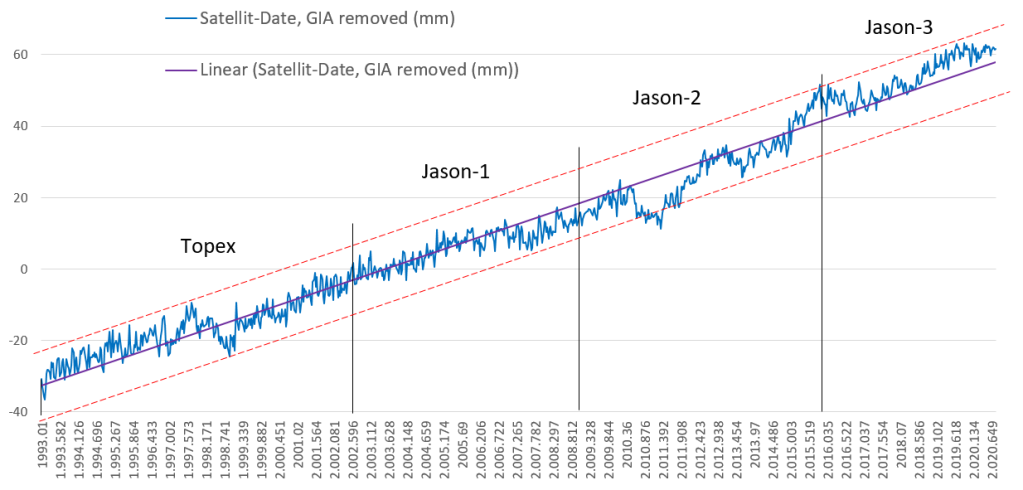

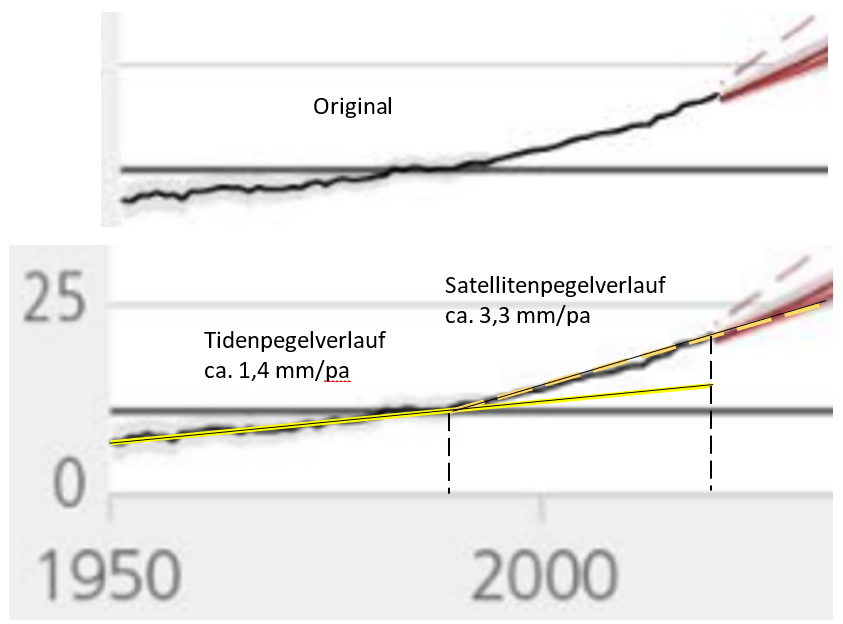

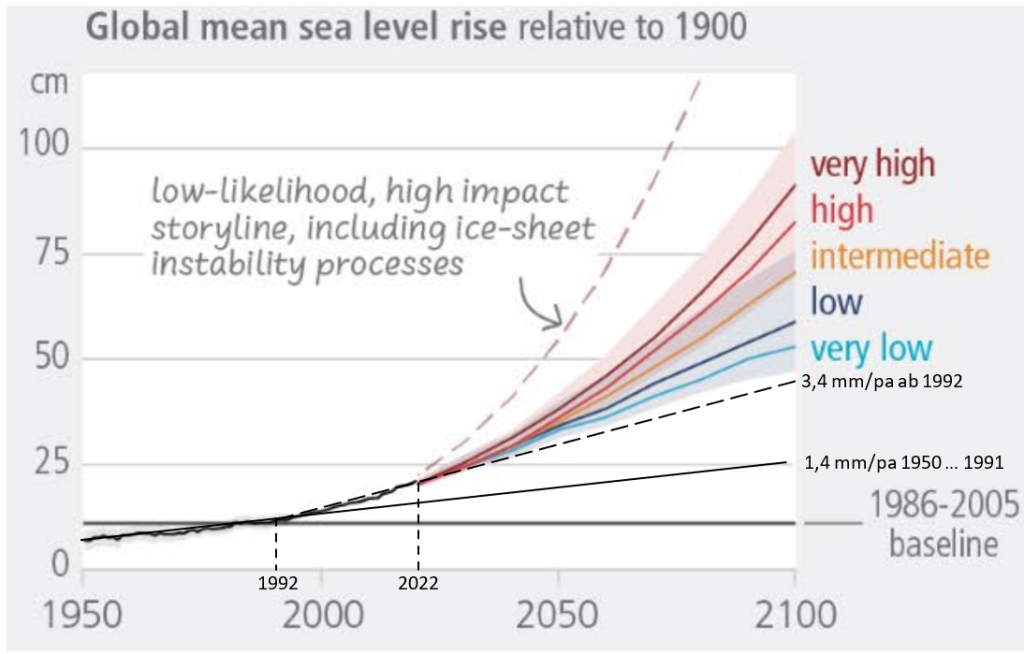

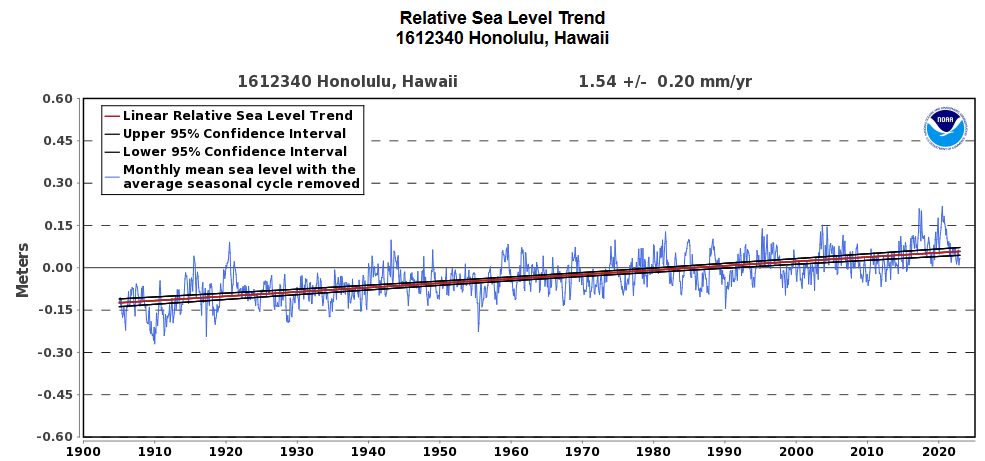

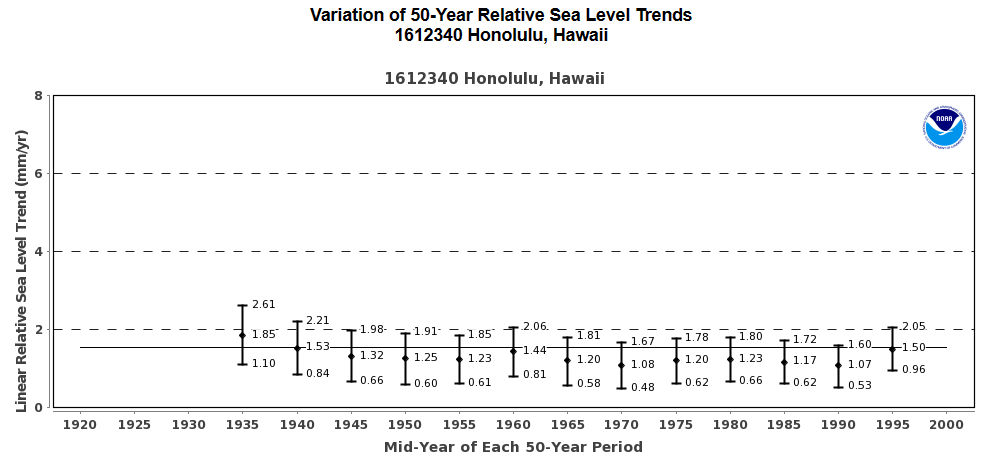

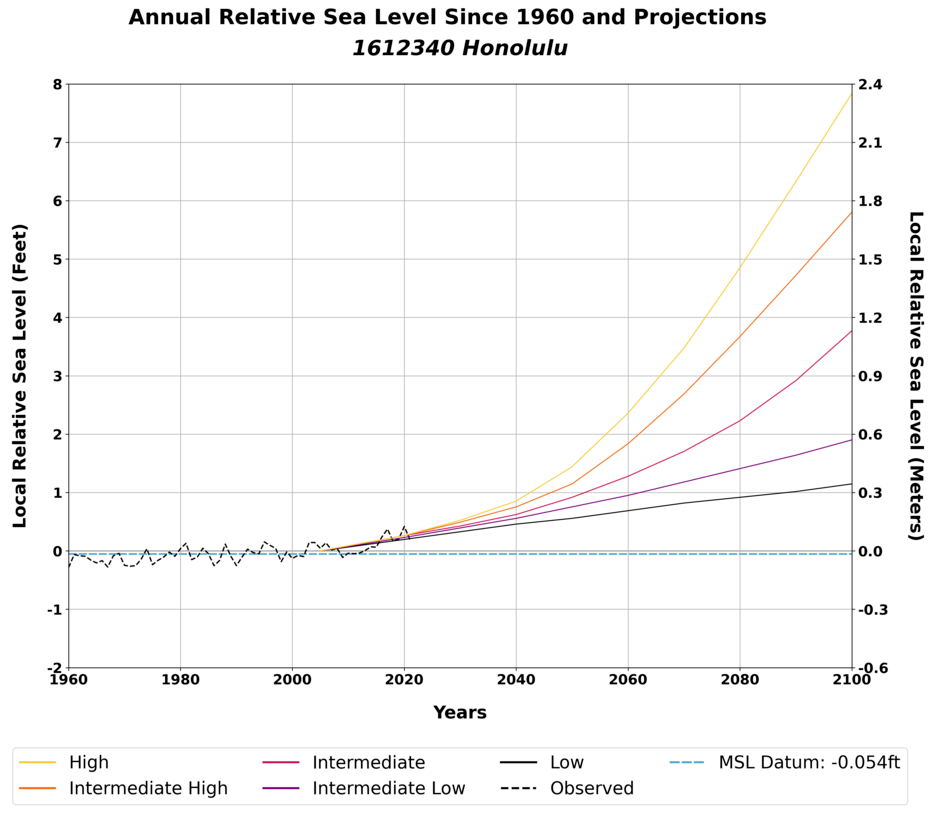

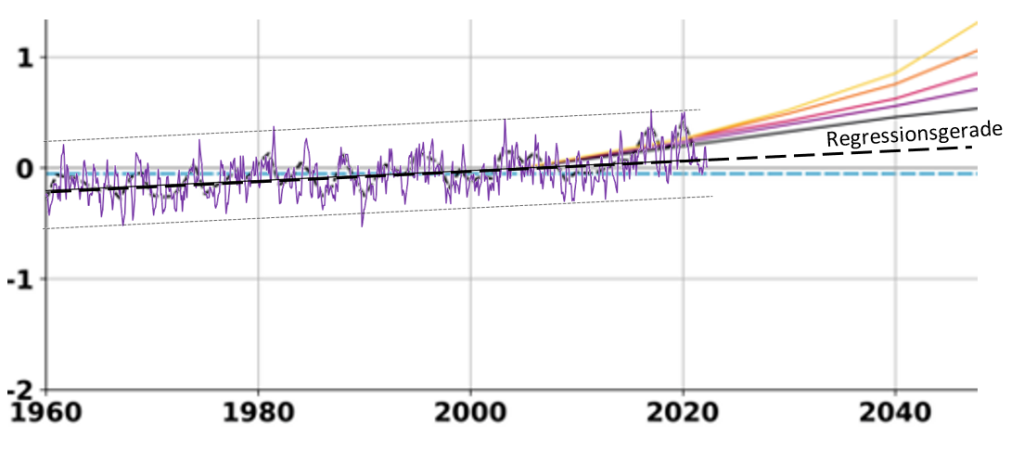

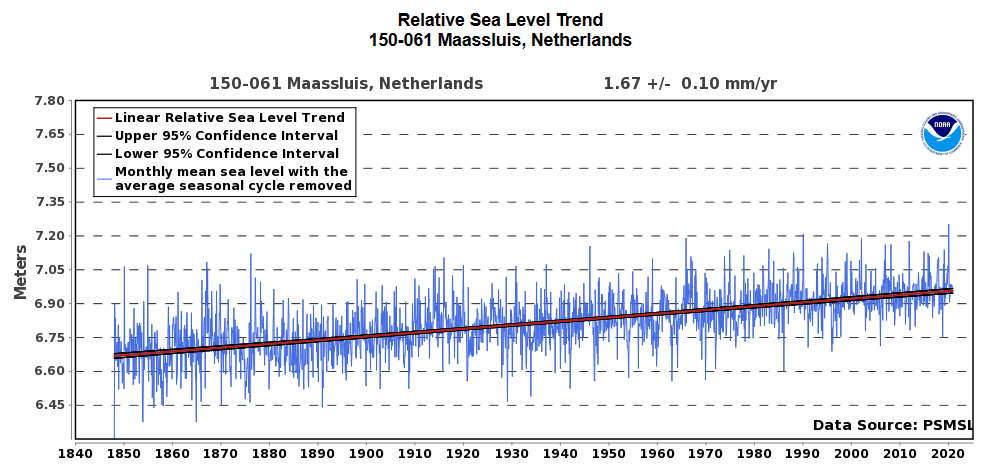

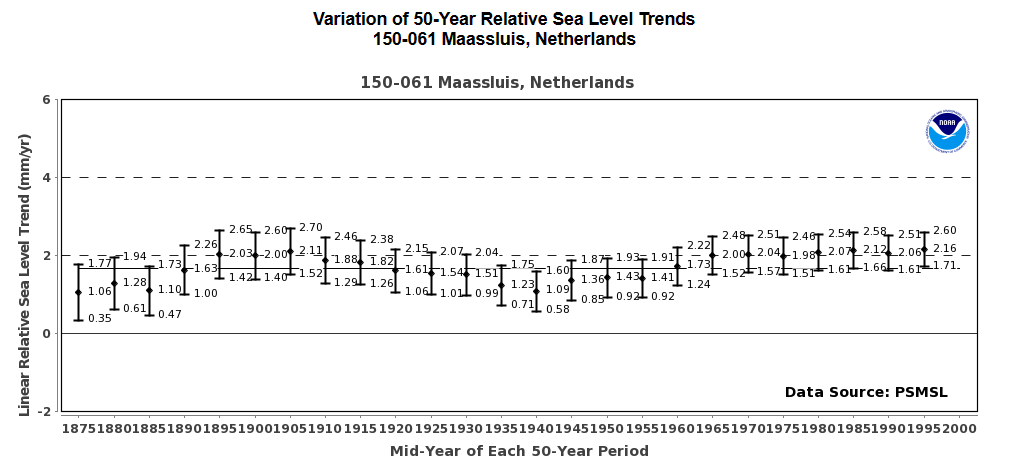

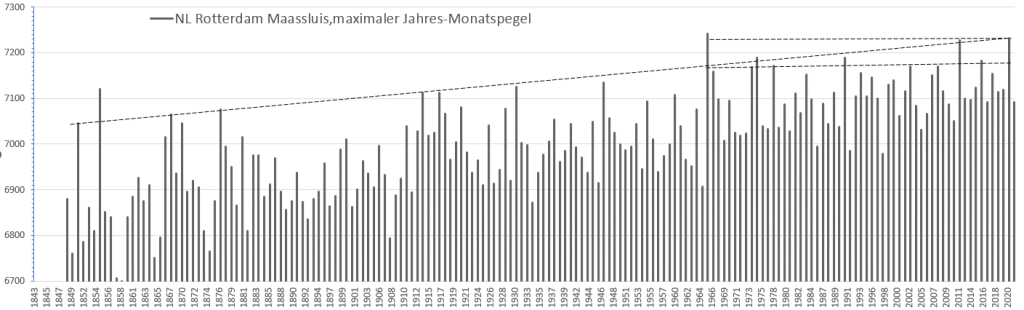

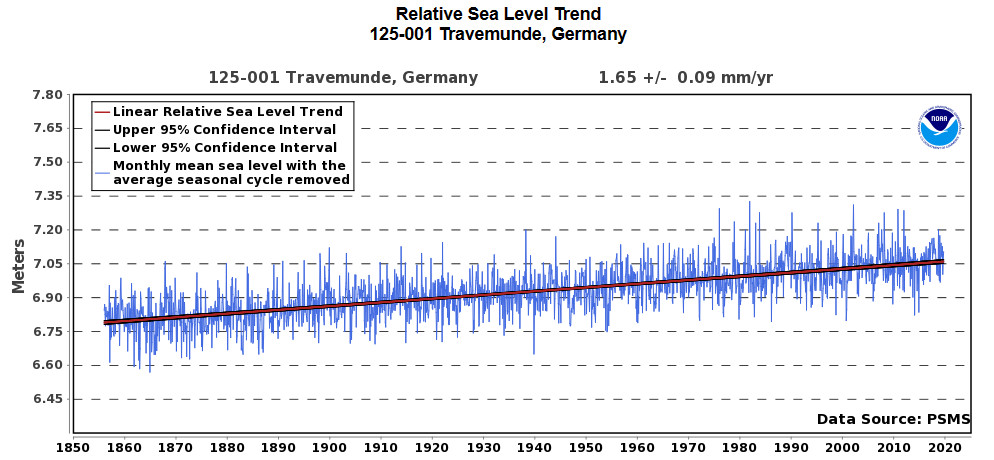

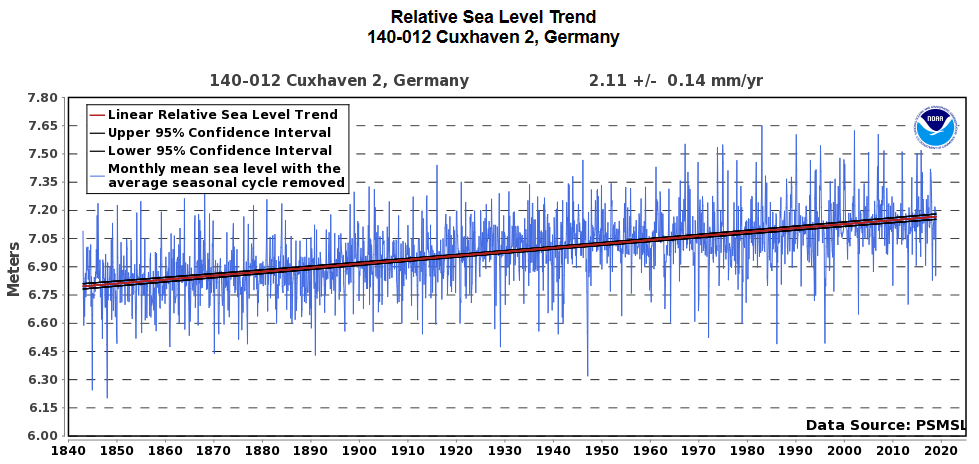

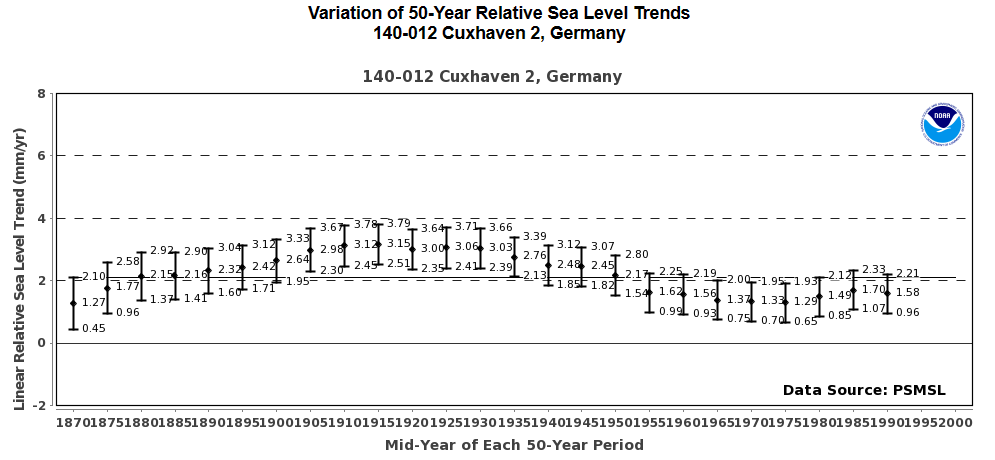

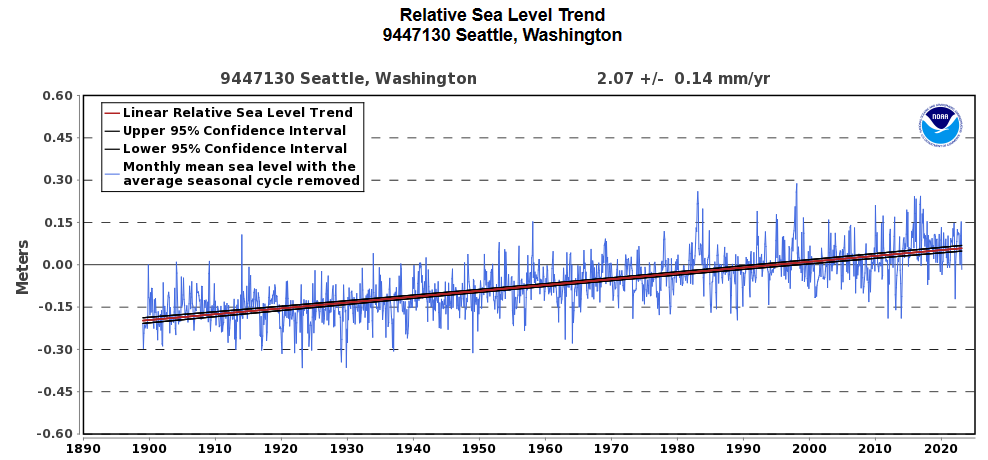

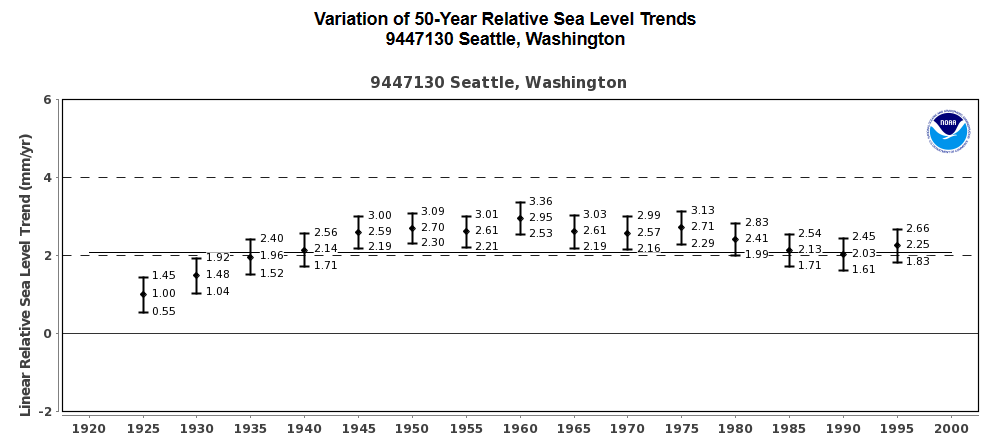

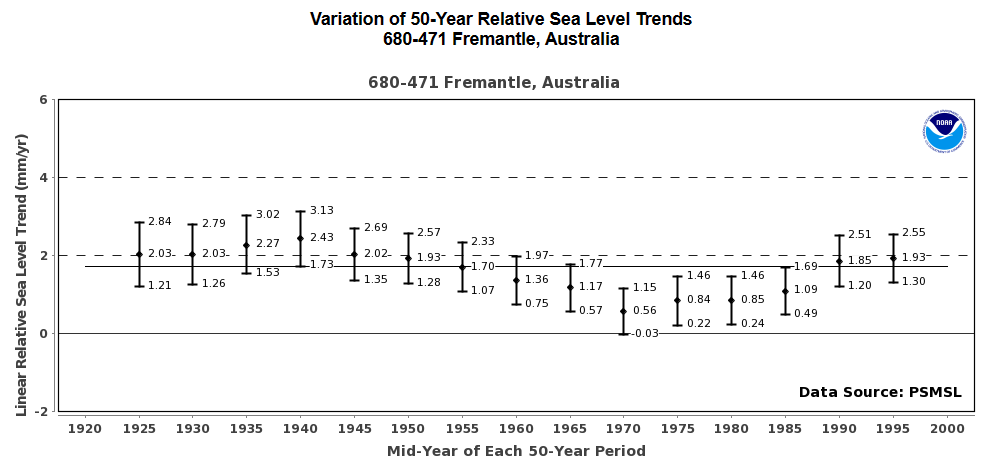

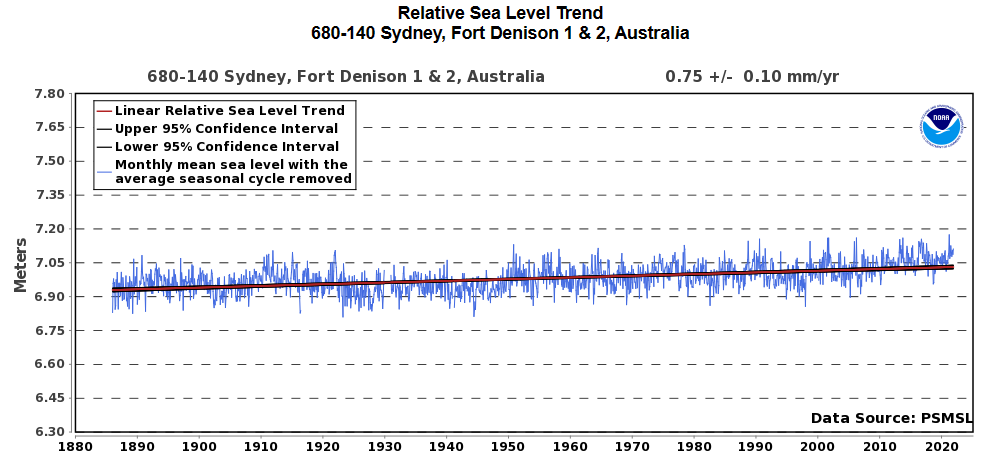

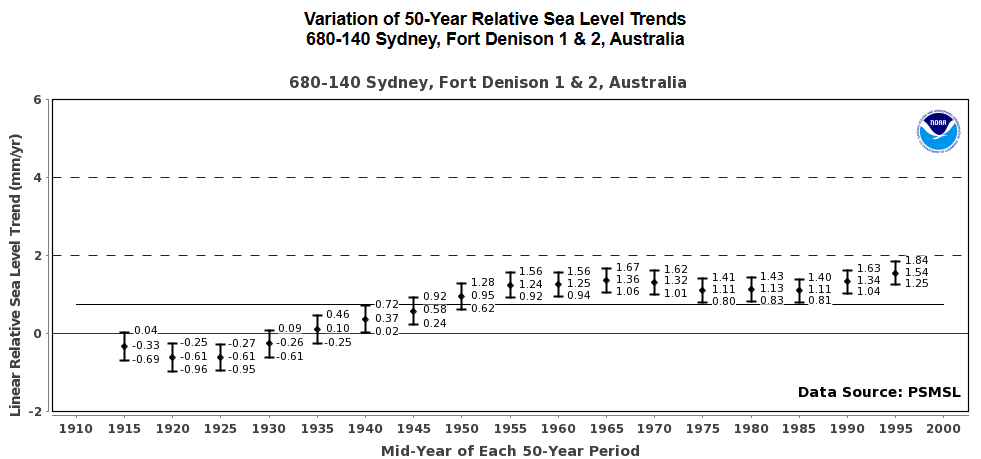

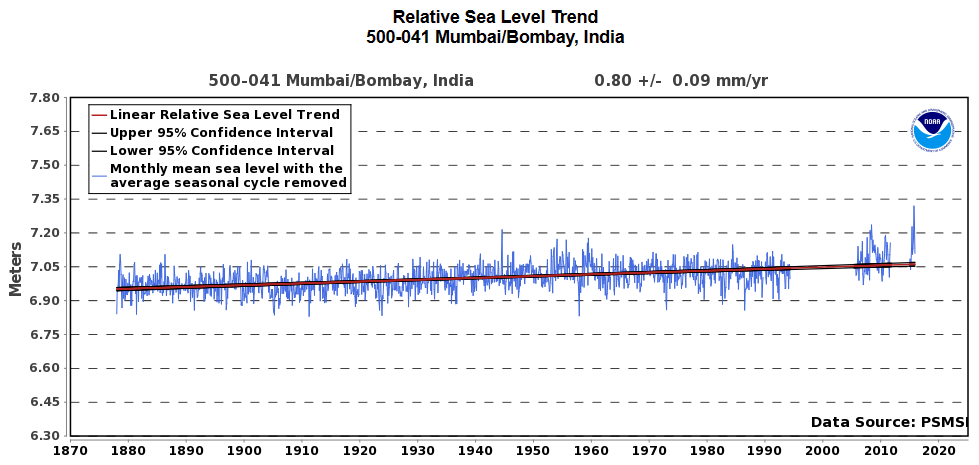

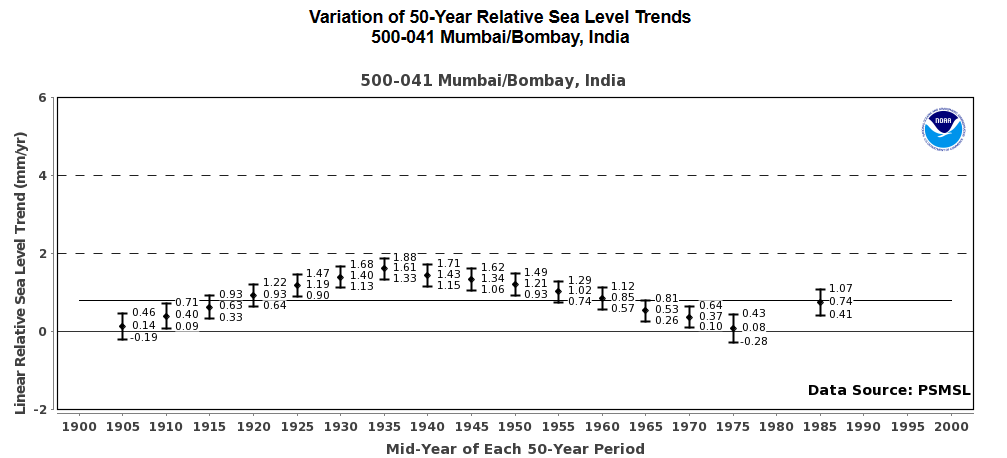

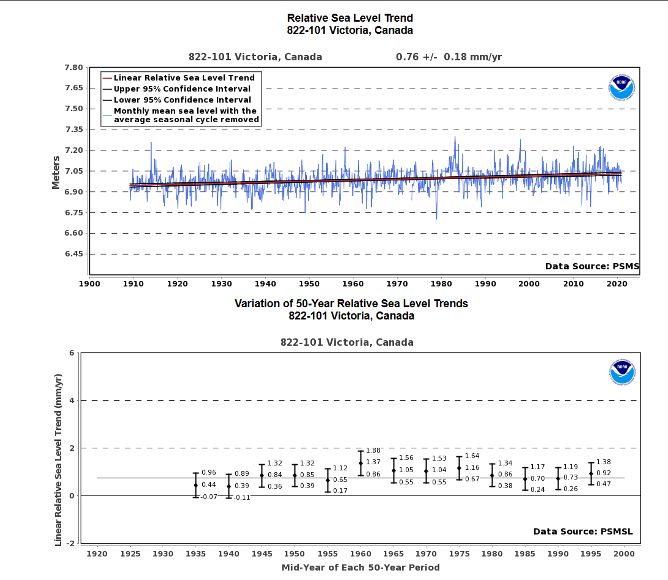

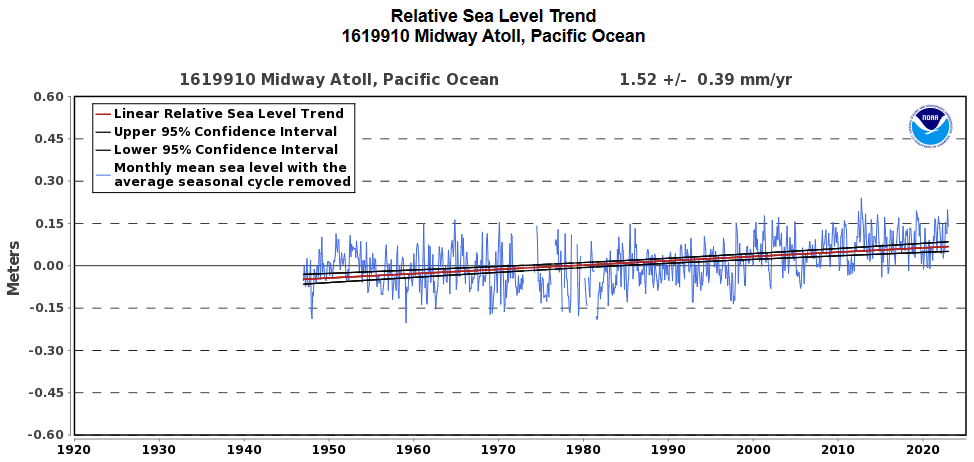

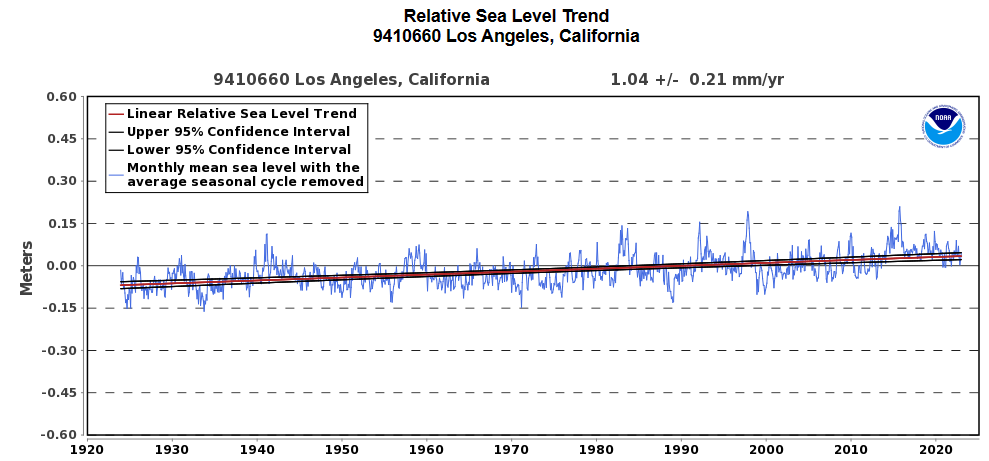

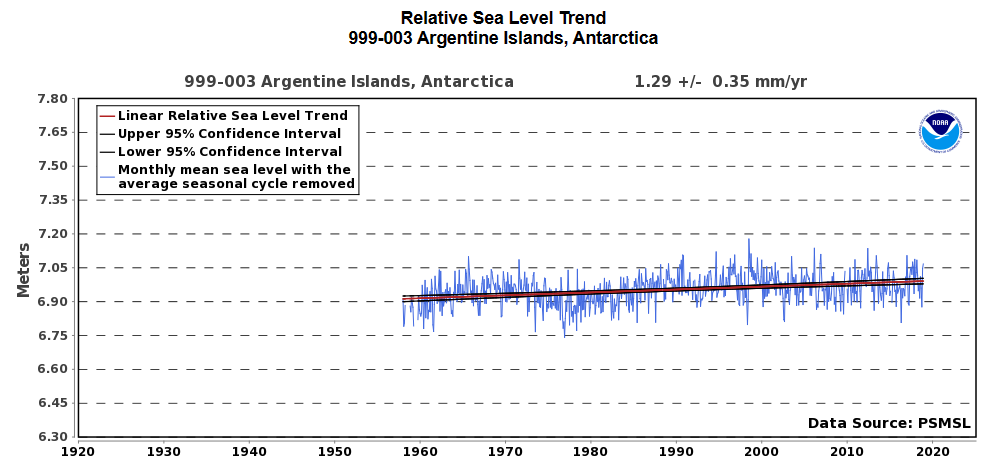

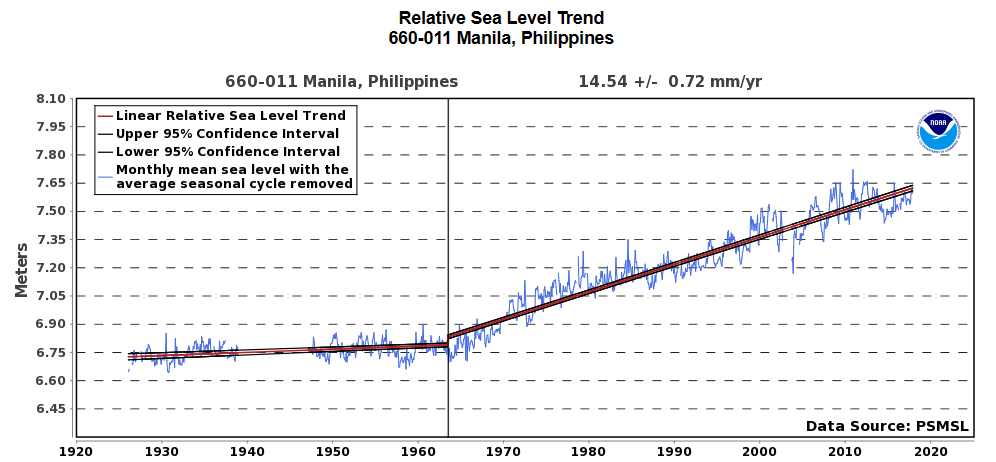

Es ist sehr wahrscheinlich, dass die mittlere Rate des global gemittelten Meeresspiegelanstiegs zwischen 1901 und 2010 1,7 [1,5 bis 1,9] mm pro Jahr-1, zwischen 1971 und 2010 2,0 [1,7 bis 2,3] mm pro Jahr-1 und zwischen 1993 und 2010 3,2 [2,8 bis 3,6] mm pro Jahr-1 betrug. Es ist wahrscheinlich, dass ähnlich hohe Raten zwischen 1920 und 1950 auftraten.

Es ist sehr wahrscheinlich, dass die jährliche Ausdehnung des antarktischen Meereises zwischen 1979 und 2012 mit einer Rate von 1,2 bis 1,8 % pro Jahrzehnt zugenommen hat. „Es besteht geringes Vertrauen in das wissenschaftliche Verständnis der beobachteten Zunahme der antarktischen Meereisausdehnung seit 1979, da die wissenschaftlichen Erklärungen für die Ursachen der Veränderungen unvollständig sind und miteinander konkurrieren und das Vertrauen in die Schätzungen der internen Variabilität gering ist.“

[Alle Hervorhebungen im Original]

SW fragt, wie sich diese Schlussfolgerungen im Laufe der Zeit bewahrheitet haben. Die historischen Temperatur- und Meeresspiegeldaten bleiben unverändert (zumindest größtenteils), und die langsame, aber unregelmäßige Erwärmung hat sich fortgesetzt.

Senator Whitehouse nutzte das jüngste Rekordtief der antarktischen Meereisausdehnung als Widerlegung der Aussagen in meiner Stellungnahme von 2014. Die Aussagen des IPCC AR5 über das antarktische Meereis, die in meiner Aussage von 2014 zitiert wurden, haben sich im Allgemeinen bestätigt. Hier ein Text aus dem IPCC AR6 WGI Report (Abschnitt 2.3.2.1.2):

„AR5 (2013) berichtete über einen kleinen, aber signifikanten Anstieg der gesamten mittleren jährlichen antarktischen Meereisausdehnung, der sehr wahrscheinlich im Bereich von 1,2-1,8 % pro Jahrzehnt zwischen 1979 und 2012 (0,13-0,20 Mio. km² pro Jahrzehnt) lag (sehr hohes Vertrauen), während SROCC (2019) berichtete, dass die gesamte antarktische Meereisbedeckung über den Zeitraum der Satellitenbeobachtungen (1979-2018) keinen signifikanten Trend aufwies (hohes Vertrauen). Das SROCC stellte fest, dass ein signifikanter positiver Trend bei der mittleren jährlichen Eisbedeckung zwischen 1979 und 2015 nicht fortgesetzt wurde, was auf drei aufeinanderfolgende Jahre mit unterdurchschnittlicher Eisbedeckung (2016-2018) zurückzuführen ist. Der SROCC stellte außerdem fest, dass historische antarktische Meereisdaten aus verschiedenen Quellen auf einen Rückgang der antarktischen Meereisbedeckung seit den frühen 1960er Jahren hinweisen, der jedoch zu gering ist, um von natürlichen Schwankungen getrennt zu werden (hohes Vertrauen).“

Nirgendwo in den IPCC-Berichten wird ein Rückgang der antarktischen Meereisausdehnung auf die vom Menschen verursachte Erwärmung zurückgeführt.

Diskrepanzen zwischen Klima-Modellprojektionen und Beobachtungen

Während der Anhörung wurde mir eine Zahl vorgelegt, die angeblich beweisen sollte, dass die Klimamodelle im Jahr 2004 die globale Durchschnittstemperatur seither genau vorhergesagt hatten.

Ich kannte diese Zahl nicht, wusste aber, dass die CMIP3-Modelle, die im IPCC AR4 von 2007 verwendet wurden, im AR5 die Temperaturen für den Zeitraum 1999-2012 zu hoch vorhergesagt hatten. Ich wusste auch, dass die CMIP3-Klimamodelle stark auf die historischen Temperaturdaten abgestimmt waren (was die gute Übereinstimmung vor 2004 erklärt). Später fand ich heraus, dass diese Zahl in einem Blogbeitrag veröffentlicht wurde, ohne dass genau beschrieben wurde, wie der Vergleich zwischen Modell und Beobachtung durchgeführt worden war.

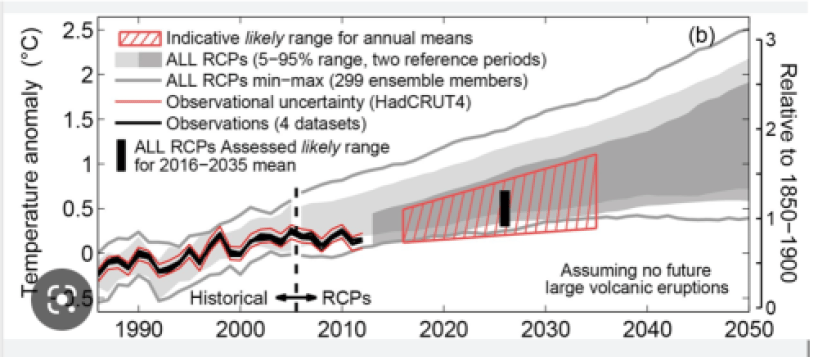

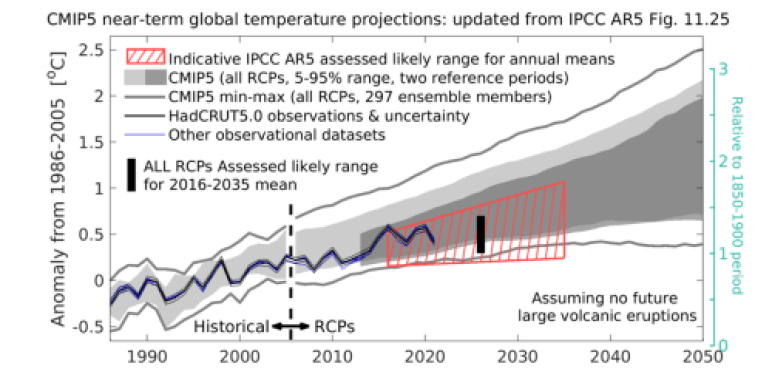

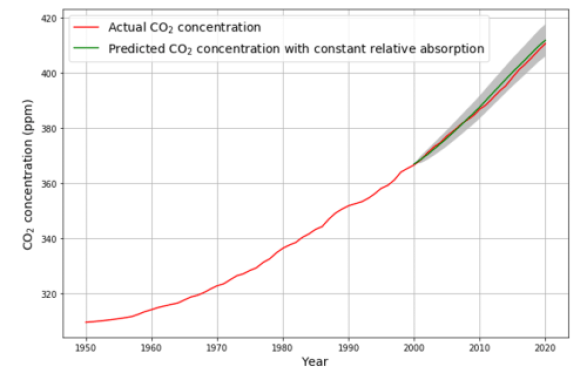

Hier ist die entsprechende Abbildung aus dem IPCC AR5. Abbildung 11.25 vergleicht Klimamodellprojektionen mit Beobachtungen der globalen Temperaturanomalien bis 2012:

Abbildung 11.25 zeigt, dass die kurzfristigen Klimaprojektionen für den Zeitraum 1999-2012 viel höher waren als die beobachteten Temperaturen, wobei mehrere Jahre unter die 5-95%-Grenze der Klimamodellsimulationen fielen.

Zu den CMIP3-Simulationen, die in dem Blogbeitrag und dem von Senator Whitehouse vorgestellten Diagramm verwendet wurden, heißt es im IPCC AR5:

„Allerdings sind die implizierten Erwärmungsraten im Zeitraum 1986-2005 bis 2016-2035 aufgrund des Hiatus geringer: 0,10°C-0,23°C pro Jahrzehnt, was darauf hindeutet, dass die AR4-Bewertung [CMIP3-Modelle] nahe dem oberen Ende der aktuellen Erwartungen für diesen spezifischen Zeitraum lag.“

Ed Hawkins ist der IPCC-Autor, der Abbildung 11.25 erstellt hat. Er aktualisierte die Abbildung mit Temperaturen bis 2021. In diesen späteren Zeitraum fielen auch die extrem warmen Temperaturen im Zusammenhang mit dem Super-El-Nino im Jahr 2016. Das Jahr 2016 erreichte kaum die Mitte der Klimamodellspanne; vergleichen Sie 2016 mit 1998 (einem früheren Super-El-Nino), das die obere Grenze der 5-95%-Spanne leicht überschritt.

Reizwörter: Korruption und Schwindel

Der unsinnigste Teil der Befragung bestand darin, mich auf meine Verwendung von zwei Reizwörtern für Klimawandel-Alarmisten anzusprechen – „korrupt“ und „Schwindel“.

SW erklärte: Sie haben das IPCC der Korruption beschuldigt. Stehen Sie zu dieser Anschuldigung? Er hat kein direktes Zitat belegt, ich habe keine Ahnung, worauf er sich genau bezieht, selbst nach einer Google-Suche nach den relevanten Wörtern.

In einem Interview für das Discover Magazine aus dem Jahr 2010 habe ich die folgende Aussage gemacht:

„Es besteht ein erhebliches öffentliches Interesse an der Untersuchung der durch Climategate aufgeworfenen Fragen. Zu diesen Fragen gehören: der Wunsch nach einer Bewertung der Zuverlässigkeit und Genauigkeit der historischen und Paläo-Temperaturaufzeichnungen/Rekonstruktionen; der Wunsch nach einer Bewertung, ob der IPCC korrumpiert wurde und ob seine Schlussfolgerungen zuverlässig sind und als Grundlage für die internationale Kohlenstoff- und Energiepolitik vertrauenswürdig sind; und die Frage, ob es einige „faule Äpfel“ in der Klimaforschungsgemeinschaft gibt, die in dem Sinne ausgemerzt werden müssen, dass sie sich nicht in verantwortlichen Positionen als Herausgeber von Zeitschriften, leitender IPCC-Autor oder Administrator befinden.“

Diese Aussage wurde später in einem Profil des Scientific American über mich aus dem Jahr 2010 in unangemessener Weise übertrieben:

„Nur wenige Wissenschaftler würden behaupten, dass der IPCC perfekt ist, aber Curry ist der Meinung, dass er gründlich reformiert werden muss. Sie beschuldigt ihn der ‚Korruption‚. ‚Ich werde nicht einfach drauflosreden und den IPCC gutheißen‘, sagt sie, ‚denn ich glaube, ich habe kein Vertrauen in den Prozess.’“

In einem Interview mit oilprice.com aus dem Jahr 2012 wurde die folgende Aussage gemacht, die meine Bedenken bezüglich des IPCC-Prozesses korrekt wiedergibt:

„Judith war einst eine Unterstützerin des IPCC, bis sie begann, mit bestimmten Strategien und Methoden der Organisation nicht mehr einverstanden zu sein. Sie befürchtete, dass die Kombination aus Gruppendenken und politischer Befürwortung in Verbindung mit einem tief verwurzelten „Syndrom der edlen Sache“ die wissenschaftliche Debatte erstickt, den wissenschaftlichen Fortschritt verlangsamt und den Bewertungsprozess korrumpiert.“

Etwa zur gleichen Zeit, als diese Interviews stattfanden, begann der InterAcademy Council (IAC) der Vereinten Nationen als Reaktion auf die durch Climategate aufgeworfenen Fragen mit einer gründlichen Überprüfung der Politik und Praxis des IPCC. Der IAC lud mich zu einem Vortrag über meine Bedenken ein. Etwa zur gleichen Zeit lud mich das U.S. Natural Research Council Committee on Science, Engineering and Public Policy ein, einen Vortrag über meine Bedenken hinsichtlich der Integrität der Klimawissenschaft im Lichte von Climategate zu halten.

Obwohl der IPCC mehrere der vom IAC empfohlenen Änderungen vorgenommen hat, bin ich weiterhin sehr besorgt über die Politisierung des IPCC. Seit 15 Jahren setze ich mich für die Integrität der wissenschaftlichen Forschung und der Bewertungsprozesse ein.

Zum jetzigen Zeitpunkt ist die IPCC-WGI zu den physikalischen Grundlagen des Klimawandels noch einigermaßen objektiv, obwohl die Zusammenfassung für die politischen Entscheidungsträger politisiert ist und die Ergebnisse herausgepickt wurden. Wie der kürzlich veröffentlichte IPCC-Synthesebericht zeigt, scheint die Wissenschaft den Raum verlassen zu haben, wobei der Schwerpunkt auf schwach begründeten Erkenntnissen über Klimaauswirkungen durch extreme Emissionsszenarien der WGII und politisierten politischen Empfehlungen zur Emissions-Reduzierung der WGIII liegt.

Das Thema „Schwindel“ ist sogar noch unsinniger.

Senator Whitehouse gab die folgende Erklärung ab: „Curry hat Trumps Beschreibung des Klimawandels als ‚Schwindel‘ zugestimmt und 2016 geschrieben, dass die UN-Definition des vom Menschen verursachten Klimawandels „als Schwindel zu qualifizieren ist.“ Dies ist eine eklatante Falschdarstellung dessen, was ich geschrieben habe.

In einem Blogbeitrag von 2016 mit dem Titel „Trumping the climate“ habe ich die Äußerungen des designierten Präsidenten Trump zum Klimawandel und seine häufige Verwendung des Wortes „Schwindel“ untersucht.

Schauen wir uns zunächst die Definition von „Schwindel“ [hoax] an; hier sind einige, die ich beim Googeln gefunden habe:

● eine humorvolle oder bösartige Täuschung.

● ein Trick, um etwas Falsches und oft Absurdes zu glauben oder als echt zu akzeptieren

● ein Plan, eine große Gruppe von Menschen zu täuschen

● eine absichtlich fabrizierte Unwahrheit, die als Wahrheit getarnt werden soll.

Mit diesen Definitionen im Hinterkopf, hier zwei Beispiele, die als Schwindel zu qualifizieren sind und über die ich bereits geschrieben habe:

1. Die UNFCCC-Definition des „Klimawandels“ ist wohl ein Schwindel: Der Klimawandel ist eine Veränderung des Klimas, die direkt oder indirekt auf menschliche Aktivitäten zurückzuführen ist, die die Zusammensetzung der globalen Atmosphäre verändert und die zusätzlich zu den über vergleichbare Zeiträume beobachteten natürlichen Klimaschwankungen auftritt[Link]. Diese Pervertierung der Definition des Begriffs „Klimawandel“ soll die Menschen zu der Annahme verleiten, dass der gesamte Klimawandel vom Menschen verursacht wird.

In Bezug auf Punkt 1 habe ich folgende Bedenken: Das UNFCCC hat den Begriff „Klimawandel“ neu definiert, weg von der traditionellen Definition, die in den geologischen, atmosphärischen und ozeanischen Wissenschaften verwendet wird, um eine Unterscheidung zwischen Klimawandel – zurückzuführen auf menschliche Aktivitäten, die die Zusammensetzung der Atmosphäre (hauptsächlich CO₂) verändern – und Klimavariabilität – zurückzuführen auf natürliche Ursachen – zu treffen. Diese Neudefinition des Begriffs „Klimawandel“, die sich nur auf vom Menschen verursachte Veränderungen der atmosphärischen Zusammensetzung bezieht, hat dazu geführt, dass der natürliche Klimawandel aus der öffentlichen Diskussion verschwunden ist – der allgemeine Sprachgebrauch spricht von „Klimawandel“ und erwähnt die natürliche Klimavariabilität nicht. Infolgedessen wird nun implizit davon ausgegangen, dass jede Veränderung, die in den letzten hundert Jahren beobachtet wurde, durch menschliche Emissionen in die Atmosphäre verursacht wurde. Diese Annahme führt dazu, dass jedes ungewöhnliche Wetter- oder Klimaereignis mit dem vom Menschen verursachten Klimawandel durch die Emissionen fossiler Brennstoffe in Verbindung gebracht wird. Diese Neudefinition des Begriffs „Klimawandel“ durch die UNFCCC ist eine Täuschung und Irreführung, die wohl dazu beigetragen hat, dass Trump den Klimawandel als Schwindel bezeichnet hat.

Warum jemand glaubt, dies sei eine Anhörung im Kongress wert, ist mir schleierhaft.

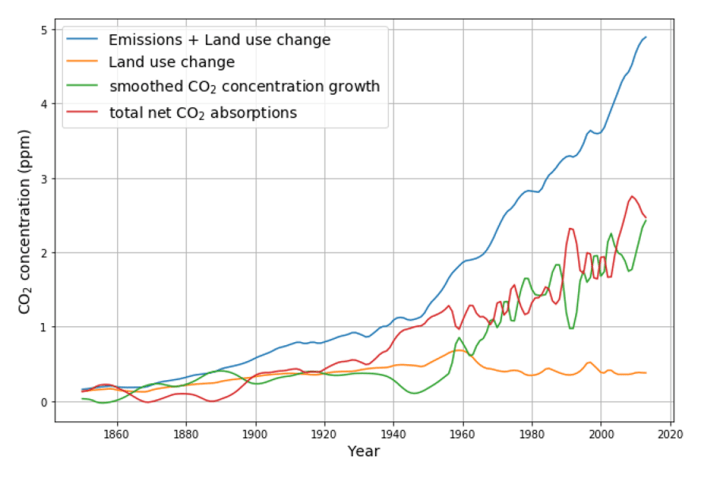

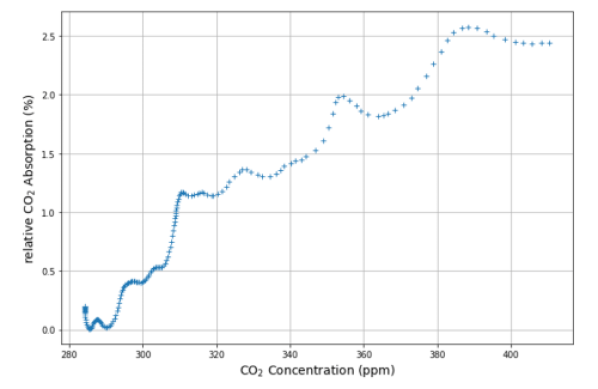

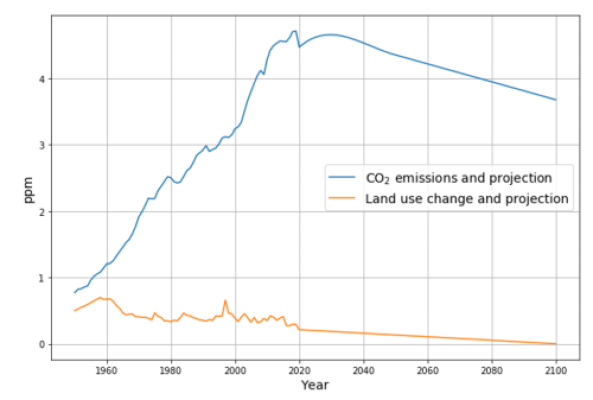

EXXON und das American Petroleum Institute

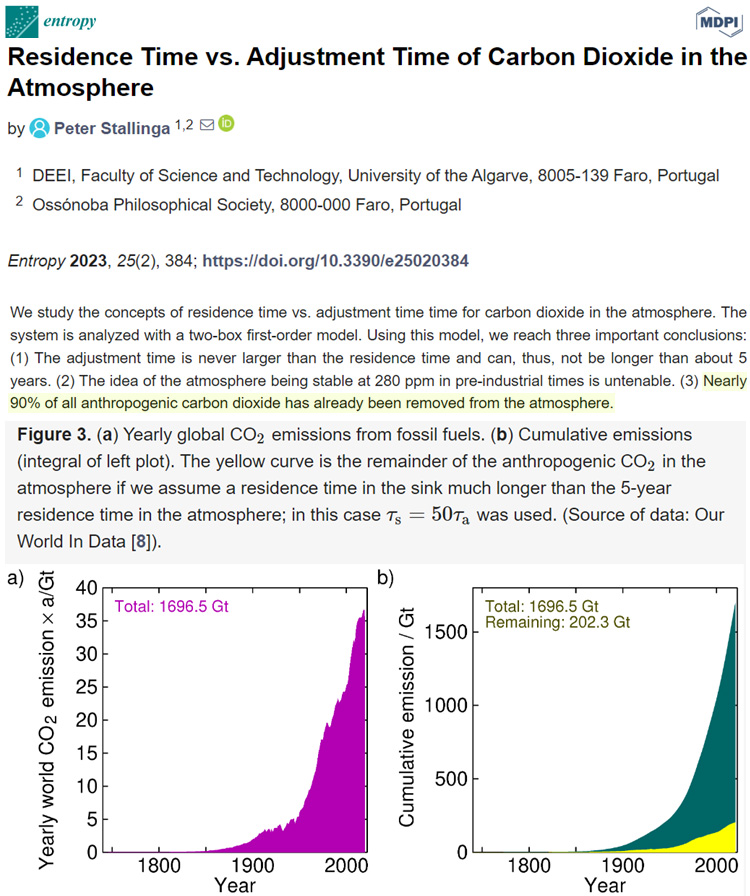

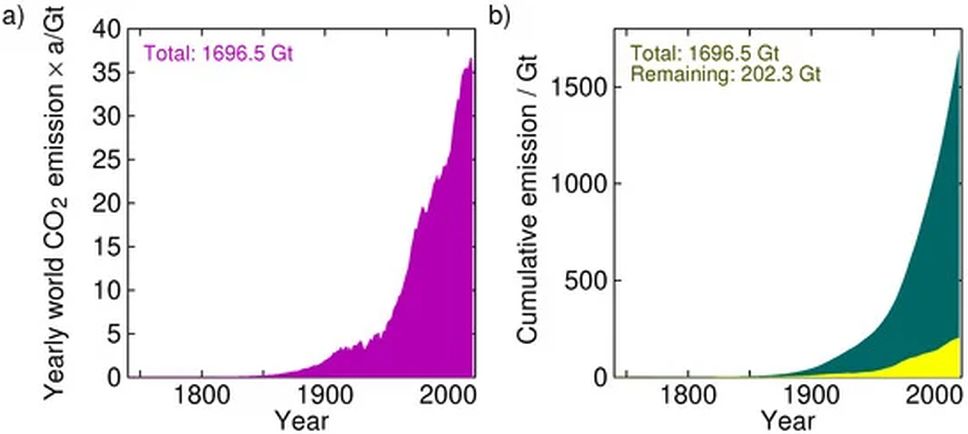

Mir wurde ein nicht entzifferbares Diagramm gezeigt, das von EXXON zu einem nicht näher bezeichneten Zeitpunkt, aber vermutlich in den 1960er oder 1970er Jahren, erstellt worden war. SW bezeichnete dieses Diagramm der CO₂-Konzentrationen und Temperaturen als ein „Modell“, das sich als ziemlich genau erwies. Zwei Linien, die beide den gleichen Trend aufweisen, stellen kein Modell dar und sagen auch nichts über die Kausalität aus.

Ich habe auch eine Erklärung gelesen, die 1968 in einem vom American Petroleum Institute in Auftrag gegebenen Bericht abgegeben wurde und in der davor gewarnt wird, dass ein weiterer Anstieg des CO₂ bis zum Jahr 2000 zu einer Klimaerwärmung führen könnte.

Der Punkt ist folgender: Unser Wissen über den Klimawandel steckte in den 1960er Jahren noch in den Kinderschuhen. Was Exxon oder irgendjemand anderes zu dieser Zeit „wusste“, war mit einer sehr schwachen Wissensbasis verbunden und ist für die aktuelle wissenschaftliche Debatte zu diesem Thema irrelevant. Wir haben den grundlegenden Effekt des atmosphärischen Treibhauseffekts seit dem 19. Jahrhundert verstanden; die wichtigsten Fragen sind nach wie vor sein Ausmaß und seine Bedeutung im Verhältnis zur natürlichen Klimavariabilität.

Der 1990 veröffentlichte Erste Sachstandsbericht des IPCC, der den besten Stand unseres Wissens mehrere Jahrzehnte nach dem Exxon-‚Modell‘ und dem AIP-Bericht widerspiegelt, enthält folgende zusammenfassende Beurteilung:

„Das Ausmaß dieser Erwärmung stimmt weitgehend mit den Vorhersagen der Klimamodelle überein, hat aber auch die gleiche Größenordnung wie die natürliche Klimaschwankung. Der beobachtete Anstieg könnte also weitgehend auf diese natürliche Schwankung zurückzuführen sein; alternativ könnten diese Schwankung und andere menschliche Faktoren eine noch stärkere, vom Menschen verursachte Treibhauserwärmung ausgeglichen haben. Die eindeutige Feststellung des verstärkten Treibhauseffekts anhand von Beobachtungen ist erst in einem Jahrzehnt oder später zu erwarten.“

Mein Op-Ed in der Washington Post aus dem Jahr 2007

Senator Whitehouse fragte mich, ob ich zu meinem Meinungsartikel von 2007 stehe, nachdem er den Teil über Risiko und Risikomanagement vorgelesen hatte. Dies ist für diese Anhörung tatsächlich von Bedeutung.

Wenn das Risiko jedoch groß ist, kann es sich lohnen, dagegen vorzugehen, auch wenn die Wahrscheinlichkeit gering ist. Betrachten Sie das Risiko als das Produkt aus Folgen und Wahrscheinlichkeit: was passieren kann und wie hoch die Wahrscheinlichkeit ist, dass es passiert [JC-Nachtrag: bei der Risikobewertung muss auch die Stärke der Wissensbasis berücksichtigt werden]. Ein Anstieg der globalen Temperaturen um 10 Grad bis 2100 ist nicht wahrscheinlich; das Gremium gibt ihm eine Wahrscheinlichkeit von 3 Prozent. Solche Risiken mit geringer Wahrscheinlichkeit und großen Auswirkungen werden routinemäßig in jede Analyse und Managementstrategie einbezogen, ob an der Wall Street oder im Pentagon.

Der Grund für die Verringerung der Kohlendioxid-Emissionen besteht darin, das Risiko möglicher katastrophaler Folgen zu verringern. Die Umstellung auf sauberere Brennstoffe hat den zusätzlichen Vorteil, dass die Auswirkungen auf die öffentliche Gesundheit und die Ökosysteme verringert und die Energiesicherheit verbessert werden, was auch dann von Nutzen ist, wenn das Risiko letztendlich verringert wird. [JC-Einschränkung: Ich stehe zu dieser Aussage, aber sie ist ganz sicher keine Befürwortung eines raschen Umstiegs auf Wind- und Sonnenenergie].

Es gibt keine einfache Lösung für dieses Problem; die Herausforderung besteht darin, wie man am besten Optionen entwickelt, die machbar, effizient, lebensfähig und skalierbar sind. Lomborg ist zu Recht besorgt über die Möglichkeit von Fehlentscheidungen in der Politik. Aber ich habe noch keine Option gesehen, die schlimmer ist, als das Risiko der globalen Erwärmung zu ignorieren und nichts zu tun.

Ich habe mich geirrt, als ich dem IPCC in Bezug auf die Eisbären vertraute, und ich lag mit den meisten meiner Kritikpunkte an Lomborg falsch. Meine Aussagen über das Risiko sind jedoch auch nach 16 Jahren noch recht gut nachvollziehbar. Aus meiner neueren Perspektive, da ich ein Buch zu diesem Thema geschrieben habe, möchte ich die folgende Nuance hinzufügen: „Climate Uncertainty and Risk“, insbesondere im Hinblick auf das „Nichtstun“.

Ein akzeptables Risiko erfordert kein Management. Risiken sind tolerierbar, wenn Aktivitäten aufgrund des damit verbundenen Nutzens als erstrebenswert erachtet werden. Bei tolerierbaren Risiken werden Bemühungen zur Risikominderung oder -bewältigung begrüßt, sofern der Nutzen der Aktivitäten nicht verloren geht. Die Verbrennung fossiler Brennstoffe wurde in der Vergangenheit als tolerierbares Risiko betrachtet. Die Risiken des Klimawandels wurden von verschiedenen Personen und Gruppen als akzeptabel, tolerierbar und nicht tolerierbar eingestuft – eine eindeutig zweideutige Situation. Wie ich in meiner schriftlichen Erklärung dargelegt habe, hängt die Einschätzung der untragbaren Risiken des Klimawandels damit zusammen, dass die langsam fortschreitende globale Erwärmung (ein sich abzeichnendes Risiko) fälschlicherweise mit den Folgen extremer Wetter- und Klimaereignisse (Notfallrisiken) verwechselt wird.

Die schleichende Erwärmung lässt sich am besten als tolerierbares Risiko beschreiben. Falls wir dieses Risiko beseitigen können, indem wir die Emissionen fossiler Brennstoffe so reduzieren, dass keine weiteren Schäden entstehen, dann ist dies zu begrüßen. Pläne, unsere Energieinfrastruktur schnell abzubauen und durch unzuverlässige Wind- und Solarenergie zu ersetzen, bergen jedoch die Gefahr, dass sie größeren Schaden anrichten als alle denkbaren Auswirkungen des Klimawandels. In meiner schriftlichen Stellungnahme bezeichne ich dies als „Übergangsrisiko“.

Vulkane und Klimawandel

Die einzige Erwähnung meiner schriftlichen Aussage durch SW ist eine Frage zu Vulkanen als Antwort auf meine Aussage:

„Plausible Szenarien der natürlichen Klimavariabilität in der Mitte des 21. Jahrhunderts (die nicht in den Klimamodellsimulationen enthalten sind) deuten auf eine Verlangsamung der globalen Erwärmung hin, die durch ein erwartetes solares Minimum, die Möglichkeit explosiver Vulkanausbrüche und eine prognostizierte Verschiebung der Ozeanzirkulationsmuster über mehrere Dekaden hinweg verursacht wird.“

SW stellte die Frage, ob ich erwarte, dass Vulkane uns vor der globalen Erwärmung retten werden. Meine Meinung dazu steht im Einklang mit der IPCC AR6 WG1 Box 4.1:

In der Regel gab es in drei von vier Jahrhunderten mindestens eine Eruption mit einer Stärke von mehr als -1 W/m² (Pinatubo oder größer). Die vulkanische Aerosolbelastung war im 20. Jahrhundert um 14 % geringer als im Durchschnitt der vorangegangenen 24 Jahrhunderte, während das 13. Jahrhundert mit vier Eruptionen, die die des Pinatubo 1991 übertrafen, zu den vulkanisch aktivsten gehörte.

Aufgrund der direkten Strahlungswirkung vulkanischer stratosphärischer Aerosole führen große Vulkanausbrüche zu einem Gesamtrückgang der GSAT [Global Surface Air Temperature], der sich im Fall von gebündeltem Vulkanismus auf Zeitskalen von mehreren Dekaden oder Jahrhunderten erstrecken kann.

[Hervorhebung im Original]

Angesichts der Unvorhersehbarkeit einzelner Ausbrüche wird der vulkanische Antrieb in CMIP6-Modellen als konstante Hintergrundbelastung vorgegeben. Das bedeutet, dass die Auswirkungen potenzieller großer Vulkanausbrüche in den Modellprojektionen weitgehend unberücksichtigt bleiben, und nur wenige Studien haben sich mit den möglichen Auswirkungen auf die Erwärmung im 21. Jahrhundert befasst. Eine Studie untersuchte Zukunftsszenarien mit hypothetischen Vulkanausbrüchen, die mit dem Niveau der vulkanischen Aktivität im CE [Common Era] unter RCP4.5 übereinstimmen, und stellte fest, dass die Klimaprojektionen erheblich verändert werden könnten. Wenn auch nur vorübergehend, könnten nach einem Ausbruch von der Größe des Samalas 1257 weltweit für einige Jahre Temperaturen nahe dem vorindustriellen Niveau erreicht werden.

Eine Häufung von Eruptionen hätte erhebliche Auswirkungen auf die Entwicklung der globalen Temperatur (GSAT) während des gesamten Jahrhunderts und könnte weitreichende Folgen haben, wie bei früheren Eruptionen beobachtet worden ist.

Mitteilung von JC an Senator Whitehouse

Wenn Sie in Zukunft einen solchen Versuch unternehmen wollen, schlage ich vor, dass Sie bessere Mitarbeiter brauchen. Die Fragen zu „korrupt“, „Schwindel“, Exxon und API waren wirklich unsinnig. Wenn Sie versuchen, etwas zu beweisen, z. B. dass die Projektionen der Klimamodelle von 2004 mit den Beobachtungen übereinstimmen, sollten Sie sich auf eine bessere Quelle als einen Blogbeitrag stützen. Auf jeden Fall scheint all dies die etwa 80 ahnungslosen Kommentatoren Ihres Youtube-Clips beeindruckt zu haben. Aber es wird ernsthafte Menschen nicht beeindrucken.

Der Klimawandel ist ein ernstes Thema. Je nach Sichtweise und Wertvorstellungen wird es in Zukunft viele Verluste und Schäden geben, entweder durch den Klimawandel selbst oder durch die Maßnahmen, die den Klimawandel verhindern sollen. Die Konflikte im Zusammenhang mit dem Klimawandel wurden durch eine zu starke Vereinfachung sowohl des Problems als auch seiner Lösungen verschärft. Und weil die Risiken des Klimawandels falsch dargestellt werden.

Eine konstruktive Zusammenarbeit mit Ihren republikanischen Kollegen ist unerlässlich, um etwas zu erreichen, das unsere Anfälligkeit für extreme Wetterereignisse und die schleichende Erwärmung verringern könnte. Ein guter Anfang wäre es, den von den Republikanern eingeladenen Zeugen ein gewisses Maß an Respekt entgegenzubringen und die in ihren Aussagen vorgebrachten Argumente sorgfältig zu prüfen. Die Anhörungen sind eine Gelegenheit für die Senatoren, tatsächlich etwas von den Experten zu lernen.

Link: https://wattsupwiththat.com/2023/03/27/senate-budget-committee-hearing-judith-curry-responds/

Übersetzt von Christian Freuer für das EIKE