Die Überlagerung von Abbildung 1b zeigt stattdessen, dass S-R-O die spekulative Bedeutung von Mitchells (1977) Abbildung 5 nicht kannte. Sie waren nachlässig. Sie haben Mitchells (1977) Abbildung 5 nicht bis zu ihrem Ursprung zurückverfolgt. Sie waren offensichtlich nicht neugierig, woher sie stammt. Und sie setzten es trotz allem für ihre Zwecke ein

von Pat Frank

In dem „Exxon Knew“ sich als nicht wissend herausstellt.

Anklagende Polemik, getarnt als Nachrichten aus der Klimawissenschaft, ist heutzutage an der Tagesordnung. Vielleicht haben Sie schon einmal eine E-Mail an einen Wissenschaftsreporter geschrieben, in der Sie Ihre Bestürzung über die unreflektierte Voreingenommenheit des IPCC zum Ausdruck gebracht oder eine Korrektur der angeblichen Wissenschaft angeboten haben. Das habe ich auch getan, und zwar viele Male. In der Regel gibt es keine Antwort.

Kürzlich hat ein Wissenschaftsreporter konstruktiv geantwortet, als ich eine E-Mail über einen Artikel über „Klimaleugnung“ und „den kohlefinanzierten Angriff auf saubere Energie“ schrieb. Zu den genannten Klimaleugnern gehörten John Droz, Steve Milloy – offenbar ein König unter den Klimaleugnern – und Donald Trump.

Lange Rede, kurzer Sinn: Der Reporter schickte meine Kommentare an den emeritierten Prof. Martin Hoffert (New York University), einen langjährigen Klimamodellierer mit einigen beeindruckenden frühen theoretischen Arbeiten. Er antwortete.

Dieser Essay ist der nukleare Fallout, der aus diesem kleinen Funken entstanden ist.

I. Der Eintritt in den Sumpf der Verzweifelten

Im Jahr 2019 hatte Prof. Hoffert vor dem House Subcommittee on Civil Rights and Civil Liberties. des Repräsentantenhauses ausgesagt. Das Thema lautete „Untersuchung der Bemühungen der Ölindustrie, die Wahrheit über den Klimawandel zu unterdrücken.“ Auf der Liste der Beweisführer stand auch Prof. Naomi Oreskes.

Prof. Hoffert hatte in den 1980er Jahren unter Vertrag mit Exxon-Klimaforschern gearbeitet. In seiner Aussage vor dem Unterausschuss des Repräsentantenhauses äußerte Prof. Hoffert großen Respekt vor ihrer Professionalität und ihrem Talent. In seiner Aussage (pdf) heißt es jedoch: „… Exxons nach außen gerichtete Desinformation und die Finanzierung von Klimawandelleugnern, obwohl unsere interne Forschung genau das Gegenteil vorhersagte. Sie sind, wie Naomi Oreskes sie nennt, ‚Händler des Zweifels“, die aus der Tatsache Kapital schlagen, dass mehr Menschen Fernsehwerbung sehen als wissenschaftliche Literatur lesen.“

Zusammen mit seiner kritischen Antwort an meinen Gesprächspartner schickte Prof. Hoffert seine Aussage vor dem Kongress und ein Exemplar von (2023) Supran, Rahmstorf und Oreskes (S-R-O), in dem der Beweis erbracht wird, dass „Exxon es wusste“.

Die Geschichte von S-R-O (2023) besagt, dass Exxon-Wissenschaftler 1980 mit absoluter Sicherheit wussten, dass die CO₂-Emissionen aus fossilen Brennstoffen das Klima erwärmen würden, dass die Wissenschaftler die Exxon-Geschäftsführung entsprechend informiert hatten und dass die Exxon-Geschäftsführung die Öffentlichkeit in den folgenden 40 Jahren zynisch und mit böser Absicht belogen hat. Alles nur um des Profits willen, und die Zukunft der eigenen Kinder sei verdammt.

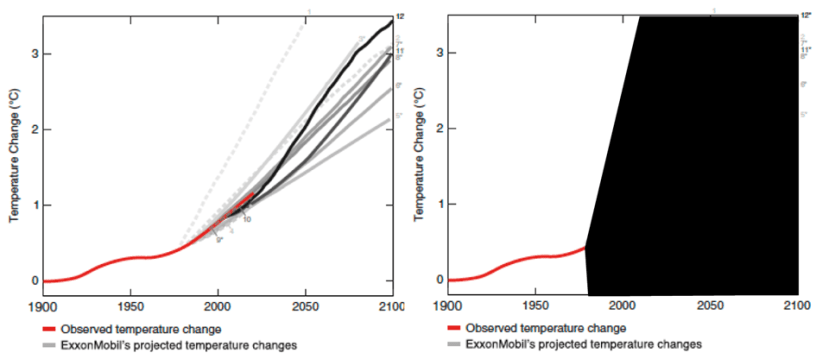

Das anklagende Zentrum von S-R-O (2023) ist ihre Abbildung 2; hier Abbildung 1 unten links.

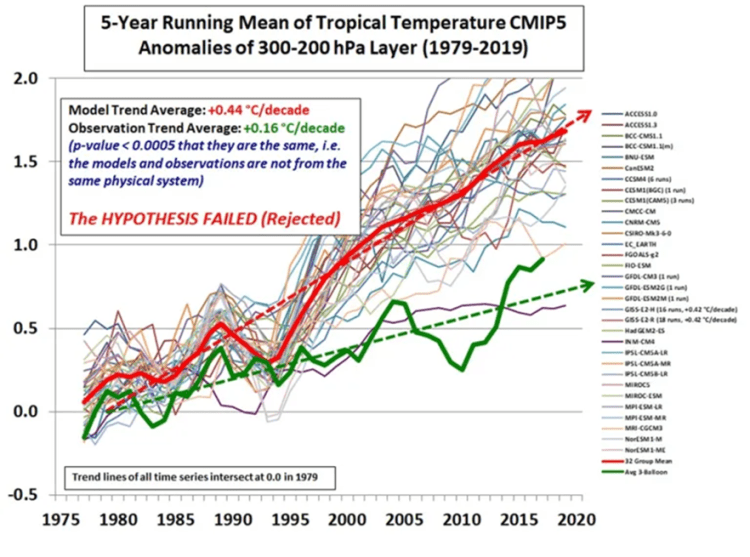

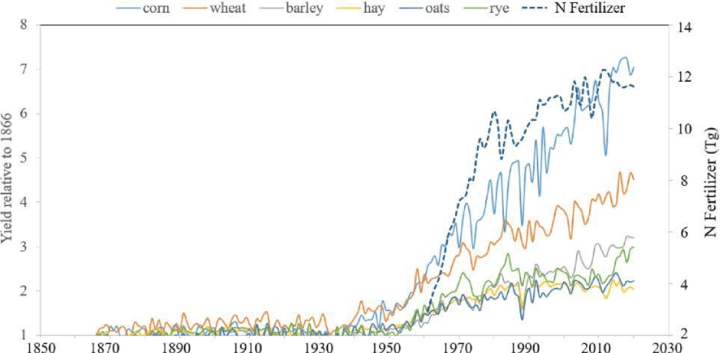

Abbildung 1, links, stellt die Exxon-internen und veröffentlichten Lufttemperaturprognosen zusammen, welche von verschiedenen Klimamodellen aus den 1970er- bis 2000er-Jahren erstellt wurden, die mit spekulativen Szenarien für künftige CO₂-Emissionen arbeiten. Die rote Linie ist die beobachtete Lufttemperatur, die zum Vergleich herangezogen wird.

Abbildung 1 (rechts) zeigt, wie die gleichen Projektionen aussehen würden, wenn sie mit allen Unsicherheitsbalken versehen würden, die sich aus den Fehlern ergeben, die Klimamodelle bei der Simulation des Erdklimas im simulierten Wolkenanteil machen.

Die Kombination der Gesamtheit der Projektionen mit der Gesamtheit ihrer Unsicherheitsbalken wird Mitternacht auf der Gesamtheit der Grafik einläuten.

Die Wolken steuern den Wärmeenergiefluss in der Atmosphäre. Der thermische Energiefluss bestimmt die Lufttemperatur. Stimmt die Bewölkung nicht, stimmt auch die Lufttemperatur nicht.

Abbildung 1: Links, Abbildung 2 aus (2023) Supran-Rahmstorf-Oreskes. Die Originallegende lautet: „Zusammenfassung aller Projektionen der globalen Erwärmung (nominale Szenarien), die von ExxonMobil-Wissenschaftlern in internen Dokumenten und begutachteten Veröffentlichungen (graue Linien) berichtet wurden, überlagert von historisch beobachteten Temperaturveränderungen (rot)“. Die Projektionen stammen aus den Jahren 1977 bis 2003. Rechts: S-R-O (2023) Abbildung 2 mit allen Projektions-Unsicherheitsbalken, die den Kalibrierungsfehler der Modellwolken ausdrücken, addiert und zusammen aufgetragen.

Über den gesamten Zeitraum von 1977 bis 2003 war die untere Nachweisgrenze für Klimamodelle >100x größer als die jährliche Störung der Treibhausgasemissionen. S-R-O (2023) behauptet, dass Klimamodelle etwas aufdecken können, das für Klimamodelle völlig unsichtbar ist. Das ist so, als würde man beim Betrachten eines Wassertropfens mit einer 4fachen Juwelierlupe ausrufen: „Bakterium!“.

S-R-O (2023) behaupten, sie wüssten jetzt, und die Exxon-Wissenschaftler und das Exxon-Management wussten 1977 um die Auswirkungen einer Störung auf das Klima, die mehr als 100-mal kleiner ist als die kleinste Störung, die das Klimamodell überhaupt auflösen kann.

Eine vollständige Bestandsaufnahme der Simulationsfehler von Klimamodellen ist sehr viel umfangreicher. Auch hier und hier. Die von den Exxon-Temperaturprognosen übermittelten Klimainformationen sind gleich Null.

Exxon konnte das damals nicht wissen, und auch sonst niemand. Exxon weiß es auch jetzt nicht, und auch sonst niemand, denn die totale Unwissenheit von 1977 herrscht auch heute noch vor.

Der S-R-O (2023) Grafik in Abbildung 1, links, fehlen auch die Unsicherheitsbalken bekannter systematischer Messfehler, die den Vorhang der Projektion über die beobachteten Temperaturen zurückziehen würden. S-R-O (2023) Abbildung 2 würde dann die tatsächlich verfügbaren Klimainformationen korrekt wiedergeben.

II. In dem Exxon enthüllt, was es wusste.

Die Exxon-Dokumente, auf die sich S-R-O (2023) stützt, sind praktischerweise auf der vom Climate Investigations Center eingerichteten und gepflegten Website Climate Files gesammelt. Wenn man sie liest, fällt einem die professionelle Vorsicht der Exxon-Wissenschaftler auf. Sie schrieben klar und deutlich über den zeitgenössischen Mangel an Wissen. Über die Unkenntnis (im Jahr 1977), ob der Anstieg des CO₂ in der Atmosphäre auf die Emissionen fossiler Brennstoffe oder auf die Abholzung von Wäldern zurückzuführen ist. Über Klimamodelle, die noch viel Arbeit benötigten und nicht in der Lage waren, die Auswirkungen unserer CO₂-Emissionen auf das Klima vorherzusagen.

In einem internen Schreiben vom 29. Januar 1980 von Walter Eckelmann, dem stellvertretenden Leiter der Exxon-Abteilung für Wissenschaft und Technik, an Morey O’Loughlin im Exxon-Vorstand heißt es: „Science & Technology ist der Ansicht, dass die Anreicherung von Kohlendioxid in der Atmosphäre ein potenziell ernstes Problem ist, das die Ergebnisse einer riesigen weltweiten Forschungsanstrengung erfordert, bevor quantitative Vorhersagen über die Wahrscheinlichkeit und den Zeitpunkt weltweiter Klimaveränderungen getroffen werden können.“

„Potenziell“ und „riesige weltweite Forschungsanstrengungen“ bringen die Bedeutung auf den Punkt. Sie wussten es nicht und es musste viel getan werden, um es herauszufinden.

Trotz gegenteiliger banaler parteipolitischer Beteuerungen weiß niemand im Voraus über die Zukunft Bescheid.

Mr. Eckelmann führte weiter aus, dass die Bemühungen die Ressourcen eines einzelnen Unternehmens (d.h. Exxon) übersteigen. Er erklärte weiter, dass Exxon ein laufendes jährliches Forschungsprogramm in Höhe von 600.000 $ für das CO₂-Klima-Problem habe und auch die CO₂-Klima-Arbeiten des Marine Biological Lab in Woods Hole und des Scientific Committee on Problems of the Environment (SCOPE) mit jeweils 20.000 $ pro Jahr finanziere.

M.B. Glaser war der Leiter des Umweltprogramms von Exxon. Sein 1982 veröffentlichtes Buch The CO₂ „Greenhouse“ Effect (pdf) fasst die Situation auf eine äußerst vernünftige Weise zusammen: „Es wäre verfrüht, jetzt signifikante Änderungen der Energieverbrauchsmuster vorzunehmen, um diesem potenziellen Problem und all den wissenschaftlichen Unsicherheiten zu begegnen, da solche Schritte schwerwiegende Auswirkungen auf die Wirtschaft und die Gesellschaft der Welt haben könnten.“

Und dies: Die Teilnehmer eines AAAS-DOE-Workshops über die gesellschaftlichen und institutionellen Reaktionen auf einen CO₂-Anstieg „waren der Meinung, dass sich die Gesellschaft innerhalb der dann bestehenden wirtschaftlichen Beschränkungen an einen CO₂-Anstieg anpassen kann. Einige der getesteten Anpassungsmaßnahmen würden nicht mehr als ein paar Prozent des für die Mitte des nächsten Jahrhunderts geschätzten Bruttosozialprodukts verschlingen.“

In seinem Bericht von 1984 über das Forschungsprogramm des Exxon-Konzerns zu Klima und CO₂ schrieb A. J. Callegeri Folgendes:

– Modelle werden eingesetzt, um physikalische Auswirkungen (Szenarien) zu erforschen und als Prognoseinstrument.

– Modellierung des Kohlenstoffkreislaufs zur Bestimmung des Verbleibs von CO₂-Emissionen aus fossilen Brennstoffen.

– Gültigkeit der Modelle nicht erwiesen.

– Die Komplexität des Kohlenstoffkreislaufs und des Klimasystems erfordert viele Annäherungen und Parametrisierungen.

– Geologische und historische Daten sind für die Validierung von Modellen unzureichend.

Kommt Ihnen das bekannt vor? Callegeris Argumente sind auch heute, fast 40 Jahre später, noch völlig zutreffend.

Im Dezember 2000 schrieb der Exxon-Klimaforscher Brian Flannery an Lloyd Keigwin (pdf), der 1996 mit Sargasso Sea berühmt wurde, und zeigte sich bestürzt über die falsche Darstellung sowohl seiner Position als auch der Unterstützung der Klimawissenschaft durch Exxon. Der Brief ist sehr lesenswert. Die Verneinung von Naomi Oreskes „Exxon Knew“-Anschuldigungen könnte nicht deutlicher sein.

Kurz gesagt, die eindeutige Beweislage ist, dass Exxon nichts wusste und sich in gutem Glauben bemühte, es herauszufinden.

Die gesamte Behauptung, Exxon habe es gewusst, beruht auf der unausgesprochenen, falschen und völlig unsinnigen Umarmung von Klimamodellen – selbst derer von 1977 – als Wahrheitsmaschinen. Gottes Lippen zu ihren Terminals werden zu Flachbildschirmen.

Exxon wusste, dass sie es nicht wussten und dass es auch sonst niemand wusste (und immer noch nicht weiß).

III. Darin verraten Supran, Rahmstorf und Oreskes, was sie 2023 noch nicht wussten.

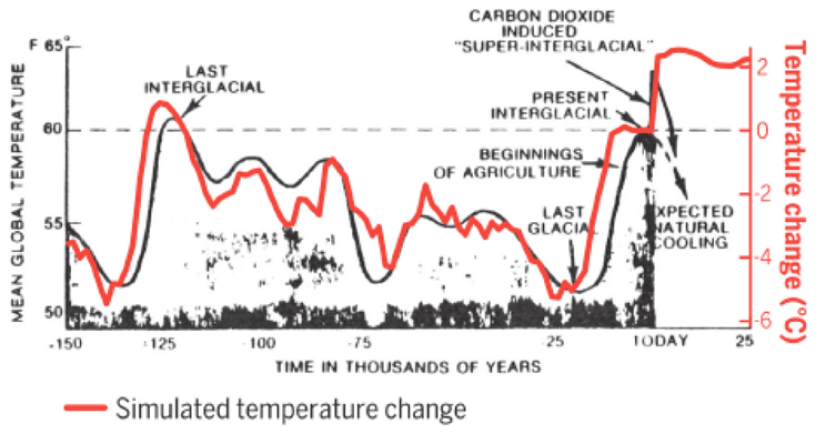

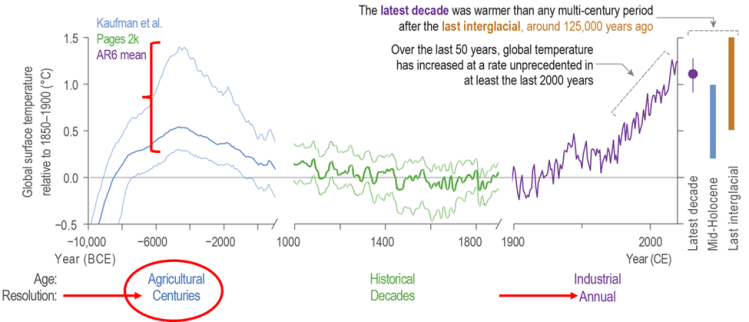

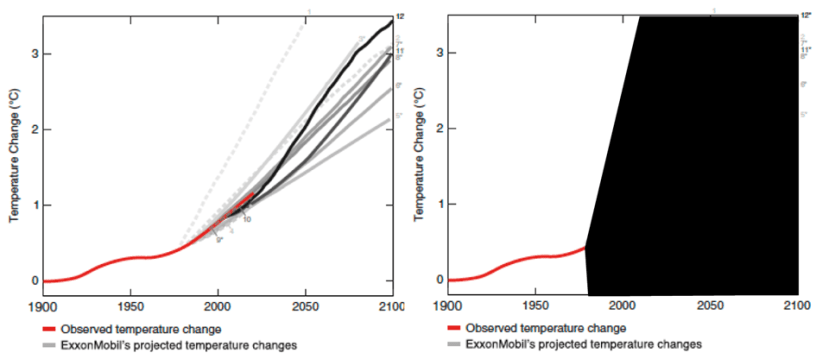

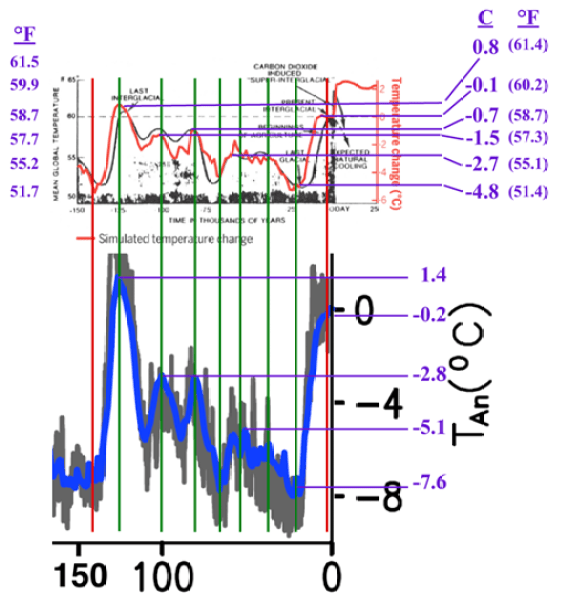

Bei der Lektüre von S-R-O (2023) wurde ich neugierig auf ihre Abbildung 1b (unten). Der schwarze Teil von Abbildung 1b stammt aus dem Jahr 1977. Im Juli desselben Jahres war es Vugraph Nr. 11 in einer Präsentation von J. F. Black vor dem Managementausschuss der Exxon Corporation. J. F. Black war ein wissenschaftlicher Berater von Exxon.

J. J. F. Black hielt seinen Vortrag 5 Jahre vor der Veröffentlichung des ersten CO₂/δ¹⁸O-Datensatzes in Eiskernen durch Neftel et al. Daher war ich neugierig auf den Ursprung der 150.000-jährigen Temperaturaufzeichnung in Abbildung 1b. Und wie wurden die Lufttemperaturen in der Tiefenzeit im Jahr 1977 zugeordnet?

Abbildung 2: S-R-O (2023) Abbildung 1b. Die schwarze Linie und die Achsen, komplett mit Verwischungen, sind J. F. Blacks Vugraph #11 von 1977. Die rote Linie ist eine geglättete „Erdsystem-Modellsimulation (Ganopolski und Brovkin (2017)) der letzten 150.000 Jahre, die nur durch orbitalen Antrieb angetrieben wird, mit einem angehängten moderaten anthropogenen Emissionsszenario.“ S-R-O (2023) Supporting Information (pdf).

Wie wurden also die in Abbildung 1b dargestellten Fahrenheit-Temperaturen (linke Ordinate) im Jahr 1977 zugeordnet? S-R-O zitiert Abbildung 1b nach J. J. M. Mitchell, Carbon dioxide and future climate. Environmental Data Service (März): 3-9 (1977), aber der S-R-O-Link führt zu einer Zusammenfassung des Energieministeriums, nicht zu der Studie.

Nach einigen Bemühungen habe ich das EDS-Zeitschriftenarchiv gefunden (42 MB pdf). Der Artikel von Mitchell erscheint in der Ausgabe vom März 1977, S. 3-9. S-R-O (2023) Abbildung 1b war ursprünglich als Abbildung 5 in Mitchell (1977) zu finden.

Mitchell hat aber auch keine Quellenangabe für seine Abbildung 5 gemacht. Er sagte auch nicht, wie die Temperaturskala zugeordnet wurde. Woher kommt das alles?

Lange Rede, kurzer Sinn: Ich suchte in der Literatur nach einem Proxy, der Daten für Mitchell im Jahr 1977 geliefert haben könnte. Diese Suche führte zu J. D. Hays, et al. (1976) „Variations in the Earth’s Orbit: Pacemaker of the Ice Ages“ (Variationen des Erdorbits: Schrittmacher der Eiszeiten).

Hays (1976) berichtete über Foraminiferen δ¹⁸O aus zwei Tiefsee-Sedimentkernen aus dem südlichen Indischen Ozean (nahe 45° südlicher Breite und 85° östlicher Länge). Hays (1976) verwendete auch Radiolarien, um die sommerlichen subantarktischen Meerestemperaturen (SST ±3 C; 95% CI) an den Kernstandorten zu schätzen.

Hays (1976) wäre 1977 der beste verfügbare Wissensstand gewesen, als Mitchell seine Arbeit schrieb und Black 1977 seinen Vortrag bei Exxon hielt.

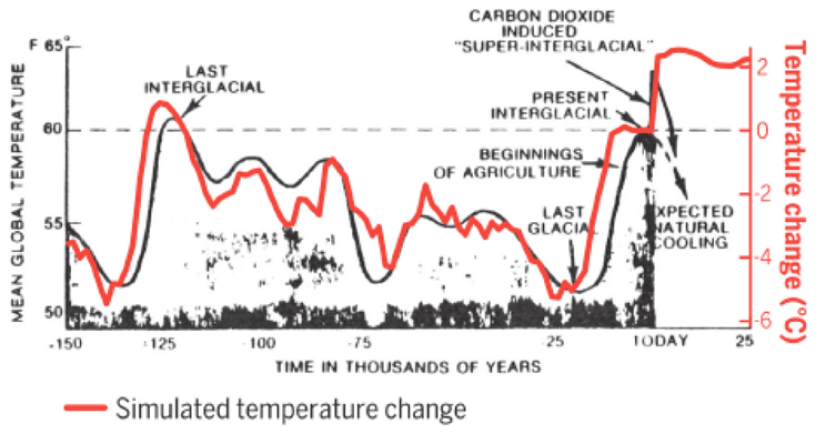

Aber es wird kompliziert. Abbildung 3 zeigt, dass die Temperaturgrafik von Mitchell (1977) sehr ähnlich aussieht wie die Stufen 1-6 der foraminiferalen δ¹⁸O-Reihe in Abbildung 9A von Hays (1976).

Abbildung 3: Ausschnitt der ersten 150.000 Jahre vor der Gegenwart der δ¹⁸O-Reihe aus Abbildung 9A von Hays et al. (1976). Die Abszisse ist im Vergleich zu S-R-O (2023) Abbildung 1b umgedreht.

In der Tat scheint Mitchell Abbildung 5 eine handgezeichnete Reproduktion von Hays (1976) Abbildung 9A zu sein.

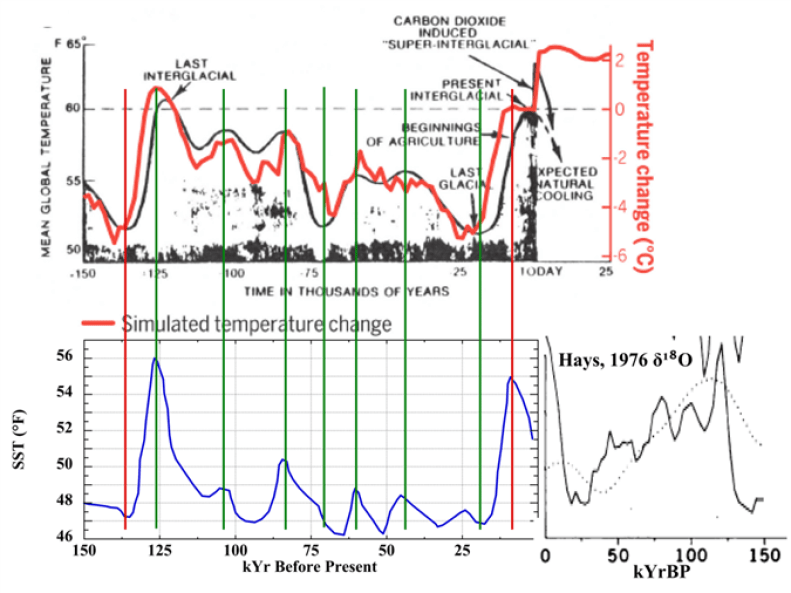

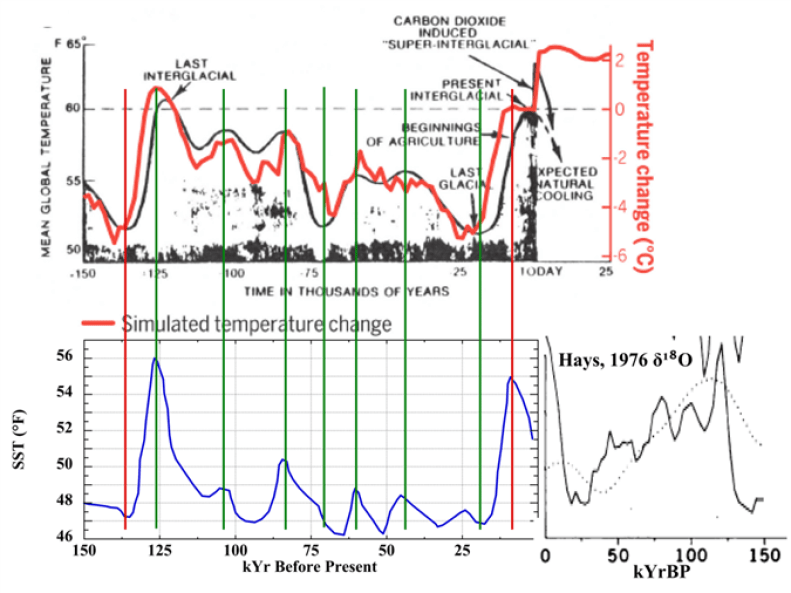

Abbildung 4 unten zeigt S-R-O (2023) Abbildung 1b und das Foraminiferen-δ¹⁸O von Hays (1976) über denselben Zeitbereich und mit skalierten Abszissen. Die vertikalen roten Linien positionieren die beiden Grafiken. Die Jahresstriche stimmen alle gut überein. Die vertikalen grünen Linien, die auf den δ¹⁸O-Merkmalen von Hays (1976) zentriert sind, stimmen gut mit denen von Mitchell (1977) überein.

Abbildung 4: S-R-O (2023) Abbildung 1b in einer Linie mit meiner digitalisierten Version von Hays (1976) Foraminiferen δ¹⁸O. Die vertikalen grünen Linien durchqueren die Zentren der schwarzen Merkmale von Mitchell (1977) und stimmen gut mit Hays δ¹⁸O überein. Die Merkmale der von S-R-O (2023) verwendeten Simulation (rot) stimmen bei -130 kyr und „Today“ nicht mit Mitchell, 1977 oder Hays (1976) überein.

Hays (1976) enthielt auch eine ebenso umfangreiche SST-Reihe, aber Abbildung 5 von Mitchell (1977) stimmt nicht mit ihr überein. Die folgende Abbildung 5 zeigt S-R-O (2023) Abbildung 1b und die SST-Reihe der Radiolarien von Hays (1976) über denselben Jahresbereich und mit den Abszissen im Register. Die vertikalen grünen Linien zeigen eine gute zeitliche Übereinstimmung zwischen den radiolaren SSTs und der in S-R-O (2023) verwendeten Simulation (rot).

Allerdings stimmen die Formen und Intensitäten der SST von Hays (1976) nicht mit den Merkmalen von Mitchell (1977) überein. Die Simulation von S-R-O (2023) stimmt mit dem Timing der SST-Reihe von Hays (1976) überein, aber zwischen 25-105 kYr bp stimmen die Formen und Intensitäten nicht überein.

Abbildung 5: Die S-R-O (2023) Abbildung 1b stimmt gut mit der zeitlichen Abfolge der SST-Reihe der Radiolarien von Hays (1976) überein. Die vertikalen grünen Linien verlaufen durch die Zentren der SST-Merkmale. Mitchell (1977) stimmt mit Hays (1976) zwischen -105 kYBP und -20kYB überein, aber die Intensitäten und Strukturen sind unterschiedlich. S-R-O (2023) (rot) stimmt mit der SST-Zeitreihe von Hays (1976) überein, aber nicht mit den Formen oder Intensitäten. Ganz rechts unten sind die ersten 150 kYr der von Hays (1976) veröffentlichten Foraminiferen-δ¹⁸O-Reihe dargestellt. Die Ähnlichkeit sowohl von S-R-O (2023) als auch von Mitchell (1977) mit Hays (1976) δ¹⁸O, aber nicht mit Hays (1976) SST, ist bei der Betrachtung offensichtlich.

Sowohl Mitchell (1977) als auch S-R-O (2023) entsprechen offensichtlich viel eher der Form der δ¹⁸O-Reihe von Hays (1976) als der SST-Reihe von Hays.

Es scheint, dass weder Supran, Rahmstorf noch Oreskes eine sorgfältige Quellenprüfung von Mitchell (1977) vorgenommen haben. S-R-O erkannte im Jahr 2023 offensichtlich nicht, dass Mitchell (1977) Hays (1976) 150 kJr. δ¹⁸O-Reihe für den Indischen Ozean umfunktioniert hatte, um sie als globale Lufttemperaturreihe zu verwenden.

Es scheint auch wahrscheinlich, dass S-R-O nicht wusste, dass Abbildung 5 von Mitchell (1977) allem Anschein nach eine handgezeichnete Karikatur der δ¹⁸O-Kurve von Hays (1976) ist.

Huch?

IV: In welchem das Temperaturproblem auftaucht.

Wie hat Mitchell also die Temperaturen seiner Abbildung 5 zugeordnet? Mitchell hatte offensichtlich Hays (1976) gelesen. Hays (1976) wiederum schätzte die eiszeitliche Temperatur auf etwa 6±1,5 C kälter als heute, was -10,8±2,7 °F entspricht.

Es ist sehr wahrscheinlich, dass Mitchell (1977) die Temperaturskala seiner wiederverwendeten δ¹⁸O-Reihe in Abbildung 5 von der glazialen Schätzung in Hays (1976) übernommen hat.

Vor diesem Hintergrund wandelte Mitchell die Celsius-Werte von Hays (1976) in Fahrenheit um, schätzte die gegenwärtige globale Durchschnittstemperatur auf 15,6 °C [60°F] und verwendete die Schätzung von Hays (1976), um das glaziale Minimum zu ermitteln. Die gestrichelte Linie zeigt die heutige Temperatur von 60 °F, und das letzte glaziale Minimum vor 25 000 Jahren ist etwa 9 °F kälter. Der Mitchell-Fahrenheit-Bereich liegt bei 49-65 °F. Die Fahrenheit-Skala ist lediglich eine lineare Interpolation.

Die von Hays (1976) ermittelte Radiolarien-Proxy-Temperatur weist eine sehr große statistische Unsicherheit auf (95% CI = ±3 C). Hays (1976) schätzte die SST des südlichen Indischen Ozeans, wo die Sedimentkerne gebohrt wurden. Es handelte sich nicht um einen globalen Durchschnitt der SST.

Mitchell hat offenbar die δ¹⁸O-Reihe von Hays (1976) zur Angabe der globalen durchschnittlichen Lufttemperatur verwendet. Wir wissen nicht, warum. Vielleicht hielt er sie für angemessen. Ungeachtet dessen wurde seine Zuordnung von S-R-O (2023) unkritisch akzeptiert, als sie die Arbeit für Abbildung 1b durchführten.

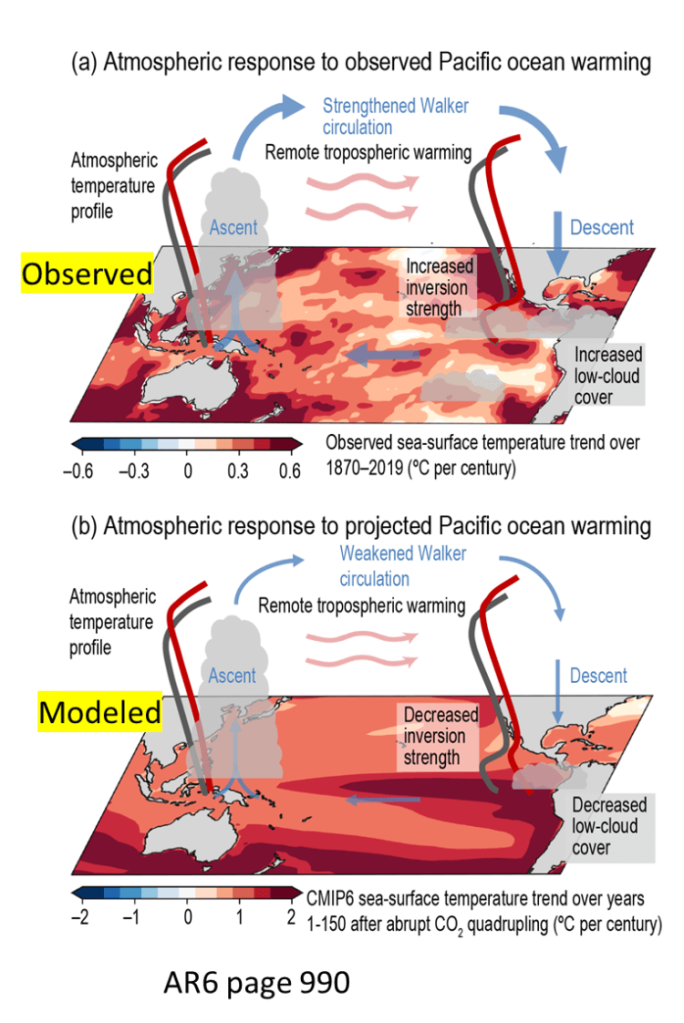

Das aufkommende Rätsel ist, wie Stefan Rahmstorf und seine angewandte Erdsystemmodell-Lufttemperatursimulation eine handgezeichnete Karikatur von 150.000 Jahren δ¹⁸O des Indischen Ozeans exakt reproduzierte, die als spekulative globale Lufttemperatur umgetauft wurde.

Ich wiederhole: Stefan Rahmstorf wendete die Erdsystemmodell-Simulation auf handgezeichnete Cartoon-Wackler eines δ¹⁸O-Doppelgängers des Indischen Ozeans an, als ob es sich um physikalisch reale globale Lufttemperaturen handelte.

V. In dem die benthische Verzweiflung offenbart wird.

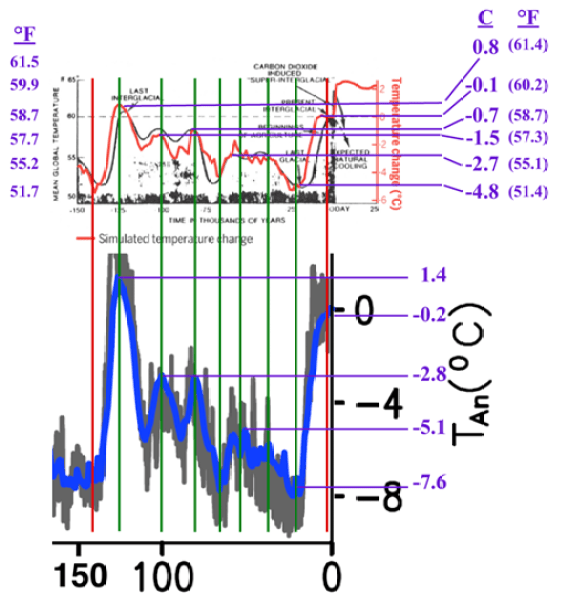

Es kommt noch schlimmer. S-R-O (2023) hat dargestellt, dass ihre Simulation des Erdsystemmodells in Abbildung 1b (rot) in (Ganopolski und Brovkin (2017)) veröffentlicht wurde (siehe die Legende zu Abbildung 2 oben). Dieses Papier enthält jedoch keine Simulationen der Lufttemperatur. Die S-R-O-Simulation (2023) findet sich in Abbildung 1 von Ganopolski und Calov (2011), die dasselbe CLIMBER-2-Erdsystemmodell verwendeten.

Ganopolski und Calov (G-C) (2011) simulierten 800.000 Jahre Lufttemperaturanomalien in der Antarktis und Grönland. S-R-O (2023) verwendeten die Antarktis-Simulation in ihrer Abbildung 1b, die Abbildung 5 von Mitchell (1977) überlagert.

Abbildung 6 unten vergleicht die Antarktis-Simulation von G-C (2011) mit Abbildung 1b von S-R-O (2023). Der Vergleich ist etwas unübersichtlich, offenbart aber eine Tiefe des unwissenschaftlichen Benthos, welche die Profs. Supran, Rahmstorf und Oreskes entweder nicht bemerkt oder einfach übergangen hatten.

Abbildung 6: Oben, Abbildung 1b von Supran, Rahmstorf und Oreskes (2023), mit ausgewählten Merkmalen kommentiert. Unten: Abbildung 1e von Ganopolski und Calov (2011), die ersten 150 kJahre der „Antarktischen Temperaturanomalie“, Simulation mit ausgewählten Anmerkungen und einem zusätzlichen 150 kJahre langen Strich (bp tick). Die oberen und unteren Abszisse sind in der Registrierung. Die roten vertikalen Linien fixieren den Vergleich am Paläo-Minimum und dem modernen Maximum. Die vertikalen grünen Linien durchqueren die Zentren der wichtigsten G-C (2011) Merkmale. Die horizontalen violetten Linien markieren die Merkmale, die mit Temperaturangaben versehen wurden.

Die ausgewählten Temperaturen wurden aus Messungen mit dem Millimeterlineal extrahiert. Ihre Genauigkeit ist nicht besser als ±0,2 °C. Abbildung 6 zeigt eine gute Übereinstimmung zwischen der G-O (2011) Antarktis-Simulation und dem S-R-O (2023) Overlay in Abbildung 1b. Die G-O (2011) Grönland-Temperaturanomalienreihe ist strukturell ähnlich, aber viel kälter (Tabelle 1).

Tabelle 1: Nicht identische Temperaturen der identischen G-C (2011) Ant. und S-R-O 2023-Simulationen:

Ant.= Antarktis, Grnld = Grönland

In den unterstützenden Informationen von S-R-O (2023) wird die Simulation in Abbildung 1b ohne die technische Darstellung wie folgt beschrieben: „Die Beobachtungen in Feld 1b von Abb. 1 spiegeln eine geglättete (LOWESS) Erdsystem-Modellsimulation der letzten 150.000 Jahre wider, die nur durch orbitalen Antrieb angetrieben wird, mit einem angehängten moderaten anthropogenen Emissionsszenario.“

S-R-O (2023) selbst beschreibt Abbildung 1b als „eine geglättete Erdsystem-Modellsimulation der letzten 150.000 Jahre“ und „eine geglättete Erdsystem-Modellsimulation der letzten 150.000 Jahre, die nur durch orbitalen Antrieb angetrieben wird, mit einem angehängten moderaten anthropogenen Emissionsszenario.“

Und die erweiterte Beschreibung von S-R-O (2023): „Tafel 1b von Abb. 1 ist ein Diagramm der globalen Erwärmungs-‚Wirkung von CO₂ auf einer interglazialen Skala’“, das ursprünglich vom Klimawissenschaftler J. Murray Mitchell Jr. im März 1977 veröffentlicht und vom Exxon-Wissenschaftler James Black in einem privaten Briefing an das Exxon Corporation Management Committee 4 Monate später reproduziert wurde. Wenn man die ursprüngliche Grafik mit den von einem modernen Erdsystemmodell simulierten Temperaturen (in rot) vergleicht, zeigt sich, dass die Exxon-Wissenschaftler ihre Vorgesetzten zutreffend vor einer „Kohlendioxid-induzierten ‚Super-Zwischeneiszeit'“, wie Mitchell Jr. es nannte, warnten, die die Erde heißer machen würde als zu jedem anderen Zeitpunkt in mindestens 150.000 Jahren.

Die Formulierung von S-R-O (2023) impliziert direkt, dass die Abbildung 5 von Mitchell (1977) eine Aufzeichnung der globalen Lufttemperatur darstellt.

Hays (1976) beschrieb jedoch die wiederverwendete δ¹⁸O-Reihe (S. 1122) wie folgt: „Abwärtsgerichtete Variationen von δ¹⁸O in den Bohrkernen spiegeln Veränderungen in der ozeanischen Isotopenzusammensetzung wider, die hauptsächlich durch das Wachsen und Schwinden der Eisschilde der nördlichen Hemisphäre verursacht werden. Somit ist das δ¹⁸O in unseren subantarktischen Bohrkernen eine Aufzeichnung des Klimas der nördlichen Hemisphäre.“

Mit anderen Worten, die δ¹⁸O-Reihe spiegelt großräumige Schwankungen des Klimas im Laufe der geologischen Zeit wider. Nicht die globale Lufttemperatur.

Foraminiferen-δ¹⁸O bleibt heute problematisch für die Verwendung als SST-Proxy. Waelbroeck et al. (2005) stellen fest: „Die große Diskrepanz zwischen den δ¹⁸O-Werten lebender und rezenter fossiler Foraminiferen unterstreicht die Schwierigkeit, vergangene Oberflächenbedingungen auf der Grundlage von δ¹⁸O fossiler planktonischer Foraminiferen zu rekonstruieren.“

VI. In welchem der Marianengraben der Verzweiflung ausgelotet wird.

Da die Simulationen der Anomalien in der Antarktis von S-R-O (2023) und G-C (2011) angeblich identisch sind, sollte man auch identische Anomalie-Temperaturen erwarten. Abbildung 6 und Tabelle 1 zeigen jedoch, dass diese, die identisch sein sollten, in Wirklichkeit sehr unterschiedlich sind. Die S-R-O (2023) Temperaturen sind alle kleiner als die G-C (2011) Homologe, außer bei 0 kYr bp. Wie konnte das passieren?

Stefan Rahmstorf ist der Klimamodellierer der Gruppe. Er ist wahrscheinlich in Treibsand gelaufen. Aber ich möchte hier sehr vorsichtig mit meiner Sprache sein.

Die einzige vernünftige Erklärung für die geringeren Temperaturunterschiede innerhalb der S-R-O (2023) Abbildung 1b Überlagerung im Vergleich zur G-C (2011) Simulation ist, dass die G-C Simulation in künstliche Übereinstimmung mit der von Mitchell (1977) handgezeichneten, wenig präzisen, thermisch spekulativen, physikalisch zweideutigen Version der Hays (1976) Foraminiferenreihe des südlichen Indischen Ozeans komprimiert wurde.

Die rote Überlagerung in Abbildung 1b ist keine genaue Wiedergabe der Simulation von G-O (2017)(sic), wie sie dargestellt wurde. Aus G-C (2011} (der offensichtlichen Quelle) wurde das rote Overlay zu einer Korrespondenz komprimiert, die einer spekulativen Karikatur eine falsche physikalische Bedeutung verleiht und Mitchell (1977) einen völlig falschen analytischen Kredit einräumt. Es ist schwer vorstellbar, wie diese Fehlkonstruktion unbeabsichtigt sein konnte.

Abbildung 1b zeigt nicht, dass Exxon davon wusste (was, wie wir bereits mit Sicherheit wissen, nicht der Fall war und auch nicht sein konnte). Exxon ist aufgrund falscher Beweise angeklagt worden.

Die Überlagerung von Abbildung 1b zeigt stattdessen, dass S-R-O die spekulative Bedeutung von Mitchells (1977) Abbildung 5 nicht kannte. Sie waren nachlässig. Sie haben Mitchells (1977) Abbildung 5 nicht bis zu ihrem Ursprung zurückverfolgt. Sie waren offensichtlich nicht neugierig, woher sie stammt. Und sie setzten es trotz allem für ihre Zwecke ein.

Vielleicht sollten die Profs. Supran, Rahmstorf und Oreskes gefragt werden, wie das passiert ist.

Abbildung 1b ist paradigmatisch für den gesamten Korpus der AGW-bezogenen Konsens-Klimatologie.

VII. In dem eine zusammenfassende Feststellung des Exxon-Wissens wiedergegeben wird.

● Die Klimamodelle von Exxon sagten die künftige Temperatur nicht voraus.

● Die Wissenschaftler von Exxon wussten, dass die Klimamodelle von Exxon die künftige Temperatur nicht vorhersagen konnten.

● Die Manager von Exxon wussten, dass die Wissenschaftler von Exxon wussten, dass die Klimamodelle von Exxon die zukünftigen Temperaturen nicht vorhersagen.

● Exxon hat sich in gutem Glauben bemüht, die Zusammenhänge zwischen CO₂ und Klima zu verstehen.

● Die Exxon-Geschäftsführung finanzierte unabhängige Forschungen über CO₂-Klima-Zusammenhänge.

● Exxon wusste es nicht.

● Exxon-Manager und Wissenschaftler wussten, dass Exxon es nicht wusste.

● Geoffrey Supran, Stefan Rahmstorf und Naomi Oreskes betrachten alle Klimamodelle als Wahrheitsmaschinen.

● Ungeachtet der eindeutigen Beweise wissen Geoffrey Supran, Stefan Rahmstorf und Naomi Oreskes nicht, dass Exxon es nicht wusste. Bestenfalls.

● Supran, Rahmstorf, Oreskes (2023) liegt in allen wichtigen Punkten falsch.

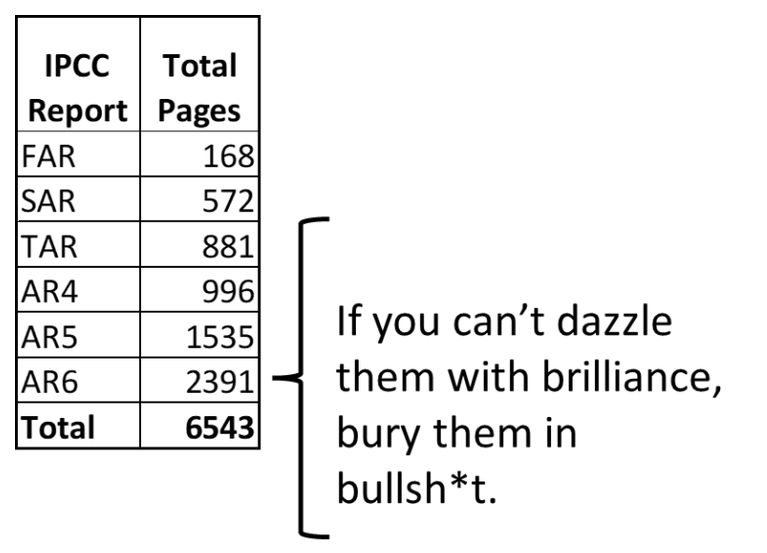

VIII. In denen Urteile gefällt und Schlussfolgerungen gezogen werden.

1.Supran, Rahmstorf, Oreskes (2023) Die Abbildung 1b ist ein minimal aufsteigendes Denkmal für eine unvorsichtige Tendenz.

2.Die S-R-O (2023) Exxon Knew Anklageschrift ist bei der Beweisanhörung kläglich gescheitert.

3.Supran, Rahmstorf, Oreskes (2023) haben die bewusste Prüfung durch die Redakteure und Gutachter des Science Magazine bestanden.

4.S-R-O (2023) gleicht einem journalistischen Schauprozess.

5.Das Science Magazine ist in der Verfolgung der Anklage verwaltungstechnisch mit Andrey Vyshinsky verwandt.

6.So sieht die Kultur aus, die heute in den Zeitschriften des Establishments herrscht.

IX. Ich ziehe meinen Hut vor dem unbeugsamen Russell Cook und wünsche diesem Werk einen gewissen Nutzen.

Link: https://wattsupwiththat.com/2023/05/17/what-i-learned-about-what-exxon-knew/

Übersetzt von Christian Freuer für das EIKE