CERES team

Im letzten Monat haben wir gemeinsam drei Artikel in wissenschaftlichen Fachzeitschriften verfasst, die sich mit dem Zwillingsproblem (1) der Verzerrung durch die Verstädterung und (2) den laufenden Debatten über die Daten zur Gesamt-Sonneneinstrahlung (TSI) befassen:

- Soon et al. (2023). Climate. https://doi.org/10.3390/cli11090179. (frei zugänglich)

- Connolly et al. (2023). Research in Astronomy and Astrophysics. https://doi.org/10.1088/1674-4527/acf18e. (Noch im Druck, Vorabdruck hier)

- Katata, Connolly and O’Neill (2023). Journal of Applied Meteorology and Climatology. https://doi.org/10.1175/JAMC-D-22-0122.1. (frei zugänglich)

Alle drei Studien haben Auswirkungen auf das wissenschaftlich schwierige Problem der Erkennung und Zuordnung (D&A) des Klimawandels. Viele unserer Erkenntnisse wurden vom IPCC in seinen letzten drei Bewertungsberichten (AR), d. h. IPCC AR4 (2007), IPCC AR5 (2013) und IPCC AR6 (2021), übersehen. Dies bedeutet, dass die sehr einflussreichen Behauptungen des IPCC in diesen Berichten, die langfristige globale Erwärmung seit dem 19. Jahrhundert sei „größtenteils vom Menschen verursacht“ und in erster Linie auf Treibhausgas-Emissionen zurückzuführen, wissenschaftlich verfrüht waren und von der wissenschaftlichen Gemeinschaft überdacht werden müssen.

Bisher war die Resonanz auf diese Studien sehr ermutigend. Insbesondere Soon et al. (2023) scheint auf großes Interesse zu stoßen, da der Artikel in den ersten zehn Tagen nach seiner Veröffentlichung mehr als 20 000 Mal auf der Website der Zeitschrift aufgerufen worden ist.

Allerdings scheinen einige Wissenschaftler, die die IPCC-Attributionserklärungen über Jahre hinweg aktiv gefördert haben, über das Interesse an unseren neuen wissenschaftlichen Studien ziemlich verärgert zu sein.

Diese Woche (6. September 2023) veröffentlichte die Website RealClimate.org einen Blogbeitrag von Dr. Gavin Schmidt, dem Direktor des NASA Goddard Institute for Space Studies (NASA GISS), der zu den Autoren gehört. In diesem Beitrag versucht Dr. Schmidt, unsere Analyse in Soon et al. (2023), eine unserer drei neuen Studien, mit „Strohmann“-Argumenten und nachweislich falschen Behauptungen zu diskreditieren.

Wir fassen das in Connolly et al. (2023) zusammen:

„Ein ‚Strohmann‘-Argument ist ein logischer Trugschluss, bei dem jemand eine Position aufstellt und dann bestreitet, die von der kritisierten Gruppe nicht tatsächlich vertreten wurde. Stattdessen werden die Argumente oder Punkte der Gruppe von den Kritikern entweder übertrieben, falsch dargestellt oder komplett erfunden.“

Wir sind der Meinung, dass diese rhetorische Technik zwar gut für Marketing, politische Kampagnen, „Hit-Pieces“ usw. sein mag, aber weder für die Wissenschaft noch für die Entwicklung fundierter Meinungen hilfreich ist. Stattdessen bemühen wir uns in unserer Kommunikation um einen „stahlharten“ Ansatz. Wir stellen in Connolly et al. (2023) klar:

„Im Wesentlichen geht es darum, die beste und konstruktivste Form des Arguments einer Person anzusprechen – auch wenn es nicht die Form ist, die sie ursprünglich präsentiert hat.“

In diesem Sinne werden wir zunächst die offensichtliche Kritik von Dr. Schmidt an Soon et al. (2023) entkräften.

Widerlegung von Dr. Schmidts Kritik an Soon et al. (2023)

In seinem letzten RealClimate-Beitrag behauptet Dr. Schmidt Folgendes:

1. Er behauptet, dass eine der beiden von Soon et al. (2023) betrachteten Zeitreihen der Gesamtsonneneinstrahlung (TSI) fehlerhaft, veraltet und unzuverlässig ist. (Nebenbei bemerkt, war dies auch eine der 27 TSI-Zeitreihen, die wir in Connolly et al. (2023) betrachtet haben, aber er diskutiert diese Studie hier nicht)

2. Er behauptet, dass eine Studie von Dr. Willie Soon aus dem Jahr 2005, die sich mit der Beziehung zwischen der TSI und den Temperaturen in der Arktis befasst, mit der Zeit widerlegt wurde.

3. Er argumentiert, dass die Aufzeichnung der Landtemperatur der nördlichen Hemisphäre, die eine der beiden von Soon et al. (2023) analysierten Temperaturaufzeichnungen war, nicht repräsentativ für die globalen Temperaturtrends in ländlichen Gebieten oder sogar für die Temperaturtrends in ländlichen Gebieten der nördlichen Hemisphäre ist.

Später in diesem Beitrag werden wir auf jede von Dr. Schmidts Behauptungen eingehen und zeigen, dass sie nicht stimmen. Doch zunächst ist es vielleicht nützlich, einige Hintergrundinformationen über RealClimate.org selbst zu vermitteln.

Wie zuverlässig ist RealClimate.org?

RealClimate.org wurde 2004 als Blog gegründet, um die wissenschaftlichen Meinungen der Eigentümer der Website zu verbreiten. Derzeit wird es von fünf Wissenschaftlern betrieben: Dr. Gavin Schmidt, Prof. Michael Mann, Dr. Rasmus Benestad, Prof. Stefan Rahmstorf und Prof. Eric Steig.

Jeder wissenschaftlich geschulte Leser (oder auch nur ein aufmerksamer Leser), der unsere Studie liest, wird feststellen können, dass jede der Behauptungen in Dr. Schmidts jüngstem Blogbeitrag entweder falsch oder irreführend ist oder bereits in unserer Studie eindeutig behandelt wurde. Aus wissenschaftlicher Sicht leistet sein Beitrag daher keinen produktiven oder sinnvollen Beitrag.

Stattdessen scheint es leider das Ziel seines Beitrags zu sein, Wissbegierige davon abzuhalten, unsere Studie zu lesen.

Wenn die Leute nur seinen Blog-Beitrag lesen würden, könnten sie davon abgehalten werden, sich unsere Studie überhaupt anzusehen – und würden daher nicht herausfinden, dass die angebliche „Kritik“ von Dr. Schmidt unbegründet ist.

Diese Art der pseudowissenschaftlichen „Demontage“ von Studien, die nicht mit den wissenschaftlichen Meinungen des RealClimate-Teams übereinstimmen, scheint ein gängiges Muster zu sein. Im November veröffentlichten sie beispielsweise eine ähnliche „Demontage“ unserer Studie aus dem Jahr 2021, die sie verächtlich mit „Serious mistakes found in recent paper by Connolly et al.“ betitelten. Dieser Beitrag fasste ihre versuchte „Widerlegung“ unserer Studie von Connolly et al. (2021) durch Richardson & Benestad (2022) zusammen.

Jeder, der sowohl Connolly et al. (2021) als auch Richardson & Benestad (2022) liest, wird schnell erkennen, dass auch ihre versuchte „Widerlegung“ leicht widerlegt wurde. In der Tat zeigen zwei unserer drei jüngsten Studien ausdrücklich, dass die Behauptungen von Richardson & Benestad (2022) fehlerhaft und falsch sind.

Wiederum scheint es, dass das Ziel von Richardson & Benestad (2022) und dem begleitenden Beitrag von RealClimate im November NICHT darin bestand, die Wissenschaft voranzubringen, sondern vielmehr darin, die Leute davon abzuhalten, Connolly et al. (2021) tatsächlich zu lesen!

Connolly et al. (2023) ist unsere offizielle Antwort auf den Versuch von Richardson & Benestad (2022), unsere frühere Studie Connolly et al. (2021) zu widerlegen.

Für alle, die sich fragen, was unsere Antwort auf Richardson & Benestads RealClimate-Beitrag vom November 2022 ist, empfehlen wir, die vollständigen Studien selbst zu lesen.

Alle drei Artikel wurden in der von Fachleuten begutachteten Zeitschrift Research in Astronomy and Astrophysics (kurz RAA) veröffentlicht.

- Connolly et al. (2021): hier

- Richardson & Benestad (2022): hier

- Our reply, Connolly et al. (2023): Abstract; Vorabdruck hier (Die endgültige Fassung wird noch gedruckt.)

Zu Behauptung 1: Welche ist die zuverlässigste verfügbare TSI-Zeitreihe?

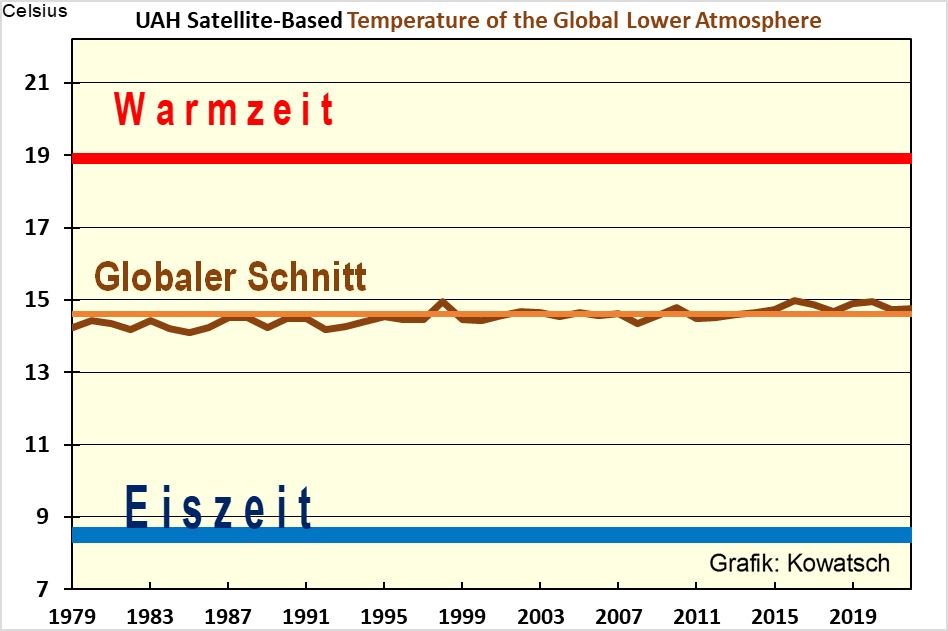

Eine zentrale Herausforderung und Gegenstand erheblicher wissenschaftlicher Debatten und Kontroversen ist die Frage, wie sich die Gesamt-Sonneneinstrahlung (TSI) seit dem 19. Jahrhundert und früher verändert hat.

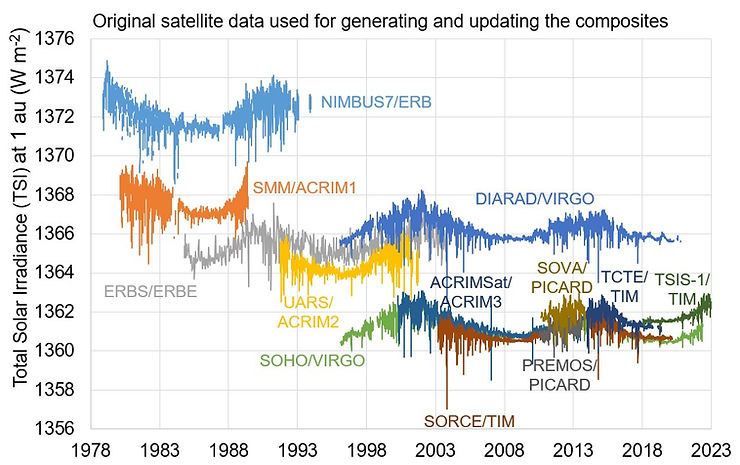

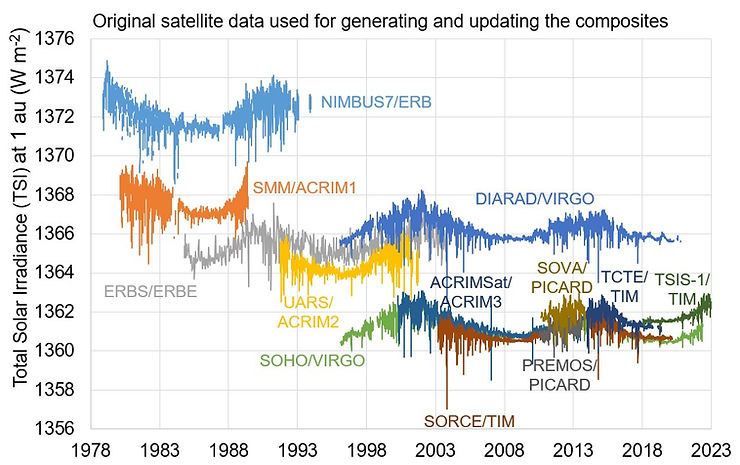

Erst Ende 1978, in der Satellitenära, wurde es möglich, die TSI direkt von oberhalb der Erdatmosphäre mit TSI-Messinstrumenten an Bord von Satelliten zu messen.

Selbst in der Satellitenära ist immer noch unklar, wie genau sich die TSI verändert hat, denn:

1. Jede Satellitenmission bleibt in der Regel nur 10-15 Jahre lang aktiv.

2. Jedes Satelliteninstrument liefert einen anderen durchschnittlichen TSI-Wert.

3. Jeder Satellit zeigt subtil unterschiedliche, aber signifikante Unterschiede in den Trends zwischen den einzelnen Sonnenfleckenzyklen.

Diese Probleme sind im Folgenden dargestellt:

Aus den obigen Ausführungen geht hervor, dass, obwohl die Daten der einzelnen Satellitenmissionen unterschiedlich sind, alle Instrumente die Zu- und Abnahmen der Sonnenaktivität über den etwa 11-jährigen „Sonnenzyklus“ aufzeichnen, der in vielen Indikatoren für die Sonnenaktivität zu beobachten ist.

Da die einzelnen Instrumente jedoch in der Regel nur 10 bis 15 Jahre abdecken und unterschiedliche Grundtendenzen aufweisen, ist unklar, welche anderen Trends bei der TSI im Laufe der Satellitenära aufgetreten sind.

Mehrere Forschungsteams haben ihre eigenen Satellitenkomposits entwickelt, indem sie die oben genannten Satellitendaten auf unterschiedliche Weise und unter Verwendung verschiedener Annahmen und Verfahren kombiniert haben. Eine Zusammenfassung finden Sie in diesem CERES-Science-Beitrag.

Einige der wichtigsten neueren Komposita sind:

1. „ACRIM“ – Die ACRIM-Gruppe stellt fest, dass es neben dem 11-jährigen Sonnenzyklus auch wichtige Trends zwischen den einzelnen Zyklen gibt. Sie stellen fest, dass es zwischen jedem solaren Minimum und Maximum in den 1980er und 1990er Jahren einen signifikanten Anstieg der TSI gab, gefolgt von einem leichten Rückgang in den frühen 2000er Jahren. Siehe z. B. Scafetta et al. (2019).

2. „PMOD“ – Die PMOD-Gruppe nimmt mehrere Anpassungen an den Daten einiger früher Satellitenmissionen vor und verwendet unterschiedliche methodische Entscheidungen und Annahmen. Sie stellen fest, dass es zwischen den einzelnen Zyklen einen leichten Rückgang der TSI gegeben hat, der jedoch recht bescheiden war. Siehe z. B. Montillet et al. (2022).

3. „RMIB/ROB“ – Die ROB-Gruppe (früher RMIB genannt) argumentiert, dass sich die TSI im Laufe der Satellitenära mit Ausnahme des 11-jährigen Sonnenzyklus fast nicht verändert hat. Siehe z. B. Dewitte & Nevens (2016).

4. „The Community Composites“ – Dudok de Wit et al. (2017) bieten zwei verschiedene TSI-Composites an. Das eine, das die ursprünglichen Satellitendaten verwendet, impliziert eine Rekonstruktion zwischen den RMIB- und ACRIM-Kompositen. Das andere, das die PMOD-bereinigten Satellitendaten verwendet, impliziert eine Rekonstruktion ähnlich dem PMOD-Komposit.

Für die Vor-Satelliten-Ära gibt es keine direkten Messungen. Stattdessen müssen sich die Forscher auf „solare Näherungswerte“ verlassen, von denen sie hoffen, dass sie wichtige Aspekte der sich verändernden Sonnenaktivität genau wiedergeben.

Einige dieser Näherungswerte sind: Sonnenfleckenzahlen, Sonnenfleckengruppen, Sonnenzykluslängen, das Verhältnis von Penumbra- und Umbra-Merkmalen der Sonnenflecken, helle Flecken in der Photosphäre der Sonne (so genannte Sonnenfaculae), Messungen kosmogener Isotope usw.

In der Regel werden die Sonnenproxies anhand der Satellitenmessungen während der Satellitenära kalibriert. Die kalibrierten solaren Näherungswerte werden dann verwendet, um die Veränderungen der TSI in der Vor-Satelliten-Ära zu schätzen.

Sie denken jetzt wahrscheinlich, dass dies ein komplexes und schwieriges Problem ist. Sie haben Recht! Obwohl einige Wissenschaftler so tun, als seien diese Probleme bereits vollständig gelöst, wissen diejenigen von uns, die seit vielen Jahren aktiv an diesen Problemen forschen, dass es sich um ein heikles und strittiges Thema handelt.

Je nachdem, (a) welches Satellitenkompositum verwendet wird, (b) welche solaren Proxies verwendet werden und (c) welche Verfahren verwendet werden, können verschiedene Forschungsteams sehr unterschiedliche langfristige TSI-Rekonstruktionen entwickeln.

Zum Beispiel:

1. Matthes et al. (2017) sind diejenigen, die IPCC AR6 verwendet haben – basierend auf dem Durchschnitt zweier anderer TSI-Rekonstruktionen – „SATIRE“ von Krivova et al. (2007) und „NRLTSI2“ von Coddington et al. (2016). Alle drei stimmen gut mit dem PMOD-Komposit überein.

2. Bei Dewitte et al. (2022) handelt es sich um eine einfache Rekonstruktion, die auf einer einfachen Neuskalierung der Sonnenfleckenzahlen basiert, um mit dem RMIB-Kompositum übereinzustimmen.

3. Egorova et al. (2018) entwickelten 4 verschiedene Schätzungen. Jede zeigt eine weitaus größere Variabilität über die letzten Jahrhunderte als die IPCC-Schätzungen.

4. In einer NASA-Studie von 2019 aktualisierten Scafetta et al. (2019) die ursprüngliche TSI-Rekonstruktion von Hoyt und Schatten (1993) unter Verwendung des ACRIM-Komposits. Diese Rekonstruktion ist in gewisser Weise einzigartig, da Hoyt und Schatten im Gegensatz zu den meisten anderen, nur ein oder zwei solare Näherungswerte verwendenden Rekonstruktionen fünf solare Näherungswerte verwendeten, um mehrere Aspekte der solaren Variabilität zu erfassen.

5. Penza et al. (2022) gehen davon aus, dass sich die TSI im vergangenen Jahrhundert erheblich verändert hat, allerdings nicht so stark wie bei Egorova et al. (2018) oder der aktualisierten Rekonstruktion von Hoyt und Schatten (1993) gezeigt.

In Connolly et al. (2023) analysierten wir insgesamt 27 TSI-Rekonstruktionen, darunter alle oben genannten. In Soon et al. (2023) haben wir uns jedoch der Einfachheit halber auf nur zwei der oben genannten Rekonstruktionen konzentriert – Matthes et al. (2017) und die ACRIM-aktualisierte Rekonstruktion von Hoyt & Schatten.

Dr. Schmidt mag offensichtlich weder das ACRIM-Kompositum noch das ursprüngliche TSI-Kompositum von Hoyt & Schatten. Wir können verstehen, warum! Es impliziert eine viel größere Rolle für die Sonne bei den Klimaveränderungen seit dem 19. Jahrhundert als das RealClimate-Team behauptet.

Es ist jedoch erwähnenswert, dass Hoyt und Schatten (1993) als eine der sechs TSI-Reihen verwendet wurde, die vom CMIP3-Modellierungsprojekt berücksichtigt wurden, das der IPCC für seine Analyse der Erkennung und Zuordnung in seinem vierten Sachstandsbericht (2007) verwendete. Dies kann bestätigt werden, wenn man die Liste der „SOL“-Zeitreihen (d. h. TSI) auf den Seiten 11-12 des Ergänzungsmaterials zu Kapitel 9 der Arbeitsgruppe 1 des IPCC AR4 überprüft.

Die CMIP5- und CMIP6-Modellierungsprojekte, die zu den AR5- und AR6-Berichten 2013 und 2021 beigetragen hatten, berücksichtigten Hoyt und Schatten (1993) nicht als potenzielle TSI-Reihe. Dies scheint jedoch teilweise auf den Einfluss von Dr. Schmidt zurückzuführen zu sein. Er war der Hauptautor von Schmidt et al. (2011), d.h. der Studie, in der die für die PMIP3- und CMIP5-Projekte zu verwendenden Klimamodellierungs-Antriebe empfohlen werden.

Wie bereits erwähnt, haben wir in Connolly et al. (2023) insgesamt 27 verschiedene TSI-Rekonstruktionen berücksichtigt und sind dennoch zu ähnlichen Schlussfolgerungen gekommen wie Soon et al. (2023). Die spezifische Wahl von Hoyt und Schatten ist also nur eine Möglichkeit zu zeigen, dass der IPCC mit seiner AR6-Zuschreibung voreilig war.

Zu Behauptung 2: Hatte Soon (2005) unrecht?

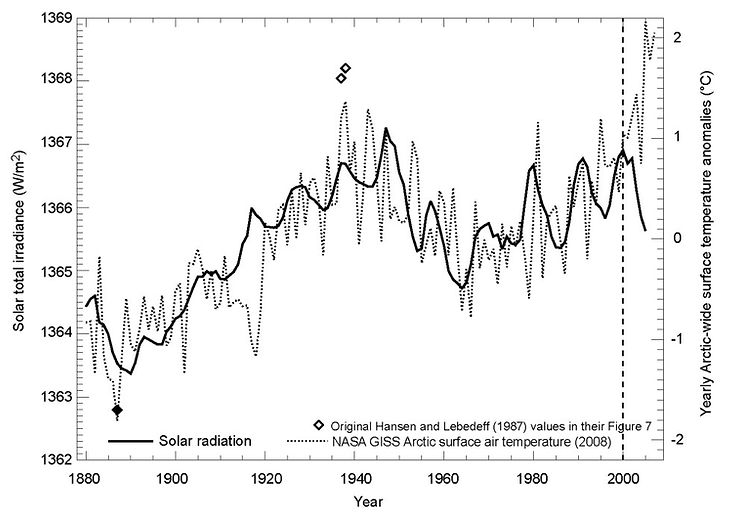

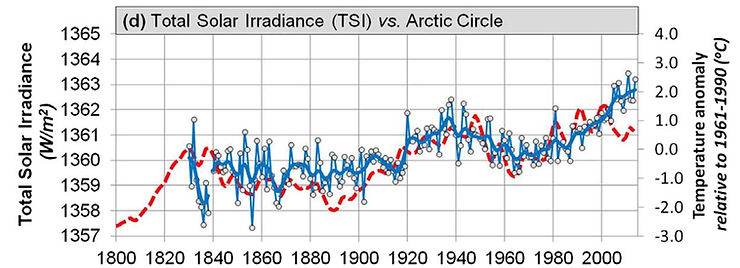

In Soon (2005) fiel Dr. Soon eine bemerkenswerte Korrelation zwischen der TSI-Reihe von Hoyt und Schatten (1993) und den arktischen Temperaturen von 1875 bis 2000 auf.

In einer nachfolgenden Studie wiederholte Soon (2009) seine Analyse unter Verwendung (a) einer neueren Version der TSI-Reihe von Hoyt und Schatten, die bis 2007 aktualisiert wurde, und (b) der arktischen Temperaturaufzeichnungen des NASA GISS von 1880-2007.

Der Vergleich wird im Folgenden in Anlehnung an Abbildung A.1 von Soon (2009) dargestellt:

In seinem Blogbeitrag von dieser Woche räumt Dr. Schmidt ein, dass die Übereinstimmung 2005 gut aussah, aber er behauptet, dass sie nicht mehr gilt:

„Aber die Zeit schreitet voran, und was 2005 noch gut aussah (mit Daten, die nur bis 2000 reichten), sah 2015 nicht mehr so gut aus.“

Dr. Schmidt zeigte dann eine Darstellung, die er 2015 mit einem anderen TSI-Datensatz als dem von Soon verwendeten erstellt hatte. Seine Reanalyse ergab keine zwingende Korrelation, wenn sie auf die aktualisierten NASA-GISS-Temperaturdaten für die Arktis angewendet wurde.

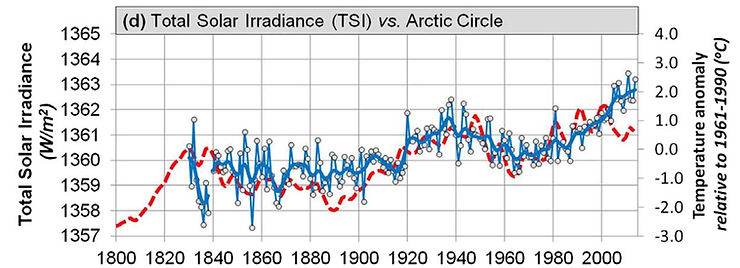

Andererseits haben wir ebenfalls im Jahr 2015 als Teil unserer Analyse der Temperaturtrends auf der nördlichen Hemisphäre in Soon et al. (2015) unsere eigene Aktualisierung der ursprünglichen Analyse von Soon (2005; 2009) einbezogen.

Unten ist Abbildung 27(d) von Soon et al. (2015) zu sehen. Die blaue Linie stellt die arktischen Temperaturen dar, während die gestrichelte rote Linie die TSI darstellt:

Der Versuch von Dr. Schmidt, die Analyse von Soon (2005) durch Verwendung einer anderen TSI-Aufzeichnung auf das Jahr 2015 zu aktualisieren, schlug fehl.

Im Gegensatz dazu bestätigte die Aktualisierung von Soon et al. (2015), welche die aktualisierte Version der TSI von Soon (2005) und Soon (2009) verwendeten, die ursprünglichen Ergebnisse der früheren Studien.

Zu Behauptung 3: Ist unsere auf den ländlichen Raum beschränkte Temperaturaufzeichnung der nördlichen Hemisphäre repräsentativ für einen echten Klimawandel?

Dr. Schmidt scheint verwirrt zu sein über die nur auf der nördlichen Hemisphäre vorhandene Temperaturaufzeichnung, die wir als eine von zwei vergleichenden Temperaturaufzeichnungen in Soon et al. (2023) und auch als einen von fünf vergleichenden Temperaturaufzeichnungen in Connolly et al. (2023) verwendet haben.

Wir sind überrascht, dass er nicht verstanden zu haben scheint, wie diese Temperaturaufzeichnungen konstruiert worden sind, da die Konstruktion aller fünf Temperaturaufzeichnungen in Connolly et al. (2021) ausführlich beschrieben wurde, zusammen mit einer detaillierten Diskussion der Gründe für jede Temperaturaufzeichnung. Einzelheiten wurden auch in der von ihm kritisierten Studie von Soon et al. (2023) dargelegt.

Vielleicht hat er sich aber auch noch nicht die Zeit genommen, Connolly et al. (2021) zu lesen. Als Connolly et al. (2021) veröffentlicht wurde, wurde Dr. Schmidt von einem Journalisten der Epoch Times gebeten, die Studie zu kommentieren. Laut The Epoch Times:

„Als er auf die neue Studie angesprochen wurde, äußerte sich Gavin Schmidt, stellvertretender leitender Berater für Klimafragen bei der NASA und Direktor des Goddard Institute for Space Studies, ebenfalls unverblümt.

‚Das ist völliger Unsinn, mit dem niemand vernünftig seine Zeit verschwenden sollte‘, sagte er der Epoch Times.

Er reagierte nicht auf eine Anfrage, ob die neue Studie der RAA konkrete Fehler enthält.“ – The Epoch Times, 16. August 2021

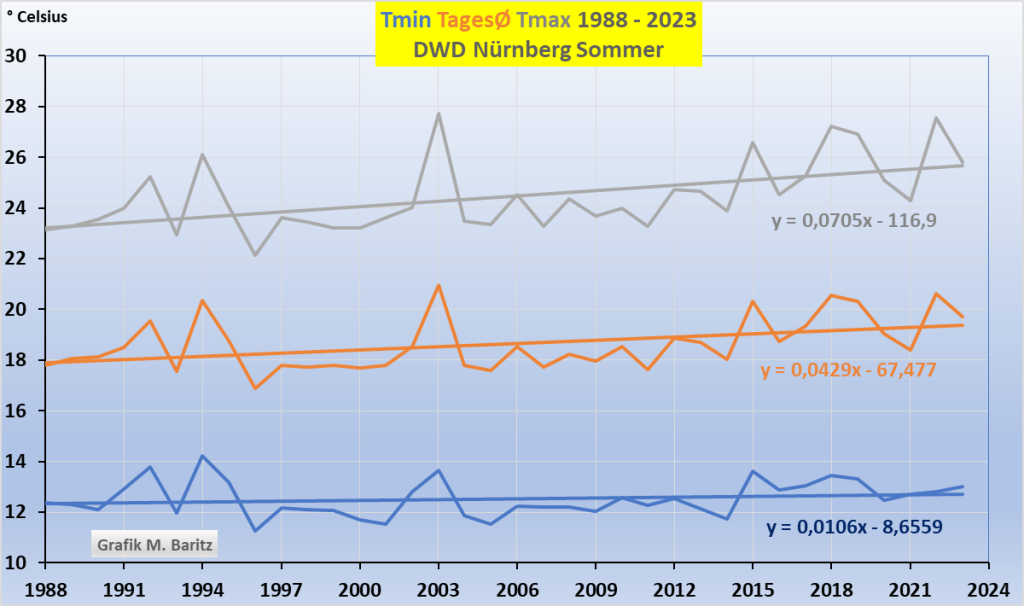

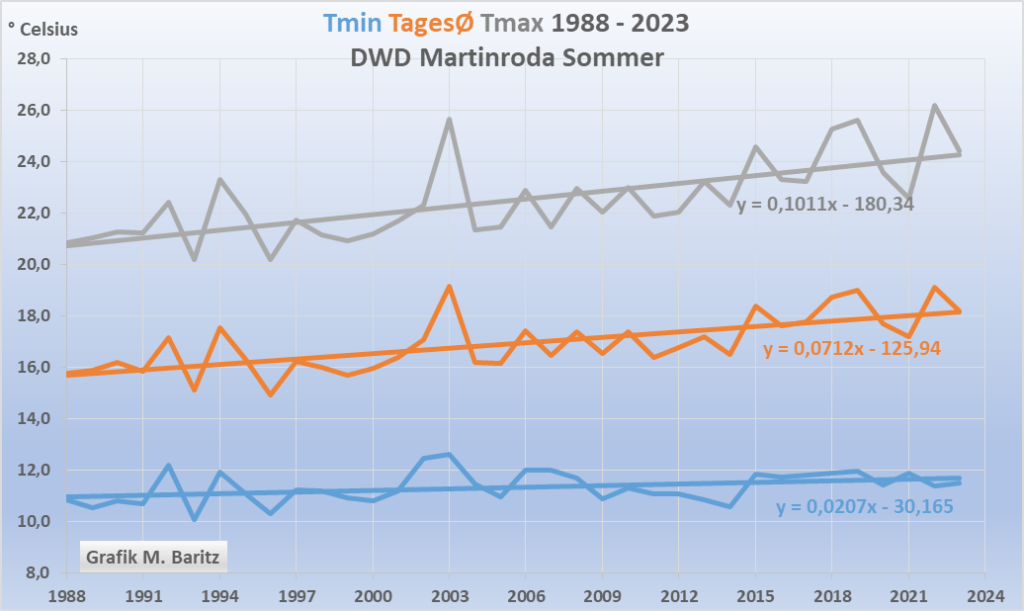

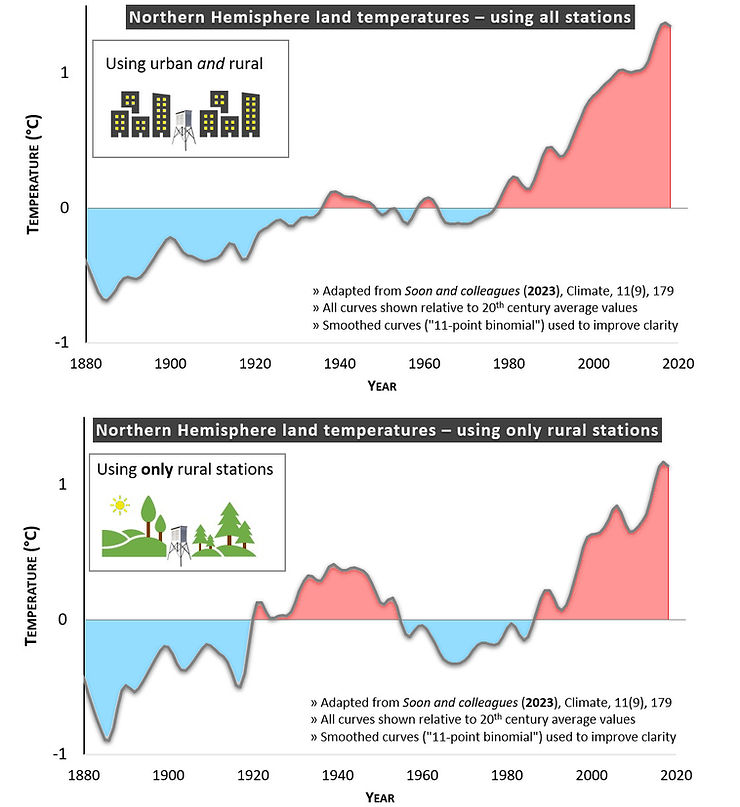

Eines der Hauptprobleme, auf das wir in Soon et al. (2023) hingewiesen haben, war das sogenannte „Urbanisierungsproblem“. Es ist bekannt, dass es in städtischen Gebieten wärmer ist als auf dem Land. Dies ist als „Urban Heat Island (UHI)“-Effekt bekannt.

Da städtische Gebiete nur 3-4 % der globalen Landfläche ausmachen, sollte dies die globalen Temperaturen nicht wesentlich beeinflussen.

Die meisten Wetterstationen, die für die Berechnung der Landkomponente der globalen Temperaturen verwendet werden, befinden sich jedoch in städtischen oder halbwegs städtischen Gebieten. Dies gilt insbesondere für die Stationen mit den längsten Temperaturaufzeichnungen. Ein Grund dafür ist die Schwierigkeit, eine Wetterstation in einem isolierten, ländlichen Gebiet über ein Jahrhundert oder länger zu besetzen und zu unterhalten.

Infolgedessen haben viele der längsten, zur Berechnung der globalen Temperaturveränderungen herangezogenen Stationsaufzeichnungen wahrscheinlich auch eine lokale Erwärmung in den Städten im Laufe ihrer Aufzeichnungen erfahren. Diese städtische Erwärmung ist nicht repräsentativ für die Klimaveränderungen in der nicht-städtischen Welt.

Die städtische Erwärmung, die fälschlicherweise in die „globalen Temperaturdaten“ einfließt, wird als „Urbanisierungsverzerrung“ bezeichnet.

Es ist immer noch unklar, inwieweit die aktuellen Schätzungen der globalen Erwärmung durch eine Verzerrung aufgrund der Verstädterung verunreinigt sind. In seinem jüngsten Bericht gab der IPCC optimistisch an, dass der Einfluss der Verstädterung wahrscheinlich weniger als 10 % der Erwärmung des Landes ausmacht. Sie haben jedoch keine stichhaltige Erklärung dafür geliefert, warum dies ihrer Meinung nach so ist.

Wie in Connolly et al. (2021), Soon et al. (2023) und Connolly et al. (2023) beschrieben, deuten mehrere wissenschaftliche Studien darauf hin, dass städtische Verzerrungen für mehr als 10 % der Erwärmung des Landes verantwortlich sind – und möglicherweise für viel mehr.

Kurzer Exkurs: Hintergrundinformationen dazu, wie und warum wir unsere auf die nördliche Hemisphäre beschränkte Temperaturaufzeichnung entwickelt haben

In Connolly et al. (2021) versuchten wir, das Problem der Verstädterung zu lösen, indem wir einen reinen Temperaturdatensatz für den ländlichen Raum entwickelten, der nur Temperaturdaten von ländlichen Stationen oder von Stationen verwendete, die ausdrücklich um Verstädterungsfehler korrigiert worden waren. Wir sahen uns jedoch mit zwei großen Problemen konfrontiert, die wir schon seit fast einem Jahrzehnt zu lösen versuchten:

1. Es gab einen erheblichen Mangel an ländlichen Stationen mit Temperaturaufzeichnungen von einem Jahrhundert oder länger.

2. Viele Wetterstationen mit langen Temperaturaufzeichnungen sind durch andere, nicht klimatisch bedingte Verzerrungen verunreinigt, z. B. durch Stationsumzüge, Änderungen der Instrumentierung usw.

Als wir uns ansahen, wie andere internationale Gruppen (einschließlich der Gruppe von Dr. Schmidt am NASA GISS) die nichtklimatischen Verzerrungen in den Daten berücksichtigten, entdeckten wir, dass sie sich nicht bemühten, die Stationsbesitzer zu kontaktieren, um „Metadaten zur Stationsgeschichte“ zu erhalten, d. h. Informationen über alle Änderungen, die mit der Station im Laufe ihrer Aufzeichnungen verbunden sind.

Stattdessen verließen sich die meisten Gruppen (einschließlich NASA GISS) auf automatisierte Computerprogramme, die versuchten zu erraten, wann Stationsänderungen eine Verzerrung verursacht haben könnten. Diese Programme verwendeten statistische Algorithmen, die jede Station mit den Aufzeichnungen benachbarter Stationen verglichen und „Homogenisierungs-Anpassungen“ an den Daten vornahmen.

In einer Reihe von drei „Arbeitsstudien“, die zwei von uns (Dr. Ronan Connolly und Dr. Michael Connolly) im Jahr 2014 veröffentlicht haben, haben wir beschrieben, wie das funktioniert:

1. Es gab schwerwiegende Fehler in den von der NOAA verwendeten Homogenisierungs-Algorithmen, also von der Gruppe, deren homogenisierte Daten das NASA GISS für seine globalen Temperaturschätzungen verwendete. (https://oprj.net/articles/climate-science/34)

2. Es gab auch ernsthafte Probleme mit dem zusätzlichen Computerprogramm zur Anpassung der „Urbanisierungsverzerrung“, das NASA GISS auf die homogenisierten Daten der NOAA anwandte (siehe https://oprj.net/articles/climate-science/31)

3. Alle bis mindestens 2013 veröffentlichten Studien, die vorgaben, eine Verzerrung durch Verstädterung als wesentliches Problem ausgeschlossen zu haben, wiesen methodische Mängel auf, so dass ihre Schlussfolgerungen ungültig waren (siehe http://oprj.net/articles/climate-science/28).

Im April 2015 boten wir während unseres Besuchs in New York City (zusammen mit Dr. Imelda Connolly) an, diese Probleme mit Dr. Schmidt in den Büros von NASA GISS zu besprechen und zu sehen, ob mögliche Lösungen gefunden werden könnten. Dr. Schmidt lehnte die Einladung mit der Begründung ab, er sei nicht sehr vertraut damit, wie der globale Temperaturdatensatz von NASA GISS aufgebaut sei. Aber er arrangierte freundlicherweise, dass wir die Studien mit Dr. Reto Ruedy besprechen konnten, der damals der leitende Wissenschaftler für den NASA-GISS-Temperaturdatensatz (genannt „GISTEMP“) war. Wir vier (Dr. Reto Ruedy, Dr. Imelda Connolly, Dr. Michael Connolly und Dr. Ronan Connolly) trafen uns im kultigen „Tom’s Restaurant“ direkt neben dem Bürogebäude des NASA GISS.

Bild: Dr. Ronan Connolly vor dem kultigen Tom’s Restaurant in New York City nach unserem dreistündigen freundschaftlichen und ausführlichen Fachgespräch mit Dr. Ruedy, das von Dr. Schmidt organisiert wurde. (April 2015).

Dr. Ruedy gab zu, dass keiner aus seinem Forschungsteam die verschiedenen, in unseren Studien aufgeworfen Probleme berücksichtigt hatte. Wir fragten ihn, ob er irgendwelche Probleme mit unserer Analyse erkennen könne. Er sagte, dass er das nicht sofort könne, aber er versprach, uns eine E-Mail zu schicken, wenn er Fehler in unserer Analyse erkennen könne. Da er uns nie eine E-Mail geschickt hat, gehen wir davon aus, dass er keine Fehler finden konnte.

Während unseres Treffens mit Dr. Ruedy warnten wir ihn vor einem Problem mit dem Homogenisierungs-Algorithmus der NOAA, das wir als „Urban Blending“-Problem bezeichnen, das andere jedoch als „statistisches Aliasing-Problem“ bezeichnet haben. Vor kurzem haben wir das Ausmaß dieses Problems in Katata et al. (2023) bestätigt.

Wir haben ihn gewarnt, dass aufgrund dieses Problems die Verzerrungen der städtischen Erwärmung in den Daten noch stärker in seine globalen Temperaturschätzungen einfließen würden, wenn er die homogenisierte Version der Daten der NOAA verwenden würde.

Er räumte ein, dass dies ein Problem sei, erklärte aber, dass das für den GISTEMP-Datensatz zuständige NASA-GISS-Team nur eine begrenzte Anzahl von Stunden pro Woche für die Arbeit an den Daten zur Verfügung habe. Daher müsse man darauf vertrauen, dass die Homogenisierungsbemühungen der NOAA besser seien als nichts.

Wir verließen unser Treffen mit Dr. Ruedy ziemlich enttäuscht, als wir feststellten, dass selbst das gut ausgestattete Forschungsteam des NASA GISS nicht wusste, wie man diese wichtigen wissenschaftlichen Probleme lösen konnte, und im Grunde nur hoffte, dass sich jemand anderes um die Daten kümmerte.

Wir beschlossen, dass wir es selbst versuchen würden, wenn sich niemand sonst um die Lösung dieser Probleme kümmern würde.

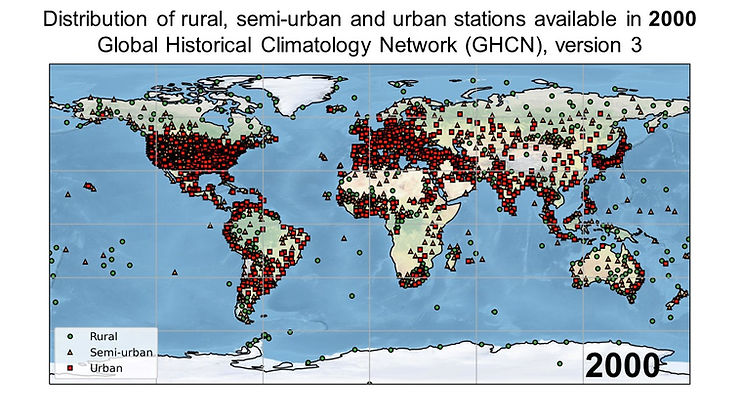

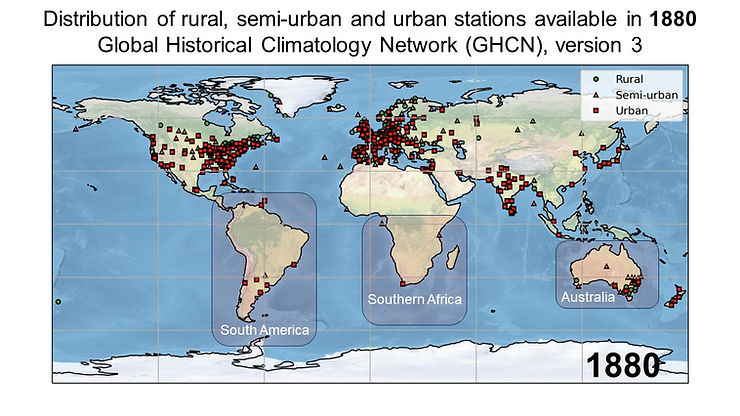

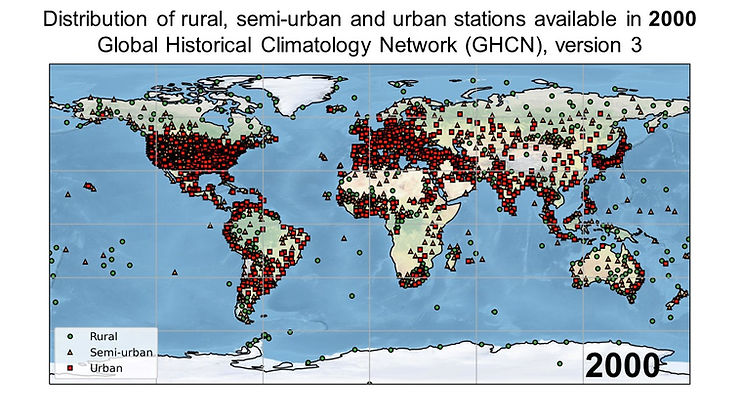

Damals stellte die NOAA zwei Arten von Stadtbewertungen zur Verfügung, die mit jedem ihrer GHCN-Datensätze (Global Historical Climatology Network) verbunden waren – eine auf der Grundlage der lokalen Bevölkerung und die andere auf der Grundlage der Intensität der Nachtbeleuchtung in dem Gebiet. Dies war Version 3 des GHCN, und die NOAA hat es bis Ende 2019 aktualisiert. Die aktuelle Version des GHCN (Version 4) enthält keine Parameter für die Urbanisierung. Daher konzentriert sich unsere Hauptanalyse derzeit auf die Version 3. Wir arbeiten jedoch daran, unsere Analyse in Zukunft mit der Version 4 zu erweitern – siehe Soon et al. (2018); O’Neill et al. (2022) und Katata et al. (2023) für weitere Einzelheiten zu dieser späteren Arbeit.

Wir haben uns entschieden, alle 7200 GHCN-Stationen in drei Kategorien einzuteilen – „ländliche“ Stationen sind diejenigen, die in Bezug auf beide GHCN-Parameter ländlich sind; „städtische“ Stationen sind diejenigen, die in Bezug auf beide Parameter städtisch sind. Alle anderen Stationen stufen wir als „semi-urban“ ein.

Dabei stießen wir sofort auf mehrere Probleme:

1. Weniger als 25% der GHCN-Stationen sind „ländlich“.

2. Die meisten der ländlichen Stationen haben sehr kurze Stationsaufzeichnungen, die oft nur 40-50 Jahre oder so umfassen.

3. Die wenigen ländlichen Stationen mit langen Aufzeichnungen, die bis ins späte 19. oder frühe 20. Jahrhundert zurückreichen, befinden sich fast ausschließlich in der nördlichen Hemisphäre und beschränken sich auf einige wenige Regionen: Nordamerika, Europa, Ostasien und einige arktische Gebiete.

4. Viele der ländlichen Stationen mit nominell langen Stationsaufzeichnungen wiesen oft große Datenlücken und plötzliche Verschiebungen der Durchschnittstemperatur auf, die möglicherweise auf nichtklimatische Stationsänderungen zurückzuführen sind.

Die meisten aus den Daten der Wetterstationen globale Temperaturaufzeichnungen erstellenden Gruppen verlassen sich auf die oben erwähnten Computerprogramme zur Temperaturhomogenisierung, um die ursprünglichen Temperaturaufzeichnungen automatisch anzupassen und „nichtklimatische Verzerrungen“ aus den Daten zu entfernen.

Wenn diese Homogenisierungs-Computerprogramme so zuverlässig wären, wie viele Wissenschaftler angenommen haben, dann sollten diese „automatisch homogenisierten“ Temperaturaufzeichnungen nicht mehr durch nichtklimatische Verzerrungen verunreinigt sein.

Wie wir jedoch herausgefunden haben (und mit Dr. Ruedy bei unserem Treffen 2015 diskutierten), weisen diese Homogenisierungsalgorithmen ernsthafte statistische Probleme auf, die neue nichtklimatische Verzerrungen in die homogenisierten Daten einbringen.

In den darauf folgenden Jahren haben wir die Schwere dieser Verzerrungen und statistischen Probleme in mehreren von Fachleuten begutachteten wissenschaftlichen Artikeln nachgewiesen: Soon et al. (2018); O’Neill et al. (2022) und kürzlich Katata et al. (2023).

Daher wurde uns klar, dass die anderen die Daten der Wetterstationen analysierenden Gruppen unbeabsichtigt einen großen wissenschaftlichen Fehler begingen, indem sie sich unkritisch auf diese automatisch „homogenisierten“ Daten verließen.

Um nichtklimatische Verzerrungen in den Daten zu korrigieren, müssen wir stattdessen realistischere, auf Experimenten basierende Korrekturen vornehmen.

Wir beschlossen, unsere Analyse damit zu beginnen, die Gebiete mit den längsten Aufzeichnungen über den ländlichen Raum und den meisten Informationen über die mit den Daten verbundenen nichtklimatischen Verzerrungen zu ermitteln. Wir fanden heraus, dass nur vier Regionen mehr als 80 % aller ländlichen Stationen mit Daten für das späte 19. und frühe 20. Jahrhundert repräsentativ sind. Alle vier Regionen liegen in der nördlichen Hemisphäre.

Unserer Meinung nach gab es auf der Südhalbkugel einfach nicht genügend Daten über ländliche Gebiete, um eine globale, rein ländliche Temperaturreihe zu erstellen, die bis ins späte 19. Jahrhundert zurück reicht.

Daher beschränkten wir unsere Analyse auf die datenreichere nördliche Hemisphäre.

Eine Region, auf die wir unsere Analyse in Zukunft ausweiten könnten, ist Europa (wie in den Studien beschrieben). Derzeit beschränkt sich unsere Analyse der Temperatur in ländlichen Gebieten in Europa auf Irland, da wir die wichtigsten Metadaten für die irischen Stationen von der nationalen meteorologischen Organisation (Met Éireann) erhalten konnten. In einer kürzlich erschienenen Studie (O’Neill et al., 2022) haben wir jedoch in Zusammenarbeit mit Wissenschaftlern aus ganz Europa die Metadaten von mehr als 800 Wetterstationen in 24 europäischen Ländern zusammengetragen – eine Zusammenfassung finden Sie hier. Die meisten dieser europäischen Stationen sind urbanisiert, aber unsere vorläufige Analyse deutet darauf hin, dass wir in der Lage sein sollten, diese Metadaten in der Zukunft zu nutzen, um eine datenreichere Temperaturaufzeichnung für das „ländliche Europa“ zu entwickeln.

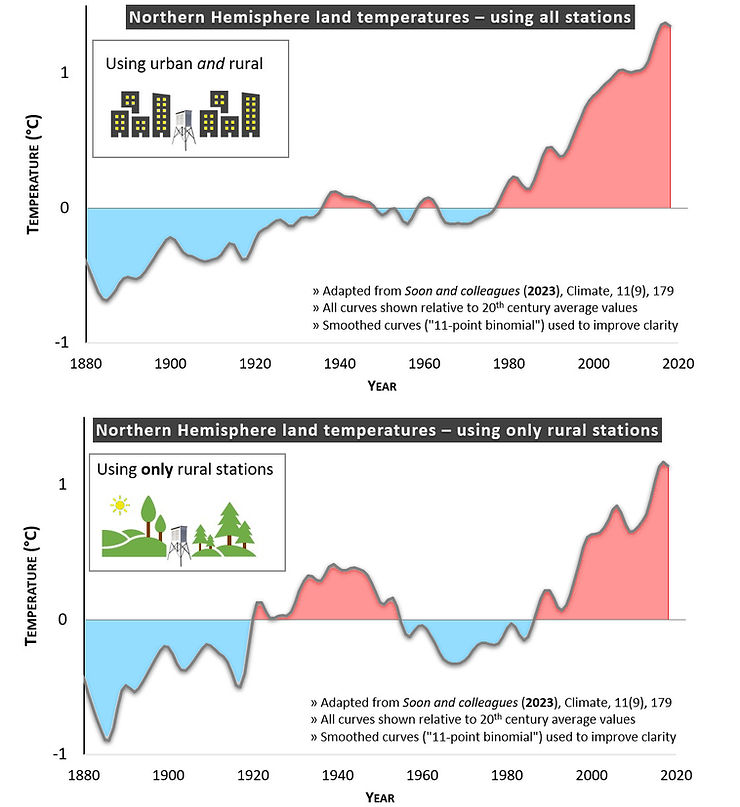

Wie schneidet unsere Reihe, die sich ausschließlich auf den ländlichen Raum bezieht, im Vergleich zur Standardreihe „Stadt und Land“ ab?

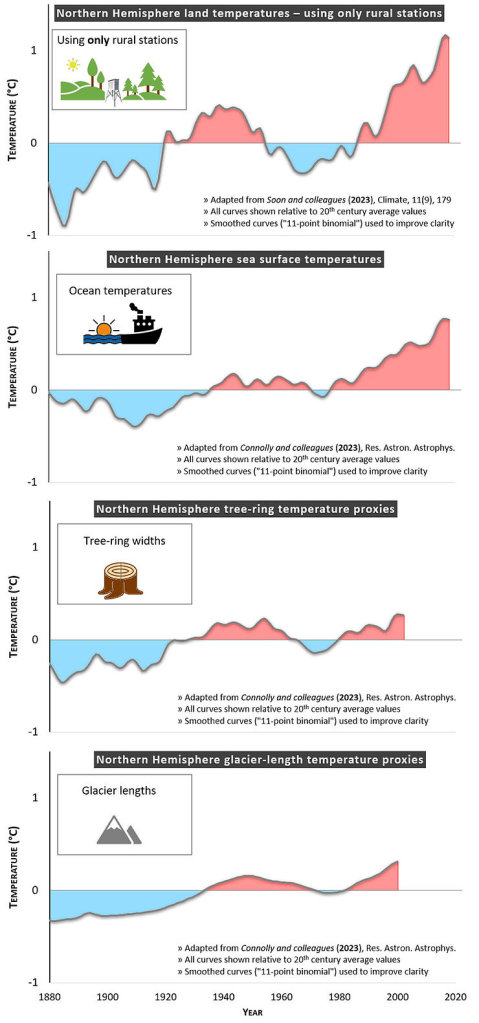

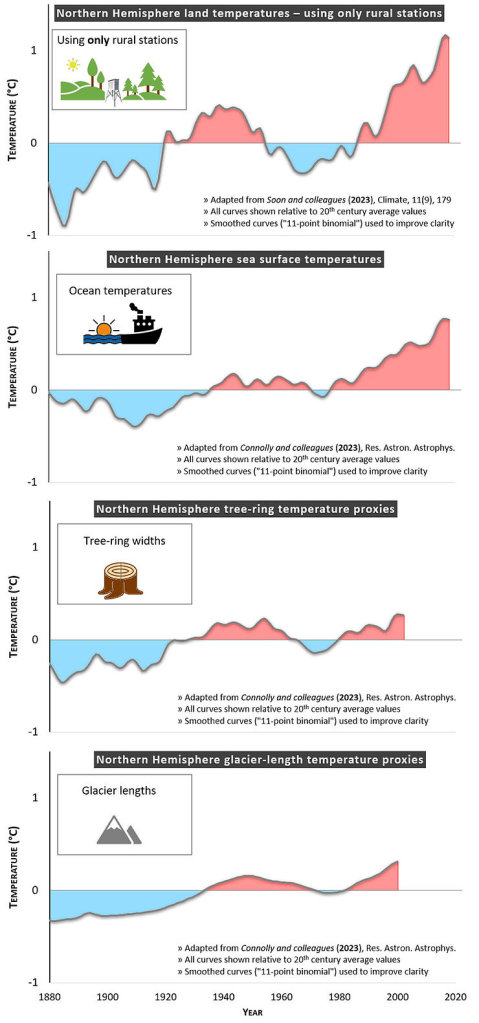

Das obere Paneel zeigt die Standardschätzungen der Landtemperaturen der nördlichen Hemisphäre unter Verwendung aller Stationen – sowohl in Städten als auch in ländlichen Gebieten. Das untere Paneel zeigt unsere Schätzung für die Temperatur auf dem Land.

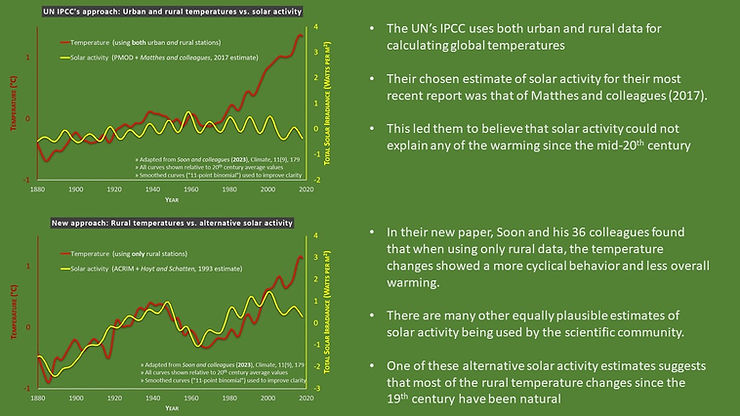

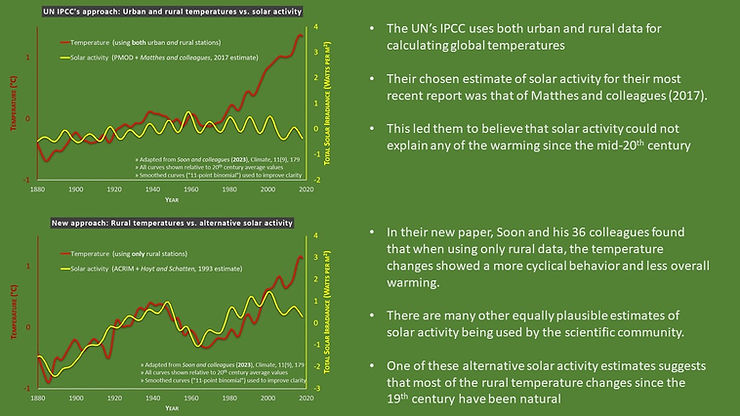

In Soon et al. (2023) – der Studie, über die sich Dr. Schmidt beschwert hat – berücksichtigen wir beide Temperaturschätzungen. Wir berücksichtigen auch zwei verschiedene TSI-Aufzeichnungen – die für die Zurechnungsexperimente im IPCC AR6 verwendete TSI-Reihe von Matthes et al. (2017) und die aktualisierte TSI-Reihe von Hoyt und Schatten, die wir bereits besprochen haben. Im Folgenden finden Sie eine Zusammenfassung einiger unserer wichtigsten Ergebnisse:

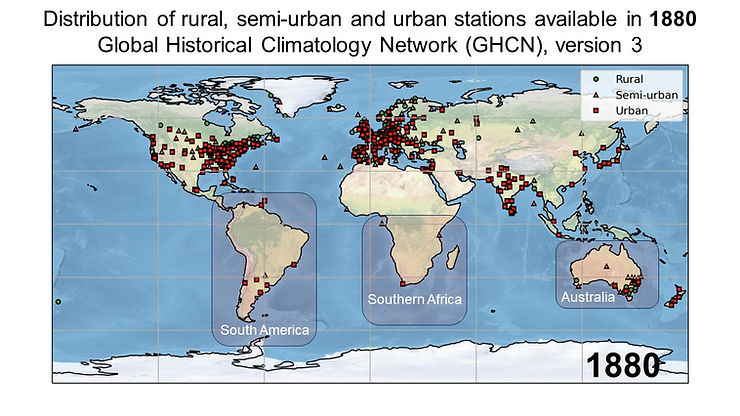

Dr. Schmidt beklagt, dass unsere auf ländliche Gebiete beschränkenden Temperaturaufzeichnungen der nördlichen Hemisphäre nicht zuverlässig sind, weil:

„Es ist keine gute flächige Stichprobe der nördlichen Hemisphäre, es ist keine gute Stichprobe ländlicher Stationen – von denen es viele im restlichen Europa, Australien, dem südlichen Afrika, Südamerika usw. gibt, es ist keine gute Stichprobe langer Stationen (von denen es wiederum viele anderswo gibt).“

Dies ist eine ziemlich clevere, aber irreführende Falschdarstellung der Daten. Beachten Sie, wie er seine Aussage in zwei Teile aufspaltet.

Im ersten Teil sagt er richtigerweise, dass es in anderen Regionen als den von uns analysierten „eine gute Stichprobe ländlicher Stationen“ gibt, aber er vergisst zu erklären, dass es sich dabei meist um Stationen mit kurzen Aufzeichnungen handelt.

Betrachtet man nämlich die Anzahl der im Jahr 2000 verfügbaren Stationen, so gibt es in der Tat viele ländliche Stationen rund um den Globus:

Im zweiten Teil seiner Erklärung stellt er richtig fest, dass es viele lange Stationsaufzeichnungen außerhalb der von uns analysierten Regionen gibt, aber er versäumt es zu erklären, dass sie nicht ländlich sind!

Nachfolgend sind die Stationen aufgeführt, für die Daten aus dem Jahr 1880 vorliegen. Wir haben die drei Regionen der südlichen Hemisphäre hervorgehoben, die wir seiner Meinung nach hätten mit einbeziehen sollen, d. h. Australien, das südliche Afrika und Südamerika:

Verstehen Sie, warum Dr. Schmidts Charakterisierung der verfügbaren Daten unaufrichtig war?

Aber was ist mit anderen Schätzungen der Temperaturen der nördlichen Hemisphäre?

In Soon et al. (2023) haben wir die Erwärmung der Landoberfläche der nördlichen Hemisphäre (1850-2018) anhand der Daten der Wetterstationen bewertet. In Connolly et al. (2023) haben wir jedoch auch drei zusätzliche Temperaturreihen der nördlichen Hemisphäre berücksichtigt. Eine wurde aus den Daten der Meerestemperatur (SST) erstellt. Die beiden anderen basierten auf Temperatur-Proxydaten: (a) Baumring-Temperaturproxydaten oder (b) Gletscherlängen-Temperaturproxydaten.

Dr. Schmidt behauptete, dass unsere nur auf dem Lande gemessenen Temperaturreihen nicht repräsentativ für die Temperaturtrends der nördlichen Hemisphäre seien. Wenn er recht hat, dann würden diese anderen Temperaturschätzungen vermutlich ganz andere Trends zeigen. Schauen wir mal!

Was meinen Sie dazu?

Offensichtlich sind sie nicht genau identisch. Wir sind jedoch der Meinung, dass alle drei alternativen Temperaturschätzungen weitgehend mit unseren reinen Temperaturaufzeichnungen auf dem Land übereinstimmen.

Daher sind wir mit Dr. Schmidts Behauptung nicht einverstanden.

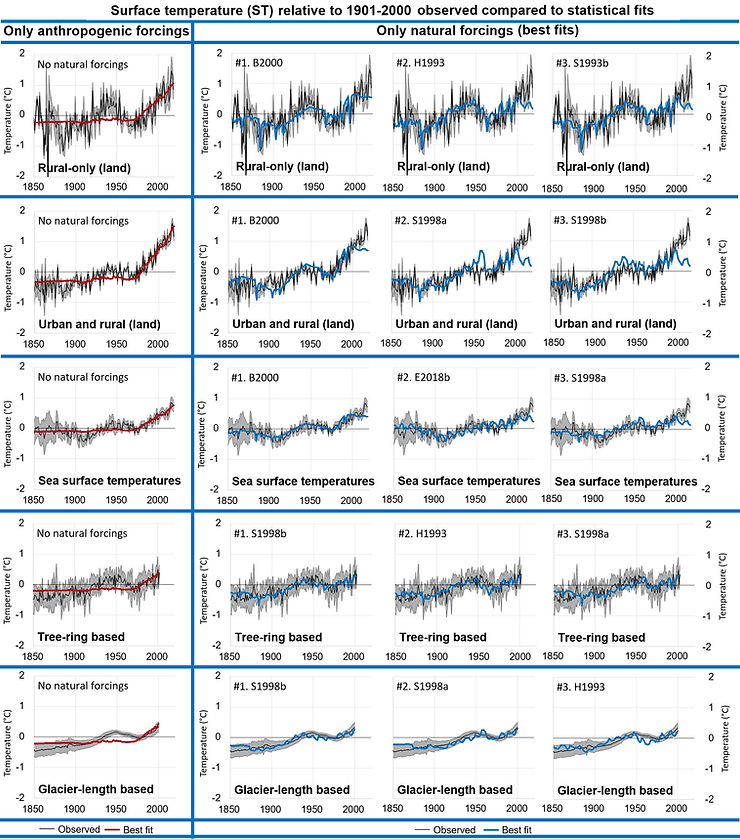

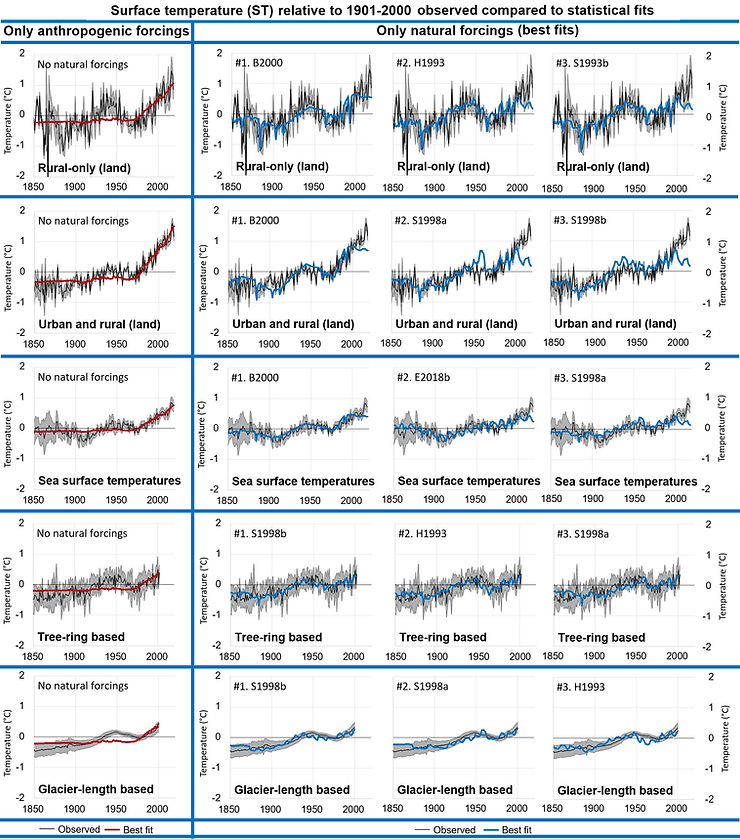

Schließlich, wenn Sie sich an den Anfang erinnern, gefiel Dr. Schmidt die zweite TSI-Reihe nicht, die wir in Soon et al. (2023) analysiert haben. In Connolly et al. (2023) analysierten wir jedoch insgesamt 27 TSI-Serien.

Für jeden Temperaturdatensatz führten wir eine statistische Analyse in Bezug auf die „natürlichen“ und „anthropogenen“ (d. h. vom Menschen verursachten) Klimatreiber durch, die der IPCC für seine Attributionsversuche verwendet. Der IPCC berücksichtigte nur zwei natürliche Faktoren – TSI und Vulkanausbrüche. Wir haben alle Aufzeichnungen des IPCC zu den Klimatreibern verwendet, aber wir haben unsere Analyse unter Verwendung jeder der 27 TSI-Serien der Reihe nach wiederholt.

Sowohl in Connolly et al. (2023) als auch in Soon et al. (2023) verfolgen wir einen ähnlichen Ansatz wie die IPCC-Zuschreibungsanalyse. Das heißt, wir vergleichen die Ergebnisse, die man erhält, wenn man sie berücksichtigt:

1. „Nur natürliche Faktoren“ (die der IPCC als TSI und Vulkanismus definiert)

2. „Nur anthropogene Faktoren“.

3. „Natürliche und anthropogene Faktoren“.

Wenn Sie die Ergebnisse all dieser Kombinationen sehen möchten, empfehlen wir Ihnen, die vollständigen Studien zu lesen. Der Einfachheit halber wollen wir jedoch nur die ersten beiden Kombinationen vergleichen.

In Abbildung 6 von Connolly et al. (2023) haben wir die Anpassungen „nur natürliche Faktoren“ unter Verwendung von drei der am besten passenden TSI-Reihen mit den Anpassungen „nur anthropogene Faktoren“ verglichen. Siehe unten:

Die TSI-Aufzeichnung, über die sich Dr. Schmidt beschwert hat, wird hier als „H1993“ bezeichnet. Beachten Sie jedoch, dass wir für jede Temperaturaufzeichnung ähnlich gute Anpassungen mit anderen TSI-Schätzungen erhalten können.

Schlussfolgerungen

In Soon et al. (2023) kamen wir zu den folgenden zentralen Schlussfolgerungen:

„(1) Die Verzerrung durch die Verstädterung bleibt ein erhebliches Problem für die globalen Landtemperaturdaten; (2) es ist immer noch unklar, welche (wenn überhaupt) der vielen TSI-Zeitreihen in der Literatur genaue Schätzungen der vergangenen TSI sind; (3) die wissenschaftliche Gemeinschaft ist noch nicht in der Lage, mit Sicherheit festzustellen, ob die Erwärmung seit 1850 überwiegend vom Menschen verursacht wurde, überwiegend natürlich ist oder eine Kombination davon.“

Diese Schlussfolgerungen stehen im Einklang mit unseren Ergebnissen in zwei weiteren Studien, die ebenfalls in den letzten Wochen veröffentlicht worden sind – in separaten, von Experten begutachteten Fachzeitschriften und unter Verwendung unterschiedlicher unabhängiger Analysen.

So haben wir in Katata et al. (2023) bestätigt, dass die Schätzung des IPCC zum Ausmaß der Verstädterung in den globalen Temperaturdaten viel zu niedrig ist. In Connolly et al. (2023) kamen wir hingegen zu dem Schluss, dass es „unklar ist, ob die beobachtete Erwärmung überwiegend vom Menschen verursacht wurde, überwiegend natürlich ist oder eine Kombination aus beidem darstellt“.

Dr. Schmidt und das RealClimate-Team wollen offenbar nicht, dass Sie unsere Studien lesen. Sie scheinen zu befürchten, dass ihre Behauptungen über den Klimawandel dann nicht mehr so überzeugend erscheinen würden.

Im Gegensatz dazu haben wir keine Angst davor, dass Menschen Studien lesen, die nicht mit uns übereinstimmen. Wir ermutigen die Menschen sogar dazu, mehrere wissenschaftliche Perspektiven zu lesen und sich ihre eigene Meinung zu bilden.

Nachstehend finden Sie Links zu den oben genannten Studien. Lesen Sie ruhig alle, die für Sie von Interesse sind!

References mentioned

- W. Soon, R. Connolly, M. Connolly, S.-I. Akasofu, S. Baliunas, J. Berglund, A. Bianchini, W.M. Briggs, C.J. Butler, R.G. Cionco, M. Crok, A.G. Elias, V.M. Fedorov, F. Gervais, H. Harde, G.W. Henry, D.V. Hoyt, O. Humlum, D.R. Legates, A.R. Lupo, S. Maruyama, P. Moore, M. Ogurtsov, C. ÓhAiseadha, M.J. Oliveira, S.-S. Park, S. Qiu, G. Quinn, N. Scafetta, J.-E. Solheim, J. Steele, L. Szarka, H.L. Tanaka, M.K. Taylor, F. Vahrenholt, V.M. Velasco Herrera and W. Zhang (2023). „The Detection and Attribution of Northern Hemisphere Land Surface Warming (1850–2018) in Terms of Human and Natural Factors: Challenges of Inadequate Data“, Climate, 11(9), 179; https://doi.org/10.3390/cli11090179. (Open access)

- R. Connolly, W. Soon, M. Connolly, S. Baliunas, J. Berglund, C.J. Butler, R.G. Cionco, A.G. Elias, V. Fedorov, H. Harde, G.W. Henry, D.V. Hoyt, O. Humlum, D.R. Legates, N. Scafetta, J.-E. Solheim, L. Szarka, V.M. Velasco Herrera, H. Yan and W.J. Zhang (2023). „Challenges in the detection and attribution of Northern Hemisphere surface temperature trends since 1850“. Research in Astronomy and Astrophysics. https://doi.org/10.1088/1674-4527/acf18e. (Still in press, but pre-print available here)

- G. Katata, R. Connolly and P. O’Neill (2023). „Evidence of urban blending in homogenized temperature records in Japan and in the United States: implications for the reliability of global land surface air temperature data“. Journal of Applied Meteorology and Climatology. 62(8), 1095-1114. https://doi.org/10.1175/JAMC-D-22-0122.1. (Open access)

- R. Connolly, W. Soon, M. Connolly, S. Baliunas, J. Berglund, C. J. Butler, R. G. Cionco, A. G. Elias, V. M. Fedorov, H. Harde, G. W. Henry, D. V. Hoyt, O. Humlum, D. R. Legates, S. Lüning, N. Scafetta, J.-E. Solheim, L. Szarka, H. van Loon, V. M. Velasco Herrera, R. C. Willson, H. Yan and W. Zhang (2021). “How much has the Sun influenced Northern Hemisphere temperature trends? An ongoing debate”. Research in Astronomy and Astrophysics, 21, 131. https://doi.org/10.1088/1674-4527/21/6/131. (Open access)

- M.T. Richardson and R.E. Benestad (2022). „Erroneous use of Statistics behind Claims of a Major Solar Role in Recent Warming“. Research in Astronomy and Astrophysics, 22, 125008. http://dx.doi.org/10.1088/1674-4527/ac981c. (pdf available here).

- N. Scafetta, R.C. Willson, J.N. Lee and D.L. Wu (2019). „Modeling Quiet Solar Luminosity Variability from TSI Satellite Measurements and Proxy Models during 1980–2018“. Remote Sensing. 11(21), 2569. https://doi.org/10.3390/rs11212569. (Open access)

- Montillet, J.-P., Finsterle, W., Kermarrec, G., Sikonja, R., Haberreiter, M., Schmutz, W., & Dudok de Wit, T. (2022). „Data fusion of total solar irradiance composite time series using 41 years of satellite measurements“. Journal of Geophysical Research: Atmospheres, 127, e2021JD036146. https://doi.org/10.1029/2021JD036146. (Preprint here)

- S. Dewitte and S. Nevens (2016). „The Total Solar Irradiance Climate Data Record“. The Astrophysical Journal, 830 25. https://doi.org/10.3847/0004-637X/830/1/25 (Open access).

- T. Dudok de Wit, G. Kopp, C. Fröhlich and M. Schöll (2017). „Methodology to create a new total solar irradiance record: Making a composite out of multiple data records“. Geophysical Research Letters, 44(3), 1196-1203. https://doi.org/10.1002/2016GL071866. (Open access)

- K. Matthes, B. Funke, M.E. Andersson, L. Barnard, J. Beer, P. Charbonneau, M.A. Clilverd, T. Dudok de Wit, M. Haberreiter, A. Hendry, C.H. Jackman, M. Kretzschmar, T. Kruschke, M. Kunze, U. Langematz, D.R. Marsh, A.C. Maycock, S. Misios, C.J. Rodger, A.A. Scaife, A. Seppälä, M. Shangguan, M. Sinnhuber, K. Tourpali, I. Usoskin, M. van de Kamp, P.T. Verronen and S. Versick (2017) „Solar forcing for CMIP6 (v3.2)“. Geoscientific Model Development, 10, 2247–2302. https://doi.org/10.5194/gmd-10-2247-2017 . (Open access).

- N. A. Krivova, L. Balmaceda and S. K. Solanki (2007). „Reconstruction of solar total irradiance since 1700 from the surface magnetic flux“. Astronomy and Astrophysics, 467, 335-346. https://doi.org/10.1051/0004-6361:20066725 . (Open access).

- O. Coddington, J.L. Lean, P. Pilewskie, M. Snow and D. Lindholm (2016). “A Solar Irradiance Climate Data Record”. Bulletin of the American Meteorological Society, 97(7), 1265-1282. https://doi.org/10.1175/BAMS-D-14-00265.1 . (Open access)

- S. Dewitte, J. Cornelis and M. Meftah (2022). „Centennial Total Solar Irradiance Variation“, Remote Sensing, 14(5), 1072. https://doi.org/10.3390/rs14051072 . (Open access)

- T. Egorova, W. Schmutz, E. Rozanov, A.I. Shapiro, I. Usoskin, J. Beer, R.V. Tagirov and T. Peter (2018). „Revised historical solar irradiance forcing“. Astronomy and Astrophysics, 615, A85. https://doi.org/10.1051/0004-6361/201731199 (Open access)

- D.V. Hoyt and K.H. Schatten (1993). „A discussion of plausible solar irradiance variations, 1700-1992“. Journal of Geophysical Research Space Physics, 98(A11), 18895-18906. https://doi.org/10.1029/93JA01944 . (pdf available here)

- V. Penza, F. Berrilli, L. Bertello, M. Cantoresi, S. Criscuoli and P. Giobbi (2022). „Total Solar Irradiance during the Last Five Centuries“. The Astrophysical Journal, 937(2), 84. https://doi.org/10.3847/1538-4357/ac8a4b . (Open access).

- W. W.-H. Soon (2005). „Variable solar irradiance as a plausible agent for multidecadal variations in the Arctic-wide surface air temperature record of the past 130 years“. Geophysical Research Letters. 32, 16. https://doi.org/10.1029/2005GL023429 (Open access)

- W. W.-H. Soon (2009). „Solar Arctic-Mediated Climate Variation on Multidecadal to Centennial Timescales: Empirical Evidence, Mechanistic Explanation, and Testable Consequences“. Physical Geography. 30, 144-184. https://doi.org/10.2747/0272-3646.30.2.144 (pdf available here).

- W. Soon, Ronan Connolly and M. Connolly (2015). “Re-evaluating the role of solar variability on Northern Hemisphere temperature trends since the 19th century”. Earth-Science Reviews, 150, 409-452. https://doi.org/10.1016/j.earscirev.2015.08.010. (Preprint version)

- P. O’Neill, R. Connolly, M. Connolly, W. Soon, B. Chimani, M. Crok, R. de Vos, H. Harde, P. Kajaba, P. Nojarov, R. Przybylak, D. Rasol, Oleg Skrynyk, Olesya Skrynyk, P. Štěpánek, A. Wypych and P. Zahradníček (2022). “Evaluation of the homogenization adjustments applied to European temperature records in the Global Historical Climatology Network dataset”. Atmosphere, 13(2), 285. https://doi.org/10.3390/atmos13020285. (Open access)

- W.W-H. Soon, R. Connolly, M. Connolly, P. O’Neill, J. Zheng, Q. Ge, Z. Hao and H. Yan (2018). Comparing the current and early 20th century warm periods in China. Earth-Science Reviews, 185, 80-101. https://doi.org/10.1016/j.earscirev.2018.05.013. (Preprint version)

- G.A. Schmidt, J.H. Jungclaus, C.M. Ammann, E. Bard, P. Braconnot, T.J. Crowley, G. Delaygue, F. Joos, N.A. Krivova, R. Muscheler, B.L. Otto-Bliesner, J. Pongratz, D.T. Shindell, S.K. Solanki, F. Steinhilber, and L.E.A. Vieira (2011). “Climate forcing reconstructions for use in PMIP simulations of the last millennium (v1.0)”. Geoscientific Model Development, 4, 33–45, https://doi.org/10.5194/gmd-4-33-2011. (Open access).

Link: https://www.ceres-science.com/post/reply-to-erroneous-claims-by-realclimate-org-on-our-research-into-the-sun-s-role-in-climate-change

Übersetzt von Christian Freuer für das EIKE